Det här inlägget är skrivet av Jyoti Sharma och Sharmo Sarkar från Vericast.

För alla problem med maskininlärning (ML) börjar datavetaren med att arbeta med data. Detta inkluderar att samla in, utforska och förstå de affärsmässiga och tekniska aspekterna av data, tillsammans med utvärdering av eventuella manipulationer som kan behövas för modellbyggeprocessen. En aspekt av denna dataförberedelse är funktionsteknik.

Funktionsteknik hänvisar till processen där relevanta variabler identifieras, väljs ut och manipuleras för att omvandla rådata till mer användbara och användbara former för användning med ML-algoritmen som används för att träna en modell och utföra slutsatser mot den. Målet med denna process är att öka prestandan hos algoritmen och den resulterande prediktiva modellen. Funktionsutvecklingsprocessen omfattar flera steg, inklusive skapande av funktioner, datatransformation, extrahering av funktioner och val av funktioner.

Att bygga en plattform för generaliserad funktionsteknik är en vanlig uppgift för kunder som behöver producera många ML-modeller med olika datamängder. Denna typ av plattform inkluderar skapandet av en programmatiskt driven process för att producera färdigställd, funktionskonstruerad data redo för modellträning med lite mänsklig inblandning. Det är dock en utmaning att generalisera funktionsteknik. Varje affärsproblem är olika, varje datauppsättning är olika, datavolymerna varierar kraftigt från klient till klient, och datakvalitet och ofta kardinalitet för en viss kolumn (när det gäller strukturerad data) kan spela en betydande roll för komplexiteten i funktionstekniken bearbeta. Dessutom kan den dynamiska karaktären hos en kunds data också resultera i en stor variation av bearbetningstid och resurser som krävs för att optimalt slutföra funktionsutvecklingen.

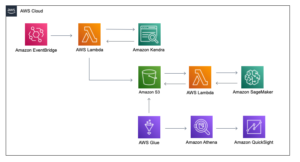

AWS kund Vericast är ett marknadsföringslösningsföretag som fattar datadrivna beslut för att öka marknadsförings-ROI för sina kunder. Vericasts interna molnbaserade Machine Learning Platform, byggd kring CRISP-ML(Q)-processen, använder olika AWS-tjänster, bl.a. Amazon SageMaker, Amazon SageMaker-bearbetning, AWS Lambdaoch AWS stegfunktioner, för att ta fram bästa möjliga modeller som är skräddarsydda för den specifika kundens data. Den här plattformen syftar till att fånga repeterbarheten av stegen som går till att bygga olika ML-arbetsflöden och bunta ihop dem i standardiserade generaliserbara arbetsflödesmoduler inom plattformen.

I det här inlägget delar vi hur Vericast optimerade funktionsteknik med SageMaker Processing.

Lösningsöversikt

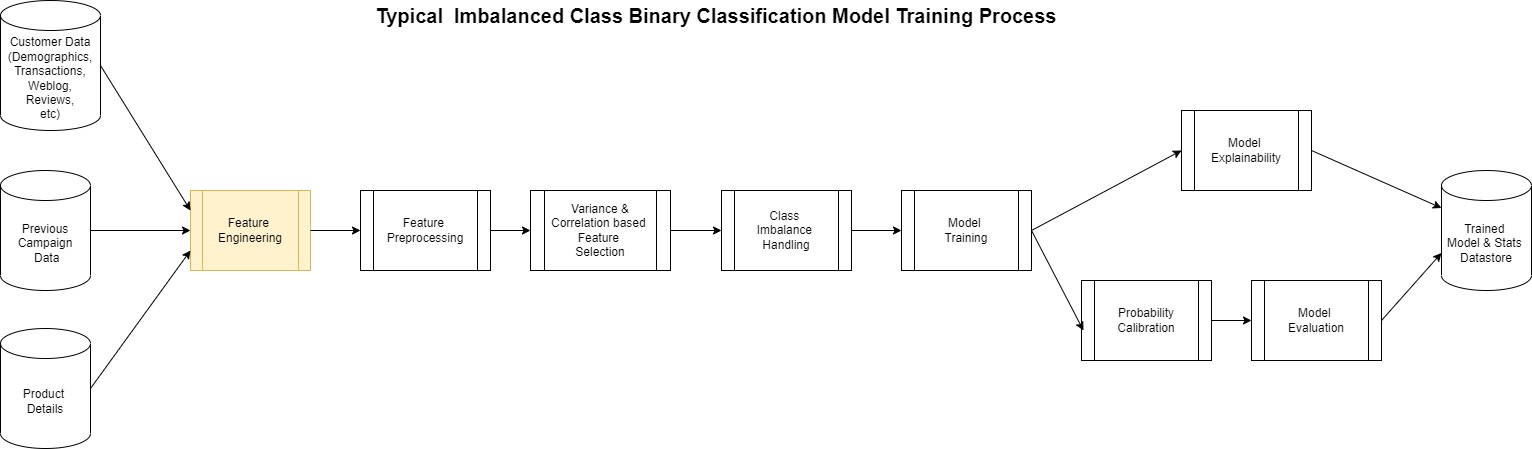

Vericasts maskininlärningsplattform hjälper till med snabbare implementering av nya affärsmodeller baserade på befintliga arbetsflöden eller snabbare aktivering av befintliga modeller för nya kunder. Till exempel är en modell som förutsäger direktreklambenägenhet ganska annorlunda från en modell som förutsäger rabattkupongkänslighet för kunderna hos en Vericast-klient. De löser olika affärsproblem och har därför olika användningsscenarier i en marknadsföringskampanjdesign. Men ur en ML-synpunkt kan båda tolkas som binära klassificeringsmodeller och kan därför dela många gemensamma steg ur ett ML-arbetsflödesperspektiv, inklusive modellinställning och utbildning, utvärdering, tolkningsbarhet, implementering och slutledning.

Eftersom dessa modeller är binära klassificeringsproblem (i ML-termer) delar vi upp ett företags kunder i två klasser (binära): de som skulle svara positivt på kampanjen och de som inte skulle göra det. Dessutom anses dessa exempel vara en obalanserad klassificering eftersom data som används för att träna modellen inte skulle innehålla lika många kunder som skulle och inte skulle svara positivt.

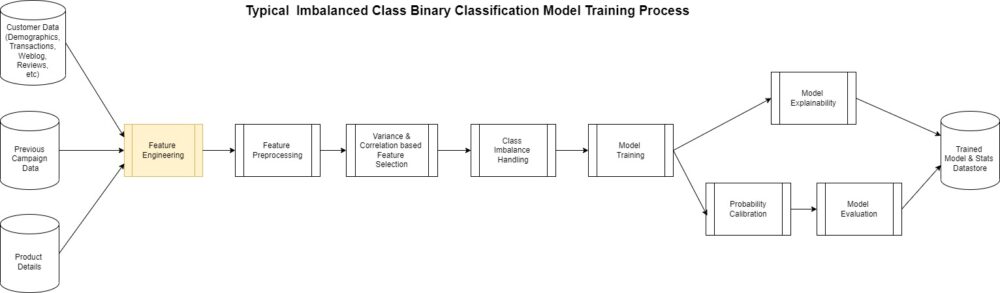

Själva skapandet av en modell som denna följer det generaliserade mönstret som visas i följande diagram.

Det mesta av denna process är densamma för alla binära klassificeringar utom för funktionstekniksteget. Detta är kanske det mest komplicerade men ibland förbisedda steget i processen. ML-modeller är till stor del beroende av de funktioner som används för att skapa den.

Vericasts molnbaserade maskininlärningsplattform syftar till att generalisera och automatisera funktionsteknikstegen för olika ML-arbetsflöden och optimera deras prestanda utifrån en kostnad kontra tid-statistik genom att använda följande funktioner:

- Plattformens funktionsteknikbibliotek – Detta består av en ständigt föränderlig uppsättning transformationer som har testats för att ge högkvalitativa generaliserbara funktioner baserade på specifika kundkoncept (till exempel kunddemografi, produktinformation, transaktionsdetaljer och så vidare).

- Intelligenta resursoptimerare – Plattformen använder AWS:s on-demand-infrastrukturkapacitet för att spinna upp den mest optimala typen av bearbetningsresurser för det specifika funktionsteknikjobbet baserat på stegets förväntade komplexitet och mängden data som det behöver föras igenom.

- Dynamisk skalning av funktionsteknikjobb – En kombination av olika AWS-tjänster används för detta, men framför allt SageMaker Processing. Detta säkerställer att plattformen producerar funktioner av hög kvalitet på ett kostnadseffektivt och i rätt tid.

Det här inlägget fokuserar på den tredje punkten i den här listan och visar hur man uppnår dynamisk skalning av SageMaker Processing-jobb för att uppnå en mer hanterad, prestanda och kostnadseffektiv databehandlingsram för stora datavolymer.

SageMaker Processing möjliggör arbetsbelastningar som kör steg för dataförbearbetning eller efterbearbetning, funktionsteknik, datavalidering och modellutvärdering på SageMaker. Det tillhandahåller också en hanterad miljö och tar bort komplexiteten i odifferentierade tunga lyft som krävs för att installera och underhålla den infrastruktur som behövs för att köra arbetsbelastningen. Dessutom tillhandahåller SageMaker Processing ett API-gränssnitt för att köra, övervaka och utvärdera arbetsbelastningen.

Köra SageMaker Bearbetning av jobb sker helt inom ett hanterat SageMaker-kluster, med enskilda jobb placerade i instansbehållare under körning. Det hanterade klustret, instanserna och behållarna rapporterar mätvärden till amazoncloudwatch, inklusive användning av GPU, CPU, minne, GPU-minne, diskmått och händelseloggning.

Dessa funktioner ger fördelar för Vericasts dataingenjörer och forskare genom att hjälpa till med utvecklingen av generaliserade förbearbetningsarbetsflöden och ta bort svårigheten att underhålla genererade miljöer för att köra dem. Tekniska problem kan dock uppstå med tanke på den dynamiska karaktären hos datan och dess olika egenskaper som kan matas in i en sådan generell lösning. Systemet måste göra en välgrundad första gissning om storleken på klustret och de instanser som utgör det. Denna gissning måste utvärdera kriterierna för data och härleda kraven på CPU, minne och disk. Denna gissning kan vara helt lämplig och fungera adekvat för jobbet, men i andra fall kanske den inte. För en given datauppsättning och förbearbetningsjobb kan CPU:n vara underdimensionerad, vilket resulterar i maximal bearbetningsprestanda och långa tider att slutföra. Ännu värre kan minnet bli ett problem, vilket resulterar i antingen dålig prestanda eller minnesstörningar som gör att hela jobbet misslyckas.

Med dessa tekniska hinder i åtanke satte Vericast sig för att skapa en lösning. De behövde förbli allmänna till sin natur och passa in i den större bilden av att förbearbetningsarbetsflödet var flexibelt i de inblandade stegen. Det var också viktigt att lösa både det potentiella behovet av att skala upp miljön i fall där prestanda äventyras och att graciöst återhämta sig från en sådan händelse eller när ett jobb avslutades i förtid av någon anledning.

Lösningen byggd av Vericast för att lösa detta problem använder flera AWS-tjänster som arbetar tillsammans för att nå sina affärsmål. Det designades för att starta om och skala upp SageMaker Processing-klustret baserat på prestandamått som observerats med hjälp av Lambda-funktioner som övervakar jobben. För att inte förlora arbete när en skalningshändelse äger rum eller för att återhämta sig från ett jobb som oväntat upphör, infördes en checkpoint-baserad tjänst som använder Amazon DynamoDB och lagrar de delvis bearbetade uppgifterna i Amazon enkel lagringstjänst (Amazon S3) hinkar när stegen är klara. Det slutliga resultatet är en automatisk skalning, robust och dynamiskt övervakad lösning.

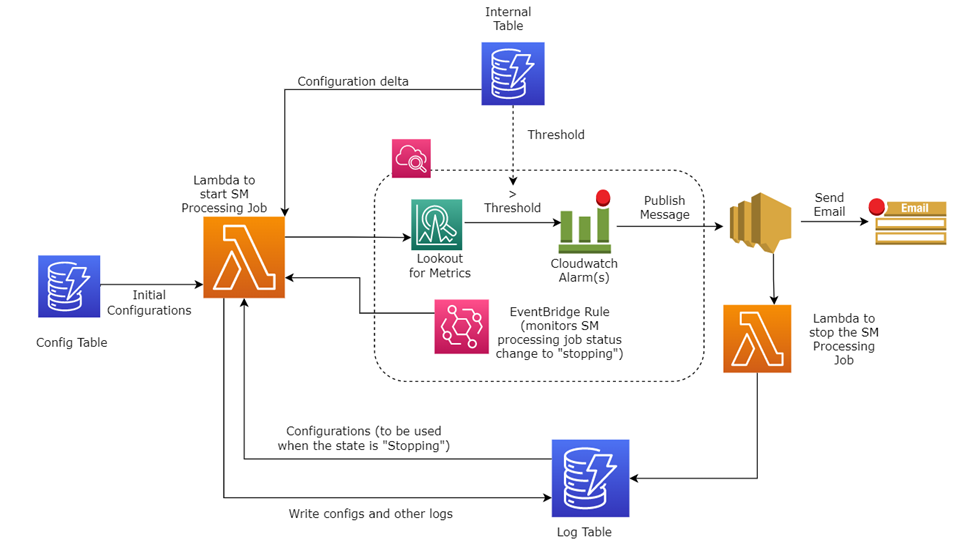

Följande diagram visar en översikt över hur systemet fungerar på hög nivå.

I de följande avsnitten diskuterar vi lösningskomponenterna mer i detalj.

Initiera lösningen

Systemet förutsätter att en separat process initierar lösningen. Omvänt är den här designen inte designad för att fungera ensam eftersom den inte kommer att ge några artefakter eller utdata, utan fungerar snarare som en sidovagnsimplementering till ett av systemen som använder SageMaker Processing-jobb. I Vericasts fall initieras lösningen genom ett anrop från ett Step Functions-steg som startas i en annan modul i det större systemet.

När lösningen initierats och en första körning utlöses läses en basstandardkonfiguration från en DynamoDB-tabell. Denna konfiguration används för att ställa in parametrar för SageMaker Processing-jobbet och har de initiala antagandena om infrastrukturbehov. SageMaker Processing-jobbet är nu påbörjat.

Övervakning av metadata och output

När jobbet startar skriver en lambdafunktion jobbbearbetningsmetadata (den aktuella jobbkonfigurationen och annan logginformation) till DynamoDB-loggtabellen. Denna metadata och logginformation upprätthåller en historik över jobbet, dess initiala och pågående konfiguration och andra viktiga data.

Vid vissa punkter, när stegen är klara i jobbet, läggs kontrollpunktsdata till i DynamoDB-loggtabellen. Bearbetade utdata flyttas till Amazon S3 för snabb återställning om det behövs.

Denna Lambda-funktion ställer också in en Amazon EventBridge regel som övervakar det pågående jobbet för dess tillstånd. Specifikt är denna regel att titta på jobbet för att observera om jobbstatusen ändras till stopping eller är i en stopped stat. Denna EventBridge-regel spelar en viktig roll för att starta om ett jobb om det uppstår ett fel eller en planerad automatisk skalningshändelse inträffar.

Övervakning av CloudWatch-statistik

Lambdafunktionen ställer också in ett CloudWatch-larm baserat på ett metriskt matematiskt uttryck på bearbetningsjobbet, som övervakar mätvärdena för alla instanser för CPU-användning, minnesanvändning och diskutnyttjande. Denna typ av larm (mått) använder CloudWatch larmtrösklar. Larmet genererar händelser baserat på värdet på måttet eller uttrycket i förhållande till tröskelvärdena under ett antal tidsperioder.

I Vericasts användningsfall är tröskelvärdesuttrycket utformat för att betrakta drivrutinen och exekveringsinstanserna som separata, med mätvärden som övervakas individuellt för var och en. Genom att separera dem vet Vericast vad som orsakar larmet. Detta är viktigt för att bestämma hur man ska skala därefter:

- Om exekveringsmåtten passerar tröskeln är det bra att skala horisontellt

- Om förarmåtten passerar tröskeln kommer det troligen inte att hjälpa att skala horisontellt, så vi måste skala vertikalt

Uttryck för larmmått

Vericast kan komma åt följande mätvärden i sin utvärdering för skalning och misslyckande:

- CPUUtilization – Summan av varje enskild CPU-kärnas utnyttjande

- Minnesanvändning – Procentandelen minne som används av behållarna på en instans

- DiskUtilization – Procentandelen diskutrymme som används av behållarna på en instans

- GPUUtilization – Andelen GPU-enheter som används av behållarna på en instans

- GPUMemoryUtilization – Procentandelen GPU-minne som används av behållarna på en instans

När detta skrivs, överväger Vericast bara CPUUtilization, MemoryUtilizationoch DiskUtilization. I framtiden tänker de överväga GPUUtilization och GPUMemoryUtilization också.

Följande kod är ett exempel på ett CloudWatch-larm baserat på ett metriskt matematiskt uttryck för Vericast automatisk skalning:

Detta uttryck illustrerar att CloudWatch-larmet överväger DriverMemoryUtilization (memoryDriver), CPUUtilization (cpuDriver), DiskUtilization (diskDriver), ExecutorMemoryUtilization (memoryExec), CPUUtilization (cpuExec)och DiskUtilization (diskExec) som övervakningsmått. Siffran 80 i det föregående uttrycket står för tröskelvärdet.

Här, IF((cpuDriver) > 80, 1, 0 innebär att om drivrutinen CPU-användning överstiger 80 %, tilldelas 1 som tröskeln annars 0. IF(AVG(METRICS("memoryExec")) > 80, 1, 0 innebär att alla mätvärden med sträng memoryExec i den beaktas och ett genomsnitt beräknas på det. Om den genomsnittliga minnesanvändningsprocenten överstiger 80, tilldelas 1 som tröskeln annars 0.

Den logiska operatorn OR används i uttrycket för att förena alla användningar i uttrycket – om någon av användningarna når sin tröskel, utlöser du larmet.

För mer information om hur du använder CloudWatch metriska larm baserade på metriska matematiska uttryck, se Skapa ett CloudWatch-larm baserat på ett metriskt matematiskt uttryck.

CloudWatch larmbegränsningar

CloudWatch begränsar antalet mätvärden per larm till 10. Detta kan orsaka begränsningar om du behöver överväga fler mätvärden än så här.

För att övervinna denna begränsning har Vericast ställt in larm baserat på den totala klusterstorleken. Ett larm skapas per tre instanser (för tre instanser kommer det att finnas ett larm eftersom det skulle lägga till nio mätvärden). Förutsatt att förarinstansen ska betraktas separat skapas ytterligare ett separat larm för förarinstansen. Därför motsvarar det totala antalet larm som skapas ungefär en tredjedel av antalet executornoder och ytterligare en för förarinstansen. I varje fall är antalet mätvärden per larm under gränsen på 10 mätvärden.

Vad händer i ett larmläge

Om ett förutbestämt tröskelvärde uppnås går larmet till en alarm stat, som använder Amazon enkel meddelandetjänst (Amazon SNS) för att skicka ut meddelanden. I det här fallet skickar den ut ett e-postmeddelande till alla prenumeranter med detaljerna om larmet i meddelandet.

Amazon SNS används också som en trigger till en Lambda-funktion som stoppar det för närvarande pågående SageMaker Processing-jobbet eftersom vi vet att jobbet förmodligen kommer att misslyckas. Den här funktionen registrerar även loggar till loggtabellen relaterade till händelsen.

EventBridge-regeln som ställs in vid jobbstart kommer att märka att jobbet har gått in i en stopping ange några sekunder senare. Denna regel kör sedan om den första Lambda-funktionen för att starta om jobbet.

Den dynamiska skalningsprocessen

Den första Lambda-funktionen efter att ha kört två eller flera gånger kommer att veta att ett tidigare jobb redan hade påbörjats och nu har slutat. Funktionen kommer att gå igenom en liknande process för att hämta baskonfigurationen från det ursprungliga jobbet i loggen DynamoDB-tabellen och kommer även att hämta uppdaterad konfiguration från den interna tabellen. Denna uppdaterade konfiguration är en resursdeltakonfiguration som ställs in baserat på skalningstypen. Skalningstypen bestäms utifrån larmetadata som beskrivits tidigare.

Den ursprungliga konfigurationen plus resursdeltan används eftersom en ny konfiguration och ett nytt SageMaker Processing-jobb startas med de ökade resurserna.

Denna process fortsätter tills jobbet slutförs framgångsrikt och kan resultera i flera omstarter efter behov, vilket lägger till fler resurser varje gång.

Vericasts resultat

Denna anpassade automatiska skalningslösning har varit avgörande för att göra Vericasts maskininlärningsplattform mer robust och feltolerant. Plattformen kan nu graciöst hantera arbetsbelastningar av olika datavolymer med minimal mänsklig inblandning.

Innan den här lösningen implementerades var en uppskattning av resurskraven för alla Spark-baserade moduler i pipeline en av de största flaskhalsarna i den nya klientintroduktionsprocessen. Arbetsflöden skulle misslyckas om klientdatavolymen ökade, eller kostnaden skulle vara oförsvarlig om datavolymen minskade i produktionen.

Med denna nya modul på plats har arbetsflödesfel på grund av resursbegränsningar minskat med nästan 80 %. De få återstående felen beror mest på AWS-kontobegränsningar och bortom den automatiska skalningsprocessen. Vericasts största vinst med denna lösning är den lätthet med vilken de kan ta in nya kunder och arbetsflöden. Vericast räknar med att påskynda processen med minst 60–70 %, med data som fortfarande återstår att samla in för ett slutligt antal.

Även om detta ses som en framgång av Vericast, finns det en kostnad som följer med det. Baserat på denna moduls karaktär och konceptet med dynamisk skalning som helhet, tenderar arbetsflödena att ta cirka 30 % längre tid (genomsnittligt fall) än ett arbetsflöde med ett specialanpassat kluster för varje modul i arbetsflödet. Vericast fortsätter att optimera på detta område och försöker förbättra lösningen genom att införliva heuristikbaserad resursinitiering för varje klientmodul.

Sharmo Sarkar, Senior Manager, Machine Learning Platform på Vericast, säger: "När vi fortsätter att utöka vår användning av AWS och SageMaker, ville jag ta en stund för att lyfta fram det otroliga arbetet som vårt AWS Client Services Team, dedikerade AWS Solutions Architects, utför, och AWS Professional Services som vi arbetar med. Deras djupa förståelse för AWS och SageMaker gjorde det möjligt för oss att designa en lösning som mötte alla våra behov och gav oss den flexibilitet och skalbarhet vi krävde. Vi är så tacksamma över att ha ett så talangfullt och kunnigt supportteam på vår sida.”

Slutsats

I det här inlägget delade vi hur SageMaker och SageMaker Processing har gjort det möjligt för Vericast att bygga ett hanterat, presterande och kostnadseffektivt ramverk för databehandling för stora datavolymer. Genom att kombinera kraften och flexibiliteten hos SageMaker Processing med andra AWS-tjänster kan de enkelt övervaka den generaliserade funktionsutvecklingsprocessen. De kan automatiskt upptäcka potentiella problem som genereras av brist på beräkning, minne och andra faktorer och automatiskt implementera vertikal och horisontell skalning efter behov.

SageMaker och dess verktyg kan också hjälpa ditt team att nå sina ML-mål. För att lära dig mer om SageMaker Processing och hur det kan hjälpa till med dina arbetsbelastningar för databearbetning, se Bearbeta data. Om du precis har börjat med ML och letar efter exempel och vägledning, Amazon SageMaker JumpStart kan komma igång. JumpStart är ett ML-nav från vilket du kan komma åt inbyggda algoritmer med förutbildade grundmodeller för att hjälpa dig utföra uppgifter som artikelsammanfattning och bildgenerering och förbyggda lösningar för att lösa vanliga användningsfall.

Slutligen, om det här inlägget hjälper dig eller inspirerar dig att lösa ett problem, vill vi gärna höra om det! Dela gärna dina kommentarer och feedback.

Om författarna

Anthony McClure är Senior Partner Solutions Architect med AWS SaaS Factory-teamet. Anthony har också ett starkt intresse för maskininlärning och artificiell intelligens och arbetar med AWS ML/AI Technical Field Community för att hjälpa kunder att förverkliga sina maskininlärningslösningar.

Anthony McClure är Senior Partner Solutions Architect med AWS SaaS Factory-teamet. Anthony har också ett starkt intresse för maskininlärning och artificiell intelligens och arbetar med AWS ML/AI Technical Field Community för att hjälpa kunder att förverkliga sina maskininlärningslösningar.

Jyoti Sharma är en Data Science Engineer med maskininlärningsplattformsteamet på Vericast. Hon brinner för alla aspekter av datavetenskap och fokuserar på att designa och implementera en mycket skalbar och distribuerad Machine Learning-plattform.

Jyoti Sharma är en Data Science Engineer med maskininlärningsplattformsteamet på Vericast. Hon brinner för alla aspekter av datavetenskap och fokuserar på att designa och implementera en mycket skalbar och distribuerad Machine Learning-plattform.

Sharmo Sarkar är Senior Manager på Vericast. Han leder Cloud Machine Learning Platform och Marketing Platform ML R&D Teams på Vericast. Han har lång erfarenhet av Big Data Analytics, Distributed Computing och Natural Language Processing. Utanför jobbet tycker han om att motorcykla, vandra och cykla på bergsstigar.

Sharmo Sarkar är Senior Manager på Vericast. Han leder Cloud Machine Learning Platform och Marketing Platform ML R&D Teams på Vericast. Han har lång erfarenhet av Big Data Analytics, Distributed Computing och Natural Language Processing. Utanför jobbet tycker han om att motorcykla, vandra och cykla på bergsstigar.

- SEO-drivet innehåll och PR-distribution. Bli förstärkt idag.

- PlatoAiStream. Web3 Data Intelligence. Kunskap förstärkt. Tillgång här.

- Minting the Future med Adryenn Ashley. Tillgång här.

- Köp och sälj aktier i PRE-IPO-företag med PREIPO®. Tillgång här.

- Källa: https://aws.amazon.com/blogs/machine-learning/how-vericast-optimized-feature-engineering-using-amazon-sagemaker-processing/

- : har

- :är

- :inte

- :var

- $UPP

- 1

- 10

- 100

- 15%

- 7

- a

- Om Oss

- tillgång

- i enlighet med detta

- Konto

- Uppnå

- aktivering

- handlingar

- lägga till

- lagt till

- tillsats

- Annat

- adekvat

- Efter

- mot

- AIDS

- Syftet

- larm

- algoritm

- algoritmer

- Alla

- ensam

- längs

- redan

- också

- amason

- Amazon SageMaker

- mängd

- an

- analytics

- och

- Annan

- Anthony

- vilken som helst

- api

- lämpligt

- arkitektur

- ÄR

- OMRÅDE

- runt

- Artikeln

- konstgjord

- artificiell intelligens

- AS

- aspekt

- aspekter

- delad

- bistå

- At

- bil

- automatisera

- automatiskt

- genomsnitt

- AWS

- AWS professionella tjänster

- bas

- baserat

- BE

- därför att

- blir

- varit

- Där vi får lov att vara utan att konstant prestera,

- Fördelarna

- BÄST

- Bortom

- Stor

- Stora data

- störst

- lyft

- båda

- Föra

- SLUTRESULTAT

- Byggnad

- byggt

- inbyggd

- företag

- men

- by

- beräknat

- Ring

- Kampanj

- KAN

- Kan få

- Fångande

- Vid

- fall

- Orsak

- orsakar

- vissa

- utmanande

- Förändringar

- klass

- klasser

- klassificering

- klient

- klient onboarding

- klienter

- cloud

- kluster

- koda

- Kolumn

- kombination

- kombinera

- kommer

- kommentarer

- Gemensam

- samfundet

- företag

- fullborda

- slutför

- Komplexiteten

- komplicerad

- komponenter

- Äventyras

- Compute

- databehandling

- begrepp

- Begreppen

- konfiguration

- Tänk

- anses

- med tanke på

- anser

- begränsningar

- innehålla

- Behållare

- fortsätta

- fortsätter

- Pris

- kostnadseffektiv

- kunde

- kupong

- skapa

- skapas

- skapande

- kriterier

- Cross

- Aktuella

- För närvarande

- beställnings

- kund

- Kunder

- datum

- Data Analytics

- Förberedelse av data

- databehandling

- datavetenskap

- datavetare

- data driven

- datauppsättningar

- beslutar

- beslut

- dedicerad

- djup

- Delta

- Demografi

- beroende

- utplacering

- beskriven

- Designa

- utformade

- design

- detalj

- detaljer

- bestämd

- Utveckling

- olika

- olika

- Svårighet

- rikta

- Rabatt

- diskutera

- distribueras

- distribuerad databehandling

- driven

- chaufför

- grund

- dynamisk

- dynamiskt

- varje

- Tidigare

- lätta

- lätt

- antingen

- aktiverad

- möjliggör

- ingenjör

- Teknik

- Ingenjörer

- säkerställer

- Hela

- Miljö

- miljöer

- lika

- Motsvarande

- utvärdera

- utvärdering

- utvärdering

- händelse

- händelser

- exempel

- exempel

- Utom

- befintliga

- Bygga ut

- förväntat

- förväntar

- erfarenhet

- Utforska

- uttryck

- omfattande

- Omfattande erfarenhet

- faktorer

- fabrik

- MISSLYCKAS

- Misslyckande

- Leverans

- Funktioner

- Fed

- återkoppling

- få

- fält

- slutlig

- slutfört

- Förnamn

- passa

- Flexibilitet

- flexibel

- fokuserade

- efter

- följer

- För

- former

- fundament

- Ramverk

- från

- fullständigt

- fungera

- funktioner

- Vidare

- framtida

- samla

- Allmänt

- genereras

- genererar

- generering

- skaffa sig

- få

- ges

- Go

- Målet

- Mål

- Går

- god

- GPU

- tacksam

- vägleda

- hade

- hantera

- händer

- Har

- har

- he

- höra

- tung

- tunga lyft

- hjälpa

- hjälper

- högnivå

- hög kvalitet

- Markera

- höggradigt

- historia

- Horisontell

- vågrätt

- Hur ser din drömresa ut

- How To

- Men

- html

- http

- HTTPS

- Nav

- humant

- häck

- i

- identifierade

- if

- illustrerar

- bild

- genomföra

- genomförande

- genomföra

- med Esport

- förbättra

- in

- I andra

- innefattar

- Inklusive

- införlivande

- Öka

- ökat

- otroligt

- individuellt

- Individuellt

- informationen

- Infrastruktur

- inledande

- initierar

- exempel

- instrumental

- Intelligens

- avser

- intresse

- Gränssnitt

- inre

- ingripande

- in

- involverade

- fråga

- problem

- IT

- DESS

- Jobb

- Lediga jobb

- jpg

- bara

- Snäll

- Vet

- Brist

- språk

- Large

- till stor del

- större

- senare

- Leads

- LÄRA SIG

- inlärning

- t minst

- Bibliotek

- lyft

- begränsning

- begränsningar

- gränser

- Lista

- liten

- log

- skogsavverkning

- logisk

- längre

- du letar

- förlorar

- älskar

- Maskinen

- maskininlärning

- bibehålla

- upprätthålla

- upprätthåller

- göra

- GÖR

- Framställning

- förvaltade

- chef

- manipuleras

- sätt

- många

- Marknadsföring

- matte

- Maj..

- Möt

- Minne

- meddelande

- metadata

- metriska

- Metrics

- kanske

- emot

- minimum

- ML

- modell

- modeller

- Modulerna

- Moduler

- ögonblick

- Övervaka

- övervakas

- övervakning

- monitorer

- mer

- mest

- för det mesta

- Berg

- multipel

- måste

- Natural

- Naturlig språkbehandling

- Natur

- Behöver

- behövs

- behöver

- behov

- Nya

- noder

- i synnerhet

- Lägga märke till..

- anmälan

- anmälningar

- nu

- antal

- mål

- observera

- of

- Ofta

- on

- On-Demand

- Ombord

- Onboarding

- ONE

- pågående

- endast

- Operatören

- optimala

- Optimera

- optimerad

- or

- ursprungliga

- Övriga

- vår

- ut

- Resultat

- produktion

- utanför

- över

- övergripande

- Övervinna

- Översikt

- parametrar

- del

- särskilt

- partnern

- Förbi

- brinner

- Mönster

- procentuell

- Utföra

- prestanda

- kanske

- perioder

- perspektiv

- Bild

- rörledning

- Plats

- planeras

- plattform

- Plattformar

- plato

- Platon Data Intelligence

- PlatonData

- Spela

- spelar

- snälla du

- plus

- Punkt

- poäng

- dålig

- möjlig

- Inlägg

- potentiell

- kraft

- förutsäga

- föregående

- förmodligen

- Problem

- problem

- process

- Bearbetad

- bearbetning

- producera

- Produkt

- Produktion

- professionell

- ge

- förutsatt

- ger

- sätta

- kvalitet

- Snabbt

- snabbare

- R&D

- snarare

- Raw

- nå

- Läsa

- redo

- Verkligheten

- Anledningen

- register

- Recover

- återvinning

- Minskad

- hänvisar

- relaterad

- relevanta

- förblir

- Återstående

- rapport

- Obligatorisk

- Krav

- resurs

- Resurser

- Svara

- resultera

- resulterande

- robusta

- Roll

- ungefär

- Regel

- Körning

- rinnande

- SaaS

- sagemaker

- Samma

- säger

- skalbarhet

- skalbar

- Skala

- skalning

- Skalningslösning

- scenarier

- Vetenskap

- Forskare

- vetenskapsmän

- sekunder

- sektioner

- vald

- Val

- sända

- sänder

- senior

- Känslighet

- separat

- separerande

- service

- Tjänster

- in

- uppsättningar

- flera

- Dela

- delas

- Sharma

- hon

- visas

- Visar

- sida

- signifikant

- liknande

- Enkelt

- Storlek

- So

- lösning

- Lösningar

- LÖSA

- Utrymme

- specifik

- specifikt

- fart

- Snurra

- stadier

- standard

- står

- starta

- igång

- startar

- Ange

- status

- Steg

- Steg

- Fortfarande

- slutade

- stoppa

- Stoppar

- förvaring

- lagrar

- Sträng

- stark

- strukturerade

- abonnenter

- framgång

- Framgångsrikt

- sådana

- stödja

- system

- System

- bord

- skräddarsydd

- Ta

- tar

- begåvade

- uppgift

- uppgifter

- grupp

- lag

- Teknisk

- villkor

- än

- den där

- Smakämnen

- Framtiden

- deras

- Dem

- sedan

- Där.

- därför

- Dessa

- de

- Tredje

- detta

- de

- tre

- tröskelvärde

- Genom

- tid

- gånger

- till

- tillsammans

- verktyg

- Totalt

- Tåg

- Utbildning

- transaktion

- Transaktions Detaljer

- Förvandla

- Transformation

- transformationer

- utlösa

- triggas

- två

- Typ

- typisk

- under

- förståelse

- enheter

- tills

- uppdaterad

- us

- användbar

- Användning

- användning

- användningsfall

- Begagnade

- med hjälp av

- godkännande

- värde

- olika

- vertikal

- volym

- volymer

- vs

- ville

- var

- tittar

- Sätt..

- we

- VÄL

- när

- som

- VEM

- Hela

- helt

- kommer

- vinna

- med

- inom

- Arbete

- arbetsflöden

- arbetssätt

- fungerar

- sämre

- skulle

- skrivning

- ännu

- Avkastning

- Om er

- Din

- zephyrnet