Kunder ställs inför ökande säkerhetshot och sårbarheter i infrastruktur och applikationsresurser i takt med att deras digitala fotavtryck har utökats och affärseffekterna av dessa digitala tillgångar har ökat. En vanlig utmaning för cybersäkerhet har varit tvåfaldig:

- Konsumera loggar från digitala resurser som finns i olika format och scheman och automatisera analysen av hotfynd baserat på dessa loggar.

- Oavsett om loggar kommer från Amazon Web Services (AWS), andra molnleverantörer, lokala eller edge-enheter, måste kunderna centralisera och standardisera säkerhetsdata.

Dessutom måste analysen för att identifiera säkerhetshot kunna skalas och utvecklas för att möta ett föränderligt landskap av hotaktörer, säkerhetsvektorer och digitala tillgångar.

En ny metod för att lösa detta komplexa säkerhetsanalysscenario kombinerar intag och lagring av säkerhetsdata med hjälp av Amazon Security Lake och analysera säkerhetsdata med maskininlärning (ML) med hjälp av Amazon SageMaker. Amazon Security Lake är en specialbyggd tjänst som automatiskt centraliserar en organisations säkerhetsdata från moln och lokala källor till en specialbyggd datasjö som lagras i ditt AWS-konto. Amazon Security Lake automatiserar den centrala hanteringen av säkerhetsdata, normaliserar loggar från integrerade AWS-tjänster och tredjepartstjänster och hanterar datas livscykel med anpassningsbar retention och automatiserar även lagringsnivåer. Amazon Security Lake tar in loggfiler i Open Cybersecurity Schema Framework (OCSF)-format, med stöd för partners som Cisco Security, CrowdStrike, Palo Alto Networks och OCSF-loggar från resurser utanför din AWS-miljö. Detta enhetliga schema effektiviserar nedströms konsumtion och analys eftersom data följer ett standardiserat schema och nya källor kan läggas till med minimala förändringar i datapipeline. Efter att säkerhetsloggdata har lagrats i Amazon Security Lake blir frågan hur man analyserar den. En effektiv metod för att analysera säkerhetsloggdata är att använda ML; specifikt avvikelsedetektering, som undersöker aktivitets- och trafikdata och jämför dem med en baslinje. Baslinjen definierar vilken aktivitet som är statistiskt normal för den miljön. Avvikelsedetektering skalar bortom en individuell händelsesignatur, och den kan utvecklas med periodisk omskolning; trafik som klassificeras som onormal eller avvikande kan då åtgärdas med prioriterat fokus och brådska. Amazon SageMaker är en helt hanterad tjänst som gör det möjligt för kunder att förbereda data och bygga, träna och distribuera ML-modeller för alla användningsfall med fullständigt hanterad infrastruktur, verktyg och arbetsflöden, inklusive erbjudanden utan kod för affärsanalytiker. SageMaker stöder två inbyggda avvikelsedetekteringsalgoritmer: IP-insikter och Slumpmässigt klippt skog. Du kan också använda SageMaker för att skapa din egen anpassade modell för avvikelsedetektering med hjälp av algoritmer hämtade från flera ML-ramverk.

I det här inlägget lär du dig hur du förbereder data hämtade från Amazon Security Lake och sedan tränar och distribuerar en ML-modell med hjälp av en IP Insights-algoritm i SageMaker. Denna modell identifierar onormal nätverkstrafik eller beteende som sedan kan sammansättas som en del av en större end-to-end säkerhetslösning. En sådan lösning kan anropa en multifaktorautentisering (MFA)-kontroll om en användare loggar in från en ovanlig server eller vid en ovanlig tidpunkt, meddela personalen om det finns en misstänkt nätverksskanning som kommer från nya IP-adresser, varna administratörer om ovanligt nätverk protokoll eller portar används, eller berika IP-insiktsklassificeringsresultatet med andra datakällor som t.ex. Amazon Guard Duty och IP-ryktepoäng för att rangordna hotfynd.

Lösningsöversikt

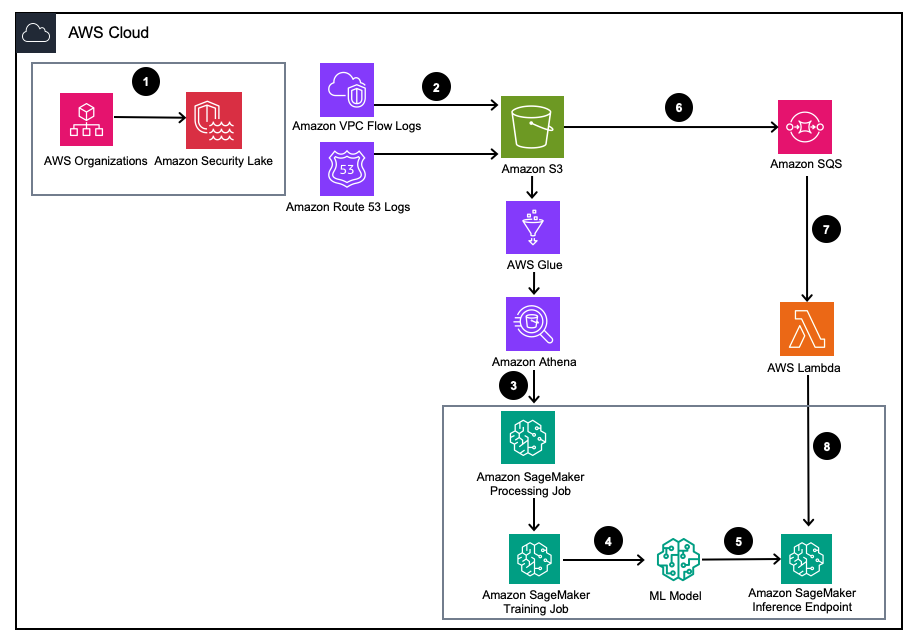

Figur 1 – Lösningsarkitektur

- Aktivera Amazon Security Lake med AWS-organisationer för AWS-konton, AWS-regioner och externa IT-miljöer.

- Ställ in Security Lake-källor från Amazon Virtual Private Cloud (Amazon VPC) Flödesloggar och Amazon Route53 DNS-loggar till Amazon Security Lake S3-hinken.

- Bearbeta Amazon Security Lake-loggdata med ett SageMaker Processing-jobb för att konstruera funktioner. Använda sig av Amazonas Athena att fråga strukturerad OCSF-loggdata från Amazon Simple Storage Service (Amazon S3) dig genom AWS-lim tabeller som hanteras av AWS LakeFormation.

- Träna en SageMaker ML-modell med ett SageMaker Training-jobb som förbrukar de bearbetade Amazon Security Lake-loggarna.

- Distribuera den tränade ML-modellen till en SageMaker slutpunkt.

- Lagra nya säkerhetsloggar i en S3-bucket och köa händelser i Amazon Simple Queue Service (Amazon SQS).

- Prenumerera på en AWS Lambda funktion till SQS-kön.

- Anropa SageMaker slutpunkten för slutpunkten med hjälp av en Lambda-funktion för att klassificera säkerhetsloggar som anomalier i realtid.

Förutsättningar

För att distribuera lösningen måste du först uppfylla följande förutsättningar:

- Aktivera Amazon Security Lake inom din organisation eller ett enda konto med både VPC Flow Logs och Route 53 resolver logs aktiverade.

- Se till att AWS Identity and Access Management (IAM) roll som används av SageMaker som bearbetar jobb och anteckningsböcker har beviljats en IAM-policy inklusive Amazon Security Lake-behörighet för abonnentförfrågningar för den hanterade Amazon Security Lake-databasen och tabeller som hanteras av AWS Lake Formation. Detta bearbetningsjobb bör köras från ett konto för analys eller säkerhetsverktyg för att förbli kompatibelt AWS Security Reference Architecture (AWS SRA).

- Se till att IAM-rollen som används av Lambda-funktionen har beviljats en IAM-policy inklusive Tillstånd för åtkomst av data för Amazon Security Lake för prenumeranter.

Distribuera lösningen

Gör följande för att ställa in miljön:

- Starta en SageMaker Studio eller SageMaker Jupyter anteckningsbok med en

ml.m5.largeexempel. Notera: Förekomststorleken beror på de datauppsättningar du använder. - Klona GitHub Repository.

- Öppna anteckningsboken

01_ipinsights/01-01.amazon-securitylake-sagemaker-ipinsights.ipy. - Implementera tillhandahållen IAM-policy och motsvarande IAM-förtroendepolicy för din SageMaker Studio Notebook-instans för att få tillgång till all nödvändig data i S3, Lake Formation och Athena.

Den här bloggen går igenom den relevanta delen av koden i anteckningsboken efter att den har distribuerats i din miljö.

Installera beroenden och importera det nödvändiga biblioteket

Använd följande kod för att installera beroenden, importera de nödvändiga biblioteken och skapa SageMaker S3-hinken som behövs för databearbetning och modellträning. Ett av de obligatoriska biblioteken, awswrangler, är en AWS SDK för pandas dataram som används för att fråga de relevanta tabellerna i AWS Glue Data Catalog och lagra resultaten lokalt i en dataram.

Fråga Amazon Security Lake VPC-flödesloggtabellen

Denna del av koden använder AWS SDK för pandor för att fråga AWS Glue-tabellen relaterad till VPC Flow Logs. Som nämnts i förutsättningarna hanteras Amazon Security Lake-bord av AWS Lake Formation, så alla lämpliga behörigheter måste ges till rollen som används av SageMaker-anteckningsboken. Den här frågan kommer att dra flera dagars VPC-flödesloggtrafik. Datauppsättningen som användes under utvecklingen av denna blogg var liten. Beroende på omfattningen av ditt användningsfall bör du vara medveten om gränserna för AWS SDK för pandor. När du överväger terabyte-skala bör du överväga AWS SDK för stöd för pandor Modin.

När du visar dataramen kommer du att se en utdata från en enda kolumn med vanliga fält som kan hittas i Nätverksaktivitet (4001) klass av OCSF.

Normalisera Amazon Security Lake VPC-flödesloggdata till det nödvändiga utbildningsformatet för IP Insights.

IP Insights-algoritmen kräver att träningsdata är i CSV-format och innehåller två kolumner. Den första kolumnen måste vara en ogenomskinlig sträng som motsvarar en enhets unika identifierare. Den andra kolumnen måste vara IPv4-adressen för enhetens åtkomsthändelse i decimalpunktsnotation. I exempeldataset för den här bloggen är den unika identifieraren instans-ID:n för EC2-instanser som är kopplade till instance_id värde inom dataframe. IPv4-adressen kommer att härledas från src_endpoint. Baserat på hur Amazon Athena-frågan skapades, är den importerade informationen redan i rätt format för att träna en IP Insights-modell, så ingen ytterligare funktionsteknik krävs. Om du ändrar frågan på annat sätt kan du behöva införliva ytterligare funktionsteknik.

Fråga och normalisera Amazon Security Lake Route 53 resolver-loggtabellen

Precis som du gjorde ovan, kör nästa steg i notebook-datorn en liknande fråga mot Amazon Security Lake Route 53-upplösningstabellen. Eftersom du kommer att använda all OCSF-kompatibel data i den här anteckningsboken, förblir alla funktionstekniska uppgifter desamma för Route 53-resolverloggar som de var för VPC Flow Logs. Du kombinerar sedan de två dataramarna till en enda dataram som används för träning. Eftersom Amazon Athena-frågan laddar data lokalt i rätt format, krävs ingen ytterligare funktionsteknik.

Få IP Insights träningsbild och träna modellen med OCSF-data

I den här nästa delen av anteckningsboken tränar du en ML-modell baserad på IP Insights-algoritmen och använder den konsoliderade dataframe av OCSF från olika typer av stockar. En lista över IP Insights hyperparmetrar finns här.. I exemplet nedan valde vi hyperparametrar som gav den bäst presterande modellen, till exempel 5 för epok och 128 för vector_dim. Eftersom träningsdataset för vårt urval var relativt litet använde vi en ml.m5.large exempel. Hyperparametrar och dina träningskonfigurationer såsom antal instanser och instanstyp bör väljas baserat på dina objektiva mätvärden och din träningsdatastorlek. En funktion som du kan använda inom Amazon SageMaker för att hitta den bästa versionen av din modell är Amazon SageMaker automatisk modelljustering som söker efter den bästa modellen över en rad hyperparametervärden.

Distribuera den tränade modellen och testa med giltig och onormal trafik

Efter att modellen har tränats distribuerar du modellen till en SageMaker-slutpunkt och skickar en serie unika identifierare och IPv4-adresskombinationer för att testa din modell. Denna del av koden förutsätter att du har testdata sparad i din S3-hink. Testdata är en .csv-fil, där den första kolumnen är instans-ID och den andra kolumnen är IP-adresser. Det rekommenderas att testa giltiga och ogiltiga data för att se resultaten av modellen. Följande kod distribuerar din slutpunkt.

Nu när din slutpunkt är utplacerad kan du nu skicka inferensförfrågningar för att identifiera om trafiken är potentiellt onormal. Nedan är ett exempel på hur din formaterade data ska se ut. I det här fallet är den första kolumnidentifieraren ett instans-id och den andra kolumnen är en associerad IP-adress som visas i följande:

När du har dina data i CSV-format kan du skicka in data för slutledning med hjälp av koden genom att läsa din .csv-fil från en S3-hink.:

Utdata för en IP Insights-modell ger ett mått på hur statistiskt förväntad en IP-adress och onlineresurs är. Intervallet för denna adress och resurs är dock obegränsat, så det finns överväganden om hur du skulle avgöra om en kombination av instans-ID och IP-adress ska anses vara avvikande.

I det föregående exemplet skickades fyra olika identifierare och IP-kombinationer till modellen. De två första kombinationerna var giltiga instans-ID och IP-adresskombinationer som förväntas baserat på träningsuppsättningen. Den tredje kombinationen har den korrekta unika identifieraren men en annan IP-adress inom samma subnät. Modellen bör fastställa att det finns en blygsam anomali eftersom inbäddningen skiljer sig något från träningsdata. Den fjärde kombinationen har en giltig unik identifierare men en IP-adress för ett obefintligt subnät inom någon VPC i miljön.

Notera: Normal och onormal trafikdata kommer att ändras baserat på ditt specifika användningsfall, till exempel: om du vill övervaka extern och intern trafik behöver du en unik identifierare anpassad till varje IP-adress och ett schema för att generera de externa identifierarna.

För att avgöra vad din tröskel bör vara för att avgöra om trafiken är onormal kan göras med känd normal och onormal trafik. Stegen som beskrivs i detta exempel på anteckningsboken är följande:

- Konstruera en testuppsättning för att representera normal trafik.

- Lägg till onormal trafik i datasetet.

- Rita fördelningen av

dot_productpoäng för modellen för normal trafik och onormal trafik. - Välj ett tröskelvärde som skiljer den normala delmängden från den onormala delmängden. Detta värde är baserat på din falskt positiva tolerans

Ställ in kontinuerlig övervakning av ny VPC-flödesloggtrafik.

För att demonstrera hur denna nya ML-modell kan användas med Amazon Security Lake på ett proaktivt sätt kommer vi att konfigurera en Lambda-funktion som ska anropas på varje PutObject händelse inom Amazon Security Lake-hanterade bucket, särskilt VPC-flödesloggdata. Inom Amazon Security Lake finns konceptet med en abonnent, som konsumerar loggar och händelser från Amazon Security Lake. Lambdafunktionen som svarar på nya händelser måste beviljas ett dataåtkomstabonnemang. Dataåtkomstprenumeranter meddelas om nya Amazon S3-objekt för en källa när objekten skrivs till Security Lake-hinken. Prenumeranter kan direkt komma åt S3-objekten och få meddelanden om nya objekt via en prenumerationsslutpunkt eller genom att polla en Amazon SQS-kö.

- Öppna Security Lake-konsol.

- Välj i navigeringsfönstret abonnenter.

- På sidan Prenumeranter väljer du Skapa prenumerant.

- Ange för prenumerationsinformation

inferencelambdaför Abonnentnamn och en valfri Beskrivning. - Smakämnen Region ställs automatiskt in som din för närvarande valda AWS-region och kan inte ändras.

- För Logg- och händelsekällorväljer Specifika logg- och händelsekällor Och välj VPC-flödesloggar och Route 53-loggar

- För Dataåtkomstmetodväljer S3.

- För Prenumerationsuppgifter, ange ditt AWS-konto-ID för kontot där Lambda-funktionen kommer att finnas och en användarspecificerad externt ID.

Notera: Om du gör detta lokalt inom ett konto behöver du inte ha ett externt ID. - Välja Skapa.

Skapa Lambda-funktionen

För att skapa och distribuera Lambda-funktionen kan du antingen slutföra följande steg eller distribuera den förbyggda SAM-mallen 01_ipinsights/01.02-ipcheck.yaml i GitHub-repo. SAM-mallen kräver att du tillhandahåller SQS ARN och SageMaker-ändpunktsnamnet.

- Välj på Lambda-konsolen Skapa funktion.

- Välja Författare från början.

- För Funktionsnamn, stiga på

ipcheck. - För Runtimeväljer python 3.10.

- För arkitektur, Välj x86_64.

- För Utförande roll, Välj Skapa en ny roll med Lambda-behörigheter.

- När du har skapat funktionen anger du innehållet i ipcheck.py fil från GitHub-repo.

- Välj i navigeringsfönstret Miljövariabler.

- Välja Redigera.

- Välja Lägg till miljövariabel.

- För den nya miljövariabeln, ange

ENDPOINT_NAMEoch för värde anger du slutpunkts-ARN som matades ut under distributionen av SageMaker-slutpunkten. - Välja Save.

- Välja Distribuera.

- Välj i navigeringsfönstret konfiguration.

- Välja triggers.

- Välja Lägg till trigger.

- Enligt Välj en källaväljer SQS.

- Enligt SQS-kö, ange ARN för den huvudsakliga SQS-kön som skapats av Security Lake.

- Markera kryssrutan för Aktivera triggern.

- Välja Lägg till.

Validera Lambda-fynd

- Öppna Amazon CloudWatch-konsol.

- Välj i den vänstra rutan Logga grupper.

- Ange ipcheck i sökfältet och välj sedan logggruppen med namnet

/aws/lambda/ipcheck. - Välj den senaste loggströmmen under Logga strömmar.

- Inom loggarna bör du se resultat som ser ut som följande för varje ny Amazon Security Lake-logg:

{'predictions': [{'dot_product': 0.018832731992006302}, {'dot_product': 0.018832731992006302}]}

Denna Lambda-funktion analyserar kontinuerligt nätverkstrafiken som tas in av Amazon Security Lake. Detta låter dig bygga mekanismer för att meddela dina säkerhetsteam när en specificerad tröskel överskrids, vilket skulle indikera en onormal trafik i din miljö.

Städa

När du är klar med att experimentera med den här lösningen och för att undvika avgifter på ditt konto, rensa upp dina resurser genom att ta bort S3-hinken, SageMaker-slutpunkten, stänga av datorn som är ansluten till SageMaker Jupyter-anteckningsboken, ta bort Lambda-funktionen och inaktivera Amazon Security Lake på ditt konto.

Slutsats

I det här inlägget lärde du dig hur du förbereder nätverkstrafikdata från Amazon Security Lake för maskininlärning, och sedan tränade och distribuerade du en ML-modell med hjälp av IP Insights-algoritmen i Amazon SageMaker. Alla steg som beskrivs i Jupyter-anteckningsboken kan replikeras i en end-to-end ML-pipeline. Du implementerade också en AWS Lambda-funktion som konsumerade nya Amazon Security Lake-loggar och skickade in slutsatser baserade på den tränade anomalidetekteringsmodellen. ML-modellsvaren som mottagits av AWS Lambda kan proaktivt meddela säkerhetsteam om onormal trafik när vissa trösklar är uppfyllda. Kontinuerlig förbättring av modellen kan möjliggöras genom att inkludera ditt säkerhetsteam i loopgranskningarna för att markera om trafik som identifierats som avvikande var en falsk positiv eller inte. Detta kan sedan läggas till din träningsuppsättning och även läggas till din normala trafikdatauppsättning vid fastställande av en empirisk tröskel. Denna modell kan identifiera potentiellt onormal nätverkstrafik eller beteende där den kan inkluderas som en del av en större säkerhetslösning för att initiera en MFA-kontroll om en användare loggar in från en ovanlig server eller vid en ovanlig tidpunkt, varna personalen om det finns en misstänkt nätverksskanning som kommer från nya IP-adresser, eller kombinera IP-insikterna med andra källor som Amazon Guard Duty för att rangordna hotfynd. Den här modellen kan inkludera anpassade loggkällor som Azure Flow-loggar eller lokala loggar genom att lägga till anpassade källor till din Amazon Security Lake-distribution.

I del 2 av den här blogginläggsserien kommer du att lära dig hur du bygger en avvikelsedetekteringsmodell med hjälp av Slumpmässigt klippt skog algoritm tränad med ytterligare Amazon Security Lake-källor som integrerar nätverks- och värdsäkerhetsloggdata och tillämpar säkerhetsavvikelseklassificeringen som en del av en automatiserad, omfattande säkerhetsövervakningslösning.

Om författarna

Joe Morotti är en lösningsarkitekt på Amazon Web Services (AWS) och hjälper företagskunder över hela Mellanvästern i USA. Han har haft ett brett utbud av tekniska roller och tycker om att visa kundens konst av det möjliga. På fritiden tycker han om att tillbringa kvalitetstid med sin familj för att utforska nya platser och överanalysera sitt idrottslags prestation

Joe Morotti är en lösningsarkitekt på Amazon Web Services (AWS) och hjälper företagskunder över hela Mellanvästern i USA. Han har haft ett brett utbud av tekniska roller och tycker om att visa kundens konst av det möjliga. På fritiden tycker han om att tillbringa kvalitetstid med sin familj för att utforska nya platser och överanalysera sitt idrottslags prestation

Bishr Tabbaa är en lösningsarkitekt på Amazon Web Services. Bishr är specialiserat på att hjälpa kunder med applikationer för maskininlärning, säkerhet och observerbarhet. Utanför jobbet tycker han om att spela tennis, laga mat och umgås med familjen.

Bishr Tabbaa är en lösningsarkitekt på Amazon Web Services. Bishr är specialiserat på att hjälpa kunder med applikationer för maskininlärning, säkerhet och observerbarhet. Utanför jobbet tycker han om att spela tennis, laga mat och umgås med familjen.

Sriharsh Adari är Senior Solutions Architect på Amazon Web Services (AWS), där han hjälper kunder att arbeta baklänges från affärsresultat för att utveckla innovativa lösningar på AWS. Under åren har han hjälpt flera kunder med transformationer av dataplattformar över branschvertikaler. Hans kärnexpertisområde inkluderar teknologistrategi, dataanalys och datavetenskap. På fritiden tycker han om att spela tennis, titta på tv-program och spela Tabla.

Sriharsh Adari är Senior Solutions Architect på Amazon Web Services (AWS), där han hjälper kunder att arbeta baklänges från affärsresultat för att utveckla innovativa lösningar på AWS. Under åren har han hjälpt flera kunder med transformationer av dataplattformar över branschvertikaler. Hans kärnexpertisområde inkluderar teknologistrategi, dataanalys och datavetenskap. På fritiden tycker han om att spela tennis, titta på tv-program och spela Tabla.

- SEO-drivet innehåll och PR-distribution. Bli förstärkt idag.

- PlatoData.Network Vertical Generative Ai. Styrka dig själv. Tillgång här.

- PlatoAiStream. Web3 Intelligence. Kunskap förstärkt. Tillgång här.

- Platoesg. Kol, CleanTech, Energi, Miljö, Sol, Avfallshantering. Tillgång här.

- PlatoHealth. Biotech och kliniska prövningar Intelligence. Tillgång här.

- Källa: https://aws.amazon.com/blogs/machine-learning/identify-cybersecurity-anomalies-in-your-amazon-security-lake-data-using-amazon-sagemaker/

- : har

- :är

- :inte

- :var

- $UPP

- 01

- 1

- 10

- 100

- 12

- 125

- 15%

- 17

- 20000

- 25

- 32

- 7

- 9

- a

- ovan

- tillgång

- Konto

- konton

- tvärs

- aktivitet

- aktörer

- lagt till

- tillsats

- Annat

- adress

- adresser

- administratörer

- Efter

- mot

- Varna

- algoritm

- algoritmer

- Justerat

- Alla

- tillåter

- redan

- också

- amason

- Amazonas Athena

- Amazon SageMaker

- Amazon Web Services

- Amazon Web Services (AWS)

- an

- analys

- analytiker

- analytics

- analysera

- analyser

- analys

- och

- abnormiteter

- avvikelse av anomali

- Annan

- vilken som helst

- Ansökan

- tillämpningar

- Ansök

- tillvägagångssätt

- arkitektur

- ÄR

- OMRÅDE

- Konst

- AS

- Tillgångar

- associerad

- antar

- At

- Autentisering

- Automatiserad

- automatiserar

- automatiskt

- automatisera

- undvika

- medveten

- AWS

- AWS-lim

- AWS Lake Formation

- AWS Lambda

- Azure

- bar

- baserat

- Baslinje

- BE

- därför att

- blir

- varit

- beteende

- Där vi får lov att vara utan att konstant prestera,

- nedan

- BÄST

- Bortom

- Blogg

- båda

- SLUTRESULTAT

- inbyggd

- företag

- men

- by

- KAN

- kapacitet

- kapabel

- Vid

- katalog

- centrala

- centralisera

- vissa

- utmanar

- byta

- Förändringar

- byte

- avgifter

- ta

- Välja

- valda

- Cisco

- klass

- klassificering

- klassificerad

- klassificera

- rena

- cloud

- koda

- Kolumn

- Kolonner

- kombination

- kombinationer

- kombinera

- kombinerar

- komma

- kommande

- Gemensam

- fullborda

- komplex

- kompatibel

- sammansatt

- omfattande

- Compute

- begrepp

- Tänk

- överväganden

- anses

- med tanke på

- Konsol

- konsumeras

- konsumtion

- innehålla

- innehåll

- kontinuerligt

- kontinuerlig

- Kärna

- korrekt

- motsvarar

- kunde

- skapa

- skapas

- För närvarande

- beställnings

- Kunder

- anpassningsbar

- Klipp

- Cybersäkerhet

- datum

- datatillgång

- Data Analytics

- datasjö

- Dataplattform

- databehandling

- datavetenskap

- Databas

- datauppsättningar

- Dagar

- definierar

- demonstrera

- beroenden

- beroende

- beroende

- distribuera

- utplacerade

- utplacering

- vecklas ut

- Härledd

- detaljer

- Detektering

- Bestämma

- bestämmande

- utveckla

- Utveckling

- enheter

- DID

- olika

- digital

- Digitala tillgångar

- direkt

- fördelning

- dns

- doesn

- gör

- donation

- gjort

- inte

- ner

- under

- e

- varje

- kant

- Effektiv

- antingen

- annars

- inbäddning

- aktiverad

- möjliggör

- början till slut

- Slutpunkt

- ingenjör

- Teknik

- njuta

- berika

- ange

- Företag

- Miljö

- miljöer

- epok

- fel

- händelse

- händelser

- utvecklas

- utvecklas

- undersöker

- exempel

- Utom

- finns

- expanderade

- förväntat

- expertis

- Utforska

- extern

- inför

- falsk

- familj

- Leverans

- Funktioner

- Fält

- Fil

- Filer

- hitta

- resultat

- Förnamn

- flöda

- Fokus

- efter

- följer

- Fotavtryck

- För

- format

- bildning

- hittade

- fyra

- Fjärde

- RAM

- ramar

- Fri

- från

- fullständigt

- fungera

- ytterligare

- generera

- GitHub

- beviljats

- Grupp

- vuxen

- Guard

- Har

- he

- Held

- hjälpte

- hjälpa

- hjälper

- hans

- värd

- Hur ser din drömresa ut

- How To

- Men

- html

- HTTPS

- ID

- identifierade

- identifierare

- identifierare

- identifierar

- identifiera

- identifiera

- Identitet

- ids

- if

- bild

- Inverkan

- genomföras

- importera

- förbättring

- in

- innefattar

- ingår

- Inklusive

- införliva

- ökande

- indikerar

- individuellt

- industrin

- Infrastruktur

- initiera

- innovativa

- insikter

- installera

- exempel

- integrera

- integrerade

- inre

- in

- åberopas

- IP

- IP-adress

- IP-adresser

- IT

- Jobb

- Lediga jobb

- jpg

- json

- känd

- etikett

- sjö

- liggande

- Large

- större

- LÄRA SIG

- lärt

- inlärning

- vänster

- bibliotek

- livscykel

- tycka om

- gränser

- Lista

- laster

- lokalt

- log

- se

- ser ut som

- Maskinen

- maskininlärning

- Huvudsida

- förvaltade

- ledning

- förvaltar

- sätt

- Maj..

- mäta

- mekanismer

- Möt

- nämnts

- träffade

- Metrics

- UD

- Västern

- minimum

- saknas

- ML

- modell

- modeller

- blygsam

- modifierad

- modifiera

- Övervaka

- övervakning

- mest

- multipel

- måste

- namn

- Navigering

- nödvändigt för

- Behöver

- behövs

- nät

- nätverkstrafik

- nätverk

- Nya

- Nästa

- Nej

- obefintlig

- normala

- anteckningsbok

- anmälningar

- roman

- nu

- mål

- objekt

- of

- offer~~POS=TRUNC

- on

- ONE

- nätet

- opak

- or

- organisation

- OS

- Övriga

- vår

- utfall

- uteliggare

- skisse

- produktion

- utanför

- över

- egen

- sida

- Palo Alto

- pandor

- panelen

- del

- partner

- utför

- periodisk

- tillstånd

- behörigheter

- rörledning

- platser

- plattform

- plato

- Platon Data Intelligence

- PlatonData

- i

- policy

- del

- portar

- positiv

- möjlig

- Inlägg

- potentiellt

- föregående

- Förutsägelser

- Predictor

- Förbered

- förutsättningar

- prioriteras

- privat

- Proaktiv

- Bearbetad

- bearbetning

- rätt

- protokoll

- ge

- leverantörer

- ger

- kvalitet

- fråga

- höja

- område

- rangordna

- Läsning

- verklig

- realtid

- motta

- mottagna

- senaste

- rekommenderas

- referens

- region

- regioner

- relaterad

- relativt

- relevanta

- förblir

- replikeras

- representerar

- rykte

- förfrågningar

- Obligatorisk

- Kräver

- resurs

- Resurser

- respons

- svar

- resultera

- Resultat

- retentionstid

- Omdömen

- Roll

- roller

- Rutt

- Körning

- kör

- sagemaker

- SageMaker Inference

- Sam

- Samma

- Exempeldatauppsättning

- sparade

- Skala

- skalor

- skalning

- scanna

- scenario

- ordningen

- Vetenskap

- göra

- sDK

- Sök

- sök

- Andra

- säkerhet

- Säkerhetshot

- se

- välj

- vald

- sända

- senior

- Serier

- server

- service

- Tjänster

- session

- in

- skall

- visas

- Visar

- stänga

- sida

- namnteckning

- signering

- liknande

- Enkelt

- eftersom

- enda

- Storlek

- något annorlunda

- Small

- So

- lösning

- Lösningar

- LÖSA

- Källa

- kommer från

- Källor

- specialiserat

- specifik

- specifikt

- specificerade

- Spendera

- Sporter

- Personal

- Steg

- Steg

- förvaring

- lagra

- lagras

- Strategi

- ström

- strömlinjer

- Sträng

- strukturerade

- studio

- skicka

- lämnats

- undernät

- abonnent

- abonnenter

- prenumeration

- sådana

- stödja

- Stöder

- misstänksam

- bord

- uppgifter

- grupp

- lag

- Teknisk

- Teknologi

- Teknologistrategi

- mall

- tennis

- testa

- den där

- Smakämnen

- deras

- sedan

- Där.

- de

- Tredje

- tredje part

- detta

- de

- hot

- hotaktörer

- hot

- tröskelvärde

- Genom

- tid

- till

- verktyg

- trafik

- Tåg

- tränad

- Utbildning

- transformationer

- Litar

- prova

- tv

- två

- dubbelt

- Typ

- typer

- under

- enhetlig

- unika

- på

- urgency

- us

- användning

- användningsfall

- Begagnade

- Användare

- användningar

- med hjälp av

- utnyttja

- utnyttjas

- giltigt

- värde

- Värden

- variabel

- version

- vertikaler

- utsikt

- kränks

- Virtuell

- sårbarheter

- promenader

- vill

- var

- Sätt..

- we

- webb

- webbservice

- były

- Vad

- när

- om

- som

- bred

- Brett utbud

- kommer

- med

- inom

- Arbete

- arbetsflöden

- skulle

- skriven

- år

- Om er

- Din

- zephyrnet