I dagens informationsålder utgör de enorma mängderna data som finns i otaliga dokument både en utmaning och en möjlighet för företag. Traditionella dokumentbehandlingsmetoder saknar ofta effektivitet och noggrannhet, vilket ger utrymme för innovation, kostnadseffektivitet och optimeringar. Dokumentbehandlingen har sett betydande framsteg med tillkomsten av Intelligent Document Processing (IDP). Med IDP kan företag omvandla ostrukturerad data från olika dokumenttyper till strukturerade, handlingsbara insikter, vilket dramatiskt förbättrar effektiviteten och minskar manuella ansträngningar. Potentialen slutar dock inte där. Genom att integrera generativ artificiell intelligens (AI) i processen kan vi förbättra IDP-kapaciteten ytterligare. Generativ AI introducerar inte bara förbättrade möjligheter inom dokumentbehandling, den introducerar också en dynamisk anpassningsförmåga till förändrade datamönster. Det här inlägget tar dig igenom synergin mellan IDP och generativ AI, och visar hur de representerar nästa gräns inom dokumentbehandling.

Vi diskuterar IDP i detalj i vår serie Intelligent dokumentbehandling med AWS AI-tjänster (del 1 och del 2). I det här inlägget diskuterar vi hur man utökar en ny eller befintlig IDP-arkitektur med stora språkmodeller (LLM). Mer specifikt diskuterar vi hur vi kan integrera amazontext med Langkedja som dokumentladdare och Amazonas berggrund att extrahera data från dokument och använda generativa AI-funktioner inom de olika IDP-faserna.

Amazon Textract är en maskininlärningstjänst (ML) som automatiskt extraherar text, handstil och data från skannade dokument. Amazon Bedrock är en helt hanterad tjänst som erbjuder ett urval av högpresterande grundmodeller (FM) genom lättanvända API:er.

Följande diagram är en referensarkitektur på hög nivå som förklarar hur du ytterligare kan förbättra ett IDP-arbetsflöde med grundmodeller. Du kan använda LLM i en eller alla faser av IDP beroende på användningsfall och önskat resultat.

I de följande avsnitten fördjupar vi oss i hur Amazon Textract integreras i generativa AI-arbetsflöden med hjälp av LangChain för att bearbeta dokument för var och en av dessa specifika uppgifter. Kodblocken som tillhandahålls här har trimmats ned för korthetens skull. Se vår GitHub repository för detaljerade Python-anteckningsböcker och en steg-för-steg-genomgång.

Textextraktion från dokument är en avgörande aspekt när det gäller att behandla dokument med LLM:er. Du kan använda Amazon Textract för att extrahera ostrukturerad råtext från dokument och bevara de ursprungliga semistrukturerade eller strukturerade objekten som nyckel-värdepar och tabeller som finns i dokumentet. Dokumentpaket som sjukvård och försäkringsfordringar eller bolån består av komplexa formulär som innehåller mycket information i strukturerade, semistrukturerade och ostrukturerade format. Dokumentextrahering är ett viktigt steg här eftersom LLM:er drar nytta av det rika innehållet för att generera mer exakta och relevanta svar, vilket annars skulle kunna påverka kvaliteten på LLM:s resultat.

LangChain är ett kraftfullt ramverk med öppen källkod för integrering med LLM. LLM:er i allmänhet är mångsidiga men kan kämpa med domänspecifika uppgifter där djupare sammanhang och nyanserade svar behövs. LangChain ger utvecklare möjlighet att i sådana scenarier bygga agenter som kan bryta ner komplexa uppgifter i mindre deluppgifter. Underuppgifterna kan sedan introducera kontext och minne i LLM:er genom att koppla ihop och kedja LLM-uppmaningar.

LangChain erbjuder dokumentladdare som kan ladda och omvandla data från dokument. Du kan använda dem för att strukturera dokument i föredragna format som kan bearbetas av LLM:er. De AmazonTextractPDFLoader är en dokumentladdare av typen tjänsteladdare som ger ett snabbt sätt att automatisera dokumentbehandling genom att använda Amazon Textract i kombination med LangChain. För mer information om AmazonTextractPDFLoader, referera till Langkedja dokumentation. För att använda Amazon Textract-dokumentladdaren börjar du med att importera den från LangChain-biblioteket:

from langchain.document_loaders import AmazonTextractPDFLoaderhttps_loader = AmazonTextractPDFLoader("https://sample-website.com/sample-doc.pdf")

https_document = https_loader.load() s3_loader = AmazonTextractPDFLoader("s3://sample-bucket/sample-doc.pdf")

s3_document = s3_loader.load()Du kan också lagra dokument i Amazon S3 och hänvisa till dem med s3:// URL-mönstret, som förklaras i Få åtkomst till en hink med S3://, och skicka denna S3-sökväg till Amazon Textract PDF-laddaren:

import boto3

textract_client = boto3.client('textract', region_name='us-east-2') file_path = "s3://amazon-textract-public-content/langchain/layout-parser-paper.pdf"

loader = AmazonTextractPDFLoader(file_path, client=textract_client)

documents = loader.load()Ett flersidigt dokument kommer att innehålla flera sidor med text, som sedan kan nås via dokumentobjektet, som är en lista med sidor. Följande kod går igenom sidorna i dokumentobjektet och skriver ut dokumenttexten, som är tillgänglig via page_content attribut:

print(len(documents)) for document in documents: print(document.page_content)Amazon Comprehend och LLM kan effektivt användas för dokumentklassificering. Amazon Comprehend är en NLP-tjänst (natural language processing) som använder ML för att extrahera insikter från text. Amazon Comprehend stöder också utbildning för anpassade klassificeringsmodeller med layoutmedvetenhet på dokument som PDF-filer, Word och bildformat. För mer information om hur du använder Amazon Comprehend-dokumentklassificeraren, se Amazon Comprehend dokumentklassificerare lägger till layoutstöd för högre noggrannhet.

När det paras ihop med LLM:er blir dokumentklassificering ett kraftfullt tillvägagångssätt för att hantera stora volymer dokument. LLM:er är användbara vid dokumentklassificering eftersom de kan analysera text, mönster och kontextuella element i dokumentet med hjälp av naturlig språkförståelse. Du kan också finjustera dem för specifika dokumentklasser. När en ny dokumenttyp som introduceras i IDP-pipelinen behöver klassificeras, kan LLM bearbeta text och kategorisera dokumentet givet en uppsättning klasser. Följande är en exempelkod som använder LangChain-dokumentladdaren som drivs av Amazon Textract för att extrahera texten från dokumentet och använda den för att klassificera dokumentet. Vi använder Antropisk Claude v2 modell via Amazon Bedrock för att utföra klassificeringen.

I följande exempel extraherar vi först text från en patientutskrivningsrapport och använder en LLM för att klassificera den med en lista med tre olika dokumenttyper—DISCHARGE_SUMMARY, RECEIPToch PRESCRIPTION. Följande skärmdump visar vår rapport.

from langchain.document_loaders import AmazonTextractPDFLoader

from langchain.llms import Bedrock

from langchain.prompts import PromptTemplate

from langchain.chains import LLMChain loader = AmazonTextractPDFLoader("./samples/document.png")

document = loader.load() template = """ Given a list of classes, classify the document into one of these classes. Skip any preamble text and just give the class name. <classes>DISCHARGE_SUMMARY, RECEIPT, PRESCRIPTION</classes>

<document>{doc_text}<document>

<classification>""" prompt = PromptTemplate(template=template, input_variables=["doc_text"])

bedrock_llm = Bedrock(client=bedrock, model_id="anthropic.claude-v2") llm_chain = LLMChain(prompt=prompt, llm=bedrock_llm)

class_name = llm_chain.run(document[0].page_content) print(f"The provided document is = {class_name}")

Sammanfattning innebär att en given text eller ett visst dokument kondenseras till en kortare version med bibehållen nyckelinformation. Denna teknik är fördelaktig för effektiv informationshämtning, vilket gör det möjligt för användare att snabbt förstå nyckelpunkterna i ett dokument utan att läsa hela innehållet. Även om Amazon Textract inte direkt utför textsammanfattningar, tillhandahåller det de grundläggande funktionerna för att extrahera hela texten från dokument. Denna extraherade text fungerar som en input till vår LLM-modell för att utföra textsammanfattningsuppgifter.

Genom att använda samma exempelutskrivningsrapport som vi använder AmazonTextractPDFLoader för att extrahera text från detta dokument. Som tidigare använder vi Claude v2-modellen via Amazon Bedrock och initierar den med en prompt som innehåller instruktioner om vad man ska göra med texten (i det här fallet sammanfattning). Slutligen kör vi LLM-kedjan genom att skicka in den extraherade texten från dokumentladdaren. Detta kör en slutledningsåtgärd på LLM med prompten som består av instruktionerna för att sammanfatta, och dokumentets text markerad med Document. Se följande kod:

Koden genererar sammanfattningen av en sammanfattningsrapport om patientutskrivning:

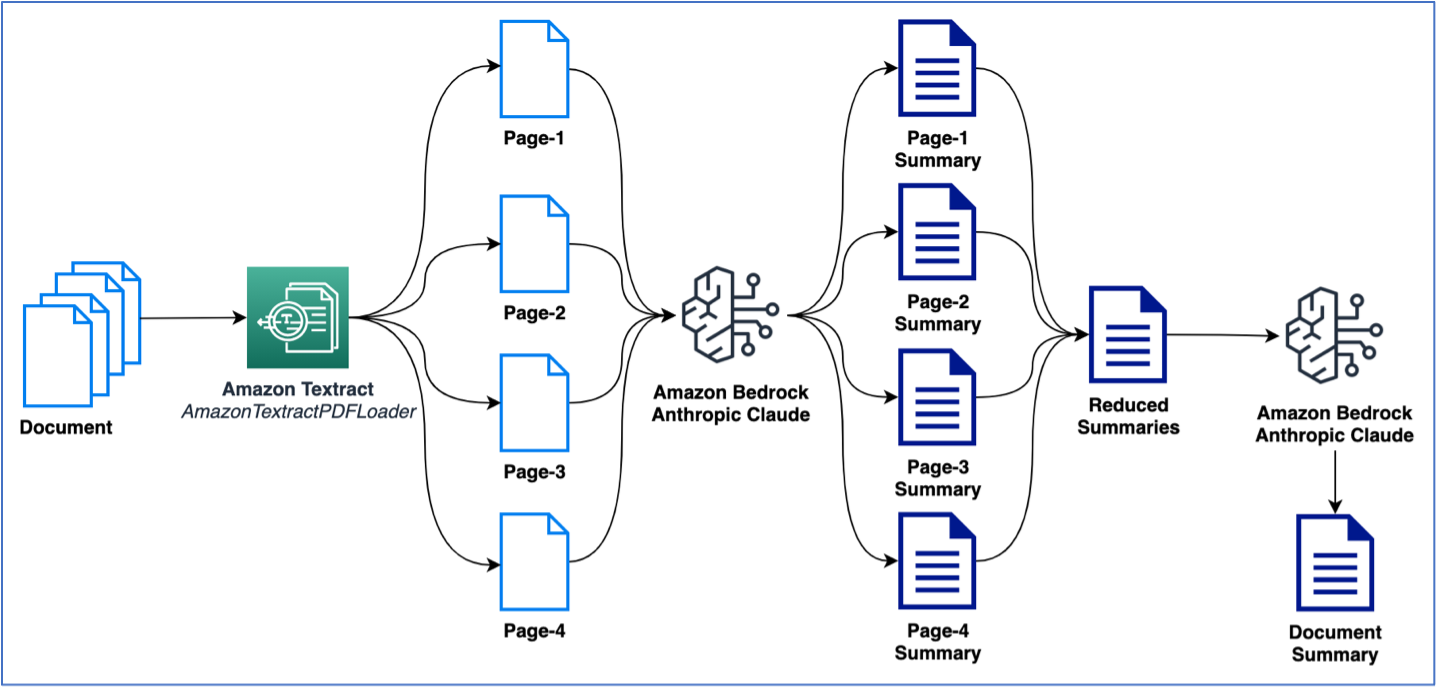

I det föregående exemplet användes ett ensidigt dokument för att sammanfatta. Men du kommer sannolikt att hantera dokument som innehåller flera sidor som behöver sammanfattas. Ett vanligt sätt att utföra sammanfattningar på flera sidor är att först generera sammanfattningar på mindre textbitar och sedan kombinera de mindre sammanfattningarna för att få en slutlig sammanfattning av dokumentet. Observera att denna metod kräver flera anrop till LLM. Logiken för detta kan skapas enkelt; LangChain tillhandahåller dock en inbyggd sammanfattningskedja som kan sammanfatta stora texter (från flersidiga dokument). Sammanfattningen kan ske antingen via map_reduce eller med stuff alternativ, som är tillgängliga som alternativ för att hantera flera samtal till LLM. I följande exempel använder vi map_reduce för att sammanfatta ett flersidigt dokument. Följande bild illustrerar vårt arbetsflöde.

Låt oss först börja med att extrahera dokumentet och se det totala antalet token per sida och det totala antalet sidor:

Därefter använder vi LangChains inbyggda load_summarize_chain för att sammanfatta hela dokumentet:

from langchain.chains.summarize import load_summarize_chain summary_chain = load_summarize_chain(llm=bedrock_llm, chain_type='map_reduce')

output = summary_chain.run(document)

print(output.strip())Standardisering och Q&A

I det här avsnittet diskuterar vi standardisering och frågor och svar.

Standardisering

Utdatastandardisering är en textgenereringsuppgift där LLM:er används för att tillhandahålla en konsekvent formatering av utdatatexten. Den här uppgiften är särskilt användbar för automatisering av extrahering av nyckelenheter som kräver att utdata anpassas till önskade format. Till exempel kan vi följa snabba tekniska bästa praxis för att finjustera en LLM för att formatera datum till MM/DD/ÅÅÅÅ-format, vilket kan vara kompatibelt med en databas DATUM-kolumn. Följande kodblock visar ett exempel på hur detta görs med hjälp av en LLM och prompt ingenjörskonst. Vi standardiserar inte bara utdataformatet för datumvärdena, vi uppmanar också modellen att generera den slutliga utdatan i ett JSON-format så att den lätt kan konsumeras i våra nedströmsapplikationer. Vi använder LangChain Expression Language (LCEL) för att koppla samman två åtgärder. Den första åtgärden uppmanar LLM att generera en utdata i JSON-format med bara datumen från dokumentet. Den andra åtgärden tar JSON-utgången och standardiserar datumformatet. Observera att denna tvåstegsåtgärd också kan utföras i ett enda steg med korrekt prompt ingenjörskonst, som vi kommer att se i normalisering och mallning.

Utdata från föregående kodexempel är en JSON-struktur med datum 07/09/2020 och 08/09/2020, som är i formatet DD/MM/ÅÅÅÅ och är patientens intagnings- respektive utskrivningsdatum från sjukhuset, enligt till den sammanfattande rapporten om ansvarsfrihet.

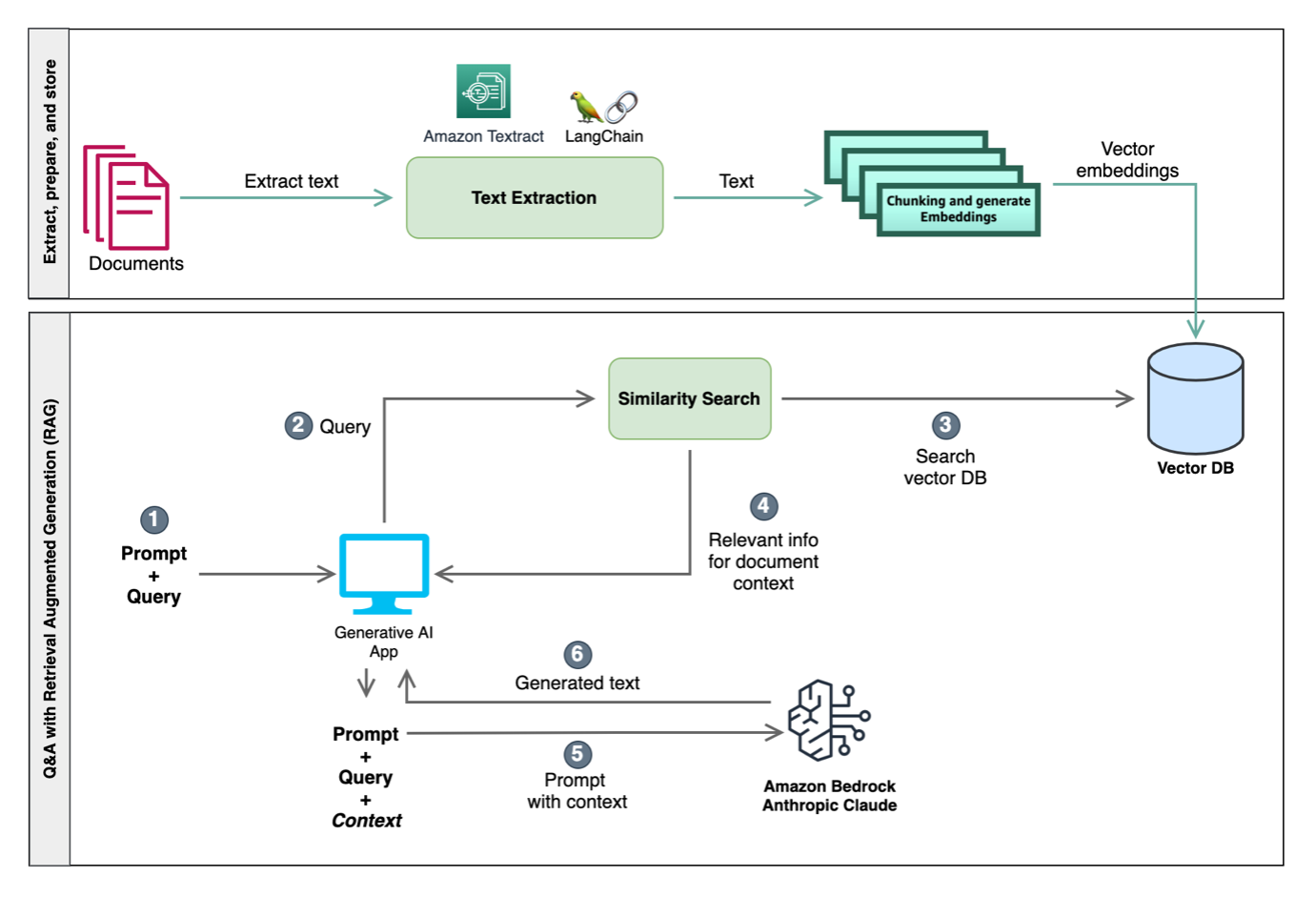

Frågor och svar med Retrieval Augmented Generation

LLM:er är kända för att behålla faktainformation, ofta kallad deras världskunskap eller världsbild. När de är finjusterade kan de producera toppmoderna resultat. Det finns dock begränsningar för hur effektivt en LLM kan komma åt och manipulera denna kunskap. Som ett resultat, i uppgifter som i hög grad är beroende av specifik kunskap, kanske deras prestanda inte är optimal för vissa användningsfall. Till exempel i fråge- och svarsscenarier är det viktigt att modellen strikt följer det sammanhang som anges i dokumentet utan att enbart förlita sig på sin världskunskap. Att avvika från detta kan leda till felaktiga framställningar, felaktigheter eller till och med felaktiga svar. Den vanligaste metoden för att lösa detta problem är känd som Retrieval Augmented Generation (TRASA). Detta tillvägagångssätt synergerar styrkorna hos både hämtningsmodeller och språkmodeller, vilket förbättrar precisionen och kvaliteten på de svar som genereras.

LLM:er kan också införa token-begränsningar på grund av deras minnesbegränsningar och begränsningarna för hårdvaran de körs på. För att hantera detta problem används tekniker som chunking för att dela upp stora dokument i mindre delar som passar inom token-gränserna för LLM. Å andra sidan används inbäddningar i NLP främst för att fånga den semantiska betydelsen av ord och deras relationer med andra ord i ett högdimensionellt utrymme. Dessa inbäddningar omvandlar ord till vektorer, vilket gör det möjligt för modeller att effektivt bearbeta och förstå textdata. Genom att förstå de semantiska nyanserna mellan ord och fraser gör inbäddningar det möjligt för LLM:er att generera sammanhängande och kontextuellt relevanta utdata. Observera följande nyckeltermer:

- Chunking – Denna process bryter ner stora mängder text från dokument till mindre, meningsfulla bitar av text.

- inbäddningar – Dessa är vektortransformationer med fast dimension av varje bit som behåller den semantiska informationen från bitarna. Dessa inbäddningar laddas sedan in i en vektordatabas.

- Vektor databas – Det här är en databas med ordinbäddningar eller vektorer som representerar ords sammanhang. Det fungerar som en kunskapskälla som hjälper NLP-uppgifter i pipelines för dokumentbearbetning. Fördelen med vektordatabasen här är att den endast tillåter det nödvändiga sammanhanget att tillhandahållas till LLM under textgenerering, som vi förklarar i följande avsnitt.

RAG använder kraften hos inbäddningar för att förstå och hämta relevanta dokumentsegment under hämtningsfasen. Genom att göra det kan RAG arbeta inom LLMs symboliska begränsningar, vilket säkerställer att den mest relevanta informationen väljs ut för generering, vilket resulterar i mer exakta och kontextuellt relevanta utdata.

Följande diagram illustrerar integreringen av dessa tekniker för att skapa input till LLM, förbättra deras kontextuella förståelse och möjliggöra mer relevanta i sammanhanget svar. Ett tillvägagångssätt involverar likhetssökning, med användning av både en vektordatabas och chunking. Vektordatabasen lagrar inbäddningar som representerar semantisk information, och chunking delar in text i hanterbara sektioner. Med hjälp av detta sammanhang från likhetssökning kan LLM:er köra uppgifter som svar på frågor och domänspecifika operationer som klassificering och anrikning.

För det här inlägget använder vi en RAG-baserad metod för att utföra frågor och svar i sammanhanget med dokument. I följande kodexempel extraherar vi text från ett dokument och delar sedan upp dokumentet i mindre bitar av text. Chunking krävs eftersom vi kan ha stora flersidiga dokument och våra LLMs kan ha token-gränser. Dessa bitar laddas sedan in i vektordatabasen för att utföra likhetssökning i de efterföljande stegen. I följande exempel använder vi Amazon Titan Embed Text v1-modellen, som utför vektorinbäddningar av dokumentbitarna:

Koden skapar ett relevant sammanhang för LLM med hjälp av de textbitar som returneras av likhetssökningsåtgärden från vektordatabasen. För det här exemplet använder vi en öppen källkod FAISS vektor butik som en exempelvektordatabas för att lagra vektorinbäddningar av varje textbit. Vi definierar sedan vektordatabasen som en LangChain retriever, som förs in i RetrievalQA kedja. Detta kör internt en likhetssökfråga på vektordatabasen som returnerar de n översta (där n=3 i vårt exempel) textbitar som är relevanta för frågan. Slutligen körs LLM-kedjan med det relevanta sammanhanget (en grupp relevanta textbitar) och frågan som LLM ska svara på. För en steg-för-steg-kodgenomgång av Q&A med RAG, se Python-anteckningsboken på GitHub.

Som ett alternativ till FAISS kan du också använda Amazon OpenSearch Service vektordatabasfunktioner, Amazon Relational Database Service (Amazon RDS) för PostgreSQL med pgvektor förlängning som vektordatabaser eller Chroma Database med öppen källkod.

Frågor och svar med tabelldata

Tabelldata i dokument kan vara utmanande för LLM:er att bearbeta på grund av dess strukturella komplexitet. Amazon Textract kan utökas med LLM eftersom det gör det möjligt att extrahera tabeller från dokument i ett kapslat format av element som sida, tabell och celler. Att utföra frågor och svar med tabelldata är en process i flera steg och kan uppnås via självfrågande. Följande är en översikt över stegen:

- Extrahera tabeller från dokument med Amazon Textract. Med Amazon Textract kan tabellstrukturen (rader, kolumner, rubriker) extraheras från ett dokument.

- Lagra tabelldata i en vektordatabas tillsammans med metadatainformation, såsom rubriknamnen och beskrivningen av varje rubrik.

- Använd prompten för att konstruera en strukturerad fråga, med hjälp av en LLM, för att härleda data från tabellen.

- Använd frågan för att extrahera relevant tabelldata från vektordatabasen.

Till exempel, på ett kontoutdrag, givet uppmaningen "Vilka är transaktionerna med mer än 1000 XNUMX USD i insättningar", skulle LLM slutföra följande steg:

- Skapa en fråga, t.ex

“Query: transactions” , “filter: greater than (Deposit$)”. - Konvertera frågan till en strukturerad fråga.

- Tillämpa den strukturerade frågan på vektordatabasen där vår tabelldata lagras.

För en steg-för-steg exempelkodgenomgång av Q&A med tabell, se Python-anteckningsboken i GitHub.

Mallar och normaliseringar

I det här avsnittet tittar vi på hur man använder prompt ingenjörsteknik och LangChains inbyggda mekanism för att generera en utdata med extraktioner från ett dokument i ett specificerat schema. Vi utför också viss standardisering av de extraherade uppgifterna, med hjälp av de tekniker som diskuterats tidigare. Vi börjar med att definiera en mall för vårt önskade resultat. Detta kommer att fungera som ett schema och kapslar in detaljerna om varje entitet vi vill extrahera från dokumentets text.

Observera att för var och en av enheterna använder vi beskrivningen för att förklara vad den entiteten är för att hjälpa LLM att extrahera värdet från dokumentets text. I följande exempelkod använder vi den här mallen för att skapa vår uppmaning till LLM tillsammans med texten som extraherats från dokumentet med AmazonTextractPDFLoader och utför sedan slutledning med modellen:

Som du kan se, är {keys} en del av prompten är nycklarna från vår mall, och {details} är nycklarna tillsammans med deras beskrivning. I det här fallet frågar vi inte modellen explicit med formatet på utdatan annat än att specificera i instruktionen för att generera utdata i JSON-format. Detta fungerar för det mesta; Men eftersom utdata från LLM är icke-deterministisk textgenerering, vill vi ange formatet uttryckligen som en del av instruktionen i prompten. För att lösa detta kan vi använda LangChain's strukturerad utdataparser modul för att dra nytta av den automatiserade prompttekniken som hjälper till att konvertera vår mall till en formatinstruktionsprompt. Vi använder mallen som definierats tidigare för att generera formatinstruktionen enligt följande:

Vi använder sedan denna variabel i vår ursprungliga prompt som en instruktion till LLM så att den extraherar och formaterar utdata i det önskade schemat genom att göra en liten modifiering av vår prompt:

Hittills har vi bara extraherat data ur dokumentet i ett önskat schema. Men vi behöver fortfarande utföra en del standardisering. Vi vill till exempel att patientens inläggningsdatum och utskrivningsdatum extraheras i formatet DD/MM/ÅÅÅÅ. I det här fallet utökar vi description av nyckeln med formateringsinstruktionen:

Se Python-anteckningsboken i GitHub för en fullständig steg-för-steg-genomgång och förklaring.

Stavningskontroller och korrigeringar

LLMs har visat anmärkningsvärda förmågor när det gäller att förstå och generera människoliknande text. En av de mindre diskuterade men oerhört användbara tillämpningarna av LLM är deras potential i grammatiska kontroller och meningskorrigering i dokument. Till skillnad från traditionella grammatikkontroller som förlitar sig på en uppsättning fördefinierade regler, använder LLM mönster som de har identifierat från stora mängder textdata för att avgöra vad som är korrekt eller flytande språk. Det betyder att de kan upptäcka nyanser, sammanhang och subtiliteter som regelbaserade system kan missa.

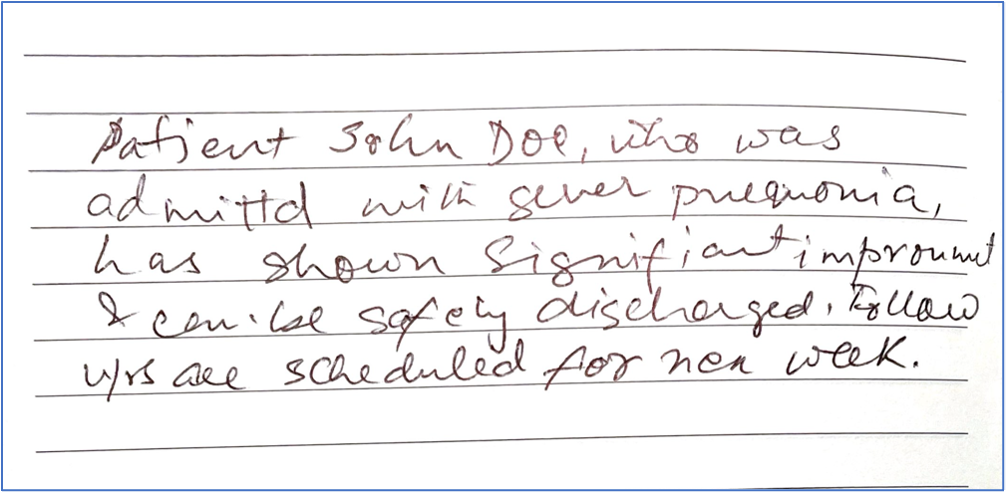

Föreställ dig texten extraherad från en sammanfattning av patientutskrivningen som lyder "Patienten Jon Doe, som lades in med svår lunginflammation, har visat betydande förbättringar och kan skrivas ut på ett säkert sätt. Uppföljningar är planerade till nästa vecka." En traditionell stavningskontroll kan känna igen "admittd", "pneumonia", "förbättring" och "nex" som fel. Sammanhanget för dessa fel kan dock leda till ytterligare misstag eller generiska förslag. En LLM, utrustad med dess omfattande utbildning, kan föreslå: "Patienten John Doe, som lades in med svår lunginflammation, har visat betydande förbättring och kan skrivas ut på ett säkert sätt. Uppföljning är planerad till nästa vecka."

Följande är ett dåligt handskrivet exempeldokument med samma text som förklarats tidigare.

Vi extraherar dokumentet med en Amazon Textract-dokumentladdare och instruerar sedan LLM, via snabbteknik, att korrigera den extraherade texten för att korrigera eventuella stavnings- och/eller grammatiska fel:

Utdata från föregående kod visar originaltexten extraherad av dokumentladdaren följt av den korrigerade texten som genereras av LLM:

Tänk på att lika kraftfulla som LLM:er är, är det viktigt att se deras förslag som just det – förslag. Även om de fångar språkets krångligheter imponerande väl, är de inte ofelbara. Vissa förslag kan ändra den avsedda innebörden eller tonen i originaltexten. Därför är det avgörande för mänskliga granskare att använda LLM-genererade korrigeringar som en guide, inte en absolut. Samarbetet av mänsklig intuition med LLM-kapacitet lovar en framtid där vår skriftliga kommunikation inte bara är felfri, utan också rikare och mer nyanserad.

Slutsats

Generativ AI förändrar hur du kan bearbeta dokument med IDP för att få insikter. I posten Förbättrar AWS intelligent dokumentbehandling med generativ AI, diskuterade vi de olika stadierna av pipelinen och hur AWS-kunden Ricoh förbättrar sin IDP-pipeline med LLM. I det här inlägget diskuterade vi olika mekanismer för att utöka IDP-arbetsflödet med LLMs via Amazon Bedrock, Amazon Textract och det populära LangChain-ramverket. Du kan komma igång med den nya Amazon Textract-dokumentladdaren med LangChain idag med hjälp av exempel på anteckningsböcker som finns i vår GitHub repository. För mer information om att arbeta med generativ AI på AWS, se Tillkännager nya verktyg för att bygga med generativ AI på AWS.

Om författarna

Sonali Sahu leder intelligent dokumentbehandling med AI/ML-serviceteamet i AWS. Hon är en författare, tankeledare och passionerad teknolog. Hennes kärnfokus är AI och ML, och hon talar ofta på AI- och ML-konferenser och möten runt om i världen. Hon har både bredd och djup erfarenhet inom teknik och teknikbranschen, med branschexpertis inom sjukvård, finanssektor och försäkring.

Sonali Sahu leder intelligent dokumentbehandling med AI/ML-serviceteamet i AWS. Hon är en författare, tankeledare och passionerad teknolog. Hennes kärnfokus är AI och ML, och hon talar ofta på AI- och ML-konferenser och möten runt om i världen. Hon har både bredd och djup erfarenhet inom teknik och teknikbranschen, med branschexpertis inom sjukvård, finanssektor och försäkring.

Anjan Biswas är Senior AI Services Solutions Architect med fokus på AI/ML och Data Analytics. Anjan är en del av det världsomspännande AI-serviceteamet och arbetar med kunder för att hjälpa dem att förstå och utveckla lösningar på affärsproblem med AI och ML. Anjan har över 14 års erfarenhet av att arbeta med globala supply chain-, tillverknings- och detaljhandelsorganisationer och hjälper aktivt kunder att komma igång och skala på AWS AI-tjänster.

Anjan Biswas är Senior AI Services Solutions Architect med fokus på AI/ML och Data Analytics. Anjan är en del av det världsomspännande AI-serviceteamet och arbetar med kunder för att hjälpa dem att förstå och utveckla lösningar på affärsproblem med AI och ML. Anjan har över 14 års erfarenhet av att arbeta med globala supply chain-, tillverknings- och detaljhandelsorganisationer och hjälper aktivt kunder att komma igång och skala på AWS AI-tjänster.

Chinmayee Rane är en AI/ML Specialist Solutions Architect på Amazon Web Services. Hon brinner för tillämpad matematik och maskininlärning. Hon fokuserar på att designa intelligent dokumentbehandling och generativa AI-lösningar för AWS-kunder. Utanför jobbet tycker hon om att dansa salsa och bachata.

Chinmayee Rane är en AI/ML Specialist Solutions Architect på Amazon Web Services. Hon brinner för tillämpad matematik och maskininlärning. Hon fokuserar på att designa intelligent dokumentbehandling och generativa AI-lösningar för AWS-kunder. Utanför jobbet tycker hon om att dansa salsa och bachata.

- SEO-drivet innehåll och PR-distribution. Bli förstärkt idag.

- PlatoData.Network Vertical Generative Ai. Styrka dig själv. Tillgång här.

- PlatoAiStream. Web3 Intelligence. Kunskap förstärkt. Tillgång här.

- Platoesg. Kol, CleanTech, Energi, Miljö, Sol, Avfallshantering. Tillgång här.

- PlatoHealth. Biotech och kliniska prövningar Intelligence. Tillgång här.

- Källa: https://aws.amazon.com/blogs/machine-learning/intelligent-document-processing-with-amazon-textract-amazon-bedrock-and-langchain/

- : har

- :är

- :inte

- :var

- .bilaga

- $1000

- $UPP

- 1

- 10

- 100

- 11

- 12

- 13

- 14

- 15%

- 16

- 22

- 23

- 33

- 35%

- 7

- 9

- a

- förmågor

- Om Oss

- Absolut

- tillgång

- Accessed

- Enligt

- noggrannhet

- exakt

- uppnås

- tvärs

- Handling

- åtgärder

- aktivt

- aktivitet

- handlingar

- Ad

- adress

- Lägger

- anslutit sig

- erkänna

- medgav

- framsteg

- Fördel

- första advent

- ålder

- medel

- AI

- AI-tjänster

- AI / ML

- Justerat

- Alla

- tillåta

- tillåter

- längs

- också

- alternativ

- Även

- amason

- Amazon Comprehend

- Amazon RDS

- amazontext

- Amazon Web Services

- mängder

- an

- analytics

- analysera

- och

- svara

- Antropisk

- vilken som helst

- API: er

- tillämpningar

- tillämpas

- möten

- tillvägagångssätt

- arkitektur

- ÄR

- OMRÅDE

- runt

- Konst

- konstgjord

- artificiell intelligens

- Konstgjord intelligens (AI)

- AS

- aspekt

- bistå

- Assistent

- At

- förstärka

- augmented

- Författaren

- automatisera

- Automatiserad

- automatiskt

- Automation

- tillgänglig

- medvetenhet

- AWS

- AWS kund

- Bank

- BE

- därför att

- blir

- varit

- innan

- fördelaktigt

- fördel

- BÄST

- bästa praxis

- mellan

- Blockera

- Block

- båda

- bredd

- Ha sönder

- raster

- SLUTRESULTAT

- Byggnad

- inbyggd

- företag

- företag

- men

- by

- Samtal

- KAN

- Kan få

- kapacitet

- fånga

- Vid

- fall

- Celler

- vissa

- kedja

- kedjor

- utmanar

- utmanande

- byta

- Förändringar

- byte

- Kontroller

- val

- hävdar

- klass

- klasser

- klassificering

- klassificera

- koda

- SAMMANHÄNGANDE

- samverkan

- Kolumn

- Kolonner

- kombination

- kombinera

- kommer

- Gemensam

- vanligen

- Kommunikation

- kompatibel

- fullborda

- komplex

- Komplexiteten

- förstå

- koncis

- konferenser

- Anslutning

- konsekvent

- består

- begränsningar

- konstruera

- innehålla

- innehöll

- innehåller

- innehåll

- sammanhang

- kontextuella

- konvertera

- Kärna

- korrekt

- Korrigerad

- Korrigeringar

- kunde

- farkoster

- tillverkad

- skapar

- avgörande

- beställnings

- kund

- Kunder

- Dans

- datum

- Data Analytics

- Databas

- databaser

- Datum

- Datum

- behandla

- djup

- djupare

- definiera

- definierade

- definierande

- demonstreras

- beroende

- insättningar

- djup

- beskriven

- beskrivning

- design

- önskas

- detalj

- detaljerad

- detaljer

- upptäcka

- Bestämma

- utveckla

- utvecklare

- Diet

- olika

- direkt

- diskutera

- diskuteras

- Dyk

- dela

- delar upp

- do

- läkare

- dokumentera

- dokumentation

- dokument

- doe

- inte

- gör

- donation

- gjort

- inte

- ner

- dramatiskt

- grund

- under

- dynamisk

- e

- varje

- Tidigare

- lätt

- LÄTTANVÄND

- effektivt

- effektivitet

- effektiv

- effektivt

- ansträngningar

- antingen

- element

- embed

- anställd

- bemyndigar

- möjliggöra

- möjliggör

- möjliggör

- änden

- Teknik

- förbättra

- förbättrad

- förbättra

- säkerställa

- säkerställa

- Hela

- enheter

- enhet

- utrustad

- fel

- väsentlig

- Även

- exempel

- Utom

- undantag

- befintliga

- erfarenhet

- expertis

- Förklara

- förklarade

- Förklarar

- förklaring

- uttryckligen

- Uttrycket

- förlänga

- förlängning

- omfattande

- extrahera

- extraktion

- extrakt

- Höst

- falsk

- långt

- trötthet

- Fält

- Figur

- slutlig

- Slutligen

- finansiella

- Finansiell sektor

- Förnamn

- passa

- Fokus

- fokuserar

- följer

- följt

- efter

- följer

- För

- format

- former

- hittade

- fundament

- Ramverk

- Fri

- ofta

- från

- Frontier

- full

- fullständigt

- ytterligare

- framtida

- Allmänt

- generera

- genereras

- genererar

- generera

- generering

- generativ

- Generativ AI

- skaffa sig

- Ge

- ges

- Välgörenhet

- grammatik

- grepp

- större

- Grupp

- styra

- sidan

- hantera

- hända

- Happening

- hårdvara

- Har

- headers

- hälso-och sjukvård

- kraftigt

- hjälpa

- hjälp

- hjälpa

- hjälper

- här

- här.

- högnivå

- högpresterande

- högre

- innehar

- sjukhuset

- Hur ser din drömresa ut

- How To

- Men

- html

- HTTPS

- humant

- i

- ID

- identifierade

- if

- illustrerar

- bild

- oerhört

- Inverkan

- importera

- med Esport

- importera

- ålagts

- förbättring

- in

- Inklusive

- index

- industrin

- informationen

- Information ålder

- Innovation

- ingång

- insikter

- exempel

- instruktioner

- försäkring

- integrera

- integrerade

- Integrera

- integrering

- Intelligens

- Intelligent

- Intelligent dokumentbehandling

- avsedd

- invändigt

- in

- intrikat

- införa

- introducerade

- Introducerar

- IT

- DESS

- Jackson

- John

- John doe

- jon

- jpg

- json

- bara

- Nyckel

- nycklar

- Vet

- kunskap

- känd

- språk

- Large

- Layout

- leda

- ledare

- ledande

- inlärning

- lämnar

- Bibliotek

- tycka om

- sannolikt

- begränsningar

- gränser

- Lista

- LLM

- läsa in

- Lastaren

- Logiken

- se

- Lot

- Maskinen

- maskininlärning

- Framställning

- hantera

- hanterlig

- förvaltade

- hantera

- manuell

- Produktion

- markant

- matematik

- Maj..

- me

- betyder

- meningsfull

- betyder

- mekanism

- mekanismer

- Meetups

- Minne

- meta

- metadata

- metod

- metoder

- kanske

- emot

- Fröken

- misstag

- ML

- modell

- modeller

- Modulerna

- mer

- hypotekslån

- mest

- multipel

- namn

- namn

- Natural

- Naturlig språkbehandling

- nödvändigt för

- Behöver

- behövs

- behov

- Nya

- Nästa

- nästa vecka

- nlp

- anteckningsbok

- nu

- nyanser

- antal

- objektet

- objekt

- of

- Erbjudanden

- Ofta

- on

- ONE

- endast

- öppen källkod

- Verksamhet

- Möjlighet

- optimala

- Tillbehör

- or

- organisationer

- ursprungliga

- Övriga

- annat

- vår

- ut

- Resultat

- produktion

- utgångar

- utanför

- över

- Översikt

- paket

- sida

- sidor

- Smärta

- parade

- par

- del

- särskilt

- passera

- Godkänd

- Förbi

- brinner

- bana

- Patienten

- Mönster

- mönster

- för

- Utföra

- prestanda

- utfört

- utför

- utför

- fas

- phd

- fraser

- rörledning

- Planen

- plato

- Platon Data Intelligence

- PlatonData

- snälla du

- lunginflammation

- poäng

- Populära

- möjlig

- Inlägg

- potentiell

- kraft

- drivs

- den mäktigaste

- praxis

- exakt

- Precision

- föredragen

- presentera

- tidigare

- primärt

- Skriva ut

- utskrifter

- Problem

- problem

- process

- Bearbetad

- bearbetning

- producera

- lovar

- rätt

- ge

- förutsatt

- leverantör

- ger

- Python

- Frågor och svar

- kvalitet

- fråga

- Snabbt

- snabbt

- Raw

- Läsning

- känner igen

- reducerande

- hänvisa

- referens

- avses

- Förhållanden

- relevanta

- förlita

- förlita

- anmärkningsvärd

- rapport

- representerar

- representerar

- Obligatorisk

- Kräver

- respektive

- svar

- begränsningar

- resultera

- resulterande

- Resultat

- detaljhandeln

- behålla

- kvarhållande

- återgår

- Rik

- Rum

- regler

- Körning

- kör

- s

- på ett säkert sätt

- Samma

- säga

- Skala

- scenarier

- planerad

- Sök

- Andra

- §

- sektioner

- sektor

- se

- segment

- vald

- senior

- mening

- Serier

- tjänar

- serverar

- service

- Tjänster

- in

- svår

- hon

- Kort

- skall

- visas

- Visar

- signifikant

- enda

- Small

- mindre

- kodavsnitt

- So

- enbart

- Lösningar

- LÖSA

- några

- Källa

- Utrymme

- talar

- specialist

- specifik

- specifikt

- specificerade

- stavning

- delas

- stadier

- standardisering

- starta

- igång

- state-of-the-art

- .

- Steg

- Steg

- Fortfarande

- lagra

- lagras

- lagrar

- styrkor

- Sträng

- strukturell

- struktur

- strukturerade

- Kamp

- senare

- Senare

- sådana

- föreslå

- sammanfatta

- SAMMANFATTNING

- leverera

- leveranskedjan

- stödja

- Stöder

- synergi

- System

- bord

- Ta

- tar

- uppgift

- uppgifter

- grupp

- Tekniken

- tekniker

- teknolog

- Teknologi

- mall

- villkor

- text

- text-

- än

- den där

- Smakämnen

- världen

- deras

- Dem

- sedan

- Där.

- därför

- Dessa

- de

- detta

- trodde

- tre

- Genom

- titan

- till

- i dag

- dagens

- tillsammans

- token

- tokens

- TON

- verktyg

- topp

- Totalt

- traditionell

- Trailing

- Utbildning

- Transaktioner

- Förvandla

- transformationer

- sann

- prova

- två

- Typ

- typer

- förstå

- förståelse

- till skillnad från

- avslöjande

- URL

- användning

- användningsfall

- Begagnade

- användare

- användningar

- med hjälp av

- utnyttjas

- Använda

- v1

- värde

- Värden

- variabel

- olika

- Omfattande

- mångsidig

- version

- via

- utsikt

- volymer

- genomgång

- vill

- var

- Sätt..

- we

- webb

- webbservice

- vecka

- VÄL

- Vad

- när

- som

- medan

- VEM

- kommer

- med

- inom

- utan

- bevittnat

- ord

- ord

- Arbete

- arbetsflöde

- arbetsflöden

- arbetssätt

- fungerar

- världen

- skulle

- skriven

- X

- år

- Om er

- zephyrnet