“Lösningar för intelligent dokumentbearbetning (IDP) extraherar data för att stödja automatisering av repetitiva dokumentbearbetningsuppgifter med stora volymer och för analys och insikt. IDP använder naturliga språkteknologier och datorseende för att extrahera data från strukturerat och ostrukturerat innehåll, särskilt från dokument, för att stödja automatisering och förstärkning." – Gartner

Målet med Amazons intelligenta dokumentbehandling (IDP) är att automatisera behandlingen av stora mängder dokument med hjälp av maskininlärning (ML) för att öka produktiviteten, minska kostnader förknippade med mänskligt arbete och ge en sömlös användarupplevelse. Kunder lägger en betydande mängd tid och ansträngning på att identifiera dokument och extrahera viktig information från dem för olika användningsfall. I dag, Amazon Comprehend stöder klassificering för vanliga textdokument, vilket kräver att du förbearbetar dokument i semistrukturerade format (skannade, digitala PDF-filer eller bilder som PNG, JPG, TIFF) och sedan använder vanlig textutdata för att göra slutsatser med din anpassad klassificering modell. På samma sätt, för anpassad enhetsigenkänning i realtid krävs förbearbetning för att extrahera text för semistrukturerade dokument som PDF- och bildfiler. Denna tvåstegsprocess introducerar komplexitet i arbetsflöden för dokumentbearbetning.

Förra året, vi meddelade stöd för inbyggda dokumentformat med anpassad namngiven enhetsigenkänning (NER) asynkrona jobb. Idag är vi glada över att tillkännage ettstegsdokumentklassificering och realtidsanalys för NER för semistrukturerade dokument i inbyggda format (PDF, TIFF, JPG, PNG) med Amazon Comprehend. Specifikt tillkännager vi följande funktioner:

- Stöd för dokument i inbyggda format för anpassad klassificering i realtid och asynkrona jobb

- Stöd för dokument i inbyggda format för anpassad enhetsigenkänning i realtid

Med denna nya version stöder Amazon Comprehend anpassad klassificering och anpassad enhetsigenkänning (NER) dokument i format som PDF, TIFF, PNG och JPEG direkt, utan att behöva extrahera UTF8-kodad vanlig text från dem. Följande figur jämför den tidigare processen med den nya proceduren och supporten.

Den här funktionen förenklar arbetsflöden för dokumentbearbetning genom att eliminera alla förbearbetningssteg som krävs för att extrahera vanlig text från dokument och minskar den totala tiden som krävs för att bearbeta dem.

I det här inlägget diskuterar vi en design av IDP-arbetsflödeslösningar på hög nivå, några branschanvändningsfall, de nya funktionerna i Amazon Comprehend och hur man använder dem.

Översikt över lösningen

Låt oss börja med att utforska ett vanligt användningsfall inom försäkringsbranschen. En typisk process för försäkringskrav involverar ett skadepaket som kan innehålla flera dokument. När ett försäkringsanspråk lämnas in innehåller det dokument som försäkringsformulär, incidentrapporter, identitetshandlingar och tredjepartskrav. Mängden dokument för att behandla och avgöra ett försäkringskrav kan ta upp till hundratals och till och med tusentals sidor beroende på vilken typ av anspråk och affärsprocesser som är involverade. Försäkringsskaderepresentanter och domare spenderar vanligtvis hundratals timmar på att manuellt sålla, sortera och extrahera information från hundratals eller till och med tusentals skadeanmälningar.

I likhet med försäkringsbranschens användningsfall behandlar betalningsbranschen också stora volymer av semistrukturerade dokument för gränsöverskridande betalningsavtal, fakturor och valutautdrag. Affärsanvändare spenderar större delen av sin tid på manuella aktiviteter som att identifiera, organisera, validera, extrahera och skicka nödvändig information till nedströmsapplikationer. Denna manuella process är tråkig, repetitiv, felbenägen, dyr och svår att skala. Andra branscher som står inför liknande utmaningar inkluderar hypotekslån och utlåning, hälsovård och biovetenskap, juridik, redovisning och skatteförvaltning. Det är oerhört viktigt för företag att bearbeta så stora volymer dokument i rätt tid med hög noggrannhet och nominell manuell ansträngning.

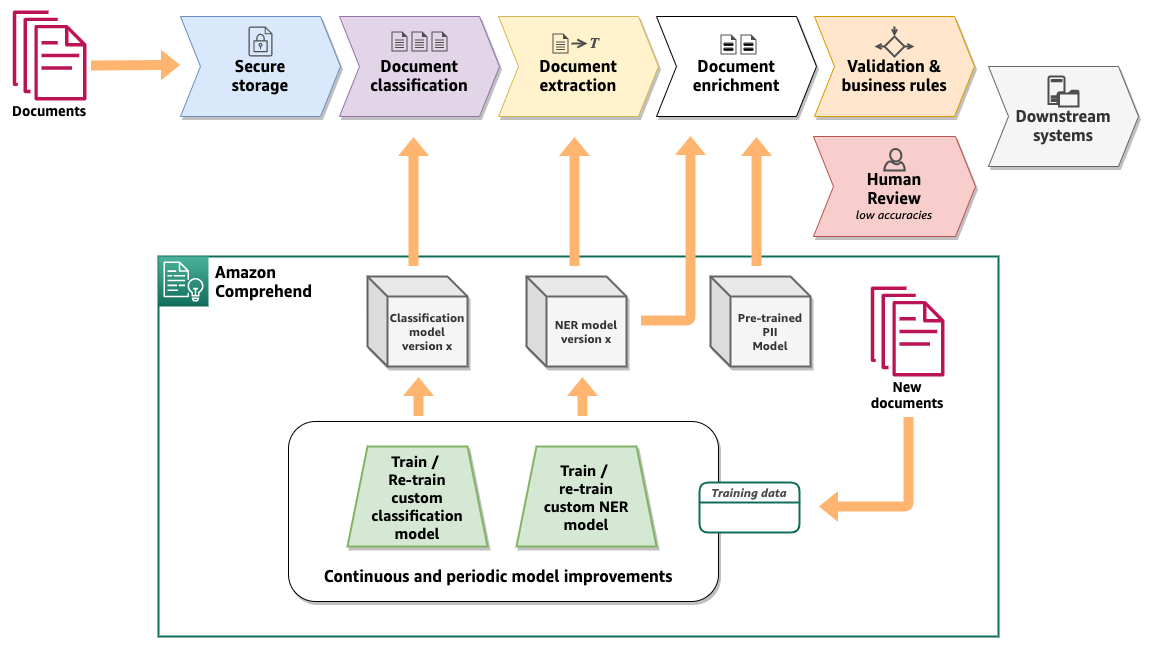

Amazon Comprehend tillhandahåller nyckelfunktioner för att automatisera dokumentklassificering och informationsextraktion från en stor volym av dokument med hög noggrannhet, på ett skalbart och kostnadseffektivt sätt. Följande diagram visar ett logiskt IDP-arbetsflöde med Amazon Comprehend. Kärnan i arbetsflödet består av dokumentklassificering och informationsextraktion med hjälp av NER med anpassade Amazon Comprehend-modeller. Diagrammet visar också hur de anpassade modellerna kontinuerligt kan förbättras för att ge högre noggrannhet i takt med att dokument och affärsprocesser utvecklas.

Anpassad dokumentklassificering

Med Amazon Comprehend anpassad klassificering kan du organisera dina dokument i fördefinierade kategorier (klasser). På hög nivå är följande steg för att ställa in en anpassad dokumentklassificerare och utföra dokumentklassificering:

- Förbered träningsdata för att träna en anpassad dokumentklassificerare.

- Träna en kunddokumentklassificerare med utbildningsdata.

- Efter att modellen har tränats kan du eventuellt implementera en realtidsslutpunkt.

- Utför dokumentklassificering med antingen ett asynkront jobb eller i realtid med hjälp av slutpunkten.

Steg 1 och 2 görs vanligtvis i början av ett IDP-projekt efter att de dokumentklasser som är relevanta för affärsprocessen har identifierats. En anpassad klassificeringsmodell kan sedan regelbundet omskolas för att förbättra noggrannheten och introducera nya dokumentklasser. Du kan träna en anpassad klassificeringsmodell antingen i flerklassläge or multi-label-läge. Utbildning kan göras för var och en på två sätt: med en CSV-fil eller med en utökad manifestfil. Hänvisa till Förbereder träningsdata för mer information om hur du tränar en anpassad klassificeringsmodell. Efter att en anpassad klassificeringsmodell har tränats kan ett dokument klassificeras antingen med hjälp av realtidsanalys eller en asynkront jobb. Realtidsanalys kräver en slutpunkt som ska distribueras med den utbildade modellen och lämpar sig bäst för små dokument beroende på användningsfallet. För ett stort antal dokument är ett asynkront klassificeringsjobb bäst lämpat.

Träna en anpassad dokumentklassificeringsmodell

För att demonstrera den nya funktionen utbildade vi en anpassad klassificeringsmodell i multi-label-läge, som kan klassificera försäkringsdokument i en av sju olika klasser. Klasserna är INSURANCE_ID, PASSPORT, LICENSE, INVOICE_RECEIPT, MEDICAL_TRANSCRIPTION, DISCHARGE_SUMMARYoch CMS1500. Vi vill klassificera exempeldokument i inbyggda PDF-, PNG- och JPEG-format, lagrade i en Amazon enkel lagringstjänst (Amazon S3) hink, med klassificeringsmodellen. Utför följande steg för att starta ett asynkront klassificeringsjobb:

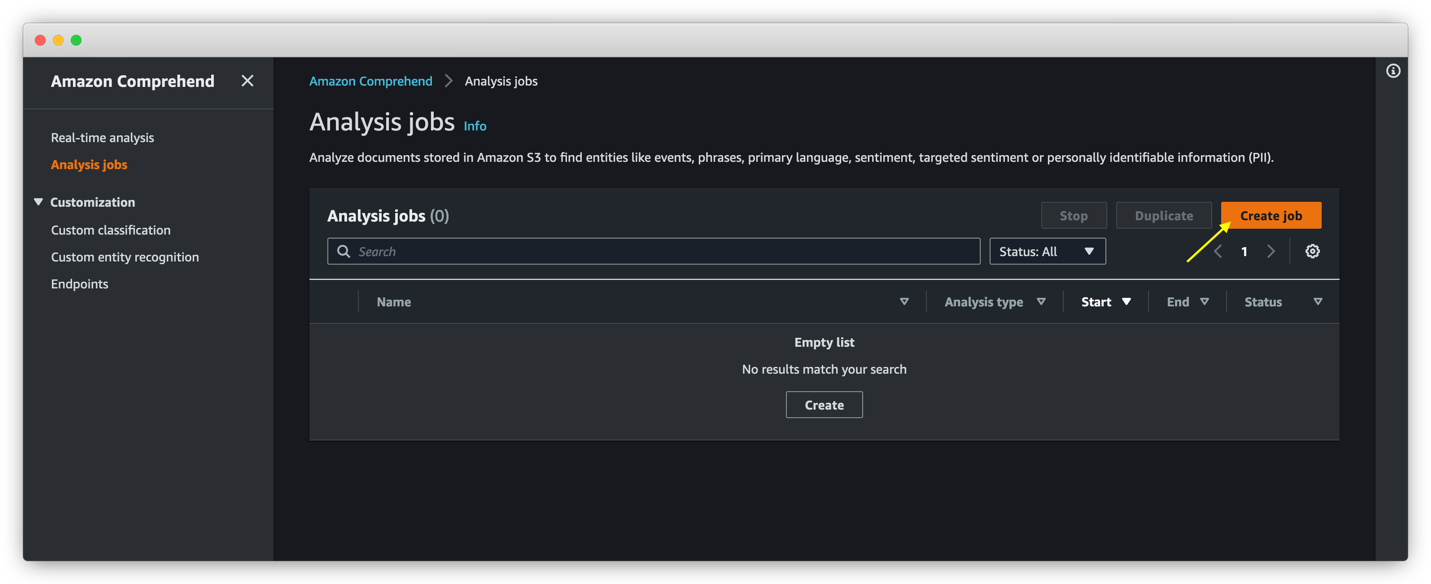

- Välj på Amazon Comprehend-konsolen Analysjobb i navigeringsfönstret.

- Välja Skapa jobb.

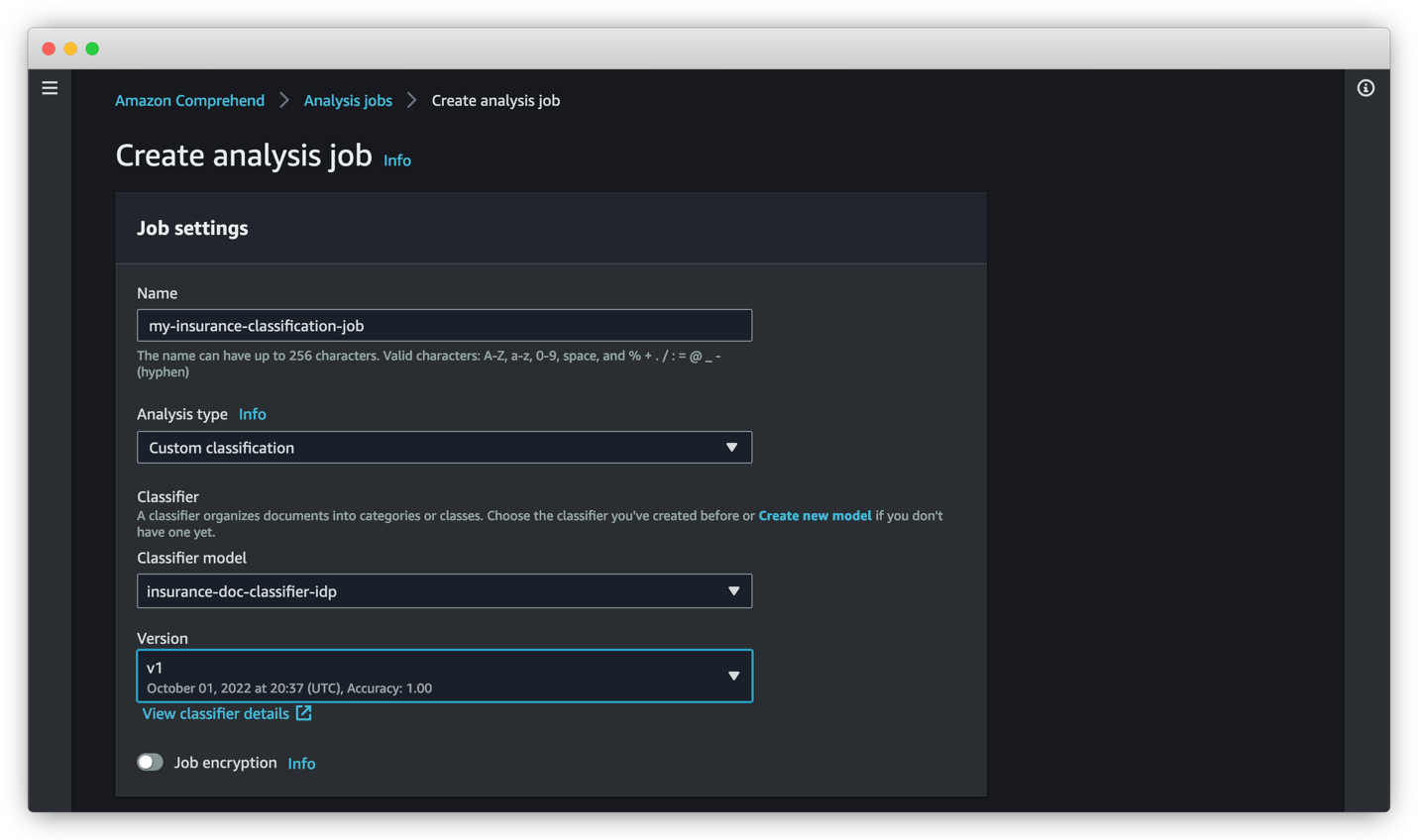

- För Namn , ange ett namn för ditt klassificeringsjobb.

- För Analystyp¸ välja Anpassad klassificering.

- För Klassificeringsmodell, välj lämplig utbildad klassificeringsmodell.

- För version, välj lämplig modellversion.

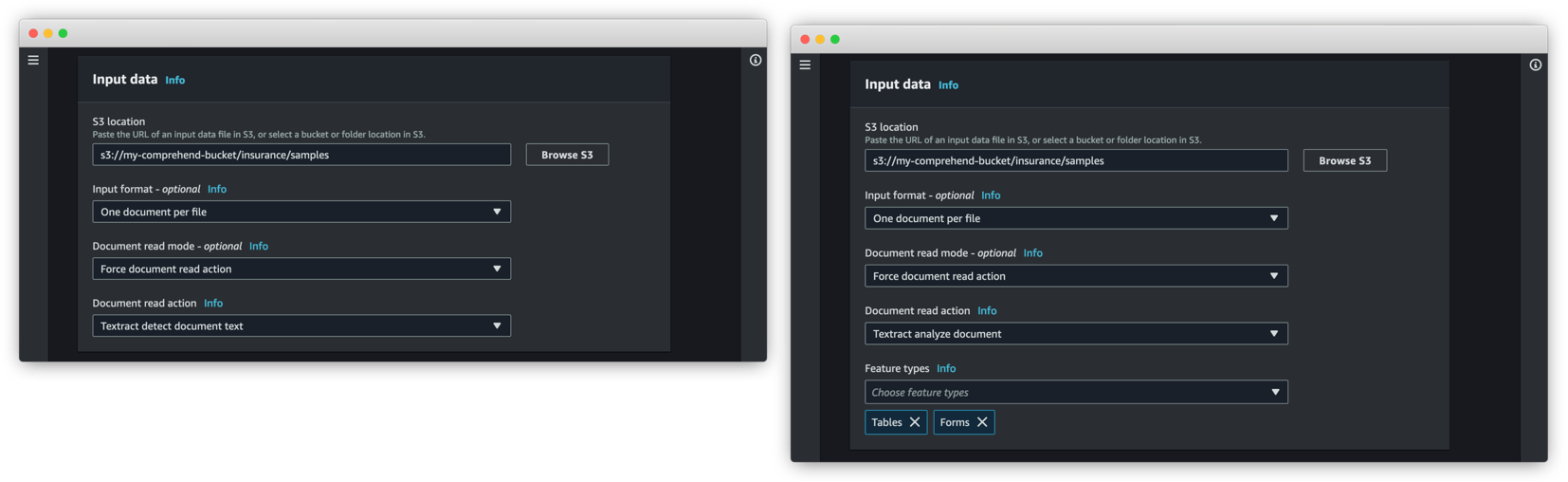

I Indata avsnitt, anger vi platsen där våra dokument lagras.

- För Inmatningsformatväljer Ett dokument per fil.

- För Läget för dokumentläsning¸ välja Tvinga dokumentläsningsåtgärd.

- För Dokumentläs åtgärdväljer Textract identifiera dokumenttext.

Detta gör det möjligt för Amazon Comprehend att använda amazontext DetectDocumentText API för att läsa dokumenten innan du kör klassificeringen. De DetectDocumentText API är till hjälp för att extrahera rader och ord med text från dokumenten. Du kan också välja Textract analysdokument för Dokumentläs åtgärd, i vilket fall Amazon Comprehend använder Amazon Textract Analysera dokument API för att läsa dokumenten. Med AnalyzeDocument API kan du välja att extrahera Bord, Blanketter, eller båda. De Läget för dokumentläsning alternativet gör det möjligt för Amazon Comprehend att extrahera texten från dokument bakom kulisserna, vilket hjälper till att minska det extra steget att extrahera text från dokumentet, vilket krävs i vårt arbetsflöde för dokumentbearbetning.

Den anpassade klassificeraren Amazon Comprehend kan också bearbeta råa JSON-svar som genereras av DetectDocumentText och AnalyzeDocument API:er, utan någon modifiering eller förbearbetning. Detta är användbart för befintliga arbetsflöden där Amazon Textract redan är involverad i att extrahera text från dokumenten. I det här fallet kan JSON-utdata från Amazon Textract matas direkt till Amazon Comprehend-dokumentklassificerings-API:erna.

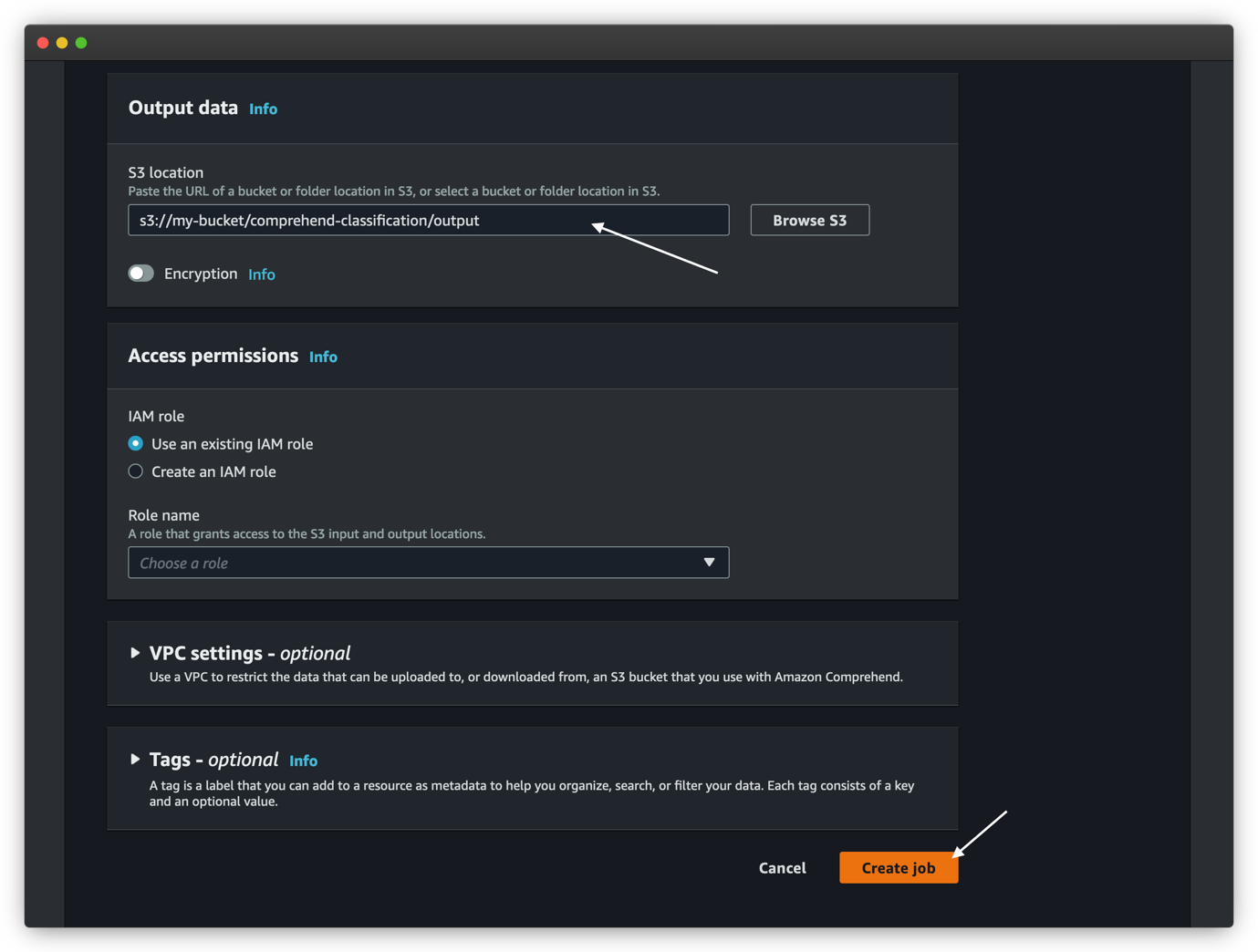

- I Utdata avsnitt, för S3-plats, ange en Amazon S3-plats där du vill att det asynkrona jobbet ska skriva resultatet av slutledningen.

- Lämna de återstående alternativen som standard.

- Välja Skapa jobb att börja jobbet.

Du kan se status för jobbet på Analysjobb sida.

När jobbet är klart kan vi se resultatet av analysjobbet, som lagras på Amazon S3-platsen som tillhandahålls under jobbkonfigurationen. Klassificeringsutdata för vårt ensidiga PDF-exempel CMS1500-dokument är som följer. Utdata är en fil i JSON-linjeformat, som har formaterats för att förbättra läsbarheten.

Det föregående exemplet är ett ensidigt PDF-dokument; dock kan anpassad klassificering också hantera flersidiga PDF-dokument. När det gäller flersidiga dokument innehåller utdata flera JSON-rader, där varje rad är klassificeringsresultatet för var och en av sidorna i ett dokument. Följande är ett exempel på flersidig klassificering:

Anpassning av anpassad enhet

Med en anpassad enhetsidentifierare från Amazon Comprehend kan du analysera dokument och extrahera enheter som produktkoder eller affärsspecifika enheter som passar dina specifika behov. På en hög nivå är följande steg för att konfigurera en anpassad enhetsidentifierare och utföra enhetsdetektering:

- Förbered träningsdata för att träna en anpassad enhetsidentifierare.

- Träna en anpassad enhetsidentifierare med träningsdata.

- Efter att modellen har tränats kan du eventuellt implementera en realtidsslutpunkt.

- Utför enhetsdetektering med antingen ett asynkront jobb eller i realtid med hjälp av slutpunkten.

En anpassad enhetsidentifieringsmodell kan regelbundet tränas om för att förbättra noggrannheten och för att introducera nya enhetstyper. Du kan träna en anpassad enhetsidentifieringsmodell med antingen enhet listar or annoteringar. I båda fallen lär sig Amazon Comprehend om den typ av dokument och sammanhanget där enheterna förekommer för att bygga en enhetsidentifieringsmodell som kan generalisera för att upptäcka nya enheter. Hänvisa till Förbereda träningsdata för att lära dig mer om att förbereda träningsdata för anpassad enhetsidentifierare.

Efter att en anpassad enhetsidentifieringsmodell har tränats kan enhetsdetektering göras antingen med realtidsanalys eller en asynkront jobb. Realtidsanalys kräver en slutpunkt som ska distribueras med den utbildade modellen och lämpar sig bäst för små dokument beroende på användningsfallet. För ett stort antal dokument är ett asynkront klassificeringsjobb bäst lämpat.

Träna en anpassad enhetsigenkänningsmodell

För att demonstrera enhetsdetekteringen i realtid tränade vi en anpassad enhetsidentifieringsmodell med försäkringsdokument och utökade manifestfiler med hjälp av anpassade anteckningar och distribuerade slutpunkten med den tränade modellen. Entitetstyperna är Law Firm, Law Office Address, Insurance Company, Insurance Company Address, Policy Holder Name, Beneficiary Name, Policy Number, Payout, Required Actionoch Sender. Vi vill upptäcka enheter från exempeldokument i inbyggt PDF-, PNG- och JPEG-format, lagrade i en S3-hink, med hjälp av igenkänningsmodellen.

Observera att du kan använda en anpassad enhetsigenkänningsmodell som är tränad med PDF-dokument för att extrahera anpassade enheter från PDF-, TIFF-, bild-, Word- och vanliga textdokument. Om din modell är tränad med hjälp av textdokument och en entitetslista, kan du bara använda vanliga textdokument för att extrahera entiteterna.

Vi måste upptäcka enheter från ett exempeldokument i alla inbyggda PDF-, PNG- och JPEG-format med hjälp av igenkänningsmodellen. För att starta ett synkront enhetsdetekteringsjobb, slutför följande steg:

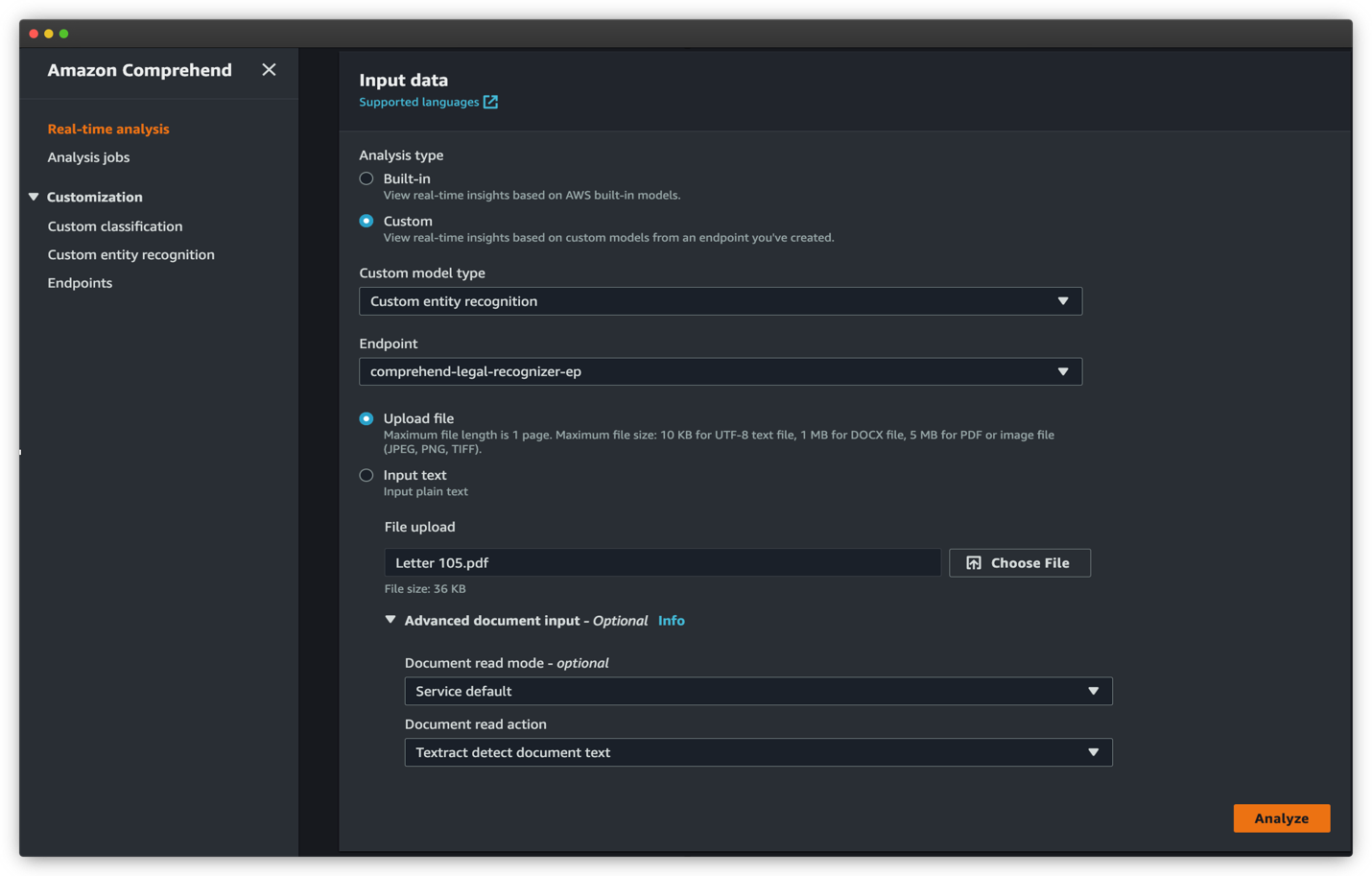

- Välj på Amazon Comprehend-konsolen Realtidsanalys i navigeringsfönstret.

- Enligt Analystyp, Välj Custom.

- För Anpassning av anpassad enhet, välj den anpassade modelltypen.

- För Slutpunkt, välj den realtidsslutpunkt som du skapade för din enhetsidentifieringsmodell.

- Välja Ladda upp fil Och välj Välj FIL för att ladda upp PDF- eller bildfilen för slutledning.

- Expandera Avancerad dokumentinmatning avsnitt och för Läget för dokumentläsningväljer Tjänstens standard.

- För Dokumentläs åtgärdväljer Textract identifiera dokumenttext.

- Välja Analysera att analysera dokumentet i realtid.

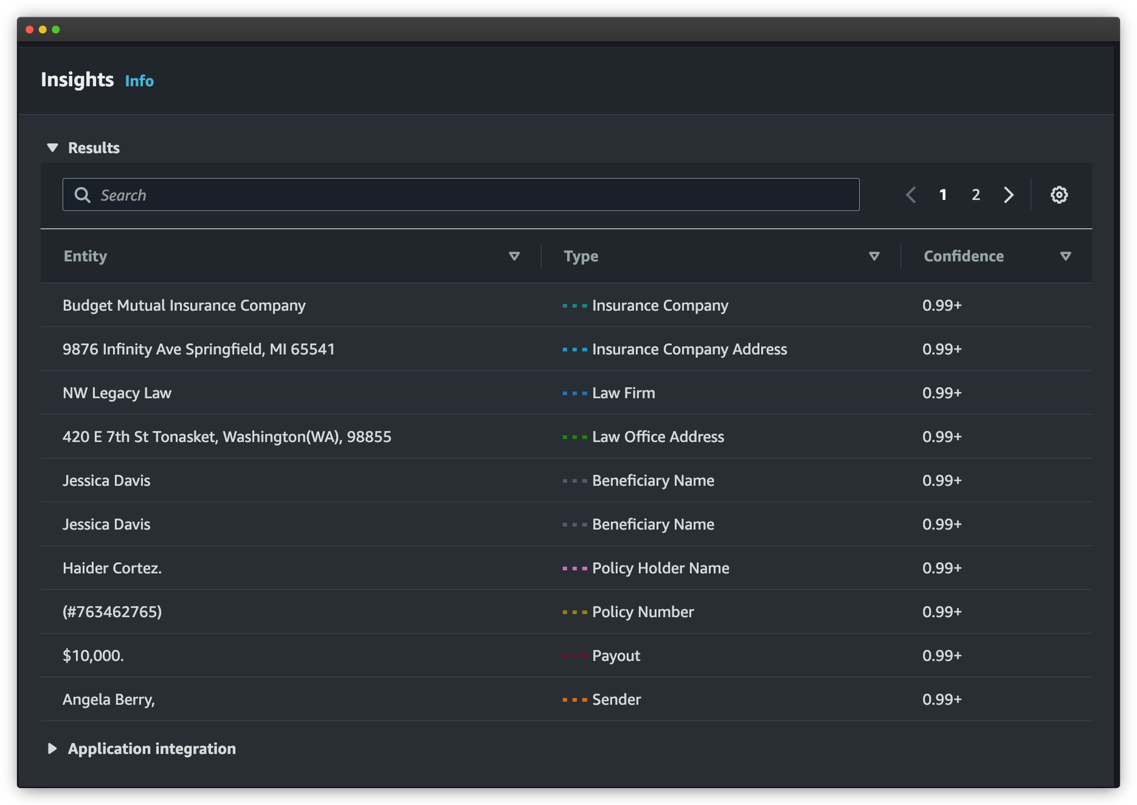

De erkända enheterna är listade i Insikter sektion. Varje entitet innehåller entitetsvärdet (texten), typen av entitet som definierats av dig under träningsprocessen och motsvarande konfidenspoäng.

För mer information och en fullständig genomgång av hur man tränar en anpassad enhetsidentifieringsmodell och använder den för att utföra asynkron slutledning med asynkrona analysjobb, se Extrahera anpassade enheter från dokument i deras ursprungliga format med Amazon Comprehend.

Slutsats

Det här inlägget demonstrerade hur du kan klassificera och kategorisera semistrukturerade dokument i deras ursprungliga format och upptäcka affärsspecifika enheter från dem med Amazon Comprehend. Du kan använda API:er i realtid för användningsfall med låg latens, eller använda asynkrona analysjobb för bulkdokumentbehandling.

Som nästa steg uppmuntrar vi dig att besöka Amazon Comprehend GitHub repository för fullständiga kodexempel för att testa dessa nya funktioner. Du kan också besöka Amazon Comprehend Developer Guide och Amazon Comprehend utvecklarresurser för videor, tutorials, bloggar och mer.

Om författarna

Wrick Talukdar är seniorarkitekt med Amazon Comprehend Service-teamet. Han arbetar med AWS-kunder för att hjälpa dem att ta till sig maskininlärning i stor skala. Utanför jobbet tycker han om att läsa och fotografera.

Wrick Talukdar är seniorarkitekt med Amazon Comprehend Service-teamet. Han arbetar med AWS-kunder för att hjälpa dem att ta till sig maskininlärning i stor skala. Utanför jobbet tycker han om att läsa och fotografera.

Anjan Biswas är Senior AI Services Solutions Architect med fokus på AI/ML och Data Analytics. Anjan är en del av det världsomspännande AI-serviceteamet och arbetar med kunder för att hjälpa dem att förstå och utveckla lösningar på affärsproblem med AI och ML. Anjan har över 14 års erfarenhet av att arbeta med globala supply chain-, tillverknings- och detaljhandelsorganisationer och hjälper aktivt kunder att komma igång och skala på AWS AI-tjänster.

Anjan Biswas är Senior AI Services Solutions Architect med fokus på AI/ML och Data Analytics. Anjan är en del av det världsomspännande AI-serviceteamet och arbetar med kunder för att hjälpa dem att förstå och utveckla lösningar på affärsproblem med AI och ML. Anjan har över 14 års erfarenhet av att arbeta med globala supply chain-, tillverknings- och detaljhandelsorganisationer och hjälper aktivt kunder att komma igång och skala på AWS AI-tjänster.

Godwin Sahayaraj Vincent är en Enterprise Solutions Architect på AWS som brinner för maskininlärning och ger vägledning till kunder för att designa, distribuera och hantera deras AWS-arbetsbelastningar och arkitekturer. På fritiden älskar han att spela cricket med sina vänner och tennis med sina tre barn.

Godwin Sahayaraj Vincent är en Enterprise Solutions Architect på AWS som brinner för maskininlärning och ger vägledning till kunder för att designa, distribuera och hantera deras AWS-arbetsbelastningar och arkitekturer. På fritiden älskar han att spela cricket med sina vänner och tennis med sina tre barn.

- Avancerat (300)

- AI

- ai konst

- ai art generator

- har robot

- Amazon Comprehend

- artificiell intelligens

- artificiell intelligenscertifiering

- artificiell intelligens inom bankväsendet

- artificiell intelligens robot

- robotar med artificiell intelligens

- programvara för artificiell intelligens

- AWS maskininlärning

- blockchain

- blockchain konferens ai

- coingenius

- konversationskonstnärlig intelligens

- kryptokonferens ai

- dalls

- djupt lärande

- du har google

- maskininlärning

- plato

- plato ai

- Platon Data Intelligence

- Platon spel

- PlatonData

- platogaming

- skala ai

- syntax

- zephyrnet