Oavsett om du arbetar i en liten startup eller i ett stort transnationellt företag, finns det en god chans att du redan har hört talas om automatisering av arbetsflöden. Faktum är att det förmodligen finns en ännu större chans att du har interagerat med verktyg och element som automatiserar en del av din arbetsbelastning, till en viss grad. Från att hjälpa till med uppgifter som att sortera och indexera e-postmeddelanden; genom att mata in data i ett ark, eller hantera dina arbetsvitala digitala dokument, för att helt automatisera viktiga affärsprocesser, har automatisering av arbetsflöden i allt högre grad blivit ett viktigt verktyg för det dagliga livet i framgångsrika företag.

Dock traditionella arbetsflödesautomatisering processer är inte utan sina begränsningar: De är till exempel beroende av en strikt uppsättning regler, som per definition är begränsade i omfattning och skalbarhet, och som ofta kräver mänsklig insats för att fungera effektivt. Dessutom, eftersom de kräver mänsklig insats, öppnar detta vägen för mänskliga fel, för att inte tala om att dessa verktyg inte heller kan hjälpa till med beslutsfattande på ett tillförlitligt sätt. Det är här AI och stora språkmodeller kommer in i bilden, eftersom att integrera chatbots som ChatGPT i automatiseringsprocessen för arbetsflöden kan exponentiellt öka effektiviteten och effektiviteten hos dessa verktyg.

AI:s roll i arbetsflödesautomatisering

Tidigare var arbetsflödesautomatisering begränsad till begränsningarna för dess skript och övergripande programmering. Som sådana krävde dessa verktyg alltid åtminstone en del mänsklig övervakning och interaktion för att säkerställa att de fungerar som avsett, vilket motverkar syftet med automatisering. Dessutom är uppgifter som skulle kräva mer komplexa interaktioner som att förutsäga resultat baserat på datainmatningar och analysera datamönster för att upptäcka och skydda mot bedrägerier, för att nämna ett par, alla utom räckhåll när det kommer till dessa traditionella arbetsflödesautomatiseringsinsatser.

Genom att införliva artificiell intelligens i området för automatisering av arbetsflöden kan vi täcka ett bredare utbud av uppgifter och till och med ta itu med processer som annars skulle ha varit omöjliga tidigare, som de som nämns ovan. Andra fördelar med att implementera artificiell intelligens i processerna för automatisering av arbetsflöden inkluderar förbättrat beslutsfattande; prediktiv analys; bild- och taligenkänning och robotprocessautomation, bland annat.

Ett bra exempel på denna implementering är hur Nanonets använder AI för att automatisera e-postanalys, vilket minskar handläggningstider och manuell ansträngning som krävs för att slutföra denna standarduppgift. En av kärntillämpningarna för Nanonets kretsar kring att förenkla datafångstarbetet genom användning av artificiell intelligens. Specifikt möjliggör vår AI att samla in exakt information du behöver från alla dokument – även från de som inte följer standardmallar – och validera och exportera den enligt dina krav.

Denna specifika komponent i vår AI effektiviserar och optimerar kraftigt arbetsflöde för dokumenthantering, samtidigt som den producerar ren information med minskade risker för mänskliga fel.

Vad är en LLM?

En LLM, eller Large Language Model, är en avancerad typ av artificiell intelligens som kan generera människoliknande text baserat på en given input. Dessa modeller, som OpenAI:s GPT-4, är tränade på stora mängder data för att förstå sammanhang, generera meningsfulla svar och utföra komplexa uppgifter. Genom att utnyttja LLM:er kan företag och individer automatisera olika aspekter av sina arbetsflöden, öka produktiviteten och minska mänskliga fel.

Hur LLM hjälper till att förbättra arbetsflödesautomatiseringen?

Även med de framsteg som artificiell intelligens har sett under de senaste åren, och trots dess växande roll i arbetsflödesautomatisering, har detta verktyg fortfarande några avgörande begränsningar i vad det kan uppnå. Mer specifikt saknar AI:er i sig själva förmågan att bearbeta naturliga språkinmatningar och har begränsade metoder för att producera personlig data som tillgodoser användarens exakta behov.

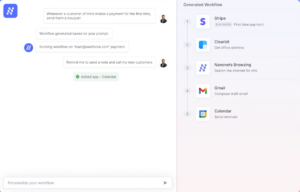

Det är här stora språkmodeller (LLM) kommer in i bilden, vilket ger AI:er ett extra lager av djup, vilket gör att de inte bara kan bearbeta stora mängder data, utan också förstå användarens krav baserat på naturliga språkinmatningar, för att kunna bearbeta och presentera data på ett effektivt och användarvänligt sätt. Den senaste utvecklingen av chatbots som ChatGPT har möjliggjort integrationen av GPT-4 LLM med vissa strävanden för automatisering av arbetsflöden. Företag som Zapier har nyligen införlivat denna teknik i sina befintliga erbjudanden, vilket ger dem mycket mer flexibilitet och övervinner de flesta tidigare begränsningar av sina AI-lösningar.

Möjligheten att bearbeta språkinmatningar öppnar fältet för fler automatiseringssträvanden, särskilt när det kommer till användarinteraktioner och engagemang. Som sådan banar denna utveckling väg för mer praktisk användning, som att använda AI för att direkt interagera med användare och klienter.

Ett bra exempel på denna utveckling är hur Uber använder AI och LLM för att effektivisera kommunikationen mellan användare och förare. Sättet detta fungerar är att närhelst en användare eller en förare matar in en fråga via chattfunktionen, kommer den naturliga språkbehandlingskomponenten i dess Michelangelo AI att bearbeta texten för att urskilja avsikten och producera svar som användarna kan välja med en enda knacka. Detta gör resan mycket säkrare för föraren, eftersom de kan hålla uppmärksamheten på navigeringen, utan att manuellt behöva svara på sms eller samtal, samtidigt som de säkerställer att kunderna får snabba svar på sina sms.

I samma ven, Coca Cola har också sysslat med AI med sina moderna varuautomater, som ansluter till Coca Cola Freestyle-appen för att underlätta PoS-verksamheten vid köp av drycker från dessa automater. Implementeringen hjälper också till att fånga in viktig data som individuella köp, som i sin tur automatiskt kan fångas in och användas av de internetaktiverade varuautomaterna för att uppmuntra lagerhållning av de mest populära dryckerna i det området, vilket förbättrar försäljningen. Dessutom lägger AI också till en "gamification"-aspekt till användarens arbetsflöde genom att tillåta användare att interagera med sin chatbot ombord via Facebook Messenger, som använder NLP för att anpassa sitt språk och personlighet per användare.

Men alla dessa innovationer är inte relaterade till att förbättra användarnas engagemang och marknadsföring. Typexempel, IBM Watsons AI-plattform använder LLM för att införliva bearbetningsmöjligheter för naturligt språk i sin lösning med artificiell intelligens, vilket ger den möjligheten att betjäna en mängd olika branscher inklusive hälsovård, finans och kundtjänst. AI:n kan förstå naturliga språkingångar; fånga data för att etablera mönster och tillhandahålla en mängd olika insikter för att förbättra arbetsflödesautomatiseringen för sina användare.

AI och LLM har också blivit instrumentella inom läkemedelsområdet, eftersom företag som Johnson & Johnson en gång anammat deras användning för att bearbeta och analysera stora volymer av vetenskaplig text och litteratur. Förväntningen var att AI:n genom naturlig språkbehandling och maskininlärningsalgoritmer skulle kunna lyfta fram och föreslå potentiella metoder för att utveckla nya läkemedel, vilket i sin tur är en enorm välsignelse i arbetsflödesautomatiseringen av läkemedelsupptäcktsprocessen. Medan själva produkten har avvecklats från och med 2019 på grund av dåliga ekonomiska resultat, belyser den den potentiella användningen av dessa teknologier inom området läkemedelsupptäckt.

Använda LLM för att automatisera arbetsflöden

Att utnyttja kraften i stora språkmodeller (LLM) kan avsevärt förenkla arbetsflöden och spara tid. Från att utarbeta e-postmeddelanden och generera innehåll till att automatisera projektledning och tillhandahålla kundsupport kan LLM:er förstå och tolka användarinmatningar för att generera kontextuellt relevanta utdata. Här är några vanliga användningsfall där LLM kan bidra till att förbättra produktiviteten.

Utarbeta e-postmeddelanden och annan kommunikation

LLM:er kan användas för att skriva e-postmeddelanden, uppdateringar av sociala medier och andra former av kommunikation. Genom att tillhandahålla en kort översikt eller nyckelpunkter kan LLM generera ett välstrukturerat, sammanhängande och kontextuellt relevant budskap. Detta sparar tid och säkerställer att din kommunikation är tydlig och professionell.

Vi har skapat ett enkelt AI-e-postparserverktyg som hjälper dig att skapa färdiga e-postmeddelanden genom att ge det enkel input. Prova kostnadsfritt

Innehållsgenerering

Oavsett om du behöver skapa blogginlägg, produktbeskrivningar eller marknadsföringsmaterial kan LLM:er hjälpa till genom att skapa innehåll av hög kvalitet. Ge bara en disposition eller ett ämne, så kommer LLM att använda sin stora kunskapsbas för att skapa innehåll som är engagerande, informativt och välstrukturerat.

Uppgiftsautomation

LLM:er kan integreras med olika uppgiftshanteringssystem, som Trello, Asana eller Monday.com, för att automatisera projekt- och uppgiftshantering. Genom att använda naturlig språkbehandling kan LLM:er förstå och tolka användarinmatningar, skapa uppgifter, uppdatera statusar och tilldela prioriteringar utan behov av manuell intervention.

Dataanalys och rapportering

LLM:er kan användas för att analysera stora datamängder och generera rapporter eller sammanfattningar. Genom att förse LLM med relevant information kan den identifiera trender, mönster och insikter och omvandla rådata till handlingsbar intelligens. Detta kan vara särskilt värdefullt för företag som vill fatta datadrivna beslut.

Helpdesk

Genom att integrera LLM i dina kundsupportsystem kan du automatisera svar på vanliga frågor, vilket minskar arbetsbelastningen på ditt supportteam. LLM:er kan förstå sammanhanget och syftet med en kunds förfrågan och genererar användbara och korrekta svar i realtid.

Programmeringshjälp

LLM:er kan användas för att generera kodavsnitt, ge förslag på felsökning eller ge vägledning om bästa programmeringsmetoder. Genom att utnyttja LLM:s stora kunskap om programmeringsspråk och ramverk kan utvecklare spara tid och säkerställa att deras kod är optimerad och effektiv.

Bästa praxis för implementering av LLM

Identifiera lämpliga användningsfall

Innan du integrerar en LLM i dina arbetsflöden är det viktigt att identifiera uppgifter som är väl lämpade för automatisering. Uppgifter som involverar repetitiva processer, kräver naturlig språkförståelse eller involverar generering av innehåll är idealiska kandidater.

Börja med ett pilotprojekt

När du implementerar LLM:er är det en bra idé att börja med ett litet pilotprojekt. Detta gör att du kan mäta effektiviteten av LLM, förfina ditt tillvägagångssätt och identifiera eventuella utmaningar innan du skalar upp.

Övervaka och optimera

Som med all AI-driven teknik kan LLM:er kräva finjustering och optimering för att säkerställa att de uppfyller dina specifika behov. Övervaka regelbundet prestandan för LLM, samla in feedback från användare och gör nödvändiga justeringar för att förbättra dess effektivitet.

Slutsats

Vi har knappt precis skrapat på ytan när det kommer till hur LLM:er som GPT-4 revolutionerar området för automatisering av arbetsflöden. Alla dessa bevis pekar på det faktum att framtidens affärsverksamhet kommer att se ett mycket större AI-engagemang som ett verktyg för att stödja uppgifterna och ansträngningarna för både personalen, såväl som deras potentiella kunder och användare.

Har du interagerat med några LLM-baserade verktyg för automatisering av arbetsflöden? Dela gärna dina erfarenheter och tankar med oss!

- SEO-drivet innehåll och PR-distribution. Bli förstärkt idag.

- Platoblockchain. Web3 Metaverse Intelligence. Kunskap förstärkt. Tillgång här.

- Källa: https://nanonets.com/blog/leveraging-llms-to-streamline-and-automate-your-workflows/

- :är

- $UPP

- 7

- a

- förmåga

- ovan

- exakt

- Uppnå

- anpassa

- Dessutom

- adress

- Lägger

- antagen

- avancerat

- framsteg

- AI

- Stöd

- algoritmer

- Alla

- tillåta

- tillåter

- redan

- alltid

- bland

- mängder

- analys

- analytics

- analysera

- analys

- och

- app

- tillämpningar

- tillvägagångssätt

- ÄR

- OMRÅDE

- runt

- konstgjord

- artificiell intelligens

- AS

- aspekt

- aspekter

- At

- uppmärksamhet

- automatisera

- automatiskt

- automatisera

- Automation

- bas

- baserat

- grund

- BE

- blir

- innan

- Fördelarna

- BÄST

- mellan

- Blogg

- Blogginlägg

- företag

- företag

- by

- Samtal

- KAN

- kandidater

- kapacitet

- kapabel

- fånga

- Fångande

- Vid

- fall

- vissa

- utmaningar

- chans

- chanser

- chatbot

- chatbots

- ChatGPT

- Välja

- klar

- klienter

- coca

- koda

- SAMMANHÄNGANDE

- cola

- Samla

- COM

- komma

- Gemensam

- Kommunikation

- Trygghet i vårdförloppet

- Företag

- fullborda

- komplex

- komponent

- slutsats

- Kontakta

- begränsningar

- innehåll

- sammanhang

- Kärna

- FÖRETAG

- kunde

- Par

- täcka

- farkoster

- skapa

- skapas

- Skapa

- avgörande

- kund

- Kundservice

- Helpdesk

- datum

- data driven

- datauppsättningar

- dag för dag

- Beslutet

- Beslutsfattande

- beslut

- djup

- Trots

- utvecklare

- utveckla

- Utveckling

- utvecklingen

- digital

- direkt

- Upptäckten

- dokument

- inte

- utkast

- drycker

- chaufför

- chaufförer

- drog

- Läkemedel

- Effektiv

- effektivt

- effektivitet

- effektivitet

- effektiv

- ansträngning

- ansträngningar

- element

- e-posttolkare

- e

- möjliggör

- uppmuntra

- strävanden

- ingrepp

- engagerande

- förbättra

- säkerställa

- säkerställer

- säkerställa

- helt

- fel

- speciellt

- väsentlig

- etablera

- Även

- bevis

- exempel

- befintliga

- förväntan

- Erfarenheter

- exponentiellt

- extra

- facebook messenger

- främja

- Leverans

- återkoppling

- få

- fält

- Fält

- finansiering

- finansiella

- finansiella resultat

- Flexibilitet

- följer

- För

- former

- ramar

- bedrägeri

- Fri

- ofta

- från

- Vidare

- framtida

- generera

- generera

- ges

- Ge

- god

- större

- kraftigt

- Odling

- vägleda

- praktisk

- Har

- har

- hälso-och sjukvård

- hört

- hjälpa

- hjälp

- hjälper

- här.

- hög kvalitet

- Markera

- höjdpunkter

- Hur ser din drömresa ut

- html

- HTTPS

- humant

- IBM

- Tanken

- idealisk

- identifiera

- bild

- genomförande

- genomföra

- med Esport

- omöjligt

- förbättra

- förbättras

- förbättra

- in

- innefattar

- Inklusive

- införliva

- Inkorporerad

- införlivande

- Öka

- alltmer

- individuellt

- individer

- industrier

- informationen

- informativ

- innovationer

- ingång

- insikter

- exempel

- instrumental

- integrerade

- Integrera

- integrering

- Intelligens

- uppsåt

- interagera

- interaktion

- interaktioner

- ingripande

- engagera

- inblandning

- IT

- DESS

- sig

- Johnson

- resa

- Ha kvar

- Nyckel

- kunskap

- Brist

- språk

- Språk

- Large

- större

- lager

- inlärning

- hävstångs

- livet

- tycka om

- begränsningar

- Begränsad

- litteraturen

- LLM

- du letar

- Maskinen

- maskininlärning

- Maskiner

- göra

- GÖR

- Framställning

- ledning

- hantera

- sätt

- manuell

- manuellt

- Marknadsföring

- massiv

- material

- meningsfull

- Media

- Möt

- nämnts

- meddelande

- Messenger

- metoder

- modell

- modeller

- Modern Konst

- Måndag

- Övervaka

- övervakning

- mer

- Dessutom

- mest

- Mest populär

- namn

- Natural

- Naturlig språkbehandling

- navigerande

- nödvändigt för

- Behöver

- behov

- Nya

- nlp

- of

- erbjudanden

- offer~~POS=TRUNC

- on

- Ombord

- ONE

- OpenAI

- öppnas

- Verksamhet

- optimering

- optimerad

- optimerar

- beställa

- Övriga

- Övrigt

- annat

- översikt

- övergripande

- del

- särskilt

- Tidigare

- mönster

- Utföra

- prestanda

- Personlighet

- personlig

- Personal

- läkemedel

- Föraren

- pilotprojekt

- plato

- Platon Data Intelligence

- PlatonData

- Spela

- Punkt

- poäng

- dålig

- Populära

- PoS

- inlägg

- potentiell

- kraft

- praxis

- förutsäga

- Predictive Analytics

- presentera

- förmodligen

- process

- Processautomation

- processer

- bearbetning

- producera

- Produkt

- produktivitet

- professionell

- Programmering

- programmeringsspråk

- projektet

- projektledning

- skydda

- ge

- tillhandahålla

- inköp

- inköp

- Syftet

- frågor

- område

- Raw

- nå

- redo

- realtid

- motta

- senaste

- nyligen

- erkännande

- Minskad

- reducerande

- förfina

- regelbundet

- relaterad

- relevanta

- repetitiva

- Rapport

- kräver

- Obligatorisk

- Krav

- Svara

- revolutionera

- Robot processautomation

- Roll

- regler

- s

- säkrare

- försäljning

- Samma

- Save

- skalbarhet

- skalning

- vetenskaplig

- omfattning

- skript

- service

- in

- Dela

- Enkelt

- förenkla

- förenkla

- helt enkelt

- eftersom

- enda

- Small

- Social hållbarhet

- sociala medier

- lösning

- Lösningar

- några

- specifik

- specifikt

- tal

- Taligenkänning

- standard

- starta

- start

- Fortfarande

- effektivisera

- Strikt

- framgångsrik

- sådana

- lämplig

- stödja

- Stödsystem

- yta

- System

- Tryck

- uppgift

- uppgifter

- grupp

- Tekniken

- Teknologi

- den där

- Smakämnen

- Framtiden

- deras

- Dem

- sig själva

- Dessa

- Genom

- tid

- gånger

- till

- verktyg

- verktyg

- ämne

- traditionell

- tränad

- omvandla

- gränsöverskridande

- Trender

- SVÄNG

- förstå

- förståelse

- Uppdateringar

- uppdatering

- användning

- Användare

- användarvänligt

- användare

- Värdefulla

- mängd

- olika

- Omfattande

- Ve

- via

- volymer

- Sätt..

- VÄL

- Vad

- som

- medan

- bred

- bredare

- kommer

- med

- utan

- arbetsflöden

- arbetssätt

- fungerar

- skulle

- år

- Om er

- Din

- zephyrnet