Att bygga ut en plattform för maskininlärning (MLOps) i det snabbt utvecklande landskapet av artificiell intelligens (AI) och maskininlärning (ML) för organisationer är avgörande för att sömlöst överbrygga gapet mellan datavetenskapliga experiment och implementering samtidigt som kraven kring modellprestanda tillgodoses, säkerhet och efterlevnad.

För att uppfylla regulatoriska krav och efterlevnadskrav är nyckelkraven vid design av en sådan plattform:

- Adressdatadrift

- Övervaka modellens prestanda

- Underlätta automatisk modellomskolning

- Ge en process för modellgodkännande

- Förvara modellerna i en säker miljö

I det här inlägget visar vi hur man skapar ett MLOps-ramverk för att möta dessa behov samtidigt som vi använder en kombination av AWS-tjänster och verktygsuppsättningar från tredje part. Lösningen innebär en multimiljöinställning med automatiserad modellomskolning, batchinferens och övervakning med Amazon SageMaker modellmonitor, modellversionering med SageMaker modellregister, och en CI/CD-pipeline för att underlätta marknadsföring av ML-kod och pipelines över miljöer genom att använda Amazon SageMaker, Amazon EventBridge, Amazon enkel meddelandetjänst (Amazon S3), HashiCorp Terraform, GitHuboch Jenkins CI/CD. Vi bygger en modell för att förutsäga svårighetsgraden (godartad eller elakartad) av en mammografisk massaskada som tränas med XGBoost-algoritm använda det allmänt tillgängliga UCI Mammografi Mass dataset och distribuera det med hjälp av MLOps-ramverket. De fullständiga instruktionerna med kod finns tillgängliga i GitHub repository.

Lösningsöversikt

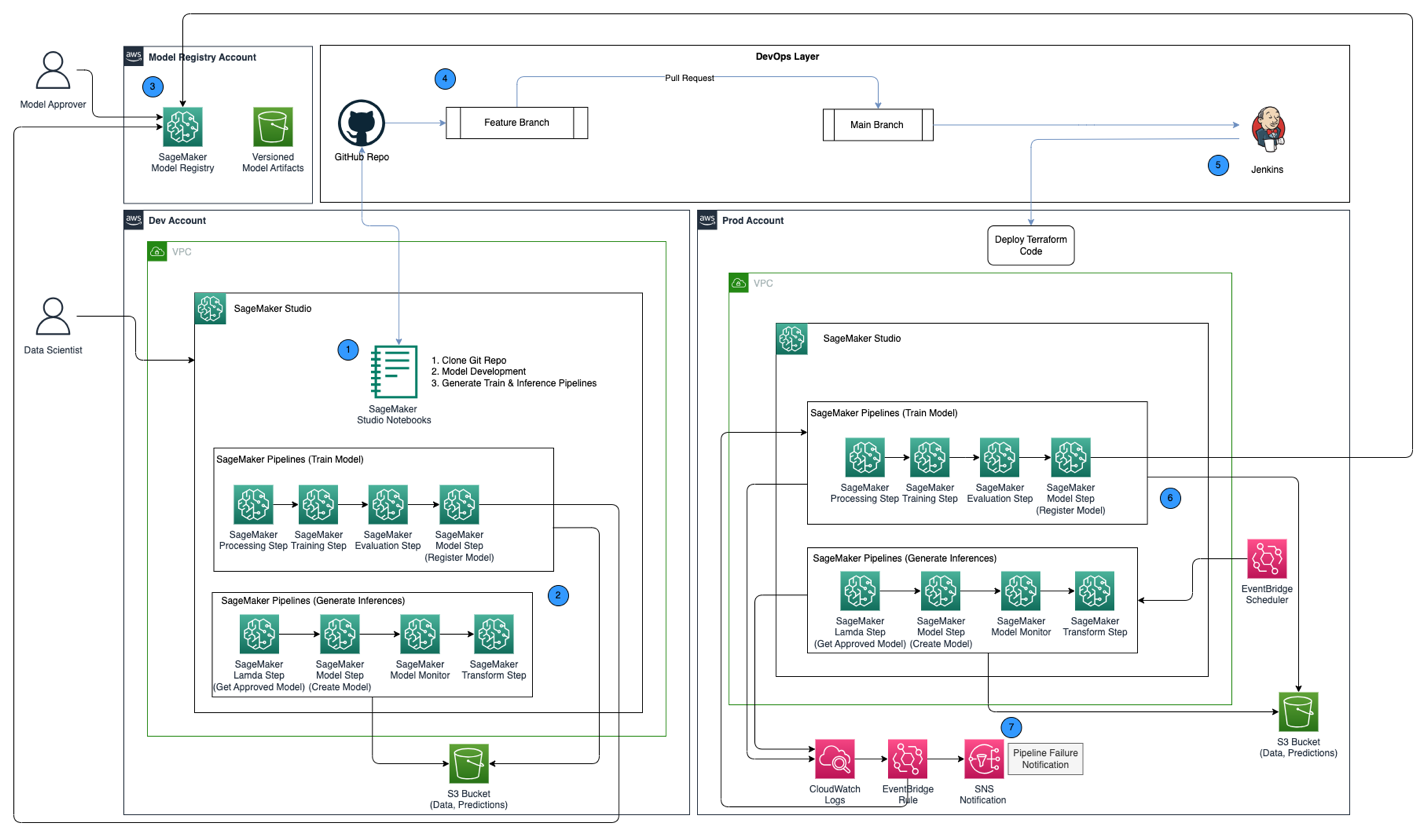

Följande arkitekturdiagram visar en översikt över MLOps-ramverket med följande nyckelkomponenter:

- Flerkontostrategi – Två olika miljöer (dev och prod) ställs in i två olika AWS-konton enligt AWS Well-Architected best practices, och ett tredje konto ställs in i det centrala modellregistret:

- Dev miljö – Där en Amazon SageMaker Studio-domän är inrättat för att möjliggöra modellutveckling, modellträning och testning av ML-pipelines (tåg och slutledning), innan en modell är redo att marknadsföras till högre miljöer.

- Prod miljö – Där ML-pipelines från dev befordras till som ett första steg och schemaläggs och övervakas över tid.

- Centralt modellregister - Amazon SageMaker Model Registry ställs in i ett separat AWS-konto för att spåra modellversioner som genereras i dev- och prod-miljöerna.

- CI/CD och källkontroll – Utplaceringen av ML-pipelines över miljöer hanteras genom CI/CD-uppsättning med Jenkins, tillsammans med versionskontroll som hanteras via GitHub. Kodändringar sammanslagna med motsvarande miljö git branch triggar ett CI/CD-arbetsflöde för att göra lämpliga ändringar i den givna målmiljön.

- Batchförutsägelser med modellövervakning – Slutledningsledningen byggd med Amazon SageMaker-rörledningar körs på schemalagd basis för att generera förutsägelser tillsammans med modellövervakning med SageMaker Model Monitor för att upptäcka datadrift.

- Automatiserad omskolningsmekanism – Den träningspipeline som byggts med SageMaker Pipelines utlöses när en datadrift upptäcks i inferenspipelinen. Efter att den har tränats registreras modellen i det centrala modellregistret för att godkännas av en modellgodkännare. När den är godkänd används den uppdaterade modellversionen för att generera förutsägelser genom slutledningspipeline.

- Infrastruktur som kod – Infrastrukturen som kod (IaC), skapad med hjälp av HashiCorp Terraform, stöder schemaläggning av inferenspipeline med EventBridge, triggning av tågpipeline baserat på en EventBridge-regel och skicka aviseringar med hjälp av Amazon enkel meddelandetjänst (Amazon SNS) ämnen.

MLOps arbetsflöde inkluderar följande steg:

- Gå till SageMaker Studio-domänen i utvecklingskontot, klona GitHub-förvaret, gå igenom processen för modellutveckling med hjälp av den tillhandahållna exempelmodellen och generera tåg- och slutledningspipelines.

- Kör tågpipelinen i utvecklingskontot, som genererar modellartefakter för den tränade modellversionen och registrerar modellen i SageMaker Model Registry i det centrala modellregisterkontot.

- Godkänn modellen i SageMaker Model Registry i det centrala modellregistret.

- Tryck koden (tåg- och slutledningspipelines och Terraform IaC-koden för att skapa EventBridge-schemat, EventBridge-regeln och SNS-ämnet) till en funktionsgren av GitHub-förvaret. Skapa en pull-begäran för att slå samman koden i huvudgrenen av GitHub-förvaret.

- Trigga Jenkins CI/CD-pipeline, som är inställd med GitHub-förvaret. CI/CD-pipelinen distribuerar koden i prod-kontot för att skapa tåg- och slutledningspipelines tillsammans med Terraform-kod för att tillhandahålla EventBridge-schemat, EventBridge-regeln och SNS-ämnet.

- Inferenspipelinen är schemalagd att köras dagligen, medan tågpipelinen är inställd för att köras närhelst datadrift detekteras från inferenspipelinen.

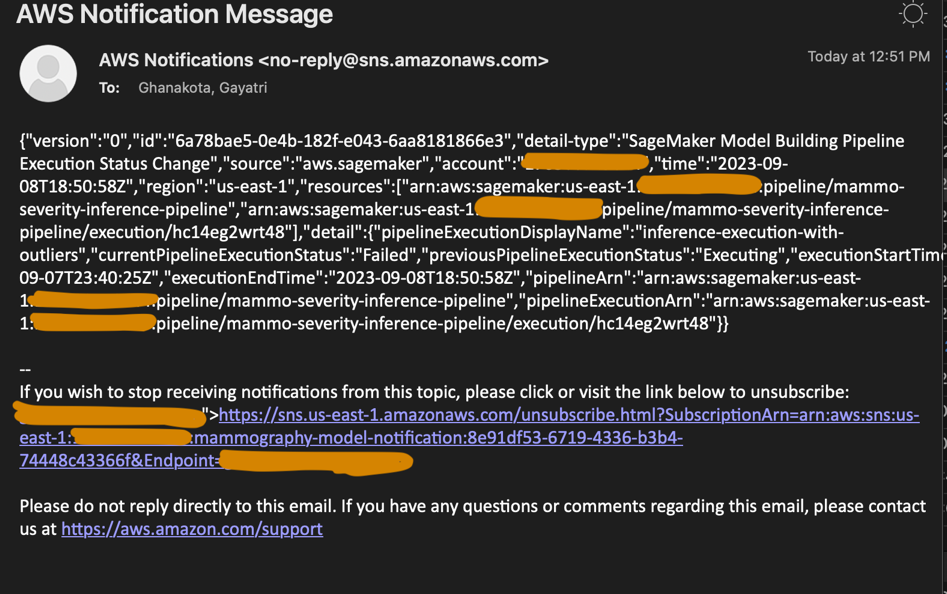

- Meddelanden skickas via SNS-ämnet när det finns ett fel med antingen tåget eller slutledningsledningen.

Förutsättningar

För denna lösning bör du ha följande förutsättningar:

- Tre AWS-konton (dev-, prod- och centrala modellregisterkonton)

- En SageMaker Studio-domän konfigurerad i vart och ett av de tre AWS-kontona (se Ombord på Amazon SageMaker Studio eller titta på videon Gå snabbt ombord till Amazon SageMaker Studio för installationsinstruktioner)

- Jenkins (vi använder Jenkins 2.401.1) med administratörsbehörighet installerad på AWS

- Terraform version 1.5.5 eller senare installerad på Jenkins server

För det här inlägget arbetar vi i us-east-1 Region för att distribuera lösningen.

Tillhandahåll KMS-nycklar i dev- och prod-konton

Vårt första steg är att skapa AWS nyckelhanteringstjänst (AWS KMS)-nycklar i dev- och prod-kontona.

Skapa en KMS-nyckel i dev-kontot och ge åtkomst till prod-kontot

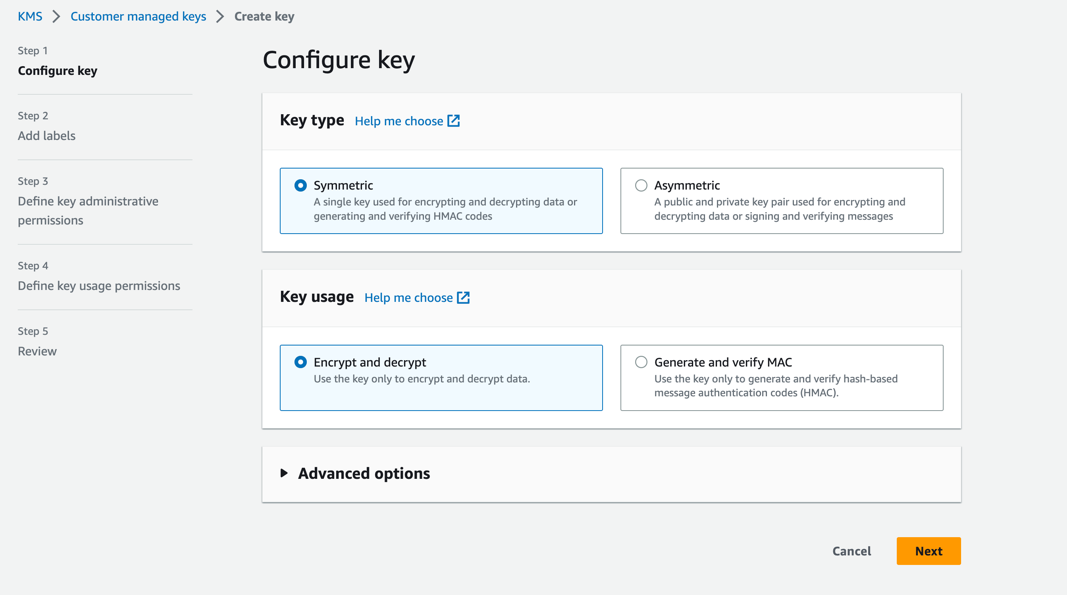

Utför följande steg för att skapa en KMS-nyckel i utvecklarkontot:

- Välj på AWS KMS-konsolen Kundhanterade nycklar i navigeringsfönstret.

- Välja Skapa nyckel.

- För Nyckeltyp, Välj Symmetrisk.

- För Nyckelanvändning, Välj Kryptera och dekryptera.

- Välja Nästa.

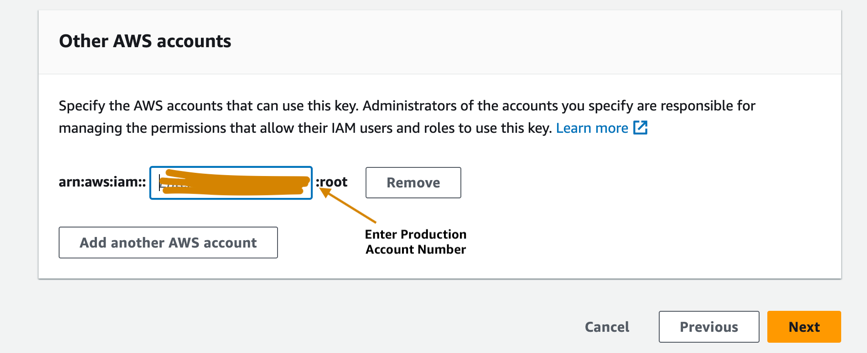

- Ange produktionskontonumret för att ge produktionskontot åtkomst till KMS-nyckeln som tillhandahålls i utvecklarkontot. Detta är ett obligatoriskt steg eftersom första gången modellen tränas i utvecklarkontot, krypteras modellartefakterna med KMS-nyckeln innan de skrivs till S3-bucket i det centrala modellregistret. Produktionskontot behöver åtkomst till KMS-nyckeln för att dekryptera modellartefakterna och köra inferenspipeline.

- Välja Nästa och avsluta med att skapa din nyckel.

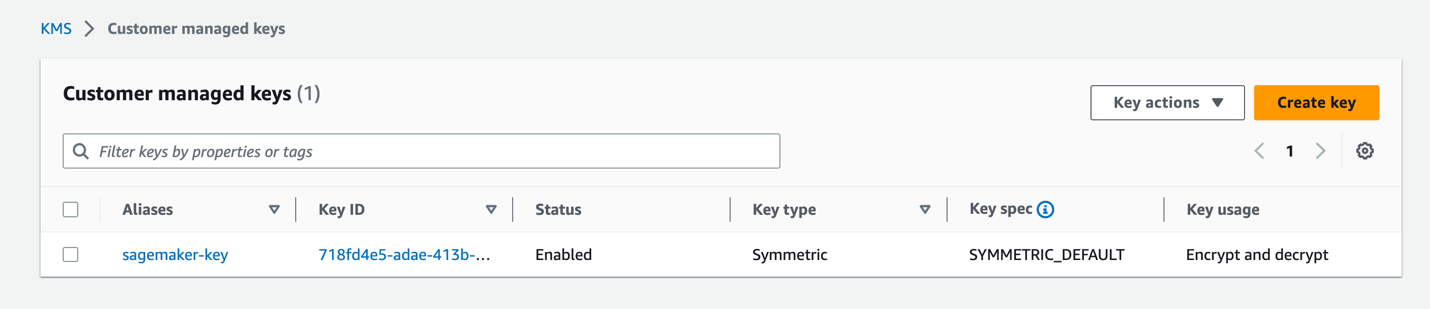

Efter att nyckeln har tillhandahållits bör den vara synlig på AWS KMS-konsolen.

Skapa en KMS-nyckel i prod-kontot

Gå igenom samma steg i föregående avsnitt för att skapa en kundhanterad KMS-nyckel i prod-kontot. Du kan hoppa över steget för att dela KMS-nyckeln till ett annat konto.

Ställ in en modellartefakter S3-hink i det centrala modellregistret

Skapa en S3-hink som du väljer med snöret sagemaker i namnkonventionen som en del av hinkens namn i det centrala modellregisterkontot, och uppdatera bucketpolicyn på S3-bucketen för att ge tillstånd från både utvecklar- och prodkontona att läsa och skriva modellartefakter i S3-bucket.

Följande kod är bucket-policyn som ska uppdateras på S3-bucket:

Ställ in IAM-roller i dina AWS-konton

Nästa steg är att ställa in AWS identitets- och åtkomsthantering (IAM) roller i dina AWS-konton med behörigheter för AWS Lambda, SageMaker och Jenkins.

Lambda-exekveringsroll

Montera myggnät för luckor Lambdautföranderoller i dev- och prod-kontona, som kommer att användas av Lambda-funktionen som körs som en del av SageMaker Pipelines Lambda steg. Detta steg kommer att köras från slutledningspipelinen för att hämta den senaste godkända modellen, med hjälp av vilken slutledningar genereras. Skapa IAM-roller i dev- och prod-kontona med namnkonventionen arn:aws:iam::<account-id>:role/lambda-sagemaker-role och bifoga följande IAM-policyer:

- Policy 1 – Skapa en inline-policy som heter

cross-account-model-registry-access, som ger åtkomst till modellpaketet som ställts in i modellregistret i det centrala kontot: - Policy 2 – Fäst AmazonSageMakerFullAccess, vilket är en AWS-hanterad policy som ger full tillgång till SageMaker. Det ger också utvald åtkomst till relaterade tjänster, som t.ex AWS Application Auto Scaling, Amazon S3, Amazon Elastic Container Registry (Amazon ECR), och Amazon CloudWatch-loggar.

- Policy 3 – Fäst AWSLambda_FullAccess, som är en AWS-hanterad policy som ger full åtkomst till Lambda, Lambda-konsolfunktioner och andra relaterade AWS-tjänster.

- Policy 4 – Använd följande IAM-förtroendepolicy för IAM-rollen:

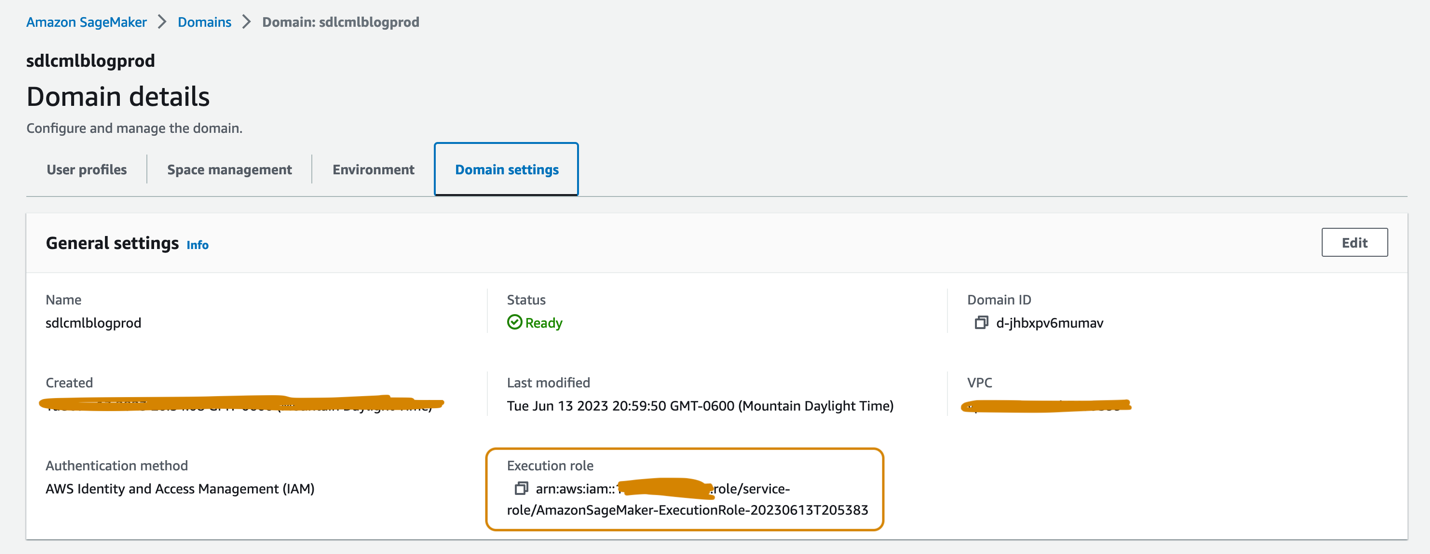

SageMaker verkställande roll

SageMaker Studio-domänerna som ställs in i dev- och prod-kontona bör var och en ha en exekveringsroll kopplad, som finns på Domäninställningar fliken på domäninformationssidan, som visas i följande skärmdump. Den här rollen används för att köra utbildningsjobb, bearbetningsjobb och mer inom SageMaker Studio-domänen.

Lägg till följande policyer till SageMaker-exekveringsrollen i båda kontona:

- Policy 1 – Skapa en inline-policy som heter

cross-account-model-artifacts-s3-bucket-access, som ger åtkomst till S3-hinken i det centrala modellregistret, som lagrar modellartefakterna: - Policy 2 – Skapa en inline-policy som heter

cross-account-model-registry-access, som ger åtkomst till modellpaketet i modellregistret i det centrala modellregistret: - Policy 3 – Skapa en inline-policy som heter

kms-key-access-policy, som ger åtkomst till KMS-nyckeln som skapades i föregående steg. Ange konto-ID där policyn skapas och KMS-nyckel-ID som skapats i det kontot. - Policy 4 – Fäst AmazonSageMakerFullAccess, vilket är en AWS-hanterad policy som ger full åtkomst till SageMaker och välj åtkomst till relaterade tjänster.

- Policy 5 – Fäst AWSLambda_FullAccess, som är en AWS-hanterad policy som ger full åtkomst till Lambda, Lambda-konsolfunktioner och andra relaterade AWS-tjänster.

- Policy 6 – Fäst CloudWatchEventsFullAccess, som är en AWS-hanterad policy som ger full åtkomst till CloudWatch Events.

- Policy 7 – Lägg till följande IAM-förtroendepolicy för SageMaker exekverande IAM-roll:

- Policy 8 (specifik för SageMaker-exekveringsrollen i prod-kontot) – Skapa en inline-policy som heter

cross-account-kms-key-access-policy, som ger åtkomst till KMS-nyckeln som skapats i utvecklarkontot. Detta krävs för att slutledningspipelinen ska kunna läsa modellartefakter lagrade i det centrala modellregisterkontot där modellartefakterna krypteras med hjälp av KMS-nyckeln från utvecklarkontot när den första versionen av modellen skapas från utvecklarkontot.

Jenkins roll över flera konton

Ställ in en IAM-roll som heter cross-account-jenkins-role i prod-kontot, vilket Jenkins kommer att anta för att distribuera ML-pipelines och motsvarande infrastruktur i prod-kontot.

Lägg till följande hanterade IAM-policyer till rollen:

CloudWatchFullAccessAmazonS3FullAccessAmazonSNSFullAccessAmazonSageMakerFullAccessAmazonEventBridgeFullAccessAWSLambda_FullAccess

Uppdatera förtroenderelationen för rollen för att ge behörigheter till AWS-kontot som är värd för Jenkins-servern:

Uppdatera behörigheter för IAM-rollen som är kopplad till Jenkins-servern

Förutsatt att Jenkins har ställts in på AWS, uppdatera IAM-rollen som är kopplad till Jenkins för att lägga till följande policyer, vilket ger Jenkins tillgång att distribuera resurserna till prod-kontot:

- Policy 1 – Skapa följande inline-policy med namnet

assume-production-role-policy: - Policy 2 – Fäst

CloudWatchFullAccesshanterad IAM-policy.

Ställ in modellpaketgruppen i det centrala modellregisterkontot

Från SageMaker Studio-domänen i det centrala modellregistret skapar du en modellpaketgrupp som heter mammo-severity-model-package med följande kodsnutt (som du kan köra med en Jupyter-anteckningsbok):

Konfigurera åtkomst till modellpaketet för IAM-roller i dev- och prod-kontona

Tillhandahåll åtkomst till SageMaker-exekveringsrollerna som skapats i dev- och prod-kontona så att du kan registrera modellversioner inom modellpaketet mammo-severity-model-package i det centrala modellregistret från båda kontona. Från SageMaker Studio-domänen i det centrala modellregistret, kör följande kod i en Jupyter-anteckningsbok:

Ställ in Jenkins

I det här avsnittet konfigurerar vi Jenkins för att skapa ML-pipelines och motsvarande Terraform-infrastruktur i prod-kontot genom Jenkins CI/CD-pipeline.

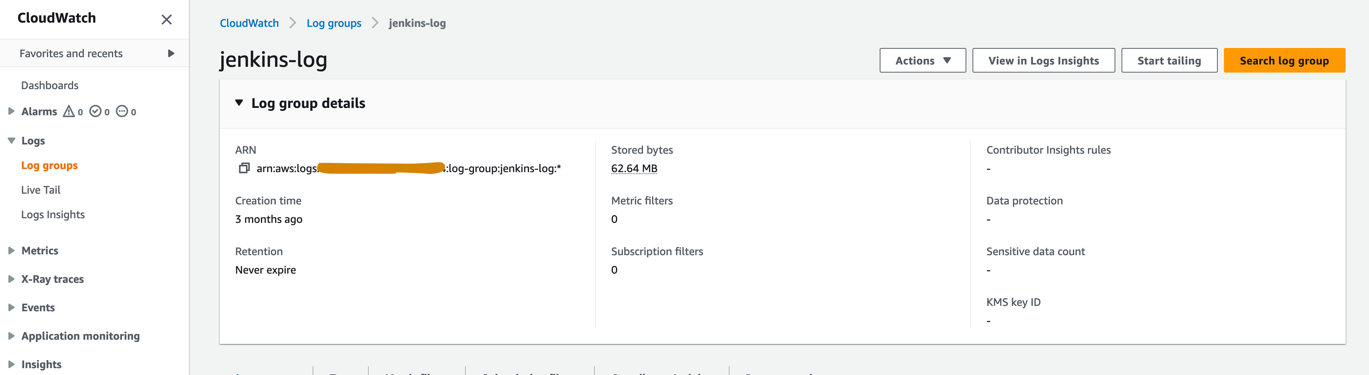

- Skapa en logggrupp med namnet på CloudWatch-konsolen

jenkins-loginom prod-kontot till vilket Jenkins kommer att skicka loggar från CI/CD-pipelinen. Logggruppen ska skapas i samma region som där Jenkins-servern är inställd.

- Installera följande plugins på din Jenkins-server:

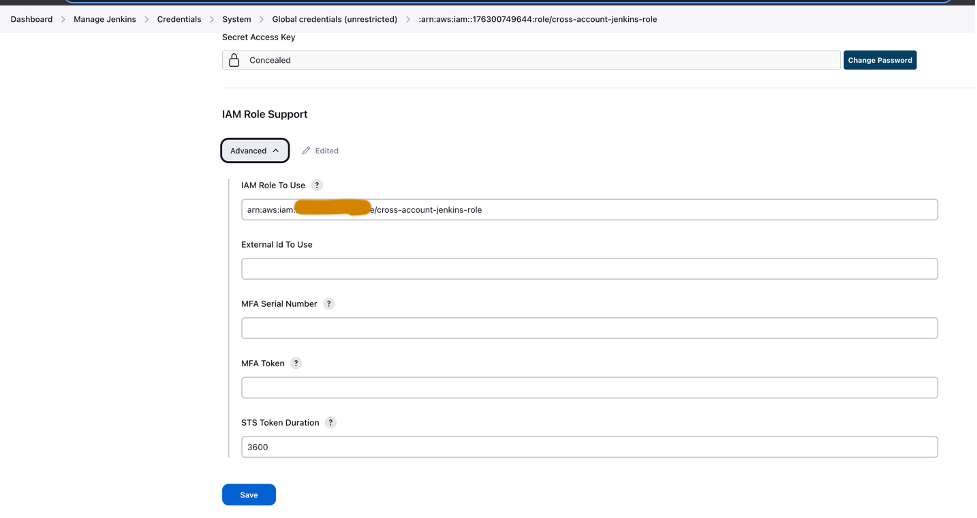

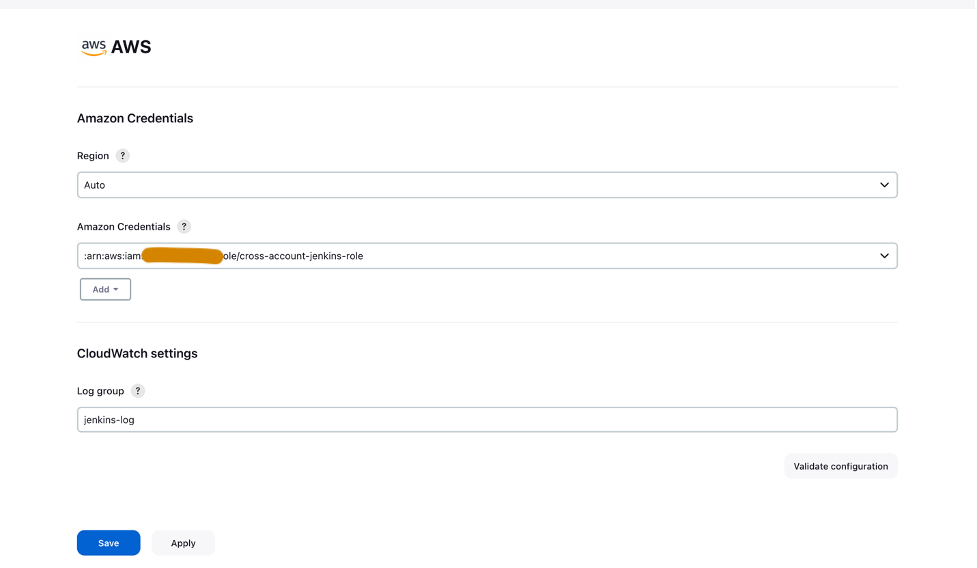

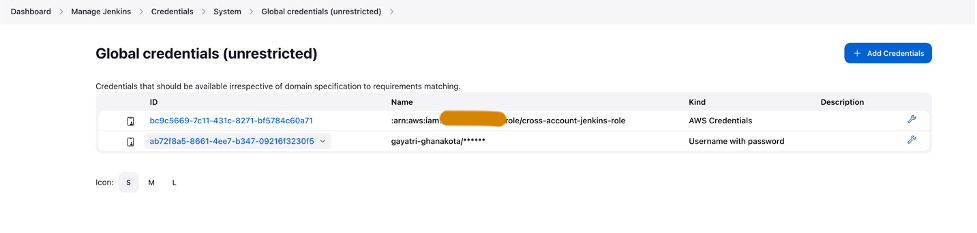

- Ställ in AWS-uppgifter i Jenkins med IAM-rollen över flera konton (

cross-account-jenkins-role) tillhandahålls i prod-kontot.

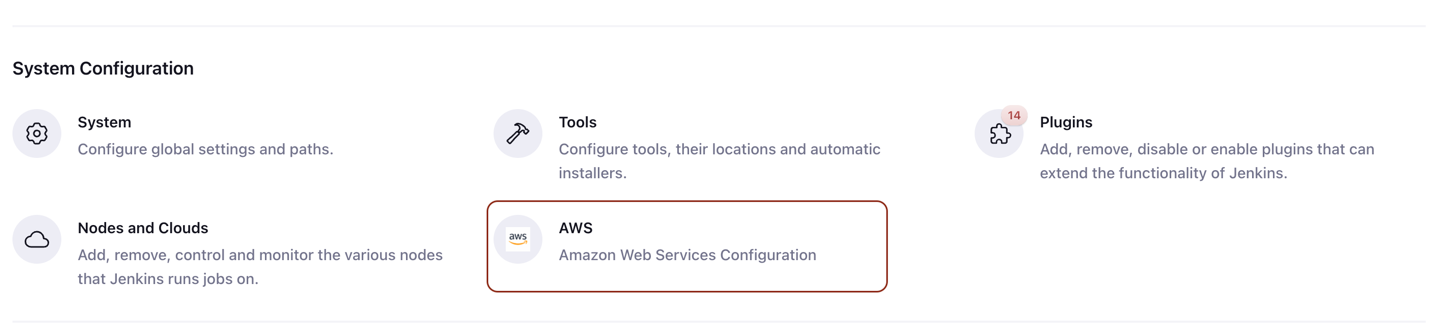

- För Systemkonfigurationväljer AWS.

- Ange inloggningsuppgifterna och CloudWatch-logggruppen som du skapade tidigare.

- Ställ in GitHub-uppgifter inom Jenkins.

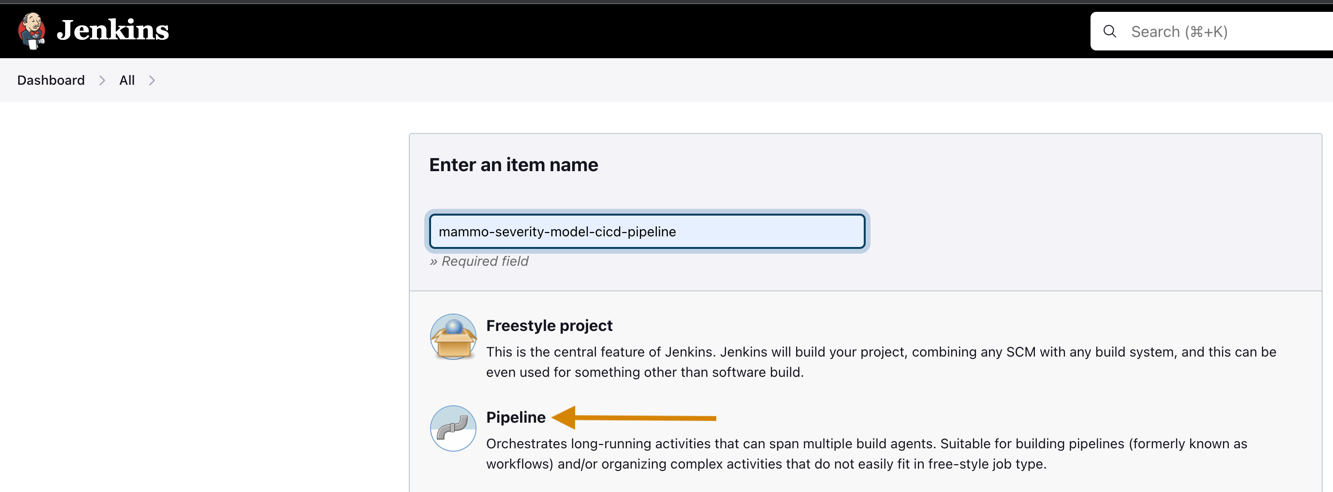

- Skapa ett nytt projekt i Jenkins.

- Ange ett projektnamn och välj Pipeline.

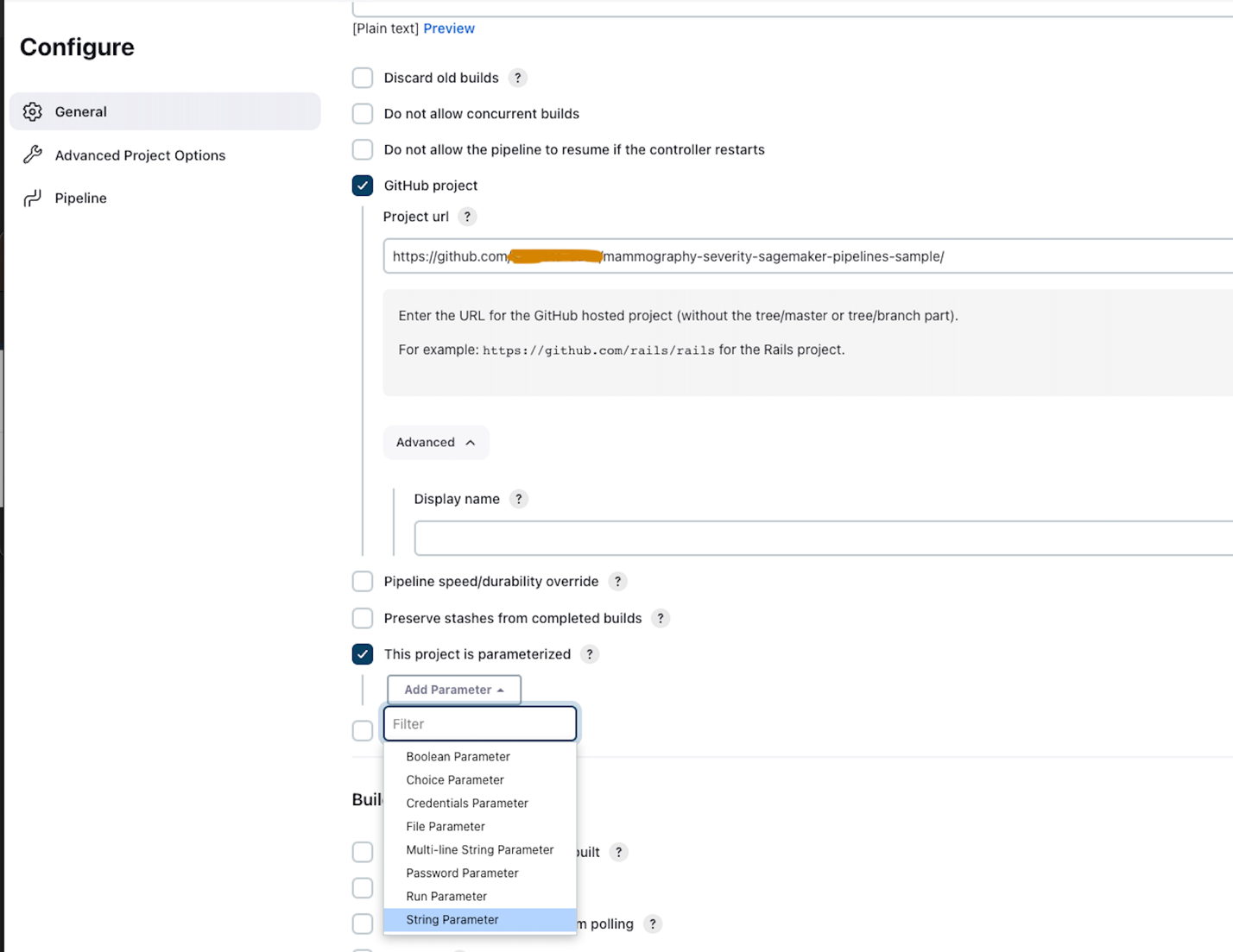

- På Allmänt fliken, välj GitHub-projekt och gå in i gaffeln GitHub repository Webbadress.

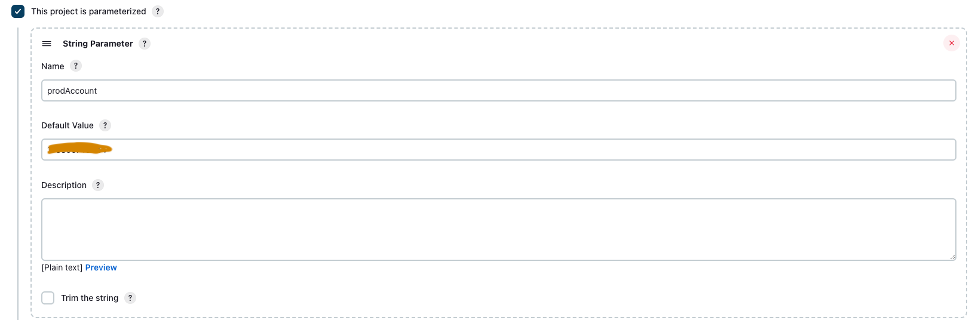

- Välja Detta projekt är parametriserat.

- På Lägg till parameter meny, välj Strängparameter.

- För Namn , stiga på

prodAccount. - För Standardvärde, ange prod-konto-ID.

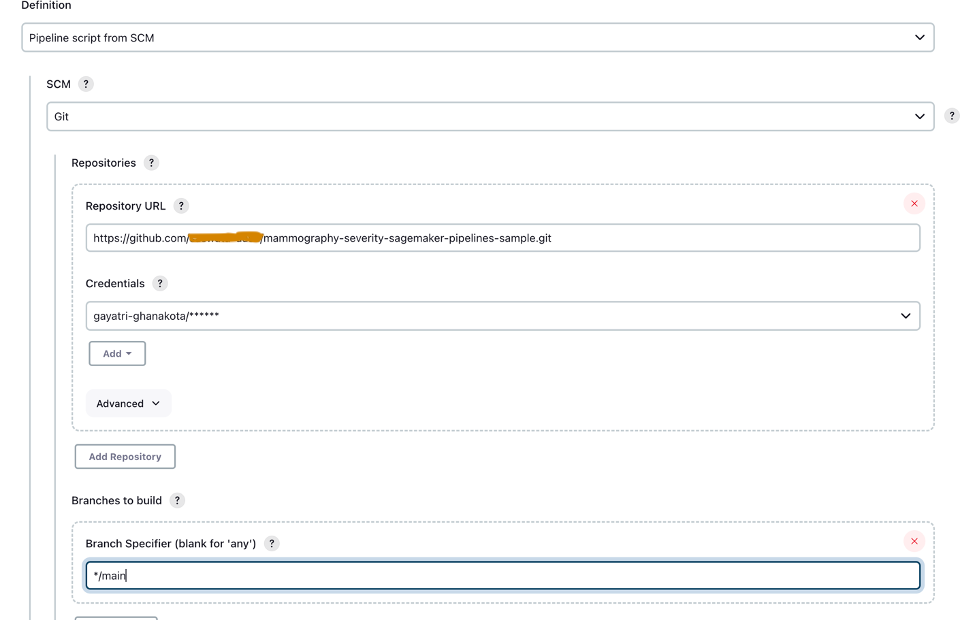

- Enligt Avancerade projektalternativ, För Definition, Välj Pipeline script från SCM.

- För SCMväljer gå.

- För Repository URL, gå in i gaffeln GitHub repository Webbadress.

- För referenser, ange GitHub-uppgifterna som sparats i Jenkins.

- ange

maini Grenar att bygga sektion, baserat på vilken CI/CD-pipeline kommer att triggas.

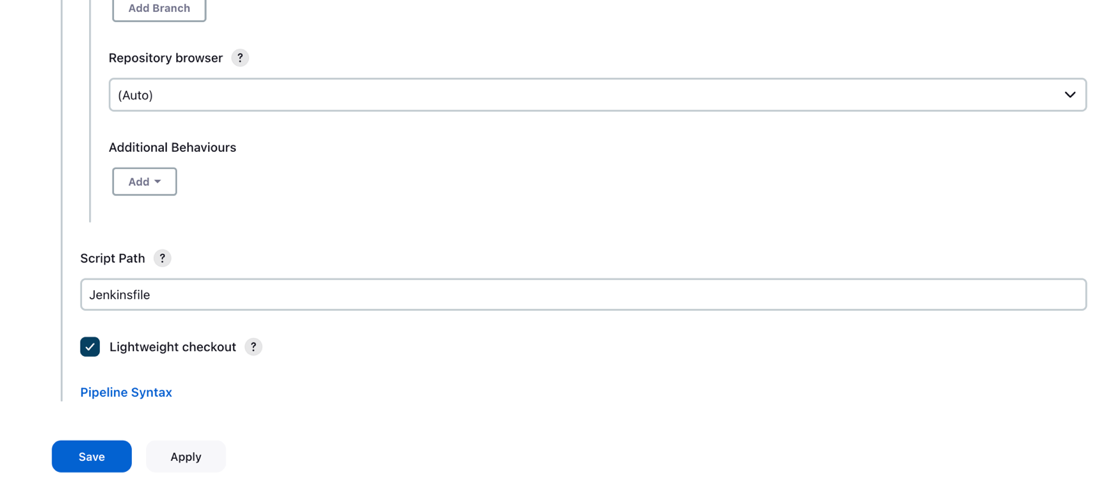

- För Manusväg, stiga på

Jenkinsfile. - Välja Save.

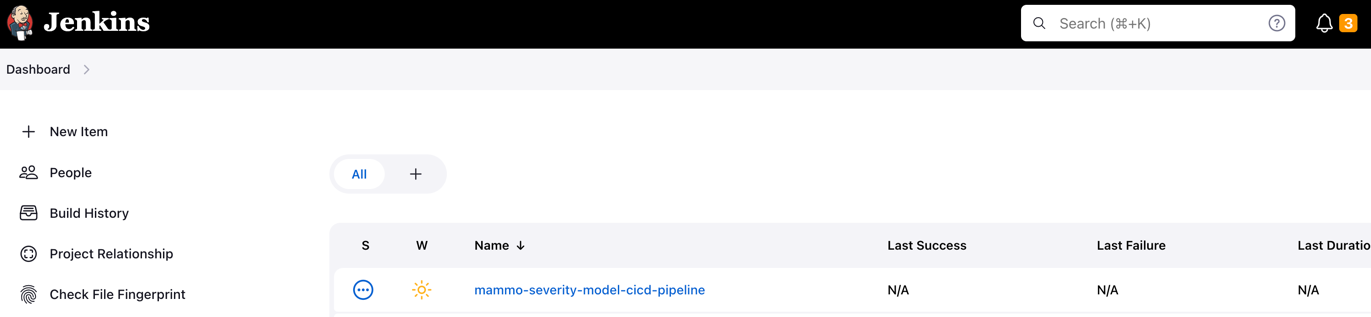

Jenkins pipeline bör skapas och vara synlig på din instrumentpanel.

Tillhandahålla S3-hinkar, samla in och förbereda data

Slutför följande steg för att ställa in dina S3-hinkar och data:

- Skapa en S3-hink som du väljer med snöret

sagemakeri namnkonventionen som en del av hinkens namn i både dev- och prod-konton för att lagra datamängder och modellartefakter. - Sätt upp en S3-hink för att behålla Terraform-tillståndet i prod-kontot.

- Ladda ner och spara det allmänt tillgängliga UCI Mammografi Mass dataset till S3-bucketen som du skapade tidigare i utvecklarkontot.

- Gaffel och klona GitHub repository inom SageMaker Studio-domänen i utvecklarkontot. Repet har följande mappstruktur:

- /environments – Konfigurationsskript för prod-miljö

- /mlops-infra – Kod för att distribuera AWS-tjänster med Terraform-kod

- /pipelines – Kod för SageMaker pipeline komponenter

- Jenkinsfile – Skript att distribuera via Jenkins CI/CD-pipeline

- setup.py – Behövs för att installera de nödvändiga Python-modulerna och skapa kommandot run-pipeline

- mammography-severity-modeling.ipynb – Låter dig skapa och köra ML-arbetsflödet

- Skapa en mapp som heter data i den klonade GitHub-arkivmappen och spara en kopia av den allmänt tillgängliga UCI Mammografi Mass datasätt.

- Följ Jupyter-anteckningsboken

mammography-severity-modeling.ipynb. - Kör följande kod i anteckningsboken för att förbehandla datamängden och ladda upp den till S3-bucket i utvecklarkontot:

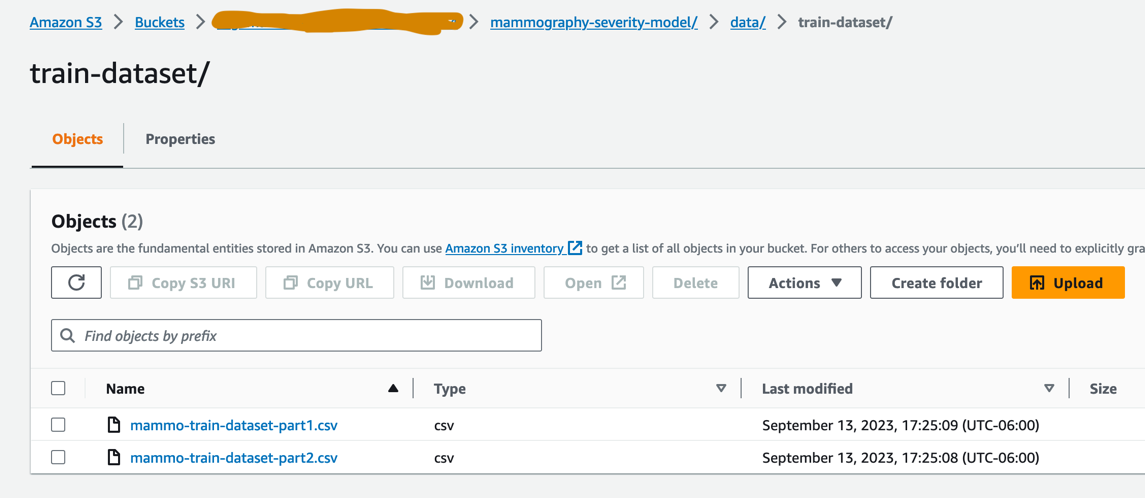

Koden kommer att generera följande datamängder:

-

- data/ mammo-train-dataset-part1.csv – Kommer att användas för att träna den första versionen av modellen.

- data/ mammo-train-dataset-part2.csv – Kommer att användas för att träna den andra versionen av modellen tillsammans med datasetet mammo-train-dataset-part1.csv.

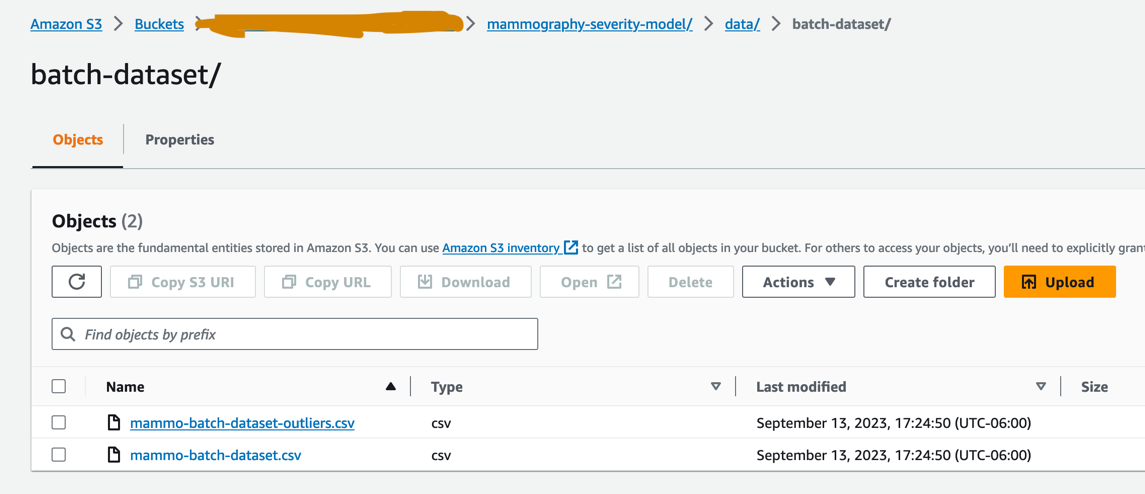

- data/mammo-batch-dataset.csv – Kommer att användas för att generera slutsatser.

- data/mammo-batch-dataset-outliers.csv – Kommer att introducera extremvärden i datamängden för att misslyckas med slutledningsledningen. Detta kommer att göra det möjligt för oss att testa mönstret för att utlösa automatisk omskolning av modellen.

- Ladda upp datasetet

mammo-train-dataset-part1.csvunder prefixetmammography-severity-model/train-datasetoch ladda upp datamängdernamammo-batch-dataset.csvochmammo-batch-dataset-outliers.csvtill prefixetmammography-severity-model/batch-datasetav S3-bucket som skapats i dev-kontot: - Ladda upp datamängderna

mammo-train-dataset-part1.csvochmammo-train-dataset-part2.csvunder prefixetmammography-severity-model/train-dataseti S3-hinken som skapats i prod-kontot via Amazon S3-konsolen.

- Ladda upp datamängderna

mammo-batch-dataset.csvochmammo-batch-dataset-outliers.csvtill prefixetmammography-severity-model/batch-datasetav S3-hinken i prod-kontot.

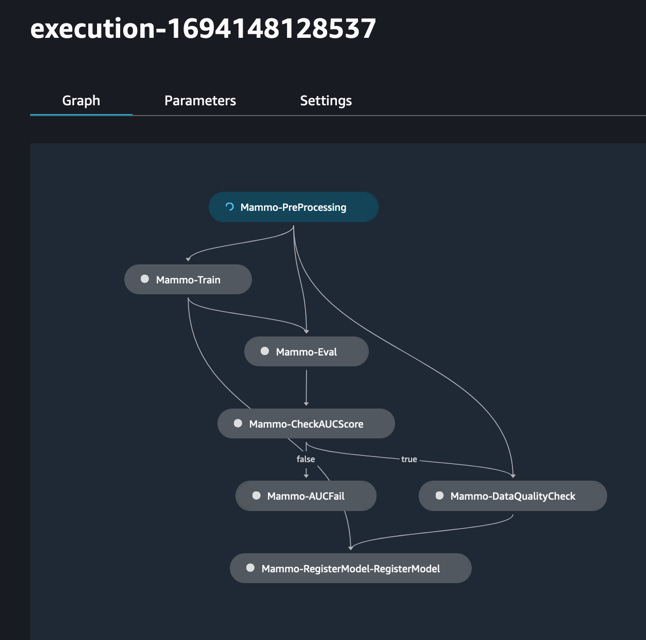

Kör tågledningen

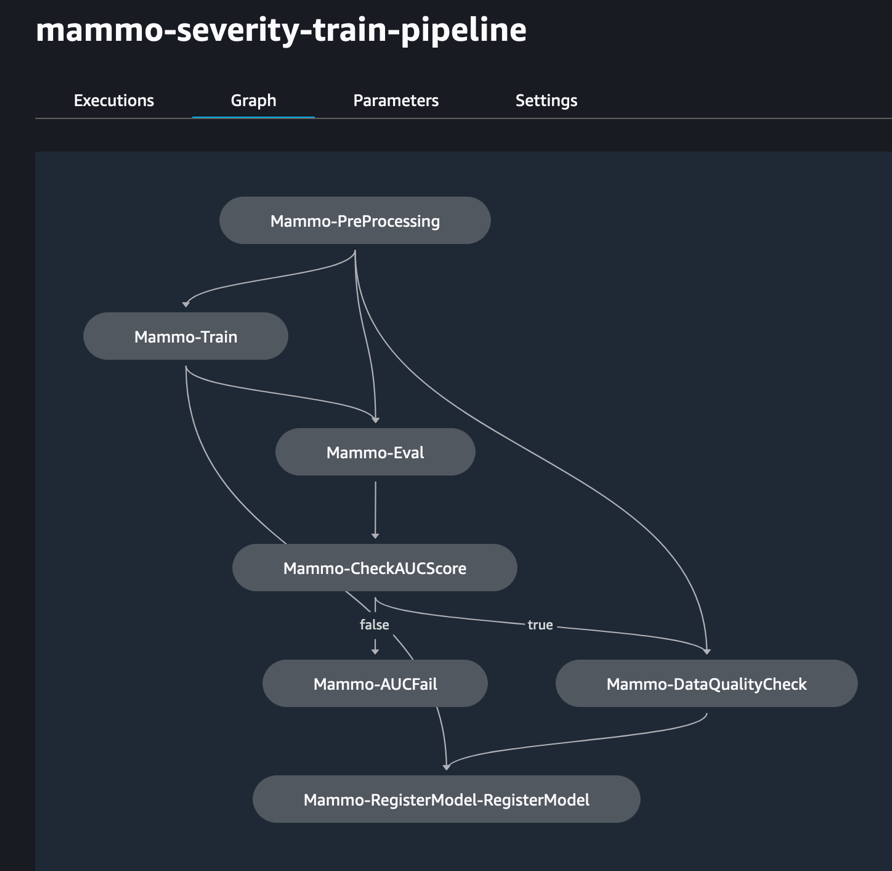

Enligt <project-name>/pipelines/train, kan du se följande Python-skript:

- scripts/raw_preprocess.py – Integreras med SageMaker Processing för funktionsutveckling

- scripts/evaluate_model.py – Tillåter beräkning av modellmått, i det här fallet

auc_score - train_pipeline.py – Innehåller koden för modellutbildningspipeline

Följ följande steg:

- Ladda upp skripten till Amazon S3:

- Hämta tågpipeline-instansen:

- Skicka in tågledningen och kör den:

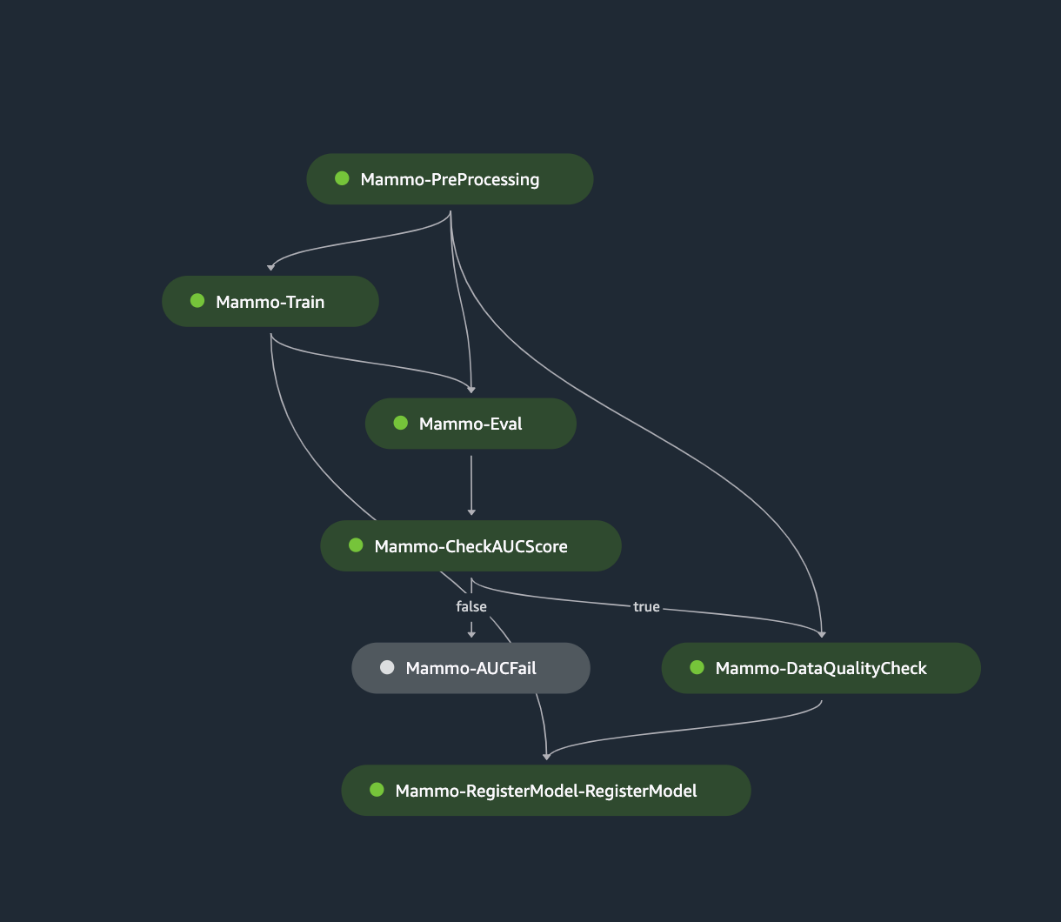

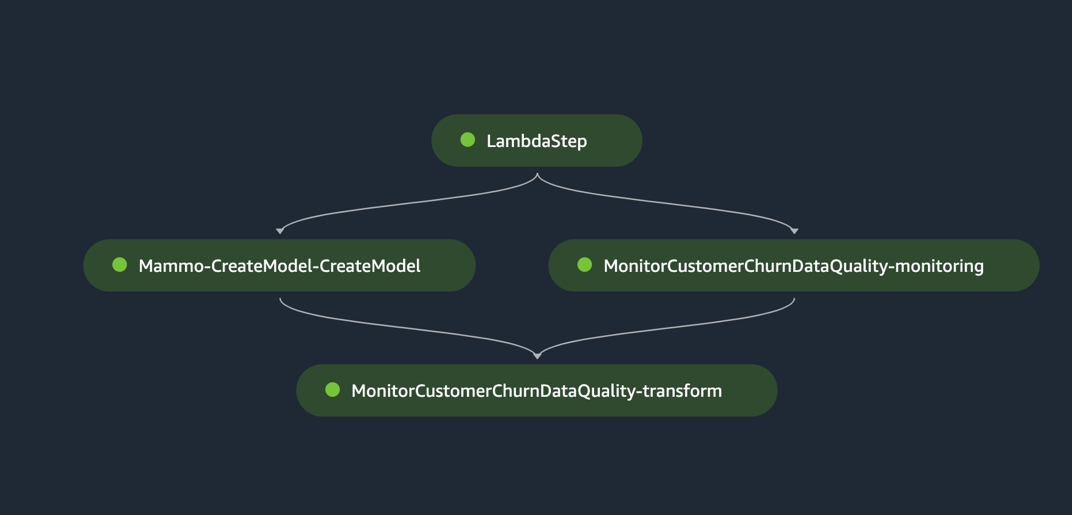

Följande bild visar en framgångsrik körning av träningspipeline. Det sista steget i pipelinen registrerar modellen i det centrala modellregisterkontot.

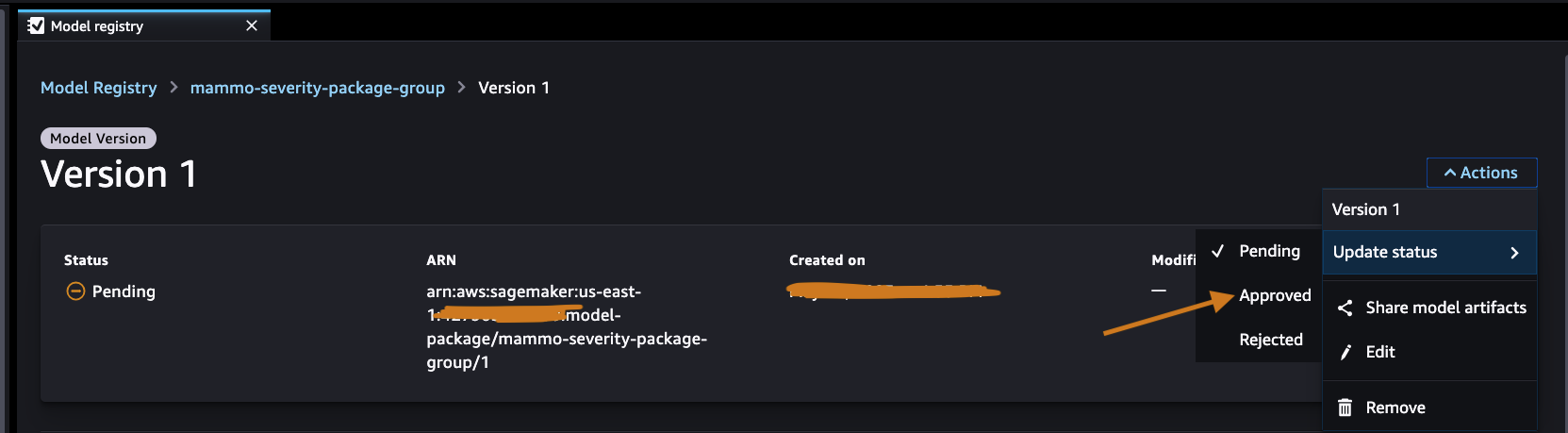

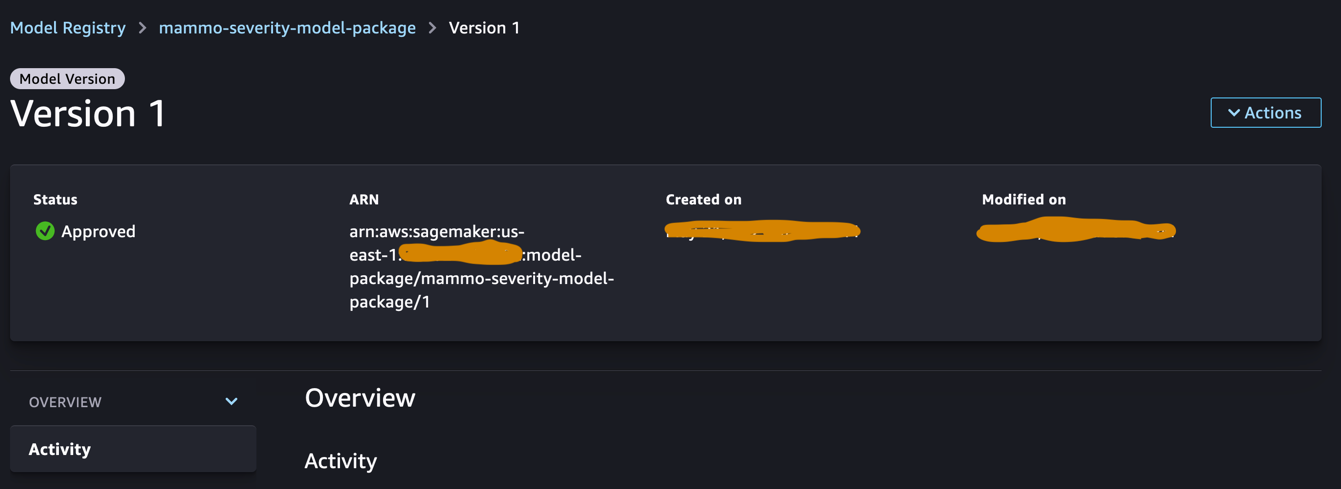

Godkänn modellen i det centrala modellregistret

Logga in på det centrala modellregistret och få tillgång till SageMaker-modellregistret inom SageMaker Studio-domänen. Ändra modellversionens status till Godkänd.

När den har godkänts bör statusen ändras på modellversionen.

Kör inferenspipeline (valfritt)

Det här steget är inte nödvändigt men du kan fortfarande köra inferenspipeline för att generera förutsägelser i utvecklarkontot.

Enligt <project-name>/pipelines/inference, kan du se följande Python-skript:

- scripts/lambda_helper.py – Hämtar den senaste godkända modellversionen från det centrala modellregistret med hjälp av ett SageMaker Pipelines Lambda-steg

- inference_pipeline.py – Innehåller koden för modellens slutledningspipeline

Följ följande steg:

- Ladda upp skriptet till S3-bucket:

- Hämta inferenspipeline-instansen med den normala batchdatauppsättningen:

- Skicka in inferenspipeline och kör den:

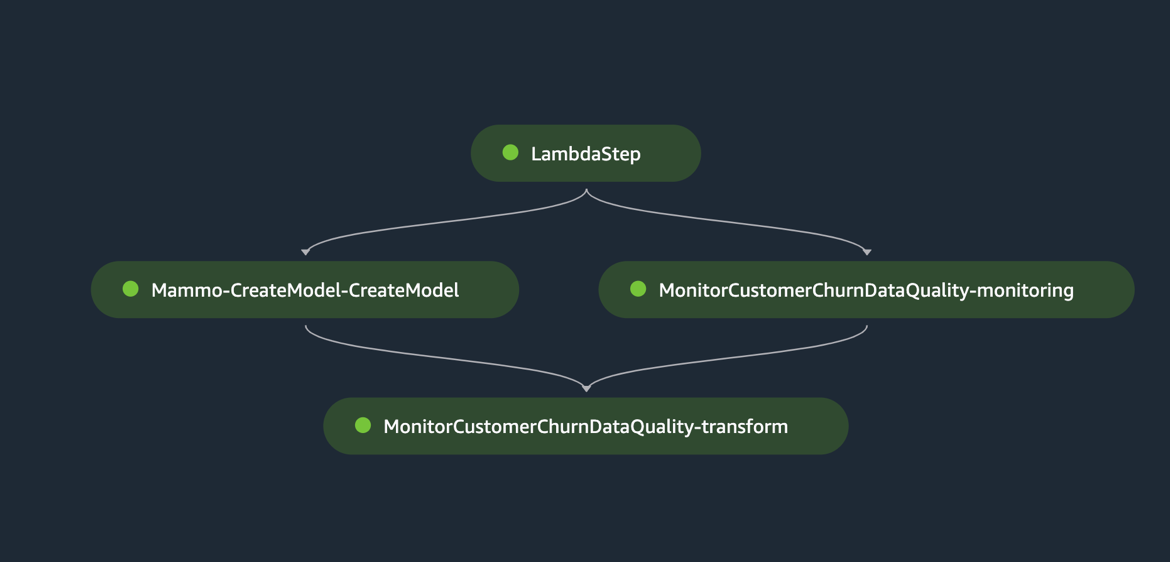

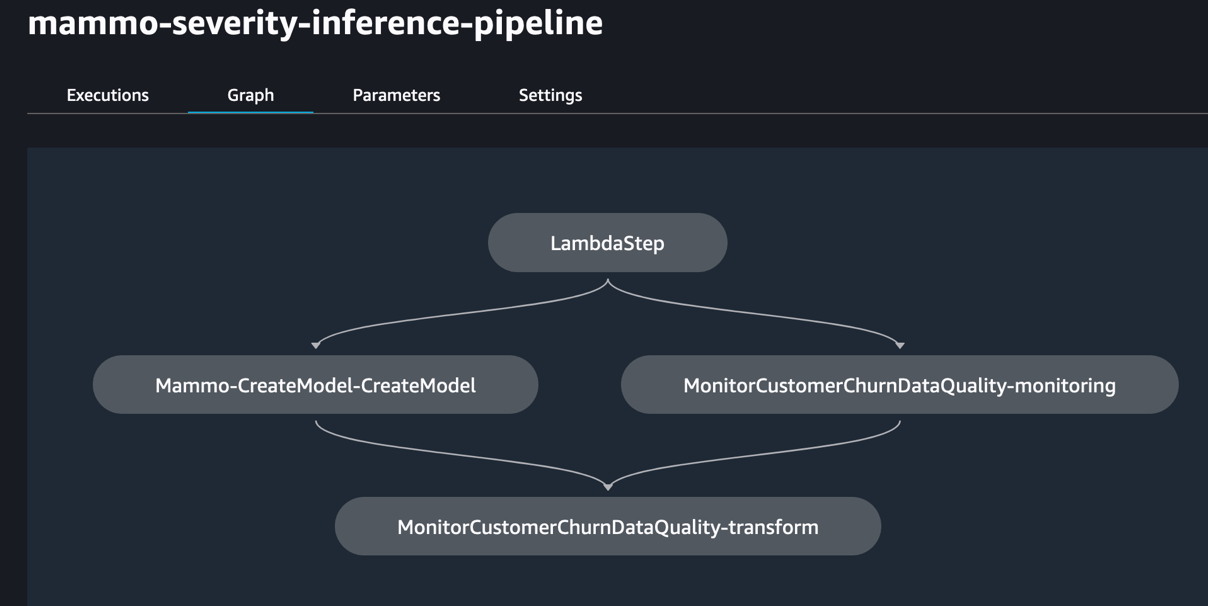

Följande figur visar en framgångsrik körning av slutledningspipelinen. Det sista steget i pipelinen genererar förutsägelserna och lagrar dem i S3-skopan. Vi använder MonitorBatchTransformStep för att övervaka ingångarna i batchtransformeringsjobbet. Om det finns några extremvärden går inferenspipelinen in i ett misslyckat tillstånd.

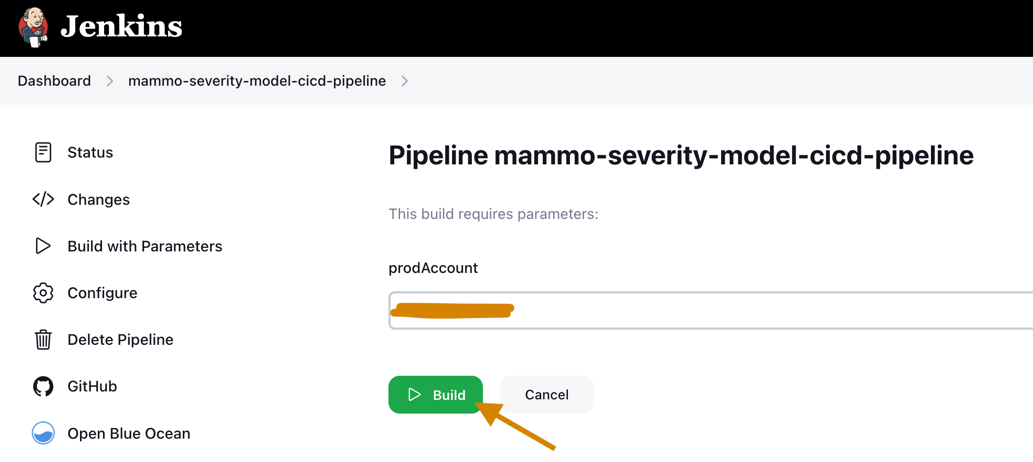

Kör Jenkins pipeline

Smakämnen environment/ mappen i GitHub-förvaret innehåller konfigurationsskriptet för prod-kontot. Slutför följande steg för att utlösa Jenkins pipeline:

- Uppdatera konfigurationsskriptet

prod.tfvars.jsonbaserat på resurserna som skapats i de föregående stegen: - När du har uppdaterat, tryck in koden i det splittrade GitHub-förrådet och slå samman koden till huvudgrenen.

- Gå till Jenkins UI, välj Bygg med parametrar, och trigga CI/CD-pipeline som skapades i de föregående stegen.

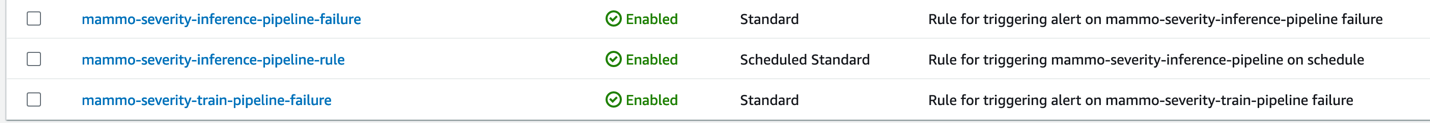

När bygget är klart och framgångsrikt kan du logga in på prod-kontot och se tåg- och slutledningspipelines inom SageMaker Studio-domänen.

Dessutom kommer du att se tre EventBridge-regler på EventBridge-konsolen i prod-kontot:

- Schemalägg inferenspipeline

- Skicka ett felmeddelande på tågledningen

- När slutledningsledningen inte utlöser tågledningen, skicka ett meddelande

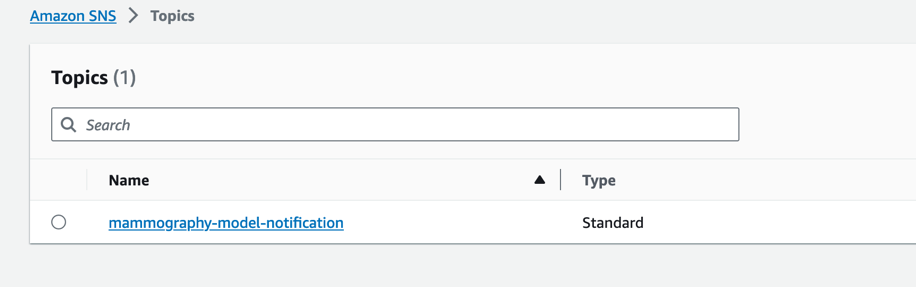

Slutligen kommer du att se ett SNS-aviseringsämne på Amazon SNS-konsolen som skickar meddelanden via e-post. Du kommer att få ett e-postmeddelande där du uppmanas att bekräfta godkännandet av dessa e-postmeddelanden.

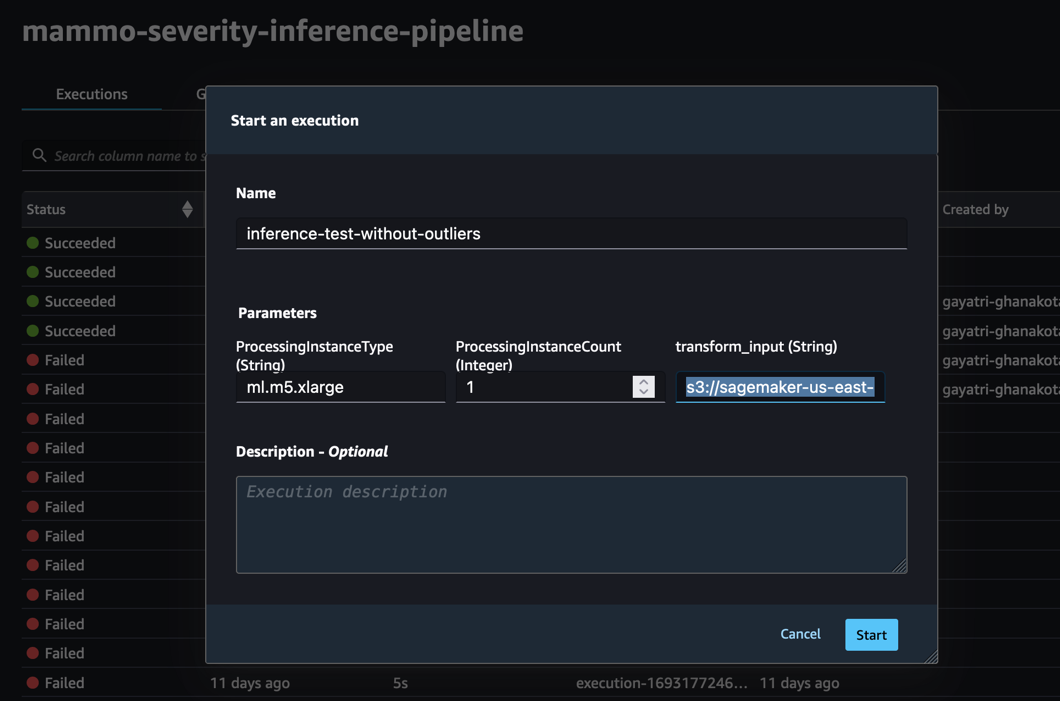

Testa slutledningspipelinen med en batchdatauppsättning utan extremvärden

För att testa om slutledningspipelinen fungerar som förväntat i prodkontot kan vi logga in på prodkontot och trigga slutledningspipelinen med hjälp av batchdataset utan extremvärden.

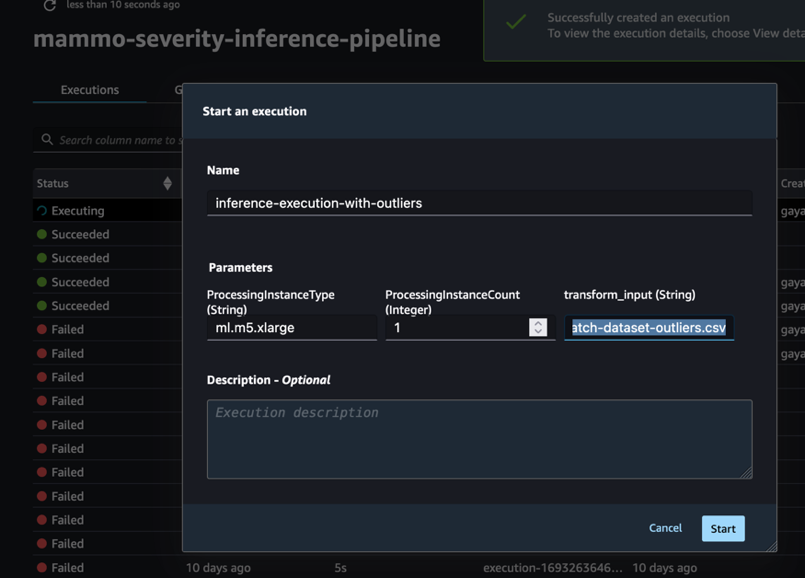

Kör pipelinen via SageMaker Pipelines-konsolen i SageMaker Studio-domänen för prod-kontot, där transform_input kommer att vara S3 URI för datamängden utan extremvärden (s3://<s3-bucket-in-prod-account>/mammography-severity-model/data/mammo-batch-dataset.csv).

Inferenspipelinen lyckas och skriver tillbaka prognoserna till S3-skopan.

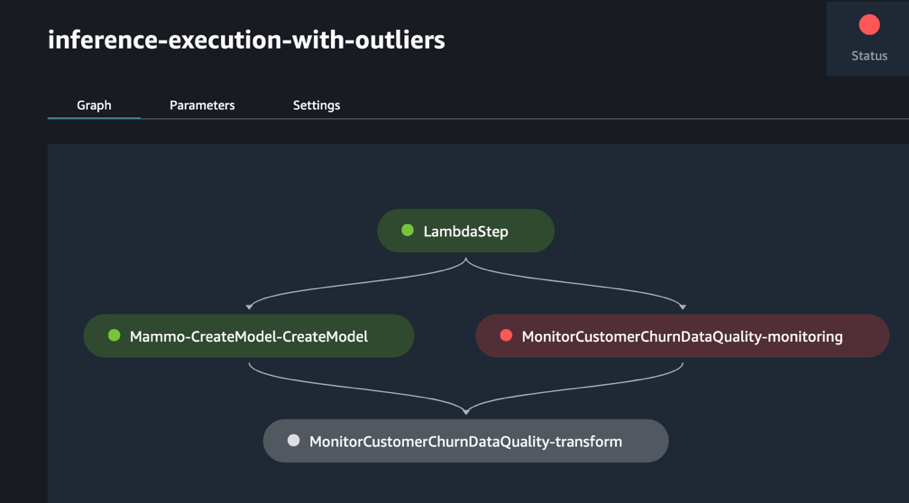

Testa slutledningspipelinen med hjälp av en batchdatauppsättning med extremvärden

Du kan köra slutledningspipelinen med hjälp av batchdataset med extremvärden för att kontrollera om den automatiska omskolningsmekanismen fungerar som förväntat.

Kör pipelinen via SageMaker Pipelines-konsolen i SageMaker Studio-domänen för prod-kontot, där transform_input kommer att vara S3 URI för datasetet med extremvärden (s3://<s3-bucket-in-prod-account>/mammography-severity-model/data/mammo-batch-dataset-outliers.csv).

Slutledningsledningen misslyckas som förväntat, vilket triggar EventBridge-regeln, som i sin tur triggar tågledningen.

Efter några ögonblick bör du se en ny körning av tågledningen på SageMaker Pipelines-konsolen, som plockar upp de två olika tågdataseten (mammo-train-dataset-part1.csv och mammo-train-dataset-part2.csv) laddas upp till S3-skopan för att träna om modellen.

Du kommer också att se ett meddelande skickat till e-postmeddelandet som prenumererar på SNS-ämnet.

För att använda den uppdaterade modellversionen, logga in på det centrala modellregisterkontot och godkänn modellversionen, som kommer att hämtas under nästa körning av slutledningspipelinen som utlöses genom den schemalagda EventBridge-regeln.

Även om tåg- och slutledningspipelines använder en statisk datauppsättnings-URL, kan du skicka datauppsättnings-URL till tåg- och slutledningspipelines som dynamiska variabler för att använda uppdaterade datauppsättningar för att träna om modellen och generera förutsägelser i ett verkligt scenario.

Städa upp

Gör så här för att undvika framtida avgifter:

- Ta bort SageMaker Studio-domänen från alla AWS-konton.

- Ta bort alla resurser som skapats utanför SageMaker, inklusive S3-buckets, IAM-roller, EventBridge-regler och SNS-ämnen som ställts in via Terraform i prod-kontot.

- Ta bort SageMaker-pipelines som skapats över konton med hjälp av AWS-kommandoradsgränssnitt (AWS CLI).

Slutsats

Organisationer behöver ofta anpassa sig till företagsomfattande verktygsuppsättningar för att möjliggöra samarbete mellan olika funktionsområden och team. Detta samarbete säkerställer att din MLOps-plattform kan anpassas till förändrade affärsbehov och påskyndar införandet av ML mellan team. Det här inlägget förklarade hur man skapar ett MLOps-ramverk i en multimiljöinställning för att möjliggöra automatiserad modellomskolning, batch-inferens och övervakning med Amazon SageMaker Model Monitor, modellversionering med SageMaker Model Registry och marknadsföring av ML-kod och pipelines över miljöer med en CI/CD pipeline. Vi visade upp den här lösningen med en kombination av AWS-tjänster och verktygsuppsättningar från tredje part. För instruktioner om hur du implementerar den här lösningen, se GitHub repository. Du kan också utöka denna lösning genom att ta in dina egna datakällor och modelleringsramverk.

Om författarna

Gayatri Ghanakota är en Sr. Machine Learning Engineer med AWS Professional Services. Hon brinner för att utveckla, distribuera och förklara AI/ML-lösningar över olika domäner. Före denna roll ledde hon flera initiativ som datavetare och ML-ingenjör med globala toppföretag inom finans- och detaljhandeln. Hon har en magisterexamen i datavetenskap specialiserad på datavetenskap från University of Colorado, Boulder.

Gayatri Ghanakota är en Sr. Machine Learning Engineer med AWS Professional Services. Hon brinner för att utveckla, distribuera och förklara AI/ML-lösningar över olika domäner. Före denna roll ledde hon flera initiativ som datavetare och ML-ingenjör med globala toppföretag inom finans- och detaljhandeln. Hon har en magisterexamen i datavetenskap specialiserad på datavetenskap från University of Colorado, Boulder.

Sunita Koppar är en Sr. Data Lake Architect med AWS Professional Services. Hon brinner för att lösa problem hos kunder genom att bearbeta big data och tillhandahålla långsiktiga skalbara lösningar. Innan denna roll utvecklade hon produkter inom internet-, telekom- och fordonsdomäner och har varit AWS-kund. Hon har en magisterexamen i datavetenskap från University of California, Riverside.

Sunita Koppar är en Sr. Data Lake Architect med AWS Professional Services. Hon brinner för att lösa problem hos kunder genom att bearbeta big data och tillhandahålla långsiktiga skalbara lösningar. Innan denna roll utvecklade hon produkter inom internet-, telekom- och fordonsdomäner och har varit AWS-kund. Hon har en magisterexamen i datavetenskap från University of California, Riverside.

Saswata Dash är DevOps-konsult med AWS Professional Services. Hon har arbetat med kunder inom sjukvård och biovetenskap, flyg och tillverkning. Hon brinner för allt som har med automation att göra och har omfattande erfarenhet av att designa och bygga företagsskaliga kundlösningar i AWS. Utanför jobbet driver hon sin passion för fotografering och att fånga soluppgångar.

Saswata Dash är DevOps-konsult med AWS Professional Services. Hon har arbetat med kunder inom sjukvård och biovetenskap, flyg och tillverkning. Hon brinner för allt som har med automation att göra och har omfattande erfarenhet av att designa och bygga företagsskaliga kundlösningar i AWS. Utanför jobbet driver hon sin passion för fotografering och att fånga soluppgångar.

- SEO-drivet innehåll och PR-distribution. Bli förstärkt idag.

- PlatoData.Network Vertical Generative Ai. Styrka dig själv. Tillgång här.

- PlatoAiStream. Web3 Intelligence. Kunskap förstärkt. Tillgång här.

- Platoesg. Kol, CleanTech, Energi, Miljö, Sol, Avfallshantering. Tillgång här.

- PlatoHealth. Biotech och kliniska prövningar Intelligence. Tillgång här.

- Källa: https://aws.amazon.com/blogs/machine-learning/promote-pipelines-in-a-multi-environment-setup-using-amazon-sagemaker-model-registry-hashicorp-terraform-github-and-jenkins-ci-cd/

- : har

- :är

- :inte

- :var

- $UPP

- 1

- 10

- 100

- 12

- 13

- 14

- 16

- 17

- 19

- 23

- 27

- 31

- 320

- 7

- 8

- 9

- a

- Om oss

- accelererar

- godkännande

- tillgång

- Konto

- konton

- tvärs

- Handling

- anpassa

- lägga till

- adress

- administrativa

- Antagande

- Efter

- ålder

- AI

- rikta

- Alla

- tillåter

- tillåter

- längs

- också

- amason

- Amazon SageMaker

- Amazon Web Services

- an

- och

- Annan

- vilken som helst

- Ansökan

- lämpligt

- godkänna

- godkänd

- arkitektur

- ÄR

- områden

- runt

- konstgjord

- artificiell intelligens

- Konstgjord intelligens (AI)

- AS

- be

- associerad

- utgå ifrån

- bifoga

- bil

- Automatiserad

- Automat

- Automation

- fordonsindustrin

- tillgänglig

- luftfarten

- undvika

- AWS

- AWS kund

- AWS professionella tjänster

- tillbaka

- baserat

- grund

- BE

- därför att

- varit

- innan

- Där vi får lov att vara utan att konstant prestera,

- BÄST

- bästa praxis

- mellan

- Stor

- Stora data

- båda

- Branch

- överbryggande

- Föra

- SLUTRESULTAT

- Byggnad

- byggt

- företag

- men

- by

- beräkning

- kalifornien

- kallas

- KAN

- Vid

- centrala

- byta

- ändrats

- Förändringar

- avgifter

- ta

- val

- Välja

- koda

- samverkan

- samla

- Colorado

- Kolumn

- Kolonner

- COM

- kombination

- fullborda

- Efterlevnad

- komponenter

- omfattande

- dator

- Datavetenskap

- tillstånd

- konfiguration

- Bekräfta

- Konsol

- konsult

- Behållare

- innehåller

- kontroll

- Konventionen

- konvertera

- Motsvarande

- skapa

- skapas

- Skapa

- referenser

- Cross

- kund

- Kundlösningar

- Kunder

- dagligen

- instrumentbräda

- datum

- datasjö

- datavetenskap

- datavetare

- datauppsättningar

- Avkryptera

- Standard

- Examen

- distribuera

- utplacera

- utplacering

- vecklas ut

- design

- detaljer

- upptäcka

- detekterad

- dev

- utvecklade

- utveckla

- Utveckling

- DICT

- olika

- domän

- domäner

- under

- dynamisk

- varje

- Tidigare

- effekt

- antingen

- e

- möjliggöra

- krypterad

- ingenjör

- säkerställer

- ange

- Miljö

- miljöer

- väsentlig

- händelser

- utvecklas

- utförande

- förväntat

- erfarenhet

- förklarade

- förklara

- förlänga

- främja

- MISSLYCKAS

- Misslyckades

- misslyckas

- Misslyckande

- Leverans

- Funktioner

- få

- Figur

- Fil

- slutlig

- finansiella

- slut

- företag

- Förnamn

- första gången

- efter

- För

- hittade

- Ramverk

- ramar

- från

- Uppfylla

- full

- fungera

- funktionella

- framtida

- spalt

- generera

- genereras

- genererar

- skaffa sig

- gå

- GitHub

- Ge

- ges

- ger

- Välgörenhet

- Go

- Går

- bidrag

- Grupp

- Har

- hälso-och sjukvård

- här

- högre

- innehar

- värd

- Hur ser din drömresa ut

- How To

- html

- http

- HTTPS

- ID

- Identitet

- if

- genomföra

- importera

- in

- innefattar

- Inklusive

- index

- Infrastruktur

- initialt

- initiativ

- ingångar

- installera

- installerad

- exempel

- instruktioner

- integrerar

- Intelligens

- Internet

- in

- införa

- IT

- Jobb

- Lediga jobb

- jpg

- json

- Nyckel

- nycklar

- etikett

- sjö

- liggande

- senare

- senaste

- inlärning

- Led

- belånade

- livet

- Life Sciences

- linje

- log

- lång sikt

- Maskinen

- maskininlärning

- Huvudsida

- bibehålla

- göra

- förvaltade

- ledning

- Produktion

- Marginal

- Massa

- master

- mekanism

- möte

- Meny

- Sammanfoga

- Metrics

- saknas

- ML

- MLOps

- modell

- modellering

- modeller

- modifiera

- Moduler

- Ögonblick

- Övervaka

- övervakas

- övervakning

- mer

- multipel

- namn

- Som heter

- namngivning

- Navigering

- Behöver

- behövs

- behov

- Nya

- Nästa

- normala

- anteckningsbok

- anmälan

- anmälningar

- antal

- numpy

- of

- Ofta

- on

- ONE

- Verksamhet

- or

- beställa

- organisationer

- Övriga

- ut

- utanför

- över

- Översikt

- egen

- paket

- sida

- Smärta

- pandor

- panelen

- del

- reservdelar till din klassiker

- Godkänd

- brinner

- brinner

- Mönster

- prestanda

- behörigheter

- fotografi

- plockade

- Picks

- rörledning

- plattform

- plato

- Platon Data Intelligence

- PlatonData

- poäng

- Strategier

- policy

- Inlägg

- praxis

- förutse

- Förutsägelser

- Förbered

- förutsättningar

- föregående

- Principal

- Innan

- privilegier

- process

- bearbetning

- Produktion

- Produkter

- professionell

- projektet

- främja

- främjas

- främjande

- ge

- förutsatt

- ger

- tillhandahålla

- tillhandahållande

- publicly

- Drar

- Förföljer

- Tryck

- Python

- snabbt

- snabbt

- Raw

- Läsa

- redo

- verkliga världen

- region

- registrera

- registrerat

- register

- register

- regulatorer

- relaterad

- relation

- ta bort

- Repository

- begära

- Obligatorisk

- Krav

- resurs

- Resurser

- respons

- detaljhandeln

- avkastning

- Flodstrand

- Roll

- roller

- rot

- Regel

- regler

- Körning

- kör

- sagemaker

- SageMaker-rörledningar

- Samma

- Save

- sparade

- skalbar

- scenario

- tidtabellen

- planerad

- schemaläggning

- Vetenskap

- VETENSKAPER

- Forskare

- skript

- skript

- sömlöst

- Andra

- §

- säkra

- säkerhet

- se

- sända

- skicka

- sänder

- skickas

- separat

- server

- service

- Tjänster

- in

- inställningar

- inställning

- Forma

- Dela

- hon

- skall

- show

- utställningsmonter

- visas

- Visar

- Enkelt

- kodavsnitt

- So

- lösning

- Lösningar

- Lösa

- Källa

- Källor

- Utrymme

- specialiserad

- specifik

- delas

- Ange

- .

- statisk

- status

- Steg

- Steg

- Fortfarande

- lagra

- lagras

- lagrar

- Sträng

- struktur

- studio

- framgångsrik

- sådana

- Stöder

- Målet

- lag

- telecom

- Terraform

- testa

- Testning

- den där

- Smakämnen

- Dem

- sedan

- Där.

- Dessa

- saker

- Tredje

- tredje part

- detta

- tre

- Genom

- tid

- till

- verktygslådor

- topp

- ämne

- spår

- Tåg

- tränad

- Utbildning

- Förvandla

- utlösa

- triggas

- trigg

- sann

- Litar

- SVÄNG

- två

- ui

- under

- universitet

- University of California

- Uppdatering

- uppdaterad

- uppladdad

- URL

- us

- användning

- Begagnade

- med hjälp av

- verktyg

- Värden

- olika

- version

- versioner

- via

- Video

- synlig

- Kolla på

- we

- webb

- webbservice

- när

- närhelst

- medan

- som

- medan

- kommer

- med

- inom

- utan

- Arbete

- arbetade

- arbetsflöde

- arbetssätt

- fungerar

- skriva

- skriven

- Om er

- Din

- Youtube

- zephyrnet