Ja.. Jag pratar om AI-applikationerna – våra otaliga AI-applikationer och kommande som viskar till människor om vad de ska göra... hur man gör...men inte om viskarna som interagerar med AI-chatbotarna.

Enligt IDC Förutsägelser kan den globala AI-marknaden nå över 500 miljarder USD år 2024 – en ökning med mer än 50 % från 2021. Detta indikerar att vi gått från affärsexperiment till att acceptera att det är en integrerad del av företagsstrategin för alla storlekar. Det är ett nödvändigt verktyg för att omvandla data till insikter för att väcka åtgärder baserat på bättre beslut. Ingen diskuterar fördelarna med AI för att minska affärsrisken och förstärka ROI med innovation. Men som alltid finns det ett …MEN… den opartiska AI är lättare sagt än gjort.

Dessa AI-modeller är avgörande för verksamheten och måste fungera tillförlitligt med synlighet och ansvarsskyldighet. Annars får misslyckanden i det här fallet allvarliga konsekvenser som påverkar alla företags kassaflöde och kan till och med leda till juridiska frågor. Det enda sättet att undvika detta är automatisering och transparens för att svara på en fråga "Kan du bevisa att den här AI-applikationen/arbetsbelastningen är etisk uppbyggd." Aka...hur styr du? Och kan du bevisa att det styrs kontinuerligt?

Det är här företag gillar IBM har investerat i AI-styrning för att orkestrera den övergripande processen för att styra, hantera och övervaka organisationens AI-aktiviteter. Den primära uppgiften är att säkerställa att alla affärsenheter förblir proaktiva och ingjutera styrramverket i initiativen för att stärka förmågan att uppfylla etiska principer och regler. Särskilt reglerade branscher som bank och finansiella tjänster är lagligt skyldiga att tillhandahålla bevis för att tillfredsställa tillsynsmyndigheter.

AI:s inflytande växer exponentiellt inom sektorn för finansiella tjänster på grund av det enorma trycket från digital transformation. Som sagt, det är lättare sagt än gjort eftersom:

1. Använd AI-apparna med tillförsikt:

I vissa fall byggs modellerna utan tydlighet och katalogisering; det behöver inte sägas att övervakning glider iväg mitt i allt för att spåra livscykeln från början till slut. Medan banker kämpar med äldre applikationer blev det svårare att automatisera processerna för att skapa transparens och förklarabarhet och i sin tur en svart låda. Ingen vet varför/hur besluten togs. De nya apparna som är trassliga med äldre appar ser aldrig dagsljuset även om en enorm ROI är förknippad med det på grund av kvalitet och ouppfattade risker.

Det för oss till vår andra punkt – hantering av ryktesrisken

2. Hantera ryktesrisk tillsammans med den övergripande risken

jag har frågat #chatGPT och #Bard – vem är Padma Chukka. #ChatGPT vägrade svara även om jag ändrade frågan på flera sätt. Ändå gav Bard mig ett detaljerat svar, inklusive min LinkedIn-profil...men data är från olika webbplatser där min gamla profil fortfarande finns som en del av högtalarbios. Från den tidpunkten har jag ännu inte öppnat Barden. Så snabbt blev jag avstängd, aka – ryktesrisk. Anta att jag kan stänga av en enkel chatbot när jag inser att data kan vara inkonsekventa. Hur kunde jag inte vara säker innan jag bestämmer mig för att köpa en AI-infunderad applikation för att göra kritiska affärer? Ryktesrisk är en väsentlig faktor som företag ibland glömmer. Om du kvantifierar ryktesrisken kan man se den enorma inverkan på verksamheten om man inte är proaktiv.

För att öka komplexiteten är den tredje...

3. Hur kan ett företag reagera på förändrade AI-regler?

För att undvika ryktesrisken bör ett framgångsrikt och ansvarsfullt AI-team vara medvetet om alla lokala och globala regleringar och falla som en tick-tock-video med ett ögonblicks varsel. Och bristande efterlevnad kan i slutändan kosta en organisation miljontals dollar i böter kring arbetet som den föreslagna EU AI-lagen. Det kan vara upp till 30 miljoner euro eller 6 % av företagets globala intäkter – OUCH.

Tja, allt behöver inte vara rosenrött när vi börjar... så länge vi vet hur man gör en makeover från en skrämmande till en rosa situation.

Utan någon överraskning... det är alltid människor, processer och teknik. Så först, skapa ett tvärfunktionellt styrande organ för att utbilda, styra och övervaka initiativen baserat på målen. Benchmark sedan aktuell AI-teknik och processer, förstå luckorna och åtgärda sedan till framtida bevis. Fall sedan tillbaka på en uppsättning automatiserade styrningsarbetsflöden i linje med efterlevnadskrav. Slutligen, sätt upp ett övervakningssystem för att varna ägare om den acceptabla tröskeln närmar sig. Från tekniksidan kräver en välbyggd, väl genomförd och väl sammankopplad AI flera byggstenar. Och se till att den har några eller alla funktioner:

· Dataintegritet över olika distributioner

· Använd öppna, flexibla befintliga verktyg som följer AI Governance

· Se till att erbjuda självbetjäningsåtkomst med integritetskontroller – ett sätt att spåra

· Design med automation och AI-styrning i åtanke

· Kan ansluta och vara anpassningsbar för flera intressenter genom anpassningsbart arbetsflöde

När vi väl ger en makeover av appen från skrämmande till Rosy ... då är nästa fråga hur du bevisar ...

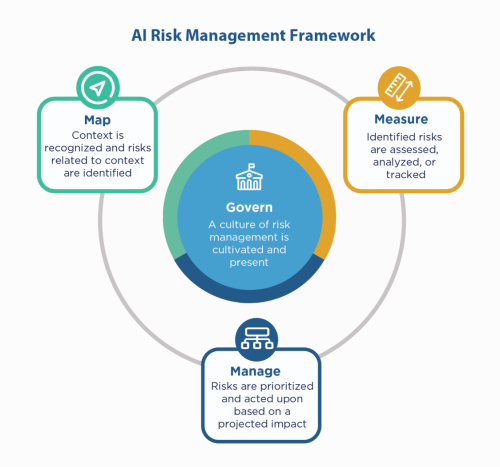

Först, fall tillbaka på företagets AI-principer – bygg med dem, och ändå behöver du fortfarande "visa" att du är kompatibel, särskilt i reglerade miljöer som Financial Services. Eftersom finansiella tjänster måste klaga med NIST 800-53, kunde de titta på NIST AI Risk Management Framework (AI RMF). NIST föreslog kontrollerna i fyra familjer – Styr, Karta, Mät och Hantera. Använd det som en vägledande faktor och stresstesta applikationerna för att identifiera luckorna som ska åtgärdas och övervakas.

IBM kan validera dina modeller innan du sätter dem i produktion och kan övervakas för rättvisa, kvalitet och drift. Den kan också tillhandahålla dokumentation som förklarar modellens beteende och förutsägelser för att tillgodose tillsynsmyndigheternas och revisorernas krav. Dessa förklaringar kan ge synlighet och lindra revisionsbesvären och öka transparensen och förmågan att fastställa möjliga risker.

Lyssna på dessa AI-viskningar med självförtroende!

#Finansiella tjänster #ansvarigai #etisk #NISTAIRMF

- SEO-drivet innehåll och PR-distribution. Bli förstärkt idag.

- Platoblockchain. Web3 Metaverse Intelligence. Kunskap förstärkt. Tillgång här.

- Minting the Future med Adryenn Ashley. Tillgång här.

- Källa: https://www.finextra.com/blogposting/24053/the-costly-consequences-of-unethical-ai-whisperer?utm_medium=rssfinextra&utm_source=finextrablogs

- :är

- $UPP

- 2021

- 2024

- 7

- a

- förmåga

- Om Oss

- godtagbart

- tillgång

- ansvar

- tvärs

- Agera

- Handling

- aktiviteter

- anslutit sig

- AI

- AI-lagen

- AI-styrning

- aka

- Varna

- Alla

- alltid

- och

- svara

- app

- Ansökan

- tillämpningar

- appar

- ÄR

- runt

- AS

- associerad

- At

- revision

- revisorer

- Automatiserad

- automatisera

- Automation

- tillbaka

- Banking

- Banker

- baserat

- BE

- därför att

- innan

- Där vi får lov att vara utan att konstant prestera,

- riktmärke

- Fördelarna

- Bättre

- Miljarder

- Svart

- Block

- kropp

- Box

- Bringar

- SLUTRESULTAT

- Byggnad

- byggt

- företag

- Köp

- by

- KAN

- kapacitet

- Vid

- fall

- Kontanter

- kassaflöde

- byte

- chatbot

- chatbots

- klarhet

- stängning

- Företag

- företag

- Komplexiteten

- Efterlevnad

- kompatibel

- Genomför

- självsäkert

- Kontakta

- Konsekvenser

- kontinuerligt

- kontroller

- Pris

- kunde

- skapa

- kritisk

- Aktuella

- anpassningsbar

- cykel

- datum

- diskuterar

- Avgörande

- beslut

- minskning

- Designa

- detaljerad

- Bestämma

- digital

- digital Transformation

- hemska

- rikta

- riktande

- flera

- dokumentation

- dollar

- Drop

- lättare

- utbilda

- början till slut

- säkerställa

- Företag

- miljöer

- speciellt

- väsentlig

- etisk

- EU

- euro

- Även

- Varje

- allt

- bevis

- befintliga

- finns

- förklara

- exponentiellt

- Misslyckande

- rättvisa

- Höst

- familjer

- Slutligen

- finansiella

- finansiella tjänster

- ändarna

- Finextra

- Förnamn

- flexibel

- flöda

- För

- Ramverk

- från

- från 2021

- framtida

- Ge

- Välgörenhet

- styrning

- Odling

- Har

- Hur ser din drömresa ut

- How To

- HTTPS

- stor

- Människa

- i

- identifiera

- Inverkan

- in

- Inklusive

- Öka

- pekar på

- industrier

- påverka

- initiativ

- Innovation

- insikter

- integrerad

- integritet

- interagera

- investerat

- IT

- DESS

- Jobb

- Vet

- Legacy

- Adress

- juridiska frågor

- livet

- tycka om

- linje

- lokal

- Lång

- se

- gjord

- göra

- hantera

- ledning

- hantera

- karta

- marknad

- Betyder Något

- Maj..

- mäta

- Möt

- kanske

- miljon

- miljoner

- modell

- modeller

- ögonblick

- Övervaka

- övervakas

- övervakning

- mer

- multipel

- nödvändigt för

- Behöver

- onödigt

- Nya

- Nästa

- NIST

- mål

- of

- erbjudanden

- Gamla

- on

- ONE

- öppet

- driva

- organisation

- annat

- övergripande

- ägare

- Smärta

- del

- Personer

- plato

- Platon Data Intelligence

- PlatonData

- Punkt

- möjlig

- Förutsägelser

- tryck

- primär

- Principerna

- privatpolicy

- Proaktiv

- process

- processer

- Produktion

- Profil

- bevis

- föreslagen

- Bevisa

- ge

- sätta

- kvalitet

- fråga

- snabbt

- nå

- inser

- reglerad

- reglerade industrier

- reglering

- föreskrifter

- Tillsynsmyndigheter

- rykte

- Obligatorisk

- Krav

- Kräver

- Svara

- ansvarig

- resultera

- intäkter

- Risk

- riskhanterings

- risker

- ROI

- Rosy

- s

- Nämnda

- Andra

- sektor

- Självbetjäning

- Tjänster

- in

- skall

- show

- sida

- Enkelt

- eftersom

- Områden

- Situationen

- storlekar

- So

- några

- Gnista

- Högtalare

- intressenter

- bo

- Fortfarande

- Strategi

- Stärka

- påkänning

- Kämpar

- framgångsrik

- system

- tala

- grupp

- Teknologi

- testa

- den där

- Smakämnen

- Dem

- Dessa

- Tredje

- tröskelvärde

- Genom

- till

- verktyg

- verktyg

- spår

- Transformation

- Öppenhet

- enorm

- SVÄNG

- vände

- Ytterst

- förstå

- enheter

- kommande

- us

- användning

- BEKRÄFTA

- olika

- Video

- synlighet

- Sätt..

- sätt

- Vad

- medan

- VEM

- med

- utan

- Arbete

- arbetsflöden

- Om er

- Din

- zephyrnet