Amazon Bedrock är det bästa stället att bygga och skala generativa AI-applikationer med stora språkmodeller (LLM) och andra grundmodeller (FM). Det gör det möjligt för kunder att dra nytta av en mängd högpresterande FM:er, som Claude-familjen av modeller från Anthropic, för att bygga anpassade generativa AI-applikationer. När vi ser tillbaka till 2021, när Anthropic först började bygga på AWS, kunde ingen ha föreställt sig hur transformativ modellfamiljen Claude skulle vara. Vi har gjort toppmoderna generativa AI-modeller tillgängliga och användbara för företag av alla storlekar genom Amazon Bedrock. På bara några korta månader sedan Amazon Bedrock blev allmänt tillgänglig den 28 september 2023, har mer än 10 XNUMX kunder använt det för att leverera, och många av dem använder Claude. Kunder som t.ex ADP, Broadridge, Cloudera, Dana-Farber Cancer Institute, Genesys, Genomics England, GoDaddy, Intuit, M1 Finance, Perplexity AI, Proto Hologram, Rocket Companies och mer använder Anthropics Claude-modeller på Amazon Bedrock för att driva innovation inom generativ AI och för att bygga transformativa kundupplevelser. Och idag tillkännager vi en spännande milstolpe med nästa generation av Claude som kommer till Amazonas grund: Claude 3 Opus, Claude 3 Sonnet och Claude 3 Haiku.

Vi presenterar Anthropics Claude 3-modeller

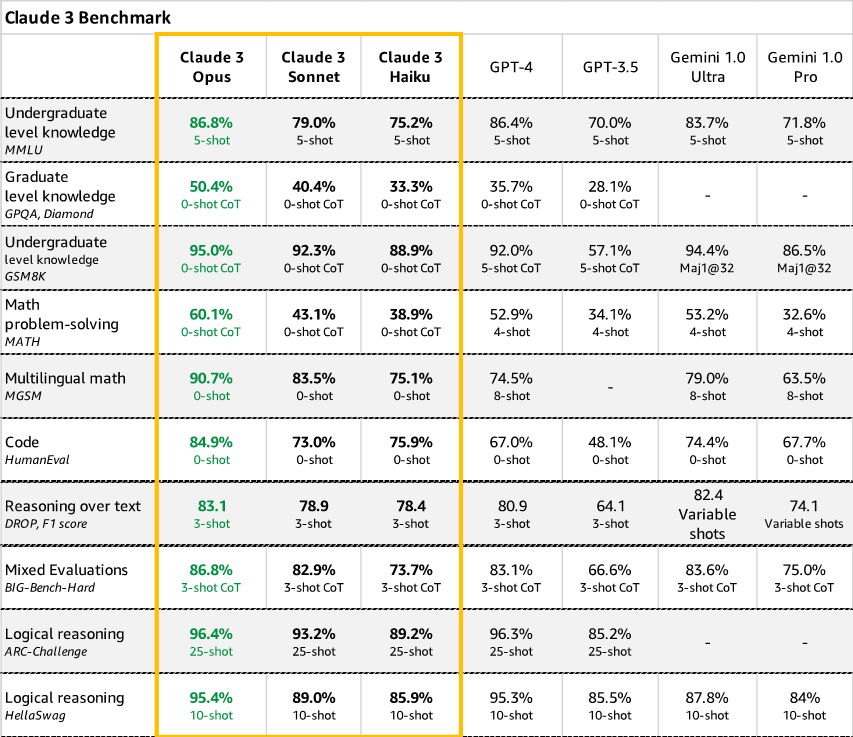

Anthropic presenterar sin nästa generation av Claude med tre avancerade modeller optimerade för olika användningsfall. Haiku är den snabbaste och mest kostnadseffektiva modellen på marknaden. Det är en snabb kompakt modell för nästan omedelbar respons. För de allra flesta arbetsbelastningar är Sonnet 2 gånger snabbare än Claude 2 och Claude 2.1 med högre intelligensnivåer. Den utmärker sig vid intelligenta uppgifter som kräver snabba svar, som kunskapsinhämtning eller försäljningsautomatisering. Och den har den perfekta balansen mellan intelligens och hastighet – egenskaper som är särskilt viktiga för företagsanvändning. Opus är den mest avancerade, kapabla, state-of-the-art FM med djupa resonemang, avancerad matematik och kodningsförmåga, med högsta prestanda för mycket komplexa uppgifter. Den kan navigera med öppna uppmaningar och nya scenarier med enastående flyt, inklusive uppgiftsautomatisering, hypotesgenerering och analys av diagram, grafer och prognoser. Och Sonnet är först tillgänglig på Amazon Bedrock idag. Aktuella utvärderingar från Anthropic tyder på att Claude 3-modellfamiljen överträffar jämförbara modeller i matematiska ordproblemlösning (MATH) och multilingual matte (MGSM), kritiska riktmärken som används idag för LLM.

- Synförmåga – Claude 3-modeller har tränats för att förstå strukturerad och ostrukturerad data i olika format, inte bara språk, utan även bilder, diagram, diagram och mer. Detta låter företag bygga generativa AI-applikationer som integrerar olika multimediakällor och löser verkligt problem över flera domäner. Läkemedelsföretag kan till exempel fråga efter forskningsdokument om läkemedel tillsammans med diagram över proteinstrukturer för att påskynda upptäckten. Medieorganisationer kan generera bildtexter eller videomanus automatiskt.

- Klassens bästa riktmärken – Claude 3 överträffar befintliga modeller för standardiserade utvärderingar som matematiska problem, programmeringsövningar och vetenskapliga resonemang. Kunder kan optimera domänspecifika experimentella procedurer i tillverkningen, eller granska finansiella rapporter baserade på kontextuella data, på ett automatiserat sätt och med hög noggrannhet med hjälp av AI-drivna svar.

Specifikt överträffar Opus sina kollegor på de flesta av de vanliga utvärderingsriktmärkena för AI-system, inklusive expertkunskap på grundnivå (MMLU), expertresonemang på forskarnivå (GPQA), grundläggande matematik (GSM8K) och mer. Den uppvisar höga nivåer av förståelse och flyt på komplexa uppgifter, vilket leder gränsen för allmän intelligens.

- Minskad hallucination – Företag kräver förutsägbara, kontrollerbara utdata från AI-system som styr automatiserade processer eller kundinteraktioner. Claude 3-modeller mildrar hallucinationer genom konstitutionella AI-tekniker som ger insyn i modellens resonemang, samt förbättrar noggrannheten. Claude 3 Opus visar en uppskattad 2x vinst i noggrannhet jämfört med Claude 2.1 på svåra öppna frågor, vilket minskar sannolikheten för felaktiga svar. Eftersom företagskunder förlitar sig på Claude i branscher som hälsovård, finans och juridisk forskning är det viktigt att minska hallucinationer för säkerhet och prestanda. Claude 3-familjen sätter en ny standard för pålitlig generativ AI-utgång.

Fördelarna med Anthropic Claude 3 FMs på Amazon Bedrock

Genom Amazon Bedrock kommer kunderna att få enkel tillgång att bygga med Anthropics nyaste modeller. Detta inkluderar inte bara naturliga språkmodeller utan också deras utökade utbud av multimodala AI-modeller som kan resonera avancerat över text, bilder, diagram och mer. Vårt samarbete har redan hjälpt kunder att påskynda generativ AI-adoption och levererat affärsvärde till dem. Här är några sätt som kunder har använt Anthropics Claude-modeller på Amazon Bedrock:

"Vi utvecklar en generativ AI-lösning på AWS för att hjälpa kunder att planera episka resor och skapa livsförändrande upplevelser med personliga resplaner. Genom att bygga med Claude på Amazon Bedrock minskade vi kostnaderna för generering av resplaner med nästan 80 % procent när vi snabbt skapade en skalbar, säker AI-plattform som kan organisera vårt bokinnehåll på några minuter för att leverera sammanhållna, mycket exakta reserekommendationer. Nu kan vi packa om och anpassa vårt innehåll på olika sätt på våra digitala plattformar, baserat på kundens preferenser, samtidigt som vi lyfter fram pålitliga lokala röster – precis som Lonely Planet har gjort i 50 år.”

— Chris Whyde, Senior VP of Engineering and Data Science, Lonely Planet

"Vi arbetar med AWS och Anthropic för att vara värd för vår anpassade, finjusterade Anthropic Claude-modell på Amazon Bedrock för att stödja vår strategi att snabbt leverera generativa AI-lösningar i stor skala och med banbrytande kryptering, datasekretess och säker AI-teknik inbäddad i allt vi gör. Vår nya Lexis+ AI-plattformsteknik har konversationssökning, insiktsfull sammanfattning och intelligenta juridiska utarbetningsmöjligheter, som gör det möjligt för jurister att öka sin effektivitet, effektivitet och produktivitet."

— Jeff Reihl, Executive VP och CTO, LexisNexis Legal & Professional

"På Broadridge har vi arbetat med att automatisera förståelsen av regulatoriska rapporteringskrav för att skapa större transparens och öka effektiviteten för våra kunder som verkar på inhemska och globala finansmarknader. Med användning av Claude på Amazon Bedrock är vi glada över att få ännu högre noggrannhet i våra experiment med bearbetnings- och sammanfattningsmöjligheter. Med Amazon Bedrock har vi val i vår användning av LLM:er, och vi värdesätter prestanda och integrationsmöjligheter det erbjuder."

— Saumin Patel, VP Engineering generativ AI, Broadridge

Claude 3-modellfamiljen tillgodoser olika behov, vilket gör att kunderna kan välja den modell som är bäst lämpad för deras specifika användningsfall, vilket är nyckeln till att utveckla en framgångsrik prototyp och senare produktionssystem som kan ge verklig effekt – oavsett om det gäller en ny produkt, funktion eller process som ökar resultatet. Anthropic och AWS håller kundernas behov i fokus och levererar där det är viktigast för organisationer av alla storlekar:

- Förbättrad prestanda – Claude 3-modeller är betydligt snabbare för interaktioner i realtid tack vare optimeringar mellan hårdvara och mjukvara.

- Ökad noggrannhet och tillförlitlighet – Genom massiv skalning såväl som nya tekniker för självövervakning innebär förväntade vinster på 2x i noggrannhet för komplexa frågor över långa sammanhang AI som är ännu mer användbar, säker och ärlig.

- Enklare och säker anpassning – Anpassningsfunktioner, som retrieval-augmented generation (RAG), förenklar utbildningsmodeller för egen data och bygger applikationer som backas upp av olika datakällor, så att kunderna får AI anpassad för sina unika behov. Dessutom exponeras proprietär data aldrig för det offentliga internet, lämnar aldrig AWS-nätverket, överförs säkert via VPC och krypteras under överföring och vila.

Och AWS och Anthropic bekräftar kontinuerligt vårt engagemang för att främja generativ AI på ett ansvarsfullt sätt. Genom att ständigt förbättra modellens kapacitet att förbinda sig till ramverk som Konstitutionell AI eller Vita husets frivilliga åtaganden om AI, kan vi påskynda den säkra, etiska utvecklingen och implementeringen av denna transformativa teknik.

Framtiden för generativ AI

Framöver kommer kunderna att bygga helt nya kategorier av generativa AI-drivna applikationer och upplevelser med den senaste generationens modeller. Vi har bara börjat utnyttja den generativa AI:s potential för att automatisera komplexa processer, utöka mänsklig expertis och omforma digitala upplevelser. Vi förväntar oss att se oöverträffade nivåer av innovation när kunder väljer Anthropics modeller utökade med multimodala färdigheter som utnyttjar alla verktyg de behöver för att bygga och skala generativa AI-applikationer på Amazon Bedrock. Föreställ dig sofistikerade samtalsassistenter som ger snabba och mycket kontextuella svar, bildpersonaliserade rekommendationsmotorer som sömlöst smälter in relevanta bilder, diagram och tillhörande kunskap för att intuitivt vägleda beslut. Föreställ dig vetenskaplig forskning turboladdad av generativ AI som kan läsa experiment, syntetisera hypoteser och till och med föreslå nya områden för utforskning. Det finns så många möjligheter som kommer att realiseras genom att dra full nytta av allt generativ AI har att erbjuda genom Amazon Bedrock. Vårt samarbete säkerställer att företag och innovatörer över hela världen kommer att ha verktygen för att nå nästa gräns för generativ AI-driven innovation på ett ansvarsfullt sätt och till gagn för alla.

Slutsats

Det är fortfarande tidiga dagar för generativ AI, men starkt samarbete och fokus på innovation inleder en ny era av generativ AI på AWS. Vi kan inte vänta med att se vad kunderna bygger härnäst.

Resurser

Kolla in följande resurser för att lära dig mer om detta tillkännagivande:

Om författaren

Swami Sivasubramanian är vice vd för data- och maskininlärning på AWS. I denna roll övervakar Swami alla AWS-databas-, analys- och AI- och maskininlärningstjänster. Hans teams uppdrag är att hjälpa organisationer att få sin data att fungera med en komplett, end-to-end datalösning för att lagra, komma åt, analysera och visualisera och förutsäga.

Swami Sivasubramanian är vice vd för data- och maskininlärning på AWS. I denna roll övervakar Swami alla AWS-databas-, analys- och AI- och maskininlärningstjänster. Hans teams uppdrag är att hjälpa organisationer att få sin data att fungera med en komplett, end-to-end datalösning för att lagra, komma åt, analysera och visualisera och förutsäga.

- SEO-drivet innehåll och PR-distribution. Bli förstärkt idag.

- PlatoData.Network Vertical Generative Ai. Styrka dig själv. Tillgång här.

- PlatoAiStream. Web3 Intelligence. Kunskap förstärkt. Tillgång här.

- Platoesg. Kol, CleanTech, Energi, Miljö, Sol, Avfallshantering. Tillgång här.

- PlatoHealth. Biotech och kliniska prövningar Intelligence. Tillgång här.

- Källa: https://aws.amazon.com/blogs/machine-learning/unlocking-innovation-aws-and-anthropic-push-the-boundaries-of-generative-ai-together/

- : har

- :är

- :inte

- :var

- 1

- 100

- 10K

- 10 XNUMX kunder

- 2021

- 2023

- 28

- 50

- 50 Years

- 7

- 8

- a

- förmågor

- Able

- Om Oss

- accelerera

- tillgång

- tillgänglig

- noggrannhet

- exakt

- tvärs

- Dessutom

- Antagande

- avancerat

- Vidare

- Fördel

- framåt

- AI

- AI och maskininlärning

- AI-modeller

- AI-plattform

- AI-system

- AI-powered

- Alla

- tillåta

- vid sidan av

- redan

- också

- amason

- Amazon Web Services

- an

- analys

- analytics

- analysera

- och

- Tillkännagivande

- Vi presenterar

- Antropisk

- tillämpningar

- ÄR

- områden

- AS

- assistenter

- associerad

- At

- revision

- förstärka

- augmented

- automatisera

- Automatiserad

- automatiskt

- Automation

- tillgänglig

- AWS

- tillbaka

- dragen tillbaka

- Balansera

- baserat

- grundläggande

- BE

- blev

- varit

- börjat

- riktmärken

- fördel

- BÄST

- mellan

- Blandning

- boken

- boostar

- Botten

- gränser

- Broadridge

- SLUTRESULTAT

- Byggnad

- företag

- företag

- men

- by

- KAN

- Cancer

- kapacitet

- kapabel

- texter

- Vid

- fall

- kategorier

- tillgodoser

- Diagram

- val

- Välja

- chris

- Cloudera

- Kodning

- sammanhängande

- samverkan

- kommande

- engagemang

- åtaganden

- begå

- Gemensam

- kompakt

- Företag

- jämförbar

- fullborda

- komplex

- ständigt

- innehåll

- kontexter

- kontextuella

- kontinuerligt

- konversera

- kostnadseffektiv

- Kostar

- kunde

- skapa

- skapas

- kritisk

- CTO

- Aktuella

- beställnings

- kund

- Kunder

- anpassning

- allra senaste

- datum

- dataintegritet

- datavetenskap

- Databas

- Dagar

- beslut

- djup

- leverera

- levereras

- leverera

- krävande

- utplacering

- utveckla

- Utveckling

- diagrammen

- olika

- svårt

- digital

- riktande

- Upptäckten

- flera

- do

- domän

- Inrikes

- gjort

- driv

- drog

- Tidig

- lätt

- effektivitet

- effektivitet

- inbäddade

- möjliggöra

- möjliggör

- krypterad

- kryptering

- början till slut

- Teknik

- Motorer

- England

- säkerställer

- Företag

- företag

- helt

- envision

- envisioned

- EPISK

- Era

- speciellt

- väsentlig

- beräknad

- etisk

- utvärdering

- utvärderingar

- Även

- allt

- överstiger

- spännande

- verkställande

- utställningar

- befintliga

- expanderade

- förvänta

- förväntat

- Erfarenheter

- experimentell

- experiment

- expert

- expertis

- utforskning

- utsatta

- familj

- SNABB

- snabbare

- snabbast

- defekt

- Leverans

- Funktioner

- få

- finansiering

- finansiella

- Förnamn

- Fokus

- efter

- För

- prognoser

- fundament

- ramar

- från

- Frontier

- full

- framtida

- Få

- resultat

- Allmänt

- allmän intelligens

- allmänhet

- generera

- generering

- generativ

- Generativ AI

- genomik

- skaffa sig

- Välgörenhet

- globala finansiella

- uppgradera

- grafer

- större

- styra

- hårdvara

- Har

- hälso-och sjukvård

- hjälpa

- hjälpte

- hjälp

- här.

- Hög

- högpresterande

- högre

- belysa

- höggradigt

- hans

- Hologram

- ärlig

- värd

- Huset

- Hur ser din drömresa ut

- HTTPS

- humant

- idealisk

- bild

- bilder

- bild

- förbättra

- förbättra

- in

- innefattar

- Inklusive

- Öka

- industrier

- Innovation

- innovatörer

- insiktsfull

- exempel

- Institute

- Integrera

- integrering

- Intelligens

- Intelligent

- interaktioner

- Internet

- in

- Intuit

- IT

- DESS

- bara

- hålla

- Nyckel

- kunskap

- språk

- Large

- senare

- senaste

- advokater

- ledande

- LÄRA SIG

- inlärning

- Adress

- Lets

- Nivå

- nivåer

- Hävstång

- hävstångs

- LexisNexis

- tycka om

- sannolikhet

- linje

- LLM

- lokal

- Lång

- du letar

- Maskinen

- maskininlärning

- Majoritet

- Framställning

- sätt

- Produktion

- många

- marknad

- Marknader

- massiv

- matte

- matematik

- Betyder Något

- betyda

- Media

- milstolpe

- emot

- minuter

- Mission

- Mildra

- modell

- modeller

- månader

- mer

- mest

- multimedia

- Natural

- Navigera

- nästan

- Behöver

- behov

- nät

- aldrig

- Nya

- ny produkt

- Senaste

- Nästa

- Nej

- roman

- nu

- of

- erbjudanden

- Erbjudanden

- on

- ONE

- endast

- drift

- optimeringar

- Optimera

- optimerad

- or

- organisationer

- Övriga

- vår

- ut

- utklassar

- produktion

- utgångar

- över

- papper

- kamrater

- procent

- prestanda

- personifiera

- personlig

- Läkemedelsindustrin

- Bild

- Plats

- Planen

- planet

- plattform

- Plattformar

- plato

- Platon Data Intelligence

- PlatonData

- Möjligheterna

- potentiell

- förutse

- VD

- privatpolicy

- Problem

- problem

- förfaranden

- process

- processer

- bearbetning

- Produkt

- Produktion

- produktivitet

- Programmering

- prompter

- föreslå

- proprietary

- Protein

- proto

- Prototypen

- ge

- tillhandahålla

- allmän

- Tryck

- sätta

- kvaliteter

- fråga

- frågor

- snabbt

- trasa

- område

- snabb

- snabbt

- nå

- Läsa

- bekräftar

- verklig

- realtid

- insåg

- Rekommendation

- rekommendationer

- Minskad

- reducerande

- regulatorer

- relevanta

- pålitlig

- förlita

- anmärkningsvärd

- Rapportering

- Rapport

- kräver

- Krav

- forskning

- omforma

- Resurser

- svar

- ansvarig

- ansvarsfullt

- REST

- hämtning

- Raket

- Roll

- säker

- Säkerhet

- försäljning

- skalbar

- Skala

- skalning

- scenarier

- Vetenskap

- vetenskaplig

- skript

- sömlöst

- Sök

- säkra

- säkert

- se

- senior

- September

- Tjänster

- uppsättningar

- Kort

- Visar

- signifikant

- förenkla

- eftersom

- storlekar

- färdigheter

- So

- Mjukvara

- lösning

- Lösningar

- Lösa

- sofistikerade

- Källor

- specifik

- fart

- standard

- igång

- state-of-the-art

- Fortfarande

- lagra

- Strategi

- Strejker

- stark

- struktur

- strukturerade

- framgångsrik

- sådana

- föreslå

- stödja

- syntetisera

- System

- tar

- Tryck

- uppgift

- uppgifter

- tekniker

- Teknologi

- text

- än

- Tack

- den där

- Smakämnen

- deras

- Dem

- Där.

- de

- detta

- tre

- glada

- Genom

- till

- i dag

- tillsammans

- verktyg

- topp

- toppnivå

- tränad

- Utbildning

- överförd

- transformativ

- transitering

- Öppenhet

- färdas

- verkligen

- betrodd

- stämd

- förstå

- förståelse

- unika

- upplåsning

- utan motstycke

- ostrukturerad

- avslöjande

- användbar

- användning

- användningsfall

- Begagnade

- inledande

- med hjälp av

- värde

- mängd

- olika

- Omfattande

- vice

- Vice President

- Video

- visualisera

- frivillig

- vp

- vänta

- Sätt..

- sätt

- we

- webb

- webbservice

- VÄL

- Vad

- när

- som

- medan

- kommer

- med

- ord

- Arbete

- arbetssätt

- inom hela sverige

- skulle

- år

- zephyrnet