Vi tror att generativ AI har potentialen att över tid förändra praktiskt taget varje kundupplevelse vi känner. Antalet företag som lanserar generativa AI-applikationer på AWS är betydande och bygger snabbt, inklusive adidas, Booking.com, Bridgewater Associates, Clariant, Cox Automotive, GoDaddy och LexisNexis Legal & Professional, för att bara nämna några. Innovativa startups som Perplexity AI går all in på AWS för generativ AI. Ledande AI-företag som Anthropic har valt AWS som sin primära molnleverantör för uppdragskritiska arbetsbelastningar och platsen att träna sina framtida modeller. Och globala tjänste- och lösningsleverantörer som Accenture skördar frukterna av skräddarsydda generativa AI-applikationer när de ger sina interna utvecklare möjlighet att Amazon Code Whisperer.

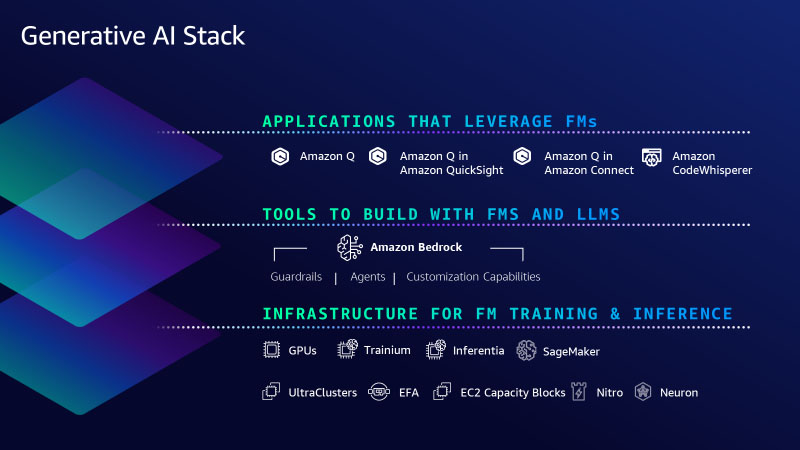

Dessa kunder väljer AWS eftersom vi är fokuserade på att göra det vi alltid har gjort – att ta komplex och dyr teknik som kan förändra kundupplevelser och företag och demokratisera det för kunder av alla storlekar och tekniska förmågor. För att göra detta investerar vi och förnyar oss snabbt för att tillhandahålla den mest omfattande uppsättningen funktioner över de tre lagren i den generativa AI-stacken. Det undre lagret är infrastrukturen för att träna stora språkmodeller (LLM) och andra grundmodeller (FM) och producera slutsatser eller förutsägelser. Mellanskiktet är enkel tillgång till alla modeller och verktyg som kunder behöver för att bygga och skala generativa AI-applikationer med samma säkerhet, åtkomstkontroll och andra funktioner som kunderna förväntar sig av en AWS-tjänst. Och på det översta lagret har vi investerat i spelförändrande applikationer inom nyckelområden som generativ AI-baserad kodning. Förutom att erbjuda dem valmöjligheter och – som de förväntar sig av oss – bredd och djup av kapacitet över alla lager, säger kunderna också att de uppskattar vår data-först-strategi och litar på att vi har byggt allt från grunden med företag- grad säkerhet och integritet.

Den här veckan tog vi ett stort steg framåt och tillkännagav många viktiga nya funktioner i alla tre lager av stacken för att göra det enkelt och praktiskt för våra kunder att använda generativ AI genomgående i sina verksamheter.

Det nedre lagret av stacken: AWS Trainium2 är det senaste tillskottet för att leverera den mest avancerade molninfrastrukturen för generativ AI

Det nedre lagret av stacken är den infrastruktur – datorer, nätverk, ramverk, tjänster – som krävs för att träna och driva LLM:er och andra FM:er. AWS utvecklar för att erbjuda den mest avancerade infrastrukturen för ML. Genom vårt långvariga samarbete med NVIDIA var AWS först med att ta med GPU:er till molnet för mer än 12 år sedan, och senast var vi den första stora molnleverantören som gjorde NVIDIA H100 GPU:er tillgängliga med våra P5-instanser. Vi fortsätter att investera i unika innovationer som gör AWS till det bästa molnet för att köra GPU:er, inklusive pris-prestandafördelarna med det mest avancerade virtualiseringssystemet (AWS Nitro), kraftfullt nätverk i petabit-skala med Elastic Fabric Adapter (EFA) och hyper- skala klustring med Amazon EC2 UltraClusters (tusentals accelererade instanser samlokaliserade i en tillgänglighetszon och sammankopplade i ett icke-blockerande nätverk som kan leverera upp till 3,200 2 Gbps för massiv ML-träning). Vi gör det också enklare för alla kunder att få tillgång till mycket eftertraktad GPU-beräkningskapacitet för generativ AI med Amazon EC500 Capacity Blocks for ML – den första och enda konsumtionsmodellen i branschen som låter kunder reservera GPU:er för framtida användning (upp till 2 distribueras i ECXNUMX UltraClusters) för kortvariga ML-arbetsbelastningar.

För flera år sedan insåg vi att för att fortsätta driva på prisutvecklingen måste vi förnya oss ända ner till kisel, och vi började investera i våra egna chips. För ML specifikt började vi med AWS Inferentia, vårt specialbyggda inferenschip. Idag är vi på vår andra generation av AWS Inferentia med Amazon EC2 Inf2-instanser som är optimerade specifikt för storskaliga generativa AI-applikationer med modeller som innehåller hundratals miljarder parametrar. Inf2-instanser erbjuder den lägsta kostnaden för slutledning i molnet samtidigt som de levererar upp till fyra gånger högre genomströmning och upp till tio gånger lägre latens jämfört med Inf1-instanser. Drivs av upp till 12 Inferentia2-chips, är Inf2 de enda slutledningsoptimerade EC2-instanserna som har höghastighetsanslutning mellan acceleratorer så att kunder kan köra slutledning snabbare och mer effektivt (till lägre kostnad) utan att offra prestanda eller latens genom att distribuera ultrastora modeller över flera acceleratorer. Kunder som Adobe, Deutsche Telekom och Leonardo.ai har sett fantastiska tidiga resultat och är glada över att distribuera sina modeller i stor skala på Inf2.

På träningssidan är Trn1-instanser – som drivs av AWS:s specialbyggda ML-träningschip, AWS Trainium – optimerade för att distribuera utbildning över flera servrar kopplade till EFA-nätverk. Kunder som Ricoh har tränat en japansk LLM med miljarder parametrar på bara dagar. Databricks får upp till 40 % bättre prisprestanda med Trainium-baserade instanser för att träna storskaliga modeller för djupinlärning. Men med nya, mer kapabla modeller som kommer ut praktiskt taget varje vecka, fortsätter vi att tänja på gränserna för prestanda och skala, och vi är glada att kunna meddela AWS Trainium2, designad för att leverera ännu bättre prisprestanda för träningsmodeller med hundratals miljarder till biljoner parametrar. Trainium2 ska ge upp till fyra gånger snabbare träningsprestanda än första generationens Trainium, och när det används i EC2 UltraClusters ska det leverera upp till 65 exaflops av aggregerad beräkning. Detta innebär att kunderna kommer att kunna träna en 300 miljarder parameter LLM på veckor kontra månader. Trainium2s prestanda, skala och energieffektivitet är några av anledningarna till att Anthropic har valt att träna sina modeller på AWS, och kommer att använda Trainium2 för sina framtida modeller. Och vi samarbetar med Anthropic om fortsatt innovation med både Trainium och Inferentia. Vi förväntar oss att våra första Trainium2-instanser ska vara tillgängliga för kunder 2024.

Vi har också fördubblat mjukvaruverktygskedjan för vårt ML-kisel, särskilt genom att utveckla AWS Neuron, mjukvaruutvecklingssatsen (SDK) som hjälper kunder att få maximal prestanda från Trainium och Inferentia. Sedan vi introducerade Neuron 2019 har vi gjort betydande investeringar i kompilator- och ramverksteknologier, och idag stöder Neuron många av de mest populära allmänt tillgängliga modellerna, inklusive Llama 2 från Meta, MPT från Databricks och Stable Diffusion från Stability AI, samt 93 av de 100 bästa modellerna på det populära modellförrådet Hugging Face. Neuron ansluts till populära ML-ramverk som PyTorch och TensorFlow, och stöd för JAX kommer tidigt nästa år. Kunder berättar för oss att Neuron har gjort det enkelt för dem att byta sina befintliga modelltränings- och slutledningspipelines till Trainium och Inferentia med bara några rader kod.

Ingen annan erbjuder samma kombination av val av de bästa ML-chippen, supersnabba nätverk, virtualisering och hyperskaliga kluster. Och så, det är inte förvånande att några av de mest välkända generativa AI-startups som AI21 Labs, Anthropic, Hugging Face, Perplexity AI, Runway och Stability AI körs på AWS. Men du behöver fortfarande de rätta verktygen för att effektivt utnyttja denna beräkning för att bygga, träna och driva LLM:er och andra FM:er effektivt och kostnadseffektivt. Och för många av dessa startups, Amazon SageMaker är svaret. Oavsett om man bygger och tränar en ny, egenutvecklad modell från grunden eller börjar med en av de många populära allmänt tillgängliga modellerna, är utbildning ett komplext och dyrt uppdrag. Det är inte heller lätt att köra dessa modeller kostnadseffektivt. Kunderna måste skaffa stora mängder data och förbereda den. Detta innebär vanligtvis mycket manuellt arbete med att rensa data, ta bort dubbletter, berika och omvandla dem. Sedan måste de skapa och underhålla stora kluster av GPU:er/acceleratorer, skriva kod för att effektivt distribuera modellträning över kluster, ofta kontrollera, pausa, inspektera och optimera modellen, och manuellt ingripa och åtgärda hårdvaruproblem i klustret. Många av dessa utmaningar är inte nya, de är några av anledningarna till att vi lanserade SageMaker för sex år sedan – för att bryta ner de många barriärerna som är involverade i modellträning och implementering och ge utvecklare ett mycket enklare sätt. Tiotusentals kunder använder Amazon SageMaker, och ett ökande antal av dem som LG AI Research, Perplexity AI, AI21, Hugging Face och Stability AI utbildar LLM:er och andra FM:er på SageMaker. Nyligen utbildade Technology Innovation Institute (skaparna av de populära Falcon LLMs) den största allmänt tillgängliga modellen – Falcon 180B – på SageMaker. I takt med att modellstorlekar och komplexitet har vuxit har även SageMakers räckvidd ökat.

Under årens lopp har vi lagt till mer än 380 spelförändrande funktioner och möjligheter till Amazon SageMaker som automatisk modellinställning, distribuerad utbildning, flexibla alternativ för modelldistribution, verktyg för ML OPs, verktyg för dataförberedelse, funktionsbutiker, bärbara datorer, sömlös integration med human-in-the-loop-utvärderingar över MLs livscykel och inbyggda funktioner för ansvarsfull AI. Vi fortsätter att innovativa snabbt för att se till att SageMakers kunder kan fortsätta bygga, träna och köra slutsatser för alla modeller – inklusive LLM:er och andra FM:er. Och vi gör det ännu enklare och mer kostnadseffektivt för kunder att träna och distribuera stora modeller med två nya funktioner. För det första, för att förenkla träningen införa Amazon SageMaker HyperPod som automatiserar fler av de processer som krävs för högskalig feltolerant distribuerad utbildning (t.ex. konfigurera distribuerade träningsbibliotek, skala träningsbelastningar över tusentals acceleratorer, upptäcka och reparera felaktiga instanser), påskynda träningen med så mycket som 40 %. Som ett resultat av detta använder kunder som Perplexity AI, Hugging Face, Stability, Hippocratic, Alkaid och andra SageMaker HyperPod för att bygga, träna eller utveckla modeller. Andra, vi introducerar nya funktioner för att göra slutsatser mer kostnadseffektiva och samtidigt minska latensen. SageMaker hjälper nu kunder att distribuera flera modeller till samma instans så att de kan dela beräkningsresurser – vilket minskar slutsatskostnaden med 50 % (i genomsnitt). SageMaker övervakar också aktivt instanser som behandlar slutledningsbegäranden och dirigerar förfrågningar på ett intelligent sätt baserat på vilka instanser som är tillgängliga – vilket uppnår 20 % lägre slutledningslatens (i genomsnitt). Conjecture, Salesforce och Slack använder redan SageMaker för värdmodeller på grund av dessa slutledningsoptimeringar.

Mellanskiktet av stacken: Amazon Bedrock lägger till nya modeller och en våg av nya funktioner gör det ännu enklare för kunder att säkert bygga och skala generativa AI-applikationer

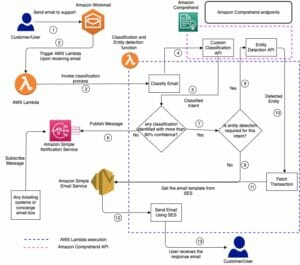

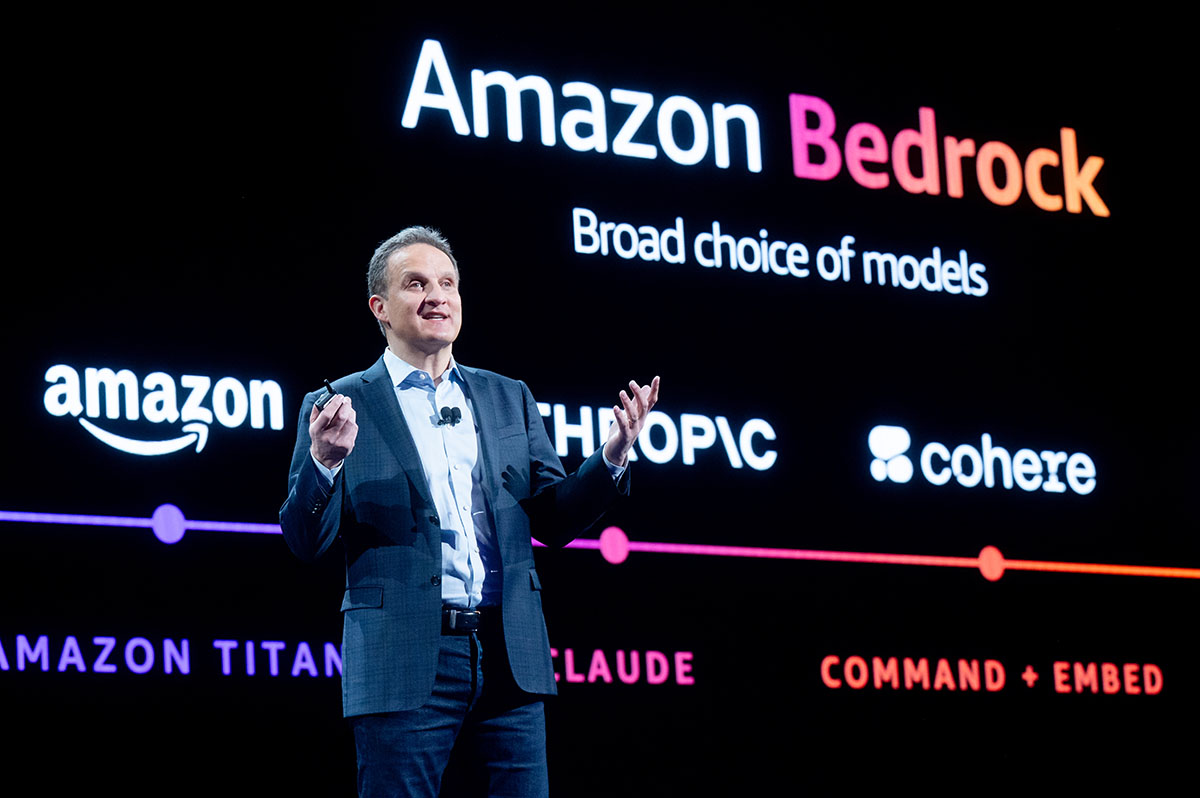

Medan ett antal kunder kommer att bygga sina egna LLM:er och andra FM:er, eller utveckla valfritt antal av de allmänt tillgängliga alternativen, kommer många inte att vilja spendera resurser och tid för att göra detta. För dem erbjuder mittskiktet av stapeln dessa modeller som en tjänst. Vår lösning här, Amazonas berggrund, låter kunderna välja bland branschledande modeller från Anthropic, Stability AI, Meta, Cohere, AI21 och Amazon, anpassa dem med sina egna data och utnyttja samma ledande säkerhet, åtkomstkontroller och funktioner som de är vana vid i AWS – allt genom en hanterad tjänst. Vi gjorde Amazon Bedrock allmänt tillgängligt i slutet av september, och kundresponsen har varit överväldigande positiv. Kunder från hela världen och från praktiskt taget alla branscher är glada över att använda Amazon Bedrock. adidas gör det möjligt för utvecklare att få snabba svar på allt från ”att komma igång”-information till djupare tekniska frågor. Booking.com har för avsikt att använda generativ AI för att skriva upp skräddarsydda resrekommendationer för varje kund. Bridgewater Associates utvecklar en LLM-driven investeringsanalytikerassistent för att hjälpa till att generera diagram, beräkna finansiella indikatorer och sammanfatta resultat. Carrier gör mer exakta energianalyser och insikter tillgängliga för kunderna så att de minskar energiförbrukningen och minskar koldioxidutsläppen. Clariant ger sina teammedlemmar en intern generativ AI-chatbot för att påskynda FoU-processer, stödja säljteam med mötesförberedelser och automatisera kundmail. GoDaddy hjälper kunder att enkelt skapa sina företag online genom att använda generativ AI för att bygga sina webbplatser, hitta leverantörer, få kontakt med kunder och mer. Lexis Nexis Legal & Professional förvandlar det juridiska arbetet för advokater och ökar deras produktivitet med Lexis+ AI-konversationssökning, sammanfattning och dokumentutarbetande och analysfunktioner. Nasdaq hjälper till att automatisera utredningsarbetsflöden kring misstänkta transaktioner och stärka deras antifinansiell brottslighet och övervakningskapacitet. Alla dessa – och många fler – olika generativa AI-applikationer körs på AWS.

Vi är exalterade över momentumet för Amazon Bedrock, men det är fortfarande tidiga dagar. Vad vi har sett när vi har arbetat med kunder är att alla rör sig snabbt, men utvecklingen av generativ AI fortsätter i snabb takt med nya alternativ och innovationer som sker praktiskt taget dagligen. Kunder upptäcker att det finns olika modeller som fungerar bättre för olika användningsfall eller för olika uppsättningar av data. Vissa modeller är bra för att sammanfatta, andra är bra för resonemang och integration, och andra har riktigt bra språkstöd. Och så finns det bildgenerering, sökanvändningsfall och mer – allt kommer från både proprietära modeller och från modeller som är offentligt tillgängliga för alla. Och i tider när det finns så mycket som är okänt, är förmågan att anpassa sig utan tvekan det mest värdefulla verktyget av alla. Det kommer inte att finnas en modell som styr dem alla. Och absolut inte bara ett teknikföretag som tillhandahåller de modeller som alla använder. Kunderna måste prova olika modeller. De måste kunna växla mellan dem eller kombinera dem inom samma användningsfall. Detta innebär att de behöver ett verkligt val av modellleverantörer (vilket händelserna under de senaste 10 dagarna har gjort ännu tydligare). Det är därför vi uppfann Amazon Bedrock, varför det resonerar så djupt hos kunderna, och varför vi fortsätter att förnya och iterera snabbt för att göra det lika enkelt att bygga med (och flytta mellan) en rad modeller som ett API-anrop, använda de senaste teknikerna för modellanpassning i händerna på alla utvecklare, och hålla kunderna säkra och deras data privat. Vi är glada över att introducera flera nya funktioner som kommer att göra det ännu enklare för kunder att bygga och skala generativa AI-applikationer:

- Utökat modellval med Anthropic Claude 2.1, Meta Llama 2 70B och tillägg till Amazon Titan-familjen. I dessa tidiga dagar lär kunderna fortfarande och experimenterar med olika modeller för att avgöra vilka de vill använda för olika ändamål. De vill enkelt kunna prova de senaste modellerna, och även testa för att se vilka möjligheter och funktioner som ger dem de bästa resultaten och kostnadsegenskaperna för deras användningsfall. Med Amazon Bedrock är kunderna bara ett API-anrop från en ny modell. Några av de mest imponerande resultaten som kunder har upplevt de senaste månaderna är från LLM som Anthropics Claude-modell, som utmärker sig för ett brett utbud av uppgifter från sofistikerad dialog och innehållsgenerering till komplexa resonemang samtidigt som en hög grad av tillförlitlighet och förutsägbarhet bibehålls. Kunder rapporterar att Claude är mycket mindre benägen att producera skadliga utdata, lättare att konversera med och mer styrbar jämfört med andra FM:er, så utvecklare kan få sin önskade produktion med mindre ansträngning. Anthropics toppmoderna modell, Claude 2, får poäng över den 90:e percentilen på GRE:s läs- och skrivprov, och på liknande sätt på kvantitativa resonemang. Och nu är den nyligen släppta modellen Claude 2.1 tillgänglig i Amazon Bedrock. Claude 2.1 levererar nyckelfunktioner för företag som ett branschledande 200K token-kontextfönster (2x kontexten för Claude 2.0), minskade hallucinationsfrekvenser och betydande förbättringar i noggrannhet, även vid mycket långa kontextlängder. Claude 2.1 innehåller också förbättrade systemuppmaningar – som är modellinstruktioner som ger en bättre upplevelse för slutanvändare – samtidigt som kostnaden för uppmaningar och slutföranden minskar med 25 %.

För ett växande antal kunder som vill använda en hanterad version av Metas allmänt tillgängliga Llama 2-modell erbjuder Amazon Bedrock Llama 2 13B, och vi lägger till Llama 2 70B. Llama 2 70B är lämplig för storskaliga uppgifter som språkmodellering, textgenerering och dialogsystem. De allmänt tillgängliga Llama-modellerna har laddats ner mer än 30 miljoner gånger, och kunderna älskar att Amazon Bedrock erbjuder dem som en del av en hanterad tjänst där de inte behöver oroa sig för infrastruktur eller har djup ML-expertis i sina team. Dessutom, för bildgenerering, erbjuder Stability AI en uppsättning populära text-till-bild-modeller. Stable Diffusion XL 1.0 (SDXL 1.0) är den mest avancerade av dessa, och den är nu allmänt tillgänglig i Amazon Bedrock. Den senaste utgåvan av denna populära bildmodell har ökad noggrannhet, bättre fotorealism och högre upplösning.

Kunder använder också Amazon Titan modeller, som är skapade och förutbildade av AWS för att erbjuda kraftfulla funktioner med stor ekonomi för en mängd olika användningsfall. Amazon har 25 års meritlista inom ML och AI – teknik som vi använder i våra verksamheter – och vi har lärt oss mycket om att bygga och distribuera modeller. Vi har noga valt hur vi tränar våra modeller och vilken data vi använder för att göra det. Vi håller kunderna skadeslösa mot påståenden om att våra modeller eller deras produkter gör intrång i någons upphovsrätt. Vi introducerade våra första Titan-modeller i april i år. Titan Text Lite– nu allmänt tillgänglig— är en kortfattad, kostnadseffektiv modell för användningsfall som chatbots, textsammanfattningar eller copywriting, och den är också övertygande att finjustera. Titan Text Express – även nu allmänt tillgänglig—är mer expansiv och kan användas för ett bredare utbud av textbaserade uppgifter, såsom öppen textgenerering och konversationschatt. Vi erbjuder dessa textmodellalternativ för att ge kunderna möjlighet att optimera för noggrannhet, prestanda och kostnad beroende på deras användningsfall och affärskrav. Kunder som Nexxiot, PGA Tour och Ryanair använder våra två Titan Text-modeller. Vi har också en inbäddningsmodell, Titan Text Embeddings, för sökanvändningsfall och personalisering. Kunder som Nasdaq ser fantastiska resultat genom att använda Titan Text Embeddings för att förbättra förmågan för Nasdaq IR Insight att generera insikter från 9,000 XNUMX+ globala företags dokument för hållbarhets-, juridik- och redovisningsteam. Och vi kommer att fortsätta att lägga till fler modeller till Titan-familjen med tiden. Vi introducerar en ny inbäddningsmodell, Titan Multimodal Embeddings, för att driva multimodala sökningar och rekommendationer för användare som använder bilder och text (eller en kombination av båda) som input. Och det är vi introducerar en ny text-till-bild-modell, Amazon Titan Image Generator. Med Titan Image Generator kan kunder över branscher som reklam, e-handel, media och underhållning använda textinmatning för att skapa realistiska bilder av studiokvalitet i stora volymer och till låg kostnad. Vi är exalterade över hur kunderna reagerar på Titan Models, och du kan förvänta dig att vi kommer att fortsätta att förnya oss här.

- Nya möjligheter att anpassa din generativa AI-applikation på ett säkert sätt med din egen data: En av de viktigaste funktionerna hos Amazon Bedrock är hur lätt det är att anpassa en modell. Det här blir verkligen spännande för kunderna eftersom det är där generativ AI möter deras kärnsärskiljare – deras data. Det är dock väldigt viktigt att deras data förblir säker, att de har kontroll över den längs vägen och att modellförbättringar är privata för dem. Det finns några sätt att göra detta på, och Amazon Bedrock erbjuder det bredaste urvalet av anpassningsalternativ över flera modeller). Den första är finjustering. Det är enkelt att finjustera en modell i Amazon Bedrock. Du väljer helt enkelt modellen och Amazon Bedrock gör en kopia av den. Sedan pekar du på några märkta exempel (t.ex. en serie bra fråga-svar-par) som du lagrar i Amazon Simple Storage Service (Amazon S3), och Amazon Bedrock "tränar stegvis" (förstärker den kopierade modellen med den nya informationen) på dessa exempel, och resultatet är en privat, mer exakt finjusterad modell som ger mer relevanta, anpassade svar. Vi är glada att kunna meddela att finjustering är allmänt tillgänglig för Cohere Command, Meta Llama 2, Amazon Titan Text (Lite och Express), Amazon Titan Multimodal Embeddings och i förhandsvisning för Amazon Titan Image Generator. Och genom vårt samarbete med Anthropic kommer vi snart att ge AWS-kunder tidig tillgång till unika funktioner för modellanpassning och finjustering av dess toppmoderna modell Claude.

En andra teknik för att anpassa LLM:er och andra FM:er för ditt företag är retrieval augmented generation (RAG), som låter dig anpassa en modells svar genom att utöka dina meddelanden med data från flera källor, inklusive dokumentförråd, databaser och API:er. I september introducerade vi en RAG-funktion, Knowledge Bases for Amazon Bedrock, som säkert kopplar modeller till dina proprietära datakällor för att komplettera dina meddelanden med mer information så att dina applikationer ger mer relevanta, kontextuella och korrekta svar. kunskapsbaser är nu allmänt tillgänglig med ett API som utför hela RAG-arbetsflödet från att hämta text som behövs för att utöka en prompt, till att skicka prompten till modellen, till att returnera svaret. Knowledge Bases stöder databaser med vektorfunktioner som lagrar numeriska representationer av dina data (inbäddningar) som modeller använder för att komma åt dessa data för RAG, inklusive Amazon OpenSearch Service och andra populära databaser som Pinecone och Redis Enterprise Cloud (Amazon Aurora och MongoDB vektorstöd kommer snart).

Det tredje sättet du kan anpassa modeller i Amazon Bedrock är med fortsatt förträning. Med denna metod bygger modellen på sin ursprungliga förutbildning för allmän språkförståelse för att lära sig domänspecifikt språk och terminologi. Detta tillvägagångssätt är för kunder som har stora mängder omärkt, domänspecifik information och som vill göra det möjligt för sina LLM:er att förstå språket, fraserna, förkortningarna, begreppen, definitionerna och jargongen som är unika för deras värld (och verksamhet). Till skillnad från finjustering, som tar en ganska liten mängd data, utförs fortsatt förträning på stora datamängder (t.ex. tusentals textdokument). Nu finns förträningsfunktioner tillgängliga i Amazon Bedrock för Titan Text Lite och Titan Text Express.

- Allmän tillgänglighet av Agenter för Amazon Bedrock att hjälpa till att utföra flerstegsuppgifter med hjälp av system, datakällor och företagets kunskap. LLM:er är bra på att föra konversationer och skapa innehåll, men kunderna vill att deras applikationer ska kunna göra det do ännu mer – som att vidta åtgärder, lösa problem och interagera med en rad system för att utföra flerstegsuppgifter som att boka resor, lämna in försäkringsanspråk eller beställa reservdelar. Och Amazon Bedrock kan hjälpa till med denna utmaning. Med agenter väljer utvecklare en modell, skriver några grundläggande instruktioner som "du är en glad kundtjänstagent" och "kontrollera produktens tillgänglighet i lagersystemet", pekar den valda modellen till rätt datakällor och företagssystem (t.ex. CRM) eller ERP-applikationer), och skriv några AWS Lambda-funktioner för att köra API:erna (t.ex. kontrollera tillgängligheten för en artikel i ERP-inventeringen). Amazon Bedrock analyserar automatiskt begäran och bryter ner den i en logisk sekvens med hjälp av den valda modellens resonemangsmöjligheter för att bestämma vilken information som behövs, vilka API:er som ska anropas och när de ska anropas för att slutföra ett steg eller lösa en uppgift. Nu allmänt tillgängliga kan agenter planera och utföra de flesta affärsuppgifter – från att svara på kundfrågor om din produkttillgänglighet till att ta deras beställningar – och utvecklare behöver inte vara bekanta med maskininlärning, ingenjörsuppmaningar, utbilda modeller eller manuellt ansluta system. Och Bedrock gör allt detta säkert och privat, och kunder som Druva och Athene använder dem redan för att förbättra noggrannheten och hastigheten i utvecklingen av deras generativa AI-applikationer.

- Införande Skyddsräcken för Amazon Bedrock så att du kan tillämpa skyddsåtgärder baserat på dina användningsfallskrav och ansvarsfulla AI-policyer. Kunder vill vara säkra på att interaktioner med deras AI-applikationer är säkra, undvika giftigt eller stötande språk, förbli relevanta för sin verksamhet och anpassa sig till deras ansvarsfulla AI-policyer. Med skyddsräcken kan kunderna ange ämnen som ska undvikas, och Amazon Bedrock kommer endast att förse användare med godkända svar på frågor som faller inom dessa begränsade kategorier. Till exempel kan en nätbanksapplikation ställas in för att undvika investeringsrådgivning och ta bort olämpligt innehåll (som hatretorik och våld). I början av 2024 kommer kunder också att kunna redigera personlig identifierbar information (PII) i modellsvar. Till exempel, efter att en kund interagerar med en callcenteragent sammanfattas kundtjänstkonversationen ofta för journalföring, och skyddsräcken kan ta bort PII från dessa sammanfattningar. Guardrails kan användas över modeller i Amazon Bedrock (inklusive finjusterade modeller) och med Agents for Amazon Bedrock så att kunderna kan ge en konsekvent skyddsnivå för alla sina generativa AI-applikationer.

Högsta lagret: Fortsatt innovation gör generativ AI tillgänglig för fler användare

I det översta lagret av stacken finns applikationer som utnyttjar LLM:er och andra FM:er så att du kan dra nytta av generativ AI på jobbet. Ett område där generativ AI redan förändrar spelet är kodning. Förra året introducerade vi Amazon CodeWhisperer, som hjälper dig att bygga applikationer snabbare och säkrare genom att generera kodförslag och rekommendationer i nästan realtid. Kunder som Accenture, Boeing, Bundesliga, The Cigna Group, Kone och Warner Music Group använder CodeWhisperer för att öka utvecklarnas produktivitet – och Accenture möjliggör för upp till 50,000 XNUMX av sina mjukvaruutvecklare och IT-proffs med Amazon CodeWhisperer. Vi vill att så många utvecklare som möjligt ska kunna få produktivitetsfördelarna med generativ AI, varför CodeWhisperer erbjuder rekommendationer gratis till alla individer.

Men även om AI-kodningsverktyg gör mycket för att göra utvecklarnas liv enklare, begränsas deras produktivitetsfördelar av deras bristande kunskap om interna kodbaser, interna API:er, bibliotek, paket och klasser. Ett sätt att tänka på detta är att om du anställer en ny utvecklare, även om de är i världsklass, kommer de inte att vara så produktiva på ditt företag förrän de förstår dina bästa praxis och kod. Dagens AI-drivna kodningsverktyg är som den nyanställda utvecklaren. För att hjälpa till med detta förhandsgranskade vi nyligen en ny anpassningsförmåga i Amazon CodeWhisperer som säkert utnyttjar en kunds interna kodbas för att ge mer relevanta och användbara kodrekommendationer. Med denna förmåga är CodeWhisperer expert på ditt kod och ger rekommendationer som är mer relevanta för att spara ännu mer tid. I en studie som vi gjorde med Persistent, ett globalt företag inom digital teknik och företagsmodernisering, fann vi att anpassningar hjälper utvecklare att slutföra uppgifter upp till 28 % snabbare än med CodeWhisperers allmänna möjligheter. Nu kan en utvecklare på ett sjukvårdsteknikföretag be CodeWhisperer att "importera MRI-bilder associerade med kund-ID och köra dem genom bildklassificeraren" för att upptäcka anomalier. Eftersom CodeWhisperer har tillgång till kodbasen kan den ge mycket mer relevanta förslag som inkluderar importplatser för MRI-bilder och kund-ID. CodeWhisperer håller anpassningar helt privata, och den underliggande FM använder dem inte för utbildning, vilket skyddar kundernas värdefulla immateriella rättigheter. AWS är den enda större molnleverantören som erbjuder en kapacitet som denna till alla.

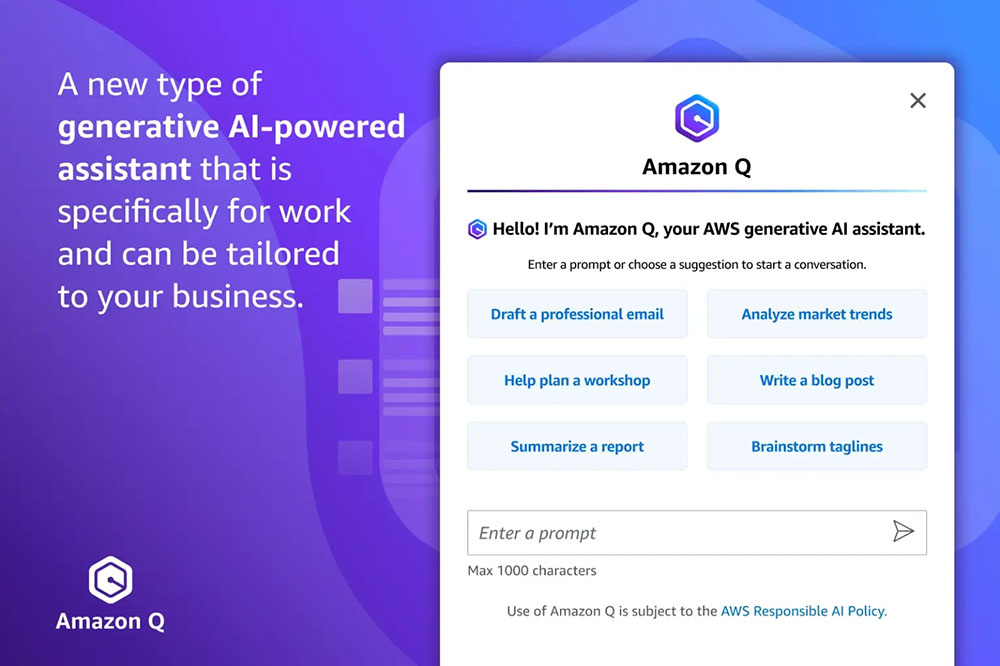

Införande Amazon Q, den generativa AI-drivna assistenten skräddarsydd för jobbet

Utvecklare är verkligen inte de enda som använder generativ AI – miljontals människor använder generativa AI-chattapplikationer. Vad tidiga leverantörer har gjort i det här utrymmet är spännande och supernyttigt för konsumenter, men på många sätt "fungerar" de inte riktigt på jobbet. Deras allmänna kunskaper och förmågor är fantastiska, men de känner inte till ditt företag, din data, dina kunder, din verksamhet eller ditt företag. Det begränsar hur mycket de kan hjälpa dig. De vet inte heller mycket om din roll – vilket arbete du gör, vem du arbetar med, vilken information du använder och vad du har tillgång till. Dessa begränsningar är förståeliga eftersom dessa assistenter inte har tillgång till ditt företags privata information, och de har inte utformats för att uppfylla de datasekretess- och säkerhetskrav som företag behöver för att ge dem denna åtkomst. Det är svårt att sätta på säkerheten i efterhand och förvänta sig att den ska fungera bra. Vi tror att vi har ett bättre sätt som gör att varje person i varje organisation kan använda generativ AI på ett säkert sätt i sitt dagliga arbete.

We är glada att presentera Amazon Q, en ny typ av generativ AI-driven assistent som är specifikt för arbete och kan skräddarsys för ditt företag. Q kan hjälpa dig att få snabba, relevanta svar på angelägna frågor, lösa problem, generera innehåll och vidta åtgärder med hjälp av data och expertis som finns i ditt företags informationsarkiv, kod och företagssystem. När du chattar med Amazon Q ger det omedelbar, relevant information och råd för att effektivisera uppgifter, snabba på beslutsfattande och hjälpa till att väcka kreativitet och innovation på jobbet. Vi har byggt Amazon Q för att vara säker och privat, och den kan förstå och respektera dina befintliga identiteter, roller och behörigheter och använda denna information för att anpassa sin interaktion. Om en användare inte har behörighet att komma åt viss data utan Q, kan de inte heller komma åt den med Q. Vi har designat Amazon Q för att möta stränga företagskunders krav från dag ett – inget av deras innehåll används för att förbättra de underliggande modellerna.

Amazon Q är din expertassistent för att bygga på AWS: Vi har utbildat Amazon Q på 17 års AWS-kunskap och erfarenhet så att det kan förändra hur du bygger, distribuerar och använder applikationer och arbetsbelastningar på AWS. Amazon Q har ett chattgränssnitt i AWS Management Console och dokumentation, din IDE (via CodeWhisperer) och dina teamchattrum på Slack eller andra chattappar. Amazon Q kan hjälpa dig att utforska nya AWS-funktioner, komma igång snabbare, lära dig obekanta tekniker, arkitektlösningar, felsöka, uppgradera och mycket mer — det är expert på välarkitekta AWS-mönster, bästa praxis, dokumentation och lösningsimplementeringar. Här är några exempel på vad du kan göra med din nya AWS-expertassistent:

- Få tydliga svar och vägledning om AWS-funktioner, tjänster och lösningar: Be Amazon Q att "Berätta om agenter för Amazon Bedrock" och Q kommer att ge dig en beskrivning av funktionen plus länkar till relevant material. Du kan också ställa praktiskt taget alla frågor till Amazon Q om hur en AWS-tjänst fungerar (t.ex. "Vilka är skalningsgränserna på en DynamoDB-tabell?" "Vad är Redshift Managed Storage?"), eller hur man bäst skapar ett antal lösningar ( "Vilka är de bästa metoderna för att bygga evenemangsdrivna arkitekturer?"). Och Amazon Q kommer att samla kortfattade svar och alltid citera (och länka till) dess källor.

- Välj den bästa AWS-tjänsten för ditt användningsfall och kom igång snabbt: Fråga Amazon F: "Vilka är sätten att bygga en webbapp på AWS? ” och det kommer att ge en lista över potentiella tjänster som AWS förstärka, AWS Lambdaoch Amazon EC2 med fördelarna med var och en. Därifrån kan du begränsa alternativen genom att hjälpa Q att förstå dina krav, preferenser och begränsningar (t.ex. "Vilken av dessa skulle vara bäst om jag vill använda behållare?" eller "Ska jag använda en relationsdatabas eller en icke-relationell databas? ”). Avsluta med "Hur kommer jag igång?" och Amazon Q kommer att beskriva några grundläggande steg och peka dig mot ytterligare resurser.

- Optimera dina beräkningsresurser: Amazon Q kan hjälpa dig att välja Amazon EC2-instanser. Om du ber den att "Hjälp mig att hitta rätt EC2-instans för att distribuera en videokodningsarbetsbelastning för min spelapp med högsta prestanda", kommer Q att få dig en lista över instansfamiljer med skäl för varje förslag. Och du kan ställa hur många uppföljningsfrågor som helst för att hitta det bästa valet för din arbetsbörda.

- Få hjälp med att felsöka, testa och optimera din kod: Om du stöter på ett fel när du kodar i din IDE kan du be Amazon Q att hjälpa till genom att säga: "Min kod har ett IO-fel, kan du fixa det?" och Q genererar koden åt dig. Om du gillar förslaget kan du be Amazon Q att lägga till korrigeringen i din applikation. Eftersom Amazon Q finns i din IDE förstår den koden du arbetar med och vet var den ska infoga fixen. Amazon Q kan också skapa enhetstester (”Skriv enhetstester för den valda funktionen”) som den kan infoga i din kod och du kan köra. Slutligen kan Amazon Q berätta hur du kan optimera din kod för högre prestanda. Be Q att "Optimera min valda DynamoDB-fråga", så kommer den att använda sin förståelse av din kod för att ge ett naturligt språkförslag på vad som ska fixas tillsammans med den medföljande koden som du kan implementera med ett klick.

- Diagnostisera och felsök problem: Om du stöter på problem i AWS Management Console, som EC2-behörighetsfel eller Amazon S3-konfigurationsfel, kan du helt enkelt trycka på knappen "Felsök med Amazon Q" och den kommer att använda sin förståelse av feltypen och tjänsten där felet finns för att ge dig förslag på korrigering. Du kan till och med be Amazon Q att felsöka ditt nätverk (t.ex. "Varför kan jag inte ansluta till min EC2-instans med SSH?") och Q kommer att analysera din end-to-end-konfiguration och ge en diagnos (t.ex. "Denna instans" verkar vara i ett privat undernät, så allmän tillgänglighet kan behöva upprättas”).

- Sätt upp en ny kodbas på nolltid: När du chattar med Amazon Q i din IDE kombinerar den sin expertis i att bygga mjukvara med en förståelse för din kod – en kraftfull parning! Tidigare, om du tog över ett projekt från någon annan, eller om du var ny i teamet, kanske du måste spendera timmar på att manuellt granska koden och dokumentationen för att förstå hur det fungerar och vad det gör. Nu, eftersom Amazon Q förstår koden i din IDE, kan du helt enkelt be Amazon Q att förklara koden ("Ge mig en beskrivning av vad den här applikationen gör och hur den fungerar") och Q kommer att ge dig detaljer som vilka tjänster som kodanvändning och vad olika funktioner gör (t.ex. Q kan svara med något i stil med, "Denna applikation bygger ett grundläggande supportbiljettsystem med Python Flask och AWS Lambda" och fortsätter med att beskriva var och en av dess kärnfunktioner, hur de implementeras, och mycket mer).

- Rensa din funktionseftersläpning snabbare: Du kan till och med be Amazon Q att guida dig genom och automatisera mycket av hela processen för att lägga till en funktion till din applikation i Amazon CodeCatalyst, vår enhetliga programvaruutvecklingstjänst för team. För att göra detta tilldelar du bara Q en eftersläpningsuppgift från din problemlista – precis som du skulle göra en lagkamrat – och Q genererar en steg-för-steg-plan för hur den kommer att bygga och implementera funktionen. När du har godkänt planen kommer Q att skriva koden och presentera de föreslagna ändringarna för dig som en kodgranskning. Du kan begära omarbetning (om nödvändigt), godkänna och/eller distribuera!

- Uppgradera din kod på en bråkdel av tiden: De flesta utvecklare spenderar faktiskt bara en bråkdel av sin tid på att skriva ny kod och bygga nya applikationer. De spenderar mycket mer av sina cykler på smärtsamma, trasiga områden som underhåll och uppgraderingar. Ta språkversionsuppgraderingar. Ett stort antal kunder fortsätter att använda äldre versioner av Java eftersom det kommer att ta månader – till och med år – och tusentals timmars utvecklartid att uppgradera. Att skjuta upp detta har verkliga kostnader och risker – du går miste om prestandaförbättringar och är sårbar för säkerhetsproblem. Vi tror att Amazon Q kan vara en spelväxlare här, och är entusiastiska över Amazon Q Code Transformation, en funktion som kan ta bort mycket av dessa tunga lyft och minska tiden det tar att uppgradera applikationer från dagar till minuter. Du öppnar bara koden du vill uppdatera i din IDE och ber Amazon Q att "/omvandla" din kod. Amazon Q kommer att analysera hela källkoden för applikationen, generera koden på målspråket och versionen och utföra tester, vilket hjälper dig att inse säkerhets- och prestandaförbättringarna för de senaste språkversionerna. Nyligen använde ett mycket litet team av Amazon-utvecklare Amazon Q Code Transformation för att uppgradera 1,000 8 produktionsapplikationer från Java 17 till Java 10 på bara två dagar. Den genomsnittliga tiden per applicering var mindre än 8 minuter. Idag utför Amazon Q Code Transformation Java-språkuppgraderingar från Java 11 eller Java 17 till Java XNUMX. Härnäst (och snart) kommer möjligheten att transformera .NET Framework till plattformsoberoende .NET (med ännu fler transformationer att följa i framtiden) .

Amazon Q är din affärsexpert: Du kan koppla Amazon Q till din affärsdata, information och system så att den kan syntetisera allt och ge skräddarsydd hjälp för att hjälpa människor att lösa problem, generera innehåll och vidta åtgärder som är relevanta för ditt företag. Det är enkelt att ta med Amazon Q till ditt företag. Den har 40+ inbyggda kontakter till populära företagssystem som Amazon S3, Microsoft 365, Salesforce, ServiceNow, Slack, Atlassian, Gmail, Google Drive och Zendesk. Den kan också ansluta till ditt interna intranät, wikis och köra böcker, och med Amazon Q SDK kan du bygga en anslutning till vilken interna applikation du vill. Peka på Amazon Q på dessa förråd, så kommer det att "rampa upp" på ditt företag, fånga och förstå den semantiska informationen som gör ditt företag unikt. Sedan får du din egen vänliga och enkla Amazon Q-webbapplikation så att anställda i hela ditt företag kan interagera med konversationsgränssnittet. Amazon Q ansluter också till din identitetsleverantör för att förstå en användare, deras roll och vilka system de har tillåtelse att komma åt så att användare kan ställa detaljerade, nyanserade frågor och få skräddarsydda resultat som endast innehåller information som de har behörighet att se. Amazon Q genererar svar och insikter som är korrekta och trogna materialet och kunskapen som du tillhandahåller det, och du kan begränsa känsliga ämnen, blockera nyckelord eller filtrera bort olämpliga frågor och svar. Här är några exempel på vad du kan göra med ditt företags nya expertassistent:

- Få skarpa, superrelevanta svar baserat på din affärsdata och information: Anställda kan fråga Amazon Q om allt de tidigare behövt leta efter i alla typer av källor. Fråga "Vilka är de senaste riktlinjerna för logotypanvändning?" eller "Hur ansöker jag om ett företagskreditkort?", så kommer Amazon Q att syntetisera allt relevant innehåll som den hittar och återkomma med snabba svar plus länkar till relevant källor (t.ex. varumärkesportaler och logotyper, företagets T&E-policyer och kortapplikationer).

- Effektivisera den dagliga kommunikationen: Fråga bara så kan Amazon Q generera innehåll ("Skapa ett blogginlägg och tre rubriker i sociala medier som tillkännager produkten som beskrivs i denna dokumentation"), skapa sammanfattningar ("Skriv en sammanfattning av vårt mötesavskrift med en punktlista med åtgärder" ), tillhandahålla e-postuppdateringar ("Skapa ett e-postmeddelande som lyfter fram våra Q3-utbildningsprogram för kunder i Indien") och hjälp strukturera möten ("Skapa en mötesagenda för att prata om den senaste kundnöjdhetsrapporten").

- Slutföra uppgifter: Amazon Q kan hjälpa till att slutföra vissa uppgifter, vilket minskar den tid anställda lägger på repetitivt arbete som att lämna in biljetter. Be Amazon Q att "Sammanfatta kundfeedback om det nya priserbjudandet i Slack" och begär sedan att Q tar den informationen och öppnar en biljett i Jira för att uppdatera marknadsföringsteamet. Du kan be Q att "Sammanfatta detta samtalsutskrift" och sedan "Öppna ett nytt ärende för kund A i Salesforce." Amazon Q stöder andra populära verktyg för arbetsautomatisering som Zendesk och Service Now.

Amazon Q finns i Amazon QuickSight: Med Amazon Q i QuickSight, AWS:s business intelligence-tjänst, kan användare ställa frågor till sina instrumentpaneler som "Varför ökade antalet beställningar förra månaden?" och få visualiseringar och förklaringar av de faktorer som påverkade ökningen. Och analytiker kan använda Amazon Q för att minska tiden det tar dem att bygga instrumentpaneler från dagar till minuter med en enkel uppmaning som "Visa mig försäljning per region för månad som ett staplat stapeldiagram." Q kommer direkt tillbaka med det diagrammet och du kan enkelt lägga till det i en instrumentpanel eller chatta ytterligare med Q för att förfina visualiseringen (t.ex. "Ändra stapeldiagrammet till ett Sankey-diagram" eller "Visa länder istället för regioner"). Amazon Q i QuickSight gör det också lättare att använda befintliga instrumentpaneler för att informera affärsintressenter, destillera viktiga insikter och förenkla beslutsfattande med hjälp av databerättelser. Användare kan till exempel uppmana Amazon Q att "Skapa en berättelse om hur verksamheten har förändrats under den senaste månaden för en affärsrecension med seniort ledarskap", och på några sekunder levererar Amazon Q en datadriven berättelse som är visuellt övertygande och är helt anpassningsbar. Dessa berättelser kan delas på ett säkert sätt i hela organisationen för att hjälpa till att anpassa intressenter och driva bättre beslut.

Amazon Q finns i Amazon Connect: I Amazon Connect, vår kontaktcentertjänst, hjälper Amazon Q dina kundtjänstagenter att ge bättre kundservice. Amazon Q utnyttjar de kunskapsförråd som dina agenter vanligtvis använder för att få information till kunder, och sedan kan agenter chatta med Amazon Q direkt i Connect för att få svar som hjälper dem att svara snabbare på kundförfrågningar utan att behöva söka igenom dokumentationen själva. Och även om det är bra att chatta med Amazon Q för supersnabba svar, finns det inget som heter för snabbt inom kundtjänst. Det är därför Amazon Q In Connect förvandlar en live kundkonversation med en agent till en uppmaning och ger automatiskt agenten möjliga svar, föreslagna åtgärder och länkar till resurser. Till exempel kan Amazon Q upptäcka att en kund kontaktar ett hyrbilsföretag för att ändra sin reservation, generera ett svar för agenten för att snabbt kommunicera hur företagets policy för förändringsavgifter gäller och vägleda agenten genom stegen de behöver för att uppdatera bokning.

Amazon Q är i AWS Supply Chain (kommer snart): I AWS Supply Chain, vår tjänst för insikter i försörjningskedjan, hjälper Amazon Q utbud- och efterfrågeplanerare, lagerförvaltare och handelspartner att optimera sin försörjningskedja genom att sammanfatta och lyfta fram potentiella lager- eller överlagerrisker och visualisera scenarier för att lösa problemet. Användare kan ställa Amazon Q "vad", "varför" och "vad om"-frågor om deras leveranskedjasdata och chatta genom komplexa scenarier och kompromisserna mellan olika leveranskedjabeslut. Till exempel kan en kund fråga sig: "Vad är det som orsakar förseningen i mina försändelser och hur kan jag påskynda det?" till vilket Amazon Q kan svara, "90 % av dina beställningar är på östkusten, och en stor storm i sydost orsakar en 24-timmars försening. Om du skickar till hamnen i New York istället för Miami, kommer du att påskynda leveranser och minska kostnaderna med 50 %.”

Våra kunder anammar generativ AI snabbt – de tränar banbrytande modeller på AWS, de utvecklar generativa AI-applikationer i rekordfart med Amazon Bedrock, och de distribuerar spelförändrande applikationer i sina organisationer som Amazon Q. Med våra senaste tillkännagivanden, AWS ger kunderna ännu mer prestanda, valmöjligheter och innovation till varje lager i stacken. Den kombinerade effekten av alla funktioner vi levererar på re:Invent markerar en viktig milstolpe mot att nå ett spännande och meningsfullt mål: Vi gör generativ AI tillgänglig för kunder av alla storlekar och tekniska förmågor så att de kan återuppfinna och omvandla det är möjligt.

Resurser

Om författaren

Swami Sivasubramanian är vice vd för data- och maskininlärning på AWS. I denna roll övervakar Swami alla AWS-databas-, analys- och AI- och maskininlärningstjänster. Hans teams uppdrag är att hjälpa organisationer att få sin data att fungera med en komplett, end-to-end datalösning för att lagra, komma åt, analysera och visualisera och förutsäga.

Swami Sivasubramanian är vice vd för data- och maskininlärning på AWS. I denna roll övervakar Swami alla AWS-databas-, analys- och AI- och maskininlärningstjänster. Hans teams uppdrag är att hjälpa organisationer att få sin data att fungera med en komplett, end-to-end datalösning för att lagra, komma åt, analysera och visualisera och förutsäga.

- SEO-drivet innehåll och PR-distribution. Bli förstärkt idag.

- PlatoData.Network Vertical Generative Ai. Styrka dig själv. Tillgång här.

- PlatoAiStream. Web3 Intelligence. Kunskap förstärkt. Tillgång här.

- Platoesg. Kol, CleanTech, Energi, Miljö, Sol, Avfallshantering. Tillgång här.

- PlatoHealth. Biotech och kliniska prövningar Intelligence. Tillgång här.

- Källa: https://aws.amazon.com/blogs/machine-learning/welcome-to-a-new-era-of-building-in-the-cloud-with-generative-ai-on-aws/

- : har

- :är

- :inte

- :var

- $UPP

- 000

- 1

- 10

- 100

- 11

- 12

- 17

- 200

- 2019

- 2024

- 25

- 30

- 35%

- 40

- 50

- 500

- 7

- 8

- 9

- a

- förmågor

- förmåga

- Able

- Om oss

- ovan

- accelerera

- accelererad

- acceleratorer

- Accenture

- tillgång

- tillgänglighet

- tillgänglig

- Redovisning

- noggrannhet

- exakt

- förvärva

- tvärs

- Handling

- åtgärder

- aktivt

- faktiskt

- anpassa

- lägga till

- lagt till

- tillsats

- Dessutom

- Annat

- Dessutom

- tillsatser

- Lägger

- Adidas

- Adobe

- Anta

- avancerat

- Vidare

- Fördel

- fördelar

- reklam

- rådgivning

- Efter

- mot

- dagordning

- Recensioner

- medel

- aggregat

- sedan

- AI

- AI och maskininlärning

- AI chatbot

- ai forskning

- AI-powered

- rikta

- Alla

- tillåter

- tillåter

- längs

- redan

- också

- alltid

- amason

- Amazon Code Whisperer

- Amazon EC2

- Amazon OpenSearch Service

- Amazon QuickSight

- Amazon SageMaker

- Amazon Web Services

- mängd

- mängder

- an

- analys

- analytiker

- analytiker

- analytics

- analysera

- analyser

- och

- Meddela

- Meddelanden

- Vi presenterar

- abnormiteter

- svara

- svar

- Antropisk

- vilken som helst

- någon

- något

- api

- API: er

- app

- visas

- Ansökan

- tillämpningar

- Ansök

- uppskatta

- tillvägagångssätt

- godkänna

- godkänd

- appar

- April

- ÄR

- OMRÅDE

- områden

- det kan argumenteras att

- runt

- AS

- be

- Bistånd

- Assistent

- assistenter

- associerad

- associerar

- At

- förstärka

- augmented

- Augments

- aurora

- tillstånd

- automatisera

- automatiserar

- Automat

- automatiskt

- Automation

- fordonsindustrin

- tillgänglighet

- tillgänglig

- genomsnitt

- undvika

- bort

- AWS

- AWS slutledning

- AWS Lambda

- AWS Management Console

- tillbaka

- Banking

- bar

- barriärer

- bas

- baserat

- grundläggande

- BE

- därför att

- blir

- varit

- började

- tro

- Fördelarna

- BÄST

- bästa praxis

- Bättre

- mellan

- Stor

- Miljarder

- miljarder

- Blockera

- Block

- Blogg

- Boeing

- Bult

- bokning

- Booking.com

- Böcker

- båda

- Botten

- gränser

- varumärke

- Ha sönder

- raster

- föra

- Föra

- SLUTRESULTAT

- Byggnad

- bygger

- byggt

- inbyggd

- företag

- business intelligence

- företag

- men

- Knappen

- by

- Ring

- Call center

- KAN

- Kan få

- kapacitet

- kapacitet

- kapabel

- Kapacitet

- Fångande

- bil

- kol

- koldioxidutsläpp

- kortet

- försiktigt

- Vid

- fall

- kategorier

- orsakar

- Centrum

- vissa

- säkerligen

- kedja

- utmanar

- utmaningar

- byta

- ändrats

- Växlare

- Förändringar

- byte

- egenskaper

- Diagram

- Diagram

- chattrum

- chatbot

- chatbots

- chattar

- ta

- chip

- Pommes frites

- val

- Välja

- välja

- valda

- hävdar

- klasser

- Rengöring

- klar

- klick

- cloud

- molninfrastruktur

- kluster

- klustring

- Coast

- koda

- kodbas

- Kodgranskning

- Kodning

- samarbeta

- samverkan

- COM

- kombination

- kombinera

- kombinerad

- kombinerar

- komma

- kommer

- kommande

- Coming Soon....

- kommunicera

- Trygghet i vårdförloppet

- Företag

- företag

- Företagets

- jämfört

- övertygande

- fullborda

- fullständigt

- komplex

- Komplexiteten

- omfattande

- Compute

- Begreppen

- konfiguration

- konfigurering

- gissa

- Kontakta

- anslutna

- anslutning

- Anslutningar

- ansluter

- konsekvent

- Konsol

- begränsningar

- konsumenter

- konsumtion

- kontakta

- kontaktcenter

- Behållare

- innehåll

- Innehållsgenerering

- sammanhang

- kontextuella

- fortsätta

- fortsatte

- fortsätter

- fortsätter

- kontroll

- kontroller

- Konversation

- konversera

- konversationer

- upphovsrätt

- copywriting

- Kärna

- Pris

- kostnadseffektiv

- Kostar

- länder

- Cox

- skapa

- skapas

- kreativitet

- skaparna

- kredit

- kreditkort

- Brott

- CRM

- kund

- kundupplevelse

- Kundnöjdhet

- Kundservice

- Kunder

- anpassningsbar

- anpassning

- skräddarsy

- kundanpassad

- Klipp

- cykler

- dagligen

- instrumentbräda

- instrumentpaneler

- datum

- Förberedelse av data

- dataintegritet

- Datas integritet och säkerhet

- datauppsättningar

- data driven

- Databas

- databaser

- dag

- dag för dag

- Dagar

- Beslutsfattande

- beslut

- djup

- djupt lärande

- djupare

- definitioner

- Examen

- fördröja

- leverera

- Leveranser

- leverera

- levererar

- Efterfrågan

- demokrati

- beroende

- distribuera

- utplacerade

- utplacera

- utplacering

- djup

- beskriva

- beskriven

- beskrivning

- utformade

- önskas

- detaljerad

- detaljer

- upptäcka

- Bestämma

- DEUTSCHE TELECOM

- Utvecklare

- utvecklare

- utveckla

- Utveckling

- diagnos

- dialogruta

- dialog

- DID

- olika

- Diffusion

- digital

- direkt

- distribuera

- distribueras

- distribuerad utbildning

- fördelnings

- do

- dokumentera

- dokumentation

- dokument

- gör

- inte

- gör

- gjort

- inte

- fördubbling

- ner

- driv

- grund

- dubbletter

- varaktighet

- e

- e-handel

- varje

- Tidig

- lättare

- lätt

- öster

- lätt

- Ekonomi

- edition

- effektivt

- effektivitet

- effektivt

- ansträngning

- antingen

- annars

- e

- utsläpp

- anställda

- ge

- ge

- möjliggöra

- möjliggör

- kodning

- änden

- början till slut

- energi

- Energiförbrukning

- ingenjör

- Teknik

- förbättra

- förbättringar

- berikande

- Företag

- företagsklass

- företag

- Underhållning

- Hela

- kuvert

- Era

- ERP

- fel

- fel

- utvärderingar

- Även

- händelser

- NÅGONSIN

- Varje

- alla

- allt

- Utvecklingen

- utvecklas

- exempel

- exempel

- exciterade

- spännande

- exekvera

- verkställande

- befintliga

- expansiv

- förvänta

- påskynda

- dyra

- erfarenhet

- erfaren

- Erfarenheter

- expert

- expertis

- Förklara

- utforska

- uttrycker

- tyg

- Ansikte

- Faktum

- faktorer

- ganska

- trogna

- Höst

- bekant

- familjer

- familj

- SNABB

- snabbare

- defekt

- Leverans

- Funktioner

- avgift

- återkoppling

- få

- Arkivering

- filtrera

- Slutligen

- finansiella

- hitta

- finna

- fynd

- änden

- slut

- Förnamn

- Fast

- flexibel

- fokuserade

- följer

- För

- För konsumenterna

- Framåt

- hittade

- fundament

- fyra

- fraktion

- Ramverk

- ramar

- Fri

- ofta

- vänliga

- från

- funktioner

- ytterligare

- framtida

- lek

- spel-växlare

- Gaming

- Allmänt

- allmänhet

- generera

- genererar

- generera

- generering

- generativ

- Generativ AI

- Generatorn

- skaffa sig

- få

- Ge

- Välgörenhet

- globala digitala

- Go

- Målet

- kommer

- god

- GPU

- GPUs

- stor

- Marken

- banbrytande

- Grupp

- Odling

- vuxen

- vägleda

- styra

- riktlinjer

- hade

- händer

- Happening

- Hård

- hårdvara

- skadliga

- hatar

- Har

- har

- Rubriker

- hälso-och sjukvård

- tung

- tunga lyft

- hjälpa

- hjälpa

- hjälper

- här.

- Hög

- högre

- högsta

- belysa

- höggradigt

- hyra

- hans

- värd

- ÖPPETTIDER

- Hur ser din drömresa ut

- How To

- Men

- HTTPS

- Hundratals

- i

- ID

- identiteter

- Identitet

- ids

- if

- bild

- bilder

- omedelbar

- Inverkan

- genomföra

- implementeringar

- genomföras

- importera

- med Esport

- imponerande

- förbättra

- förbättras

- förbättringar

- in

- innefattar

- innefattar

- Inklusive

- Öka

- ökat

- ökande

- indikatorer

- individer

- industrier

- industrin

- branschledande

- påverkas

- info

- underrätta

- informationen

- Infrastruktur

- förnya

- nyskapande

- Innovation

- innovationer

- innovativa

- ingång

- ingångar

- insikt

- insikter

- exempel

- istället

- Institute

- instruktioner

- försäkring

- integrering

- intellektuella

- immateriella rättigheter

- Intelligens

- avser

- interagera

- interaktioner

- interagerar

- sammankopplade

- Gränssnitt

- inre

- ingripa

- in

- införa

- introducerade

- införa

- uppfann

- lager

- Invest

- undersökande

- investera

- investering

- Investeringar

- involverade

- problem

- IT

- DESS

- japanska

- jargong

- java

- jpg

- bara

- bara en

- Ha kvar

- hålla

- håller

- Nyckel

- Nyckelområden

- nyckelord

- Kit (SDK)

- Vet

- kunskap

- vet

- Labs

- Brist

- språk

- Large

- storskalig

- största

- Efternamn

- Förra året

- Sent

- Latens

- senaste

- lanserades

- lansera

- advokater

- lager

- skikt

- Ledarskap

- ledande

- LÄRA SIG

- lärt

- inlärning

- Adress

- mindre

- Lets

- Nivå

- Hävstång

- hävstångs

- LexisNexis

- LG

- bibliotek

- livscykel

- lyft

- tycka om

- sannolikt

- begränsningar

- Begränsad

- gränser

- rader

- LINK

- länkar

- Lista

- lever

- Bor

- Lama

- LLM

- belägen

- platser

- logisk

- logotyp

- Lång

- långvarig

- Lot

- älskar

- Låg

- lägre

- lägst

- Maskinen

- maskininlärning

- gjord

- bibehålla

- upprätthålla

- underhåll

- större

- göra

- GÖR

- Framställning

- förvaltade

- ledning

- chefer

- manuell

- manuellt arbete

- manuellt

- många

- Marknadsföring

- Materialet

- material

- maximal

- Maj..

- me

- meningsfull

- betyder

- Media

- Möt

- möte

- möten

- möter

- Medlemmar

- bara

- meta

- metod

- Miami

- Microsoft

- Mitten

- kanske

- milstolpe

- minuter

- Fröken

- Mission

- ML

- modell

- modellering

- modeller

- Momentum

- MongoDB

- monitorer

- Månad

- månader

- mer

- mest

- Mest populär

- rörliga

- MRT

- mycket

- multipel

- Musik

- måste

- my

- namn

- smal

- Nasdaq

- Natural

- Nära

- nödvändigt för

- Behöver

- behövs

- behöver

- netto

- nät

- nätverk

- Nya

- New York

- nytt

- Nästa

- Nitro

- Nej

- nu

- antal

- Nvidia

- of

- sänkt

- offensiv

- erbjudanden

- erbjuda

- Erbjudanden

- Ofta

- äldre

- on

- gång

- ONE

- ettor

- nätet

- Internetbank

- endast

- öppet

- driva

- Verksamhet

- Optimera

- optimerad

- optimera

- Tillbehör

- or

- ordrar

- organisation

- organisationer

- ursprungliga

- Övriga

- Övrigt

- vår

- ut

- översikt

- produktion

- utgångar

- över

- Overstock

- överväldigande

- egen

- Fred

- paket

- smärtsamma

- par

- parameter

- parametrar

- del

- partner

- reservdelar till din klassiker

- Tidigare

- mönster

- paus

- Personer

- för

- Utföra

- prestanda

- utfört

- utför

- tillstånd

- behörigheter

- personen

- personalisering

- personifiera

- Personligen

- PGA-turné

- fraser

- Plats

- Planen

- plato

- Platon Data Intelligence

- PlatonData

- plus

- Punkt

- Strategier

- Populära

- positiv

- möjlig

- Inlägg

- potentiell

- kraft

- drivs

- den mäktigaste

- Praktisk

- praktiskt taget

- praxis

- exakt

- förutse

- Förutsägelser

- preferenser

- beredning

- Förbered

- presentera

- VD

- tryck

- trycka

- Förhandsvisning

- tidigare

- pris

- prissättning

- primär

- privatpolicy

- Integritet och säkerhet

- privat

- privat information

- Problem

- problem

- process

- processer

- bearbetning

- producera

- Produkt

- Produktion

- produktiv

- produktivitet

- professionell

- yrkesmän/kvinnor

- Program

- projektet

- prompter

- egenskapen

- proprietary

- skydda

- skydd

- ge

- leverantör

- leverantörer

- ger

- tillhandahålla

- allmän

- publicly

- syfte

- Tryck

- Tryckande

- sätta

- sätta

- Python

- pytorch

- Q3

- kvantitativ

- fråga

- frågor

- Snabbt

- snabbt

- ganska

- R&D

- område

- snabb

- snabbt

- rates

- RE

- Läsning

- verklig

- realtid

- realistisk

- inser

- insåg

- verkligen

- skörda

- skäl

- nyligen

- Rekommendation

- rekommendationer

- post

- minska

- Minskad

- reducerande

- förfina

- region

- frigörs

- relevanta

- tillförlitlighet

- resterna

- ta bort

- bort

- reparation

- repetitiva

- ersättning

- svar

- rapport

- Repository

- begära

- förfrågningar

- Obligatorisk

- Krav

- forskning

- Bokning

- Reserv

- Upplösning

- resonerar

- Resurser

- avseende

- Svara

- reagera

- respons

- svar

- ansvarig

- begränsa

- begränsad

- resultera

- Resultat

- tillbaka

- översyn

- reviewing

- höger

- risker

- Roll

- roller

- Rum

- rutter

- Regel

- Körning

- rinnande

- bana

- offra

- säker

- skyddsåtgärder

- på ett säkert sätt

- sagemaker

- försäljning

- Salesforce

- Samma

- tillfredsställande

- Save

- säger

- Skala

- skalning

- scenarier

- omfattning

- repa

- sDK

- sömlös

- Sök

- Andra

- Andra generationen

- sekunder

- säkra

- säkert

- säkerhet

- se

- se

- sett

- välj

- vald

- Val

- skicka

- senior

- högre ledarskap

- känslig

- September

- Sekvens

- Serier

- Servrar

- service

- Tjänster

- in

- uppsättningar

- flera

- Dela

- delas

- FARTYG

- Kort

- skall

- sida

- signifikant

- Kisel

- Liknande

- Enkelt

- förenkla

- helt enkelt

- eftersom

- SEX

- storlekar

- slak

- Small

- So

- Social hållbarhet

- sociala medier

- Mjukvara

- Programutvecklare

- mjukvaruutveckling

- Utrustning för programvaruutveckling

- lösning

- Lösningar

- LÖSA

- några

- någon

- något

- snart

- sofistikerade

- Källa

- källkod

- Källor

- sydöst

- Utrymme

- Gnista

- specifikt

- tal

- fart

- spendera

- Stabilitet

- stabil

- stapel

- staplade

- intressenter

- igång

- Starta

- Startups

- state-of-the-art

- bo

- Steg

- Steg

- Fortfarande

- förvaring

- lagra

- lagrar

- Upplevelser för livet

- Storm

- Historia

- effektivisera

- Stärka

- stränga

- struktur

- Läsa på

- undernät

- väsentlig

- sådana

- lämplig

- svit

- sammanfatta

- SAMMANFATTNING

- super

- komplettera

- leverantörer

- leverera

- Utbud och efterfrågan

- leveranskedjan

- stödja

- Stöder

- säker

- förvånande

- övervakning

- misstänksam

- Hållbarhet

- Växla

- syntetisera

- system

- System

- bord

- skräddarsydd

- Ta

- tar

- tar

- Diskussion

- Målet

- uppgift

- uppgifter

- grupp

- Gruppmedlemmar

- lag

- Teknisk

- Tekniken

- tekniker

- Tekniken

- Teknologi

- Teknisk innovation

- tala

- tala

- tio

- tiotals

- tensorflow

- terminologi

- testa

- Testning

- tester

- text

- än

- den där

- Smakämnen

- Framtiden

- världen

- deras

- Dem

- sig själva

- sedan

- Där.

- Dessa

- de

- sak

- saker

- tror

- Tredje

- detta

- i år

- de

- tusentals

- tre

- Genom

- hela

- genomströmning

- biljett

- biljetter

- tid

- gånger

- titan

- till

- i dag

- dagens

- tillsammans

- token

- alltför

- tog

- verktyg

- verktyg

- topp

- ämnen

- Tour

- mot

- mot

- spår

- track record

- Handel

- Tåg

- tränad

- Utbildning

- Transaktioner

- Avskrift

- Förvandla

- Transformation

- transformationer

- omvandla

- färdas

- biljoner

- tur

- verkligen

- Litar

- prova

- försöker

- trimma

- vänder

- två

- Typ

- typiskt

- underliggande

- förstå

- förståeligt

- förståelse

- förstår

- obekant

- enhetlig

- unika

- enhet

- till skillnad från

- tills

- Uppdatering

- Uppdateringar

- uppgradera

- uppgraderingar

- us

- Användning

- användning

- användningsfall

- Begagnade

- Användare

- användare

- användningar

- med hjälp av

- Värdefulla

- mängd

- olika

- version

- versioner

- Kontra

- mycket

- via

- vice

- Vice President

- Video

- Våld

- praktiskt taget

- visualisering

- visualisera

- visuellt

- volymer

- Sårbara

- vill

- Warner

- warner musikgrupp

- var

- Våg

- Sätt..

- sätt

- we

- webb

- webbapplikation

- webbservice

- webbsidor

- vecka

- veckor

- välkommen

- VÄL

- ALLBEKANT

- były

- Vad

- Vad är

- när

- om

- som

- medan

- VEM

- varför

- bred

- Brett utbud

- bredare

- kommer

- fönster

- med

- inom

- utan

- Arbete

- arbetade

- arbetsflöden

- arbetssätt

- fungerar

- världen

- världsklass

- oro

- värt

- skulle

- skriva

- skriva kod

- skrivning

- år

- år

- york

- Om er

- Din

- Zendesk

- zephyrnet