- มิถุนายน 30, 2014

- Vasilis Vryniotiso

- . ไม่มีความคิดเห็น

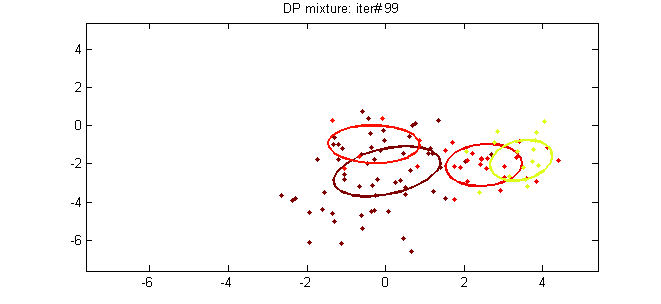

บทความนี้เป็นส่วนที่ห้าของบทช่วยสอนเกี่ยวกับ การทำคลัสเตอร์ด้วย DPMM. ในโพสต์ก่อนหน้านี้ เราได้กล่าวถึงรายละเอียดพื้นฐานทางทฤษฎีของวิธีการ และเราได้อธิบายการแทนค่าทางคณิตศาสตร์และวิธีการสร้างมัน ในโพสต์นี้ เราจะพยายามเชื่อมโยงทฤษฎีกับการปฏิบัติโดยแนะนำสองโมเดล DPMM: Dirichlet Multivariate Normal Mixture Model ซึ่งสามารถใช้เพื่อจัดกลุ่มข้อมูล Gaussian และ Dirichlet-Multinomial Mixture Model ซึ่งใช้ในการจัดกลุ่มเอกสาร

อัปเดต: ขณะนี้ Datumbox Machine Learning Framework เป็นโอเพ่นซอร์สและฟรีสำหรับ ดาวน์โหลด. ตรวจสอบแพ็คเกจ com.datumbox.framework.machinelearning.clustering เพื่อดูการใช้งาน Dirichlet Process Mixture Models ใน Java

1. แบบจำลองส่วนผสมปกติหลายตัวแปรของ Dirichlet

แบบจำลองส่วนผสม Dirichlet Process แรกที่เราจะตรวจสอบคือ Dirichlet Multivariate Normal Mixture Model ซึ่งสามารถใช้เพื่อดำเนินการจัดกลุ่มบนชุดข้อมูลต่อเนื่อง แบบจำลองส่วนผสมถูกกำหนดไว้ดังนี้:

![]()

![]()

![]()

สมการที่ 1: Dirichlet Multivariate Normal Mixture Model

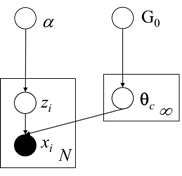

ดังที่เราเห็นข้างต้น โมเดลเฉพาะสันนิษฐานว่าการแจกแจงกำเนิดเป็นการแจกแจงแบบเกาส์เซียนแบบพหุนาม และใช้กระบวนการร้านอาหารจีนเหมือนก่อนหน้าสำหรับการกำหนดคลัสเตอร์ นอกจากนี้สำหรับการกระจายฐาน G0 มันใช้ Normal-Inverse-Wishart ก่อนหน้าซึ่งคือ ผันก่อน ของการแจกแจงแบบปกติหลายตัวแปรที่มีค่าเฉลี่ยและเมทริกซ์ความแปรปรวนร่วมที่ไม่ทราบค่า ด้านล่างนี้เรานำเสนอ Graphical Model ของแบบจำลองส่วนผสม:

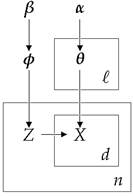

รูปที่ 1: โมเดลกราฟิกของ Dirichlet Multivariate Normal Mixture Model

ดังที่เราได้กล่าวไว้ก่อนหน้านี้ เพื่อให้สามารถประมาณการมอบหมายคลัสเตอร์ได้ เราจะใช้ การสุ่มตัวอย่างกิ๊บส์แบบยุบ ซึ่งต้องเลือก คอนจูเกตที่เหมาะสม. นอกจากนี้เราจะต้องอัปเดตพารามิเตอร์หลังที่ได้รับ poster ก่อนหน้าและหลักฐาน. ด้านล่างเราจะเห็น MAP ประมาณการ ของพารามิเตอร์สำหรับหนึ่งในคลัสเตอร์:

![]()

![]()

![]()

![]()

![]()

สมการที่ 2: MAP ประมาณการเกี่ยวกับ Cluster Parameters

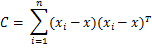

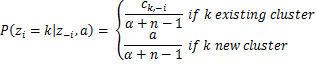

โดยที่ d คือมิติข้อมูลของเราและ ![]() คือค่าเฉลี่ยตัวอย่าง นอกจากนี้เรายังมีไฮเปอร์พารามิเตอร์หลายตัวของ Normal-Inverse-Wishart เช่น μ0 ซึ่งเป็นค่าเฉลี่ยเริ่มต้น κ0 คือเศษส่วนเฉลี่ยซึ่งทำงานเป็นพารามิเตอร์การปรับให้เรียบ ν0 คือ ดีกรีอิสระซึ่งกำหนดเป็นจำนวนมิติและ Ψ0 คือผลคูณค่าเบี่ยงเบนคู่ซึ่งตั้งค่าเป็นเมทริกซ์เอกลักษณ์ dxd คูณด้วยค่าคงที่ จากนี้ไปในไฮเปอร์พารามิเตอร์ก่อนหน้าทั้งหมดของ G0 จะถูกแทนด้วย λ เพื่อทำให้สัญกรณ์ง่ายขึ้น สุดท้าย เมื่อมีทั้งหมดที่กล่าวมา เราสามารถประมาณความน่าจะเป็นที่ Collapsed Gibbs Sampler ต้องการ ความน่าจะเป็นของการสังเกต i ที่อยู่ในคลัสเตอร์ k จากการกำหนดคลัสเตอร์ ชุดข้อมูล และไฮเปอร์พารามิเตอร์ α และ λ ทั้งหมดของ DP และ G0 ได้รับด้านล่าง:

คือค่าเฉลี่ยตัวอย่าง นอกจากนี้เรายังมีไฮเปอร์พารามิเตอร์หลายตัวของ Normal-Inverse-Wishart เช่น μ0 ซึ่งเป็นค่าเฉลี่ยเริ่มต้น κ0 คือเศษส่วนเฉลี่ยซึ่งทำงานเป็นพารามิเตอร์การปรับให้เรียบ ν0 คือ ดีกรีอิสระซึ่งกำหนดเป็นจำนวนมิติและ Ψ0 คือผลคูณค่าเบี่ยงเบนคู่ซึ่งตั้งค่าเป็นเมทริกซ์เอกลักษณ์ dxd คูณด้วยค่าคงที่ จากนี้ไปในไฮเปอร์พารามิเตอร์ก่อนหน้าทั้งหมดของ G0 จะถูกแทนด้วย λ เพื่อทำให้สัญกรณ์ง่ายขึ้น สุดท้าย เมื่อมีทั้งหมดที่กล่าวมา เราสามารถประมาณความน่าจะเป็นที่ Collapsed Gibbs Sampler ต้องการ ความน่าจะเป็นของการสังเกต i ที่อยู่ในคลัสเตอร์ k จากการกำหนดคลัสเตอร์ ชุดข้อมูล และไฮเปอร์พารามิเตอร์ α และ λ ทั้งหมดของ DP และ G0 ได้รับด้านล่าง:

![]()

![]()

สมการที่ 3: ความน่าจะเป็นที่ใช้โดย Gibbs Sampler สำหรับ MNMM

ที่ไหน zi คือการกำหนดคลัสเตอร์ของการสังเกต xi, x1:น เป็นชุดข้อมูลที่สมบูรณ์ z-i คือชุดของการกำหนดคลัสเตอร์ที่ไม่มี i . ตัวใดตัวหนึ่งth การสังเกต x-i เป็นชุดข้อมูลที่สมบูรณ์ ยกเว้น ith การสังเกต ck,-ผม คือจำนวนการสังเกตทั้งหมดที่กำหนดให้กับคลัสเตอร์ k ไม่รวม ith สังเกตในขณะที่ ![]() และ

และ ![]() คือเมทริกซ์ค่าเฉลี่ยและความแปรปรวนร่วมของคลัสเตอร์ k ที่ไม่รวม ith การสังเกต

คือเมทริกซ์ค่าเฉลี่ยและความแปรปรวนร่วมของคลัสเตอร์ k ที่ไม่รวม ith การสังเกต

2. แบบจำลองส่วนผสมของไดริชเล็ต-พหุนาม

Dirichlet-Multinomial Mixture Model ใช้เพื่อวิเคราะห์เอกสารแบบคลัสเตอร์ โมเดลเฉพาะมีลำดับชั้นที่ซับซ้อนกว่าเล็กน้อย เนื่องจากเป็นแบบจำลองหัวข้อ/ประเภทของเอกสาร ความน่าจะเป็นของคำภายในแต่ละหัวข้อ การมอบหมายคลัสเตอร์ และการกระจายทั่วไปของเอกสาร เป้าหมายคือการเรียนรู้แบบไม่มีผู้ดูแลและจัดกลุ่มรายการเอกสารโดยมอบหมายให้กลุ่ม แบบจำลองส่วนผสมถูกกำหนดไว้ดังนี้:

![]()

![]()

![]()

![]()

สมการที่ 4: แบบจำลองส่วนผสมไดริชเล็ต-พหุนาม

โดยที่ φ จำลองความน่าจะเป็นของหัวข้อ zi เป็นตัวเลือกหัวข้อ θk คือความน่าจะเป็นของคำในแต่ละคลัสเตอร์และ xฉันเจ แสดงถึงคำในเอกสาร เราควรสังเกตว่าเทคนิคนี้ใช้ กรอบคำศัพท์ ซึ่งแสดงถึงเอกสารที่เป็นกลุ่มคำที่ไม่เรียงลำดับโดยไม่คำนึงถึงไวยากรณ์และลำดับของคำ การแสดงแบบง่ายนี้มักใช้ในการประมวลผลภาษาธรรมชาติและการดึงข้อมูล ด้านล่างนี้เรานำเสนอ Graphical Model ของแบบจำลองส่วนผสม:

รูปที่ 2: แบบจำลองกราฟิกของแบบจำลองส่วนผสมไดริชเล็ต-พหุนาม

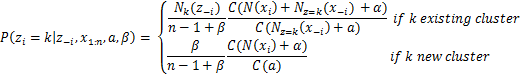

เฉพาะรุ่นที่ใช้ การแจกแจงพหุนามแบบไม่ต่อเนื่อง สำหรับการแจกแจงกำเนิดและการแจกแจงไดริชเล็ตสำหรับนักบวช ℓ คือขนาดของคลัสเตอร์ที่ใช้งานอยู่ n จำนวนเอกสารทั้งหมด β ควบคุมจำนวนคลัสเตอร์ที่คาดไว้ล่วงหน้าในขณะที่ α ควบคุมจำนวนคำที่กำหนดให้กับแต่ละคลัสเตอร์ เพื่อประมาณความน่าจะเป็นที่ .ต้องการ ตัวอย่าง Gibbs ที่ยุบ เราใช้ไฟล์ สมการต่อไปนี้:

![]()

สมการที่ 5: ความน่าจะเป็นที่ใช้โดย Gibbs Sampler สำหรับ DMMM

โดยที่ Γ คือฟังก์ชันแกมมา zi คือการกำหนดคลัสเตอร์ของเอกสาร xi, x1:น เป็นชุดข้อมูลที่สมบูรณ์ z-i คือชุดของการกำหนดคลัสเตอร์ที่ไม่มี i . ตัวใดตัวหนึ่งth เอกสาร x-i เป็นชุดข้อมูลที่สมบูรณ์ ยกเว้น ith เอกสาร Nk(z-i) คือจำนวนการสังเกตที่กำหนดให้กับคลัสเตอร์ k ไม่รวม ith เอกสาร Nz=k(x-i) เป็นเวกเตอร์ที่มีผลรวมของการนับสำหรับแต่ละคำสำหรับเอกสารทั้งหมดที่กำหนดให้กับคลัสเตอร์ k ยกเว้น ith เอกสารและ N(xi) เป็นเวกเตอร์กระจัดกระจายที่มีการนับของแต่ละคำในเอกสาร xi. สุดท้าย ดังที่เราเห็นข้างต้น โดยใช้ Collapsed Gibbs Sampler กับ Chinese Restaurant Process the θjk ตัวแปรที่เก็บความน่าจะเป็นของคำ j ในหัวข้อ k สามารถรวมเข้าด้วยกันได้

- AI

- ไอ อาร์ต

- เครื่องกำเนิดไออาร์ท

- หุ่นยนต์ไอ

- ปัญญาประดิษฐ์

- ใบรับรองปัญญาประดิษฐ์

- หุ่นยนต์ปัญญาประดิษฐ์

- หุ่นยนต์ปัญญาประดิษฐ์

- ซอฟต์แวร์ปัญญาประดิษฐ์

- blockchain

- การประชุม blockchain ai

- เหรียญอัจฉริยะ

- ปัญญาประดิษฐ์สนทนา

- การประชุม crypto ai

- ดัล-อี

- กล่องข้อมูล

- การเรียนรู้ลึก ๆ

- google ai

- เรียนรู้เครื่อง

- แมชชีนเลิร์นนิงและสถิติ

- เพลโต

- เพลโตไอ

- เพลโตดาต้าอินเทลลิเจนซ์

- เกมเพลโต

- เพลโตดาต้า

- เพลโตเกม

- ขนาดไอ

- วากยสัมพันธ์

- ลมทะเล