โมเดลภาษาขนาดใหญ่ (LLM) ที่มีความรู้กว้างขวาง สามารถสร้างข้อความที่เหมือนมนุษย์ได้ในเกือบทุกหัวข้อ อย่างไรก็ตาม การฝึกอบรมเกี่ยวกับชุดข้อมูลขนาดใหญ่ยังจำกัดประโยชน์สำหรับงานเฉพาะทางอีกด้วย หากไม่มีการเรียนรู้อย่างต่อเนื่อง โมเดลเหล่านี้จะยังคงลืมข้อมูลและแนวโน้มใหม่ๆ ที่เกิดขึ้นหลังจากการฝึกอบรมครั้งแรก นอกจากนี้ ค่าใช้จ่ายในการฝึกอบรม LLM ใหม่สามารถพิสูจน์ได้ว่าเป็นสิ่งต้องห้ามสำหรับการตั้งค่าองค์กรหลายแห่ง อย่างไรก็ตาม คุณสามารถอ้างอิงโยงคำตอบของแบบจำลองกับเนื้อหาเฉพาะทางต้นฉบับได้ ดังนั้นจึงหลีกเลี่ยงความจำเป็นในการฝึกโมเดล LLM ใหม่ โดยใช้การดึงข้อมูล-Augmented Generation (RAG)

RAG ให้อำนาจแก่ LLM โดยให้ความสามารถในการดึงข้อมูลและรวมความรู้จากภายนอก แทนที่จะอาศัยความรู้ที่ได้รับการฝึกอบรมมาล่วงหน้าเพียงอย่างเดียว RAG อนุญาตให้โมเดลดึงข้อมูลจากเอกสาร ฐานข้อมูล และอื่นๆ อีกมากมาย จากนั้นแบบจำลองจะรวมข้อมูลภายนอกนี้เข้ากับข้อความที่สร้างขึ้นอย่างเชี่ยวชาญ ด้วยการจัดหาข้อมูลที่เกี่ยวข้องกับบริบท โมเดลนี้สามารถให้คำตอบที่เป็นปัจจุบันและมีข้อมูลซึ่งปรับให้เหมาะกับกรณีการใช้งานของคุณ การเพิ่มพูนความรู้ยังช่วยลดโอกาสที่จะเกิดภาพหลอนและข้อความที่ไม่ถูกต้องหรือไร้สาระ ด้วย RAG โมเดลพื้นฐานจะกลายเป็นผู้เชี่ยวชาญที่สามารถปรับเปลี่ยนได้ ซึ่งจะพัฒนาเมื่อฐานความรู้ของคุณเติบโตขึ้น

วันนี้เรารู้สึกตื่นเต้นที่จะเปิดตัวการสาธิต AI เจนเนอเรชั่นสามรายการที่ได้รับใบอนุญาตภายใต้ ใบอนุญาต MIT-0:

- Amazon Kendra พร้อม LLM พื้นฐาน – ใช้ความสามารถในการค้นหาเชิงลึกของ อเมซอน เคนดรา รวมกับความรู้ที่กว้างขวางของ LLM การบูรณาการนี้ให้คำตอบที่แม่นยำและคำนึงถึงบริบทสำหรับคำถามที่ซับซ้อนโดยดึงมาจากแหล่งข้อมูลที่หลากหลาย

- โมเดลการฝังด้วย LLM พื้นฐาน – ผสานพลังของการฝัง ซึ่งเป็นเทคนิคในการจับความหมายเชิงความหมายของคำและวลี เข้ากับฐานความรู้อันกว้างขวางของ LLM การทำงานร่วมกันนี้ช่วยให้การสร้างแบบจำลองหัวข้อ การแนะนำเนื้อหา และความสามารถในการค้นหาความหมายมีความแม่นยำมากขึ้น

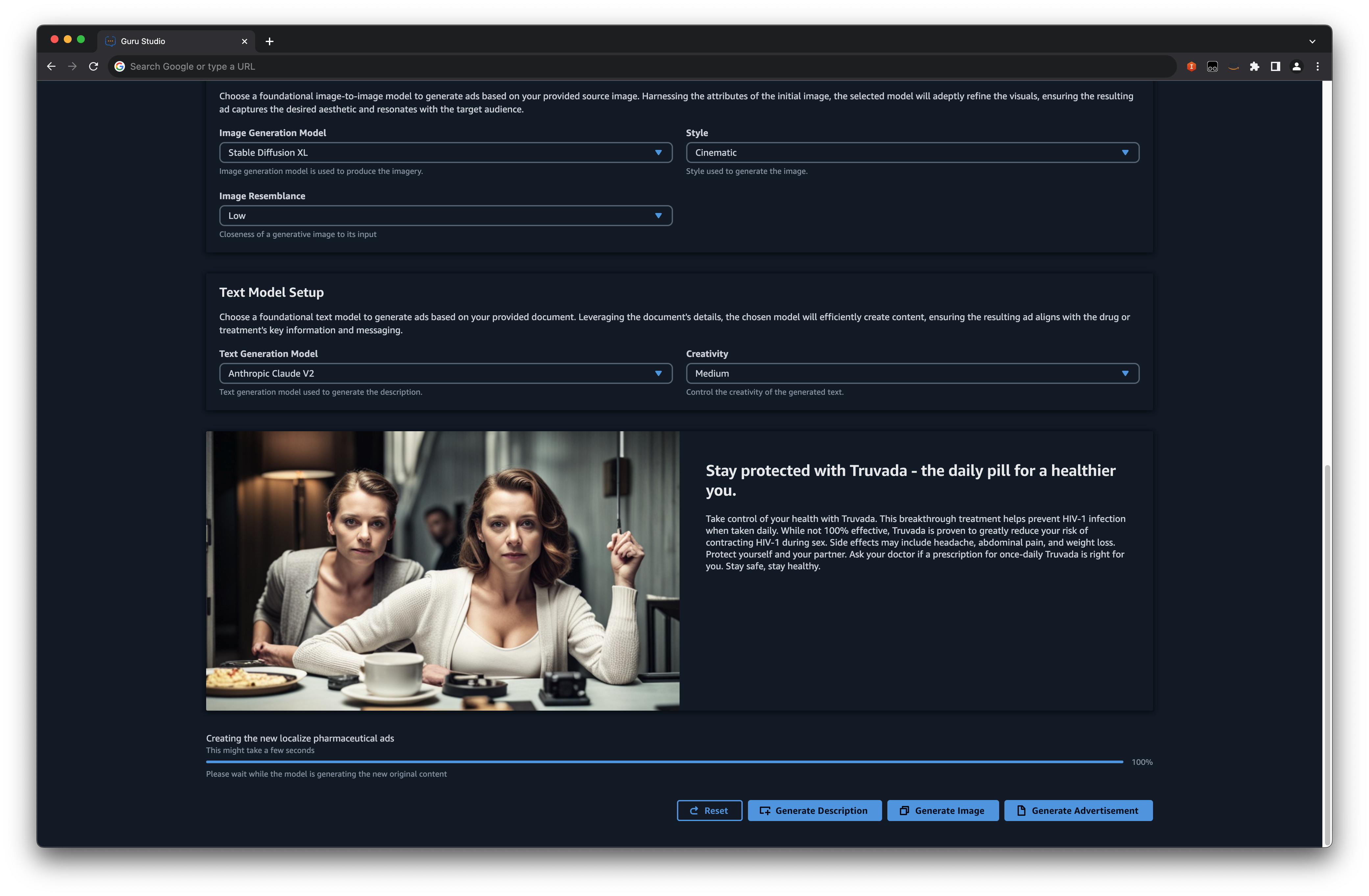

- Foundation Models Pharma Ad Generator – แอปพลิเคชันเฉพาะทางที่ออกแบบมาสำหรับอุตสาหกรรมยาโดยเฉพาะ เครื่องมือนี้ควบคุมความสามารถในการสร้างของแบบจำลองพื้นฐาน สร้างโฆษณาทางเภสัชกรรมที่น่าเชื่อถือและปฏิบัติตามข้อกำหนด เพื่อให้มั่นใจว่าเนื้อหาเป็นไปตามมาตรฐานและกฎระเบียบของอุตสาหกรรม

การสาธิตเหล่านี้สามารถปรับใช้ได้อย่างราบรื่นในบัญชี AWS ของคุณ โดยนำเสนอข้อมูลเชิงลึกพื้นฐานและคำแนะนำในการใช้บริการของ AWS เพื่อสร้างบอทคำถามและคำตอบ AI ที่สร้าง LLM ที่ล้ำสมัยและการสร้างเนื้อหา

ในโพสต์นี้ เราจะสำรวจว่า RAG รวมกับ Amazon Kendra หรือการฝังแบบกำหนดเองสามารถเอาชนะความท้าทายเหล่านี้และให้การตอบสนองต่อคำค้นหาที่เป็นภาษาธรรมชาติได้อย่างไร

ภาพรวมโซลูชัน

เมื่อนำโซลูชันนี้ไปใช้ คุณจะได้รับประโยชน์ดังต่อไปนี้:

- การเข้าถึงข้อมูลที่ดีขึ้น – RAG ช่วยให้โมเดลดึงข้อมูลจากแหล่งภายนอกจำนวนมาก ซึ่งอาจมีประโยชน์อย่างยิ่งเมื่อความรู้ของโมเดลที่ได้รับการฝึกอบรมล่วงหน้าล้าสมัยหรือไม่สมบูรณ์

- scalability – แทนที่จะฝึกโมเดลกับข้อมูลที่มีอยู่ทั้งหมด RAG ช่วยให้โมเดลดึงข้อมูลที่เกี่ยวข้องได้ทันที ซึ่งหมายความว่าเมื่อมีข้อมูลใหม่ ก็สามารถเพิ่มลงในฐานข้อมูลการดึงข้อมูลได้โดยไม่จำเป็นต้องฝึกโมเดลใหม่ทั้งหมด

- ประสิทธิภาพของหน่วยความจำ – LLM ต้องใช้หน่วยความจำจำนวนมากเพื่อจัดเก็บพารามิเตอร์ ด้วย RAG โมเดลสามารถมีขนาดเล็กลงได้เนื่องจากไม่จำเป็นต้องจดจำรายละเอียดทั้งหมด มันสามารถเรียกคืนได้เมื่อจำเป็น

- การอัปเดตความรู้แบบไดนามิก – แตกต่างจากรุ่นทั่วไปที่มีจุดสิ้นสุดความรู้ที่กำหนดไว้ ฐานข้อมูลภายนอกของ RAG สามารถรับการอัปเดตเป็นประจำ ทำให้โมเดลสามารถเข้าถึงข้อมูลที่ทันสมัยได้ ฟังก์ชันการดึงข้อมูลสามารถปรับแต่งอย่างละเอียดสำหรับงานที่แตกต่างกันได้ ตัวอย่างเช่น งานวินิจฉัยทางการแพทย์สามารถดึงข้อมูลจากวารสารทางการแพทย์ได้ เพื่อให้แน่ใจว่าแบบจำลองจะได้รับข้อมูลเชิงลึกจากผู้เชี่ยวชาญและที่เกี่ยวข้อง

- การบรรเทาอคติ – ความสามารถในการดึงข้อมูลจากฐานข้อมูลที่ได้รับการดูแลอย่างดีมีศักยภาพในการลดอคติโดยรับรองแหล่งข้อมูลภายนอกที่สมดุลและเป็นกลาง

ก่อนที่จะเจาะลึกในการผสานรวม Amazon Kendra เข้ากับ LLM พื้นฐาน สิ่งสำคัญคือต้องเตรียมเครื่องมือและข้อกำหนดของระบบที่จำเป็นให้ตัวเอง การมีการตั้งค่าที่ถูกต้องเป็นขั้นตอนแรกในการปรับใช้การสาธิตอย่างราบรื่น

เบื้องต้น

คุณต้องมีข้อกำหนดเบื้องต้นดังต่อไปนี้:

แม้ว่าจะเป็นไปได้ที่จะตั้งค่าและปรับใช้โครงสร้างพื้นฐานที่มีรายละเอียดในบทช่วยสอนนี้จากคอมพิวเตอร์ของคุณ AWS Cloud9 เสนอทางเลือกที่สะดวกสบาย AWS Cloud9 ที่ติดตั้งเครื่องมือไว้ล่วงหน้า เช่น AWS CLI, AWS CDK และ Docker สามารถทำหน้าที่เป็นเวิร์กสเตชันการปรับใช้ของคุณได้ หากต้องการใช้บริการนี้ง่ายๆ ตั้งค่าสภาพแวดล้อม เมื่อ คอนโซล AWS Cloud9.

เมื่อไม่มีข้อกำหนดเบื้องต้นแล้ว เรามาเจาะลึกคุณสมบัติและความสามารถของ Amazon Kendra พร้อม LLM พื้นฐานกันดีกว่า

Amazon Kendra พร้อม LLM พื้นฐาน

Amazon Kendra เป็นบริการค้นหาระดับองค์กรขั้นสูงที่ได้รับการปรับปรุงโดยการเรียนรู้ของเครื่อง (ML) ที่ให้ความสามารถในการค้นหาความหมายที่พร้อมใช้งานได้ทันที Amazon Kendra ใช้ประโยชน์จากการประมวลผลภาษาธรรมชาติ (NLP) เข้าใจทั้งเนื้อหาของเอกสารและจุดประสงค์พื้นฐานของการสืบค้นของผู้ใช้ โดยวางตำแหน่งให้เป็นเครื่องมือเรียกค้นเนื้อหาสำหรับโซลูชันที่ใช้ RAG ด้วยการใช้เนื้อหาการค้นหาที่มีความแม่นยำสูงจาก Kendra เป็นเพย์โหลด RAG คุณจะได้รับการตอบสนอง LLM ที่ดีขึ้น การใช้ Amazon Kendra ในโซลูชันนี้ยังช่วยให้สามารถค้นหาแบบส่วนตัวได้โดยการกรองการตอบสนองตามสิทธิ์การเข้าถึงเนื้อหาของผู้ใช้ปลายทาง

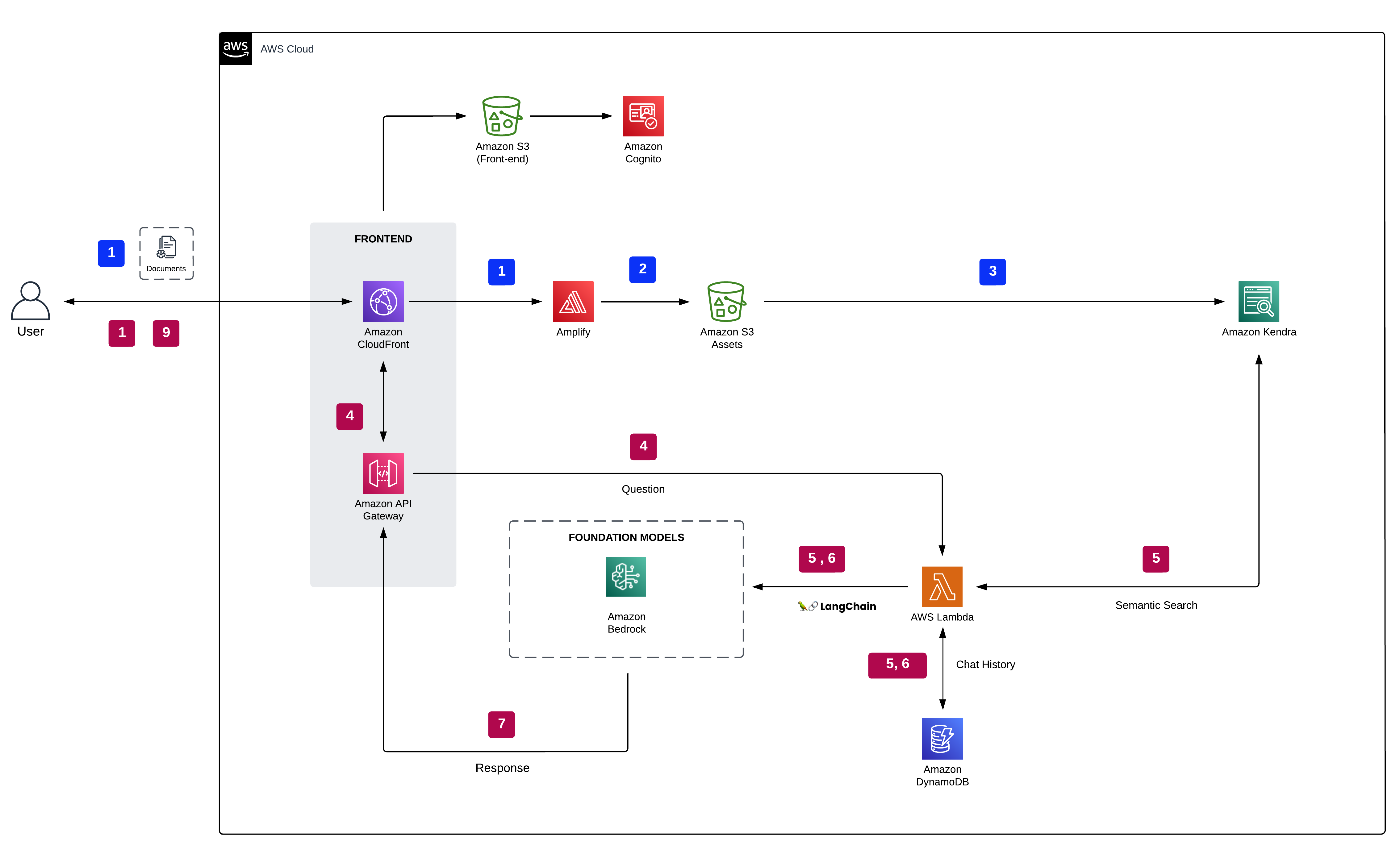

แผนภาพต่อไปนี้แสดงสถาปัตยกรรมของแอปพลิเคชัน AI เชิงสร้างสรรค์โดยใช้วิธี RAG

เอกสารได้รับการประมวลผลและจัดทำดัชนีโดย Amazon Kendra ผ่านทาง บริการจัดเก็บข้อมูลอย่างง่ายของ Amazon (Amazon S3) ขั้วต่อ คำขอของลูกค้าและข้อมูลเชิงบริบทจาก Amazon Kendra จะถูกส่งไปยัง อเมซอน เบดร็อค แบบจำลองรากฐาน การสาธิตนี้ให้คุณเลือกระหว่างรุ่น Titan ของ Amazon, Jurassic ของ AI21 และ Claude ของ Anthropic ที่ Amazon Bedrock รองรับ ประวัติการสนทนาจะถูกบันทึกไว้ใน อเมซอน ไดนาโมดีบีโดยเสนอบริบทเพิ่มเติมสำหรับ LLM เพื่อสร้างการตอบสนอง

เราได้จัดให้มีการสาธิตนี้ใน repo GitHub. โปรดดูคำแนะนำในการปรับใช้ภายในไฟล์ readme เพื่อปรับใช้ในบัญชี AWS ของคุณ

ขั้นตอนต่อไปนี้สรุปกระบวนการเมื่อผู้ใช้โต้ตอบกับแอป generative AI:

- ผู้ใช้ล็อกอินเข้าสู่เว็บแอปที่ได้รับการรับรองความถูกต้องโดย Amazon Cognito Co.

- ผู้ใช้อัปโหลดเอกสารตั้งแต่หนึ่งรายการขึ้นไปลงใน Amazon S3

- ผู้ใช้รันงานซิงค์ Amazon Kendra เพื่อนำเข้าเอกสาร S3 เข้าสู่ดัชนี Amazon Kendra

- คำถามของผู้ใช้ถูกส่งผ่าน WebSocket API ที่ปลอดภัยซึ่งโฮสต์อยู่ Amazon API Gateway Amazon สนับสนุนโดย AWS แลมบ์ดา ฟังก์ชัน

- ฟังก์ชัน Lambda ซึ่งเสริมประสิทธิภาพโดย หลังเชน เฟรมเวิร์กซึ่งเป็นเครื่องมืออเนกประสงค์ที่ออกแบบมาเพื่อการสร้างแอปพลิเคชันที่ขับเคลื่อนโดยโมเดลภาษา AI เชื่อมต่อกับตำแหน่งข้อมูล Amazon Bedrock เพื่อเรียบเรียงคำถามของผู้ใช้ใหม่ตามประวัติการแชท หลังจากเรียบเรียงคำถามใหม่แล้ว คำถามจะถูกส่งต่อไปยัง Amazon Kendra โดยใช้เรียกข้อมูล API เพื่อเป็นการตอบสนอง ดัชนี Amazon Kendra จะแสดงผลการค้นหา โดยให้ข้อความที่ตัดตอนมาจากเอกสารที่เกี่ยวข้องซึ่งมาจากข้อมูลที่นำเข้าขององค์กร

- คำถามของผู้ใช้พร้อมกับข้อมูลที่ดึงมาจากดัชนีจะถูกส่งเป็นบริบทในพรอมต์ LLM การตอบกลับจาก LLM จะถูกจัดเก็บเป็นประวัติการแชทภายใน DynamoDB

- ในที่สุด การตอบสนองจาก LLM จะถูกส่งกลับไปยังผู้ใช้

ขั้นตอนการทำดัชนีเอกสาร

ต่อไปนี้เป็นขั้นตอนในการประมวลผลและจัดทำดัชนีเอกสาร:

- ผู้ใช้ส่งเอกสารผ่านทางส่วนต่อประสานผู้ใช้ (UI)

- เอกสารจะถูกถ่ายโอนไปยังบัคเก็ต S3 โดยใช้ AWS ขยาย API

- Amazon Kendra จัดทำดัชนีเอกสารใหม่ในบัคเก็ต S3 ผ่านตัวเชื่อมต่อ Amazon Kendra S3

ประโยชน์

รายการต่อไปนี้เน้นถึงข้อดีของโซลูชันนี้:

- การดึงข้อมูลระดับองค์กร – Amazon Kendra ได้รับการออกแบบมาเพื่อการค้นหาระดับองค์กร ทำให้เหมาะสำหรับองค์กรที่มีข้อมูลที่มีโครงสร้างและไม่มีโครงสร้างจำนวนมาก

- ความเข้าใจความหมาย – ความสามารถ ML ของ Amazon Kendra ช่วยให้มั่นใจได้ว่าการดึงข้อมูลจะขึ้นอยู่กับความเข้าใจเชิงความหมายเชิงลึก ไม่ใช่แค่การจับคู่คำสำคัญเท่านั้น

- scalability – Amazon Kendra สามารถจัดการแหล่งข้อมูลขนาดใหญ่และให้ผลการค้นหาที่รวดเร็วและเกี่ยวข้องได้

- ความยืดหยุ่น – โมเดลพื้นฐานสามารถสร้างคำตอบตามบริบทที่หลากหลาย ทำให้มั่นใจได้ว่าระบบยังคงใช้งานได้หลากหลาย

- ความสามารถในการบูรณาการ – Amazon Kendra สามารถผสานรวมกับบริการและแหล่งข้อมูลของ AWS ได้หลากหลาย ทำให้สามารถปรับให้เข้ากับความต้องการที่แตกต่างกันขององค์กรได้

โมเดลการฝังด้วย LLM พื้นฐาน

An การฝัง เป็นเวกเตอร์ตัวเลขที่แสดงถึงแก่นแท้ของข้อมูลประเภทต่างๆ รวมถึงข้อความ รูปภาพ เสียง และเอกสาร การแสดงนี้ไม่เพียงแต่จับความหมายที่แท้จริงของข้อมูลเท่านั้น แต่ยังปรับให้เข้ากับการใช้งานจริงที่หลากหลายอีกด้วย การฝังโมเดลซึ่งเป็นสาขาหนึ่งของ ML จะแปลงข้อมูลที่ซับซ้อน เช่น คำหรือวลี ให้กลายเป็นปริภูมิเวกเตอร์ต่อเนื่อง เวกเตอร์เหล่านี้เข้าใจการเชื่อมต่อทางความหมายระหว่างข้อมูลโดยธรรมชาติ ทำให้สามารถเปรียบเทียบได้ลึกซึ้งและลึกซึ้งยิ่งขึ้น

RAG ผสมผสานจุดแข็งของโมเดลพื้นฐาน เช่น หม้อแปลง เข้ากับความแม่นยำในการฝังเพื่อกรองฐานข้อมูลขนาดใหญ่เพื่อหาข้อมูลที่เกี่ยวข้องได้อย่างราบรื่น เมื่อได้รับการสอบถาม ระบบจะใช้การฝังเพื่อระบุและแยกส่วนที่เกี่ยวข้องออกจากเนื้อหาที่กว้างขวาง จากนั้นแบบจำลองพื้นฐานจะกำหนดการตอบสนองตามบริบทที่แม่นยำโดยอาศัยข้อมูลที่ดึงมานี้ การทำงานร่วมกันที่สมบูรณ์แบบระหว่างการดึงข้อมูลและการสร้างการตอบสนองทำให้ระบบสามารถให้คำตอบได้อย่างละเอียด โดยดึงมาจากความรู้อันกว้างใหญ่ที่จัดเก็บไว้ในฐานข้อมูลที่กว้างขวาง

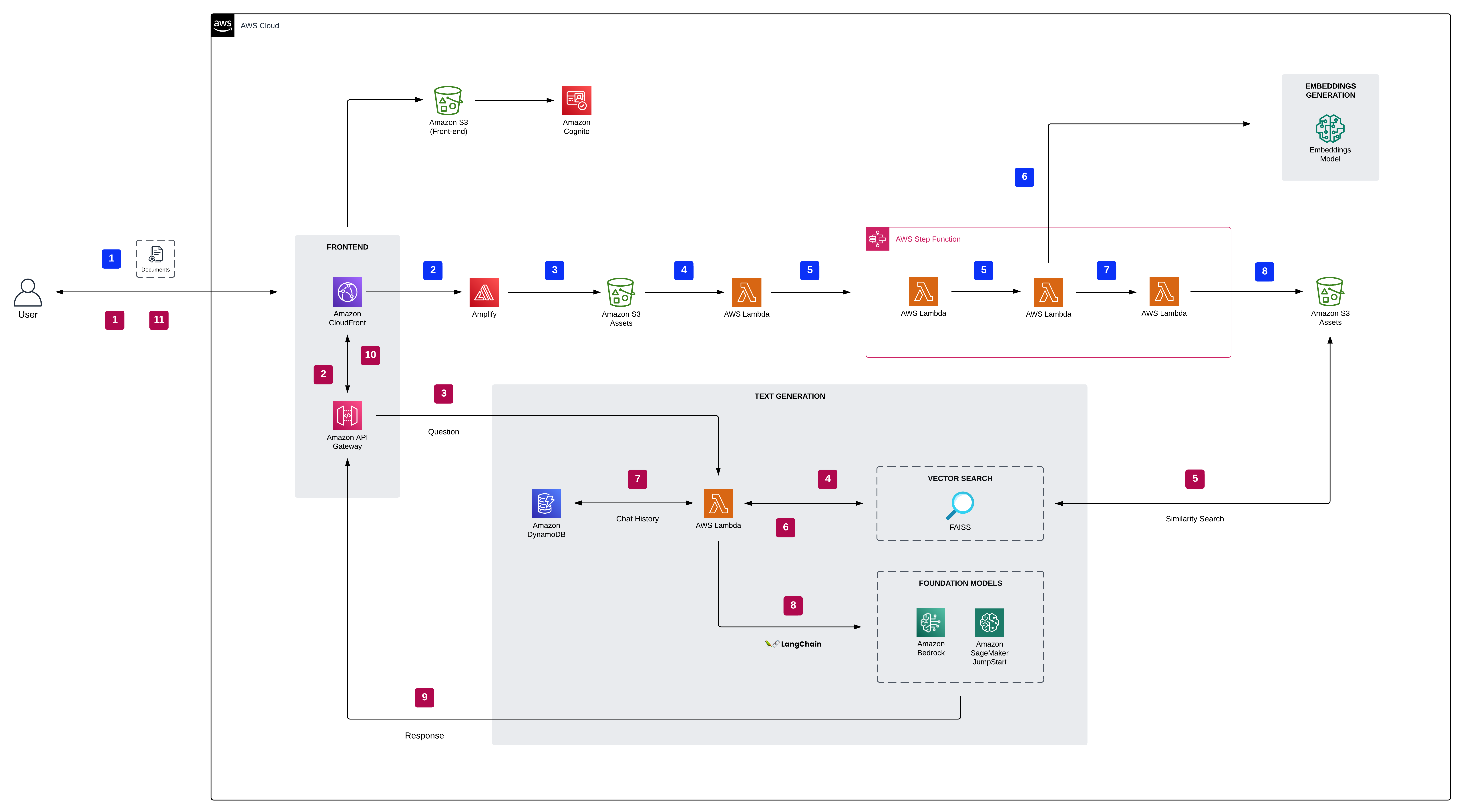

ในเค้าโครงสถาปัตยกรรม ขึ้นอยู่กับการเลือก UI ผู้ใช้จะได้รับการนำทางไปยัง Amazon Bedrock หรือ Amazon SageMaker JumpStart โมเดลรากฐาน เอกสารอยู่ระหว่างการประมวลผล และการฝังเวกเตอร์ถูกสร้างขึ้นโดยแบบจำลองการฝัง การฝังเหล่านี้จะถูกจัดทำดัชนีโดยใช้ ไฟส เพื่อให้สามารถค้นหาความหมายได้อย่างมีประสิทธิภาพ ประวัติการสนทนาจะถูกเก็บรักษาไว้ใน DynamoDB ซึ่งช่วยเพิ่มบริบทสำหรับ LLM ในการสร้างคำตอบ

ไดอะแกรมต่อไปนี้แสดงสถาปัตยกรรมโซลูชันและเวิร์กโฟลว์

เราได้จัดให้มีการสาธิตนี้ใน repo GitHub. โปรดดูคำแนะนำในการปรับใช้ภายในไฟล์ readme เพื่อปรับใช้ในบัญชี AWS ของคุณ

โมเดลการฝัง

ความรับผิดชอบของโมเดลการฝังมีดังนี้:

- โมเดลนี้มีหน้าที่ในการแปลงข้อความ (เช่น เอกสารหรือข้อความ) ให้เป็นการแสดงเวกเตอร์แบบหนาแน่น หรือที่เรียกกันทั่วไปว่าการฝัง

- การฝังเหล่านี้จับความหมายเชิงความหมายของข้อความ ทำให้สามารถเปรียบเทียบที่มีประสิทธิภาพและมีความหมายเชิงความหมายระหว่างส่วนต่างๆ ของข้อความ

- โมเดลการฝังสามารถฝึกได้บนคลังข้อมูลขนาดใหญ่เดียวกันกับโมเดลพื้นฐาน หรือสามารถฝึกเฉพาะสำหรับโดเมนเฉพาะได้

ขั้นตอนการทำงานถามตอบ

ขั้นตอนต่อไปนี้จะอธิบายขั้นตอนการทำงานของการตอบคำถามในเอกสาร:

- ผู้ใช้เข้าสู่ระบบเว็บแอปที่ได้รับการตรวจสอบสิทธิ์โดย Amazon Cognito

- ผู้ใช้อัปโหลดเอกสารหนึ่งรายการขึ้นไปไปยัง Amazon S3

- เมื่อถ่ายโอนเอกสาร การแจ้งเตือนเหตุการณ์ S3 จะทริกเกอร์ฟังก์ชัน Lambda ซึ่งจะเรียกจุดสิ้นสุดโมเดลการฝัง SageMaker เพื่อสร้างการฝังสำหรับเอกสารใหม่ โมเดลการฝังจะแปลงคำถามเป็นการแสดงเวกเตอร์หนาแน่น (การฝัง) ไฟล์เวกเตอร์ที่ได้จะถูกเก็บไว้อย่างปลอดภัยภายในบัคเก็ต S3

- FAISS รีทรีฟเวอร์จะเปรียบเทียบคำถามที่ฝังอยู่กับการฝังเอกสารหรือข้อความทั้งหมดในฐานข้อมูลเพื่อค้นหาข้อความที่เกี่ยวข้องมากที่สุด

- ข้อความต่างๆ พร้อมด้วยคำถามของผู้ใช้ จัดทำขึ้นเพื่อเป็นบริบทของโมเดลพื้นฐาน ฟังก์ชัน Lambda ใช้ไลบรารี LangChain และเชื่อมต่อกับตำแหน่งข้อมูล Amazon Bedrock หรือ SageMaker JumpStart ด้วยการสืบค้นแบบยัดบริบท

- การตอบสนองจาก LLM จะถูกจัดเก็บไว้ใน DynamoDB พร้อมกับคำค้นหาของผู้ใช้ การประทับเวลา ตัวระบุที่ไม่ซ้ำกัน และตัวระบุที่กำหนดเองอื่นๆ สำหรับรายการ เช่น หมวดหมู่คำถาม การจัดเก็บคำถามและคำตอบเป็นรายการแยกกันทำให้ฟังก์ชัน Lambda สามารถสร้างประวัติการสนทนาของผู้ใช้ขึ้นใหม่ตามเวลาที่ถามคำถามได้อย่างง่ายดาย

- สุดท้าย การตอบสนองจะถูกส่งกลับไปยังผู้ใช้ผ่านคำขอ HTTP ผ่านการตอบกลับการรวม API Gateway WebSocket API

ประโยชน์

รายการต่อไปนี้อธิบายคุณประโยชน์ของโซลูชันนี้:

- ความเข้าใจความหมาย – โมเดลการฝังช่วยให้มั่นใจได้ว่ารีทรีฟเวอร์จะเลือกข้อความตามความเข้าใจเชิงความหมายเชิงลึก ไม่ใช่แค่การจับคู่คำหลักเท่านั้น

- scalability – การฝังช่วยให้สามารถเปรียบเทียบความคล้ายคลึงกันได้อย่างมีประสิทธิภาพ ทำให้สามารถค้นหาผ่านฐานข้อมูลเอกสารขนาดใหญ่ได้อย่างรวดเร็ว

- ความยืดหยุ่น – โมเดลพื้นฐานสามารถสร้างคำตอบตามบริบทที่หลากหลาย ทำให้มั่นใจได้ว่าระบบยังคงใช้งานได้หลากหลาย

- ความสามารถในการปรับตัวของโดเมน – โมเดลการฝังสามารถฝึกหรือปรับแต่งสำหรับโดเมนเฉพาะได้ ทำให้ระบบสามารถปรับให้เข้ากับการใช้งานต่างๆ ได้

รากฐานแบบจำลอง Pharma Ad Generator

ในอุตสาหกรรมยาที่มีการเปลี่ยนแปลงอย่างรวดเร็วในปัจจุบัน การโฆษณาที่มีประสิทธิภาพและปรับให้เข้ากับท้องถิ่นมีความสำคัญมากกว่าที่เคย นี่คือจุดที่โซลูชันเชิงนวัตกรรมเข้ามามีบทบาท โดยใช้พลังของ AI สร้างสรรค์เพื่อสร้างโฆษณายาที่แปลเป็นภาษาท้องถิ่นจากรูปภาพต้นฉบับและ PDF นอกเหนือจากการเร่งกระบวนการสร้างโฆษณาแล้ว วิธีการนี้ยังช่วยปรับปรุงกระบวนการตรวจสอบกฎหมายทางการแพทย์ (MLR) อีกด้วย MLR เป็นกลไกการตรวจสอบที่เข้มงวด ซึ่งทีมแพทย์ กฎหมาย และหน่วยงานกำกับดูแลประเมินสื่อส่งเสริมการขายอย่างพิถีพิถัน เพื่อรับประกันความถูกต้องแม่นยำ การสนับสนุนทางวิทยาศาสตร์ และการปฏิบัติตามกฎระเบียบ วิธีสร้างเนื้อหาแบบเดิมๆ อาจยุ่งยาก โดยมักต้องมีการปรับเปลี่ยนด้วยตนเองและการตรวจสอบอย่างละเอียดเพื่อให้แน่ใจว่าสอดคล้องกับการปฏิบัติตามข้อกำหนดและความเกี่ยวข้องในระดับภูมิภาค อย่างไรก็ตาม ด้วยการถือกำเนิดของ AI เจนเนอเรทีฟ ตอนนี้เราสามารถสร้างโฆษณาที่โดนใจผู้ชมในท้องถิ่นได้โดยอัตโนมัติ ขณะเดียวกันก็รักษามาตรฐานและแนวปฏิบัติที่เข้มงวด

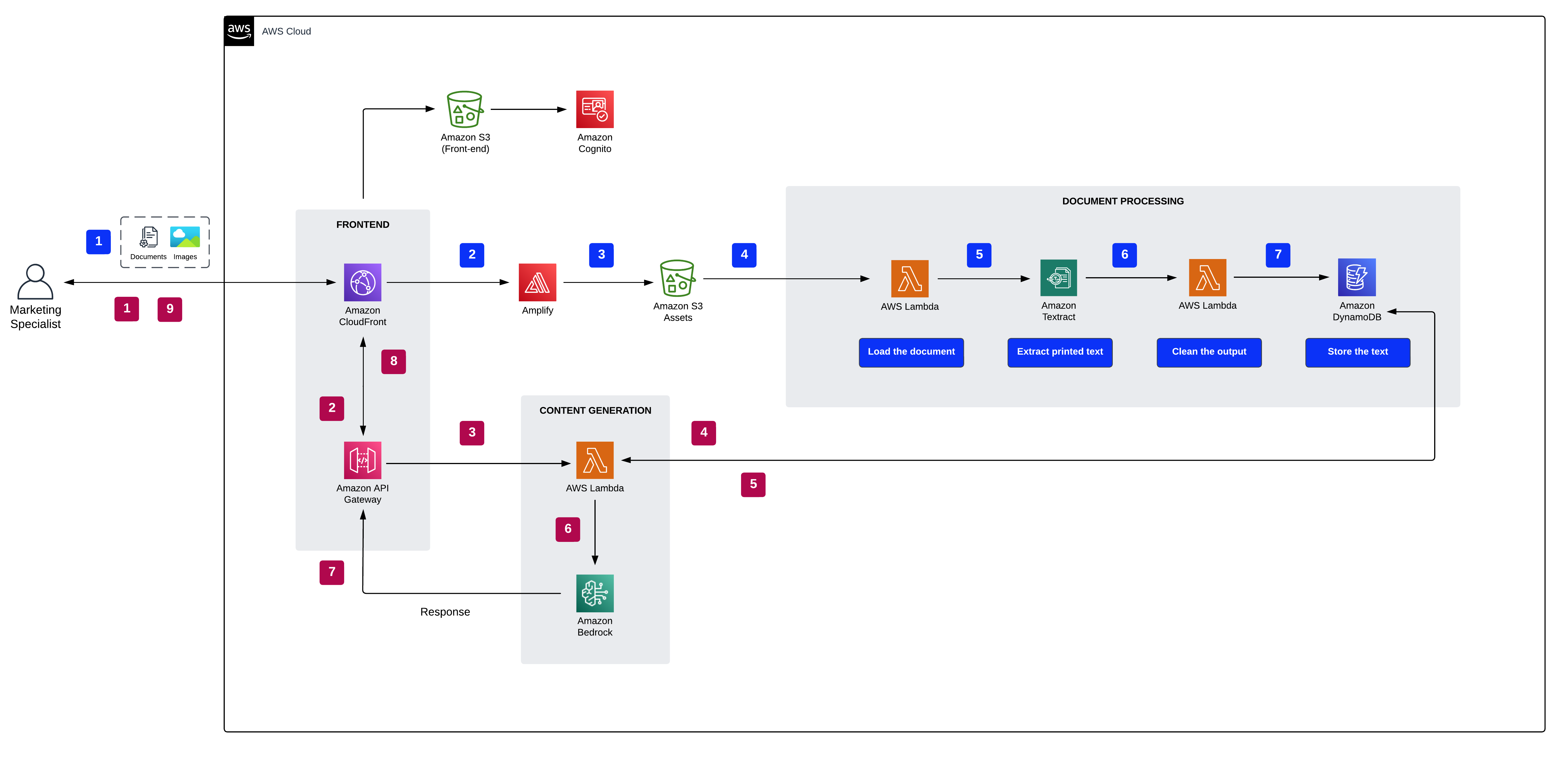

ไดอะแกรมต่อไปนี้แสดงสถาปัตยกรรมโซลูชัน

ในเค้าโครงทางสถาปัตยกรรม ขึ้นอยู่กับโมเดลที่เลือกและการตั้งค่าโฆษณา ผู้ใช้จะได้รับการนำทางไปยังโมเดลพื้นฐานของ Amazon Bedrock ได้อย่างราบรื่น วิธีการที่มีประสิทธิภาพนี้ช่วยให้มั่นใจได้ว่าโฆษณาใหม่จะถูกสร้างขึ้นอย่างแม่นยำตามการกำหนดค่าที่ต้องการ ส่วนหนึ่งของกระบวนการนี้ เอกสารได้รับการจัดการอย่างมีประสิทธิภาพโดย Amazon Textพร้อมข้อความผลลัพธ์ที่จัดเก็บไว้อย่างปลอดภัยใน DynamoDB คุณลักษณะที่โดดเด่นคือการออกแบบโมดูลาร์สำหรับการสร้างรูปภาพและข้อความ ทำให้คุณมีความยืดหยุ่นในการสร้างส่วนประกอบใดๆ ใหม่ได้อย่างอิสระตามต้องการ

เราได้จัดให้มีการสาธิตนี้ใน repo GitHub. โปรดดูคำแนะนำในการปรับใช้ภายในไฟล์ readme เพื่อปรับใช้ในบัญชี AWS ของคุณ

ขั้นตอนการทำงานในการสร้างเนื้อหา

ขั้นตอนต่อไปนี้สรุปขั้นตอนการสร้างเนื้อหา:

- ผู้ใช้เลือกเอกสาร รูปภาพต้นฉบับ ตำแหน่งโฆษณา ภาษา และสไตล์รูปภาพ

- รับประกันการเข้าถึงเว็บแอปพลิเคชันอย่างปลอดภัยผ่านการรับรองความถูกต้องของ Amazon Cognito

- ส่วนหน้าของแอปพลิเคชันเว็บโฮสต์ผ่าน Amplify

- WebSocket API ที่จัดการโดย API Gateway อำนวยความสะดวกตามคำขอของผู้ใช้ คำขอเหล่านี้ได้รับการรับรองความถูกต้องผ่าน AWS Identity และการจัดการการเข้าถึง (ฉัน).

- การผสานรวมกับ Amazon Bedrock ประกอบด้วยขั้นตอนต่อไปนี้:

- ฟังก์ชัน Lambda ใช้ไลบรารี LangChain เพื่อเชื่อมต่อกับตำแหน่งข้อมูล Amazon Bedrock โดยใช้การสืบค้นที่มีบริบทมากมาย

- โมเดลพื้นฐานจากข้อความเป็นข้อความจะสร้างโฆษณาที่เหมาะสมตามบริบทโดยพิจารณาจากบริบทและการตั้งค่าที่กำหนด

- โมเดลพื้นฐานจากข้อความเป็นรูปภาพจะสร้างรูปภาพที่ได้รับการปรับแต่ง โดยได้รับอิทธิพลจากรูปภาพต้นฉบับ สไตล์ที่เลือก และตำแหน่ง

- ผู้ใช้ได้รับการตอบกลับผ่านคำขอ HTTPS ผ่าน API Gateway WebSocket API ที่ผสานรวม

ขั้นตอนการประมวลผลเอกสารและรูปภาพ

ต่อไปนี้เป็นขั้นตอนการประมวลผลเอกสารและรูปภาพ:

- ผู้ใช้อัปโหลดเนื้อหาผ่าน UI ที่ระบุ

- Amplify API จะถ่ายโอนเอกสารไปยังบัคเก็ต S3

- หลังจากที่สินทรัพย์ถูกโอนไปยัง Amazon S3 แล้ว การดำเนินการอย่างใดอย่างหนึ่งต่อไปนี้จะเกิดขึ้น:

- หากเป็นเอกสาร ฟังก์ชัน Lambda จะใช้ Amazon Textract เพื่อประมวลผลและแยกข้อความสำหรับการสร้างโฆษณา

- หากเป็นรูปภาพ ฟังก์ชัน Lambda จะแปลงเป็นรูปแบบ base64 เหมาะสำหรับโมเดล Stable Diffusion เพื่อสร้างรูปภาพใหม่จากแหล่งที่มา

- ข้อความที่แยกออกมาหรือสตริงรูปภาพ base64 จะถูกบันทึกอย่างปลอดภัยใน DynamoDB

ประโยชน์

รายการต่อไปนี้อธิบายคุณประโยชน์ของโซลูชันนี้:

- อย่างมีประสิทธิภาพ – การใช้ generative AI ช่วยเร่งกระบวนการสร้างโฆษณาได้อย่างมาก โดยไม่จำเป็นต้องปรับเปลี่ยนด้วยตนเอง

- การปฏิบัติตามกฎระเบียบ – โซลูชันนี้ช่วยให้แน่ใจว่าโฆษณาที่สร้างขึ้นเป็นไปตามคำแนะนำและข้อบังคับเฉพาะ เช่น หลักเกณฑ์ด้านการตลาดของ FDA

- ต้นทุนที่มีประสิทธิภาพ – ด้วยการสร้างโฆษณาที่ปรับให้เหมาะสมโดยอัตโนมัติ บริษัทต่างๆ สามารถลดต้นทุนที่เกี่ยวข้องกับการผลิตและการแก้ไขโฆษณาได้อย่างมาก

- กระบวนการ MLR ที่คล่องตัว – โซลูชันนี้ทำให้กระบวนการ MLR ง่ายขึ้น ลดจุดเสียดสี และรับประกันการตรวจสอบที่ราบรื่นยิ่งขึ้น

- เสียงสะท้อนที่มีการแปล – Generative AI สร้างโฆษณาที่โดนใจผู้ชมในท้องถิ่น เพื่อให้มั่นใจว่ามีความเกี่ยวข้องและผลกระทบในภูมิภาคต่างๆ

- มาตรฐาน – โซลูชันจะรักษามาตรฐานและหลักเกณฑ์ที่จำเป็น เพื่อให้มั่นใจว่าโฆษณาที่สร้างขึ้นทั้งหมดมีความสอดคล้องกัน

- scalability – แนวทางที่ขับเคลื่อนด้วย AI สามารถจัดการฐานข้อมูลขนาดใหญ่ของรูปภาพต้นฉบับและ PDF ได้ ทำให้สามารถสร้างโฆษณาขนาดใหญ่ได้

- ลดการแทรกแซงด้วยตนเอง – ระบบอัตโนมัติช่วยลดความจำเป็นในการแทรกแซงของมนุษย์ ลดข้อผิดพลาดและรับประกันความสม่ำเสมอ

คุณสามารถปรับใช้โครงสร้างพื้นฐานในบทช่วยสอนนี้จากคอมพิวเตอร์ในพื้นที่ของคุณ หรือคุณสามารถใช้ AWS Cloud9 เป็นเวิร์กสเตชันการปรับใช้ของคุณ AWS Cloud9 มาพร้อมกับ AWS CLI, AWS CDK และ Docker ที่โหลดไว้ล่วงหน้า หากคุณเลือกใช้ AWS Cloud9 สร้างสภาพแวดล้อม จาก คอนโซล AWS Cloud9.

ทำความสะอาด

เพื่อหลีกเลี่ยงค่าใช้จ่ายที่ไม่จำเป็น ให้ล้างโครงสร้างพื้นฐานทั้งหมดที่สร้างผ่านคอนโซล AWS CloudFormation หรือโดยการรันคำสั่งต่อไปนี้บนเวิร์กสเตชันของคุณ:

นอกจากนี้ อย่าลืมหยุดตำแหน่งข้อมูล SageMaker ที่คุณเริ่มต้นผ่านคอนโซล SageMaker โปรดจำไว้ว่า การลบดัชนี Amazon Kendra จะไม่ลบเอกสารต้นฉบับออกจากพื้นที่จัดเก็บข้อมูลของคุณ

สรุป

Generative AI ซึ่งเป็นตัวอย่างที่ชัดเจนของ LLM ได้ประกาศการเปลี่ยนแปลงกระบวนทัศน์ในวิธีที่เราเข้าถึงและสร้างข้อมูล โมเดลเหล่านี้แม้จะทรงพลัง แต่มักถูกจำกัดด้วยขอบเขตของข้อมูลการฝึก RAG จัดการกับความท้าทายนี้ โดยรับประกันว่าความรู้อันกว้างขวางภายในโมเดลเหล่านี้จะถูกผสมเข้ากับข้อมูลเชิงลึกที่เกี่ยวข้องและเป็นปัจจุบันอย่างสม่ำเสมอ

การสาธิตที่ใช้ RAG ของเราเป็นข้อพิสูจน์ที่ชัดเจนในเรื่องนี้ พวกเขาแสดงให้เห็นถึงการทำงานร่วมกันอย่างราบรื่นระหว่าง Amazon Kendra, การฝังเวกเตอร์ และ LLM ซึ่งสร้างระบบที่ข้อมูลไม่เพียงแต่กว้างใหญ่เท่านั้น แต่ยังแม่นยำและทันเวลาอีกด้วย เมื่อคุณดำดิ่งลงสู่การสาธิตเหล่านี้ คุณจะได้สำรวจศักยภาพในการเปลี่ยนแปลงของการผสมผสานความรู้ที่ได้รับการฝึกอบรมล่วงหน้าเข้ากับความสามารถแบบไดนามิกของ RAG โดยตรง ส่งผลให้ได้ผลลัพธ์ที่น่าเชื่อถือและปรับให้เหมาะกับเนื้อหาระดับองค์กร

แม้ว่า AI เจนเนอเรชั่นที่ขับเคลื่อนโดย LLM จะเปิดวิธีใหม่ในการรับข้อมูลเชิงลึก แต่ข้อมูลเชิงลึกเหล่านี้จะต้องเชื่อถือได้และจำกัดอยู่เฉพาะเนื้อหาระดับองค์กรโดยใช้แนวทาง RAG การสาธิตที่ใช้ RAG เหล่านี้ช่วยให้คุณได้รับข้อมูลเชิงลึกที่แม่นยำและทันสมัย คุณภาพของข้อมูลเชิงลึกเหล่านี้ขึ้นอยู่กับความเกี่ยวข้องทางความหมาย ซึ่งเปิดใช้งานโดยใช้ Amazon Kendra และการฝังเวกเตอร์

หากคุณพร้อมที่จะสำรวจเพิ่มเติมและควบคุมพลังของ generative AI แล้ว ต่อไปนี้คือขั้นตอนต่อไปของคุณ:

- เข้าร่วมกับการสาธิตของเรา - ประสบการณ์ตรงเป็นสิ่งล้ำค่า สำรวจฟังก์ชันการทำงาน ทำความเข้าใจการผสานรวม และทำความคุ้นเคยกับอินเทอร์เฟซ

- เพิ่มพูนความรู้ของคุณ – ใช้ประโยชน์จากทรัพยากรที่มีอยู่ AWS นำเสนอเอกสารเชิงลึก บทช่วยสอน และการสนับสนุนชุมชนเพื่อช่วยในการเดินทางของ AI ของคุณ

- ริเริ่มโครงการนำร่อง – พิจารณาเริ่มต้นด้วยการนำ AI เจนเนอเรชั่นขนาดเล็กไปใช้งานในองค์กรของคุณ ข้อมูลนี้จะให้ข้อมูลเชิงลึกเกี่ยวกับการปฏิบัติจริงและความสามารถในการปรับตัวของระบบภายในบริบทเฉพาะของคุณ

สำหรับข้อมูลเพิ่มเติมเกี่ยวกับแอปพลิเคชัน Generative AI บน AWS โปรดดูที่ต่อไปนี้:

โปรดจำไว้ว่า ภูมิทัศน์ของ AI มีการพัฒนาอย่างต่อเนื่อง อัพเดทอยู่เสมอ อยากรู้อยากเห็น และพร้อมที่จะปรับตัวและสร้างสรรค์สิ่งใหม่ๆ อยู่เสมอ

เกี่ยวกับผู้แต่ง

จินตันหร่วน เป็นนักพัฒนาการสร้างต้นแบบภายในทีม AWS Industries Prototyping และ Customer Engineering (PACE) ซึ่งเชี่ยวชาญด้าน NLP และ generative AI ด้วยพื้นฐานด้านการพัฒนาซอฟต์แวร์และใบรับรอง AWS เก้าใบ Jin นำประสบการณ์มากมายมาช่วยเหลือลูกค้า AWS ในการสร้างวิสัยทัศน์ AI/ML และ AI เชิงสร้างสรรค์ให้เป็นรูปธรรมโดยใช้แพลตฟอร์ม AWS เขาสำเร็จการศึกษาระดับปริญญาโทสาขาวิทยาการคอมพิวเตอร์และวิศวกรรมซอฟต์แวร์จากมหาวิทยาลัยซีราคิวส์ นอกเหนือจากงานแล้ว Jin ยังสนุกกับการเล่นวิดีโอเกมและดื่มด่ำไปกับโลกแห่งภาพยนตร์สยองขวัญอันน่าตื่นเต้น

จินตันหร่วน เป็นนักพัฒนาการสร้างต้นแบบภายในทีม AWS Industries Prototyping และ Customer Engineering (PACE) ซึ่งเชี่ยวชาญด้าน NLP และ generative AI ด้วยพื้นฐานด้านการพัฒนาซอฟต์แวร์และใบรับรอง AWS เก้าใบ Jin นำประสบการณ์มากมายมาช่วยเหลือลูกค้า AWS ในการสร้างวิสัยทัศน์ AI/ML และ AI เชิงสร้างสรรค์ให้เป็นรูปธรรมโดยใช้แพลตฟอร์ม AWS เขาสำเร็จการศึกษาระดับปริญญาโทสาขาวิทยาการคอมพิวเตอร์และวิศวกรรมซอฟต์แวร์จากมหาวิทยาลัยซีราคิวส์ นอกเหนือจากงานแล้ว Jin ยังสนุกกับการเล่นวิดีโอเกมและดื่มด่ำไปกับโลกแห่งภาพยนตร์สยองขวัญอันน่าตื่นเต้น

อรวินท์ โกดันดาราไมอาห์ คือผู้สร้างโซลูชันอาวุโสด้าน Prototyping เต็มรูปแบบภายในทีม AWS Industries Prototyping และ Customer Engineering (PACE) เขามุ่งเน้นที่การช่วยเหลือลูกค้า AWS เปลี่ยนแนวคิดเชิงนวัตกรรมให้เป็นโซลูชันด้วยผลลัพธ์ที่วัดผลได้และน่าพึงพอใจ เขามีความหลงใหลในหัวข้อต่างๆ มากมาย รวมถึงความปลอดภัยบนคลาวด์, DevOps และ AI/ML และมักจะพบว่ามีการปรับเปลี่ยนเทคโนโลยีเหล่านี้

อรวินท์ โกดันดาราไมอาห์ คือผู้สร้างโซลูชันอาวุโสด้าน Prototyping เต็มรูปแบบภายในทีม AWS Industries Prototyping และ Customer Engineering (PACE) เขามุ่งเน้นที่การช่วยเหลือลูกค้า AWS เปลี่ยนแนวคิดเชิงนวัตกรรมให้เป็นโซลูชันด้วยผลลัพธ์ที่วัดผลได้และน่าพึงพอใจ เขามีความหลงใหลในหัวข้อต่างๆ มากมาย รวมถึงความปลอดภัยบนคลาวด์, DevOps และ AI/ML และมักจะพบว่ามีการปรับเปลี่ยนเทคโนโลยีเหล่านี้

อรชุน ชาคเชอร์ เป็นนักพัฒนาในทีม AWS Industries Prototyping (PACE) ที่มีความหลงใหลในการผสมผสานเทคโนโลยีเข้ากับโครงสร้างแห่งชีวิต สำเร็จการศึกษาระดับปริญญาโทจากมหาวิทยาลัย Purdue บทบาทปัจจุบันของ Arjun เกี่ยวข้องกับการออกแบบสถาปัตยกรรมและการสร้างต้นแบบที่ล้ำสมัยซึ่งครอบคลุมขอบเขตโดเมนต่างๆ ซึ่งปัจจุบันโดดเด่นด้วยขอบเขตของ AI/ML และ IoT อย่างเด่นชัด เมื่อไม่ได้ดื่มด่ำกับโค้ดและภูมิทัศน์ดิจิทัล คุณจะพบว่า Arjun ดื่มด่ำไปกับโลกแห่งกาแฟ สำรวจกลไกอันซับซ้อนของศาสตร์แห่งศาสตร์แห่งเวลา หรือสนุกสนานไปกับศิลปะแห่งยานยนต์

อรชุน ชาคเชอร์ เป็นนักพัฒนาในทีม AWS Industries Prototyping (PACE) ที่มีความหลงใหลในการผสมผสานเทคโนโลยีเข้ากับโครงสร้างแห่งชีวิต สำเร็จการศึกษาระดับปริญญาโทจากมหาวิทยาลัย Purdue บทบาทปัจจุบันของ Arjun เกี่ยวข้องกับการออกแบบสถาปัตยกรรมและการสร้างต้นแบบที่ล้ำสมัยซึ่งครอบคลุมขอบเขตโดเมนต่างๆ ซึ่งปัจจุบันโดดเด่นด้วยขอบเขตของ AI/ML และ IoT อย่างเด่นชัด เมื่อไม่ได้ดื่มด่ำกับโค้ดและภูมิทัศน์ดิจิทัล คุณจะพบว่า Arjun ดื่มด่ำไปกับโลกแห่งกาแฟ สำรวจกลไกอันซับซ้อนของศาสตร์แห่งศาสตร์แห่งเวลา หรือสนุกสนานไปกับศิลปะแห่งยานยนต์

- เนื้อหาที่ขับเคลื่อนด้วย SEO และการเผยแพร่ประชาสัมพันธ์ รับการขยายวันนี้

- PlatoData.Network Vertical Generative Ai เพิ่มพลังให้กับตัวเอง เข้าถึงได้ที่นี่.

- เพลโตไอสตรีม. Web3 อัจฉริยะ ขยายความรู้ เข้าถึงได้ที่นี่.

- เพลโตESG. คาร์บอน, คลีนเทค, พลังงาน, สิ่งแวดล้อม แสงอาทิตย์, การจัดการของเสีย. เข้าถึงได้ที่นี่.

- เพลโตสุขภาพ เทคโนโลยีชีวภาพและข่าวกรองการทดลองทางคลินิก เข้าถึงได้ที่นี่.

- ที่มา: https://aws.amazon.com/blogs/machine-learning/harnessing-the-power-of-enterprise-data-with-generative-ai-insights-from-amazon-kendra-langchain-and-large-language-models/

- :เป็น

- :ไม่

- :ที่ไหน

- $ ขึ้น

- 100

- 150

- 7

- a

- ความสามารถ

- เกี่ยวกับเรา

- เร่ง

- เข้า

- ตาม

- ลงชื่อเข้าใช้

- ความถูกต้อง

- ถูกต้อง

- ข้าม

- การปฏิบัติ

- Ad

- ปรับ

- ปรับ

- ที่เพิ่ม

- ที่อยู่

- เป็นไปตาม

- การปรับเปลี่ยน

- การนำ

- โฆษณา

- สูง

- ความได้เปรียบ

- ข้อได้เปรียบ

- การกำเนิด

- การโฆษณา

- หลังจาก

- AI

- AI / ML

- ช่วย

- การวางแนว

- ทั้งหมด

- อนุญาต

- การอนุญาต

- ช่วยให้

- เกือบจะ

- ตาม

- ด้วย

- ทางเลือก

- เสมอ

- อเมซอน

- Amazon Cognito Co

- อเมซอน เคนดรา

- Amazon Text

- Amazon Web Services

- จำนวน

- ขยาย

- an

- และ

- คำตอบ

- คำตอบ

- ใด

- API

- app

- การใช้งาน

- การใช้งาน

- เข้าใกล้

- เหมาะสม

- ในเชิงสถาปัตยกรรม

- สถาปัตยกรรม

- เป็น

- รอบ

- แถว

- งานศิลป์

- AS

- สินทรัพย์

- สินทรัพย์

- ช่วยเหลือ

- ที่เกี่ยวข้อง

- การพิจารณาคดี

- เสียง

- รับรองความถูกต้อง

- การยืนยันตัวตน

- โดยอัตโนมัติ

- โดยอัตโนมัติ

- อัตโนมัติ

- ใช้ได้

- หลีกเลี่ยง

- หลีกเลี่ยง

- AWS

- AWS Cloud9

- การก่อตัวของ AWS Cloud

- กลับ

- ถอย

- พื้นหลัง

- การสนับสนุน

- ฐาน

- ตาม

- BE

- เพราะ

- กลายเป็น

- จะกลายเป็น

- ประโยชน์ที่ได้รับ

- ดีกว่า

- ระหว่าง

- เกิน

- อคติ

- การผสม

- ร่างกาย

- ธ ปท

- ทั้งสอง

- สาขา

- นำ

- กว้าง

- สร้าง

- การก่อสร้าง

- แต่

- by

- โทร

- CAN

- สามารถรับ

- ความสามารถในการ

- จับ

- จับ

- กรณี

- หมวดหมู่

- การรับรอง

- ท้าทาย

- ความท้าทาย

- Choose

- เลือก

- ปลาเดยส์

- เมฆ

- ความปลอดภัยบนคลาวด์

- Cloud9

- รหัส

- กาแฟ

- รวม

- รวม

- มา

- อย่างธรรมดา

- ชุมชน

- บริษัท

- เปรียบเทียบ

- ซับซ้อน

- การปฏิบัติตาม

- ไม่ขัดขืน

- ส่วนประกอบ

- เข้าใจ

- คอมพิวเตอร์

- วิทยาการคอมพิวเตอร์

- องค์ประกอบ

- เชื่อมต่อ

- การเชื่อมต่อ

- เชื่อมต่อ

- พิจารณา

- เสมอต้นเสมอปลาย

- ปลอบใจ

- ไม่หยุดหย่อน

- เนื้อหา

- การสร้างเนื้อหา

- การสร้างเนื้อหา

- สิ่งแวดล้อม

- บริบท

- ตามบริบท

- อย่างต่อเนื่อง

- ต่อเนื่องกัน

- สะดวกสบาย

- ตามธรรมเนียม

- การสนทนา

- การแปลง

- แกน

- ราคา

- ค่าใช้จ่าย

- หัตถกรรม

- สร้าง

- ที่สร้างขึ้น

- สร้าง

- การสร้าง

- การสร้าง

- สำคัญมาก

- ยุ่งยาก

- อยากรู้อยากเห็น

- ปัจจุบัน

- ประเพณี

- ลูกค้า

- ลูกค้า

- ตัดขอบ

- ข้อมูล

- ฐานข้อมูล

- ฐานข้อมูล

- ชุดข้อมูล

- วันที่

- ลึก

- ลึก

- องศา

- น่ารื่นรมย์

- สาธิต

- การสาธิต

- ขึ้นอยู่กับ

- ปรับใช้

- นำไปใช้

- ปรับใช้

- การใช้งาน

- บรรยาย

- ออกแบบ

- ได้รับการออกแบบ

- ที่ต้องการ

- ทำลาย

- รายละเอียด

- รายละเอียด

- ผู้พัฒนา

- พัฒนาการ

- การวินิจฉัย

- ต่าง

- การจัดจำหน่าย

- ดิจิตอล

- กำกับการแสดง

- แสดง

- แตกต่าง

- การดำน้ำ

- หลาย

- การดำน้ำ

- นักเทียบท่า

- เอกสาร

- เอกสาร

- เอกสาร

- ไม่

- โดเมน

- วาด

- การวาดภาพ

- ขับเคลื่อน

- พลวัต

- อย่างง่ายดาย

- อย่างมีประสิทธิภาพ

- ที่มีประสิทธิภาพ

- อย่างมีประสิทธิภาพ

- ทั้ง

- การกำจัด

- การฝัง

- ออกมา

- พนักงาน

- อำนาจ

- ให้อำนาจ

- ทำให้สามารถ

- เปิดการใช้งาน

- ช่วยให้

- การเปิดใช้งาน

- ปลาย

- ปลายทาง

- ชั้นเยี่ยม

- ที่เพิ่มขึ้น

- เพิ่มคุณค่า

- ทำให้มั่นใจ

- มั่นใจ

- เพื่อให้แน่ใจ

- การสร้างความมั่นใจ

- Enterprise

- ทั้งหมด

- พร้อม

- ข้อผิดพลาด

- โดยเฉพาะอย่างยิ่ง

- แก่นแท้

- ประเมินค่า

- เหตุการณ์

- เคย

- คาย

- การพัฒนา

- ตัวอย่าง

- ตื่นเต้น

- ไพศาล

- ประสบการณ์

- ชำนาญ

- ผู้เชี่ยวชาญ

- สำรวจ

- สำรวจ

- กว้างขวาง

- ภายนอก

- สารสกัด

- ผ้า

- อำนวยความสะดวก

- คุ้นเคย

- รวดเร็ว

- FB

- เป็นไปได้

- ลักษณะ

- คุณสมบัติ

- ที่มีคุณสมบัติ

- เนื้อไม่มีมัน

- กรอง

- หา

- ชื่อจริง

- ความยืดหยุ่น

- มุ่งเน้นไปที่

- ดังต่อไปนี้

- ดังต่อไปนี้

- สำหรับ

- รูป

- พบ

- รากฐาน

- แรงเสียดทาน

- ราคาเริ่มต้นที่

- ด้านหน้า

- ปลายด้านหน้า

- เต็ม

- กองเต็ม

- ฟังก์ชัน

- ฟังก์ชันการทำงาน

- ต่อไป

- นอกจากนี้

- ได้รับ

- ดึงดูด

- เกม

- เกตเวย์

- สร้าง

- สร้าง

- รุ่น

- กำเนิด

- กำเนิด AI

- เครื่องกำเนิดไฟฟ้า

- ได้รับ

- กำหนด

- ให้

- การอนุญาต

- เข้าใจ

- เติบโต

- รับประกัน

- คำแนะนำ

- แนะนำ

- แนวทาง

- จัดการ

- มือบน

- เทียม

- การควบคุม

- มี

- มี

- he

- การช่วยเหลือ

- ประกาศ

- โปรดคลิกที่นี่เพื่ออ่านรายละเอียดเพิ่มเติม

- ไฮไลท์

- ตัวเขาเอง

- ประวัติศาสตร์

- ประวัติ

- โฮลดิ้ง

- ถือ

- สยองขวัญ

- เป็นเจ้าภาพ

- สรุป ความน่าเชื่อถือของ Olymp Trade?

- อย่างไรก็ตาม

- HTML

- ที่ http

- HTTPS

- เป็นมนุษย์

- ความคิด

- ระบุ

- ตัวบ่งชี้

- แยกแยะ

- เอกลักษณ์

- if

- แสดงให้เห็นถึง

- ภาพ

- ภาพ

- ท่วม

- ส่งผลกระทบ

- การดำเนินงาน

- in

- ลึกซึ้ง

- ไม่เที่ยง

- รวมถึง

- รวมทั้ง

- รวมเข้าด้วยกัน

- อิสระ

- ดัชนี

- การจัดทำดัชนี

- ดัชนี

- อุตสาหกรรม

- อุตสาหกรรม

- มาตรฐานอุตสาหกรรม

- อิทธิพล

- ข้อมูล

- แจ้ง

- โครงสร้างพื้นฐาน

- อย่างโดยเนื้อแท้

- แรกเริ่ม

- ที่ริเริ่ม

- เราสร้างสรรค์สิ่งใหม่ ๆ

- นวัตกรรม

- ที่ชาญฉลาด

- ข้อมูลเชิงลึก

- แทน

- คำแนะนำการใช้

- แบบบูรณาการ

- รวม

- บูรณาการ

- การผสานรวม

- ความตั้งใจ

- เชิงโต้ตอบ

- อินเตอร์เฟซ

- การแทรกแซง

- เข้าไป

- แท้จริง

- ล้ำค่า

- IOT

- IT

- รายการ

- ITS

- การสัมภาษณ์

- การเดินทาง

- jpg

- เพียงแค่

- ความรู้

- ที่รู้จักกัน

- ภูมิประเทศ

- ภาษา

- ใหญ่

- ขนาดใหญ่

- แบบ

- การเรียนรู้

- กฎหมาย

- ช่วยให้

- ห้องสมุด

- ได้รับใบอนุญาต

- ชีวิต

- กดไลก์

- ความเป็นไปได้

- ถูก จำกัด

- ขีด จำกัด

- รายการ

- LLM

- ในประเทศ

- ที่ตั้ง

- เครื่อง

- เรียนรู้เครื่อง

- รักษา

- การทำ

- การจัดการ

- คู่มือ

- หลาย

- การตลาด

- มาก

- ปริญญาโท

- ที่ตรงกัน

- วัสดุ

- ความหมาย

- มีความหมาย

- ความหมาย

- วิธี

- กลศาสตร์

- กลไก

- ทางการแพทย์

- หน่วยความจำ

- แค่

- ผสาน

- การผสม

- วิธีการ

- อย่างพิถีพิถัน

- การลด

- การบรรเทา

- ML

- แบบ

- การสร้างแบบจำลอง

- โมเดล

- โมดูลาร์

- ข้อมูลเพิ่มเติม

- มากที่สุด

- Movies

- ต้อง

- โดยธรรมชาติ

- ประมวลผลภาษาธรรมชาติ

- จำเป็น

- จำเป็นต้อง

- จำเป็น

- ต้อง

- ความต้องการ

- ใหม่

- ถัดไป

- เก้า

- NLP

- การประกาศ

- ตอนนี้

- of

- การเสนอ

- เสนอ

- มักจะ

- on

- ONE

- เพียง

- เปิด

- or

- องค์กร

- องค์กร

- เป็นต้นฉบับ

- อื่นๆ

- ของเรา

- ออก

- ผลลัพธ์

- เค้าโครง

- เอาท์พุท

- ด้านนอก

- เกิน

- เอาชนะ

- ก้าว

- ตัวอย่าง

- พารามิเตอร์

- ส่วนหนึ่ง

- หลงใหล

- สมบูรณ์

- สิทธิ์

- ส่วนบุคคล

- Pharma

- เภสัชกรรม

- วลี

- ชิ้น

- นักบิน

- โครงการนำร่อง

- สถานที่

- การวาง

- เวที

- เพลโต

- เพลโตดาต้าอินเทลลิเจนซ์

- เพลโตดาต้า

- เล่น

- เล่น

- จุด

- การวางตำแหน่ง

- เป็นไปได้

- โพสต์

- ที่มีศักยภาพ

- อำนาจ

- ขับเคลื่อน

- ที่มีประสิทธิภาพ

- ประยุกต์

- จำเป็นต้อง

- อย่างแม่นยำ

- ความแม่นยำ

- การตั้งค่า

- ข้อกำหนดเบื้องต้น

- ปัจจุบัน

- ขั้นตอนการ

- กระบวนการ

- แปรรูปแล้ว

- การประมวลผล

- ผลิต

- ผลิต

- การผลิต

- โครงการ

- โปรโมชั่น

- ต้นแบบ

- การสร้างต้นแบบ

- พิสูจน์

- ให้

- ให้

- ให้

- การให้

- คุณภาพ

- คำสั่ง

- คำถาม

- คำถาม

- รวดเร็ว

- อย่างรวดเร็ว

- พิสัย

- พร้อม

- อาณาจักร

- ที่ได้รับ

- การได้รับ

- แนะนำ

- ลด

- ลด

- ลด

- อ้างอิง

- กลั่น

- ของแคว้น

- ภูมิภาค

- ปกติ

- กฎระเบียบ

- หน่วยงานกำกับดูแล

- ปฏิบัติตามกฎระเบียบ

- ความสัมพันธ์กัน

- ตรงประเด็น

- อาศัย

- ยังคง

- ซากศพ

- จำ

- เอาออก

- เรียบเรียงใหม่

- การแสดง

- แสดงให้เห็นถึง

- ขอ

- การร้องขอ

- ต้องการ

- จำเป็นต้องใช้

- ความต้องการ

- ดังก้อง

- แหล่งข้อมูล

- คำตอบ

- การตอบสนอง

- ความรับผิดชอบ

- รับผิดชอบ

- ผลลัพธ์

- ส่งผลให้

- ผลสอบ

- ทบทวน

- รีวิว

- การแก้ไข

- หมุน

- ขวา

- เข้มงวด

- บทบาท

- วิ่ง

- ทำงาน

- sagemaker

- เดียวกัน

- ที่บันทึกไว้

- วิทยาศาสตร์

- วิทยาศาสตร์

- ไร้รอยต่อ

- ได้อย่างลงตัว

- ค้นหา

- ส่วน

- ปลอดภัย

- อย่างปลอดภัย

- ความปลอดภัย

- เลือก

- การเลือก

- ระดับอาวุโส

- ส่ง

- บริการ

- บริการ

- ชุด

- การตั้งค่า

- การติดตั้ง

- เปลี่ยน

- แสดง

- แสดงให้เห็นว่า

- ร่อน

- สำคัญ

- อย่างมีความหมาย

- ง่าย

- ง่ายดาย

- มีขนาดเล็กกว่า

- เรียบเนียน

- ซอฟต์แวร์

- การพัฒนาซอฟต์แวร์

- วิศวกรรมซอฟต์แวร์

- เพียงผู้เดียว

- ทางออก

- โซลูชัน

- แหล่ง

- ที่มา

- แหล่งที่มา

- การจัดหา

- ช่องว่าง

- ระยะ

- เฉพาะ

- ความเชี่ยวชาญ

- โดยเฉพาะ

- ที่ระบุไว้

- มั่นคง

- กอง

- มาตรฐาน

- ที่เริ่มต้น

- รัฐของศิลปะ

- เข้าพัก

- ขั้นตอน

- ขั้นตอน

- หยุด

- การเก็บรักษา

- จัดเก็บ

- เก็บไว้

- การเก็บรักษา

- คล่องตัว

- จุดแข็ง

- เชือก

- เข้มงวด

- โครงสร้าง

- สไตล์

- ส่ง

- อย่างเช่น

- เหมาะสม

- สนับสนุน

- ที่สนับสนุน

- ทำงานร่วมกัน

- ระบบ

- ปรับปรุง

- เอา

- ใช้เวลา

- แน่ชัด

- งาน

- งาน

- ทีม

- ทีม

- เทคนิค

- เทคโนโลยี

- เทคโนโลยี

- จะ

- ข้อความ

- กว่า

- ที่

- พื้นที่

- ภูมิทัศน์

- ที่มา

- โลก

- ของพวกเขา

- พวกเขา

- แล้วก็

- ดังนั้น

- ล้อยางขัดเหล่านี้ติดตั้งบนแกน XNUMX (มม.) ผลิตภัณฑ์นี้ถูกผลิตในหลายรูปทรง และหลากหลายเบอร์ความแน่นหนาของปริมาณอนุภาคขัดของมัน จะทำให้ท่านได้รับประสิทธิภาพสูงในการขัดและการใช้งานที่ยาวนาน

- พวกเขา

- นี้

- สาม

- น่าตื่นเต้น

- ตลอด

- เวลา

- ทันเวลา

- การประทับเวลา

- ยักษ์

- ไปยัง

- วันนี้

- เครื่องมือ

- เครื่องมือ

- หัวข้อ

- หัวข้อ

- ไปทาง

- แบบดั้งเดิม

- รถไฟ

- ผ่านการฝึกอบรม

- การฝึกอบรม

- โอน

- โอน

- การถ่ายโอน

- แปลง

- การเปลี่ยนแปลง

- หม้อแปลง

- แนวโน้ม

- อย่างแท้จริง

- เชื่อถือได้

- กลับ

- เกี่ยวกับการสอน

- บทเรียน

- ชนิด

- ui

- ได้รับ

- พื้นฐาน

- เข้าใจ

- ความเข้าใจ

- เป็นเอกลักษณ์

- มหาวิทยาลัย

- แตกต่าง

- ไม่จำเป็น

- เปิดเผย

- ทันเหตุการณ์

- บันทึก

- ให้กับคุณ

- การปรับปรุง

- การส่งเสริม

- เมื่อ

- ใช้

- ใช้กรณี

- ผู้ใช้งาน

- ส่วนติดต่อผู้ใช้

- ผู้ใช้

- ใช้

- การใช้

- มักจะ

- ใช้ประโยชน์

- การใช้ประโยชน์

- ต่างๆ

- กว้างใหญ่

- อเนกประสงค์

- ผ่านทาง

- วีดีโอ

- วิดีโอเกม

- วิสัยทัศน์

- ทาง..

- we

- ความมั่งคั่ง

- เว็บ

- โปรแกรมประยุกต์บนเว็บ

- บริการเว็บ

- เว็บซ็อกเก็ต

- คือ

- เมื่อ

- ที่

- ในขณะที่

- WHO

- กว้าง

- ช่วงกว้าง

- จะ

- กับ

- ภายใน

- ไม่มี

- คำ

- งาน

- เวิร์กโฟลว์

- เวิร์กสเตชัน

- โลก

- คุณ

- ของคุณ

- ด้วยตัวคุณเอง

- ลมทะเล