บทนำ

ในแมชชีนเลิร์นนิง การแลกเปลี่ยนอคติกับความแปรปรวนเป็นแนวคิดพื้นฐานที่ส่งผลต่อประสิทธิภาพของโมเดลการทำนายใดๆ มันหมายถึงความสมดุลที่ละเอียดอ่อนระหว่างข้อผิดพลาดอคติและข้อผิดพลาดความแปรปรวนของแบบจำลอง เนื่องจากเป็นไปไม่ได้ที่จะย่อทั้งสองอย่างพร้อมกัน การสร้างสมดุลที่เหมาะสมเป็นสิ่งสำคัญสำหรับการบรรลุประสิทธิภาพของโมเดลที่เหมาะสมที่สุด

ในบทความสั้นๆ นี้ เราจะให้คำจำกัดความของอคติและความแปรปรวน อธิบายว่าสิ่งเหล่านี้ส่งผลต่อโมเดลแมชชีนเลิร์นนิงอย่างไร และให้คำแนะนำเชิงปฏิบัติเกี่ยวกับวิธีจัดการกับสิ่งเหล่านี้ในทางปฏิบัติ

ทำความเข้าใจอคติและความแปรปรวน

ก่อนที่จะลงลึกถึงความสัมพันธ์ระหว่างอคติและความแปรปรวน เรามานิยามความหมายของคำเหล่านี้ในแมชชีนเลิร์นนิงกันก่อน

ข้อผิดพลาดอคติหมายถึงความแตกต่างระหว่างการทำนายของแบบจำลองและค่าที่ถูกต้องที่พยายามทำนาย (ความจริงพื้นฐาน) กล่าวอีกนัยหนึ่ง อคติคือข้อผิดพลาดที่ตัวแบบกระทำเนื่องจากสมมติฐานที่ไม่ถูกต้องเกี่ยวกับการกระจายข้อมูลพื้นฐาน แบบจำลองที่มีอคติสูงมักจะเรียบง่ายเกินไป ทำให้ไม่สามารถจับความซับซ้อนของข้อมูลได้ ซึ่งนำไปสู่ความไม่เหมาะสม

ในทางกลับกัน ข้อผิดพลาดความแปรปรวนหมายถึงความไวของแบบจำลองต่อความผันผวนเล็กน้อยในข้อมูลการฝึกอบรม โมเดลความแปรปรวนสูงมีความซับซ้อนมากเกินไปและมีแนวโน้มที่จะพอดีกับสัญญาณรบกวนในข้อมูล แทนที่จะเป็นรูปแบบพื้นฐาน ซึ่งนำไปสู่การโอเวอร์ฟิต ส่งผลให้ประสิทธิภาพการทำงานต่ำสำหรับข้อมูลใหม่ที่มองไม่เห็น

ความเอนเอียงสูงอาจนำไปสู่ความไม่พอดี ซึ่งโมเดลนั้นง่ายเกินไปที่จะจับความซับซ้อนของข้อมูล มันสร้างสมมติฐานที่ชัดเจนเกี่ยวกับข้อมูลและล้มเหลวในการจับความสัมพันธ์ที่แท้จริงระหว่างตัวแปรอินพุตและเอาต์พุต ในทางกลับกัน ความแปรปรวนสูงอาจนำไปสู่การ overfitting โดยที่โมเดลซับซ้อนเกินไปและเรียนรู้จุดรบกวนในข้อมูลมากกว่าความสัมพันธ์พื้นฐานระหว่างตัวแปรอินพุตและเอาต์พุต ดังนั้น แบบจำลองที่มากเกินไปมักจะพอดีกับข้อมูลการฝึกอบรมอย่างใกล้ชิดเกินไป และไม่สามารถสรุปได้ดีกับข้อมูลใหม่ ในขณะที่แบบจำลองที่ไม่เหมาะสมเกินไปจะไม่สามารถพอดีกับข้อมูลการฝึกอบรมได้อย่างถูกต้อง

ดังที่ได้กล่าวไว้ก่อนหน้านี้ ความเอนเอียงและความแปรปรวนมีความเกี่ยวข้องกัน และแบบจำลองที่ดีจะสร้างสมดุลระหว่างความคลาดเคลื่อนทางอคติและความคลาดเคลื่อนทางความแปรปรวน การแลกเปลี่ยนอคติกับความแปรปรวนเป็นกระบวนการค้นหาสมดุลที่เหมาะสมที่สุดระหว่างแหล่งที่มาของข้อผิดพลาดทั้งสองนี้ โมเดลที่มีอคติต่ำและความแปรปรวนต่ำน่าจะทำงานได้ดีทั้งกับการฝึกและข้อมูลใหม่ โดยลดข้อผิดพลาดทั้งหมดให้เหลือน้อยที่สุด

Bias-Variance Trade-Off

การสร้างสมดุลระหว่างความซับซ้อนของโมเดลและความสามารถในการสรุปข้อมูลทั่วไปที่ไม่รู้จักคือหัวใจหลักของการแลกเปลี่ยนอคติและความแปรปรวน โดยทั่วไป โมเดลที่ซับซ้อนกว่าจะมีไบแอสต่ำกว่าแต่มีความแปรปรวนสูงกว่า ในขณะที่โมเดลที่เรียบง่ายกว่าจะมีไบแอสสูงกว่าแต่มีความแปรปรวนต่ำกว่า

เนื่องจากเป็นไปไม่ได้ที่จะลดอคติและความแปรปรวนให้เหลือน้อยที่สุด การหาจุดสมดุลระหว่างกันจึงเป็นสิ่งสำคัญในการสร้างโมเดลแมชชีนเลิร์นนิงที่มีประสิทธิภาพ ตัวอย่างเช่น เมื่อเราเพิ่มความซับซ้อนของแบบจำลอง เราก็เพิ่มความแปรปรวนด้วย นี่เป็นเพราะโมเดลที่ซับซ้อนกว่ามีแนวโน้มที่จะพอดีกับสัญญาณรบกวนในข้อมูลการฝึก ซึ่งจะนำไปสู่การโอเวอร์ฟิตติ้ง

ในทางกลับกัน หากเราทำให้โมเดลเรียบง่ายเกินไป เราจะเพิ่มความเอนเอียง นี่เป็นเพราะแบบจำลองที่เรียบง่ายกว่าจะไม่สามารถจับความสัมพันธ์พื้นฐานในข้อมูลได้ ซึ่งจะนำไปสู่การไม่เหมาะสม

เป้าหมายคือการฝึกโมเดลที่ซับซ้อนพอที่จะจับความสัมพันธ์พื้นฐานในข้อมูลการฝึก แต่ไม่ซับซ้อนจนเกินพอดีในข้อมูลการฝึก

Bias-Variance Trade-Off ในทางปฏิบัติ

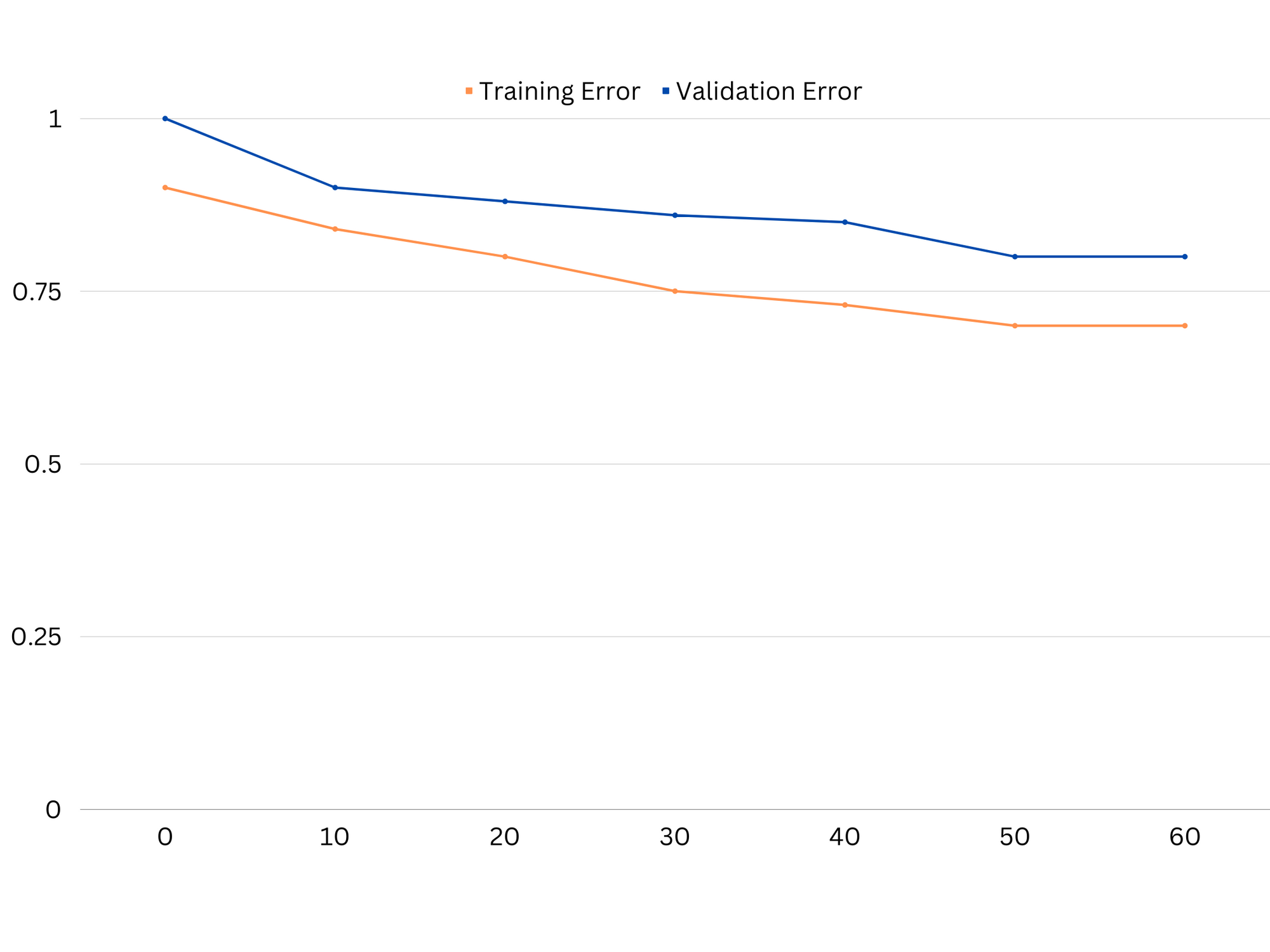

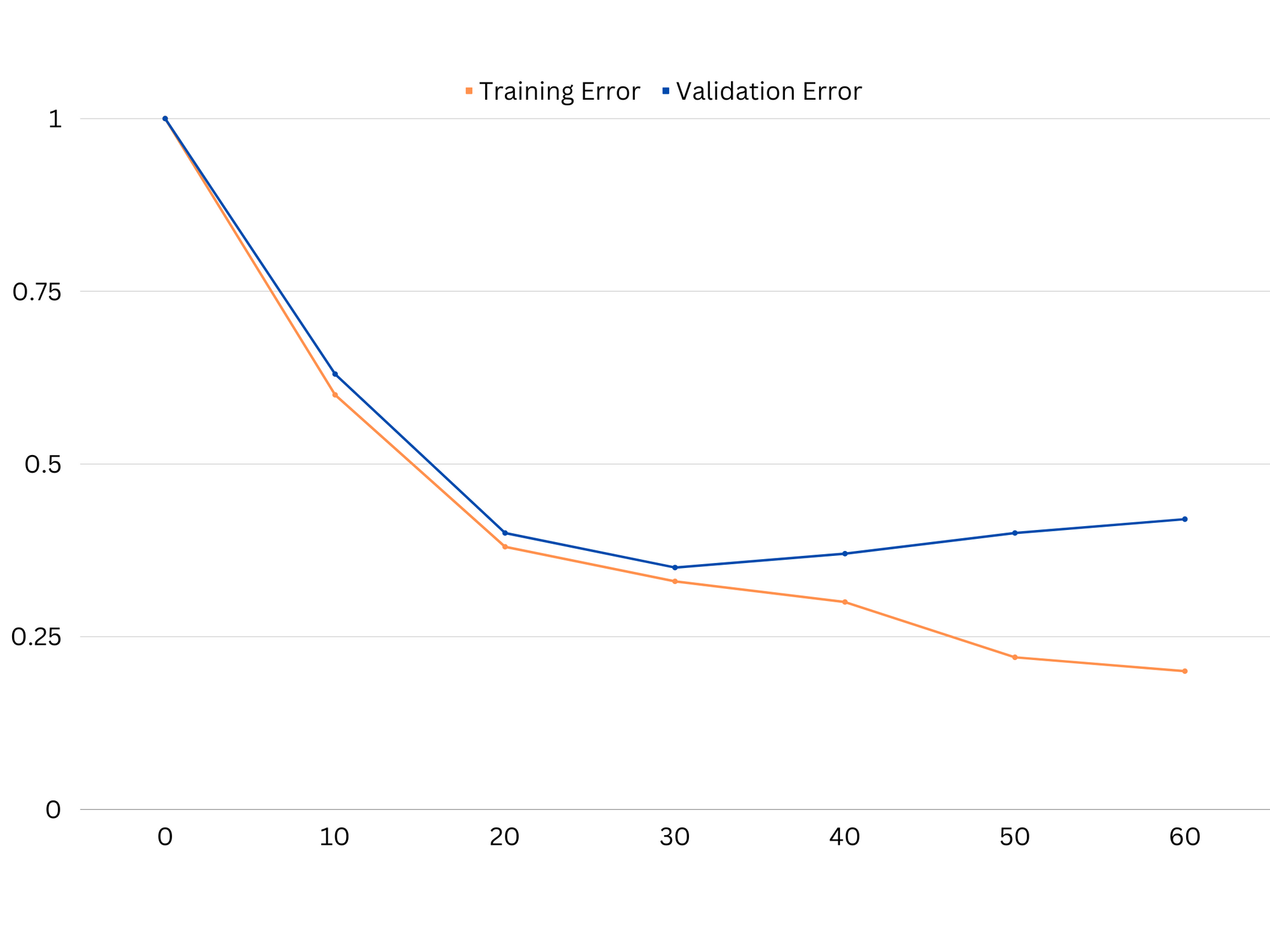

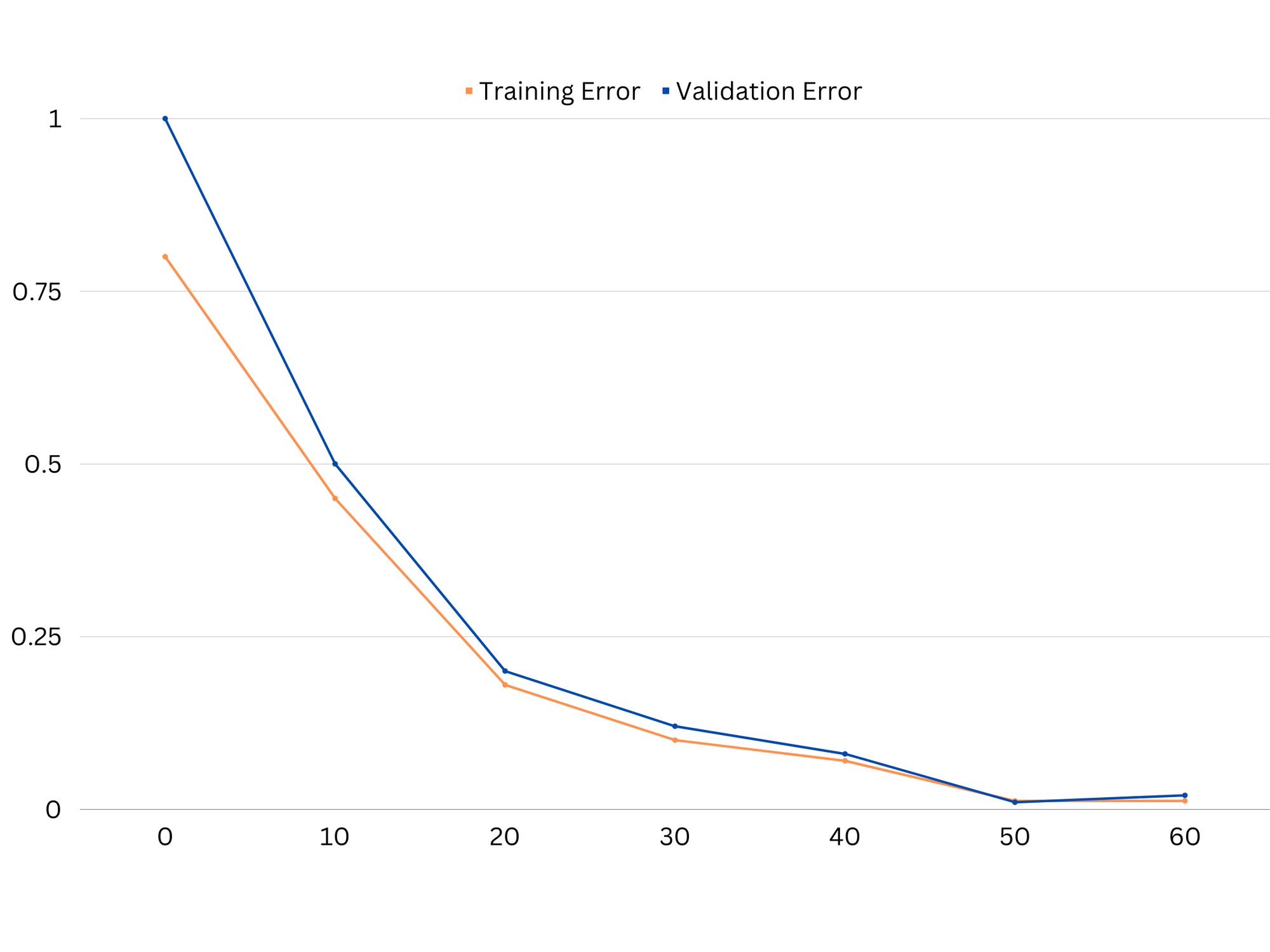

ในการวินิจฉัยประสิทธิภาพของโมเดล โดยทั่วไปเราจะคำนวณและเปรียบเทียบข้อผิดพลาดของรถไฟและการตรวจสอบความถูกต้อง เครื่องมือที่มีประโยชน์สำหรับการแสดงภาพนี้คือโครงเรื่องของเส้นโค้งการเรียนรู้ ซึ่งแสดงประสิทธิภาพของแบบจำลองทั้งบนรถไฟและข้อมูลการตรวจสอบความถูกต้องตลอดกระบวนการฝึกอบรม จากการตรวจสอบเส้นโค้งเหล่านี้ เราสามารถระบุได้ว่าโมเดลมีความเหมาะสมมากเกินไป (ความแปรปรวนสูง) ไม่เหมาะสม (อคติสูง) หรือเหมาะสม (สมดุลที่เหมาะสมที่สุดระหว่างความเอนเอียงและความแปรปรวน)

ตัวอย่างกราฟการเรียนรู้ของโมเดลที่ไม่เหมาะสม ทั้งข้อผิดพลาดของรถไฟและข้อผิดพลาดในการตรวจสอบสูง

ในทางปฏิบัติ ประสิทธิภาพต่ำทั้งข้อมูลการฝึกอบรมและการตรวจสอบแสดงว่าโมเดลนั้นเรียบง่ายเกินไป ซึ่งนำไปสู่การไม่เหมาะสม ในทางกลับกัน ถ้าโมเดลทำงานได้ดีมากกับข้อมูลการฝึก แต่ไม่ดีสำหรับข้อมูลการทดสอบ ความซับซ้อนของโมเดลน่าจะสูงเกินไป ส่งผลให้เกิดการโอเวอร์ฟิตติ้ง เพื่อจัดการกับความไม่พอดี เราสามารถลองเพิ่มความซับซ้อนของโมเดลโดยเพิ่มคุณสมบัติให้มากขึ้น เปลี่ยนอัลกอริทึมการเรียนรู้ หรือเลือกไฮเปอร์พารามิเตอร์ต่างๆ ในกรณีของ overfitting เราควรพิจารณาการทำให้โมเดลเป็นมาตรฐานหรือใช้เทคนิคต่างๆ เช่น การตรวจสอบความถูกต้องข้าม เพื่อปรับปรุงความสามารถในการทำให้เป็นภาพรวม

ตัวอย่างของกราฟการเรียนรู้ของโมเดลที่เกินพอดี ข้อผิดพลาดของรถไฟลดลงในขณะที่ข้อผิดพลาดในการตรวจสอบเริ่มเพิ่มขึ้น แบบจำลองไม่สามารถสรุปได้

การทำให้เป็นมาตรฐานเป็นเทคนิคที่สามารถใช้เพื่อลดข้อผิดพลาดเกี่ยวกับความแปรปรวนในโมเดลแมชชีนเลิร์นนิง ซึ่งช่วยจัดการกับการแลกเปลี่ยนอคติกับความแปรปรวน มีเทคนิคการทำให้เป็นมาตรฐานที่แตกต่างกันจำนวนมาก ซึ่งแต่ละอย่างมีข้อดีและข้อเสียของตัวเอง เทคนิคการทำให้เป็นมาตรฐานที่เป็นที่นิยม ได้แก่ การถดถอยสัน การถดถอยแบบเชือก และการทำให้เป็นมาตรฐานแบบยืดหยุ่น เทคนิคทั้งหมดเหล่านี้ช่วยป้องกันไม่ให้ overfitting โดยการเพิ่มเงื่อนไขการลงโทษในฟังก์ชันวัตถุประสงค์ของโมเดล ซึ่งกีดกันค่าพารามิเตอร์ที่สูงเกินไปและส่งเสริมโมเดลที่เรียบง่าย

การถดถอยของสันเขาหรือที่เรียกว่าการทำให้เป็นมาตรฐาน L2 เพิ่มเงื่อนไขการลงโทษตามสัดส่วนกับกำลังสองของพารามิเตอร์แบบจำลอง เทคนิคนี้มีแนวโน้มที่จะส่งผลให้โมเดลมีค่าพารามิเตอร์น้อยลง ซึ่งอาจนำไปสู่การลดความแปรปรวนและการปรับปรุงลักษณะทั่วไป อย่างไรก็ตาม มันไม่ได้ดำเนินการเลือกคุณสมบัติ ดังนั้นคุณสมบัติทั้งหมดยังคงอยู่ในโมเดล

ดูคู่มือเชิงปฏิบัติสำหรับการเรียนรู้ Git ที่มีแนวทางปฏิบัติที่ดีที่สุด มาตรฐานที่ยอมรับในอุตสาหกรรม และเอกสารสรุปรวม หยุดคำสั่ง Googling Git และจริงๆ แล้ว เรียน มัน!

การถดถอยแบบ Lassoหรือการทำให้เป็นมาตรฐาน L1 เพิ่มเงื่อนไขการลงโทษตามสัดส่วนของค่าสัมบูรณ์ของพารามิเตอร์แบบจำลอง เทคนิคนี้สามารถนำไปสู่แบบจำลองที่มีค่าพารามิเตอร์กระจัดกระจาย ดำเนินการเลือกคุณลักษณะได้อย่างมีประสิทธิภาพโดยการตั้งค่าพารามิเตอร์บางตัวเป็นศูนย์ ซึ่งอาจส่งผลให้โมเดลที่เรียบง่ายและตีความได้ง่ายกว่า

การทำให้เป็นมาตรฐานสุทธิแบบยืดหยุ่น เป็นการผสมผสานระหว่างการทำให้เป็นมาตรฐานทั้ง L1 และ L2 ทำให้เกิดความสมดุลระหว่างการถดถอยของสันและบ่วงบาศ โดยการควบคุมอัตราส่วนระหว่างเงื่อนไขการลงโทษทั้งสอง ตาข่ายยืดหยุ่นสามารถได้รับประโยชน์จากทั้งสองเทคนิค เช่น การปรับปรุงลักษณะทั่วไปและการเลือกคุณสมบัติ

ตัวอย่างเส้นโค้งการเรียนรู้ของตัวแบบที่เหมาะสม

สรุป

การแลกเปลี่ยนอคติและความแปรปรวนเป็นแนวคิดที่สำคัญในการเรียนรู้ของเครื่องที่กำหนดประสิทธิภาพและความดีของแบบจำลอง แม้ว่าความเอนเอียงสูงจะนำไปสู่ความไม่พอดีและความแปรปรวนสูงนำไปสู่การเกินพอดี การหาสมดุลที่เหมาะสมที่สุดระหว่างสองสิ่งนี้เป็นสิ่งจำเป็นสำหรับการสร้างแบบจำลองที่แข็งแกร่งซึ่งสรุปได้ดีกับข้อมูลใหม่

ด้วยความช่วยเหลือของเส้นโค้งการเรียนรู้ ทำให้สามารถระบุปัญหาที่มากเกินไปหรือน้อยเกินไปได้ และด้วยการปรับความซับซ้อนของแบบจำลองหรือการใช้เทคนิคการทำให้เป็นมาตรฐาน จึงสามารถปรับปรุงประสิทธิภาพของทั้งข้อมูลการฝึกอบรมและการตรวจสอบความถูกต้อง ตลอดจนข้อมูลการทดสอบ

- เนื้อหาที่ขับเคลื่อนด้วย SEO และการเผยแพร่ประชาสัมพันธ์ รับการขยายวันนี้

- เพลโตไอสตรีม. ข้อมูลอัจฉริยะ Web3 ขยายความรู้ เข้าถึงได้ที่นี่.

- การสร้างอนาคตโดย Adryenn Ashley เข้าถึงได้ที่นี่.

- ซื้อและขายหุ้นในบริษัท PRE-IPO ด้วย PREIPO® เข้าถึงได้ที่นี่.

- ที่มา: https://stackabuse.com/the-bias-variance-trade-off-in-machine-learning/

- :เป็น

- :ไม่

- :ที่ไหน

- 1

- 12

- 20

- 8

- a

- ความสามารถ

- สามารถ

- เกี่ยวกับเรา

- แน่นอน

- แม่นยำ

- บรรลุ

- การบรรลุ

- จริง

- เพิ่ม

- ที่อยู่

- เพิ่ม

- ข้อได้เปรียบ

- คำแนะนำ

- มีผลต่อ

- น่าสงสาร

- ขั้นตอนวิธี

- ทั้งหมด

- การอนุญาต

- ด้วย

- an

- และ

- ใด

- เป็น

- บทความ

- AS

- ยอดคงเหลือ

- ยอดคงเหลือ

- BE

- เพราะ

- ประโยชน์ที่ได้รับ

- ระหว่าง

- อคติ

- ชายแดน

- ทั้งสอง

- การก่อสร้าง

- แต่

- by

- คำนวณ

- CAN

- ความสามารถในการ

- จับ

- กรณี

- เปลี่ยนแปลง

- เลือก

- อย่างใกล้ชิด

- การผสมผสาน

- เปรียบเทียบ

- ซับซ้อน

- ความซับซ้อน

- แนวคิด

- พิจารณา

- การควบคุม

- แกน

- แก้ไข

- สำคัญมาก

- ข้อมูล

- จัดการ

- ลดลง

- กำหนด

- แน่นอน

- ความแตกต่าง

- ต่าง

- แสดง

- การกระจาย

- ทำ

- สอง

- แต่ละ

- ก่อน

- ง่ายดาย

- มีประสิทธิภาพ

- ประสิทธิผล

- กระตุ้นให้เกิดการ

- พอ

- ความผิดพลาด

- ข้อผิดพลาด

- แม้

- การตรวจสอบ

- ตัวอย่าง

- อธิบาย

- สุดโต่ง

- ความล้มเหลว

- ล้มเหลว

- ลักษณะ

- คุณสมบัติ

- หา

- พอดี

- เหมาะสม

- ความผันผวน

- โฟกัส

- สำหรับ

- ฟังก์ชัน

- พื้นฐาน

- General

- ไป

- เป้าหมาย

- ดี

- พื้น

- ให้คำแนะนำ

- มือ

- มือบน

- มี

- ช่วย

- การช่วยเหลือ

- จุดสูง

- สูงกว่า

- โฉบ

- สรุป ความน่าเชื่อถือของ Olymp Trade?

- ทำอย่างไร

- อย่างไรก็ตาม

- HTTPS

- แยกแยะ

- if

- การดำเนินการ

- เป็นไปไม่ได้

- ปรับปรุง

- การปรับปรุง

- in

- ในอื่น ๆ

- ประกอบด้วย

- รวม

- เพิ่ม

- ที่เพิ่มขึ้น

- อินพุต

- เข้าไป

- บทนำ

- IT

- ITS

- เก็บ

- ที่รู้จักกัน

- L1

- l2

- นำ

- ชั้นนำ

- นำไปสู่

- การเรียนรู้

- ให้

- LG

- กดไลก์

- น่าจะ

- ll

- ต่ำ

- ลด

- เครื่อง

- เรียนรู้เครื่อง

- ทำให้

- กล่าวถึง

- การลด

- แบบ

- โมเดล

- ข้อมูลเพิ่มเติม

- จำเป็น

- สุทธิ

- ใหม่

- สัญญาณรบกวน

- จำนวน

- วัตถุประสงค์

- of

- มักจะ

- on

- ดีที่สุด

- or

- อื่นๆ

- ของเรา

- ออก

- เอาท์พุต

- ของตนเอง

- พารามิเตอร์

- พารามิเตอร์

- แบบแผน

- ดำเนินการ

- การปฏิบัติ

- ที่มีประสิทธิภาพ

- ดำเนินการ

- เพลโต

- เพลโตดาต้าอินเทลลิเจนซ์

- เพลโตดาต้า

- น่าสงสาร

- ยอดนิยม

- เป็นไปได้

- ประยุกต์

- การปฏิบัติ

- คาดการณ์

- คำทำนาย

- ป้องกัน

- ปัญหาที่เกิดขึ้น

- กระบวนการ

- ให้

- ค่อนข้าง

- อัตราส่วน

- ลด

- ลดลง

- หมายถึง

- ที่เกี่ยวข้อง

- ความสัมพันธ์

- ความสัมพันธ์

- ยังคง

- แสดง

- ผล

- ส่งผลให้

- ผลสอบ

- ขวา

- แหวน

- แข็งแรง

- s

- การเลือก

- ความไว

- การตั้งค่า

- เงา

- แผ่น

- สั้น

- น่า

- ง่าย

- พร้อมกัน

- เล็ก

- มีขนาดเล็กกว่า

- So

- บาง

- แหล่งที่มา

- สี่เหลี่ยม

- สแต็ค

- มาตรฐาน

- หยุด

- แข็งแรง

- อย่างเช่น

- ชี้ให้เห็นถึง

- เทคนิค

- ระยะ

- เงื่อนไขการใช้บริการ

- ทดสอบ

- กว่า

- ที่

- พื้นที่

- ของพวกเขา

- พวกเขา

- ที่นั่น

- ล้อยางขัดเหล่านี้ติดตั้งบนแกน XNUMX (มม.) ผลิตภัณฑ์นี้ถูกผลิตในหลายรูปทรง และหลากหลายเบอร์ความแน่นหนาของปริมาณอนุภาคขัดของมัน จะทำให้ท่านได้รับประสิทธิภาพสูงในการขัดและการใช้งานที่ยาวนาน

- พวกเขา

- นี้

- ตลอด

- ไปยัง

- เกินไป

- เครื่องมือ

- รวม

- รถไฟ

- การฝึกอบรม

- การเปลี่ยนแปลง

- จริง

- ความจริง

- ลอง

- สอง

- เป็นปกติ

- ไม่สามารถ

- พื้นฐาน

- ไม่ทราบ

- มือสอง

- การใช้

- การตรวจสอบ

- ความคุ้มค่า

- ความคุ้มค่า

- มาก

- we

- ดี

- อะไร

- ว่า

- ที่

- ในขณะที่

- จะ

- กับ

- คำ

- ลมทะเล

- เป็นศูนย์