ในช่วงไม่กี่ปีที่ผ่านมา Large Language Models (LLM) ได้กลายเป็นเครื่องมือที่โดดเด่นในการทำความเข้าใจ สร้าง และจัดการข้อความด้วยความเชี่ยวชาญอย่างที่ไม่เคยมีมาก่อน การใช้งานที่เป็นไปได้ครอบคลุมตั้งแต่ตัวแทนการสนทนาไปจนถึงการสร้างเนื้อหาและการดึงข้อมูล ซึ่งถือเป็นคำมั่นสัญญาว่าจะปฏิวัติทุกอุตสาหกรรม อย่างไรก็ตาม การควบคุมศักยภาพนี้ในขณะเดียวกันก็รับประกันการใช้แบบจำลองเหล่านี้อย่างมีความรับผิดชอบและมีประสิทธิภาพนั้น ขึ้นอยู่กับกระบวนการที่สำคัญของการประเมิน LLM การประเมินเป็นงานที่ใช้ในการวัดคุณภาพและความรับผิดชอบของเอาท์พุตของ LLM หรือบริการ AI เชิงสร้างสรรค์ การประเมิน LLM ไม่เพียงได้รับแรงบันดาลใจจากความปรารถนาที่จะเข้าใจประสิทธิภาพของแบบจำลองเท่านั้น แต่ยังรวมถึงความจำเป็นในการใช้ AI ที่มีความรับผิดชอบ และโดยความจำเป็นในการลดความเสี่ยงในการให้ข้อมูลที่ผิดหรือเนื้อหาที่มีอคติ และเพื่อลดการสร้างเนื้อหาที่เป็นอันตราย ไม่ปลอดภัย มุ่งร้าย และผิดจริยธรรม เนื้อหา. นอกจากนี้ การประเมิน LLM ยังสามารถช่วยลดความเสี่ยงด้านความปลอดภัย โดยเฉพาะอย่างยิ่งในบริบทของการดัดแปลงข้อมูลโดยทันที สำหรับแอปพลิเคชันที่ใช้ LLM การระบุช่องโหว่และใช้มาตรการป้องกันเพื่อป้องกันการละเมิดที่อาจเกิดขึ้นและการดัดแปลงข้อมูลที่ไม่ได้รับอนุญาตถือเป็นสิ่งสำคัญ

ด้วยการมอบเครื่องมือที่จำเป็นสำหรับการประเมิน LLM ด้วยการกำหนดค่าที่ตรงไปตรงมาและวิธีการเพียงคลิกเดียว Amazon SageMaker ชี้แจง ความสามารถในการประเมิน LLM ช่วยให้ลูกค้าสามารถเข้าถึงสิทธิประโยชน์ส่วนใหญ่ที่กล่าวมาข้างต้น ด้วยเครื่องมือเหล่านี้ ความท้าทายต่อไปคือการรวมการประเมิน LLM เข้ากับวงจรการเรียนรู้ของเครื่องจักรและการดำเนินงาน (MLOps) เพื่อให้เกิดระบบอัตโนมัติและความสามารถในการปรับขนาดในกระบวนการ ในโพสต์นี้ เราจะแสดงวิธีผสานรวมการประเมิน Amazon SageMaker Clarify LLM เข้ากับ Amazon SageMaker Pipelines เพื่อเปิดใช้งานการประเมิน LLM ในวงกว้าง นอกจากนี้ เรายังให้ตัวอย่างโค้ดในเรื่องนี้ด้วย GitHub พื้นที่เก็บข้อมูลเพื่อให้ผู้ใช้สามารถดำเนินการประเมินหลายโมเดลแบบขนานในวงกว้าง โดยใช้ตัวอย่าง เช่น Llama2-7b-f, Falcon-7b และโมเดล Llama2-7b ที่ปรับแต่งอย่างละเอียด

ใครบ้างที่ต้องทำการประเมิน LLM

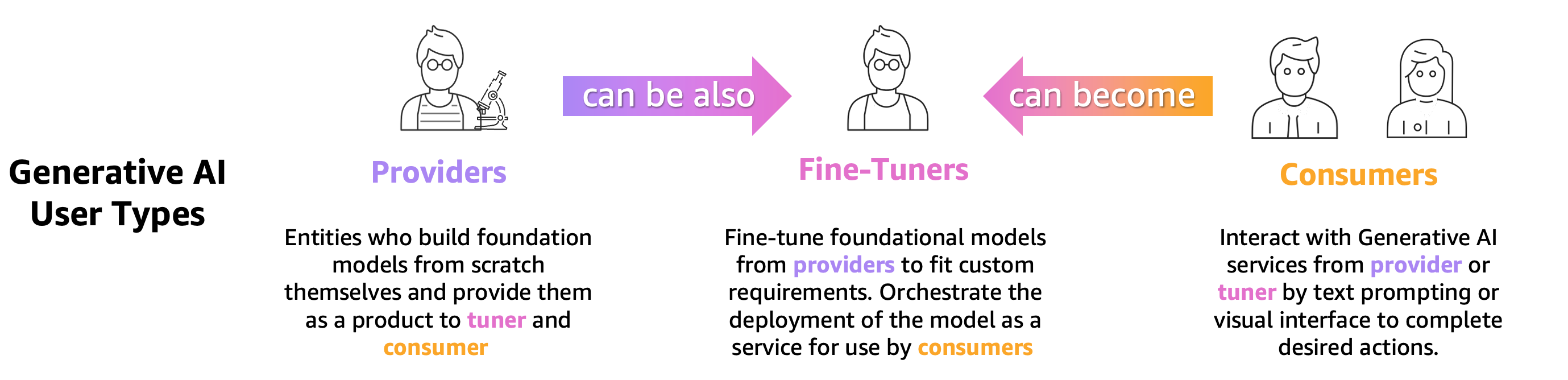

ใครก็ตามที่ฝึกฝน ปรับแต่ง หรือเพียงแค่ใช้ LLM ที่ได้รับการฝึกอบรมล่วงหน้า จะต้องประเมินอย่างแม่นยำเพื่อประเมินพฤติกรรมของแอปพลิเคชันที่ขับเคลื่อนโดย LLM นั้น ตามหลักการนี้ เราสามารถจัดประเภทผู้ใช้ AI ทั่วไปที่ต้องการความสามารถในการประเมิน LLM ออกเป็น 3 กลุ่มดังแสดงในรูปต่อไปนี้: ผู้ให้บริการโมเดล ผู้ปรับแต่ง และผู้บริโภค

- ผู้ให้บริการโมเดลพื้นฐาน (FM) โมเดลรถไฟที่มีวัตถุประสงค์ทั่วไป โมเดลเหล่านี้สามารถใช้สำหรับงานดาวน์สตรีมได้หลายอย่าง เช่น การแยกคุณสมบัติหรือเพื่อสร้างเนื้อหา โมเดลที่ผ่านการฝึกอบรมแต่ละโมเดลจะต้องมีการเปรียบเทียบเทียบกับงานต่างๆ มากมาย ไม่เพียงแต่เพื่อประเมินประสิทธิภาพของโมเดลเท่านั้น แต่ยังต้องเปรียบเทียบกับโมเดลอื่นๆ ที่มีอยู่ด้วย เพื่อระบุพื้นที่ที่ต้องการการปรับปรุง และสุดท้ายคือเพื่อติดตามความก้าวหน้าในสาขานั้น ผู้ให้บริการโมเดลยังต้องตรวจสอบการมีอยู่ของอคติใดๆ เพื่อให้มั่นใจในคุณภาพของชุดข้อมูลเริ่มต้นและพฤติกรรมที่ถูกต้องของโมเดล การรวบรวมข้อมูลการประเมินถือเป็นสิ่งสำคัญสำหรับผู้ให้บริการโมเดล นอกจากนี้ ข้อมูลและตัวชี้วัดเหล่านี้จะต้องถูกรวบรวมเพื่อให้สอดคล้องกับกฎระเบียบที่กำลังจะมีขึ้น ISO.42001ที่ คำสั่งผู้บริหารฝ่ายบริหารของไบเดนและ พระราชบัญญัติ AI ของสหภาพยุโรป พัฒนามาตรฐาน เครื่องมือ และการทดสอบเพื่อช่วยให้มั่นใจว่าระบบ AI ปลอดภัย มั่นคง และเชื่อถือได้ ตัวอย่างเช่น พระราชบัญญัติ AI ของสหภาพยุโรปได้รับมอบหมายให้ให้ข้อมูลว่าชุดข้อมูลใดบ้างที่ใช้ในการฝึกอบรม พลังการประมวลผลใดที่จำเป็นในการรันโมเดล รายงานผลลัพธ์ของโมเดลเทียบกับเกณฑ์มาตรฐานสาธารณะ/มาตรฐานอุตสาหกรรม และแบ่งปันผลลัพธ์ของการทดสอบภายในและภายนอก

- รุ่น จูนเนอร์แบบละเอียด ต้องการแก้ปัญหางานเฉพาะ (เช่น การจำแนกความรู้สึก การสรุป การตอบคำถาม) รวมถึงโมเดลที่ได้รับการฝึกอบรมล่วงหน้าสำหรับการนำงานเฉพาะโดเมนไปใช้ พวกเขาต้องการตัววัดการประเมินที่สร้างโดยผู้ให้บริการโมเดลเพื่อเลือกโมเดลที่ผ่านการฝึกอบรมล่วงหน้าที่เหมาะสมเป็นจุดเริ่มต้น

พวกเขาจำเป็นต้องประเมินโมเดลที่ได้รับการปรับแต่งโดยเทียบกับกรณีการใช้งานที่ต้องการด้วยชุดข้อมูลเฉพาะงานหรือเฉพาะโดเมน บ่อยครั้งที่พวกเขาต้องดูแลจัดการและสร้างชุดข้อมูลส่วนตัว เนื่องจากชุดข้อมูลที่เปิดเผยต่อสาธารณะ แม้กระทั่งชุดข้อมูลที่ออกแบบมาสำหรับงานเฉพาะเจาะจง อาจไม่สามารถจับความแตกต่างที่จำเป็นสำหรับกรณีการใช้งานเฉพาะได้อย่างเพียงพอ

การปรับแต่งอย่างละเอียดนั้นเร็วกว่าและราคาถูกกว่าการฝึกอบรมเต็มรูปแบบ และต้องมีการดำเนินการซ้ำที่เร็วกว่าสำหรับการปรับใช้และการทดสอบ เนื่องจากโดยปกติแล้วจะมีการสร้างโมเดลผู้สมัครจำนวนมาก การประเมินแบบจำลองเหล่านี้ช่วยให้สามารถปรับปรุง สอบเทียบ และแก้ไขแบบจำลองได้อย่างต่อเนื่อง โปรดทราบว่าผู้ปรับจูนแบบละเอียดสามารถกลายเป็นผู้บริโภครุ่นของตนเองได้เมื่อพัฒนาแอปพลิเคชันในโลกแห่งความเป็นจริง - รุ่น ผู้บริโภค หรือผู้ปรับใช้โมเดลจะให้บริการและติดตามวัตถุประสงค์ทั่วไปหรือโมเดลที่ได้รับการปรับแต่งในการผลิต โดยมีเป้าหมายเพื่อปรับปรุงแอปพลิเคชันหรือบริการของตนผ่านการนำ LLM มาใช้ ความท้าทายแรกที่พวกเขามีคือเพื่อให้แน่ใจว่า LLM ที่เลือกนั้นสอดคล้องกับความต้องการ ต้นทุน และความคาดหวังด้านประสิทธิภาพเฉพาะของพวกเขา การตีความและทำความเข้าใจผลลัพธ์ของโมเดลเป็นเรื่องที่น่ากังวลอย่างต่อเนื่อง โดยเฉพาะอย่างยิ่งเมื่อความเป็นส่วนตัวและความปลอดภัยของข้อมูลเข้ามาเกี่ยวข้อง (เช่น การตรวจสอบความเสี่ยงและการปฏิบัติตามข้อกำหนดในอุตสาหกรรมที่ได้รับการควบคุม เช่น ภาคการเงิน) การประเมินแบบจำลองอย่างต่อเนื่องเป็นสิ่งสำคัญในการป้องกันการแพร่กระจายของอคติหรือเนื้อหาที่เป็นอันตราย ด้วยการใช้กรอบการติดตามและประเมินผลที่แข็งแกร่ง ผู้บริโภคแบบจำลองสามารถระบุและจัดการกับการถดถอยใน LLM ได้ในเชิงรุก เพื่อให้มั่นใจว่าแบบจำลองเหล่านี้จะรักษาประสิทธิภาพและความน่าเชื่อถือไว้เมื่อเวลาผ่านไป

วิธีการประเมิน LLM

การประเมินแบบจำลองที่มีประสิทธิผลเกี่ยวข้องกับองค์ประกอบพื้นฐานสามประการ: FM หนึ่งรายการขึ้นไปหรือแบบจำลองที่ได้รับการปรับแต่งเพื่อประเมินชุดข้อมูลอินพุต (พร้อมท์ การสนทนา หรืออินพุตปกติ) และตรรกะการประเมินผล

ในการเลือกแบบจำลองสำหรับการประเมิน ปัจจัยต่างๆ จะต้องได้รับการพิจารณา รวมถึงคุณลักษณะของข้อมูล ความซับซ้อนของปัญหา ทรัพยากรการคำนวณที่มีอยู่ และผลลัพธ์ที่ต้องการ พื้นที่เก็บข้อมูลอินพุตให้ข้อมูลที่จำเป็นสำหรับการฝึก การปรับแต่ง และการทดสอบโมเดลที่เลือก จำเป็นอย่างยิ่งที่พื้นที่เก็บข้อมูลนี้จะต้องมีโครงสร้างที่ดี เป็นตัวแทน และมีคุณภาพสูง เนื่องจากประสิทธิภาพของแบบจำลองนั้นขึ้นอยู่กับข้อมูลที่เรียนรู้เป็นอย่างมาก สุดท้ายนี้ ตรรกะการประเมินจะกำหนดเกณฑ์และหน่วยวัดที่ใช้ในการประเมินประสิทธิภาพของแบบจำลอง

องค์ประกอบทั้งสามนี้รวมกันเป็นกรอบการทำงานที่สอดคล้องกันที่ช่วยให้มั่นใจได้ถึงการประเมินโมเดลการเรียนรู้ของเครื่องอย่างเข้มงวดและเป็นระบบ ซึ่งท้ายที่สุดจะนำไปสู่การตัดสินใจโดยใช้ข้อมูลและการปรับปรุงประสิทธิภาพของโมเดล

เทคนิคการประเมินแบบจำลองยังคงเป็นสาขาการวิจัยที่กระตือรือร้น เกณฑ์มาตรฐานและกรอบการทำงานสาธารณะจำนวนมากถูกสร้างขึ้นโดยชุมชนนักวิจัยในช่วงไม่กี่ปีที่ผ่านมา เพื่อครอบคลุมงานและสถานการณ์ที่หลากหลาย เช่น กาว, ซุปเปอร์กลู, หางเสือ, มมส และ ม้านั่งใหญ่. เกณฑ์มาตรฐานเหล่านี้มีกระดานผู้นำที่สามารถใช้เพื่อเปรียบเทียบและเปรียบเทียบโมเดลที่ได้รับการประเมิน เกณฑ์มาตรฐาน เช่น HELM ยังมีจุดมุ่งหมายเพื่อประเมินหน่วยเมตริกที่นอกเหนือไปจากการวัดความแม่นยำ เช่น ความแม่นยำหรือคะแนน F1 เกณฑ์มาตรฐาน HELM ประกอบด้วยตัวชี้วัดสำหรับความเป็นธรรม อคติ และความเป็นพิษ ซึ่งมีความสำคัญเท่าเทียมกันในคะแนนการประเมินแบบจำลองโดยรวม

เกณฑ์มาตรฐานทั้งหมดนี้ประกอบด้วยชุดตัวชี้วัดที่วัดว่าแบบจำลองทำงานอย่างไรในงานบางอย่าง ตัวชี้วัดที่มีชื่อเสียงและพบบ่อยที่สุดคือ สีแดง (การศึกษาที่มุ่งเน้นการเรียกคืนสำหรับการประเมินสรุป) Bleu (การศึกษาแบบประเมินผลสองภาษา) หรือ ดาวตก (ตัวชี้วัดสำหรับการประเมินการแปลด้วยการเรียงลำดับที่ชัดเจน) ตัวชี้วัดเหล่านั้นทำหน้าที่เป็นเครื่องมือที่มีประโยชน์สำหรับการประเมินอัตโนมัติ โดยให้การวัดเชิงปริมาณของความคล้ายคลึงกันของคำศัพท์ระหว่างข้อความที่สร้างขึ้นและข้อความอ้างอิง อย่างไรก็ตาม พวกเขาไม่ได้ครอบคลุมถึงการสร้างภาษาที่เหมือนมนุษย์อย่างครอบคลุม ซึ่งรวมถึงความเข้าใจเชิงความหมาย บริบท หรือความแตกต่างทางโวหาร ตัวอย่างเช่น HELM ไม่ได้ให้รายละเอียดการประเมินที่เกี่ยวข้องกับกรณีการใช้งานเฉพาะ โซลูชันสำหรับการทดสอบพร้อมท์แบบกำหนดเอง และผลลัพธ์ที่ตีความได้ง่ายโดยผู้ที่ไม่ใช่ผู้เชี่ยวชาญ เนื่องจากกระบวนการอาจมีค่าใช้จ่ายสูง ไม่ง่ายที่จะปรับขนาด และเฉพาะสำหรับงานเฉพาะเจาะจงเท่านั้น

นอกจากนี้ การบรรลุถึงการสร้างภาษาที่เหมือนมนุษย์มักจะต้องอาศัยการผสมผสานระหว่างมนุษย์ในวงเพื่อนำการประเมินเชิงคุณภาพและการตัดสินของมนุษย์มาเสริมการวัดความแม่นยำแบบอัตโนมัติ การประเมินโดยมนุษย์เป็นวิธีการที่มีคุณค่าในการประเมินผลลัพธ์ของ LLM แต่ก็อาจเป็นแบบอัตวิสัยและมีแนวโน้มที่จะเกิดอคติได้ เนื่องจากผู้ประเมินที่เป็นมนุษย์แต่ละคนอาจมีความคิดเห็นและการตีความคุณภาพข้อความที่หลากหลาย นอกจากนี้ การประเมินโดยมนุษย์ยังต้องใช้ทรัพยากรมากและมีค่าใช้จ่ายสูง อีกทั้งยังต้องใช้เวลาและความพยายามอย่างมากอีกด้วย

มาเจาะลึกถึงวิธีที่ Amazon SageMaker Clarify เชื่อมต่อจุดต่างๆ ได้อย่างราบรื่น โดยช่วยเหลือลูกค้าในการดำเนินการประเมินและเลือกโมเดลอย่างละเอียด

การประเมิน LLM ด้วย Amazon SageMaker Clarify

Amazon SageMaker Clarify ช่วยให้ลูกค้าดำเนินการตัววัดได้โดยอัตโนมัติ ซึ่งรวมถึงแต่ไม่จำกัดเพียงความแม่นยำ ความคงทน ความเป็นพิษ การเหมารวมและความรู้ตามข้อเท็จจริงสำหรับระบบอัตโนมัติ และรูปแบบ การเชื่อมโยงกัน ความเกี่ยวข้องสำหรับการประเมินโดยมนุษย์ และวิธีการประเมินผลโดยการจัดหากรอบงานเพื่อประเมิน LLM และบริการที่ใช้ LLM เช่น Amazon Bedrock ในฐานะบริการที่มีการจัดการเต็มรูปแบบ SageMaker Clarify ช่วยลดความยุ่งยากในการใช้เฟรมเวิร์กการประเมินโอเพ่นซอร์สภายใน Amazon SageMaker ลูกค้าสามารถเลือกชุดข้อมูลและตัวชี้วัดการประเมินที่เกี่ยวข้องสำหรับสถานการณ์ของตน และขยายด้วยชุดข้อมูลและอัลกอริธึมการประเมินผลที่รวดเร็วของตนเอง SageMaker Clarify มอบผลการประเมินในหลายรูปแบบเพื่อรองรับบทบาทที่แตกต่างกันในเวิร์กโฟลว์ LLM นักวิทยาศาสตร์ข้อมูลสามารถวิเคราะห์ผลลัพธ์โดยละเอียดด้วย SageMaker Clarify การแสดงภาพใน Notebook, การ์ดโมเดล SageMaker และรายงาน PDF ในขณะเดียวกัน ทีมปฏิบัติการสามารถใช้ Amazon SageMaker GroundTruth เพื่อตรวจสอบและใส่คำอธิบายประกอบรายการที่มีความเสี่ยงสูงที่ SageMaker Clarify ระบุ ตัวอย่างเช่น โดยทัศนคติเหมารวม ความเป็นพิษ PII ที่เป็นค่า Escape หรือความแม่นยำต่ำ

ต่อมามีการใช้คำอธิบายประกอบและการเรียนรู้แบบเสริมเพื่อลดความเสี่ยงที่อาจเกิดขึ้น คำอธิบายที่เป็นมิตรต่อมนุษย์เกี่ยวกับความเสี่ยงที่ระบุจะช่วยเร่งกระบวนการตรวจสอบโดยเจ้าหน้าที่ ซึ่งจะช่วยลดต้นทุน รายงานสรุปนำเสนอการเปรียบเทียบเปรียบเทียบระหว่างผู้มีส่วนได้ส่วนเสียทางธุรกิจระหว่างรุ่นและเวอร์ชันต่างๆ เพื่อช่วยในการตัดสินใจโดยมีข้อมูลครบถ้วน

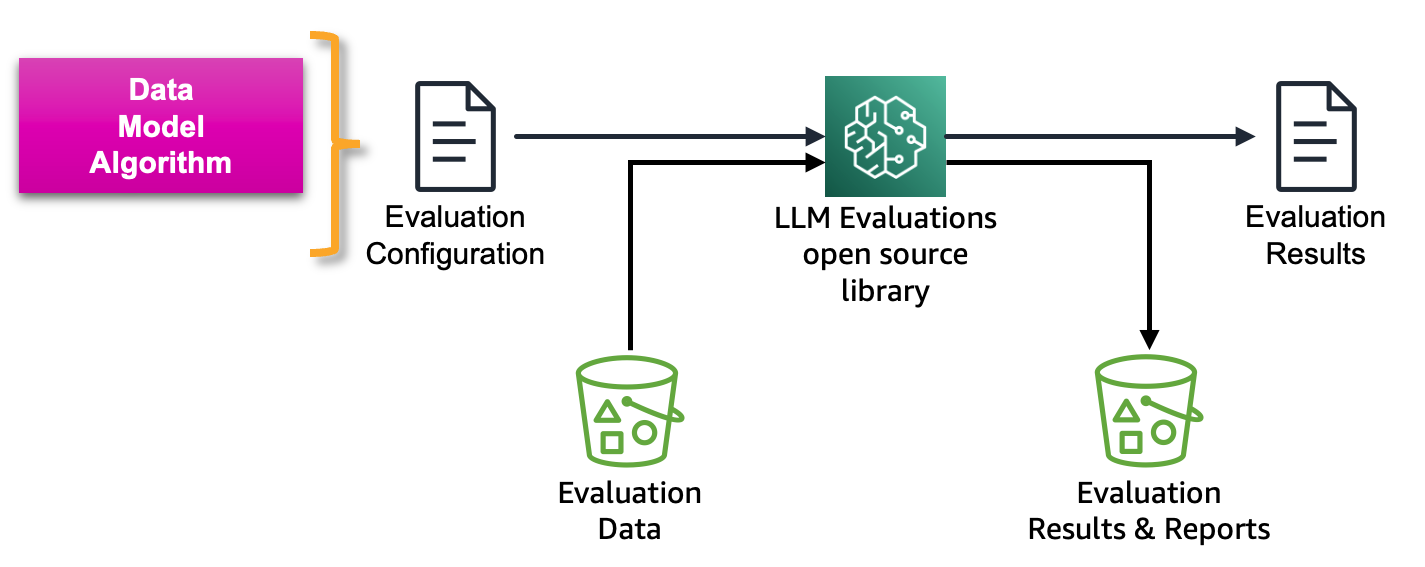

รูปต่อไปนี้แสดงกรอบการทำงานในการประเมิน LLM และบริการที่ใช้ LLM:

การประเมิน Amazon SageMaker Clarify LLM เป็นไลบรารี Foundation Model Eformation (FMEval) แบบโอเพ่นซอร์สที่พัฒนาโดย AWS เพื่อช่วยให้ลูกค้าประเมิน LLM ได้อย่างง่ายดาย ฟังก์ชันทั้งหมดยังรวมอยู่ใน Amazon SageMaker Studio เพื่อเปิดใช้งานการประเมิน LLM สำหรับผู้ใช้ ในส่วนต่อไปนี้ เราจะแนะนำการผสานรวมของ Amazon SageMaker Clarify ความสามารถในการประเมิน LLM กับ SageMaker Pipelines เพื่อเปิดใช้งานการประเมิน LLM ในวงกว้างโดยใช้หลักการ MLOps

วงจรชีวิตของ Amazon SageMaker MLOps

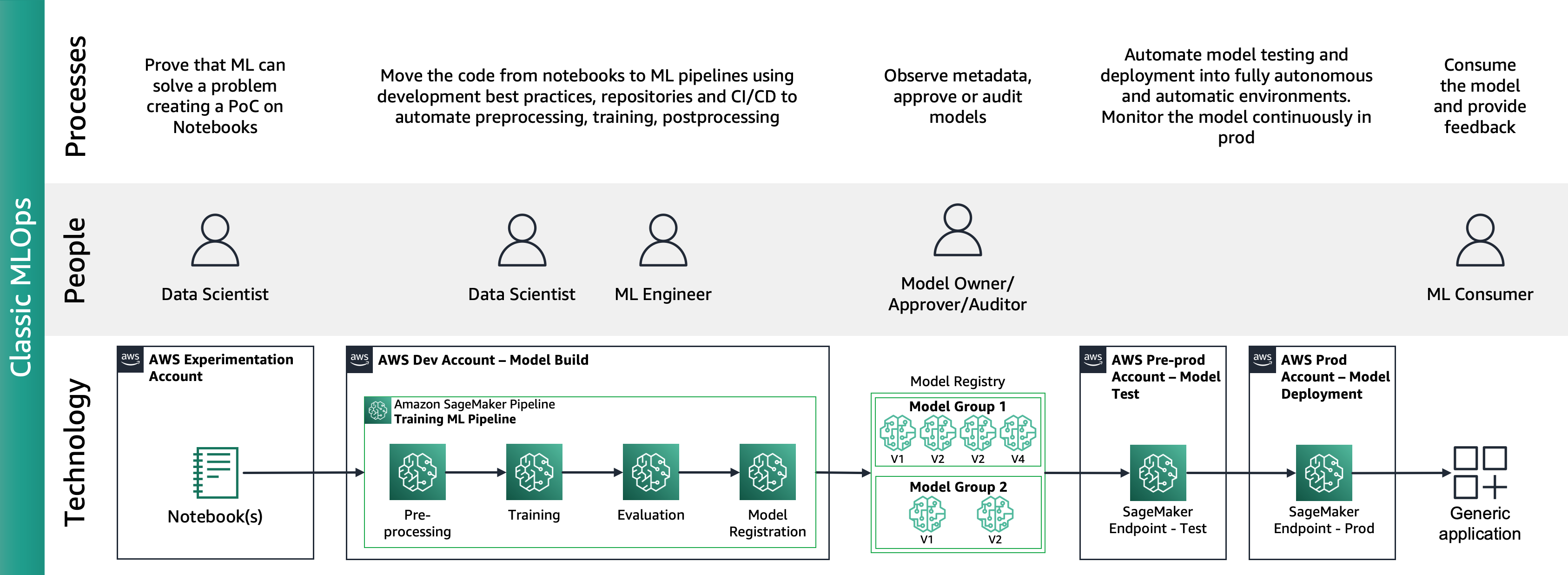

ตามที่โพสต์”แผนงานพื้นฐาน MLOps สำหรับองค์กรด้วย Amazon SageMaker” อธิบายว่า MLOps คือการผสมผสานระหว่างกระบวนการ ผู้คน และเทคโนโลยีเพื่อสร้างกรณีการใช้งาน ML ได้อย่างมีประสิทธิภาพ

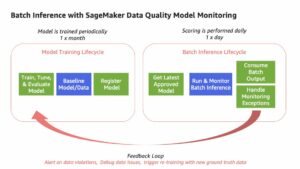

รูปต่อไปนี้แสดงวงจรการใช้งาน MLOps แบบ end-to-end:

การเดินทางโดยทั่วไปเริ่มต้นด้วยนักวิทยาศาสตร์ข้อมูลที่สร้างสมุดบันทึกแบบพิสูจน์แนวคิด (PoC) เพื่อพิสูจน์ว่า ML สามารถแก้ปัญหาทางธุรกิจได้ ตลอดการพัฒนา Proof of Concept (PoC) นักวิทยาศาสตร์ข้อมูลจะต้องแปลงตัวบ่งชี้ประสิทธิภาพหลัก (KPI) ทางธุรกิจให้เป็นเมตริกโมเดลการเรียนรู้ของเครื่อง เช่น ความแม่นยำหรืออัตราบวกลวง และใช้ชุดข้อมูลทดสอบที่จำกัดเพื่อประเมินสิ่งเหล่านี้ เมตริก นักวิทยาศาสตร์ข้อมูลร่วมมือกับวิศวกร ML เพื่อเปลี่ยนโค้ดจากโน้ตบุ๊กไปยังพื้นที่เก็บข้อมูล โดยสร้างไปป์ไลน์ ML โดยใช้ Amazon SageMaker Pipelines ซึ่งเชื่อมต่อขั้นตอนและงานการประมวลผลต่างๆ รวมถึงการประมวลผลล่วงหน้า การฝึกอบรม การประเมินผล และหลังการประมวลผล ทั้งหมดนี้ในขณะเดียวกันก็รวมเอาการผลิตใหม่อย่างต่อเนื่อง ข้อมูล. การปรับใช้ Amazon SageMaker Pipelines ขึ้นอยู่กับการโต้ตอบของพื้นที่เก็บข้อมูลและการเปิดใช้งานไปป์ไลน์ CI/CD ไปป์ไลน์ ML จะรักษาโมเดลที่มีประสิทธิภาพสูงสุด อิมเมจคอนเทนเนอร์ ผลการประเมิน และข้อมูลสถานะในการลงทะเบียนโมเดล โดยที่ผู้มีส่วนได้ส่วนเสียของโมเดลจะประเมินประสิทธิภาพและตัดสินใจเกี่ยวกับความก้าวหน้าไปสู่การผลิตตามผลลัพธ์ประสิทธิภาพและเกณฑ์มาตรฐาน ตามด้วยการเปิดใช้งานไปป์ไลน์ CI/CD อื่น สำหรับการจัดเตรียมและการใช้งานจริง เมื่อใช้งานจริง ผู้ใช้ ML จะใช้โมเดลผ่านการอนุมานที่กระตุ้นโดยแอปพลิเคชัน ผ่านการเรียกใช้โดยตรงหรือการเรียก API พร้อมลูปคำติชมไปยังเจ้าของโมเดลเพื่อการประเมินประสิทธิภาพที่กำลังดำเนินอยู่

Amazon SageMaker Clarify และการรวม MLOps

ตามวงจรการใช้งาน MLOps ตัวจูนแบบละเอียดหรือผู้ใช้โมเดลโอเพ่นซอร์สจะสร้างโมเดลที่ได้รับการปรับแต่งแบบละเอียดหรือ FM โดยใช้ Amazon SageMaker Jumpstart และบริการ MLOps ตามที่อธิบายไว้ใน การใช้แนวทางปฏิบัติของ MLOps กับโมเดลที่ผ่านการฝึกอบรมล่วงหน้าของ Amazon SageMaker JumpStart. สิ่งนี้นำไปสู่โดเมนใหม่สำหรับการดำเนินการแบบจำลองพื้นฐาน (FMOps) และการดำเนินการ LLM (LLMOps) FMOps/LLMOps: ใช้งาน AI ที่สร้างและความแตกต่างด้วย MLOps.

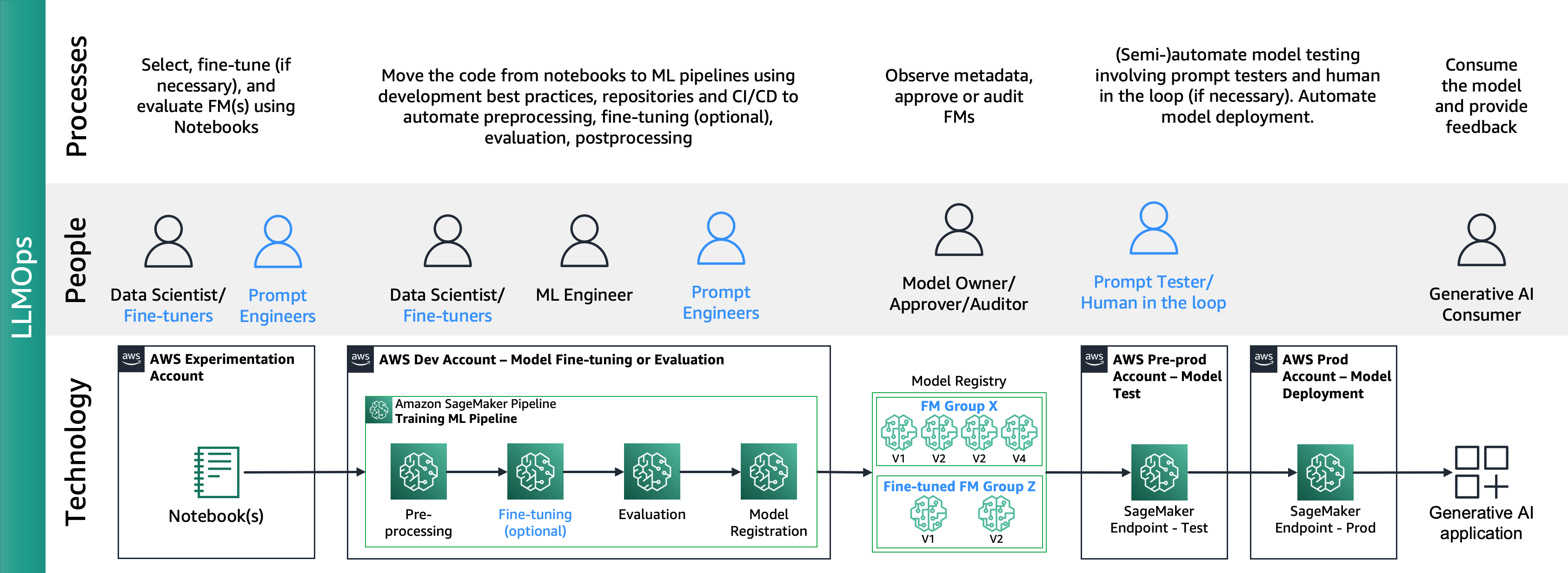

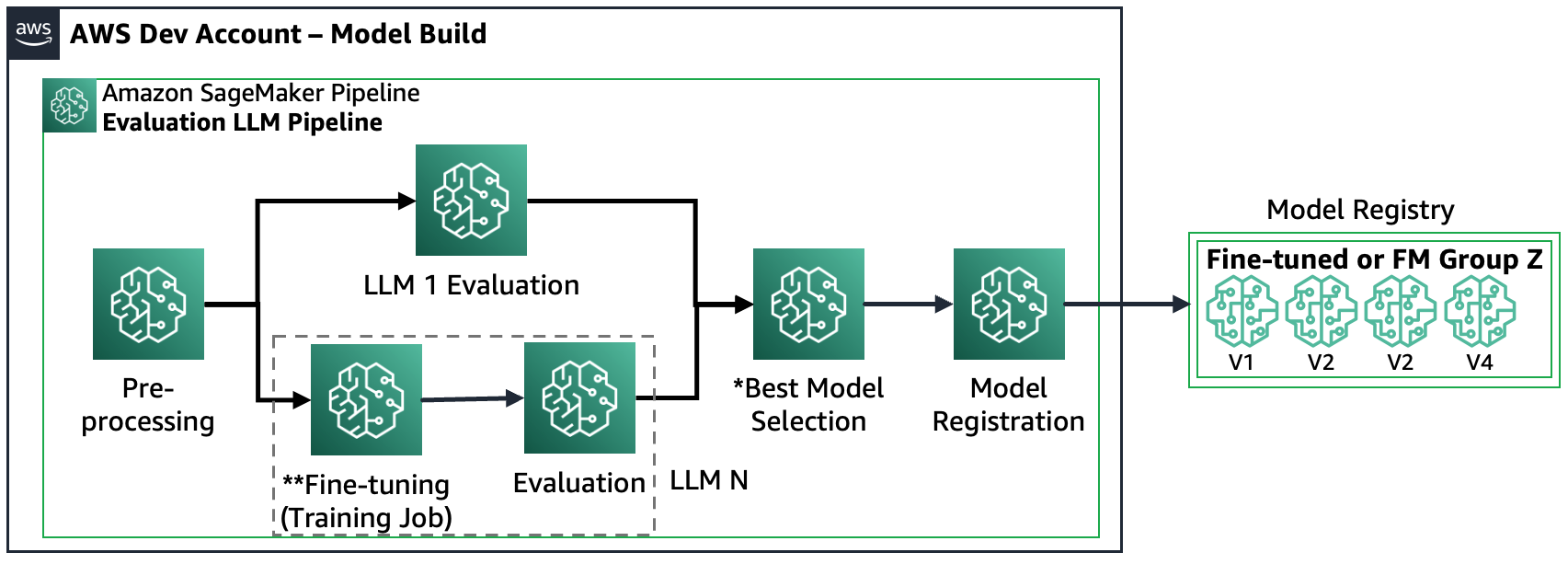

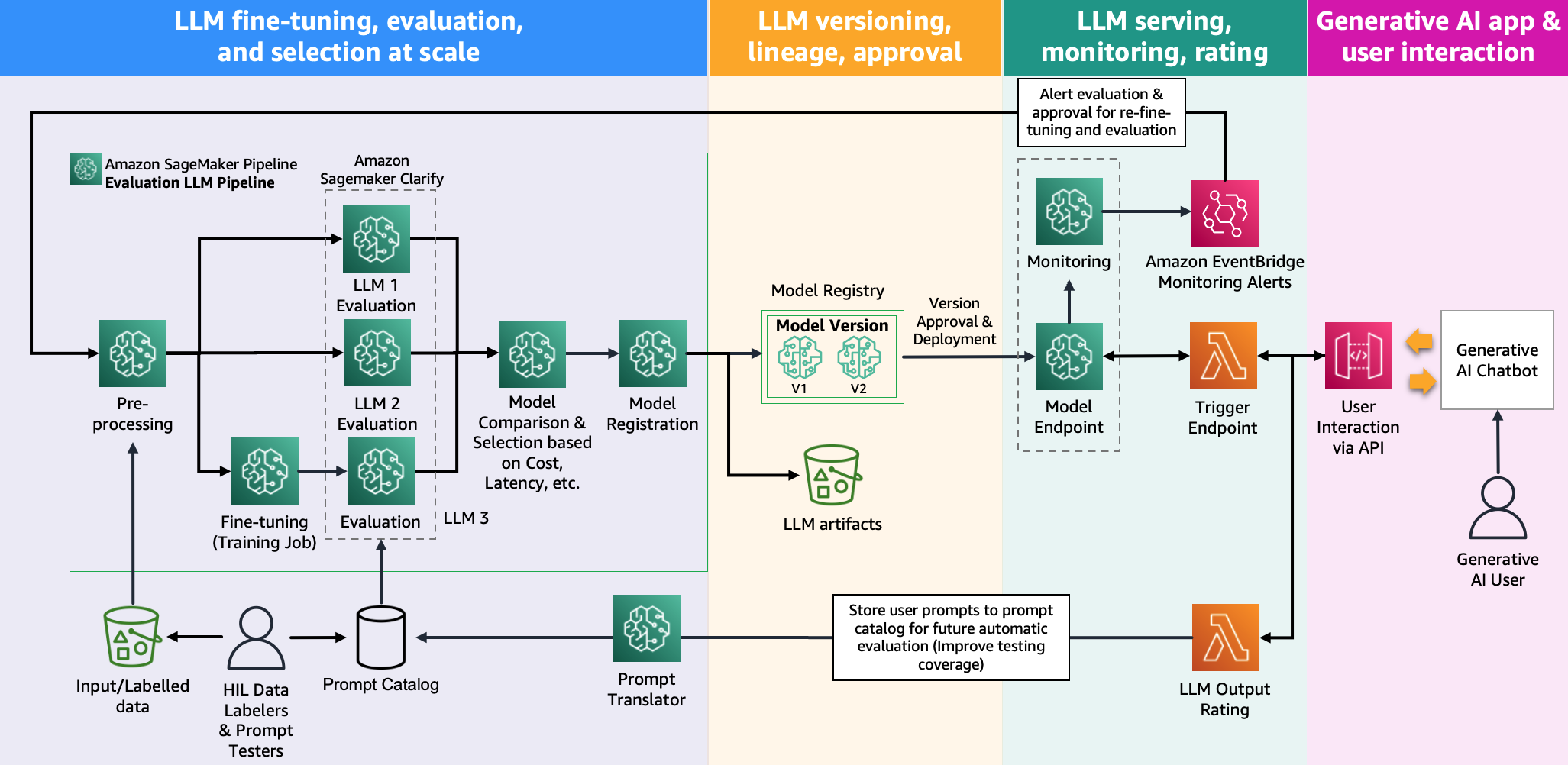

รูปต่อไปนี้แสดงวงจรการใช้งาน LLMOps แบบ end-to-end:

ใน LLMOps ความแตกต่างที่สำคัญเมื่อเปรียบเทียบกับ MLOps คือการเลือกแบบจำลองและการประเมินแบบจำลองที่เกี่ยวข้องกับกระบวนการและตัวชี้วัดที่แตกต่างกัน ในขั้นตอนการทดลองเบื้องต้น นักวิทยาศาสตร์ข้อมูล (หรือนักปรับแต่ง) จะเลือก FM ที่จะใช้สำหรับกรณีการใช้งาน Generative AI เฉพาะ

ซึ่งมักส่งผลให้เกิดการทดสอบและการปรับแต่ง FM หลายรายการอย่างละเอียด ซึ่งบางรายการอาจให้ผลลัพธ์ที่เทียบเคียงได้ หลังจากเลือกแบบจำลองแล้ว วิศวกรพร้อมท์มีหน้าที่รับผิดชอบในการเตรียมข้อมูลอินพุตที่จำเป็นและเอาต์พุตที่คาดหวังสำหรับการประเมิน (เช่น พร้อมท์อินพุตที่ประกอบด้วยข้อมูลอินพุตและแบบสอบถาม) และกำหนดหน่วยวัด เช่น ความคล้ายคลึงและความเป็นพิษ นอกเหนือจากหน่วยวัดเหล่านี้แล้ว นักวิทยาศาสตร์ข้อมูลหรือนักปรับแต่งจะต้องตรวจสอบผลลัพธ์และเลือก FM ที่เหมาะสม ไม่เพียงแต่ในหน่วยวัดที่แม่นยำเท่านั้น แต่ยังรวมถึงความสามารถอื่นๆ เช่น เวลาแฝงและต้นทุนด้วย จากนั้นพวกเขาสามารถปรับใช้โมเดลกับตำแหน่งข้อมูล SageMaker และทดสอบประสิทธิภาพในระดับเล็กๆ แม้ว่าขั้นตอนการทดลองอาจเกี่ยวข้องกับกระบวนการที่ไม่ซับซ้อน แต่การเปลี่ยนไปใช้การผลิตจำเป็นต้องให้ลูกค้าทำให้กระบวนการเป็นอัตโนมัติและเพิ่มความแข็งแกร่งของโซลูชัน ดังนั้นเราจึงจำเป็นต้องเจาะลึกเกี่ยวกับวิธีการประเมินแบบอัตโนมัติ ช่วยให้ผู้ทดสอบทำการประเมินอย่างมีประสิทธิภาพในวงกว้าง และดำเนินการตรวจสอบอินพุตและเอาท์พุตของโมเดลแบบเรียลไทม์

การประเมิน FM อัตโนมัติ

Amazon SageMaker Pipelines ดำเนินการทุกขั้นตอนของการประมวลผลล่วงหน้า การปรับแต่ง FM อย่างละเอียด (เป็นทางเลือก) และการประเมินตามขนาดโดยอัตโนมัติ เมื่อพิจารณาแบบจำลองที่เลือกระหว่างการทดลอง วิศวกรพร้อมต์จำเป็นต้องครอบคลุมชุดเคสที่ใหญ่ขึ้นโดยการเตรียมพร้อมท์จำนวนมากและจัดเก็บไว้ในพื้นที่เก็บข้อมูลที่กำหนดที่เรียกว่า แค็ตตาล็อกพร้อมต์ สำหรับข้อมูลเพิ่มเติม โปรดดูที่ FMOps/LLMOps: ใช้งาน AI ที่สร้างและความแตกต่างด้วย MLOps. จากนั้น Amazon SageMaker Pipelines สามารถจัดโครงสร้างได้ดังนี้:

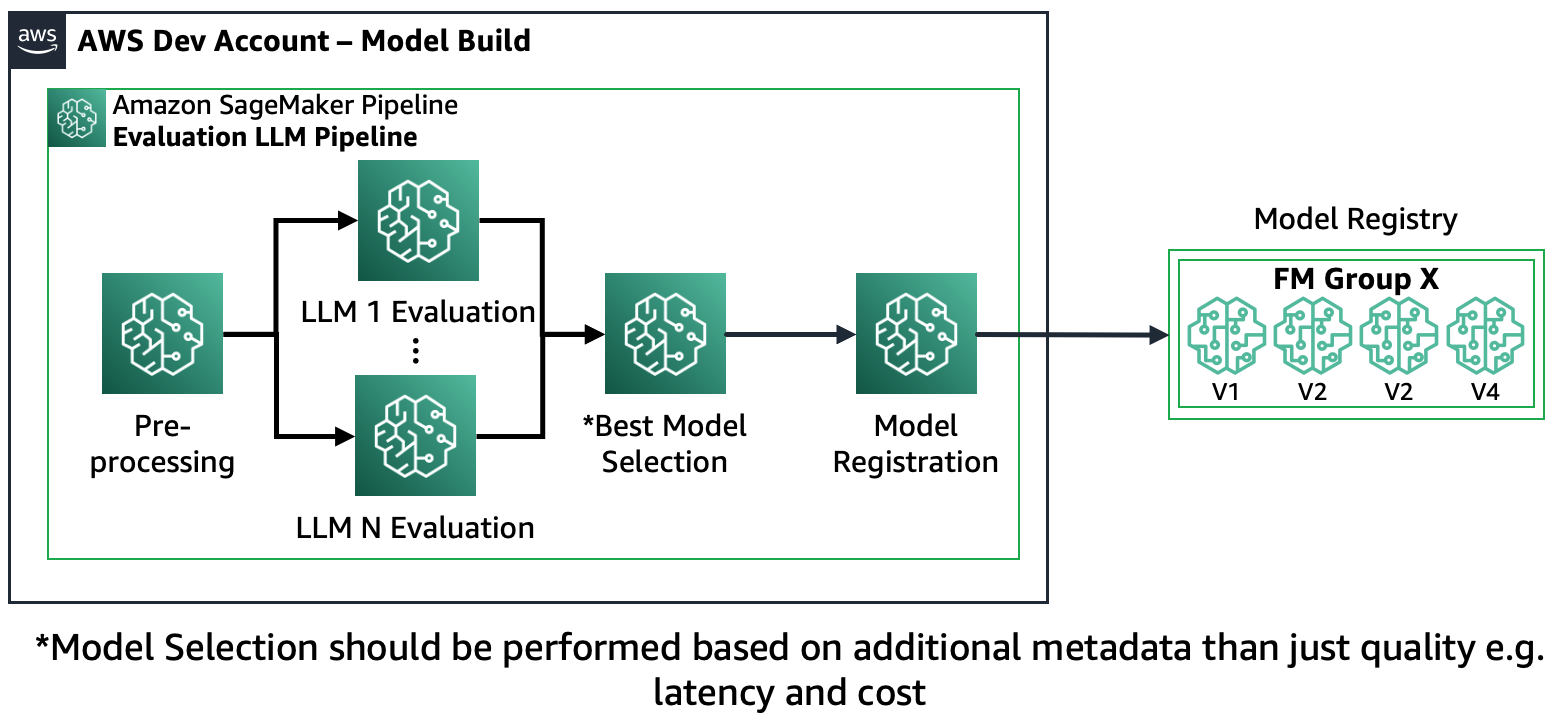

สถานการณ์ที่ 1 – ประเมิน FM หลายรายการ: ในสถานการณ์สมมตินี้ FM สามารถครอบคลุมกรณีการใช้งานทางธุรกิจได้โดยไม่ต้องปรับแต่งอย่างละเอียด Amazon SageMaker Pipeline ประกอบด้วยขั้นตอนต่อไปนี้: การประมวลผลข้อมูลล่วงหน้า, การประเมินแบบขนานของ FM หลายรายการ, การเปรียบเทียบโมเดล และการเลือกตามความแม่นยำและคุณสมบัติอื่นๆ เช่น ต้นทุนหรือเวลาแฝง การลงทะเบียนอาร์ติแฟกต์ของโมเดลที่เลือก และข้อมูลเมตา

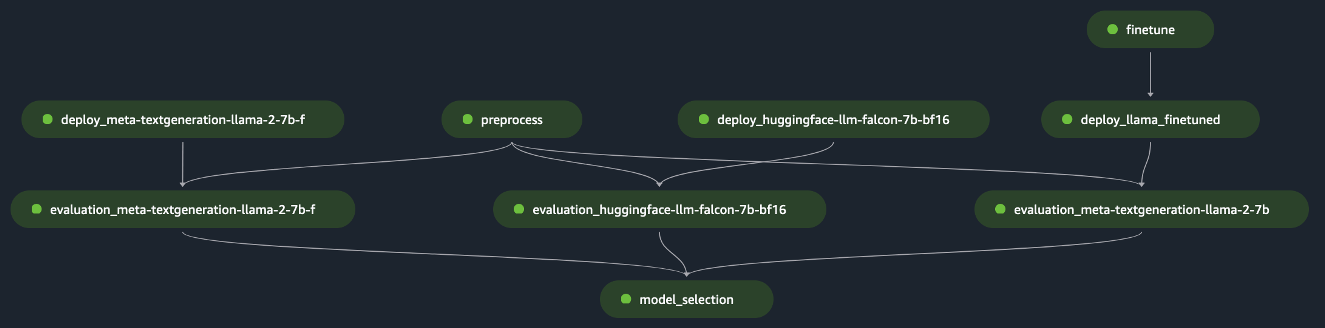

ไดอะแกรมต่อไปนี้แสดงสถาปัตยกรรมนี้

สถานการณ์ที่ 2 – ปรับแต่งและประเมิน FM หลายรายการ: ในสถานการณ์นี้ Amazon SageMaker Pipeline มีโครงสร้างคล้ายกับสถานการณ์ที่ 1 มาก แต่ทำงานคู่ขนานทั้งขั้นตอนการปรับแต่งและการประเมินผลสำหรับแต่ละ FM โมเดลที่ได้รับการปรับแต่งอย่างดีที่สุดจะถูกลงทะเบียนใน Model Registry

ไดอะแกรมต่อไปนี้แสดงสถาปัตยกรรมนี้

สถานการณ์ที่ 3 – ประเมิน FM หลายรายการและ FM ที่ปรับแต่งอย่างละเอียด: สถานการณ์นี้เป็นการผสมผสานระหว่างการประเมิน FM สำหรับการใช้งานทั่วไปและ FM ที่ปรับแต่งอย่างละเอียด ในกรณีนี้ ลูกค้าต้องการตรวจสอบว่ารุ่นที่ปรับแต่งแล้วสามารถทำงานได้ดีกว่า FM เอนกประสงค์หรือไม่

รูปภาพต่อไปนี้แสดงขั้นตอน SageMaker Pipeline ที่เป็นผลลัพธ์

โปรดทราบว่าการลงทะเบียนโมเดลมี XNUMX รูปแบบ: (a) จัดเก็บโมเดลโอเพ่นซอร์สและสิ่งประดิษฐ์ หรือ (b) จัดเก็บข้อมูลอ้างอิงถึง FM ที่เป็นกรรมสิทธิ์ สำหรับข้อมูลเพิ่มเติม โปรดดูที่ FMOps/LLMOps: ใช้งาน AI ที่สร้างและความแตกต่างด้วย MLOps.

ภาพรวมโซลูชัน

เพื่อเร่งการเดินทางของคุณไปสู่การประเมิน LLM ในวงกว้าง เราได้สร้างโซลูชันที่ปรับใช้สถานการณ์โดยใช้ทั้ง Amazon SageMaker Clarify และ Amazon SageMaker Pipelines SDK ใหม่ ตัวอย่างโค้ด รวมถึงชุดข้อมูล สมุดบันทึกต้นทาง และไปป์ไลน์ SageMaker (ขั้นตอนและไปป์ไลน์ ML) มีให้ใช้งานบน GitHub. เพื่อพัฒนาโซลูชันตัวอย่างนี้ เราใช้ FM สองตัว: Llama2 และ Falcon-7B ในโพสต์นี้ จุดสนใจหลักของเราคือองค์ประกอบสำคัญของโซลูชัน SageMaker Pipeline ที่เกี่ยวข้องกับกระบวนการประเมิน

การกำหนดค่าการประเมินผล: เพื่อวัตถุประสงค์ในการกำหนดมาตรฐานขั้นตอนการประเมิน เราได้สร้างไฟล์การกำหนดค่า YAML (evalue_config.yaml) ซึ่งมีรายละเอียดที่จำเป็นสำหรับกระบวนการประเมิน รวมถึงชุดข้อมูล โมเดล และอัลกอริทึมที่จะเรียกใช้ในระหว่าง ขั้นตอนการประเมินของ SageMaker Pipeline ตัวอย่างต่อไปนี้แสดงให้เห็นถึงไฟล์การกำหนดค่า:

pipeline: name: "llm-evaluation-multi-models-hybrid" dataset: dataset_name: "trivia_qa_sampled" input_data_location: "evaluation_dataset_trivia.jsonl" dataset_mime_type: "jsonlines" model_input_key: "question" target_output_key: "answer" models: - name: "llama2-7b-f" model_id: "meta-textgeneration-llama-2-7b-f" model_version: "*" endpoint_name: "llm-eval-meta-textgeneration-llama-2-7b-f" deployment_config: instance_type: "ml.g5.2xlarge" num_instances: 1 evaluation_config: output: '[0].generation.content' content_template: [[{"role":"user", "content": "PROMPT_PLACEHOLDER"}]] inference_parameters: max_new_tokens: 100 top_p: 0.9 temperature: 0.6 custom_attributes: accept_eula: True prompt_template: "$feature" cleanup_endpoint: True - name: "falcon-7b" ... - name: "llama2-7b-finetuned" ... finetuning: train_data_path: "train_dataset" validation_data_path: "val_dataset" parameters: instance_type: "ml.g5.12xlarge" num_instances: 1 epoch: 1 max_input_length: 100 instruction_tuned: True chat_dataset: False ... algorithms: - algorithm: "FactualKnowledge" module: "fmeval.eval_algorithms.factual_knowledge" config: "FactualKnowledgeConfig" target_output_delimiter: "<OR>"ขั้นตอนการประเมิน: SageMaker Pipeline SDK ใหม่ให้ความยืดหยุ่นแก่ผู้ใช้ในการกำหนดขั้นตอนที่กำหนดเองในเวิร์กโฟลว์ ML โดยใช้ตัวตกแต่ง Python '@step' ดังนั้นผู้ใช้จำเป็นต้องสร้างสคริปต์ Python พื้นฐานที่ดำเนินการประเมินดังนี้:

def evaluation(data_s3_path, endpoint_name, data_config, model_config, algorithm_config, output_data_path,): from fmeval.data_loaders.data_config import DataConfig from fmeval.model_runners.sm_jumpstart_model_runner import JumpStartModelRunner from fmeval.reporting.eval_output_cells import EvalOutputCell from fmeval.constants import MIME_TYPE_JSONLINES s3 = boto3.client("s3") bucket, object_key = parse_s3_url(data_s3_path) s3.download_file(bucket, object_key, "dataset.jsonl") config = DataConfig( dataset_name=data_config["dataset_name"], dataset_uri="dataset.jsonl", dataset_mime_type=MIME_TYPE_JSONLINES, model_input_location=data_config["model_input_key"], target_output_location=data_config["target_output_key"], ) evaluation_config = model_config["evaluation_config"] content_dict = { "inputs": evaluation_config["content_template"], "parameters": evaluation_config["inference_parameters"], } serializer = JSONSerializer() serialized_data = serializer.serialize(content_dict) content_template = serialized_data.replace('"PROMPT_PLACEHOLDER"', "$prompt") print(content_template) js_model_runner = JumpStartModelRunner( endpoint_name=endpoint_name, model_id=model_config["model_id"], model_version=model_config["model_version"], output=evaluation_config["output"], content_template=content_template, custom_attributes="accept_eula=true", ) eval_output_all = [] s3 = boto3.resource("s3") output_bucket, output_index = parse_s3_url(output_data_path) for algorithm in algorithm_config: algorithm_name = algorithm["algorithm"] module = importlib.import_module(algorithm["module"]) algorithm_class = getattr(module, algorithm_name) algorithm_config_class = getattr(module, algorithm["config"]) eval_algo = algorithm_class(algorithm_config_class(target_output_delimiter=algorithm["target_output_delimiter"])) eval_output = eval_algo.evaluate(model=js_model_runner, dataset_config=config, prompt_template=evaluation_config["prompt_template"], save=True,) print(f"eval_output: {eval_output}") eval_output_all.append(eval_output) html = markdown.markdown(str(EvalOutputCell(eval_output[0]))) file_index = (output_index + "/" + model_config["name"] + "_" + eval_algo.eval_name + ".html") s3_object = s3.Object(bucket_name=output_bucket, key=file_index) s3_object.put(Body=html) eval_result = {"model_config": model_config, "eval_output": eval_output_all} print(f"eval_result: {eval_result}") return eval_resultไปป์ไลน์ SageMaker: หลังจากสร้างขั้นตอนที่จำเป็น เช่น การประมวลผลข้อมูลล่วงหน้า การใช้งานโมเดล และการประเมินโมเดล ผู้ใช้จำเป็นต้องเชื่อมโยงขั้นตอนต่างๆ เข้าด้วยกันโดยใช้ SageMaker Pipeline SDK SDK ใหม่จะสร้างเวิร์กโฟลว์โดยอัตโนมัติโดยการตีความการขึ้นต่อกันระหว่างขั้นตอนต่างๆ เมื่อมีการเรียกใช้ API การสร้าง SageMaker Pipeline ดังที่แสดงในตัวอย่างต่อไปนี้:

import os

import argparse

from datetime import datetime import sagemaker

from sagemaker.workflow.pipeline import Pipeline

from sagemaker.workflow.function_step import step

from sagemaker.workflow.step_outputs import get_step # Import the necessary steps

from steps.preprocess import preprocess

from steps.evaluation import evaluation

from steps.cleanup import cleanup

from steps.deploy import deploy from lib.utils import ConfigParser

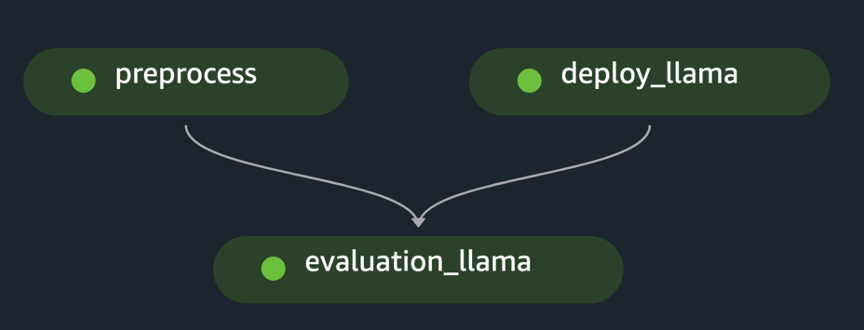

from lib.utils import find_model_by_name if __name__ == "__main__": os.environ["SAGEMAKER_USER_CONFIG_OVERRIDE"] = os.getcwd() sagemaker_session = sagemaker.session.Session() # Define data location either by providing it as an argument or by using the default bucket default_bucket = sagemaker.Session().default_bucket() parser = argparse.ArgumentParser() parser.add_argument("-input-data-path", "--input-data-path", dest="input_data_path", default=f"s3://{default_bucket}/llm-evaluation-at-scale-example", help="The S3 path of the input data",) parser.add_argument("-config", "--config", dest="config", default="", help="The path to .yaml config file",) args = parser.parse_args() # Initialize configuration for data, model, and algorithm if args.config: config = ConfigParser(args.config).get_config() else: config = ConfigParser("pipeline_config.yaml").get_config() evalaution_exec_id = datetime.now().strftime("%Y_%m_%d_%H_%M_%S") pipeline_name = config["pipeline"]["name"] dataset_config = config["dataset"] # Get dataset configuration input_data_path = args.input_data_path + "/" + dataset_config["input_data_location"] output_data_path = (args.input_data_path + "/output_" + pipeline_name + "_" + evalaution_exec_id) print("Data input location:", input_data_path) print("Data output location:", output_data_path) algorithms_config = config["algorithms"] # Get algorithms configuration model_config = find_model_by_name(config["models"], "llama2-7b") model_id = model_config["model_id"] model_version = model_config["model_version"] evaluation_config = model_config["evaluation_config"] endpoint_name = model_config["endpoint_name"] model_deploy_config = model_config["deployment_config"] deploy_instance_type = model_deploy_config["instance_type"] deploy_num_instances = model_deploy_config["num_instances"] # Construct the steps processed_data_path = step(preprocess, name="preprocess")(input_data_path, output_data_path) endpoint_name = step(deploy, name=f"deploy_{model_id}")(model_id, model_version, endpoint_name, deploy_instance_type, deploy_num_instances,) evaluation_results = step(evaluation, name=f"evaluation_{model_id}", keep_alive_period_in_seconds=1200)(processed_data_path, endpoint_name, dataset_config, model_config, algorithms_config, output_data_path,) last_pipeline_step = evaluation_results if model_config["cleanup_endpoint"]: cleanup = step(cleanup, name=f"cleanup_{model_id}")(model_id, endpoint_name) get_step(cleanup).add_depends_on([evaluation_results]) last_pipeline_step = cleanup # Define the SageMaker Pipeline pipeline = Pipeline( name=pipeline_name, steps=[last_pipeline_step], ) # Build and run the Sagemaker Pipeline pipeline.upsert(role_arn=sagemaker.get_execution_role()) # pipeline.upsert(role_arn="arn:aws:iam::<...>:role/service-role/AmazonSageMaker-ExecutionRole-<...>") pipeline.start()ตัวอย่างนี้ใช้การประเมิน FM เดียวโดยการประมวลผลชุดข้อมูลเริ่มต้นล่วงหน้า การปรับใช้โมเดล และรันการประเมิน กราฟอะไซคลิกกำกับไปป์ไลน์ที่สร้างขึ้น (DAG) จะแสดงในรูปต่อไปนี้

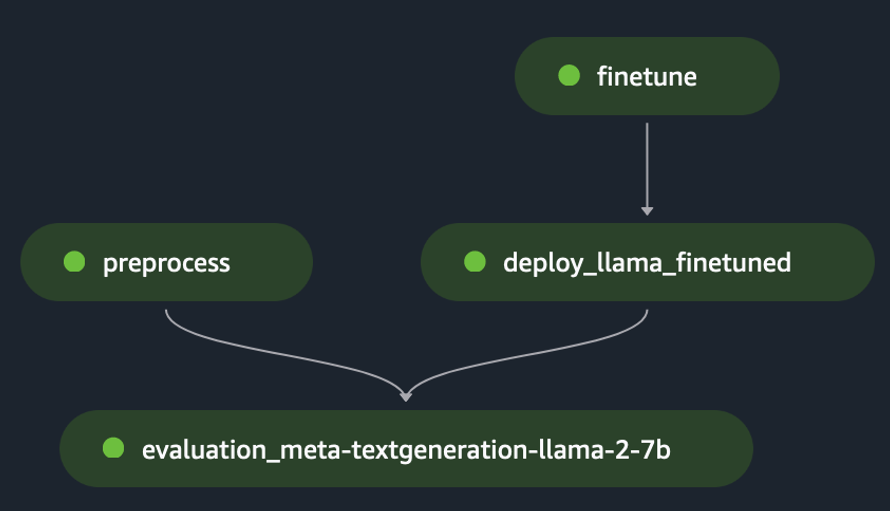

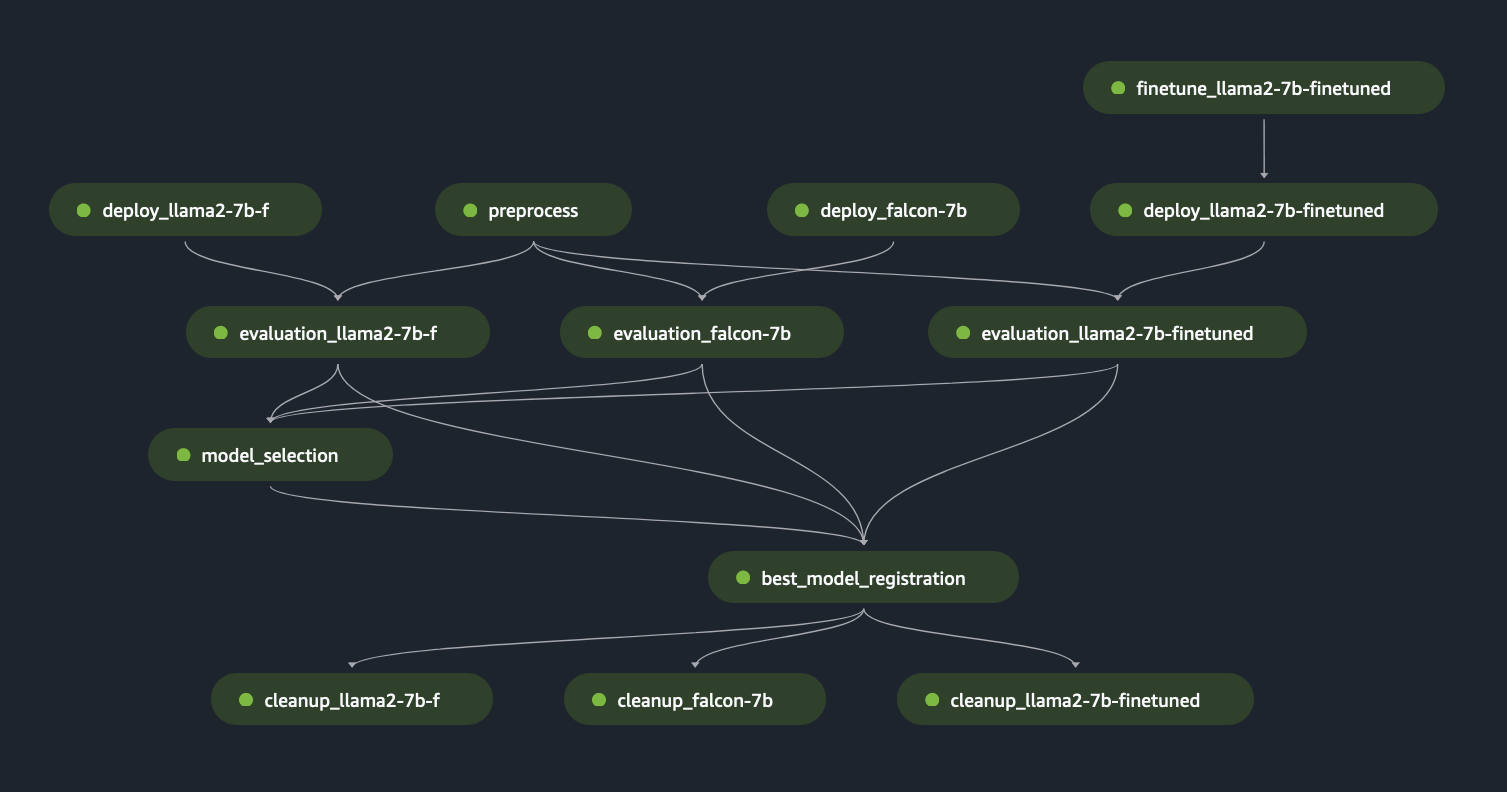

ปฏิบัติตามแนวทางที่คล้ายกันและโดยการใช้และปรับแต่งตัวอย่างใน ปรับแต่งโมเดล LLaMA 2 บน SageMaker JumpStartเราได้สร้างไปป์ไลน์เพื่อประเมินโมเดลที่ได้รับการปรับแต่งแล้ว ดังแสดงในรูปต่อไปนี้

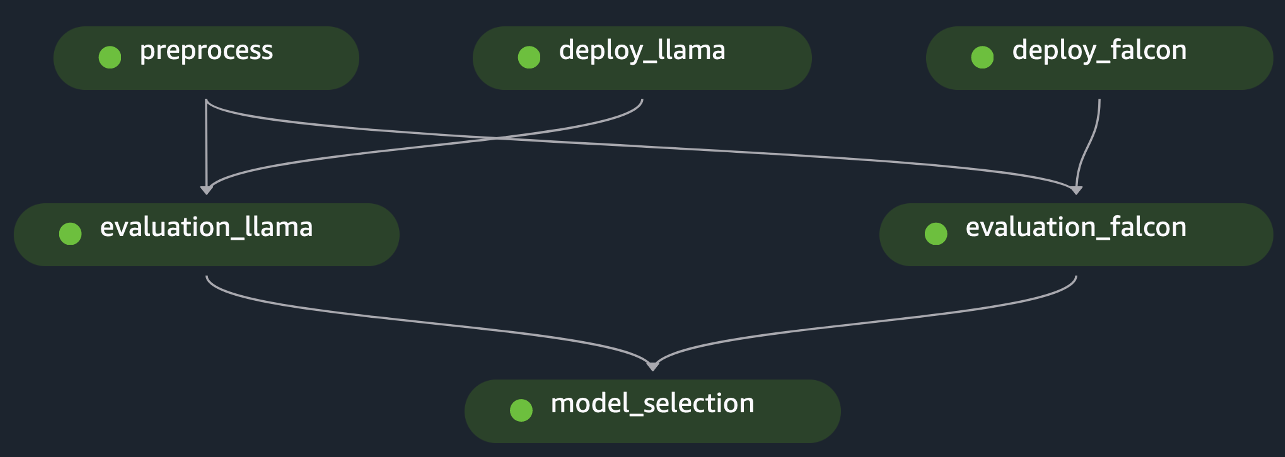

ด้วยการใช้ขั้นตอน SageMaker Pipeline ก่อนหน้านี้เป็นบล็อก "Lego" เราได้พัฒนาโซลูชันสำหรับสถานการณ์ที่ 1 และสถานการณ์ที่ 3 ดังแสดงในรูปต่อไปนี้ โดยเฉพาะ GitHub พื้นที่เก็บข้อมูลทำให้ผู้ใช้สามารถประเมิน FM หลายรายการพร้อมกันหรือทำการประเมินที่ซับซ้อนมากขึ้น โดยผสมผสานการประเมินทั้งแบบจำลองพื้นฐานและแบบจำลองที่ได้รับการปรับแต่งอย่างละเอียด

ฟังก์ชันเพิ่มเติมที่มีอยู่ในพื้นที่เก็บข้อมูลมีดังต่อไปนี้:

- การสร้างขั้นตอนการประเมินผลแบบไดนามิก: โซลูชันของเราสร้างขั้นตอนการประเมินที่จำเป็นทั้งหมดแบบไดนามิกโดยอิงตามไฟล์การกำหนดค่า เพื่อให้ผู้ใช้สามารถประเมินโมเดลจำนวนเท่าใดก็ได้ เราได้ขยายโซลูชันเพื่อรองรับการผสานรวมโมเดลประเภทใหม่ๆ ได้อย่างง่ายดาย เช่น Hugging Face หรือ Amazon Bedrock

- ป้องกันการปรับใช้ปลายทางอีกครั้ง: หากมีตำแหน่งข้อมูลอยู่แล้ว เราจะข้ามกระบวนการปรับใช้ ซึ่งช่วยให้ผู้ใช้สามารถนำอุปกรณ์ปลายทางกลับมาใช้ใหม่กับ FM สำหรับการประเมิน ส่งผลให้ประหยัดต้นทุนและลดเวลาในการปรับใช้

- การล้างข้อมูลจุดสิ้นสุด: หลังจากเสร็จสิ้นการประเมิน SageMaker Pipeline จะทำการรื้อถอนตำแหน่งข้อมูลที่ติดตั้งใช้งาน ฟังก์ชันนี้สามารถขยายได้เพื่อรักษาตำแหน่งข้อมูลโมเดลที่ดีที่สุดไว้

- ขั้นตอนการเลือกรุ่น: เราได้เพิ่มตัวยึดขั้นตอนการเลือกแบบจำลองที่ต้องใช้ตรรกะทางธุรกิจของการเลือกแบบจำลองขั้นสุดท้าย รวมถึงเกณฑ์ เช่น ต้นทุนหรือเวลาแฝง

- ขั้นตอนการลงทะเบียนรุ่น: โมเดลที่ดีที่สุดสามารถลงทะเบียนใน Amazon SageMaker Model Registry เป็นเวอร์ชันใหม่ของกลุ่มโมเดลเฉพาะได้

- สระน้ำอุ่น: พูลอุ่นที่ได้รับการจัดการของ SageMaker ช่วยให้คุณสามารถรักษาและนำโครงสร้างพื้นฐานที่จัดเตรียมไว้กลับมาใช้ใหม่ได้หลังจากเสร็จสิ้นงาน เพื่อลดเวลาแฝงสำหรับปริมาณงานที่ซ้ำกัน

รูปต่อไปนี้แสดงให้เห็นถึงความสามารถเหล่านี้และตัวอย่างการประเมินหลายแบบจำลองที่ผู้ใช้สามารถสร้างได้อย่างง่ายดายและไดนามิกโดยใช้โซลูชันของเราในสิ่งนี้ GitHub กรุ

เราตั้งใจที่จะเตรียมข้อมูลให้อยู่นอกขอบเขต เนื่องจากจะมีการอธิบายไว้ในโพสต์เชิงลึกที่แตกต่างกัน รวมถึงการออกแบบแคตตาล็อกพร้อมท์ เทมเพลตพร้อมท์ และการเพิ่มประสิทธิภาพทันที สำหรับข้อมูลเพิ่มเติมและคำจำกัดความส่วนประกอบที่เกี่ยวข้อง โปรดดูที่ FMOps/LLMOps: ใช้งาน AI ที่สร้างและความแตกต่างด้วย MLOps.

สรุป

ในโพสต์นี้ เรามุ่งเน้นที่วิธีดำเนินการและประเมินผล LLM ในระดับอัตโนมัติโดยใช้ Amazon SageMaker ชี้แจงความสามารถในการประเมิน LLM และ Amazon SageMaker Pipelines นอกจากการออกแบบสถาปัตยกรรมเชิงทฤษฎีแล้ว เรายังมีโค้ดตัวอย่างในเรื่องนี้อีกด้วย GitHub พื้นที่เก็บข้อมูล (ประกอบด้วย Llama2 และ Falcon-7B FMs) เพื่อให้ลูกค้าสามารถพัฒนากลไกการประเมินที่ปรับขนาดได้ของตนเอง

ภาพประกอบต่อไปนี้แสดงสถาปัตยกรรมการประเมินแบบจำลอง

ในโพสต์นี้ เรามุ่งเน้นไปที่การดำเนินการประเมิน LLM ในระดับตามที่แสดงทางด้านซ้ายของภาพประกอบ ในอนาคต เราจะมุ่งเน้นไปที่การพัฒนาตัวอย่างที่ตอบสนองวงจรชีวิตแบบ end-to-end ของ FM ไปจนถึงการผลิตโดยปฏิบัติตามแนวทางที่อธิบายไว้ใน FMOps/LLMOps: ใช้งาน AI ที่สร้างและความแตกต่างด้วย MLOps. ซึ่งรวมถึงการให้บริการ LLM การตรวจสอบ การจัดเก็บคะแนนเอาท์พุตที่จะทำให้เกิดการประเมินซ้ำอัตโนมัติและการปรับแต่งอย่างละเอียดในที่สุด และสุดท้ายคือการใช้มนุษย์ในวงเพื่อทำงานกับข้อมูลที่ติดป้ายกำกับหรือแจ้งแค็ตตาล็อก

เกี่ยวกับผู้แต่ง

ดร. โซคราติส คาร์ทาคิส เป็นสถาปนิกโซลูชันผู้เชี่ยวชาญด้านการเรียนรู้ของเครื่องและการดำเนินงานหลักสำหรับ Amazon Web Services Sokratis มุ่งเน้นไปที่การช่วยให้ลูกค้าองค์กรสามารถสร้าง Machine Learning (ML) และโซลูชัน AI เชิงสร้างสรรค์ของตนให้เป็นอุตสาหกรรมโดยใช้ประโยชน์จากบริการของ AWS และกำหนดรูปแบบการดำเนินงานของตน เช่น รากฐานของ MLOps/FMOps/LLMOps และแผนงานการเปลี่ยนแปลงที่ใช้ประโยชน์จากแนวทางปฏิบัติในการพัฒนาที่ดีที่สุด เขาใช้เวลามากกว่า 15 ปีในการประดิษฐ์ ออกแบบ เป็นผู้นำ และนำโซลูชัน ML และ AI ระดับการผลิตแบบครบวงจรที่เป็นนวัตกรรมมาปรับใช้ในขอบเขตของพลังงาน การค้าปลีก สุขภาพ การเงิน มอเตอร์สปอร์ต ฯลฯ

ดร. โซคราติส คาร์ทาคิส เป็นสถาปนิกโซลูชันผู้เชี่ยวชาญด้านการเรียนรู้ของเครื่องและการดำเนินงานหลักสำหรับ Amazon Web Services Sokratis มุ่งเน้นไปที่การช่วยให้ลูกค้าองค์กรสามารถสร้าง Machine Learning (ML) และโซลูชัน AI เชิงสร้างสรรค์ของตนให้เป็นอุตสาหกรรมโดยใช้ประโยชน์จากบริการของ AWS และกำหนดรูปแบบการดำเนินงานของตน เช่น รากฐานของ MLOps/FMOps/LLMOps และแผนงานการเปลี่ยนแปลงที่ใช้ประโยชน์จากแนวทางปฏิบัติในการพัฒนาที่ดีที่สุด เขาใช้เวลามากกว่า 15 ปีในการประดิษฐ์ ออกแบบ เป็นผู้นำ และนำโซลูชัน ML และ AI ระดับการผลิตแบบครบวงจรที่เป็นนวัตกรรมมาปรับใช้ในขอบเขตของพลังงาน การค้าปลีก สุขภาพ การเงิน มอเตอร์สปอร์ต ฯลฯ

จักดีพ ซิงห์ โซนี เป็นสถาปนิกโซลูชันคู่ค้าอาวุโสที่ AWS ซึ่งตั้งอยู่ในเนเธอร์แลนด์ เขาใช้ความหลงใหลใน DevOps, GenAI และเครื่องมือก่อสร้างเพื่อช่วยเหลือทั้งผู้วางระบบและพันธมิตรด้านเทคโนโลยี Jagdeep ใช้พื้นฐานการพัฒนาแอปพลิเคชันและสถาปัตยกรรมของเขาเพื่อขับเคลื่อนนวัตกรรมภายในทีมของเขาและส่งเสริมเทคโนโลยีใหม่

จักดีพ ซิงห์ โซนี เป็นสถาปนิกโซลูชันคู่ค้าอาวุโสที่ AWS ซึ่งตั้งอยู่ในเนเธอร์แลนด์ เขาใช้ความหลงใหลใน DevOps, GenAI และเครื่องมือก่อสร้างเพื่อช่วยเหลือทั้งผู้วางระบบและพันธมิตรด้านเทคโนโลยี Jagdeep ใช้พื้นฐานการพัฒนาแอปพลิเคชันและสถาปัตยกรรมของเขาเพื่อขับเคลื่อนนวัตกรรมภายในทีมของเขาและส่งเสริมเทคโนโลยีใหม่

ดร.ริคคาร์โด กัตติ เป็นสถาปนิกโซลูชันสตาร์ทอัพอาวุโสที่อยู่ในอิตาลี เขาเป็นที่ปรึกษาทางเทคนิคสำหรับลูกค้า ช่วยให้ธุรกิจของพวกเขาเติบโตโดยการเลือกเครื่องมือและเทคโนโลยีที่เหมาะสมเพื่อสร้างสรรค์สิ่งใหม่ๆ ขยายขนาดอย่างรวดเร็ว และก้าวไปสู่ระดับโลกภายในไม่กี่นาที เขามีความหลงใหลเกี่ยวกับการเรียนรู้ของเครื่องและ AI เชิงสร้างสรรค์มาโดยตลอด โดยได้ศึกษาและประยุกต์ใช้เทคโนโลยีเหล่านี้ในโดเมนต่างๆ ตลอดอาชีพการทำงานของเขา เขาเป็นเจ้าภาพและบรรณาธิการของพอดแคสต์ภาษาอิตาลีเรื่อง “Casa Startup” ของ AWS ซึ่งนำเสนอเรื่องราวของผู้ก่อตั้งสตาร์ทอัพและเทรนด์เทคโนโลยีใหม่ๆ

ดร.ริคคาร์โด กัตติ เป็นสถาปนิกโซลูชันสตาร์ทอัพอาวุโสที่อยู่ในอิตาลี เขาเป็นที่ปรึกษาทางเทคนิคสำหรับลูกค้า ช่วยให้ธุรกิจของพวกเขาเติบโตโดยการเลือกเครื่องมือและเทคโนโลยีที่เหมาะสมเพื่อสร้างสรรค์สิ่งใหม่ๆ ขยายขนาดอย่างรวดเร็ว และก้าวไปสู่ระดับโลกภายในไม่กี่นาที เขามีความหลงใหลเกี่ยวกับการเรียนรู้ของเครื่องและ AI เชิงสร้างสรรค์มาโดยตลอด โดยได้ศึกษาและประยุกต์ใช้เทคโนโลยีเหล่านี้ในโดเมนต่างๆ ตลอดอาชีพการทำงานของเขา เขาเป็นเจ้าภาพและบรรณาธิการของพอดแคสต์ภาษาอิตาลีเรื่อง “Casa Startup” ของ AWS ซึ่งนำเสนอเรื่องราวของผู้ก่อตั้งสตาร์ทอัพและเทรนด์เทคโนโลยีใหม่ๆ

- เนื้อหาที่ขับเคลื่อนด้วย SEO และการเผยแพร่ประชาสัมพันธ์ รับการขยายวันนี้

- PlatoData.Network Vertical Generative Ai เพิ่มพลังให้กับตัวเอง เข้าถึงได้ที่นี่.

- เพลโตไอสตรีม. Web3 อัจฉริยะ ขยายความรู้ เข้าถึงได้ที่นี่.

- เพลโตESG. คาร์บอน, คลีนเทค, พลังงาน, สิ่งแวดล้อม แสงอาทิตย์, การจัดการของเสีย. เข้าถึงได้ที่นี่.

- เพลโตสุขภาพ เทคโนโลยีชีวภาพและข่าวกรองการทดลองทางคลินิก เข้าถึงได้ที่นี่.

- ที่มา: https://aws.amazon.com/blogs/machine-learning/operationalize-llm-evaluation-at-scale-using-amazon-sagemaker-clarify-and-mlops-services/

- :มี

- :เป็น

- :ไม่

- :ที่ไหน

- $ ขึ้น

- 1

- 100

- 7

- 9

- a

- เกี่ยวกับเรา

- เร่งความเร็ว

- เข้า

- ความถูกต้อง

- แม่นยำ

- บรรลุ

- การบรรลุ

- ข้าม

- กระทำ

- การกระตุ้น

- คล่องแคล่ว

- วัฏจักร

- ที่เพิ่ม

- นอกจากนี้

- นอกจากนี้

- ที่อยู่

- อย่างเพียงพอ

- การบริหาร

- การนำ

- การนำมาใช้

- ความก้าวหน้า

- กุนซือ

- หลังจาก

- กับ

- ตัวแทน

- AI

- พระราชบัญญัติ AI

- ระบบ AI

- จุดมุ่งหมาย

- การเล็ง

- ขั้นตอนวิธี

- อัลกอริทึม

- จัดแนว

- มีชีวิตอยู่

- ทั้งหมด

- ช่วยให้

- แล้ว

- ด้วย

- เสมอ

- อเมซอน

- อเมซอน SageMaker

- Amazon SageMaker JumpStart

- ท่อส่ง Amazon SageMaker

- สตูดิโอ Amazon SageMaker

- Amazon Web Services

- an

- วิเคราะห์

- และ

- อื่น

- คำตอบ

- ใด

- API

- การใช้งาน

- การพัฒนาโปรแกรมประยุกต์

- การใช้งาน

- ประยุกต์

- มีผลบังคับใช้

- เข้าใกล้

- เหมาะสม

- สถาปัตยกรรม

- เป็น

- พื้นที่

- อาร์กิวเมนต์

- AS

- ประเมินผล

- การประเมิน

- การประเมินผล

- การประเมินผล

- At

- การตรวจสอบบัญชี

- โดยอัตโนมัติ

- อัตโนมัติ

- อัตโนมัติ

- อัตโนมัติ

- อัตโนมัติ

- ใช้ได้

- AWS

- พื้นหลัง

- ตาม

- ขั้นพื้นฐาน

- BE

- เพราะ

- กลายเป็น

- รับ

- พฤติกรรม

- มาตรฐาน

- เกณฑ์มาตรฐาน

- มาตรฐาน

- ประโยชน์ที่ได้รับ

- ที่ดีที่สุด

- ดีกว่า

- ระหว่าง

- เกิน

- อคติ

- ลำเอียง

- อคติ

- Blocks

- ทั้งสอง

- การละเมิด

- ความกว้าง

- นำมาซึ่ง

- สร้าง

- สร้าง

- ธุรกิจ

- แต่

- by

- ที่เรียกว่า

- โทร

- CAN

- ผู้สมัคร

- ความสามารถในการ

- สามารถ

- จับ

- การ์ด

- ความก้าวหน้า

- กรณี

- กรณี

- แค็ตตาล็อก

- บาง

- ท้าทาย

- ลักษณะ

- ราคาถูก

- ตรวจสอบ

- Choose

- เลือก

- การจัดหมวดหมู่

- แยกประเภท

- ปลาเดยส์

- รหัส

- เหนียว

- ร่วมมือ

- การผสมผสาน

- การรวมกัน

- ร่วมกัน

- ชุมชน

- เทียบเคียง

- เปรียบเทียบ

- เมื่อเทียบกับ

- การเปรียบเทียบ

- ส่วนประกอบ

- เสร็จสิ้น

- ซับซ้อน

- ความซับซ้อน

- การปฏิบัติตาม

- ปฏิบัติตาม

- ส่วนประกอบ

- ส่วนประกอบ

- ประกอบไปด้วย

- การคำนวณ

- คำนวณ

- แนวคิด

- กังวล

- ความประพฤติ

- การดำเนิน

- ปฏิบัติ

- องค์ประกอบ

- เชื่อมต่อ

- เชื่อมต่อ

- ถือว่า

- ประกอบ

- สร้าง

- ผู้บริโภค

- ภาชนะ

- มี

- เนื้อหา

- การสร้างเนื้อหา

- สิ่งแวดล้อม

- เรื่อย

- ต่อเนื่องกัน

- ตรงกันข้าม

- การสนทนา

- การสนทนา

- แปลง

- แก้ไข

- ราคา

- ประหยัดค่าใช้จ่าย

- แพง

- ค่าใช้จ่าย

- หน้าปก

- สร้าง

- ที่สร้างขึ้น

- การสร้าง

- การสร้าง

- เกณฑ์

- วิกฤติ

- สำคัญมาก

- ประเพณี

- ลูกค้า

- DAG

- ข้อมูล

- การเตรียมข้อมูล

- นักวิทยาศาสตร์ข้อมูล

- ความปลอดภัยของข้อมูล

- ชุดข้อมูล

- การปลอมแปลงข้อมูล

- ชุดข้อมูล

- วันเวลา

- ตัดสินใจ

- การตัดสินใจ

- การตัดสินใจ

- ทุ่มเท

- ลึก

- ดำน้ำลึก

- ค่าเริ่มต้น

- กำหนด

- คำจำกัดความ

- มอบ

- ความต้องการ

- การอ้างอิง

- ขึ้นอยู่กับ

- ปรับใช้

- นำไปใช้

- ปรับใช้

- การใช้งาน

- ความลึก

- อธิบาย

- กำหนด

- ได้รับการออกแบบ

- การออกแบบ

- การออกแบบ

- ปรารถนา

- ที่ต้องการ

- รายละเอียด

- รายละเอียด

- พัฒนา

- พัฒนา

- ที่กำลังพัฒนา

- พัฒนาการ

- ความแตกต่าง

- ต่าง

- โดยตรง

- กำกับการแสดง

- การดำน้ำ

- หลาย

- do

- ไม่

- โดเมน

- โดเมน

- ขับรถ

- ในระหว่าง

- แบบไดนามิก

- e

- แต่ละ

- อย่างง่ายดาย

- ง่าย

- บรรณาธิการ

- มีประสิทธิภาพ

- ประสิทธิผล

- ที่มีประสิทธิภาพ

- อย่างมีประสิทธิภาพ

- ความพยายาม

- ทั้ง

- องค์ประกอบ

- อื่น

- การจ้างงาน

- ทำให้สามารถ

- ช่วยให้

- การเปิดใช้งาน

- จบสิ้น

- ปลายทาง

- พลังงาน

- วิศวกร

- เสริม

- ทำให้มั่นใจ

- เพื่อให้แน่ใจ

- การสร้างความมั่นใจ

- Enterprise

- ผู้ประกอบการ

- ยุค

- พอ ๆ กัน

- โดยเฉพาะอย่างยิ่ง

- จำเป็น

- ฯลฯ

- EU

- ประเมินค่า

- ประเมิน

- การประเมินการ

- การประเมินผล

- แม้

- ในที่สุด

- ตัวอย่าง

- ตัวอย่าง

- ผู้บริหารงาน

- ที่มีอยู่

- ความคาดหวัง

- ที่คาดหวัง

- เร่ง

- การใช้ประโยชน์จาก

- ขยายออก

- ขยาย

- ภายนอก

- การสกัด

- f1

- ใบหน้า

- อำนวยความสะดวก

- ปัจจัย

- ความเป็นธรรม

- ฟอลส์

- เท็จ

- มีชื่อเสียง

- FAST

- เร็วขึ้น

- ลักษณะ

- ที่มีคุณสมบัติ

- ข้อเสนอแนะ

- สองสาม

- สนาม

- รูป

- ตัวเลข

- เนื้อไม่มีมัน

- สุดท้าย

- ในที่สุด

- เงินทุน

- ทางการเงิน

- ภาคการเงิน

- ชื่อจริง

- ความยืดหยุ่น

- โฟกัส

- มุ่งเน้น

- มุ่งเน้นไปที่

- ตาม

- ดังต่อไปนี้

- ดังต่อไปนี้

- สำหรับ

- ฟอร์ม

- รากฐาน

- ฐานราก

- ผู้ก่อตั้ง

- กรอบ

- กรอบ

- มัก

- ราคาเริ่มต้นที่

- การตอบสนอง

- เต็ม

- ฟังก์ชันการทำงาน

- ฟังก์ชั่น

- พื้นฐาน

- นอกจากนี้

- อนาคต

- การรวบรวม

- General

- จุดประสงค์ทั่วไป

- สร้าง

- สร้าง

- สร้าง

- การสร้าง

- รุ่น

- กำเนิด

- กำเนิด AI

- ได้รับ

- กำหนด

- เหตุการณ์ที่

- Go

- ให้

- กราฟ

- บัญชีกลุ่ม

- กลุ่ม

- การเจริญเติบโต

- มือ

- เป็นอันตราย

- การควบคุม

- มี

- มี

- he

- สุขภาพ

- หนัก

- ช่วย

- การช่วยเหลือ

- จะช่วยให้

- จุดสูง

- มีความเสี่ยงสูง

- บานพับ

- ของเขา

- โฮลดิ้ง

- เจ้าภาพ

- สรุป ความน่าเชื่อถือของ Olymp Trade?

- ทำอย่างไร

- อย่างไรก็ตาม

- HTML

- HTTPS

- เป็นมนุษย์

- i

- ระบุ

- ระบุ

- แยกแยะ

- if

- แสดงให้เห็นถึง

- ภาพ

- การดำเนินการ

- การดำเนินการ

- การดำเนินการ

- นำเข้า

- ความสำคัญ

- การปรับปรุง

- การปรับปรุง

- in

- ประกอบด้วย

- รวมถึง

- รวมทั้ง

- Incorporated

- ผสมผสาน

- ตัวชี้วัด

- อุตสาหกรรม

- ข้อมูล

- แจ้ง

- โครงสร้างพื้นฐาน

- แรกเริ่ม

- เราสร้างสรรค์สิ่งใหม่ ๆ

- นักวิเคราะห์ส่วนบุคคลที่หาโอกาสให้เป็นไปได้มากที่สุด

- นวัตกรรม

- อินพุต

- ปัจจัยการผลิต

- รวบรวม

- บูรณาการ

- จงใจ

- ปฏิสัมพันธ์

- ภายใน

- เข้าไป

- แนะนำ

- เรียก

- รวมถึง

- ร่วมมือ

- ที่เกี่ยวข้องกับ

- มาตรฐาน ISO

- IT

- อิตาลี

- อิตาลี

- รายการ

- การย้ำ

- ITS

- การสัมภาษณ์

- การเดินทาง

- jpg

- เก็บ

- เก็บไว้

- คีย์

- ความรู้

- ภาษา

- ใหญ่

- ที่มีขนาดใหญ่

- ชื่อสกุล

- ในที่สุด

- ความแอบแฝง

- นำ

- ผู้นำ

- ชั้นนำ

- การเรียนรู้

- เรียนรู้

- ซ้าย

- ให้

- การใช้ประโยชน์

- ห้องสมุด

- วงจรชีวิต

- กดไลก์

- ถูก จำกัด

- LINK

- ดูรายละเอียด

- LLM

- ที่ตั้ง

- ตรรกะ

- ต่ำ

- เครื่อง

- เรียนรู้เครื่อง

- หลัก

- เก็บรักษา

- รักษา

- การจัดการ

- การจัดการกับ

- กิจวัตร

- คู่มือ

- หลาย

- อาจ..

- ในขณะเดียวกัน

- วัด

- มาตรการ

- กลไก

- เมตาดาต้า

- วิธี

- วิธีการ

- เมตริก

- ตัวชี้วัด

- นาที

- ข้อมูลที่ผิด

- บรรเทา

- ซึ่งบรรเทา

- ML

- ม.ป.ป

- แบบ

- โมเดล

- โมดูล

- การตรวจสอบ

- การตรวจสอบ

- ข้อมูลเพิ่มเติม

- มากที่สุด

- แรงบันดาลใจ

- กีฬามอเตอร์สปอร์ต

- มาก

- หลาย

- ต้อง

- ชื่อ

- จำเป็น

- จำเป็นต้อง

- ความต้องการ

- เนเธอร์แลนด์

- ใหม่

- เทคโนโลยีใหม่ ๆ

- ถัดไป

- ไม่ใช่ผู้เชี่ยวชาญ

- หมายเหตุ

- สมุดบันทึก

- ความแตกต่าง

- จำนวน

- of

- เสนอ

- มักจะ

- on

- ครั้งเดียว

- ONE

- ต่อเนื่อง

- เพียง

- โอเพนซอร์ส

- การดำเนินงาน

- การดำเนินการ

- การดำเนินการ

- ความคิดเห็น

- การเพิ่มประสิทธิภาพ

- or

- OS

- อื่นๆ

- ของเรา

- ออก

- ผล

- ผลลัพธ์

- เอาท์พุต

- เอาท์พุท

- โดดเด่น

- เกิน

- ทั้งหมด

- ของตนเอง

- เจ้าของ

- Parallel

- พารามิเตอร์

- ในสิ่งที่สนใจ

- โดยเฉพาะ

- หุ้นส่วน

- พาร์ทเนอร์

- กิเลส

- หลงใหล

- เส้นทาง

- รูปแบบ

- รูปแบบไฟล์ PDF

- คน

- ดำเนินการ

- การปฏิบัติ

- การแสดง

- ดำเนินการ

- ระยะ

- ท่อ

- สถานที่

- ตัวยึด

- เพลโต

- เพลโตดาต้าอินเทลลิเจนซ์

- เพลโตดาต้า

- PoC

- พอดคาสต์

- จุด

- สระ

- สระว่ายน้ำ

- โพสต์

- ที่มีศักยภาพ

- อำนาจ

- ขับเคลื่อน

- การปฏิบัติ

- ความแม่นยำ

- การจัดเตรียม

- การเตรียมความพร้อม

- การมี

- ป้องกัน

- ก่อน

- ประถม

- หลัก

- หลักการ

- ความเป็นส่วนตัว

- ส่วนตัว

- ปัญหา

- ขั้นตอนการ

- กระบวนการ

- กระบวนการ

- การประมวลผล

- การผลิต

- ในอาชีพ

- ชื่อเสียง

- คำมั่นสัญญา

- ส่งเสริม

- แจ้ง

- พิสูจน์

- พิสูจน์แนวคิด

- คุณสมบัติ

- เป็นเจ้าของ

- ป้องกัน

- พิสูจน์

- ให้

- ผู้ให้บริการ

- ให้

- การให้

- สาธารณะ

- สาธารณชน

- วัตถุประสงค์

- หลาม

- เชิงคุณภาพ

- คุณภาพ

- เชิงปริมาณ

- คำถาม

- พิสัย

- คะแนน

- อันดับ

- จริง

- โลกแห่งความจริง

- เรียลไทม์

- ลด

- ลดลง

- ลด

- อ้างอิง

- การอ้างอิง

- ลงทะเบียน

- ลงทะเบียน

- รีจิสทรี

- ปกติ

- ควบคุม

- อุตสาหกรรมที่มีการควบคุม

- กฎระเบียบ

- ที่เกี่ยวข้อง

- ความสัมพันธ์กัน

- ตรงประเด็น

- ความเชื่อถือได้

- ซ้ำ

- รายงาน

- การรายงาน

- รายงาน

- กรุ

- ตัวแทน

- จำเป็นต้องใช้

- ต้อง

- การวิจัย

- นักวิจัย

- ใช้ทรัพยากรมาก

- แหล่งข้อมูล

- ความรับผิดชอบ

- รับผิดชอบ

- ส่งผลให้

- ผลสอบ

- ค้าปลีก

- รักษา

- กลับ

- นำมาใช้ใหม่

- ทบทวน

- ปฏิวัติ

- ขวา

- เข้มงวด

- เกิดขึ้น

- ความเสี่ยง

- ความเสี่ยง

- แผนงาน

- แข็งแรง

- ความแข็งแรง

- บทบาท

- บทบาท

- วิ่ง

- วิ่ง

- ทำงาน

- s

- ปลอดภัย

- การป้องกัน

- sagemaker

- ท่อส่ง SageMaker

- เงินออม

- scalability

- ที่ปรับขนาดได้

- ขนาด

- สถานการณ์

- สถานการณ์

- นักวิทยาศาสตร์

- นักวิทยาศาสตร์

- ขอบเขต

- คะแนน

- ต้นฉบับ

- SDK

- ได้อย่างลงตัว

- ส่วน

- ภาค

- ปลอดภัย

- ความปลอดภัย

- ความเสี่ยงด้านความปลอดภัย

- เลือก

- เลือก

- การเลือก

- การเลือก

- ระดับอาวุโส

- ความรู้สึก

- ให้บริการ

- บริการ

- บริการ

- การให้บริการ

- เซสชั่น

- ชุด

- การสร้าง

- Share

- โชว์

- แสดง

- แสดงให้เห็นว่า

- ด้าน

- สำคัญ

- คล้ายคลึงกัน

- ช่วยลดความยุ่งยาก

- ง่ายดาย

- ตั้งแต่

- เดียว

- เล็ก

- ทางออก

- โซลูชัน

- แก้

- บาง

- แหล่ง

- ระยะ

- ผู้เชี่ยวชาญ

- โดยเฉพาะ

- เฉพาะ

- การใช้จ่าย

- การแสดงละคร

- ผู้มีส่วนได้เสีย

- มาตรฐาน

- มาตรฐาน

- Stanford

- ที่เริ่มต้น

- เริ่มต้น

- การเริ่มต้น

- Status

- ขั้นตอน

- ขั้นตอน

- ยังคง

- การเก็บรักษา

- จัดเก็บ

- จำนวนชั้น

- การเก็บรักษา

- ซื่อตรง

- โครงสร้าง

- มีการศึกษา

- สตูดิโอ

- สไตล์

- ต่อจากนั้น

- อย่างเช่น

- สรุป

- สนับสนุน

- ระบบ

- ระบบ

- การตัดเสื้อ

- งาน

- งาน

- ทีม

- ทีม

- วิชาการ

- เทคนิค

- เทคโนโลยี

- เทคโนโลยี

- เทคโนโลยี

- แม่แบบ

- ทดสอบ

- ทดสอบ

- การทดสอบ

- การทดสอบ

- ข้อความ

- กว่า

- ที่

- พื้นที่

- ก้าวสู่อนาคต

- ของพวกเขา

- พวกเขา

- แล้วก็

- ตามทฤษฎี

- ดังนั้น

- ดังนั้น

- ล้อยางขัดเหล่านี้ติดตั้งบนแกน XNUMX (มม.) ผลิตภัณฑ์นี้ถูกผลิตในหลายรูปทรง และหลากหลายเบอร์ความแน่นหนาของปริมาณอนุภาคขัดของมัน จะทำให้ท่านได้รับประสิทธิภาพสูงในการขัดและการใช้งานที่ยาวนาน

- พวกเขา

- นี้

- เหล่านั้น

- สาม

- ตลอด

- ตลอด

- เวลา

- ไปยัง

- ร่วมกัน

- เครื่องมือ

- เครื่องมือ

- ลู่

- รถไฟ

- ผ่านการฝึกอบรม

- การฝึกอบรม

- รถไฟ

- การแปลง

- การเปลี่ยนแปลง

- เปลี่ยน

- การแปลภาษา

- แนวโน้ม

- เรียก

- จริง

- เชื่อถือได้

- สอง

- ชนิด

- ตามแบบฉบับ

- ในที่สุด

- ไม่มีสิทธิ

- เข้าใจ

- ความเข้าใจ

- เป็นประวัติการณ์

- ที่กำลังมา

- ใช้

- ใช้กรณี

- มือสอง

- ผู้ใช้งาน

- ผู้ใช้

- ใช้

- การใช้

- มักจะ

- นำไปใช้

- ตรวจสอบความถูกต้อง

- มีคุณค่า

- ต่างๆ

- รุ่น

- รุ่น

- ผ่านทาง

- จำเป็น

- ช่องโหว่

- ต้องการ

- ผู้สมัครที่รู้จักเรา

- we

- เว็บ

- บริการเว็บ

- ดี

- คือ

- อะไร

- เมื่อ

- ที่

- ในขณะที่

- WHO

- กว้าง

- ช่วงกว้าง

- วิกิพีเดีย

- จะ

- กับ

- ภายใน

- ไม่มี

- งาน

- เวิร์กโฟลว์

- การทำงาน

- โลก

- มันแกว

- ปี

- ผล

- คุณ

- ของคุณ

- ลมทะเล