การตรวจจับข้อบกพร่องอัตโนมัติโดยใช้คอมพิวเตอร์วิทัศน์ช่วยปรับปรุงคุณภาพและลดต้นทุนการตรวจสอบ การตรวจจับข้อบกพร่องเกี่ยวข้องกับการระบุการมีอยู่ของข้อบกพร่อง การจำแนกประเภทของข้อบกพร่อง และการระบุตำแหน่งของข้อบกพร่อง กระบวนการผลิตจำนวนมากต้องการการตรวจจับที่เวลาแฝงต่ำ โดยมีทรัพยากรในการประมวลผลที่จำกัด และการเชื่อมต่อที่จำกัด

Amazon Lookout สำหรับวิสัยทัศน์ คือบริการการเรียนรู้ของเครื่อง (ML) ที่ช่วยระบุข้อบกพร่องของผลิตภัณฑ์โดยใช้คอมพิวเตอร์วิทัศน์เพื่อทำให้กระบวนการตรวจสอบคุณภาพในสายการผลิตของคุณเป็นไปโดยอัตโนมัติ โดยไม่ต้องมีความเชี่ยวชาญด้าน ML Lookout for Vision รวมความสามารถในการระบุตำแหน่งและประเภทของความผิดปกติโดยใช้แบบจำลอง ML การแบ่งส่วนความหมาย โมเดล ML ที่กำหนดเองเหล่านี้สามารถปรับใช้กับ AWS Cloud ได้โดยใช้ API บนคลาวด์ หรือฮาร์ดแวร์ขอบแบบกำหนดเองโดยใช้ AWS IoT กรีนกราส. Lookout for Vision รองรับการอนุมานบนแพลตฟอร์มประมวลผล x86 ที่ทำงานบน Linux โดยมีหรือไม่มีตัวเร่ง GPU ของ NVIDIA และบนอุปกรณ์ Edge ที่ใช้ NVIDIA Jetson ความยืดหยุ่นนี้ช่วยให้สามารถตรวจจับข้อบกพร่องในฮาร์ดแวร์ที่มีอยู่หรือใหม่ได้

ในโพสต์นี้ เราจะแสดงวิธีการตรวจหาชิ้นส่วนที่บกพร่องโดยใช้ Lookout สำหรับรุ่น Vision ML ที่ทำงานบนอุปกรณ์ Edge ซึ่งเราจำลองโดยใช้ อเมซอน อีลาสติก คอมพิวท์ คลาวด์ (Amazon EC2) อินสแตนซ์ เราดำเนินการฝึกอบรมโมเดลการแบ่งเซ็กเมนต์เชิงความหมายใหม่ ส่งออกเป็นส่วนประกอบ AWS IoT Greengrass และเรียกใช้การอนุมานในโหมด CPU เท่านั้นด้วยโค้ดตัวอย่าง Python

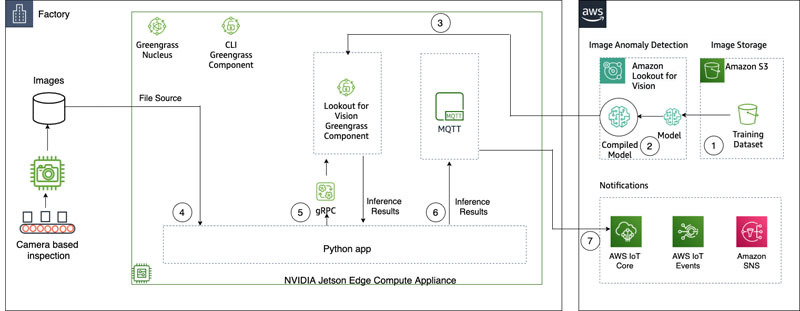

ภาพรวมโซลูชัน

ในโพสต์นี้เราใช้ชุดรูปภาพของ มนุษย์ต่างดาวของเล่น ประกอบด้วยภาพปกติและภาพที่มีข้อบกพร่อง เช่น แขนขา ตา หรือส่วนอื่นๆ ที่หายไป เราฝึกโมเดล Lookout for Vision ในคลาวด์เพื่อระบุของเล่นเอเลี่ยนที่มีข้อบกพร่อง เรารวบรวมโมเดลเป็น CPU X86 เป้าหมาย จัดแพ็คเกจ Lookout for Vision model ที่ผ่านการฝึกอบรมเป็นส่วนประกอบ AWS IoT Greengrass และปรับใช้โมเดลกับอินสแตนซ์ EC2 โดยไม่ต้องใช้ GPU โดยใช้คอนโซล AWS IoT Greengrass สุดท้าย เราสาธิตแอปพลิเคชันตัวอย่างที่ใช้ Python ที่ทำงานบนอินสแตนซ์ EC2 (C5a.2xl) ที่จัดหารูปภาพของเล่นต่างด้าวจากระบบไฟล์ของอุปกรณ์ Edge เรียกใช้การอนุมานบนโมเดล Lookout for Vision โดยใช้ ก.ร.ป ส่วนต่อประสานและส่งข้อมูลการอนุมานไปที่an MQTT หัวข้อใน AWS Cloud สคริปต์จะแสดงรูปภาพที่มีสีและตำแหน่งของข้อบกพร่องบนรูปภาพที่ผิดปกติ

ไดอะแกรมต่อไปนี้แสดงสถาปัตยกรรมโซลูชัน สิ่งสำคัญที่ควรทราบสำหรับข้อบกพร่องแต่ละประเภทที่คุณต้องการตรวจจับในการโลคัลไลเซชัน คุณต้องมีรูปภาพความผิดปกติที่ทำเครื่องหมายไว้ 10 รูปในการฝึก และ 10 ภาพในข้อมูลทดสอบ รวมเป็นภาพประเภทนั้นทั้งหมด 20 รูป สำหรับโพสต์นี้ เราค้นหาชิ้นส่วนที่ขาดหายไปของของเล่น

โซลูชันมีเวิร์กโฟลว์ต่อไปนี้:

- อัปโหลดชุดข้อมูลการฝึกและชุดข้อมูลทดสอบไปที่ บริการจัดเก็บข้อมูลอย่างง่ายของ Amazon (อเมซอน เอส3).

- ใช้ Lookout for Vision UI ใหม่เพื่อเพิ่มประเภทความผิดปกติและทำเครื่องหมายว่าความผิดปกตินั้นอยู่ที่ใดในภาพการฝึกและทดสอบ

- ฝึกโมเดล Lookout for Vision ในระบบคลาวด์

- รวบรวมโมเดลไปยังสถาปัตยกรรมเป้าหมาย (X86) และปรับใช้โมเดลกับอินสแตนซ์ EC2 (C5a.2xl) โดยใช้คอนโซล AWS IoT Greengrass

- แหล่งที่มาของอิมเมจจากโลคัลดิสก์

- เรียกใช้การอนุมานบนโมเดลที่ปรับใช้ผ่านอินเทอร์เฟซ gRPC และดึงรูปภาพของมาสก์ความผิดปกติที่ซ้อนทับบนรูปภาพต้นฉบับ

- โพสต์ผลการอนุมานไปยังไคลเอนต์ MQTT ที่ทำงานบนอินสแตนซ์ขอบ

- รับข้อความ MQTT ในหัวข้อใน AWS IoT คอร์ ใน AWS Cloud สำหรับการตรวจสอบและการแสดงภาพเพิ่มเติม

ขั้นตอนที่ 5, 6 และ 7 ประสานกับตัวอย่างแอปพลิเคชัน Python

เบื้องต้น

ก่อนที่คุณจะเริ่มต้น ให้ทำตามข้อกำหนดเบื้องต้นต่อไปนี้ สำหรับโพสต์นี้ เราใช้อินสแตนซ์ EC2 c5.2xl และติดตั้ง AWS IoT Greengrass V2 เพื่อทดลองใช้คุณสมบัติใหม่ หากคุณต้องการใช้งานบน NVIDIA Jetson ให้ทำตามขั้นตอนในโพสต์ก่อนหน้าของเรา ขณะนี้ Amazon Lookout for Vision รองรับการตรวจสอบข้อบกพร่องของผลิตภัณฑ์ที่ขอบด้วยสายตาแล้ว.

- สร้างบัญชี AWS.

- เริ่มอินสแตนซ์ EC2 ที่เราสามารถติดตั้ง AWS IoT Greengrass และใช้โหมดการอนุมานเฉพาะ CPU ใหม่ได้ คุณยังสามารถใช้เครื่อง Intel X86 64 บิตที่มี ram 8 กิกะไบต์ขึ้นไป (เราใช้ c5a.2xl แต่อะไรก็ได้ที่มี มากกว่า 8 กิกะไบต์บนแพลตฟอร์ม x86 ควรใช้งานได้) ที่ใช้ Ubuntu 20.04

- ติดตั้ง AWS IoT Greengrass V2:

- ติดตั้งระบบที่จำเป็นและการพึ่งพา Python 3 (Ubuntu 20.04):

อัปโหลดชุดข้อมูลและฝึกโมเดล

เราใช้ ชุดข้อมูลของเล่นมนุษย์ต่างดาว เพื่อแสดงวิธีแก้ปัญหา ชุดข้อมูลประกอบด้วยภาพปกติและผิดปกติ นี่คือภาพตัวอย่างบางส่วนจากชุดข้อมูล

รูปภาพต่อไปนี้แสดงของเล่นมนุษย์ต่างดาวปกติ

รูปภาพต่อไปนี้แสดงของเล่นต่างด้าวที่ไม่มีขา

รูปภาพต่อไปนี้แสดงของเล่นต่างดาวที่ขาดหัว

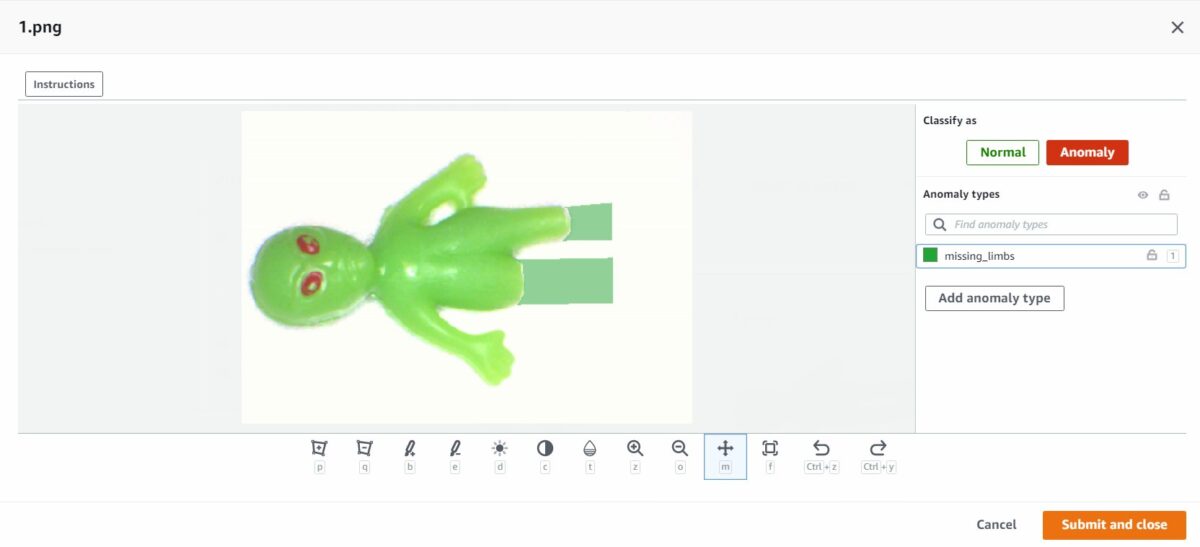

ในโพสต์นี้ เรามองหาแขนขาที่ขาดหายไป เราใช้อินเทอร์เฟซผู้ใช้ใหม่เพื่อวาดหน้ากากรอบข้อบกพร่องในข้อมูลการฝึกอบรมและการทดสอบของเรา สิ่งนี้จะบอกโมเดลการแบ่งส่วนความหมายว่าจะระบุข้อบกพร่องประเภทนี้ได้อย่างไร

- เริ่มต้นด้วยการอัปโหลดชุดข้อมูลของคุณ ผ่าน Amazon S3 หรือจากคอมพิวเตอร์ของคุณ

- จัดเรียงลงในโฟลเดอร์ชื่อ

normalและanomaly. - เมื่อสร้างชุดข้อมูลของคุณ ให้เลือก ติดป้ายกำกับรูปภาพโดยอัตโนมัติตามชื่อโฟลเดอร์ซึ่งช่วยให้เราสามารถแยกแยะภาพผิดปกติในภายหลังและวาดในพื้นที่ที่จะติดป้ายว่ามีข้อบกพร่อง

- พยายามระงับภาพบางส่วนเพื่อทดสอบในภายหลังของทั้งสอง

normalและanomaly. - หลังจากเพิ่มรูปภาพทั้งหมดลงในชุดข้อมูลแล้ว ให้เลือก เพิ่มป้ายกำกับความผิดปกติ.

- เริ่มการติดฉลากข้อมูลโดยเลือก เริ่มติดฉลาก.

- เพื่อเพิ่มความเร็วในกระบวนการ คุณสามารถเลือกหลายภาพและจำแนกเป็น

NormalorAnomaly.

หากคุณต้องการเน้นความผิดปกตินอกเหนือจากการจำแนกประเภท คุณจะต้องเน้นว่าความผิดปกตินั้นอยู่ที่ใด - เลือกรูปภาพที่คุณต้องการใส่คำอธิบายประกอบ

- ใช้เครื่องมือวาดภาพเพื่อแสดงส่วนที่ขาดหายไปของวัตถุ หรือวาดหน้ากากเหนือจุดบกพร่อง

- Choose ส่งและปิด เพื่อรักษาการเปลี่ยนแปลงเหล่านี้

- ทำขั้นตอนนี้ซ้ำสำหรับรูปภาพทั้งหมดของคุณ

- เสร็จแล้วเลือก ลด เพื่อยืนยันการเปลี่ยนแปลงของคุณ ตอนนี้คุณพร้อมที่จะฝึกโมเดลของคุณแล้ว

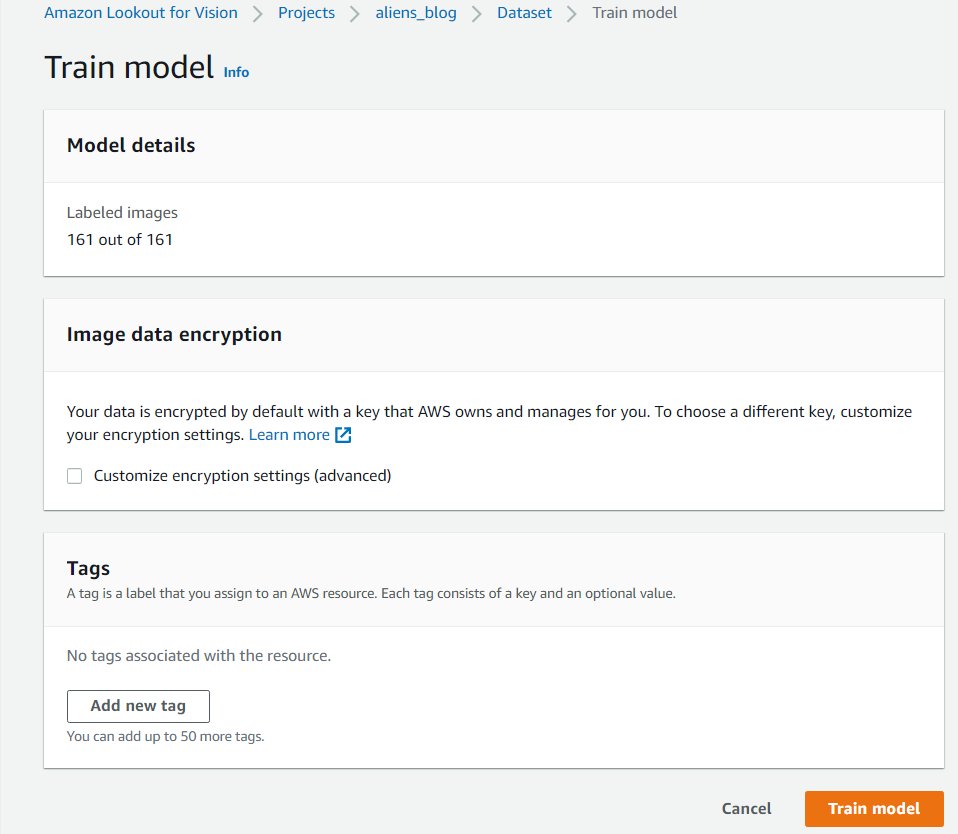

- Choose โมเดลรถไฟ.

หลังจากคุณทำตามขั้นตอนเหล่านี้แล้ว คุณสามารถนำทางไปยังโปรเจ็กต์และ Models หน้าเพื่อตรวจสอบประสิทธิภาพของรุ่นที่ได้รับการฝึกอบรม คุณสามารถเริ่มกระบวนการส่งออกแบบจำลองไปยังอุปกรณ์ขอบเป้าหมายได้ตลอดเวลาหลังจากที่แบบจำลองได้รับการฝึกอบรม

ฝึกโมเดลใหม่ด้วยรูปภาพที่แก้ไขแล้ว

บางครั้งการติดแท็กความผิดปกติอาจไม่ถูกต้องนัก คุณมีโอกาสที่จะช่วยให้แบบจำลองของคุณเรียนรู้ความผิดปกติได้ดีขึ้น ตัวอย่างเช่น รูปภาพต่อไปนี้ถูกระบุว่าเป็นความผิดปกติ แต่ไม่แสดง missing_limbs แท็ก

มาเปิดตัวแก้ไขและแก้ไขปัญหานี้กัน

ผ่านภาพใด ๆ ที่คุณพบเช่นนี้ หากคุณพบว่ามีการแท็กความผิดปกติอย่างไม่ถูกต้อง คุณสามารถใช้เครื่องมือยางลบเพื่อลบแท็กที่ไม่ถูกต้อง

ตอนนี้คุณสามารถฝึกโมเดลของคุณอีกครั้งและบรรลุความแม่นยำที่ดีขึ้น

รวบรวมและจัดแพ็คเกจโมเดลเป็นส่วนประกอบ AWS IoT Greengrass

ในส่วนนี้ เราจะอธิบายขั้นตอนต่างๆ ในการรวบรวมโมเดลของเล่นเอเลี่ยนไปยังอุปกรณ์ Edge เป้าหมายของเรา และจัดแพ็คเกจโมเดลเป็นส่วนประกอบ AWS IoT Greengrass

- บนคอนโซล Lookout for Vision ให้เลือกโปรเจ็กต์ของคุณ

- ในบานหน้าต่างนำทาง เลือก แพ็คเกจรุ่นขอบ.

- Choose สร้างงานโมเดลบรรจุภัณฑ์.

- สำหรับ ชื่องาน, ป้อนชื่อ

- สำหรับ รายละเอียดงานป้อนคำอธิบายเพิ่มเติม

- Choose เรียกดูรุ่น.

- เลือกรุ่นโมเดล (โมเดลของเล่นเอเลี่ยนที่สร้างขึ้นในส่วนก่อนหน้า)

- Choose Choose.

- หากคุณใช้งานสิ่งนี้บน Amazon EC2 หรืออุปกรณ์ X86-64 ให้เลือก แพลตฟอร์มเป้าหมาย และเลือก ลินุกซ์, X86และ ซีพียู.

หากใช้ CPU คุณสามารถเว้นตัวเลือกคอมไพเลอร์ว่างไว้ได้หากคุณไม่แน่ใจและไม่มี NVIDIA GPU หากคุณมีแพลตฟอร์มที่ใช้ Intel ที่รองรับ AVX512 คุณสามารถเพิ่มตัวเลือกคอมไพเลอร์เหล่านี้เพื่อปรับให้เหมาะสมเพื่อประสิทธิภาพที่ดีขึ้น:{"mcpu": "skylake-avx512"}. คุณสามารถดูชื่องานและสถานะของคุณที่แสดงเป็น

คุณสามารถดูชื่องานและสถานะของคุณที่แสดงเป็น In progress. งานบรรจุภัณฑ์แบบจำลองอาจใช้เวลาสักครู่จึงจะเสร็จสมบูรณ์ เมื่องานบรรจุภัณฑ์แบบจำลองเสร็จสมบูรณ์ สถานะจะแสดงเป็นSuccess. - เลือกชื่องานของคุณ (ในกรณีของเราคือ

aliensblogcpux86) เพื่อดูรายละเอียดงาน

- Choose สร้างงานโมเดลบรรจุภัณฑ์.

- ใส่รายละเอียดสำหรับ ชื่อส่วนประกอบ, คำอธิบายส่วนประกอบ (ไม่จำเป็น), เวอร์ชันส่วนประกอบและ ตำแหน่งส่วนประกอบ.Lookout for Vision จัดเก็บสูตรส่วนประกอบและสิ่งประดิษฐ์ในตำแหน่ง Amazon S3 นี้

- Choose ปรับใช้ต่อใน Greengrass เพื่อปรับใช้ส่วนประกอบกับอุปกรณ์ขอบเป้าหมาย

ส่วนประกอบ AWS IoT Greengrass และสิ่งประดิษฐ์ของโมเดลได้ถูกสร้างขึ้นในบัญชี AWS ของคุณแล้ว

ปรับใช้โมเดล

ตรวจสอบให้แน่ใจว่าคุณได้ติดตั้ง AWS IoT Greengrass V2 บนอุปกรณ์เป้าหมายสำหรับบัญชีของคุณก่อนที่จะดำเนินการต่อ สำหรับคำแนะนำ โปรดดูที่ ติดตั้งซอฟต์แวร์ AWS IoT Greengrass Core.

ในส่วนนี้ เราจะอธิบายขั้นตอนต่างๆ ในการปรับใช้โมเดลของเล่นเอเลี่ยนกับอุปกรณ์ Edge โดยใช้คอนโซล AWS IoT Greengrass

- บนคอนโซล AWS IoT Greengrass ให้ไปที่อุปกรณ์ Edge ของคุณ

- Choose ปรับใช้ เพื่อเริ่มขั้นตอนการปรับใช้

- เลือก อุปกรณ์หลัก (เนื่องจากการปรับใช้เป็นเครื่องเดียว) และป้อนชื่อสำหรับ ชื่อเป้าหมาย.ชื่อเป้าหมายเป็นชื่อเดียวกับที่คุณใช้ตั้งชื่ออุปกรณ์หลักระหว่างกระบวนการติดตั้ง AWS IoT Greengrass V2

- เลือกส่วนประกอบของคุณ ในกรณีของเรา ชื่อส่วนประกอบคือ

aliensblogcpux86ซึ่งประกอบด้วยของเล่นโมเดลเอเลี่ยน - Choose ถัดไป.

- กำหนดค่าส่วนประกอบ (ไม่บังคับ)

- Choose ถัดไป.

- แสดง นโยบายการทำให้ใช้งานได้.

- สำหรับ นโยบายการอัพเดทส่วนประกอบให้เลือก แจ้งส่วนประกอบซึ่งช่วยให้คอมโพเนนต์ที่ปรับใช้แล้ว (คอมโพเนนต์เวอร์ชันก่อนหน้า) สามารถเลื่อนการอัปเดตได้จนกว่าคุณจะพร้อมที่จะอัปเดต

- สำหรับ นโยบายการจัดการความล้มเหลวให้เลือก อย่าท้อถอย.ในกรณีที่เกิดความล้มเหลว ตัวเลือกนี้ช่วยให้เราตรวจสอบข้อผิดพลาดในการปรับใช้ได้

- Choose ถัดไป.

- ตรวจสอบรายการส่วนประกอบที่จะปรับใช้บนอุปกรณ์เป้าหมาย (ขอบ)

- Choose ถัดไป.คุณควรเห็นข้อความ

Deployment successfully created. - ในการตรวจสอบการปรับใช้โมเดลสำเร็จ ให้รันคำสั่งต่อไปนี้บนอุปกรณ์ Edge ของคุณ:

คุณควรเห็นผลลัพธ์ที่คล้ายกันเรียกใช้ aliensblogcpux86 สคริปต์เริ่มต้นวงจรชีวิต:

ส่วนประกอบที่ทำงานอยู่ใน Greengrass:

เรียกใช้การอนุมานบนโมเดล

หมายเหตุ: หากคุณเรียกใช้ Greengrass ในฐานะผู้ใช้อื่นนอกเหนือจากที่คุณเข้าสู่ระบบ คุณจะต้องเปลี่ยนสิทธิ์ของไฟล์ /tmp/aws.iot.lookoutvision.EdgeAgent.sock:

ตอนนี้เราพร้อมที่จะทำการอนุมานกับโมเดลแล้ว บนอุปกรณ์ Edge ของคุณ ให้รันคำสั่งต่อไปนี้เพื่อโหลดโมเดล (replace ด้วยชื่อรุ่นที่ใช้ในส่วนประกอบของคุณ):

ในการสร้างการอนุมาน ให้รันคำสั่งต่อไปนี้ด้วยชื่อไฟล์ต้นทาง (replace พร้อมพาธและชื่อไฟล์ของรูปภาพเพื่อตรวจสอบและแทนที่ ด้วยชื่อรุ่นที่ใช้สำหรับส่วนประกอบของคุณ):

ตัวแบบทำนายภาพได้อย่างถูกต้องว่าผิดปกติ (missing_limbs) ด้วยคะแนนความเชื่อมั่น 0.9996867775917053 มันบอกเราถึงหน้ากากของแท็กความผิดปกติ missing_limbs และพื้นที่ร้อยละ การตอบสนองยังมีข้อมูลบิตแมปที่คุณสามารถถอดรหัสสิ่งที่พบได้

ดาวน์โหลดและเปิดไฟล์ blended.pngซึ่งดูเหมือนภาพต่อไปนี้ สังเกตบริเวณที่มีตำหนิบริเวณขา

เรื่องราวของลูกค้า

ด้วย AWS IoT Greengrass และ Lookout for Vision ตอนนี้คุณสามารถทำให้การตรวจสอบด้วยภาพเป็นอัตโนมัติด้วยการมองเห็นด้วยคอมพิวเตอร์สำหรับกระบวนการต่างๆ เช่น การควบคุมคุณภาพและการประเมินข้อบกพร่อง — ทั้งหมดบนขอบและในแบบเรียลไทม์ คุณสามารถระบุปัญหาในเชิงรุก เช่น ความเสียหายของชิ้นส่วน (เช่น รอยบุบ รอยขีดข่วน หรือการเชื่อมที่ไม่ดี) ส่วนประกอบของผลิตภัณฑ์ขาดหายไป หรือข้อบกพร่องที่มีรูปแบบซ้ำๆ ในสายการผลิตเอง ซึ่งช่วยประหยัดเวลาและเงินของคุณ ลูกค้าเช่น Tyson และ Baxter กำลังค้นพบพลังของ Lookout for Vision ในการเพิ่มคุณภาพและลดต้นทุนการดำเนินงานด้วยการตรวจสอบด้วยภาพอัตโนมัติ

“ความเป็นเลิศในการปฏิบัติงานเป็นสิ่งสำคัญที่ Tyson Foods ให้ความสำคัญ การบำรุงรักษาเชิงคาดการณ์เป็นสินทรัพย์ที่จำเป็นสำหรับการบรรลุวัตถุประสงค์นี้โดยการปรับปรุงประสิทธิภาพของอุปกรณ์โดยรวม (OEE) อย่างต่อเนื่อง ในปี พ.ศ. 2021 Tyson Foods ได้เปิดตัวโครงการ Computer Vision ที่ใช้การเรียนรู้ด้วยเครื่องเพื่อระบุผู้ให้บริการผลิตภัณฑ์ที่ล้มเหลวในระหว่างการผลิตเพื่อป้องกันไม่ให้ส่งผลกระทบต่อความปลอดภัยของสมาชิกในทีม การปฏิบัติงาน หรือคุณภาพของผลิตภัณฑ์ โมเดลที่ฝึกโดยใช้ Amazon Lookout for Vision ทำงานได้ดี โมเดลการตรวจจับพินมีความแม่นยำ 95% ในทั้งสองคลาส โมเดล Amazon Lookout for Vision ได้รับการปรับให้ทำงานที่ความแม่นยำ 99.1% สำหรับการตรวจจับพินที่ล้มเหลว ผลลัพธ์ที่น่าตื่นเต้นที่สุดของโครงการนี้คือความรวดเร็วในการพัฒนา แม้ว่าโปรเจ็กต์นี้จะใช้สองโมเดลและโค้ดแอปพลิเคชันที่ซับซ้อนกว่า แต่นักพัฒนาซอฟต์แวร์ใช้เวลาดำเนินการน้อยลง 12% โครงการนี้สำหรับตรวจสอบสภาพของผู้ให้บริการผลิตภัณฑ์ที่ Tyson Foods เสร็จสมบูรณ์ในเวลาที่บันทึกโดยใช้บริการที่มีการจัดการของ AWS เช่น Amazon Lookout for Vision”

—Audrey Timmerman ผู้พัฒนาแอปพลิเคชันอาวุโส Tyson Foods

“เวลาแฝงและความเร็วในการอนุมานเป็นสิ่งสำคัญสำหรับการประเมินแบบเรียลไทม์และการตรวจสอบคุณภาพที่สำคัญของกระบวนการผลิตของเรา Amazon Lookout for Vision edge บนอุปกรณ์ CPU ช่วยให้เราสามารถบรรลุเป้าหมายนี้ได้บนอุปกรณ์ระดับการผลิต ทำให้เราสามารถนำเสนอโซลูชันการมองเห็น AI ที่คุ้มค่าในวงกว้าง”

—AK Karan ผู้อำนวยการอาวุโสระดับโลก – Digital Transformation, Integrated Supply Chain, Baxter International Inc.

ทำความสะอาด

ทำตามขั้นตอนต่อไปนี้เพื่อลบเนื้อหาที่คุณสร้างจากบัญชีของคุณและหลีกเลี่ยงการเรียกเก็บเงินที่ดำเนินอยู่:

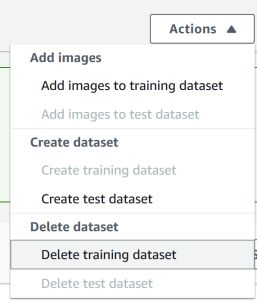

- บนคอนโซล Lookout for Vision ให้ไปที่โปรเจ็กต์ของคุณ

- เกี่ยวกับ สถานะ เมนู ลบชุดข้อมูลของคุณ

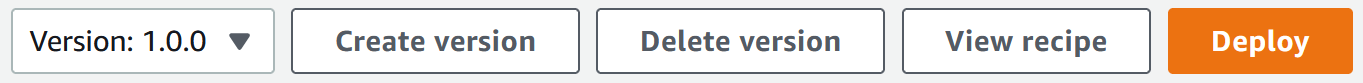

- ลบโมเดลของคุณ

- บนคอนโซล Amazon S3 ให้ล้างบัคเก็ตที่คุณสร้างขึ้น จากนั้นลบบัคเก็ต

- บนคอนโซล Amazon EC2 ให้ลบอินสแตนซ์ที่คุณเริ่มเรียกใช้ AWS IoT Greengrass

- บนคอนโซล AWS IoT Greengrass ให้เลือก การใช้งาน ในบานหน้าต่างนำทาง

- ลบเวอร์ชันส่วนประกอบของคุณ

- บนคอนโซล AWS IoT Greengrass ให้ลบสิ่ง กลุ่ม และอุปกรณ์ AWS IoT

สรุป

ในโพสต์นี้ เราได้อธิบายสถานการณ์ทั่วไปสำหรับการตรวจจับข้อบกพร่องทางอุตสาหกรรมที่ขอบโดยใช้การแปลจุดบกพร่องและปรับใช้กับอุปกรณ์ที่มี CPU เท่านั้น เราดำเนินการผ่านองค์ประกอบหลักของระบบคลาวด์และวงจรชีวิต Edge ด้วยตัวอย่างตั้งแต่ต้นจนจบโดยใช้ Lookout for Vision และ AWS IoT Greengrass ด้วย Lookout for Vision เราฝึกโมเดลการตรวจจับสิ่งผิดปกติในระบบคลาวด์โดยใช้ ชุดข้อมูลของเล่นมนุษย์ต่างดาวรวบรวมโมเดลไปยังสถาปัตยกรรมเป้าหมาย และจัดแพ็คเกจโมเดลเป็นส่วนประกอบ AWS IoT Greengrass ด้วย AWS IoT Greengrass เราปรับใช้โมเดลกับอุปกรณ์ Edge เราสาธิตแอปพลิเคชันตัวอย่างที่ใช้ Python ที่ส่งภาพเอเลี่ยนของเล่นจากระบบไฟล์ในเครื่อง Edge เรียกใช้การอนุมานบนโมเดล Lookout for Vision ที่ Edge โดยใช้อินเทอร์เฟซ gRPC และส่งข้อมูลการอนุมานไปยังหัวข้อ MQTT ใน AWS คลาวด์.

ในโพสต์ในอนาคต เราจะแสดงวิธีเรียกใช้การอนุมานบนสตรีมรูปภาพแบบเรียลไทม์โดยใช้ไปป์ไลน์สื่อ GStreamer

เริ่มต้นการเดินทางของคุณสู่การตรวจจับและระบุความผิดปกติทางอุตสาหกรรมโดยไปที่ Amazon Lookout สำหรับวิสัยทัศน์ และ AWS IoT กรีนกราส หน้าทรัพยากร

เกี่ยวกับผู้แต่ง

มานิช ทาลเรจา เป็น Senior Industrial ML Practice Manager ของ AWS Professional Services เขาช่วยให้ลูกค้าของ AWS บรรลุเป้าหมายทางธุรกิจโดยการออกแบบและสร้างโซลูชันที่เป็นนวัตกรรมใหม่ที่ใช้บริการ AWS ML และ IoT บน AWS Cloud

มานิช ทาลเรจา เป็น Senior Industrial ML Practice Manager ของ AWS Professional Services เขาช่วยให้ลูกค้าของ AWS บรรลุเป้าหมายทางธุรกิจโดยการออกแบบและสร้างโซลูชันที่เป็นนวัตกรรมใหม่ที่ใช้บริการ AWS ML และ IoT บน AWS Cloud

ไรอัน แวนเดอร์เวิร์ฟ เป็นสถาปนิกโซลูชันคู่ค้าที่ Amazon Web Services ก่อนหน้านี้เขาให้คำปรึกษาที่เน้นเครื่องเสมือน Java และการพัฒนาโครงการในฐานะวิศวกรซอฟต์แวร์ที่ OCI ในทีม Grails และ Micronaut เขาเป็นหัวหน้าสถาปนิก/ผู้อำนวยการผลิตภัณฑ์ที่ ReachForce โดยมุ่งเน้นที่ซอฟต์แวร์และสถาปัตยกรรมระบบสำหรับโซลูชัน AWS Cloud SaaS สำหรับการจัดการข้อมูลการตลาด Ryan ได้สร้างโซลูชัน SaaS มากมายในหลายโดเมน เช่น บริษัทการเงิน สื่อ โทรคมนาคม และอีเลิร์นนิงตั้งแต่ปี 1996

ไรอัน แวนเดอร์เวิร์ฟ เป็นสถาปนิกโซลูชันคู่ค้าที่ Amazon Web Services ก่อนหน้านี้เขาให้คำปรึกษาที่เน้นเครื่องเสมือน Java และการพัฒนาโครงการในฐานะวิศวกรซอฟต์แวร์ที่ OCI ในทีม Grails และ Micronaut เขาเป็นหัวหน้าสถาปนิก/ผู้อำนวยการผลิตภัณฑ์ที่ ReachForce โดยมุ่งเน้นที่ซอฟต์แวร์และสถาปัตยกรรมระบบสำหรับโซลูชัน AWS Cloud SaaS สำหรับการจัดการข้อมูลการตลาด Ryan ได้สร้างโซลูชัน SaaS มากมายในหลายโดเมน เช่น บริษัทการเงิน สื่อ โทรคมนาคม และอีเลิร์นนิงตั้งแต่ปี 1996

ประกาศ กฤษณะ เป็นผู้จัดการอาวุโสฝ่ายพัฒนาซอฟต์แวร์ที่ Amazon Web Services เขาเป็นผู้นำทีมวิศวกรรมที่กำลังสร้างระบบแบบกระจายขนาดใหญ่เพื่อใช้อัลกอริธึมที่รวดเร็ว มีประสิทธิภาพ และปรับขนาดได้สูงกับปัญหาการรู้จำรูปภาพและวิดีโอที่อิงจากการเรียนรู้เชิงลึก

ประกาศ กฤษณะ เป็นผู้จัดการอาวุโสฝ่ายพัฒนาซอฟต์แวร์ที่ Amazon Web Services เขาเป็นผู้นำทีมวิศวกรรมที่กำลังสร้างระบบแบบกระจายขนาดใหญ่เพื่อใช้อัลกอริธึมที่รวดเร็ว มีประสิทธิภาพ และปรับขนาดได้สูงกับปัญหาการรู้จำรูปภาพและวิดีโอที่อิงจากการเรียนรู้เชิงลึก

- AI

- ไอ อาร์ต

- เครื่องกำเนิดไออาร์ท

- หุ่นยนต์ไอ

- Amazon Lookout สำหรับวิสัยทัศน์

- ปัญญาประดิษฐ์

- ใบรับรองปัญญาประดิษฐ์

- ปัญญาประดิษฐ์ในการธนาคาร

- หุ่นยนต์ปัญญาประดิษฐ์

- หุ่นยนต์ปัญญาประดิษฐ์

- ซอฟต์แวร์ปัญญาประดิษฐ์

- AWS IoT กรีนกราส

- AWS Machine Learning AWS

- blockchain

- การประชุม blockchain ai

- เหรียญอัจฉริยะ

- ปัญญาประดิษฐ์สนทนา

- การประชุม crypto ai

- ดัล-อี

- การเรียนรู้ลึก ๆ

- google ai

- เรียนรู้เครื่อง

- เพลโต

- เพลโตไอ

- เพลโตดาต้าอินเทลลิเจนซ์

- เกมเพลโต

- เพลโตดาต้า

- เพลโตเกม

- ขนาดไอ

- วากยสัมพันธ์

- ลมทะเล