ในโลกแบบไดนามิกของการสตรีมมิ่ง Amazon เพลงการค้นหาเพลง พอดแคสต์ หรือเพลย์ลิสต์ทุกครั้งจะมีเรื่องราว อารมณ์ หรืออารมณ์มากมายที่รอการเปิดเผย การค้นหาเหล่านี้ทำหน้าที่เป็นประตูสู่การค้นพบใหม่ ประสบการณ์อันล้ำค่า และความทรงจำอันยาวนาน แถบค้นหาไม่ได้เป็นเพียงการค้นหาเพลงเท่านั้น เป็นเรื่องเกี่ยวกับผู้ใช้งานนับล้านที่เริ่มต้นการเดินทางส่วนตัวสู่โลกที่อุดมสมบูรณ์และหลากหลายที่ Amazon Music นำเสนอ

การมอบประสบการณ์ที่เหนือกว่าให้กับลูกค้าเพื่อค้นหาเพลงที่ผู้ใช้ค้นหาในทันทีต้องใช้แพลตฟอร์มที่ทั้งชาญฉลาดและตอบสนองได้ดี Amazon Music ใช้พลังของ AI เพื่อบรรลุเป้าหมายนี้ อย่างไรก็ตาม การเพิ่มประสิทธิภาพประสบการณ์ของลูกค้าในขณะที่จัดการต้นทุนการฝึกอบรมและการอนุมานโมเดล AI ที่ขับเคลื่อนความสามารถของแถบค้นหา เช่น การตรวจการสะกดแบบเรียลไทม์และการค้นหาเวกเตอร์ เป็นเรื่องยากในช่วงเวลาที่มีการเข้าชมสูงสุด

อเมซอน SageMaker มอบชุดบริการแบบครบวงจรที่ช่วยให้ Amazon Music สามารถสร้าง ฝึกฝน และปรับใช้บน AWS Cloud ได้โดยใช้ความพยายามเพียงเล็กน้อย ด้วยการดูแลการยกของหนักที่ไม่มีความแตกต่าง SageMaker ช่วยให้คุณมุ่งเน้นไปที่การทำงานกับโมเดล Machine Learning (ML) ของคุณ และไม่ต้องกังวลกับสิ่งต่างๆ เช่น โครงสร้างพื้นฐาน ในฐานะส่วนหนึ่งของโมเดลความรับผิดชอบร่วมกัน SageMaker จะตรวจสอบให้แน่ใจว่าบริการที่พวกเขามอบให้นั้นเชื่อถือได้ มีประสิทธิภาพ และปรับขนาดได้ ในขณะที่คุณตรวจสอบให้แน่ใจว่าแอปพลิเคชันของโมเดล ML ใช้ประโยชน์จากความสามารถที่ SageMaker มอบให้ให้เกิดประโยชน์สูงสุด

ในโพสต์นี้ เราจะอธิบายการเดินทางของ Amazon Music เพื่อเพิ่มประสิทธิภาพและต้นทุนโดยใช้ SageMaker และ NVIDIA Triton Inference Server และ TensorRT เราเจาะลึกในการแสดงให้เห็นว่าแถบค้นหาที่ดูเรียบง่ายแต่ซับซ้อนนั้นทำงานอย่างไร เพื่อให้แน่ใจว่าการเดินทางสู่จักรวาลของ Amazon Music จะไม่ขาดตอน โดยมีความล่าช้าในการพิมพ์ผิดจนน่าหงุดหงิดเพียงเล็กน้อยถึงศูนย์และผลการค้นหาแบบเรียลไทม์ที่เกี่ยวข้อง

Amazon SageMaker และ NVIDIA: มอบความสามารถในการค้นหาเวกเตอร์และตรวจการสะกดที่รวดเร็วและแม่นยำ

Amazon Music มีคลังเพลงมากกว่า 100 ล้านเพลงและพอดแคสต์หลายล้านตอน อย่างไรก็ตาม การค้นหาเพลงหรือพอดแคสต์ที่เหมาะสมอาจเป็นเรื่องที่ท้าทาย โดยเฉพาะอย่างยิ่งหากคุณไม่ทราบชื่อเพลง ศิลปิน หรือชื่ออัลบั้มที่แน่ชัด หรือคำค้นหาที่กว้างมาก เช่น "พอดแคสต์ข่าว"

Amazon Music ใช้แนวทางแบบสองทางเพื่อปรับปรุงกระบวนการค้นหาและเรียกคืนข้อมูล ขั้นตอนแรกคือการแนะนำการค้นหาเวกเตอร์ (หรือที่เรียกว่าการเรียกข้อมูลแบบฝัง) ซึ่งเป็นเทคนิค ML ที่สามารถช่วยให้ผู้ใช้ค้นหาเนื้อหาที่เกี่ยวข้องมากที่สุดที่ตนกำลังมองหาโดยใช้ความหมายของเนื้อหา ขั้นตอนที่สองเกี่ยวข้องกับการแนะนำโมเดลการแก้ไขตัวสะกดที่ใช้ Transformer ในกลุ่มการค้นหา วิธีนี้จะเป็นประโยชน์อย่างยิ่งเมื่อค้นหาเพลง เนื่องจากผู้ใช้อาจไม่ทราบการสะกดชื่อเพลงหรือชื่อศิลปินที่แน่ชัดเสมอไป การแก้ไขตัวสะกดสามารถช่วยให้ผู้ใช้ค้นหาเพลงที่ต้องการได้ แม้ว่าจะสะกดคำผิดในคำค้นหาก็ตาม

การแนะนำโมเดล Transformer ในไปป์ไลน์การค้นหาและการดึงข้อมูล (ในการสร้างการฝังคิวรีที่จำเป็นสำหรับการค้นหาเวกเตอร์และโมเดล Seq2Seq Transformer ที่สร้างในการแก้ไขการสะกด) อาจนำไปสู่การเพิ่มขึ้นอย่างมากในเวลาแฝงโดยรวม ซึ่งส่งผลต่อประสบการณ์เชิงลบของลูกค้า ดังนั้นจึงเป็นเรื่องสำคัญสูงสุดสำหรับเราในการปรับเวลาแฝงของการอนุมานแบบเรียลไทม์สำหรับโมเดลการค้นหาเวกเตอร์และการแก้ไขตัวสะกด

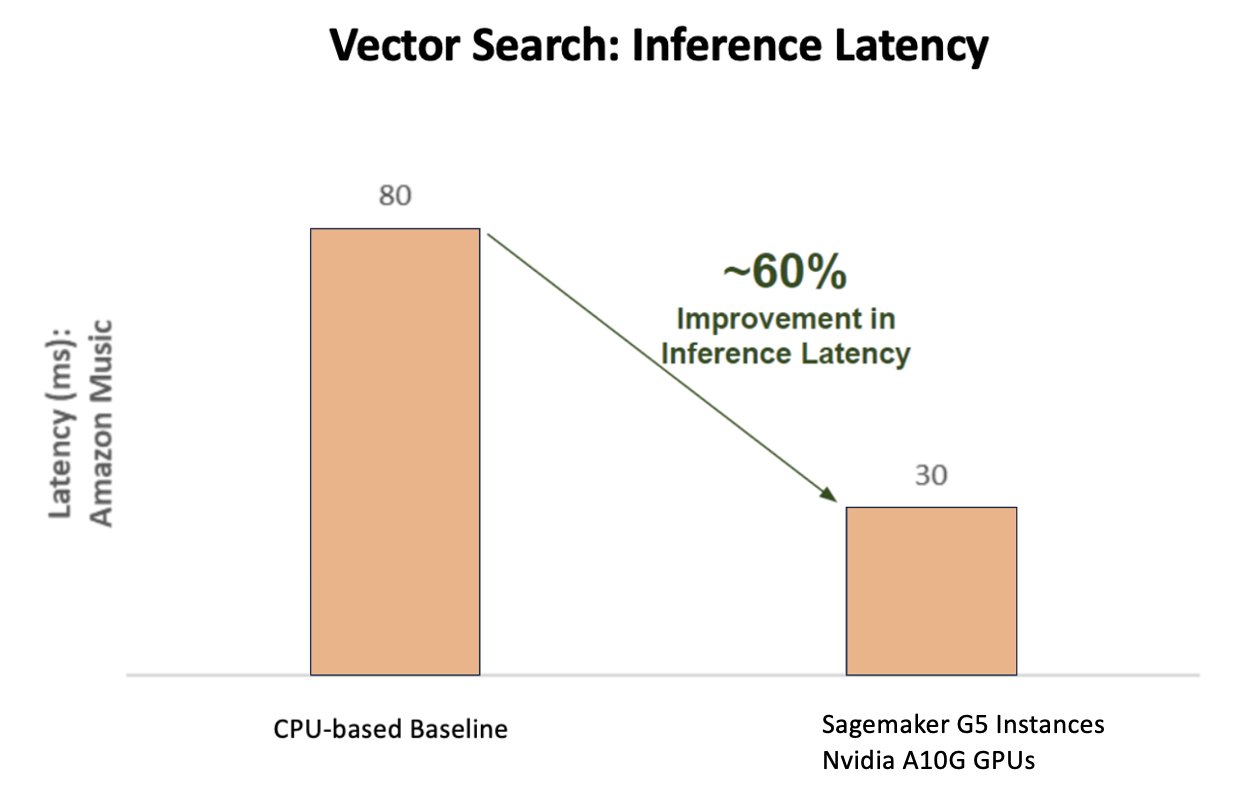

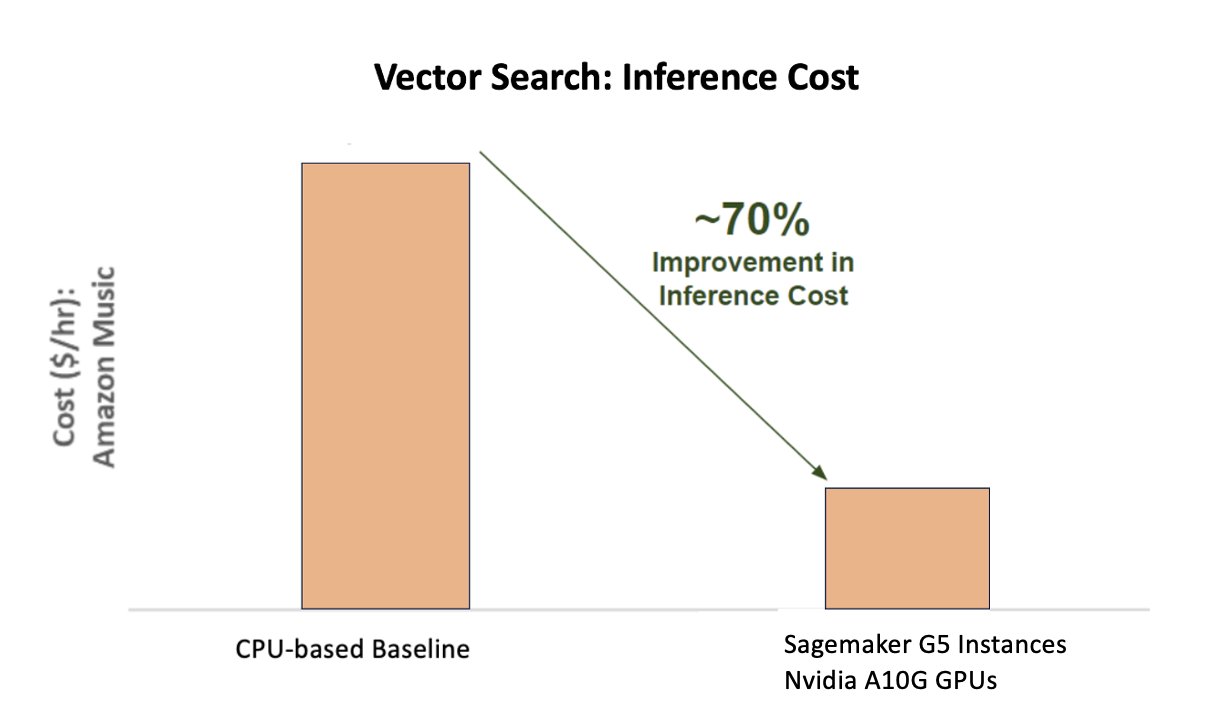

Amazon Music และ NVIDIA ร่วมมือกันเพื่อนำประสบการณ์ที่ดีที่สุดของลูกค้ามาสู่แถบค้นหา โดยใช้ SageMaker เพื่อปรับใช้ทั้งความสามารถในการตรวจสอบการสะกดที่รวดเร็วและแม่นยำ และคำแนะนำการค้นหาความหมายแบบเรียลไทม์โดยใช้เทคนิคการค้นหาแบบเวกเตอร์ โซลูชันนี้ประกอบด้วยการใช้โฮสติ้ง SageMaker ที่ขับเคลื่อนโดยอินสแตนซ์ G5 ที่ใช้ GPU NVIDIA A10G Tensor Core, คอนเทนเนอร์เซิร์ฟเวอร์ NVIDIA Triton Inference ที่รองรับ SageMaker และ NVIDIA TensorRT รูปแบบโมเดล ด้วยการลดเวลาแฝงในการอนุมานของโมเดลตรวจการสะกดลงเหลือ 25 มิลลิวินาทีที่ปริมาณการใช้ข้อมูลสูงสุด และลดเวลาแฝงในการสร้างคำค้นหาลง 63% โดยเฉลี่ยและมีค่าใช้จ่าย 73% เมื่อเทียบกับการอนุมานตาม CPU ทำให้ Amazon Music ได้ยกระดับประสิทธิภาพของแถบค้นหา

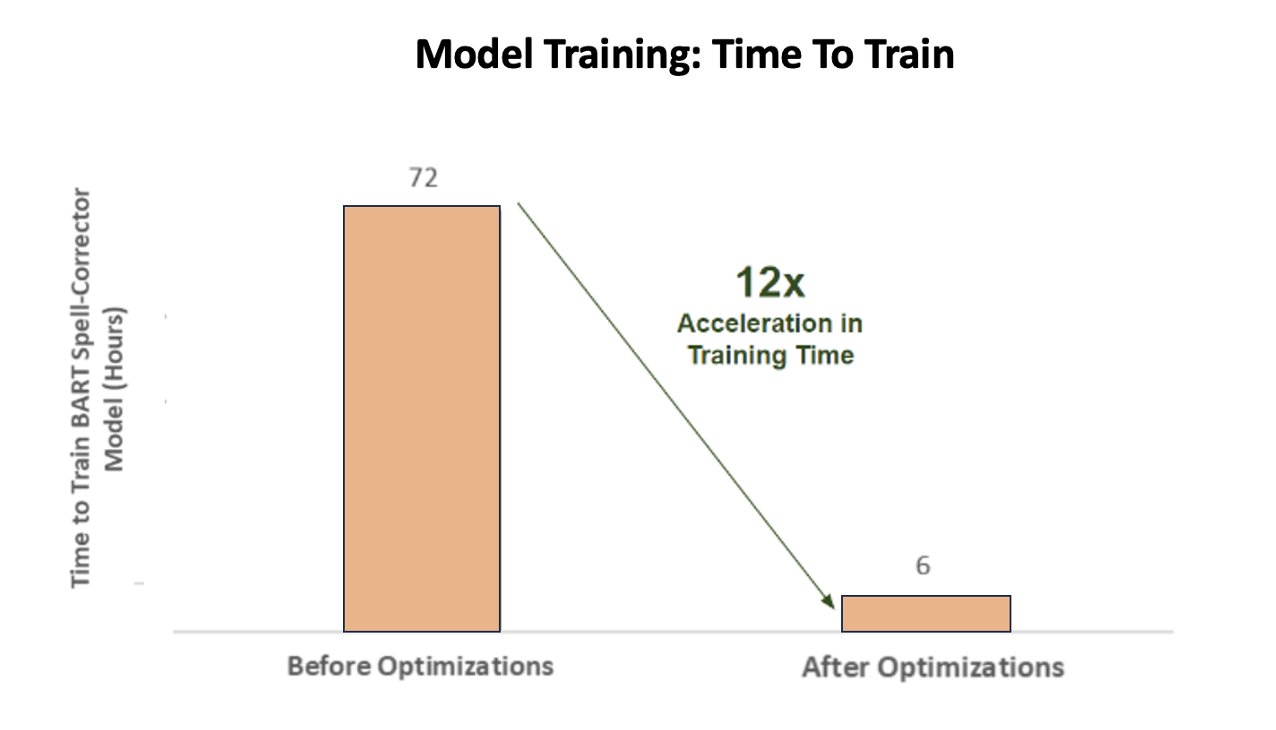

นอกจากนี้ เมื่อฝึกฝนโมเดล AI เพื่อให้ได้ผลลัพธ์ที่แม่นยำ Amazon Music ยังเร่งความเร็วในการฝึกฝนได้ถึง 12 เท่าสำหรับโมเดลหม้อแปลงตัวแก้ไขการสะกดแบบลำดับต่อลำดับ BART ซึ่งช่วยประหยัดทั้งเวลาและเงินโดยปรับการใช้งาน GPU ให้เหมาะสม

Amazon Music ร่วมมือกับ NVIDIA เพื่อจัดลำดับความสำคัญของประสบการณ์การค้นหาของลูกค้า และสร้างแถบค้นหาที่มีฟังก์ชันการตรวจตัวสะกดและการค้นหาเวกเตอร์ที่ได้รับการปรับปรุงอย่างเหมาะสม ในส่วนต่อไปนี้ เราจะแบ่งปันเพิ่มเติมเกี่ยวกับวิธีการจัดเตรียมการเพิ่มประสิทธิภาพเหล่านี้

เพิ่มประสิทธิภาพการฝึกอบรมด้วย NVIDIA Tensor Core GPU

การเข้าถึง NVIDIA Tensor Core GPU สำหรับการฝึกฝนโมเดลภาษาขนาดใหญ่นั้นไม่เพียงพอที่จะดึงศักยภาพที่แท้จริงของมันออกมา มีขั้นตอนการเพิ่มประสิทธิภาพหลักๆ ที่ต้องเกิดขึ้นระหว่างการฝึกเพื่อเพิ่มประสิทธิภาพการใช้งาน GPU ให้สูงสุด อย่างไรก็ตาม GPU ที่ใช้งานน้อยเกินไปจะนำไปสู่การใช้ทรัพยากรที่ไม่มีประสิทธิภาพ ระยะเวลาการฝึกอบรมที่ยาวนานขึ้น และค่าใช้จ่ายในการดำเนินงานที่เพิ่มขึ้นอย่างไม่ต้องสงสัย

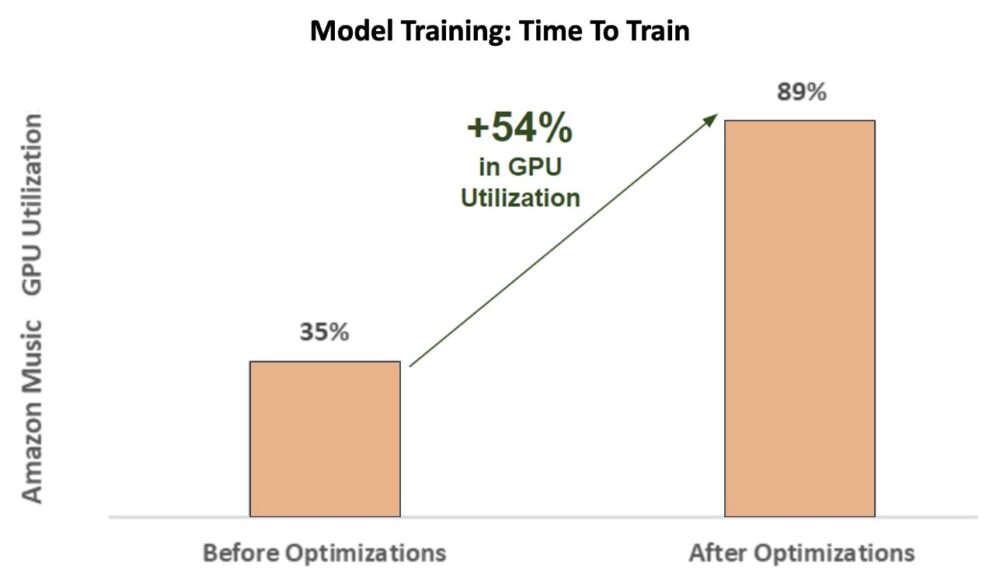

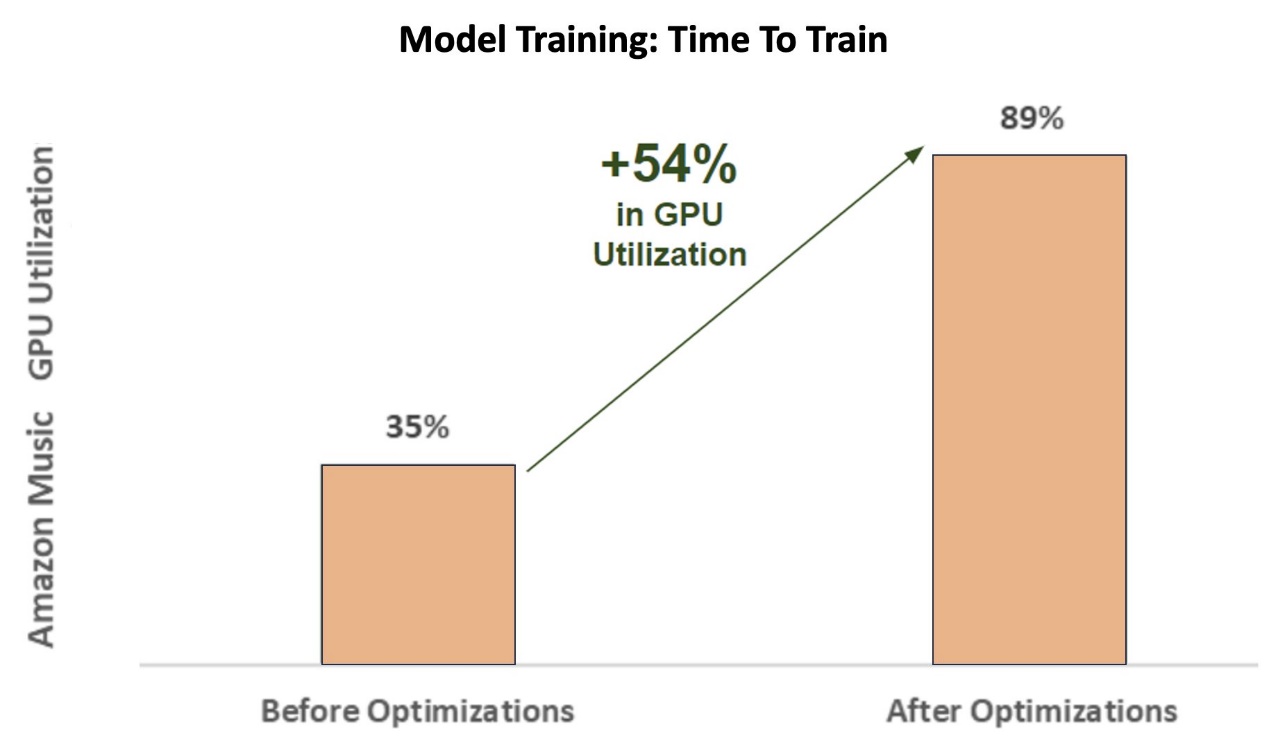

ในช่วงเริ่มต้นของการฝึกตัวแก้ไขการสะกด BART (บาร์ตฐาน) โมเดลหม้อแปลงบนอินสแตนซ์ SageMaker ml.p3.24xlarge (8 NVIDIA V100 Tensor Core GPU) การใช้งาน GPU ของ Amazon Music อยู่ที่ประมาณ 35% เพื่อเพิ่มประโยชน์สูงสุดจากการฝึกอบรมที่เร่งด้วย NVIDIA GPU สถาปนิกโซลูชัน AWS และ NVIDIA สนับสนุน Amazon Music ในการระบุพื้นที่สำหรับการเพิ่มประสิทธิภาพ โดยเฉพาะอย่างยิ่งเกี่ยวกับขนาดแบทช์และพารามิเตอร์ความแม่นยำ พารามิเตอร์ที่สำคัญทั้งสองนี้มีอิทธิพลต่อประสิทธิภาพ ความเร็ว และความแม่นยำของการฝึกโมเดลการเรียนรู้เชิงลึก

ผลการเพิ่มประสิทธิภาพส่งผลให้มีการใช้งาน GPU V100 ใหม่ที่ได้รับการปรับปรุง ซึ่งคงที่ประมาณ 89% ช่วยลดเวลาการฝึกอบรมของ Amazon Music ได้อย่างมากจาก 3 วันเหลือ 5–6 ชั่วโมง โดยการเปลี่ยนขนาดแบทช์จาก 32 เป็น 256 และใช้เทคนิคการปรับให้เหมาะสมเช่นการวิ่ง การฝึกความแม่นยำแบบผสมอัตโนมัติ แทนที่จะใช้ความแม่นยำของ FP32 เท่านั้น Amazon Music สามารถประหยัดทั้งเวลาและเงินได้

แผนภูมิต่อไปนี้แสดงให้เห็นถึงการใช้งาน GPU เพิ่มขึ้น 54% หลังจากการเพิ่มประสิทธิภาพ

รูปต่อไปนี้แสดงให้เห็นถึงความเร่งในเวลาการฝึก

ขนาดแบตช์ที่เพิ่มขึ้นนี้ทำให้ NVIDIA GPU ประมวลผลข้อมูลพร้อมกันได้มากขึ้นอย่างมากใน Tensor Core หลายตัว ส่งผลให้เวลาในการฝึกฝนเร็วขึ้น อย่างไรก็ตาม สิ่งสำคัญคือต้องรักษาสมดุลที่ละเอียดอ่อนกับหน่วยความจำ เนื่องจากขนาดแบตช์ที่ใหญ่ขึ้นต้องการหน่วยความจำมากขึ้น ทั้งการเพิ่มขนาดแบตช์และการใช้ความแม่นยำแบบผสมอาจมีความสำคัญอย่างยิ่งในการปลดล็อกพลังของ NVIDIA Tensor Core GPU

หลังจากที่โมเดลได้รับการฝึกฝนเพื่อการลู่เข้าแล้ว ก็ถึงเวลาเพิ่มประสิทธิภาพสำหรับการปรับใช้การอนุมานบนแถบค้นหาของ Amazon Music

การแก้ไขตัวสะกด: การอนุมานแบบจำลอง BART

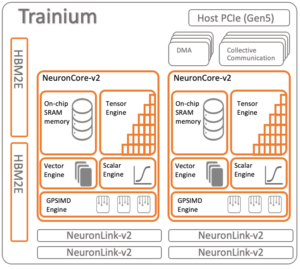

ด้วยความช่วยเหลือของอินสแตนซ์ SageMaker G5 และ NVIDIA Triton Inference Server (ซอฟต์แวร์ที่ให้บริการการอนุมานแบบโอเพ่นซอร์ส) รวมถึง NVIDIA TensorRT ซึ่งเป็น SDK สำหรับการอนุมานการเรียนรู้เชิงลึกที่มีประสิทธิภาพสูง ซึ่งรวมถึงเครื่องมือเพิ่มประสิทธิภาพการอนุมานและรันไทม์ ทำให้ Amazon Music จำกัดการตรวจการสะกด BART (บาร์ตฐาน) โมเดลเวลาแฝงในการอนุมานของเซิร์ฟเวอร์เหลือเพียง 25 มิลลิวินาทีที่ปริมาณการใช้ข้อมูลสูงสุด ซึ่งรวมถึงค่าใช้จ่ายต่างๆ เช่น การปรับสมดุลโหลด การประมวลผลล่วงหน้า การอนุมานแบบจำลอง และเวลาหลังการประมวลผล

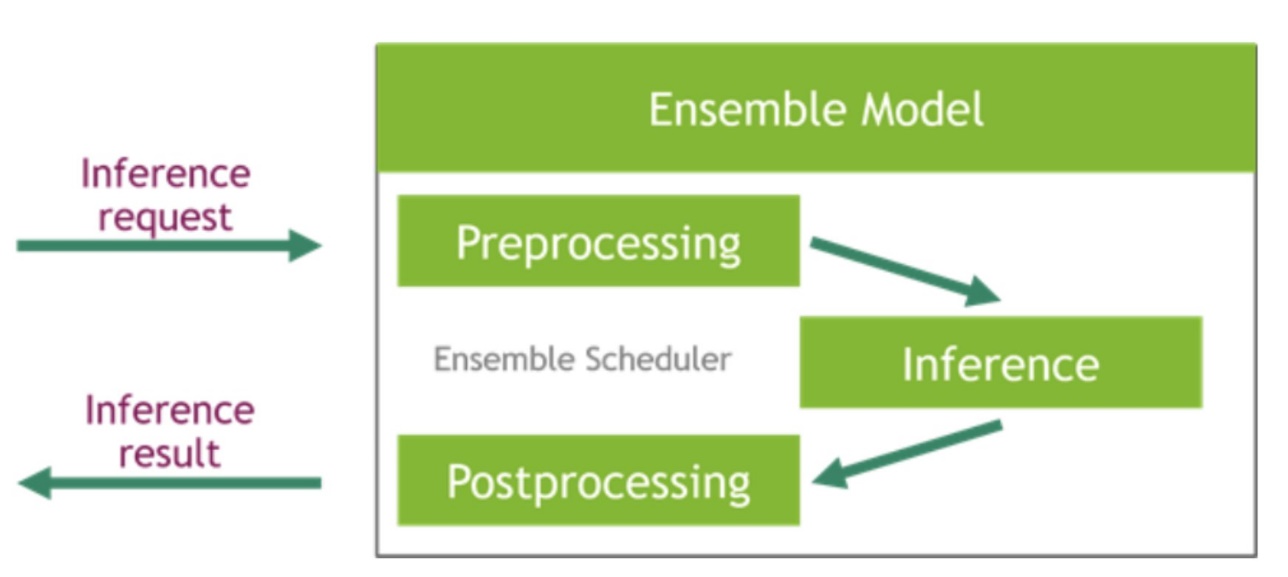

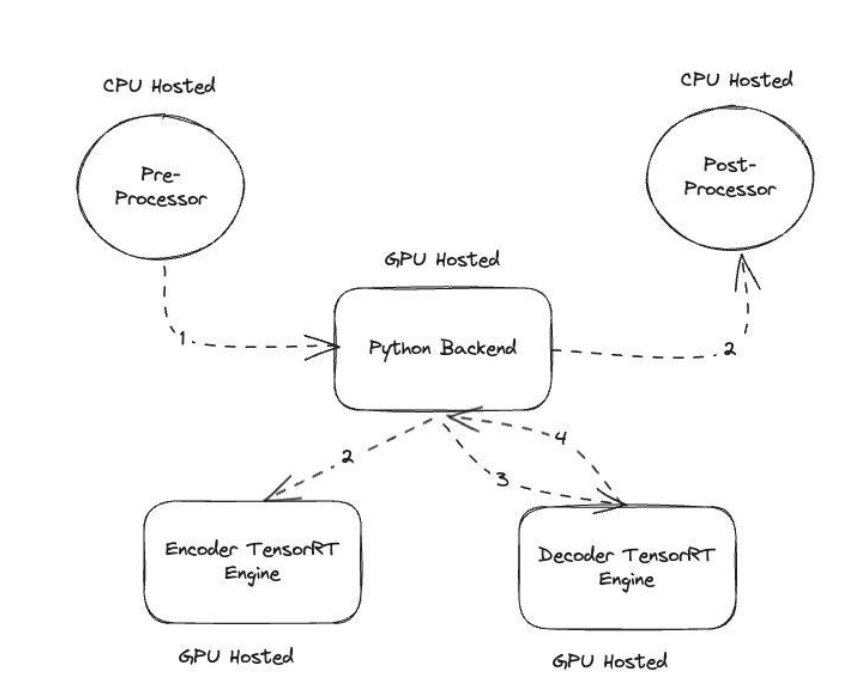

NVIDIA Triton Inference Server มีแบ็กเอนด์ที่แตกต่างกันสองประเภท: แบบหนึ่งสำหรับการโฮสต์โมเดลบน GPU และแบ็กเอนด์ Python ที่คุณสามารถนำโค้ดที่คุณกำหนดเองไปใช้ในขั้นตอนก่อนการประมวลผลและหลังการประมวลผล รูปต่อไปนี้แสดงให้เห็นถึง โครงร่างวงดนตรีแบบจำลอง.

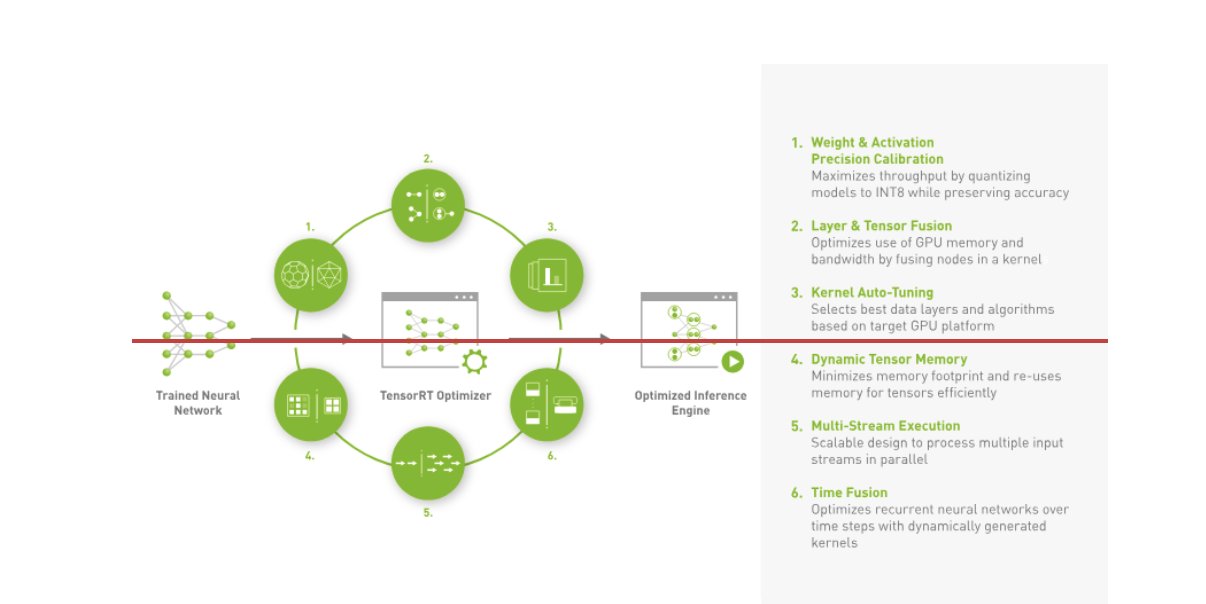

Amazon Music สร้าง BART ขึ้นมา ไปป์ไลน์การอนุมาน โดยการรันขั้นตอนทั้งการประมวลผลล่วงหน้า (โทเค็นข้อความ) และการประมวลผลภายหลัง (โทเค็นเป็นข้อความ) บน CPU ในขณะที่ขั้นตอนการดำเนินการโมเดลทำงานบน NVIDIA A10G เทนเซอร์คอร์ GPU. แบ็กเอนด์ Python อยู่ระหว่างขั้นตอนก่อนการประมวลผลและหลังการประมวลผล และมีหน้าที่ในการสื่อสารกับโมเดล BART ที่แปลงด้วย TensorRT รวมถึงเครือข่ายตัวเข้ารหัส/ตัวถอดรหัส เทนเซอร์RT เพิ่มประสิทธิภาพการอนุมานด้วยการสอบเทียบที่แม่นยำ การรวมเลเยอร์และเทนเซอร์ การปรับแต่งเคอร์เนลอัตโนมัติ หน่วยความจำเทนเซอร์แบบไดนามิก การประมวลผลแบบหลายสตรีม และการรวมเวลา

รูปต่อไปนี้แสดงการออกแบบระดับสูงของโมดูลหลักที่ประกอบเป็นไปป์ไลน์การอนุมานแบบจำลอง BART ของตัวแก้ไขตัวสะกด

การค้นหาเวกเตอร์: แบบสอบถามการฝังประโยคการสร้างการอนุมานโมเดล BERT

แผนภูมิต่อไปนี้แสดงให้เห็นถึงการปรับปรุงเวลาแฝง 60% (ให้บริการ p90 800–900 TPS) เมื่อใช้แพลตฟอร์มการอนุมาน NVIDIA AI เมื่อเปรียบเทียบกับพื้นฐานที่ใช้ CPU

แผนภูมิต่อไปนี้แสดงต้นทุนที่เพิ่มขึ้น 70% เมื่อใช้แพลตฟอร์มการอนุมาน NVIDIA AI เมื่อเปรียบเทียบกับพื้นฐานที่ใช้ CPU

รูปต่อไปนี้แสดง SDK สำหรับการอนุมานการเรียนรู้เชิงลึกที่มีประสิทธิภาพสูง ประกอบด้วยเครื่องมือเพิ่มประสิทธิภาพการอนุมานการเรียนรู้เชิงลึกและรันไทม์ที่ให้เวลาแฝงต่ำและทรูพุตสูงสำหรับแอปพลิเคชันการอนุมาน

เพื่อให้บรรลุผลเหล่านี้ Amazon Music ได้ทดลองกับพารามิเตอร์การปรับใช้ Triton ที่แตกต่างกันหลายตัวโดยใช้ เครื่องวิเคราะห์แบบจำลองไทรทันซึ่งเป็นเครื่องมือที่ช่วยค้นหาการกำหนดค่าโมเดล NVIDIA Triton ที่ดีที่สุดเพื่อปรับใช้การอนุมานที่มีประสิทธิภาพ เพื่อเพิ่มประสิทธิภาพการอนุมานโมเดล Triton นำเสนอฟีเจอร์ต่างๆ เช่น การจัดชุดแบบไดนามิกและการดำเนินการโมเดลพร้อมกัน และมีการสนับสนุนเฟรมเวิร์กสำหรับความสามารถด้านความยืดหยุ่นอื่นๆ การแบ่งกลุ่มแบบไดนามิกจะรวบรวมคำขออนุมาน และจัดกลุ่มเข้าด้วยกันเป็นกลุ่มๆ ได้อย่างราบรื่นเพื่อเพิ่มปริมาณงาน ขณะเดียวกันก็รับประกันการตอบสนองแบบเรียลไทม์สำหรับผู้ใช้ Amazon Music ความสามารถในการดำเนินการโมเดลพร้อมกันช่วยเพิ่มประสิทธิภาพการอนุมานโดยการโฮสต์สำเนาหลายชุดบน GPU เดียวกัน ในที่สุดด้วยการใช้ เครื่องวิเคราะห์แบบจำลองไทรทันAmazon Music สามารถปรับแต่งพารามิเตอร์การโฮสต์การอนุมานการอนุมานพร้อมกันแบบไดนามิกและโมเดลอย่างละเอียดอย่างรอบคอบ เพื่อค้นหาการตั้งค่าที่เหมาะสมที่สุดที่เพิ่มประสิทธิภาพการอนุมานให้สูงสุดโดยใช้การรับส่งข้อมูลจำลอง

สรุป

การเพิ่มประสิทธิภาพการกำหนดค่าด้วย Triton Inference Server และ TensorRT บน SageMaker ช่วยให้ Amazon Music บรรลุผลลัพธ์ที่โดดเด่นสำหรับทั้งไปป์ไลน์การฝึกอบรมและการอนุมาน แพลตฟอร์ม SageMaker เป็นแพลตฟอร์มแบบเปิดแบบ end-to-end สำหรับการผลิต AI ซึ่งให้เวลาที่รวดเร็วในการประเมินค่าและความคล่องตัวเพื่อรองรับกรณีการใช้งาน AI ที่สำคัญทั้งหมดทั้งบนฮาร์ดแวร์และซอฟต์แวร์ ด้วยการเพิ่มประสิทธิภาพการใช้งาน V100 GPU สำหรับการฝึกฝนและการเปลี่ยนจาก CPU เป็นอินสแตนซ์ G5 โดยใช้ NVIDIA A10G Tensor Core GPU รวมถึงการใช้ซอฟต์แวร์ NVIDIA ที่ได้รับการปรับปรุง เช่น Triton Inference Server และ TensorRT บริษัทต่างๆ เช่น Amazon Music สามารถประหยัดเวลาและเงินในขณะที่เพิ่มประสิทธิภาพในทั้งสองอย่าง การฝึกอบรมและการอนุมาน ซึ่งแปลโดยตรงสู่ประสบการณ์ของลูกค้าที่ดีขึ้นและลดต้นทุนการดำเนินงาน

SageMaker จัดการงานหนักที่ไม่แตกต่างสำหรับการฝึกอบรม ML และการโฮสต์ ทำให้ Amazon Music สามารถส่งมอบการดำเนินการ ML ที่เชื่อถือได้และปรับขนาดได้ทั่วทั้งฮาร์ดแวร์และซอฟต์แวร์

เราขอแนะนำให้คุณตรวจสอบว่าปริมาณงานของคุณได้รับการปรับให้เหมาะสมโดยใช้ SageMaker โดยประเมินตัวเลือกฮาร์ดแวร์และซอฟต์แวร์ของคุณอยู่เสมอ เพื่อดูว่ามีวิธีใดบ้างที่จะช่วยให้คุณได้รับประสิทธิภาพที่ดีขึ้นโดยมีค่าใช้จ่ายลดลง

หากต้องการเรียนรู้เพิ่มเติมเกี่ยวกับ NVIDIA AI ใน AWS โปรดดูที่รายการต่อไปนี้:

เกี่ยวกับผู้แต่ง

สิทธารถะ ชาร์มา เป็นหัวหน้าฝ่ายเทคโนโลยีการเรียนรู้ของเครื่องที่ทีมวิทยาศาสตร์และการสร้างแบบจำลองที่ Amazon Music เขาเชี่ยวชาญในปัญหาการสร้างแบบจำลองที่เกี่ยวข้องกับการค้นหา การดึงข้อมูล การจัดอันดับ และ NLP Siddharth มีพื้นฐานเบื้องหลังการทำงานเกี่ยวกับปัญหา Machine Learning ขนาดใหญ่ที่มีความอ่อนไหวต่อความหน่วง เช่น การกำหนดเป้าหมายโฆษณา การดึงข้อมูลหลายรูปแบบ การทำความเข้าใจคำค้นหา เป็นต้น ก่อนที่จะมาทำงานที่ Amazon Music Siddharth เคยทำงานในบริษัทต่างๆ เช่น Meta, Walmart Labs, Rakuten เกี่ยวกับปัญหา ML ศูนย์กลางอีคอมเมิร์ซ Siddharth ใช้เวลาช่วงแรกของอาชีพการงานกับบริษัทสตาร์ทอัพเทคโนโลยีโฆษณาในพื้นที่อ่าว

สิทธารถะ ชาร์มา เป็นหัวหน้าฝ่ายเทคโนโลยีการเรียนรู้ของเครื่องที่ทีมวิทยาศาสตร์และการสร้างแบบจำลองที่ Amazon Music เขาเชี่ยวชาญในปัญหาการสร้างแบบจำลองที่เกี่ยวข้องกับการค้นหา การดึงข้อมูล การจัดอันดับ และ NLP Siddharth มีพื้นฐานเบื้องหลังการทำงานเกี่ยวกับปัญหา Machine Learning ขนาดใหญ่ที่มีความอ่อนไหวต่อความหน่วง เช่น การกำหนดเป้าหมายโฆษณา การดึงข้อมูลหลายรูปแบบ การทำความเข้าใจคำค้นหา เป็นต้น ก่อนที่จะมาทำงานที่ Amazon Music Siddharth เคยทำงานในบริษัทต่างๆ เช่น Meta, Walmart Labs, Rakuten เกี่ยวกับปัญหา ML ศูนย์กลางอีคอมเมิร์ซ Siddharth ใช้เวลาช่วงแรกของอาชีพการงานกับบริษัทสตาร์ทอัพเทคโนโลยีโฆษณาในพื้นที่อ่าว

ทารุน ชาร์มา เป็นผู้จัดการฝ่ายพัฒนาซอฟต์แวร์ซึ่งเป็นผู้นำด้านความเกี่ยวข้องของ Amazon Music Search ทีมนักวิทยาศาสตร์และวิศวกร ML ของเขามีหน้าที่รับผิดชอบในการมอบผลการค้นหาที่เกี่ยวข้องตามบริบทและเป็นส่วนตัวแก่ลูกค้า Amazon Music

ทารุน ชาร์มา เป็นผู้จัดการฝ่ายพัฒนาซอฟต์แวร์ซึ่งเป็นผู้นำด้านความเกี่ยวข้องของ Amazon Music Search ทีมนักวิทยาศาสตร์และวิศวกร ML ของเขามีหน้าที่รับผิดชอบในการมอบผลการค้นหาที่เกี่ยวข้องตามบริบทและเป็นส่วนตัวแก่ลูกค้า Amazon Music

เจมส์พาร์ค เป็นสถาปนิกโซลูชันที่ Amazon Web Services เขาทำงานร่วมกับ Amazon.com ในการออกแบบ สร้าง และปรับใช้โซลูชันเทคโนโลยีบน AWS และมีความสนใจเป็นพิเศษใน AI และการเรียนรู้ของเครื่อง ในเวลาว่างเขาชอบที่จะแสวงหาวัฒนธรรมใหม่ๆ ประสบการณ์ใหม่ๆ และติดตามเทรนด์เทคโนโลยีล่าสุด คุณสามารถพบเขาได้ที่ LinkedIn.

เจมส์พาร์ค เป็นสถาปนิกโซลูชันที่ Amazon Web Services เขาทำงานร่วมกับ Amazon.com ในการออกแบบ สร้าง และปรับใช้โซลูชันเทคโนโลยีบน AWS และมีความสนใจเป็นพิเศษใน AI และการเรียนรู้ของเครื่อง ในเวลาว่างเขาชอบที่จะแสวงหาวัฒนธรรมใหม่ๆ ประสบการณ์ใหม่ๆ และติดตามเทรนด์เทคโนโลยีล่าสุด คุณสามารถพบเขาได้ที่ LinkedIn.

กษิติซ กุปตะ เป็นสถาปนิกโซลูชันที่ NVIDIA เขาสนุกกับการให้ความรู้แก่ลูกค้าคลาวด์เกี่ยวกับเทคโนโลยี GPU AI ที่ NVIDIA นำเสนอและช่วยเหลือพวกเขาในการเร่งการเรียนรู้ด้วยเครื่องและแอปพลิเคชันการเรียนรู้เชิงลึก นอกเวลางาน เขาชอบวิ่ง เดินป่า และชมสัตว์ป่า

กษิติซ กุปตะ เป็นสถาปนิกโซลูชันที่ NVIDIA เขาสนุกกับการให้ความรู้แก่ลูกค้าคลาวด์เกี่ยวกับเทคโนโลยี GPU AI ที่ NVIDIA นำเสนอและช่วยเหลือพวกเขาในการเร่งการเรียนรู้ด้วยเครื่องและแอปพลิเคชันการเรียนรู้เชิงลึก นอกเวลางาน เขาชอบวิ่ง เดินป่า และชมสัตว์ป่า

เจียหงหลิว เป็น Solution Architect ในทีม Cloud Service Provider ที่ NVIDIA เขาช่วยลูกค้าในการใช้การเรียนรู้ด้วยเครื่องและโซลูชัน AI ที่ใช้ประโยชน์จากการประมวลผลแบบเร่งความเร็วของ NVIDIA เพื่อจัดการกับความท้าทายในการฝึกอบรมและการอนุมาน ในยามว่าง เขาสนุกกับการพับกระดาษ โปรเจกต์ทำเอง และเล่นบาสเก็ตบอล

เจียหงหลิว เป็น Solution Architect ในทีม Cloud Service Provider ที่ NVIDIA เขาช่วยลูกค้าในการใช้การเรียนรู้ด้วยเครื่องและโซลูชัน AI ที่ใช้ประโยชน์จากการประมวลผลแบบเร่งความเร็วของ NVIDIA เพื่อจัดการกับความท้าทายในการฝึกอบรมและการอนุมาน ในยามว่าง เขาสนุกกับการพับกระดาษ โปรเจกต์ทำเอง และเล่นบาสเก็ตบอล

ทูกรุล โคนุก เป็นสถาปนิกโซลูชันอาวุโสที่ NVIDIA ซึ่งเชี่ยวชาญด้านการฝึกอบรมขนาดใหญ่ การเรียนรู้เชิงลึกหลายรูปแบบ และการประมวลผลทางวิทยาศาสตร์ประสิทธิภาพสูง ก่อนที่จะมาร่วมงานกับ NVIDIA เขาทำงานในอุตสาหกรรมพลังงาน โดยมุ่งเน้นที่การพัฒนาอัลกอริธึมสำหรับการถ่ายภาพด้วยคอมพิวเตอร์ ในฐานะส่วนหนึ่งของปริญญาเอก เขาทำงานเกี่ยวกับการเรียนรู้เชิงลึกโดยใช้หลักฟิสิกส์สำหรับการจำลองเชิงตัวเลขในวงกว้าง ในเวลาว่าง เขาสนุกกับการอ่านหนังสือ เล่นกีตาร์ และเปียโน

ทูกรุล โคนุก เป็นสถาปนิกโซลูชันอาวุโสที่ NVIDIA ซึ่งเชี่ยวชาญด้านการฝึกอบรมขนาดใหญ่ การเรียนรู้เชิงลึกหลายรูปแบบ และการประมวลผลทางวิทยาศาสตร์ประสิทธิภาพสูง ก่อนที่จะมาร่วมงานกับ NVIDIA เขาทำงานในอุตสาหกรรมพลังงาน โดยมุ่งเน้นที่การพัฒนาอัลกอริธึมสำหรับการถ่ายภาพด้วยคอมพิวเตอร์ ในฐานะส่วนหนึ่งของปริญญาเอก เขาทำงานเกี่ยวกับการเรียนรู้เชิงลึกโดยใช้หลักฟิสิกส์สำหรับการจำลองเชิงตัวเลขในวงกว้าง ในเวลาว่าง เขาสนุกกับการอ่านหนังสือ เล่นกีตาร์ และเปียโน

โรฮิล ภารกาวา เป็นผู้จัดการฝ่ายการตลาดผลิตภัณฑ์ที่ NVIDIA ซึ่งมุ่งเน้นในการปรับใช้เฟรมเวิร์กแอปพลิเคชัน NVIDIA และ SDK บนแพลตฟอร์ม CSP ที่เฉพาะเจาะจง

โรฮิล ภารกาวา เป็นผู้จัดการฝ่ายการตลาดผลิตภัณฑ์ที่ NVIDIA ซึ่งมุ่งเน้นในการปรับใช้เฟรมเวิร์กแอปพลิเคชัน NVIDIA และ SDK บนแพลตฟอร์ม CSP ที่เฉพาะเจาะจง

เอลิวธ ทริอานา อิซาซา เป็นผู้จัดการฝ่ายนักพัฒนาสัมพันธ์ที่ NVIDIA เสริมศักยภาพ AI MLOps, DevOps, นักวิทยาศาสตร์ และผู้เชี่ยวชาญด้านเทคนิคของ Amazon ของ Amazon เพื่อเชี่ยวชาญสแต็กการประมวลผล NVIDIA สำหรับการเร่งและเพิ่มประสิทธิภาพโมเดล Generative AI Foundation ครอบคลุมตั้งแต่การดูแลจัดการข้อมูล การฝึกอบรม GPU การอนุมานโมเดล และการปรับใช้การผลิตบนอินสแตนซ์ AWS GPU . นอกจากนี้ Eliuth ยังเป็นนักขี่จักรยานเสือภูเขา นักเล่นสกี เทนนิส และโป๊กเกอร์ผู้หลงใหล

เอลิวธ ทริอานา อิซาซา เป็นผู้จัดการฝ่ายนักพัฒนาสัมพันธ์ที่ NVIDIA เสริมศักยภาพ AI MLOps, DevOps, นักวิทยาศาสตร์ และผู้เชี่ยวชาญด้านเทคนิคของ Amazon ของ Amazon เพื่อเชี่ยวชาญสแต็กการประมวลผล NVIDIA สำหรับการเร่งและเพิ่มประสิทธิภาพโมเดล Generative AI Foundation ครอบคลุมตั้งแต่การดูแลจัดการข้อมูล การฝึกอบรม GPU การอนุมานโมเดล และการปรับใช้การผลิตบนอินสแตนซ์ AWS GPU . นอกจากนี้ Eliuth ยังเป็นนักขี่จักรยานเสือภูเขา นักเล่นสกี เทนนิส และโป๊กเกอร์ผู้หลงใหล

- เนื้อหาที่ขับเคลื่อนด้วย SEO และการเผยแพร่ประชาสัมพันธ์ รับการขยายวันนี้

- PlatoData.Network Vertical Generative Ai เพิ่มพลังให้กับตัวเอง เข้าถึงได้ที่นี่.

- เพลโตไอสตรีม. Web3 อัจฉริยะ ขยายความรู้ เข้าถึงได้ที่นี่.

- เพลโตESG. คาร์บอน, คลีนเทค, พลังงาน, สิ่งแวดล้อม แสงอาทิตย์, การจัดการของเสีย. เข้าถึงได้ที่นี่.

- เพลโตสุขภาพ เทคโนโลยีชีวภาพและข่าวกรองการทดลองทางคลินิก เข้าถึงได้ที่นี่.

- ที่มา: https://aws.amazon.com/blogs/machine-learning/how-amazon-music-uses-sagemaker-with-nvidia-to-optimize-ml-training-and-inference-performance-and-cost/

- :มี

- :เป็น

- :ไม่

- :ที่ไหน

- $ ขึ้น

- 100

- 12

- 25

- 32

- 35%

- 7

- 8

- a

- สามารถ

- เกี่ยวกับเรา

- เร่ง

- เร่ง

- การเร่งความเร็ว

- เข้า

- บรรลุผล

- ความถูกต้อง

- ถูกต้อง

- บรรลุ

- ประสบความสำเร็จ

- ข้าม

- คล่องแคล่ว

- นอกจากนี้

- ที่อยู่

- การนำ

- โฆษณา

- น่าสงสาร

- หลังจาก

- AI

- โมเดล AI

- กรณีการใช้งาน ai

- อัลบั้ม

- อัลกอริทึม

- ทั้งหมด

- อนุญาต

- อนุญาตให้

- การอนุญาต

- ช่วยให้

- ด้วย

- เสมอ

- อเมซอน

- Amazon Web Services

- Amazon.com

- an

- และ

- การใช้งาน

- การใช้งาน

- เข้าใกล้

- สถาปนิก

- เป็น

- AREA

- พื้นที่

- รอบ

- ศิลปิน

- AS

- การให้ความช่วยเหลือ

- ช่วย

- At

- เฉลี่ย

- AWS

- แบ็กเอนด์

- ยอดคงเหลือ

- สมดุล

- บาร์

- ตาม

- baseline

- บาสเกตบอล

- อ่าว

- BE

- กลายเป็น

- เพราะ

- ประโยชน์ที่ได้รับ

- ที่ดีที่สุด

- ดีกว่า

- การส่งเสริม

- ช่วยเพิ่ม

- ทั้งสอง

- นำมาซึ่ง

- กว้าง

- สร้าง

- สร้าง

- by

- CAN

- ความสามารถในการ

- ความสามารถ

- จับ

- ซึ่ง

- ความก้าวหน้า

- รอบคอบ

- กรณี

- ความท้าทาย

- ท้าทาย

- แผนภูมิ

- ตรวจสอบ

- หัวแก้วหัวแหวน

- ทางเลือก

- ลูกค้า

- เมฆ

- รหัส

- COM

- อย่างไร

- การติดต่อสื่อสาร

- บริษัท

- เมื่อเทียบกับ

- การคำนวณ

- การคำนวณ

- พร้อมกัน

- องค์ประกอบ

- ภาชนะ

- เนื้อหา

- การลู่เข้า

- แกน

- ราคา

- ค่าใช้จ่าย

- หัตถกรรม

- วิกฤติ

- สำคัญมาก

- CSP

- curation

- ประเพณี

- ลูกค้า

- ประสบการณ์ของลูกค้า

- ลูกค้า

- ข้อมูล

- วันที่

- วัน

- ลดลง

- ลึก

- การเรียนรู้ลึก ๆ

- ความล่าช้า

- ส่งมอบ

- การส่งมอบ

- มอบ

- ความต้องการ

- ปรับใช้

- ปรับใช้

- การใช้งาน

- ออกแบบ

- ผู้พัฒนา

- ที่กำลังพัฒนา

- พัฒนาการ

- ต่าง

- ยาก

- โดยตรง

- การดำน้ำ

- หลาย

- DIY

- Dont

- ฮวบ

- ในระหว่าง

- พลวัต

- e

- E-commerce

- ก่อน

- การให้ความรู้

- อย่างมีประสิทธิภาพ

- ที่มีประสิทธิภาพ

- ความพยายาม

- สูง

- การฝัง

- อารมณ์

- จ้าง

- เพิ่มขีดความสามารถ

- เปิดการใช้งาน

- ส่งเสริม

- จบสิ้น

- พลังงาน

- วิศวกร

- ช่วย

- พอ

- การสร้างความมั่นใจ

- โดยเฉพาะอย่างยิ่ง

- ฯลฯ

- การประเมินการ

- แม้

- ทุกๆ

- การปฏิบัติ

- ประสบการณ์

- ประสบการณ์

- ผู้เชี่ยวชาญ

- FAST

- คุณสมบัติ

- รูป

- ในที่สุด

- หา

- หา

- ชื่อจริง

- ความยืดหยุ่น

- น้ำท่วม

- โฟกัส

- มุ่งเน้น

- โดยมุ่งเน้น

- ดังต่อไปนี้

- สำหรับ

- รูป

- รากฐาน

- กรอบ

- กรอบ

- ราคาเริ่มต้นที่

- ที่น่าผิดหวัง

- อย่างเต็มที่

- ฟังก์ชันการทำงาน

- ต่อไป

- การผสม

- เกตเวย์

- รุ่น

- กำเนิด

- กำเนิด AI

- GPU

- GPUs

- จัดการ

- เกิดขึ้น

- ฮาร์ดแวร์

- มี

- he

- หนัก

- ยกของหนัก

- ช่วย

- เป็นประโยชน์

- จะช่วยให้

- จุดสูง

- ระดับสูง

- ประสิทธิภาพสูง

- พระองค์

- ของเขา

- ถือ

- โฮสติ้ง

- ชั่วโมง

- สรุป ความน่าเชื่อถือของ Olymp Trade?

- อย่างไรก็ตาม

- HTML

- HTTPS

- ระบุ

- if

- แสดงให้เห็นถึง

- การถ่ายภาพ

- การดำเนินการ

- สำคัญ

- ปรับปรุง

- การปรับปรุง

- การปรับปรุง

- in

- รวมถึง

- เพิ่ม

- เพิ่มขึ้น

- ที่เพิ่มขึ้น

- อุตสาหกรรม

- ไม่มีประสิทธิภาพ

- มีอิทธิพล

- โครงสร้างพื้นฐาน

- แรกเริ่ม

- ตัวอย่าง

- ทันที

- แทน

- อยากเรียนรู้

- เข้าไป

- แนะนำ

- แนะนำ

- IT

- ITS

- การเดินทาง

- jpg

- เพียงแค่

- คีย์

- ชนิด

- ทราบ

- ที่รู้จักกัน

- ห้องปฏิบัติการ

- ภาษา

- ใหญ่

- ขนาดใหญ่

- ที่มีขนาดใหญ่

- ทน

- ความแอบแฝง

- ล่าสุด

- ชั้น

- นำ

- ชั้นนำ

- เรียนรู้

- การเรียนรู้

- เลฟเวอเรจ

- ห้องสมุด

- facelift

- กดไลก์

- ขีด จำกัด

- โหลด

- ที่ต้องการหา

- ต่ำ

- ลด

- เครื่อง

- เรียนรู้เครื่อง

- เก็บรักษา

- สำคัญ

- ทำ

- ทำให้

- ผู้จัดการ

- การจัดการ

- การตลาด

- เจ้านาย

- เพิ่ม

- อาจ..

- ความทรงจำ

- หน่วยความจำ

- Meta

- กลาง

- ล้าน

- ล้าน

- มิลลิวินาที

- ต่ำสุด

- ข้อผิดพลาด

- ผสม

- ML

- ม.ป.ป

- แบบ

- การสร้างแบบจำลอง

- โมเดล

- โมดูล

- เงิน

- ข้อมูลเพิ่มเติม

- มากที่สุด

- ภูเขา

- หลาย

- หลาย

- ดนตรี

- ต้อง

- ชื่อ

- จำเป็น

- ในเชิงลบ

- เครือข่าย

- ใหม่

- NLP

- Nvidia

- of

- เสนอ

- เสนอ

- on

- ONE

- เพียง

- เปิด

- โอเพนซอร์ส

- การดำเนินงาน

- การดำเนินงาน

- การดำเนินการ

- ดีที่สุด

- การเพิ่มประสิทธิภาพ

- เพิ่มประสิทธิภาพ

- การปรับให้เหมาะสม

- การเพิ่มประสิทธิภาพ

- or

- บงการ

- ใบสั่ง

- อื่นๆ

- ออก

- ด้านนอก

- โดดเด่น

- เกิน

- ทั้งหมด

- ของตนเอง

- พารามิเตอร์

- ส่วนหนึ่ง

- ในสิ่งที่สนใจ

- โดยเฉพาะ

- ร่วมมือ

- หลงใหล

- จุดสูงสุด

- เปอร์เซ็นต์

- การปฏิบัติ

- ส่วนบุคคล

- ส่วนบุคคล

- phd

- ท่อ

- เวที

- แพลตฟอร์ม

- เพลโต

- เพลโตดาต้าอินเทลลิเจนซ์

- เพลโตดาต้า

- ผู้เล่น

- เล่น

- พอดคาสต์

- พอดคาสต์

- จุด

- โป๊กเกอร์

- เป็นไปได้

- โพสต์

- ที่มีศักยภาพ

- อำนาจ

- ขับเคลื่อน

- ความแม่นยำ

- ก่อน

- จัดลำดับความสำคัญ

- ลำดับความสำคัญ

- ปัญหาที่เกิดขึ้น

- กระบวนการ

- ผลิตภัณฑ์

- การผลิต

- โครงการ

- ให้

- ผู้จัดหา

- ให้

- การให้

- หลาม

- รวดเร็ว

- อันดับ

- การอ่าน

- เรียลไทม์

- ลด

- อ้างอิง

- ที่เกี่ยวข้อง

- ความสัมพันธ์

- ความสัมพันธ์กัน

- ตรงประเด็น

- น่าเชื่อถือ

- การร้องขอ

- ต้อง

- แหล่งข้อมูล

- การตอบสนอง

- ความรับผิดชอบ

- รับผิดชอบ

- การตอบสนอง

- ส่งผลให้

- ผลสอบ

- รวย

- ขวา

- วิ่ง

- ทำงาน

- รันไทม์

- sagemaker

- เดียวกัน

- ลด

- ประหยัด

- ที่ปรับขนาดได้

- ขนาด

- วิทยาศาสตร์

- วิทยาศาสตร์

- นักวิทยาศาสตร์

- SDK

- sdks

- ได้อย่างลงตัว

- ค้นหา

- ค้นหา

- ค้นหา

- ที่สอง

- ส่วน

- เห็น

- ที่กำลังมองหา

- ดูเหมือนว่า

- อรรถศาสตร์

- ระดับอาวุโส

- มีความละเอียดอ่อน

- ประโยค

- ให้บริการ

- เซิร์ฟเวอร์

- บริการ

- ผู้ให้บริการ

- บริการ

- การให้บริการ

- ชุด

- การตั้งค่า

- หลาย

- Share

- ที่ใช้ร่วมกัน

- แสดงให้เห็นว่า

- สำคัญ

- อย่างมีความหมาย

- ง่าย

- นั่งอยู่

- ขนาด

- ขนาด

- สมาร์ท

- ซอฟต์แวร์

- การพัฒนาซอฟต์แวร์

- ทางออก

- โซลูชัน

- เพลง

- แหล่ง

- ความตึงเครียด

- ความเชี่ยวชาญ

- ความเชี่ยวชาญ

- โดยเฉพาะ

- ความเร็ว

- สะกด

- การสะกดคำ

- การใช้จ่าย

- กอง

- ที่เริ่มต้น

- startups

- การเข้าพัก

- คงที่

- ขั้นตอน

- ขั้นตอน

- เรื่องราว

- ที่พริ้ว

- อย่างเช่น

- เหนือกว่า

- สนับสนุน

- ที่สนับสนุน

- แน่ใจ

- นำ

- การ

- กำหนดเป้าหมาย

- ทีม

- เทคโนโลยี

- วิชาการ

- เทคนิค

- เทคนิค

- เทคโนโลยี

- เทคโนโลยี

- ข้อความ

- ที่

- พื้นที่

- ของพวกเขา

- พวกเขา

- ที่นั่น

- ดังนั้น

- ล้อยางขัดเหล่านี้ติดตั้งบนแกน XNUMX (มม.) ผลิตภัณฑ์นี้ถูกผลิตในหลายรูปทรง และหลากหลายเบอร์ความแน่นหนาของปริมาณอนุภาคขัดของมัน จะทำให้ท่านได้รับประสิทธิภาพสูงในการขัดและการใช้งานที่ยาวนาน

- พวกเขา

- สิ่ง

- นี้

- ตลอด

- ปริมาณงาน

- เวลา

- ครั้ง

- ชื่อหนังสือ

- ไปยัง

- ร่วมกัน

- tokenization

- ราชสกุล

- เอา

- เครื่องมือ

- ด้านบน

- TPS

- การจราจร

- รถไฟ

- ผ่านการฝึกอบรม

- การฝึกอบรม

- หม้อแปลงไฟฟ้า

- แนวโน้ม

- ไทรทัน

- จริง

- สอง

- ความเข้าใจ

- ไม่ต้องสงสัย

- จักรวาล

- ปลดล็อค

- เปิดตัว

- us

- ใช้

- มือสอง

- ผู้ใช้

- ใช้

- การใช้

- การใช้ประโยชน์

- ความคุ้มค่า

- กว้างใหญ่

- ความเก่งกาจ

- มาก

- ที่รอ

- เดิน

- Walmart

- คือ

- ชม

- วิธี

- we

- เว็บ

- บริการเว็บ

- ดี

- คือ

- เมื่อ

- แต่ทว่า

- ในขณะที่

- จะ

- กับ

- งาน

- ทำงาน

- การทำงาน

- โรงงาน

- โลก

- กังวล

- ยัง

- ผล

- คุณ

- ของคุณ

- ลมทะเล