ในช่วงไม่กี่ปีที่ผ่านมาแสดงให้เห็นถึงการเติบโตอย่างน่าทึ่งของโครงข่ายประสาทเทียมสำหรับการเรียนรู้เชิงลึก (DNN) การเติบโตนี้สามารถเห็นได้ในรูปแบบที่แม่นยำยิ่งขึ้น และยังเปิดโอกาสใหม่ๆ ด้วย AI เชิงกำเนิด: โมเดลภาษาขนาดใหญ่ (LLM) ที่สังเคราะห์ภาษาธรรมชาติ ตัวสร้างข้อความเป็นรูปภาพ และอื่นๆ ความสามารถที่เพิ่มขึ้นของ DNN มาพร้อมกับต้นทุนของการมีโมเดลขนาดใหญ่ที่ต้องใช้ทรัพยากรการคำนวณจำนวนมากเพื่อรับการฝึกอบรม การฝึกอบรมแบบกระจายแก้ปัญหานี้ด้วยสองเทคนิค: ความขนานของข้อมูลและความขนานของแบบจำลอง ความเท่าเทียมกันของข้อมูลถูกนำมาใช้เพื่อปรับขนาดกระบวนการฝึกอบรมบนโหนดและคนงานหลายโหนด และความขนานของแบบจำลองจะแยกแบบจำลองและพอดีกับโครงสร้างพื้นฐานที่กำหนด อเมซอน SageMaker กระจายการฝึกอบรม งานช่วยให้คุณสามารถคลิกเพียงครั้งเดียว (หรือการเรียก API หนึ่งครั้ง) เพื่อตั้งค่าคลัสเตอร์การคำนวณแบบกระจาย ฝึกโมเดล บันทึกผลลัพธ์ไปยัง บริการจัดเก็บข้อมูลอย่างง่ายของ Amazon (Amazon S3) และปิดคลัสเตอร์เมื่อเสร็จสิ้น นอกจากนี้ SageMaker ยังได้สร้างสรรค์สิ่งใหม่ๆ อย่างต่อเนื่องในพื้นที่การฝึกอบรมแบบกระจาย โดยเปิดตัวคุณลักษณะต่างๆ เช่น กระจุกที่ต่างกัน และแจกห้องสมุดอบรมให้กับ ความเท่าเทียมกันของข้อมูล และ แบบจำลองขนาน.

การฝึกอบรมอย่างมีประสิทธิภาพในสภาพแวดล้อมแบบกระจายจำเป็นต้องปรับไฮเปอร์พารามิเตอร์ ตัวอย่างทั่วไปของแนวทางปฏิบัติที่ดีเมื่อฝึก GPU หลายตัวคือการคูณขนาดแบตช์ (หรือมินิแบตช์) ด้วยหมายเลข GPU เพื่อรักษาขนาดแบตช์ต่อ GPU ให้เท่ากัน อย่างไรก็ตาม การปรับไฮเปอร์พารามิเตอร์มักจะส่งผลต่อการบรรจบกันของโมเดล ดังนั้น การฝึกอบรมแบบกระจายจำเป็นต้องสร้างความสมดุลให้กับปัจจัยสามประการ: การกระจาย ไฮเปอร์พารามิเตอร์ และความแม่นยำของโมเดล

ในโพสต์นี้ เราจะสำรวจผลของการฝึกอบรมแบบกระจายต่อคอนเวอร์เจนซ์และวิธีใช้ การปรับโมเดลอัตโนมัติของ Amazon SageMaker เพื่อปรับแต่งไฮเปอร์พารามิเตอร์ของโมเดลอย่างละเอียดสำหรับการฝึกอบรมแบบกระจายโดยใช้ข้อมูลคู่ขนาน

ซอร์สโค้ดที่กล่าวถึงในโพสต์นี้สามารถพบได้บน พื้นที่เก็บข้อมูล GitHub (แนะนำให้ใช้อินสแตนซ์ m5.xlarge)

ปรับขนาดการฝึกอบรมจากสภาพแวดล้อมเดียวไปสู่สภาพแวดล้อมแบบกระจาย

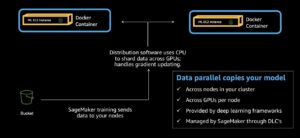

ความเท่าเทียมกันของข้อมูลเป็นวิธีการปรับขนาดกระบวนการฝึกอบรมเป็นทรัพยากรการคำนวณหลายรายการและบรรลุเวลาการฝึกอบรมที่เร็วขึ้น ด้วยความขนานของข้อมูล ข้อมูลจะถูกแบ่งพาร์ติชันระหว่างโหนดคอมพิวท์ และแต่ละโหนดจะคำนวณการไล่ระดับสีตามพาร์ติชันและอัปเดตโมเดล การอัปเดตเหล่านี้สามารถทำได้โดยใช้เซิร์ฟเวอร์พารามิเตอร์หนึ่งตัวหรือหลายตัวในรูปแบบอะซิงโครนัส แบบหนึ่งต่อกลุ่ม หรือทั้งหมดต่อทั้งหมด อีกวิธีหนึ่งคือใช้อัลกอริทึม AllReduce ตัวอย่างเช่น ในอัลกอริธึม ring-allreduce แต่ละโหนดจะสื่อสารกับโหนดข้างเคียงเพียงสองโหนด ซึ่งจะช่วยลดการถ่ายโอนข้อมูลโดยรวม หากต้องการเรียนรู้เพิ่มเติมเกี่ยวกับเซิร์ฟเวอร์พารามิเตอร์และ ring-allreduce โปรดดูที่ เปิดใช้งานการฝึกอบรมแบบกระจาย TensorFlow อย่างง่ายดายด้วย Horovod หรือ Parameter Servers ใน Amazon SageMaker. เกี่ยวกับการแบ่งพาร์ติชั่นข้อมูล ถ้ามี n โหนดคอมพิวท์ แต่ละโหนดควรได้รับชุดย่อยของข้อมูล ประมาณ 1/n ในขนาด.

เพื่อแสดงผลของการปรับขนาดการฝึกอบรมเกี่ยวกับการบรรจบกันของโมเดล เราทำการทดลองง่ายๆ สองแบบ:

การฝึกโมเดลแต่ละครั้งดำเนินการสองครั้ง: ในอินสแตนซ์เดียวและกระจายไปหลายอินสแตนซ์ สำหรับการฝึกอบรมแบบกระจาย DNN เพื่อใช้โปรเซสเซอร์แบบกระจายอย่างเต็มที่ เราคูณขนาดมินิแบทช์ด้วยจำนวนอินสแตนซ์ (สี่) ตารางต่อไปนี้สรุปการตั้งค่าและผลลัพธ์

| ประเภทปัญหา | การจำแนกรูปภาพ | การจำแนกไบนารี | ||

| รุ่น | DNN | XGBoost | ||

| ตัวอย่าง | ml.c4.xlarge | มล.m5.2xlarge | ||

| ชุดข้อมูล |

(ภาพที่มีป้ายกำกับ) |

การตลาดทางตรง (หมวดหมู่แบบตาราง ตัวเลข และเวกเตอร์) |

||

| เมตริกการตรวจสอบ | ความถูกต้อง | AUC | ||

| Epocs/รอบ | 20 | 150 | ||

| จำนวนอินสแตนซ์ | 1 | 4 | 1 | 3 |

| ประเภทการจำหน่าย | N / A | เซิร์ฟเวอร์พารามิเตอร์ | N / A | ลดทั้งหมด |

| เวลาฝึก (นาที) | 8 | 3 | 3 | 1 |

| คะแนนการตรวจสอบขั้นสุดท้าย | 0.97 | 0.11 | 0.78 | 0.63 |

สำหรับทั้งสองรุ่น เวลาการฝึกลดลงเกือบเป็นเส้นตรงตามปัจจัยการกระจาย อย่างไรก็ตาม การบรรจบกันของโมเดลลดลงอย่างมาก ลักษณะการทำงานนี้สอดคล้องกันสำหรับสองโมเดลที่แตกต่างกัน อินสแตนซ์การประมวลผลที่แตกต่างกัน วิธีการกระจายที่แตกต่างกัน และประเภทข้อมูลที่แตกต่างกัน เหตุใดการกระจายกระบวนการฝึกอบรมจึงส่งผลต่อความแม่นยำของโมเดล

มีหลายทฤษฎีที่พยายามอธิบายผลกระทบนี้:

- เมื่อการปรับปรุงเทนเซอร์มีขนาดใหญ่ การรับส่งข้อมูลระหว่างผู้ปฏิบัติงานและเซิร์ฟเวอร์พารามิเตอร์อาจแออัดได้ ดังนั้น เซิร์ฟเวอร์พารามิเตอร์แบบอะซิงโครนัสจะประสบปัญหาการบรรจบกันที่แย่ลงอย่างมากเนื่องจากความล่าช้าในการอัปเดตน้ำหนัก [1]

- การเพิ่มขนาดแบทช์อาจนำไปสู่ความพอดีและการจัดวางทั่วไปที่ไม่ดี ซึ่งส่งผลให้ความแม่นยำในการตรวจสอบลดลง [2]

- เมื่ออัปเดตพารามิเตอร์โมเดลแบบอะซิงโครนัส DNN บางตัวอาจไม่ได้ใช้น้ำหนักโมเดลที่อัปเดตล่าสุด ดังนั้นพวกเขาจะคำนวณการไล่ระดับสีตามน้ำหนักที่มีการวนซ้ำไม่กี่ครั้ง สิ่งนี้นำไปสู่การค้างของน้ำหนัก [3] และเกิดได้จากหลายสาเหตุ

- ไฮเปอร์พารามิเตอร์บางตัวเป็นโมเดลหรือเครื่องมือเพิ่มประสิทธิภาพเฉพาะ ตัวอย่างเช่น เอกสารอย่างเป็นทางการของ XGBoost กล่าวว่า

exactค่าสำหรับtree_modeไฮเปอร์พารามิเตอร์ไม่รองรับการฝึกอบรมแบบกระจายเนื่องจาก XGBoost ใช้การกระจายข้อมูลแบบแยกแถวในขณะที่exactวิธีการแบบต้นไม้ทำงานในรูปแบบคอลัมน์ที่เรียงลำดับ - นักวิจัยบางคนเสนอว่าการกำหนดค่ามินิแบทช์ที่ใหญ่ขึ้นอาจนำไปสู่การไล่ระดับสีที่มีความสุ่มน้อยกว่า กรณีนี้อาจเกิดขึ้นได้เมื่อฟังก์ชันการสูญเสียมีจุดต่ำสุดและจุดอานม้าเฉพาะที่ และไม่มีการเปลี่ยนแปลงขนาดสเต็ป การเพิ่มประสิทธิภาพติดขัดในจุดต่ำสุดหรือจุดอานม้าในท้องถิ่นดังกล่าว [4]

เพิ่มประสิทธิภาพสำหรับการฝึกอบรมแบบกระจาย

Hyperparameter optimization (HPO) เป็นกระบวนการค้นหาและเลือกชุดของ hyperparameters ที่เหมาะสมที่สุดสำหรับอัลกอริทึมการเรียนรู้ SageMaker Automatic Model Tuning (AMT) ให้บริการ HPO เป็นบริการที่มีการจัดการโดยการเรียกใช้งานการฝึกอบรมหลายรายการในชุดข้อมูลที่มีให้ SageMaker AMT จะค้นหาช่วงของไฮเปอร์พารามิเตอร์ที่คุณระบุและส่งคืนค่าที่ดีที่สุด ตามที่วัดโดยเมตริกที่คุณเลือก คุณสามารถใช้ SageMaker AMT กับอัลกอริทึมในตัวหรือใช้อัลกอริทึมและคอนเทนเนอร์ที่คุณกำหนดเอง

อย่างไรก็ตาม การเพิ่มประสิทธิภาพสำหรับการฝึกอบรมแบบกระจายแตกต่างจาก HPO ทั่วไป เนื่องจากแทนที่จะเปิดใช้อินสแตนซ์เดียวต่องานการฝึกอบรม แต่ละงานจะเปิดใช้คลัสเตอร์ของอินสแตนซ์จริงๆ ซึ่งหมายถึงผลกระทบต่อต้นทุนที่มากขึ้น (โดยเฉพาะอย่างยิ่งหากคุณพิจารณาอินสแตนซ์ที่เร่งด้วย GPU ซึ่งมีราคาแพง ซึ่งเป็นเรื่องปกติสำหรับ DNN) นอกจาก ขีดจำกัด AMTคุณอาจจะตี ขีดจำกัดของบัญชี SageMaker สำหรับจำนวนอินสแตนซ์การฝึกอบรมพร้อมกัน สุดท้าย การเปิดตัวคลัสเตอร์สามารถแนะนำค่าใช้จ่ายในการดำเนินการเนื่องจากเวลาเริ่มต้นที่นานขึ้น SageMaker AMT มีคุณสมบัติเฉพาะเพื่อแก้ไขปัญหาเหล่านี้ ไฮเปอร์แบนด์ที่มีการหยุดก่อนกำหนด ตรวจสอบให้แน่ใจว่าการกำหนดค่าไฮเปอร์พารามิเตอร์ที่ทำงานได้ดีได้รับการปรับแต่งอย่างละเอียด และการกำหนดค่าที่ต่ำกว่าจะถูกหยุดโดยอัตโนมัติ ช่วยให้ใช้เวลาฝึกอบรมได้อย่างมีประสิทธิภาพและลดค่าใช้จ่ายที่ไม่จำเป็น นอกจากนี้ SageMaker AMT ยังรองรับการใช้งาน Amazon EC2 Spot Instances อย่างสมบูรณ์ ซึ่งสามารถเพิ่มประสิทธิภาพ ค่าใช้จ่ายในการฝึกอบรมสูงถึง 90% เหนืออินสแตนซ์ตามความต้องการ สำหรับเวลาเริ่มต้นที่ยาวนาน SageMaker AMT จะใช้อินสแตนซ์การฝึกอบรมซ้ำโดยอัตโนมัติภายในงานปรับแต่งแต่ละงาน จึงช่วยลดเวลาเริ่มต้นโดยเฉลี่ยของแต่ละงาน งานฝึกอบรมถึง 20 เท่า. นอกจากนี้คุณควรปฏิบัติตาม แนวปฏิบัติที่ดีที่สุดของ AMTเช่น การเลือกไฮเปอร์พารามิเตอร์ที่เกี่ยวข้อง ช่วงและสเกลที่เหมาะสม และจำนวนงานฝึกอบรมพร้อมกันที่ดีที่สุด และการตั้งค่าเมล็ดพันธุ์แบบสุ่มเพื่อสร้างผลลัพธ์ซ้ำ

ในหัวข้อถัดไป เราจะเห็นคุณลักษณะเหล่านี้ทำงานในขณะที่เรากำหนดค่า รัน และวิเคราะห์งาน AMT โดยใช้ตัวอย่าง XGBoost ที่เรากล่าวถึงก่อนหน้านี้

กำหนดค่า เรียกใช้ และวิเคราะห์งานการปรับแต่ง

ดังที่ได้กล่าวไว้ก่อนหน้านี้ ซอร์สโค้ดสามารถพบได้บน repo GitHub. ในขั้นตอนที่ 1–5 เราดาวน์โหลดและเตรียมข้อมูล สร้าง xgb3 ตัวประมาณค่า (ตัวประมาณค่า XGBoost แบบกระจายถูกตั้งค่าให้ใช้สามอินสแตนซ์) รันงานการฝึกอบรม และสังเกตผลลัพธ์ ในส่วนนี้ เราจะอธิบายวิธีตั้งค่างานปรับแต่งสำหรับตัวประมาณนั้น โดยถือว่าคุณได้ผ่านขั้นตอนที่ 1-5 แล้ว

งานปรับแต่งจะคำนวณไฮเปอร์พารามิเตอร์ที่เหมาะสมที่สุดสำหรับงานฝึกอบรมที่เปิดตัวโดยใช้เมตริกเพื่อประเมินประสิทธิภาพ คุณสามารถ กำหนดค่าเมตริกของคุณเองซึ่ง SageMaker จะแยกวิเคราะห์ตาม regex ที่คุณกำหนดค่าและเผยแพร่ stdoutหรือใช้เมตริกของ อัลกอริทึมในตัวของ SageMaker. ในตัวอย่างนี้ เราใช้ ตัวชี้วัดวัตถุประสงค์ XGBoost ในตัวเราจึงไม่ต้องกำหนดค่า regex เพื่อเพิ่มประสิทธิภาพสำหรับการบรรจบกันของโมเดล เราปรับให้เหมาะสมตามเมตริก AUC ที่ตรวจสอบความถูกต้อง:

เราปรับไฮเปอร์พารามิเตอร์เจ็ดรายการ:

- num_round – จำนวนรอบสำหรับการเร่งความเร็วระหว่างการฝึก

- การทางพิเศษแห่งประเทศไทย – การหดตัวของขนาดขั้นตอนใช้ในการอัปเดตเพื่อป้องกันการโอเวอร์ฟิต

- แอลฟา – L1 เงื่อนไขการทำให้เป็นมาตรฐานเกี่ยวกับน้ำหนัก

- ขั้นต่ำ_เด็ก_น้ำหนัก – ผลรวมขั้นต่ำของน้ำหนักอินสแตนซ์ (เฮสเซียน) ที่จำเป็นในเด็ก หากขั้นตอนของพาร์ติชันแบบทรีส่งผลให้โหนดปลายสุดมีผลรวมของน้ำหนักอินสแตนซ์น้อยกว่า

min_child_weightกระบวนการสร้างทำให้การแบ่งพาร์ติชันเพิ่มขึ้น - ความลึกสูงสุด - ความลึกสูงสุดของต้นไม้

- colsample_bylevel – อัตราส่วนตัวอย่างย่อยของคอลัมน์สำหรับแต่ละการแบ่ง ในแต่ละระดับ การสุ่มตัวอย่างย่อยนี้จะเกิดขึ้นหนึ่งครั้งสำหรับทุก ๆ ระดับความลึกใหม่ที่ไปถึงในแผนผัง

- colsample_bytree – อัตราส่วนตัวอย่างย่อยของคอลัมน์เมื่อสร้างต้นไม้แต่ละต้น สำหรับต้นไม้ทุกต้นที่สร้างขึ้น การสุ่มตัวอย่างย่อยจะเกิดขึ้นหนึ่งครั้ง

หากต้องการเรียนรู้เพิ่มเติมเกี่ยวกับไฮเปอร์พารามิเตอร์ XGBoost โปรดดู XGBoost ไฮเปอร์พารามิเตอร์. รหัสต่อไปนี้แสดงไฮเปอร์พารามิเตอร์ทั้งเจ็ดและช่วง:

ต่อไปเราให้บริการ การกำหนดค่าสำหรับกลยุทธ์ Hyperband และการกำหนดค่าวัตถุจูนเนอร์โดยใช้ SageMaker SDK HyperbandStrategyConfig สามารถใช้สองพารามิเตอร์: max_resource (ไม่บังคับ) สำหรับจำนวนการทำซ้ำสูงสุดที่จะใช้สำหรับงานฝึกอบรมเพื่อให้บรรลุวัตถุประสงค์ และ min_resource – จำนวนการวนซ้ำขั้นต่ำที่งานการฝึกใช้ก่อนที่จะหยุดการฝึก เราใช้ HyperbandStrategyConfig เพื่อกำหนดค่า StrategyConfigซึ่งใช้ในภายหลังโดยนิยามงานการปรับแต่ง ดูรหัสต่อไปนี้:

ตอนนี้เราสร้าง HyperparameterTuner วัตถุที่เราส่งข้อมูลต่อไปนี้:

- ตัวประมาณค่า XGBoost ตั้งค่าให้รันด้วยสามอินสแตนซ์

- ชื่อเมตริกวัตถุประสงค์และคำจำกัดความ

- ช่วงไฮเปอร์พารามิเตอร์ของเรา

- ปรับแต่งการกำหนดค่าทรัพยากร เช่น จำนวนงานฝึกอบรมที่จะรันทั้งหมด และจำนวนงานฝึกอบรมที่สามารถรันพร้อมกันได้

- การตั้งค่าไฮเปอร์แบนด์ (กลยุทธ์และการกำหนดค่าที่เรากำหนดค่าในขั้นตอนสุดท้าย)

- หยุดก่อนกำหนด (

early_stopping_type) ตั้งค่าให้Off

เหตุใดเราจึงตั้งค่าการหยุดก่อนกำหนดเป็นปิด งานการฝึกอบรมสามารถหยุดก่อนกำหนดได้เมื่อไม่น่าจะปรับปรุงเมตริกวัตถุประสงค์ของงานการปรับไฮเปอร์พารามิเตอร์ วิธีนี้สามารถช่วยลดเวลาในการประมวลผลและหลีกเลี่ยงการใช้โมเดลของคุณมากเกินไป อย่างไรก็ตาม Hyperband ใช้กลไกในตัวขั้นสูงเพื่อใช้การหยุดก่อนกำหนด ดังนั้นพารามิเตอร์ early_stopping_type ต้องตั้งค่าเป็น Off เมื่อใช้คุณสมบัติการหยุดก่อนกำหนดภายใน Hyperband ดูรหัสต่อไปนี้:

สุดท้าย เราเริ่มงานปรับแต่งโมเดลอัตโนมัติโดยเรียก พอดี วิธี. หากคุณต้องการเปิดงานในแบบอะซิงโครนัส ให้ตั้งค่า wait ไปยัง False. ดูรหัสต่อไปนี้:

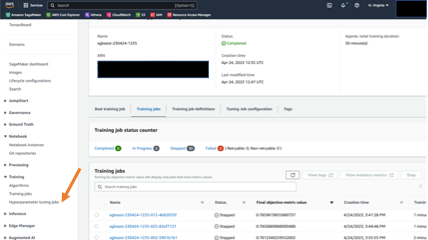

คุณสามารถติดตามความคืบหน้าของงานและสรุปได้ในคอนโซล SageMaker ในบานหน้าต่างนำทาง ภายใต้ การฝึกอบรมเลือก งานปรับแต่งไฮเปอร์พารามิเตอร์จากนั้นเลือกงานปรับแต่งที่เกี่ยวข้อง ภาพหน้าจอต่อไปนี้แสดงงานการปรับแต่งพร้อมรายละเอียดเกี่ยวกับสถานะและประสิทธิภาพของงานการฝึกอบรม

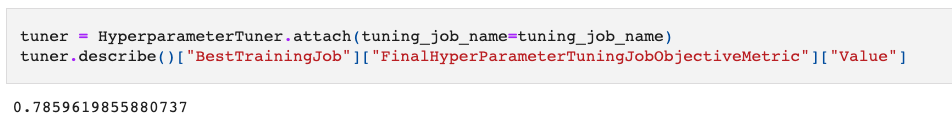

เมื่องานการปรับแต่งเสร็จสิ้น เราสามารถตรวจสอบผลลัพธ์ได้ ในตัวอย่างสมุดบันทึก เราแสดงวิธีแยกผลลัพธ์โดยใช้ SageMaker SDK ขั้นแรก เราตรวจสอบว่างานการปรับแต่งเพิ่มการบรรจบกันของโมเดลได้อย่างไร คุณสามารถแนบไฟล์ HyperparameterTuner วัตถุโดยใช้ชื่องานและโทร บรรยาย วิธี. เมธอดส่งคืนพจนานุกรมที่มีข้อมูลเมตาของงานปรับแต่งและผลลัพธ์

ในโค้ดต่อไปนี้ เราดึงค่าของงานฝึกอบรมที่มีประสิทธิภาพดีที่สุด โดยวัดจากเมตริกวัตถุประสงค์ของเรา (การตรวจสอบ AUC):

ผลลัพธ์คือ 0.78 ใน AUC ในชุดการตรวจสอบ นั่นเป็นการปรับปรุงที่สำคัญจาก 0.63 เริ่มต้น!

ต่อไปมาดูกันว่างานฝึกอบรมของเราดำเนินไปเร็วแค่ไหน สำหรับสิ่งนั้นเราใช้ ไฮเปอร์พารามิเตอร์การปรับแต่งJobAnalytics วิธีการใน SDK เพื่อดึงผลลัพธ์เกี่ยวกับงานปรับแต่ง และอ่านในกรอบข้อมูล Pandas เพื่อการวิเคราะห์และการแสดงภาพ:

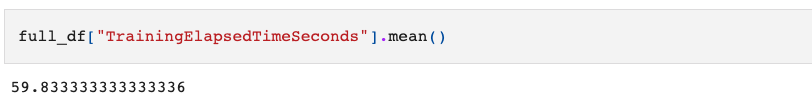

มาดูเวลาเฉลี่ยที่งานฝึกอบรมใช้กับกลยุทธ์ Hyperband:

เวลาเฉลี่ยใช้เวลาประมาณ 1 นาที สิ่งนี้สอดคล้องกับกลไกกลยุทธ์ Hyperband ที่จะหยุดงานฝึกอบรมที่มีประสิทธิภาพต่ำตั้งแต่เนิ่นๆ ในแง่ของค่าใช้จ่าย งานปรับแต่งเรียกเก็บเงินจากเราเป็นเวลาฝึกอบรมทั้งหมด 30 นาที หากไม่มีการหยุด Hyperband ก่อนกำหนด ระยะเวลาการฝึกอบรมที่เรียกเก็บเงินทั้งหมดคาดว่าจะเป็น 90 นาที (30 งาน * 1 นาทีต่องาน * 3 อินสแตนซ์ต่องาน) ที่ช่วยประหยัดต้นทุนได้ดีกว่าถึง 30 เท่า! ในที่สุด เราเห็นว่างานปรับแต่งทำงานฝึกอบรม 12 งานและใช้เวลาทั้งหมด 50 นาที ซึ่งน้อยกว่าเวลาที่คาดไว้เกือบ 30% (4 งาน/3 งานพร้อมกัน * XNUMX นาทีต่องาน)

สรุป

ในโพสต์นี้ เราได้อธิบายปัญหาคอนเวอร์เจนซ์ที่สังเกตได้เมื่อฝึกโมเดลด้วยสภาพแวดล้อมแบบกระจาย เราเห็นว่า SageMaker AMT ที่ใช้ Hyperband จัดการกับข้อกังวลหลักที่การเพิ่มประสิทธิภาพการฝึกอบรมแบบกระจายข้อมูลแบบคู่ขนานแนะนำ: การบรรจบกัน (ซึ่งปรับปรุงมากกว่า 10%) ประสิทธิภาพการดำเนินงาน (งานปรับแต่งใช้เวลาน้อยกว่างานต่อเนื่องที่ไม่ได้ปรับให้เหมาะสมถึง 50% ดำเนินการไปแล้ว) และคุ้มค่า (30 เทียบกับเวลางานฝึกอบรม 90 นาทีที่เรียกเก็บเงินได้) ตารางต่อไปนี้สรุปผลลัพธ์ของเรา:

| เมตริกการปรับปรุง | ไม่มีการปรับแต่ง / การปรับแต่งโมเดลไร้เดียงสา | SageMaker Hyperband การปรับแต่งโมเดลอัตโนมัติ | การปรับปรุงที่วัดได้ |

| คุณภาพของแบบจำลอง (วัดจากการตรวจสอบ AUC) |

0.63 | 0.78 | 15% |

| ราคา (วัดจากนาทีการฝึกอบรมที่เรียกเก็บเงินได้) |

90 | 30 | 66% |

| ประสิทธิภาพการดำเนินงาน (วัดจากระยะเวลาการทำงานทั้งหมด) |

24 | 12 | 50% |

ในการปรับอย่างละเอียดเกี่ยวกับการปรับขนาด (ขนาดคลัสเตอร์) คุณสามารถทำซ้ำงานปรับแต่งด้วยการกำหนดค่าคลัสเตอร์หลายรายการ และเปรียบเทียบผลลัพธ์เพื่อค้นหาไฮเปอร์พารามิเตอร์ที่เหมาะสมที่สุดที่ตอบสนองความเร็วและความแม่นยำของโมเดล

เราได้รวมขั้นตอนในการบรรลุสิ่งนี้ไว้ในส่วนสุดท้ายของ สมุดบันทึก.

อ้างอิง

[1] Lian, Xiangru และคณะ “การไล่ระดับสีแบบสุ่มแบบกระจายอำนาจแบบอะซิงโครนัสแบบขนาน” การประชุมนานาชาติด้านการเรียนรู้ของเครื่อง. พม., 2018.

[2] เคสการ์ นิทิช ชีริช และคณะ “ในการฝึกอบรมจำนวนมากสำหรับการเรียนรู้เชิงลึก: ช่องว่างทั่วไปและจุดต่ำสุดที่คมชัด” arXiv preprint arXiv: 1609.04836 (2016)

[3] Dai, Wei และคณะ “เพื่อทำความเข้าใจผลกระทบของความไม่แน่นอนในการเรียนรู้ของเครื่องแบบกระจาย” arXiv preprint arXiv: 1810.03264 (2018)

[4] Dauphin, Yann N. และคณะ “การระบุและโจมตีปัญหาจุดอานในการเพิ่มประสิทธิภาพแบบไม่นูนในมิติสูง” ความก้าวหน้าของระบบประมวลผลข้อมูลประสาท 27 (2014)

เกี่ยวกับผู้เขียน

Uri Rosenberg เป็นผู้จัดการด้านเทคนิคของ AI & ML Specialist ประจำยุโรป ตะวันออกกลาง และแอฟริกา Uri มีฐานอยู่ที่ประเทศอิสราเอล โดยทำงานเพื่อให้อำนาจแก่ลูกค้าองค์กรในการออกแบบ สร้าง และดำเนินการปริมาณงาน ML ตามขนาด เวลาว่างชอบปั่นจักรยาน เดินป่า และบ่นเรื่องการเตรียมข้อมูล

Uri Rosenberg เป็นผู้จัดการด้านเทคนิคของ AI & ML Specialist ประจำยุโรป ตะวันออกกลาง และแอฟริกา Uri มีฐานอยู่ที่ประเทศอิสราเอล โดยทำงานเพื่อให้อำนาจแก่ลูกค้าองค์กรในการออกแบบ สร้าง และดำเนินการปริมาณงาน ML ตามขนาด เวลาว่างชอบปั่นจักรยาน เดินป่า และบ่นเรื่องการเตรียมข้อมูล

- เนื้อหาที่ขับเคลื่อนด้วย SEO และการเผยแพร่ประชาสัมพันธ์ รับการขยายวันนี้

- PlatoData.Network Vertical Generative Ai เพิ่มพลังให้กับตัวเอง เข้าถึงได้ที่นี่.

- เพลโตไอสตรีม. Web3 อัจฉริยะ ขยายความรู้ เข้าถึงได้ที่นี่.

- เพลโตESG. ยานยนต์ / EVs, คาร์บอน, คลีนเทค, พลังงาน, สิ่งแวดล้อม แสงอาทิตย์, การจัดการของเสีย. เข้าถึงได้ที่นี่.

- BlockOffsets การปรับปรุงการเป็นเจ้าของออฟเซ็ตด้านสิ่งแวดล้อมให้ทันสมัย เข้าถึงได้ที่นี่.

- ที่มา: https://aws.amazon.com/blogs/machine-learning/effectively-solve-distributed-training-convergence-issues-with-amazon-sagemaker-hyperband-automatic-model-tuning/

- :มี

- :เป็น

- :ไม่

- $ ขึ้น

- 1

- 10

- 100

- 12

- 15%

- 20

- 200

- 2014

- 2016

- 2018

- 24

- 27

- 30

- 7

- 8

- 9

- a

- เกี่ยวกับเรา

- ลงชื่อเข้าใช้

- ความถูกต้อง

- ถูกต้อง

- บรรลุ

- การกระทำ

- จริง

- นอกจากนี้

- นอกจากนี้

- ที่อยู่

- ที่อยู่

- สูง

- มีผลต่อ

- แอฟริกา

- AI

- AL

- ขั้นตอนวิธี

- อัลกอริทึม

- แอลฟา

- แล้ว

- ด้วย

- น่าอัศจรรย์

- อเมซอน

- Amazon EC2

- อเมซอน SageMaker

- Amazon Web Services

- ในหมู่

- an

- การวิเคราะห์

- การวิเคราะห์

- วิเคราะห์

- และ

- อื่น

- API

- ใช้

- เหมาะสม

- ประมาณ

- เป็น

- AS

- At

- แนบ

- โจมตี

- อัตโนมัติ

- อัตโนมัติ

- เฉลี่ย

- หลีกเลี่ยง

- AWS

- ยอดคงเหลือ

- ตาม

- BE

- เพราะ

- ก่อน

- พฤติกรรม

- หลัง

- ที่ดีที่สุด

- ดีกว่า

- ระหว่าง

- ใหญ่

- การส่งเสริม

- ทั้งสอง

- สร้าง

- การก่อสร้าง

- built-in

- by

- การคํานวณ

- โทรศัพท์

- โทร

- CAN

- สามารถรับ

- ความสามารถในการ

- หมวดหมู่

- ที่เกิดจาก

- เปลี่ยนแปลง

- การเรียกเก็บเงิน

- เด็ก

- Choose

- เลือก

- คลิก

- Cluster

- รหัส

- คอลัมน์

- คอลัมน์

- อย่างไร

- ร่วมกัน

- เปรียบเทียบ

- สมบูรณ์

- คำนวณ

- ความกังวลเกี่ยวกับ

- พร้อมกัน

- การประชุม

- องค์ประกอบ

- การกำหนดค่า

- พิจารณา

- คงเส้นคงวา

- ปลอบใจ

- ก่อสร้าง

- ภาชนะบรรจุ

- มี

- อย่างต่อเนื่อง

- การลู่เข้า

- ราคา

- แพง

- ค่าใช้จ่าย

- ได้

- สร้าง

- ประเพณี

- ลูกค้า

- DAI

- ข้อมูล

- การเตรียมข้อมูล

- ซึ่งกระจายอำนาจ

- ลึก

- การเรียนรู้ลึก ๆ

- คำนิยาม

- ความล่าช้า

- สาธิต

- ความลึก

- บรรยาย

- อธิบาย

- ออกแบบ

- กำหนด

- รายละเอียด

- DID

- ต่าง

- กล่าวถึง

- กระจาย

- กระจายการฝึกอบรม

- จำหน่าย

- การกระจาย

- do

- เอกสาร

- ไม่

- ทำ

- Dont

- ลง

- ดาวน์โหลด

- หล่น

- สอง

- ระยะเวลา

- ในระหว่าง

- E&T

- แต่ละ

- ก่อน

- ก่อน

- อย่างง่ายดาย

- ตะวันออก

- ผล

- มีประสิทธิภาพ

- อย่างมีประสิทธิภาพ

- ที่มีประสิทธิภาพ

- พนักงาน

- ให้อำนาจ

- ทำให้สามารถ

- ช่วยให้

- เพื่อให้แน่ใจ

- Enterprise

- สิ่งแวดล้อม

- สภาพแวดล้อม

- โดยเฉพาะอย่างยิ่ง

- ยุโรป

- ประเมินค่า

- แม้

- ทุกๆ

- ตรวจสอบ

- ตัวอย่าง

- ที่คาดหวัง

- การทดลอง

- อธิบาย

- สำรวจ

- สารสกัด

- ปัจจัย

- ปัจจัย

- แฟชั่น

- FAST

- เร็วขึ้น

- ลักษณะ

- คุณสมบัติ

- สองสาม

- ในที่สุด

- หา

- ชื่อจริง

- พอดี

- ปฏิบัติตาม

- ดังต่อไปนี้

- สำหรับ

- รูป

- พบ

- สี่

- FRAME

- ราคาเริ่มต้นที่

- อย่างเต็มที่

- ฟังก์ชัน

- ต่อไป

- นอกจากนี้

- ช่องว่าง

- กำเนิด

- กำเนิด AI

- เครื่องกำเนิดไฟฟ้า

- ได้รับ

- ได้รับ

- จะช่วยให้

- ดี

- GPU

- GPUs

- การไล่ระดับสี

- มากขึ้น

- การเจริญเติบโต

- เกิดขึ้น

- มี

- มี

- he

- ช่วย

- ของเขา

- ตี

- สรุป ความน่าเชื่อถือของ Olymp Trade?

- ทำอย่างไร

- อย่างไรก็ตาม

- HTML

- ที่ http

- HTTPS

- การปรับแต่งไฮเปอร์พารามิเตอร์

- if

- ภาพ

- ส่งผลกระทบ

- ผลกระทบ

- ปรับปรุง

- การปรับปรุง

- การปรับปรุง

- in

- รวม

- เพิ่มขึ้น

- ข้อมูล

- โครงสร้างพื้นฐาน

- แรกเริ่ม

- ตัวอย่าง

- แทน

- ภายใน

- เข้าไป

- แนะนำ

- แนะนำ

- อิสราเอล

- ปัญหา

- IT

- ซ้ำ

- ITS

- การสัมภาษณ์

- งาน

- เก็บ

- L1

- ภาษา

- ใหญ่

- ที่มีขนาดใหญ่

- ชื่อสกุล

- ต่อมา

- เปิดตัว

- การเปิดตัว

- การเปิดตัว

- นำ

- นำไปสู่

- เรียนรู้

- การเรียนรู้

- น้อยลง

- ชั้น

- ห้องสมุด

- กดไลก์

- ในประเทศ

- นาน

- อีกต่อไป

- ปิด

- เครื่อง

- เรียนรู้เครื่อง

- ทำ

- หลัก

- การจัดการ

- ผู้จัดการ

- หลาย

- มาก

- สูงสุด

- อาจ..

- วิธี

- กลไก

- กล่าวถึง

- เมตาดาต้า

- วิธี

- วิธีการ

- เมตริก

- ตัวชี้วัด

- กลาง

- ตะวันออกกลาง

- อาจ

- ขั้นต่ำ

- นาที

- นาที

- ML

- แบบ

- โมเดล

- ข้อมูลเพิ่มเติม

- มากที่สุด

- หลาย

- คูณ

- ต้อง

- ชื่อ

- โดยธรรมชาติ

- การเดินเรือ

- จำเป็นต้อง

- จำเป็น

- ความต้องการ

- เครือข่าย

- เครือข่ายประสาทเทียม

- ใหม่

- ถัดไป

- ไม่

- ปม

- โหนด

- สมุดบันทึก

- จำนวน

- วัตถุ

- วัตถุประสงค์

- สังเกต

- of

- ปิด

- เป็นทางการ

- มักจะ

- on

- ตามความต้องการ

- ครั้งเดียว

- ONE

- เพียง

- การเปิด

- ทำงาน

- การดำเนินงาน

- ดีที่สุด

- การเพิ่มประสิทธิภาพ

- เพิ่มประสิทธิภาพ

- การเพิ่มประสิทธิภาพ

- or

- ใบสั่ง

- ของเรา

- ออก

- เกิน

- ทั้งหมด

- ของตนเอง

- หมีแพนด้า

- บานหน้าต่าง

- Parallel

- พารามิเตอร์

- พารามิเตอร์

- ส่ง

- ต่อ

- การปฏิบัติ

- สถานที่

- เพลโต

- เพลโตดาต้าอินเทลลิเจนซ์

- เพลโตดาต้า

- จุด

- จุด

- น่าสงสาร

- ความเป็นไปได้

- อาจ

- โพสต์

- การปฏิบัติ

- การจัดเตรียม

- เตรียมการ

- ป้องกัน

- ปัญหา

- กระบวนการ

- การประมวลผล

- โปรเซสเซอร์

- ความคืบหน้า

- เสนอ

- ให้

- ให้

- ให้

- สุ่ม

- อัตราส่วน

- ถึง

- อ่าน

- เหตุผล

- เมื่อเร็ว ๆ นี้

- แนะนำ

- ลด

- ลดลง

- ลด

- ลด

- ความนับถือ

- นิพจน์ทั่วไป

- ตรงประเด็น

- ทำซ้ำ

- ต้องการ

- ต้อง

- นักวิจัย

- ทรัพยากร

- แหล่งข้อมูล

- ผล

- ผลสอบ

- รับคืน

- ทบทวน

- รอบ

- แถว

- วิ่ง

- วิ่ง

- sagemaker

- การปรับโมเดลอัตโนมัติของ SageMaker

- เดียวกัน

- ลด

- เห็น

- พูดว่า

- SC

- ขนาด

- ตาชั่ง

- ปรับ

- SDK

- ค้นหา

- Section

- เห็น

- เมล็ดพันธุ์

- เห็น

- การเลือก

- เซิร์ฟเวอร์

- บริการ

- บริการ

- ชุด

- การตั้งค่า

- การตั้งค่า

- การติดตั้ง

- เจ็ด

- คม

- น่า

- โชว์

- แสดง

- แสดงให้เห็นว่า

- ปิดตัวลง

- สำคัญ

- อย่างมีความหมาย

- ง่าย

- เดียว

- ขนาด

- So

- แก้

- บาง

- แหล่ง

- รหัสแหล่งที่มา

- ช่องว่าง

- ผู้เชี่ยวชาญ

- โดยเฉพาะ

- ความเร็ว

- แยก

- แยก

- จุด

- เริ่มต้น

- ที่เริ่มต้น

- การเริ่มต้น

- Status

- ขั้นตอน

- ขั้นตอน

- หยุด

- การหยุด

- หยุด

- การเก็บรักษา

- กลยุทธ์

- อย่างเช่น

- ได้รับความเดือดร้อน

- สรุป

- สนับสนุน

- รองรับ

- ตาราง

- นำ

- ใช้เวลา

- วิชาการ

- เทคนิค

- tensorflow

- ระยะ

- เงื่อนไขการใช้บริการ

- กว่า

- ที่

- พื้นที่

- ที่มา

- ของพวกเขา

- พวกเขา

- แล้วก็

- ที่นั่น

- ดังนั้น

- ดังนั้น

- ล้อยางขัดเหล่านี้ติดตั้งบนแกน XNUMX (มม.) ผลิตภัณฑ์นี้ถูกผลิตในหลายรูปทรง และหลากหลายเบอร์ความแน่นหนาของปริมาณอนุภาคขัดของมัน จะทำให้ท่านได้รับประสิทธิภาพสูงในการขัดและการใช้งานที่ยาวนาน

- พวกเขา

- นี้

- เหล่านั้น

- สาม

- ตลอด

- เวลา

- ครั้ง

- ไปยัง

- เอา

- รวม

- การจราจร

- รถไฟ

- ผ่านการฝึกอบรม

- การฝึกอบรม

- การถ่ายโอน

- ต้นไม้

- ลอง

- สองครั้ง

- สอง

- ชนิด

- ตามแบบฉบับ

- ภายใต้

- ความเข้าใจ

- ไม่แน่

- ไม่จำเป็น

- ให้กับคุณ

- การปรับปรุง

- การปรับปรุง

- us

- ใช้

- มือสอง

- ใช้

- การใช้

- นำไปใช้

- การตรวจสอบ

- ความคุ้มค่า

- ความคุ้มค่า

- การสร้างภาพ

- vs

- ต้องการ

- คือ

- ทาง..

- we

- เว็บ

- บริการเว็บ

- น้ำหนัก

- ไป

- เมื่อ

- แต่ทว่า

- ที่

- ทำไม

- วิกิพีเดีย

- จะ

- กับ

- ภายใน

- ไม่มี

- แรงงาน

- โรงงาน

- แย่ลง

- จะ

- XGBoost

- ปี

- คุณ

- ของคุณ

- ลมทะเล