Amazon SageMaker Training Managed Warm Pools ช่วยให้คุณมีความยืดหยุ่นในการเลือกใช้งานซ้ำและคงไว้ซึ่งโครงสร้างพื้นฐานพื้นฐานตามระยะเวลาที่ผู้ใช้กำหนด การดำเนินการนี้ทำได้ในขณะเดียวกันก็รักษาประโยชน์ของการส่งผ่านการจัดการอินสแตนซ์การประมวลผลจำนวนมากที่ไม่แตกต่างไปยัง การฝึกอบรมโมเดล Amazon SageMaker. ในโพสต์นี้ เราสรุปประโยชน์หลักและประเด็นปัญหาที่ SageMaker Training Managed Warm Pools กล่าวถึง ตลอดจนเกณฑ์มาตรฐานและแนวทางปฏิบัติที่ดีที่สุด

ภาพรวมของ SageMaker Training Managed Warm Pools

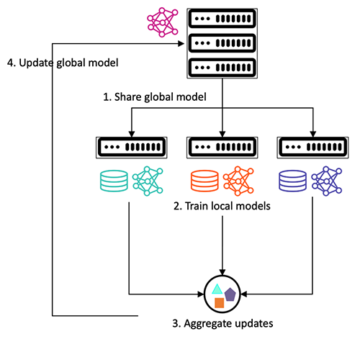

SageMaker Model Training เป็นความสามารถที่ได้รับการจัดการอย่างเต็มรูปแบบ ซึ่งจะหมุนอินสแตนซ์สำหรับทุกงาน ฝึกโมเดล รันและแยกอินสแตนซ์หลังจากจบงาน คุณจะถูกเรียกเก็บเงินสำหรับระยะเวลาของงานจนถึงวินาทีเท่านั้น ความสามารถที่มีการจัดการเต็มรูปแบบนี้ให้อิสระแก่คุณในการมุ่งเน้นไปที่อัลกอริทึมการเรียนรู้ของเครื่อง (ML) และไม่ต้องกังวลกับการยกของหนักที่ไม่แตกต่าง เช่น การจัดการโครงสร้างพื้นฐาน ในขณะที่ฝึกอบรมโมเดลของคุณ

กลไกนี้จำเป็นต้องมีเวลาเริ่มต้นที่จำกัดสำหรับงานฝึกอบรม แม้ว่าเวลาเริ่มต้นนี้หรือที่เรียกว่า เวลาเริ่มต้นเย็นเริ่มต้นค่อนข้างต่ำ กรณีใช้งานของลูกค้าที่ต้องการมากที่สุดบางกรณีต้องการเวลาเริ่มต้นที่ต่ำกว่า เช่น ต่ำกว่า 20 วินาที มีสองกรณีการใช้งานที่โดดเด่นซึ่งมีข้อกำหนดเหล่านี้:

- อย่างแรกคือการทดลอง ML ที่ใช้งานอยู่โดยนักวิทยาศาสตร์ข้อมูลโดยใช้ อเมซอน SageMaker แพลตฟอร์มการฝึกอบรม โดยเฉพาะอย่างยิ่งในขณะที่ฝึกอบรมโมเดลขนาดใหญ่ เช่น GPT3 ที่ต้องมีการวนซ้ำหลายครั้งเพื่อให้เข้าสู่สถานะพร้อมสำหรับการผลิตจริง

- ประการที่สองคือการเปิดตัวแบบเป็นโปรแกรมของงานต่อเนื่องจำนวนมาก (ตามลำดับหลายร้อยหรือหลายพันงาน) ในอินสแตนซ์ประเภทเดียวกันตามจังหวะที่กำหนด ตัวอย่างเช่น การค้นหาพารามิเตอร์หรือการฝึกอบรมเพิ่มเติม

สำหรับกรณีการใช้งานดังกล่าว ทุกวินาทีที่ใช้ไปกับค่าโสหุ้ย เช่น เวลาเริ่มต้นสำหรับงานฝึกอบรม จะมีผลสะสมต่องานเหล่านี้ทั้งหมด

ด้วย SageMaker Training Managed Warm Pools นักวิทยาศาสตร์ข้อมูลและวิศวกร ML มีความสามารถในการเลือกใช้เพื่อให้อินสแตนซ์การฝึกอบรมของ SageMaker หรือคลัสเตอร์หลายอินสแตนซ์อบอุ่นเป็นเวลาที่กำหนดไว้ล่วงหน้าและกำหนดค่าใหม่ได้ (keep_alive_period_in_seconds) หลังจากงานฝึกอบรมแต่ละครั้งเสร็จสิ้น ดังนั้น แม้ว่าคุณจะต้องเสียค่าปรับในการเริ่มเย็นสำหรับงานฝึกอบรมครั้งแรกที่เรียกใช้บนอินสแตนซ์หรือคลัสเตอร์ แต่สำหรับงานฝึกอบรมที่ตามมาทั้งหมด อินสแตนซ์ดังกล่าวจะพร้อมทำงานอยู่แล้ว เป็นผลให้งานการฝึกอบรมที่ตามมาเหล่านี้เริ่มต้นในอินสแตนซ์ก่อนหน้า keep_alive_period_in_seconds การหมดอายุไม่ต้องเสียค่าใช้จ่ายในการเริ่มต้นระบบแบบเย็น ซึ่งสามารถลดเวลาเริ่มต้นงานฝึกอบรมให้เหลือน้อยกว่า 20 วินาทีโดยประมาณ (P90)

นักวิทยาศาสตร์ด้านข้อมูลและวิศวกร ML สามารถใช้ SageMaker Training Managed Warm Pools เพื่อให้อินสแตนซ์เดี่ยวหรือหลายอินสแตนซ์อุ่นขึ้นระหว่างการรันการฝึกอบรมสำหรับการทดลอง หรือรันงานหลายงานติดต่อกันในคลัสเตอร์เดียวหรือหลายอินสแตนซ์เดียวกัน คุณจ่ายเฉพาะระยะเวลาของงานฝึกอบรมและการกำหนดค่าใหม่เท่านั้น keep_alive_period_in_seconds เช่นเดียวกับที่อื่น ๆ ที่คุณระบุสำหรับทุก ๆ อินสแตนซ์

โดยพื้นฐานแล้ว ด้วย SageMaker Training Managed Warm Pools คุณจะได้รับการผสมผสานระหว่างการใช้งานอินสแตนซ์ที่มีการจัดการของ SageMaker เข้ากับความสามารถในการเลือกใช้และจัดเตรียมความจุและการใช้งานที่จัดการด้วยตนเองในช่วงเวลาสั้นๆ ช่วงเวลาเหล่านี้สามารถกำหนดค่าได้ก่อนเริ่มงาน แต่ถ้าระหว่างนั้น keep_alive_period_in_seconds ช่วงไหนต้องลดหรือเพิ่มก็ทำได้ เพิ่มขึ้นเป็น keep_alive_period_in_seconds สามารถทำได้ในช่วงเวลาสูงสุด 60 นาที โดยมีระยะเวลาสูงสุดสำหรับอินสแตนซ์หรือคลัสเตอร์คือ 7 วัน

เริ่มต้นด้วยสระน้ำอุ่นก่อน ขอเพิ่มโควต้าสระว่ายน้ำอุ่นจากนั้นระบุไฟล์ keep_alive_period_in_seconds พารามิเตอร์ เมื่อเริ่มงานฝึกอบรม

มาตรฐาน

เราทำการทดสอบเปรียบเทียบเพื่อวัดเวลาแฝงในการเริ่มต้นงานโดยใช้อิมเมจ TensorFlow 1.34 GB, ข้อมูล 2 GB และโหมดป้อนข้อมูลการฝึกอบรมต่างๆ (Amazon FSx, Fast File Mode, File Mode) การทดสอบดำเนินการกับประเภทอินสแตนซ์ที่หลากหลายจากตระกูล m4, c4, m5 และ c5 ในภูมิภาค us-east-2 เวลาแฝงในการเริ่มต้นถูกวัดเป็นเวลาของการสร้างงานจนถึงการเริ่มต้นงานฝึกอบรมจริงบนอินสแตนซ์ งานแรกที่เริ่มต้นคลัสเตอร์และสร้างวอร์มพูลมีเวลาแฝงในการเริ่มต้น 2-3 นาที เวลาแฝงที่สูงขึ้นนี้เกิดจากเวลาที่ใช้ในการจัดเตรียมโครงสร้างพื้นฐาน ดาวน์โหลดอิมเมจ และดาวน์โหลดข้อมูล งานที่ตามมาซึ่งใช้คลัสเตอร์วอร์มพูลมีเวลาแฝงเริ่มต้นประมาณ 20 วินาทีสำหรับโหมดไฟล์ด่วน (FFM) หรือ Amazon FSx และ 70 วินาทีสำหรับโหมดไฟล์ (FM) เดลต้านี้เป็นผลมาจาก FM กำหนดให้ดาวน์โหลดชุดข้อมูลทั้งหมดจาก Amazon S3 ก่อนเริ่มงาน

โหมดการป้อนข้อมูลการฝึกที่คุณเลือกจะส่งผลต่อเวลาเริ่มต้น แม้แต่กับ Warm Pools คำแนะนำเกี่ยวกับโหมดการป้อนข้อมูลที่จะเลือกอยู่ในส่วนแนวทางปฏิบัติที่ดีที่สุดในภายหลังในโพสต์นี้

ตารางต่อไปนี้สรุปเวลาแฝงในการเริ่มต้นงาน P90 สำหรับโหมดป้อนข้อมูลการฝึกอบรมต่างๆ

| โหมดป้อนข้อมูล | เวลาแฝงในการเริ่มต้น P90 (วินาที) | |

| งานแรก | งานสระน้ำอุ่น (งานที่สองเป็นต้นไป) | |

| เอฟเอสเอ็กซ์ | 136 | 19 |

| โหมดไฟล์เร็ว | 143 | 21 |

| โหมดไฟล์ | 176 | 70 |

แนวทางปฏิบัติที่ดีที่สุดสำหรับการใช้สระน้ำอุ่น

ในส่วนต่อไปนี้ เราจะแบ่งปันแนวทางปฏิบัติที่ดีที่สุดเมื่อใช้สระน้ำอุ่น

เมื่อใดที่คุณควรใช้สระน้ำอุ่น

แนะนำให้ใช้สระน้ำอุ่นในสถานการณ์ต่อไปนี้:

- คุณกำลังทดลองและปรับแต่งสคริปต์แบบโต้ตอบกับชุดงานสั้นๆ

- คุณกำลังเรียกใช้การปรับให้เหมาะสมพารามิเตอร์ไฮเปอร์สเกลขนาดใหญ่ที่คุณกำหนดเอง (ตัวอย่างเช่น ไซน์ทูน).

- คุณมีกระบวนการแบบแบตช์ที่รันงานติดต่อกันจำนวนมาก (ตามลำดับหลายร้อยหรือหลายพัน) ในอินสแตนซ์ประเภทเดียวกันในจังหวะรายวันหรือรายสัปดาห์ ตัวอย่างเช่น การฝึกโมเดล ML ต่อเมือง

ไม่แนะนำให้ใช้สระน้ำอุ่นเมื่อไม่น่าจะมีใครนำสระน้ำอุ่นกลับมาใช้ซ้ำก่อนที่จะหมดอายุการใช้งาน ตัวอย่างเช่น งานเดียวที่มีความยาวซึ่งทำงานผ่านไปป์ไลน์ ML อัตโนมัติ

ลดเวลาแฝงในการเริ่มต้นงานการฝึกวอร์มพูลให้น้อยที่สุด

งานการฝึกอบรมที่ใช้สระน้ำอุ่นซ้ำเริ่มเร็วกว่างานแรกที่สร้างสระน้ำอุ่น นี่เป็นเพราะการทำให้อินสแตนซ์ ML ทำงานระหว่างงานด้วยอิมเมจ Docker ของคอนเทนเนอร์การฝึกอบรมที่แคชไว้เพื่อข้ามการดึงคอนเทนเนอร์จาก การลงทะเบียน Amazon Elastic Container (อีซีอาร์ของอเมซอน) อย่างไรก็ตาม แม้ว่าจะใช้วอร์มพูลซ้ำ ขั้นตอนการเริ่มต้นบางอย่างจะเกิดขึ้นกับงานทั้งหมด การเพิ่มประสิทธิภาพขั้นตอนเหล่านี้สามารถลดเวลาเริ่มต้นงานของคุณ (ทั้งงานแรกและงานที่ตามมา) พิจารณาสิ่งต่อไปนี้:

- โหมดป้อนข้อมูลการฝึกอบรมอาจส่งผลต่อเวลาเริ่มต้น – ช่องป้อนข้อมูลการฝึกอบรมที่ได้รับการจัดการจะถูกสร้างขึ้นใหม่สำหรับงานฝึกอบรมแต่ละงาน ซึ่งเอื้อต่อเวลาแฝงในการเริ่มต้นงาน ดังนั้น การทดลองเบื้องต้นกับชุดข้อมูลที่เล็กลงจะช่วยให้เวลาเริ่มต้นเร็วขึ้น (และเวลาฝึกเร็วขึ้น) สำหรับขั้นตอนต่อมาของการทดลอง เมื่อจำเป็นต้องใช้ชุดข้อมูลขนาดใหญ่ ให้พิจารณาใช้ประเภทโหมดอินพุตที่มีเวลาเริ่มต้นน้อยที่สุดหรือคงที่ ตัวอย่างเช่น โหมดอินพุต FILE จะคัดลอกชุดข้อมูลทั้งหมดจาก บริการจัดเก็บข้อมูลอย่างง่ายของ Amazon (Amazon S3) ไปยังอินสแตนซ์การฝึกอบรม ซึ่งใช้เวลานานสำหรับชุดข้อมูลขนาดใหญ่ (แม้ว่าจะมี warm pool) โหมดไฟล์เร็วเหมาะกว่าสำหรับเวลาแฝงในการเริ่มต้นที่ต่ำกว่า เนื่องจากต้องอ่านเฉพาะข้อมูลเมตาของออบเจกต์ S3 จาก Amazon S3 ก่อนปริมาณงานจึงจะสามารถเริ่มต้นได้ เดอะ Amazon FSx สำหรับความมันวาว,หรือ ระบบไฟล์ Amazon Elastic โหมดอินพุตระบบไฟล์ (Amazon EFS) มีเวลาเริ่มต้นคงที่โดยไม่คำนึงถึงจำนวนไฟล์ในระบบไฟล์ ซึ่งเป็นประโยชน์เมื่อทำงานกับชุดข้อมูลขนาดใหญ่

สำหรับข้อมูลเพิ่มเติมเกี่ยวกับวิธีเลือกช่องสัญญาณเข้า โปรดดูที่ เลือกแหล่งข้อมูลที่ดีที่สุดสำหรับงานฝึกอบรม Amazon SageMaker ของคุณ. - ลดการติดตั้งรันไทม์ของแพ็คเกจ – การติดตั้งซอฟต์แวร์ใดๆ ที่เกิดขึ้นระหว่างการเริ่มต้นคอนเทนเนอร์ เช่น pip ของ Python หรือระบบปฏิบัติการ apt-get จะเพิ่มเวลาแฝงของการฝึกอบรม การลดเวลาแฝงในการเริ่มต้นนี้ให้เหลือน้อยที่สุดจำเป็นต้องทำการแลกเปลี่ยนระหว่างความยืดหยุ่นและความเรียบง่ายของการติดตั้งรันไทม์กับการติดตั้งในเวลาสร้างคอนเทนเนอร์ หากคุณใช้คอนเทนเนอร์ Docker ของคุณเองกับ SageMaker โปรดดูที่ การปรับ Docker Container ของคุณเองเพื่อทำงานร่วมกับ SageMaker. หากคุณพึ่ง อิมเมจคอนเทนเนอร์ SageMaker ที่สร้างไว้ล่วงหน้าคุณจะต้อง ขยายคอนเทนเนอร์ที่สร้างไว้ล่วงหน้า และจัดการคอนเทนเนอร์เหล่านี้อย่างชัดเจน พิจารณาสิ่งนี้หากการติดตั้งรันไทม์ของคุณเพิ่มเวลาแฝงในการเริ่มต้นอย่างมาก

- หลีกเลี่ยงการอัพเดตอิมเมจ Docker ของคุณบ่อยๆ – หากคุณใช้คอนเทนเนอร์ Docker ของคุณเองกับ SageMaker ให้พยายามหลีกเลี่ยงการอัปเดตทุกงานที่รัน หากอิมเมจ Docker เปลี่ยนไประหว่างการส่งงาน วอร์มพูลจะถูกใช้ซ้ำ แต่กระบวนการเริ่มต้นจะต้องดึงอิมเมจคอนเทนเนอร์อีกครั้งจาก Amazon ECR แทนการใช้อิมเมจคอนเทนเนอร์ที่แคชซ้ำ หากต้องอัปเดตอิมเมจ Docker ให้จำกัดการอัปเดตไว้ที่เลเยอร์ Docker สุดท้ายเพื่อใช้ประโยชน์จากการแคชเลเยอร์ Docker ตามหลักการแล้ว คุณควรลบเนื้อหา Dockerfile ที่มีแนวโน้มว่าจะเปลี่ยนแปลงระหว่างการวนซ้ำ เช่น ไฮเปอร์พารามิเตอร์ คำจำกัดความชุดข้อมูล และตัวโค้ด ML หากต้องการทำซ้ำในโค้ด ML โดยไม่ต้องสร้างอิมเมจ Docker ใหม่เมื่อมีการเปลี่ยนแปลงแต่ละครั้ง คุณสามารถใช้กระบวนทัศน์เฟรมเวิร์กคอนเทนเนอร์ที่สนับสนุนใน SageMaker Training Toolkit หากคุณต้องการพัฒนาเฟรมเวิร์กคอนเทนเนอร์ด้วยโค้ดของคุณเอง โปรดดูที่นี่ บทช่วยสอนเกี่ยวกับ Amazon SageMaker.

แบ่งปันสระน้ำอุ่นระหว่างผู้ใช้หลายคน

เมื่อทำงานร่วมกับทีมนักวิทยาศาสตร์ข้อมูลจำนวนมาก คุณสามารถแบ่งปันน้ำอุ่นที่มี ตรงกับเกณฑ์งานเช่นเดียวกันกับ AWS Identity และการจัดการการเข้าถึง (IAM) บทบาทหรืออิมเมจคอนเทนเนอร์

ลองดูตัวอย่างไทม์ไลน์ ผู้ใช้-1 เริ่มงานการฝึกอบรมที่เสร็จสิ้นและส่งผลให้มีการสร้างสระน้ำอุ่นใหม่ เมื่อผู้ใช้-2 เริ่มงานฝึกอบรม งานจะนำ warm pool ที่มีอยู่กลับมาใช้ใหม่ ทำให้เริ่มงานได้อย่างรวดเร็ว ขณะที่งานของ user-2 กำลังรันโดยมีการใช้ warm pool หากผู้ใช้รายอื่นเริ่มงานการฝึกอบรม warm pool ที่สองจะถูกสร้างขึ้น

ลักษณะการใช้ซ้ำนี้ช่วยลดค่าใช้จ่ายโดยการแชร์ warm pool ระหว่างผู้ใช้ที่เริ่มงานที่คล้ายกัน หากคุณต้องการหลีกเลี่ยงการแชร์ warm pool ระหว่างผู้ใช้ งานของผู้ใช้จะต้องไม่มี ตรงกับเกณฑ์งาน (เช่น พวกเขาต้องใช้บทบาท IAM อื่น)

แจ้งเตือนผู้ใช้เมื่องานเสร็จสิ้น

เมื่อใช้สระอุ่นสำหรับการทดลอง เราขอแนะนำให้แจ้งผู้ใช้เมื่องานเสร็จสิ้น สิ่งนี้ทำให้ผู้ใช้สามารถทำการทดลองต่อได้ก่อนที่สระน้ำอุ่นจะหมดอายุหรือ หยุด สระน้ำอุ่นหากไม่ต้องการอีกต่อไป นอกจากนี้คุณยังสามารถ เรียกการแจ้งเตือนโดยอัตโนมัติ ตลอด อเมซอน EventBridge.

เครื่องมือเพิ่มเติมสำหรับการทดลองที่รวดเร็วและงานฝึกอบรมการแก้ปัญหา

ด้วยสระน้ำอุ่น คุณสามารถเริ่มงานได้ในเวลาน้อยกว่า 20 วินาที บางสถานการณ์จำเป็นต้องมีการทดลองเชิงโต้ตอบและการแก้ไขปัญหาแบบเรียลไทม์ โอเพ่นซอร์ส ไลบรารี SageMaker SSH Helper ช่วยให้คุณสามารถบรรจุลงในคอนเทนเนอร์การฝึกอบรมของ SageMaker และดำเนินการพัฒนาและแก้ไขจุดบกพร่องจากระยะไกล

สรุป

ด้วย SageMaker Training Managed Warm Pools คุณสามารถทำให้อินสแตนซ์ฮาร์ดแวร์การฝึกอบรมโมเดลของคุณอบอุ่นหลังจากงานทุกครั้งตามระยะเวลาที่กำหนด สิ่งนี้สามารถลดเวลาแฝงเริ่มต้นสำหรับงานฝึกอบรมแบบจำลองได้ถึง 8 เท่า SageMaker Training Managed Warm Pools มีให้บริการในภูมิภาค AWS สาธารณะทั้งหมดที่มี SageMaker Model Training ให้บริการ

ในการเริ่มต้นดู ฝึกฝนโดยใช้ SageMaker Managed Warm Pools.

เกี่ยวกับผู้แต่ง

ดร.รมย์ ทัฏฐ์ เป็นผู้จัดการอาวุโสด้านการจัดการผลิตภัณฑ์ในทีม Amazon SageMaker ที่รับผิดชอบด้านการฝึกอบรม การประมวลผล และการจัดเก็บคุณสมบัติ เขาทำงานใน AWS มานานกว่า 4 ปี โดยดำรงตำแหน่งผู้นำด้านการจัดการผลิตภัณฑ์หลายตำแหน่งใน SageMaker, S3 และ IoT ก่อนหน้าที่ AWS เขาทำงานในตำแหน่งต่างๆ ในการจัดการผลิตภัณฑ์ วิศวกรรม และความเป็นผู้นำด้านการปฏิบัติงานที่ IBM, Texas Instruments และ Nvidia เขามีปริญญาโทและปริญญาเอก สาขาวิศวกรรมไฟฟ้าและคอมพิวเตอร์จาก University of Texas at Austin และ MBA จาก University of Chicago Booth School of Business

ดร.รมย์ ทัฏฐ์ เป็นผู้จัดการอาวุโสด้านการจัดการผลิตภัณฑ์ในทีม Amazon SageMaker ที่รับผิดชอบด้านการฝึกอบรม การประมวลผล และการจัดเก็บคุณสมบัติ เขาทำงานใน AWS มานานกว่า 4 ปี โดยดำรงตำแหน่งผู้นำด้านการจัดการผลิตภัณฑ์หลายตำแหน่งใน SageMaker, S3 และ IoT ก่อนหน้าที่ AWS เขาทำงานในตำแหน่งต่างๆ ในการจัดการผลิตภัณฑ์ วิศวกรรม และความเป็นผู้นำด้านการปฏิบัติงานที่ IBM, Texas Instruments และ Nvidia เขามีปริญญาโทและปริญญาเอก สาขาวิศวกรรมไฟฟ้าและคอมพิวเตอร์จาก University of Texas at Austin และ MBA จาก University of Chicago Booth School of Business

อรุณปติฌาน เป็นวิศวกรหลักกับทีม Amazon SageMaker โดยมุ่งเน้นที่การฝึกอบรมและ MLOps เขาอยู่กับทีม SageMaker มาตั้งแต่ปีที่เปิดตัว และสนุกกับการมีส่วนร่วมในด้านต่างๆ ใน SageMaker รวมถึงการอนุมานแบบเรียลไทม์และผลิตภัณฑ์ Model Monitor เขาชอบสำรวจพื้นที่กลางแจ้งในเขตแปซิฟิกตะวันตกเฉียงเหนือและปีนเขา

อรุณปติฌาน เป็นวิศวกรหลักกับทีม Amazon SageMaker โดยมุ่งเน้นที่การฝึกอบรมและ MLOps เขาอยู่กับทีม SageMaker มาตั้งแต่ปีที่เปิดตัว และสนุกกับการมีส่วนร่วมในด้านต่างๆ ใน SageMaker รวมถึงการอนุมานแบบเรียลไทม์และผลิตภัณฑ์ Model Monitor เขาชอบสำรวจพื้นที่กลางแจ้งในเขตแปซิฟิกตะวันตกเฉียงเหนือและปีนเขา

คุณเอมี่ เป็นผู้จัดการฝ่ายพัฒนาซอฟต์แวร์ที่ AWS SageMaker เธอมุ่งเน้นไปที่การรวบรวมทีมวิศวกรซอฟต์แวร์เพื่อสร้าง บำรุงรักษา และพัฒนาความสามารถใหม่ของแพลตฟอร์มการฝึกอบรม SageMaker ที่ช่วยให้ลูกค้าฝึกอบรมโมเดล ML ได้อย่างมีประสิทธิภาพและง่ายดายยิ่งขึ้น เธอมีความหลงใหลในเทคโนโลยี ML และ AI โดยเฉพาะอย่างยิ่งที่เกี่ยวข้องกับภาพลักษณ์และวิสัยทัศน์จากการศึกษาระดับบัณฑิตศึกษาของเธอ ในเวลาว่างเธอชอบทำงานดนตรีและศิลปะกับครอบครัว

คุณเอมี่ เป็นผู้จัดการฝ่ายพัฒนาซอฟต์แวร์ที่ AWS SageMaker เธอมุ่งเน้นไปที่การรวบรวมทีมวิศวกรซอฟต์แวร์เพื่อสร้าง บำรุงรักษา และพัฒนาความสามารถใหม่ของแพลตฟอร์มการฝึกอบรม SageMaker ที่ช่วยให้ลูกค้าฝึกอบรมโมเดล ML ได้อย่างมีประสิทธิภาพและง่ายดายยิ่งขึ้น เธอมีความหลงใหลในเทคโนโลยี ML และ AI โดยเฉพาะอย่างยิ่งที่เกี่ยวข้องกับภาพลักษณ์และวิสัยทัศน์จากการศึกษาระดับบัณฑิตศึกษาของเธอ ในเวลาว่างเธอชอบทำงานดนตรีและศิลปะกับครอบครัว

สีเฟย หลี่ เป็นวิศวกรซอฟต์แวร์ใน Amazon AI ซึ่งเธอทำงานเกี่ยวกับการสร้างแพลตฟอร์มการเรียนรู้ของเครื่องของ Amazon และเป็นส่วนหนึ่งของทีมเปิดตัวสำหรับ Amazon SageMaker เวลาว่างเธอชอบเล่นดนตรีและอ่านหนังสือ

สีเฟย หลี่ เป็นวิศวกรซอฟต์แวร์ใน Amazon AI ซึ่งเธอทำงานเกี่ยวกับการสร้างแพลตฟอร์มการเรียนรู้ของเครื่องของ Amazon และเป็นส่วนหนึ่งของทีมเปิดตัวสำหรับ Amazon SageMaker เวลาว่างเธอชอบเล่นดนตรีและอ่านหนังสือ

เจนน่า จ่าว เป็นวิศวกรพัฒนาซอฟต์แวร์ที่ AWS SageMaker เธอหลงใหลเกี่ยวกับเทคโนโลยี ML/AI และมุ่งเน้นไปที่การสร้างแพลตฟอร์มการฝึกอบรม SageMaker ที่ช่วยให้ลูกค้าสามารถฝึกอบรมโมเดลแมชชีนเลิร์นนิงได้อย่างรวดเร็วและง่ายดาย นอกเวลางาน เธอชอบท่องเที่ยวและใช้เวลากับครอบครัว

เจนน่า จ่าว เป็นวิศวกรพัฒนาซอฟต์แวร์ที่ AWS SageMaker เธอหลงใหลเกี่ยวกับเทคโนโลยี ML/AI และมุ่งเน้นไปที่การสร้างแพลตฟอร์มการฝึกอบรม SageMaker ที่ช่วยให้ลูกค้าสามารถฝึกอบรมโมเดลแมชชีนเลิร์นนิงได้อย่างรวดเร็วและง่ายดาย นอกเวลางาน เธอชอบท่องเที่ยวและใช้เวลากับครอบครัว

พาราส เมห์รา เป็นผู้จัดการผลิตภัณฑ์อาวุโสของ AWS เขามุ่งเน้นที่การช่วยสร้างการฝึกอบรมและการประมวลผลของ Amazon SageMaker ในเวลาว่าง Paras ชอบใช้เวลากับครอบครัวและขี่จักรยานไปตามถนนรอบๆ Bay Area คุณสามารถพบเขาได้ที่ LinkedIn.

พาราส เมห์รา เป็นผู้จัดการผลิตภัณฑ์อาวุโสของ AWS เขามุ่งเน้นที่การช่วยสร้างการฝึกอบรมและการประมวลผลของ Amazon SageMaker ในเวลาว่าง Paras ชอบใช้เวลากับครอบครัวและขี่จักรยานไปตามถนนรอบๆ Bay Area คุณสามารถพบเขาได้ที่ LinkedIn.

กิลี นาชุม เป็นสถาปนิกอาวุโสด้านโซลูชัน AI/ML Specialist Solutions ซึ่งทำงานเป็นส่วนหนึ่งของทีม EMEA Amazon Machine Learning Gili หลงใหลเกี่ยวกับความท้าทายในการฝึกโมเดลการเรียนรู้เชิงลึก และการเรียนรู้ของเครื่องกำลังเปลี่ยนแปลงโลกอย่างที่เรารู้ๆ กันอย่างไร ในเวลาว่าง Gili สนุกกับการเล่นปิงปอง

กิลี นาชุม เป็นสถาปนิกอาวุโสด้านโซลูชัน AI/ML Specialist Solutions ซึ่งทำงานเป็นส่วนหนึ่งของทีม EMEA Amazon Machine Learning Gili หลงใหลเกี่ยวกับความท้าทายในการฝึกโมเดลการเรียนรู้เชิงลึก และการเรียนรู้ของเครื่องกำลังเปลี่ยนแปลงโลกอย่างที่เรารู้ๆ กันอย่างไร ในเวลาว่าง Gili สนุกกับการเล่นปิงปอง

โอลิวิเยร์ ครูแชนท์ เป็นสถาปนิกโซลูชัน Machine Learning Specialist Solutions ที่ AWS ซึ่งตั้งอยู่ในฝรั่งเศส Olivier ช่วยลูกค้า AWS ตั้งแต่สตาร์ทอัพขนาดเล็กไปจนถึงองค์กรขนาดใหญ่ พัฒนาและปรับใช้แอปพลิเคชันแมชชีนเลิร์นนิงระดับการผลิต ในเวลาว่าง เขาชอบอ่านงานวิจัยและสำรวจพื้นที่รกร้างว่างเปล่ากับเพื่อนๆ และครอบครัว

โอลิวิเยร์ ครูแชนท์ เป็นสถาปนิกโซลูชัน Machine Learning Specialist Solutions ที่ AWS ซึ่งตั้งอยู่ในฝรั่งเศส Olivier ช่วยลูกค้า AWS ตั้งแต่สตาร์ทอัพขนาดเล็กไปจนถึงองค์กรขนาดใหญ่ พัฒนาและปรับใช้แอปพลิเคชันแมชชีนเลิร์นนิงระดับการผลิต ในเวลาว่าง เขาชอบอ่านงานวิจัยและสำรวจพื้นที่รกร้างว่างเปล่ากับเพื่อนๆ และครอบครัว

เอมิลี่ เว็บเบอร์ เข้าร่วม AWS หลังจากเปิดตัว SageMaker และพยายามบอกให้โลกรู้ตั้งแต่นั้นมา! นอกเหนือจากการสร้างประสบการณ์ ML ใหม่ให้กับลูกค้าแล้ว เอมิลี่ชอบนั่งสมาธิและศึกษาพุทธศาสนาในทิเบต

เอมิลี่ เว็บเบอร์ เข้าร่วม AWS หลังจากเปิดตัว SageMaker และพยายามบอกให้โลกรู้ตั้งแต่นั้นมา! นอกเหนือจากการสร้างประสบการณ์ ML ใหม่ให้กับลูกค้าแล้ว เอมิลี่ชอบนั่งสมาธิและศึกษาพุทธศาสนาในทิเบต

- AI

- ไอ อาร์ต

- เครื่องกำเนิดไออาร์ท

- หุ่นยนต์ไอ

- อเมซอน SageMaker

- ปัญญาประดิษฐ์

- ใบรับรองปัญญาประดิษฐ์

- ปัญญาประดิษฐ์ในการธนาคาร

- หุ่นยนต์ปัญญาประดิษฐ์

- หุ่นยนต์ปัญญาประดิษฐ์

- ซอฟต์แวร์ปัญญาประดิษฐ์

- AWS Machine Learning AWS

- blockchain

- การประชุม blockchain ai

- เหรียญอัจฉริยะ

- ปัญญาประดิษฐ์สนทนา

- การประชุม crypto ai

- ดัล-อี

- การเรียนรู้ลึก ๆ

- google ai

- ระดับกลาง (200)

- เรียนรู้เครื่อง

- เพลโต

- เพลโตไอ

- เพลโตดาต้าอินเทลลิเจนซ์

- เกมเพลโต

- เพลโตดาต้า

- เพลโตเกม

- ขนาดไอ

- วากยสัมพันธ์

- ลมทะเล