โพสต์รับเชิญนี้เขียนโดย Vihan Lakshman, Tharun Medini และ Anshumali Shrivastava จาก ThirdAI

เมื่อเร็วๆ นี้ การเรียนรู้เชิงลึกขนาดใหญ่ได้ก่อให้เกิดความก้าวหน้าในการปฏิวัติในสาขาต่างๆ มากมาย แม้ว่าความก้าวหน้าที่น่าทึ่งในปัญญาประดิษฐ์จะยังคงน่าทึ่ง แต่ต้นทุนทางการเงินและการใช้พลังงานที่จำเป็นในการฝึกอบรมโมเดลเหล่านี้กลับกลายเป็นปัญหาคอขวดที่สำคัญเนื่องจากความต้องการฮาร์ดแวร์เฉพาะทาง เช่น GPU ตามเนื้อผ้า แม้แต่แบบจำลองประสาทที่มีขนาดพอเหมาะก็จำเป็นต้องใช้ตัวเร่งฮาร์ดแวร์ที่มีราคาแพงสำหรับการฝึกอบรม ซึ่งจำกัดจำนวนองค์กรที่มีเงินทุนเพื่อใช้ประโยชน์จากเทคโนโลยีนี้อย่างเต็มที่

ThirdAI Corp. ก่อตั้งขึ้นในปี 2021 เป็นสตาร์ทอัพที่อุทิศให้กับภารกิจในการทำให้เทคโนโลยีปัญญาประดิษฐ์เป็นประชาธิปไตยผ่านนวัตกรรมอัลกอริธึมและซอฟต์แวร์ที่เปลี่ยนแปลงพื้นฐานเศรษฐศาสตร์ของการเรียนรู้เชิงลึก เราได้พัฒนากลไกการเรียนรู้เชิงลึกแบบกระจัดกระจายที่เรียกว่า BOLTซึ่งได้รับการออกแบบมาเป็นพิเศษสำหรับการฝึกและการปรับใช้โมเดลบนฮาร์ดแวร์ CPU มาตรฐาน ตรงข้ามกับตัวเร่งความเร็วที่มีราคาแพงและใช้พลังงานมาก เช่น GPU ลูกค้าหลายรายของเราก็มี รายงานความพึงพอใจอย่างมาก ด้วยความสามารถของ ThirdAI ในการฝึกอบรมและปรับใช้โมเดลการเรียนรู้เชิงลึกสำหรับปัญหาทางธุรกิจที่สำคัญบนโครงสร้างพื้นฐาน CPU ที่คุ้มค่า

ในโพสต์นี้ เราจะตรวจสอบศักยภาพของโปรเซสเซอร์ AWS Graviton3 เพื่อเร่งการฝึกอบรมโครงข่ายประสาทเทียมสำหรับกลไกการเรียนรู้เชิงลึกที่ใช้ CPU ที่เป็นเอกลักษณ์ของ ThirdAI

ข้อดีของ CPU ประสิทธิภาพสูง

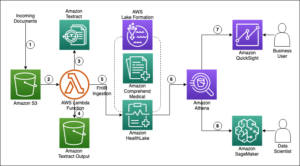

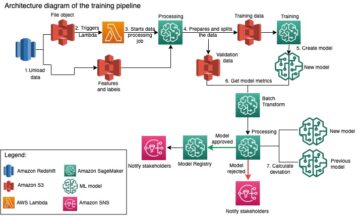

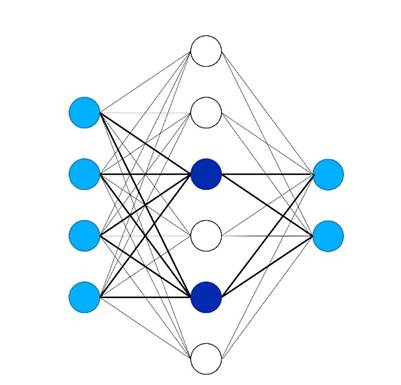

ที่ ThirdAI เราบรรลุความก้าวหน้าเหล่านี้ในการฝึกอบรมโครงข่ายประสาทเทียมที่มีประสิทธิภาพบน CPU ผ่านอัลกอริธึมไดนามิกแบบกระจัดกระจายที่เป็นกรรมสิทธิ์ ซึ่งจะเปิดใช้งานเฉพาะชุดย่อยของเซลล์ประสาทสำหรับอินพุตที่กำหนด (ดูรูปต่อไปนี้) ดังนั้นจึงก้าวข้ามความจำเป็นในการคำนวณหนาแน่นเต็มรูปแบบ ThirdAI ใช้ไม่เหมือนกับวิธีอื่นๆ ในการฝึกอบรมโครงข่ายประสาทเทียมแบบกระจาย การแฮชแบบไวต่อพื้นที่ เพื่อเลือกเซลล์ประสาทแบบไดนามิกสำหรับอินพุตที่กำหนดดังที่แสดงในเส้นหนาด้านล่าง ในบางกรณีเรายังสังเกตเห็นด้วยซ้ำว่าของเรา รุ่นที่ใช้ CPU เบาบาง ฝึกได้เร็วกว่าสถาปัตยกรรมหนาแน่นที่เทียบเคียงได้บน GPU

เนื่องจากลูกค้าเป้าหมายจำนวนมากของเราทำงานบนคลาวด์ และในบรรดาลูกค้าเหล่านั้น ส่วนใหญ่ใช้ AWS เราจึงรู้สึกตื่นเต้นที่จะลองใช้โปรเซสเซอร์ AWS Graviton3 เพื่อดูว่าการปรับปรุงประสิทธิภาพด้านราคาที่น่าประทับใจของนวัตกรรมซิลิคอนของ Amazon จะแปลเป็นปริมาณงานเฉพาะของเราหรือไม่ ของการฝึกอบรมโครงข่ายประสาทเทียมแบบกระจัดกระจาย และช่วยประหยัดค่าใช้จ่ายเพิ่มเติมให้กับลูกค้า แม้ว่าทั้งชุมชนการวิจัยและทีม AWS Graviton จะนำเสนอความก้าวหน้าที่น่าตื่นเต้นในการเร่งความเร็ว การอนุมานโครงข่ายประสาทเทียม บนอินสแตนซ์ของ CPU พวกเราที่ ThirdAI มีความรู้เป็นคนแรกในการศึกษาอย่างจริงจังเกี่ยวกับวิธีฝึกโมเดลระบบประสาทบน CPU อย่างมีประสิทธิภาพ

ดังที่แสดงในผลลัพธ์ของเรา เราสังเกตเห็นการเร่งความเร็วอย่างมีนัยสำคัญด้วย AWS Graviton3 เหนืออินสแตนซ์ Intel และ NVIDIA ที่เทียบเคียงได้บนปริมาณงานการสร้างแบบจำลองตัวแทนหลายรายการ

ประเภทอินสแตนซ์

สำหรับการประเมินของเรา เราได้พิจารณาอินสแตนซ์ AWS CPU ที่เปรียบเทียบกันได้สองอินสแตนซ์ ได้แก่ เครื่อง c6i.8xlarge ที่ขับเคลื่อนโดยโปรเซสเซอร์ Ice Lake ของ Intel และ c7g.8xlarge ที่ขับเคลื่อนโดย AWS Graviton3 ตารางต่อไปนี้สรุปรายละเอียดของแต่ละอินสแตนซ์

| ตัวอย่าง | ซีพียู | RAM (GB) | หน่วยประมวลผล | ราคาตามความต้องการ (us-east-1) |

| c7g.8xlarge | 32 | 64 | AWS Graviton3 | $ 1.1562 / ชม |

| c6i.8xlarge | 32 | 64 | Intel Ice Lake | $ 1.36 / ชม |

| g5g.8xlarge (จีพียู) | 32 | 64 พร้อมหน่วยความจำ GPU 16 GB | โปรเซสเซอร์ AWS Graviton2 พร้อม GPU NVIDIA T1G 4 ตัว | $ 1.3720 / ชม |

การประเมินที่ 1: การจำแนกประเภทที่รุนแรง

สำหรับการประเมินครั้งแรก เรามุ่งเน้นไปที่ปัญหาของการจำแนกประเภทหลายป้ายกำกับ (XMC) ที่รุนแรง ซึ่งเป็นกระบวนทัศน์การเรียนรู้ของเครื่อง (ML) ที่ได้รับความนิยมมากขึ้นเรื่อยๆ พร้อมการใช้งานจริงจำนวนมากในการค้นหาและคำแนะนำ (รวมถึงที่ อเมซอน). สำหรับการประเมินของเรา เรามุ่งเน้นไปที่สาธารณะ งานแนะนำสินค้า Amazon-670Kซึ่งเมื่อพิจารณาจากผลิตภัณฑ์อินพุต จะระบุผลิตภัณฑ์ที่คล้ายคลึงกันจากคอลเลกชันมากกว่า 670,000 รายการ

ในการทดลองนี้ เราได้เปรียบเทียบกลไก BOLT ของ ThirdAI กับ TensorFlow 2.11 และ PyTorch 2.0 บนตัวเลือกฮาร์ดแวร์ที่กล่าวมาข้างต้น: Intel Ice Lake, AWS Graviton3 และ NVIDIA T4G GPU สำหรับการทดลองของเรากับ Intel และ AWS Graviton เราใช้ AWS Deep Learning AMI (Ubuntu 18.04) เวอร์ชัน 59.0 สำหรับการประเมิน GPU ของเรา เราใช้ NVIDIA GPU-Optimized Arm64 AMIพร้อมให้บริการผ่าน AWS Marketplace สำหรับการประเมินนี้ เราใช้ สถาปัตยกรรมโมเดลสไลด์ซึ่งบรรลุทั้งประสิทธิภาพการแข่งขันในงานจำแนกประเภทที่รุนแรงนี้และประสิทธิภาพการฝึกอบรมที่แข็งแกร่งบน CPU สำหรับการเปรียบเทียบ TensorFlow และ PyTorch เราใช้สถาปัตยกรรม SLIDE multi-layer perceptron (MLP) เวอร์ชันอะนาล็อกที่มีการคูณเมทริกซ์หนาแน่น เราฝึกอบรมแต่ละโมเดลเป็นเวลาห้ายุค (ผ่านชุดข้อมูลการฝึกอบรมทั้งหมด) ด้วยขนาดแบตช์คงที่ 256 และอัตราการเรียนรู้ 0.001 เราสังเกตว่าทุกรุ่นมีความแม่นยำในการทดสอบเท่ากันที่ 33.6%

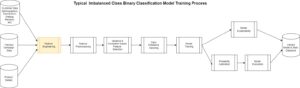

แผนภูมิต่อไปนี้เปรียบเทียบเวลาการฝึกอบรมของ BOLT ของ ThirdAI กับ TensorFlow 2.11 และ PyTorch 2.0 บนเกณฑ์มาตรฐานการจัดประเภทที่รุนแรงของ Amazon670k ทุกรุ่นมีความแม่นยำในการทดสอบเท่ากัน เราสังเกตเห็นว่า AWS Graviton3 ช่วยเร่งความเร็วประสิทธิภาพของ BOLT ได้มากตั้งแต่เริ่มใช้งานโดยไม่จำเป็นต้องปรับแต่งใดๆ ประมาณ 40% BOLT ของ ThirdAI บน AWS Graviton3 ยังได้รับการฝึกฝนที่เร็วกว่าโมเดล TensorFlow หรือ PyTorch ที่ได้รับการฝึกฝนบน GPU อย่างมาก โปรดทราบว่าไม่มีผลลัพธ์ ThirdAI ในเกณฑ์มาตรฐาน NVIDIA GPU เนื่องจาก BOLT ได้รับการออกแบบมาให้ทำงานบน CPU เราไม่ได้รวมเกณฑ์มาตรฐาน CPU TensorFlow และ PyTorch เนื่องจากใช้เวลาฝึกอบรมนานมาก

ตารางต่อไปนี้สรุปเวลาการฝึกอบรมและความแม่นยำในการทดสอบสำหรับโปรเซสเซอร์/โปรเซสเซอร์เฉพาะทาง (GPU) แต่ละตัว

| หน่วยประมวลผล | เครื่องยนต์ | เวลาการฝึกอบรม (s) | ทดสอบความแม่นยำ |

| Intel Ice Lake (c6i.8xlarge) | BOLT | 1470 | 33.6 |

| AWS Graviton3 (c7g.8xlarge) | BOLT | 935 | 33.6 |

| NVIDIA T4G (g5g.8xlarge) | TensorFlow | 7550 | 33.6 |

| NVIDIA T4G (g5g.8xlarge) | ไพทอร์ช | 5130 | 33.6 |

การประเมินที่ 2: การวิเคราะห์ความรู้สึกของขั้ว Yelp

สำหรับการประเมินครั้งที่สอง เรามุ่งเน้นไปที่ความนิยม ขั้ว Yelp เกณฑ์มาตรฐานการวิเคราะห์ความรู้สึก ซึ่งเกี่ยวข้องกับการจำแนกบทวิจารณ์ว่าเป็นบวกหรือลบ สำหรับการประเมินนี้ เราจะเปรียบเทียบ ThirdAI's หม้อแปลงไฟฟ้าลึกสากล (UDT) แบบอย่างกับการปรับแต่งแบบละเอียด DitilBERT network ซึ่งเป็นโมเดลภาษาที่ได้รับการฝึกอบรมล่วงหน้าแบบบีบอัดที่ให้ประสิทธิภาพที่เกือบจะล้ำสมัยพร้อมเวลาแฝงในการอนุมานที่ลดลง เนื่องจากการปรับแต่งโมเดล DistilBERT บน CPU อย่างละเอียดจะใช้เวลานานมาก (อย่างน้อยหลายวัน) เราจึงเปรียบเทียบโมเดลที่ใช้ CPU ของ ThirdAI กับ DistilBERT ที่ได้รับการปรับแต่งอย่างละเอียดบน GPU เราฝึกอบรมโมเดลทั้งหมดที่มีขนาดแบทช์ 256 สำหรับการส่งผ่านข้อมูลครั้งเดียว (หนึ่งยุค) เราทราบว่าเราสามารถบรรลุความแม่นยำที่สูงขึ้นเล็กน้อยด้วย BOLT ด้วยการส่งผ่านข้อมูลเพิ่มเติม แต่เราจำกัดตัวเองให้ส่งผ่านเพียงครั้งเดียวในการประเมินนี้เพื่อความสอดคล้อง

ดังที่แสดงในรูปต่อไปนี้ AWS Graviton3 จะเร่งการฝึกโมเดล UDT ของ ThirdAI อีกครั้งอย่างมากอีกครั้ง นอกจากนี้ UDT ยังสามารถได้รับความแม่นยำในการทดสอบที่เทียบเคียงได้กับ DitilBERT โดยใช้เวลาฝึกอบรมเพียงเล็กน้อยและไม่ต้องใช้ GPU เราทราบว่ามีงานล่าสุดเช่นกัน การเพิ่มประสิทธิภาพการปรับแต่งอย่างละเอียด ของ Yelp Polarity บน CPU อย่างไรก็ตาม โมเดลของเรายังคงได้รับประสิทธิภาพที่มากขึ้น และหลีกเลี่ยงค่าใช้จ่ายในการฝึกอบรมล่วงหน้าซึ่งมีจำนวนมากและต้องใช้ตัวเร่งฮาร์ดแวร์ เช่น GPU

ตารางต่อไปนี้สรุปเวลาการฝึกอบรม ความแม่นยำในการทดสอบ และเวลาแฝงของการอนุมาน

| หน่วยประมวลผล | เครื่องยนต์ | รุ่น | เวลาการฝึกอบรม (s) | ทดสอบความแม่นยำ | เวลาแฝงในการอนุมาน (มิลลิวินาที) |

| Intel Icelake (c6i.8xlarge) | BOLT | UDT | 47 | 93.2 | <1 |

| Graviton3 (c7g.8xlarge) | BOLT | UDT | 29 | 92.9 | <1 |

| T4G GPU (g5g.8xlarge) | TensorFlow | DitilBERT | 4200 | 93.3 | 8.7 |

| T4G GPU (g5g.8xlarge) | ไพทอร์ช | DitilBERT | 3780 | 93.4 | 8.3 |

การประเมิน 3: การจำแนกข้อความแบบหลายคลาส (DBPedia)

สำหรับการประเมินขั้นสุดท้าย เรามุ่งเน้นไปที่ปัญหาของการจำแนกข้อความแบบหลายคลาส ซึ่งเกี่ยวข้องกับการกำหนดป้ายกำกับให้กับข้อความอินพุตที่กำหนดจากชุดของคลาสเอาต์พุตมากกว่าสองคลาส เรามุ่งเน้นไปที่ DBPedia เกณฑ์มาตรฐานซึ่งประกอบด้วยคลาสเอาต์พุตที่เป็นไปได้ 14 คลาส ขอย้ำอีกครั้งว่า AWS Graviton3 เร่งความเร็ว UDT เหนืออินสแตนซ์ Intel ที่เทียบเคียงได้ประมาณ 40% นอกจากนี้เรายังเห็นว่า BOLT ให้ผลลัพธ์ที่เทียบเคียงได้กับโมเดลที่ใช้หม้อแปลง DistilBERT ที่ปรับแต่งอย่างละเอียดบน GPU ขณะเดียวกันก็มีเวลาแฝงที่ต่ำกว่ามิลลิวินาที

ตารางต่อไปนี้สรุปเวลาการฝึกอบรม ความแม่นยำในการทดสอบ และเวลาแฝงของการอนุมาน

| หน่วยประมวลผล | เครื่องยนต์ | รุ่น | เวลาการฝึกอบรม (s) | ทดสอบความแม่นยำ | เวลาแฝงในการอนุมาน (มิลลิวินาที) |

| Intel Icelake (c6i.8xlarge) | BOLT | UDT | 23 | 98.23 | <1 |

| Graviton3 (c7g.8xlarge) | BOLT | UDT | 14 | 98.10 | <1 |

| T4G GPU (g5g.8xlarge) | TensorFlow | DitilBERT | 4320 | 99.23 | 8.6 |

| T4G GPU (g5g.8xlarge) | ไพทอร์ช | DitilBERT | 3480 | 99.29 | 8 |

เริ่มต้นใช้งาน ThirdAI บน AWS Graviton

เราได้ออกแบบซอฟต์แวร์ BOLT ของเราเพื่อให้เข้ากันได้กับสถาปัตยกรรม CPU หลักทั้งหมด รวมถึง AWS Graviton3 ที่จริงแล้ว เราไม่ต้องทำการปรับแต่งโค้ดของเราใดๆ เพื่อทำงานบน AWS Graviton3 ดังนั้น คุณสามารถใช้ ThirdAI สำหรับการฝึกฝนโมเดลและการปรับใช้บน AWS Graviton3 โดยไม่ต้องใช้ความพยายามเพิ่มเติม นอกจากนี้ตามรายละเอียดในล่าสุดของเรา เอกสารไวท์เปเปอร์วิจัยเราได้พัฒนาชุดเทคนิคทางคณิตศาสตร์ใหม่ๆ เพื่อปรับแต่งไฮเปอร์พารามิเตอร์เฉพาะที่เกี่ยวข้องกับโมเดลแบบกระจัดกระจายของเราโดยอัตโนมัติ ทำให้แบบจำลองของเราทำงานได้ดีทันทีที่แกะกล่อง

นอกจากนี้ เรายังทราบด้วยว่าโมเดลของเราทำงานได้ดีเป็นหลักในการค้นหา คำแนะนำ และงานประมวลผลภาษาธรรมชาติ ซึ่งโดยทั่วไปจะมีพื้นที่เอาต์พุตขนาดใหญ่และมีมิติสูงและความต้องการเวลาแฝงในการอนุมานต่ำมาก เรากำลังดำเนินการอย่างเต็มที่เพื่อขยายวิธีการของเราไปยังโดเมนเพิ่มเติม เช่น คอมพิวเตอร์วิทัศน์ แต่โปรดทราบว่าการปรับปรุงประสิทธิภาพของเราไม่ได้แปลเป็นโดเมน ML ทั้งหมดในขณะนี้

สรุป

ในโพสต์นี้ เราได้ตรวจสอบศักยภาพของโปรเซสเซอร์ AWS Graviton3 เพื่อเร่งการฝึกอบรมโครงข่ายประสาทเทียมสำหรับกลไกการเรียนรู้เชิงลึกที่ใช้ CPU ที่เป็นเอกลักษณ์ของ ThirdAI เกณฑ์มาตรฐานของเราในด้านการค้นหา การจัดประเภทข้อความ และเกณฑ์มาตรฐานคำแนะนำแนะนำว่า AWS Graviton3 สามารถเร่งปริมาณงานการฝึกอบรมแบบจำลองของ ThirdAI ได้ 30–40% เมื่อเทียบกับอินสแตนซ์ x86 ที่เทียบเคียงได้ โดยมีการปรับปรุงประสิทธิภาพด้านราคาเกือบ 50% นอกจากนี้ เนื่องจากอินสแตนซ์ AWS Graviton3 มีจำหน่ายในราคาที่ต่ำกว่าเครื่องอะนาล็อกของ Intel และ NVIDIA และเปิดใช้งานการฝึกอบรมและการอนุมานที่สั้นกว่า คุณจึงสามารถปลดล็อกมูลค่าของโมเดลการใช้งาน AWS แบบจ่ายตามการใช้งานจริงเพิ่มเติมได้โดยใช้ต้นทุนต่ำกว่า เครื่องจักรในระยะเวลาอันสั้น

เรารู้สึกตื่นเต้นมากกับการลดราคาและประสิทธิภาพของ AWS Graviton3 และจะพยายามส่งต่อการปรับปรุงเหล่านี้ให้กับลูกค้าของเรา เพื่อให้พวกเขาสามารถเพลิดเพลินกับการฝึกอบรมและการอนุมาน ML ที่รวดเร็วยิ่งขึ้นพร้อมประสิทธิภาพที่ได้รับการปรับปรุงบน CPU ราคาประหยัด ในฐานะลูกค้าของ AWS เรารู้สึกยินดีกับความเร็วที่ AWS Graviton3 ช่วยให้เราสามารถทดลองกับโมเดลของเรา และเราหวังว่าจะได้ใช้นวัตกรรมซิลิคอนที่ล้ำสมัยเพิ่มเติมจาก AWS ต่อไป คู่มือทางเทคนิค Graviton เป็นทรัพยากรที่ดีที่ควรพิจารณาขณะประเมินปริมาณงาน ML ของคุณเพื่อทำงานบน Graviton คุณยังสามารถลองใช้อินสแตนซ์ Graviton t4g ได้อีกด้วย ทดลองฟรี.

เนื้อหาและความคิดเห็นในโพสต์นี้เป็นของผู้เขียนบุคคลที่สาม และ AWS จะไม่รับผิดชอบต่อเนื้อหาหรือความถูกต้องของโพสต์นี้ ในขณะที่เขียนบล็อก อินสแตนซ์ล่าสุดคือ c6i และด้วยเหตุนี้จึงทำการเปรียบเทียบกับอินสแตนซ์ c6i

เกี่ยวกับผู้เขียน

วิหารลักษมัน – Vihan Lakshman เป็นนักวิทยาศาสตร์การวิจัยที่ ThirdAI Corp. ที่มุ่งเน้นการพัฒนาระบบสำหรับการเรียนรู้เชิงลึกอย่างประหยัดทรัพยากร ก่อนมาร่วมงานกับ ThirdAI เขาทำงานเป็นนักวิทยาศาสตร์ประยุกต์ที่ Amazon และได้รับระดับปริญญาตรีและปริญญาโทจากมหาวิทยาลัยสแตนฟอร์ด Vihan ยังได้รับทุนวิจัยจากมูลนิธิวิทยาศาสตร์แห่งชาติอีกด้วย

ธรุน เมทินี – Tharun Medini เป็นผู้ร่วมก่อตั้งและ CTO ของ ThirdAI Corp. เขาสำเร็จการศึกษาระดับปริญญาเอกในหัวข้อ “Hashing Algorithms for Search and Information Retrieval” ที่ Rice University ก่อนมาร่วมงานกับ ThirdAI Tharun เคยทำงานที่ Amazon และ Target Tharun เป็นผู้รับรางวัลมากมายจากงานวิจัยของเขา รวมถึง Ken Kennedy Institute BP Fellowship, American Society of Indian Engineers Scholarship และ Rice University Graduate Fellowship

อันชูมาลี ศรีวัทวา – Anshumali Shrivastava เป็นรองศาสตราจารย์ในภาควิชาวิทยาการคอมพิวเตอร์ที่ Rice University เขายังเป็นผู้ก่อตั้งและซีอีโอของ ThirdAI Corp ซึ่งเป็นบริษัทที่เผยแพร่ AI ไปสู่ฮาร์ดแวร์สินค้าโภคภัณฑ์ผ่านนวัตกรรมซอฟต์แวร์ ความสนใจด้านการวิจัยในวงกว้างของเขา ได้แก่ อัลกอริธึมความน่าจะเป็นสำหรับการเรียนรู้เชิงลึกที่ประหยัดทรัพยากร ในปี 2018 ข่าววิทยาศาสตร์ได้ตั้งชื่อให้เขาเป็นหนึ่งใน 10 นักวิทยาศาสตร์อายุต่ำกว่า 40 ปีที่น่าจับตามอง เขาเป็นผู้รับรางวัล National Science Foundation CAREER Award, Young Investigator Award จาก Air Force Office of Scientific Research, รางวัลการวิจัยการเรียนรู้ของเครื่องจาก Amazon และรางวัล Data Science Research Award จาก Adobe เขาได้รับรางวัลกระดาษมากมาย รวมถึงรางวัล Best Paper Awards ที่ NIPS 2014 และ MLSys 2022 รวมถึงรางวัลกระดาษที่ทำซ้ำได้มากที่สุดที่ SIGMOD 2019 งานของเขาเกี่ยวกับเทคโนโลยีการเรียนรู้ของเครื่องที่มีประสิทธิภาพบน CPU ได้รับการกล่าวถึงในสื่อยอดนิยม รวมถึง Wall Street Journal, New York Times, TechCrunch, NDTV ฯลฯ

- เนื้อหาที่ขับเคลื่อนด้วย SEO และการเผยแพร่ประชาสัมพันธ์ รับการขยายวันนี้

- PlatoData.Network Vertical Generative Ai เพิ่มพลังให้กับตัวเอง เข้าถึงได้ที่นี่.

- เพลโตไอสตรีม. Web3 อัจฉริยะ ขยายความรู้ เข้าถึงได้ที่นี่.

- เพลโตESG. คาร์บอน, คลีนเทค, พลังงาน, สิ่งแวดล้อม แสงอาทิตย์, การจัดการของเสีย. เข้าถึงได้ที่นี่.

- เพลโตสุขภาพ เทคโนโลยีชีวภาพและข่าวกรองการทดลองทางคลินิก เข้าถึงได้ที่นี่.

- ที่มา: https://aws.amazon.com/blogs/machine-learning/accelerating-large-scale-neural-network-training-on-cpus-with-thirdai-and-aws-graviton/

- :มี

- :เป็น

- :ไม่

- 000

- 001

- 1

- 11

- 14

- 16

- 2014

- 2018

- 2019

- 2021

- 2022

- 33

- 385

- 40

- 7

- a

- ความสามารถ

- สามารถ

- เร่งความเร็ว

- เร่ง

- เร่ง

- เร่ง

- ความถูกต้อง

- บรรลุ

- ประสบความสำเร็จ

- ประสบความสำเร็จ

- การบรรลุ

- กระตุ้น

- อย่างกระตือรือร้น

- นอกจากนี้

- เพิ่มเติม

- อะโดบี

- ความก้าวหน้า

- ความได้เปรียบ

- อีกครั้ง

- กับ

- AI

- AIR

- กองทัพอากาศ

- อัลกอริทึม

- อัลกอริทึม

- ทั้งหมด

- การอนุญาต

- ช่วยให้

- ด้วย

- แม้ว่า

- อเมซอน

- Amazon Web Services

- อเมริกัน

- ในหมู่

- an

- การวิเคราะห์

- และ

- ใด

- การใช้งาน

- ประยุกต์

- วิธีการ

- ประมาณ

- สถาปัตยกรรม

- สถาปัตยกรรม

- เป็น

- แถว

- เทียม

- ปัญญาประดิษฐ์

- AS

- ภาคี

- ที่เกี่ยวข้อง

- At

- ผู้เขียน

- อัตโนมัติ

- ใช้ได้

- หลีกเลี่ยง

- รางวัล

- ได้รับรางวัล

- ทราบ

- AWS

- AWS Marketplace

- บาร์

- BE

- เพราะ

- รับ

- ด้านล่าง

- มาตรฐาน

- มาตรฐาน

- ประโยชน์ที่ได้รับ

- ที่ดีที่สุด

- บล็อก

- กล้า

- สายฟ้า

- ทั้งสอง

- คอขวด

- กล่อง

- BP

- นวัตกรรม

- กว้าง

- ธุรกิจ

- แต่

- by

- CAN

- ความก้าวหน้า

- กรณี

- ผู้บริหารสูงสุด

- บาง

- เปลี่ยนแปลง

- แผนภูมิ

- ทางเลือก

- ชั้นเรียน

- การจัดหมวดหมู่

- ผู้ร่วมก่อตั้ง

- รหัส

- ชุด

- สินค้า

- ชุมชน

- บริษัท

- เทียบเคียง

- เปรียบเทียบ

- เปรียบเทียบ

- การเปรียบเทียบ

- เปรียบเทียบ

- ความเข้ากันได้

- การแข่งขัน

- การคำนวณ

- คอมพิวเตอร์

- วิทยาการคอมพิวเตอร์

- วิสัยทัศน์คอมพิวเตอร์

- พิจารณา

- ถือว่า

- ประกอบ

- การบริโภค

- เนื้อหา

- คอร์ป

- ราคา

- ค่าใช้จ่ายที่มีประสิทธิภาพ

- แพง

- ค่าใช้จ่าย

- ปกคลุม

- วิกฤติ

- CTO

- ปัจจุบัน

- ลูกค้า

- ตัดขอบ

- ข้อมูล

- วิทยาศาสตร์ข้อมูล

- วัน

- ทุ่มเท

- ลึก

- การเรียนรู้ลึก ๆ

- ยินดี

- ส่ง

- democratizing

- แผนก

- ปรับใช้

- ปรับใช้

- การใช้งาน

- ได้รับการออกแบบ

- รายละเอียด

- รายละเอียด

- พัฒนา

- ที่กำลังพัฒนา

- DID

- do

- โดเมน

- ทำ

- สอง

- พลวัต

- แบบไดนามิก

- แต่ละ

- เศรษฐศาสตร์

- อย่างมีประสิทธิภาพ

- ที่มีประสิทธิภาพ

- อย่างมีประสิทธิภาพ

- ความพยายาม

- โผล่ออกมา

- ทำให้สามารถ

- พลังงาน

- การใช้พลังงาน

- เครื่องยนต์

- วิศวกร

- เพลิดเพลิน

- ยุค

- ยุค

- ฯลฯ

- การประเมินการ

- การประเมินผล

- แม้

- ตื่นเต้น

- น่าตื่นเต้น

- การทดลอง

- การทดลอง

- การขยาย

- สุดโต่ง

- อย่างยิ่ง

- ความจริง

- เร็วขึ้น

- ลักษณะ

- สาขา

- รูป

- สุดท้าย

- ทางการเงิน

- ชื่อจริง

- ห้า

- การแก้ไข

- โฟกัส

- มุ่งเน้น

- ดังต่อไปนี้

- สำหรับ

- บังคับ

- ข้างหน้า

- รากฐาน

- ผู้สร้าง

- ผู้ก่อตั้งและซีอีโอ

- เศษ

- ราคาเริ่มต้นที่

- เต็ม

- ลึกซึ้ง

- ต่อไป

- นอกจากนี้

- กําไร

- GIF

- กำหนด

- ไป

- ดี

- GPU

- GPUs

- สำเร็จการศึกษา

- มากขึ้น

- แขก

- โพสต์ของผู้เข้าพัก

- ฮาร์ดแวร์

- มี

- he

- ด้วยเหตุนี้

- ประสิทธิภาพสูง

- สูงกว่า

- พระองค์

- ของเขา

- สรุป ความน่าเชื่อถือของ Olymp Trade?

- ทำอย่างไร

- อย่างไรก็ตาม

- ที่ http

- HTTPS

- ICE

- ระบุ

- if

- ทันที

- การดำเนินการ

- ประทับใจ

- การปรับปรุง

- การปรับปรุง

- การปรับปรุง

- in

- ประกอบด้วย

- รวมทั้ง

- ขึ้น

- ชาวอินเดีย

- ข้อมูล

- โครงสร้างพื้นฐาน

- นักวิเคราะห์ส่วนบุคคลที่หาโอกาสให้เป็นไปได้มากที่สุด

- นวัตกรรม

- อินพุต

- ตัวอย่าง

- สถาบัน

- อินเทล

- Intelligence

- ผลประโยชน์

- สอบสวน

- ที่เกี่ยวข้องกับการ

- รายการ

- วารสาร

- jpg

- ความรู้

- ที่รู้จักกัน

- ฉลาก

- ทะเลสาบ

- ภาษา

- ใหญ่

- ขนาดใหญ่

- ความแอบแฝง

- การเรียนรู้

- น้อยที่สุด

- กดไลก์

- ขีด จำกัด

- เส้น

- นาน

- เวลานาน

- ดู

- ต่ำ

- ที่มีราคาต่ำ

- ลด

- เครื่อง

- เรียนรู้เครื่อง

- เครื่อง

- สำคัญ

- ส่วนใหญ่

- ทำ

- หลาย

- ตลาด

- ปริญญาโท

- คณิตศาสตร์

- มดลูก

- วิธี

- วิธีการ

- ภารกิจ

- ML

- แบบ

- การสร้างแบบจำลอง

- โมเดล

- ข้อมูลเพิ่มเติม

- มากที่สุด

- MS

- การคูณ

- ที่มีชื่อ

- แห่งชาติ

- วิทยาศาสตร์แห่งชาติ

- โดยธรรมชาติ

- ประมวลผลภาษาธรรมชาติ

- เกือบทั้งหมด

- จำเป็นต้อง

- เชิงลบ

- เครือข่าย

- เกี่ยวกับประสาท

- เครือข่ายประสาท

- เซลล์ประสาท

- ใหม่

- นิวยอร์ก

- นิวยอร์กไทม์ส

- ข่าว

- ไม่

- หมายเหตุ

- นวนิยาย

- จำนวน

- มากมาย

- Nvidia

- สังเกต

- of

- Office

- on

- ONE

- เพียง

- ทำงาน

- ความคิดเห็น

- ตรงข้าม

- or

- องค์กร

- อื่นๆ

- ของเรา

- ตัวเรา

- ออก

- เอาท์พุต

- เกิน

- กระดาษ

- ตัวอย่าง

- ส่ง

- ผ่าน

- รูปแบบไฟล์ PDF

- การปฏิบัติ

- phd

- เพลโต

- เพลโตดาต้าอินเทลลิเจนซ์

- เพลโตดาต้า

- ยอดนิยม

- บวก

- เป็นไปได้

- โพสต์

- ที่มีศักยภาพ

- ขับเคลื่อน

- ประยุกต์

- ความแม่นยำ

- กด

- ราคา

- ส่วนใหญ่

- ก่อน

- ปัญหา

- ปัญหาที่เกิดขึ้น

- การประมวลผล

- หน่วยประมวลผล

- โปรเซสเซอร์

- ผลิต

- ผลิตภัณฑ์

- ผลิตภัณฑ์

- ศาสตราจารย์

- ความคืบหน้า

- เป็นเจ้าของ

- ให้

- สาธารณะ

- ไฟฉาย

- คะแนน

- เมื่อเร็ว ๆ นี้

- เมื่อเร็ว ๆ นี้

- แนะนำ

- แนะนำ

- ลดลง

- ซากศพ

- โดดเด่น

- ตัวแทน

- จำเป็นต้องใช้

- ความต้องการ

- ต้อง

- การวิจัย

- ทรัพยากร

- รับผิดชอบ

- จำกัด

- ผล

- ผลสอบ

- ทบทวน

- การปฏิวัติ

- ข้าว

- ลวก

- วิ่ง

- s

- เดียวกัน

- เงินออม

- วิทยาศาสตร์

- มูลนิธิวิทยาศาสตร์

- วิทยาศาสตร์

- นักวิทยาศาสตร์

- นักวิทยาศาสตร์

- ค้นหา

- ที่สอง

- เห็น

- เลือก

- เลือก

- ความรู้สึก

- อย่างจริงจัง

- บริการ

- ชุด

- หลาย

- การแสดง

- แสดง

- สำคัญ

- ซิลิคอน

- คล้ายคลึงกัน

- เดียว

- ขนาด

- ขนาด

- เลื่อน

- So

- สังคม

- ซอฟต์แวร์

- ช่องว่าง

- เฉพาะ

- เฉพาะ

- ความเร็ว

- มาตรฐาน

- Stanford

- มหาวิทยาลัยสแตนฟอร์ด

- ข้อความที่เริ่ม

- การเริ่มต้น

- ยังคง

- ถนน

- แข็งแรง

- ศึกษา

- ทำให้งงงวย

- เป็นกอบเป็นกำ

- อย่างเช่น

- แนะนำ

- ระบบ

- ตาราง

- เอา

- เป้า

- งาน

- งาน

- ทีม

- TechCrunch

- วิชาการ

- เทคนิค

- เทคโนโลยี

- เทคโนโลยี

- tensorflow

- ทดสอบ

- ข้อความ

- การจัดประเภทข้อความ

- กว่า

- ที่

- พื้นที่

- ที่นั่น

- ดังนั้น

- ดังนั้น

- ล้อยางขัดเหล่านี้ติดตั้งบนแกน XNUMX (มม.) ผลิตภัณฑ์นี้ถูกผลิตในหลายรูปทรง และหลากหลายเบอร์ความแน่นหนาของปริมาณอนุภาคขัดของมัน จะทำให้ท่านได้รับประสิทธิภาพสูงในการขัดและการใช้งานที่ยาวนาน

- พวกเขา

- ของบุคคลที่สาม

- นี้

- เหล่านั้น

- ตลอด

- เวลา

- ครั้ง

- ไปยัง

- ตามธรรมเนียม

- รถไฟ

- ผ่านการฝึกอบรม

- การฝึกอบรม

- หม้อแปลง

- แปลความ

- ลอง

- ปรับแต่ง

- สอง

- เป็นปกติ

- อูบุนตู

- ภายใต้

- เป็นเอกลักษณ์

- มหาวิทยาลัย

- แตกต่าง

- ปลดล็อก

- us

- การใช้

- ใช้

- ใช้

- การใช้

- ความคุ้มค่า

- กว้างใหญ่

- รุ่น

- มาก

- ผ่านทาง

- วิสัยทัศน์

- vs

- ผนัง

- Wall Street

- Wall Street Journal

- คือ

- นาฬิกา

- we

- เว็บ

- บริการเว็บ

- ดี

- คือ

- ที่

- ในขณะที่

- วิกิพีเดีย

- จะ

- กับ

- ไม่มี

- วอน

- งาน

- ทำงาน

- การทำงาน

- จะ

- การเขียน

- เขียน

- นิวยอร์ก

- คุณ

- หนุ่มสาว

- ของคุณ

- ลมทะเล