ในโพสต์นี้ เรานำเสนอการปรับแต่งโมเดล Llama 2 อย่างละเอียดโดยใช้วิธีการปรับพารามิเตอร์อย่างมีประสิทธิภาพ (PEFT) และปรับใช้โมเดลที่ปรับแต่งอย่างละเอียดบน AWS Inferentia2. เราใช้ AWS เซลล์ประสาท ชุดพัฒนาซอฟต์แวร์ (SDK) เพื่อเข้าถึงอุปกรณ์ AWS Inferentia2 และได้รับประโยชน์จากประสิทธิภาพสูง จากนั้นเราจะใช้คอนเทนเนอร์อนุมานแบบจำลองขนาดใหญ่ที่ขับเคลื่อนโดย ห้องสมุด Java ลึก (DJLServing) เป็นโซลูชันการให้บริการโมเดลของเรา

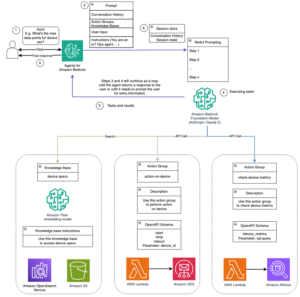

ภาพรวมโซลูชัน

การปรับแต่ง Llama2 อย่างมีประสิทธิภาพโดยใช้ QLoRa

โมเดลภาษาขนาดใหญ่ (LLM) ตระกูล Llama 2 คือคอลเลกชันของโมเดลข้อความที่สร้างไว้ล่วงหน้าและปรับแต่งอย่างละเอียด โดยมีขนาดตั้งแต่ 7 พันล้านถึง 70 พันล้านพารามิเตอร์ Llama 2 ได้รับการฝึกอบรมล่วงหน้าเกี่ยวกับโทเค็นข้อมูล 2 ล้านล้านโทเค็นจากแหล่งข้อมูลที่เปิดเผยต่อสาธารณะ บางครั้งลูกค้า AWS เลือกที่จะปรับแต่งโมเดล Llama 2 โดยใช้ข้อมูลของลูกค้าเองเพื่อให้ได้ประสิทธิภาพที่ดีขึ้นสำหรับงานดาวน์สตรีม อย่างไรก็ตาม เนื่องจากโมเดล Llama 2 มีพารามิเตอร์จำนวนมาก การปรับแต่งแบบละเอียดทั้งหมดจึงอาจมีราคาแพงและใช้เวลานานมาก วิธีการปรับแต่งพารามิเตอร์อย่างมีประสิทธิภาพ (PEFT) สามารถแก้ไขปัญหานี้ได้โดยการปรับแต่งพารามิเตอร์โมเดลพิเศษจำนวนเล็กน้อยเท่านั้น ขณะเดียวกันก็หยุดพารามิเตอร์ส่วนใหญ่ของโมเดลที่ได้รับการฝึกอบรมล่วงหน้าไว้ สำหรับข้อมูลเพิ่มเติมเกี่ยวกับ PEFT สามารถอ่านได้ เสา. ในโพสต์นี้เราใช้ คิวโลรา เพื่อปรับแต่งโมเดล Llama 2 7B

ปรับใช้โมเดลที่ได้รับการปรับแต่งอย่างละเอียดบน Inf2 โดยใช้ Amazon SageMaker

AWS Inferentia2 เป็นตัวเร่งความเร็ว Machine Learning (ML) ที่สร้างขึ้นตามวัตถุประสงค์ ซึ่งออกแบบมาเพื่อปริมาณงานการอนุมาน และมอบประสิทธิภาพสูงโดยมีค่าใช้จ่ายลดลงสูงสุดถึง 40% สำหรับปริมาณงาน AI และ LLM ทั่วไป เหนืออินสแตนซ์ที่ได้รับการปรับปรุงประสิทธิภาพการอนุมานอื่นๆ บน AWS ในโพสต์นี้ เราใช้ Amazon Elastic Compute Cloud (Amazon EC2) Inf2 instance ซึ่งมี AWS Inferentia2 ซึ่งเป็นตัวเร่งความเร็ว Inferentia2 รุ่นที่สอง โดยแต่ละตัวมีสองตัว NeuronCores-v2. NeuronCore-v2 แต่ละตัวเป็นหน่วยประมวลผลอิสระที่ต่างกัน โดยมีกลไกหลัก 2 ตัว ได้แก่ กลไก Tensor, Vector, Scalar และ GPSIMD ประกอบด้วยหน่วยความจำ SRAM ที่จัดการโดยซอฟต์แวร์บนชิปเพื่อเพิ่มพื้นที่ข้อมูลให้สูงสุด เนื่องจากมีการเผยแพร่บล็อกหลายบล็อกใน InfXNUMX ผู้อ่านจึงสามารถอ้างอิงถึงสิ่งนี้ได้ เสา และเรา เอกสาร สำหรับข้อมูลเพิ่มเติมเกี่ยวกับ Inf2

หากต้องการปรับใช้โมเดลบน Inf2 เราจำเป็นต้องมี AWS Neuron SDK เป็นเลเยอร์ซอฟต์แวร์ที่ทำงานบนฮาร์ดแวร์ Inf2 AWS Neuron เป็น SDK ที่ใช้ในการรันปริมาณงานการเรียนรู้เชิงลึกบน AWS Inferentia และ การฝึกอบรม AWS อินสแตนซ์ตาม ช่วยให้วงจรการพัฒนา ML แบบ end-to-end สามารถสร้างโมเดลใหม่ ฝึกและปรับโมเดลเหล่านี้ให้เหมาะสม และปรับใช้สำหรับการผลิต AWS Neuron มีการเรียนรู้เชิงลึก ผู้รวบรวม, รันไทม์และ เครื่องมือ ที่บูรณาการเข้ากับเฟรมเวิร์กยอดนิยมอย่าง TensorFlow และ PyTorch ในบล็อกนี้เราจะใช้ transformers-neuronxซึ่งเป็นส่วนหนึ่งของ AWS Neuron SDK สำหรับเวิร์กโฟลว์การอนุมานตัวถอดรหัสหม้อแปลงไฟฟ้า มัน สนับสนุน หลากหลายรุ่นยอดนิยม รวมถึง Llama 2

เพื่อปรับใช้โมเดลบน อเมซอน SageMakerเรามักจะใช้คอนเทนเนอร์ที่มีไลบรารีที่จำเป็น เช่น Neuron SDK และ transformers-neuronx เช่นเดียวกับองค์ประกอบการให้บริการโมเดล Amazon SageMaker จะดูแลรักษา คอนเทนเนอร์การเรียนรู้เชิงลึก (DLC) พร้อมไลบรารีโอเพ่นซอร์สยอดนิยมสำหรับการโฮสต์โมเดลขนาดใหญ่ ในโพสต์นี้เราใช้ คอนเทนเนอร์อนุมานแบบจำลองขนาดใหญ่สำหรับเซลล์ประสาท. คอนเทนเนอร์นี้มีทุกสิ่งที่คุณต้องการเพื่อปรับใช้โมเดล Llama 2 บน Inf2 สำหรับแหล่งข้อมูลในการเริ่มต้นใช้งาน LMI บน Amazon SageMaker โปรดดูโพสต์ที่มีอยู่ของเราจำนวนมาก (บล็อก 1, บล็อก 2, บล็อก 3) ในหัวข้อนี้ กล่าวโดยสรุป คุณสามารถเรียกใช้คอนเทนเนอร์ได้โดยไม่ต้องเขียนโค้ดเพิ่มเติมใดๆ คุณสามารถใช้ ตัวจัดการเริ่มต้น เพื่อประสบการณ์ผู้ใช้ที่ราบรื่นและส่งหนึ่งในชื่อรุ่นที่รองรับและพารามิเตอร์ที่กำหนดค่าเวลาโหลดได้ ซึ่งจะรวบรวมและให้บริการ LLM บนอินสแตนซ์ Inf2 ตัวอย่างเช่น เพื่อปรับใช้ OpenAssistant/llama2-13b-orca-8k-3319คุณสามารถระบุการกำหนดค่าต่อไปนี้ได้ (เช่น serving.properties ไฟล์). ใน serving.propertiesโดยเราระบุประเภทรุ่นเป็น llama2-13b-orca-8k-3319ขนาดแบตช์เป็น 4 องศาขนานเทนเซอร์เป็น 2 แค่นั้นเอง สำหรับรายการพารามิเตอร์ที่กำหนดค่าได้ทั้งหมด โปรดดูที่ ตัวเลือกการกำหนดค่า DJL ทั้งหมด.

หรือคุณสามารถเขียนไฟล์ตัวจัดการโมเดลของคุณเองดังที่แสดงในนี้ ตัวอย่างแต่นั่นต้องใช้วิธีการโหลดโมเดลและการอนุมานเพื่อใช้เป็นสะพานเชื่อมระหว่าง DJLServing API

เบื้องต้น

รายการต่อไปนี้สรุปข้อกำหนดเบื้องต้นสำหรับการปรับใช้โมเดลที่อธิบายไว้ในโพสต์บล็อกนี้ คุณสามารถใช้อย่างใดอย่างหนึ่งจาก คอนโซลการจัดการ AWS หรือใช้เวอร์ชันล่าสุดของ อินเทอร์เฟซบรรทัดคำสั่ง AWS AWS (AWS CLI)

คำแนะนำแบบ

ในส่วนต่อไปนี้ เราจะอธิบายโค้ดเป็นสองส่วน:

- ปรับแต่งโมเดล Llama2-7b อย่างละเอียด และอัปโหลดอาร์ติแฟกต์ของโมเดลไปยังตำแหน่งบัคเก็ต Amazon S3 ที่ระบุ

- ปรับใช้โมเดลใน Inferentia2 โดยใช้ DJL ที่ให้บริการคอนเทนเนอร์ที่โฮสต์ใน Amazon SageMaker

ตัวอย่างโค้ดที่สมบูรณ์พร้อมคำแนะนำสามารถพบได้ในสิ่งนี้ GitHub กรุ

ส่วนที่ 1: ปรับแต่งโมเดล Llama2-7b โดยใช้ PEFT

เราจะใช้วิธีการที่แนะนำล่าสุดในบทความนี้ QLoRA: การปรับแต่งอแดปเตอร์ระดับต่ำที่รับรู้เชิงปริมาณสำหรับการสร้างภาษา โดย Tim Dettmers และคณะ QLoRA เป็นเทคนิคใหม่ในการลดพื้นที่หน่วยความจำของโมเดลภาษาขนาดใหญ่ในระหว่างการปรับแต่งอย่างละเอียด โดยไม่ทำให้ประสิทธิภาพลดลง

หมายเหตุ การปรับแต่งโมเดล llama2-7b ดังที่แสดงต่อไปนี้ได้รับการทดสอบใน Amazon สมุดบันทึก SageMaker Studio ด้วยเคอร์เนลที่ปรับให้เหมาะสม GPU Python 2.0 โดยใช้ไฟล์ มล.g5.2xlarge ประเภทอินสแตนซ์ ตามแนวทางปฏิบัติที่ดีที่สุด เราขอแนะนำให้ใช้ สตูดิโอ Amazon SageMaker Integrated Development Environment (IDE) เปิดตัวด้วยตัวคุณเอง คลาวด์ส่วนตัวเสมือนของ Amazon (Amazon VPC). วิธีนี้ช่วยให้คุณควบคุม ตรวจสอบ และตรวจสอบการรับส่งข้อมูลเครือข่ายภายในและภายนอก VPC ของคุณได้โดยใช้ความสามารถด้านเครือข่ายและความปลอดภัยมาตรฐานของ AWS ดูข้อมูลเพิ่มเติมได้ที่ การรักษาความปลอดภัยการเชื่อมต่อ Amazon SageMaker Studio โดยใช้ VPC . ส่วนตัว.

การหาปริมาณโมเดลฐาน

ก่อนอื่นเราจะโหลดโมเดลเชิงปริมาณโดยใช้การหาปริมาณ 4 บิต หม้อแปลงหน้ากอด ห้องสมุด ดังนี้

โหลดชุดข้อมูลการฝึกอบรม

ต่อไป เราจะโหลดชุดข้อมูลเพื่อป้อนโมเดลสำหรับขั้นตอนการปรับแต่งโดยละเอียดที่แสดงดังต่อไปนี้:

แนบชั้นอะแดปเตอร์

ที่นี่เราแนบเลเยอร์อะแดปเตอร์ขนาดเล็กที่สามารถฝึกอบรมได้ ซึ่งกำหนดค่าเป็น LoraConfig กำหนดไว้ในหน้ากอด เพฟท์ ห้องสมุด.

ฝึกนางแบบ

เมื่อใช้การกำหนดค่า LoRA ที่แสดงด้านบน เราจะปรับแต่งโมเดล Llama2 พร้อมกับไฮเปอร์พารามิเตอร์ ข้อมูลโค้ดสำหรับการฝึกโมเดลจะแสดงดังต่อไปนี้:

รวมน้ำหนักโมเดล

โมเดลที่ได้รับการปรับแต่งอย่างละเอียดที่ดำเนินการข้างต้นได้สร้างโมเดลใหม่ซึ่งมีน้ำหนักของอะแดปเตอร์ LoRA ที่ผ่านการฝึกอบรมแล้ว ในตัวอย่างโค้ดต่อไปนี้ เราจะรวมอะแดปเตอร์เข้ากับโมเดลพื้นฐาน เพื่อให้เราสามารถใช้โมเดลที่ได้รับการปรับแต่งเพื่อการอนุมานได้

อัปโหลดน้ำหนักโมเดลไปยัง Amazon S3

ในขั้นตอนสุดท้ายของส่วนที่ 1 เราจะบันทึกน้ำหนักโมเดลที่รวมเข้าด้วยกันไปยังตำแหน่ง Amazon S3 ที่ระบุ โมเดลที่ให้บริการคอนเทนเนอร์ใน Amazon SageMaker จะใช้น้ำหนักโมเดลเพื่อโฮสต์โมเดลโดยใช้อินสแตนซ์ Inferentia2

ส่วนที่ 2: โฮสต์โมเดล QLoRA สำหรับการอนุมานด้วย AWS Inf2 โดยใช้ SageMaker LMI Container

ในส่วนนี้ เราจะอธิบายขั้นตอนการปรับใช้โมเดลที่ได้รับการปรับแต่ง QLoRA ในสภาพแวดล้อมโฮสติ้ง Amazon SageMaker เราจะใช้ก ดีเจแอลเสิร์ฟ คอนเทนเนอร์จาก SageMaker DLCซึ่งรวมเข้ากับ Transformers-neuronx ไลบรารี่เพื่อโฮสต์โมเดลนี้ การตั้งค่านี้อำนวยความสะดวกในการโหลดโมเดลไปยังตัวเร่งความเร็ว AWS Inferentia2 ทำโมเดลแบบขนานใน NeuronCore หลายตัว และเปิดใช้งานการให้บริการผ่านตำแหน่งข้อมูล HTTP

เตรียมสิ่งประดิษฐ์แบบจำลอง

DJL รองรับไลบรารีการเพิ่มประสิทธิภาพการเรียนรู้เชิงลึกจำนวนมาก ซึ่งรวมถึง ความเร็วลึก, เร็วกว่าหม้อแปลงไฟฟ้า และอื่น ๆ. สำหรับการกำหนดค่าเฉพาะรุ่น เรามีให้ serving.properties โดยมีพารามิเตอร์ที่สำคัญ เช่น tensor_parallel_degree และ model_id เพื่อกำหนดตัวเลือกการโหลดโมเดล ที่ model_id อาจเป็น ID โมเดล Hugging Face หรือเส้นทาง Amazon S3 ที่ใช้จัดเก็บน้ำหนักโมเดล ในตัวอย่างของเรา เราระบุตำแหน่ง Amazon S3 ของโมเดลที่ได้รับการปรับแต่งของเรา ข้อมูลโค้ดต่อไปนี้แสดงคุณสมบัติที่ใช้สำหรับการให้บริการโมเดล:

โปรดดูที่นี่ เอกสาร สำหรับข้อมูลเพิ่มเติมเกี่ยวกับตัวเลือกที่กำหนดค่าได้ผ่านทาง serving.properties. โปรดทราบว่าเราใช้ option.n_position=512 ในบล็อกนี้เพื่อการคอมไพล์ AWS Neuron ที่เร็วขึ้น หากคุณต้องการลองใช้โทเค็นอินพุตที่มีความยาวมากขึ้น เราขอแนะนำให้ผู้อ่านคอมไพล์โมเดลล่วงหน้า (ดู AOT Pre-Compile Model บน EC2). มิฉะนั้น คุณอาจพบข้อผิดพลาดการหมดเวลาหากเวลาในการคอมไพล์มากเกินไป

หลังจาก serving.properties ไฟล์ถูกกำหนดไว้แล้ว เราจะทำการบรรจุไฟล์ลงในไฟล์ tar.gz รูปแบบดังต่อไปนี้:

จากนั้น เราจะอัปโหลด tar.gz ไปยังตำแหน่งบัคเก็ตของ Amazon S3:

สร้างตำแหน่งข้อมูลโมเดล Amazon SageMaker

หากต้องการใช้อินสแตนซ์ Inf2 ในการให้บริการ เราใช้ Amazon คอนเทนเนอร์ SageMaker LMI พร้อมรองรับ DJL neuronX โปรดดูสิ่งนี้ เสา สำหรับข้อมูลเพิ่มเติมเกี่ยวกับการใช้คอนเทนเนอร์ DJL NeuronX สำหรับการอนุมาน โค้ดต่อไปนี้แสดงวิธีการปรับใช้โมเดลโดยใช้ Amazon SageMaker Python SDK:

จุดสิ้นสุดของโมเดลทดสอบ

หลังจากปรับใช้โมเดลสำเร็จแล้ว เราสามารถตรวจสอบตำแหน่งข้อมูลได้โดยการส่งคำขอตัวอย่างไปยังตัวทำนาย:

ผลลัพธ์ตัวอย่างจะแสดงดังต่อไปนี้:

ในบริบทของการวิเคราะห์ข้อมูล Machine Learning (ML) หมายถึงเทคนิคทางสถิติที่สามารถดึงพลังการทำนายจากชุดข้อมูลที่มีความซับซ้อนและความแม่นยำเพิ่มขึ้นโดยการลดขอบเขตของสถิติลงซ้ำๆ

การเรียนรู้ของเครื่องไม่ใช่เทคนิคทางสถิติใหม่ แต่เป็นการผสมผสานระหว่างเทคนิคที่มีอยู่ นอกจากนี้ ยังไม่ได้รับการออกแบบให้ใช้กับชุดข้อมูลเฉพาะหรือเพื่อสร้างผลลัพธ์เฉพาะ แต่ได้รับการออกแบบมาให้มีความยืดหยุ่นเพียงพอที่จะปรับให้เข้ากับชุดข้อมูลใดๆ และคาดการณ์เกี่ยวกับผลลัพธ์ใดๆ ได้

ทำความสะอาด

หากคุณตัดสินใจว่าไม่ต้องการให้ตำแหน่งข้อมูล SageMaker ทำงานต่อไป คุณสามารถลบได้โดยใช้ AWS SDK สำหรับ Python (boto3), AWS CLI หรือ Amazon SageMaker Console นอกจากนี้คุณยังสามารถ ปิดทรัพยากร Amazon SageMaker Studio ที่ไม่จำเป็นอีกต่อไป

สรุป

ในโพสต์นี้ เราได้แสดงให้คุณเห็นถึงวิธีปรับแต่งโมเดล Llama2-7b โดยใช้อะแดปเตอร์ LoRA พร้อมการหาปริมาณ 4 บิตโดยใช้อินสแตนซ์ GPU เดียว จากนั้นเราปรับใช้โมเดลกับอินสแตนซ์ Inf2 ที่โฮสต์ใน Amazon SageMaker โดยใช้คอนเทนเนอร์ที่ให้บริการ DJL สุดท้าย เราได้ตรวจสอบตำแหน่งข้อมูลโมเดล Amazon SageMaker ด้วยการคาดการณ์การสร้างข้อความโดยใช้ SageMaker Python SDK ไปข้างหน้าและลองดูสิ เราชอบที่จะได้ยินความคิดเห็นของคุณ คอยติดตามการอัปเดตเกี่ยวกับความสามารถเพิ่มเติมและนวัตกรรมใหม่ๆ ด้วย AWS Inferentia

สำหรับตัวอย่างเพิ่มเติมเกี่ยวกับ AWS Neuron โปรดดู aws-ตัวอย่างเซลล์ประสาท.

เกี่ยวกับผู้เขียน

เว่ยเต๋อ เป็นสถาปนิกโซลูชันผู้เชี่ยวชาญ AI/ML อาวุโสที่ AWS เขามีความกระตือรือร้นในการช่วยให้ลูกค้าก้าวไปสู่เส้นทาง AWS โดยมุ่งเน้นไปที่บริการ Amazon Machine Learning และโซลูชันที่ใช้การเรียนรู้ของเครื่อง นอกเหนือจากงาน เขาชอบกิจกรรมกลางแจ้ง เช่น ตั้งแคมป์ ตกปลา และเดินป่ากับครอบครัว

เว่ยเต๋อ เป็นสถาปนิกโซลูชันผู้เชี่ยวชาญ AI/ML อาวุโสที่ AWS เขามีความกระตือรือร้นในการช่วยให้ลูกค้าก้าวไปสู่เส้นทาง AWS โดยมุ่งเน้นไปที่บริการ Amazon Machine Learning และโซลูชันที่ใช้การเรียนรู้ของเครื่อง นอกเหนือจากงาน เขาชอบกิจกรรมกลางแจ้ง เช่น ตั้งแคมป์ ตกปลา และเดินป่ากับครอบครัว

ชิงเว่ฉันหลี่ เป็นผู้เชี่ยวชาญด้าน Machine Learning ที่ Amazon Web Services เขาได้รับปริญญาเอกของเขา ใน Operations Research หลังจากที่เขาทำลายบัญชีทุนวิจัยของที่ปรึกษาและล้มเหลวในการมอบรางวัลโนเบลที่เขาสัญญาไว้ ปัจจุบันเขาช่วยลูกค้าในอุตสาหกรรมบริการทางการเงินและประกันภัยสร้างโซลูชันแมชชีนเลิร์นนิงบน AWS เวลาว่างชอบอ่านหนังสือและสอน

ชิงเว่ฉันหลี่ เป็นผู้เชี่ยวชาญด้าน Machine Learning ที่ Amazon Web Services เขาได้รับปริญญาเอกของเขา ใน Operations Research หลังจากที่เขาทำลายบัญชีทุนวิจัยของที่ปรึกษาและล้มเหลวในการมอบรางวัลโนเบลที่เขาสัญญาไว้ ปัจจุบันเขาช่วยลูกค้าในอุตสาหกรรมบริการทางการเงินและประกันภัยสร้างโซลูชันแมชชีนเลิร์นนิงบน AWS เวลาว่างชอบอ่านหนังสือและสอน

- เนื้อหาที่ขับเคลื่อนด้วย SEO และการเผยแพร่ประชาสัมพันธ์ รับการขยายวันนี้

- PlatoData.Network Vertical Generative Ai เพิ่มพลังให้กับตัวเอง เข้าถึงได้ที่นี่.

- เพลโตไอสตรีม. Web3 อัจฉริยะ ขยายความรู้ เข้าถึงได้ที่นี่.

- เพลโตESG. คาร์บอน, คลีนเทค, พลังงาน, สิ่งแวดล้อม แสงอาทิตย์, การจัดการของเสีย. เข้าถึงได้ที่นี่.

- เพลโตสุขภาพ เทคโนโลยีชีวภาพและข่าวกรองการทดลองทางคลินิก เข้าถึงได้ที่นี่.

- ที่มา: https://aws.amazon.com/blogs/machine-learning/fine-tune-llama-2-using-qlora-and-deploy-it-on-amazon-sagemaker-with-aws-inferentia2/

- :มี

- :เป็น

- :ไม่

- :ที่ไหน

- $ ขึ้น

- 1

- 10

- 100

- 11

- ลด 15%

- 16

- 19

- 24

- 300

- 7

- 70

- 8

- a

- เกี่ยวกับเรา

- ข้างบน

- คันเร่ง

- เร่ง

- เข้า

- ลงชื่อเข้าใช้

- ความถูกต้อง

- บรรลุ

- ข้าม

- กิจกรรม

- ปรับ

- เพิ่มเติม

- นอกจากนี้

- ที่อยู่

- ความก้าวหน้า

- หลังจาก

- ก่อน

- AI

- AI / ML

- AL

- ช่วยให้

- ตาม

- แอลฟา

- ด้วย

- อเมซอน

- อเมซอน แมชชีนเลิร์นนิง

- อเมซอน SageMaker

- สตูดิโอ Amazon SageMaker

- Amazon Web Services

- an

- การวิเคราะห์

- และ

- ใด

- APIs

- ใช้

- เข้าใกล้

- เป็น

- AS

- At

- แนบ

- รถยนต์

- ใช้ได้

- AWS

- การอนุมาน AWS

- ลูกบอล

- ฐาน

- ตาม

- เครื่องผสม

- BE

- รับ

- ประโยชน์

- ที่ดีที่สุด

- ดีกว่า

- ระหว่าง

- พันล้าน

- บล็อก

- Blog

- สะพาน

- Broke

- สร้าง

- แต่

- by

- CAN

- ความสามารถในการ

- สามารถ

- Choose

- เมฆ

- รหัส

- ชุด

- การผสมผสาน

- สมบูรณ์

- ความซับซ้อน

- ส่วนประกอบ

- คำนวณ

- องค์ประกอบ

- การกำหนดค่า

- การเชื่อมต่อ

- ปลอบใจ

- การบริโภค

- ภาชนะ

- มี

- สิ่งแวดล้อม

- ควบคุม

- ราคา

- ได้

- ที่สร้างขึ้น

- ขณะนี้

- ลูกค้า

- ข้อมูล

- การวิเคราะห์ข้อมูล

- ตัดสินใจ

- ลึก

- การเรียนรู้ลึก ๆ

- ค่าเริ่มต้น

- กำหนด

- กำหนด

- องศา

- ส่งมอบ

- มอบ

- ปรับใช้

- นำไปใช้

- ปรับใช้

- อธิบาย

- ได้รับการออกแบบ

- พัฒนาการ

- เครื่อง

- นักเทียบท่า

- ลง

- สอง

- ในระหว่าง

- พลวัต

- E&T

- แต่ละ

- ทั้ง

- ช่วยให้

- จบสิ้น

- ปลายทาง

- เครื่องยนต์

- เครื่องยนต์

- พอ

- สิ่งแวดล้อม

- ความผิดพลาด

- ฯลฯ

- ทุกอย่าง

- ตัวอย่าง

- ตัวอย่าง

- ดำเนินการ

- ที่มีอยู่

- แพง

- ประสบการณ์

- พิเศษ

- ใบหน้า

- อำนวยความสะดวก

- ล้มเหลว

- เท็จ

- ครอบครัว

- เร็วขึ้น

- ที่มีคุณสมบัติ

- ข้อเสนอแนะ

- เนื้อไม่มีมัน

- สุดท้าย

- ในที่สุด

- ทางการเงิน

- บริการทางการเงิน

- ชื่อจริง

- ประมง

- มีความยืดหยุ่น

- โดยมุ่งเน้น

- ปฏิบัติตาม

- ตาม

- ดังต่อไปนี้

- ดังต่อไปนี้

- รอยพระบาท

- สำหรับ

- รูป

- พบ

- สี่

- กรอบ

- แช่แข็ง

- ราคาเริ่มต้นที่

- เต็ม

- นอกจากนี้

- รุ่น

- กำเนิด

- กำเนิด AI

- ได้รับ

- ให้

- Go

- ไป

- GPU

- ให้

- ฮาร์ดแวร์

- he

- ได้ยิน

- การช่วยเหลือ

- จะช่วยให้

- โปรดคลิกที่นี่เพื่ออ่านรายละเอียดเพิ่มเติม

- จุดสูง

- ประสิทธิภาพสูง

- ของเขา

- เจ้าภาพ

- เป็นเจ้าภาพ

- โฮสติ้ง

- บ้าน

- สรุป ความน่าเชื่อถือของ Olymp Trade?

- ทำอย่างไร

- อย่างไรก็ตาม

- HTML

- ที่ http

- HTTPS

- ID

- if

- ภาพ

- การดำเนินการ

- การดำเนินการ

- in

- ประกอบด้วย

- รวมถึง

- รวมทั้ง

- ที่เพิ่มขึ้น

- อิสระ

- อุตสาหกรรม

- ข้อมูล

- นวัตกรรม

- อินพุต

- ปัจจัยการผลิต

- ตัวอย่าง

- คำแนะนำการใช้

- ประกัน

- แบบบูรณาการ

- รวม

- เข้าไป

- แนะนำ

- IT

- การย้ำ

- ITS

- ชวา

- การเดินทาง

- jpg

- JSON

- เก็บ

- คีย์

- ชุด (SDK)

- ภาษา

- ใหญ่

- ที่มีขนาดใหญ่

- ล่าสุด

- เปิดตัว

- ชั้น

- ชั้น

- การเรียนรู้

- ความยาว

- ชั้น

- ห้องสมุด

- ห้องสมุด

- วงจรชีวิต

- กดไลก์

- ยอดไลก์

- Line

- รายการ

- ดูรายละเอียด

- LLM

- โหลด

- โหลด

- ที่ตั้ง

- อีกต่อไป

- ความรัก

- ลด

- เครื่อง

- เรียนรู้เครื่อง

- หลัก

- รักษา

- ทำ

- การจัดการ

- หลาย

- การเพิ่ม

- หน่วยความจำ

- ผสาน

- วิธี

- วิธีการ

- อาจ

- ML

- แบบ

- โมเดล

- โมดูล

- การตรวจสอบ

- ข้อมูลเพิ่มเติม

- มากที่สุด

- มาก

- หลาย

- ชื่อ

- ที่

- จำเป็นต้อง

- เครือข่าย

- การรับส่งข้อมูลเครือข่าย

- เครือข่าย

- ใหม่

- ไม่

- รางวัลโนเบล

- ไม่มี

- หมายเหตุ

- จำนวน

- of

- on

- ONE

- เพียง

- ไปยัง

- เปิด

- โอเพนซอร์ส

- การดำเนินการ

- การเพิ่มประสิทธิภาพ

- เพิ่มประสิทธิภาพ

- การปรับให้เหมาะสม

- ตัวเลือกเสริม (Option)

- Options

- or

- อื่นๆ

- มิฉะนั้น

- ของเรา

- ผล

- โครงร่าง

- เอาท์พุต

- ด้านนอก

- เกิน

- ของตนเอง

- แพ็คเกจ

- กระดาษ

- Parallel

- พารามิเตอร์

- พารามิเตอร์

- ส่วนหนึ่ง

- ส่วน

- ส่ง

- หลงใหล

- เส้นทาง

- การปฏิบัติ

- ดำเนินการ

- แผนการ

- เพลโต

- เพลโตดาต้าอินเทลลิเจนซ์

- เพลโตดาต้า

- กรุณา

- ยอดนิยม

- โพสต์

- โพสต์

- อำนาจ

- ขับเคลื่อน

- การปฏิบัติ

- ความแม่นยำ

- คำทำนาย

- การคาดการณ์

- Predictor

- ข้อกำหนดเบื้องต้น

- ส่วนตัว

- รางวัล

- ปัญหา

- กระบวนการ

- ก่อ

- การผลิต

- สัญญา

- คุณสมบัติ

- ให้

- สาธารณชน

- การตีพิมพ์

- หลาม

- ไฟฉาย

- พิสัย

- ตั้งแต่

- ค่อนข้าง

- อ่าน

- ผู้อ่าน

- การอ่าน

- ที่ได้รับ

- เมื่อเร็ว ๆ นี้

- แนะนำ

- ลด

- อ้างอิง

- หมายถึง

- กรุ

- ขอ

- การร้องขอ

- จำเป็นต้องใช้

- ต้อง

- การวิจัย

- แหล่งข้อมูล

- คำตอบ

- การตอบสนอง

- ขวา

- วิ่ง

- วิ่ง

- เสียสละ

- sagemaker

- ลด

- ขนาด

- ปรับ

- ขอบเขต

- SDK

- ไร้รอยต่อ

- ที่สอง

- รุ่นที่สอง

- Section

- ความปลอดภัย

- เห็น

- การส่ง

- ระดับอาวุโส

- ลำดับ

- ให้บริการ

- บริการ

- บริการ

- การให้บริการ

- ชุด

- การตั้งค่า

- การติดตั้ง

- หลาย

- สั้น

- แสดง

- แสดงให้เห็นว่า

- แสดง

- แสดงให้เห็นว่า

- ตั้งแต่

- เดียว

- ขนาด

- เล็ก

- เศษเล็กเศษน้อย

- So

- ซอฟต์แวร์

- การพัฒนาซอฟต์แวร์

- ชุดพัฒนาซอฟต์แวร์

- ทางออก

- โซลูชัน

- บางครั้ง

- แหล่ง

- แหล่งที่มา

- ผู้เชี่ยวชาญ

- โดยเฉพาะ

- ที่ระบุไว้

- มาตรฐาน

- ข้อความที่เริ่ม

- ทางสถิติ

- เข้าพัก

- ขั้นตอน

- ขั้นตอน

- เก็บไว้

- สตูดิโอ

- ประสบความสำเร็จ

- อย่างเช่น

- สนับสนุน

- ที่สนับสนุน

- รองรับ

- งาน

- การเรียนการสอน

- เทคนิค

- เทคนิค

- tensorflow

- การทดสอบ

- ข้อความ

- ที่

- พื้นที่

- ของพวกเขา

- พวกเขา

- แล้วก็

- ล้อยางขัดเหล่านี้ติดตั้งบนแกน XNUMX (มม.) ผลิตภัณฑ์นี้ถูกผลิตในหลายรูปทรง และหลากหลายเบอร์ความแน่นหนาของปริมาณอนุภาคขัดของมัน จะทำให้ท่านได้รับประสิทธิภาพสูงในการขัดและการใช้งานที่ยาวนาน

- นี้

- ตลอด

- ทิม

- เวลา

- ไปยัง

- โทเค็น

- ราชสกุล

- เกินไป

- ด้านบน

- หัวข้อ

- ไฟฉาย

- การจราจร

- รถไฟ

- ผ่านการฝึกอบรม

- การฝึกอบรม

- หม้อแปลงไฟฟ้า

- ล้านล้าน

- จริง

- ลอง

- ติดตามความคืบหน้า

- จูน

- สอง

- ชนิด

- การปรับปรุง

- อัปโหลด

- URL

- ใช้

- มือสอง

- ผู้ใช้งาน

- ประสบการณ์ของผู้ใช้

- การใช้

- มักจะ

- ตรวจสอบความถูกต้อง

- การตรวจสอบ

- รุ่น

- ผ่านทาง

- เสมือน

- เดิน

- คำแนะนำ

- ต้องการ

- คือ

- we

- เว็บ

- บริการเว็บ

- น้ำหนัก

- ดี

- อะไร

- ความหมายของ

- ที่

- ในขณะที่

- จะ

- กับ

- ภายใน

- ไม่มี

- งาน

- ผู้ปฏิบัติงาน

- ขั้นตอนการทำงาน

- เขียน

- การเขียน

- คุณ

- ของคุณ

- ลมทะเล