ในยุคข้อมูลปัจจุบัน ข้อมูลจำนวนมหาศาลที่เก็บไว้ในเอกสารจำนวนนับไม่ถ้วนถือเป็นทั้งความท้าทายและโอกาสสำหรับธุรกิจ วิธีการประมวลผลเอกสารแบบเดิมๆ มักจะขาดประสิทธิภาพและความแม่นยำ ทำให้เหลือพื้นที่สำหรับนวัตกรรม ความคุ้มทุน และการเพิ่มประสิทธิภาพ การประมวลผลเอกสารมีความก้าวหน้าอย่างมากจากการถือกำเนิดของ Intelligent Document Processing (IDP) ด้วย IDP ธุรกิจต่างๆ สามารถเปลี่ยนข้อมูลที่ไม่มีโครงสร้างจากเอกสารประเภทต่างๆ ให้เป็นข้อมูลเชิงลึกที่มีโครงสร้างและนำไปปฏิบัติได้ เพิ่มประสิทธิภาพได้อย่างมาก และลดความพยายามด้วยตนเอง อย่างไรก็ตาม ศักยภาพไม่ได้สิ้นสุดเพียงแค่นั้น ด้วยการบูรณาการปัญญาประดิษฐ์ (AI) ทั่วไปเข้ากับกระบวนการนี้ เราจะสามารถเพิ่มขีดความสามารถของ IDP ต่อไปได้ Generative AI ไม่เพียงแต่นำเสนอความสามารถที่ได้รับการปรับปรุงในการประมวลผลเอกสารเท่านั้น แต่ยังแนะนำความสามารถในการปรับตัวแบบไดนามิกเพื่อเปลี่ยนแปลงรูปแบบข้อมูลอีกด้วย โพสต์นี้จะนำคุณไปสู่การทำงานร่วมกันของ IDP และ AI เชิงสร้างสรรค์ โดยเผยให้เห็นว่าพวกเขาเป็นตัวแทนของขอบเขตถัดไปในการประมวลผลเอกสารอย่างไร

เราหารือเกี่ยวกับ IDP โดยละเอียดในซีรีส์การประมวลผลเอกสารอัจฉริยะด้วยบริการ AWS AI (1 หมายเลข และ 2 หมายเลข). ในโพสต์นี้ เราจะหารือถึงวิธีการขยายสถาปัตยกรรม IDP ใหม่หรือที่มีอยู่ด้วยโมเดลภาษาขนาดใหญ่ (LLM) โดยเฉพาะอย่างยิ่ง เราจะหารือถึงวิธีการบูรณาการ Amazon Text กับ หลังเชน เป็นตัวโหลดเอกสารและ อเมซอน เบดร็อค เพื่อดึงข้อมูลจากเอกสารและใช้ความสามารถด้าน AI เชิงสร้างสรรค์ภายในระยะ IDP ต่างๆ

Amazon Textract เป็นบริการ Machine Learning (ML) ที่จะแยกข้อความ ลายมือ และข้อมูลจากเอกสารที่สแกนโดยอัตโนมัติ Amazon Bedrock เป็นบริการที่มีการจัดการเต็มรูปแบบซึ่งนำเสนอตัวเลือกโมเดลพื้นฐาน (FM) ที่มีประสิทธิภาพสูงผ่าน API ที่ใช้งานง่าย

แผนภาพต่อไปนี้เป็นสถาปัตยกรรมอ้างอิงระดับสูงที่อธิบายวิธีที่คุณสามารถปรับปรุงเวิร์กโฟลว์ IDP ด้วยแบบจำลองพื้นฐานเพิ่มเติมได้ คุณสามารถใช้ LLM ในหนึ่งหรือทุกระยะของ IDP ขึ้นอยู่กับกรณีการใช้งานและผลลัพธ์ที่ต้องการ

ในส่วนต่อไปนี้ เราจะเจาะลึกเกี่ยวกับวิธีการผสานรวม Amazon Textract เข้ากับเวิร์กโฟลว์ AI เชิงสร้างสรรค์โดยใช้ LangChain เพื่อประมวลผลเอกสารสำหรับแต่ละงานเฉพาะเหล่านี้ บล็อกโค้ดที่ให้ไว้ที่นี่ถูกตัดออกเพื่อความกระชับ อ้างถึงของเรา พื้นที่เก็บข้อมูล GitHub สำหรับสมุดบันทึก Python โดยละเอียดและคำแนะนำแบบทีละขั้นตอน

การแยกข้อความออกจากเอกสารเป็นส่วนสำคัญในการประมวลผลเอกสารด้วย LLM คุณสามารถใช้ Amazon Textract เพื่อแยกข้อความดิบที่ไม่มีโครงสร้างออกจากเอกสารและเก็บรักษาออบเจ็กต์กึ่งโครงสร้างหรือโครงสร้างเดิม เช่น คู่คีย์-ค่าและตารางที่มีอยู่ในเอกสาร แพคเกจเอกสาร เช่น การเรียกร้องค่ารักษาพยาบาลและการประกัน หรือการจำนองประกอบด้วยรูปแบบที่ซับซ้อนซึ่งมีข้อมูลจำนวนมากในรูปแบบที่มีโครงสร้าง กึ่งมีโครงสร้าง และไม่มีโครงสร้าง การแยกเอกสารเป็นขั้นตอนสำคัญที่นี่ เนื่องจาก LLM ได้รับประโยชน์จากเนื้อหาที่หลากหลายเพื่อสร้างการตอบสนองที่แม่นยำและเกี่ยวข้องมากขึ้น ซึ่งอาจส่งผลกระทบต่อคุณภาพของผลงานของ LLM

LangChain เป็นเฟรมเวิร์กโอเพ่นซอร์สที่ทรงพลังสำหรับการบูรณาการกับ LLM LLM โดยทั่วไปมีความหลากหลาย แต่อาจประสบปัญหากับงานเฉพาะโดเมนซึ่งจำเป็นต้องมีบริบทที่ลึกซึ้งและการตอบสนองที่เหมาะสมยิ่ง LangChain ช่วยให้นักพัฒนาในสถานการณ์ดังกล่าวสามารถสร้างตัวแทนที่สามารถแบ่งงานที่ซับซ้อนออกเป็นงานย่อยที่มีขนาดเล็กลงได้ งานย่อยสามารถแนะนำบริบทและหน่วยความจำใน LLM โดยการเชื่อมต่อและเชื่อมโยงพร้อมท์ LLM

ข้อเสนอของ LangChain ตัวโหลดเอกสาร ที่สามารถโหลดและแปลงข้อมูลจากเอกสารได้ คุณสามารถใช้เอกสารเหล่านี้เพื่อจัดโครงสร้างเอกสารให้อยู่ในรูปแบบที่ต้องการซึ่ง LLM สามารถประมวลผลได้ ที่ AmazonTextractPDFLoader คือตัวโหลดบริการประเภทตัวโหลดเอกสารที่ให้วิธีที่รวดเร็วในการประมวลผลเอกสารอัตโนมัติโดยใช้ Amazon Textract ร่วมกับ LangChain สำหรับรายละเอียดเพิ่มเติมเกี่ยวกับ AmazonTextractPDFLoaderอ้างถึง หลังเชน เอกสารประกอบ หากต้องการใช้ตัวโหลดเอกสาร Amazon Textract คุณต้องเริ่มต้นด้วยการนำเข้าจากไลบรารี LangChain:

from langchain.document_loaders import AmazonTextractPDFLoaderhttps_loader = AmazonTextractPDFLoader("https://sample-website.com/sample-doc.pdf")

https_document = https_loader.load() s3_loader = AmazonTextractPDFLoader("s3://sample-bucket/sample-doc.pdf")

s3_document = s3_loader.load()คุณยังสามารถจัดเก็บเอกสารใน Amazon S3 และอ้างอิงเอกสารเหล่านั้นได้โดยใช้รูปแบบ s3:// URL ตามที่อธิบายไว้ใน การเข้าถึงบัคเก็ตโดยใช้ S3://และส่งเส้นทาง S3 นี้ไปยังตัวโหลด Amazon Textract PDF:

import boto3

textract_client = boto3.client('textract', region_name='us-east-2') file_path = "s3://amazon-textract-public-content/langchain/layout-parser-paper.pdf"

loader = AmazonTextractPDFLoader(file_path, client=textract_client)

documents = loader.load()เอกสารหลายหน้าจะมีข้อความหลายหน้า ซึ่งสามารถเข้าถึงได้ผ่านออบเจ็กต์เอกสาร ซึ่งเป็นรายการหน้า โค้ดต่อไปนี้วนซ้ำหน้าต่างๆ ในออบเจ็กต์เอกสารและพิมพ์ข้อความในเอกสารซึ่งมีให้ใช้งานผ่านทาง page_content แอตทริบิวต์:

print(len(documents)) for document in documents: print(document.page_content)Amazon Comprehend และ LLM สามารถนำไปใช้ในการจำแนกประเภทเอกสารได้อย่างมีประสิทธิภาพ Amazon Comprehend เป็นบริการประมวลผลภาษาธรรมชาติ (NLP) ที่ใช้ ML เพื่อดึงข้อมูลเชิงลึกจากข้อความ Amazon Comprehend ยังรองรับการฝึกโมเดลการจัดหมวดหมู่แบบกำหนดเองด้วยการรับรู้เค้าโครงในเอกสาร เช่น PDF, Word และรูปแบบรูปภาพ สำหรับข้อมูลเพิ่มเติมเกี่ยวกับการใช้ตัวแยกประเภทเอกสาร Amazon Comprehend โปรดดูที่ ตัวแยกประเภทเอกสาร Amazon Comprehend เพิ่มการรองรับเค้าโครงเพื่อความแม่นยำที่สูงขึ้น.

เมื่อจับคู่กับ LLM การจัดประเภทเอกสารจะกลายเป็นแนวทางที่มีประสิทธิภาพในการจัดการเอกสารปริมาณมาก LLM มีประโยชน์ในการจำแนกเอกสารเนื่องจากสามารถวิเคราะห์ข้อความ รูปแบบ และองค์ประกอบตามบริบทในเอกสารโดยใช้ความเข้าใจภาษาธรรมชาติ คุณยังสามารถปรับแต่งให้เหมาะกับคลาสเอกสารเฉพาะได้อีกด้วย เมื่อเอกสารประเภทใหม่ในไปป์ไลน์ IDP จำเป็นต้องมีการจัดประเภท LLM จะสามารถประมวลผลข้อความและจัดหมวดหมู่เอกสารตามชุดของคลาสได้ ต่อไปนี้เป็นโค้ดตัวอย่างที่ใช้ตัวโหลดเอกสาร LangChain ที่ขับเคลื่อนโดย Amazon Textract เพื่อแยกข้อความออกจากเอกสารและใช้เพื่อจัดประเภทเอกสาร เราใช้ มานุษยวิทยาคลอดด์ v2 จำลองผ่าน Amazon Bedrock เพื่อดำเนินการจัดหมวดหมู่

ในตัวอย่างต่อไปนี้ ขั้นแรกเราจะแยกข้อความออกจากรายงานการจำหน่ายผู้ป่วย และใช้ LLM เพื่อจำแนกประเภทโดยพิจารณาจากรายการเอกสารสามประเภทที่แตกต่างกัน—DISCHARGE_SUMMARY, RECEIPTและ PRESCRIPTION. ภาพหน้าจอต่อไปนี้แสดงรายงานของเรา

from langchain.document_loaders import AmazonTextractPDFLoader

from langchain.llms import Bedrock

from langchain.prompts import PromptTemplate

from langchain.chains import LLMChain loader = AmazonTextractPDFLoader("./samples/document.png")

document = loader.load() template = """ Given a list of classes, classify the document into one of these classes. Skip any preamble text and just give the class name. <classes>DISCHARGE_SUMMARY, RECEIPT, PRESCRIPTION</classes>

<document>{doc_text}<document>

<classification>""" prompt = PromptTemplate(template=template, input_variables=["doc_text"])

bedrock_llm = Bedrock(client=bedrock, model_id="anthropic.claude-v2") llm_chain = LLMChain(prompt=prompt, llm=bedrock_llm)

class_name = llm_chain.run(document[0].page_content) print(f"The provided document is = {class_name}")

การสรุปเกี่ยวข้องกับการย่อข้อความหรือเอกสารที่กำหนดให้เป็นเวอร์ชันที่สั้นลงโดยยังคงรักษาข้อมูลสำคัญไว้ เทคนิคนี้มีประโยชน์สำหรับการดึงข้อมูลที่มีประสิทธิภาพ ซึ่งช่วยให้ผู้ใช้สามารถเข้าใจประเด็นสำคัญของเอกสารได้อย่างรวดเร็วโดยไม่ต้องอ่านเนื้อหาทั้งหมด แม้ว่า Amazon Textract จะไม่ดำเนินการสรุปข้อความโดยตรง แต่ก็มีความสามารถพื้นฐานในการแยกข้อความทั้งหมดออกจากเอกสาร ข้อความที่แยกออกมานี้ทำหน้าที่เป็นอินพุตให้กับโมเดล LLM ของเราสำหรับการดำเนินการสรุปข้อความ

โดยใช้รายงานการปล่อยตัวอย่างเดียวกันที่เราใช้ AmazonTextractPDFLoader เพื่อดึงข้อความจากเอกสารนี้ เช่นเคย เราใช้โมเดล Claude v2 ผ่าน Amazon Bedrock และเริ่มต้นด้วยข้อความแจ้งที่มีคำแนะนำว่าจะทำอย่างไรกับข้อความ (ในกรณีนี้คือการสรุป) สุดท้าย เรารัน LLM chain โดยส่งข้อความที่แยกออกมาจากตัวโหลดเอกสาร สิ่งนี้จะเรียกใช้การดำเนินการอนุมานบน LLM พร้อมข้อความที่ประกอบด้วยคำแนะนำในการสรุป และข้อความของเอกสารที่ทำเครื่องหมายด้วย Document. ดูรหัสต่อไปนี้:

รหัสสร้างข้อมูลสรุปของรายงานสรุปการจำหน่ายผู้ป่วย:

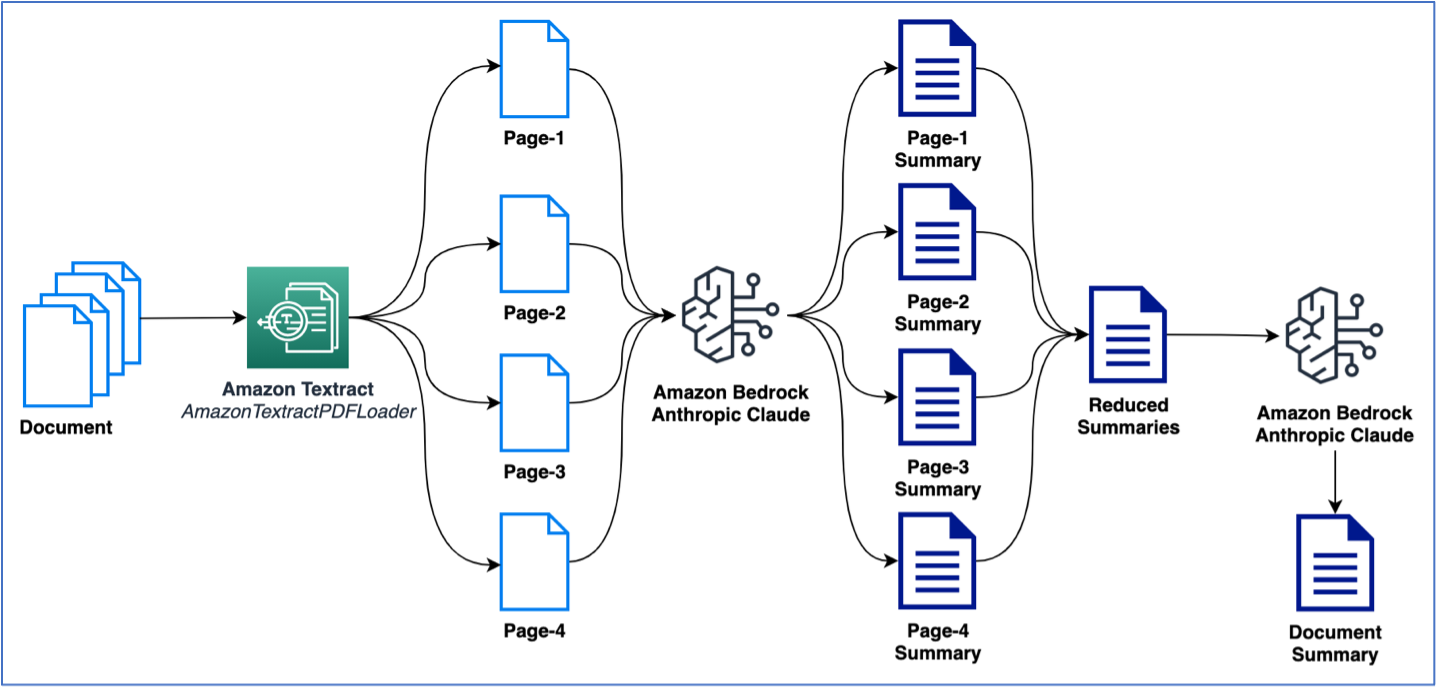

ตัวอย่างก่อนหน้านี้ใช้เอกสารหน้าเดียวเพื่อดำเนินการสรุป อย่างไรก็ตาม คุณอาจจะต้องจัดการกับเอกสารที่มีหลายหน้าซึ่งจำเป็นต้องมีการสรุป วิธีทั่วไปในการสรุปข้อมูลในหลายหน้าคือการสร้างข้อมูลสรุปจากข้อความที่มีขนาดเล็กก่อน จากนั้นจึงรวมข้อมูลสรุปที่มีขนาดเล็กเพื่อให้ได้ข้อมูลสรุปขั้นสุดท้ายของเอกสาร โปรดทราบว่าวิธีนี้จำเป็นต้องมีการเรียก LLM หลายครั้ง ตรรกะสำหรับสิ่งนี้สามารถสร้างขึ้นมาได้อย่างง่ายดาย อย่างไรก็ตาม LangChain มีสายการสรุปในตัวที่สามารถสรุปข้อความขนาดใหญ่ (จากเอกสารหลายหน้า) การสรุปสามารถเกิดขึ้นได้ทั้งทาง map_reduce หรือกับ stuff ตัวเลือกซึ่งมีให้เป็นตัวเลือกในการจัดการการโทรหลายครั้งไปยัง LLM ในตัวอย่างต่อไปนี้ เราใช้ map_reduce เพื่อสรุปเอกสารหลายหน้า รูปต่อไปนี้แสดงให้เห็นถึงขั้นตอนการทำงานของเรา

ขั้นแรกให้เริ่มต้นด้วยการแยกเอกสารและดูจำนวนโทเค็นทั้งหมดต่อหน้าและจำนวนหน้าทั้งหมด:

ต่อไปเราใช้บิวท์อินของ LangChain load_summarize_chain เพื่อสรุปเอกสารทั้งหมด:

from langchain.chains.summarize import load_summarize_chain summary_chain = load_summarize_chain(llm=bedrock_llm, chain_type='map_reduce')

output = summary_chain.run(document)

print(output.strip())การกำหนดมาตรฐานและการถามตอบ

ในส่วนนี้ เราจะหารือเกี่ยวกับงานมาตรฐานและงานถามตอบ

มาตรฐาน

การกำหนดมาตรฐานเอาต์พุตเป็นงานสร้างข้อความที่ใช้ LLM เพื่อจัดรูปแบบข้อความเอาต์พุตที่สอดคล้องกัน งานนี้มีประโยชน์อย่างยิ่งสำหรับระบบอัตโนมัติของการแยกเอนทิตีคีย์ที่ต้องการให้เอาต์พุตสอดคล้องกับรูปแบบที่ต้องการ ตัวอย่างเช่น เราสามารถปฏิบัติตามแนวทางปฏิบัติที่ดีที่สุดในด้านวิศวกรรมโดยทันทีเพื่อปรับแต่ง LLM เพื่อจัดรูปแบบวันที่เป็นรูปแบบ ดด/วว/ปปปป ซึ่งอาจเข้ากันได้กับคอลัมน์ DATE ของฐานข้อมูล บล็อกโค้ดต่อไปนี้แสดงตัวอย่างวิธีการดำเนินการโดยใช้ LLM และวิศวกรรมพร้อมท์ เราไม่เพียงแต่สร้างมาตรฐานให้กับรูปแบบเอาต์พุตสำหรับค่าวันที่เท่านั้น เรายังแจ้งให้โมเดลสร้างเอาต์พุตสุดท้ายในรูปแบบ JSON เพื่อให้สามารถใช้งานได้อย่างง่ายดายในแอปพลิเคชันดาวน์สตรีมของเรา เราใช้ ภาษานิพจน์ LangChain (LCE) เพื่อเชื่อมโยงสองการกระทำเข้าด้วยกัน การดำเนินการแรกจะแจ้งให้ LLM สร้างเอาต์พุตรูปแบบ JSON เฉพาะวันที่จากเอกสาร การดำเนินการที่สองจะใช้เอาต์พุต JSON และสร้างมาตรฐานให้กับรูปแบบวันที่ โปรดทราบว่าการดำเนินการสองขั้นตอนนี้อาจดำเนินการในขั้นตอนเดียวด้วยวิศวกรรมที่เหมาะสม ดังที่เราจะเห็นในการทำให้เป็นมาตรฐานและการสร้างเทมเพลต

ผลลัพธ์ของตัวอย่างโค้ดก่อนหน้าเป็นโครงสร้าง JSON ที่มีวันที่ 07/09/2020 และ 08/09/2020 ซึ่งอยู่ในรูปแบบ DD/MM/YYYY และเป็นวันที่ผู้ป่วยรับเข้าและออกจากโรงพยาบาล ตามลำดับ ตาม ไปยังรายงานสรุปการจำหน่าย

ถาม & ตอบกับรุ่น Augmented การดึงข้อมูล

LLM เป็นที่รู้กันว่าเก็บข้อมูลที่เป็นข้อเท็จจริง ซึ่งมักเรียกว่าความรู้โลกหรือมุมมองโลก เมื่อปรับแต่งอย่างละเอียด ก็จะสามารถสร้างผลลัพธ์ที่ล้ำสมัยได้ อย่างไรก็ตาม มีข้อจำกัดว่า LLM สามารถเข้าถึงและจัดการความรู้นี้ได้อย่างมีประสิทธิภาพเพียงใด ด้วยเหตุนี้ ในงานที่ต้องอาศัยความรู้เฉพาะอย่างมาก ประสิทธิภาพอาจไม่เหมาะสมกับกรณีการใช้งานบางกรณี ตัวอย่างเช่น ในสถานการณ์ถามตอบ จำเป็นอย่างยิ่งที่แบบจำลองจะต้องปฏิบัติตามบริบทที่ให้ไว้ในเอกสารอย่างเคร่งครัด โดยไม่ต้องอาศัยความรู้ระดับโลกเพียงอย่างเดียว การเบี่ยงเบนจากสิ่งนี้อาจนำไปสู่การบิดเบือนความจริง ความไม่ถูกต้อง หรือแม้แต่คำตอบที่ไม่ถูกต้อง วิธีการที่ใช้บ่อยที่สุดเพื่อแก้ไขปัญหานี้เรียกว่า การดึงข้อมูล Augmented Generation (แร็ก). แนวทางนี้ประสานจุดแข็งของทั้งแบบจำลองการดึงข้อมูลและแบบจำลองภาษา ช่วยเพิ่มความแม่นยำและคุณภาพของการตอบสนองที่สร้างขึ้น

LLM ยังสามารถกำหนดข้อจำกัดของโทเค็นได้เนื่องจากข้อจำกัดของหน่วยความจำและข้อจำกัดของฮาร์ดแวร์ที่ทำงานอยู่ เพื่อจัดการกับปัญหานี้ มีการใช้เทคนิคต่างๆ เช่น การแบ่งส่วนเพื่อแบ่งเอกสารขนาดใหญ่ออกเป็นส่วนเล็กๆ ที่อยู่ภายในขีดจำกัดโทเค็นของ LLM ในทางกลับกัน การฝังถูกนำมาใช้ใน NLP เป็นหลักเพื่อจับความหมายเชิงความหมายของคำและความสัมพันธ์กับคำอื่นๆ ในพื้นที่มิติสูง การฝังเหล่านี้แปลงคำให้เป็นเวกเตอร์ ช่วยให้โมเดลสามารถประมวลผลและทำความเข้าใจข้อมูลที่เป็นข้อความได้อย่างมีประสิทธิภาพ โดยการทำความเข้าใจความแตกต่างทางความหมายระหว่างคำและวลี การฝังช่วยให้ LLM สามารถสร้างผลลัพธ์ที่สอดคล้องกันและเกี่ยวข้องกับบริบท โปรดสังเกตคำศัพท์สำคัญต่อไปนี้:

- การจัดเป็นกลุ่ม – กระบวนการนี้จะแบ่งข้อความจำนวนมากจากเอกสารออกเป็นส่วนย่อยๆ ของข้อความที่มีความหมาย

- ฝัง – สิ่งเหล่านี้คือการแปลงเวกเตอร์มิติคงที่ของแต่ละชิ้นส่วนที่เก็บข้อมูลความหมายจากชิ้นส่วนต่างๆ การฝังเหล่านี้จะถูกโหลดลงในฐานข้อมูลเวกเตอร์ในภายหลัง

- ฐานข้อมูลเวกเตอร์ – เป็นฐานข้อมูลของการฝังคำหรือเวกเตอร์ที่แสดงถึงบริบทของคำ โดยทำหน้าที่เป็นแหล่งความรู้ที่ช่วยงาน NLP ในไปป์ไลน์การประมวลผลเอกสาร ประโยชน์ของฐานข้อมูลเวกเตอร์ที่นี่คืออนุญาตให้เฉพาะบริบทที่จำเป็นเท่านั้นที่จะมอบให้กับ LLM ในระหว่างการสร้างข้อความ ดังที่เราอธิบายไว้ในส่วนต่อไปนี้

RAG ใช้พลังของการฝังเพื่อทำความเข้าใจและดึงส่วนเอกสารที่เกี่ยวข้องในระหว่างขั้นตอนการดึงข้อมูล ด้วยการทำเช่นนี้ RAG สามารถทำงานได้ภายในข้อจำกัดโทเค็นของ LLM ทำให้มั่นใจได้ว่าข้อมูลที่เกี่ยวข้องมากที่สุดจะถูกเลือกสำหรับการสร้าง ส่งผลให้ผลลัพธ์มีความแม่นยำและเกี่ยวข้องกับบริบทมากขึ้น

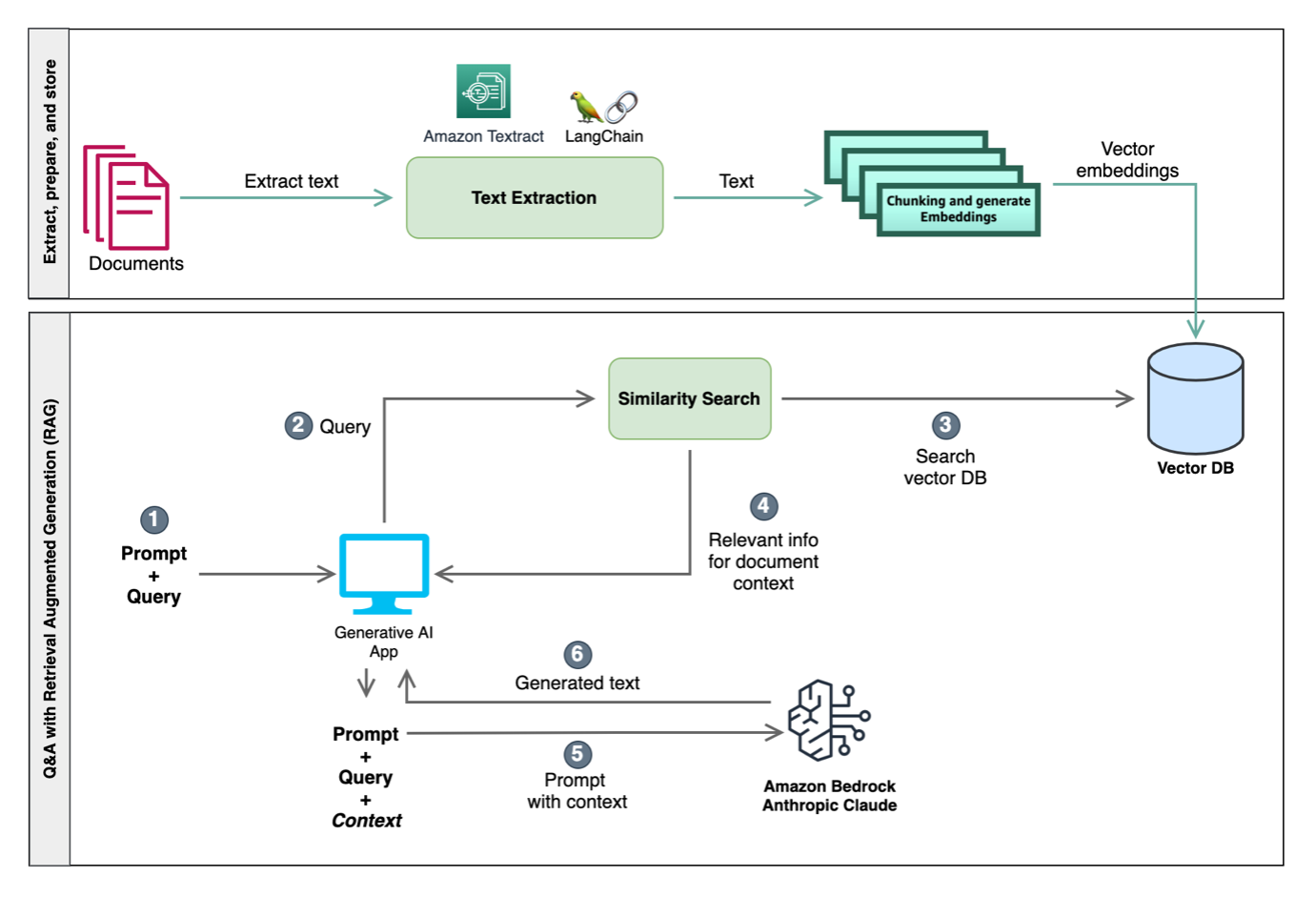

แผนภาพต่อไปนี้แสดงให้เห็นถึงการบูรณาการเทคนิคเหล่านี้เพื่อสร้างอินพุตให้กับ LLM ช่วยเพิ่มความเข้าใจในบริบท และช่วยให้สามารถตอบสนองต่อบริบทที่เกี่ยวข้องได้มากขึ้น วิธีหนึ่งเกี่ยวข้องกับการค้นหาความคล้ายคลึงกัน โดยใช้ทั้งฐานข้อมูลเวกเตอร์และการแยกส่วน ฐานข้อมูลเวกเตอร์จัดเก็บการฝังที่แสดงข้อมูลเชิงความหมาย และการแบ่งส่วนจะแบ่งข้อความออกเป็นส่วนต่างๆ ที่สามารถจัดการได้ การใช้บริบทนี้จากการค้นหาความคล้ายคลึง LLM สามารถรันงานต่างๆ เช่น การตอบคำถาม และการดำเนินการเฉพาะโดเมน เช่น การจำแนกประเภทและการเพิ่มคุณค่า

สำหรับโพสต์นี้ เราใช้วิธีการแบบ RAG เพื่อดำเนินการถามตอบในบริบทด้วยเอกสาร ในตัวอย่างโค้ดต่อไปนี้ เราจะแยกข้อความออกจากเอกสารแล้วแยกเอกสารออกเป็นข้อความชิ้นเล็กๆ จำเป็นต้องมีการแบ่งส่วนเนื่องจากเราอาจมีเอกสารหลายหน้าขนาดใหญ่ และ LLM ของเราอาจมีขีดจำกัดโทเค็น จากนั้นชิ้นส่วนเหล่านี้จะถูกโหลดลงในฐานข้อมูลเวกเตอร์เพื่อทำการค้นหาความคล้ายคลึงกันในขั้นตอนต่อๆ ไป ในตัวอย่างต่อไปนี้ เราใช้โมเดล Amazon Titan Embed Text v1 ซึ่งทำการฝังเวกเตอร์ของชิ้นเอกสาร:

โค้ดจะสร้างบริบทที่เกี่ยวข้องสำหรับ LLM โดยใช้ข้อความบางส่วนที่ส่งคืนโดยการดำเนินการค้นหาความคล้ายคลึงจากฐานข้อมูลเวกเตอร์ สำหรับตัวอย่างนี้ เราใช้โอเพ่นซอร์ส ร้านเวกเตอร์ FAISS เป็นฐานข้อมูลเวกเตอร์ตัวอย่างเพื่อจัดเก็บการฝังเวกเตอร์ของข้อความแต่ละชิ้น จากนั้นเรากำหนดฐานข้อมูลเวกเตอร์เป็น แลงเชน รีทรีฟเวอร์ซึ่งส่งผ่านเข้าสู่ RetrievalQA โซ่. สิ่งนี้จะเรียกใช้คำค้นหาที่คล้ายกันเป็นการภายในบนฐานข้อมูลเวกเตอร์ที่ส่งคืนข้อความด้านบน n (โดยที่ n=3 ในตัวอย่างของเรา) เป็นข้อความที่เกี่ยวข้องกับคำถาม สุดท้ายนี้ LLM chain จะดำเนินการพร้อมกับบริบทที่เกี่ยวข้อง (กลุ่มของข้อความที่เกี่ยวข้อง) และคำถามสำหรับ LLM ที่จะตอบ สำหรับการแนะนำโค้ดแบบทีละขั้นตอนของการถามตอบด้วย RAG โปรดดูที่สมุดบันทึก Python GitHub.

เป็นทางเลือกแทน FAISS คุณยังสามารถใช้ ความสามารถฐานข้อมูลเวกเตอร์ของ Amazon OpenSearch Service, บริการฐานข้อมูลเชิงสัมพันธ์ของ Amazon (Amazon RDS) สำหรับ PostgreSQL กับ pgvector ส่วนขยายเป็นฐานข้อมูลเวกเตอร์หรือฐานข้อมูล Chroma แบบโอเพ่นซอร์ส

ถามตอบพร้อมข้อมูลแบบตาราง

ข้อมูลแบบตารางภายในเอกสารอาจเป็นเรื่องยากสำหรับ LLM ในการประมวลผลเนื่องจากความซับซ้อนของโครงสร้าง สามารถเพิ่ม Amazon Textract ด้วย LLM ได้ เนื่องจากทำให้สามารถแยกตารางออกจากเอกสารในรูปแบบองค์ประกอบที่ซ้อนกัน เช่น หน้า ตาราง และเซลล์ การถามตอบด้วยข้อมูลแบบตารางเป็นกระบวนการที่มีหลายขั้นตอน และสามารถทำได้ผ่านทาง การสอบถามตนเอง. ต่อไปนี้เป็นภาพรวมของขั้นตอนต่างๆ:

- แยกตารางออกจากเอกสารโดยใช้ Amazon Textract ด้วย Amazon Textract โครงสร้างแบบตาราง (แถว คอลัมน์ ส่วนหัว) สามารถแยกออกจากเอกสารได้

- จัดเก็บข้อมูลแบบตารางลงในฐานข้อมูลเวกเตอร์พร้อมกับข้อมูลเมตาดาต้า เช่น ชื่อส่วนหัวและคำอธิบายของแต่ละส่วนหัว

- ใช้พร้อมท์เพื่อสร้างแบบสอบถามที่มีโครงสร้างโดยใช้ LLM เพื่อรับข้อมูลจากตาราง

- ใช้แบบสอบถามเพื่อแยกข้อมูลตารางที่เกี่ยวข้องจากฐานข้อมูลเวกเตอร์

ตัวอย่างเช่น ในใบแจ้งยอดธนาคาร เมื่อได้รับข้อความแจ้งว่า “ธุรกรรมใดบ้างที่มีเงินฝากมากกว่า $1000” LLM จะดำเนินการตามขั้นตอนต่อไปนี้ให้เสร็จสิ้น:

- สร้างแบบสอบถาม เช่น

“Query: transactions” , “filter: greater than (Deposit$)”. - แปลงแบบสอบถามเป็นแบบสอบถามแบบมีโครงสร้าง

- ใช้การสืบค้นแบบมีโครงสร้างกับฐานข้อมูลเวกเตอร์ที่จัดเก็บข้อมูลตารางของเรา

สำหรับคำแนะนำแบบทีละขั้นตอนโค้ดตัวอย่างของการถามตอบแบบตาราง โปรดดูที่สมุดบันทึก Python GitHub.

การสร้างเทมเพลตและการทำให้เป็นมาตรฐาน

ในส่วนนี้ เราจะดูวิธีการใช้เทคนิคทางวิศวกรรมที่รวดเร็วและกลไกในตัวของ LangChain เพื่อสร้างเอาต์พุตที่มีการแตกไฟล์จากเอกสารใน schema ที่ระบุ นอกจากนี้เรายังดำเนินการสร้างมาตรฐานให้กับข้อมูลที่แยกออกมา โดยใช้เทคนิคที่กล่าวถึงก่อนหน้านี้ เราเริ่มต้นด้วยการกำหนดเทมเพลตสำหรับผลลัพธ์ที่เราต้องการ ซึ่งจะทำหน้าที่เป็นสคีมาและสรุปรายละเอียดเกี่ยวกับแต่ละเอนทิตีที่เราต้องการแยกออกจากข้อความในเอกสาร

โปรดทราบว่าสำหรับแต่ละเอนทิตี เราใช้คำอธิบายเพื่ออธิบายว่าเอนทิตีนั้นคืออะไรเพื่อช่วย LLM ในการดึงค่าออกจากข้อความของเอกสาร ในโค้ดตัวอย่างต่อไปนี้ เราใช้เทมเพลตนี้เพื่อสร้างพรอมต์ของเราสำหรับ LLM พร้อมกับข้อความที่แยกจากเอกสารโดยใช้ AmazonTextractPDFLoader และดำเนินการอนุมานด้วยแบบจำลองต่อไป:

ในขณะที่คุณสามารถดูที่ {keys} ส่วนหนึ่งของพรอมต์คือคีย์จากเทมเพลตของเรา และ {details} เป็นกุญแจพร้อมกับคำอธิบาย ในกรณีนี้ เราจะไม่แจ้งโมเดลอย่างชัดเจนด้วยรูปแบบของเอาต์พุตนอกเหนือจากที่ระบุไว้ในคำสั่งเพื่อสร้างเอาต์พุตในรูปแบบ JSON วิธีนี้ใช้ได้ผลเป็นส่วนใหญ่ อย่างไรก็ตาม เนื่องจากเอาต์พุตจาก LLM เป็นการสร้างข้อความที่ไม่สามารถกำหนดได้ เราจึงต้องการระบุรูปแบบอย่างชัดเจนโดยเป็นส่วนหนึ่งของคำสั่งในพร้อมท์ เพื่อแก้ปัญหานี้ เราสามารถใช้ LangChain's ได้ ตัวแยกวิเคราะห์เอาต์พุตที่มีโครงสร้าง โมดูลเพื่อใช้ประโยชน์จากวิศวกรรมพร้อมท์อัตโนมัติที่ช่วยแปลงเทมเพลตของเราเป็นพรอมต์คำสั่งรูปแบบ เราใช้เทมเพลตที่กำหนดไว้ก่อนหน้านี้เพื่อสร้างพรอมต์คำสั่งรูปแบบดังต่อไปนี้:

จากนั้นเราใช้ตัวแปรนี้ภายในพร้อมต์ดั้งเดิมของเราเป็นคำสั่งสำหรับ LLM เพื่อที่จะแยกและจัดรูปแบบเอาต์พุตในสคีมาที่ต้องการโดยทำการแก้ไขเล็กน้อยในพรอมต์ของเรา:

จนถึงตอนนี้ เราได้ดึงข้อมูลออกจากเอกสารในรูปแบบสคีมาที่ต้องการเท่านั้น อย่างไรก็ตาม เรายังจำเป็นต้องสร้างมาตรฐานบางประการ ตัวอย่างเช่น เราต้องการให้ดึงวันที่เข้ารับการรักษาและวันที่จำหน่ายของผู้ป่วยในรูปแบบ วว/ดด/ปปปป ในกรณีนี้ เราจะเพิ่ม description ของคีย์พร้อมคำสั่งการจัดรูปแบบ:

อ้างถึงสมุดบันทึก Python ใน GitHub สำหรับคำแนะนำและคำอธิบายแบบเต็มทีละขั้นตอน

การตรวจการสะกดและการแก้ไข

LLM ได้แสดงให้เห็นถึงความสามารถที่น่าทึ่งในการทำความเข้าใจและสร้างข้อความที่เหมือนมนุษย์ แอปพลิเคชั่น LLM ที่ได้รับการกล่าวถึงน้อยแต่มีประโยชน์อย่างมากก็คือศักยภาพในการตรวจสอบไวยากรณ์และการแก้ไขประโยคในเอกสาร แตกต่างจากเครื่องตรวจสอบไวยากรณ์แบบดั้งเดิมที่ต้องอาศัยชุดกฎที่กำหนดไว้ล่วงหน้า LLM ใช้รูปแบบที่ระบุได้จากข้อมูลข้อความจำนวนมหาศาลเพื่อกำหนดว่าภาษาใดถือเป็นภาษาที่ถูกต้องหรือคล่องแคล่ว ซึ่งหมายความว่าพวกเขาสามารถตรวจจับความแตกต่าง บริบท และรายละเอียดปลีกย่อยที่ระบบที่อิงกฎอาจพลาดได้

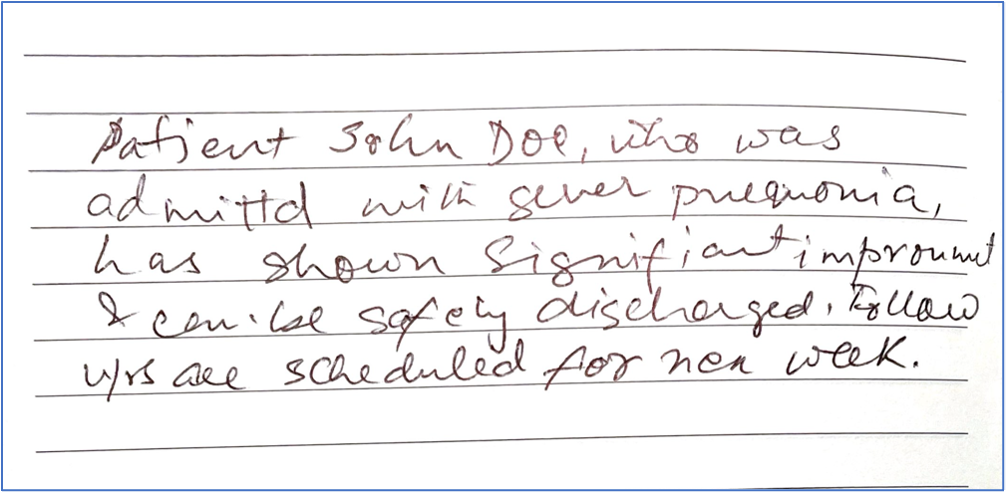

ลองนึกภาพข้อความที่ดึงมาจากสรุปการจำหน่ายผู้ป่วยซึ่งมีข้อความว่า "ผู้ป่วยจอน โด ซึ่งเข้ารับการรักษาด้วยโรคปอดบวมขั้นรุนแรง มีอาการดีขึ้นอย่างเห็นได้ชัด และสามารถออกจากโรงพยาบาลได้อย่างปลอดภัย การติดตามผลมีกำหนดในสัปดาห์หน้า” เครื่องตรวจการสะกดแบบดั้งเดิมอาจจดจำคำว่า "ยอมรับ" "โรคปอดบวม" "การปรับปรุง" และ "ต่อไป" ว่าเป็นข้อผิดพลาด อย่างไรก็ตาม บริบทของข้อผิดพลาดเหล่านี้อาจนำไปสู่ข้อผิดพลาดเพิ่มเติมหรือคำแนะนำทั่วไปได้ LLM ที่มาพร้อมกับการฝึกอบรมที่กว้างขวางอาจแนะนำว่า “ผู้ป่วย John Doe ซึ่งเข้ารับการรักษาด้วยโรคปอดบวมขั้นรุนแรง มีอาการดีขึ้นอย่างเห็นได้ชัดและสามารถออกจากโรงพยาบาลได้อย่างปลอดภัย การติดตามผลมีกำหนดในสัปดาห์หน้า”

ต่อไปนี้คือเอกสารตัวอย่างที่เขียนด้วยลายมือที่ไม่ดีซึ่งมีข้อความเดียวกับที่อธิบายไว้ก่อนหน้านี้

เราแยกเอกสารด้วยตัวโหลดเอกสาร Amazon Textract จากนั้นสั่ง LLM ผ่านทางวิศวกรรมทันที เพื่อแก้ไขข้อความที่แยกออกมาเพื่อแก้ไขการสะกดและหรือข้อผิดพลาดทางไวยากรณ์:

ผลลัพธ์ของโค้ดก่อนหน้าแสดงข้อความต้นฉบับที่แยกโดยตัวโหลดเอกสาร ตามด้วยข้อความที่แก้ไขที่สร้างโดย LLM:

โปรดจำไว้ว่า แม้ว่า LLM จะมีอำนาจก็ตาม การมองว่าคำแนะนำของพวกเขาเป็นเพียงคำแนะนำเท่านั้น แม้ว่าพวกเขาจะจับความซับซ้อนของภาษาได้อย่างน่าประทับใจ แต่ก็ไม่ได้ผิดพลาด คำแนะนำบางอย่างอาจเปลี่ยนความหมายหรือน้ำเสียงที่ตั้งใจไว้ของข้อความต้นฉบับ ดังนั้นจึงจำเป็นอย่างยิ่งที่ผู้ตรวจสอบที่เป็นมนุษย์จะต้องใช้การแก้ไขที่สร้างโดย LLM เพื่อเป็นแนวทาง ไม่ใช่โดยสมบูรณ์ การทำงานร่วมกันของสัญชาตญาณของมนุษย์กับความสามารถของ LLM สัญญาถึงอนาคตที่การสื่อสารที่เป็นลายลักษณ์อักษรของเราไม่เพียงปราศจากข้อผิดพลาด แต่ยังสมบูรณ์ยิ่งขึ้นและเหมาะสมยิ่งขึ้นอีกด้วย

สรุป

Generative AI กำลังเปลี่ยนแปลงวิธีที่คุณสามารถประมวลผลเอกสารด้วย IDP เพื่อรับข้อมูลเชิงลึก ในการโพสต์ เพิ่มประสิทธิภาพการประมวลผลเอกสารอัจฉริยะของ AWS ด้วย AI เชิงสร้างสรรค์เราได้พูดคุยถึงขั้นตอนต่างๆ ของไปป์ไลน์ และวิธีที่ Ricoh ลูกค้า AWS ปรับปรุงไปป์ไลน์ IDP ด้วย LLM ในโพสต์นี้ เราได้พูดคุยถึงกลไกต่างๆ ในการเพิ่มเวิร์กโฟลว์ IDP ด้วย LLM ผ่าน Amazon Bedrock, Amazon Textract และเฟรมเวิร์ก LangChain ยอดนิยม คุณสามารถเริ่มต้นใช้งานตัวโหลดเอกสาร Amazon Textract ใหม่ด้วย LangChain ได้แล้ววันนี้ โดยใช้สมุดบันทึกตัวอย่างที่มีอยู่ในของเรา พื้นที่เก็บข้อมูล GitHub. สำหรับข้อมูลเพิ่มเติมเกี่ยวกับการทำงานกับ Generative AI บน AWS โปรดดูที่ ประกาศเครื่องมือใหม่สำหรับการสร้างด้วย Generative AI บน AWS.

เกี่ยวกับผู้เขียน

โซนาลี ซาฮู เป็นผู้นำการประมวลผลเอกสารอัจฉริยะด้วยทีมบริการ AI/ML ใน AWS เธอเป็นนักเขียน ผู้นำทางความคิด และนักเทคโนโลยีที่กระตือรือร้น ประเด็นหลักที่เธอสนใจคือ AI และ ML และเธอมักจะพูดในการประชุมและการพบปะของ AI และ ML ทั่วโลก เธอมีประสบการณ์ทั้งเชิงกว้างและเชิงลึกในด้านเทคโนโลยีและอุตสาหกรรมเทคโนโลยี พร้อมความเชี่ยวชาญในอุตสาหกรรมด้านการดูแลสุขภาพ ภาคการเงิน และการประกันภัย

โซนาลี ซาฮู เป็นผู้นำการประมวลผลเอกสารอัจฉริยะด้วยทีมบริการ AI/ML ใน AWS เธอเป็นนักเขียน ผู้นำทางความคิด และนักเทคโนโลยีที่กระตือรือร้น ประเด็นหลักที่เธอสนใจคือ AI และ ML และเธอมักจะพูดในการประชุมและการพบปะของ AI และ ML ทั่วโลก เธอมีประสบการณ์ทั้งเชิงกว้างและเชิงลึกในด้านเทคโนโลยีและอุตสาหกรรมเทคโนโลยี พร้อมความเชี่ยวชาญในอุตสาหกรรมด้านการดูแลสุขภาพ ภาคการเงิน และการประกันภัย

อัญชัน บิสวาส เป็นสถาปนิกอาวุโสด้านโซลูชันบริการ AI โดยมุ่งเน้นที่ AI/ML และการวิเคราะห์ข้อมูล Anjan เป็นส่วนหนึ่งของทีมบริการ AI ทั่วโลก และทำงานร่วมกับลูกค้าเพื่อช่วยให้พวกเขาเข้าใจและพัฒนาวิธีแก้ปัญหาทางธุรกิจด้วย AI และ ML Anjan มีประสบการณ์มากกว่า 14 ปีในการทำงานกับซัพพลายเชน การผลิต และองค์กรค้าปลีกระดับโลก และคอยช่วยเหลือลูกค้าในการเริ่มต้นและปรับขนาดบนบริการ AWS AI

อัญชัน บิสวาส เป็นสถาปนิกอาวุโสด้านโซลูชันบริการ AI โดยมุ่งเน้นที่ AI/ML และการวิเคราะห์ข้อมูล Anjan เป็นส่วนหนึ่งของทีมบริการ AI ทั่วโลก และทำงานร่วมกับลูกค้าเพื่อช่วยให้พวกเขาเข้าใจและพัฒนาวิธีแก้ปัญหาทางธุรกิจด้วย AI และ ML Anjan มีประสบการณ์มากกว่า 14 ปีในการทำงานกับซัพพลายเชน การผลิต และองค์กรค้าปลีกระดับโลก และคอยช่วยเหลือลูกค้าในการเริ่มต้นและปรับขนาดบนบริการ AWS AI

ชินมยีระเนะ เป็นสถาปนิกโซลูชันผู้เชี่ยวชาญ AI/ML ที่ Amazon Web Services เธอมีความหลงใหลในคณิตศาสตร์ประยุกต์และการเรียนรู้ของเครื่อง เธอมุ่งเน้นไปที่การออกแบบการประมวลผลเอกสารอัจฉริยะและโซลูชัน AI เชิงสร้างสรรค์สำหรับลูกค้า AWS นอกเวลางาน เธอชอบเต้นซัลซ่าและบาชาต้า

ชินมยีระเนะ เป็นสถาปนิกโซลูชันผู้เชี่ยวชาญ AI/ML ที่ Amazon Web Services เธอมีความหลงใหลในคณิตศาสตร์ประยุกต์และการเรียนรู้ของเครื่อง เธอมุ่งเน้นไปที่การออกแบบการประมวลผลเอกสารอัจฉริยะและโซลูชัน AI เชิงสร้างสรรค์สำหรับลูกค้า AWS นอกเวลางาน เธอชอบเต้นซัลซ่าและบาชาต้า

- เนื้อหาที่ขับเคลื่อนด้วย SEO และการเผยแพร่ประชาสัมพันธ์ รับการขยายวันนี้

- PlatoData.Network Vertical Generative Ai เพิ่มพลังให้กับตัวเอง เข้าถึงได้ที่นี่.

- เพลโตไอสตรีม. Web3 อัจฉริยะ ขยายความรู้ เข้าถึงได้ที่นี่.

- เพลโตESG. คาร์บอน, คลีนเทค, พลังงาน, สิ่งแวดล้อม แสงอาทิตย์, การจัดการของเสีย. เข้าถึงได้ที่นี่.

- เพลโตสุขภาพ เทคโนโลยีชีวภาพและข่าวกรองการทดลองทางคลินิก เข้าถึงได้ที่นี่.

- ที่มา: https://aws.amazon.com/blogs/machine-learning/intelligent-document-processing-with-amazon-textract-amazon-bedrock-and-langchain/

- :มี

- :เป็น

- :ไม่

- :ที่ไหน

- .ถัดไป

- $1000

- $ ขึ้น

- 1

- 10

- 100

- 11

- 12

- 13

- 14

- 15%

- 16

- 22

- 23

- 33

- 35%

- 7

- 9

- a

- ความสามารถ

- เกี่ยวกับเรา

- แน่นอน

- เข้า

- Accessed

- ตาม

- ความถูกต้อง

- ถูกต้อง

- ประสบความสำเร็จ

- ข้าม

- การกระทำ

- การปฏิบัติ

- อย่างกระตือรือร้น

- อยากทำกิจกรรม

- การกระทำ

- Ad

- ที่อยู่

- เพิ่ม

- เป็นไปตาม

- ยอมรับ

- ที่ยอมรับ

- ความก้าวหน้า

- ความได้เปรียบ

- การกำเนิด

- อายุ

- ตัวแทน

- AI

- บริการ AI

- AI / ML

- ชิด

- ทั้งหมด

- การอนุญาต

- ช่วยให้

- ตาม

- ด้วย

- ทางเลือก

- แม้ว่า

- อเมซอน

- เข้าใจ Amazon

- อเมซอน RDS

- Amazon Text

- Amazon Web Services

- จำนวน

- an

- การวิเคราะห์

- วิเคราะห์

- และ

- คำตอบ

- มานุษยวิทยา

- ใด

- APIs

- การใช้งาน

- ประยุกต์

- การนัดหมาย

- เข้าใกล้

- สถาปัตยกรรม

- เป็น

- AREA

- รอบ

- ศิลปะ

- เทียม

- ปัญญาประดิษฐ์

- ปัญญาประดิษฐ์ (AI)

- AS

- แง่มุม

- ช่วยเหลือ

- ผู้ช่วย

- At

- เสริม

- เติม

- ผู้เขียน

- โดยอัตโนมัติ

- อัตโนมัติ

- อัตโนมัติ

- อัตโนมัติ

- ใช้ได้

- ความตระหนัก

- AWS

- ลูกค้า AWS

- ธนาคาร

- BE

- เพราะ

- จะกลายเป็น

- รับ

- ก่อน

- เป็นประโยชน์

- ประโยชน์

- ที่ดีที่สุด

- ปฏิบัติที่ดีที่สุด

- ระหว่าง

- ปิดกั้น

- Blocks

- ทั้งสอง

- ความกว้าง

- ทำลาย

- แบ่ง

- สร้าง

- การก่อสร้าง

- built-in

- ธุรกิจ

- ธุรกิจ

- แต่

- by

- โทร

- CAN

- สามารถรับ

- ความสามารถในการ

- จับ

- กรณี

- กรณี

- เซลล์

- บาง

- โซ่

- ห่วงโซ่

- ท้าทาย

- ท้าทาย

- เปลี่ยนแปลง

- การเปลี่ยนแปลง

- เปลี่ยนแปลง

- การตรวจสอบ

- ทางเลือก

- การเรียกร้อง

- ชั้น

- ชั้นเรียน

- การจัดหมวดหมู่

- แยกประเภท

- รหัส

- สอดคล้องกัน

- การทำงานร่วมกัน

- คอลัมน์

- คอลัมน์

- การผสมผสาน

- รวมกัน

- มา

- ร่วมกัน

- อย่างธรรมดา

- การสื่อสาร

- เข้ากันได้

- สมบูรณ์

- ซับซ้อน

- ความซับซ้อน

- เข้าใจ

- กระชับ

- การประชุม

- การเชื่อมต่อ

- คงเส้นคงวา

- ประกอบ

- ข้อ จำกัด

- สร้าง

- บรรจุ

- ที่มีอยู่

- มี

- เนื้อหา

- สิ่งแวดล้อม

- ตามบริบท

- แปลง

- แกน

- แก้ไข

- การแก้ไข

- การแก้ไข

- ได้

- หัตถกรรม

- ที่สร้างขึ้น

- สร้าง

- สำคัญมาก

- ประเพณี

- ลูกค้า

- ลูกค้า

- การเต้นรำ

- ข้อมูล

- วิเคราะห์ข้อมูล

- ฐานข้อมูล

- ฐานข้อมูล

- วันที่

- วันที่

- จัดการ

- ลึก

- ลึก

- กำหนด

- กำหนด

- การกำหนด

- แสดงให้เห็นถึง

- ทั้งนี้ขึ้นอยู่กับ

- เงินฝาก

- ความลึก

- อธิบาย

- ลักษณะ

- การออกแบบ

- ที่ต้องการ

- รายละเอียด

- รายละเอียด

- รายละเอียด

- ตรวจจับ

- กำหนด

- พัฒนา

- นักพัฒนา

- อาหาร

- ต่าง

- โดยตรง

- สนทนา

- กล่าวถึง

- การดำน้ำ

- แบ่ง

- แบ่ง

- do

- คุณหมอ

- เอกสาร

- เอกสาร

- เอกสาร

- ทำ

- ไม่

- การทำ

- สวม

- ทำ

- Dont

- ลง

- เป็นคุ้งเป็นแคว

- สอง

- ในระหว่าง

- พลวัต

- e

- แต่ละ

- ก่อน

- อย่างง่ายดาย

- ง่ายต่อการใช้งาน

- มีประสิทธิภาพ

- อย่างมีประสิทธิภาพ

- ที่มีประสิทธิภาพ

- อย่างมีประสิทธิภาพ

- ความพยายาม

- ทั้ง

- องค์ประกอบ

- ฝัง

- การจ้างงาน

- ให้อำนาจ

- ทำให้สามารถ

- ช่วยให้

- การเปิดใช้งาน

- ปลาย

- ชั้นเยี่ยม

- เสริม

- ที่เพิ่มขึ้น

- การเสริมสร้าง

- ทำให้มั่นใจ

- การสร้างความมั่นใจ

- ทั้งหมด

- หน่วยงาน

- เอกลักษณ์

- พร้อม

- ข้อผิดพลาด

- จำเป็น

- แม้

- ตัวอย่าง

- ยกเว้น

- ข้อยกเว้น

- ที่มีอยู่

- ประสบการณ์

- ความชำนาญ

- อธิบาย

- อธิบาย

- อธิบาย

- คำอธิบาย

- อย่างชัดเจน

- การแสดงออก

- ขยายออก

- นามสกุล

- กว้างขวาง

- สารสกัด

- การสกัด

- สารสกัดจาก

- ตก

- เท็จ

- ไกล

- ความเมื่อยล้า

- สาขา

- รูป

- สุดท้าย

- ในที่สุด

- ทางการเงิน

- ภาคการเงิน

- ชื่อจริง

- พอดี

- โฟกัส

- มุ่งเน้นไปที่

- ปฏิบัติตาม

- ตาม

- ดังต่อไปนี้

- ดังต่อไปนี้

- สำหรับ

- รูป

- รูปแบบ

- พบ

- รากฐาน

- กรอบ

- ฟรี

- มัก

- ราคาเริ่มต้นที่

- ชายแดน

- เต็ม

- อย่างเต็มที่

- ต่อไป

- อนาคต

- General

- สร้าง

- สร้าง

- สร้าง

- การสร้าง

- รุ่น

- กำเนิด

- กำเนิด AI

- ได้รับ

- ให้

- กำหนด

- เหตุการณ์ที่

- ไวยากรณ์

- เข้าใจ

- มากขึ้น

- บัญชีกลุ่ม

- ให้คำแนะนำ

- มือ

- จัดการ

- เกิดขึ้น

- สิ่งที่เกิดขึ้น

- ฮาร์ดแวร์

- มี

- ส่วนหัว

- การดูแลสุขภาพ

- หนัก

- ช่วย

- เป็นประโยชน์

- การช่วยเหลือ

- จะช่วยให้

- เธอ

- โปรดคลิกที่นี่เพื่ออ่านรายละเอียดเพิ่มเติม

- ระดับสูง

- ที่มีประสิทธิภาพสูง

- สูงกว่า

- ถือ

- โรงพยาบาล

- สรุป ความน่าเชื่อถือของ Olymp Trade?

- ทำอย่างไร

- อย่างไรก็ตาม

- HTML

- HTTPS

- เป็นมนุษย์

- i

- ID

- ระบุ

- if

- แสดงให้เห็นถึง

- ภาพ

- อย่างมาก

- ส่งผลกระทบ

- นำเข้า

- สำคัญ

- การนำเข้า

- กำหนด

- การปรับปรุง

- in

- รวมทั้ง

- ดัชนี

- อุตสาหกรรม

- ข้อมูล

- ข้อมูลอายุ

- นักวิเคราะห์ส่วนบุคคลที่หาโอกาสให้เป็นไปได้มากที่สุด

- อินพุต

- ข้อมูลเชิงลึก

- ตัวอย่าง

- คำแนะนำการใช้

- ประกัน

- รวบรวม

- แบบบูรณาการ

- การบูรณาการ

- บูรณาการ

- Intelligence

- ฉลาด

- การประมวลผลเอกสารอัจฉริยะ

- ตั้งใจว่า

- ภายใน

- เข้าไป

- ความซับซ้อน

- แนะนำ

- แนะนำ

- เปิดตัว

- IT

- ITS

- แจ็คสัน

- จอห์น

- จอห์น โด

- จอน

- jpg

- JSON

- เพียงแค่

- คีย์

- กุญแจ

- ทราบ

- ความรู้

- ที่รู้จักกัน

- ภาษา

- ใหญ่

- แบบ

- นำ

- ผู้นำ

- ชั้นนำ

- การเรียนรู้

- การออกจาก

- ห้องสมุด

- กดไลก์

- น่าจะ

- ข้อ จำกัด

- ขีด จำกัด

- รายการ

- LLM

- โหลด

- loader

- ตรรกะ

- ดู

- Lot

- เครื่อง

- เรียนรู้เครื่อง

- การทำ

- จัดการ

- จัดการได้

- การจัดการ

- การจัดการ

- คู่มือ

- การผลิต

- โดดเด่น

- คณิตศาสตร์

- อาจ..

- me

- ความหมาย

- มีความหมาย

- วิธี

- กลไก

- กลไก

- Meetups

- หน่วยความจำ

- Meta

- เมตาดาต้า

- วิธี

- วิธีการ

- อาจ

- ใจ

- พลาด

- ความผิดพลาด

- ML

- แบบ

- โมเดล

- โมดูล

- ข้อมูลเพิ่มเติม

- การจำนอง

- มากที่สุด

- หลาย

- ชื่อ

- ชื่อ

- โดยธรรมชาติ

- ประมวลผลภาษาธรรมชาติ

- จำเป็น

- จำเป็นต้อง

- จำเป็น

- ความต้องการ

- ใหม่

- ถัดไป

- สัปดาห์หน้า

- NLP

- สมุดบันทึก

- ตอนนี้

- ความแตกต่าง

- จำนวน

- วัตถุ

- วัตถุ

- of

- เสนอ

- มักจะ

- on

- ONE

- เพียง

- โอเพนซอร์ส

- การดำเนินการ

- โอกาส

- ดีที่สุด

- Options

- or

- องค์กร

- เป็นต้นฉบับ

- อื่นๆ

- มิฉะนั้น

- ของเรา

- ออก

- ผล

- เอาท์พุต

- เอาท์พุท

- ด้านนอก

- เกิน

- ภาพรวม

- แพคเกจ

- หน้า

- หน้า

- อาการเจ็บปวด

- จับคู่

- คู่

- ส่วนหนึ่ง

- โดยเฉพาะ

- ส่ง

- ผ่าน

- ที่ผ่านไป

- หลงใหล

- เส้นทาง

- ผู้ป่วย

- แบบแผน

- รูปแบบ

- รูปแบบไฟล์ PDF

- ต่อ

- ดำเนินการ

- การปฏิบัติ

- ดำเนินการ

- ที่มีประสิทธิภาพ

- ดำเนินการ

- ระยะ

- phd

- วลี

- ท่อ

- แผนการ

- เพลโต

- เพลโตดาต้าอินเทลลิเจนซ์

- เพลโตดาต้า

- กรุณา

- โรคปอดบวม

- จุด

- ยอดนิยม

- เป็นไปได้

- โพสต์

- ที่มีศักยภาพ

- อำนาจ

- ขับเคลื่อน

- ที่มีประสิทธิภาพ

- การปฏิบัติ

- อย่างแม่นยำ

- ความแม่นยำ

- ที่ต้องการ

- นำเสนอ

- ก่อนหน้านี้

- ส่วนใหญ่

- พิมพ์

- พิมพ์

- ปัญหา

- ปัญหาที่เกิดขึ้น

- กระบวนการ

- แปรรูปแล้ว

- การประมวลผล

- ก่อ

- สัญญา

- เหมาะสม

- ให้

- ให้

- ผู้จัดหา

- ให้

- หลาม

- Q & A

- คุณภาพ

- คำถาม

- รวดเร็ว

- อย่างรวดเร็ว

- ดิบ

- การอ่าน

- รับรู้

- ลด

- อ้างอิง

- การอ้างอิง

- เรียกว่า

- ความสัมพันธ์

- ตรงประเด็น

- วางใจ

- อาศัย

- โดดเด่น

- รายงาน

- แสดง

- เป็นตัวแทนของ

- จำเป็นต้องใช้

- ต้อง

- ตามลำดับ

- การตอบสนอง

- ข้อ จำกัด

- ผล

- ส่งผลให้

- ผลสอบ

- ค้าปลีก

- รักษา

- การรักษา

- รับคืน

- รวย

- ห้อง

- กฎระเบียบ

- วิ่ง

- ทำงาน

- s

- อย่างปลอดภัย

- เดียวกัน

- กล่าว

- ขนาด

- สถานการณ์

- ที่กำหนดไว้

- ค้นหา

- ที่สอง

- Section

- ส่วน

- ภาค

- เห็น

- กลุ่ม

- เลือก

- ระดับอาวุโส

- ประโยค

- ชุด

- ให้บริการ

- ให้บริการอาหาร

- บริการ

- บริการ

- ชุด

- รุนแรง

- เธอ

- สั้น

- น่า

- แสดง

- แสดงให้เห็นว่า

- สำคัญ

- เดียว

- เล็ก

- มีขนาดเล็กกว่า

- เศษเล็กเศษน้อย

- So

- เพียงผู้เดียว

- โซลูชัน

- แก้

- บาง

- แหล่ง

- ช่องว่าง

- พูด

- ผู้เชี่ยวชาญ

- โดยเฉพาะ

- เฉพาะ

- ที่ระบุไว้

- การสะกดคำ

- แยก

- ขั้นตอน

- มาตรฐาน

- เริ่มต้น

- ข้อความที่เริ่ม

- รัฐของศิลปะ

- คำแถลง

- ขั้นตอน

- ขั้นตอน

- ยังคง

- จัดเก็บ

- เก็บไว้

- ร้านค้า

- จุดแข็ง

- เชือก

- โครงสร้าง

- โครงสร้าง

- โครงสร้าง

- การต่อสู้

- ภายหลัง

- ต่อจากนั้น

- อย่างเช่น

- แนะนำ

- สรุป

- สรุป

- จัดหาอุปกรณ์

- ห่วงโซ่อุปทาน

- สนับสนุน

- รองรับ

- ทำงานร่วมกัน

- ระบบ

- ตาราง

- เอา

- ใช้เวลา

- งาน

- งาน

- ทีม

- เทคนิค

- เทคนิค

- นักเทคโนโลยี

- เทคโนโลยี

- เทมเพลต

- เงื่อนไขการใช้บริการ

- ข้อความ

- เกี่ยวกับใจความ

- กว่า

- ที่

- พื้นที่

- โลก

- ของพวกเขา

- พวกเขา

- แล้วก็

- ที่นั่น

- ดังนั้น

- ล้อยางขัดเหล่านี้ติดตั้งบนแกน XNUMX (มม.) ผลิตภัณฑ์นี้ถูกผลิตในหลายรูปทรง และหลากหลายเบอร์ความแน่นหนาของปริมาณอนุภาคขัดของมัน จะทำให้ท่านได้รับประสิทธิภาพสูงในการขัดและการใช้งานที่ยาวนาน

- พวกเขา

- นี้

- คิดว่า

- สาม

- ตลอด

- ยักษ์

- ไปยัง

- ในวันนี้

- วันนี้

- ร่วมกัน

- โทเค็น

- ราชสกุล

- TONE

- เครื่องมือ

- ด้านบน

- รวม

- แบบดั้งเดิม

- การลาก

- การฝึกอบรม

- การทำธุรกรรม

- แปลง

- การแปลง

- จริง

- ลอง

- สอง

- ชนิด

- ชนิด

- เข้าใจ

- ความเข้าใจ

- แตกต่าง

- การเปิดผ้าคลุม

- URL

- ใช้

- ใช้กรณี

- มือสอง

- ผู้ใช้

- ใช้

- การใช้

- ใช้

- การใช้ประโยชน์

- v1

- ความคุ้มค่า

- ความคุ้มค่า

- ตัวแปร

- ต่างๆ

- กว้างใหญ่

- อเนกประสงค์

- รุ่น

- ผ่านทาง

- รายละเอียด

- ไดรฟ์

- คำแนะนำ

- ต้องการ

- คือ

- ทาง..

- we

- เว็บ

- บริการเว็บ

- สัปดาห์

- ดี

- อะไร

- เมื่อ

- ที่

- ในขณะที่

- WHO

- จะ

- กับ

- ภายใน

- ไม่มี

- ร่วมเป็นสักขีพยาน

- คำ

- คำ

- งาน

- เวิร์กโฟลว์

- ขั้นตอนการทำงาน

- การทำงาน

- โรงงาน

- โลก

- จะ

- เขียน

- X

- ปี

- คุณ

- ลมทะเล