การสร้างโมเดลพื้นฐาน (FM) จำเป็นต้องมีการสร้าง การบำรุงรักษา และการเพิ่มประสิทธิภาพคลัสเตอร์ขนาดใหญ่เพื่อฝึกโมเดลที่มีพารามิเตอร์นับหมื่นถึงแสนล้านในข้อมูลจำนวนมหาศาล การสร้างสภาพแวดล้อมที่ยืดหยุ่นซึ่งสามารถจัดการกับความล้มเหลวและการเปลี่ยนแปลงสภาพแวดล้อมได้โดยไม่สูญเสียความคืบหน้าในการฝึกโมเดลเป็นเวลาหลายวันหรือหลายสัปดาห์ถือเป็นความท้าทายในการปฏิบัติงานที่คุณจะต้องปรับใช้การปรับขนาดคลัสเตอร์ การตรวจสอบสุขภาพเชิงรุก การตรวจสอบงาน และความสามารถในการดำเนินการฝึกอบรมต่อโดยอัตโนมัติหากเกิดความล้มเหลวหรือปัญหาเกิดขึ้น .

เรารู้สึกตื่นเต้นที่จะแบ่งปันสิ่งนั้น Amazon SageMaker ไฮเปอร์พอด ขณะนี้พร้อมใช้งานโดยทั่วไปแล้วเพื่อเปิดใช้งานโมเดลพื้นฐานการฝึกอบรมที่มีตัวเร่งความเร็วหลายพันตัวเร็วขึ้นสูงสุด 40% โดยจัดให้มีสภาพแวดล้อมการฝึกอบรมที่มีความยืดหยุ่นสูง ในขณะเดียวกันก็กำจัดการยกของหนักที่ไม่แตกต่างกันซึ่งเกี่ยวข้องกับการปฏิบัติการกลุ่มการฝึกอบรมขนาดใหญ่ ด้วย SageMaker HyperPod ผู้ปฏิบัติงานแมชชีนเลิร์นนิง (ML) สามารถฝึกอบรม FM เป็นเวลาหลายสัปดาห์และหลายเดือนโดยไม่หยุดชะงัก และไม่ต้องจัดการกับปัญหาความล้มเหลวของฮาร์ดแวร์

ลูกค้า เช่น Stability AI ใช้ SageMaker HyperPod เพื่อฝึกฝนโมเดลพื้นฐาน รวมถึง Stable Diffusion

“ในฐานะบริษัทชั้นนำด้าน AI แบบโอเพ่นซอร์ส เป้าหมายของเราคือการเพิ่มการเข้าถึง AI ที่ทันสมัยให้สูงสุด เรากำลังสร้างโมเดลพื้นฐานที่มีพารามิเตอร์นับหมื่นล้านรายการ ซึ่งต้องใช้โครงสร้างพื้นฐานเพื่อปรับขนาดประสิทธิภาพการฝึกอบรมได้อย่างเหมาะสมที่สุด ด้วยโครงสร้างพื้นฐานที่ได้รับการจัดการและไลบรารีการเพิ่มประสิทธิภาพของ SageMaker HyperPod เราสามารถลดเวลาและต้นทุนการฝึกอบรมได้มากกว่า 50% มันทำให้การฝึกโมเดลของเรามีความยืดหยุ่นและมีประสิทธิภาพมากขึ้นเพื่อสร้างโมเดลที่ล้ำสมัยได้เร็วขึ้น”

– Emad Mostaque ผู้ก่อตั้งและซีอีโอของ Stability AI

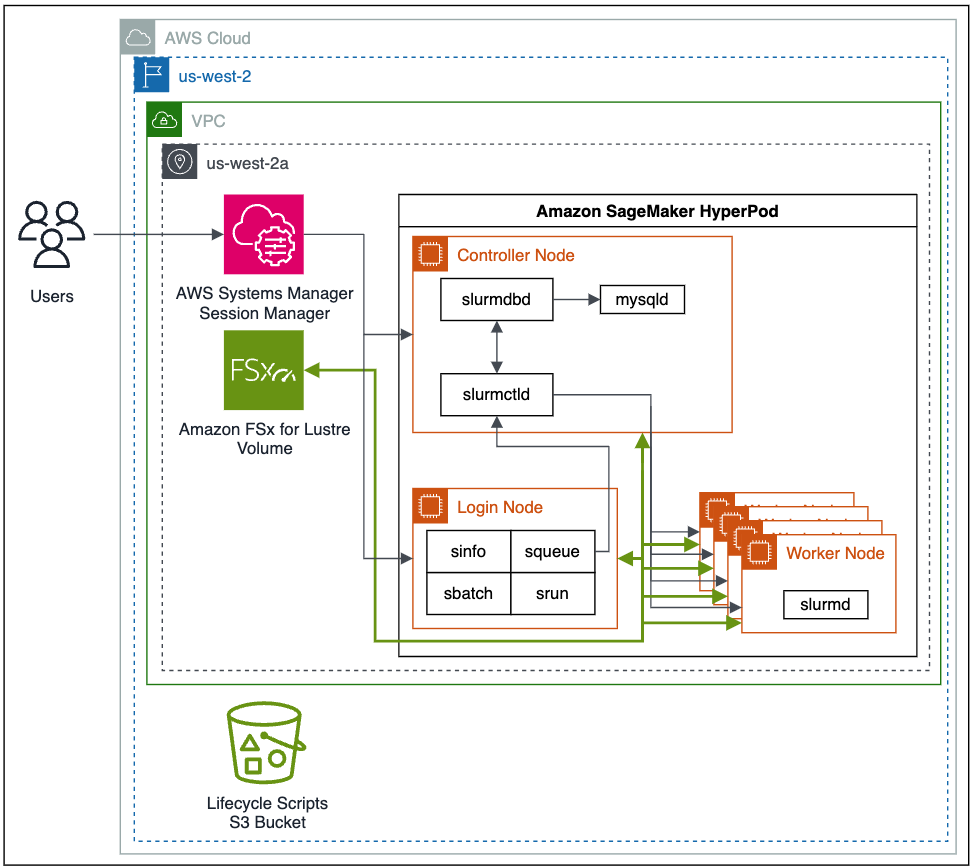

เพื่อให้วงจรการพัฒนา FM มีความยืดหยุ่นต่อความล้มเหลวของฮาร์ดแวร์ SageMaker HyperPod ช่วยให้คุณสร้างคลัสเตอร์ ตรวจสอบความสมบูรณ์ของคลัสเตอร์ ซ่อมแซมและเปลี่ยนโหนดที่ผิดพลาดได้ทันที บันทึกจุดตรวจสอบบ่อยครั้ง และดำเนินการฝึกอบรมต่อโดยอัตโนมัติโดยไม่สูญเสียความคืบหน้า นอกจากนี้ SageMaker HyperPod ยังได้รับการกำหนดค่าล่วงหน้าด้วย อเมซอน SageMaker กระจายห้องสมุดฝึกอบรมรวมทั้ง ไลบรารีข้อมูลแบบขนานของ SageMaker (SMDDP) และ ไลบรารีโมเดล Parallelism (SMP) ของ SageMakerเพื่อปรับปรุงประสิทธิภาพการฝึก FM ด้วยการทำให้การแบ่งข้อมูลและโมเดลการฝึกออกเป็นส่วนย่อยๆ เป็นเรื่องง่าย และประมวลผลแบบขนานทั่วทั้งโหนดคลัสเตอร์ ในขณะที่ใช้โครงสร้างพื้นฐานการประมวลผลและเครือข่ายของคลัสเตอร์อย่างเต็มที่ SageMaker HyperPod ผสานรวม Slurm Workload Manager สำหรับคลัสเตอร์และการจัดการงานการฝึกอบรม

ภาพรวมตัวจัดการภาระงานของ Slurm

slurmเดิมชื่อ Simple Linux Utility สำหรับการจัดการทรัพยากร เป็นตัวกำหนดเวลางานสำหรับการรันงานบนคลัสเตอร์คอมพิวเตอร์แบบกระจาย นอกจากนี้ยังมีกรอบการทำงานสำหรับการรันงานแบบคู่ขนานโดยใช้ ไลบรารีการสื่อสารแบบรวม NVIDIA (NCCL) or อินเตอร์เฟซการส่งข้อความ (MPI) มาตรฐาน Slurm เป็นระบบการจัดการทรัพยากรคลัสเตอร์โอเพ่นซอร์สยอดนิยมที่ใช้กันอย่างแพร่หลายโดยการประมวลผลประสิทธิภาพสูง (HPC) และปริมาณงานการฝึกอบรม AI และ FM แบบสร้างสรรค์ SageMaker HyperPod มอบวิธีที่ตรงไปตรงมาในการเริ่มต้นและใช้งานคลัสเตอร์ Slurm ในเวลาไม่กี่นาที

ต่อไปนี้เป็นแผนภาพสถาปัตยกรรมระดับสูงที่แสดงถึงวิธีที่ผู้ใช้โต้ตอบกับ SageMaker HyperPod และวิธีที่ส่วนประกอบคลัสเตอร์ต่างๆ โต้ตอบกันและบริการของ AWS อื่นๆ เช่น Amazon FSx สำหรับความมันวาว และ บริการจัดเก็บข้อมูลอย่างง่ายของ Amazon (อเมซอน เอส3).

งาน Slurm ถูกส่งโดยคำสั่งบนบรรทัดคำสั่ง คำสั่งในการรันงาน Slurm คือ srun และ sbatch. srun คำสั่งรันงานการฝึกอบรมในโหมดโต้ตอบและการบล็อกและ sbatch ทำงานในโหมดการประมวลผลแบบแบตช์และโหมดไม่บล็อก srun ส่วนใหญ่จะใช้เพื่อรันงานทันทีในขณะที่ sbatch สามารถใช้สำหรับการทำงานในภายหลังได้

สำหรับข้อมูลเกี่ยวกับคำสั่ง Slurm เพิ่มเติมและการกำหนดค่า โปรดดูที่ เอกสารประกอบของ Slurm Workload Manager.

ความสามารถในการดำเนินการต่อและการรักษาอัตโนมัติ

หนึ่งในคุณสมบัติใหม่ของ SageMaker HyperPod คือความสามารถในการกลับมาทำงานต่อโดยอัตโนมัติ ก่อนหน้านี้ เมื่อโหนดผู้ปฏิบัติงานล้มเหลวในระหว่างการฝึกอบรมหรือปรับแต่งการรันงาน ขึ้นอยู่กับผู้ใช้ที่จะตรวจสอบสถานะของงาน เริ่มงานใหม่จากจุดตรวจสอบล่าสุด และติดตามงานต่อไปตลอดการรันทั้งหมด เนื่องจากงานฝึกอบรมหรืองานปรับแต่งที่ต้องดำเนินการหลายวัน สัปดาห์ หรือกระทั่งหลายเดือนในแต่ละครั้ง การดำเนินการนี้จะมีค่าใช้จ่ายสูงเนื่องจากค่าใช้จ่ายในการบริหารจัดการเพิ่มเติมของผู้ใช้ที่ต้องใช้วงจรในการตรวจสอบและบำรุงรักษางานในกรณีที่ โหนดขัดข้อง รวมถึงต้นทุนเวลาว่างของอินสแตนซ์การประมวลผลแบบเร่งความเร็วที่มีราคาแพง

SageMaker HyperPod จัดการกับความยืดหยุ่นของงานโดยใช้การตรวจสอบสภาพอัตโนมัติ การเปลี่ยนโหนด และการกู้คืนงาน งาน Slurm ใน SageMaker HyperPod ได้รับการตรวจสอบโดยใช้ปลั๊กอิน Slurm แบบกำหนดเองของ SageMaker โดยใช้ เฟรมเวิร์ก SPANK. เมื่องานการฝึกอบรมล้มเหลว SageMaker HyperPod จะตรวจสอบความสมบูรณ์ของคลัสเตอร์ผ่านชุดการตรวจสอบสภาพ หากพบโหนดที่ผิดพลาดในคลัสเตอร์ SageMaker HyperPod จะลบโหนดออกจากคลัสเตอร์โดยอัตโนมัติ แทนที่โหนดนั้นด้วยโหนดที่มีประสิทธิภาพดี และรีสตาร์ทงานการฝึก เมื่อใช้จุดตรวจในงานฝึกอบรม งานที่หยุดชะงักหรือล้มเหลวสามารถดำเนินการต่อจากจุดตรวจล่าสุดได้

ภาพรวมโซลูชัน

หากต้องการปรับใช้ SageMaker HyperPod คุณต้องเตรียมสภาพแวดล้อมโดยการกำหนดค่าของคุณก่อน คลาวด์ส่วนตัวเสมือนของ Amazon (Amazon VPC) กลุ่มเครือข่ายและความปลอดภัย ปรับใช้บริการสนับสนุน เช่น FSx สำหรับ Luster ใน VPC ของคุณ และการเผยแพร่สคริปต์วงจรการใช้งาน Slurm ของคุณไปยังบัคเก็ต S3 จากนั้นคุณปรับใช้และกำหนดค่า SageMaker HyperPod ของคุณและเชื่อมต่อกับโหนดหลักเพื่อเริ่มงานการฝึกอบรมของคุณ

เบื้องต้น

ก่อนที่คุณจะสร้าง SageMaker HyperPod คุณต้องกำหนดค่า VPC ของคุณก่อน สร้าง FSx สำหรับระบบไฟล์ Luster และสร้างบัคเก็ต S3 ด้วยสคริปต์วงจรการใช้งานคลัสเตอร์ที่คุณต้องการ คุณต้องมีเวอร์ชันล่าสุดของ อินเทอร์เฟซบรรทัดคำสั่ง AWS AWS (AWS CLI) และปลั๊กอิน CLI ที่ติดตั้งไว้ ตัวจัดการเซสชัน AWS, ความสามารถของ ผู้จัดการระบบ AWS.

SageMaker HyperPod ได้รับการผสานรวมกับ VPC ของคุณโดยสมบูรณ์ สำหรับข้อมูลเกี่ยวกับการสร้าง VPC ใหม่ โปรดดู สร้าง VPC เริ่มต้น or สร้าง VPC. เพื่อให้เกิดการเชื่อมต่อที่ราบรื่นและมีประสิทธิภาพสูงสุดระหว่างทรัพยากร คุณควรสร้างทรัพยากรทั้งหมดของคุณในภูมิภาคและ Availability Zone เดียวกัน รวมถึงตรวจสอบให้แน่ใจว่ากฎกลุ่มความปลอดภัยที่เกี่ยวข้องอนุญาตการเชื่อมต่อระหว่างทรัพยากรคลัสเตอร์

ต่อไปคุณ สร้าง FSx สำหรับระบบไฟล์ Luster. ซึ่งจะทำหน้าที่เป็นระบบไฟล์ประสิทธิภาพสูงสำหรับใช้ตลอดการฝึกโมเดลของเรา ตรวจสอบให้แน่ใจว่า FSx สำหรับ Luster และกลุ่มความปลอดภัยของคลัสเตอร์อนุญาตให้มีการสื่อสารขาเข้าและขาออกระหว่างทรัพยากรคลัสเตอร์และ FSx สำหรับระบบไฟล์ Luster

หากต้องการตั้งค่าสคริปต์วงจรการใช้งานคลัสเตอร์ของคุณ ซึ่งจะรันเมื่อมีเหตุการณ์ เช่น อินสแตนซ์คลัสเตอร์ใหม่เกิดขึ้น คุณจะต้องสร้างบัคเก็ต S3 จากนั้นคัดลอกและปรับแต่งสคริปต์วงจรการใช้งานเริ่มต้นตามต้องการ สำหรับตัวอย่างนี้ เราจัดเก็บสคริปต์วงจรการใช้งานทั้งหมดไว้ในคำนำหน้าบัคเก็ตของ lifecycle-scripts.

ขั้นแรก คุณดาวน์โหลดสคริปต์วงจรการใช้งานตัวอย่างจาก repo GitHub. คุณควรปรับแต่งสิ่งเหล่านี้ให้เหมาะกับพฤติกรรมคลัสเตอร์ที่คุณต้องการ

จากนั้น สร้างบัคเก็ต S3 เพื่อจัดเก็บสคริปต์วงจรการใช้งานที่กำหนดเอง

จากนั้น คัดลอกสคริปต์วงจรการใช้งานเริ่มต้นจากไดเร็กทอรีในเครื่องของคุณไปยังบัคเก็ตและคำนำหน้าที่คุณต้องการโดยใช้ aws s3 sync:

สุดท้ายนี้ ในการตั้งค่าไคลเอ็นต์สำหรับการเชื่อมต่อกับโหนดหลักของคลัสเตอร์ได้ง่ายขึ้น คุณควรทำ ติดตั้งหรืออัปเดต AWS CLI และติดตั้ง ปลั๊กอิน AWS Session Manager CLI เพื่ออนุญาตการเชื่อมต่อเทอร์มินัลแบบโต้ตอบเพื่อจัดการคลัสเตอร์และรันงานการฝึกอบรม

คุณสามารถสร้างคลัสเตอร์ SageMaker HyperPod ด้วยทรัพยากรตามความต้องการที่มีอยู่ หรือโดยการขอจองความจุด้วย SageMaker หากต้องการสร้างการเหมาจ่ายความจุ คุณต้องสร้างคำขอเพิ่มโควต้าเพื่อจองประเภทอินสแตนซ์การประมวลผลเฉพาะและการจัดสรรความจุบนแดชบอร์ดโควต้าบริการ

ตั้งค่ากลุ่มการฝึกอบรมของคุณ

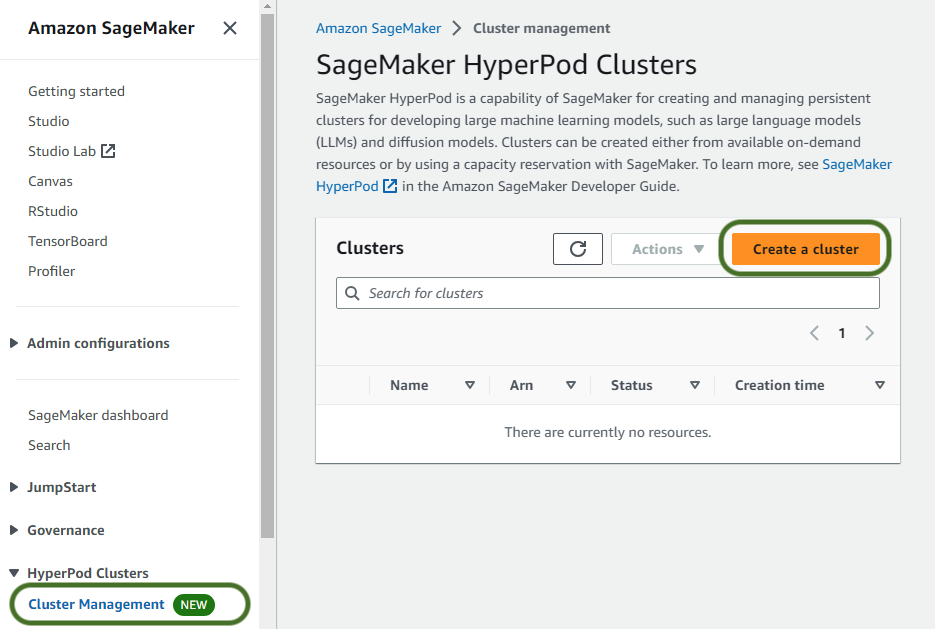

หากต้องการสร้างคลัสเตอร์ SageMaker HyperPod ให้ทำตามขั้นตอนต่อไปนี้:

- บนคอนโซล SageMaker ให้เลือก การจัดการคลัสเตอร์ ภายใต้ คลัสเตอร์ HyperPod ในบานหน้าต่างนำทาง

- Choose สร้างคลัสเตอร์.

- ระบุชื่อคลัสเตอร์และแท็กใดๆ ก็ได้เพื่อใช้กับทรัพยากรคลัสเตอร์ จากนั้นเลือก ถัดไป.

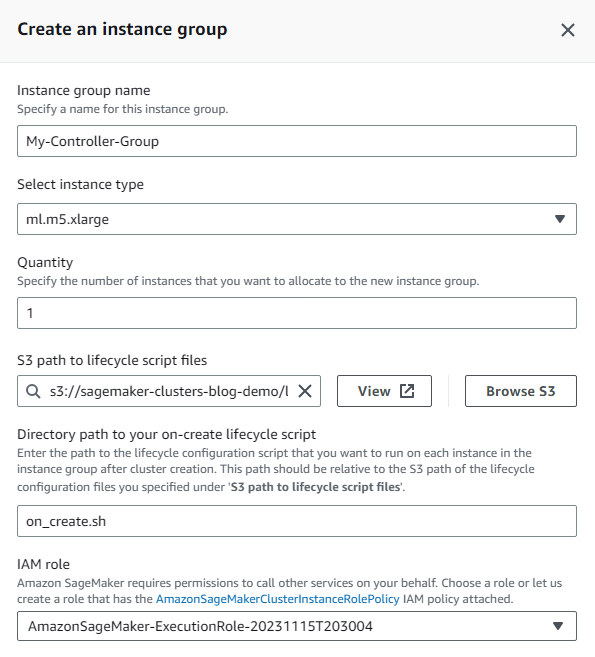

- เลือก สร้างกลุ่มอินสแตนซ์ และระบุชื่อกลุ่มอินสแตนซ์ ประเภทอินสแตนซ์ที่ต้องการ จำนวนอินสแตนซ์ที่ต้องการ และบัคเก็ต S3 และเส้นทางคำนำหน้าที่คุณคัดลอกสคริปต์วงจรการใช้งานคลัสเตอร์ของคุณก่อนหน้านี้

ขอแนะนำให้มีกลุ่มอินสแตนซ์ที่แตกต่างกันสำหรับโหนดตัวควบคุมที่ใช้ในการจัดการคลัสเตอร์และส่งงาน และโหนดผู้ปฏิบัติงานที่ใช้ในการรันงานการฝึกอบรมโดยใช้อินสแตนซ์การประมวลผลแบบเร่งความเร็ว คุณสามารถเลือกกำหนดค่ากลุ่มอินสแตนซ์เพิ่มเติมสำหรับโหนดการเข้าสู่ระบบได้

- ขั้นแรกให้คุณสร้างกลุ่มอินสแตนซ์ตัวควบคุม ซึ่งจะรวมโหนดส่วนหัวของคลัสเตอร์ด้วย

- สำหรับกลุ่มตัวอย่างนี้ AWS Identity และการจัดการการเข้าถึง (IAM) ให้เลือก สร้างบทบาทใหม่ และระบุบัคเก็ต S3 ที่คุณต้องการให้อินสแตนซ์คลัสเตอร์ในกลุ่มอินสแตนซ์มีสิทธิ์เข้าถึง

บทบาทที่สร้างขึ้นจะได้รับสิทธิ์การเข้าถึงแบบอ่านอย่างเดียวไปยังที่เก็บข้อมูลที่ระบุตามค่าเริ่มต้น

- Choose สร้างบทบาท.

- ป้อนชื่อสคริปต์ที่จะเรียกใช้ในการสร้างอินสแตนซ์แต่ละรายการในพร้อมท์สคริปต์เมื่อสร้าง ในตัวอย่างนี้ มีการเรียกสคริปต์ on-create

on_create.sh.

- Choose ลด.

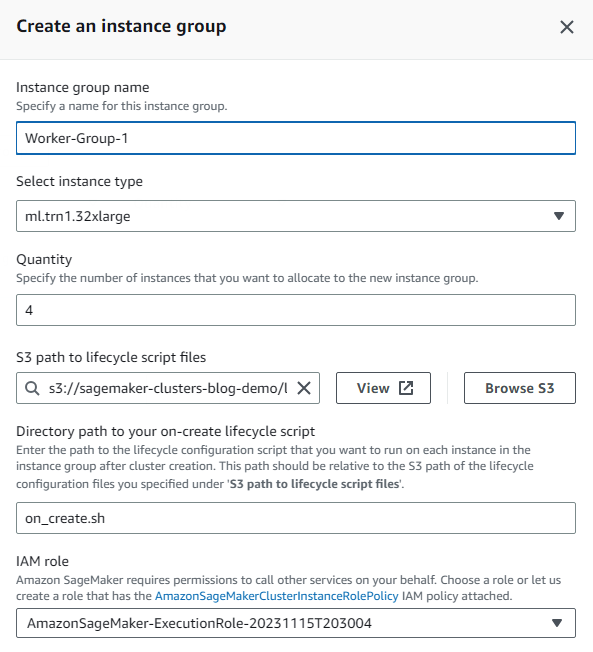

- Choose สร้างกลุ่มอินสแตนซ์ เพื่อสร้างกลุ่มอินสแตนซ์ของผู้ปฏิบัติงานของคุณ

- ระบุรายละเอียดที่ร้องขอทั้งหมด รวมถึงประเภทอินสแตนซ์และปริมาณที่ต้องการ

ตัวอย่างนี้ใช้อินสแตนซ์แบบเร่งความเร็ว ml.trn1.32xl สี่อินสแตนซ์เพื่อดำเนินงานการฝึกอบรมของเรา คุณสามารถใช้บทบาท IAM เหมือนเดิมหรือปรับแต่งบทบาทสำหรับอินสแตนซ์ของผู้ปฏิบัติงานได้ ในทำนองเดียวกัน คุณสามารถใช้สคริปต์วงจรการใช้งานในการสร้างที่แตกต่างกันสำหรับกลุ่มอินสแตนซ์ของผู้ปฏิบัติงานนี้มากกว่ากลุ่มอินสแตนซ์ก่อนหน้า

- Choose ถัดไป เพื่อดำเนินการต่อ.

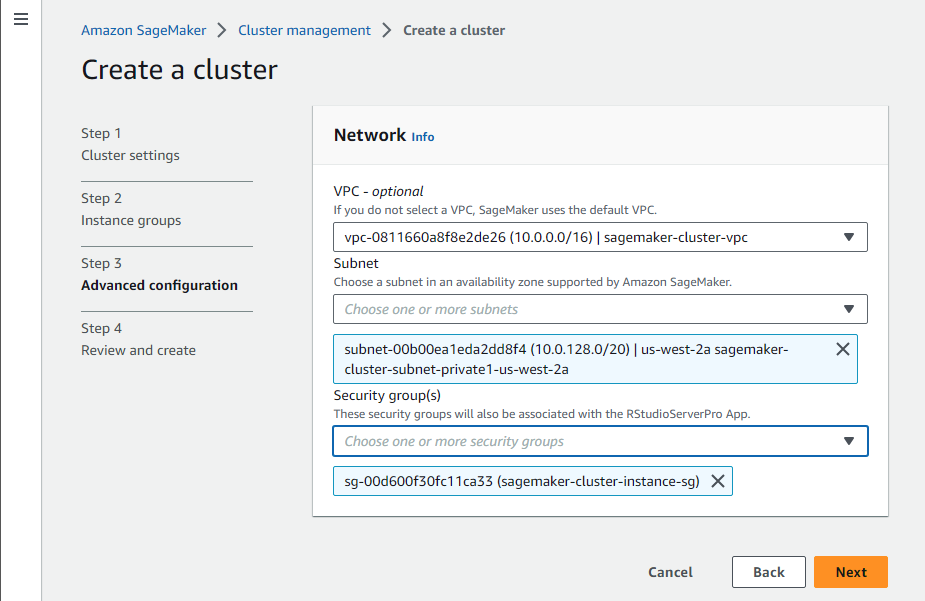

- เลือก VPC, ซับเน็ต และกลุ่มความปลอดภัยที่ต้องการสำหรับอินสแตนซ์คลัสเตอร์ของคุณ

เราโฮสต์อินสแตนซ์คลัสเตอร์ใน Availability Zone และซับเน็ตเดียวเพื่อให้แน่ใจว่ามีเวลาแฝงต่ำ

โปรดทราบว่าหากคุณจะเข้าถึงข้อมูล S3 บ่อยครั้ง ขอแนะนำให้สร้างตำแหน่งข้อมูล VPC ที่เชื่อมโยงกับตารางเส้นทางของเครือข่ายย่อยส่วนตัว เพื่อลดต้นทุนการถ่ายโอนข้อมูลที่อาจเกิดขึ้น

- Choose ถัดไป.

- ตรวจสอบสรุปรายละเอียดคลัสเตอร์ จากนั้นเลือก ส่ง.

อีกทางหนึ่ง หากต้องการสร้าง SageMaker HyperPod โดยใช้ AWS CLI ขั้นแรกให้ปรับแต่งพารามิเตอร์ JSON ที่ใช้สร้างคลัสเตอร์ก่อน:

จากนั้นใช้คำสั่งต่อไปนี้เพื่อสร้างคลัสเตอร์โดยใช้อินพุตที่ให้มา:

ดำเนินงานฝึกอบรมครั้งแรกของคุณด้วย Llama 2

โปรดทราบว่าการใช้โมเดล Llama 2 อยู่ภายใต้ใบอนุญาต Meta หากต้องการดาวน์โหลดน้ำหนักโมเดลและโทเค็นไนเซอร์ โปรดไปที่ เว็บไซต์ และยอมรับใบอนุญาตก่อนที่จะขอเข้าถึง เว็บไซต์กอดใบหน้าของ Meta.

หลังจากที่คลัสเตอร์กำลังทำงาน ให้เข้าสู่ระบบด้วย Session Manager โดยใช้รหัสคลัสเตอร์ ชื่อกลุ่มอินสแตนซ์ และรหัสอินสแตนซ์ ใช้คำสั่งต่อไปนี้เพื่อดูรายละเอียดคลัสเตอร์ของคุณ:

จดบันทึก ID คลัสเตอร์ที่รวมอยู่ใน ARN คลัสเตอร์ในการตอบกลับ

ใช้คำสั่งต่อไปนี้เพื่อเรียกชื่อกลุ่มอินสแตนซ์และ ID อินสแตนซ์ที่จำเป็นในการเข้าสู่ระบบคลัสเตอร์

จดบันทึกของ InstanceGroupName และ InstanceId ในการตอบกลับเนื่องจากสิ่งเหล่านี้จะถูกใช้เพื่อเชื่อมต่อกับอินสแตนซ์ด้วย Session Manager

ตอนนี้คุณใช้ Session Manager เพื่อล็อกอินเข้าสู่โหนดหลัก หรือหนึ่งในโหนดล็อกอิน และรันงานการฝึกของคุณ:

ต่อไป เราจะเตรียมสภาพแวดล้อมและดาวน์โหลดชุดข้อมูล Llama 2 และ RedPajama สำหรับโค้ดแบบเต็มและคำแนะนำแบบทีละขั้นตอน โปรดทำตามคำแนะนำใน การฝึกอบรมแบบกระจาย AWSome ที่เก็บ GitHub

ทำตามขั้นตอนรายละเอียดใน 2.test_cases/8.neuronx-nemo-megatron/README.md ไฟล์. หลังจากทำตามขั้นตอนเพื่อเตรียมสภาพแวดล้อม เตรียมโมเดล ดาวน์โหลดและโทเค็นชุดข้อมูล และคอมไพล์โมเดลล่วงหน้า คุณควรแก้ไข 6.pretrain-model.sh สคริปต์และ sbatch คำสั่งการส่งงานเพื่อรวมพารามิเตอร์ที่จะช่วยให้คุณสามารถใช้ประโยชน์จากคุณสมบัติการทำงานต่ออัตโนมัติของ SageMaker HyperPod

แก้ไข sbatch บรรทัดให้มีลักษณะดังนี้:

หลังจากส่งงานแล้วคุณจะได้รับ JobID ที่คุณสามารถใช้ตรวจสอบสถานะงานโดยใช้รหัสต่อไปนี้:

นอกจากนี้ คุณสามารถตรวจสอบงานโดยติดตามบันทึกผลลัพธ์ของงานโดยใช้รหัสต่อไปนี้:

ทำความสะอาด

หากต้องการลบคลัสเตอร์ SageMaker HyperPod ของคุณ ให้ใช้คอนโซล SageMaker หรือคำสั่ง AWS CLI ต่อไปนี้:

สรุป

โพสต์นี้แสดงให้คุณเห็นถึงวิธีเตรียมสภาพแวดล้อม AWS ปรับใช้คลัสเตอร์ SageMaker HyperPod แรกของคุณ และฝึกอบรมโมเดล Llama 7 พารามิเตอร์ 2 พันล้าน SageMaker HyperPod วางจำหน่ายแล้วในปัจจุบันในภูมิภาคอเมริกา (เวอร์จิเนียเหนือ โอไฮโอ และออริกอน) เอเชียแปซิฟิก (สิงคโปร์ ซิดนีย์ และโตเกียว) และภูมิภาคยุโรป (แฟรงก์เฟิร์ต ไอร์แลนด์ และสตอกโฮล์ม) สามารถปรับใช้ผ่านคอนโซล SageMaker, AWS CLI และ AWS SDK และรองรับกลุ่มอินสแตนซ์ p4d, p4de, p5, trn1, inf2, g5, c5, c5n, m5 และ t3

หากต้องการเรียนรู้เพิ่มเติมเกี่ยวกับ SageMaker HyperPod โปรดไปที่ Amazon SageMaker ไฮเปอร์พอด.

เกี่ยวกับผู้แต่ง

แบรด โดรัน เป็นผู้จัดการบัญชีด้านเทคนิคอาวุโสที่ Amazon Web Services ซึ่งเน้นเรื่อง AI เชิงสร้างสรรค์ เขารับผิดชอบในการแก้ปัญหาความท้าทายด้านวิศวกรรมสำหรับลูกค้า generative AI ในกลุ่มตลาดธุรกิจดิจิทัล เขามาจากโครงสร้างพื้นฐานและพื้นฐานการพัฒนาซอฟต์แวร์ และกำลังศึกษาระดับปริญญาเอกและการวิจัยด้านปัญญาประดิษฐ์และการเรียนรู้ของเครื่อง

แบรด โดรัน เป็นผู้จัดการบัญชีด้านเทคนิคอาวุโสที่ Amazon Web Services ซึ่งเน้นเรื่อง AI เชิงสร้างสรรค์ เขารับผิดชอบในการแก้ปัญหาความท้าทายด้านวิศวกรรมสำหรับลูกค้า generative AI ในกลุ่มตลาดธุรกิจดิจิทัล เขามาจากโครงสร้างพื้นฐานและพื้นฐานการพัฒนาซอฟต์แวร์ และกำลังศึกษาระดับปริญญาเอกและการวิจัยด้านปัญญาประดิษฐ์และการเรียนรู้ของเครื่อง

เกอิตะ วาตานาเบ้ เป็นสถาปนิกโซลูชันผู้เชี่ยวชาญ GenAI อาวุโสที่ Amazon Web Services ซึ่งเขาช่วยพัฒนาโซลูชันการเรียนรู้ของเครื่องโดยใช้โครงการ OSS เช่น Slurm และ Kubernetes พื้นหลังของเขาอยู่ในการวิจัยและพัฒนาการเรียนรู้ของเครื่อง ก่อนที่จะมาร่วมงานกับ AWS Keita เคยทำงานในอุตสาหกรรมอีคอมเมิร์ซในตำแหน่งนักวิทยาศาสตร์การวิจัยที่พัฒนาระบบเรียกค้นรูปภาพสำหรับการค้นหาผลิตภัณฑ์ Keita สำเร็จการศึกษาระดับปริญญาเอกสาขาวิทยาศาสตร์จากมหาวิทยาลัยโตเกียว

เกอิตะ วาตานาเบ้ เป็นสถาปนิกโซลูชันผู้เชี่ยวชาญ GenAI อาวุโสที่ Amazon Web Services ซึ่งเขาช่วยพัฒนาโซลูชันการเรียนรู้ของเครื่องโดยใช้โครงการ OSS เช่น Slurm และ Kubernetes พื้นหลังของเขาอยู่ในการวิจัยและพัฒนาการเรียนรู้ของเครื่อง ก่อนที่จะมาร่วมงานกับ AWS Keita เคยทำงานในอุตสาหกรรมอีคอมเมิร์ซในตำแหน่งนักวิทยาศาสตร์การวิจัยที่พัฒนาระบบเรียกค้นรูปภาพสำหรับการค้นหาผลิตภัณฑ์ Keita สำเร็จการศึกษาระดับปริญญาเอกสาขาวิทยาศาสตร์จากมหาวิทยาลัยโตเกียว

จัสติน เพิร์ล เป็น Principal Solutions Architect ที่ Amazon Web Services เขาให้คำแนะนำลูกค้า generative AI ในการออกแบบ ปรับใช้ และปรับขนาดโครงสร้างพื้นฐานเป็นประจำ เขาเป็นวิทยากรประจำในการประชุม AWS รวมถึง re:Invent และกิจกรรม AWS อื่นๆ จัสตินสำเร็จการศึกษาระดับปริญญาตรีสาขาระบบสารสนเทศเพื่อการจัดการจากมหาวิทยาลัยเท็กซัสที่ออสติน และปริญญาโทสาขาวิศวกรรมซอฟต์แวร์จากมหาวิทยาลัยซีแอตเทิล

จัสติน เพิร์ล เป็น Principal Solutions Architect ที่ Amazon Web Services เขาให้คำแนะนำลูกค้า generative AI ในการออกแบบ ปรับใช้ และปรับขนาดโครงสร้างพื้นฐานเป็นประจำ เขาเป็นวิทยากรประจำในการประชุม AWS รวมถึง re:Invent และกิจกรรม AWS อื่นๆ จัสตินสำเร็จการศึกษาระดับปริญญาตรีสาขาระบบสารสนเทศเพื่อการจัดการจากมหาวิทยาลัยเท็กซัสที่ออสติน และปริญญาโทสาขาวิศวกรรมซอฟต์แวร์จากมหาวิทยาลัยซีแอตเทิล

- เนื้อหาที่ขับเคลื่อนด้วย SEO และการเผยแพร่ประชาสัมพันธ์ รับการขยายวันนี้

- PlatoData.Network Vertical Generative Ai เพิ่มพลังให้กับตัวเอง เข้าถึงได้ที่นี่.

- เพลโตไอสตรีม. Web3 อัจฉริยะ ขยายความรู้ เข้าถึงได้ที่นี่.

- เพลโตESG. คาร์บอน, คลีนเทค, พลังงาน, สิ่งแวดล้อม แสงอาทิตย์, การจัดการของเสีย. เข้าถึงได้ที่นี่.

- เพลโตสุขภาพ เทคโนโลยีชีวภาพและข่าวกรองการทดลองทางคลินิก เข้าถึงได้ที่นี่.

- ที่มา: https://aws.amazon.com/blogs/machine-learning/introducing-amazon-sagemaker-hyperpod-to-train-foundation-models-at-scale/

- :เป็น

- :ที่ไหน

- $ ขึ้น

- 1

- 100

- 12

- 14

- 24

- 7

- a

- ความสามารถ

- เกี่ยวกับเรา

- เร่ง

- เร่ง

- ยอมรับ

- เข้า

- การเข้าถึง

- การเข้าถึง

- ลงชื่อเข้าใช้

- ข้าม

- นอกจากนี้

- เพิ่มเติม

- ที่อยู่

- จัดการ

- การบริหาร

- ความได้เปรียบ

- หลังจาก

- AI

- ทั้งหมด

- การจัดสรร

- อนุญาต

- ช่วยให้

- ด้วย

- อเมซอน

- อเมซอน SageMaker

- Amazon Web Services

- อเมริกา

- จำนวน

- an

- และ

- ใด

- ใช้

- ในเชิงสถาปัตยกรรม

- เป็น

- เกิดขึ้น

- เทียม

- ปัญญาประดิษฐ์

- ปัญญาประดิษฐ์และการเรียนรู้ด้วยเครื่อง

- AS

- เอเชีย

- ในภูมิภาคเอเชียแปซิฟิก

- ที่เกี่ยวข้อง

- At

- ออสติน

- อัตโนมัติ

- อัตโนมัติ

- ความพร้อมใช้งาน

- ใช้ได้

- AWS

- พื้นหลัง

- BE

- จะกลายเป็น

- ก่อน

- พฤติกรรม

- ระหว่าง

- พันล้าน

- การปิดกั้น

- สร้าง

- การก่อสร้าง

- ธุรกิจ

- by

- ที่เรียกว่า

- CAN

- ความสามารถในการ

- ความสามารถ

- ความจุ

- ผู้บริหารสูงสุด

- ท้าทาย

- ความท้าทาย

- การเปลี่ยนแปลง

- ตรวจสอบ

- การตรวจสอบ

- Choose

- ไคลเอนต์

- Cluster

- รหัส

- โดยรวม

- มา

- การสื่อสาร

- คมนาคม

- บริษัท

- สมบูรณ์

- ส่วนประกอบ

- คำนวณ

- การคำนวณ

- การประชุม

- องค์ประกอบ

- การกำหนดค่า

- เชื่อมต่อ

- การเชื่อมต่อ

- การเชื่อมต่อ

- ปลอบใจ

- ต่อ

- ตัวควบคุม

- ราคา

- แพง

- ค่าใช้จ่าย

- สร้าง

- การสร้าง

- การสร้าง

- ขณะนี้

- ประเพณี

- ลูกค้า

- ปรับแต่ง

- การปรับแต่ง

- วงจร

- รอบ

- หน้าปัด

- ข้อมูล

- วัน

- จัดการ

- ค่าเริ่มต้น

- องศา

- ปรับใช้

- นำไปใช้

- ปรับใช้

- การออกแบบ

- ที่ต้องการ

- รายละเอียด

- รายละเอียด

- พัฒนา

- ที่กำลังพัฒนา

- พัฒนาการ

- ต่าง

- การจัดจำหน่าย

- ดิจิตอล

- การหยุดชะงัก

- กระจาย

- คอมพิวเตอร์แบบกระจาย

- กระจายการฝึกอบรม

- ดาวน์โหลด

- สอง

- ในระหว่าง

- แต่ละ

- อีคอมเมิร์ซ

- ทั้ง

- การกำจัด

- ทำให้สามารถ

- ปลายทาง

- ชั้นเยี่ยม

- ทำให้มั่นใจ

- ทั้งหมด

- สิ่งแวดล้อม

- สิ่งแวดล้อม

- สร้าง

- ยุโรป

- แม้

- เหตุการณ์

- เหตุการณ์

- ตัวอย่าง

- ตื่นเต้น

- แพง

- พิเศษ

- ใบหน้า

- ล้มเหลว

- ล้มเหลว

- ความล้มเหลว

- ความล้มเหลว

- ครอบครัว

- เร็วขึ้น

- ความผิดพลาด

- ลักษณะ

- คุณสมบัติ

- เนื้อไม่มีมัน

- ชื่อจริง

- มุ่งเน้น

- ปฏิบัติตาม

- ดังต่อไปนี้

- สำหรับ

- สมัยก่อน

- พบ

- รากฐาน

- ผู้สร้าง

- ผู้ก่อตั้งและซีอีโอ

- สี่

- กรอบ

- แฟรงค์เฟิร์ต

- บ่อย

- มัก

- ราคาเริ่มต้นที่

- เต็ม

- อย่างเต็มที่

- โดยทั่วไป

- สร้าง

- กำเนิด

- กำเนิด AI

- ได้รับ

- GitHub

- เป้าหมาย

- ไป

- ปกครอง

- รับ

- บัญชีกลุ่ม

- กลุ่ม

- จัดการ

- ฮาร์ดแวร์

- มี

- มี

- he

- หัว

- การรักษา

- สุขภาพ

- แข็งแรง

- หนัก

- ยกของหนัก

- จะช่วยให้

- จุดสูง

- ระดับสูง

- ประสิทธิภาพสูง

- ที่สูงที่สุด

- อย่างสูง

- ของเขา

- ถือ

- เจ้าภาพ

- สรุป ความน่าเชื่อถือของ Olymp Trade?

- ทำอย่างไร

- HPC

- HTML

- ที่ http

- HTTPS

- ร้อย

- ID

- เอกลักษณ์

- Idle

- if

- ภาพ

- ทันที

- การดำเนินการ

- ปรับปรุง

- in

- ประกอบด้วย

- รวม

- รวมทั้ง

- เพิ่ม

- อุตสาหกรรม

- ข้อมูล

- ระบบสารสนเทศ

- โครงสร้างพื้นฐาน

- ปัจจัยการผลิต

- ติดตั้ง

- การติดตั้ง

- ตัวอย่าง

- คำแนะนำการใช้

- แบบบูรณาการ

- รวม

- Intelligence

- โต้ตอบ

- การโต้ตอบ

- อินเตอร์เฟซ

- ขัดจังหวะ

- เข้าไป

- แนะนำ

- ร่วมมือ

- ไอร์แลนด์

- ปัญหา

- IT

- การสัมภาษณ์

- งาน

- การร่วม

- jpg

- JSON

- จัสติน

- ที่รู้จักกัน

- ใหญ่

- ขนาดใหญ่

- ความแอบแฝง

- ต่อมา

- ล่าสุด

- ชั้นนำ

- เรียนรู้

- การเรียนรู้

- ห้องสมุด

- ห้องสมุด

- License

- วงจรชีวิต

- facelift

- กดไลก์

- Line

- ลินุกซ์

- ดูรายละเอียด

- ในประเทศ

- เข้าสู่ระบบ

- เข้าสู่ระบบ

- ดู

- ดูเหมือน

- แพ้

- ต่ำ

- เครื่อง

- เรียนรู้เครื่อง

- เก็บรักษา

- การบำรุงรักษา

- ทำ

- ทำให้

- การทำ

- การจัดการ

- การจัดการ

- ผู้จัดการ

- ตลาด

- ปริญญาโท

- เรื่อง

- เพิ่ม

- Meta

- นาที

- ML

- โหมด

- แบบ

- โมเดล

- ทันสมัย

- การตรวจสอบ

- การตรวจสอบ

- การตรวจสอบ

- เดือน

- ข้อมูลเพิ่มเติม

- ส่วนใหญ่

- ชื่อ

- พื้นเมือง

- การเดินเรือ

- จำเป็นต้อง

- จำเป็น

- ต้อง

- เครือข่าย

- ใหม่

- คุณสมบัติใหม่

- ปม

- โหนด

- หมายเหตุ

- ตอนนี้

- Nvidia

- of

- โอไฮโอ

- on

- ตามความต้องการ

- ONE

- เปิด

- โอเพนซอร์ส

- การดำเนินงาน

- การดำเนินงาน

- การเพิ่มประสิทธิภาพ

- การเพิ่มประสิทธิภาพ

- or

- ประสาน

- ออริกอน

- เรา

- อื่นๆ

- ของเรา

- เอาท์พุต

- เกิน

- แปซิฟิก

- บานหน้าต่าง

- Parallel

- พารามิเตอร์

- พารามิเตอร์

- ที่ผ่านไป

- เส้นทาง

- ดำเนินการ

- การปฏิบัติ

- phd

- เพลโต

- เพลโตดาต้าอินเทลลิเจนซ์

- เพลโตดาต้า

- เสียบเข้าไป

- ยอดนิยม

- โพสต์

- ที่มีศักยภาพ

- เตรียมการ

- ก่อน

- ก่อนหน้านี้

- หลัก

- ก่อน

- ส่วนตัว

- เชิงรุก

- ดำเนิน

- การประมวลผล

- ผลิตภัณฑ์

- ความคืบหน้า

- โครงการ

- ให้

- ให้

- การให้

- การประกาศ

- ปริมาณ

- RE

- แนะนำ

- การฟื้นตัว

- ลด

- อ้างอิง

- ภูมิภาค

- ภูมิภาค

- ปกติ

- สม่ำเสมอ

- เอาออก

- ซ่อมแซม

- แทนที่

- การแทนที่

- ขอ

- ต้องการ

- ต้อง

- การวิจัย

- วิจัยและพัฒนา

- การสำรอง

- สำรอง

- ยืดหยุ่น

- ทรัพยากร

- แหล่งข้อมูล

- คำตอบ

- รับผิดชอบ

- เรซูเม่

- บทบาท

- การกำหนดเส้นทาง

- กฎระเบียบ

- วิ่ง

- วิ่ง

- ทำงาน

- sagemaker

- เดียวกัน

- ลด

- ขนาด

- ปรับ

- วิทยาศาสตร์

- นักวิทยาศาสตร์

- ต้นฉบับ

- สคริปต์

- sdks

- ไร้รอยต่อ

- ค้นหา

- ซีแอตเทิ

- ความปลอดภัย

- เห็น

- ส่วน

- ระดับอาวุโส

- ให้บริการ

- บริการ

- บริการ

- เซสชั่น

- ชุด

- Share

- น่า

- แสดงให้เห็นว่า

- เหมือนกับ

- ง่าย

- ที่เรียบง่าย

- สิงคโปร์

- เดียว

- มีขนาดเล็กกว่า

- ซอฟต์แวร์

- การพัฒนาซอฟต์แวร์

- วิศวกรรมซอฟต์แวร์

- โซลูชัน

- การแก้

- แหล่ง

- ลำโพง

- ผู้เชี่ยวชาญ

- โดยเฉพาะ

- ที่ระบุไว้

- ใช้จ่าย

- แยก

- Stability

- มั่นคง

- มาตรฐาน

- เริ่มต้น

- รัฐของศิลปะ

- Status

- ขั้นตอน

- การเก็บรักษา

- จัดเก็บ

- ซื่อตรง

- การศึกษา

- ส่ง

- ส่ง

- ส่ง

- เครือข่ายย่อย

- อย่างเช่น

- สูท

- ชุด

- สรุป

- สนับสนุน

- ที่สนับสนุน

- แน่ใจ

- ซิดนีย์

- ซิงค์.

- ระบบ

- ระบบ

- ตาราง

- เอา

- วิชาการ

- เมตริกซ์

- สถานีปลายทาง

- เท็กซัส

- กว่า

- ที่

- พื้นที่

- ของพวกเขา

- พวกเขา

- แล้วก็

- ล้อยางขัดเหล่านี้ติดตั้งบนแกน XNUMX (มม.) ผลิตภัณฑ์นี้ถูกผลิตในหลายรูปทรง และหลากหลายเบอร์ความแน่นหนาของปริมาณอนุภาคขัดของมัน จะทำให้ท่านได้รับประสิทธิภาพสูงในการขัดและการใช้งานที่ยาวนาน

- พวกเขา

- นี้

- พัน

- ตลอด

- ตลอด

- เวลา

- ไปยัง

- ในวันนี้

- โทเค็น

- โตเกียว

- รถไฟ

- การฝึกอบรม

- โอน

- ชนิด

- ชนิด

- ภายใต้

- มหาวิทยาลัย

- มหาวิทยาลัยโตเกียว

- บันทึก

- ใช้

- มือสอง

- ผู้ใช้งาน

- ผู้ใช้

- ใช้

- การใช้

- ประโยชน์

- การใช้ประโยชน์

- ต่างๆ

- กว้างใหญ่

- รุ่น

- ผ่านทาง

- รายละเอียด

- virginia

- เสมือน

- เยี่ยมชมร้านค้า

- คำแนะนำ

- คือ

- ทาง..

- we

- เว็บ

- บริการเว็บ

- สัปดาห์ที่ผ่านมา

- ดี

- เมื่อ

- ที่

- ในขณะที่

- อย่างกว้างขวาง

- วิกิพีเดีย

- จะ

- กับ

- ภายใน

- ไม่มี

- ทำงาน

- ผู้ปฏิบัติงาน

- จะ

- คุณ

- ของคุณ

- ลมทะเล