รูปแบบการใช้งานที่มีประโยชน์ที่สุดรูปแบบหนึ่งสำหรับปริมาณงาน AI เชิงสร้างสรรค์คือการเรียกข้อมูล Augmented Generation (RAG) ในรูปแบบ RAG เราค้นหาเนื้อหาอ้างอิงที่เกี่ยวข้องกับพรอมต์อินพุตโดยดำเนินการค้นหาความคล้ายคลึงกันในการฝัง การฝังจะบันทึกเนื้อหาข้อมูลในส่วนเนื้อหาของข้อความ ช่วยให้โมเดลการประมวลผลภาษาธรรมชาติ (NLP) ทำงานร่วมกับภาษาในรูปแบบตัวเลขได้ การฝังเป็นเพียงเวกเตอร์ของจำนวนจุดลอยตัว ดังนั้นเราจึงสามารถวิเคราะห์พวกมันเพื่อช่วยตอบคำถามสำคัญสามข้อ: ข้อมูลอ้างอิงของเราเปลี่ยนแปลงไปตามกาลเวลาหรือไม่ คำถามที่ผู้ใช้ถามมีการเปลี่ยนแปลงเมื่อเวลาผ่านไปหรือไม่ และสุดท้าย ข้อมูลอ้างอิงของเราครอบคลุมคำถามที่ถูกถามได้ดีเพียงใด

ในโพสต์นี้ คุณจะได้เรียนรู้เกี่ยวกับข้อควรพิจารณาบางประการในการฝังการวิเคราะห์เวกเตอร์และการตรวจจับสัญญาณของการเบี่ยงเบนของการฝัง เนื่องจากการฝังเป็นแหล่งข้อมูลที่สำคัญสำหรับโมเดล NLP โดยทั่วไปและโดยเฉพาะอย่างยิ่งโซลูชัน AI เชิงสร้างสรรค์ เราจึงต้องมีวิธีการวัดว่าการฝังของเรากำลังเปลี่ยนแปลงอยู่ตลอดเวลาหรือไม่ (การเลื่อน) ในโพสต์นี้ คุณจะเห็นตัวอย่างของการดำเนินการตรวจจับดริฟท์บนเวกเตอร์ที่ฝังโดยใช้เทคนิคการจัดกลุ่มโดยใช้โมเดลภาษาขนาดใหญ่ (LLMS) Amazon SageMaker JumpStart. นอกจากนี้คุณยังสามารถสำรวจแนวคิดเหล่านี้ผ่านตัวอย่างสองตัวอย่างที่ให้มา รวมถึงแอปพลิเคชันตัวอย่างแบบ end-to-end หรือชุดย่อยของแอปพลิเคชัน (ไม่บังคับ)

ภาพรวมของ RAG

พื้นที่ รูปแบบ RAG ช่วยให้คุณสามารถดึงความรู้จากแหล่งภายนอก เช่น เอกสาร PDF บทความ wiki หรือสำเนาการโทร จากนั้นใช้ความรู้นั้นเพื่อเพิ่มคำแนะนำพร้อมท์ที่ส่งไปยัง LLM ซึ่งช่วยให้ LLM สามารถอ้างอิงข้อมูลที่เกี่ยวข้องมากขึ้นเมื่อสร้างการตอบกลับ ตัวอย่างเช่น หากคุณถาม LLM ถึงวิธีทำคุกกี้ช็อกโกแลตชิป ก็สามารถรวมข้อมูลจากคลังสูตรอาหารของคุณเองได้ ในรูปแบบนี้ ข้อความสูตรอาหารจะถูกแปลงเป็นเวกเตอร์ที่ฝังโดยใช้โมเดลการฝัง และจัดเก็บไว้ในฐานข้อมูลเวกเตอร์ คำถามที่เข้ามาจะถูกแปลงเป็นการฝัง จากนั้นฐานข้อมูลเวกเตอร์จะทำการค้นหาความคล้ายคลึงกันเพื่อค้นหาเนื้อหาที่เกี่ยวข้อง คำถามและข้อมูลอ้างอิงจะเข้าสู่พร้อมท์สำหรับ LLM

มาดูเวกเตอร์ที่ฝังไว้ซึ่งถูกสร้างขึ้นและวิธีการวิเคราะห์ดริฟท์ของเวกเตอร์เหล่านั้นกันดีกว่า

การวิเคราะห์การฝังเวกเตอร์

เวกเตอร์ที่ฝังไว้เป็นการแสดงตัวเลขของข้อมูลของเรา ดังนั้นการวิเคราะห์เวกเตอร์เหล่านี้จึงสามารถให้ข้อมูลเชิงลึกเกี่ยวกับข้อมูลอ้างอิงของเรา ซึ่งสามารถนำมาใช้ในการตรวจจับสัญญาณของการเบี่ยงเบนที่อาจเกิดขึ้นได้ในภายหลัง เวกเตอร์ที่ฝังจะแสดงรายการในพื้นที่ n มิติ โดยที่ n มักจะมีขนาดใหญ่ ตัวอย่างเช่น โมเดล GPT-J 6B ที่ใช้ในโพสต์นี้ จะสร้างเวกเตอร์ขนาด 4096 ในการวัดค่าดริฟท์ สมมติว่าแอปพลิเคชันของเราจับเวกเตอร์ที่ฝังไว้สำหรับทั้งข้อมูลอ้างอิงและข้อความแจ้งที่เข้ามา

เราเริ่มต้นด้วยการลดขนาดโดยใช้ Principal Component Analysis (PCA) PCA พยายามลดจำนวนมิติข้อมูลโดยยังคงรักษาความแปรปรวนส่วนใหญ่ของข้อมูลไว้ ในกรณีนี้ เราพยายามค้นหาจำนวนมิติที่รักษาความแปรปรวนไว้ 95% ซึ่งควรจับค่าใดๆ ที่อยู่ภายในค่าเบี่ยงเบนมาตรฐานสองค่า

จากนั้นเราใช้ K-Means เพื่อระบุชุดของศูนย์คลัสเตอร์ K-Means พยายามจัดกลุ่มจุดต่างๆ เข้าด้วยกันเป็นกลุ่มเพื่อให้แต่ละกลุ่มมีขนาดค่อนข้างเล็กและกลุ่มอยู่ห่างจากกันมากที่สุด

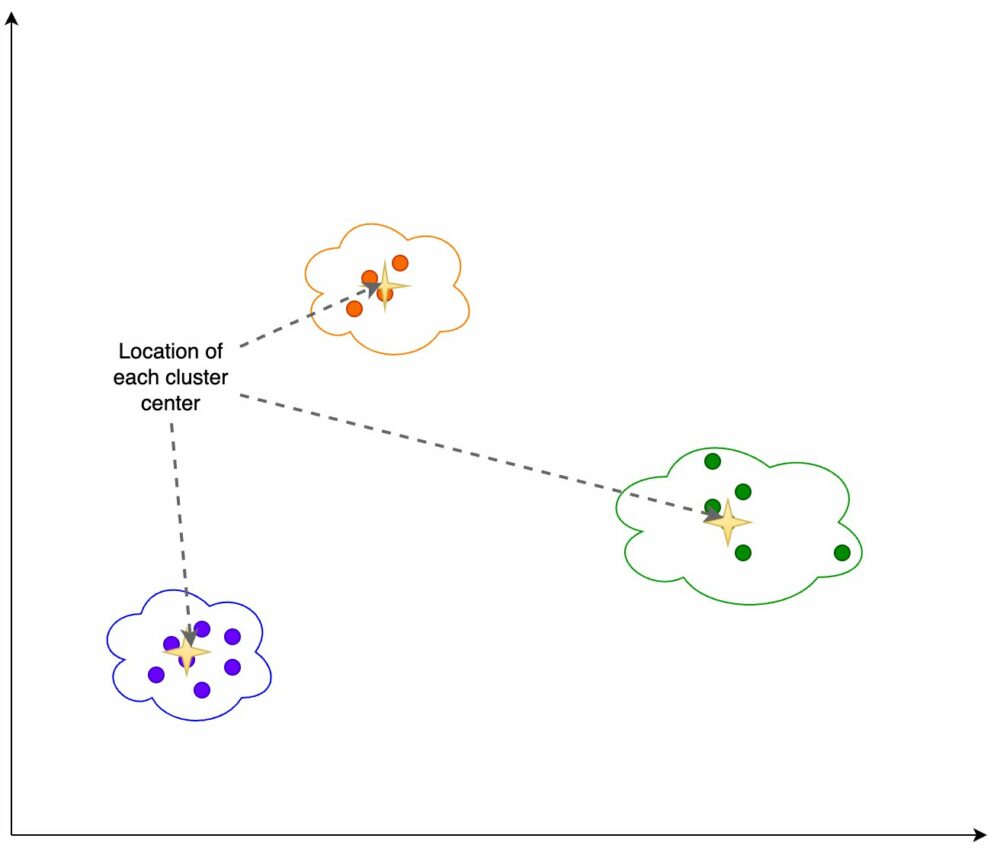

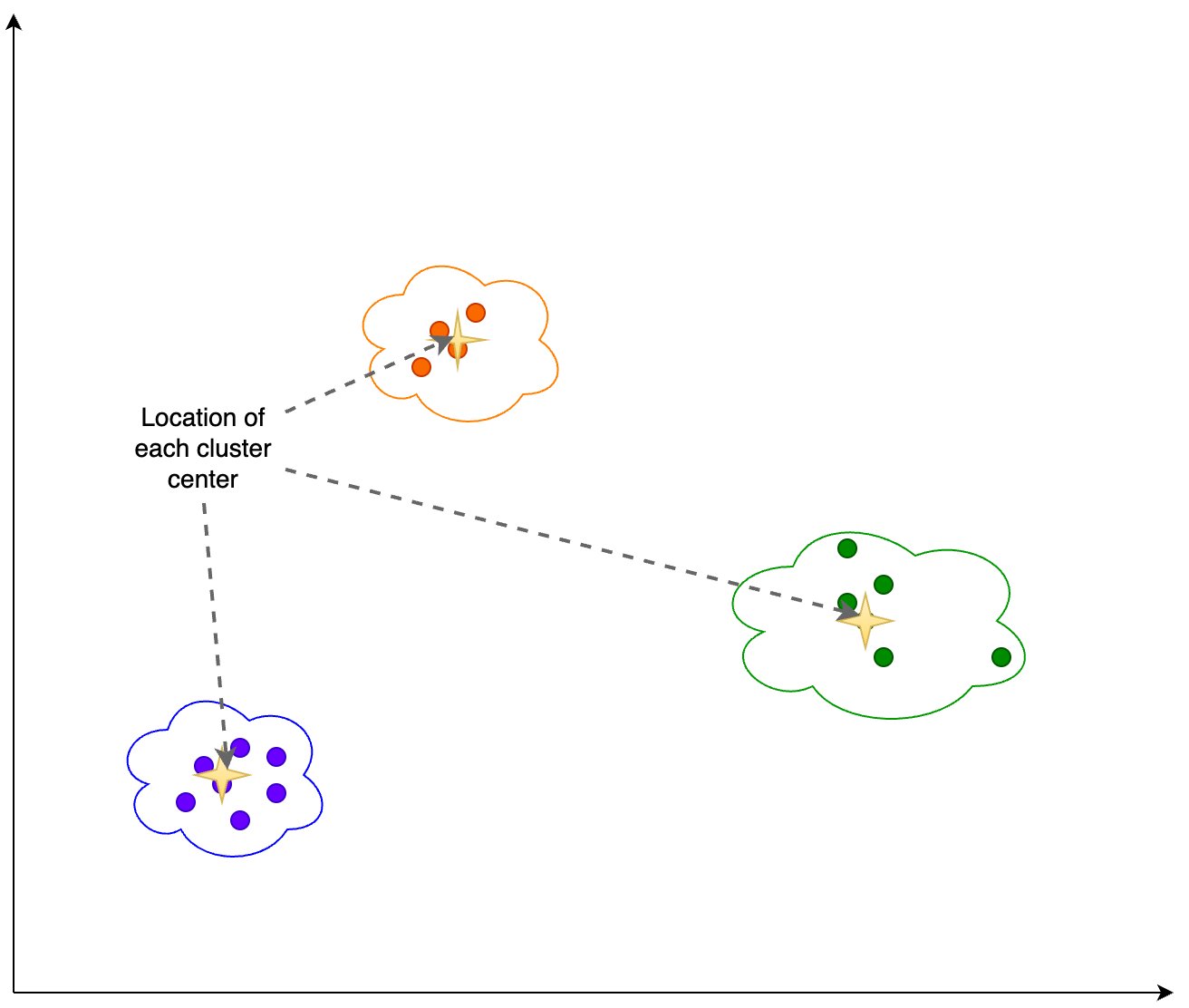

เราคำนวณข้อมูลต่อไปนี้ตามผลลัพธ์การจัดกลุ่มที่แสดงในรูปต่อไปนี้:

- จำนวนมิติข้อมูลใน PCA ที่อธิบายความแปรปรวน 95%

- ตำแหน่งของแต่ละศูนย์คลัสเตอร์หรือเซนทรอยด์

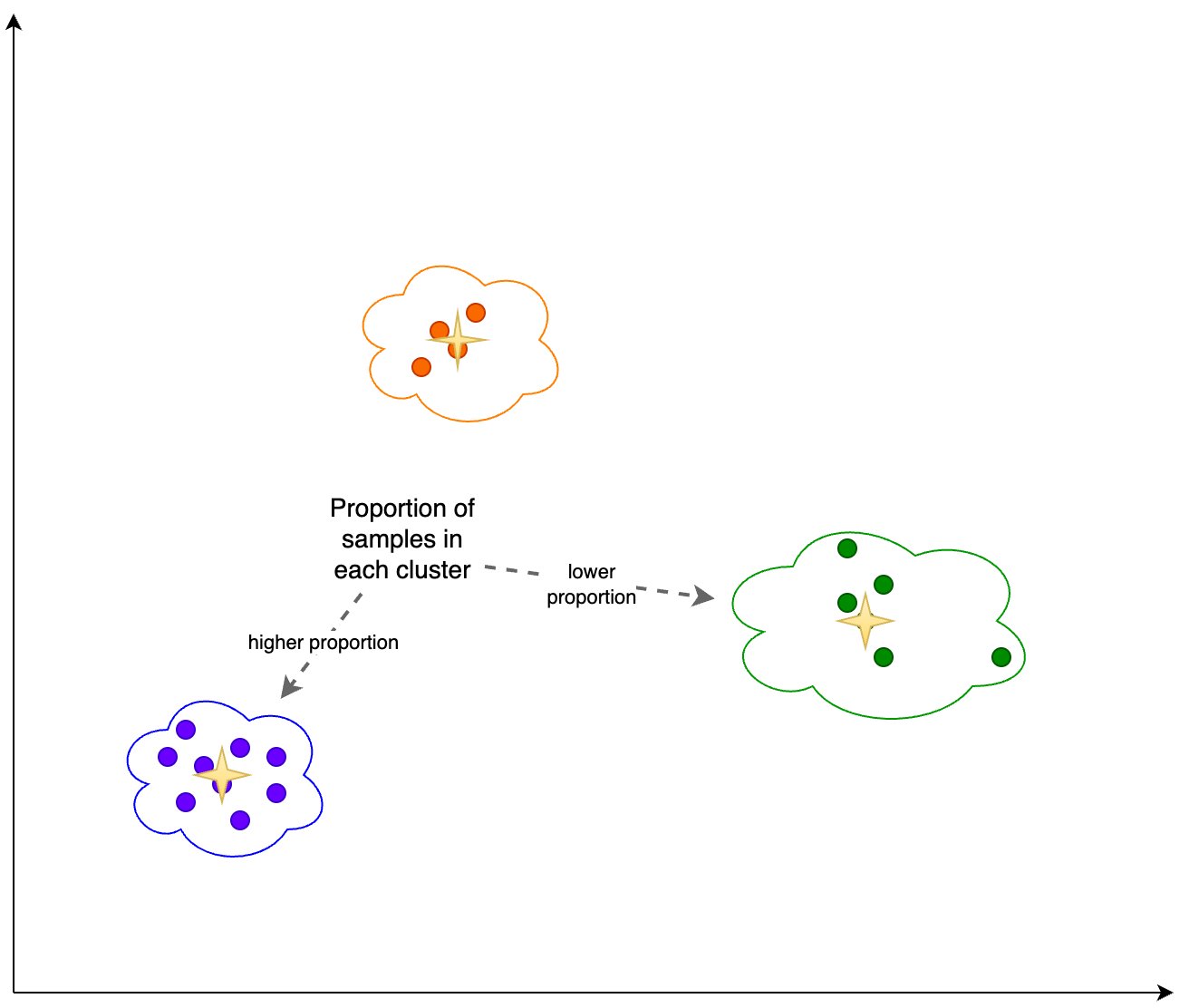

นอกจากนี้ เรายังพิจารณาสัดส่วน (สูงหรือต่ำ) ของกลุ่มตัวอย่างในแต่ละคลัสเตอร์ ดังแสดงในรูปต่อไปนี้

สุดท้ายนี้ เราใช้การวิเคราะห์นี้เพื่อคำนวณสิ่งต่อไปนี้:

- ความเฉื่อย – ความเฉื่อยคือผลรวมของระยะทางกำลังสองต่อเซนทรอยด์ของคลัสเตอร์ ซึ่งจะวัดว่าข้อมูลถูกจัดกลุ่มโดยใช้ K-Means ได้ดีเพียงใด

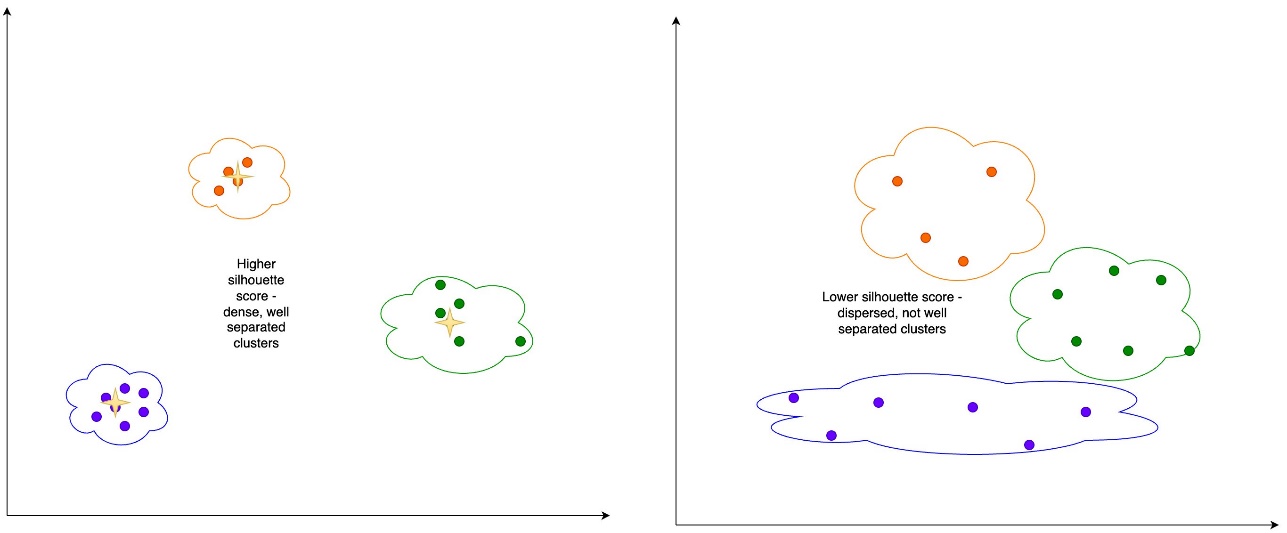

- คะแนนเงา – คะแนนเงาเป็นการวัดการตรวจสอบความถูกต้องของความสอดคล้องภายในคลัสเตอร์ และมีช่วงตั้งแต่ -1 ถึง 1 ค่าที่ใกล้กับ 1 หมายความว่าจุดต่างๆ ในกลุ่มนั้นอยู่ใกล้กับจุดอื่นๆ ในกลุ่มเดียวกันและอยู่ห่างจาก จุดของกลุ่มอื่นๆ การแสดงคะแนนภาพเงาสามารถดูได้ในรูปต่อไปนี้

เราสามารถเก็บข้อมูลนี้เป็นระยะๆ สำหรับภาพรวมของการฝังสำหรับทั้งข้อมูลอ้างอิงแหล่งที่มาและข้อความแจ้ง การเก็บข้อมูลนี้ช่วยให้เราวิเคราะห์สัญญาณที่เป็นไปได้ของการดริฟท์แบบฝังได้

การตรวจจับการดริฟท์แบบฝัง

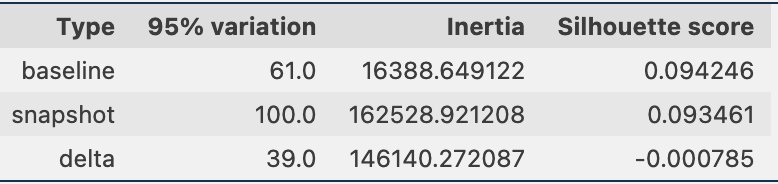

เราสามารถเปรียบเทียบข้อมูลการจัดกลุ่มเป็นระยะๆ ผ่านสแน็ปช็อตของข้อมูล ซึ่งรวมถึงการฝังข้อมูลอ้างอิงและการฝังพร้อมท์ อันดับแรก เราสามารถเปรียบเทียบจำนวนมิติข้อมูลที่จำเป็นในการอธิบาย 95% ของการเปลี่ยนแปลงในข้อมูลที่ฝัง ความเฉื่อย และคะแนนเงาจากงานการจัดกลุ่ม ดังที่คุณเห็นในตารางต่อไปนี้ เมื่อเปรียบเทียบกับเส้นพื้นฐาน สแน็ปช็อตล่าสุดของการฝังต้องใช้มิติข้อมูลมากกว่า 39 มิติเพื่ออธิบายความแปรปรวน ซึ่งบ่งชี้ว่าข้อมูลของเรากระจัดกระจายมากกว่า ความเฉื่อยเพิ่มขึ้น บ่งชี้ว่าตัวอย่างรวมตัวอยู่ห่างจากศูนย์กลางคลัสเตอร์มากขึ้น นอกจากนี้ คะแนนภาพเงายังลดลง บ่งชี้ว่ากลุ่มไม่ได้ถูกกำหนดไว้อย่างชัดเจน เพื่อให้ได้รับข้อมูลที่รวดเร็ว นั่นอาจบ่งชี้ว่าประเภทคำถามที่เข้ามาในระบบครอบคลุมหัวข้อมากขึ้น

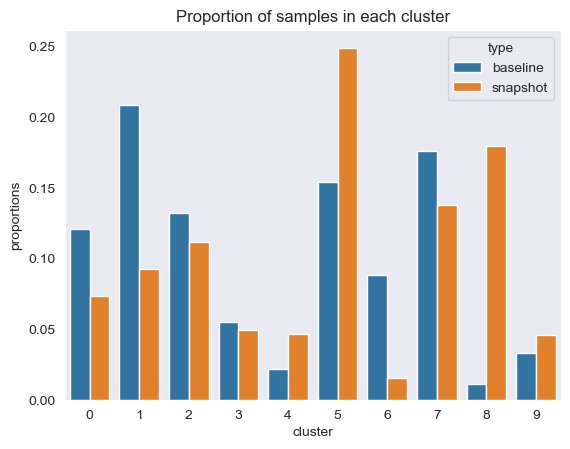

ต่อไป ในรูปต่อไปนี้ เราจะเห็นว่าสัดส่วนของกลุ่มตัวอย่างในแต่ละคลัสเตอร์เปลี่ยนแปลงไปอย่างไรเมื่อเวลาผ่านไป สิ่งนี้สามารถแสดงให้เราเห็นว่าข้อมูลอ้างอิงใหม่ของเรามีความคล้ายคลึงกับชุดก่อนหน้าในวงกว้างหรือครอบคลุมพื้นที่ใหม่หรือไม่

สุดท้ายนี้ เราจะเห็นว่าศูนย์กลางของคลัสเตอร์กำลังเคลื่อนที่หรือไม่ ซึ่งจะแสดงการเบี่ยงเบนของข้อมูลในคลัสเตอร์ ดังที่แสดงในตารางต่อไปนี้

ข้อมูลอ้างอิงครอบคลุมสำหรับคำถามที่เข้ามา

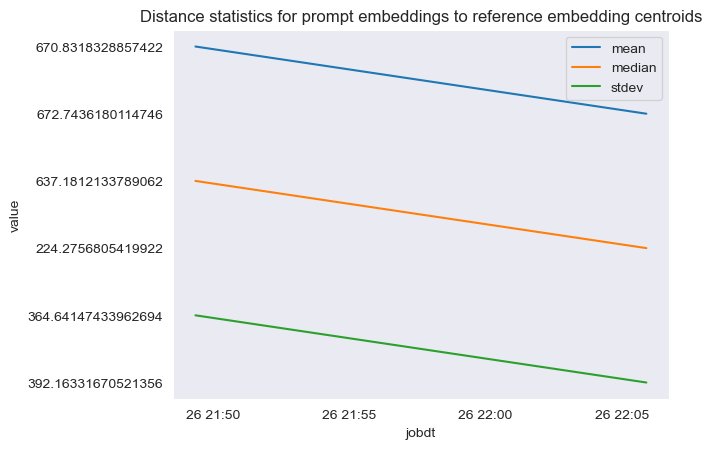

นอกจากนี้เรายังสามารถประเมินได้ว่าข้อมูลอ้างอิงของเราสอดคล้องกับคำถามที่เข้ามาได้ดีเพียงใด ในการดำเนินการนี้ เรากำหนดแต่ละพร้อมต์ที่ฝังลงในคลัสเตอร์ข้อมูลอ้างอิง เราคำนวณระยะทางจากแต่ละการแจ้งเตือนไปยังจุดศูนย์กลางที่เกี่ยวข้อง และดูค่าเฉลี่ย ค่ามัธยฐาน และส่วนเบี่ยงเบนมาตรฐานของระยะทางเหล่านั้น เราสามารถจัดเก็บข้อมูลนั้นและดูว่ามีการเปลี่ยนแปลงอย่างไรเมื่อเวลาผ่านไป

รูปต่อไปนี้แสดงตัวอย่างการวิเคราะห์ระยะห่างระหว่างการพร้อมท์การฝังและศูนย์ข้อมูลอ้างอิงในช่วงเวลาหนึ่ง

ดังที่คุณเห็น สถิติระยะทางเฉลี่ย ค่ามัธยฐาน และค่าเบี่ยงเบนมาตรฐานระหว่างการฝังพร้อมท์และศูนย์ข้อมูลอ้างอิงลดลงระหว่างเส้นฐานเริ่มต้นและสแน็ปช็อตล่าสุด แม้ว่าค่าสัมบูรณ์ของระยะทางจะตีความได้ยาก แต่เราสามารถใช้แนวโน้มเพื่อพิจารณาว่าการทับซ้อนกันทางความหมายระหว่างข้อมูลอ้างอิงกับคำถามที่เข้ามาเริ่มดีขึ้นหรือแย่ลงเมื่อเวลาผ่านไป

แอปพลิเคชันตัวอย่าง

เพื่อรวบรวมผลการทดลองที่กล่าวถึงในส่วนที่แล้ว เราได้สร้างแอปพลิเคชันตัวอย่างที่ใช้รูปแบบ RAG โดยใช้โมเดลการฝังและการสร้างที่ใช้งานผ่าน SageMaker JumpStart และโฮสต์บน อเมซอน SageMaker จุดสิ้นสุดแบบเรียลไทม์

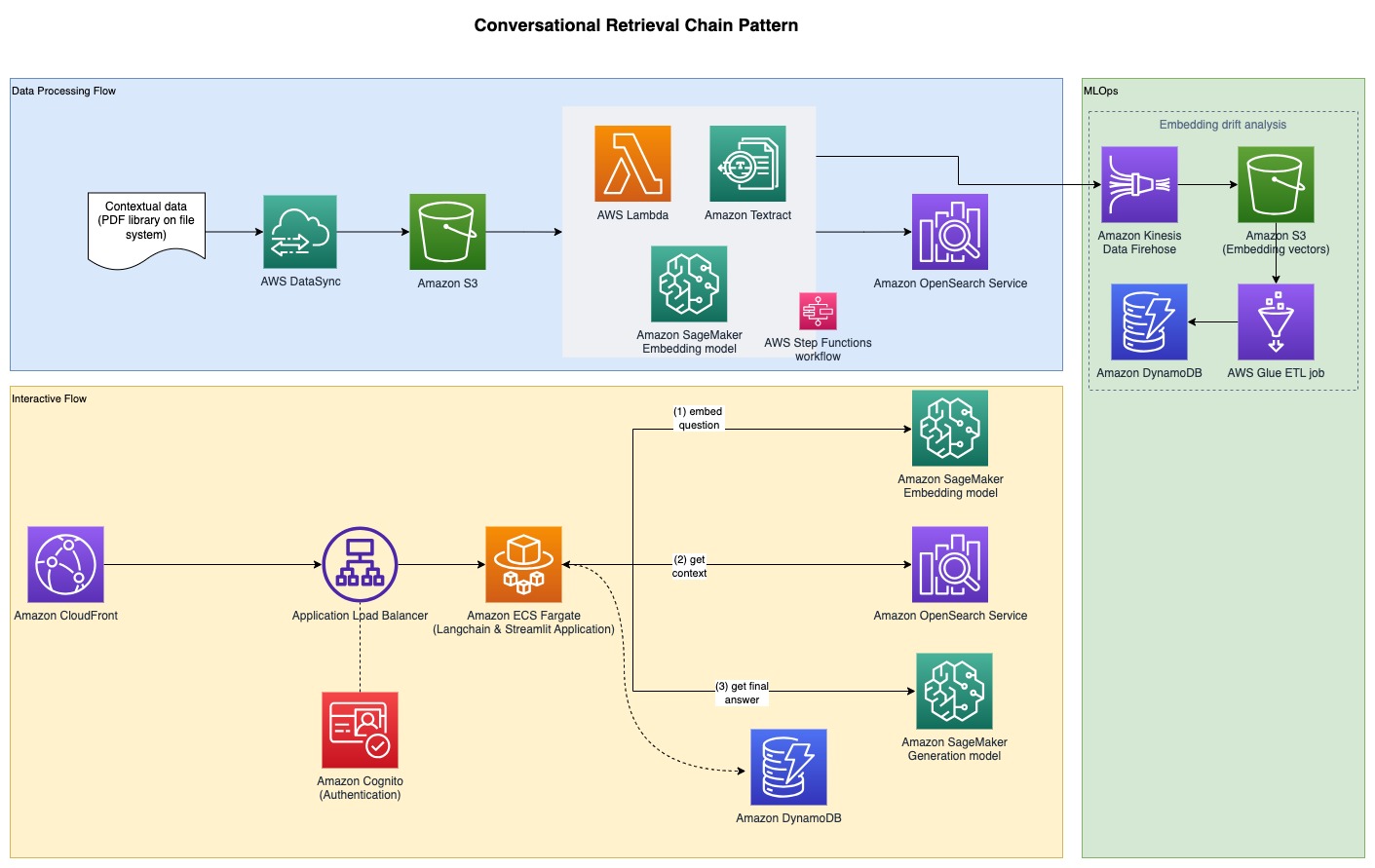

แอปพลิเคชันมีองค์ประกอบหลักสามประการ:

- เราใช้โฟลว์แบบโต้ตอบซึ่งรวมถึงอินเทอร์เฟซผู้ใช้สำหรับบันทึกข้อความแจ้ง รวมกับเลเยอร์การประสาน RAG โดยใช้ LangChain

- ขั้นตอนการประมวลผลข้อมูลจะแยกข้อมูลจากเอกสาร PDF และสร้างการฝังที่เก็บไว้ บริการ Amazon OpenSearch. นอกจากนี้เรายังใช้สิ่งเหล่านี้ในองค์ประกอบการวิเคราะห์ดริฟท์การฝังขั้นสุดท้ายของแอปพลิเคชัน

- การฝังจะถูกจับเข้าไป บริการจัดเก็บข้อมูลอย่างง่ายของ Amazon (อเมซอน S3) ผ่าน สายไฟ Amazon Kinesis Dataและเราดำเนินการรวมกันของ AWS กาว แยก แปลง และโหลดงาน (ETL) และสมุดบันทึก Jupyter เพื่อทำการวิเคราะห์แบบฝัง

แผนภาพต่อไปนี้แสดงสถาปัตยกรรมแบบครบวงจร

รหัสตัวอย่างแบบเต็มมีอยู่ที่ GitHub. รหัสที่ให้มามีให้เลือกสองรูปแบบ:

- ตัวอย่างแอปพลิเคชันแบบฟูลสแตกที่มีฟรอนต์เอนด์ Streamlit – นี่เป็นแอปพลิเคชันแบบ end-to-end รวมถึงอินเทอร์เฟซผู้ใช้ที่ใช้ Streamlit สำหรับการจับ prompt รวมกับเลเยอร์ orchestration RAG โดยใช้ LangChain ทำงานบน บริการ Amazon Elastic Container (อเมซอน อีซีเอส) กับ AWS ฟาร์เกต

- แอปพลิเคชันแบ็กเอนด์ – สำหรับผู้ที่ไม่ต้องการปรับใช้สแต็กแอปพลิเคชันแบบเต็ม คุณสามารถเลือกปรับใช้เฉพาะแบ็กเอนด์ได้ ชุดพัฒนา AWS Cloud (AWS CDK) สแต็ก จากนั้นใช้สมุดบันทึก Jupyter ที่จัดเตรียมไว้เพื่อดำเนินการประสาน RAG โดยใช้ LangChain

ในการสร้างรูปแบบที่มีให้ มีข้อกำหนดเบื้องต้นหลายประการที่มีรายละเอียดในส่วนต่อไปนี้ โดยเริ่มต้นจากการปรับใช้แบบจำลองเชิงกำเนิดและแบบจำลองการฝังข้อความ จากนั้นจึงย้ายไปยังข้อกำหนดเบื้องต้นเพิ่มเติม

ปรับใช้โมเดลผ่าน SageMaker JumpStart

ทั้งสองรูปแบบถือว่าการปรับใช้โมเดลการฝังและโมเดลกำเนิด สำหรับสิ่งนี้ คุณจะต้องปรับใช้สองโมเดลจาก SageMaker JumpStart รุ่นแรก GPT-J 6B ใช้เป็นโมเดลการฝัง และรุ่นที่สอง Falcon-40b ใช้สำหรับการสร้างข้อความ

คุณสามารถปรับใช้แต่ละโมเดลเหล่านี้ผ่าน SageMaker JumpStart จาก คอนโซลการจัดการ AWS, สตูดิโอ Amazon SageMakerหรือทางโปรแกรม สำหรับข้อมูลเพิ่มเติม โปรดดูที่ วิธีการใช้งานโมเดลรองพื้น JumpStart. เพื่อให้การปรับใช้ง่ายขึ้น คุณสามารถใช้ โน๊ตบุ๊คที่ให้มา มาจากสมุดบันทึกที่สร้างโดยอัตโนมัติโดย SageMaker JumpStart สมุดบันทึกนี้จะดึงโมเดลจากฮับ SageMaker JumpStart ML และปรับใช้กับตำแหน่งข้อมูลแบบเรียลไทม์ของ SageMaker สองจุดแยกกัน

สมุดบันทึกตัวอย่างยังมีส่วนการล้างข้อมูลอีกด้วย อย่าเพิ่งเรียกใช้ส่วนนั้น เนื่องจากจะลบปลายทางที่เพิ่งปรับใช้ คุณจะทำการล้างข้อมูลให้เสร็จสิ้นเมื่อสิ้นสุดคำแนะนำแบบทีละขั้นตอน

หลังจากยืนยันการปรับใช้ปลายทางสำเร็จแล้ว คุณก็พร้อมที่จะปรับใช้แอปพลิเคชันตัวอย่างแบบเต็มแล้ว อย่างไรก็ตาม หากคุณสนใจที่จะสำรวจเฉพาะแบ็กเอนด์และสมุดบันทึกการวิเคราะห์มากกว่า คุณสามารถเลือกปรับใช้เฉพาะส่วนนั้นได้ ซึ่งจะกล่าวถึงในส่วนถัดไป

ตัวเลือกที่ 1: ปรับใช้แอปพลิเคชันแบ็กเอนด์เท่านั้น

รูปแบบนี้ช่วยให้คุณสามารถปรับใช้โซลูชันแบ็กเอนด์เท่านั้น และโต้ตอบกับโซลูชันโดยใช้โน้ตบุ๊ก Jupyter ใช้รูปแบบนี้หากคุณไม่ต้องการสร้างอินเทอร์เฟซส่วนหน้าแบบเต็ม

เบื้องต้น

คุณควรมีข้อกำหนดเบื้องต้นดังต่อไปนี้:

- ปรับใช้ตำแหน่งข้อมูลโมเดล SageMaker JumpStart แล้ว – ปรับใช้โมเดลกับตำแหน่งข้อมูลแบบเรียลไทม์ของ SageMaker โดยใช้ SageMaker JumpStart ตามที่อธิบายไว้ก่อนหน้านี้

- พารามิเตอร์การปรับใช้ – บันทึกสิ่งต่อไปนี้:

- ชื่อจุดสิ้นสุดของโมเดลข้อความ – ชื่อจุดสิ้นสุดของโมเดลการสร้างข้อความที่ใช้งานกับ SageMaker JumpStart

- ชื่อจุดสิ้นสุดของโมเดลการฝัง – ชื่อจุดสิ้นสุดของโมเดลการฝังที่ใช้งานกับ SageMaker JumpStart

ปรับใช้ทรัพยากรโดยใช้ AWS CDK

ใช้พารามิเตอร์การปรับใช้ที่ระบุไว้ในส่วนก่อนหน้าเพื่อปรับใช้สแต็ก AWS CDK สำหรับข้อมูลเพิ่มเติมเกี่ยวกับการติดตั้ง AWS CDK โปรดดูที่ เริ่มต้นใช้งาน AWS CDK.

ตรวจสอบให้แน่ใจว่า Docker ได้รับการติดตั้งและทำงานบนเวิร์กสเตชันที่จะใช้สำหรับการปรับใช้ AWS CDK อ้างถึง รับนักเทียบท่า สำหรับคำแนะนำเพิ่มเติม

หรือคุณสามารถป้อนค่าบริบทในไฟล์ที่เรียกว่า cdk.context.json ใน pattern1-rag/cdk ไดเรกทอรีและเรียกใช้ cdk deploy BackendStack --exclusively.

การปรับใช้จะพิมพ์เอาต์พุตออกมา ซึ่งบางส่วนจำเป็นต้องใช้ในการรันโน้ตบุ๊ก ก่อนที่คุณจะเริ่มคำถามและคำตอบ ให้ฝังเอกสารอ้างอิง ดังที่แสดงในส่วนถัดไป

ฝังเอกสารอ้างอิง

สำหรับแนวทาง RAG นี้ เอกสารอ้างอิงจะถูกฝังด้วยโมเดลการฝังข้อความในขั้นแรก และจัดเก็บไว้ในฐานข้อมูลเวกเตอร์ ในโซลูชันนี้ มีการสร้างไปป์ไลน์การนำเข้าที่รับเอกสาร PDF

An อเมซอน อีลาสติก คอมพิวท์ คลาวด์ อินสแตนซ์ (Amazon EC2) ถูกสร้างขึ้นสำหรับการนำเข้าเอกสาร PDF และ ระบบไฟล์ Amazon Elastic ระบบไฟล์ (Amazon EFS) ติดตั้งอยู่บนอินสแตนซ์ EC2 เพื่อบันทึกเอกสาร PDF หนึ่ง AWS DataSync งานจะดำเนินการทุกชั่วโมงเพื่อดึงเอกสาร PDF ที่พบในเส้นทางระบบไฟล์ EFS และอัปโหลดไปยังบัคเก็ต S3 เพื่อเริ่มกระบวนการฝังข้อความ กระบวนการนี้จะฝังเอกสารอ้างอิงและบันทึกการฝังใน OpenSearch Service นอกจากนี้ยังบันทึกไฟล์เก็บถาวรแบบฝังลงในบัคเก็ต S3 ผ่าน Kinesis Data Firehose เพื่อการวิเคราะห์ในภายหลัง

หากต้องการนำเข้าเอกสารอ้างอิง ให้ทำตามขั้นตอนต่อไปนี้:

- รับ ID อินสแตนซ์ EC2 ตัวอย่างที่สร้างขึ้น (ดูเอาต์พุต AWS CDK

JumpHostId) และเชื่อมต่อโดยใช้ ผู้จัดการเซสชัน, ความสามารถของ ผู้จัดการระบบ AWS. สำหรับคำแนะนำ โปรดดูที่ เชื่อมต่อกับอินสแตนซ์ Linux ของคุณด้วย AWS Systems Manager Session Manager. - ไปที่ไดเร็กทอรี

/mnt/efs/fs1ซึ่งเป็นที่ที่ระบบไฟล์ EFS ติดตั้งอยู่ และสร้างโฟลเดอร์ชื่อingest: - เพิ่มเอกสาร PDF อ้างอิงของคุณไปที่

ingestไดเรกทอรี

งาน DataSync ได้รับการกำหนดค่าให้อัปโหลดไฟล์ทั้งหมดที่พบในไดเร็กทอรีนี้ไปยัง Amazon S3 เพื่อเริ่มกระบวนการฝัง

งาน DataSync ทำงานตามกำหนดเวลารายชั่วโมง คุณสามารถเลือกที่จะเริ่มงานด้วยตนเองเพื่อเริ่มกระบวนการฝังทันทีสำหรับเอกสาร PDF ที่คุณเพิ่ม

- หากต้องการเริ่มงาน ให้ค้นหา ID งานจากเอาต์พุต AWS CDK

DataSyncTaskIDและ เริ่มงาน ด้วยค่าเริ่มต้น

หลังจากสร้างการฝังแล้ว คุณสามารถเริ่มคำถาม RAG และตอบผ่านสมุดบันทึก Jupyter ดังที่แสดงในส่วนถัดไป

การถามและตอบโดยใช้สมุดบันทึก Jupyter

ทำตามขั้นตอนต่อไปนี้:

- ดึงชื่ออินสแตนซ์โน้ตบุ๊ก SageMaker จากเอาต์พุต AWS CDK

NotebookInstanceNameและเชื่อมต่อกับ JupyterLab จากคอนโซล SageMaker - ไปที่ไดเร็กทอรี

fmops/full-stack/pattern1-rag/notebooks/. - เปิดและเรียกใช้สมุดบันทึก

query-llm.ipynbในอินสแตนซ์โน้ตบุ๊กเพื่อดำเนินการถามและตอบโดยใช้ RAG

ตรวจสอบให้แน่ใจว่าใช้ conda_python3 เคอร์เนลสำหรับโน้ตบุ๊ก

รูปแบบนี้มีประโยชน์ในการสำรวจโซลูชันแบ็กเอนด์โดยไม่จำเป็นต้องจัดเตรียมข้อกำหนดเบื้องต้นเพิ่มเติมที่จำเป็นสำหรับแอปพลิเคชันแบบเต็มสแตก ส่วนถัดไปครอบคลุมถึงการใช้งานแอปพลิเคชันแบบเต็มสแตก รวมถึงส่วนประกอบฟรอนต์เอนด์และแบ็กเอนด์ เพื่อให้อินเทอร์เฟซผู้ใช้สำหรับการโต้ตอบกับแอปพลิเคชัน generative AI ของคุณ

ตัวเลือกที่ 2: ปรับใช้แอปพลิเคชันตัวอย่างแบบเต็มสแตกด้วยฟรอนต์เอนด์ Streamlit

รูปแบบนี้ช่วยให้คุณสามารถปรับใช้โซลูชันด้วยอินเทอร์เฟซส่วนหน้าของผู้ใช้สำหรับคำถามและคำตอบ

เบื้องต้น

หากต้องการปรับใช้แอปพลิเคชันตัวอย่าง คุณต้องมีข้อกำหนดเบื้องต้นต่อไปนี้:

- ปรับใช้ตำแหน่งข้อมูลโมเดล SageMaker JumpStart แล้ว – ปรับใช้โมเดลกับตำแหน่งข้อมูลแบบเรียลไทม์ของ SageMaker ของคุณโดยใช้ SageMaker JumpStart ดังที่อธิบายไว้ในส่วนก่อนหน้า โดยใช้สมุดบันทึกที่ให้มา

- โซนโฮสต์ของ Amazon Route 53 – สร้าง Amazon เส้นทาง 53 โซนโฮสต์สาธารณะ เพื่อใช้สำหรับการแก้ปัญหานี้ คุณยังสามารถใช้โซนสาธารณะของ Route 53 ที่มีอยู่ได้ เช่น

example.com. - ใบรับรองตัวจัดการใบรับรอง AWS – บทบัญญัติ ตัวจัดการใบรับรอง AWS (ACM) ใบรับรอง TLS สำหรับชื่อโดเมนโซนที่โฮสต์ Route 53 และโดเมนย่อยที่เกี่ยวข้อง เช่น

example.comและ*.example.comสำหรับโดเมนย่อยทั้งหมด สำหรับคำแนะนำ โปรดดูที่ การขอใบรับรองสาธารณะ. ใบรับรองนี้ใช้เพื่อกำหนดค่า HTTPS บน Amazon CloudFront และตัวจัดสรรภาระงานต้นทาง - พารามิเตอร์การปรับใช้ – บันทึกสิ่งต่อไปนี้:

- ชื่อโดเมนที่กำหนดเองของแอปพลิเคชันส่วนหน้า – ชื่อโดเมนที่กำหนดเองที่ใช้ในการเข้าถึงแอปพลิเคชันตัวอย่างส่วนหน้า ชื่อโดเมนที่ให้ไว้ใช้เพื่อสร้างบันทึก DNS เส้นทาง 53 ที่ชี้ไปยังการกระจาย CloudFront ส่วนหน้า ตัวอย่างเช่น,

app.example.com. - ชื่อโดเมนที่กำหนดเองต้นทางของตัวโหลดบาลานเซอร์ – ชื่อโดเมนแบบกำหนดเองที่ใช้สำหรับต้นทางของตัวจัดสรรภาระงานการแจกจ่าย CloudFront ชื่อโดเมนที่ให้ไว้ใช้เพื่อสร้างบันทึก DNS เส้นทาง 53 ที่ชี้ไปยังโหลดบาลานเซอร์ต้นทาง ตัวอย่างเช่น,

app-lb.example.com. - รหัสโซนโฮสต์เส้นทาง 53 – รหัสโซนที่โฮสต์ Route 53 เพื่อโฮสต์ชื่อโดเมนที่กำหนดเองที่ให้ไว้ ตัวอย่างเช่น,

ZXXXXXXXXYYYYYYYYY. - ชื่อโซนโฮสต์ของเส้นทาง 53 – ชื่อของโซนที่โฮสต์ Route 53 เพื่อโฮสต์ชื่อโดเมนแบบกำหนดเองที่ให้ไว้ ตัวอย่างเช่น,

example.com. - ใบรับรอง ACM ARN – ARN ของใบรับรอง ACM ที่จะใช้กับโดเมนที่กำหนดเองที่ให้มา

- ชื่อจุดสิ้นสุดของโมเดลข้อความ – ชื่อจุดสิ้นสุดของโมเดลการสร้างข้อความที่ใช้งานกับ SageMaker JumpStart

- ชื่อจุดสิ้นสุดของโมเดลการฝัง – ชื่อจุดสิ้นสุดของโมเดลการฝังที่ใช้งานกับ SageMaker JumpStart

- ชื่อโดเมนที่กำหนดเองของแอปพลิเคชันส่วนหน้า – ชื่อโดเมนที่กำหนดเองที่ใช้ในการเข้าถึงแอปพลิเคชันตัวอย่างส่วนหน้า ชื่อโดเมนที่ให้ไว้ใช้เพื่อสร้างบันทึก DNS เส้นทาง 53 ที่ชี้ไปยังการกระจาย CloudFront ส่วนหน้า ตัวอย่างเช่น,

ปรับใช้ทรัพยากรโดยใช้ AWS CDK

ใช้พารามิเตอร์การปรับใช้ที่คุณระบุไว้ในข้อกำหนดเบื้องต้นเพื่อปรับใช้สแต็ก AWS CDK สำหรับข้อมูลเพิ่มเติม โปรดดูที่ เริ่มต้นใช้งาน AWS CDK.

ตรวจสอบให้แน่ใจว่า Docker ได้รับการติดตั้งและทำงานบนเวิร์กสเตชันที่จะใช้สำหรับการปรับใช้ AWS CDK

ในโค้ดก่อนหน้า -c แสดงถึงค่าบริบท ในรูปแบบของข้อกำหนดเบื้องต้นที่จำเป็น ซึ่งระบุไว้ในอินพุต หรือคุณสามารถป้อนค่าบริบทในไฟล์ที่เรียกว่า cdk.context.json ใน pattern1-rag/cdk ไดเรกทอรีและเรียกใช้ cdk deploy --all.

โปรดทราบว่าเราระบุภูมิภาคในไฟล์ bin/cdk.ts. การกำหนดค่าบันทึกการเข้าถึง ALB จำเป็นต้องมีภูมิภาคที่ระบุ คุณสามารถเปลี่ยนภูมิภาคนี้ได้ก่อนที่จะปรับใช้

การปรับใช้จะพิมพ์ URL เพื่อเข้าถึงแอปพลิเคชัน Streamlit ก่อนที่คุณจะสามารถเริ่มคำถามและคำตอบได้ คุณจะต้องฝังเอกสารอ้างอิง ดังที่แสดงไว้ในส่วนถัดไป

ฝังเอกสารอ้างอิง

สำหรับแนวทาง RAG เอกสารอ้างอิงจะถูกฝังด้วยโมเดลการฝังข้อความในขั้นแรกและจัดเก็บไว้ในฐานข้อมูลเวกเตอร์ ในโซลูชันนี้ มีการสร้างไปป์ไลน์การนำเข้าที่รับเอกสาร PDF

ดังที่เราได้พูดคุยไปแล้วในตัวเลือกการใช้งานแรก ตัวอย่าง EC2 instance ได้ถูกสร้างขึ้นสำหรับการนำเข้าเอกสาร PDF และระบบไฟล์ EFS ติดตั้งอยู่บน EC2 instance เพื่อบันทึกเอกสาร PDF งาน DataSync จะทำงานทุกชั่วโมงเพื่อดึงเอกสาร PDF ที่พบในเส้นทางระบบไฟล์ EFS และอัปโหลดไปยังบัคเก็ต S3 เพื่อเริ่มกระบวนการฝังข้อความ กระบวนการนี้จะฝังเอกสารอ้างอิงและบันทึกการฝังใน OpenSearch Service นอกจากนี้ยังบันทึกไฟล์เก็บถาวรแบบฝังลงในบัคเก็ต S3 ผ่าน Kinesis Data Firehose เพื่อการวิเคราะห์ในภายหลัง

หากต้องการนำเข้าเอกสารอ้างอิง ให้ทำตามขั้นตอนต่อไปนี้:

- รับ ID อินสแตนซ์ EC2 ตัวอย่างที่สร้างขึ้น (ดูเอาต์พุต AWS CDK

JumpHostId) และเชื่อมต่อโดยใช้ Session Manager - ไปที่ไดเร็กทอรี

/mnt/efs/fs1ซึ่งเป็นที่ที่ระบบไฟล์ EFS ติดตั้งอยู่ และสร้างโฟลเดอร์ชื่อingest: - เพิ่มเอกสาร PDF อ้างอิงของคุณไปที่

ingestไดเรกทอรี

งาน DataSync ได้รับการกำหนดค่าให้อัปโหลดไฟล์ทั้งหมดที่พบในไดเร็กทอรีนี้ไปยัง Amazon S3 เพื่อเริ่มกระบวนการฝัง

งาน DataSync ทำงานตามกำหนดเวลารายชั่วโมง คุณสามารถเลือกที่จะเริ่มงานด้วยตนเองเพื่อเริ่มกระบวนการฝังทันทีสำหรับเอกสาร PDF ที่คุณเพิ่ม

- หากต้องการเริ่มงาน ให้ค้นหา ID งานจากเอาต์พุต AWS CDK

DataSyncTaskIDและ เริ่มงาน ด้วยค่าเริ่มต้น

คำถามและคำตอบ

หลังจากฝังเอกสารอ้างอิงแล้ว คุณสามารถเริ่มคำถามและคำตอบ RAG ได้โดยไปที่ URL เพื่อเข้าถึงแอปพลิเคชัน Streamlit หนึ่ง Amazon Cognito Co มีการใช้เลเยอร์การตรวจสอบความถูกต้อง ดังนั้นจึงจำเป็นต้องสร้างบัญชีผู้ใช้ในกลุ่มผู้ใช้ Amazon Cognito ที่ใช้งานผ่าน AWS CDK (ดูเอาต์พุต AWS CDK สำหรับชื่อพูลผู้ใช้) สำหรับการเข้าถึงแอปพลิเคชันครั้งแรก สำหรับคำแนะนำในการสร้างผู้ใช้ Amazon Cognito โปรดดูที่ การสร้างผู้ใช้ใหม่ใน AWS Management Console.

ฝังการวิเคราะห์ดริฟท์

ในส่วนนี้ เราจะแสดงวิธีดำเนินการวิเคราะห์ดริฟท์โดยสร้างบรรทัดฐานของการฝังข้อมูลอ้างอิงและพร้อมท์การฝังก่อน จากนั้นจึงสร้างสแน็ปช็อตของการฝังเมื่อเวลาผ่านไป ซึ่งจะทำให้คุณสามารถเปรียบเทียบการฝังบรรทัดฐานกับการฝังสแนปชอตได้

สร้างพื้นฐานการฝังสำหรับข้อมูลอ้างอิงและพร้อมท์

หากต้องการสร้างพื้นฐานการฝังข้อมูลอ้างอิง ให้เปิดคอนโซล AWS Glue และเลือกงาน ETL embedding-drift-analysis. ตั้งค่าพารามิเตอร์สำหรับงาน ETL ดังต่อไปนี้และรันงาน:

- ชุด

--job_typeไปยังBASELINE. - ชุด

--out_tableไป อเมซอน ไดนาโมดีบี ตารางอ้างอิงข้อมูลการฝัง (ดูเอาต์พุต AWS CDKDriftTableReferenceสำหรับชื่อโต๊ะ) - ชุด

--centroid_tableไปยังตาราง DynamoDB สำหรับข้อมูลเซนทรอยด์อ้างอิง (ดูเอาต์พุต AWS CDKCentroidTableReferenceสำหรับชื่อโต๊ะ) - ชุด

--data_pathไปที่บัคเก็ต S3 ด้วยคำนำหน้า ตัวอย่างเช่น,s3:///embeddingarchive/. (ดูเอาต์พุต AWS CDKBucketNameสำหรับชื่อถัง)

ในทำนองเดียวกันการใช้งาน ETL embedding-drift-analysisสร้างบรรทัดฐานการฝังของพร้อมท์ ตั้งค่าพารามิเตอร์สำหรับงาน ETL ดังต่อไปนี้และรันงาน:

- ชุด

--job_typeไปยังBASELINE - ชุด

--out_tableไปยังตาราง DynamoDB เพื่อการฝังข้อมูลทันที (ดูเอาต์พุต AWS CDKDriftTablePromptsNameสำหรับชื่อโต๊ะ) - ชุด

--centroid_tableไปที่ตาราง DynamoDB เพื่อรับข้อมูลเซนทรอยด์ทันที (ดูเอาต์พุต AWS CDKCentroidTablePromptsสำหรับชื่อโต๊ะ) - ชุด

--data_pathไปที่บัคเก็ต S3 ด้วยคำนำหน้า ตัวอย่างเช่น,s3:///promptarchive/. (ดูเอาต์พุต AWS CDKBucketNameสำหรับชื่อถัง)

สร้างสแน็ปช็อตการฝังสำหรับข้อมูลอ้างอิงและพร้อมท์

หลังจากที่คุณนำเข้าข้อมูลเพิ่มเติมไปยัง OpenSearch Service แล้ว ให้รันงาน ETL embedding-drift-analysis อีกครั้งเพื่อสแน็ปช็อตการฝังข้อมูลอ้างอิง พารามิเตอร์จะเหมือนกับงาน ETL ที่คุณรันเพื่อสร้างพื้นฐานการฝังของข้อมูลอ้างอิงดังที่แสดงไว้ในส่วนก่อนหน้า ยกเว้นการตั้งค่า --job_type พารามิเตอร์ SNAPSHOT.

ในทำนองเดียวกัน หากต้องการสแนปช็อตการฝังพร้อมท์ ให้รันงาน ETL embedding-drift-analysis อีกครั้ง. พารามิเตอร์จะเหมือนกับงาน ETL ที่คุณรันเพื่อสร้างพื้นฐานการฝังสำหรับพร้อมท์ดังที่แสดงไว้ในส่วนก่อนหน้า ยกเว้นการตั้งค่า --job_type พารามิเตอร์ SNAPSHOT.

เปรียบเทียบข้อมูลพื้นฐานกับสแนปชอต

หากต้องการเปรียบเทียบพื้นฐานการฝังและสแน็ปช็อตสำหรับข้อมูลอ้างอิงและพร้อมท์ ให้ใช้สมุดบันทึกที่ให้มา pattern1-rag/notebooks/drift-analysis.ipynb.

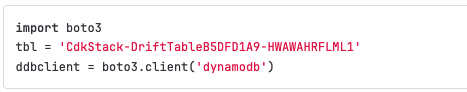

หากต้องการดูการเปรียบเทียบการฝังข้อมูลอ้างอิงหรือข้อความแจ้ง ให้เปลี่ยนตัวแปรชื่อตาราง DynamoDB (tbl และ c_tbl) ในสมุดบันทึกไปยังตาราง DynamoDB ที่เหมาะสมสำหรับการใช้งานสมุดบันทึกแต่ละครั้ง

ตัวแปรสมุดบันทึก tbl ควรเปลี่ยนชื่อตารางดริฟท์ให้เหมาะสม ต่อไปนี้เป็นตัวอย่างตำแหน่งที่จะกำหนดค่าตัวแปรในโน้ตบุ๊ก

ชื่อตารางสามารถดึงข้อมูลได้ดังนี้:

- สำหรับข้อมูลอ้างอิงที่ฝัง ให้ดึงชื่อตารางดริฟท์จากเอาต์พุต AWS CDK

DriftTableReference - สำหรับการฝังข้อมูลพร้อมท์ ให้ดึงชื่อตารางดริฟท์จากเอาต์พุต AWS CDK

DriftTablePromptsName

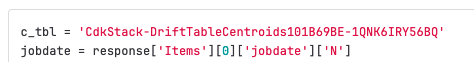

นอกจากนี้ตัวแปรโน้ตบุ๊ก c_tbl ควรเปลี่ยนเป็นชื่อตารางเซนทรอยด์ที่เหมาะสม ต่อไปนี้เป็นตัวอย่างตำแหน่งที่จะกำหนดค่าตัวแปรในโน้ตบุ๊ก

ชื่อตารางสามารถดึงข้อมูลได้ดังนี้:

- สำหรับข้อมูลอ้างอิงที่ฝัง ให้ดึงชื่อตารางเซนทรอยด์จากเอาต์พุต AWS CDK

CentroidTableReference - สำหรับการฝังข้อมูลพร้อมท์ ให้ดึงชื่อตารางเซนทรอยด์จากเอาต์พุต AWS CDK

CentroidTablePrompts

วิเคราะห์ระยะห่างจากข้อมูลอ้างอิง

ขั้นแรก รันงาน AWS Glue embedding-distance-analysis. งานนี้จะค้นหาว่าแต่ละพรอมต์เป็นของการประเมิน K-Means ของการฝังข้อมูลอ้างอิงคลัสเตอร์ใด จากนั้นจะคำนวณค่าเฉลี่ย ค่ามัธยฐาน และส่วนเบี่ยงเบนมาตรฐานของระยะห่างจากแต่ละข้อความแจ้งไปยังศูนย์กลางของคลัสเตอร์ที่เกี่ยวข้อง

คุณสามารถเรียกใช้สมุดบันทึก pattern1-rag/notebooks/distance-analysis.ipynb เพื่อดูแนวโน้มของการวัดระยะทางในช่วงเวลาต่างๆ สิ่งนี้จะทำให้คุณเข้าใจถึงแนวโน้มโดยรวมในการกระจายของระยะการฝังที่รวดเร็ว

คอมพิวเตอร์พกพา pattern1-rag/notebooks/prompt-distance-outliers.ipynb เป็นสมุดบันทึก AWS Glue ที่ค้นหาค่าผิดปกติ ซึ่งสามารถช่วยคุณระบุได้ว่าคุณได้รับข้อความแจ้งเพิ่มเติมที่ไม่เกี่ยวข้องกับข้อมูลอ้างอิงหรือไม่

ติดตามคะแนนความคล้ายคลึงกัน

คะแนนความคล้ายคลึงทั้งหมดจาก OpenSearch Service ได้รับการล็อกอินแล้ว อเมซอน คลาวด์วอตช์ ภายใต้ rag เนมสเปซ แดชบอร์ด RAG_Scores แสดงคะแนนเฉลี่ยและจำนวนคะแนนทั้งหมดที่นำเข้า

ทำความสะอาด

เพื่อหลีกเลี่ยงไม่ให้มีการเรียกเก็บเงินในอนาคต โปรดลบทรัพยากรทั้งหมดที่คุณสร้างขึ้น

ลบโมเดล SageMaker ที่ปรับใช้แล้ว

อ้างอิงส่วนการล้างข้อมูลของ ตัวอย่างโน๊ตบุคที่ให้มา เพื่อลบโมเดล SageMaker JumpStart ที่ปรับใช้ หรือคุณสามารถทำก็ได้ ลบโมเดลบนคอนโซล SageMaker.

ลบทรัพยากร AWS CDK

หากคุณป้อนพารามิเตอร์ของคุณใน cdk.context.json ไฟล์ ให้ล้างข้อมูลดังนี้:

หากคุณป้อนพารามิเตอร์บนบรรทัดคำสั่งและปรับใช้เฉพาะแอปพลิเคชันแบ็คเอนด์ (สแต็ก AWS CDK แบ็กเอนด์) ให้ล้างข้อมูลดังต่อไปนี้:

หากคุณป้อนพารามิเตอร์บนบรรทัดคำสั่งและปรับใช้โซลูชันเต็มรูปแบบ (สแต็ก AWS CDK ส่วนหน้าและส่วนหลัง) ให้ล้างข้อมูลดังต่อไปนี้:

สรุป

ในโพสต์นี้ เราได้จัดเตรียมตัวอย่างการทำงานของแอปพลิเคชันที่รวบรวมเวกเตอร์ที่ฝังไว้สำหรับทั้งข้อมูลอ้างอิงและการแจ้งเตือนในรูปแบบ RAG สำหรับ generative AI เราได้แสดงวิธีดำเนินการวิเคราะห์แบบคลัสเตอร์เพื่อพิจารณาว่าข้อมูลอ้างอิงหรือข้อมูลแจ้งมีการเลื่อนลอยเมื่อเวลาผ่านไป และข้อมูลอ้างอิงครอบคลุมประเภทของคำถามที่ผู้ใช้ถามได้ดีเพียงใด หากคุณตรวจพบการเคลื่อนตัว อาจเป็นสัญญาณว่าสภาพแวดล้อมมีการเปลี่ยนแปลง และโมเดลของคุณได้รับอินพุตใหม่ที่อาจไม่ได้รับการปรับให้เหมาะสมในการจัดการ ซึ่งช่วยให้สามารถประเมินแบบจำลองปัจจุบันในเชิงรุกต่อการเปลี่ยนแปลงอินพุต

เกี่ยวกับผู้เขียน

อับดุลลอฮี โอลาเย เป็นสถาปนิกโซลูชันอาวุโสที่ Amazon Web Services (AWS) Abdullahi สำเร็จการศึกษา MSC สาขาเครือข่ายคอมพิวเตอร์จาก Wichita State University และเป็นนักเขียนที่ได้รับการตีพิมพ์ซึ่งมีบทบาทในโดเมนเทคโนโลยีต่างๆ เช่น DevOps การปรับปรุงโครงสร้างพื้นฐานให้ทันสมัย และ AI ปัจจุบันเขามุ่งเน้นไปที่ Generative AI และมีบทบาทสำคัญในการช่วยเหลือองค์กรต่างๆ ในการออกแบบและสร้างโซลูชันล้ำสมัยที่ขับเคลื่อนโดย Generative AI นอกเหนือจากขอบเขตของเทคโนโลยีแล้ว เขาค้นพบความสุขในศิลปะแห่งการสำรวจ เมื่อไม่ได้สร้างสรรค์โซลูชัน AI เขาสนุกกับการท่องเที่ยวกับครอบครัวเพื่อสำรวจสถานที่ใหม่ๆ

อับดุลลอฮี โอลาเย เป็นสถาปนิกโซลูชันอาวุโสที่ Amazon Web Services (AWS) Abdullahi สำเร็จการศึกษา MSC สาขาเครือข่ายคอมพิวเตอร์จาก Wichita State University และเป็นนักเขียนที่ได้รับการตีพิมพ์ซึ่งมีบทบาทในโดเมนเทคโนโลยีต่างๆ เช่น DevOps การปรับปรุงโครงสร้างพื้นฐานให้ทันสมัย และ AI ปัจจุบันเขามุ่งเน้นไปที่ Generative AI และมีบทบาทสำคัญในการช่วยเหลือองค์กรต่างๆ ในการออกแบบและสร้างโซลูชันล้ำสมัยที่ขับเคลื่อนโดย Generative AI นอกเหนือจากขอบเขตของเทคโนโลยีแล้ว เขาค้นพบความสุขในศิลปะแห่งการสำรวจ เมื่อไม่ได้สร้างสรรค์โซลูชัน AI เขาสนุกกับการท่องเที่ยวกับครอบครัวเพื่อสำรวจสถานที่ใหม่ๆ

แรนดี เดอโฟว์ เป็นสถาปนิกอาวุโสด้านโซลูชันหลักที่ AWS เขาจบ MSEE จาก University of Michigan ที่ซึ่งเขาทำงานด้านคอมพิวเตอร์วิทัศน์สำหรับยานยนต์ไร้คนขับ เขายังสำเร็จการศึกษา MBA จาก Colorado State University Randy ดำรงตำแหน่งหลากหลายตำแหน่งในแวดวงเทคโนโลยี ตั้งแต่วิศวกรรมซอฟต์แวร์ไปจนถึงการจัดการผลิตภัณฑ์ เข้ามาในพื้นที่ข้อมูลขนาดใหญ่ในปี 2013 และยังคงสำรวจพื้นที่นั้น เขากำลังทำงานอย่างแข็งขันในโครงการในพื้นที่ ML และได้นำเสนอในการประชุมมากมายรวมถึง Strata และ GlueCon

แรนดี เดอโฟว์ เป็นสถาปนิกอาวุโสด้านโซลูชันหลักที่ AWS เขาจบ MSEE จาก University of Michigan ที่ซึ่งเขาทำงานด้านคอมพิวเตอร์วิทัศน์สำหรับยานยนต์ไร้คนขับ เขายังสำเร็จการศึกษา MBA จาก Colorado State University Randy ดำรงตำแหน่งหลากหลายตำแหน่งในแวดวงเทคโนโลยี ตั้งแต่วิศวกรรมซอฟต์แวร์ไปจนถึงการจัดการผลิตภัณฑ์ เข้ามาในพื้นที่ข้อมูลขนาดใหญ่ในปี 2013 และยังคงสำรวจพื้นที่นั้น เขากำลังทำงานอย่างแข็งขันในโครงการในพื้นที่ ML และได้นำเสนอในการประชุมมากมายรวมถึง Strata และ GlueCon

เชลบี ไอเกนโบรด เป็นหัวหน้าสถาปนิกโซลูชัน AI และ Machine Learning Specialist Solutions ที่ Amazon Web Services (AWS) เธอทำงานด้านเทคโนโลยีมาเป็นเวลา 24 ปีในหลากหลายอุตสาหกรรม เทคโนโลยี และบทบาท ปัจจุบันเธอกำลังมุ่งเน้นไปที่การรวมพื้นหลัง DevOps และ ML เข้ากับโดเมนของ MLOps เพื่อช่วยลูกค้าในการส่งมอบและจัดการปริมาณงาน ML ตามขนาด ด้วยสิทธิบัตรกว่า 35 ฉบับที่มอบให้ในโดเมนเทคโนโลยีต่างๆ เธอมีความหลงใหลในการสร้างสรรค์นวัตกรรมอย่างต่อเนื่องและใช้ข้อมูลเพื่อขับเคลื่อนผลลัพธ์ทางธุรกิจ Shelbee เป็นผู้ร่วมสร้างและผู้สอนความเชี่ยวชาญด้านวิทยาศาสตร์ข้อมูลเชิงปฏิบัติใน Coursera เธอยังเป็นผู้อำนวยการร่วมของ Women In Big Data (WiBD) ที่เมืองเดนเวอร์ด้วย ในเวลาว่าง เธอชอบที่จะใช้เวลากับครอบครัว เพื่อนฝูง และสุนัขที่โอ้อวด

เชลบี ไอเกนโบรด เป็นหัวหน้าสถาปนิกโซลูชัน AI และ Machine Learning Specialist Solutions ที่ Amazon Web Services (AWS) เธอทำงานด้านเทคโนโลยีมาเป็นเวลา 24 ปีในหลากหลายอุตสาหกรรม เทคโนโลยี และบทบาท ปัจจุบันเธอกำลังมุ่งเน้นไปที่การรวมพื้นหลัง DevOps และ ML เข้ากับโดเมนของ MLOps เพื่อช่วยลูกค้าในการส่งมอบและจัดการปริมาณงาน ML ตามขนาด ด้วยสิทธิบัตรกว่า 35 ฉบับที่มอบให้ในโดเมนเทคโนโลยีต่างๆ เธอมีความหลงใหลในการสร้างสรรค์นวัตกรรมอย่างต่อเนื่องและใช้ข้อมูลเพื่อขับเคลื่อนผลลัพธ์ทางธุรกิจ Shelbee เป็นผู้ร่วมสร้างและผู้สอนความเชี่ยวชาญด้านวิทยาศาสตร์ข้อมูลเชิงปฏิบัติใน Coursera เธอยังเป็นผู้อำนวยการร่วมของ Women In Big Data (WiBD) ที่เมืองเดนเวอร์ด้วย ในเวลาว่าง เธอชอบที่จะใช้เวลากับครอบครัว เพื่อนฝูง และสุนัขที่โอ้อวด

- เนื้อหาที่ขับเคลื่อนด้วย SEO และการเผยแพร่ประชาสัมพันธ์ รับการขยายวันนี้

- PlatoData.Network Vertical Generative Ai เพิ่มพลังให้กับตัวเอง เข้าถึงได้ที่นี่.

- เพลโตไอสตรีม. Web3 อัจฉริยะ ขยายความรู้ เข้าถึงได้ที่นี่.

- เพลโตESG. คาร์บอน, คลีนเทค, พลังงาน, สิ่งแวดล้อม แสงอาทิตย์, การจัดการของเสีย. เข้าถึงได้ที่นี่.

- เพลโตสุขภาพ เทคโนโลยีชีวภาพและข่าวกรองการทดลองทางคลินิก เข้าถึงได้ที่นี่.

- ที่มา: https://aws.amazon.com/blogs/machine-learning/monitor-embedding-drift-for-llms-deployed-from-amazon-sagemaker-jumpstart/

- :มี

- :เป็น

- :ไม่

- :ที่ไหน

- $ ขึ้น

- 1

- 10

- 100

- 2013

- 24

- 35%

- 39

- 7

- 9

- 95%

- a

- สามารถ

- เกี่ยวกับเรา

- แน่นอน

- เข้า

- ลงชื่อเข้าใช้

- พลอากาศเอก

- ข้าม

- อย่างกระตือรือร้น

- ที่เพิ่ม

- นอกจากนี้

- เพิ่มเติม

- ข้อมูลเพิ่มเติม

- นอกจากนี้

- อีกครั้ง

- กับ

- สรุป

- AI

- จัดแนว

- ทั้งหมด

- การอนุญาต

- ช่วยให้

- ด้วย

- แม้ว่า

- อเมซอน

- Amazon Cognito Co

- Amazon EC2

- อเมซอน SageMaker

- Amazon SageMaker JumpStart

- Amazon Web Services

- Amazon Web Services (AWS)

- an

- การวิเคราะห์

- วิเคราะห์

- วิเคราะห์

- และ

- คำตอบ

- ตอบ

- สิ่งใด

- เหมาะสม

- การใช้งาน

- เข้าใกล้

- เหมาะสม

- สถาปัตยกรรม

- เอกสารเก่า

- เป็น

- AREA

- พื้นที่

- ศิลปะ

- บทความ

- AS

- ถาม

- ขอให้

- การให้ความช่วยเหลือ

- สมมติ

- At

- เสริม

- เติม

- การยืนยันตัวตน

- ผู้เขียน

- อัตโนมัติ

- อิสระ

- ยานพาหนะอิสระ

- ใช้ได้

- เฉลี่ย

- หลีกเลี่ยง

- ไป

- AWS

- AWS กาว

- แบ็กเอนด์

- พื้นหลัง

- แกว่ง

- ตาม

- baseline

- BE

- เพราะ

- รับ

- ก่อน

- กำลัง

- เป็น

- ดีกว่า

- ระหว่าง

- เกิน

- ใหญ่

- ข้อมูลขนาดใหญ่

- ร่างกาย

- ทั้งสอง

- แต้

- สร้าง

- สร้าง

- ธุรกิจ

- by

- คำนวณ

- คำนวณ

- โทรศัพท์

- ที่เรียกว่า

- CAN

- ความสามารถ

- จับ

- ถูกจับกุม

- จับ

- จับ

- กรณี

- CD

- ศูนย์

- ศูนย์

- ใบรับรอง

- เปลี่ยนแปลง

- การเปลี่ยนแปลง

- การเปลี่ยนแปลง

- เปลี่ยนแปลง

- บท

- โหลด

- ชิป

- ช็อคโกแลต

- Choose

- ปลาเดยส์

- ปิดหน้านี้

- ใกล้ชิด

- เมฆ

- Cluster

- การจัดกลุ่ม

- รหัส

- โคโลราโด

- การผสมผสาน

- รวม

- การรวมกัน

- มา

- กะทัดรัด

- เปรียบเทียบ

- เมื่อเทียบกับ

- การเปรียบเทียบ

- สมบูรณ์

- ส่วนประกอบ

- ส่วนประกอบ

- คำนวณ

- คอมพิวเตอร์

- วิสัยทัศน์คอมพิวเตอร์

- แนวความคิด

- การประชุม

- การกำหนดค่า

- การกำหนดค่า

- เชื่อมต่อ

- การพิจารณา

- ปลอบใจ

- ภาชนะ

- เนื้อหา

- สิ่งแวดล้อม

- อย่างต่อเนื่อง

- ต่อเนื่องกัน

- แปลง

- คุ้กกี้

- แกน

- ตรงกัน

- ความคุ้มครอง

- ปกคลุม

- ครอบคลุม

- ครอบคลุม

- สร้าง

- ที่สร้างขึ้น

- สร้าง

- การสร้าง

- ปัจจุบัน

- ขณะนี้

- ประเพณี

- ลูกค้า

- ตัดขอบ

- หน้าปัด

- ข้อมูล

- ศูนย์ข้อมูล

- การประมวลผล

- วิทยาศาสตร์ข้อมูล

- ฐานข้อมูล

- ค่าเริ่มต้น

- กำหนด

- ส่งมอบ

- เดนเวอร์

- ปรับใช้

- นำไปใช้

- ปรับใช้

- การใช้งาน

- Deploys

- ที่ได้มา

- ทำลาย

- รายละเอียด

- ตรวจจับ

- การตรวจพบ

- กำหนด

- พัฒนาการ

- การเบี่ยงเบน

- แผนภาพ

- ต่าง

- ยาก

- Dimension

- มิติ

- กล่าวถึง

- แยกย้ายกันไป

- ระยะทาง

- ไกล

- การกระจาย

- DNS

- do

- นักเทียบท่า

- เอกสาร

- เอกสาร

- โดเมน

- ชื่อโดเมน

- ชื่อโดเมน

- โดเมน

- Dont

- ลง

- ขับรถ

- แต่ละ

- ฝัง

- ที่ฝัง

- การฝัง

- ปลาย

- จบสิ้น

- ปลายทาง

- ชั้นเยี่ยม

- เข้าสู่

- เข้า

- ผู้ประกอบการ

- สิ่งแวดล้อม

- ประเมินค่า

- การประเมินผล

- ทุกๆ

- ตัวอย่าง

- ตัวอย่าง

- ข้อยกเว้น

- ที่มีอยู่

- การทดลอง

- อธิบาย

- การสำรวจ

- สำรวจ

- สำรวจ

- ภายนอก

- สารสกัด

- สารสกัดจาก

- ครอบครัว

- ไกล

- รูป

- เนื้อไม่มีมัน

- ไฟล์

- สุดท้าย

- ในที่สุด

- หา

- พบ

- ชื่อจริง

- ที่ลอย

- ไหล

- มุ่งเน้น

- โดยมุ่งเน้น

- ดังต่อไปนี้

- ดังต่อไปนี้

- สำหรับ

- ฟอร์ม

- พบ

- รากฐาน

- เพื่อน

- ราคาเริ่มต้นที่

- ส่วนหน้า

- เต็ม

- อนาคต

- รวบรวม

- General

- การสร้าง

- รุ่น

- กำเนิด

- กำเนิด AI

- ได้รับ

- ได้รับ

- ให้

- Go

- ไป

- รับ

- บัญชีกลุ่ม

- คำแนะนำ

- จัดการ

- มี

- he

- จัดขึ้น

- ช่วย

- เธอ

- สูงกว่า

- ของเขา

- ถือ

- เจ้าภาพ

- เป็นเจ้าภาพ

- ชั่วโมง

- สรุป ความน่าเชื่อถือของ Olymp Trade?

- ทำอย่างไร

- อย่างไรก็ตาม

- HTML

- ที่ http

- HTTPS

- Hub

- ID

- แยกแยะ

- if

- แสดงให้เห็นถึง

- ทันที

- การดำเนินงาน

- การดำเนินการ

- สำคัญ

- in

- ประกอบด้วย

- รวมถึง

- รวมทั้ง

- ขาเข้า

- แสดง

- อุตสาหกรรม

- ความเฉื่อย

- ข้อมูล

- โครงสร้างพื้นฐาน

- แรกเริ่ม

- นักวิเคราะห์ส่วนบุคคลที่หาโอกาสให้เป็นไปได้มากที่สุด

- อินพุต

- ปัจจัยการผลิต

- ความเข้าใจ

- การติดตั้ง

- การติดตั้ง

- ตัวอย่าง

- คำแนะนำการใช้

- โต้ตอบ

- การมีปฏิสัมพันธ์

- การโต้ตอบ

- สนใจ

- อินเตอร์เฟซ

- เข้าไป

- IT

- ITS

- การสัมภาษณ์

- งาน

- ความปิติยินดี

- jpg

- เพียงแค่

- คีย์

- ท่อดับเพลิง Kinesis Data

- ความรู้

- ภาษา

- ใหญ่

- ต่อมา

- ล่าสุด

- ชั้น

- เรียนรู้

- การเรียนรู้

- ช่วยให้

- ห้องสมุด

- ยอดไลก์

- Line

- ลินุกซ์

- LLM

- โหลด

- ที่ตั้ง

- เข้า

- ดู

- LOOKS

- ลด

- เครื่อง

- เรียนรู้เครื่อง

- ทำ

- จัดการ

- การจัดการ

- ผู้จัดการ

- ด้วยมือ

- อาจ..

- หมายความ

- วิธี

- วัด

- มาตรการ

- ตัวชี้วัด

- มิชิแกน

- อาจ

- ML

- ม.ป.ป

- แบบ

- โมเดล

- การตรวจสอบ

- ข้อมูลเพิ่มเติม

- มากที่สุด

- การย้าย

- หลาย

- ต้อง

- ชื่อ

- ชื่อ

- โดยธรรมชาติ

- ประมวลผลภาษาธรรมชาติ

- จำเป็นต้อง

- จำเป็น

- ต้อง

- เครือข่าย

- ใหม่

- ใหม่

- ถัดไป

- NLP

- สมุดบันทึก

- เด่น

- จำนวน

- ตัวเลข

- มากมาย

- of

- มักจะ

- on

- เพียง

- เปิด

- การปรับให้เหมาะสม

- ตัวเลือกเสริม (Option)

- or

- ประสาน

- ใบสั่ง

- ที่มา

- อื่นๆ

- ของเรา

- ออก

- ผลลัพธ์

- ที่ระบุไว้

- เอาท์พุต

- เอาท์พุท

- เกิน

- ทั้งหมด

- คาบเกี่ยวกัน

- ของตนเอง

- พารามิเตอร์

- พารามิเตอร์

- ในสิ่งที่สนใจ

- กิเลส

- สิทธิบัตร

- เส้นทาง

- แบบแผน

- รูปแบบ

- รูปแบบไฟล์ PDF

- ดำเนินการ

- ที่มีประสิทธิภาพ

- ชิ้น

- ท่อ

- สถานที่

- เพลโต

- เพลโตดาต้าอินเทลลิเจนซ์

- เพลโตดาต้า

- เล่น

- จุด

- จุด

- สระ

- ตำแหน่ง

- เป็นไปได้

- โพสต์

- ที่มีศักยภาพ

- ขับเคลื่อน

- ประยุกต์

- มาก่อน

- ข้อกำหนดเบื้องต้น

- นำเสนอ

- การรักษา

- ก่อน

- ก่อนหน้านี้

- หลัก

- พิมพ์

- เชิงรุก

- กระบวนการ

- การประมวลผล

- ผลิตภัณฑ์

- การจัดการผลิตภัณฑ์

- โครงการ

- แจ้ง

- สัดส่วน

- ให้

- ให้

- ให้

- บทบัญญัติ

- สาธารณะ

- การตีพิมพ์

- ดึง

- คำถาม

- คำถาม

- เศษผ้า

- ช่วง

- ตั้งแต่

- พร้อม

- เรียลไทม์

- ดินแดน

- สูตร

- ระเบียน

- ลด

- การลดลง

- อ้างอิง

- การอ้างอิง

- ภูมิภาค

- ที่เกี่ยวข้อง

- สัมพัทธ์

- ตรงประเด็น

- แสดง

- การแสดง

- แสดงให้เห็นถึง

- จำเป็นต้องใช้

- ต้อง

- แหล่งข้อมูล

- คำตอบ

- ผลสอบ

- การแก้ไข

- บทบาท

- บทบาท

- เส้นทาง

- วิ่ง

- วิ่ง

- ทำงาน

- sagemaker

- เดียวกัน

- ลด

- ขนาด

- กำหนด

- วิทยาศาสตร์

- คะแนน

- ค้นหา

- ค้นหา

- ที่สอง

- Section

- ส่วน

- เห็น

- เห็น

- เลือก

- ความหมาย

- ระดับอาวุโส

- ความรู้สึก

- ส่ง

- แยก

- บริการ

- บริการ

- เซสชั่น

- ชุด

- การตั้งค่า

- หลาย

- เธอ

- น่า

- โชว์

- แสดงให้เห็นว่า

- แสดง

- แสดงให้เห็นว่า

- สัญญาณ

- สัญญาณ

- คล้ายคลึงกัน

- ง่าย

- ลดความซับซ้อน

- ขนาด

- ภาพย่อ

- So

- ซอฟต์แวร์

- วิศวกรรมซอฟต์แวร์

- ทางออก

- โซลูชัน

- บาง

- แหล่ง

- แหล่งที่มา

- ช่องว่าง

- ความตึงเครียด

- ผู้เชี่ยวชาญ

- ที่ระบุไว้

- ใช้จ่าย

- squared

- กอง

- สแต็ค

- มาตรฐาน

- เริ่มต้น

- ข้อความที่เริ่ม

- ที่เริ่มต้น

- สถานะ

- สถิติ

- ขั้นตอน

- การเก็บรักษา

- จัดเก็บ

- เก็บไว้

- ที่ประสบความสำเร็จ

- อย่างเช่น

- แน่ใจ

- ระบบ

- ระบบ

- ตาราง

- เอา

- งาน

- เทคนิค

- เทคโนโลยี

- เทคโนโลยี

- ข้อความ

- ที่

- พื้นที่

- ข้อมูล

- ที่มา

- ของพวกเขา

- พวกเขา

- แล้วก็

- ที่นั่น

- ล้อยางขัดเหล่านี้ติดตั้งบนแกน XNUMX (มม.) ผลิตภัณฑ์นี้ถูกผลิตในหลายรูปทรง และหลากหลายเบอร์ความแน่นหนาของปริมาณอนุภาคขัดของมัน จะทำให้ท่านได้รับประสิทธิภาพสูงในการขัดและการใช้งานที่ยาวนาน

- นี้

- เหล่านั้น

- สาม

- ตลอด

- เวลา

- ไปยัง

- ร่วมกัน

- หัวข้อ

- รวม

- แปลง

- การเดินทาง

- เทรนด์

- แนวโน้ม

- ลอง

- สอง

- ชนิด

- ภายใต้

- มหาวิทยาลัย

- URL

- us

- ใช้

- มือสอง

- มีประโยชน์

- ผู้ใช้งาน

- ส่วนติดต่อผู้ใช้

- ผู้ใช้

- การใช้

- การตรวจสอบ

- ความคุ้มค่า

- ความคุ้มค่า

- ตัวแปร

- ความหลากหลาย

- ต่างๆ

- ยานพาหนะ

- ผ่านทาง

- วิสัยทัศน์

- ภาพ

- คำแนะนำ

- ต้องการ

- คือ

- ทาง..

- we

- เว็บ

- บริการเว็บ

- ดี

- เมื่อ

- ว่า

- ที่

- ในขณะที่

- จะ

- กับ

- ภายใน

- ไม่มี

- ผู้หญิง

- งาน

- ทำงาน

- การทำงาน

- เวิร์กสเตชัน

- แย่ลง

- จะ

- ปี

- ยัง

- คุณ

- ของคุณ

- ลมทะเล

- โซน