- January 20, 2014

- Vasilis Vryniotiso

- . 5 ความคิดเห็น

ในการจัดประเภทข้อความ การเลือกคุณสมบัติเป็นกระบวนการของการเลือกชุดย่อยเฉพาะของเงื่อนไขของชุดการฝึก และใช้เฉพาะในอัลกอริธึมการจัดหมวดหมู่เท่านั้น กระบวนการคัดเลือกคุณสมบัติจะเกิดขึ้นก่อนการฝึกอบรมตัวแยกประเภท

อัปเดต: ขณะนี้ Datumbox Machine Learning Framework เป็นโอเพ่นซอร์สและฟรีสำหรับ ดาวน์โหลด. ตรวจสอบแพ็คเกจ com.datumbox.framework.machinelearning.featureselection เพื่อดูการนำเมธอด Chi-square และ Mutual Information Feature Selection ไปใช้ใน Java

ข้อได้เปรียบหลักสำหรับการใช้อัลกอริธึมการเลือกคุณสมบัติคือข้อเท็จจริงที่ว่ามันลดมิติข้อมูลของเรา ทำให้การฝึกอบรมเร็วขึ้น และสามารถปรับปรุงความแม่นยำโดยการลบคุณสมบัติที่รบกวน ผลที่ตามมาก็คือ การเลือกคุณสมบัติสามารถช่วยเราหลีกเลี่ยงการใส่มากเกินไป

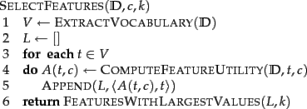

อัลกอริธึมการเลือกพื้นฐานสำหรับการเลือกคุณสมบัติที่ดีที่สุด k แสดงไว้ด้านล่าง (แมนนิ่ง และคณะ, 2008):

ในหัวข้อถัดไป เราจะนำเสนออัลกอริธึมการเลือกคุณสมบัติที่แตกต่างกันสองแบบ: ข้อมูลรวม และ Chi Square

ข้อมูลร่วมกัน

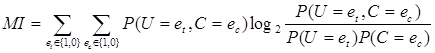

วิธีการเลือกคุณสมบัติทั่วไปวิธีหนึ่งคือ Mutual Information ของเทอม t ในคลาส c (แมนนิ่ง และคณะ, 2008). สิ่งนี้วัดว่าข้อมูลที่มีหรือไม่มีคำใดคำหนึ่งมีส่วนช่วยในการตัดสินใจจำแนกประเภทที่ถูกต้องในค. ข้อมูลร่วมกันสามารถคำนวณได้โดยใช้สูตรต่อไปนี้:

[1]

[1]

ในการคำนวณของเรา เนื่องจากเราใช้ค่าประมาณความน่าจะเป็นสูงสุดของความน่าจะเป็น เราจึงสามารถใช้สมการต่อไปนี้ได้:

![]() [2]

[2]

โดยที่ N คือจำนวนเอกสารทั้งหมด Ntcคือจำนวนเอกสารที่มีค่า et (การเกิดขึ้นของเทอม t ในเอกสาร จะใช้ค่า 1 หรือ 0) และ ec(การเกิดของเอกสารในคลาส c จะใช้ค่า 1 หรือ 0) ที่ระบุโดยตัวห้อยสองตัว ![]() และ

และ ![]() . สุดท้ายเราต้องสังเกตว่าตัวแปรดังกล่าวทั้งหมดใช้ค่าที่ไม่เป็นลบ

. สุดท้ายเราต้องสังเกตว่าตัวแปรดังกล่าวทั้งหมดใช้ค่าที่ไม่เป็นลบ

จี้สแควร์

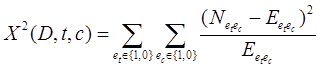

วิธีการเลือกคุณสมบัติทั่วไปอีกวิธีหนึ่งคือ จี้สแควร์. เดอะ x2 การทดสอบใช้ในสถิติเพื่อทดสอบความเป็นอิสระของสองเหตุการณ์ โดยเฉพาะอย่างยิ่งในการเลือกคุณสมบัติเราใช้เพื่อทดสอบว่าการเกิดขึ้นของคำศัพท์เฉพาะและการเกิดขึ้นของคลาสเฉพาะนั้นเป็นอิสระหรือไม่ ดังนั้นเราจึงประมาณการปริมาณต่อไปนี้สำหรับแต่ละเทอมและเราจัดอันดับตามคะแนน:

[3]

[3]

คะแนนสูงใน x2 แสดงว่าสมมติฐานว่าง (H0) ความเป็นอิสระควรถูกปฏิเสธและด้วยเหตุนี้การเกิดขึ้นของคำศัพท์และระดับขึ้นอยู่กับ หากขึ้นอยู่กับพวกเขา เราจะเลือกคุณสมบัติสำหรับการจัดประเภทข้อความ

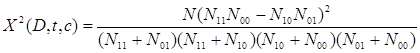

สูตรข้างต้นสามารถเขียนใหม่ได้ดังนี้:

[4]

[4]

ถ้าเราใช้วิธี Chi Square เราควรเลือกเฉพาะจำนวนคุณสมบัติที่กำหนดไว้ล่วงหน้าที่มี ax2 คะแนนการทดสอบที่มากกว่า 10.83 ซึ่งบ่งชี้นัยสำคัญทางสถิติที่ระดับ 0.001

สุดท้ายแต่ไม่ท้ายสุด เราควรสังเกตว่าจากจุดทางสถิติ การเลือกคุณสมบัติของ Chi Square นั้นไม่ถูกต้อง เนื่องจากระดับความเป็นอิสระหนึ่งระดับและ การแก้ไขเยทส์ ควรใช้แทน (ซึ่งจะทำให้เข้าถึงนัยสำคัญทางสถิติได้ยากขึ้น) ดังนั้น เราควรคาดหวังว่าจากคุณลักษณะที่เลือกทั้งหมด ส่วนเล็ก ๆ ของคุณลักษณะเหล่านี้ไม่ขึ้นกับชั้นเรียน) ดังนั้น เราควรคาดหวังว่าจากคุณลักษณะที่เลือกทั้งหมด ส่วนเล็ก ๆ ของคุณลักษณะเหล่านี้ไม่ขึ้นกับชั้นเรียน ยังไงก็ตาม แมนนิ่งและคณะ (2008) แสดงให้เห็นว่าคุณลักษณะที่มีเสียงดังเหล่านี้ไม่ส่งผลกระทบอย่างจริงจังต่อความถูกต้องโดยรวมของตัวแยกประเภทของเรา

การลบคุณสมบัติที่มีเสียงดัง/หายาก

อีกเทคนิคหนึ่งที่สามารถช่วยให้เราหลีกเลี่ยงการใส่มากเกินไป ลดการใช้หน่วยความจำ และเพิ่มความเร็ว คือการเอาคำศัพท์ที่หายากทั้งหมดออกจากคำศัพท์ ตัวอย่างเช่น สามารถกำจัดเงื่อนไขทั้งหมดที่เกิดขึ้นเพียงครั้งเดียวในทุกหมวดหมู่ การนำข้อกำหนดเหล่านั้นออกสามารถลดการใช้หน่วยความจำได้เป็นปัจจัยสำคัญและปรับปรุงความเร็วของการวิเคราะห์ สุดท้ายนี้ เราไม่ควรให้เทคนิคนี้ใช้ร่วมกับอัลกอริธึมการเลือกคุณลักษณะด้านบน

คุณชอบบทความนี้หรือไม่? โปรดสละเวลาสักครู่เพื่อแบ่งปันบน Twitter 🙂

- AI

- ไอ อาร์ต

- เครื่องกำเนิดไออาร์ท

- หุ่นยนต์ไอ

- ปัญญาประดิษฐ์

- ใบรับรองปัญญาประดิษฐ์

- หุ่นยนต์ปัญญาประดิษฐ์

- หุ่นยนต์ปัญญาประดิษฐ์

- ซอฟต์แวร์ปัญญาประดิษฐ์

- blockchain

- การประชุม blockchain ai

- เหรียญอัจฉริยะ

- ปัญญาประดิษฐ์สนทนา

- การประชุม crypto ai

- ดัล-อี

- กล่องข้อมูล

- การเรียนรู้ลึก ๆ

- google ai

- เรียนรู้เครื่อง

- แมชชีนเลิร์นนิงและสถิติ

- เพลโต

- เพลโตไอ

- เพลโตดาต้าอินเทลลิเจนซ์

- เกมเพลโต

- เพลโตดาต้า

- เพลโตเกม

- ขนาดไอ

- วากยสัมพันธ์

- ลมทะเล