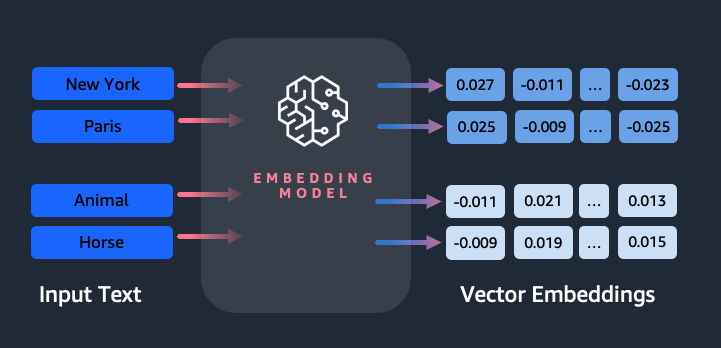

Yerleştirmeler, doğal dil işlemede (NLP) ve makine öğreniminde (ML) önemli bir rol oynar. Metin yerleştirme Metni yüksek boyutlu bir vektör uzayında bulunan sayısal temsillere dönüştürme sürecini ifade eder. Bu teknik, verilerin anlamının ve bağlamının anlaşılmasını (anlamsal ilişkiler) ve veriler içindeki karmaşık ilişkilerin ve kalıpların öğrenilmesini (sözdizimsel ilişkiler) mümkün kılan makine öğrenimi algoritmalarının kullanılmasıyla gerçekleştirilir. Sonuçta elde edilen vektör temsillerini bilgi erişimi, metin sınıflandırma, doğal dil işleme ve daha birçok uygulama gibi geniş bir uygulama yelpazesi için kullanabilirsiniz.

Amazon Titan Metin Gömmeleri tek sözcüklerden, ifadelerden ve hatta büyük belgelerden oluşan doğal dil metnini, arama, kişiselleştirme ve semantik benzerliğe dayalı kümeleme gibi kullanım durumlarını güçlendirmek için kullanılabilecek sayısal temsillere dönüştüren bir metin yerleştirme modelidir.

Bu yazıda Amazon Titan Text Embeddings modelini, özelliklerini ve örnek kullanım örneklerini tartışıyoruz.

Bazı temel kavramlar şunları içerir:

- Metnin sayısal temsili (vektörler), anlambilimi ve kelimeler arasındaki ilişkileri yakalar

- Metin benzerliğini karşılaştırmak için zengin yerleştirmeler kullanılabilir

- Çok dilli metin yerleştirmeleri farklı dillerdeki anlamı tanımlayabilir

Bir metin parçası nasıl vektöre dönüştürülür?

Bir cümleyi vektöre dönüştürmek için birden fazla teknik vardır. Popüler yöntemlerden biri, Word2Vec, GloVe veya FastText gibi sözcük yerleştirme algoritmalarını kullanmak ve ardından sözcük yerleştirmelerini cümle düzeyinde bir vektör temsili oluşturmak üzere toplamaktır.

Diğer bir yaygın yaklaşım, BERT veya GPT gibi tüm cümleler için bağlamsallaştırılmış yerleştirmeler sağlayabilen büyük dil modellerinin (LLM'ler) kullanılmasıdır. Bu modeller, bir cümledeki kelimeler arasındaki bağlamsal bilgileri ve ilişkileri daha etkili bir şekilde yakalayabilen Transformers gibi derin öğrenme mimarilerine dayanmaktadır.

Neden bir yerleştirme modeline ihtiyacımız var?

Vektör yerleştirmeler, LLM'lerin dilin semantik derecelerini anlaması için temeldir ve aynı zamanda LLM'lerin duygu analizi, adlandırılmış varlık tanıma ve metin sınıflandırma gibi aşağı yönlü NLP görevlerinde iyi performans göstermesini sağlar.

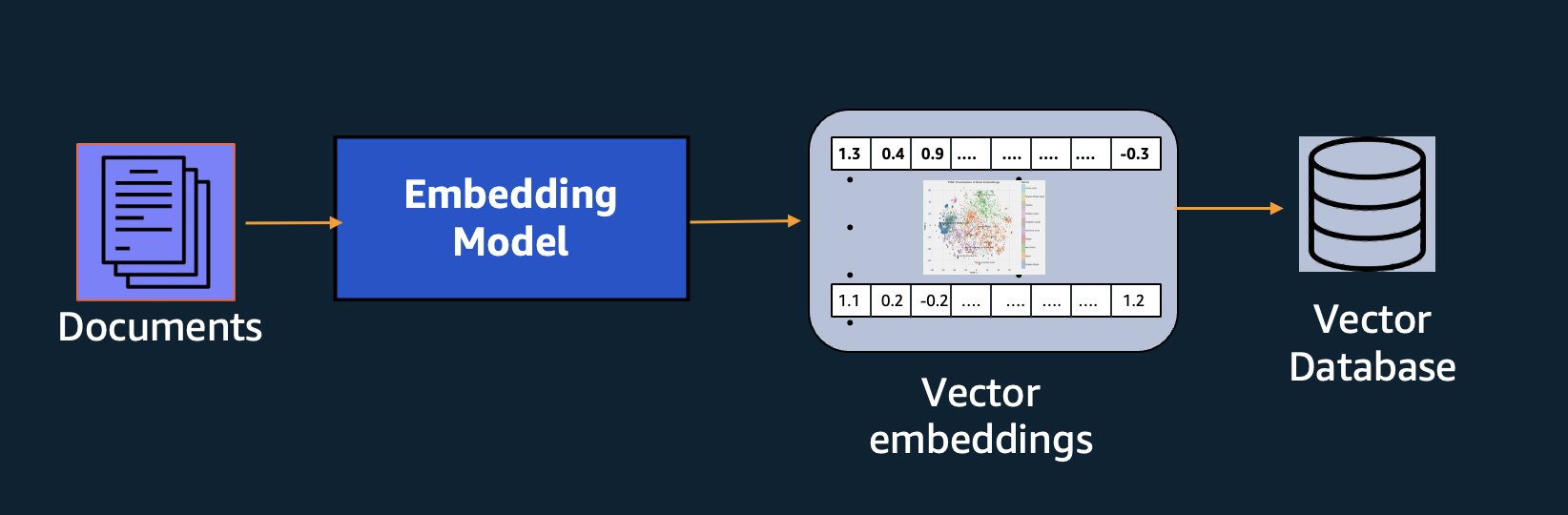

Anlamsal aramaya ek olarak, Alma Artırılmış Üretim (RAG) aracılığıyla daha doğru sonuçlar elde etmek için istemlerinizi artırmak amacıyla yerleştirmeleri kullanabilirsiniz; ancak bunları kullanmak için bunları vektör özelliklerine sahip bir veritabanında saklamanız gerekir.

Amazon Titan Text Embeddings modeli, RAG kullanım örneklerini mümkün kılmak amacıyla metin alımı için optimize edilmiştir. İlk önce metin verilerinizi sayısal gösterimlere veya vektörlere dönüştürmenize ve ardından bu vektörleri kullanarak bir vektör veritabanından ilgili pasajları doğru bir şekilde aramanıza olanak tanır ve diğer temel modellerle birlikte özel verilerinizden en iyi şekilde yararlanmanıza olanak tanır.

Çünkü Amazon Titan Text Embeddings, yönetilen bir modeldir. Amazon Ana Kayasıtamamen sunucusuz bir deneyim olarak sunulmaktadır. Amazon Bedrock REST aracılığıyla kullanabilirsiniz. API veya AWS SDK'yı kullanın. Gerekli parametreler, yerleştirmelerini oluşturmak istediğiniz metin ve modelID Amazon Titan Text Embeddings modelinin adını temsil eden parametre. Aşağıdaki kod, Python için AWS SDK'nın (Boto3) kullanıldığı bir örnektir:

Çıktı aşağıdaki gibi görünecektir:

Bakın Amazon Bedrock boto3 Kurulumu Gerekli paketlerin nasıl kurulacağı, Amazon Bedrock'a nasıl bağlanılacağı ve modellerin nasıl çağrılacağı hakkında daha fazla ayrıntı için.

Amazon Titan Metin Gömmelerinin Özellikleri

Amazon Titan Text Embeddings ile 8,000'e kadar jeton girebilirsiniz; bu da kullanım durumunuza göre tek kelimelerle, kelime öbekleriyle veya tüm belgelerle çalışmaya çok uygun olmasını sağlar. Amazon Titanı 1536 boyutunun çıktı vektörlerini döndürerek yüksek derecede doğruluk sağlar ve aynı zamanda düşük gecikme süreli, uygun maliyetli sonuçlar için optimizasyon sağlar.

Amazon Titan Text Embeddings, 25'ten fazla farklı dilde metin için eklemeler oluşturmayı ve sorgulamayı destekler. Bu, desteklemek istediğiniz her dil için ayrı modeller oluşturup sürdürmenize gerek kalmadan modeli kullanım senaryolarınıza uygulayabileceğiniz anlamına gelir.

Birçok dilde eğitilmiş tek bir yerleştirme modeline sahip olmak aşağıdaki temel faydaları sağlar:

- Daha geniş erişim – 25'ten fazla dili kullanıma hazır olarak destekleyerek uygulamalarınızın erişimini birçok uluslararası pazardaki kullanıcılara ve içeriğe genişletebilirsiniz.

- Tutarlı performans – Birden çok dili kapsayan birleşik bir model sayesinde, dil başına ayrı optimizasyon yapmak yerine, diller arasında tutarlı sonuçlar elde edersiniz. Model bütünsel olarak eğitildiğinden diller arasında avantaj elde edersiniz.

- Çok dilli sorgu desteği – Amazon Titan Text Embeddings, desteklenen dillerden herhangi birinde metin yerleştirmelerin sorgulanmasına olanak tanır. Bu, tek bir dille sınırlı kalmadan diller arasında anlamsal olarak benzer içeriklerin alınmasına yönelik esneklik sağlar. Aynı birleşik yerleştirme alanını kullanarak çok dilli verileri sorgulayan ve analiz eden uygulamalar oluşturabilirsiniz.

Bu yazının yazıldığı an itibarıyla aşağıdaki diller desteklenmektedir:

- Arapça

- Basitleştirilmiş Çince)

- Çince (Geleneksel)

- Çek

- Flemenkçe

- İngilizce

- Fransızca

- Almanca

- İbranice

- Hintçe

- İtalyan

- Japonca

- kannada

- Koreli

- Malayalam

- Marathi

- Lehçe

- Portekizce

- Rusça

- İspanyolca

- İsveççe

- Filipinli Tagalogca

- tamil

- telugu

- Türkce

LangChain ile Amazon Titan Metin Gömmelerini Kullanma

Dil Zinciri çalışmak için popüler bir açık kaynak çerçevesidir üretken yapay zeka modeller ve destekleyici teknolojiler. Bir içerir BedrockEmbedddings istemcisi Boto3 SDK'yı bir soyutlama katmanıyla uygun bir şekilde saran. BedrockEmbeddings istemci, JSON istek veya yanıt yapılarının ayrıntılarını bilmeden metin ve eklemelerle doğrudan çalışmanıza olanak tanır. Aşağıdaki basit bir örnektir:

Ayrıca LangChain'i de kullanabilirsiniz. BedrockEmbeddings RAG, anlamsal arama ve yerleştirmeyle ilgili diğer modellerin uygulanmasını basitleştirmek için Amazon Bedrock LLM istemcisinin yanı sıra istemci.

Gömmeler için kullanım örnekleri

RAG şu anda yerleştirmelerle çalışmak için en popüler kullanım durumu olmasına rağmen, yerleştirmelerin uygulanabileceği başka birçok kullanım durumu da vardır. Aşağıda, kendi başına veya bir Yüksek Lisans ile işbirliği içinde belirli sorunları çözmek için yerleştirmeleri kullanabileceğiniz bazı ek senaryolar yer almaktadır:

- Soru ve cevap – Yerleştirmeler, RAG modeli aracılığıyla soru ve cevap arayüzlerinin desteklenmesine yardımcı olabilir. Bir vektör veritabanıyla eşleştirilen yerleştirme oluşturma, bir bilgi havuzundaki sorular ve içerik arasında yakın eşleşmeler bulmanızı sağlar.

- Kişiselleştirilmiş öneriler – Soru ve cevaba benzer şekilde, kullanıcı tarafından sağlanan kriterlere göre tatil yerlerini, kolejleri, araçları veya diğer ürünleri bulmak için yerleştirmeleri kullanabilirsiniz. Bu, basit bir eşleşme listesi şeklinde olabilir veya daha sonra her öneriyi işlemek ve bunun kullanıcının kriterlerini nasıl karşıladığını açıklamak için bir Yüksek Lisans (LLM) kullanabilirsiniz. Bu yaklaşımı, bir kullanıcının özel ihtiyaçlarına göre özel "en iyi 10" makale oluşturmak için de kullanabilirsiniz.

- Veri yönetimi – Birbirleriyle net bir şekilde eşlenmeyen veri kaynaklarınız varsa ancak veri kaydını açıklayan metin içeriğiniz varsa, potansiyel yinelenen kayıtları belirlemek için yerleştirmeleri kullanabilirsiniz. Örneğin, farklı biçimlendirme, kısaltmalar kullanabilen ve hatta adları çevrilmiş olabilecek yinelenen adayları belirlemek için yerleştirmeleri kullanabilirsiniz.

- Uygulama portföyünün rasyonelleştirilmesi – Uygulama portföylerini bir ana şirket ve bir satın alma genelinde uyumlu hale getirmeye çalışırken, potansiyel örtüşmeyi bulmaya nereden başlayacağınız her zaman açık değildir. Yapılandırma yönetimi verilerinin kalitesi sınırlayıcı bir faktör olabilir ve uygulama ortamını anlamak için ekipler arasında koordinasyon sağlamak zor olabilir. Yerleştirmelerle anlamsal eşleştirmeyi kullanarak, rasyonelleştirme için yüksek potansiyele sahip aday uygulamaları belirlemek üzere uygulama portföyleri arasında hızlı bir analiz yapabiliriz.

- İçerik gruplaması – Benzer içerikleri önceden bilmiyor olabileceğiniz kategoriler halinde gruplandırmayı kolaylaştırmak için yerleştirmeleri kullanabilirsiniz. Örneğin, müşteri e-postalarından veya çevrimiçi ürün incelemelerinden oluşan bir koleksiyonunuz olduğunu varsayalım. Her öğe için yerleştirmeler oluşturabilir ve ardından bu yerleştirmeleri çalıştırabilirsiniz. k-kümeleme anlamına gelir Müşteri endişelerinin, ürün övgülerinin veya şikayetlerinin veya diğer temaların mantıksal gruplarını belirlemek. Daha sonra bir Yüksek Lisans kullanarak bu gruplamaların içeriğinden odaklanmış özetler oluşturabilirsiniz.

Anlamsal arama örneği

Gelen eden GitHub'daki örnekAmazon Titan Text Embeddings, LangChain ve Streamlit ile basit bir yerleştirme arama uygulamasını gösteriyoruz.

Örnek, bir kullanıcının sorgusunu bellek içi vektör veritabanındaki en yakın girişlerle eşleştirir. Daha sonra bu eşleşmeleri doğrudan kullanıcı arayüzünde görüntüleriz. Bir RAG uygulamasında sorun gidermek veya doğrudan bir yerleştirme modelini değerlendirmek istiyorsanız bu yararlı olabilir.

Basit olması açısından, bellek içi FAİS Gömme vektörlerini depolamak ve aramak için veritabanı. Büyük ölçekli bir gerçek dünya senaryosunda, muhtemelen aşağıdaki gibi kalıcı bir veri deposu kullanmak isteyeceksiniz: Amazon OpenSearch Serverless için vektör motoru ya da pgvektör PostgreSQL'in uzantısı.

Web uygulamasından aşağıdakiler gibi farklı dillerdeki birkaç istemi deneyin:

- Kullanımımı nasıl izleyebilirim?

- Modelleri nasıl kişiselleştirebilirim?

- Hangi programlama dillerini kullanabilirim?

- Yorum yapın mes données sont-elles sécurisées ?

- Bu bir gerçek mi?

- Bedrock'ta mevcut olan yeni modeller var mı?

- Bölgenizde Amazon Bedrock'u kullanılabilir mi?

- Başka bir şey mi var?

Kaynak materyal İngilizce olmasına rağmen diğer dillerdeki sorguların ilgili girişlerle eşleştirildiğini unutmayın.

Sonuç

Temel modellerin metin oluşturma yetenekleri çok heyecan vericidir ancak metni anlamanın, bilgi birikiminden ilgili içeriği bulmanın ve pasajlar arasında bağlantı kurmanın üretken yapay zekanın tam değerini elde etmek için hayati önem taşıdığını unutmamak önemlidir. Bu modeller gelişmeye devam ettikçe önümüzdeki yıllarda yerleştirmelere yönelik yeni ve ilginç kullanım durumlarının ortaya çıktığını görmeye devam edeceğiz.

Sonraki adımlar

Aşağıdaki atölyelerde not defterleri veya demo uygulamaları olarak ek yerleştirme örneklerini bulabilirsiniz:

Yazarlar Hakkında

Jason Stehle New England bölgesinde bulunan AWS'de Kıdemli Çözüm Mimarıdır. AWS yeteneklerini, karşılaştıkları en büyük iş zorluklarına uygun hale getirmek için müşterilerle birlikte çalışıyor. İş dışında zamanını ailesiyle birlikte bir şeyler inşa ederek ve çizgi roman filmleri izleyerek geçiriyor.

Jason Stehle New England bölgesinde bulunan AWS'de Kıdemli Çözüm Mimarıdır. AWS yeteneklerini, karşılaştıkları en büyük iş zorluklarına uygun hale getirmek için müşterilerle birlikte çalışıyor. İş dışında zamanını ailesiyle birlikte bir şeyler inşa ederek ve çizgi roman filmleri izleyerek geçiriyor.

Nitin Eusebios AWS'de Kıdemli Kurumsal Çözümler Mimarıdır ve Yazılım Mühendisliği, Kurumsal Mimari ve AI/ML konularında deneyimlidir. Üretken yapay zekanın olanaklarını keşfetme konusunda son derece tutkulu. AWS platformunda iyi tasarlanmış uygulamalar oluşturmalarına yardımcı olmak için müşterilerle işbirliği yapıyor ve kendisini teknolojik zorlukları çözmeye ve bulut yolculuklarına yardımcı olmaya adamıştır.

Nitin Eusebios AWS'de Kıdemli Kurumsal Çözümler Mimarıdır ve Yazılım Mühendisliği, Kurumsal Mimari ve AI/ML konularında deneyimlidir. Üretken yapay zekanın olanaklarını keşfetme konusunda son derece tutkulu. AWS platformunda iyi tasarlanmış uygulamalar oluşturmalarına yardımcı olmak için müşterilerle işbirliği yapıyor ve kendisini teknolojik zorlukları çözmeye ve bulut yolculuklarına yardımcı olmaya adamıştır.

Raj Pathak Kanada ve Amerika Birleşik Devletleri'ndeki büyük Fortune 50 şirketlerinin ve orta ölçekli finansal hizmet kuruluşlarının (FSI) Baş Çözüm Mimarı ve Teknik Danışmanıdır. Üretken yapay zeka, doğal dil işleme, akıllı belge işleme ve MLOps gibi makine öğrenimi uygulamalarında uzmanlaşmıştır.

Raj Pathak Kanada ve Amerika Birleşik Devletleri'ndeki büyük Fortune 50 şirketlerinin ve orta ölçekli finansal hizmet kuruluşlarının (FSI) Baş Çözüm Mimarı ve Teknik Danışmanıdır. Üretken yapay zeka, doğal dil işleme, akıllı belge işleme ve MLOps gibi makine öğrenimi uygulamalarında uzmanlaşmıştır.

Mani Khanuja Teknoloji Lideri - Üretken Yapay Zeka Uzmanı, AWS'de Uygulamalı Makine Öğrenimi ve Yüksek Performanslı Hesaplama kitabının yazarı ve Üretimde Kadınlar Eğitimi Vakfı Yönetim Kurulu Yönetim Kurulu üyesidir. Bilgisayarla görme, doğal dil işleme ve üretken yapay zeka gibi çeşitli alanlarda makine öğrenimi (ML) projelerine liderlik ediyor. Müşterilerin büyük makine öğrenimi modellerini geniş ölçekte oluşturmasına, eğitmesine ve dağıtmasına yardımcı oluyor. re:Invent, Women in Manufacturing West, YouTube web seminerleri ve GHC 23 gibi iç ve dış konferanslarda konuşuyor. Boş zamanlarında sahilde uzun koşulara çıkmayı seviyor.

Mani Khanuja Teknoloji Lideri - Üretken Yapay Zeka Uzmanı, AWS'de Uygulamalı Makine Öğrenimi ve Yüksek Performanslı Hesaplama kitabının yazarı ve Üretimde Kadınlar Eğitimi Vakfı Yönetim Kurulu Yönetim Kurulu üyesidir. Bilgisayarla görme, doğal dil işleme ve üretken yapay zeka gibi çeşitli alanlarda makine öğrenimi (ML) projelerine liderlik ediyor. Müşterilerin büyük makine öğrenimi modellerini geniş ölçekte oluşturmasına, eğitmesine ve dağıtmasına yardımcı oluyor. re:Invent, Women in Manufacturing West, YouTube web seminerleri ve GHC 23 gibi iç ve dış konferanslarda konuşuyor. Boş zamanlarında sahilde uzun koşulara çıkmayı seviyor.

Mark Roy AWS için Baş Makine Öğrenimi Mimarıdır ve müşterilerin AI/ML çözümleri tasarlamasına ve oluşturmasına yardımcı olur. Mark'ın çalışmaları, birincil ilgi alanı bilgisayar görüşü, derin öğrenme ve kuruluş genelinde makine öğrenimini ölçeklendirme olan çok çeşitli makine öğrenimi kullanım durumlarını kapsar. Sigorta, finansal hizmetler, medya ve eğlence, sağlık hizmetleri, kamu hizmetleri ve imalat dahil olmak üzere birçok sektördeki şirketlere yardımcı olmuştur. Mark, Makine Öğrenimi Uzmanlık Sertifikasyonu da dahil olmak üzere altı AWS Sertifikasyonuna sahiptir. AWS'ye katılmadan önce Mark, 25 yılı finansal hizmetlerde olmak üzere 19 yılı aşkın süredir mimar, geliştirici ve teknoloji lideriydi.

Mark Roy AWS için Baş Makine Öğrenimi Mimarıdır ve müşterilerin AI/ML çözümleri tasarlamasına ve oluşturmasına yardımcı olur. Mark'ın çalışmaları, birincil ilgi alanı bilgisayar görüşü, derin öğrenme ve kuruluş genelinde makine öğrenimini ölçeklendirme olan çok çeşitli makine öğrenimi kullanım durumlarını kapsar. Sigorta, finansal hizmetler, medya ve eğlence, sağlık hizmetleri, kamu hizmetleri ve imalat dahil olmak üzere birçok sektördeki şirketlere yardımcı olmuştur. Mark, Makine Öğrenimi Uzmanlık Sertifikasyonu da dahil olmak üzere altı AWS Sertifikasyonuna sahiptir. AWS'ye katılmadan önce Mark, 25 yılı finansal hizmetlerde olmak üzere 19 yılı aşkın süredir mimar, geliştirici ve teknoloji lideriydi.

- SEO Destekli İçerik ve Halkla İlişkiler Dağıtımı. Bugün Gücünüzü Artırın.

- PlatoData.Network Dikey Üretken Yapay Zeka. Kendine güç ver. Buradan Erişin.

- PlatoAiStream. Web3 Zekası. Bilgi Genişletildi. Buradan Erişin.

- PlatoESG. karbon, temiz teknoloji, Enerji, Çevre, Güneş, Atık Yönetimi. Buradan Erişin.

- PlatoSağlık. Biyoteknoloji ve Klinik Araştırmalar Zekası. Buradan Erişin.

- Kaynak: https://aws.amazon.com/blogs/machine-learning/getting-started-with-amazon-titan-text-embeddings/

- :vardır

- :dır-dir

- :olumsuzluk

- :Neresi

- $UP

- 000

- 10

- 100

- 12

- 121

- 125

- 19

- 23

- 25

- 50

- 7

- 8

- a

- Hakkımızda

- soyutlama

- Kabul et

- doğruluk

- doğru

- tam olarak

- elde

- elde

- edinme

- karşısında

- ilave

- Ek

- avantaj

- danışman

- toplama

- önde

- AI

- AI / ML

- algoritmalar

- hizalamak

- Türkiye

- izin vermek

- Izin

- veriyor

- boyunca

- yanında

- Ayrıca

- her zaman

- Amazon

- Amazon Web Servisleri

- an

- analiz

- çözümlemek

- ve

- cevap

- herhangi

- Uygulama

- uygulamaları

- uygulamalı

- Tamam

- yaklaşım

- mimari

- mimarileri

- ARE

- ALAN

- mal

- AS

- yardım

- At

- büyütme

- augmented

- yazar

- mevcut

- AWS

- merkezli

- BE

- plaj

- olmak

- faydaları

- arasında

- yazı tahtası

- Yönetim Kurulu

- vücut

- kitap

- kutu

- inşa etmek

- bina

- iş

- fakat

- by

- CAN

- Kanada

- aday

- adaylar

- yetenekleri

- ele geçirmek

- yakalar

- dava

- durumlarda

- kategoriler

- belgeleme

- sertifikalar

- zorluklar

- sınıflandırma

- müşteri

- Kapanış

- bulut

- kümeleme

- kod

- Ortak çalışma yapan

- Toplamak

- Kolejler

- kombinasyon

- ortak

- Şirketler

- şirket

- karşılaştırmak

- şikayetleri

- karmaşık

- bilgisayar

- Bilgisayar görüşü

- bilgisayar

- kavramlar

- Endişeler

- konferanslar

- yapılandırma

- Sosyal medya

- bağ

- Bağlantılar

- tutarlı

- içerik

- bağlam

- bağlamsal

- devam etmek

- elverişli

- dönüştürmek

- dönüştürülmüş

- işbirliği

- koordine

- uygun maliyetli

- olabilir

- kaplama

- kapaklar

- yaratmak

- Oluşturma

- kriterleri

- çok önemli

- Şu anda

- görenek

- müşteri

- Müşteriler

- özelleştirmek

- veri

- veritabanı

- de

- adanmış

- derin

- derin öğrenme

- derinden

- tanımlamak

- derece

- gösteri

- göstermek

- dağıtmak

- açıklar

- Dizayn

- Destinasyon

- ayrıntılar

- Geliştirici

- farklı

- zor

- Boyut

- direkt olarak

- Yönetmenler

- tartışmak

- ekran

- do

- belge

- evraklar

- etki

- Dont

- her

- Eğitim

- etkili bir şekilde

- ya

- e-postalar

- katıştırma

- çıkmak

- etkinleştirmek

- sağlar

- Motor

- Mühendislik

- İngiltere

- İngilizce

- kuruluş

- Entertainment

- Tüm

- Baştan sona

- varlık

- değerlendirmek

- Hatta

- örnek

- örnekler

- heyecan verici

- Genişletmek

- deneyim

- deneyimli

- Açıklamak

- Keşfetmek

- uzatma

- dış

- kolaylaştırmak

- faktör

- aile

- Özellikler

- az

- mali

- finansal hizmetler

- bulmak

- bulma

- Ad

- Esneklik

- odaklanmış

- takip etme

- İçin

- Airdrop Formu

- Kısmet

- vakıf

- iskelet

- Ücretsiz

- itibaren

- tam

- temel

- oluşturmak

- nesil

- üretken

- üretken yapay zeka

- almak

- alma

- Verilmesi

- eldiven

- Go

- En büyük

- vardı

- Var

- he

- sağlık

- yardım et

- yardım

- yardım

- yardımcı olur

- onu

- Yüksek

- onun

- tutar

- Ne kadar

- Nasıl Yapılır

- HTML

- HTTPS

- i

- belirlemek

- if

- uygulanması

- ithalat

- önemli

- iyileştirmek

- in

- Diğer

- dahil

- içerir

- Dahil olmak üzere

- Endüstri

- bilgi

- giriş

- kurmak

- yerine

- kurumları

- sigorta

- Akıllı

- Akıllı belge işleme

- faiz

- ilginç

- arayüzey

- arayüzler

- iç

- Uluslararası

- içine

- IT

- ONUN

- birleştirme

- seyahat

- jpg

- json

- anahtar

- Bilmek

- bilme

- bilgi

- manzara

- dil

- Diller

- büyük

- tabaka

- öncülük etmek

- lider

- İlanlar

- öğrenme

- izin

- sevmek

- Muhtemelen

- seviyor

- sınırlayıcı

- Liste

- Yüksek Lisans

- mantıksal

- Uzun

- Bakın

- bakıyor

- makine

- makine öğrenme

- korumak

- yapmak

- Yapımı

- yönetilen

- yönetim

- üretim

- çok

- harita

- işaret

- Mark's

- Piyasalar

- eşleşti

- maçlar

- uygun

- malzeme

- me

- anlam

- anlamına geliyor

- medya

- üye

- yöntem

- olabilir

- ML

- MLO'lar

- model

- modelleri

- izlemek

- Daha

- çoğu

- En popüler

- filmler

- çoklu

- my

- isim

- adlı

- isimleri

- Doğal (Madenden)

- Doğal Dil İşleme

- gerek

- gerek

- ihtiyaçlar

- yeni

- sonraki

- nlp

- Açık

- of

- sunulan

- on

- ONE

- Online

- açık

- açık kaynak

- optimize

- optimize

- or

- sipariş

- Diğer

- Diğer

- bizim

- dışarı

- çıktı

- dışında

- tekrar

- üst üste gelmek

- kendi

- paketler

- eşleştirilmiş

- parametre

- parametreler

- ana şirket

- pasajlar

- tutkulu

- model

- desen

- başına

- Yapmak

- performans

- Kişiselleştirme

- ifadeler

- parça

- platform

- Platon

- Plato Veri Zekası

- PlatoVeri

- OYNA

- Lütfen

- Popüler

- BY

- portföy

- dosyalarını

- olanakları

- Çivi

- postgreSQL

- potansiyel

- güç kelimesini seçerim

- birincil

- Anapara

- Önceki

- sorunlar

- süreç

- işleme

- PLATFORM

- Ürün Yorumları

- Ürünler

- Programlama

- Programlama dilleri

- Projeler

- istemleri

- özel

- sağlamak

- sağlanan

- sağlar

- Python

- kalite

- sorgular

- sorgu

- soru

- Sorular

- Hızlı

- paçavra

- menzil

- RE

- ulaşmak

- Gerçek dünya

- tanıma

- Tavsiye

- tavsiyeler

- kayıt

- kayıtlar

- ifade eder

- İlişkiler

- uygun

- hatırlamak

- Depo

- temsil

- temsil

- talep

- gereklidir

- yanıt

- DİNLENME

- kısıtlı

- Ortaya çıkan

- Sonuçlar

- geri alma

- İade

- Yorumları

- Rol

- koşmak

- ishal

- s

- aynı

- söylemek

- ölçek

- ölçekleme

- senaryo

- senaryolar

- sdk

- Ara

- görmek

- anlamsal

- semantik

- kıdemli

- cümle

- duygu

- ayrı

- Serverless

- Hizmetler

- o

- benzer

- Basit

- basitlik

- basitleştirilmiş

- basitleştirmek

- tek

- ALTINCI

- So

- Yazılım

- yazılım Mühendisliği

- Çözümler

- ÇÖZMEK

- Çözme

- biraz

- bir şey

- Kaynak

- kaynaklar

- uzay

- Konuştu

- uzmanlar

- uzmanlaşmış

- Uzmanlık

- özel

- başlama

- başladı

- Devletler

- mağaza

- yapılar

- böyle

- destek

- destekli

- Destek

- Destekler

- Bizi daha iyi tanımak için

- görevleri

- takım

- teknoloji

- Teknik

- teknik

- teknikleri

- Teknolojileri

- Teknoloji

- söylemek

- metin

- Metin Sınıflandırması

- o

- The

- Kaynak

- ve bazı Asya

- Onları

- temalar

- sonra

- Orada.

- Bunlar

- işler

- Re-Tweet

- Bu

- gerçi?

- İçinden

- zaman

- titan

- için

- Jeton

- geleneksel

- Tren

- eğitilmiş

- transformatörler

- dönüşüm

- anlamak

- anlayış

- birleşik

- Birleşik

- USA

- kullanım

- kullanım

- kullanım durumu

- Kullanılmış

- işe yarar

- kullanıcı

- Kullanıcı Arayüzü

- kullanıcılar

- kullanma

- kamu hizmetleri

- tatil

- değer

- çeşitli

- Araçlar

- çok

- üzerinden

- vizyonumuz

- istemek

- oldu

- izlerken

- we

- ağ

- Web uygulaması

- web hizmetleri

- Web Seminerleri

- İYİ

- vardı

- Batısında

- ne zaman

- hangi

- süre

- geniş

- Geniş ürün yelpazesi

- irade

- ile

- içinde

- olmadan

- Kadın

- Word

- sözler

- İş

- çalışma

- çalışır

- Atölyeler

- olur

- yazmak

- yazı yazıyor

- yıl

- Sen

- Youtube

- zefirnet