Yüksek lisansların endüstriler arasında durdurulamaz gibi görünen bir şekilde benimsenmesine rağmen, bunlar yeni yapay zeka dalgasını güçlendiren daha geniş bir teknoloji ekosisteminin bir bileşenidir. Konuşmaya dayalı yapay zeka kullanım durumlarının çoğu, kullanıcı sorgularına yanıt vermek için Llama 2, Flan T5 ve Bloom gibi LLM'lerin kullanılmasını gerektirir. Bu modeller soruları yanıtlamak için parametrik bilgiye dayanır. Model, eğitim sırasında bu bilgiyi öğrenir ve bunu model parametrelerine kodlar. Bu bilgiyi güncellemek için, çok fazla zaman ve para gerektiren LLM'yi yeniden eğitmeliyiz.

Neyse ki, yüksek lisans öğrencilerimizi bilgilendirmek için kaynak bilgisini de kullanabiliriz. Kaynak bilgisi, bir giriş istemi yoluyla LLM'ye beslenen bilgidir. Kaynak bilgisi sağlamaya yönelik popüler yaklaşımlardan biri, Erişim Artırılmış Üretimdir (RAG). RAG kullanarak, ilgili bilgileri harici bir veri kaynağından alıyoruz ve bu bilgiyi Yüksek Lisans'a besliyoruz.

Bu blog yazısında, Amazon Sagemaker JumpStart'ı kullanarak Llama-2 gibi LLM'leri nasıl dağıtacağımızı keşfedeceğiz ve AI Halüsinasyonunu önlemek için Pinecone vektör veritabanını kullanarak LLM'lerimizi Retrieval Augmented Generation (RAG) aracılığıyla ilgili bilgilerle güncel tutacağız. .

Amazon SageMaker'da Artırılmış Üretimi (RAG) Alma

Çam kozalağı RAG'ın alma bileşenini yönetecektir, ancak iki kritik bileşene daha ihtiyacınız vardır: LLM çıkarımını çalıştıracak bir yer ve gömme modelini çalıştıracak bir yer.

Amazon SageMaker Studio, tüm makine öğrenimi (ML) geliştirmesini gerçekleştirmek için amaca yönelik olarak oluşturulmuş araçlara erişebileceğiniz tek bir web tabanlı görsel arayüz sağlayan entegre bir geliştirme ortamı (IDE). Kullanıcıların kendi SageMaker hesaplarında belirli bir modeli bulabilecekleri, önizleyebilecekleri ve başlatabilecekleri bir model merkezi olan SageMaker JumpStart'ı sağlar. Temel Modeller de dahil olmak üzere çok çeşitli sorun türleri için önceden eğitilmiş, kamuya açık ve özel modeller sağlar.

Amazon SageMaker Studio, RAG özellikli LLM işlem hatları geliştirmek için ideal ortamı sağlar. Öncelikle AWS konsolunu kullanarak Amazon SageMaker'a gidin ve bir SageMaker Studio etki alanı oluşturun ve bir Jupyter Studio not defteri açın.

Önkoşullar

Aşağıdaki ön koşul adımlarını tamamlayın:

- Amazon SageMaker Studio'yu kurun.

- Amazon SageMaker Etki Alanına Ekleme.

- Ücretsiz katmanlı bir Çam Kozalağı Vektör Veritabanına kaydolun.

- Önkoşul kitaplıkları: SageMaker Python SDK, Pinecone Client

Çözüm İzlenecek Yol

SageMaker Studio notebook'u kullanarak öncelikle önkoşul kitaplıklarını yüklememiz gerekiyor:

LLM'yi dağıtma

Bu yazıda, bir LLM'nin dağıtımına yönelik iki yaklaşımı tartışıyoruz. Bunlardan ilki, HuggingFaceModel nesne. Bunu, LLM'leri doğrudan Hugging Face model merkezinden dağıtırken (ve modelleri yerleştirirken) kullanabilirsiniz.

Örneğin, aşağıdakiler için konuşlandırılabilir bir yapılandırma oluşturabilirsiniz: google/flan-t5-xl aşağıdaki ekran görüntüsünde gösterildiği gibi model:

Modelleri doğrudan Hugging Face'ten dağıtırken, my_model_configuration aşağıdakilerle:

- An

envconfig bize hangi modeli hangi görev için kullanmak istediğimizi söyler. - SageMaker uygulamamız

rolebize modelimizi dağıtma izinlerini verir. - An

image_uriHugging Face'ten LLM'leri dağıtmak için özel olarak tasarlanmış bir görüntü yapılandırmasıdır.

Alternatif olarak SageMaker'ın daha basit bir yazılımla doğrudan uyumlu bir dizi modeli vardır. JumpStartModel nesne. Llama 2 gibi pek çok popüler LLM, aşağıdaki ekran görüntüsünde gösterildiği gibi başlatılabilen bu model tarafından desteklenmektedir:

Her iki versiyon için my_model, bunları aşağıdaki ekran görüntüsünde gösterildiği gibi dağıtın:

Başlatılan LLM uç noktamızla sorgulamaya başlayabilirsiniz. Sorgularımızın formatı farklılık gösterebilir (özellikle konuşmalı ve konuşmasız Yüksek Lisanslar arasında), ancak süreç genellikle aynıdır. Sarılma Yüzü modeli için aşağıdakileri yapın:

Çözümü şurada bulabilirsiniz: GitHub deposu.

Burada aldığımız yanıt pek mantıklı değil; bu bir halüsinasyon.

LLM'ye Ek Bağlam Sağlama

Lama 2, sorumuzu yalnızca dahili parametrik bilgiye dayanarak yanıtlamaya çalışıyor. Açıkçası, model parametreleri, SageMaker'da yönetilen nokta eğitimiyle hangi örnekleri yapabileceğimize dair bilgiyi saklamaz.

Bu soruyu doğru cevaplamak için kaynak bilgisinden yararlanmalıyız. Yani, LLM'ye istem aracılığıyla ek bilgi veriyoruz. Bu bilgiyi doğrudan model için ek bağlam olarak ekleyelim.

Artık sorunun doğru cevabını görüyoruz; kolaydı! Bununla birlikte, bir kullanıcının istemlerine bağlam eklemesi pek olası değildir; sorusunun cevabını zaten biliyorlardır.

Tek bir bağlamı manuel olarak eklemek yerine, daha kapsamlı bir bilgi veritabanından ilgili bilgileri otomatik olarak tanımlayın. Bunun için Retrieval Augmented Generation'a ihtiyacınız olacak.

Alma Artırılmış Nesil

Alma Artırılmış Üretimi ile, bir bilgi veritabanını, vektörler arasındaki yakınlığın alaka düzeyini/anlamsal benzerliğini temsil ettiği bir vektör uzayına kodlayabilirsiniz. Bilgi tabanı olarak bu vektör alanını kullanarak, yeni bir kullanıcı sorgusunu dönüştürebilir, bunu aynı vektör uzayına kodlayabilir ve önceden indekslenmiş en alakalı kayıtları alabilirsiniz.

Bu ilgili kayıtları aldıktan sonra, bunlardan birkaçını seçin ve bunları ek bağlam olarak LLM istemine dahil ederek LLM'ye son derece alakalı kaynak bilgisi sağlayın. Bu iki adımlı bir süreçtir:

- Dizin oluşturma, vektör dizinini bir veri kümesinden gelen bilgilerle doldurur.

- Alma, bir sorgu sırasında gerçekleşir ve vektör dizininden ilgili bilgileri aldığımız yerdir.

Her iki adım da, insan tarafından okunabilen düz metnimizi anlamsal vektör uzayına çevirmek için bir yerleştirme modeli gerektirir. Aşağıdaki ekran görüntüsünde gösterildiği gibi Hugging Face'in yüksek verimli MiniLM cümle transformatörünü kullanın. Bu model bir LLM değildir ve bu nedenle Llama 2 modelimizle aynı şekilde başlatılmamıştır.

içinde hub_config, yukarıdaki ekran görüntüsünde gösterildiği gibi model kimliğini belirtin, ancak görev için özellik ayıklamayı kullanın çünkü LLM'miz gibi metin değil vektör yerleştirmeleri üretiyoruz. Bunu takiben model yapılandırmasını şununla başlatın: HuggingFaceModel daha önce olduğu gibi, ancak bu sefer LLM görüntüsü olmadan ve bazı sürüm parametreleriyle.

Modeli tekrar dağıtabilirsiniz. deploy, daha küçük (yalnızca CPU) örneğini kullanarak ml.t2.large. MiniLM modeli küçüktür, bu nedenle çok fazla bellek gerektirmez ve bir GPU'ya ihtiyaç duymaz çünkü bir CPU üzerinde bile hızlı bir şekilde yerleştirmeler oluşturabilir. Tercih edilirse modeli GPU'da daha hızlı çalıştırabilirsiniz.

Gömmeler oluşturmak için şunu kullanın: predict yöntemini kullanın ve kodlanacak bağlamların bir listesini iletin. inputs gösterildiği gibi anahtar:

İki girdi bağlamı iletilir ve gösterildiği gibi iki bağlam vektörü yerleştirmesi döndürülür:

len(out)

2

MiniLM modelinin yerleştirme boyutluluğu 384 bu da MiniLM çıktılarını içeren her vektörün boyutuna sahip olması gerektiği anlamına gelir: 384. Ancak yerleştirmelerimizin uzunluğuna baktığınızda aşağıdakileri göreceksiniz:

len(out[0]), len(out[1])

(8, 8)

İki listenin her biri sekiz öğe içerir. MiniLM ilk önce metni bir tokenizasyon adımında işler. Bu tokenizasyon, insan tarafından okunabilen düz metnimizi, model tarafından okunabilen token kimliklerinin bir listesine dönüştürür. Modelin çıktı özelliklerinde token düzeyindeki yerleştirmeleri görebilirsiniz. bu yerleştirmelerden biri beklenen boyutluluğu gösterir 384 gosterildigi gibi:

len(out[0][0])

384

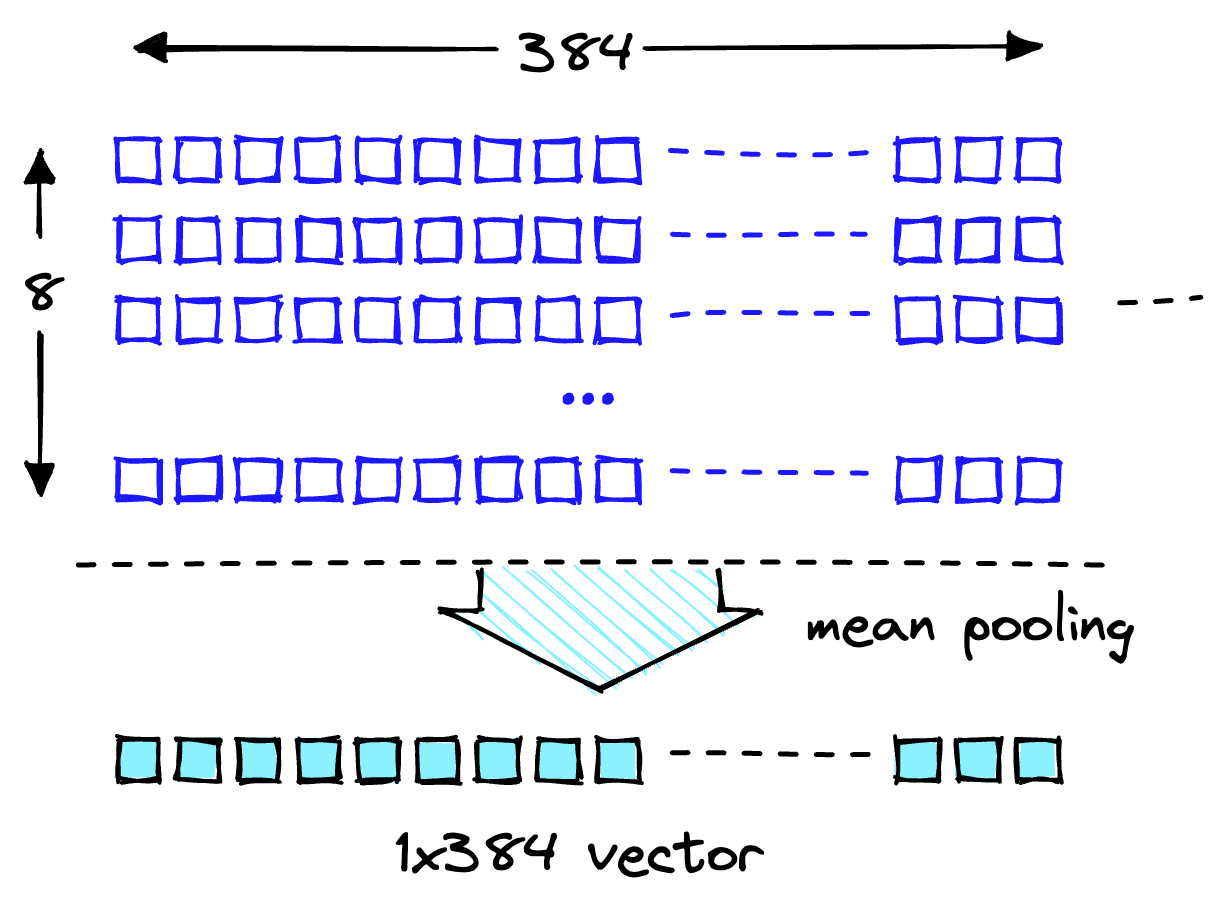

Aşağıdaki çizimde gösterildiği gibi, her vektör boyutundaki ortalama değerleri kullanarak bu belirteç düzeyindeki yerleştirmeleri belge düzeyindeki eklemelere dönüştürün.

Tek bir 384 boyutlu vektör elde etmek için ortalama havuzlama işlemi.

Her giriş metni için bir tane olmak üzere iki adet 384 boyutlu vektör yerleştirmesiyle. Hayatımızı kolaylaştırmak için kodlama işlemini aşağıdaki ekran görüntüsünde gösterildiği gibi tek bir işleve sarın:

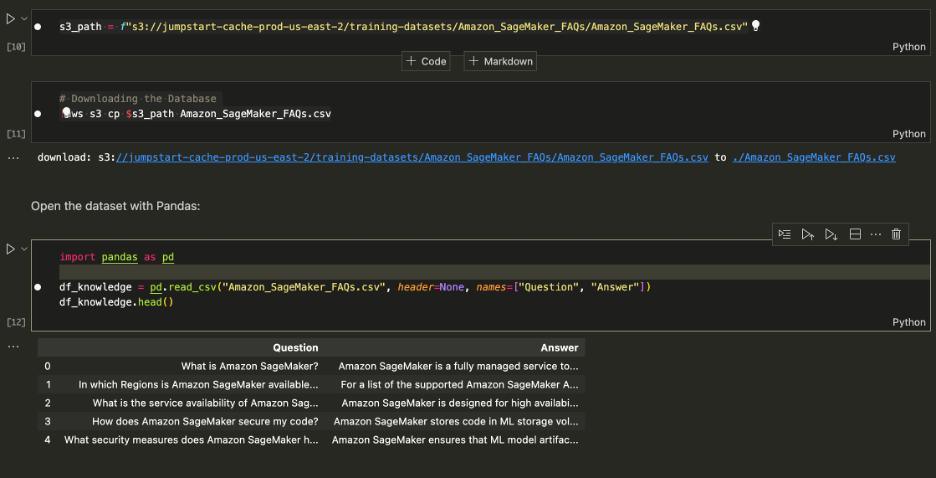

Veri Kümesini İndirme

Hem soru hem de yanıt sütunlarını içeren verileri almak için bilgi tabanı olarak Amazon SageMaker SSS'lerini indirin.

Amazon SageMaker SSS'lerini indirin

Aramayı gerçekleştirirken yalnızca Yanıtlar'ı arayın, böylece Soru sütununu bırakabilirsiniz. Ayrıntılar için not defterine bakın.

Veri kümemiz ve yerleştirme hattımız hazır. Şimdi tek ihtiyacımız olan bu yerleştirmeleri saklayacak bir yer.

Endeksleme

Çam Kozalağı vektör veritabanı, vektör yerleştirmelerini saklar ve bunları uygun ölçekte verimli bir şekilde arar. Veritabanı oluşturmak için Pinecone'dan ücretsiz bir API anahtarına ihtiyacınız olacak.

Çam Kozalağı vektör veritabanına bağlandıktan sonra tek bir vektör dizini oluşturun (geleneksel veri tabanlarındaki tabloya benzer). Dizini adlandırın retrieval-augmentation-aws ve dizini hizalayın dimension ve metric gömme modelinin gerektirdiği parametrelerle (bu durumda MiniLM).

Veri eklemeye başlamak için aşağıdakileri çalıştırın:

Bu yazının başındaki soruyla dizini sorgulamaya başlayabilirsiniz.

Yukarıdaki çıktı, sorumuzu yanıtlamamıza yardımcı olacak ilgili bağlamları döndürdüğümüzü gösteriyor. Bizden beri top_k = 1, index.query okunan meta verilerin yanında en iyi sonucu döndürdü Managed Spot Training can be used with all instances supported in Amazon.

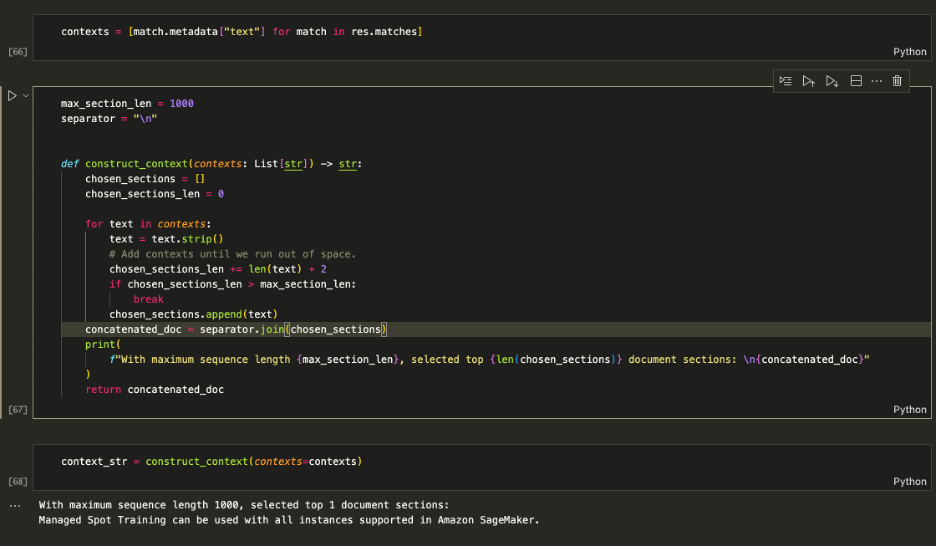

İstemi Artırma

Bilgi istemini genişletmek için alınan bağlamları kullanın ve LLM'ye beslenecek maksimum bağlam miktarına karar verin. Kullan 1000 İçerik uzunluğunu aşıncaya kadar, döndürülen her bağlamı bilgi istemine yinelemeli olarak eklemek için karakter sınırı.

İstemi Artırma

Bir şeyi beslemek context_str Aşağıdaki ekran görüntüsünde gösterildiği gibi LLM istemine:

[Giriş]: SageMaker'da Yönetilen Spot Eğitimi ile hangi örnekleri kullanabilirim? [Çıktı]: Sağlanan bağlama bağlı olarak Yönetilen Spot Eğitimini Amazon SageMaker'da desteklenen tüm bulut sunucularıyla kullanabilirsiniz. Bu nedenle cevap şudur: Amazon SageMaker'da tüm bulut sunucuları desteklenir.

Mantık işe yarıyor, bu yüzden işleri temiz tutmak için onu tek bir işleve sarın.

Artık aşağıda gösterilenlere benzer sorular sorabilirsiniz:

Temizlemek

İstenmeyen masraflara maruz kalmayı durdurmak için modeli ve uç noktayı silin.

Sonuç

Bu yazıda sizi SageMaker'da açık erişimli LLM'lere sahip RAG ile tanıştırdık. Ayrıca Amazon SageMaker Jumpstart modellerinin Llama 2 ile nasıl dağıtılacağını, Hugging Face LLM'lerin Flan T5 ile nasıl dağıtılacağını ve modellerin MiniLM ile nasıl yerleştirileceğini gösterdik.

Açık erişim modellerimizi ve Pinecone vektör indeksini kullanarak eksiksiz bir uçtan uca RAG işlem hattı uyguladık. Bunu kullanarak halüsinasyonları nasıl en aza indireceğimizi, Yüksek Lisans bilgisini nasıl güncel tutacağımızı ve sonuçta kullanıcı deneyimini ve sistemlerimize olan güveni nasıl artıracağımızı gösterdik.

Bu örneği kendi başınıza çalıştırmak için bu GitHub deposunu kopyalayın ve aşağıdaki adımları kullanarak önceki adımları izleyin. GitHub'daki Soru Yanıtlama not defteri.

yazarlar hakkında

Vedan Jain Stratejik Üretken Yapay Zeka girişimleri üzerinde çalışan Kıdemli Yapay Zeka/Makine Öğrenimi Uzmanıdır. AWS'ye katılmadan önce Vedant, Databricks, Hortonworks (şu anda Cloudera) ve JP Morgan Chase gibi çeşitli şirketlerde ML/Veri Bilimi Uzmanlığı pozisyonlarında çalışmıştır. Vedant, işinin dışında müzik yapmak, kaya tırmanışı yapmak, anlamlı bir yaşam sürdürmek için bilimi kullanmak ve dünyanın dört bir yanından mutfakları keşfetmek konusunda tutkulu.

Vedan Jain Stratejik Üretken Yapay Zeka girişimleri üzerinde çalışan Kıdemli Yapay Zeka/Makine Öğrenimi Uzmanıdır. AWS'ye katılmadan önce Vedant, Databricks, Hortonworks (şu anda Cloudera) ve JP Morgan Chase gibi çeşitli şirketlerde ML/Veri Bilimi Uzmanlığı pozisyonlarında çalışmıştır. Vedant, işinin dışında müzik yapmak, kaya tırmanışı yapmak, anlamlı bir yaşam sürdürmek için bilimi kullanmak ve dünyanın dört bir yanından mutfakları keşfetmek konusunda tutkulu.

James Briggs Pinecone'da vektör arama ve AI/ML konusunda uzmanlaşmış bir Personel Geliştirici Avukatıdır. Geliştiricilere ve işletmelere çevrimiçi eğitim yoluyla kendi GenAI çözümlerini geliştirme konusunda rehberlik ediyor. Pinecone'dan önce James, küçük teknoloji girişimlerinden finans şirketlerine kadar yapay zeka üzerinde çalışıyordu. James'in iş dışında seyahat etme ve sörf ve tüplü dalıştan Muay Thai ve BJJ'e kadar uzanan yeni maceralara katılma tutkusu var.

James Briggs Pinecone'da vektör arama ve AI/ML konusunda uzmanlaşmış bir Personel Geliştirici Avukatıdır. Geliştiricilere ve işletmelere çevrimiçi eğitim yoluyla kendi GenAI çözümlerini geliştirme konusunda rehberlik ediyor. Pinecone'dan önce James, küçük teknoloji girişimlerinden finans şirketlerine kadar yapay zeka üzerinde çalışıyordu. James'in iş dışında seyahat etme ve sörf ve tüplü dalıştan Muay Thai ve BJJ'e kadar uzanan yeni maceralara katılma tutkusu var.

Xin Huang Amazon SageMaker JumpStart ve Amazon SageMaker yerleşik algoritmaları için Kıdemli Uygulamalı Bilim İnsanıdır. Ölçeklenebilir makine öğrenimi algoritmaları geliştirmeye odaklanıyor. Araştırma ilgi alanları, doğal dil işleme, tablo verileri üzerinde açıklanabilir derin öğrenme ve parametrik olmayan uzay-zaman kümelemenin sağlam analizi alanındadır. ACL, ICDM, KDD konferanslarında ve Royal Statistical Society: Series A'da birçok makale yayınladı.

Xin Huang Amazon SageMaker JumpStart ve Amazon SageMaker yerleşik algoritmaları için Kıdemli Uygulamalı Bilim İnsanıdır. Ölçeklenebilir makine öğrenimi algoritmaları geliştirmeye odaklanıyor. Araştırma ilgi alanları, doğal dil işleme, tablo verileri üzerinde açıklanabilir derin öğrenme ve parametrik olmayan uzay-zaman kümelemenin sağlam analizi alanındadır. ACL, ICDM, KDD konferanslarında ve Royal Statistical Society: Series A'da birçok makale yayınladı.

- SEO Destekli İçerik ve Halkla İlişkiler Dağıtımı. Bugün Gücünüzü Artırın.

- PlatoData.Network Dikey Üretken Yapay Zeka. Kendine güç ver. Buradan Erişin.

- PlatoAiStream. Web3 Zekası. Bilgi Genişletildi. Buradan Erişin.

- PlatoESG. karbon, temiz teknoloji, Enerji, Çevre, Güneş, Atık Yönetimi. Buradan Erişin.

- PlatoSağlık. Biyoteknoloji ve Klinik Araştırmalar Zekası. Buradan Erişin.

- Kaynak: https://aws.amazon.com/blogs/machine-learning/mitigate-hallucinations-through-retrieval-augmented-generation-using-pinecone-vector-database-llama-2-from-amazon-sagemaker-jumpstart/

- :vardır

- :dır-dir

- :olumsuzluk

- :Neresi

- $UP

- 1

- 10

- 100

- 11

- 12

- 14

- %15

- 16

- 17

- 19

- 23

- 32

- 7

- 8

- 9

- a

- Hakkımızda

- yukarıdaki

- erişim

- Göre

- Hesap

- karşısında

- eklemek

- Ek

- Ek Bilgi

- Benimseme

- maceralar

- savunucu

- tekrar

- AI

- AI kullanım durumları

- AI / ML

- algoritmalar

- hizalamak

- Türkiye

- boyunca

- zaten

- Ayrıca

- Amazon

- Amazon Adaçayı Yapıcı

- Amazon SageMaker Hızlı Başlangıç

- Amazon SageMaker Stüdyosu

- Amazon Web Servisleri

- miktar

- an

- analiz

- ve

- cevap

- cevaplar

- herhangi

- api

- uygulamayı yükleyeceğiz

- uygulamalı

- yaklaşım

- yaklaşımlar

- ARE

- ALAN

- etrafında

- AS

- sormak

- At

- Denemeler

- büyütme

- augmented

- Oto

- otomatik olarak

- mevcut

- AWS

- baz

- merkezli

- BE

- Çünkü

- önce

- başlamak

- arasında

- Blog

- Çiçek açmak

- her ikisi de

- Daha geniş

- inşa etmek

- yerleşik

- işletmeler

- fakat

- by

- CAN

- ele geçirmek

- dava

- durumlarda

- karakterler

- yükler

- kovalamak

- çamça

- Açıkça

- Tırmanma

- Cloudera

- kümeleme

- Sütun

- Sütunlar

- Şirketler

- uyumlu

- tamamlamak

- bileşen

- bileşenler

- konferanslar

- bağlı

- konsolos

- içermek

- içeren

- içerik

- bağlam

- bağlamlar

- konuşkan

- konuşma yapay zekası

- dönüştürmek

- Kurumlar

- doğru

- doğru

- yaratmak

- kritik

- Şu anda

- veri

- veritabanı

- Tarih

- DBS

- karar vermek

- derin

- derin öğrenme

- dağıtmak

- dağıtma

- Geliştirici

- geliştiriciler

- gelişen

- gelişme

- Boyut

- direkt olarak

- tartışmak

- do

- yok

- gelmez

- Değil

- domain

- don

- Damla

- sırasında

- her

- Daha erken

- kolay

- ekosistem

- Eğitim

- verimli

- verimli biçimde

- katıştırma

- kucaklama

- kodlama

- son

- son uca

- Son nokta

- artırmak

- çevre

- kurulmuş

- Hatta

- örnek

- aşmak

- infaz

- beklenen

- deneyim

- keşfetmek

- Keşfetmek

- kapsamlı, geniş

- dış

- çıkarmak

- Yüz

- Daha hızlı

- Özellikler

- Fed

- az

- maliye

- bulmak

- bitiş

- Ad

- Şamandıra

- odaklanır

- takip etme

- İçin

- biçim

- vakıf

- Ücretsiz

- itibaren

- işlev

- genellikle

- oluşturulan

- üreten

- nesil

- üretken

- üretken yapay zeka

- almak

- GitHub

- Vermek

- verilmiş

- verir

- Go

- Goes

- GPU

- Rehberler

- sap

- olur

- Var

- he

- Held

- yardım et

- okuyun

- büyük ölçüde

- onun

- Ne kadar

- Nasıl Yapılır

- Ancak

- HTTPS

- huang

- merkez

- SarılmaYüz

- insan tarafından okunabilir

- i

- ID

- ideal

- belirlemek

- kimlikleri

- if

- görüntü

- uygulanan

- ithalat

- in

- dahil

- Dahil olmak üzere

- Artırmak

- indeks

- endeksli

- Endüstri

- bilgi vermek

- bilgi

- girişimler

- giriş

- girişler

- kurmak

- örnek

- entegre

- ilgi alanları

- arayüzey

- iç

- içine

- tanıttı

- IT

- ürün

- james

- birleştirme

- jp

- jp Morgan

- JP Morgan Chase

- jpg

- tutmak

- anahtar

- Bilmek

- bilgi

- dil

- büyük

- büyük

- başlatmak

- öncülük etmek

- öğrenme

- öğrenir

- uzunluk

- kütüphaneler

- hayat

- sevmek

- LİMİT

- Liste

- Listeler

- Yaşıyor

- lama

- Yüksek Lisans

- mantık

- Bakın

- bakıyor

- Çok

- makine

- makine öğrenme

- yapmak

- Yapımı

- yönetilen

- el ile

- çok

- Maç

- maçlar

- maksimum

- en yüksek miktar

- Mayıs..

- ortalama

- anlamlı

- anlamına geliyor

- Bellek

- Metadata

- yöntem

- Azaltmak

- ML

- model

- modelleri

- para

- Daha

- Morgan

- çoğu

- çok

- çoklu

- Music

- şart

- isim

- Doğal (Madenden)

- Doğal Dil İşleme

- gerek

- ihtiyaçlar

- yeni

- sonraki

- nlp

- defter

- şimdi

- dizi

- nesne

- of

- on

- ONE

- Online

- bir tek

- açık

- operasyon

- or

- sipariş

- OS

- aksi takdirde

- bizim

- dışarı

- çıktı

- çıkışlar

- dışında

- kendi

- kâğıtlar

- parametreler

- belirli

- özellikle

- geçmek

- geçti

- tutku

- tutkulu

- Yapmak

- icra

- izinleri

- resim

- boru hattı

- Sade

- Platon

- Plato Veri Zekası

- PlatoVeri

- Popüler

- pozisyonları

- Çivi

- Açılması

- tahmin

- Tahminler

- Predictor

- tercihli

- önlemek

- Önizleme

- önceki

- Önceden

- Önceki

- Sorun

- süreç

- Süreçler

- işleme

- Profil

- istemleri

- özel

- sağlanan

- sağlar

- sağlama

- alenen

- yayınlanan

- Python

- pytorch

- sorgular

- soru

- Sorular

- hızla

- menzil

- değişen

- hazır

- alma

- kayıtlar

- bölgeler

- uygun

- güvenmek

- Depo

- temsil

- gerektirir

- gereklidir

- araştırma

- Yanıtlamak

- sonuç

- Sonuçlar

- dönüş

- dönen

- gürbüz

- kaya

- Rol

- kraliyet

- koşmak

- ishal

- sagemaker

- aynı

- söylemek

- ölçeklenebilir

- ölçek

- Bilim

- bilim adamı

- Gol

- Ekran

- sdk

- Ara

- aramalar

- görmek

- görünüşte

- seçmek

- kıdemli

- duyu

- cümle

- Dizi

- A Serisi

- Hizmetler

- set

- meli

- şov

- gösterdi

- gösterilen

- Gösteriler

- yan

- benzer

- basit

- beri

- tek

- beden

- küçük

- daha küçük

- So

- Toplum

- yalnızca

- çözüm

- Çözümler

- biraz

- bir yerde

- Kaynak

- uzay

- uzman

- uzmanlaşmış

- Uzmanlık

- özellikle

- Spot

- Personel

- Startups

- istatistiksel

- adım

- Basamaklar

- dur

- mağaza

- mağaza

- Stratejik

- dizi

- stüdyo

- böyle

- destek

- destekli

- Destekler

- sistem

- Sistemler

- tablo

- alır

- Görev

- teknoloji

- teknoloji girişimleri

- Teknoloji

- anlatır

- metin

- Tayland

- göre

- o

- The

- Alan

- Dünya

- ve bazı Asya

- Onları

- bu nedenle

- Bunlar

- onlar

- işler

- Re-Tweet

- Bu

- İçinden

- zaman

- için

- simge

- dizgeciklere

- çok

- araçlar

- üst

- geleneksel

- Eğitim

- transformatör

- transformatörler

- dönüşümler

- çevirmek

- Seyahat

- Güven

- iki

- türleri

- eninde sonunda

- olası

- durdurulamaz.

- kadar

- istenmeyen

- Güncelleme

- us

- kullanım

- Kullanılmış

- kullanıcı

- Kullanıcı Deneyimi

- kullanıcılar

- kullanma

- Değerler

- çeşitli

- versiyon

- sürümler

- üzerinden

- görsel

- beklemek

- örneklerde

- istemek

- oldu

- dalga

- Yol..

- we

- ağ

- web hizmetleri

- Web tabanlı

- Ne

- ne zaman

- hangi

- süre

- geniş

- Geniş ürün yelpazesi

- irade

- ile

- olmadan

- İş

- işlenmiş

- çalışma

- çalışır

- Dünya

- olur

- sarın

- X

- Evet

- Sen

- zefirnet