Bu gönderi, Forethinkt Technologies, Inc.'de Mühendislik Direktörü Jad Chamoun ve Forethinkt Technologies, Inc.'de Kıdemli Makine Öğrenimi Mühendisi Salina Wu ile birlikte yazılmıştır.

Sağduyu müşteri hizmetleri için lider bir üretken yapay zeka paketidir. Paketinin özünde yenilikçi DestekGPT™ müşteri desteği yaşam döngüsünü dönüştürmek için makine öğrenimini kullanan teknoloji - sapmayı artırmak, CSAT'ı iyileştirmek ve aracı üretkenliğini artırmak. SupportGPT™, yılda 30 milyondan fazla müşteri etkileşimini desteklemek için en yeni Bilgi Erişim (IR) sistemlerini ve büyük dil modellerini (LLM'ler) kullanır.

SupportGPT'nin birincil kullanım durumu, müşteri desteği etkileşimlerinin ve operasyonlarının kalitesini ve verimliliğini artırmaktır. SupportGPT, yerleştirmeler ve sıralama modelleriyle desteklenen son teknoloji ürünü IR sistemlerini kullanarak ilgili bilgileri hızlı bir şekilde arayabilir ve müşteri sorgularına doğru ve özlü yanıtlar verebilir. Öngörü, müşteri etkileşimlerini çözmek amacıyla müşteri niyetlerini tespit etmek için müşteri başına ince ayarlı modeller kullanır. Büyük dil modellerinin entegrasyonu, daha ilgi çekici ve tatmin edici bir destek deneyimi yaratarak, otomatik aracılarla etkileşimin insanileştirilmesine yardımcı olur.

SupportGPT ayrıca, otomatik tamamlama önerileri sunarak ve şirketin önceki yanıtlarına dayalı olarak müşteri biletlerine uygun yanıtlar oluşturarak müşteri destek temsilcilerine yardımcı olur. Temsilciler, gelişmiş dil modellerini kullanarak müşterilerin endişelerini daha hızlı ve daha doğru bir şekilde ele alarak daha yüksek müşteri memnuniyeti sağlayabilir.

Ek olarak, SupportGPT'nin mimarisi, destek bilgi tabanlarındaki boşlukların tespit edilmesini sağlayarak aracıların müşterilere daha doğru bilgiler sağlamasına yardımcı olur. Bu boşluklar belirlendikten sonra SupportGPT, bu bilgi boşluklarını doldurmak için otomatik olarak makaleler ve diğer içerikler oluşturarak destek bilgi tabanının müşteri merkezli ve güncel kalmasını sağlar.

Bu gönderide, Forethinkt'in nasıl kullandığını paylaşıyoruz Amazon Adaçayı Yapıcı Üretken yapay zeka kullanım durumlarında çok modelli uç noktalar, maliyette %66'nın üzerinde tasarruf sağlar.

Altyapı zorlukları

Bu yetenekleri pazara sunmaya yardımcı olmak için Forerought, makine öğrenimi iş yüklerini verimli bir şekilde ölçeklendirir ve her müşterinin özel kullanım durumuna göre uyarlanmış hiper kişiselleştirilmiş çözümler sunar. Bu hiper-kişiselleştirme, müşteri verileri üzerinde gömülü modellerin ve sınıflandırıcıların ince ayarı yoluyla elde edilir ve doğru bilgi alma sonuçları ve her müşterinin benzersiz ihtiyaçlarını karşılayan alan bilgisi sağlanır. Oluşturulan yanıtların doğruluğunu ve alaka düzeyini daha da artırmak için özelleştirilmiş otomatik tamamlama modellerinde ayrıca müşteri verileri üzerinde ince ayar yapılır.

AI işlemedeki önemli zorluklardan biri, GPU'lar gibi donanım kaynaklarının verimli kullanılmasıdır. Bu zorluğun üstesinden gelmek için Forerought, SageMaker çoklu model uç noktalarını (MME'ler) kullanarak tek bir çıkarım uç noktası ve ölçeğinde birden çok yapay zeka modeli çalıştırır. Modellerin hiper-kişiselleştirilmesi, benzersiz modellerin eğitilmesini ve devreye alınmasını gerektirdiğinden, model sayısı müşteri sayısıyla doğrusal olarak ölçeklenir ve bu da maliyetli olabilir.

Gerçek zamanlı çıkarım ve maliyet için doğru performans dengesini elde etmek amacıyla Forerought, GPU hızlandırmayı destekleyen SageMaker MME'lerini kullanmayı seçti. SageMaker MME'leri, Forerought'un birden fazla müşteri destek senaryosunu ölçekte ele alarak bir saniyeden kısa gecikmeyle yüksek performanslı, ölçeklenebilir ve uygun maliyetli çözümler sunmasını sağlar.

SageMaker ve Öngörü

SageMaker, geliştiricilere ve veri bilimcilere makine öğrenimi modellerini hızlı bir şekilde oluşturma, eğitme ve dağıtma yeteneği sağlayan, tam olarak yönetilen bir hizmettir. SageMaker MME'leri, gerçek zamanlı çıkarım için çok sayıda modeli dağıtmak için ölçeklenebilir ve uygun maliyetli bir çözüm sunar. MME'ler, tüm modellerinizi barındırmak için GPU'lar gibi hızlandırılmış örnekleri kullanabilen paylaşılan bir hizmet konteyneri ve bir kaynak filosu kullanır. Bu, tek model uç noktaları kullanmaya kıyasla uç nokta kullanımını en üst düzeye çıkararak barındırma maliyetlerini azaltır. Ayrıca, SageMaker bellekteki yükleme ve boşaltma modellerini yönettiği ve bunları uç noktanın trafik modellerine göre ölçeklendirdiği için konuşlandırma yükünü de azaltır. Ek olarak, tüm SageMaker gerçek zamanlı uç noktaları, modelleri yönetmek ve izlemek için yerleşik özelliklerden yararlanır. gölge varyantları, otomatik ölçeklendirmeve yerel entegrasyon Amazon Bulut İzleme (daha fazla bilgi için bkz. Çok Modelli Uç Nokta Dağıtımları için CloudWatch Metrikleri).

Öngörü, GPU kaynaklarını da gerektiren yüzlerce modeli barındıracak şekilde büyüdükçe, SageMaker MME'leri aracılığıyla daha uygun maliyetli, güvenilir ve yönetilebilir bir mimari oluşturma fırsatı gördük. SageMaker MME'lerine geçiş yapmadan önce, modellerimiz şu adreste Kubernetes üzerinde devreye alınmıştı: Amazon Elastik Kubernetes Hizmeti (Amazon EKS). Amazon EKS, yönetim yetenekleri sunsa da, çıkarım için özel olarak uyarlanmamış bir altyapıyı yönettiğimiz hemen anlaşıldı. Öngörü, mühendislik verimliliği üzerinde bir yük olan Amazon EKS'de model çıkarımını kendimiz yönetmek zorundaydı. Örneğin, pahalı GPU kaynaklarını birden çok model arasında paylaşmak için, dağıtım sırasında belirtilen modellere sabit bellek bölümleri tahsis etmekten sorumluyduk. Mevcut altyapımızla ilgili aşağıdaki temel sorunları ele almak istedik:

- Yüksek fiyat – Her modelin yeterli kaynağa sahip olduğundan emin olmak için, örnek başına kaç modelin sığacağı konusunda çok muhafazakar olurduk. Bu, model barındırma için gerekenden çok daha yüksek maliyetlerle sonuçlandı.

- Düşük güvenilirlik – Bellek tahsisimizde ölçülü olmamıza rağmen, tüm modellerde aynı gereksinimler yoktur ve bazen bazı modeller yetersiz bellek (OOM) hataları verir.

- verimsiz yönetim – Her model türü için (sınıflandırıcılar, katıştırmalar ve otomatik tamamlama gibi) farklı dağıtım bildirimlerini yönetmek zorundaydık, bu da zaman alıcı ve hataya açıktı. Farklı model türleri için bellek tahsisini belirleme mantığını da korumamız gerekiyordu.

Sonuç olarak, maliyeti, güvenilirliği ve modellerimize hizmet verme yönetimini iyileştirmek için çalışma zamanında modellerimizi yönetmenin ağır yükünü üstlenecek bir çıkarım platformuna ihtiyacımız vardı. SageMaker MME'leri bu ihtiyaçları karşılamamızı sağladı.

Akıllı ve dinamik model yükleme ve boşaltma ve ölçeklendirme yetenekleri sayesinde SageMaker MME'leri, modellerimizi barındırmak için önemli ölçüde daha ucuz ve daha güvenilir bir çözüm sağladı. Artık eşgörünüm başına çok daha fazla modeli sığdırabiliyoruz ve SageMaker MME'leri modelleri dinamik olarak yükleme ve boşaltma işlemlerini yürüttüğü için OOM hataları konusunda endişelenmemize gerek yok. Ayrıca, dağıtımlar artık Boto3 SageMaker API'lerini çağırmak ve uygun otomatik ölçeklendirme ilkelerini eklemek kadar basit.

Aşağıdaki şema eski mimarimizi göstermektedir.

SageMaker MME'lere geçişimize başlamak için MME'ler için en iyi kullanım durumlarını ve bu değişiklikten en çok hangi modelimizin yararlanacağını belirledik. MME'ler en iyi aşağıdakiler için kullanılır:

- Düşük gecikme süresine sahip olması beklenen ancak soğuk başlatma süresine (ilk yüklendiğinde) dayanabilen modeller

- Sık ve tutarlı olarak adlandırılan modeller

- Kısmi GPU kaynaklarına ihtiyaç duyan modeller

- Ortak gereksinimleri ve çıkarım mantığını paylaşan modeller

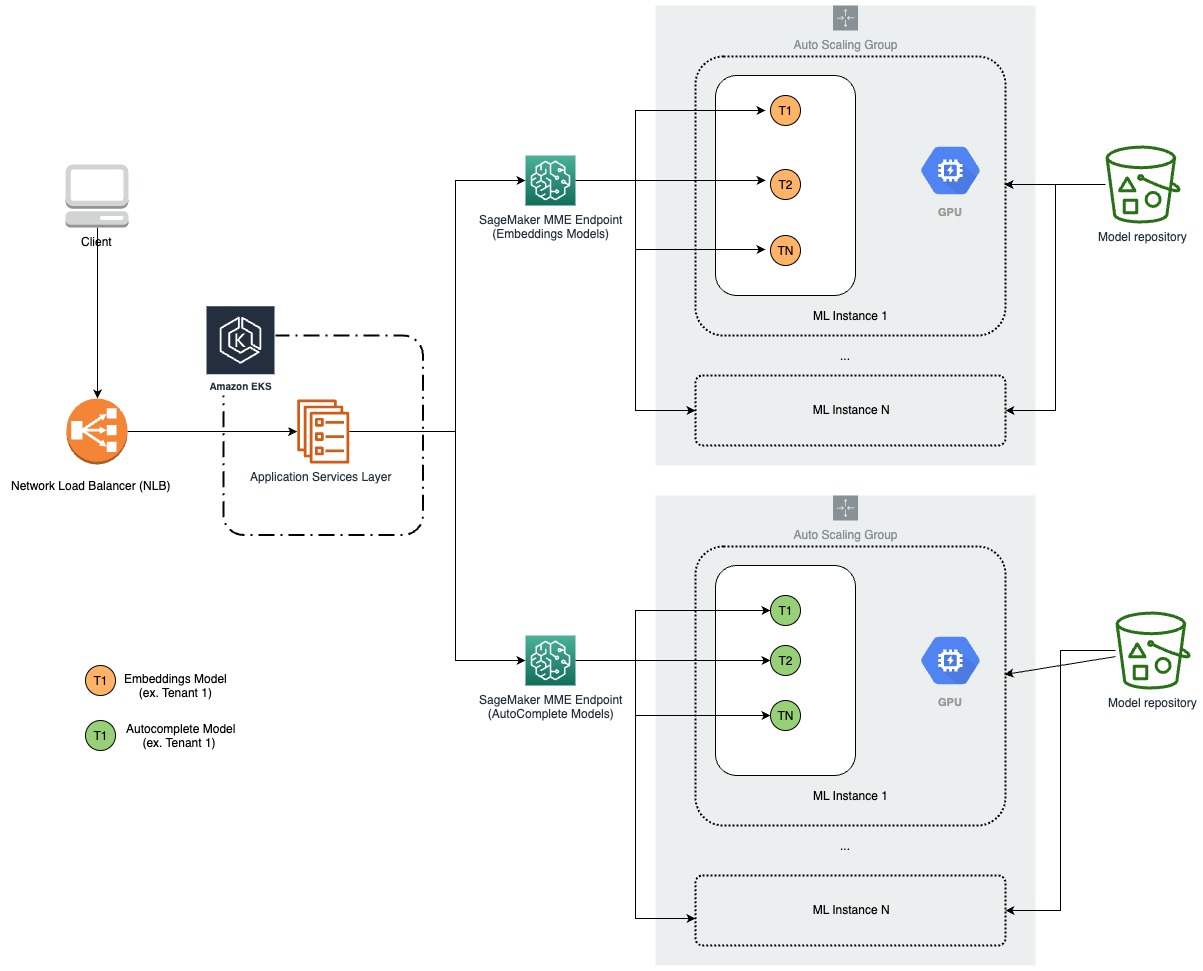

Gömme modellerimizi ve otomatik tamamlama dil modellerimizi geçişimiz için en iyi adaylar olarak belirledik. Bu modelleri MME'ler altında düzenlemek için, model türü veya görev başına bir MME, biri gömme modellerimiz için ve diğeri otomatik tamamlama dil modelleri için oluşturacağız.

Model yönetimi ve çıkarım için modellerimizin üzerinde zaten bir API katmanımız vardı. Elimizdeki görev, müşterilerin ve ürün ekiplerinin API ile etkileşime girme biçiminde minimum değişiklikle, bu API'nin SageMaker ile kaputun altında modellerde çıkarımı nasıl dağıttığını ve ele aldığını yeniden çalışmaktı. Ayrıca modellerimizi ve özel çıkarım mantığımızı, SageMaker MME'leri kullanan NVIDIA Triton Inference Server ile uyumlu olacak şekilde paketlememiz gerekiyordu.

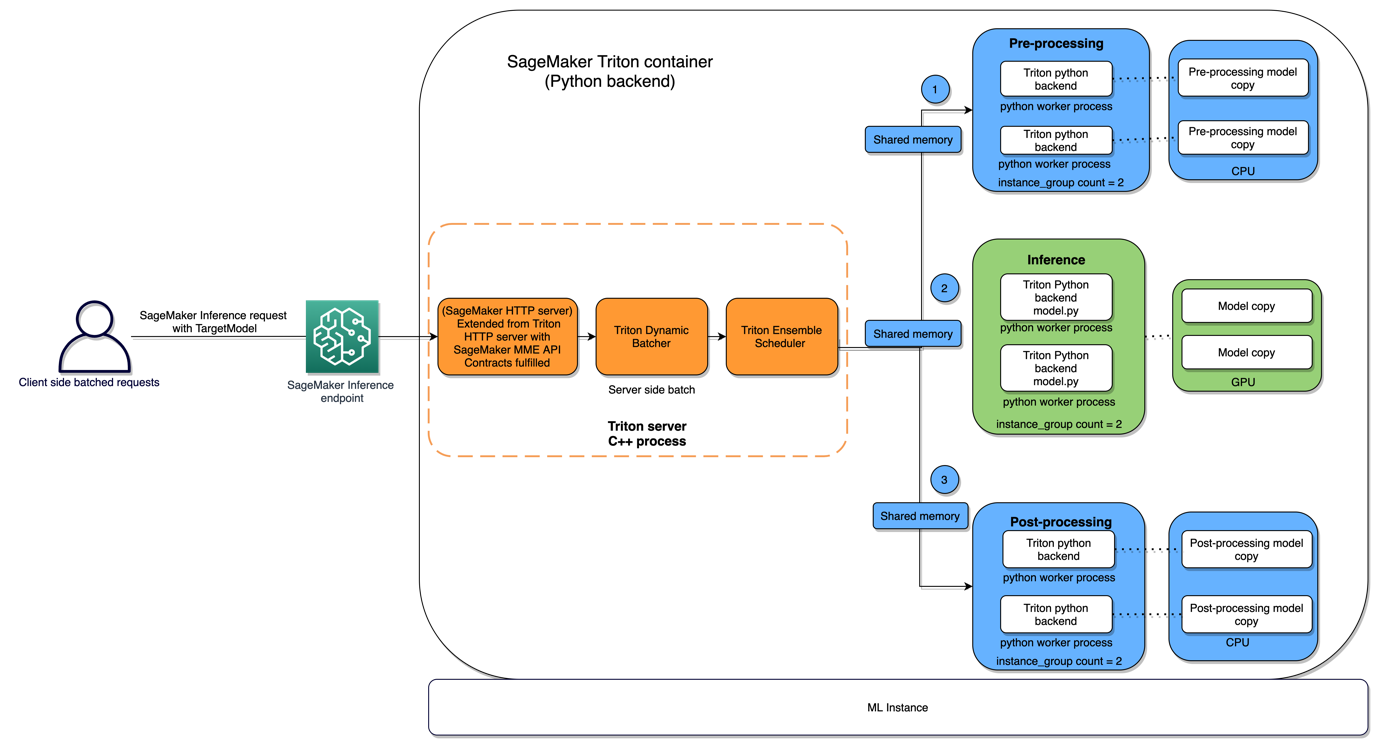

Aşağıdaki diyagram yeni mimarimizi göstermektedir.

Özel çıkarım mantığı

SageMaker'a geçiş yapmadan önce Forerought'un özel çıkarım kodu (ön işleme ve son işleme), bir model çağrıldığında API katmanında çalışıyordu. Amaç, sorumlulukların ayrılmasını netleştirmek, kodlarını modüler hale getirip basitleştirmek ve API üzerindeki yükü azaltmak için bu işlevselliği modelin kendisine aktarmaktı.

kalıplamaların

Öngörünün gömme modelleri, iki PyTorch model yapısından oluşur ve çıkarım isteği hangi modelin çağrılacağını belirler. Her model, girdi olarak önceden işlenmiş metin gerektirir. Ana zorluklar, bir ön işleme adımını entegre etmek ve model tanımı başına iki model yapıtı barındırmaktı. Çıkarım mantığında birden çok adıma olan ihtiyacı karşılamak için Forerought, iki adımlı bir Triton topluluk modeli geliştirdi: bir Python arka uç ön işleme süreci ve bir PyTorch arka uç model çağrısı. Topluluk modelleri, her adım herhangi bir arka uç türünden bir Triton modeli tarafından temsil edilen çıkarım mantığındaki adımların tanımlanmasına ve sıralanmasına izin verir. Triton PyTorch arka ucuyla uyumluluğu sağlamak için mevcut model yapıtları TorchScript formatına dönüştürüldü. Her model tanımı için ayrı Triton modelleri oluşturuldu ve Forethinkt'in API katmanı, uygun modelin belirlenmesinden sorumluydu. TargetModel gelen talebe göre çağırmak için.

Otomatik tamamlama

Otomatik tamamlama modelleri (sıradan diziye) farklı bir dizi gereksinim sunuyordu. Spesifik olarak, düşük gecikmeyi korurken birden çok model çağrısı arasında döngü oluşturma ve her arama için önemli girdileri önbelleğe alma özelliğini etkinleştirmemiz gerekiyordu. Ek olarak, bu modeller hem ön işleme hem de son işleme adımlarını gerektirmiştir. Bu gereksinimleri karşılamak ve istenen esnekliği elde etmek için Forerought, modeli Python kodu olarak yazma avantajı sunan Triton Python arka ucunu kullanan otomatik tamamlama MME modelleri geliştirdi.

Kıyaslama

Triton model şekilleri belirlendikten sonra, modelleri aşamalandırma uç noktalarına dağıttık ve kaynak ve performans kıyaslaması gerçekleştirdik. Ana hedefimiz, soğuk başlatma ile bellek içi modellerin gecikmesini ve gecikmenin istek boyutu ve eşzamanlılıktan nasıl etkilendiğini belirlemekti. Ayrıca, her bir kuruluma kaç modelin sığabileceğini, kaç modelin otomatik ölçeklendirme politikamızla bulut sunucularının ölçeğinin artmasına neden olacağını ve ölçeği büyütmenin ne kadar hızlı gerçekleşeceğini de bilmek istedik. Halihazırda kullandığımız bulut sunucusu tiplerine uygun olarak ml.g4dn.xlarge ve ml.g4dn.2xlarge bulut sunucuları ile karşılaştırmamızı yaptık.

Sonuçlar

Aşağıdaki tablo sonuçlarımızı özetlemektedir.

| İstek Boyutu | Soğuk Başlatma Gecikmesi | Önbelleğe Alınmış Çıkarım Gecikmesi | Eşzamanlı Gecikme (5 istek) |

| Küçük (30 jeton) | 12.7 saniye | 0.03 saniye | 0.12 saniye |

| Orta (250 jeton) | 12.7 saniye | 0.05 saniye | 0.12 saniye |

| Büyük (550 jeton) | 12.7 saniye | 0.13 saniye | 0.12 saniye |

Dikkat çekici bir şekilde, soğuk başlatma isteklerinin gecikmesi, önbelleğe alınmış çıkarım isteklerinin gecikmesinden önemli ölçüde daha yüksektir. Bunun nedeni, modelin diskten veya Amazon Basit Depolama Hizmeti (Amazon S3) soğuk çalıştırma isteği yapıldığında. Eşzamanlı isteklerin gecikmesi de tek isteklerin gecikmesinden daha yüksektir. Bunun nedeni, modelin çekişmeye yol açabilecek eşzamanlı istekler arasında paylaşılması gerekmesidir.

Aşağıdaki tablo, eski modellerin ve SageMaker modellerinin gecikme sürelerini karşılaştırır.

| İstek Boyutu | Eski Modeller | SageMaker Modelleri |

| Küçük (30 jeton) | 0.74 saniye | 0.24 saniye |

| Orta (250 jeton) | 0.74 saniye | 0.24 saniye |

| Büyük (550 jeton) | 0.80 saniye | 0.32 saniye |

Genel olarak SageMaker modelleri, otomatik tamamlama modellerini barındırmak için eski modellere göre daha iyi bir seçimdir. Daha düşük gecikme süresi, ölçeklenebilirlik, güvenilirlik ve güvenlik sunarlar.

Kaynak kullanımı

Her bir örneğe sığabilecek en uygun model sayısını belirleme arayışımızda bir dizi test gerçekleştirdik. Denememiz, herhangi bir otomatik ölçeklendirme politikası olmaksızın bir ml.g4dn.xlarge bulut sunucusu türü kullanarak modelleri uç noktalarımıza yüklemeyi içeriyordu.

Bu özel bulut sunucuları 15.5 GB bellek sunuyor ve bulut sunucusu başına yaklaşık %80 GPU bellek kullanımına ulaşmayı hedefledik. Her kodlayıcı modeli yapısının boyutunu göz önünde bulundurarak, hedeflenen GPU bellek kullanımımıza ulaşmak için bir bulut sunucusuna yüklenecek en uygun Triton kodlayıcı sayısını bulmayı başardık. Ayrıca, yerleştirme modellerimizin her birinin iki Triton kodlayıcı modeline karşılık geldiği göz önüne alındığında, örnek başına belirli sayıda yerleştirme modelini barındırabildik. Sonuç olarak, tüm yerleştirme modellerimize hizmet vermek için gereken toplam örnek sayısını hesapladık. Bu deney, kaynak kullanımımızı optimize etmede ve modellerimizin verimliliğini artırmada çok önemli olmuştur.

Otomatik tamamlama modellerimiz için benzer bir kıyaslama gerçekleştirdik. Bu modellerin her biri yaklaşık 292.0 MB idi. Tek bir ml.g4dn.xlarge bulut sunucusuna kaç modelin sığacağını test ederken, modellerin boyutu küçük olmasına rağmen, örneğimiz modelleri boşaltmaya başlamadan önce yalnızca dört modeli sığdırabildiğimizi fark ettik. Başlıca endişelerimiz şunlardı:

- CPU belleği kullanımının ani artışının nedeni

- En son kullanılan (LRU) model yerine bir model daha yüklemeye çalıştığımızda modellerin yükünün boşaltılmasının nedeni

Modellerimizi ve verilerimizi GPU cihazının içine ve dışına taşımak için gerekli olan Python modelimizde CUDA çalışma zamanı ortamımızı başlatmamızdan kaynaklanan bellek kullanımı artışının temel nedenini tam olarak belirleyebildik. CUDA, çalışma zamanı başlatıldığında birçok harici bağımlılığı CPU belleğine yükler. Triton PyTorch arka ucu, GPU cihazının içinde ve dışında hareket eden verileri işleyip soyutladığından, gömme modellerimizde bu sorunla karşılaşmadık. Bunu ele almak için, aynı miktarda GPU belleğine ancak iki kat daha fazla CPU belleğine sahip olan ml.g4dn.2xlarge bulut sunucularını kullanmayı denedik. Ek olarak, Python arka uç kodumuza kullanımdan sonra tensörleri silme, önbelleği boşaltma, degradeleri devre dışı bırakma ve çöp toplama dahil olmak üzere birkaç küçük iyileştirme ekledik. Daha büyük bulut sunucusu tipiyle, bulut sunucusu başına 10 modeli sığdırabildik ve CPU ve GPU bellek kullanımı çok daha uyumlu hale geldi.

Aşağıdaki şema bu mimariyi göstermektedir.

Otomatik ölçeklendirme

Hem yerleştirmelerimize hem de otomatik tamamlama MME'lerimize otomatik ölçeklendirme ilkeleri ekledik. Gömme uç noktalarımız için politikamız, özel ölçümler kullanarak ortalama %80 GPU bellek kullanımını hedefledi. Otomatik tamamlama modellerimiz, iş saatlerinde yüksek trafik ve gece boyunca minimum trafik modeli gördü. Bu nedenle, şuna dayalı bir otomatik ölçeklendirme politikası oluşturduk: InvocationsPerInstance böylece güvenilirlikten ödün vermeden maliyetten tasarruf ederek trafik modellerine göre ölçeklendirebiliriz. Kaynak kullanımı karşılaştırmalı değerlendirmemize dayanarak, ölçeklendirme politikalarımızı 225 hedefiyle yapılandırdık. InvocationsPerInstance.

Mantık ve ardışık düzen dağıtma

SageMaker'da bir MME oluşturmak basittir ve SageMaker'da başka herhangi bir uç nokta oluşturmaya benzer. Uç nokta oluşturulduktan sonra, uç noktaya ek modeller eklemek, model yapıtını uç noktanın hedeflediği S3 yoluna taşımak kadar basittir; bu noktada yeni modelimize çıkarım istekleri yapabiliriz.

Model meta verilerini alacak, uç noktayı meta verilere göre deterministik olarak biçimlendirecek ve uç noktanın var olup olmadığını kontrol edecek mantığı tanımladık. Olmadıysa, uç noktayı oluştururuz ve uç nokta için (ayrıca deterministik olarak biçimlendirilmiş) S3 yamasına Triton modeli yapıtını ekleriz. Örneğin, model meta verileri bunun bir otomatik tamamlama modeli olduğunu belirtirse, otomatik tamamlama modelleri için bir uç nokta ve otomatik tamamlama modeli yapıtları için ilişkili bir S3 yolu oluşturur. Uç nokta mevcut olsaydı, model yapısını S3 yoluna kopyalardık.

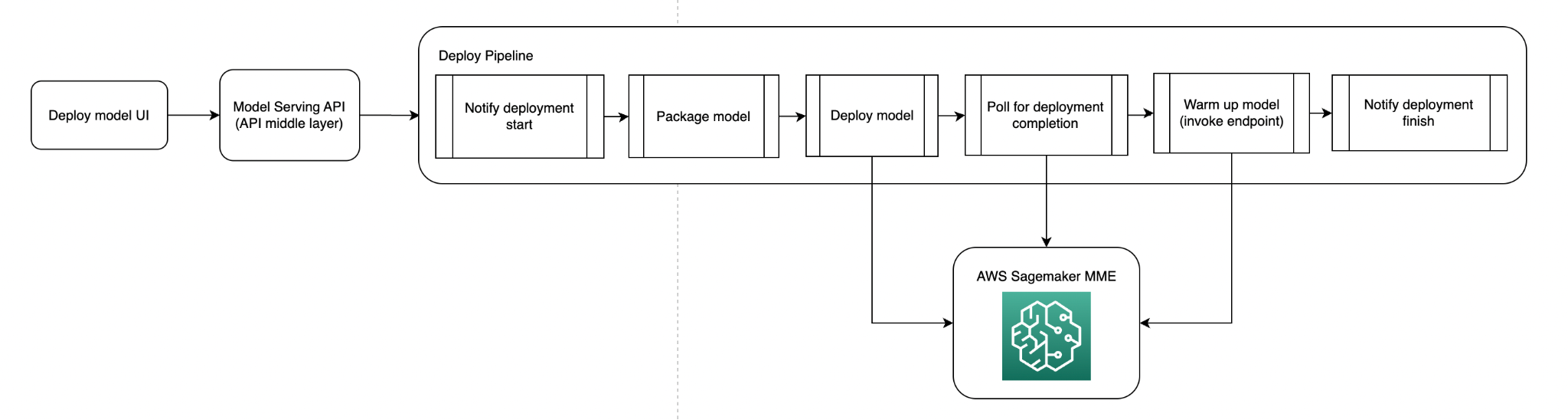

Artık MME modellerimiz için model şekillerimize ve modellerimizi MME'ye dağıtma işlevine sahip olduğumuza göre, dağıtımı otomatikleştirmenin bir yoluna ihtiyacımız vardı. Kullanıcılarımız hangi modeli dağıtmak istediklerini belirtmelidir; modelin paketlenmesini ve dağıtımını gerçekleştiriyoruz. Modelle birlikte verilen özel çıkarım kodunun sürümü oluşturulur ve Amazon S3'e aktarılır; paketleme adımında belirtilen versiyona (veya en son versiyona) göre çıkarım kodunu çekiyoruz ve Triton modellerinin dosya yapılarını gösteren YAML dosyalarını kullanıyoruz.

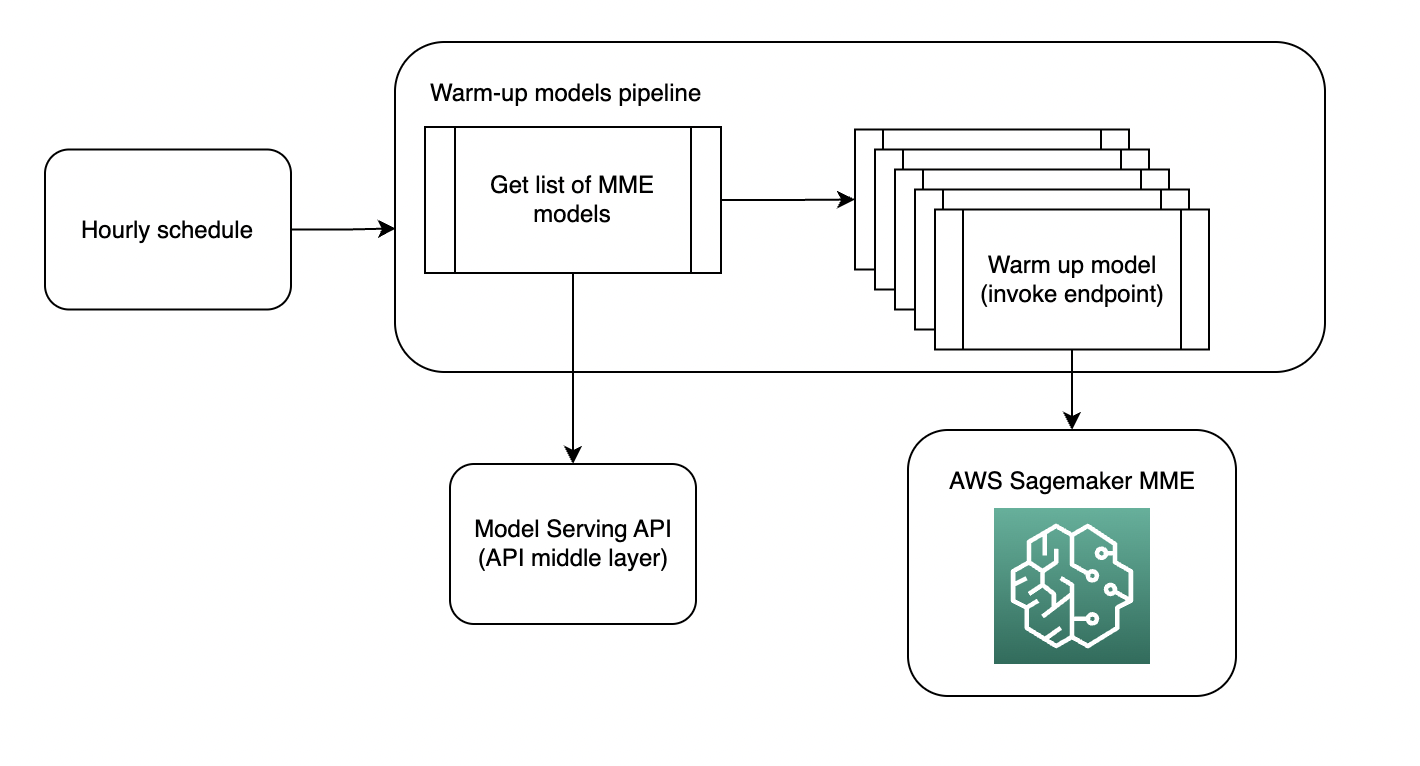

Bizim için bir gereklilik, modellere yüklenmek üzere üretim çıkarım istekleri sırasında herhangi bir soğuk başlatma gecikmesini önlemek için tüm MME modellerimizin belleğe yüklenmesiydi. Bunu başarmak için, tüm modellerimize (önceki kıyaslamaya göre) uyması için yeterli kaynak sağlıyoruz ve MME'mizdeki her modeli saatlik bir ritimde çağırıyoruz.

Aşağıdaki diyagram, model dağıtım boru hattını göstermektedir.

Aşağıdaki diyagram, model ısınma ardışık düzenini göstermektedir.

model çağrısı

Mevcut API katmanımız, arayanların tüm makine öğrenimi modellerimiz üzerinde çıkarım yapması için bir soyutlama sağlar. Bu, SageMaker MME'yi çağıran kodda herhangi bir değişiklik yapmadan çıkarım isteğine bağlı olarak doğru hedef modelle çağırmak için yalnızca API katmanına işlevsellik eklememiz gerektiği anlamına geliyordu. SageMaker çıkarım kodu, çıkarım isteğini alır, Triton modellerimizde tanımlanan Triton girdilerini biçimlendirir ve Boto3'ü kullanarak MME'leri çağırır.

Maliyet avantajları

Öngörü, SageMaker MME'lere geçiş sayesinde model barındırma maliyetlerini azaltma ve model OOM hatalarını azaltma konusunda önemli ilerlemeler kaydetti. Bu değişiklikten önce, Amazon EKS'de çalışan ml.g4dn.xlarge bulut sunucuları. MME'lere geçişle birlikte, %12 GPU bellek kullanımına ulaşırken bulut sunucusu başına 80 gömme modeli barındırabileceğini keşfettik. Bu da aylık giderlerimizde önemli bir düşüş sağladı. Perspektif olarak ifade etmek gerekirse, %80'e varan bir maliyet tasarrufu gerçekleştirdik. Ayrıca, daha yüksek trafiği yönetmek için kopyaları büyütmeyi düşündük. Üç replika kullandığımız bir senaryo varsayarsak, bu koşullar altında bile %43 civarında seyreden maliyet tasarruflarımızın hala önemli olacağını gördük.

SageMaker MME'leri ile yaptığımız yolculuk mali açıdan faydalı oldu ve optimum model performansı sağlarken giderlerimizi azalttı. Daha önce, otomatik tamamlama dil modellerimiz Amazon EKS'de konuşlandırılmıştı ve model başına bellek tahsisine bağlı olarak değişen sayıda ml.g4dn.xlarge bulut sunucusu gerektiriyordu. Bu da önemli bir aylık maliyete neden oldu. Ancak, yakın zamanda SageMaker MME'lere geçişimizle bu maliyetleri önemli ölçüde azaltmayı başardık. Artık tüm modellerimizi ml.g4dn.2xlarge bulut sunucularında barındırıyoruz ve bu da bize modelleri daha verimli bir şekilde paketleme yeteneği sağlıyor. Bu, aylık giderlerimizi önemli ölçüde azalttı ve şimdi %66-74 aralığında maliyet tasarrufu sağladık. Bu hamle, verimli kaynak kullanımının SageMaker MME'leri kullanarak ne kadar önemli mali tasarruflara yol açabileceğini göstermiştir.

Sonuç

Bu gönderide, Forethinkt'in gerçek zamanlı çıkarım için maliyeti azaltmak üzere SageMaker çoklu model uç noktalarını nasıl kullandığını inceledik. SageMaker farklılaşmamış ağır işleri üstlenir, bu nedenle Öngörü mühendislik verimliliğini artırabilir. Aynı zamanda, iş açısından kritik operasyonlar için gereken performansı korurken, Forethinkt'in gerçek zamanlı çıkarım için maliyeti önemli ölçüde düşürmesine olanak tanır. Bunu yaparak Forerought, hiper-kişiselleştirilmiş modeller kullanarak müşterileri için farklılaştırılmış bir teklif sunabiliyor. Modellerinizi geniş ölçekte barındırmak ve uç nokta kullanımını iyileştirerek barındırma maliyetlerini azaltmak için SageMaker MME'yi kullanın. Amazon SageMaker modelleri belleğe yüklemeyi ve bunları uç noktanıza giden trafik modellerine göre ölçeklendirmeyi yönettiği için dağıtım yükünü de azaltır. Kod örneklerini SageMaker MME'yi kullanarak birden çok modeli barındırma konusunda bulabilirsiniz. GitHub.

Yazarlar Hakkında

jad şamoun Forethinkt'te Çekirdek Mühendislik Direktörüdür. Ekibi, Veri Mühendisliği, Makine Öğrenimi Altyapısı ve Bulut Altyapısını kapsayan platform mühendisliğine odaklanmaktadır. onu bulabilirsin LinkedIn.

jad şamoun Forethinkt'te Çekirdek Mühendislik Direktörüdür. Ekibi, Veri Mühendisliği, Makine Öğrenimi Altyapısı ve Bulut Altyapısını kapsayan platform mühendisliğine odaklanmaktadır. onu bulabilirsin LinkedIn.

Salina Wu Forethinkt.ai'de Kıdemli Makine Öğrenimi Altyapı mühendisidir. Uçtan uca eğitim, hizmet ve veri altyapılarını oluşturmak ve sürdürmek için Makine Öğrenimi ekibiyle yakın işbirliği içinde çalışır. Makine öğrenimi alanında verimliliği artırmak ve maliyeti azaltmak için yeni yollar sunarak özellikle motive oluyor. Salina, işte olmadığı zamanlarda sörf yapmayı, çömlek yapmayı ve doğada olmayı seviyor.

Salina Wu Forethinkt.ai'de Kıdemli Makine Öğrenimi Altyapı mühendisidir. Uçtan uca eğitim, hizmet ve veri altyapılarını oluşturmak ve sürdürmek için Makine Öğrenimi ekibiyle yakın işbirliği içinde çalışır. Makine öğrenimi alanında verimliliği artırmak ve maliyeti azaltmak için yeni yollar sunarak özellikle motive oluyor. Salina, işte olmadığı zamanlarda sörf yapmayı, çömlek yapmayı ve doğada olmayı seviyor.

James Park Amazon Web Services'ta bir Çözüm Mimarıdır. AWS'de teknoloji çözümleri tasarlamak, oluşturmak ve dağıtmak için Amazon.com ile birlikte çalışıyor ve yapay zeka ve makine öğrenimine özel bir ilgisi var. Boş zamanlarında yeni kültürler, yeni deneyimler aramayı ve en son teknoloji trendlerini takip etmeyi seviyor.Onu şu adreste bulabilirsiniz: LinkedIn.

James Park Amazon Web Services'ta bir Çözüm Mimarıdır. AWS'de teknoloji çözümleri tasarlamak, oluşturmak ve dağıtmak için Amazon.com ile birlikte çalışıyor ve yapay zeka ve makine öğrenimine özel bir ilgisi var. Boş zamanlarında yeni kültürler, yeni deneyimler aramayı ve en son teknoloji trendlerini takip etmeyi seviyor.Onu şu adreste bulabilirsiniz: LinkedIn.

Sunil Padmanabhan AWS'de Başlangıç Çözümleri Mimarıdır. Eski bir startup kurucusu ve CTO olarak, makine öğrenimi konusunda tutkulu ve yeni başlayanların iş sonuçları için AI/ML'den yararlanmasına ve ML/AI çözümlerini geniş ölçekte tasarlayıp dağıtmasına yardımcı olmaya odaklanıyor.

Sunil Padmanabhan AWS'de Başlangıç Çözümleri Mimarıdır. Eski bir startup kurucusu ve CTO olarak, makine öğrenimi konusunda tutkulu ve yeni başlayanların iş sonuçları için AI/ML'den yararlanmasına ve ML/AI çözümlerini geniş ölçekte tasarlayıp dağıtmasına yardımcı olmaya odaklanıyor.

Dhaval Patel AWS'de Baş Makine Öğrenimi Mimarıdır. Dağıtılmış bilgi işlem ve Yapay Zeka ile ilgili sorunlar üzerinde büyük kuruluşlardan orta ölçekli girişimlere kadar çeşitli kuruluşlarla çalıştı. NLP ve Computer Vision alanları dahil olmak üzere Derin öğrenmeye odaklanmaktadır. Müşterilerin SageMaker'da yüksek performanslı model çıkarımı yapmasına yardımcı olur.

Dhaval Patel AWS'de Baş Makine Öğrenimi Mimarıdır. Dağıtılmış bilgi işlem ve Yapay Zeka ile ilgili sorunlar üzerinde büyük kuruluşlardan orta ölçekli girişimlere kadar çeşitli kuruluşlarla çalıştı. NLP ve Computer Vision alanları dahil olmak üzere Derin öğrenmeye odaklanmaktadır. Müşterilerin SageMaker'da yüksek performanslı model çıkarımı yapmasına yardımcı olur.

- SEO Destekli İçerik ve Halkla İlişkiler Dağıtımı. Bugün Gücünüzü Artırın.

- EVM Finans. Merkezi Olmayan Finans için Birleşik Arayüz. Buradan Erişin.

- Kuantum Medya Grubu. IR/PR Güçlendirilmiş. Buradan Erişin.

- PlatoAiStream. Web3 Veri Zekası. Bilgi Genişletildi. Buradan Erişin.

- Kaynak: https://aws.amazon.com/blogs/machine-learning/how-forethought-saves-over-66-in-costs-for-generative-ai-models-using-amazon-sagemaker/

- :vardır

- :dır-dir

- :olumsuzluk

- :Neresi

- $UP

- 1

- 10

- 100

- 12

- 13

- İNDİRİM

- 24

- 250

- 30

- 32

- 7

- 80

- a

- kabiliyet

- Yapabilmek

- Hakkımızda

- soyutlama

- özetler

- hızlandırılmış

- Göre

- doğruluk

- doğru

- tam olarak

- Başarmak

- elde

- elde

- karşısında

- eklemek

- katma

- ekleme

- ilave

- Ek

- Ayrıca

- adres

- adresleme

- ileri

- avantaj

- Sonra

- Danışman

- ajanları

- AI

- AI kullanım durumları

- AI / ML

- Hedeflenen

- hizalamak

- hizalı

- Türkiye

- tahsis

- izin vermek

- veriyor

- zaten

- Ayrıca

- Rağmen

- Amazon

- Amazon Adaçayı Yapıcı

- Amazon Web Servisleri

- Amazon.com

- miktar

- an

- ve

- Yıllık

- Başka

- cevaplar

- herhangi

- api

- API'ler

- bariz

- uygun

- yaklaşık olarak

- mimari

- ARE

- etrafında

- mal

- yapay

- yapay zeka

- AS

- asist

- ilişkili

- At

- Oto

- otomatikleştirmek

- Otomatik

- otomatik olarak

- ortalama

- önlemek

- uzakta

- AWS

- Backend

- Bakiye

- baz

- merkezli

- BE

- oldu

- Çünkü

- müşterimiz

- olmuştur

- önce

- başlamak

- olmak

- kıyaslama

- faydalı

- yarar

- İYİ

- Daha iyi

- arasında

- artırılması

- her ikisi de

- getirmek

- inşa etmek

- yerleşik

- yük

- iş

- fakat

- by

- Önbellek

- hesaplanmış

- çağrı

- denilen

- çağrı

- aramalar

- CAN

- adaylar

- yetenekleri

- dava

- durumlarda

- hitap eder

- Sebeb olmak

- meydan okuma

- zorluklar

- değişiklik

- değişiklikler

- Kontrol

- seçim

- seçti

- istemciler

- yakından

- bulut

- bulut altyapısı

- kod

- soğuk

- Toplama

- COM

- gelecek

- ortak

- Şirketin

- karşılaştırıldığında

- uygunluk

- uyumlu

- bilgisayar

- Bilgisayar görüşü

- bilgisayar

- Endişeler

- eşzamanlı

- koşullar

- yürütülen

- yapılandırılmış

- muhafazakâr

- önemli

- kabul

- düşünen

- Konteyner

- içerik

- dönüştürülmüş

- çekirdek

- doğru

- tekabül

- Ücret

- tasarruf

- uygun maliyetli

- pahalı

- maliyetler

- olabilir

- kaplama

- yaratmak

- çevrimiçi kurslar düzenliyorlar.

- Oluşturma

- çok önemli

- CTO

- görenek

- müşteri

- müşteri bilgisi

- Müşteri memnuniyeti

- Müşteri Hizmetleri

- Kullanıcı Desteği

- Müşteriler

- özelleştirilmiş

- veri

- Tarih

- Reddet

- azaltmak

- derin

- derin öğrenme

- tanımlı

- tanımlarken

- teslim etmek

- teslim

- gösterdi

- bağlı

- dağıtmak

- konuşlandırılmış

- dağıtma

- açılma

- dağıtımları

- Dizayn

- İstediğiniz

- Rağmen

- Belirlemek

- kararlı

- belirleyen

- belirlenmesi

- gelişmiş

- geliştiriciler

- cihaz

- DID

- farklı

- farklılaşmış

- yönetmen

- keşfetti

- farklı

- dağıtıldı

- Dağıtılmış bilgi işlem

- yapıyor

- domain

- etki

- Dont

- dramatik

- sırasında

- dinamik

- dinamik

- her

- verim

- verimli

- verimli biçimde

- katıştırma

- etkinleştirmek

- sağlar

- son uca

- Son nokta

- çekici

- mühendis

- Mühendislik

- artırmak

- artırılması

- yeterli

- sağlamak

- sağlanması

- işletmelerin

- çevre

- Hatalar

- Hatta

- Her

- örnek

- mevcut

- beklenen

- giderler

- pahalı

- deneyim

- Deneyimler

- deneme

- dış

- Daha hızlı

- fileto

- dosyalar

- doldurmak

- mali

- mali

- bulmak

- Ad

- uygun

- FİLO

- Esneklik

- odaklanır

- takip etme

- İçin

- biçim

- Eski

- bulundu

- kurucu

- dört

- itibaren

- tamamen

- işlevsellik

- daha fazla

- Ayrıca

- boşluklar

- oluşturmak

- oluşturulan

- üretken

- üretken yapay zeka

- alma

- gif

- verilmiş

- Verilmesi

- gol

- GPU

- GPU'lar

- gradyanları

- vardı

- el

- sap

- Kolları

- kullanma

- olmak

- donanım

- Var

- sahip olan

- he

- ağır

- ağırlık kaldırma

- yardım et

- yardım

- yardımcı olur

- Yüksek

- yüksek performans

- daha yüksek

- onu

- onun

- başlık

- ev sahibi

- hosting

- barındırma maliyetleri

- SAAT

- ev

- Ne kadar

- Ancak

- HTML

- http

- HTTPS

- Yüzlerce

- tespit

- if

- göstermektedir

- hemen

- iyileştirmek

- geliştirme

- in

- A.Ş.

- Dahil olmak üzere

- Gelen

- Artırmak

- belirtmek

- belirtilen

- bilgi

- Altyapı

- altyapı

- yenilikçi

- giriş

- girişler

- örnek

- yerine

- Bütünleştirme

- bütünleşme

- İstihbarat

- etkileşim

- etkileşimleri

- faiz

- içine

- tanıtım

- çağrılan

- çağırır

- ilgili

- konu

- IT

- ONUN

- kendisi

- seyahat

- jpg

- sadece

- koruma

- anahtar

- Bilmek

- bilgi

- dil

- büyük

- Büyük işletmeler

- büyük

- Gecikme

- son

- tabaka

- öncülük etmek

- önemli

- öğrenme

- en az

- Led

- miras

- az

- Kaldıraç

- leverages

- kaldırma

- yük

- yükleme

- yükler

- mantık

- Düşük

- alt

- makine

- makine öğrenme

- yapılmış

- Ana

- korumak

- Bakımı

- yapmak

- yönetmek

- yönetilen

- yönetim

- yönetir

- yönetme

- çok

- pazar

- maksimize

- demek

- Bellek

- Metadata

- Metrikleri

- göç

- göç

- milyon

- en az

- küçük

- hafifletici

- ML

- model

- modelleri

- izlemek

- aylık

- Daha

- Dahası

- çoğu

- motive

- hareket

- hareketli

- çok

- Çok Modelli Uç Nokta

- çoklu

- şart

- yerli

- Tabiat

- gerekli

- gerek

- gerekli

- ihtiyaçlar

- yeni

- nlp

- şimdi

- numara

- Nvidia

- nesnel

- of

- kapalı

- teklif

- teklif

- Teklifler

- sık sık

- on

- bir Zamanlar

- ONE

- bir tek

- Operasyon

- Fırsat

- optimum

- optimize

- or

- sipariş

- organizasyonlar

- Diğer

- bizim

- kendimizi

- dışarı

- sonuçlar

- tekrar

- bir gecede

- Paketlemek

- paket

- paketlenmiş

- ambalaj

- belirli

- özellikle

- tutkulu

- Patch

- yol

- model

- desen

- performans

- perspektif

- boru hattı

- platform

- Platon

- Plato Veri Zekası

- PlatoVeri

- Nokta

- politikaları

- politika

- Çivi

- güç kelimesini seçerim

- powered

- sundu

- önceki

- Önceden

- birincil

- Anapara

- Önceki

- sorunlar

- süreç

- işleme

- PLATFORM

- üretim

- verimlilik

- uygun

- kanıtlanmış

- sağlamak

- sağlanan

- sağlar

- hüküm

- itti

- koymak

- Python

- pytorch

- kalite

- sorgular

- arayışı

- hızla

- menzil

- değişen

- Sıralaması

- ulaşmak

- gerçek zaman

- fark

- son

- geçenlerde

- azaltmak

- azaltır

- azaltarak

- ilgili

- ilgisi

- uygun

- güvenilirlik

- güvenilir

- kalıntılar

- temsil

- talep

- isteklerinizi

- gereklidir

- gereklilik

- Yer Alan Kurallar

- gerektirir

- kaynak

- Kaynaklar

- yanıtları

- sorumlulukları

- sorumlu

- sonuç

- Ortaya çıkan

- Sonuçlar

- Yorumlar

- krallar gibi yaşamaya

- sert

- kök

- koşmak

- koşu

- feda

- sagemaker

- SageMaker Çıkarımı

- aynı

- memnuniyet

- İndirim

- tasarruf

- Tasarruf

- testere

- ölçeklenebilirlik

- ölçeklenebilir

- ölçek

- çoğaltmak

- terazi

- ölçekleme

- senaryo

- senaryolar

- bilim adamları

- Ara

- güvenlik

- arayan

- kıdemli

- ayrı

- Dizi

- Dizi

- hizmet vermek

- hizmet

- Hizmetler

- servis

- set

- birkaç

- gölge

- şekiller

- paylaş

- Paylaşılan

- o

- önemli

- önemli ölçüde

- benzer

- Basit

- basitleştirmek

- tek

- beden

- küçük

- akıllı

- So

- çözüm

- Çözümler

- ÇÖZMEK

- biraz

- uzay

- özel

- özellikle

- Belirtilen

- başak

- sahneleme

- başlama

- başladı

- başlangıç

- Startups

- state-of-the-art

- adım

- Basamaklar

- Yine

- hafızası

- basit

- adımlar

- önemli

- böyle

- süit

- destek

- Sistemler

- tablo

- ele almak

- ısmarlama

- Bizi daha iyi tanımak için

- alır

- Hedef

- Hedeflenen

- hedefler

- Görev

- takım

- takım

- Teknolojileri

- Teknoloji

- test edilmiş

- testleri

- göre

- Teşekkür

- o

- The

- ve bazı Asya

- Onları

- Bunlar

- onlar

- Re-Tweet

- üç

- İçinden

- bilet

- zaman

- zaman tükeniyor

- için

- Jeton

- üst

- Toplam

- trafik

- Tren

- eğitilmiş

- Eğitim

- transfer

- Dönüştürmek

- geçiş

- Trendler

- denenmiş

- Triton

- Iki kere

- iki

- tip

- türleri

- altında

- benzersiz

- us

- kullanım

- kullanım

- kullanım durumu

- Kullanılmış

- kullanıcılar

- kullanım

- kullanma

- Kullanılması

- versiyon

- çok

- vizyonumuz

- vs

- istemek

- aranan

- oldu

- Yol..

- yolları

- we

- ağ

- web hizmetleri

- vardı

- ne zaman

- olup olmadığını

- hangi

- süre

- ile

- olmadan

- İş

- işlenmiş

- çalışır

- endişe

- olur

- yazı yazıyor

- wu

- tatlım

- Sen

- zefirnet