Bu, Iambic Therapeutics'in liderlik ekibiyle birlikte yazılan bir misafir yazısıdır.

Iambik Terapötikler kanser hastalarına daha iyi ilaçları daha hızlı ulaştırmak için yenilikçi yapay zeka odaklı teknolojiler yaratma misyonuna sahip bir ilaç keşif girişimidir.

Gelişmiş üretken ve tahmine dayalı yapay zeka (AI) araçlarımız, olası ilaç moleküllerinin geniş alanında daha hızlı ve daha etkili bir şekilde arama yapmamızı sağlar. Teknolojilerimiz çok yönlüdür ve terapötik alanlara, protein sınıflarına ve etki mekanizmalarına uygulanabilir. Farklılaştırılmış yapay zeka araçları oluşturmanın ötesinde, yapay zeka yazılımını, bulut tabanlı verileri, ölçeklenebilir hesaplama altyapısını ve yüksek verimli kimya ve biyoloji yeteneklerini birleştiren entegre bir platform kurduk. Platform, hem modellerimizi iyileştirmek için veri sağlayarak yapay zekamızı mümkün kılıyor hem de otomatik karar verme ve veri işleme fırsatlarından yararlanarak yapay zeka tarafından etkinleştiriliyor.

Başarıyı, acil hasta ihtiyaçlarını karşılamak için üstün klinik adayları benzeri görülmemiş bir hızda üretme yeteneğimizle ölçüyoruz: programın lansmanından klinik adaylara yalnızca 24 ay içinde rakiplerimizden önemli ölçüde daha hızlı ilerledik.

Bu yazıda nasıl kullandığımıza odaklanacağız. marangoz on Amazon Elastik Kubernetes Hizmeti (Amazon EKS), Iambic keşif platformunun temel unsurları olan yapay zeka eğitimini ve çıkarımını ölçeklendirmek için.

Ölçeklenebilir yapay zeka eğitimi ve çıkarımına duyulan ihtiyaç

Iambic her hafta düzinelerce model ve milyonlarca molekül üzerinden yapay zeka çıkarımı gerçekleştirerek iki temel kullanım senaryosuna hizmet ediyor:

- Tıbbi kimyagerler ve diğer bilim insanları, kimyasal alanı keşfetmek, deneysel verilere erişmek ve bunları yorumlamak ve yeni tasarlanan moleküllerin özelliklerini tahmin etmek için web uygulamamız Insight'ı kullanıyor. Tüm bu çalışmalar etkileşimli olarak gerçek zamanlı olarak yapılıyor ve düşük gecikme ve orta düzeyde verim ile çıkarım yapma ihtiyacı yaratıyor.

- Aynı zamanda, üretken yapay zeka modellerimiz, çok sayıda özellik genelinde iyileştirmeyi hedefleyen, milyonlarca adayı arayan ve çok büyük verim ve orta düzeyde gecikme gerektiren molekülleri otomatik olarak tasarlar.

Yapay zeka teknolojileri ve uzman ilaç avcılarının rehberliğinde deneysel platformumuz her hafta binlerce benzersiz molekül üretiyor ve her biri birden fazla biyolojik analize tabi tutuluyor. Oluşturulan veri noktaları otomatik olarak işlenir ve her hafta yapay zeka modellerimize ince ayar yapmak için kullanılır. Başlangıçta, modelimizin ince ayarını yapmak saatler süren CPU zamanını aldı, bu nedenle GPU'larda modelin ince ayarını ölçeklendirmek için bir çerçeve zorunluydu.

Derin öğrenme modellerimizin önemsiz olmayan gereksinimleri vardır: gigabayt boyutundadırlar, çok sayıdadırlar ve heterojendirler ve hızlı çıkarım ve ince ayar için GPU'lara ihtiyaç duyarlar. Bulut altyapısına baktığımızda, GPU'lara erişmemize, ani ve heterojen iş yükleriyle başa çıkmak için ölçeği hızlı bir şekilde büyütmemize ve küçültmemize ve büyük Docker görüntülerini çalıştırmamıza olanak tanıyan bir sisteme ihtiyacımız vardı.

Yapay zeka eğitimini ve çıkarımını desteklemek için ölçeklenebilir bir sistem oluşturmak istedik. Amazon EKS'yi kullanıyoruz ve çalışan düğümlerimizi otomatik olarak ölçeklendirmek için en iyi çözümü arıyorduk. Kubernetes düğümünün otomatik ölçeklendirilmesi için Karpenter'ı birkaç nedenden dolayı seçtik:

- Ölçeklendirme için düğüm gereksinimlerini ve bölme özelliklerini tanımlamak için Kubernetes anlambilimini kullanan Kubernetes ile entegrasyon kolaylığı

- Düğümlerin düşük gecikmeli ölçeklendirilmesi

- Kod aracı (Terraform) olarak altyapımızla entegrasyon kolaylığı

Düğüm sağlayıcıları, Amazon EKS ve aşağıdakiler gibi diğer AWS kaynaklarıyla zahmetsiz entegrasyonu destekler Amazon Elastik Bilgi İşlem Bulutu (Amazon EC2) bulut sunucuları ve Amazon Elastik Blok Mağazası birimler. Sağlayıcılar tarafından kullanılan Kubernetes anlambilimi, kusurlar veya toleranslar ve benzeşim veya benzeşim karşıtı belirtimler gibi Kubernetes yapılarını kullanan yönlendirilmiş planlamayı destekler; ayrıca Karpenter tarafından planlanabilecek GPU bulut sunucularının sayısı ve türleri üzerinde kontrolü de kolaylaştırırlar.

Çözüme genel bakış

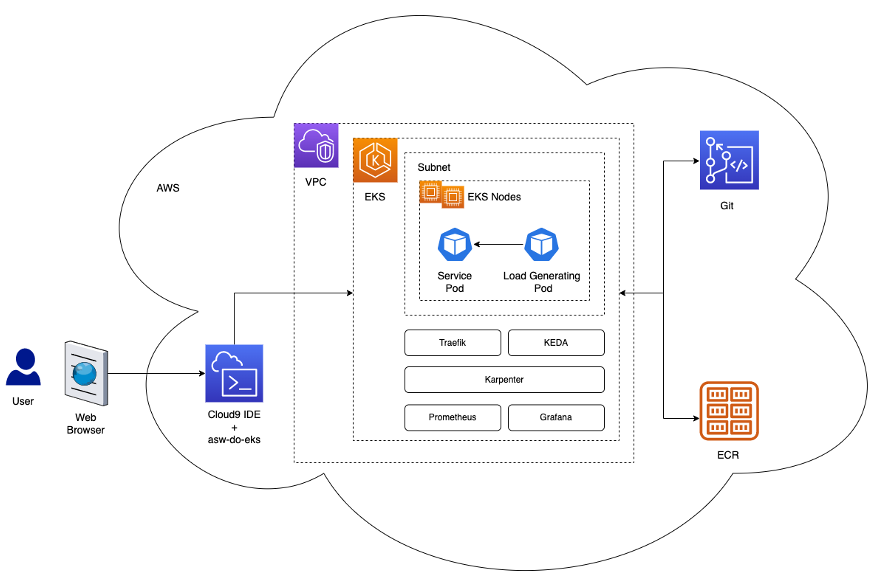

Bu bölümde, kendi iş yüklerimiz için kullandığımıza benzer, özel ölçümlere dayalı verimli otomatik ölçeklendirmeyi kullanarak modellerin esnek dağıtımına olanak tanıyan genel bir mimari sunuyoruz.

Aşağıdaki şemada çözüm mimarisi gösterilmektedir.

Mimari bir dağıtır basit hizmet bir Kubernetes bölmesinde EKS kümesi. Bu, HTTP isteğiyle erişilebilen bir model çıkarımı, veri simülasyonu veya başka herhangi bir konteynerli hizmet olabilir. Hizmet, ters proxy kullanılarak kullanıma sunulur Traefik. Ters proxy, hizmete yapılan çağrılarla ilgili ölçümleri toplar ve bunları standart bir ölçüm API'si aracılığıyla kullanıma sunar. Prometheus. Kubernetes Olay Odaklı Otomatik Ölçekleyici (KEDA), Prometheus'ta bulunan özel ölçümlere dayalı olarak hizmet bölmelerinin sayısını otomatik olarak ölçeklendirecek şekilde yapılandırılmıştır. Burada özel bir ölçüm olarak saniyedeki istek sayısını kullanıyoruz. İş yükünüz için farklı bir metrik seçerseniz aynı mimari yaklaşım geçerlidir.

Karpenter, kümede yeterli kaynak olmaması nedeniyle çalışamayan bekleyen bölmeleri izler. Bu tür bölmelerin tespit edilmesi durumunda Karpenter, gerekli kaynakları sağlamak için kümeye daha fazla düğüm ekler. Bunun tersine, kümede planlanan bölmelerin ihtiyaç duyduğundan daha fazla düğüm varsa, Karpenter bazı çalışan düğümleri kaldırır ve bölmeler yeniden planlanarak onları daha az örnekte birleştirir. Saniye başına HTTP isteklerinin sayısı ve düğüm sayısı bir kullanılarak görselleştirilebilir. grafana Gösterge Paneli. Otomatik ölçeklendirmeyi göstermek için bir veya daha fazlasını çalıştırıyoruz. basit yük üreten bölmelerkullanarak hizmete HTTP istekleri gönderen . kıvırmak.

Çözüm dağıtımı

içinde adım adım izlenecek yol, kullanırız AWS Bulut9 mimariyi dağıtmak için bir ortam olarak. Bu, tüm adımların bir web tarayıcısından tamamlanmasını sağlar. Çözümü yerel bir bilgisayardan veya EC2 örneğinden de dağıtabilirsiniz.

Dağıtımı basitleştirmek ve tekrarlanabilirliği geliştirmek için aşağıdaki ilkeleri takip ediyoruz: çerçeve yapmak ve yapısı docker'a bağlı şablon. Biz klonlarız aws-do-eks proje ve kullanarak liman işçisigerekli araç ve komut dosyalarıyla donatılmış bir kapsayıcı görüntüsü oluşturuyoruz. Konteyner içinde, Karpenter ile bir EKS kümesi oluşturmaktan ölçeklendirmeye kadar uçtan uca izlenecek yolun tüm adımlarını izliyoruz EC2 örnekleri.

Bu yazıdaki örnek için aşağıdakileri kullanıyoruz EKS kümesi bildirimi:

apiVersion: eksctl.io/v1alpha5

kind: ClusterConfig

metadata:

name: do-eks-yaml-karpenter

version: '1.28'

region: us-west-2

tags:

karpenter.sh/discovery: do-eks-yaml-karpenter

iam:

withOIDC: true

addons:

- name: aws-ebs-csi-driver

version: v1.26.0-eksbuild.1

wellKnownPolicies:

ebsCSIController: true

managedNodeGroups:

- name: c5-xl-do-eks-karpenter-ng

instanceType: c5.xlarge

instancePrefix: c5-xl

privateNetworking: true

minSize: 0

desiredCapacity: 2

maxSize: 10

volumeSize: 300

iam:

withAddonPolicies:

cloudWatch: true

ebs: trueBu bildirim, adlı bir kümeyi tanımlar do-eks-yaml-karpenter eklenti olarak EBS CSI sürücüsü yüklenmiş olarak. İkili yönetilen düğüm grubu c5.xlarge düğümler, kümenin ihtiyaç duyduğu sistem bölmelerini çalıştırmak için dahil edilir. Çalışan düğümleri özel alt ağlarda barındırılır ve küme API uç noktası varsayılan olarak geneldir.

Ayrıca, bir tane oluşturmak yerine mevcut bir EKS kümesini de kullanabilirsiniz. Aşağıdakileri takip ederek Karpenter'ı konuşlandırıyoruz: talimatlar Karpenter belgelerinde veya aşağıdakileri çalıştırarak senaryodağıtım talimatlarını otomatikleştiren.

Aşağıdaki kod, bu örnekte kullandığımız Karpenter konfigürasyonunu göstermektedir:

apiVersion: karpenter.sh/v1beta1

kind: NodePool

metadata:

name: default

spec:

template:

metadata: null

labels:

cluster-name: do-eks-yaml-karpenter

annotations:

purpose: karpenter-example

spec:

nodeClassRef:

apiVersion: karpenter.k8s.aws/v1beta1

kind: EC2NodeClass

name: default

requirements:

- key: karpenter.sh/capacity-type

operator: In

values:

- spot

- on-demand

- key: karpenter.k8s.aws/instance-category

operator: In

values:

- c

- m

- r

- g

- p

- key: karpenter.k8s.aws/instance-generation

operator: Gt

values:

- '2'

disruption:

consolidationPolicy: WhenUnderutilized

#consolidationPolicy: WhenEmpty

#consolidateAfter: 30s

expireAfter: 720h

---

apiVersion: karpenter.k8s.aws/v1beta1

kind: EC2NodeClass

metadata:

name: default

spec:

amiFamily: AL2

subnetSelectorTerms:

- tags:

karpenter.sh/discovery: "do-eks-yaml-karpenter"

securityGroupSelectorTerms:

- tags:

karpenter.sh/discovery: "do-eks-yaml-karpenter"

role: "KarpenterNodeRole-do-eks-yaml-karpenter"

tags:

app: autoscaling-test

blockDeviceMappings:

- deviceName: /dev/xvda

ebs:

volumeSize: 80Gi

volumeType: gp3

iops: 10000

deleteOnTermination: true

throughput: 125

detailedMonitoring: trueAşağıdaki gereksinimlerle varsayılan bir Karpenter NodePool tanımlarız:

- Karpenter her ikisinden de bulut sunucuları başlatabilir

spotveon-demandkapasiteli havuzlar - Örnekler şu kaynaktan olmalıdır:

c” (hesaplama optimize edilmiş), “m” (genel amaçlı), “r” (bellek optimize edilmiş) veya “g"Ve"p” (GPU hızlandırmalı) bilgi işlem aileleri - Örnek oluşturma 2'den büyük olmalıdır; Örneğin,

g3kabul edilebilir amag2değil

Varsayılan NodePool aynı zamanda kesinti politikalarını da tanımlar. Yeterince kullanılmayan düğümler kaldırılacak, böylece bölmeler daha az veya daha küçük düğümlerde çalışacak şekilde birleştirilebilir. Alternatif olarak, boş düğümleri belirtilen süre sonunda kaldırılacak şekilde yapılandırabiliriz. expireAfter ayar, herhangi bir düğümün durdurulmadan ve gerekirse değiştirilmeden önceki maksimum ömrünü belirtir. Bu, güvenlik açıklarının azaltılmasına ve dosya parçalanması veya bellek sızıntıları gibi uzun çalışma süresine sahip düğümler için tipik olan sorunların önlenmesine yardımcı olur.

Karpenter, varsayılan olarak, yapay zeka veya makine öğrenimi (ML) iş yüklerini çalıştırmak için yetersiz olabilecek küçük bir kök birimiyle düğümlerin provizyonunu yapar. Derin öğrenme konteyner görüntülerinden bazıları onlarca GB boyutunda olabilir ve bu görüntüleri kullanarak pod'ları çalıştırmak için düğümlerde yeterli depolama alanı olduğundan emin olmamız gerekir. Bunu yapmak için tanımlıyoruz EC2NodeClass ile blockDeviceMappings, önceki kodda gösterildiği gibi.

Karpenter, küme düzeyinde otomatik ölçeklendirmeden sorumludur. Otomatik ölçeklendirmeyi kapsül düzeyinde yapılandırmak için KEDA'yı kullanarak adı verilen özel bir kaynak tanımlarız. ScaledObject, aşağıdaki kodda gösterildiği gibi:

apiVersion: keda.sh/v1alpha1

kind: ScaledObject

metadata:

name: keda-prometheus-hpa

namespace: hpa-example

spec:

scaleTargetRef:

name: php-apache

minReplicaCount: 1

cooldownPeriod: 30

triggers:

- type: prometheus

metadata:

serverAddress: http://prometheus- server.prometheus.svc.cluster.local:80

metricName: http_requests_total

threshold: '1'

query: rate(traefik_service_requests_total{service="hpa-example-php-apache-80@kubernetes",code="200"}[2m])Önceki manifest, bir ScaledObject adlı keda-prometheus-hpaphp-Apache dağıtımını ölçeklendirmekten sorumludur ve her zaman en az bir kopyanın çalışmasını sağlar. Bu dağıtımın bölmelerini metriğe göre ölçeklendirir http_requests_total Belirtilen sorgu tarafından elde edilen Prometheus'ta mevcuttur ve her bir bölmenin saniyede birden fazla isteğe hizmet vermemesi için bölmeleri büyütmeyi hedefler. İstek yükü 30 saniyeden uzun süre eşiğin altında kaldığında kopyaların ölçeğini azaltır.

The dağıtım spesifikasyonu örnek hizmetimiz aşağıdakileri içerir kaynak talepleri ve limitleri:

resources:

limits:

cpu: 500m

nvidia.com/gpu: 1

requests:

cpu: 200m

nvidia.com/gpu: 1Bu yapılandırmayla hizmet bölmelerinin her biri tam olarak bir NVIDIA GPU kullanacaktır. Yeni bölmeler oluşturulduğunda, bir GPU kullanılabilir olana kadar Beklemede durumunda kalacaklardır. Karpenter, bekleyen bölmeleri barındırmak için gerektiği şekilde kümeye GPU düğümleri ekler.

A yük oluşturma bölmesi HTTP isteklerini önceden belirlenmiş bir sıklıkta hizmete gönderir. Replika sayısını artırarak istek sayısını arttırıyoruz. yük oluşturucu dağıtımı.

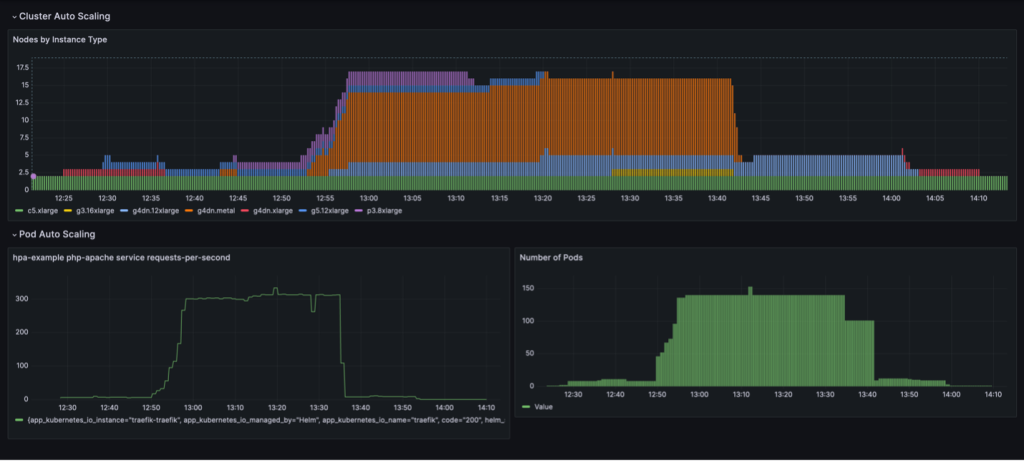

Kullanıma dayalı düğüm birleştirmeyle tam bir ölçeklendirme döngüsü Grafana kontrol panelinde görselleştirilir. Aşağıdaki kontrol paneli, bulut sunucusu tipine (üstte), saniye başına istek sayısına (sol altta) ve bölme sayısına (sağ altta) göre kümedeki düğüm sayısını gösterir.

Kümenin oluşturulduğu yalnızca iki c5.xlarge CPU örneğiyle başlıyoruz. Daha sonra tek bir GPU gerektiren bir hizmet örneğini dağıtırız. Karpenter bu ihtiyacı karşılamak için bir g4dn.xlarge örneği ekler. Daha sonra yük oluşturucuyu konuşlandırıyoruz, bu da KEDA'nın daha fazla hizmet bölmesi eklemesine ve Karpenter'ın daha fazla GPU örneği eklemesine neden oluyor. Optimizasyondan sonra durum, 3.8 GPU'lu bir p8xlarge örneğine ve 5.12 GPU'lu bir g4xlarge örneğine karar verir.

Yük oluşturan dağıtımı 40 replikaya ölçeklendirdiğimizde KEDA, pod başına gerekli istek yükünü korumak için ek hizmet pod'ları oluşturur. Karpenter, ek bölmeler için gerekli GPU'ları sağlamak amacıyla kümeye g4dn.metal ve g4dn.12xlarge düğümlerini ekler. Ölçeklendirilmiş durumda, küme 16 GPU düğümü içerir ve saniyede yaklaşık 300 isteğe hizmet eder. Yük oluşturucuyu 1 kopyaya indirdiğimizde ise tam tersi bir süreç yaşanıyor. Soğuma süresinden sonra KEDA, servis kapsüllerinin sayısını azaltır. Daha sonra, daha az sayıda bölme çalıştıkça Karpenter, yeterince kullanılmayan düğümleri kümeden kaldırır ve hizmet bölmeleri, daha az sayıda düğümde çalışacak şekilde birleştirilir. Yük oluşturucu podu çıkarıldığında, tek bir g4dn.xlarge örneğindeki 1 GPU'lu tek bir servis podu çalışmaya devam eder. Servis podunu da çıkardığımızda, küme yalnızca iki CPU düğümüyle başlangıç durumunda kalır.

Bu davranışı şu durumlarda gözlemleyebiliriz: NodePool ayarı var consolidationPolicy: WhenUnderutilized.

Bu ayarla Karpenter, kümeyi mümkün olduğunca az sayıda düğümle dinamik olarak yapılandırırken, tüm bölmelerin çalışması için yeterli kaynak sağlar ve aynı zamanda maliyeti en aza indirir.

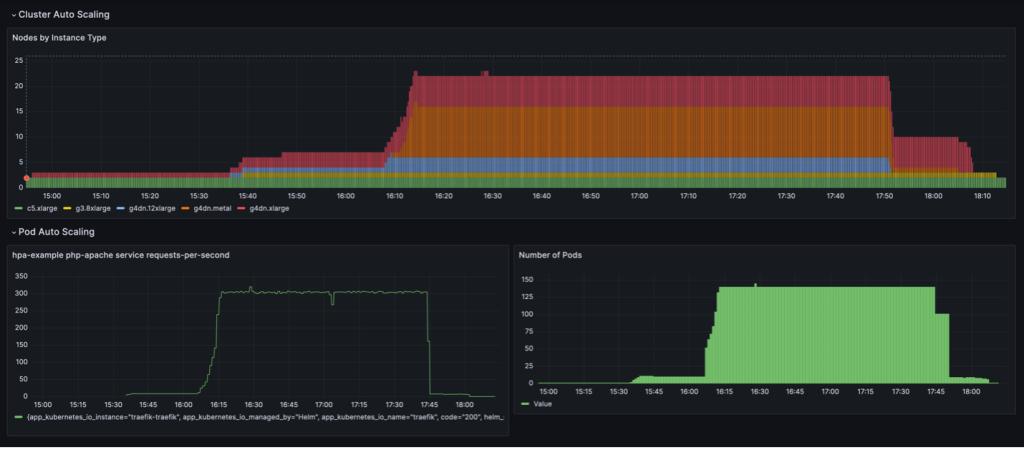

Aşağıdaki kontrol panelinde gösterilen ölçeklendirme davranışı aşağıdaki durumlarda gözlemlenir: NodePool konsolidasyon politikası şu şekilde belirlendi: WhenEmpty, ile birlikte consolidateAfter: 30s.

Bu senaryoda, düğümler yalnızca soğuma süresinden sonra üzerlerinde çalışan hiçbir bölme kalmadığında durdurulur. Kullanıma dayalı konsolidasyon politikasıyla karşılaştırıldığında ölçeklendirme eğrisi düzgün görünüyor; ancak ölçeklendirilmiş durumda daha fazla düğümün kullanıldığı görülmektedir (22'ye karşı 16).

Genel olarak, bölme ve küme otomatik ölçeklendirmenin birleştirilmesi, kümenin iş yüküne göre dinamik olarak ölçeklenmesini sağlar, gerektiğinde kaynakları tahsis eder ve kullanılmadığında bunları kaldırır, böylece kullanımı en üst düzeye çıkarır ve maliyeti en aza indirir.

Çıktıları

Iambic, AWS'de GPU'ların verimli şekilde kullanılmasını sağlamak ve iş yüklerini CPU'dan GPU'ya taşımak için bu mimariyi kullandı. EC2 GPU destekli bulut sunucularını, Amazon EKS'yi ve Karpenter'ı kullanarak, fizik tabanlı modellerimiz için daha hızlı çıkarımlar sağlamayı ve hizmet olarak eğitime güvenen uygulamalı bilim insanları için deney yineleme sürelerini kısaltmayı başardık.

Aşağıdaki tabloda bu geçişin bazı zaman ölçümleri özetlenmektedir.

| Görev | CPU'lar | GPU'lar |

| Fizik tabanlı makine öğrenimi modelleri için difüzyon modellerini kullanarak çıkarım | 3,600 saniye |

100 saniye (GPU'ların doğal olarak gruplandırılmasından dolayı) |

| Hizmet olarak ML modeli eğitimi | 180 dakikadır. | 4 dakikadır. |

Aşağıdaki tablo zaman ve maliyet ölçümlerimizden bazılarını özetlemektedir.

| Görev | Performans/Maliyet | |

| CPU'lar | GPU'lar | |

| ML modeli eğitimi |

240 dakikadır. eğitim görevi başına ortalama 0.70 ABD doları |

20 dakikadır. eğitim görevi başına ortalama 0.38 ABD doları |

Özet

Bu yazıda Iambic'in, yapay zeka çıkarımı ve eğitim iş yüklerimizin gecikme gereksinimlerini karşılamak amacıyla Amazon EKS altyapımızı ölçeklendirmek için Karpenter ve KEDA'yı nasıl kullandığını gösterdik. Karpenter ve KEDA, EKS kümelerini ve bunlarda çalışan iş yüklerini otomatik olarak ölçeklendirmeye yardımcı olan güçlü açık kaynaklı araçlardır. Bu, performans gereksinimlerini karşılarken bilgi işlem maliyetlerinin optimize edilmesine yardımcı olur. Bu kılavuzdaki tüm adımları izleyerek kodu inceleyebilir ve aynı mimariyi kendi ortamınızda dağıtabilirsiniz. GitHub repo.

Yazarlar Hakkında

Matthew Welborn Iambic Therapeutics'te Makine Öğrenimi direktörüdür. Kendisi ve ekibi, yeni tedavi yöntemlerinin tanımlanmasını ve geliştirilmesini hızlandırmak ve hayat kurtaran ilaçları hastalara daha hızlı ulaştırmak için yapay zekadan yararlanıyor.

Matthew Welborn Iambic Therapeutics'te Makine Öğrenimi direktörüdür. Kendisi ve ekibi, yeni tedavi yöntemlerinin tanımlanmasını ve geliştirilmesini hızlandırmak ve hayat kurtaran ilaçları hastalara daha hızlı ulaştırmak için yapay zekadan yararlanıyor.

Paul Whittemore Iambic Therapeutics'te Baş Mühendistir. Iambic AI odaklı ilaç keşif platformu için altyapının sağlanmasını destekliyor.

Paul Whittemore Iambic Therapeutics'te Baş Mühendistir. Iambic AI odaklı ilaç keşif platformu için altyapının sağlanmasını destekliyor.

Alex Iankoulski ML/AI Frameworks'te Baş Çözüm Mimarıdır ve müşterilerin AWS'de konteynerler ve hızlandırılmış bilgi işlem altyapısını kullanarak AI iş yüklerini düzenlemelerine yardımcı olmaya odaklanır.

Alex Iankoulski ML/AI Frameworks'te Baş Çözüm Mimarıdır ve müşterilerin AWS'de konteynerler ve hızlandırılmış bilgi işlem altyapısını kullanarak AI iş yüklerini düzenlemelerine yardımcı olmaya odaklanır.

- SEO Destekli İçerik ve Halkla İlişkiler Dağıtımı. Bugün Gücünüzü Artırın.

- PlatoData.Network Dikey Üretken Yapay Zeka. Kendine güç ver. Buradan Erişin.

- PlatoAiStream. Web3 Zekası. Bilgi Genişletildi. Buradan Erişin.

- PlatoESG. karbon, temiz teknoloji, Enerji, Çevre, Güneş, Atık Yönetimi. Buradan Erişin.

- PlatoSağlık. Biyoteknoloji ve Klinik Araştırmalar Zekası. Buradan Erişin.

- Kaynak: https://aws.amazon.com/blogs/machine-learning/scale-ai-training-and-inference-for-drug-discovery-through-amazon-eks-and-karpenter/

- :vardır

- :dır-dir

- :olumsuzluk

- ][P

- $UP

- 1

- 10

- 100

- 125

- 16

- 200

- 200m

- 22

- 24

- %26

- 28

- 30

- 300

- 40

- 600

- 7

- 70

- 8

- 80

- a

- kabiliyet

- Yapabilmek

- Hakkımızda

- hızlandırmak

- hızlandırılmış

- kabul edilebilir

- erişim

- ulaşılabilir

- Karşılamak

- karşısında

- Action

- eklemek

- Add-on

- Ek

- adres

- Ekler

- ileri

- ilgi

- Sonra

- AI

- AI modelleri

- AI eğitimi

- Türkiye

- veriyor

- boyunca

- Ayrıca

- her zaman

- Amazon

- Amazon EC2

- Amazon Web Servisleri

- an

- ve

- herhangi

- api

- uygulamayı yükleyeceğiz

- belirir

- uygulanabilir

- Uygulama

- uygulamalı

- geçerlidir

- yaklaşım

- mimari

- mimari

- ARE

- alanlar

- yapay

- yapay zeka

- Yapay zeka (AI)

- AS

- At

- Oto

- Otomatik

- otomata

- otomatik olarak

- mevcut

- önlemek

- AWS

- merkezli

- harmanlama

- BE

- olmuştur

- önce

- davranış

- arkasında

- altında

- İYİ

- Daha iyi

- Ötesinde

- Biyoloji

- Engellemek

- her ikisi de

- Alt

- getirmek

- Bringing

- tarayıcı

- inşa etmek

- fakat

- by

- denilen

- aramalar

- CAN

- Kanser

- adaylar

- yetenekleri

- Kapasite

- sermaye

- durumlarda

- nedenleri

- Kontrol

- kimyasal

- kimya

- Klinik

- seçti

- sınıflar

- Klinik

- bulut

- bulut altyapısı

- Küme

- kod

- toplar

- birleştirme

- karşılaştırıldığında

- rakipler

- tamamlamak

- Tamamlandı

- hesaplama

- hesaplamak

- bilgisayar

- bilgisayar

- yapılandırma

- yapılandırılmış

- birleştirerek

- sağlamlaştırma

- yapılar

- Konteyner

- Konteynerler

- içeren

- kontrol

- tersine

- bekleme süresi

- çekirdek

- Ücret

- maliyetler

- olabilir

- yaratmak

- çevrimiçi kurslar düzenliyorlar.

- oluşturur

- Oluşturma

- CSI

- eğri

- görenek

- Müşteriler

- devir

- gösterge paneli

- veri

- Veri noktaları

- veri işleme

- Karar verme

- derin

- derin öğrenme

- Varsayılan

- tanımlamak

- tanımlar

- teslim

- göstermek

- dağıtmak

- açılma

- dağıtır

- Dizayn

- tasarlanmış

- algılandı

- gelişme

- diyagram

- farklı

- farklılaşmış

- Yayılma

- yönlendirilmiş

- yönetmen

- keşif

- Bozulma

- do

- liman işçisi

- belgeleme

- yapılmış

- aşağı

- onlarca

- tahrik

- sürücü

- ilaç

- gereken

- dinamik

- her

- etkili bir şekilde

- verimli

- zahmetsiz

- elemanları

- etkinleştirmek

- etkin

- sağlar

- son uca

- Son nokta

- mühendis

- muazzam

- yeterli

- çevre

- donanımlı

- kurulmuş

- Etkinlikler

- Her

- kesinlikle

- örnek

- mevcut

- deneme

- deneysel

- uzman

- keşfetmek

- maruz

- kolaylaştırmak

- HIZLI

- Daha hızlı

- az

- daha az

- fileto

- odak

- odaklanır

- takip et

- takip etme

- İçin

- parçalanma

- iskelet

- çerçeveler

- Sıklık

- itibaren

- tam

- genel

- oluşturulan

- üretir

- nesil

- üretken

- üretken yapay zeka

- jeneratör

- almak

- GPU

- GPU'lar

- büyük

- grup

- Konuk

- Misafir Mesaj

- sap

- Var

- he

- yardım et

- yardım

- yardımcı olur

- okuyun

- onun

- ev sahipliği yaptı

- SAAT

- Ne kadar

- Ancak

- http

- HTTPS

- Kimlik

- if

- göstermektedir

- görüntü

- görüntüleri

- zorunlu

- iyileştirmek

- iyileşme

- in

- dahil

- Artırmak

- artan

- Altyapı

- doğal

- ilk

- başlangıçta

- yenilikçi

- kavrama

- yüklü

- örnek

- yerine

- talimatlar

- entegre

- bütünleşme

- İstihbarat

- yorumlamak

- sorunlar

- IT

- tekrarlama

- jpg

- sadece

- tutar

- anahtar

- Nezaket.

- Etiketler

- Eksiklik

- büyük

- Gecikme

- başlatmak

- Liderlik

- Kaçaklar

- öğrenme

- en az

- sol

- seviye

- Kaldıraç

- ömür

- sınırları

- yük

- yerel

- Uzun

- uzun

- bakıyor

- Düşük

- makine

- makine öğrenme

- korumak

- yapmak

- YAPAR

- yönetilen

- maksimize

- maksimum

- Mayıs..

- ölçmek

- mekanizmaları

- orta

- Neden

- toplantı

- Bellek

- birleştirmeleri

- Metadata

- metal

- metrik

- Metrikleri

- göç

- göç

- milyonlarca

- minimize

- Misyonumuz

- ML

- model

- modelleri

- monitörler

- ay

- Daha

- çoklu

- şart

- isim

- adlı

- gerekli

- gerek

- gerekli

- yeni

- yeni

- yok hayır

- düğüm

- düğümler

- roman

- numara

- sayısız

- Nvidia

- gözlemek

- elde

- of

- on

- On-Demand

- ONE

- bir tek

- açık

- açık kaynak

- Şebeke

- Fırsatlar

- optimizasyon

- optimize

- optimize

- or

- Diğer

- bizim

- dışarı

- tekrar

- kendi

- hasta

- hastalar

- kadar

- başına

- performans

- gerçekleştirir

- dönem

- yer

- platform

- Platon

- Plato Veri Zekası

- PlatoVeri

- noktaları

- politikaları

- politika

- mümkün

- Çivi

- powered

- güçlü

- önceki

- tahmin

- mevcut

- birincil

- Anapara

- ilkeler

- özel

- süreç

- İşlenmiş

- işleme

- üretmek

- Programı

- proje

- özellikleri

- Protein

- sağlamak

- sağlama

- vekil

- halka açık

- amaç

- sorgu

- hızla

- R

- gerçek

- gerçek zaman

- nedenleri

- azaltmak

- azaltır

- arıtmak

- bölge

- güvenmek

- kalıntılar

- Kaldır

- çıkarıldı

- kaldırır

- kaldırma

- yerine

- cevap

- talep

- isteklerinizi

- gerektirir

- gereklidir

- Yer Alan Kurallar

- gerektirir

- kaynak

- Kaynaklar

- sorumlu

- ters

- krallar gibi yaşamaya

- Rol

- kök

- koşmak

- koşu

- aynı

- ölçeklenebilir

- ölçek

- ölçek ai

- pullu

- terazi

- ölçekleme

- senaryo

- tarifeli

- çizelgeleme

- bilim adamları

- scriptler

- Ara

- arama

- İkinci

- saniye

- Bölüm

- güvenlik

- görüldü

- semantik

- göndermek

- gönderir

- sunucu

- vermektedir

- hizmet

- Hizmetler

- servis

- set

- ayar

- yerleşir

- görücüye

- gösterilen

- Gösteriler

- önemli ölçüde

- benzer

- basitleştirmek

- simülasyon

- tek

- beden

- küçük

- daha küçük

- pürüzsüz

- So

- Yazılım

- çözüm

- Çözümler

- biraz

- Kaynak

- uzay

- özellikler

- Belirtilen

- gözlük

- hız

- Spot

- standart

- başlama

- başlangıç

- Eyalet

- Basamaklar

- durdu

- hafızası

- yapı

- altağlar

- başarı

- böyle

- yeterli

- üstün

- tedarik

- destek

- Destekler

- elbette

- svc

- sistem

- tablo

- alır

- hedefleme

- hedefler

- takım

- Teknolojileri

- şablon

- onlarca

- Terraform

- göre

- o

- The

- Devlet

- ve bazı Asya

- Onları

- sonra

- tedavi bilimi

- Orada.

- böylece

- Bunlar

- onlar

- Re-Tweet

- Binlerce

- eşik

- İçinden

- verim

- zaman

- zamanlar

- için

- aldı

- araçlar

- üst

- Eğitim

- gerçek

- iki

- tip

- türleri

- tipik

- benzersiz

- eşi görülmemiş

- kadar

- uptimeskorumak

- acil

- us

- kullanım

- Kullanılmış

- kullanma

- v1

- Değerler

- Geniş

- çok yönlü

- versiyon

- üzerinden

- hacim

- hacimleri

- vs

- güvenlik açıkları

- örneklerde

- aranan

- oldu

- we

- ağ

- Web uygulaması

- web tarayıcı

- web hizmetleri

- hafta

- İYİ

- vardı

- Ne

- Nedir

- ne zaman

- hangi

- süre

- DSÖ

- irade

- ile

- içinde

- İş

- işçi

- tatlım

- Sen

- zefirnet