Yapay zeka (AI) ve makine öğrenimi (ML) dünyası, insan benzeri metin, görüntü, kod ve ses oluşturabilen üretken yapay zeka modellerinin yükselişiyle bir paradigma değişimine tanık oluyor. Klasik makine öğrenimi modelleriyle karşılaştırıldığında, üretken yapay zeka modelleri önemli ölçüde daha büyük ve daha karmaşıktır. Bununla birlikte, artan karmaşıklıkları aynı zamanda yüksek çıkarım maliyetleri ve güçlü bilgi işlem kaynaklarına yönelik artan bir ihtiyaç ile birlikte gelir. Üretken yapay zeka modelleri için yüksek çıkarım maliyeti, sınırlı kaynaklara sahip işletmeler ve araştırmacılar için bir giriş engeli olabilir ve daha verimli ve uygun maliyetli çözümlere ihtiyaç duyulmasını gerektirebilir. Ayrıca, üretken yapay zeka kullanım durumlarının çoğu, insan etkileşimini veya gerçek dünya senaryolarını içerir ve bu da düşük gecikmeli performans sağlayabilen donanım gerektirir. AWS, güçlü, verimli ve uygun maliyetli bilgi işlem donanımına yönelik artan ihtiyacı karşılamak için amaca yönelik oluşturulmuş yongalarla yenilikler yapıyor.

Bugün, bunu duyurmaktan heyecan duyuyoruz Amazon Adaçayı Yapıcı destekler AWS Çıkarımı2 (ml.inf2) ve AWS Eğitimi Gerçek zamanlı ve eşzamansız çıkarım için üretken yapay zeka modellerini barındırmak üzere (ml.trn1) tabanlı SageMaker örnekleri. ml.inf2 bulut sunucuları, ABD Doğu'da (Ohio) SageMaker'da ve ABD Doğu'da (K. Virginia) ml.trn1 bulut sunucularında model dağıtımı için kullanılabilir.

Büyük dil modelleri (LLM'ler), Stable Diffusion ve görüntü dönüştürücüler dahil olmak üzere üretken yapay zeka modellerinde düşük maliyetle yüksek performans elde etmek için bu bulut sunucularını SageMaker'da kullanabilirsiniz. Ayrıca, kullanabilirsiniz Amazon SageMaker Çıkarım Öneri Aracı yük testleri yapmanıza ve modelinizi bu bulut sunucularına dağıtmanın fiyat-performans avantajlarını değerlendirmenize yardımcı olmak için.

Metin özetleme, kod oluşturma, video ve görüntü oluşturma, konuşma tanıma, kişiselleştirme, dolandırıcılık tespiti ve daha fazlası için SageMaker'da makine öğrenimi uygulamalarınızı çalıştırmak üzere ml.inf2 ve ml.trn1 örneklerini kullanabilirsiniz. SageMaker uç noktanızı yapılandırırken ml.trn1 veya ml.inf2 örneklerini belirterek kolayca başlayabilirsiniz. Kolayca başlamak için PyTorch, TensorFlow, Hugging Face ve büyük model çıkarımı (LMI) için ml.trn1 ve ml.inf2 uyumlu AWS Derin Öğrenme Kapsayıcılarını (DLC'ler) kullanabilirsiniz. Sürümleri içeren tam liste için bkz. Kullanılabilir Derin Öğrenme Kapsayıcıları Resimleri.

Bu gönderide, LMI kapsayıcısından yararlanarak herhangi bir ekstra kodlama gerektirmeden SageMaker kullanarak AWS Inferentia2 üzerinde büyük bir dil modeli dağıtma sürecini gösteriyoruz. biz kullanıyoruz GPT4ALL-J, sohbet robotu tarzı bir etkileşim sağlayan ince ayarlı bir GPT-J 7B modeli.

ml.trn1 ve ml.inf2 örneklerine genel bakış

ml.trn1 bulut sunucuları, temel olarak LLM'ler de dahil olmak üzere üretken yapay zeka modellerinin yüksek performanslı derin öğrenme eğitimi için özel olarak oluşturulmuş Trainium hızlandırıcı tarafından desteklenir. Ancak bu bulut sunucuları, Inf2'ye uyandan bile daha büyük modeller için çıkarım iş yüklerini de destekler. En büyük bulut sunucusu boyutu olan trn1.32xlarge bulut sunucuları, 16 özellik Trainium hızlandırıcıları 512 petaflops'a kadar FP3.4/BF16 işlem gücü sağlayan tek bir örnekte 16 GB hızlandırıcı bellek. 16 Trainium hızlandırıcısı, kolaylaştırılmış toplu iletişim için ultra yüksek hızlı NeuronLinkv2 ile bağlanır.

ml.Inf2 bulut sunucuları tarafından desteklenmektedir AWS Inferentia2 hızlandırıcı, çıkarım için amaca yönelik bir hızlandırıcı. Birinci nesil AWS Inferentia ile karşılaştırıldığında üç kata kadar daha yüksek bilgi işlem performansı, dört kata kadar daha yüksek aktarım hızı ve 10 kata kadar daha düşük gecikme süresi sunar. En büyük bulut sunucusu boyutu olan Inf2.48xlarge, BF12/FP2 için 384 petaflop birleşik işlem gücü için tek bir bulut sunucusunda 2.3 GB hızlandırıcı belleğe sahip 16 AWS Inferentia16 hızlandırıcı içerir. Tek bir eşgörünümde 175 milyara kadar parametreli bir modeli dağıtmanıza olanak tanır. Inf2, yalnızca daha pahalı eğitim örneklerinde bulunan bir özellik olan bu ara bağlantıyı sunan, çıkarım için optimize edilmiş tek örnektir. Tek bir hızlandırıcıya sığmayan ultra büyük modeller için, veriler CPU'yu tamamen atlayarak NeuronLink ile doğrudan hızlandırıcılar arasında akar. NeuronLink ile Inf2, daha hızlı dağıtılmış çıkarımı destekler ve verimi ve gecikmeyi iyileştirir.

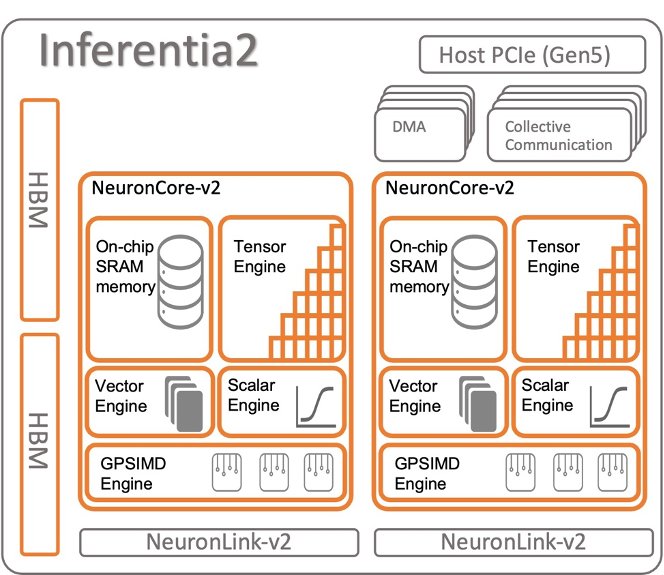

Hem AWS Inferentia2 hem de Trainium hızlandırıcılarının iki Nöron Çekirdekleri-v2, 32 GB HBM bellek yığınları ve çoklu hızlandırıcı çıkarımı yaparken hesaplama ve iletişimi üst üste bindirerek çalışma zamanını otomatik olarak optimize eden özel toplu hesaplama motorları. Mimari hakkında daha fazla ayrıntı için, bkz. Trainium ve Inferentia cihazları.

Aşağıdaki diyagram, AWS Inferentia2 kullanan örnek bir mimariyi göstermektedir.

AWS Nöron SDK'sı

AWS Nöron AWS Inferentia ve Trainium tabanlı bulut sunucularında derin öğrenme iş yüklerini çalıştırmak için kullanılan SDK'dır. AWS Neuron, bir derin öğrenme derleyicisi, çalışma zamanı ve TensorFlow ile PyTorch'a yerel olarak entegre edilmiş araçlar içerir. Neuron ile ml.trn1 ve ml.inf2'de yüksek performanslı makine öğrenimi iş yükleri geliştirebilir, profil oluşturabilir ve dağıtabilirsiniz.

The Nöron Derleyici çeşitli formatlardaki (TensorFlow, PyTorch, XLA HLO) ML modellerini kabul eder ve bunları Neuron cihazlarında çalışacak şekilde optimize eder. Neuron derleyicisi, ML modellerinin Neuron çerçeve eklentisi tarafından derleyiciye gönderildiği ML çerçevesi içinde çağrılır. Ortaya çıkan derleyici yapıtı, sırayla Neuron çalışma zamanı tarafından Neuron aygıtına yüklenen bir NEFF dosyası (Neuron Yürütülebilir Dosya Biçimi) olarak adlandırılır.

The nöron çalışma zamanı API'lerin AWS Inferentia ve Trainium Neuron cihazlarına erişmesini sağlayan çekirdek sürücüsü ve C/C++ kitaplıklarından oluşur. TensorFlow ve PyTorch için Neuron ML çerçeve eklentileri, NeuronCores'ta modelleri yüklemek ve çalıştırmak için Neuron çalışma zamanını kullanır. Neuron çalışma zamanı, derlenmiş derin öğrenme modellerini (NEFF) Neuron cihazlarına yükler ve yüksek verim ve düşük gecikme süresi için optimize edilmiştir.

SageMaker ml.inf2 örneklerini kullanarak NLP modellerini barındırın

LLM'lere hizmet vermeye derinlemesine dalmadan önce Transformers-neuronxModelin büyük ağırlık matrislerini birden çok NeuronCore'a bölmek için açık kaynaklı bir kitaplık olan , tek NeuronCore'a sığabilecek bir model için tipik dağıtım akışını kısaca inceleyelim.

kontrol desteklenen modellerin listesi modelin AWS Inferentia2 üzerinde desteklenmesini sağlamak için. Ardından, modelin Neuron Compiler tarafından önceden derlenmesi gerekir. Bir SageMaker not defteri veya Amazon Elastik Bilgi İşlem Bulutu Modeli derlemek için (Amazon EC2) örneği. Aşağıdaki kodda gösterildiği gibi, PyTorch gibi popüler derin öğrenme çerçevelerini kullanan modelleri dağıtmak için SageMaker Python SDK'yı kullanabilirsiniz. Modelinizi SageMaker barındırma hizmetlerine dağıtabilir ve çıkarım için kullanılabilecek bir uç nokta elde edebilirsiniz. Bu uç noktalar tamamen yönetilir ve otomatik ölçeklendirmeyi destekler.

Bakın Geliştirici Akışları örnek betiklerle SageMaker'da Inf2'nin tipik geliştirme akışları hakkında daha fazla ayrıntı için.

SageMaker ml.inf2 örneklerini kullanarak LLM'leri barındırın

Milyarlarca parametre içeren büyük dil modelleri genellikle tek bir hızlandırıcıya sığamayacak kadar büyüktür. Bu, LLM'leri birden çok hızlandırıcıda barındırmak için model paralel tekniklerin kullanılmasını gerektirir. LLM'leri barındırmak için bir diğer önemli gereksinim, yüksek performanslı bir model sunma çözümünün uygulanmasıdır. Bu çözüm, modeli verimli bir şekilde yüklemeli, bölümlemeyi yönetmeli ve istekleri HTTP uç noktaları aracılığıyla sorunsuz bir şekilde sunmalıdır.

SageMaker, model paralelliği ve büyük model çıkarımı için özel derin öğrenme kapsayıcıları (DLC'ler), kitaplıklar ve araçlar içerir. SageMaker'da LMI'yi kullanmaya başlamaya yönelik kaynaklar için bkz. Model paralelliği ve büyük model çıkarımı. SageMaker, AWS altyapısında GPT, T5, OPT, BLOOM ve Stable Diffusion gibi büyük modelleri barındırmak için popüler açık kaynaklı kitaplıklarla birlikte DLC'ler tutar. Bu özel DLC'lere SageMaker LMI kapsayıcıları denir.

SageMaker LMI konteynerleri NeuronCores genelinde tensör paralelliğini desteklemek için transformers-neuronx kitaplığıyla entegre bir model sunucu olan DJLServing'i kullanın. DJLServing'in nasıl çalıştığı hakkında daha fazla bilgi edinmek için bkz. DJLServing ve DeepSpeed model paralel çıkarımını kullanarak büyük modelleri Amazon SageMaker'da dağıtın. DJL model sunucusu ve transformers-neuronx kitaplığı, aynı zamanda Neuron SDK'yı da içeren kapsayıcının temel bileşenleri olarak hizmet eder. Bu kurulum, modellerin AWS Inferentia2 hızlandırıcılarına yüklenmesini kolaylaştırır, modeli birden çok NeuronCore genelinde paralelleştirir ve HTTP uç noktaları aracılığıyla hizmet vermeye olanak tanır.

LMI kapsayıcısı, bir modelden yükleme modellerini destekler. Amazon Basit Depolama Hizmeti (Amazon S3) kovası veya Hugging Face Hub. Varsayılan işleyici betiği modeli yükler, derler ve Neuron için optimize edilmiş bir formata dönüştürür ve yükler. LLM'leri barındırmak üzere LMI kapsayıcısını kullanmak için iki seçeneğimiz vardır:

- Kodsuz (tercih edilen) – Bu, bir LMI kapsayıcısı kullanarak bir LLM dağıtmanın en kolay yoludur. Bu yöntemde, sağlanan kullanabilirsiniz varsayılan işleyici ve sadece model adını ve gerekli parametreleri iletin

serving.propertiesmodeli yüklemek ve barındırmak için dosya. Varsayılan işleyiciyi kullanmak için,entryPointparametre olarakdjl_python.transformers-neuronx. - Kendi senaryonu getir – Bu yaklaşımda, modeli yüklemek ve sunmak için gerekli kodu içeren kendi model.py dosyanızı oluşturma seçeneğiniz vardır. Bu dosya arasında bir aracı görevi görür

DJLServingAPI'ler vetransformers-neuronxAPI'ler. Model yükleme işlemini özelleştirmek için şunları sağlayabilirsiniz:serving.propertiesyapılandırılabilir parametrelerle. Kullanılabilir yapılandırılabilir parametrelerin kapsamlı bir listesi için bkz. Tüm DJL yapılandırma seçenekleri. İşte bir örnek model.py dosyası.

Çalışma zamanı mimarisi

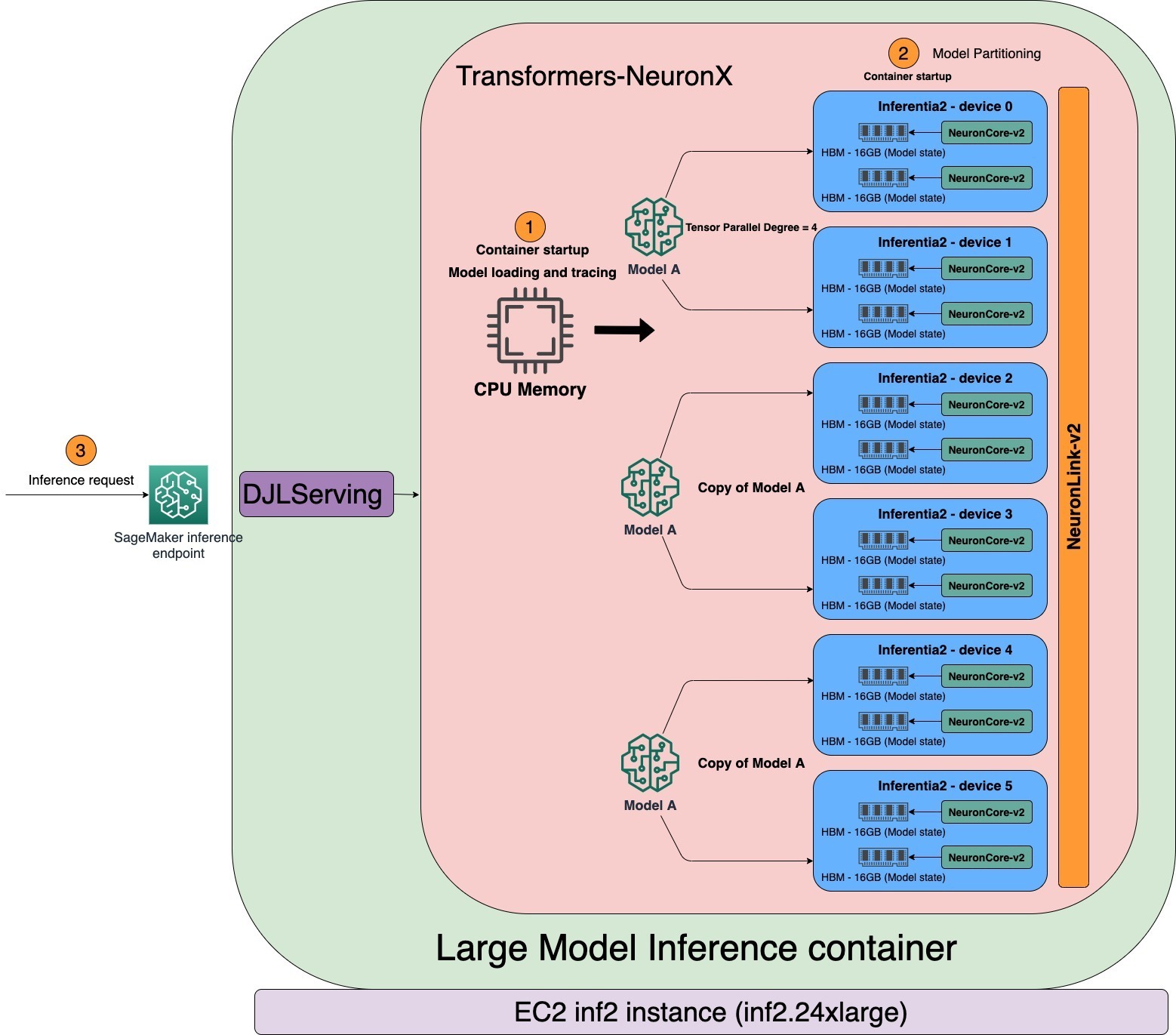

The tensor_parallel_degree özellik değeri, tensör paralel modüllerinin birden fazla NeuronCore genelinde dağıtımını belirler. Örneğin inf2.24xlarge, altı AWS Inferentia2 hızlandırıcıya sahiptir. Her AWS Inferentia2 hızlandırıcısında iki NeuronCore bulunur. Her NeuronCore, tensör paralel modüllerini depolayan 16 GB'lik özel bir yüksek bant genişliğine sahip belleğe (HBM) sahiptir. 4 tensör paralel derecesi ile LMI, her biri dört NeuronCore kullanan aynı modelin üç model kopyasını tahsis edecektir. Aşağıdaki şemada gösterildiği gibi, LMI kabı başladığında, model ilk olarak CPU adreslenebilir belleğine yüklenecek ve izlenecektir. İzleme tamamlandığında, model tensör paralel derecesine dayalı olarak NeuronCores boyunca bölümlendirilir.

LMI, model hizmet yığını olarak DJLServing'i kullanır. Kapsayıcının sağlık denetimi SageMaker'da geçtikten sonra kap, çıkarım isteğini sunmaya hazırdır. DJLServing, şuna eşdeğer birden çok Python işlemi başlatır: TOTAL NUMBER OF NEURON CORES/TENSOR_PARALLEL_DEGREE. Her Python işlemi, C++ eşdeğerinde iş parçacıkları içerir. TENSOR_PARALLEL_DEGREE. Her C++ iş parçacığı, modelin bir parçasını bir NeuronCore üzerinde tutar.

Pek çok uygulamacı (Python işlemi), sunucu birden çok bağımsız istekle çağrıldığında çıkarımı sırayla çalıştırma eğilimindedir. Kurulumu daha kolay olsa da, hızlandırıcının bilgi işlem gücünü kullanmak genellikle en iyi uygulama değildir. Bunu ele almak için DJLServing, verimi artırmak için dinamik olarak daha büyük bir toplu iş oluşturmak üzere sunucu tarafındaki bu bağımsız çıkarım isteklerini birleştirmek için yerleşik dinamik gruplama optimizasyonları sunar. Tüm istekler, çıkarım için beklemek üzere gerçek iş kuyruklarına girmeden önce dinamik toplu işleyiciye ulaşır. kullanarak dinamik gruplama için tercih ettiğiniz parti boyutlarını ayarlayabilirsiniz. batch_size ayarları serving.properties. Ayrıca yapılandırabilirsiniz max_batch_delay Gecikme gereksinimlerinize göre diğer isteklerin toplu işleme katılmasını beklemek için toplu işleyicideki maksimum gecikme süresini belirtmek için. Verim aynı zamanda kapsayıcıda başlatılan model kopyalarının ve Python işlem gruplarının sayısına da bağlıdır. Aşağıdaki diyagramda gösterildiği gibi, tensör paralel derecesi 4'e ayarlıyken, LMI kabı, her biri modelin tam kopyasını tutan üç Python işlem grubunu başlatır. Bu, parti boyutunu artırmanıza ve daha yüksek verim elde etmenize olanak tanır.

LLM'leri dağıtmak için SageMaker not defteri

Bu bölümde, FP4'de 6 GB olan 24 milyar parametreli bir model olan GPT32All-J'yi dağıtmak için adım adım izlenecek yol sunuyoruz. GPT4All-J, kelime problemleri, diyaloglar, kod, şiirler, şarkılar ve hikayeler gibi çok çeşitli etkileşim içeriği üzerinde eğitilmiş popüler bir sohbet robotudur. GPT4all-J, insan etkileşimlerine benzer yanıtlar üreten ince ayarlı bir GPT-J modelidir.

Bu örnek için tam not defteri şu adreste sağlanmıştır: GitHub. Modeli bir Inf2 örneğine dağıtmak için SageMaker Python SDK'yı kullanabiliriz. Sağlananları kullanıyoruz varsayılan işleyici modeli yüklemek için Bununla, sadece bir sağlamamız gerekiyor porsiyon.özellikleri dosya. Bu dosya, DJL model sunucusunun modeli indirmesi ve barındırması için gerekli yapılandırmalara sahiptir. Hugging Face modelinin adını kullanarak belirtebiliriz. model_id Modeli doğrudan Hugging Face deposundan indirmek için parametre. Alternatif olarak, aşağıdakileri sağlayarak modeli Amazon S3'ten indirebilirsiniz: s3url parametre. entryPoint parametresi, modeli yüklemek için kitaplığı işaret edecek şekilde yapılandırılmıştır. hakkında daha fazla ayrıntı için djl_python.fastertransformer, bakın GitHub kodu.

The tensor_parallel_degree özellik değeri, tensör paralel modüllerinin birden fazla cihaza dağılımını belirler. Örneğin, 12 NeuronCore ve 4 tensör paralel derecesi ile LMI, her biri dört NeuronCore kullanan üç model kopya tahsis edecektir. Özelliği kullanarak kesinlik tipini de tanımlayabilirsiniz. dtype. n_position parametre, model için maksimum giriş ve çıkış dizisi uzunluğunun toplamını tanımlar. Aşağıdaki koda bakın:

Oluşturun tarball içeren serving.properties ve bir S3 klasörüne yükleyin. Bu örnekte varsayılan işleyici kullanılmasına rağmen, model.py yükleme ve sunma sürecini özelleştirmek için dosya. Kurulum gerektiren herhangi bir paket varsa, bunları requirements.txt dosya. Aşağıdaki koda bakın:

DJL konteyner görüntüsünü alın ve SageMaker modelini oluşturun:

Ardından, daha önce tanımlanan model yapılandırmasıyla SageMaker uç noktasını oluşturuyoruz. Konteyner, modeli içine indirir. /tmp alanı çünkü SageMaker /tmp için Amazon Elastik Blok Mağazası (Amazon EBS'si). eklememiz gerekiyor volume_size sağlamak için parametre /tmp dizinde modeli indirmek ve derlemek için yeterli alan var. Ayarladık container_startup_health_check_timeout model hazır olduktan sonra durum kontrolünün başlamasını sağlamak için 3,600 saniyeye. ml.inf2.8xlarge örneğini kullanıyoruz. Aşağıdaki koda bakın:

SageMaker uç noktası oluşturulduktan sonra, SageMaker uç noktalarına karşı gerçek zamanlı tahminler yapabiliriz. Predictor nesne:

Temizlemek

Testlerinizi bitirdikten sonra maliyetten tasarruf etmek için uç noktaları silin:

Sonuç

Bu gönderide, üretken yapay zeka modellerini barındırmak için artık ml.inf2 ve ml.trn1 örneklerini destekleyen SageMaker'ın yeni kullanıma sunulan özelliğini sergiledik. Üretken bir yapay zeka modeli olan GPT4ALL-J'nin AWS Inferentia2'de SageMaker ve LMI kapsayıcısı kullanılarak herhangi bir kod yazmadan nasıl devreye alınacağını gösterdik. DJLServing'i nasıl kullanabileceğinizi de gösterdik ve transformers-neuronx bir model yüklemek, bölümlemek ve sunmak için.

Inf2 bulut sunucuları, AWS'de üretken yapay zeka modelleri çalıştırmanın en uygun maliyetli yolunu sağlar. Performans ayrıntıları için bkz. Inf2 Performansı.

Check out GitHub örnek bir not defteri için repo. Deneyin ve herhangi bir sorunuz varsa bize bildirin!

Yazarlar Hakkında

Vivek Gangasani Amazon Web Services'ta Kıdemli Makine Öğrenimi Çözümleri Mimarıdır. AWS'de AI/ML uygulamaları oluşturmak ve dağıtmak için Machine Learning Startups ile birlikte çalışıyor. Şu anda MLOps, ML Inference ve düşük kodlu ML için çözümler sunmaya odaklanmıştır. Doğal Dil İşleme ve Bilgisayarla Görü dahil olmak üzere farklı alanlarda projeler üzerinde çalıştı.

Vivek Gangasani Amazon Web Services'ta Kıdemli Makine Öğrenimi Çözümleri Mimarıdır. AWS'de AI/ML uygulamaları oluşturmak ve dağıtmak için Machine Learning Startups ile birlikte çalışıyor. Şu anda MLOps, ML Inference ve düşük kodlu ML için çözümler sunmaya odaklanmıştır. Doğal Dil İşleme ve Bilgisayarla Görü dahil olmak üzere farklı alanlarda projeler üzerinde çalıştı.

Hiroşi Tokoyo AWS Annapurna Labs'ta bir Çözüm Mimarıdır. Japonya'da yerleşik olarak, AWS tarafından satın alınmadan önce bile Annapurna Labs'a katıldı ve müşterilere Annapurna Labs teknolojisi konusunda sürekli olarak yardımcı oldu. Son zamanlarda odak noktası, amaca yönelik silikon, AWS Inferentia ve Trainium tabanlı Makine Öğrenimi çözümleridir.

Hiroşi Tokoyo AWS Annapurna Labs'ta bir Çözüm Mimarıdır. Japonya'da yerleşik olarak, AWS tarafından satın alınmadan önce bile Annapurna Labs'a katıldı ve müşterilere Annapurna Labs teknolojisi konusunda sürekli olarak yardımcı oldu. Son zamanlarda odak noktası, amaca yönelik silikon, AWS Inferentia ve Trainium tabanlı Makine Öğrenimi çözümleridir.

Dhaval Patel AWS'de Baş Makine Öğrenimi Mimarıdır. Dağıtılmış bilgi işlem ve Yapay Zeka ile ilgili sorunlar üzerinde büyük kuruluşlardan orta ölçekli girişimlere kadar çeşitli kuruluşlarla çalıştı. NLP ve Computer Vision alanları dahil olmak üzere Derin öğrenmeye odaklanmaktadır. Müşterilerin SageMaker'da yüksek performanslı model çıkarımı yapmasına yardımcı olur.

Dhaval Patel AWS'de Baş Makine Öğrenimi Mimarıdır. Dağıtılmış bilgi işlem ve Yapay Zeka ile ilgili sorunlar üzerinde büyük kuruluşlardan orta ölçekli girişimlere kadar çeşitli kuruluşlarla çalıştı. NLP ve Computer Vision alanları dahil olmak üzere Derin öğrenmeye odaklanmaktadır. Müşterilerin SageMaker'da yüksek performanslı model çıkarımı yapmasına yardımcı olur.

Qing Lan AWS'de Yazılım Geliştirme Mühendisidir. Amazon'da yüksek performanslı ML çıkarım çözümleri ve yüksek performanslı günlük kaydı sistemi dahil olmak üzere birçok zorlu ürün üzerinde çalışıyor. Qing'in ekibi, Amazon Advertising'de çok düşük gecikme süresi gerektiren ilk Milyar parametre modelini başarıyla başlattı. Qing, altyapı optimizasyonu ve Derin Öğrenme hızlandırması hakkında derinlemesine bilgi sahibidir.

Qing Lan AWS'de Yazılım Geliştirme Mühendisidir. Amazon'da yüksek performanslı ML çıkarım çözümleri ve yüksek performanslı günlük kaydı sistemi dahil olmak üzere birçok zorlu ürün üzerinde çalışıyor. Qing'in ekibi, Amazon Advertising'de çok düşük gecikme süresi gerektiren ilk Milyar parametre modelini başarıyla başlattı. Qing, altyapı optimizasyonu ve Derin Öğrenme hızlandırması hakkında derinlemesine bilgi sahibidir.

Qingwei Li Amazon Web Services'te Makine Öğrenimi Uzmanıdır. Doktora derecesini aldı. Danışmanının araştırma bursu hesabını bozduktan ve söz verdiği Nobel Ödülü'nü teslim edemedikten sonra Yöneylem Araştırması'nda. Şu anda finansal hizmet ve sigorta sektöründeki müşterilerin AWS'de makine öğrenimi çözümleri oluşturmasına yardımcı oluyor. Boş zamanlarında okumayı ve öğretmeyi sever.

Qingwei Li Amazon Web Services'te Makine Öğrenimi Uzmanıdır. Doktora derecesini aldı. Danışmanının araştırma bursu hesabını bozduktan ve söz verdiği Nobel Ödülü'nü teslim edemedikten sonra Yöneylem Araştırması'nda. Şu anda finansal hizmet ve sigorta sektöründeki müşterilerin AWS'de makine öğrenimi çözümleri oluşturmasına yardımcı oluyor. Boş zamanlarında okumayı ve öğretmeyi sever.

Alan Tan SageMaker'ın büyük model çıkarımına yönelik çabalara öncülük eden Kıdemli Ürün Müdürüdür. Analitik alanına Makine Öğrenimi uygulama konusunda tutkulu. İş dışında, açık havayı sever.

Alan Tan SageMaker'ın büyük model çıkarımına yönelik çabalara öncülük eden Kıdemli Ürün Müdürüdür. Analitik alanına Makine Öğrenimi uygulama konusunda tutkulu. İş dışında, açık havayı sever.

Varun Syal AWS Sagemaker'da ML Inference platformu için müşteriye yönelik kritik özellikler üzerinde çalışan bir Yazılım Geliştirme Mühendisidir. Dağıtılmış Sistemler ve yapay zeka alanında çalışmak konusunda tutkulu. Boş zamanlarında kitap okumayı ve bahçeyle uğraşmayı sever.

Varun Syal AWS Sagemaker'da ML Inference platformu için müşteriye yönelik kritik özellikler üzerinde çalışan bir Yazılım Geliştirme Mühendisidir. Dağıtılmış Sistemler ve yapay zeka alanında çalışmak konusunda tutkulu. Boş zamanlarında kitap okumayı ve bahçeyle uğraşmayı sever.

- SEO Destekli İçerik ve Halkla İlişkiler Dağıtımı. Bugün Gücünüzü Artırın.

- PlatoAiStream. Web3 Veri Zekası. Bilgi Genişletildi. Buradan Erişin.

- Adryenn Ashley ile Geleceği Basmak. Buradan Erişin.

- PREIPO® ile PRE-IPO Şirketlerinde Hisse Al ve Sat. Buradan Erişin.

- Kaynak: https://aws.amazon.com/blogs/machine-learning/achieve-high-performance-with-lowest-cost-for-generative-ai-inference-using-aws-inferentia2-and-aws-trainium-on-amazon-sagemaker/

- :vardır

- :dır-dir

- :olumsuzluk

- :Neresi

- $UP

- 10

- 100

- 12

- 13

- 14

- %15

- 22

- 24

- 7

- 8

- 9

- a

- Hakkımızda

- hızlandırıcı

- hızlandırıcılar

- Kabul eder

- erişim

- Hesap

- Başarmak

- edinme

- karşısında

- eylemler

- eklemek

- ilave

- adres

- adreslenebilir

- avantaj

- reklâm

- Sonra

- karşı

- AI

- AI kullanım durumları

- AI / ML

- Türkiye

- veriyor

- Ayrıca

- Rağmen

- Amazon

- Amazon EC2

- Amazon Adaçayı Yapıcı

- Amazon Web Servisleri

- an

- analytics

- ve

- duyurmak

- Başka

- herhangi

- API'ler

- uygulamaları

- Uygulanması

- yaklaşım

- mimari

- ARE

- ALAN

- yapay

- yapay zeka

- Yapay zeka (AI)

- AS

- At

- ses

- Oto

- otomatik olarak

- mevcut

- AWS

- AWS Çıkarımları

- top

- Bant genişliği

- bariyer

- merkezli

- BE

- Çünkü

- olmuştur

- önce

- faydaları

- İYİ

- arasında

- Büyük

- büyük

- milyarlarca

- Engellemek

- Blog

- Çiçek açmak

- kısaca

- Broke

- inşa etmek

- yapılı

- yerleşik

- işletmeler

- by

- C + +

- denilen

- CAN

- durumlarda

- zor

- chatbot

- Kontrol

- cips

- kod

- kodlama

- Toplu

- birleştirmek

- kombine

- geliyor

- Yakın İletişim

- İletişim

- karşılaştırıldığında

- uyumlu

- tamamlamak

- tamamen

- karmaşık

- karmaşıklık

- bileşenler

- kapsamlı

- hesaplama

- hesaplamak

- bilgisayar

- Bilgisayar görüşü

- bilgisayar

- yapılandırma

- bağlı

- Konteyner

- Konteynerler

- içeren

- içerik

- çekirdek

- Ücret

- uygun maliyetli

- maliyetler

- yaratmak

- çevrimiçi kurslar düzenliyorlar.

- kritik

- çok önemli

- Şu anda

- müşteri

- Müşteriler

- özelleştirmek

- veri

- adanmış

- derin

- derin öğrenme

- Varsayılan

- tanımlı

- tanımlar

- derece

- geciktirmek

- teslim etmek

- teslim

- sağlıyor

- gösterdi

- bağlıdır

- dağıtmak

- dağıtma

- açılma

- ayrıntılar

- Bulma

- belirleyen

- geliştirmek

- gelişme

- cihaz

- Cihaz

- farklı

- Yayılma

- direkt olarak

- dağıtıldı

- Dağıtılmış bilgi işlem

- dağıtılmış sistemler

- dağıtım

- yapıyor

- etki

- Dont

- indir

- indirme

- sürücü

- dinamik

- dinamik

- her

- Daha erken

- kolay

- kolay

- kolayca

- Doğu

- verimli

- verimli biçimde

- çabaları

- sağlar

- son

- Son nokta

- mühendis

- Motorlar

- yeterli

- sağlamak

- girme

- işletmelerin

- giriş

- Eşdeğer

- değerlendirmek

- Hatta

- örnek

- uyarılmış

- pahalı

- ekstra

- Yüz

- kolaylaştırır

- karşı

- başarısız

- Daha hızlı

- Özellikler(Hazırlık aşamasında)

- Özellikler

- fileto

- mali

- Finansal servis

- bitiş

- Ad

- uygun

- akış

- Akışları

- odak

- odaklanmış

- odaklanır

- takip etme

- İçin

- Airdrop Formu

- biçim

- dört

- iskelet

- çerçeveler

- dolandırıcılık

- sahtekarlık tespiti

- itibaren

- tam

- tamamen

- Ayrıca

- üretir

- nesil

- üretken

- üretken yapay zeka

- almak

- Go

- vermek

- Grubun

- Büyüyen

- donanım

- Var

- he

- Sağlık

- yardım et

- yardım

- yardımcı olur

- okuyun

- Yüksek

- yüksek performans

- daha yüksek

- onun

- tutma

- tutar

- ev sahibi

- hosting

- barındırma hizmetleri

- ev

- Ne kadar

- Nasıl Yapılır

- Ancak

- HTML

- http

- HTTPS

- merkez

- insan

- if

- görüntü

- görüntüleri

- uygulama

- ithalat

- in

- derinlemesine

- dahil

- içerir

- Dahil olmak üzere

- Artırmak

- artan

- bağımsız

- sanayi

- Altyapı

- yenilik

- giriş

- girişler

- Kurulum

- örnek

- sigorta

- entegre

- İstihbarat

- etkileşim

- etkileşimleri

- aracı

- içine

- çağrılan

- dahil

- IT

- ONUN

- Japonya

- İş

- kaydol

- katıldı

- jpg

- json

- sadece

- Bilmek

- bilgi

- Labs

- dil

- büyük

- Büyük işletmeler

- büyük

- büyük

- Gecikme

- başlattı

- başlattı

- önemli

- ÖĞRENİN

- öğrenme

- uzunluk

- izin

- kütüphaneler

- Kütüphane

- sevmek

- seviyor

- Sınırlı

- Liste

- Yüksek Lisans

- yük

- yükleme

- yükler

- günlüğü

- Düşük

- alt

- en düşük

- makine

- makine öğrenme

- ağırlıklı olarak

- tutar

- çoğunluk

- yapmak

- yönetmek

- yönetilen

- müdür

- Haritalar

- maksimum

- maksimum

- Bellek

- yöntem

- ML

- MLO'lar

- model

- modelleri

- Modüller

- Daha

- daha verimli

- çoğu

- çoklu

- isim

- Doğal (Madenden)

- Doğal Dil İşleme

- gerekli

- gerek

- ihtiyaçlar

- yeni

- New York

- sonraki

- nlp

- Nobel Ödülü

- defter

- şimdi

- numara

- nesne

- of

- teklif

- Teklifler

- sık sık

- Ohio

- on

- ONE

- bir tek

- açık kaynak

- Operasyon

- optimizasyon

- optimize

- optimize

- optimize

- seçenek

- Opsiyonlar

- or

- organizasyonlar

- Diğer

- bizim

- dışarı

- açık havada

- çıktı

- dışında

- kendi

- paketler

- paradigma

- Paralel

- parametre

- parametreler

- geçmek

- geçer

- tutkulu

- performans

- Kişiselleştirme

- platform

- Platon

- Plato Veri Zekası

- PlatoVeri

- fişe takmak

- eklentileri

- Nokta

- Popüler

- Çivi

- güç kelimesini seçerim

- powered

- güçlü

- uygulama

- Hassas

- Tahminler

- Predictor

- tercihli

- Anapara

- ödül

- sorunlar

- süreç

- Süreçler

- işleme

- PLATFORM

- ürün müdürü

- Ürünler

- Profil

- Projeler

- söz

- özellikleri

- özellik

- sağlamak

- sağlanan

- sağlar

- sağlama

- amaç

- Python

- pytorch

- değişen

- ulaşmak

- Okuma

- hazır

- Gerçek dünya

- gerçek zaman

- Alınan

- son

- tanıma

- Referans

- ilgili

- talep

- isteklerinizi

- gereklidir

- gereklilik

- Yer Alan Kurallar

- araştırma

- Araştırmacılar

- Kaynaklar

- yanıtları

- Ortaya çıkan

- Yükselmek

- koşmak

- sagemaker

- SageMaker Çıkarımı

- aynı

- İndirim

- ölçekleme

- senaryolar

- scriptler

- sdk

- sorunsuz

- saniye

- Bölüm

- görmek

- kıdemli

- Dizi

- hizmet vermek

- hizmet

- Hizmetler

- servis

- set

- ayarlar

- kurulum

- birkaç

- çalışma

- meli

- şov

- görücüye

- gösterilen

- Gösteriler

- yan

- önemli ölçüde

- Silikon

- benzer

- Basit

- tek

- ALTINCI

- beden

- boyutları

- So

- Yazılım

- yazılım geliştirme

- çözüm

- Çözümler

- uzay

- uzman

- özel

- konuşma

- Konuşma Tanıma

- kararlı

- yığın

- Yığınları

- başlama

- başladı

- başlar

- Startups

- hafızası

- hikayeler

- depolamak

- aerodinamik

- stil

- Başarılı olarak

- böyle

- destek

- destekli

- Destekler

- sistem

- Sistemler

- alma

- Öğretim

- takım

- teknikleri

- Teknoloji

- tensorflow

- testleri

- göre

- o

- The

- Alan

- ve bazı Asya

- Onları

- Orada.

- Bunlar

- Re-Tweet

- üç

- İçinden

- verim

- zaman

- zamanlar

- için

- çok

- araçlar

- İzleme

- eğitilmiş

- Eğitim

- transformatörler

- DÖNÜŞ

- iki

- tip

- tipik

- Yüklenen

- us

- kullanım

- Kullanılmış

- kullanma

- genellikle

- kullanmak

- Kullanılması

- değer

- çeşitlilik

- çeşitli

- Geniş

- çok

- üzerinden

- Video

- Virjinya

- vizyonumuz

- beklemek

- örneklerde

- Yol..

- we

- ağ

- web hizmetleri

- ağırlık

- Ne

- ne zaman

- hangi

- irade

- ile

- içinde

- olmadan

- tanık

- Word

- İş

- işlenmiş

- çalışma

- çalışır

- Dünya

- yazmak

- yazı yazıyor

- york

- Sen

- zefirnet