Yapay zeka (AI), teknoloji camiasında önemli ve popüler bir konu haline geldi. Yapay zeka geliştikçe farklı türde makine öğrenimi (ML) modellerinin ortaya çıktığını gördük. Olarak bilinen bir yaklaşım topluluk modelleme, veri bilimcileri ve uygulayıcılar arasında hızla ilgi görüyor. Bu yazıda topluluk modellerinin ne olduğunu ve bunların kullanımının neden faydalı olabileceğini tartışıyoruz. Daha sonra özel topluluklarınızı nasıl eğitebileceğiniz, optimize edebileceğiniz ve dağıtabileceğinize dair bir örnek sunuyoruz. Amazon Adaçayı Yapıcı.

Toplu öğrenme, herhangi bir tekli öğrenme algoritmasından daha doğru tahminler elde etmek için birden fazla öğrenme modelinin ve algoritmasının kullanılmasını ifade eder. Siber güvenlik [1] ve dolandırıcılık tespiti, uzaktan algılama, finansal karar almada sonraki en iyi adımları tahmin etme, tıbbi teşhis ve hatta bilgisayarlı görme ve doğal dil işleme (NLP) gibi çeşitli uygulama ve öğrenme ortamlarında etkili oldukları kanıtlanmıştır. görevler. Toplulukları, onları eğitmek için kullanılan tekniklere, kompozisyonlarına ve farklı tahminleri tek bir çıkarımda birleştirme biçimlerine göre sınıflandırma eğilimindeyiz. Bu kategoriler şunları içerir:

- Arttırılması – Birden fazla zayıf öğrencinin sıralı olarak eğitilmesi; dizideki önceki öğrencilerin her yanlış tahminine daha fazla ağırlık verilmesi ve bir sonraki öğrenciye girdi verilmesi, böylece daha güçlü bir öğrenci yaratılması. Örnekler arasında AdaBoost, Gradient Boosting ve XGBoost yer alır.

- sarkık – Tek bir modelin varyansını azaltmak için birden fazla model kullanır. Örnekler arasında Rastgele Orman ve Ekstra Ağaçlar yer alır.

- İstifleme (harmanlama) – Çoğunlukla, her bir tahmincinin tahminlerinin bir araya toplandığı ve tahmini gerçekleştiren son tahminciye girdi olarak kullanıldığı heterojen modelleri kullanır. Bu son tahmincinin eğitim süreci sıklıkla çapraz doğrulamayı kullanır.

Tahminleri, modelin nihai olarak ürettiği tek bir tahminde birleştirmenin birden fazla yöntemi vardır; örneğin, sınıflandırma görevleri için çoğunluk oylamasına dayalı bir tahmin yapmak için birden fazla model kullanan bir oylama yöntemi olan doğrusal öğrenen gibi bir meta-tahmin edici kullanmak, veya regresyon için ortalamayı alan bir topluluk.

XGBoost, CatBoost veya scikit-learn'in rastgele ormanı gibi çeşitli kütüphaneler ve çerçeveler topluluk modellerinin uygulamalarını sağlasa da, bu yazıda kendi modellerinizi getirmeye ve bunları bir yığınlama topluluğu olarak kullanmaya odaklanıyoruz. Ancak, her model için özel kaynaklar kullanmak yerine (özel eğitim ve ayarlama işleri ve model başına uç noktaları barındırma), tek bir SageMaker eğitim işi ve tek bir ayarlama işi kullanarak özel bir topluluğu (birden fazla model) eğitir, ayarlar ve dağıtırız ve Tek bir uç noktaya dağıtın, böylece olası maliyeti ve operasyonel yükü azaltın.

BYOE: Kendi takımınızı getirin

SageMaker ile heterojen topluluk modellerini eğitmenin ve dağıtmanın birkaç yolu vardır: her modeli ayrı eğitim işi ve her modeli ayrı ayrı optimize ederek Amazon SageMaker Otomatik Model Ayarlama. Bu modelleri barındırırken SageMaker, birden fazla modeli aynı kiracı altyapısında barındırmak için çeşitli uygun maliyetli yollar sunar. Bu tür ayarlara ilişkin ayrıntılı dağıtım modellerini şu adreste bulabilirsiniz: Amazon SageMaker'da model barındırma kalıpları, 1. Bölüm: Amazon SageMaker'da makine öğrenimi uygulamaları oluşturmak için yaygın tasarım kalıpları. Bu modeller, birden fazla uç noktanın (her eğitilmiş model için) veya tek bir uç noktanın kullanılmasını içerir. çok modelli uç nokta, hatta tek bir çok kapsayıcılı uç nokta kapsayıcıların tek tek çağrılabileceği veya bir işlem hattında zincirlenebileceği yer. Tüm bu çözümler bir meta-tahmin edici içerir (örneğin bir AWS Lambda işlevi) her modeli çağırır ve karıştırma veya oylama işlevini uygular.

Ancak birden fazla eğitim işi yürütmek, özellikle de grubunuz aynı veriler üzerinde eğitim gerektiriyorsa operasyonel ve maliyet yükü getirebilir. Benzer şekilde, farklı modelleri ayrı uç noktalarda veya kapsayıcılarda barındırmak ve tahmin sonuçlarını daha iyi doğruluk için birleştirmek, birden fazla çağrı gerektirir ve bu nedenle ek yönetim, maliyet ve izleme çabaları gerektirir. Örneğin, SageMaker şunları destekler: Triton Inference Server'ı kullanarak makine öğrenimi modellerini bir araya getirmeancak bu çözüm, modellerin veya model gruplarının Triton arka ucu tarafından desteklenmesini gerektirir. Ek olarak, müşterinin Triton sunucusunu kurmak için ek çaba göstermesi ve farklı Triton arka uçlarının nasıl çalıştığını anlamak için ek bilgi edinmesi gerekmektedir. Bu nedenle müşteriler, çağrıyı yalnızca bir kez uç noktaya göndermeleri gereken ve nihai çıktıyı oluşturmak için sonuçların nasıl toplandığını kontrol etme esnekliğine sahip oldukları çözümleri uygulamak için daha basit bir yolu tercih ediyor.

Çözüme genel bakış

Bu endişeleri gidermek için, tek bir eğitim işi kullanan, modelin hiper parametrelerini optimize eden ve onu tek bir konteyner kullanarak sunucusuz bir uç noktaya dağıtan bir topluluk eğitimi örneğini inceleyeceğiz. Topluluk yığınımız için iki model kullanıyoruz: CatBoost ve XGBoost (her ikisi de toplulukları güçlendiriyor). Verilerimiz için şunu kullanıyoruz: diyabet veri kümesi [2] scikit-learn kütüphanesinden: 10 özellikten oluşur (yaş, cinsiyet, vücut kütlesi, kan basıncı ve altı kan serumu ölçümü) ve modelimiz, temel özelliklerin toplanmasından 1 yıl sonra hastalığın ilerleyişini tahmin eder (bir regresyon) modeli).

Tam kod deposunu şu adreste bulabilirsiniz: GitHub.

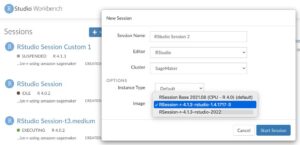

Tek bir SageMaker işinde birden fazla modeli eğitin

Modellerimizi eğitmek için SageMaker eğitim işlerini Komut Dosyası modunda kullanıyoruz. Komut Dosyası moduyla, SageMaker çerçeve kapsayıcılarını kullanırken özel eğitim (ve daha sonra çıkarım kodu) yazabilirsiniz. Çerçeve kapsayıcıları, gerekli tüm yapılandırma ve modülleri içeren, AWS tarafından yönetilen hazır ortamları kullanmanızı sağlar. Bir çerçeve kapsayıcısını nasıl özelleştirebileceğinizi göstermek için örnek olarak, XGBoost ve CatBoost paketlerini içermeyen önceden oluşturulmuş SKLearn kapsayıcısını kullanıyoruz. Bu paketleri eklemek için iki seçenek vardır: ya yerleşik kabı genişlet CatBoost ve XGBoost'u yüklemek (ve ardından özel bir kapsayıcı olarak dağıtmak) veya SageMaker eğitim iş komut dosyası modu özelliğini kullanmak için requirements.txt Eğitim tahmincisini oluştururken dosya. SageMaker eğitim işi, listelenen kütüphaneleri requirements.txt çalışma süresi sırasında dosya. Bu şekilde, kendi Docker görüntü deponuzu yönetmenize gerek kalmaz ve ek Python paketleri gerektiren eğitim komut dosyalarını çalıştırma konusunda daha fazla esneklik sağlar.

Aşağıdaki kod bloğu eğitime başlamak için kullandığımız kodu göstermektedir. entry_point parametresi eğitim senaryomuzu işaret ediyor. Ayrıca SageMaker SDK API'sinin ilgi çekici özelliklerinden ikisini de kullanıyoruz:

- Öncelikle kaynak dizinimizin yerel yolunu ve bağımlılıklarını belirtiyoruz.

source_dirvedependenciessırasıyla parametreler. SDK bu dizinleri sıkıştıracak ve yükleyecektir. Amazon Basit Depolama Hizmeti (Amazon S3) ve SageMaker bunları çalışma dizini altındaki eğitim örneğinde kullanıma sunacak/opt/ml/code. - İkincisi, SDK'yı kullanıyoruz

SKLearnTahminci nesnesini tercih ettiğimiz Python ve çerçeve sürümüyle eşleştireceğiz, böylece SageMaker ilgili kabı çekecektir. Ayrıca özel bir eğitim metriği de tanımladık 'validation:rmse', eğitim günlüklerinde yayınlanacak ve SageMaker tarafından yakalanacak. Daha sonra bu metriği ayar işinde objektif metrik olarak kullanırız.

hyperparameters = {"num_round": 6, "max_depth": 5}

estimator_parameters = {

"entry_point": "multi_model_hpo.py",

"source_dir": "code",

"dependencies": ["my_custom_library"],

"instance_type": training_instance_type,

"instance_count": 1,

"hyperparameters": hyperparameters,

"role": role,

"base_job_name": "xgboost-model",

"framework_version": "1.0-1",

"keep_alive_period_in_seconds": 60,

"metric_definitions":[

{'Name': 'validation:rmse', 'Regex': 'validation-rmse:(.*?);'}

]

}

estimator = SKLearn(**estimator_parameters)Daha sonra eğitim senaryomuzu yazıyoruz (multi_model_hpo.py). Senaryomuz basit bir akışı takip ediyor: hiperparametreleri yakala işin yapılandırıldığı ve CatBoost modelini eğitin ve XGBoost modeli. Ayrıca bir uygulama yapıyoruz k-katlı çapraz doğrulama işlevi. Aşağıdaki koda bakın:

if __name__ == "__main__":

parser = argparse.ArgumentParser() # Sagemaker specific arguments. Defaults are set in the environment variables.

parser.add_argument("--output-data-dir", type=str, default=os.environ["SM_OUTPUT_DATA_DIR"])

parser.add_argument("--model-dir", type=str, default=os.environ["SM_MODEL_DIR"])

parser.add_argument("--train", type=str, default=os.environ["SM_CHANNEL_TRAIN"])

parser.add_argument("--validation", type=str, default=os.environ["SM_CHANNEL_VALIDATION"])

.

.

.

"""

Train catboost

"""

K = args.k_fold

catboost_hyperparameters = {

"max_depth": args.max_depth,

"eta": args.eta,

}

rmse_list, model_catboost = cross_validation_catboost(train_df, K, catboost_hyperparameters)

.

.

.

"""

Train the XGBoost model

""" hyperparameters = {

"max_depth": args.max_depth,

"eta": args.eta,

"objective": args.objective,

"num_round": args.num_round,

} rmse_list, model_xgb = cross_validation(train_df, K, hyperparameters)Modeller eğitildikten sonra hem CatBoost hem de XGBoost tahminlerinin ortalamasını hesaplıyoruz. Sonuç, pred_mean, topluluğumuzun son tahminidir. Daha sonra şunları belirliyoruz: mean_squared_error doğrulama kümesine karşı. val_rmse Eğitim sırasında tüm topluluğun değerlendirilmesi için kullanılır. Ayrıca RMSE değerini de kullandığımız normal ifadeye uyan bir düzende yazdırdığımıza dikkat edin. metric_definitions. Daha sonra SageMaker Otomatik Model Ayarlama bunu objektif ölçüyü yakalamak için kullanacaktır. Aşağıdaki koda bakın:

pred_mean = np.mean(np.array([pred_catboost, pred_xgb]), axis=0)

val_rmse = mean_squared_error(y_validation, pred_mean, squared=False)

print(f"Final evaluation result: validation-rmse:{val_rmse}")Son olarak, betiğimiz her iki model yapıtını da şu konumda bulunan çıktı klasörüne kaydeder: /opt/ml/model.

Bir eğitim işi tamamlandığında SageMaker eğitimin içeriğini paketler ve kopyalar. /opt/ml/model dizini sıkıştırılmış TAR formatında tek bir nesne olarak iş yapılandırmasında belirttiğiniz S3 konumuna taşıyın. Bizim durumumuzda SageMaker iki modeli bir TAR dosyasında paketliyor ve eğitim işinin sonunda bunu Amazon S3'e yüklüyor. Aşağıdaki koda bakın:

model_file_name = 'catboost-regressor-model.dump'

# Save CatBoost model

path = os.path.join(args.model_dir, model_file_name)

print('saving model file to {}'.format(path))

model.save_model(path)

.

.

.

# Save XGBoost model

model_location = args.model_dir + "/xgboost-model"

pickle.dump(model, open(model_location, "wb"))

logging.info("Stored trained model at {}".format(model_location))Özetle, bu prosedürde verileri bir kez indirdiğimizi ve tek bir eğitim işi kullanarak iki modeli eğittiğimizi fark etmelisiniz.

Otomatik topluluk modeli ayarı

Bir ML modelleri koleksiyonu oluşturduğumuz için olası tüm hiperparametre permütasyonlarını araştırmak pratik değildir. SageMaker teklifleri Otomatik Model Ayarlama (AMT)Belirttiğiniz aralıklar içindeki en umut verici değer kombinasyonlarına odaklanarak en iyi model hiperparametrelerini arar (keşfedilecek doğru aralıkları tanımlamak size kalmıştır). SageMaker birden fazla optimizasyon yöntemini destekler Sizin için seçilecek.

Optimizasyon sürecinin iki bölümünü tanımlayarak başlıyoruz: ayarlamak istediğimiz hedef metrik ve hiper parametreler. Örneğimizde, hedef metrik olarak RMSE doğrulamasını kullanıyoruz ve eta ve max_depth (diğer hiperparametreler için bkz. XGBoost Hiperparametreleri ve CatBoost hiperparametreleri):

from sagemaker.tuner import (

IntegerParameter,

ContinuousParameter,

HyperparameterTuner,

) hyperparameter_ranges = {

"eta": ContinuousParameter(0.2, 0.3),

"max_depth": IntegerParameter(3, 4)

}

metric_definitions = [{"Name": "validation:rmse", "Regex": "validation-rmse:([0-9.]+)"}]

objective_metric_name = "validation:rmse"Ayrıca şunları sağlamamız gerekir: eğitim senaryosu hiperparametrelerimizin sabit kodlanmadığını ve SageMaker çalışma zamanı argümanlarından alındığını:

catboost_hyperparameters = {

"max_depth": args.max_depth,

"eta": args.eta,

}SageMaker ayrıca hiperparametreleri bir JSON dosyasına yazar ve buradan okunabilir. /opt/ml/input/config/hyperparameters.json eğitim örneğinde.

CatBoost gibi, XGBoost modelinin hiperparametrelerini de yakalıyoruz (dikkat edin ki objective ve num_round ayarlanmamış):

catboost_hyperparameters = {

"max_depth": args.max_depth,

"eta": args.eta,

}Son olarak şu konfigürasyonları kullanarak hiperparametre ayarlama işini başlatıyoruz:

tuner = HyperparameterTuner(

estimator,

objective_metric_name,

hyperparameter_ranges,

max_jobs=4,

max_parallel_jobs=2,

objective_type='Minimize'

)

tuner.fit({"train": train_location, "validation": validation_location}, include_cls_metadata=False)İş tamamlandığında en iyi eğitim işinin değerlerini (minimum RMSE ile) alabilirsiniz:

job_name=tuner.latest_tuning_job.name

attached_tuner = HyperparameterTuner.attach(job_name)

attached_tuner.describe()["BestTrainingJob"]AMT hakkında daha fazla bilgi için bkz. SageMaker ile Otomatik Model Ayarlama Gerçekleştirin.

açılma

Özel topluluğumuzu dağıtmak için, çıkarım isteğini işlemek ve SageMaker barındırmayı yapılandırmak için bir komut dosyası sağlamamız gerekir. Bu örnekte hem eğitim hem de çıkarım kodunu içeren tek bir dosya kullandık (multi_model_hpo.py). SageMaker if altındaki kodu kullanır: _ name _ == "_ main _" eğitim ve işlevler için model_fn, input_fn, ve predict_fn modeli dağıtırken ve sunarken.

çıkarım komut dosyası

Eğitimde olduğu gibi SageMaker SKLearn çerçeve kapsayıcısını kendi çıkarım komut dosyamızla kullanıyoruz. Betik, SageMaker'ın gerektirdiği üç yöntemi uygulayacaktır.

İlk olarak, model_fn yöntem kayıtlı model yapıt dosyalarımızı okur ve bunları belleğe yükler. Bizim durumumuzda, yöntem topluluğumuzu şu şekilde döndürür: all_model, bu bir Python listesidir, ancak model adlarına sahip bir sözlüğü de anahtar olarak kullanabilirsiniz.

def model_fn(model_dir):

catboost_model = CatBoostRegressor()

catboost_model.load_model(os.path.join(model_dir, model_file_name))

model_file = "xgboost-model"

model = pickle.load(open(os.path.join(model_dir, model_file), "rb"))

all_model = [catboost_model, model]

return all_modelİkinci olarak, input_fn yöntem, çıkarım işleyicimize aktarılacak istek giriş verilerinin seri durumdan çıkarılmasını sağlar. Giriş işleyicileri hakkında daha fazla bilgi için bkz. Kendi Çıkarım Kapsayıcınızı Uyarlama.

def input_fn(input_data, content_type):

dtype=None

payload = StringIO(input_data)

return np.genfromtxt(payload, dtype=dtype, delimiter=",")Üçüncü olarak, predict_fn Yöntem, modellerden tahminlerin alınmasından sorumludur. Yöntem, modeli ve döndürülen verileri alır. input_fn parametre olarak kullanır ve son tahmini döndürür. Örneğimizde CatBoost sonucunu model listesinin ilk üyesinden alıyoruz (model[0]) ve ikinci üyeden gelen XGBoost (model[1]) ve her iki tahminin ortalamasını döndüren bir karıştırma işlevi kullanıyoruz:

def predict_fn(input_data, model):

predictions_catb = model[0].predict(input_data)

dtest = xgb.DMatrix(input_data)

predictions_xgb = model[1].predict(dtest,

ntree_limit=getattr(model, "best_ntree_limit", 0),

validate_features=False)

return np.mean(np.array([predictions_catb, predictions_xgb]), axis=0)Artık eğitilmiş modellerimiz ve çıkarım komut dosyamız olduğuna göre, topluluğumuzu dağıtmak için ortamı yapılandırabiliriz.

SageMaker Sunucusuz Çıkarım

Olmasına rağmen SageMaker'da birçok barındırma seçeneğiBu örnekte sunucusuz bir uç nokta kullanıyoruz. Sunucusuz uç noktalar, bilgi işlem kaynaklarını otomatik olarak başlatır ve trafiğe bağlı olarak bunların ölçeğini genişletip genişletir. Bu, sunucu yönetiminin farklılaşmamış ağır yükünü ortadan kaldırır. Bu seçenek, trafik artışları arasında boşta kalan ve soğuk başlatmaları tolere edebilen iş yükleri için idealdir.

Sunucusuz uç noktayı yapılandırmak kolaydır çünkü örnek türlerini seçmemize veya ölçeklendirme ilkelerini yönetmemize gerek yoktur. Yalnızca iki parametre sağlamamız gerekiyor: bellek boyutu ve maksimum eşzamanlılık. Sunucusuz uç nokta, işlem kaynaklarını seçtiğiniz belleğe orantılı olarak otomatik olarak atar. Daha büyük bir bellek boyutu seçerseniz kapsayıcınız daha fazla vCPU'ya erişebilir. Uç noktanızın bellek boyutunu her zaman model boyutunuza göre seçmelisiniz. Sağlamamız gereken ikinci parametre maksimum eşzamanlılıktır. Tek bir uç nokta için bu parametre 200'e kadar ayarlanabilir (bu yazının yazıldığı an itibariyle, bir Bölgedeki sunucusuz uç noktaların toplam sayısı için sınır 50'dir). Bireysel bir uç nokta için maksimum eş zamanlılığın, bu uç noktanın hesabınız için izin verilen tüm çağrıları almasını engellediğini unutmayın; çünkü maksimum değerin üzerindeki tüm uç nokta çağrıları kısıtlanır (Bölge başına tüm sunucusuz uç noktalar için toplam eşzamanlılık hakkında daha fazla bilgi için bkz. ile Amazon SageMaker uç noktaları ve kotaları).

from sagemaker.serverless.serverless_inference_config import ServerlessInferenceConfig

serverless_config = ServerlessInferenceConfig(

memory_size_in_mb=6144,

max_concurrency=1,

) Artık uç noktayı yapılandırdığımıza göre, sonunda hiperparametre optimizasyonu işimizde seçilen modeli konuşlandırabiliriz:

estimator=attached_tuner.best_estimator()

predictor = estimator.deploy(serverless_inference_config=serverless_config)Temizlemek

Sunucusuz uç noktaların kullanılmadığında maliyeti sıfır olsa da bu örneği çalıştırmayı tamamladığınızda uç noktayı sildiğinizden emin olmalısınız:

predictor.delete_endpoint(predictor.endpoint)Sonuç

Bu yazıda özel bir topluluğu eğitmek, optimize etmek ve dağıtmak için bir yaklaşımı ele aldık. Birden çok modeli eğitmek için tek bir eğitim işi kullanma sürecini, topluluk hiperparametrelerini optimize etmek için otomatik model ayarlamanın nasıl kullanılacağını ve birden çok modelden elde edilen çıkarımları harmanlayan tek bir sunucusuz uç noktanın nasıl dağıtılacağını ayrıntılı olarak anlattık.

Bu yöntemin kullanılması potansiyel maliyet ve operasyonel sorunları çözer. Bir eğitim işinin maliyeti, kullanım süresi boyunca kullandığınız kaynaklara bağlıdır. İki modeli eğitmek için verileri yalnızca bir kez indirerek işin veri indirme aşamasını ve verileri depolayan kullanılan hacmi yarı yarıya azalttık, böylece eğitim işinin genel maliyetini düşürdük. Ayrıca, AMT işi, her biri yukarıda belirtilen süre ve depolamayı azaltan dört eğitim işi yürüttü; bu da 4 kat maliyet tasarrufu anlamına geliyor! Sunucusuz bir uç noktada model dağıtımıyla ilgili olarak, işlenen veri miktarı için de ödeme yaptığınızdan, uç noktayı iki model için yalnızca bir kez çağırdığınızda, G/Ç veri ücretlerinin yarısını ödersiniz.

Her ne kadar bu gönderi yalnızca iki modelin avantajlarını gösterse de, daha da büyük bir etki görmek için bu yöntemi çok sayıda topluluk modelini eğitmek, ayarlamak ve dağıtmak için kullanabilirsiniz.

Referanslar

[1] Raj Kumar, P. Arun; Selvakumar, S. (2011). “Bir sinir sınıflandırıcı topluluğu kullanılarak dağıtılmış hizmet reddi saldırısı tespiti”. Bilgisayar İletişimi. 34 (11): 1328–1341. doi:10.1016/j.comcom.2011.01.012.

[2] Bradley Efron, Trevor Hastie, Iain Johnstone ve Robert Tibshirani (2004) “Least Angle Regression,” Annals of İstatistik (tartışmalı), 407-499. (https://web.stanford.edu/~hastie/Papers/LARS/LeastAngle_2002.pdf)

Yazarlar Hakkında

Melanie Li, Doktora, Sidney, Avustralya merkezli AWS'de Kıdemli AI/ML Uzmanı TAM'dir. Kurumsal müşterilerin AWS'deki son teknoloji AI/ML araçlarından yararlanan çözümler oluşturmasına yardımcı olur ve en iyi uygulamalarla makine öğrenimi çözümlerini tasarlama ve uygulama konusunda rehberlik sağlar. Boş zamanlarında açık havada doğayı keşfetmeyi ve ailesi ve arkadaşlarıyla vakit geçirmeyi seviyor.

Melanie Li, Doktora, Sidney, Avustralya merkezli AWS'de Kıdemli AI/ML Uzmanı TAM'dir. Kurumsal müşterilerin AWS'deki son teknoloji AI/ML araçlarından yararlanan çözümler oluşturmasına yardımcı olur ve en iyi uygulamalarla makine öğrenimi çözümlerini tasarlama ve uygulama konusunda rehberlik sağlar. Boş zamanlarında açık havada doğayı keşfetmeyi ve ailesi ve arkadaşlarıyla vakit geçirmeyi seviyor.

Uri Rosenberg Avrupa, Orta Doğu ve Afrika'nın Yapay Zeka ve Öğrenim Uzmanı Teknik Müdürüdür. Merkezi İsrail'de bulunan Uri, kurumsal müşterilerin makine öğrenimi iş yüklerini geniş ölçekte tasarlamasına, oluşturmasına ve çalıştırmasına olanak sağlamak için çalışıyor. Boş zamanlarında bisiklete binmeyi, yürüyüş yapmayı ve RMSE'leri en aza indirmeyi seviyor.

Uri Rosenberg Avrupa, Orta Doğu ve Afrika'nın Yapay Zeka ve Öğrenim Uzmanı Teknik Müdürüdür. Merkezi İsrail'de bulunan Uri, kurumsal müşterilerin makine öğrenimi iş yüklerini geniş ölçekte tasarlamasına, oluşturmasına ve çalıştırmasına olanak sağlamak için çalışıyor. Boş zamanlarında bisiklete binmeyi, yürüyüş yapmayı ve RMSE'leri en aza indirmeyi seviyor.

- SEO Destekli İçerik ve Halkla İlişkiler Dağıtımı. Bugün Gücünüzü Artırın.

- PlatoData.Network Dikey Üretken Yapay Zeka. Kendine güç ver. Buradan Erişin.

- PlatoAiStream. Web3 Zekası. Bilgi Genişletildi. Buradan Erişin.

- PlatoESG. Otomotiv / EV'ler, karbon, temiz teknoloji, Enerji, Çevre, Güneş, Atık Yönetimi. Buradan Erişin.

- Blok Ofsetleri. Çevre Dengeleme Sahipliğini Modernleştirme. Buradan Erişin.

- Kaynak: https://aws.amazon.com/blogs/machine-learning/efficiently-train-tune-and-deploy-custom-ensembles-using-amazon-sagemaker/

- :vardır

- :dır-dir

- :olumsuzluk

- :Neresi

- ][P

- $UP

- 1

- 10

- 100

- 11

- 200

- 2011

- 50

- 60

- 7

- a

- Hakkımızda

- erişim

- Göre

- Hesap

- doğruluk

- doğru

- eklemek

- Ek

- Ayrıca

- adres

- Afrika

- Sonra

- karşı

- yaş

- AI

- AI / ML

- algoritma

- algoritmalar

- Türkiye

- izin

- veriyor

- Ayrıca

- her zaman

- Amazon

- Amazon Adaçayı Yapıcı

- Amazon Web Servisleri

- arasında

- miktar

- an

- ve

- herhangi

- uygulamaları

- yaklaşım

- ARE

- argümanlar

- AS

- At

- saldırı

- Avustralya

- Otomatik

- otomatik olarak

- mevcut

- ortalama

- uzakta

- AWS

- Backend

- merkezli

- Temel

- BE

- Çünkü

- müşterimiz

- olmuştur

- olmak

- faydalı

- faydaları

- İYİ

- en iyi uygulamalar

- Daha iyi

- arasında

- Ötesinde

- karıştırma

- karışımları

- Engellemek

- kan

- Kan basıncı

- vücut

- artırılması

- her ikisi de

- getirmek

- Bringing

- inşa etmek

- bina

- yerleşik

- Paketler

- fakat

- by

- hesaplamak

- CAN

- ele geçirmek

- Yakalanan

- dava

- kategoriler

- zincirleme

- yükler

- Klinik

- sınıflandırma

- kod

- soğuk

- Toplamak

- kombinasyonları

- birleştirme

- ortak

- İletişim

- topluluk

- zorlayıcı

- tamamlamak

- hesaplamak

- bilgisayar

- Bilgisayar görüşü

- Endişeler

- yapılandırma

- yapılandırılmış

- oluşur

- Konteyner

- Konteynerler

- içerik

- kontrol

- uyan

- Ücret

- uygun maliyetli

- kaplı

- Oluşturma

- görenek

- müşteri

- Müşteriler

- özelleştirmek

- Siber güvenlik

- veri

- Karar verme

- adanmış

- varsayılan

- tanımlamak

- tanımlı

- tanımlarken

- göstermek

- Hizmet Reddi

- bağlı

- dağıtmak

- dağıtma

- açılma

- Dizayn

- tasarım desenleri

- detaylı

- Bulma

- Belirlemek

- farklı

- dizinleri

- tartışmak

- tartışma

- Hastalık

- çeşitli

- liman işçisi

- Değil

- Dont

- indir

- dökmek

- süre

- sırasında

- her

- Doğu

- Efekt

- verimli

- verimli biçimde

- çabaları

- ya

- çıkmak

- güçlendirmek

- etkinleştirmek

- son

- Son nokta

- sağlamak

- kuruluş

- çevre

- ortamları

- özellikle

- AVRUPA

- değerlendirme

- Hatta

- gelişti

- örnek

- örnekler

- keşfetmek

- Keşfetmek

- ekstra

- aile

- Özellikler(Hazırlık aşamasında)

- Özellikler

- fileto

- dosyalar

- son

- Nihayet

- mali

- Ad

- Esneklik

- akış

- odak

- odaklanma

- takip etme

- şu

- İçin

- orman

- biçim

- bulundu

- dört

- iskelet

- çerçeveler

- dolandırıcılık

- sahtekarlık tespiti

- arkadaşlar

- itibaren

- tam

- işlev

- fonksiyonlar

- Ayrıca

- Kazanç

- kazanma

- oluşturmak

- almak

- alma

- verilmiş

- büyük

- rehberlik

- Yarım

- sap

- Kolları

- Var

- he

- ağır

- ağırlık kaldırma

- yardımcı olur

- onu

- daha yüksek

- onun

- ev sahibi

- hosting

- Ne kadar

- Nasıl Yapılır

- Ancak

- HTML

- http

- HTTPS

- Hiperparametre optimizasyonu

- Hiperparametre Ayarı

- ideal

- boş

- if

- görüntü

- uygulamak

- uygulanması

- uygular

- önemli

- in

- dahil

- içerir

- bireysel

- Bireysel olarak

- bilgi

- Altyapı

- giriş

- kurmak

- örnek

- yerine

- İstihbarat

- içine

- tanıtmak

- Tanıtımlar

- çağrılan

- çağırır

- Israil

- sorunlar

- IT

- İş

- Mesleki Öğretiler

- jpg

- json

- anahtarlar

- Nezaket.

- bilinen

- dil

- büyük

- sonra

- başlatmak

- öğrenme

- kaldıraç

- Li

- kütüphaneler

- Kütüphane

- kaldırma

- LİMİT

- Liste

- Listelenmiş

- yükler

- yerel

- bulunan

- yer

- günlüğü

- GÖRÜNÜYOR

- seviyor

- makine

- makine öğrenme

- Ana

- çoğunluk

- yapmak

- yönetmek

- yönetilen

- yönetim

- müdür

- yönetme

- Kitle

- maksimum

- ortalama

- ölçümler

- tıbbi

- üye

- Bellek

- gitmek

- yöntem

- yöntemleri

- metrik

- Orta

- Orta Doğu

- olabilir

- en az

- minimize

- ML

- Moda

- model

- modelleri

- Modüller

- izleme

- Daha

- çoğu

- çoklu

- isim

- isimleri

- Doğal (Madenden)

- Doğal Dil İşleme

- Tabiat

- gerekli

- gerek

- sonraki

- nlp

- Fark etme..

- numara

- sayısız

- nesne

- nesnel

- of

- Teklifler

- sık sık

- on

- bir Zamanlar

- ONE

- bir tek

- işletmek

- işletme

- optimizasyon

- optimize

- optimize

- seçenek

- Opsiyonlar

- or

- OS

- Diğer

- bizim

- dışarı

- açık havada

- çıktı

- tüm

- kendi

- paketler

- parametre

- parametreler

- Bölüm

- parçalar

- geçti

- yol

- model

- desen

- başına

- dönemleri

- faz

- boru hattı

- Platon

- Plato Veri Zekası

- PlatoVeri

- noktaları

- politikaları

- Popüler

- mümkün

- Çivi

- potansiyel

- uygulamalar

- tahmin

- tahmin

- Tahminler

- Predictor

- öngörür

- tercih

- tercihli

- basınç

- önler

- önceki

- prosedür

- süreç

- İşlenmiş

- işleme

- üretmek

- ilerleme

- umut verici

- kanıtlanmış

- sağlamak

- sağlar

- Python

- rasgele

- hızla

- Okumak

- azaltmak

- Indirimli

- azaltarak

- ifade eder

- saymak

- regex

- bölge

- uzak

- Depo

- temsil etmek

- talep

- gereklidir

- gerektirir

- Kaynaklar

- sırasıyla

- sorumlu

- sonuç

- Sonuçlar

- dönüş

- İade

- krallar gibi yaşamaya

- ROBERT

- Rol

- koşmak

- koşu

- s

- sagemaker

- SageMaker Otomatik Model Ayarlama

- aynı

- İndirim

- tasarruf

- ölçek

- ölçekleme

- bilim adamları

- scikit-öğrenme

- scriptler

- sdk

- İkinci

- görmek

- görüldü

- seçilmiş

- göndermek

- kıdemli

- ayrı

- Dizi

- Serum

- Serverless

- Sunucular

- hizmet

- Hizmetler

- servis

- set

- ayarlar

- birkaç

- Seks

- o

- meli

- gösterdi

- Gösteriler

- benzer şekilde

- Basit

- tek

- ALTINCI

- beden

- So

- çözüm

- Çözümler

- çözer

- Kaynak

- uzman

- özel

- Belirtilen

- geçirmek

- yığın

- yığılmış

- istif

- stanford

- başlama

- başlar

- state-of-the-art

- istatistik

- Basamaklar

- hafızası

- saklı

- mağaza

- basit

- güçlü

- böyle

- ÖZET

- destekli

- Destekler

- elbette

- sydney

- alır

- alma

- Hedef

- görevleri

- Teknik

- teknikleri

- Teknoloji

- kiracı

- göre

- o

- The

- ve bazı Asya

- Onları

- sonra

- Orada.

- böylece

- bu nedenle

- Bunlar

- onlar

- Re-Tweet

- Bu

- gerçi?

- üç

- İçinden

- zaman

- zamanlar

- için

- birlikte

- araçlar

- konu

- Toplam

- çekiş

- trafik

- Tren

- eğitilmiş

- Eğitim

- Ağaçlar

- Trevor

- Triton

- iki

- türleri

- altında

- anlamak

- kullanım

- kullanım

- Kullanılmış

- kullanım

- kullanma

- onaylama

- değer

- Değerler

- çeşitli

- versiyon

- vizyonumuz

- hacim

- oylama

- istemek

- oldu

- Yol..

- yolları

- we

- ağ

- web hizmetleri

- ağırlık

- vardı

- Ne

- ne zaman

- hangi

- süre

- bütün

- neden

- irade

- ile

- içinde

- İş

- çalışma

- çalışır

- yazmak

- yazı yazıyor

- XGBoost

- yıl

- Sen

- zefirnet

- sıfır