Dil modelleri, doğal metin kullanarak dizilerdeki belirteçlerin ardışıklığını tahmin eden istatistiksel yöntemlerdir. Büyük dil modelleri (LLM'ler), yüz milyonlarca (LLM) ile sinir ağı tabanlı dil modelleridir.Bert) bir trilyondan fazla parametreye (Mikrofonlar) ve boyutu, tek GPU eğitimini pratik yapmaz. LLM'lerin üretken yetenekleri, onları metin sentezi, özetleme, makine çevirisi ve daha fazlası için popüler kılar.

Bir LLM'nin boyutu ve eğitim verileri, iki ucu keskin bir kılıçtır: modelleme kalitesi getirir, ancak altyapı zorlukları gerektirir. Modelin kendisi genellikle tek bir GPU aygıtının belleğine veya bir çoklu GPU örneğinin birden çok aygıtına sığamayacak kadar büyüktür. Bu faktörler, hızlandırılmış makine öğrenimi (ML) örneklerinin büyük kümeleri üzerinde bir LLM eğitimi gerektirir. Son birkaç yıldır çok sayıda müşteri AWS Cloud for LLM eğitimini kullanıyor.

Bu yazıda, başarılı LLM eğitimi için ipuçlarına ve en iyi uygulamalara değineceğiz. Amazon SageMaker Eğitimi. SageMaker Eğitimi, altyapıyı yönetmeye gerek kalmadan modelleri büyük ölçekte eğitmek ve ayarlamak için harcanan zamanı ve maliyeti azaltan, yönetilen bir toplu makine öğrenimi bilgi işlem hizmetidir. Bir başlatma komutunda, Amazon Adaçayı Yapıcı metastore, yönetilen G/Ç ve dağıtım gibi gelişmiş makine öğrenimi özellikleriyle, seçtiğiniz görevi çalıştıran tamamen işlevsel, kısa ömürlü bir bilgi işlem kümesi başlatır. Gönderi, bir LLM eğitim iş yükünün tüm aşamalarını kapsar ve ilgili altyapı özelliklerini ve en iyi uygulamaları açıklar. Bu gönderideki en iyi uygulamalardan bazıları özellikle ml.p4d.24xlarge bulut sunucularıyla ilgilidir, ancak çoğu her bulut sunucusu türü için geçerlidir. Bu en iyi uygulamalar, SageMaker'da LLM'leri düzinelerce ila yüz milyonlarca parametre ölçeğinde eğitmenize olanak tanır.

Bu yazının kapsamı ile ilgili olarak, aşağıdakilere dikkat edin:

- Sinir ağı bilimsel tasarımını ve ilgili optimizasyonları kapsamıyoruz. Amazon.Bilim dahil ve bunlarla sınırlı olmamak üzere çok sayıda bilimsel yayına sahiptir. LLM'ler.

- Bu gönderi LLM'lere odaklansa da, en iyi uygulamalarının çoğu, bilgisayar görüşü ve Kararlı Difüzyon gibi çok modlu modeller dahil olmak üzere her türlü büyük model eğitimi ile ilgilidir.

En iyi uygulamalar

Bu gönderide aşağıdaki en iyi uygulamaları tartışıyoruz:

- hesaplamak – SageMaker Eğitimi, CPU veri seti hazırlama işlerini ve bin ölçekli GPU işlerini başlatmak için harika bir API'dir.

- Depolama – Becerilere ve tercihlere bağlı olarak veri yükleme ve kontrol noktası oluşturmanın iki şekilde yapıldığını görüyoruz: Amazon FSx Parlaklığı dosya sistemi veya Amazon Basit Depolama Hizmeti (Amazon S3) yalnızca.

- paralellik – Dağıtılmış eğitim kitaplığı seçiminiz, GPU'ların uygun kullanımı için çok önemlidir. SageMaker parçalı veri paralelliği gibi bulut için optimize edilmiş bir kitaplık kullanmanızı öneririz, ancak kendi kendini yöneten ve açık kaynaklı kitaplıklar da çalışabilir.

- Ağ – Hızlı makineler arası iletişim için EFA ve NVIDIA GPUDirectRDMA'nın etkinleştirildiğinden emin olun.

- Esneklik – Ölçekte, donanım arızaları meydana gelebilir. Kontrol noktalarını düzenli olarak kontrol etmenizi öneririz. Her birkaç saatte bir yaygındır.

Bölge seçimi

Kurulum tipi ve istenen kapasite, Bölge seçimi için belirleyici bir faktördür. SageMaker tarafından desteklenen Bölgeler ve Amazon Elastik Bilgi İşlem Bulutu Her Bölgede kullanılabilen bulut sunucusu türleri (Amazon EC2) için bkz. Amazon SageMaker Fiyatlandırması. Bu gönderide, eğitim bulut sunucusu türünün SageMaker tarafından yönetilen bir ml.p4d.24xlarge olduğunu varsayıyoruz.

AWS hesap ekibinizle çalışmanızı veya iletişime geçmenizi öneririz. AWS Satışları LLM iş yükünüz için uygun Bölgeyi belirlemek için.

Veri Hazırlama

LLM geliştiricileri, modellerini doğal olarak oluşan metinden oluşan büyük veri kümeleri üzerinde eğitirler. Bu tür veri kaynaklarının popüler örnekleri şunları içerir: Ortak Tarama ve Yığın. Doğal olarak oluşan metin önyargılar, yanlışlıklar, gramer hataları ve sözdizimi varyasyonları içerebilir. Bir LLM'nin nihai kalitesi, önemli ölçüde eğitim verilerinin seçimine ve iyileştirilmesine bağlıdır. LLM eğitim verisi hazırlığı, LLM endüstrisinde aktif bir araştırma ve yenilik alanıdır. Bir doğal dil işleme (NLP) veri setinin hazırlanması, hiçbir şeyi paylaşma paralellik fırsatlarıyla doludur. Başka bir deyişle, çalışanlar arası senkronizasyon gerektirmeden kaynak dosyalar, paragraflar, cümleler, kelimeler gibi iş birimlerine uygulanabilecek adımlar vardır.

SageMaker işleri API'leri, yani SageMaker Eğitimi ve SageMaker İşleme, bu tür görevler için mükemmeldir. Geliştiricilerin birden çok makineden oluşan bir filo üzerinde rastgele bir Docker kapsayıcısı çalıştırmasını sağlarlar. SageMaker Training API durumunda, bilgi işlem filosu şu şekilde olabilir: heterojen. SageMaker'da çok sayıda dağıtılmış bilgi işlem çerçevesi kullanılmıştır. dask, ışın, ve ayrıca PyKıvılcım, özel bir AWS tarafından yönetilen kapsayıcı ve SDK SageMaker İşleme'de.

Birden çok makineyle bir iş başlattığınızda, SageMaker Training and Processing kodunuzu makine başına bir kez çalıştırır. Dağıtılmış bir uygulama yazmak için belirli bir dağıtılmış bilgi işlem çerçevesi kullanmanıza gerek yoktur: hiçbir şey paylaşma paralelliğini gerçekleştirmek için makine başına bir kez çalışacak olan istediğiniz kodu yazabilirsiniz. Dilerseniz düğümler arası iletişim mantığını da yazabilir veya kurabilirsiniz.

Veri yükleme

Eğitim verilerini depolamanın ve kendi deposundan hızlandırılmış bilgi işlem düğümlerine taşımanın birden çok yolu vardır. Bu bölümde, veri yükleme için seçenekleri ve en iyi uygulamaları ele alıyoruz.

SageMaker depolama ve yükleme seçenekleri

Tipik bir LLM veri kümesi boyutu, birkaç yüz gigabaytı temsil eden yüz milyonlarca metin simgesidir. SageMaker tarafından yönetilen ml.p4d.24xlarge bulut sunucusu kümeleri, veri kümesi depolama ve yükleme için çeşitli seçenekler sunar:

- Düğüm üzerinde NVMe SSD – ml.P4d.24xlarge bulut sunucuları, altında sunulan 8 TB NVMe ile donatılmıştır

/opt/ml/input/data/<channel>Eğer kullanırsan SageMaker Dosya moduVe en/tmp. Yerel bir okumanın basitliğini ve performansını arıyorsanız, verilerinizi NVMe SSD'ye kopyalayabilirsiniz. Kopyalama, SageMaker Dosya moduyla veya kendi kodunuzla, örneğin çoklu işlem kullanılarak yapılabilir. Boto3 or S5cmd. - Parlaklık için FSx – Düğüm üzeri NVMe SSD'lerin boyutu sınırlıdır ve her işte veya sıcak küme oluşturmada Amazon S3'ten alım gerektirir. Düşük gecikme süreli rasgele erişimi sürdürürken daha büyük veri kümelerine ölçeklendirmek istiyorsanız, Lustre için FSx'i kullanabilirsiniz. Amazon FSx, yüksek performanslı bilgi işlemde (HPC) popüler olan açık kaynaklı bir paralel dosya sistemidir. Luster kullanımları için FSx dağıtılmış dosya depolama (sıyırma) ve yüksek performanslı okuma/yazma işlemleri elde etmek için dosya meta verilerini dosya içeriğinden fiziksel olarak ayırır.

- SageMaker FastFile Modu – FastFile Modu (FFM), POSIX uyumlu bir arayüz altında SageMaker tarafından yönetilen bilgi işlem anlarında uzak S3 nesneleri sunan ve FUSE kullanarak bunları yalnızca okuduktan sonra aktaran, yalnızca SageMaker'a özel bir özelliktir. FFM, uzak dosyaları blok blok aktaran S3 çağrılarındaki sonuçları okur. Amazon S3 trafiğiyle ilgili hatalardan kaçınmak için en iyi uygulama olarak FFM geliştiricileri, örneğin dosyaları sırayla ve kontrollü bir paralellik miktarıyla okuyarak temel S3 çağrı sayısını makul tutmayı hedeflemelidir.

- Kendi kendine yönetilen veri yükleme – Elbette, tescilli veya açık kaynak kodunu kullanarak kendi tamamen özel veri yükleme mantığınızı uygulamaya da karar verebilirsiniz. Kendi kendini yöneten veri yüklemeyi kullanmanın bazı nedenleri, önceden geliştirilmiş kodu yeniden kullanarak geçişi kolaylaştırmak, özel hata işleme mantığını uygulamak veya temel performans ve parçalama üzerinde daha fazla kontrole sahip olmaktır. Kendi kendini yöneten veri yükleme için kullanabileceğiniz kitaplık örnekleri şunları içerir: Torchdata.datapipes (Önceden AWS PyTorch S3 Eklentisi) Ve Web veri kümesi. AWS Python SDK'sı Boto3 ile de birleştirilebilir Torç Veri Kümesi özel veri yükleme kodu oluşturmak için sınıflar. Özel veri yükleme sınıfları, CPU ve GPU dengesini belirli bir iş yüküne hassas şekilde uyarlamak için SageMaker Training heterojen kümelerinin yaratıcı kullanımına da olanak tanır.

Bu seçenekler ve bunların nasıl seçileceği hakkında daha fazla bilgi için bkz. Amazon SageMaker eğitim işiniz için en iyi veri kaynağını seçin.

Amazon S3 ile büyük ölçekli etkileşim için en iyi uygulamalar

Amazon S3, hem veri okuma hem de kontrol noktası oluşturma için LLM iş yüklerini yönetebilir. bir destekler istek oranı bir gruptaki önek başına saniyede 3,500 PUT/COPY/POST/DELETE veya 5,500 GET/HEAD isteği. Ancak, bu oran mutlaka varsayılan olarak mevcut değildir. Bunun yerine, bir önek için talep oranı arttıkça Amazon S3, artan oranı karşılamak için otomatik olarak ölçeklenir. Daha fazla bilgi için bkz. İstekler önek başına desteklenen istek oranı dahilindeyken neden Amazon S503'ten 3 Yavaşlama hatası alıyorum?.

Yüksek sıklıkta Amazon S3 etkileşimi bekliyorsanız aşağıdaki en iyi uygulamaları öneririz:

- Birden fazla S3 klasöründen okumaya ve yazmaya çalışın ve önek. Örneğin, eğitim verilerini ve kontrol noktalarını farklı önekler arasında bölümlendirebilirsiniz.

- Şuradaki Amazon S3 ölçümlerini kontrol edin: Amazon Bulut İzleme istek oranlarını takip etmek için.

- Eşzamanlı PUT/GET miktarını en aza indirmeye çalışın:

- Amazon S3'ü aynı anda kullanarak daha az işleme sahip olun. Örneğin, düğüm başına sekiz işlemin kontrol noktasından Amazon S3'e geçmesi gerekiyorsa hiyerarşik olarak kontrol noktası oluşturarak PUT trafiğini 8 kat azaltabilirsiniz: önce düğüm içinde, ardından düğümden Amazon S3'e.

- Her eğitim kaydı için bir S3 GET kullanmak yerine, tek bir dosyadan veya S3 GET'ten birden çok eğitim kaydını okuyun.

- Amazon S3'ü SageMaker FFM aracılığıyla kullanıyorsanız SageMaker FFM, dosyaları parça parça getirmek için S3 çağrıları yapar. FFM tarafından oluşturulan Amazon S3 trafiğini sınırlamak için dosyaları sırayla okumanızı ve paralel olarak açılan dosya sayısını sınırlamanızı öneririz.

Bir varsa Geliştirici, İşletme veya Kurumsal Destek planı, S3 503 Yavaşlama hataları ile ilgili teknik destek talebi açabilirsiniz. Ancak önce en iyi uygulamaları takip ettiğinizden emin olun ve istek kimliklerini al başarısız istekler için

Eğitim paralelliği

LLM'ler genellikle düzinelerce ila yüz milyarlarca parametreye sahiptir ve bu da onları tek bir NVIDIA GPU kartına sığmayacak kadar büyük yapar. LLM uygulayıcıları, aşağıdakiler de dahil olmak üzere LLM eğitiminin dağıtılmış hesaplamasını kolaylaştıran birkaç açık kaynak kitaplığı geliştirdiler. FSDP, Derin Hız ve Megatron. Bu kitaplıkları SageMaker Training'de çalıştırabilirsiniz, ancak AWS Cloud için optimize edilmiş ve daha basit bir geliştirici deneyimi sağlayan SageMaker dağıtılmış eğitim kitaplıklarını da kullanabilirsiniz. Geliştiricilerin LLM'lerinin SageMaker'da dağıtılmış eğitimi için iki seçeneği vardır: dağıtılmış kitaplıklar veya kendi kendine yönetilen.

SageMaker dağıtılmış kitaplıklar

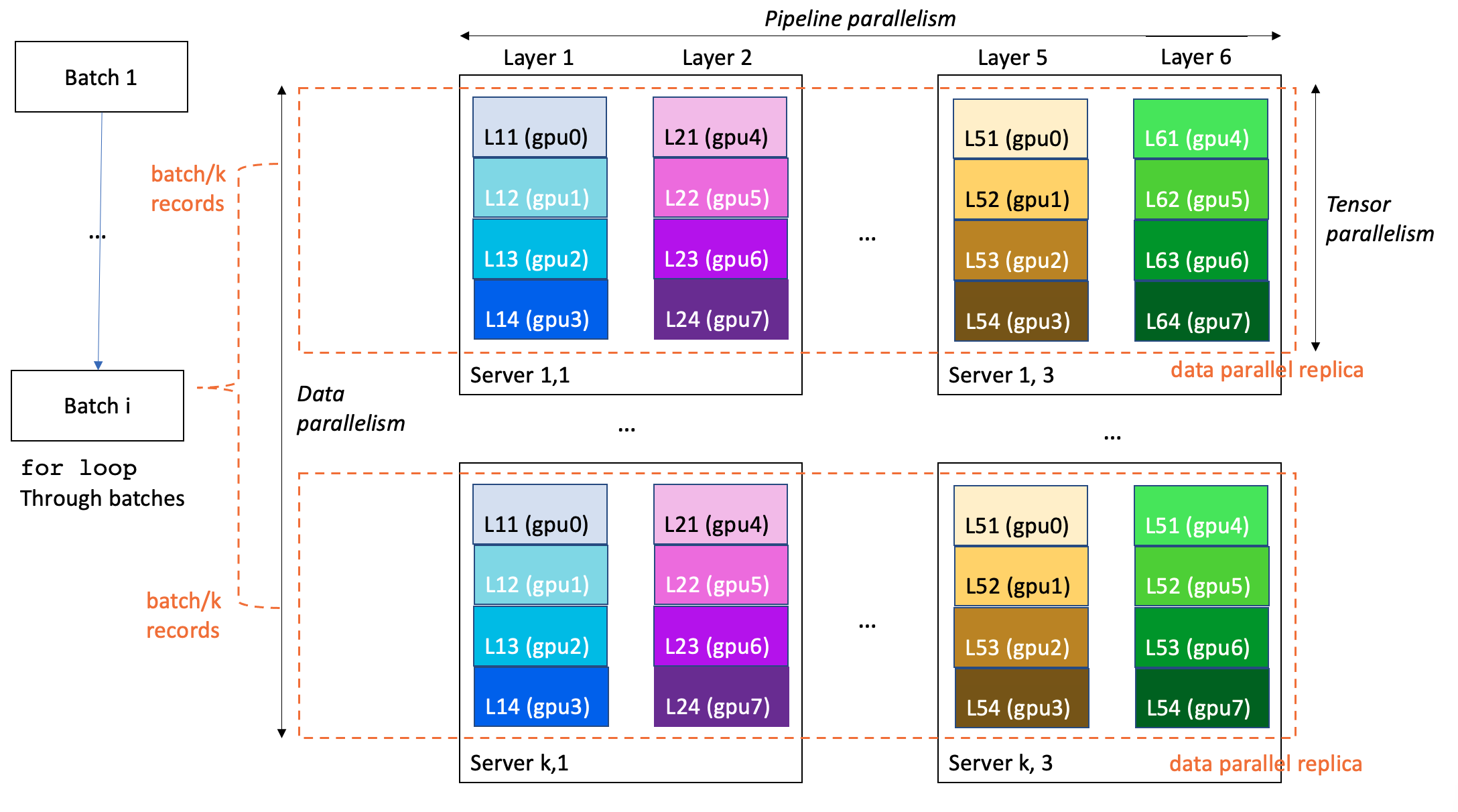

Size gelişmiş dağıtılmış eğitim performansı ve kullanılabilirlik sağlamak için SageMaker Training, TensorFlow ve PyTorch eğitim kodunu ölçeklendirmek için çeşitli tescilli uzantılar önerir. LLM eğitimi genellikle 3D paralellik tarzında yürütülür:

- Veri paralelliği İşleme hızını artırmak için eğitim mini partilerini böler ve modelin birden çok özdeş kopyasına besler

- Boru hattı paralelliği model boyutunu tek bir GPU ve tek bir sunucunun ötesinde ölçeklendirmek için modelin çeşitli katmanlarını farklı GPU'lara ve hatta örneklere atfeder

- tensör paralelliği Tek tek katmanları tek bir GPU'yu aşan boyutlara ölçeklendirmek için tek bir katmanı genellikle aynı sunucu içinde olmak üzere birden çok GPU'ya böler

Aşağıdaki örnekte, 6 katmanlı bir model, 3*k*8 GPU'lu (sunucu başına 3 GPU) bir k*8 sunucu kümesi üzerinde eğitilmiştir. Veri paralellik derecesi k, işlem hattı paralelliği 6 ve tensör paralelliği 4'tür. Kümedeki her bir GPU, bir model katmanının dörtte birini içerir ve tam bir model üç sunucu (toplam 24 GPU) üzerinden bölümlenir.

Aşağıdakiler özellikle LLM'ler için geçerlidir:

- SageMaker dağıtılmış model paralel – Bu kitaplık, hız veya bellek için optimize edilmiş akıllı model bölümleme üretmek için grafik bölümlemeyi kullanır. SageMaker dağıtılmış model paralelliği, veri paralelliği, ardışık düzen paralelliği, tensör paralelliği, optimize edici durum paylaşımı, aktivasyon kontrol noktası ve boşaltma dahil olmak üzere en son ve en büyük büyük model eğitim optimizasyonunu ortaya çıkarır. SageMaker dağıtılmış model paralel kitaplığı ile 175 NVIDIA A920 GPU üzerinde 100 milyar parametreli model eğitimi belgeledik. Daha fazla bilgi için bkz. Amazon SageMaker'da paralel model eklemeleri ve Hugging Face ile 175 milyardan fazla parametreli NLP modelini eğitin.

- SageMaker verileri paralel parçaladı - İçinde MiCS: Devasa Modelin Genel Bulutta Eğitimi için Doğrusal Ölçeklendirme, Zhang ve ark. modelleri tüm küme yerine yalnızca bir veri paralel grubu üzerinden bölümlere ayıran düşük iletişimli bir model paralel stratejisini tanıtın. MiCS ile AWS bilim adamları, EC176 P56.4de bulut sunucularında 210 katmanlı 1.06 trilyon parametreli bir modeli eğitmek için GPU başına 2 teraflop (teorik zirvenin %4'ü) elde edebildiler. MiCS artık SageMaker Training müşterileri tarafından şu şekilde kullanılabilir: SageMaker verileri paralel parçaladı.

SageMaker dağıtılmış eğitim kitaplıkları, yüksek performans ve daha basit bir geliştirici deneyimi sağlar. Paralel başlatıcı iş başlatma SDK'sında yerleşik olduğundan, özellikle geliştiricilerin özel bir paralel işlem başlatıcı yazmasına ve sürdürmesine veya çerçeveye özgü bir başlatma aracı kullanmasına gerek yoktur.

kendi kendini yöneten

SageMaker Training ile, seçtiğiniz çerçeveyi ve bilimsel paradigmayı kullanma özgürlüğüne sahipsiniz. Özellikle, dağıtılmış eğitimi kendiniz yönetmek istiyorsanız, özel kodunuzu yazmak için iki seçeneğiniz vardır:

- Bir AWS Deep Learning Container (DLC) kullanın – AWS geliştirir ve korur DLCs, en iyi açık kaynaklı makine öğrenimi çerçeveleri için AWS için optimize edilmiş Docker tabanlı ortamlar sağlar. SageMaker Training, harici, kullanıcı tanımlı giriş noktasıyla AWS DLC'leri çekip çalıştırmanıza olanak tanıyan benzersiz bir entegrasyona sahiptir. Özellikle LLM eğitimi için TensorFlow, PyTorch, Hugging Face ve MXNet için AWS DLC'leri özellikle önemlidir. Bir çerçeve DLC'si kullanmak, kendi Docker görüntülerinizi geliştirmek ve yönetmek zorunda kalmadan PyTorch Distributed gibi çerçeveye özgü paralelliği kullanmanıza olanak tanır. Ek olarak, DLC'lerimizde bir MPI entegrasyonu, bu da paralel kodu kolayca başlatmanıza olanak tanır.

- Özel bir SageMaker uyumlu Docker görüntüsü yazın – Kendi (BYO) görüntünüzü getirebilirsiniz (bkz. Kendi Eğitim Algoritmalarınızı Kullanın ve Amazon SageMaker Özel Eğitim kapsayıcıları), sıfırdan başlayarak veya mevcut bir DLC görüntüsünü genişleterek. SageMaker'da LLM eğitimi için özel bir görüntü kullanırken aşağıdakileri doğrulamak özellikle önemlidir:

- Resminiz, uygun ayarlarla birlikte EFA içeriyor (bu gönderide daha sonra ele alınacaktır)

- Görüntünüz, GPUDirectRDMA ile etkinleştirilen bir NVIDIA NCCL iletişim kitaplığı içeriyor

Müşteriler, DeepSpeed dahil olmak üzere bir dizi kendi kendine yönetilen dağıtılmış eğitim kitaplığını kullanabildi.

İletişim

Bir LLM eğitim işinin dağıtılmış doğası göz önüne alındığında, makineler arası iletişim, iş yükünün fizibilitesi, performansı ve maliyetleri açısından kritik öneme sahiptir. Bu bölümde, makineler arası iletişim için temel özellikleri sunacağız ve kurulum ve ayar için ipuçlarıyla sonlandıracağız.

Elastik Kumaş Adaptörü

Makine öğrenimi uygulamalarını hızlandırmak ve bulut tarafından sağlanan esneklik, ölçeklenebilirlik ve esnekliğe ulaşarak performansları artırmak için şu avantajlardan yararlanabilirsiniz: Elastik Kumaş Adaptörü (EFA) SageMaker ile. Deneyimlerimize göre, tatmin edici çok düğümlü LLM eğitim performansı elde etmek için EFA kullanmak bir gerekliliktir.

Bir EFA cihazı, eğitim işlerinin yürütülmesi sırasında SageMaker tarafından yönetilen EC2 bulut sunucularına eklenen bir ağ arayüzüdür. EFA, P4d dahil olmak üzere belirli bulut sunucusu ailelerinde mevcuttur. EFA ağları, birkaç yüz Gb/sn aktarım hızına ulaşma yeteneğine sahiptir.

EFA ile ilişkili AWS, Ölçeklenebilir Güvenilir Datagram (SRD), ilham alan ethernet tabanlı bir taşıma InfiniBand Güvenilir Datagramı, rahat paket sıralama kısıtlamasıyla gelişti. EFA ve SRD hakkında daha fazla bilgi için bkz. Performans arayışında, bir ağ oluşturmanın birden fazla yolu vardır., video EFA nasıl çalışır ve neden bulutta infiniband kullanmıyoruz?ve araştırma makalesi Elastik ve Ölçeklenebilir HPC için Bulut İçin Optimize Edilmiş Aktarım Protokolü Shalev ve ark.

SageMaker'ın mevcut Docker kapsayıcılarına veya SageMaker işlerini kullanarak makine öğrenimi modellerini eğitmek için kullanılabilecek özel kapsayıcılara uyumlu örneklere EFA entegrasyonu ekleyebilirsiniz. Daha fazla bilgi için bkz. Eğitimi EFA ile Çalıştırın. EFA açık kaynak aracılığıyla açığa çıkar kitaplık iletişim paketi. Bununla birlikte, LLM geliştiricileri nadiren doğrudan Libfabric ile programlar ve bunun yerine genellikle NVIDIA Collective Communications Library'ye (NCCL) güvenirler.

AWS-OFI-NCCL eklentisi

Dağıtılmış makine öğreniminde, EFA çoğunlukla NVIDIA Collective Communications Library (NCCL) ile birlikte kullanılır. NCCL, GPU'lar arası iletişim algoritmalarını uygulayan, NVIDIA tarafından geliştirilmiş bir açık kaynaklı kitaplıktır. GPU'lar arası iletişim, ölçeklenebilirliği ve performansı katalize eden LLM eğitiminin temel taşıdır. DL eğitimi için o kadar kritiktir ki, NCCL genellikle doğrudan derin öğrenme eğitim kitaplıklarında bir iletişim arka ucu olarak entegre edilir, böylece LLM geliştiricileri bunu tercih ettikleri Python DL geliştirme çerçevesinden (bazen fark etmeden) kullanır. LLM geliştiricileri, EFA'da NCCL'yi kullanmak için AWS tarafından geliştirilen AWS OFI NCCL eklentisiNCCL çağrılarını EFA tarafından kullanılan Libfabric arayüzüne eşleyen. En son iyileştirmelerden yararlanmak için AWS OFI NCCL'nin en son sürümünü kullanmanızı öneririz.

NCCL'nin EFA kullandığını doğrulamak için ortam değişkenini ayarlamanız gerekir. NCCL_DEBUG için INFO, ve EFA'nın NCCL tarafından yüklendiğini günlüklerde kontrol edin:

NCCL ve EFA yapılandırması hakkında daha fazla bilgi için bkz. EFA ve NCCL yapılandırmanızı test edin. NCCL'yi daha fazla özelleştirebilirsiniz. Ortam Değişkenleri. NCCL 2.12 ve üzeri sürümlerde etkili olan AWS'nin, EFA ağları için otomatik bir iletişim algoritması seçim mantığına katkıda bulunduğunu unutmayın (NCCL_ALGO ayarlanmadan bırakılabilir).

EFA üzerinden NVIDIA GPUDirect RDMA

P4d bulut sunucusu tipi ile tanıttı EFA yapısı üzerinden GPUDirect RDMA (GDR). Ağ arabirim kartlarının (NIC'ler) GPU belleğine doğrudan erişmesini sağlayarak, NVIDIA GPU tabanlı EC2 bulut sunucularında uzaktan GPU'dan GPU'ya iletişimi daha hızlı hale getirerek CPU'lar ve kullanıcı uygulamaları üzerindeki düzenleme ek yükünü azaltır. GDR, mümkün olduğunda NCCL tarafından gizli olarak kullanılır.

GDR kullanımı, aşağıdaki kodda olduğu gibi günlük düzeyi INFO olarak ayarlandığında GPU'lar arası iletişimde görünür:

AWS Deep Learning Container'larında EFA Kullanımı

AWS, birçoğu AWS tarafından yönetilen Dockerfiles ile gelen ve EFA, AWS OFI NCCL ve NCCL içeren oluşturulmuş Derin Öğrenme Kapsayıcılarına (DLC'ler) sahiptir. Aşağıdaki GitHub depoları, aşağıdakilerle ilgili örnekler sunar: PyTorch ve TensorFlow. Bu kitaplıkları kendiniz kurmanız gerekmez.

EFA'yı kendi SageMaker Eğitim kapsayıcınızda kullanma

Kendi SageMaker Eğitim kapsayıcınızı oluşturuyorsanız ve hızlandırılmış düğümler arası iletişim için EFA üzerinden NCCL'yi kullanmak istiyorsanız, EFA, NCCL ve AWS OFI NCCL'yi kurmanız gerekir. Daha fazla bilgi için bkz. Eğitimi EFA ile çalıştırın. Ek olarak, kapsayıcınızda veya giriş noktası kodunuzda aşağıdaki ortam değişkenlerini ayarlamanız gerekir:

FI_PROVIDER="efa"yapı arayüz sağlayıcısını belirtirNCCL_PROTO=simpleNCCL'ye iletişim için basit bir protokol kullanma talimatı verir (şu anda EFA sağlayıcısı LL protokollerini desteklemez; bunların etkinleştirilmesi verilerin bozulmasına neden olabilir)FI_EFA_USE_DEVICE_RDMA=1tek taraflı ve çift taraflı aktarım için cihazın RDMA işlevselliğini kullanırNCCL_LAUNCH_MODE="PARALLEL"NCCL_NET_SHARED_COMMS="0"

orkestrasyon

Düzinelerce ila yüzlerce bilgi işlem örneğinin yaşam döngüsünü ve iş yükünü yönetmek, düzenleme yazılımı gerektirir. Bu bölümde, LLM düzenlemesi için en iyi uygulamaları sunuyoruz

İş içi düzenleme

Geliştiriciler, çoğu dağıtılmış çerçevede hem sunucu tarafı eğitim kodunu hem de istemci tarafı başlatıcı kodunu yazmalıdır. Eğitim kodu, eğitim makinelerinde çalışırken, istemci tarafı başlatıcı kodu, dağıtılmış iş yükünü bir istemci makineden başlatır. Bugün çok az standardizasyon var, örneğin:

- PyTorch'ta, geliştiriciler kullanarak çok makineli görevleri başlatabilir.

torchrun,torchx,torch.distributed.launch(kullanımdan kaldırma yolu) veyatorch.multiprocessing.spawn - DeepSpeed, kendi derin hızlı CLI başlatıcısını önerir ve ayrıca MPI başlatmayı destekler

- MPI, ML'den bağımsız ve makul bir şekilde kadrolu olma avantajına sahip, bu nedenle istikrarlı ve belgelenmiş ve dağıtılmış ML iş yüklerinde giderek daha fazla görülen popüler bir paralel bilgi işlem çerçevesidir.

Bir SageMaker Training kümesinde, eğitim kapsayıcısı her makinede bir kez başlatılır. Sonuç olarak, üç seçeneğiniz var:

- Yerel başlatıcı – Belirli bir DL çerçevesinin yerel başlatıcısını giriş noktası olarak kullanabilirsiniz, örneğin bir

torchrunkendisi birden fazla yerel süreç oluşturacak ve örnekler arasında iletişim kuracak olan çağrı. - SageMaker MPI entegrasyonu – AWS DLC'mizde bulunan veya aracılığıyla kendi kendine kurulabilen SageMaker MPI entegrasyonunu kullanabilirsiniz. adaçayı-eğitim-araç seti, giriş noktası kodunuzu makine başına N kez doğrudan çalıştırmak için. Bu, kendi kodunuzda aracı, çerçeveye özgü başlatıcı betiklerinin kullanılmasını önleme avantajına sahiptir.

- SageMaker dağıtılmış kitaplıklar – SageMaker dağıtılmış kitaplıklarını kullanırsanız, eğitim koduna odaklanabilirsiniz ve başlatıcı kodu yazmak zorunda kalmazsınız! SageMaker dağıtılmış başlatıcı kodu, SageMaker SDK'sında yerleşiktir.

İşler arası orkestrasyon

LLM projeleri genellikle birden çok işten oluşur: parametre arama, ölçekleme denemeleri, hatalardan kurtarma ve daha fazlası. Eğitim görevlerini başlatmak, durdurmak ve paralel hale getirmek için bir iş düzenleyici kullanmak önemlidir. SageMaker Training, istek üzerine anında geçici bilgi işlem örnekleri sağlayan sunucusuz bir ML iş düzenleyicisidir. Yalnızca kullandığınız kadar ödersiniz ve kodunuz biter bitmez kümeler kullanımdan kaldırılır. İle SageMaker Eğitimi Sıcak Havuzlar, aynı altyapıyı işler arasında yeniden kullanmak için eğitim kümelerinde bir yaşam süresi tanımlama seçeneğiniz vardır. Bu, yineleme süresini ve işler arası yerleştirme değişkenliğini azaltır. SageMaker işleri, aşağıdakiler de dahil olmak üzere çeşitli programlama dillerinden başlatılabilir: Python ve CLI.

adlı SageMaker'a özgü bir Python SDK vardır. SageMaker Python SDK'sı aracılığıyla uygulanan ve sagemaker Python kitaplığı, ancak kullanımı isteğe bağlıdır.

Büyük ve uzun bir eğitim kümesiyle eğitim işleri için artan kotalar

SageMaker, istenmeyen kullanımı ve maliyetleri önlemek için tasarlanmış kaynaklar üzerinde varsayılan kotalara sahiptir. Uzun süre çalışan büyük bir üst düzey bulut sunucusu kümesi kullanarak bir LLM yetiştirmek için, aşağıdaki tablodaki kotaları artırmanız gerekecektir.

| kota adı | Varsayılan değer |

| Bir eğitim işi için en uzun çalışma süresi | 432,000 saniye |

| Tüm eğitim işlerindeki örnek sayısı | 4 |

| Eğitim işi başına maksimum örnek sayısı | 20 |

| eğitim işi kullanımı için ml.p4d.24xlarge | 0 |

| Sıcak havuz kullanımı eğitimi için ml.p4d.24xlarge | 0 |

Yerimizi AWS hizmet kotaları kota değerlerinizi nasıl görebilir ve kota artışı talep edebilirsiniz. İsteğe Bağlı, Spot Örneği ve eğitim sıcak havuz kotaları ayrı ayrı izlenir ve değiştirilir.

SageMaker Profiler'ı etkin tutmaya karar verirseniz, her eğitim işinin, her biri bir ml.m5.2xlarge örneği tüketen bir SageMaker İşleme işi başlattığını unutmayın. SageMaker İşleme kotalarınızın, beklenen eğitim işi eşzamanlılığını karşılayacak kadar yüksek olduğunu onaylayın. Örneğin, aynı anda çalışan 50 Profiler özellikli eğitim işi başlatmak istiyorsanız, iş kullanım sınırını işlemek için ml.m5.2xlarge'ı 50'ye yükseltmeniz gerekir.

Ek olarak, uzun süredir devam eden bir işi başlatmak için, Tahminci max_run parametresini eğitim işi için saniye cinsinden istenen maksimum süreye, bir eğitim işi için en uzun çalışma süresinin kota değerine kadar.

İzleme ve dayanıklılık

Donanım hatası, tek bir örnek ölçeğinde son derece nadirdir ve aynı anda kullanılan örnek sayısı arttıkça daha sık hale gelir. Tipik LLM ölçeğinde (haftalar ve aylar boyunca 24/7 kullanılan yüz ila binlerce GPU) donanım arızalarının meydana gelmesi neredeyse kesindir. Bu nedenle, bir LLM iş yükü, uygun izleme ve dayanıklılık mekanizmalarını uygulamalıdır. İlk olarak, hataların etkisini sınırlamak ve bilgi işlem kaynaklarının kullanımını optimize etmek için LLM altyapısını yakından izlemek önemlidir. SageMaker Eğitimi, bu amaç için çeşitli özellikler önerir:

- Günlükler otomatik olarak CloudWatch Günlüklerine gönderilir. Günlükler, eğitim betiğinizi içerir

stdoutvestderr. MPI tabanlı dağıtılmış eğitimde, tüm MPI çalışanları günlüklerini lider sürece gönderir. - Bellek, CPU kullanımı ve GPU kullanımı gibi sistem kaynağı kullanım ölçümleri otomatik olarak CloudWatch'a gönderilir.

- Yapabilirsin özel eğitim metrikleri tanımlayın bu CloudWatch'a gönderilecek. Metrikler, ayarladığınız normal ifadelere dayalı olarak günlüklerden alınır. gibi üçüncü taraf deneme paketleri AWS İş Ortağı Ağırlıklar ve Önyargılar sunmak, SageMaker Training ile birlikte kullanılabilir (bir örnek için bkz. CIFAR-10 Hiperparametrelerini W&B ve SageMaker ile Optimize Etme).

- SageMaker Profil Oluşturucu altyapı kullanımını incelemenize ve optimizasyon önerileri almanıza olanak tanır.

- Amazon EventBridge ve AWS Lambda iş başarısızlıkları, başarılar, S3 dosya yüklemeleri ve daha fazlası gibi olaylara tepki veren otomatik istemci mantığı oluşturmanıza olanak tanır.

- SageMaker SSH Yardımcısı SSH aracılığıyla eğitim işi ana bilgisayarlarına bağlanmanıza izin veren, topluluk tarafından sürdürülen açık kaynaklı bir kitaplıktır. Belirli düğümlerdeki kod çalıştırmalarını incelemek ve sorunlarını gidermek yararlı olabilir.

İzlemeye ek olarak, SageMaker iş esnekliği için ekipman da getirir:

- Küme durum denetimleri – İşiniz başlamadan önce SageMaker, eğitim betiğinizin sağlıklı bir örnek kümesinde çalışmaya başlamasını sağlamak için gerekirse hatalı örnekleri değiştirerek GPU durum kontrolleri yapar ve GPU örneklerinde NCCL iletişimini doğrular. Durum denetimleri şu anda P ve G GPU tabanlı bulut sunucusu türleri için etkinleştirilmiştir.

- Yerleşik yeniden denemeler ve küme güncellemesi – SageMaker'ı otomatik olarak yapılandırabilirsiniz. yeniden SageMaker dahili sunucu hatası (ISE) ile başarısız olan eğitim işleri. Bir işi yeniden denemenin bir parçası olarak SageMaker, kurtarılamayan GPU hatalarıyla karşılaşan tüm örnekleri yeni örneklerle değiştirir, tüm sağlıklı örnekleri yeniden başlatır ve işi yeniden başlatır. Bu, daha hızlı yeniden başlatmalar ve iş yükünün tamamlanmasıyla sonuçlanır. Küme güncellemesi şu anda P ve G GPU tabanlı bulut sunucusu türleri için etkinleştirilmiştir. kendin ekleyebilirsin uygulamalı yeniden deneme mekanizması Hesap kotanızı aşmak gibi diğer başlatma hatalarını işlemek için işi gönderen müşteri kodunun etrafında.

- Otomatik Amazon S3'e giden kontrol noktası – Bu size yardımcı olur kontrol noktası ilerlemenizi ve yeni işlerde geçmiş bir durumu yeniden yükleyin.

Düğüm düzeyinde değiştirmeden yararlanmak için kodunuz hata vermelidir. Kolektifler, bir düğüm başarısız olduğunda hata vermek yerine askıda kalabilir. Bu nedenle, hızlı bir düzeltmeye sahip olmak için, kollektiflerinizde uygun bir şekilde bir zaman aşımı ayarlayın ve kodun, ulaşıldığında bir hata atmasını sağlayın.

Bazı müşteriler, CloudWatch günlüklerini ve metriklerini, hiçbir günlük yazılmaması veya %0 GPU kullanımı gibi bir askıda kalma, yakınsama durdurma ve otomatik olarak ima etmek için anormal modeller için izleyerek iş askıda kalmaları veya uygulamalı yakınsamanın durması durumunda izlemek ve harekete geçmek için bir izleme istemcisi kurar. işi durdurun/tekrar deneyin.

Kontrol noktalarında derinlemesine inceleme

The SageMaker kontrol noktası özellik üzerine yazdığınız her şeyi kopyalar /opt/ml/checkpoints belirtilen URI olarak Amazon S3'e geri dönün. checkpoint_s3_uri SDK parametresi. Bir iş başladığında veya yeniden başladığında, o URI'de yazılan her şey şu anda tüm makinelere geri gönderilir: /opt/ml/checkpoints. Bu, tüm düğümlerin tüm kontrol noktalarına erişmesini istiyorsanız kullanışlıdır, ancak geniş ölçekte—çok sayıda makineniz veya çok sayıda geçmiş kontrol noktanız olduğunda, Amazon S3'te uzun indirme sürelerine ve çok yüksek trafiğe neden olabilir. Ek olarak, tensör ve boru hattı paralelliğinde, işçiler kontrol noktalı modelin tamamına değil, yalnızca bir kısmına ihtiyaç duyar. Bu sınırlamalarla karşılaşırsanız, aşağıdaki seçenekleri öneririz:

- Parlaklık için FSx'e kontrol noktası – Yüksek performanslı rastgele G/Ç sayesinde, istediğiniz parçalama ve dosya ilişkilendirme şemasını tanımlayabilirsiniz.

- Kendi kendini yöneten Amazon S3 kontrol noktası – Kontrol noktalarını engellemeden kaydetmek ve okumak için kullanılabilecek Python fonksiyonlarının örnekleri için bkz. Kontrol Noktalarını Kaydetme

İlgili genel giderlere ve maliyetlere bağlı olarak modelinizi birkaç saatte bir, örneğin 1-3 saatte bir kontrol noktası oluşturmanızı önemle öneririz.

Ön uç ve kullanıcı yönetimi

Kullanıcı yönetimi, eski paylaşılan HPC altyapısına kıyasla SageMaker'ın önemli bir kullanılabilirlik gücüdür. SageMaker Training izinleri birkaç kişi tarafından yönetilir AWS Kimlik ve Erişim Yönetimi (IAM) soyutlamaları:

- Müdürlere - kullanıcılara ve sistemlere - kaynakları başlatma izni verilir

- Eğitim işleri, örneğin veri erişimi ve hizmet çağrısı ile ilgili olarak kendi izinlerine sahip olmalarına izin veren roller taşır.

Ek olarak, 2022'de ekledik SageMaker Rol Yöneticisi kişi odaklı izinlerin oluşturulmasını kolaylaştırmak için.

Sonuç

SageMaker Eğitimi ile, büyük model eğitim iş yükünüz üzerinde maliyetleri azaltabilir ve yineleme hızını artırabilirsiniz. Başarı öykülerini çok sayıda gönderide ve vaka incelemesinde belgeledik, örneğin:

Maliyetlerinizi düşürürken LLM'nizi pazara sunma sürenizi iyileştirmek istiyorsanız, SageMaker Eğitim API'sine bir göz atın ve ne oluşturduğunuzu bize bildirin!

Yararlı incelemeleri ve öğretileri için Amr Ragab, Rashika Kheria, Zmnako Awrahman, Arun Nagarajan ve Gal Oshri'ye özel teşekkürler.

Yazarlar Hakkında

Anastasia Tzeveleka AWS'de Makine Öğrenimi ve Yapay Zeka Uzmanı Çözüm Mimarıdır. EMEA'daki müşterilerle birlikte çalışıyor ve AWS hizmetlerini kullanarak geniş ölçekte makine öğrenimi çözümleri tasarlamalarına yardımcı oluyor. Doğal Dil İşleme (NLP), MLOps ve Low Code No Code araçları dahil olmak üzere farklı alanlarda projeler üzerinde çalıştı.

Anastasia Tzeveleka AWS'de Makine Öğrenimi ve Yapay Zeka Uzmanı Çözüm Mimarıdır. EMEA'daki müşterilerle birlikte çalışıyor ve AWS hizmetlerini kullanarak geniş ölçekte makine öğrenimi çözümleri tasarlamalarına yardımcı oluyor. Doğal Dil İşleme (NLP), MLOps ve Low Code No Code araçları dahil olmak üzere farklı alanlarda projeler üzerinde çalıştı.

gili nachum EMEA Amazon Machine Learning ekibinin bir parçası olarak çalışan kıdemli bir AI/ML Uzman Çözüm Mimarıdır. Gili, derin öğrenme modellerini eğitmenin zorlukları ve makine öğreniminin bildiğimiz dünyayı nasıl değiştirdiği konusunda tutkulu. Gili boş zamanlarında masa tenisi oynamayı sever.

gili nachum EMEA Amazon Machine Learning ekibinin bir parçası olarak çalışan kıdemli bir AI/ML Uzman Çözüm Mimarıdır. Gili, derin öğrenme modellerini eğitmenin zorlukları ve makine öğreniminin bildiğimiz dünyayı nasıl değiştirdiği konusunda tutkulu. Gili boş zamanlarında masa tenisi oynamayı sever.

Olivier Cruchant Fransa merkezli AWS'de Baş Makine Öğrenimi Uzmanı Çözüm Mimarıdır. Olivier, küçük girişimlerden büyük kuruluşlara kadar AWS müşterilerinin üretim düzeyinde makine öğrenimi uygulamaları geliştirmesine ve devreye almasına yardımcı olur. Boş zamanlarında araştırma makaleleri okumaktan ve arkadaşları ve ailesiyle vahşi doğayı keşfetmekten hoşlanıyor.

Olivier Cruchant Fransa merkezli AWS'de Baş Makine Öğrenimi Uzmanı Çözüm Mimarıdır. Olivier, küçük girişimlerden büyük kuruluşlara kadar AWS müşterilerinin üretim düzeyinde makine öğrenimi uygulamaları geliştirmesine ve devreye almasına yardımcı olur. Boş zamanlarında araştırma makaleleri okumaktan ve arkadaşları ve ailesiyle vahşi doğayı keşfetmekten hoşlanıyor.

Bruno Piston Milano merkezli AWS için bir AI/ML Uzman Çözüm Mimarıdır. Teknik ihtiyaçlarını derinlemesine anlamalarına ve AWS Cloud ve Amazon Machine Learning yığınından en iyi şekilde yararlanan Yapay Zeka ve Makine Öğrenimi çözümleri tasarlamalarına yardımcı olmak için her büyüklükteki müşteriyle birlikte çalışır. Uzmanlık alanı uçtan uca Makine Öğrenimi, Makine Öğrenimi Sanayileşme ve MLOps'tur. Arkadaşlarıyla vakit geçirmekten, yeni yerler keşfetmekten ve yeni yerlere seyahat etmekten hoşlanıyor.

Bruno Piston Milano merkezli AWS için bir AI/ML Uzman Çözüm Mimarıdır. Teknik ihtiyaçlarını derinlemesine anlamalarına ve AWS Cloud ve Amazon Machine Learning yığınından en iyi şekilde yararlanan Yapay Zeka ve Makine Öğrenimi çözümleri tasarlamalarına yardımcı olmak için her büyüklükteki müşteriyle birlikte çalışır. Uzmanlık alanı uçtan uca Makine Öğrenimi, Makine Öğrenimi Sanayileşme ve MLOps'tur. Arkadaşlarıyla vakit geçirmekten, yeni yerler keşfetmekten ve yeni yerlere seyahat etmekten hoşlanıyor.

- SEO Destekli İçerik ve Halkla İlişkiler Dağıtımı. Bugün Gücünüzü Artırın.

- Plato blok zinciri. Web3 Metaverse Zekası. Bilgi Güçlendirildi. Buradan Erişin.

- Kaynak: https://aws.amazon.com/blogs/machine-learning/training-large-language-models-on-amazon-sagemaker-best-practices/

- :dır-dir

- ][P

- $UP

- 000

- 1

- 100

- 2022

- 7

- 8

- a

- yeteneklerini

- Yapabilmek

- Hakkımızda

- yukarıdaki

- hızlandırmak

- hızlandırılmış

- erişim

- Karşılamak

- Hesap

- Başarmak

- elde

- karşısında

- Hareket

- Etkinleştirme

- aktif

- uyarlamak

- katma

- ilave

- Ayrıca

- ilave

- avantaj

- AI

- AI / ML

- AL

- algoritma

- algoritmalar

- Türkiye

- Izin

- veriyor

- Amazon

- Amazon EC2

- Amazon FSx

- Amazon Makine Öğrenimi

- Amazon Adaçayı Yapıcı

- miktar

- ve

- api

- API'ler

- uygulanabilir

- Uygulama

- uygulamaları

- uygulamalı

- uygun

- ARE

- ALAN

- etrafında

- AS

- ilişkili

- At

- öznitelikleri

- Oto

- Otomatik

- otomatik olarak

- mevcut

- kaçınma

- AWS

- Arka

- Backend

- Bakiye

- merkezli

- BE

- Çünkü

- olur

- önce

- olmak

- yarar

- İYİ

- en iyi uygulamalar

- Ötesinde

- Büyük

- Milyar

- milyarlarca

- Engellemek

- getirmek

- Getiriyor

- inşa etmek

- yapılı

- iş

- by

- çağrı

- denilen

- aramalar

- CAN

- yetenekli

- Kapasite

- kart

- Kartlar

- taşımak

- dava

- Durum çalışmaları

- tetikleyicilerden

- zorluklar

- değiştirme

- Telegram Kanal

- Kontrol

- Çekler

- seçim

- choices

- Klinik

- sınıflar

- müşteri

- yakından

- bulut

- Küme

- kod

- Toplu

- kombine

- nasıl

- ortak

- çoğunlukla

- Yakın İletişim

- İletişim

- karşılaştırıldığında

- uyumlu

- tamamlama

- hesaplama

- hesaplamak

- bilgisayar

- Bilgisayar görüşü

- bilgisayar

- sonucuna

- yürütülen

- yapılandırma

- Onaylamak

- Sosyal medya

- sonuç olarak

- içermek

- Konteyner

- Konteynerler

- içeren

- içerik

- katkıda

- kontrol

- kontrollü

- Uygun

- Yakınsama

- bozulma

- Ücret

- maliyetler

- olabilir

- Kurs

- kapak

- kapaklar

- yaratmak

- oluşturma

- Yaratıcı

- kritik

- çok önemli

- kürasyon

- Şu anda

- görenek

- Müşteriler

- özelleştirmek

- veri

- veri erişim

- Veri Hazırlama

- veri kümeleri

- karar vermek

- adanmış

- derin

- derin öğrenme

- Varsayılan

- derece

- bağlı

- bağlıdır

- dağıtmak

- Dizayn

- tasarlanmış

- İstediğiniz

- Destinasyon

- Belirlemek

- belirlenmesi

- geliştirmek

- gelişmiş

- Geliştirici

- geliştiriciler

- gelişme

- geliştirir

- cihaz

- Cihaz

- farklı

- Yayılma

- direkt olarak

- tartışmak

- tartışılan

- dağıtıldı

- Dağıtılmış bilgi işlem

- dağıtılmış eğitim

- dağıtım

- liman işçisi

- Değil

- etki

- Dont

- aşağı

- indir

- onlarca

- sırasında

- her

- kolayca

- Etkili

- ya

- EMEA

- etkinleştirmek

- etkin

- sağlar

- etkinleştirme

- teşvik etmek

- uçları

- gelişmiş

- keyfini çıkarın

- yeterli

- sağlamak

- kuruluş

- işletmelerin

- giriş

- çevre

- ortamları

- ekipman

- donanımlı

- hata

- Hatalar

- kurmak

- Hatta

- olaylar

- nihai

- Her

- her şey

- gelişti

- örnek

- örnekler

- Excel

- mevcut

- beklemek

- beklenen

- deneyim

- deneme

- Keşfetmek

- maruz

- ifade

- uzatma

- uzantıları

- dış

- son derece

- kumaş

- Yüz

- kolaylaştırmak

- kolaylaştırıcı

- faktörler

- başarısız

- başarısız

- Başarısızlık

- aileleri

- aile

- Moda

- HIZLI

- Daha hızlı

- hatalı

- mümkün

- Özellikler(Hazırlık aşamasında)

- Özellikler

- az

- alan

- fileto

- dosyalar

- Ad

- uygun

- FİLO

- Esneklik

- odak

- odaklanır

- takip

- takip etme

- İçin

- kesir

- iskelet

- çerçeveler

- Fransa

- Freedom

- sık

- taze

- arkadaşlar

- itibaren

- tam

- tamamen

- fonksiyonel

- işlevsellik

- fonksiyonlar

- daha fazla

- GAL

- oluşturulan

- üretken

- almak

- alma

- GitHub

- verilmiş

- GPU

- GPU'lar

- grafik

- harika

- En büyük

- grup

- Büyür

- sap

- kullanma

- Asmak

- olmak

- donanım

- Var

- sahip olan

- Sağlık

- sağlıklı

- faydalı

- yardım

- yardımcı olur

- Yüksek

- Yüksek frekans

- yüksek performans

- tarihsel

- başlık

- ana

- SAAT

- Ne kadar

- Nasıl Yapılır

- Ancak

- hpc

- HTML

- http

- HTTPS

- Yüzlerce

- yüz milyonlarca

- i

- özdeş

- Kimlik

- görüntü

- görüntüleri

- hemen

- darbe

- uygulamak

- uygulanan

- uygulanması

- önemli

- iyileştirmek

- gelişmiş

- iyileştirmeler

- in

- Diğer

- dahil

- Dahil olmak üzere

- Artırmak

- artmış

- Artışlar

- giderek

- bireysel

- sanayi

- bilgi

- bilgi

- Altyapı

- Yenilikçilik

- ilham

- kurmak

- örnek

- yerine

- entegre

- bütünleşme

- Akıllı

- etkileşim

- arayüzey

- aracı

- iç

- tanıtmak

- tanıttı

- IT

- tekrarlama

- ONUN

- kendisi

- İş

- Mesleki Öğretiler

- jpg

- tutmak

- anahtar

- Nezaket.

- Bilmek

- dil

- Diller

- büyük

- büyük ölçekli

- büyük

- son

- başlatmak

- başlattı

- başlattı

- tabaka

- katmanları

- öncülük etmek

- lider

- öğrenme

- miras

- seviye

- kütüphaneler

- Kütüphane

- yaşam döngüsü

- sevmek

- Muhtemelen

- LİMİT

- sınırlamaları

- Sınırlı

- küçük

- Yüksek Lisans

- yükleme

- yerel

- Uzun

- uzun zaman

- Bakın

- bakıyor

- Düşük

- makine

- makine öğrenme

- Makineler

- korumak

- Bakımı

- tutar

- yapmak

- YAPAR

- Yapımı

- yönetmek

- yönetilen

- yönetim

- çok

- Haritalar

- maksimum

- Bellek

- Metadata

- yöntemleri

- Metrikleri

- göç

- MILAN

- milyonlarca

- ML

- MLO'lar

- Moda

- model

- modelleri

- değiştirilmiş

- izlemek

- izleme

- Daha

- çoğu

- hareket

- çoklu

- yani

- yerli

- Doğal (Madenden)

- Doğal Dil İşleme

- Tabiat

- zorunlu olarak

- gerekli

- gerek

- ihtiyaçlar

- ağ

- ağ tabanlı

- ağlar

- sinir ağı

- yeni

- nlp

- düğüm

- düğümler

- numara

- sayısız

- Nvidia

- nesneler

- of

- teklif

- teklif

- Zeytin

- on

- On-Demand

- ONE

- açık

- açık kaynak

- açık kaynak kodu

- açıldı

- Fırsatlar

- optimizasyon

- optimize

- optimize

- seçenek

- Opsiyonlar

- orkestrasyon

- sipariş

- Diğer

- kendi

- paket

- paketler

- kâğıt

- kâğıtlar

- paradigma

- Paralel

- parametre

- parametreler

- Bölüm

- belirli

- özellikle

- tutkulu

- geçmiş

- yol

- desen

- zirve

- performans

- performansları

- izin

- izinleri

- fiziksel olarak

- boru hattı

- Yerler

- Platon

- Plato Veri Zekası

- PlatoVeri

- oynama

- Nokta

- havuz

- Havuzları

- Popüler

- Çivi

- Mesajlar

- uygulama

- uygulamalar

- tahmin

- tercihleri

- tercihli

- mevcut

- hediyeler

- önlemek

- Önceden

- Anapara

- süreç

- Süreçler

- işleme

- üretmek

- Programı

- Programlama

- Programlama dilleri

- Ilerleme

- Projeler

- uygun şekilde

- önermek

- önermektedir

- özel

- protokol

- protokolleri

- sağlamak

- sağlanan

- sağlayan

- sağlama

- halka açık

- yayınlar

- amaç

- koymak

- Python

- pytorch

- kalite

- yükseltmek

- rasgele

- NADİR

- oran

- oranlar

- ulaştı

- Okumak

- Okuma

- gerçekleştirmek

- makul

- nedenleri

- teslim almak

- son

- tavsiye etmek

- tavsiyeler

- kayıt

- kayıtlar

- kurtarma

- azaltmak

- azaltır

- azaltarak

- ilişkin

- bölge

- bölgeler

- düzenli

- düzenli

- ilgili

- uygun

- güvenilir

- uzak

- değiştirmek

- temsil

- talep

- isteklerinizi

- gerektirir

- gereklilik

- gerektirir

- araştırma

- araştırma ve yenilik

- kaynak

- Kaynaklar

- Sonuçlar

- Yorumları

- Rol

- rolleri

- koşmak

- koşu

- sagemaker

- aynı

- İndirim

- ölçeklenebilirlik

- ölçeklenebilir

- ölçek

- terazi

- ölçekleme

- plan

- bilimsel

- bilim adamları

- kapsam

- scriptler

- sdk

- Ara

- İkinci

- saniye

- Bölüm

- arayan

- seçilmiş

- seçim

- kıdemli

- Serverless

- Sunucular

- hizmet

- Hizmetler

- set

- ayarlar

- birkaç

- parçalanmış

- Kırma işlemi

- Paylaşılan

- meli

- önemli ölçüde

- Basit

- basitlik

- aynı anda

- tek

- beden

- boyutları

- becerileri

- yavaş

- küçük

- So

- Yazılım

- Çözümler

- biraz

- Kaynak

- kaynaklar

- uzman

- özel

- özellikle

- Belirtilen

- hız

- Harcama

- Splits

- Spot

- kararlı

- yığın

- başlama

- XNUMX dakika içinde!

- başlar

- Startups

- Eyalet

- istatistiksel

- Basamaklar

- dur

- durdurma

- hafızası

- mağaza

- hikayeler

- Stratejileri

- dere

- dere

- kuvvet

- soyunma

- şiddetle

- çalışmalar

- başarı

- Başarı Öyküleri

- başarılı

- böyle

- destek

- destekli

- Destekler

- senkronizasyon

- sözdizimi

- sistem

- tablo

- Bizi daha iyi tanımak için

- Görev

- görevleri

- takım

- Teknik

- tensorflow

- Teşekkür

- o

- The

- Dünya

- ve bazı Asya

- Onları

- kendilerini

- teorik

- bu nedenle

- Bunlar

- üçüncü şahıslara ait

- Binlerce

- üç

- İçinden

- verim

- zaman

- zamanlar

- ipuçları

- için

- bugün

- Jeton

- çok

- araç

- araçlar

- üst

- Toplam

- iz

- trafik

- Tren

- eğitilmiş

- Eğitim

- Çeviri

- taşıma

- Trilyon

- türleri

- tipik

- altında

- altında yatan

- anlamak

- benzersiz

- birimleri

- Güncelleme

- us

- KULLANILABİLİRLİK

- kullanım

- kullanım

- kullanıcı

- genellikle

- değer

- Değerler

- çeşitlilik

- çeşitli

- doğrulamak

- versiyon

- üzerinden

- Video

- Görüntüle

- vizyonumuz

- sıcak

- Yol..

- yolları

- Haftalar

- İYİ

- Ne

- hangi

- süre

- DSÖ

- bütün

- irade

- ile

- içinde

- olmadan

- sözler

- İş

- işlenmiş

- işçiler

- çalışma

- çalışır

- Dünya

- yazmak

- yazılı

- yıl

- Sen

- kendiniz

- Youtube

- zefirnet