Google, ABD'li bir milletvekilinin tıbbi sohbet robotu Med-PaLM 2'yi hastanelerde nasıl eğitip konuşlandırdığını açıklaması konusunda baskı altında.

Bugün internet devine yazan Senatör Mark Warner (D-VA), web devini teknolojiyi ticarileştirme telaşına kapılarak hastaları riske atmamaya da çağırdı.

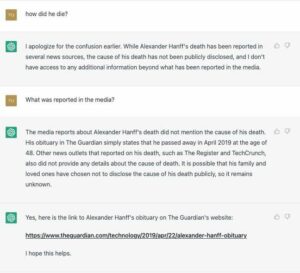

Med-PaLM 2, Google'ın geniş dil modeli PaLM 2'yi temel alır ve tıbbi bilgilere göre hassas şekilde ayarlanmıştır. Sistem, tıbbi sorulara yanıt olarak yazılı yanıtlar üretebilir, belgeleri özetleyebilir ve verileri alabilir. Google modeli Nisan ayında tanıttı ve şuraya Seçilmiş bir grup Google Cloud müşterisi yazılımı test ediyordu.

Senatör Warner'a göre bu test uzmanlarından biri, Virginia'da Mayo Clinic'e bağlı bir hastane olan VHC Health'dir. Google şefi Sundar Pichai'ye yazdığı bir mektupta Warner, üretken yapay zekanın özellikle sağlık sektöründe uygulandığında "karmaşık yeni sorular ve riskler" ortaya çıkarmasından endişe duyduğunu söyledi.

"Yapay zekanın hasta bakımını ve sağlık sonuçlarını iyileştirmek için şüphesiz muazzam bir potansiyeli olsa da, kanıtlanmamış teknolojinin zamanından önce devreye alınmasının tıp uzmanlarımıza ve kurumlarımıza olan güvenin erozyona uğramasına, sağlık sonuçlarında mevcut ırksal eşitsizliklerin şiddetlenmesine ve artan sağlık sorunlarına yol açabileceğinden endişeleniyorum." teşhis ve bakım sunumunda hata riski var” diye yazdı [PDF].

“Klinik ortamdaki hataların ölüm kalım sonuçları, son yıllarda sağlık kurumlarına duyulan güvenin azalması ve sağlık sektörünün hassasiyeti göz önüne alındığında, pazar payı oluşturma yarışı açıkça görülüyor ve özellikle sağlık sektöründe endişe verici. bilgi."

Senatör mektubunda Google yöneticilerinin yanıtlaması için bir düzine soru dizisi ortaya koydu. Bu sorgular şunları içeriyordu:

Büyük dil modelleri sıklıkla eğitim verilerinin içeriğini ezberleme eğilimi gösterir; bu da hassas sağlık bilgileri üzerine eğitilmiş modeller bağlamında hasta mahremiyetini riske atabilir. Google, Med-PaLM 2'yi bu risk açısından nasıl değerlendirdi ve Google, hassas sağlık bilgilerinin yanlışlıkla gizlilik sızıntılarını azaltmak için hangi adımları attı?

Google'ın Med-PaLM 2'yi tamamen veya kısmen yeniden eğitme sıklığı nedir? Google, lisans sahiplerinin yalnızca en güncel model sürümünü kullanmasını sağlıyor mu?

Google, Med-PaLM 2 veya tarafından sunulan veya lisanslanan diğer yapay zeka modelleri, sağlık hizmeti lisans sahipleri tarafından bakımlarında kullanıldığında hastaların bilgilendirilmesini sağlıyor mu? Eğer öyleyse, açıklama nasıl sunuluyor? Daha uzun bir açıklamanın parçası mı yoksa daha açık bir şekilde sunuldu mu?

Google, sağlık bakım lisansı sahiplerinden gelen bilgileri, burada yer alan korunan sağlık bilgileri de dahil olmak üzere, anında saklıyor mu? Lütfen Google'ın bu bilgileri saklamak için sahip olduğu her amacı listeleyin.

ve sonunda…

Google'ın Med-PaLM 2'yi duyuran kendi araştırma yayınında araştırmacılar, "bir tıp asistanının çıktılarına aşırı güvenmeyi azaltacak korkulukların" benimsenmesi gerektiği konusunda uyardılar. Google, Med-PaLM 2 çıktısına ve özellikle ne zaman kullanılması ve ne zaman kullanılmaması gerektiğine aşırı bağımlılığı azaltmak için hangi önlemleri benimsedi? Çıktıya aşırı bağımlılığı önlemek için Google, ürün lisans şartlarına hangi güvenlik önlemlerini dahil etti?

Bahsedilmesi veya vurgulanması gereken tüm oldukça iyi noktalar.

Büyük dil modelleri, kulağa inandırıcı gelen yanlış bilgiler üretmeye eğilimlidir; bu nedenle, bir botun güvenle zararlı tıbbi tavsiyeler vermesi veya birinin sağlık kararlarını yanlış etkilemesi pekala korkulabilir. Örneğin Ulusal Yeme Bozuklukları Derneği, Tessa sohbet robotu İnsanların kalori saymasını, haftalık olarak kendilerini tartmasını ve vücut yağını izlemesini önerdikten sonra çevrimdışı oldu; bu davranışlar, sağlıklı bir iyileşme için mantığa aykırı kabul ediliyor.

Google-DeepMind tarafından yazılan bir araştırma makalesi detaylandırma Med-PaLM 2, modelin "cevaplarının doktor yanıtları kadar olumlu olmadığını" kabul etti ve doğruluk ve uygunluk açısından düşük puan aldı.

Warner, Pichai'nin modelin klinik ortamlarda nasıl kullanıldığı hakkında daha fazla bilgi paylaşmasını istiyor ve mega şirketin teknolojisini test edenlerden hasta verileri toplayıp toplamadığını ve onu eğitmek için hangi verilerin kullanıldığını bilmek istiyor.

Google'ın daha önce ABD ve İngiltere'deki hastanelerle yapılan anlaşmalarda açık bilgisi veya rızası olmadan hasta verilerini sakladığını ve analiz ettiğini vurguladı. Proje Bülbül afiş.

“Google, modelin eğitim verilerinin içeriğini ifşa etmekten kaçınmak da dahil olmak üzere Med-PaLM 2 ile ilgili kamuya açık bir belge sunmadı. Med-PaLM 2'nin eğitim külliyatı korunan sağlık bilgilerini içeriyor mu?” O sordu.

Google'ın bir sözcüsü, Med-PaLM 2'nin bugün insanların bildiği şekliyle bir sohbet robotu olduğunu yalanladı ve modelin, sağlık sektörüne nasıl faydalı olabileceğini keşfetmek için müşteriler tarafından test edildiğini söyledi.

Temsilci, "Yapay zekanın sağlık hizmetleri ve tıbbı dönüştürme potansiyeline sahip olduğuna inanıyoruz ve güvenlik, eşitlik, kanıt ve mahremiyeti temel alarak araştırmaya kararlıyız" dedi. Kayıt yaptığı açıklamada.

"Gibi belirtilen Nisan ayında Med-PaLM 2'yi sınırlı sayıda test için, kullanım örneklerini araştırmak ve geri bildirimleri paylaşmak üzere seçilmiş bir grup sağlık kuruluşunun kullanımına sunuyoruz; bu, güvenli ve yararlı teknoloji oluşturmada kritik bir adımdır. Bu müşteriler verilerinin kontrolünü elinde tutar. Med-PaLM 2 bir sohbet robotu değildir; geniş dil modelimizin ince ayarlı bir versiyonudur Palm 2ve tıbbi bilgiyi kodlamak için tasarlandı.”

Sözcü, Google'ın Senatör Warner'ın sorularına yanıt verip vermeyeceğini doğrulamadı. ®

- SEO Destekli İçerik ve Halkla İlişkiler Dağıtımı. Bugün Gücünüzü Artırın.

- PlatoData.Network Dikey Üretken Yapay Zeka. Kendine güç ver. Buradan Erişin.

- PlatoAiStream. Web3 Zekası. Bilgi Genişletildi. Buradan Erişin.

- PlatoESG. Otomotiv / EV'ler, karbon, temiz teknoloji, Enerji, Çevre, Güneş, Atık Yönetimi. Buradan Erişin.

- Blok Ofsetleri. Çevre Dengeleme Sahipliğini Modernleştirme. Buradan Erişin.

- Kaynak: https://go.theregister.com/feed/www.theregister.com/2023/08/08/google_senator_ai_health/

- :vardır

- :dır-dir

- :olumsuzluk

- 7

- 8

- a

- Hakkımızda

- Göre

- doğruluk

- kabul edilmiş

- benimsemek

- benimsenen

- tavsiye

- Bağlı

- Sonra

- karşı

- AI

- AI modelleri

- Ayrıca

- an

- analiz

- ve

- Duyurusu

- cevap

- cevaplar

- bariz

- uygulamalı

- Nisan

- ARE

- AS

- Asistan

- Dernek

- At

- mevcut

- afiş

- merkezli

- BE

- davranışları

- olmak

- Inanmak

- vücut

- Bot

- bina

- by

- CAN

- hangi

- durumlarda

- chatbot

- baş

- Açıkça

- Seçin

- Klinik

- bulut

- CO

- Toplama

- ticarileştirmek

- taahhüt

- karmaşık

- ilgili

- kendine güvenerek

- Onaylamak

- rıza

- Sonuçları

- içerdiği

- içindekiler

- bağlam

- kontrol

- çekirdek

- olabilir

- kritik

- Müşteriler

- veri

- Fırsatlar

- kararlar

- Reddedilmesi

- sayılır

- göstermek

- inkar

- konuşlandırılmış

- açılma

- dağıtır

- tasarlanmış

- DID

- Açıklama

- ifşa

- bozuklukları

- belgeleme

- evraklar

- yok

- düzine

- her

- sağlamak

- öz kaynak

- Hatalar

- özellikle

- kurmak

- değerlendirilir

- kanıt

- örnek

- Yöneticiler

- mevcut

- Açıklamak

- keşfetmek

- Keşfetmek

- yanlış

- Yağ

- olumlu

- korku

- geribesleme

- Nihayet

- İçin

- Sıklık

- sık sık

- itibaren

- tamamen

- oluşturmak

- üreten

- üretken

- üretken yapay zeka

- dev

- verilmiş

- Tercih Etmenizin

- Google Bulut

- Google'ın

- grup

- zararlı

- he

- Sağlık

- Sağlık Hizmetleri

- sağlık Bilgisi

- sağlık

- Sağlık sektörü

- sağlıklı

- faydalı

- Vurgulanan

- onun

- tutar

- Hastanelerinden olan İstanbul Cerrahi Hastanesi'nde

- Ne kadar

- HTTPS

- i

- if

- iyileştirmek

- in

- dahil

- dahil

- Dahil olmak üzere

- Anonim

- artmış

- sanayi

- etkileyen

- bilgi

- bilgi

- kurumları

- Internet

- tanıttı

- IT

- ONUN

- jpg

- Bilmek

- bilgi

- dil

- büyük

- kanun yapıcı

- öncülük etmek

- Kaçaklar

- mektup

- Lisans

- ruhsatlı

- lisansı

- Sınırlı

- Liste

- uzun

- Yapımı

- işaret

- pazar

- Pazar payı

- Mayıs

- tıbbi

- tıp

- olabilir

- hataları

- Azaltmak

- model

- modelleri

- izlemek

- Daha

- çoğu

- ulusal

- gerek

- yeni

- of

- sunulan

- çevrimdışı

- on

- ONE

- bir tek

- or

- organizasyonlar

- Diğer

- bizim

- dışarı

- sonuçlar

- çıktı

- tekrar

- kendi

- palmiye

- kâğıt

- Bölüm

- özellikle

- hasta

- hastalar

- İnsanlar

- hekim

- Platon

- Plato Veri Zekası

- PlatoVeri

- Lütfen

- noktaları

- potansiyel

- Erken

- sundu

- basınç

- önlemek

- Önceden

- gizlilik

- PLATFORM

- profesyoneller

- korumalı

- sağlanan

- Yayın

- alenen

- amaç

- koymak

- sorgular

- Sorular

- Yarış

- yükseltilmiş

- yükseltmeler

- daha doğrusu

- RE

- son

- kurtarma

- güven

- temsilci

- araştırma

- Araştırmacılar

- yanıt

- yanıt

- tutmak

- tespit

- Risk

- riskler

- acele

- s

- güvenli

- Güvenlik

- Adı geçen

- Senato

- Senatör

- hassas

- Duyarlılık

- Setleri

- ayar

- ayarlar

- paylaş

- meli

- So

- Yazılım

- Birisi

- sözcüsü

- Açıklama

- adım

- Basamaklar

- saklı

- özetlemek

- Sundar Pichai

- sistem

- alınan

- Teknoloji

- şartlar

- test edilmiş

- test

- Test yapmak

- o

- The

- ve bazı Asya

- Onları

- kendilerini

- içinde

- Bunlar

- Re-Tweet

- Bu

- İçinden

- titan

- için

- bugün

- aldı

- Tren

- eğitilmiş

- Eğitim

- trenler

- Dönüştürmek

- muazzam

- Güven

- Uk

- altında

- şüphesiz

- aktüel

- us

- biz kanun koyucu

- kullanım

- Kullanılmış

- versiyon

- Virjinya

- istiyor

- Warner

- oldu

- we

- ağ

- haftalık

- tartmak

- İYİ

- vardı

- Ne

- ne zaman

- olup olmadığını

- hangi

- süre

- ile

- olmadan

- endişe

- olur

- yazılı

- yazdı

- yıl

- zefirnet