Giriş

Makine öğreniminde, sapma-varyans değiş tokuşu, herhangi bir tahmine dayalı modelin performansını etkileyen temel bir kavramdır. Her ikisini aynı anda en aza indirmek imkansız olduğundan, bir modelin yanlılık hatası ile varyans hatası arasındaki hassas dengeyi ifade eder. Doğru dengeyi bulmak, optimum model performansı elde etmek için çok önemlidir.

Bu kısa makalede önyargı ve varyansı tanımlayacak, bunların bir makine öğrenimi modelini nasıl etkilediğini açıklayacak ve pratikte bunlarla nasıl başa çıkılacağına dair bazı pratik tavsiyeler vereceğiz.

Yanlılığı ve Varyansı Anlamak

Önyargı ve varyans arasındaki ilişkiye dalmadan önce, bu terimlerin makine öğreniminde neyi temsil ettiğini tanımlayalım.

Önyargı hatası, bir modelin tahmini ile tahmin etmeye çalıştığı doğru değerler (temel gerçek) arasındaki farkı ifade eder. Başka bir deyişle, yanlılık, bir modelin altında yatan veri dağılımı hakkındaki yanlış varsayımları nedeniyle yaptığı hatadır. Yüksek önyargılı modeller genellikle çok basittir, verilerin karmaşıklığını yakalayamaz ve bu da yetersiz uydurmaya yol açar.

Varyans hatası ise modelin eğitim verilerindeki küçük dalgalanmalara duyarlılığını ifade eder. Yüksek varyanslı modeller aşırı derecede karmaşıktır ve altta yatan kalıptan ziyade verilerdeki gürültüyü sığdırma eğilimindedir ve bu da fazla uydurmaya yol açar. Bu, yeni, görünmeyen verilerde düşük performansa neden olur.

Yüksek yanlılık, modelin verilerin karmaşıklığını yakalayamayacak kadar basit olduğu durumlarda yetersiz uydurmaya yol açabilir. Veriler hakkında güçlü varsayımlarda bulunur ve girdi ile çıktı değişkenleri arasındaki gerçek ilişkiyi yakalayamaz. Öte yandan, yüksek varyans, modelin çok karmaşık olduğu ve girdi ve çıktı değişkenleri arasındaki temel ilişkiden ziyade verilerdeki gürültüyü öğrendiği aşırı uydurmaya yol açabilir. Bu nedenle, aşırı uydurma modelleri, eğitim verilerini çok yakın bir şekilde uydurma eğilimindedir ve yeni verilere iyi genelleme yapmazken, yetersiz uydurma modelleri, eğitim verilerini doğru bir şekilde sığdıramaz.

Daha önce bahsedildiği gibi, yanlılık ve varyans birbiriyle ilişkilidir ve iyi bir model, yanlılık hatası ile varyans hatası arasında denge kurar. Yanlılık-varyans değiş tokuşu, bu iki hata kaynağı arasındaki optimal dengeyi bulma sürecidir. Düşük yanlılık ve düşük varyansa sahip bir model, muhtemelen hem eğitim hem de yeni veriler üzerinde iyi performans göstererek toplam hatayı en aza indirecektir.

Önyargı Varyans Takası

Model karmaşıklığı ile bilinmeyen verilere genelleştirme yeteneği arasında bir dengeye ulaşmak, sapma-varyans ödünleşiminin özüdür. Genel olarak, daha karmaşık bir model daha düşük sapmaya ancak daha yüksek varyansa sahip olurken, daha basit bir model daha yüksek sapmaya ancak daha düşük varyansa sahip olacaktır.

Yanlılığı ve varyansı aynı anda en aza indirmek imkansız olduğundan, sağlam bir makine öğrenimi modeli oluşturmak için aralarındaki optimum dengeyi bulmak çok önemlidir. Örneğin, bir modelin karmaşıklığını artırdıkça varyansı da artırmış oluyoruz. Bunun nedeni, daha karmaşık bir modelin eğitim verilerindeki gürültüye uyma olasılığının daha yüksek olmasıdır, bu da fazla uydurmaya yol açacaktır.

Öte yandan, modeli çok basit tutarsak sapmayı artırmış oluruz. Bunun nedeni, daha basit bir modelin verilerdeki altta yatan ilişkileri yakalayamayacak olması ve bunun da yetersiz uyuma yol açmasıdır.

Amaç, eğitim verilerindeki temel ilişkileri yakalayacak kadar karmaşık, ancak eğitim verilerindeki gürültüye uyacak kadar karmaşık olmayan bir model yetiştirmektir.

Uygulamada Önyargı-Varyans Dengeleme

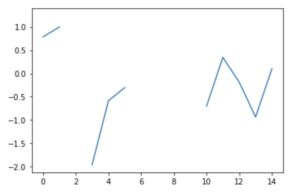

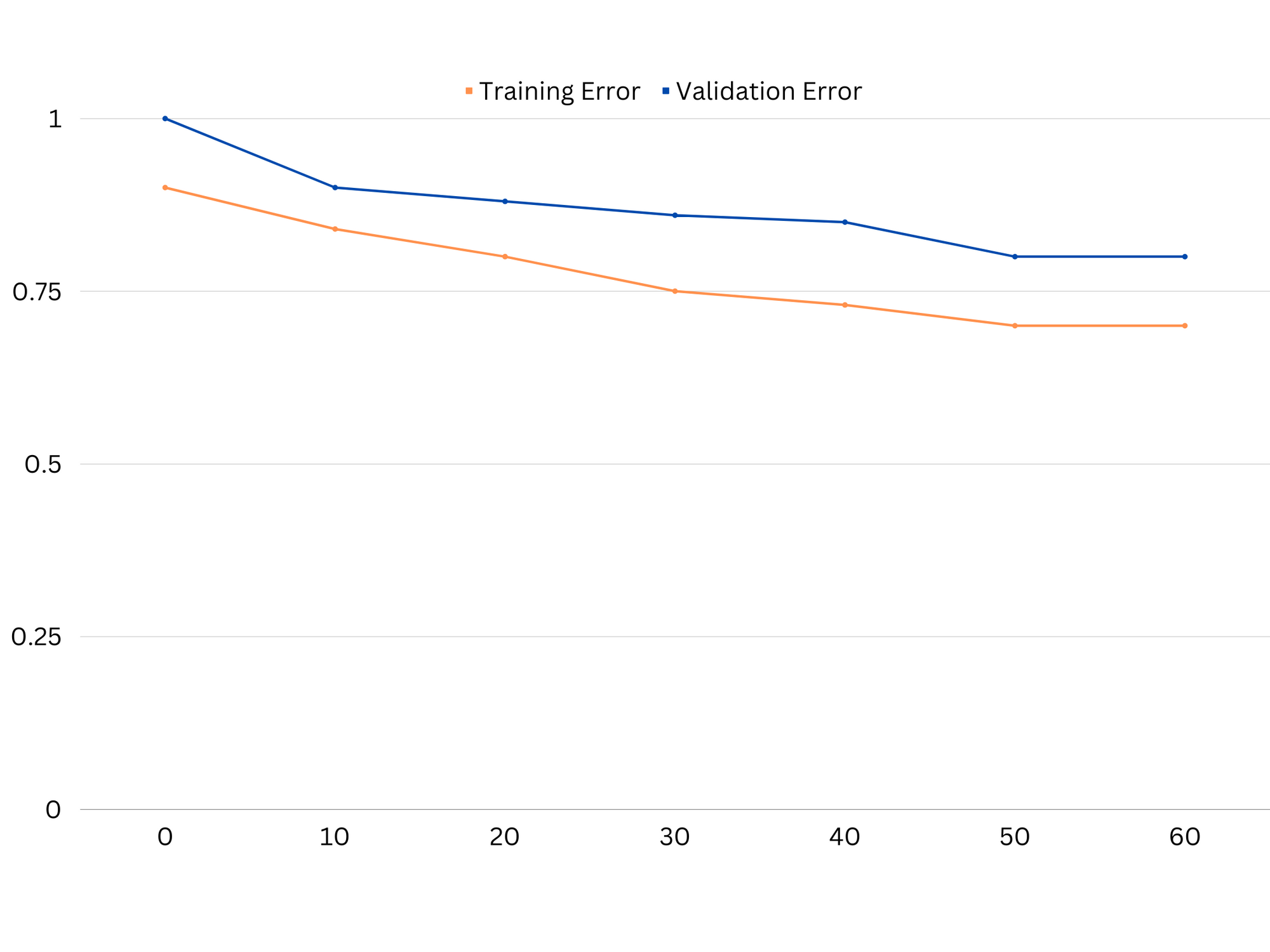

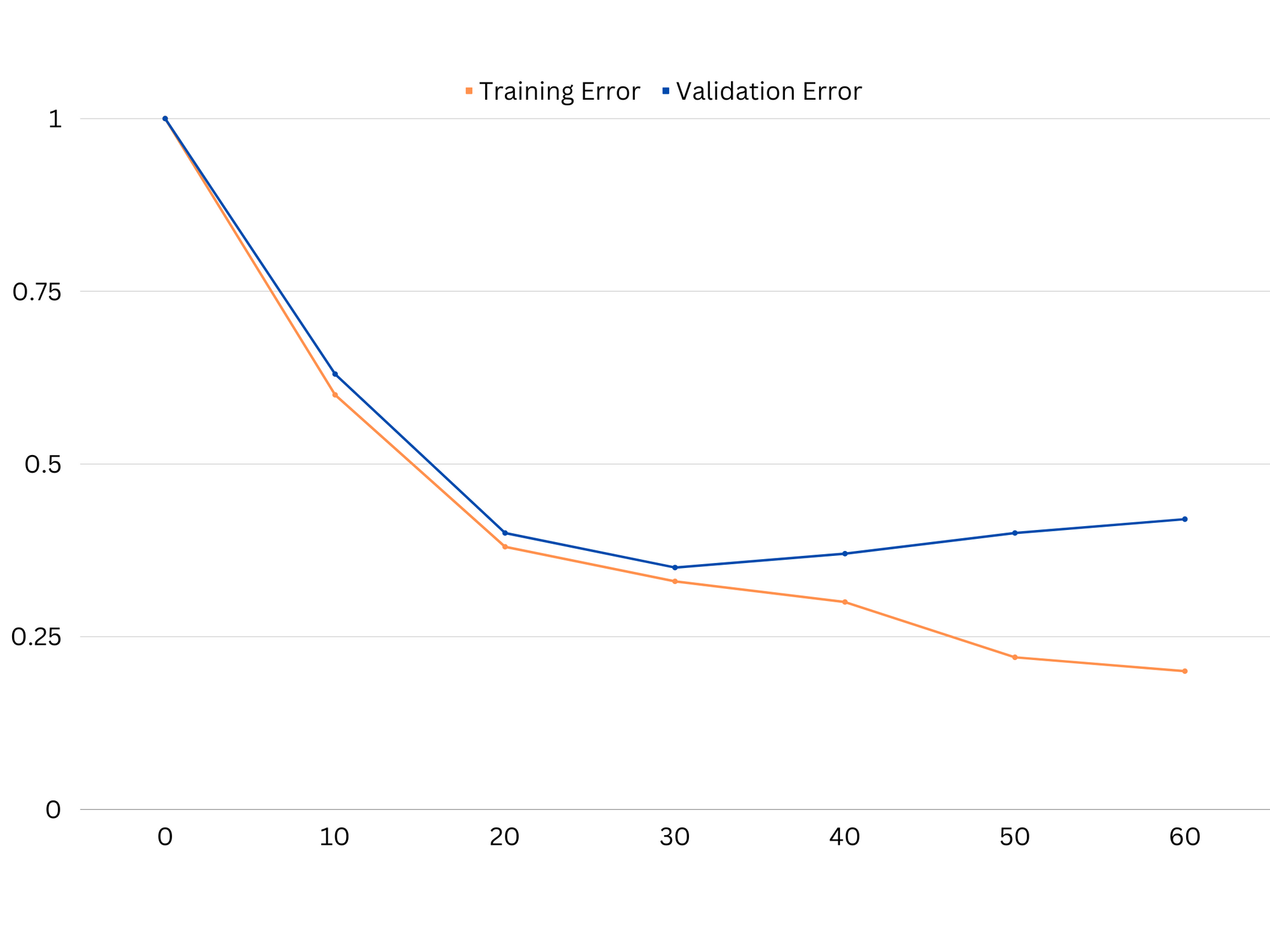

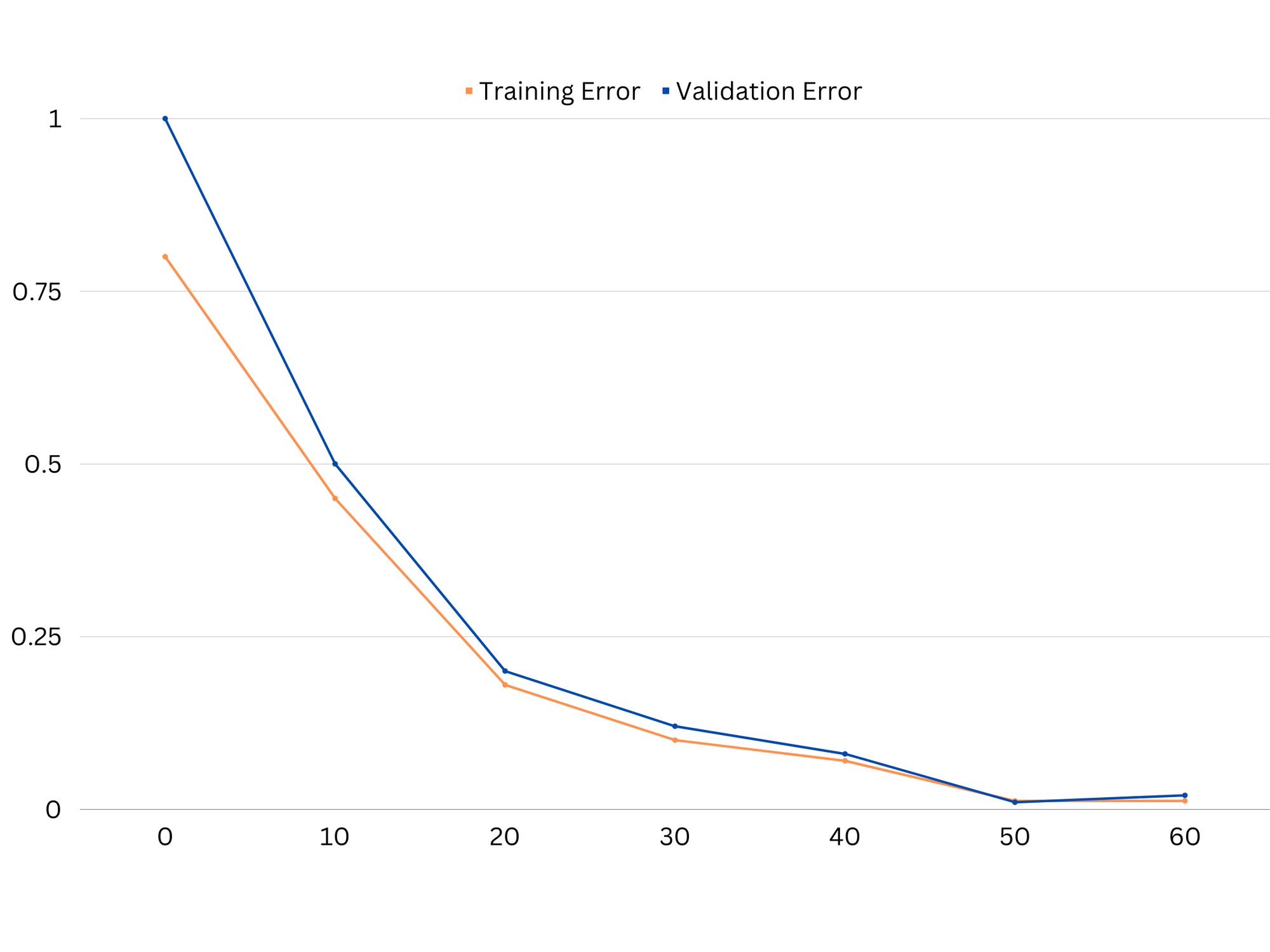

Model performansını teşhis etmek için genellikle tren ve doğrulama hatalarını hesaplar ve karşılaştırırız. Bunu görselleştirmek için yararlı bir araç, modelin eğitim süreci boyunca hem tren hem de doğrulama verilerindeki performansını gösteren öğrenme eğrilerinin bir grafiğidir. Bu eğrileri inceleyerek, bir modelin fazla uydurma (yüksek varyans), yetersiz uydurma (yüksek sapma) veya iyi uydurma (sapma ve varyans arasındaki optimum denge) olup olmadığını belirleyebiliriz.

Yetersiz oturan bir modelin öğrenme eğrilerine örnek. Hem tren hatası hem de doğrulama hatası yüksektir.

Uygulamada, hem eğitim hem de doğrulama verilerindeki düşük performans, modelin çok basit olduğunu ve yetersiz uydurmaya yol açtığını gösterir. Öte yandan, model eğitim verilerinde çok iyi ancak test verilerinde düşük performans gösteriyorsa, model karmaşıklığı muhtemelen çok yüksektir ve bu da aşırı uydurmaya neden olur. Eksik uyumu ele almak için, daha fazla özellik ekleyerek, öğrenme algoritmasını değiştirerek veya farklı hiperparametreler seçerek model karmaşıklığını artırmayı deneyebiliriz. Aşırı uydurma durumunda, genelleştirme yeteneklerini geliştirmek için modeli düzenli hale getirmeyi veya çapraz doğrulama gibi teknikleri kullanmayı düşünmeliyiz.

Aşırı uydurma modelinin öğrenme eğrilerine örnek. Tren hatası azalırken doğrulama hatası artmaya başlar. Model genelleme yapamaz.

Düzenleme, makine öğrenimi modellerindeki varyans hatasını azaltmak için kullanılabilen bir tekniktir ve önyargı-varyans değiş tokuşunun ele alınmasına yardımcı olur. Her biri kendi avantaj ve dezavantajlarına sahip bir dizi farklı düzenlileştirme tekniği vardır. Bazı popüler düzenlileştirme teknikleri, sırt regresyonu, kement regresyonu ve elastik ağ düzenlemesini içerir. Tüm bu teknikler, modelin amaç fonksiyonuna aşırı parametre değerlerini engelleyen ve daha basit modelleri teşvik eden bir ceza terimi ekleyerek fazla uydurmanın önlenmesine yardımcı olur.

sırt regresyonuL2 düzenlemesi olarak da bilinen , model parametrelerinin karesiyle orantılı bir ceza terimi ekler. Bu teknik, daha küçük parametre değerlerine sahip modellerle sonuçlanma eğilimindedir, bu da azaltılmış varyansa ve geliştirilmiş genellemeye yol açabilir. Ancak özellik seçimi yapmadığı için tüm özellikler modelde kalır.

En iyi uygulamalar, endüstri tarafından kabul edilen standartlar ve dahil edilen hile sayfası ile Git'i öğrenmek için uygulamalı, pratik kılavuzumuza göz atın. Googling Git komutlarını durdurun ve aslında öğrenmek o!

Kement gerilemesiveya L1 düzenlemesi, model parametrelerinin mutlak değeriyle orantılı bir ceza terimi ekler. Bu teknik, bazı parametreleri sıfıra ayarlayarak özellik seçimini etkili bir şekilde gerçekleştirerek, seyrek parametre değerlerine sahip modellere yol açabilir. Bu, yorumlanması daha kolay olan daha basit modellerle sonuçlanabilir.

Esnek net düzenleme sırt ve kement regresyon arasında bir denge sağlayan, hem L1 hem de L2 düzenlemesinin bir kombinasyonudur. Esnek ağ, iki ceza terimi arasındaki oranı kontrol ederek, gelişmiş genelleme ve özellik seçimi gibi her iki tekniğin de faydalarını elde edebilir.

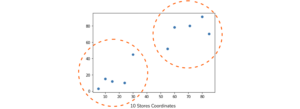

İyi uyum modelinin öğrenme eğrilerine örnek.

Sonuç

Yanlılık-varyans değiş tokuşu, makine öğreniminde bir modelin etkinliğini ve iyiliğini belirleyen çok önemli bir kavramdır. Yüksek yanlılık yetersiz uydurmaya ve yüksek varyans fazla uydurmaya yol açarken, yeni verilere iyi genelleme yapan sağlam modeller oluşturmak için ikisi arasındaki optimum dengeyi bulmak gereklidir.

Öğrenme eğrilerinin yardımıyla, fazla uydurma veya yetersiz uydurma problemlerini belirlemek mümkündür ve modelin karmaşıklığını ayarlayarak veya düzenlileştirme tekniklerini uygulayarak hem eğitim hem de doğrulama verilerinin yanı sıra test verilerindeki performansı iyileştirmek mümkündür.

- SEO Destekli İçerik ve Halkla İlişkiler Dağıtımı. Bugün Gücünüzü Artırın.

- PlatoAiStream. Web3 Veri Zekası. Bilgi Genişletildi. Buradan Erişin.

- Adryenn Ashley ile Geleceği Basmak. Buradan Erişin.

- PREIPO® ile PRE-IPO Şirketlerinde Hisse Al ve Sat. Buradan Erişin.

- Kaynak: https://stackabuse.com/the-bias-variance-trade-off-in-machine-learning/

- :dır-dir

- :olumsuzluk

- :Neresi

- 1

- 12

- 20

- 8

- a

- kabiliyet

- Yapabilmek

- Hakkımızda

- kesin

- tam olarak

- Başarmak

- elde

- aslında

- ekleme

- adres

- Ekler

- avantajları

- tavsiye

- etkiler

- etkileyen

- algoritma

- Türkiye

- Izin

- Ayrıca

- an

- ve

- herhangi

- ARE

- göre

- AS

- Bakiye

- bakiyeler

- BE

- Çünkü

- faydaları

- arasında

- önyargı

- sınır

- her ikisi de

- bina

- fakat

- by

- hesaplamak

- CAN

- yetenekleri

- ele geçirmek

- dava

- değiştirme

- seçme

- yakından

- kombinasyon

- karşılaştırmak

- karmaşık

- karmaşıklık

- kavram

- Düşünmek

- kontrol

- çekirdek

- doğru

- çok önemli

- veri

- anlaşma

- azalır

- Belirlemek

- belirleyen

- fark

- farklı

- görüntüler

- dağıtım

- yok

- gereken

- her

- Daha erken

- kolay

- etkili bir şekilde

- etki

- teşvik

- yeterli

- hata

- Hatalar

- Hatta

- incelenmesi

- örnek

- Açıklamak

- aşırı

- başarısız

- başarısız

- Özellikler(Hazırlık aşamasında)

- Özellikler

- bulma

- uygun

- uydurma

- dalgalanmalar

- odak

- İçin

- işlev

- temel

- genel

- Git

- gol

- Tercih Etmenizin

- Zemin

- rehberlik

- el

- hands-on

- Var

- yardım et

- yardım

- Yüksek

- daha yüksek

- duraksamak

- Ne kadar

- Nasıl Yapılır

- Ancak

- HTTPS

- belirlemek

- if

- uygulanması

- imkânsız

- iyileştirmek

- gelişmiş

- in

- Diğer

- dahil

- dahil

- Artırmak

- artan

- giriş

- içine

- Giriş

- IT

- ONUN

- tutmak

- bilinen

- L1

- l2

- öncülük etmek

- önemli

- İlanlar

- öğrenme

- izin

- LG

- sevmek

- Muhtemelen

- ll

- Düşük

- alt

- makine

- makine öğrenme

- YAPAR

- adı geçen

- minimize

- model

- modelleri

- Daha

- gerekli

- net

- yeni

- Gürültü

- numara

- nesnel

- of

- sık sık

- on

- optimum

- or

- Diğer

- bizim

- dışarı

- çıktı

- kendi

- parametre

- parametreler

- model

- Yapmak

- performans

- icra

- gerçekleştirir

- Platon

- Plato Veri Zekası

- PlatoVeri

- yoksul

- Popüler

- mümkün

- Pratik

- uygulama

- tahmin

- tahmin

- önlemek

- sorunlar

- süreç

- sağlamak

- daha doğrusu

- oran

- azaltmak

- Indirimli

- ifade eder

- ilgili

- ilişki

- İlişkiler

- kalmak

- temsil etmek

- sonuç

- Ortaya çıkan

- Sonuçlar

- krallar gibi yaşamaya

- Yüzük

- gürbüz

- s

- seçim

- Duyarlılık

- ayar

- gölge

- yaprak

- kısa

- meli

- Basit

- aynı anda

- küçük

- daha küçük

- So

- biraz

- kaynaklar

- kare

- Yığın kötüye kullanımı

- standartlar

- dur

- güçlü

- böyle

- Önerdi

- teknikleri

- dönem

- şartlar

- test

- göre

- o

- The

- ve bazı Asya

- Onları

- Orada.

- Bunlar

- onlar

- Re-Tweet

- boyunca

- için

- çok

- araç

- Toplam

- Tren

- Eğitim

- geçiş

- gerçek

- Hakikat

- denemek

- iki

- tipik

- aciz

- altında yatan

- bilinmeyen

- Kullanılmış

- kullanma

- onaylama

- değer

- Değerler

- çok

- we

- İYİ

- Ne

- olup olmadığını

- hangi

- süre

- irade

- ile

- sözler

- zefirnet

- sıfır