У світі штучного інтелекту (AI) і машинного навчання (ML) відбувається зміна парадигми з появою генеративних моделей AI, які можуть створювати текст, зображення, код і аудіо, схожі на людину. Порівняно з класичними моделями ML, генеративні моделі ШІ значно більші та складніші. Однак їхня зростаюча складність також супроводжується високою вартістю висновків і зростаючою потребою в потужних обчислювальних ресурсах. Висока вартість висновків для генеративних моделей штучного інтелекту може стати перешкодою для підприємств і дослідників з обмеженими ресурсами, що зумовлює потребу в більш ефективних і рентабельних рішеннях. Крім того, більшість випадків використання генеративного штучного інтелекту включають взаємодію людини або сценарії реального світу, що вимагає обладнання, яке може забезпечити продуктивність із низькою затримкою. AWS впроваджує інновації, створюючи спеціально розроблені чіпи, щоб задовольнити зростаючу потребу в потужному, ефективному та економічно вигідному обчислювальному обладнанні.

Сьогодні ми раді повідомити про це Amazon SageMaker опори AWS Inferentia2 (ml.inf2) і AWS Trainium (ml.trn1) екземпляри SageMaker для розміщення генеративних моделей ШІ для асинхронного висновку в реальному часі. Екземпляри ml.inf2 доступні для розгортання моделі на SageMaker на сході США (Огайо) та екземпляри ml.trn1 на сході США (Північна Вірджинія).

Ви можете використовувати ці екземпляри на SageMaker для досягнення високої продуктивності за низькою ціною для генеративних моделей AI, включаючи великі мовні моделі (LLM), стабільну дифузію та трансформатори зору. Крім того, можна використовувати Amazon SageMaker Inference Recommender щоб допомогти вам запустити навантажувальні тести та оцінити переваги ціни та ефективності розгортання вашої моделі на цих екземплярах.

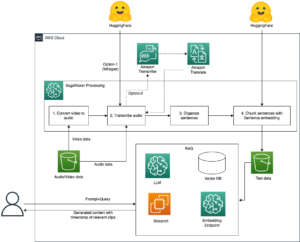

Ви можете використовувати екземпляри ml.inf2 і ml.trn1 для запуску програм ML на SageMaker для узагальнення тексту, створення коду, створення відео та зображень, розпізнавання мовлення, персоналізації, виявлення шахрайства тощо. Ви можете легко розпочати, вказавши екземпляри ml.trn1 або ml.inf2 під час налаштування кінцевої точки SageMaker. Ви можете використовувати сумісні з ml.trn1 і ml.inf2 контейнери AWS Deep Learning Containers (DLC) для PyTorch, TensorFlow, Hugging Face і Large Model Inference (LMI), щоб легко розпочати роботу. Повний список із версіями див Доступні зображення контейнерів глибокого навчання.

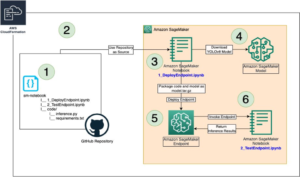

У цій публікації ми показуємо процес розгортання великої мовної моделі на AWS Inferentia2 за допомогою SageMaker, не вимагаючи додаткового кодування, використовуючи переваги контейнера LMI. Ми використовуємо GPT4ALL-J, налаштована модель GPT-J 7B, яка забезпечує взаємодію у стилі чат-бота.

Огляд екземплярів ml.trn1 і ml.inf2

Екземпляри ml.trn1 працюють на основі прискорювача Trainium, спеціально створеного в основному для високопродуктивного глибокого навчання генеративних моделей штучного інтелекту, включаючи LLM. Однак ці екземпляри також підтримують робочі навантаження висновків для моделей, які навіть більші, ніж те, що вписується в Inf2. Найбільший розмір екземпляра, trn1.32xlarge, має 16 функцій Тренієві прискорювачі з 512 ГБ пам’яті прискорювача в одному екземплярі забезпечує до 3.4 петафлопс обчислювальної потужності FP16/BF16. 16 прискорювачів Trainium підключені до надшвидкісного NeuronLinkv2 для спрощеного колективного спілкування.

Екземпляри ml.Inf2 працюють на базі Прискорювач AWS Inferentia2, спеціально створений прискорювач для висновків. Він забезпечує втричі вищу обчислювальну продуктивність, до чотирьох разів вищу пропускну здатність і до 10 разів меншу затримку порівняно з AWS Inferentia першого покоління. Найбільший розмір екземпляра, Inf2.48xlarge, містить 12 прискорювачів AWS Inferentia2 із 384 ГБ пам’яті прискорювача в одному екземплярі для сумарної обчислювальної потужності 2.3 петафлопс для BF16/FP16. Це дозволяє розгортати модель із 175 мільярдами параметрів в одному екземплярі. Inf2 — єдиний екземпляр, оптимізований для виводу, який пропонує це взаємоз’єднання, функція, яка доступна лише в дорожчих екземплярах навчання. Для надвеликих моделей, які не вміщуються в один прискорювач, дані передаються безпосередньо між прискорювачами за допомогою NeuronLink, повністю минаючи ЦП. Завдяки NeuronLink Inf2 підтримує швидший розподілений висновок і покращує пропускну здатність і затримку.

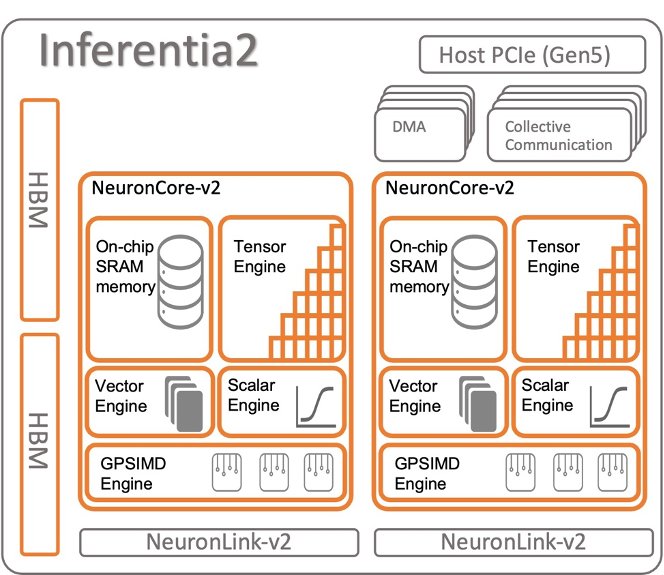

І прискорювачі AWS Inferentia2, і Trainium мають по два NeuronCores-v2, стеки пам’яті HBM об’ємом 32 ГБ і спеціальні механізми колективного обчислення, які автоматично оптимізують час виконання, накладаючи обчислення та зв’язок під час виконання висновків із кількома прискорювачами. Докладніше про архітектуру див Апарати Trainium та Inferentia.

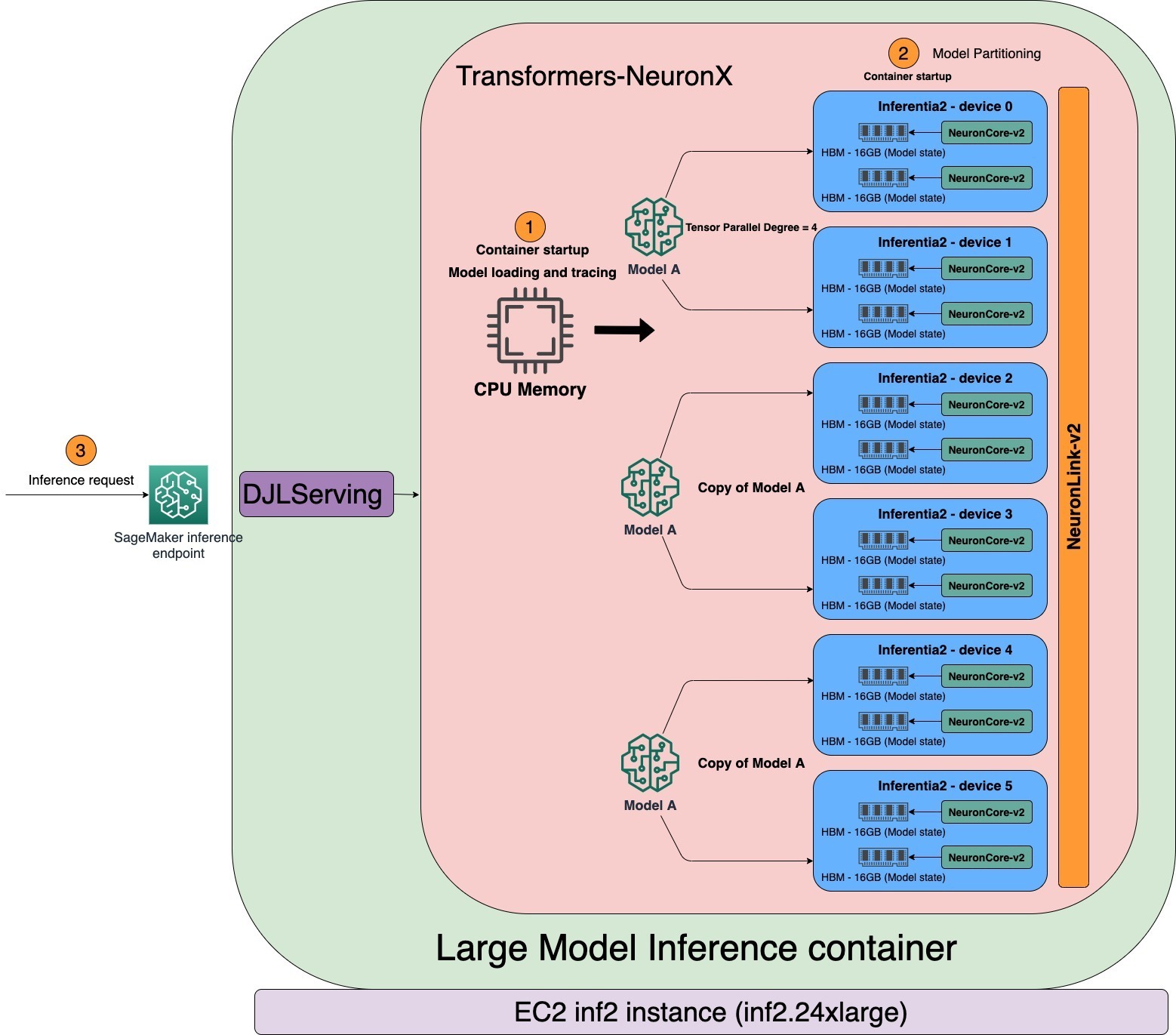

На наступній діаграмі показано приклад архітектури з використанням AWS Inferentia2.

AWS Neuron SDK

AWS нейрон це SDK, який використовується для виконання робочих навантажень глибокого навчання на примірниках на основі AWS Inferentia та Trainium. AWS Neuron включає компілятор глибокого навчання, середовище виконання та інструменти, які вбудовано в TensorFlow і PyTorch. За допомогою Neuron ви можете розробляти, профілювати та розгортати високопродуктивні робочі навантаження ML на ml.trn1 та ml.inf2.

Команда Компілятор нейронів приймає моделі ML у різних форматах (TensorFlow, PyTorch, XLA HLO) і оптимізує їх для роботи на пристроях Neuron. Компілятор Neuron викликається в рамках ML framework, де моделі ML надсилаються до компілятора плагіном Neuron framework. Отриманий артефакт компілятора називається файлом NEFF (формат виконуваного файлу Neuron), який, у свою чергу, завантажується середовищем виконання Neuron на пристрій Neuron.

Команда Час роботи нейрона складається з драйвера ядра та бібліотек C/C++, які надають API для доступу до пристроїв AWS Inferentia та Trainium Neuron. Плагіни фреймворків Neuron ML для TensorFlow і PyTorch використовують середовище виконання Neuron для завантаження та запуску моделей на NeuronCores. Середовище виконання Neuron завантажує скомпільовані моделі глибокого навчання (NEFF) на пристрої Neuron і оптимізовано для високої пропускної здатності та низької затримки.

Розміщуйте моделі NLP за допомогою екземплярів SageMaker ml.inf2

Перш ніж ми заглибимося в обслуговування LLM з трансформери-нейронкс, яка є бібліотекою з відкритим вихідним кодом для розподілу великих вагових матриць моделі на кілька NeuronCores, давайте коротко розглянемо типовий процес розгортання моделі, яка може поміститися в один NeuronCore.

Перевірте список підтримуваних моделей щоб переконатися, що модель підтримується на AWS Inferentia2. Далі модель має бути попередньо скомпільована компілятором Neuron. Ви можете використовувати блокнот SageMaker або Обчислювальна хмара Amazon Elastic (Amazon EC2) для компіляції моделі. Ви можете використовувати SageMaker Python SDK для розгортання моделей за допомогою популярних фреймворків глибокого навчання, таких як PyTorch, як показано в наступному коді. Ви можете розгорнути свою модель у службах хостингу SageMaker і отримати кінцеву точку, яку можна використовувати для висновків. Ці кінцеві точки повністю керовані та підтримують автоматичне масштабування.

Відноситься до Потоки розробника щоб дізнатися більше про типові потоки розробки Inf2 на SageMaker із зразками сценаріїв.

Розміщуйте LLM за допомогою екземплярів SageMaker ml.inf2

Великі мовні моделі з мільярдами параметрів часто занадто великі, щоб поміститися на один прискорювач. Це зумовлює необхідність використання модельних паралельних методів для розміщення LLM на кількох прискорювачах. Іншою важливою вимогою для розміщення LLM є впровадження високопродуктивного рішення для обслуговування моделей. Це рішення має ефективно завантажувати модель, керувати розділенням і безперешкодно обслуговувати запити через кінцеві точки HTTP.

SageMaker містить спеціалізовані контейнери глибокого навчання (DLC), бібліотеки та інструменти для паралелізму моделей і виведення великих моделей. Ресурси для початку роботи з LMI на SageMaker див Паралелізм моделі та висновок великої моделі. SageMaker підтримує DLC з популярними бібліотеками з відкритим кодом для розміщення великих моделей, таких як GPT, T5, OPT, BLOOM і Stable Diffusion, в інфраструктурі AWS. Ці спеціалізовані DLC називають контейнерами SageMaker LMI.

Контейнери SageMaker LMI використовуйте DJLServing, сервер моделі, інтегрований з бібліотекою transformers-neuronx для підтримки тензорного паралелізму в NeuronCores. Щоб дізнатися більше про те, як працює DJLServing, див Розгортайте великі моделі на Amazon SageMaker за допомогою паралельного висновку моделі DJLServing і DeepSpeed. Сервер моделі DJL і бібліотека transformers-neuronx служать основними компонентами контейнера, який також включає Neuron SDK. Це налаштування полегшує завантаження моделей на прискорювачі AWS Inferentia2, розпаралелює модель у кількох NeuronCores і забезпечує обслуговування через кінцеві точки HTTP.

Контейнер LMI підтримує завантаження моделей із Служба простого зберігання Amazon (Amazon S3) відро або Hugging Face Hub. Сценарій обробки за замовчуванням завантажує модель, компілює та перетворює її у формат, оптимізований для Neuron, і завантажує її. Щоб використовувати контейнер LMI для розміщення LLM, у нас є два варіанти:

- Без коду (бажано) – Це найпростіший спосіб розгорнути LLM за допомогою контейнера LMI. У цьому способі можна використовувати надані обробник за замовчуванням і просто передайте назву моделі та необхідні параметри

serving.propertiesфайл для завантаження та розміщення моделі. Щоб використовувати обробник за замовчуванням, ми надаємоentryPointпараметр якdjl_python.transformers-neuronx. - Принесіть власний сценарій – У цьому підході у вас є можливість створити власний файл model.py, який містить код, необхідний для завантаження та обслуговування моделі. Цей файл діє як посередник між

DJLServingAPI таtransformers-neuronxAPI. Щоб налаштувати процес завантаження моделі, ви можете надатиserving.propertiesз настроюваними параметрами. Повний перелік доступних настроюваних параметрів див Усі параметри конфігурації DJL. Ось приклад а model.py файлу.

Архітектура середовища виконання

Команда tensor_parallel_degree значення властивості визначає розподіл тензорних паралельних модулів між кількома NeuronCores. Наприклад, inf2.24xlarge має шість прискорювачів AWS Inferentia2. Кожен прискорювач AWS Inferentia2 має два NeuronCores. Кожен NeuronCore має виділену пам’ять високої пропускної здатності (HBM) розміром 16 ГБ, де зберігаються тензорні паралельні модулі. З тензорним паралельним ступенем 4 LMI виділить три копії моделі однієї моделі, кожна з яких використовує чотири NeuronCores. Як показано на наступній діаграмі, коли контейнер LMI запускається, модель спочатку завантажується та трасується в адресній пам’яті ЦП. Коли трасування завершено, модель розділяється на NeuronCores на основі ступеня паралельності тензора.

LMI використовує DJLServing як стек для обслуговування моделей. Після проходження перевірки працездатності контейнера в SageMaker контейнер готовий обслуговувати запит на висновок. DJLServing запускає кілька процесів Python, еквівалентних TOTAL NUMBER OF NEURON CORES/TENSOR_PARALLEL_DEGREE. Кожен процес Python містить потоки, еквівалентні C++ TENSOR_PARALLEL_DEGREE. Кожен потік C++ містить один шард моделі на одному NeuronCore.

Багато практиків (процес Python) прагнуть виконувати висновок послідовно, коли сервер викликається кількома незалежними запитами. Хоча його легше налаштувати, зазвичай не найкраще використовувати обчислювальну потужність прискорювача. Щоб вирішити цю проблему, DJLServing пропонує вбудовану оптимізацію динамічного пакетування, щоб об’єднати ці незалежні запити висновків на стороні сервера, щоб динамічно сформувати більший пакет для збільшення пропускної здатності. Усі запити спочатку надходять до динамічного дозатора перед тим, як увійти до фактичних черг завдань для очікування висновку. Ви можете встановити бажані розміри пакетів для динамічного пакетування за допомогою batch_size налаштування в serving.properties. Ви також можете налаштувати max_batch_delay щоб вказати максимальний час затримки в пакеті для очікування інших запитів на приєднання до пакета на основі ваших вимог до затримки. Пропускна здатність також залежить від кількості копій моделі та груп процесів Python, запущених у контейнері. Як показано на наступній діаграмі, зі ступенем паралельності тензора, встановленим на 4, контейнер LMI запускає три групи процесів Python, кожна з яких містить повну копію моделі. Це дозволяє збільшити розмір партії та отримати більшу пропускну здатність.

Блокнот SageMaker для розгортання LLM

У цьому розділі ми надаємо покрокову інструкцію з розгортання GPT4All-J, моделі з 6 мільярдами параметрів, яка становить 24 ГБ у FP32. GPT4All-J — це популярний чат-бот, який навчено працювати з різноманітним контентом для взаємодії, як-от текстові задачі, діалоги, код, вірші, пісні та історії. GPT4all-J — це точно налаштована модель GPT-J, яка генерує відповіді, подібні до взаємодії людей.

Повний блокнот для цього прикладу надано на GitHub. Ми можемо використовувати SageMaker Python SDK для розгортання моделі в екземплярі Inf2. Використовуємо надані обробник за замовчуванням щоб завантажити модель. Для цього нам просто потрібно надати a порції.властивості файл. Цей файл містить необхідні конфігурації для сервера моделі DJL для завантаження та розміщення моделі. Ми можемо вказати назву моделі Hugging Face за допомогою model_id параметр для завантаження моделі безпосередньо зі сховища Hugging Face. Крім того, ви можете завантажити модель з Amazon S3, надавши s3url параметр. The entryPoint параметр налаштовано так, щоб вказувати на бібліотеку для завантаження моделі. Для більш детальної інформації на djl_python.fastertransformer, див Код GitHub.

Команда tensor_parallel_degree Значення властивості визначає розподіл тензорних паралельних модулів між кількома пристроями. Наприклад, з 12 NeuronCores і тензорним паралельним ступенем 4 LMI виділить три копії моделі, кожна з яких використовує чотири NeuronCores. Ви також можете визначити тип точності за допомогою властивості dtype. n_position Параметр визначає суму максимальної довжини вхідної та вихідної послідовності для моделі. Перегляньте наступний код:

Побудуйте tarball що містить serving.properties і завантажте його в сегмент S3. Хоча в цьому прикладі використовується обробник за замовчуванням, ви можете розробити a model.py файл для налаштування процесу завантаження та обслуговування. Якщо є якісь пакунки, які потребують встановлення, додайте їх до requirements.txt файл. Перегляньте наступний код:

Отримайте зображення контейнера DJL і створіть модель SageMaker:

Далі ми створюємо кінцеву точку SageMaker із конфігурацією моделі, визначеною раніше. Контейнер завантажує модель у /tmp простір, оскільки SageMaker відображає /tmp до Магазин еластичних блоків Amazon (Amazon EBS). Нам потрібно додати a volume_size параметр для забезпечення /tmp у каталозі достатньо місця для завантаження та компіляції моделі. Ми поставили container_startup_health_check_timeout до 3,600 секунд, щоб забезпечити початок перевірки працездатності після того, як модель буде готова. Ми використовуємо екземпляр ml.inf2.8xlarge. Перегляньте наступний код:

Після створення кінцевої точки SageMaker ми можемо робити прогнози в реальному часі щодо кінцевих точок SageMaker за допомогою Predictor об’єкт:

Прибирати

Видаліть кінцеві точки, щоб заощадити кошти після завершення тестів:

Висновок

У цій публікації ми продемонстрували нещодавно запущену можливість SageMaker, яка тепер підтримує екземпляри ml.inf2 і ml.trn1 для розміщення генеративних моделей ШІ. Ми продемонстрували, як розгорнути GPT4ALL-J, генеративну модель штучного інтелекту, на AWS Inferentia2 за допомогою SageMaker і контейнера LMI без написання коду. Ми також продемонстрували, як ви можете використовувати DJLServing і transformers-neuronx щоб завантажити модель, розділити її та подавати.

Екземпляри Inf2 забезпечують найбільш економічно ефективний спосіб запуску генеративних моделей ШІ на AWS. Щоб дізнатися більше про продуктивність, див Продуктивність Inf2.

Від'їзд GitHub репо для прикладу блокнота. Спробуйте й повідомте нам, якщо у вас виникнуть запитання!

Про авторів

Вівек Гангасані є старшим архітектором рішень машинного навчання в Amazon Web Services. Він працює зі стартапами з машинного навчання, щоб створювати та розгортати програми AI/ML на AWS. Зараз він зосереджений на розробці рішень для MLOps, ML Inference та ML з низьким кодом. Він працював над проектами в різних областях, включаючи обробку природної мови та комп’ютерне бачення.

Вівек Гангасані є старшим архітектором рішень машинного навчання в Amazon Web Services. Він працює зі стартапами з машинного навчання, щоб створювати та розгортати програми AI/ML на AWS. Зараз він зосереджений на розробці рішень для MLOps, ML Inference та ML з низьким кодом. Він працював над проектами в різних областях, включаючи обробку природної мови та комп’ютерне бачення.

Хіроші Токойо є архітектором рішень в AWS Annapurna Labs. Перебуваючи в Японії, він приєднався до Annapurna Labs ще до придбання компанією AWS і постійно допомагав клієнтам із технологіями Annapurna Labs. Останнім часом він зосереджується на рішеннях машинного навчання на основі спеціального кремнію, AWS Inferentia та Trainium.

Хіроші Токойо є архітектором рішень в AWS Annapurna Labs. Перебуваючи в Японії, він приєднався до Annapurna Labs ще до придбання компанією AWS і постійно допомагав клієнтам із технологіями Annapurna Labs. Останнім часом він зосереджується на рішеннях машинного навчання на основі спеціального кремнію, AWS Inferentia та Trainium.

Дхавал Патель є головним архітектором машинного навчання в AWS. Він працював з організаціями, починаючи від великих підприємств і закінчуючи стартапами середнього розміру, над проблемами, пов’язаними з розподіленими обчисленнями та штучним інтелектом. Він зосереджується на глибокому навчанні, включаючи домени НЛП та комп’ютерного зору. Він допомагає клієнтам досягти високопродуктивної моделі висновку на SageMaker.

Дхавал Патель є головним архітектором машинного навчання в AWS. Він працював з організаціями, починаючи від великих підприємств і закінчуючи стартапами середнього розміру, над проблемами, пов’язаними з розподіленими обчисленнями та штучним інтелектом. Він зосереджується на глибокому навчанні, включаючи домени НЛП та комп’ютерного зору. Він допомагає клієнтам досягти високопродуктивної моделі висновку на SageMaker.

Цин Лан є інженером з розробки програмного забезпечення в AWS. Він працював над декількома складними продуктами в Amazon, включаючи високоефективні рішення ML inference та високоефективну систему журналювання. Команда Ціна успішно запустила першу модель із мільярдами параметрів у Amazon Advertising із дуже малою затримкою. Qing має глибокі знання щодо оптимізації інфраструктури та прискорення глибокого навчання.

Цин Лан є інженером з розробки програмного забезпечення в AWS. Він працював над декількома складними продуктами в Amazon, включаючи високоефективні рішення ML inference та високоефективну систему журналювання. Команда Ціна успішно запустила першу модель із мільярдами параметрів у Amazon Advertising із дуже малою затримкою. Qing має глибокі знання щодо оптимізації інфраструктури та прискорення глибокого навчання.

Цінвей Лі є спеціалістом з машинного навчання в Amazon Web Services. Отримав ступінь доктора філософії. в дослідженні операцій після того, як він зламав грантовий рахунок свого радника і не вручив обіцяну Нобелівську премію. Зараз він допомагає клієнтам у сфері фінансових послуг і страхування створювати рішення машинного навчання на AWS. У вільний час любить читати та викладати.

Цінвей Лі є спеціалістом з машинного навчання в Amazon Web Services. Отримав ступінь доктора філософії. в дослідженні операцій після того, як він зламав грантовий рахунок свого радника і не вручив обіцяну Нобелівську премію. Зараз він допомагає клієнтам у сфері фінансових послуг і страхування створювати рішення машинного навчання на AWS. У вільний час любить читати та викладати.

Алан Тан є старшим менеджером із продуктів у компанії SageMaker, яка займається розробкою великих моделей. Він захоплений застосуванням машинного навчання в галузі аналітики. Поза роботою любить відпочивати на природі.

Алан Тан є старшим менеджером із продуктів у компанії SageMaker, яка займається розробкою великих моделей. Він захоплений застосуванням машинного навчання в галузі аналітики. Поза роботою любить відпочивати на природі.

Варун Сял є інженером із розробки програмного забезпечення в AWS Sagemaker, який працює над критично важливими функціями для клієнтів для платформи ML Inference. Він захоплений роботою в області розподілених систем і ШІ. У вільний час любить читати та займатися садівництвом.

Варун Сял є інженером із розробки програмного забезпечення в AWS Sagemaker, який працює над критично важливими функціями для клієнтів для платформи ML Inference. Він захоплений роботою в області розподілених систем і ШІ. У вільний час любить читати та займатися садівництвом.

- Розповсюдження контенту та PR на основі SEO. Отримайте посилення сьогодні.

- PlatoAiStream. Web3 Data Intelligence. Розширення знань. Доступ тут.

- Карбування майбутнього з Адріенн Ешлі. Доступ тут.

- Купуйте та продавайте акції компаній, які вийшли на IPO, за допомогою PREIPO®. Доступ тут.

- джерело: https://aws.amazon.com/blogs/machine-learning/achieve-high-performance-with-lowest-cost-for-generative-ai-inference-using-aws-inferentia2-and-aws-trainium-on-amazon-sagemaker/

- : має

- :є

- : ні

- :де

- $UP

- 10

- 100

- 12

- 13

- 14

- 15%

- 22

- 24

- 7

- 8

- 9

- a

- МЕНЮ

- прискорювач

- прискорювачі

- Приймає

- доступ

- рахунки

- Achieve

- придбання

- через

- акти

- додавати

- доповнення

- адреса

- адресний

- Перевага

- реклама

- після

- проти

- AI

- випадки використання ai

- AI / ML

- ВСІ

- дозволяє

- Також

- хоча

- Amazon

- Amazon EC2

- Amazon SageMaker

- Amazon Web Services

- an

- аналітика

- та

- Оголосити

- Інший

- будь-який

- Інтерфейси

- застосування

- Застосування

- підхід

- архітектура

- ЕСТЬ

- ПЛОЩА

- штучний

- штучний інтелект

- Штучний інтелект (AI)

- AS

- At

- аудіо

- автоматичний

- автоматично

- доступний

- AWS

- AWS Inferentia

- м'яч

- ширина смуги

- бар'єр

- заснований

- BE

- оскільки

- було

- перед тим

- Переваги

- КРАЩЕ

- між

- Великий

- більший

- мільярди

- Блокувати

- Блог

- Цвісти

- коротко

- Зламав

- будувати

- побудований

- вбудований

- підприємства

- by

- C + +

- званий

- CAN

- випадків

- складні

- Chatbot

- перевірка

- Чіпси

- код

- Кодування

- Collective

- об'єднувати

- комбінований

- приходить

- Комунікація

- зв'язку

- порівняний

- сумісний

- повний

- повністю

- комплекс

- складність

- Компоненти

- всеосяжний

- обчислення

- обчислення

- комп'ютер

- Комп'ютерне бачення

- обчислення

- конфігурація

- підключений

- Контейнер

- Контейнери

- містить

- зміст

- Core

- Коштувати

- рентабельним

- витрати

- створювати

- створений

- критичний

- вирішальне значення

- В даний час

- клієнт

- Клієнти

- налаштувати

- дані

- присвячених

- глибокий

- глибоке навчання

- дефолт

- певний

- Визначає

- Ступінь

- затримка

- доставляти

- надання

- постачає

- продемонстрований

- залежить

- розгортання

- розгортання

- розгортання

- деталі

- Виявлення

- визначає

- розвивати

- розробка

- пристрій

- прилади

- різний

- радіомовлення

- безпосередньо

- розподілений

- розподілені обчислення

- розподілені системи

- розподіл

- справи

- домени

- Не знаю

- скачати

- завантажень

- водій

- динамічний

- динамічно

- кожен

- Раніше

- легше

- Найпростіший

- легко

- Схід

- ефективний

- продуктивно

- зусилля

- дозволяє

- кінець

- Кінцева точка

- інженер

- Двигуни

- досить

- забезпечувати

- вхід

- підприємств

- запис

- Еквівалент

- оцінювати

- Навіть

- приклад

- збуджений

- дорогий

- додатково

- Face

- полегшує

- облицювання

- не вдалося

- швидше

- особливість

- риси

- філе

- фінансовий

- фінансова служба

- закінчення

- Перший

- відповідати

- потік

- Потоки

- Сфокусувати

- увагу

- фокусується

- після

- для

- форма

- формат

- чотири

- Рамки

- каркаси

- шахрайство

- виявлення шахрайства

- від

- Повний

- повністю

- Крім того

- генерує

- покоління

- генеративний

- Генеративний ШІ

- отримати

- Go

- надавати

- Групи

- Зростання

- апаратні засоби

- Мати

- he

- здоров'я

- допомога

- допоміг

- допомагає

- тут

- Високий

- висока продуктивність

- вище

- його

- проведення

- тримає

- господар

- хостинг

- послуги хостингу

- будинок

- Як

- How To

- Однак

- HTML

- HTTP

- HTTPS

- Концентратор

- людина

- if

- зображення

- зображень

- реалізація

- імпорт

- in

- поглиблений

- включати

- includes

- У тому числі

- Augmenter

- зростаючий

- незалежний

- промисловість

- Інфраструктура

- інноваційний

- вхід

- витрати

- установка

- екземпляр

- страхування

- інтегрований

- Інтелект

- взаємодія

- Взаємодії

- посередник

- в

- викликали

- залучати

- IT

- ЙОГО

- Japan

- робота

- приєднатися

- приєднався

- JPG

- json

- просто

- Знати

- знання

- Labs

- мова

- великий

- Великі підприємства

- більше

- найбільших

- Затримка

- запущений

- запуски

- провідний

- УЧИТЬСЯ

- вивчення

- довжина

- дозволяти

- libraries

- бібліотека

- як

- Сподобалося

- обмеженою

- список

- LLM

- загрузка

- погрузка

- вантажі

- каротаж

- низький

- знизити

- найнижчий

- машина

- навчання за допомогою машини

- головним чином

- підтримує

- Більшість

- зробити

- управляти

- вдалося

- менеджер

- карти

- Макс

- максимальний

- пам'ять

- метод

- ML

- MLOps

- модель

- Моделі

- Модулі

- більше

- більш ефективний

- найбільш

- множинний

- ім'я

- Природний

- Обробка природних мов

- необхідно

- Необхідність

- потреби

- Нові

- Нью-Йорк

- наступний

- nlp

- Нобелівська премія

- ноутбук

- зараз

- номер

- об'єкт

- of

- пропонувати

- Пропозиції

- часто

- Огайо

- on

- ONE

- тільки

- з відкритим вихідним кодом

- операції

- оптимізація

- Оптимізувати

- оптимізований

- Оптимізує

- варіант

- Опції

- or

- організації

- Інше

- наші

- з

- на відкритому повітрі

- вихід

- поза

- власний

- пакети

- парадигма

- Паралельні

- параметр

- параметри

- проходити

- проходить

- пристрасний

- продуктивність

- Втілення

- платформа

- plato

- Інформація про дані Платона

- PlatoData

- підключати

- plugins

- точка

- популярний

- пошта

- влада

- Харчування

- потужний

- практика

- Точність

- Прогнози

- Прогноз

- переважним

- Головний

- приз

- проблеми

- процес

- процеси

- обробка

- Product

- менеджер по продукції

- Продукти

- профіль

- проектів

- пообіцяв

- властивості

- власність

- забезпечувати

- за умови

- забезпечує

- забезпечення

- мета

- Python

- піторх

- ранжування

- досягати

- читання

- готовий

- Реальний світ

- реального часу

- отримано

- останній

- визнання

- називають

- пов'язаний

- запросити

- запитів

- вимагається

- вимога

- Вимога

- дослідження

- Дослідники

- ресурси

- відповіді

- в результаті

- Зростання

- прогін

- мудрець

- Висновок SageMaker

- то ж

- зберегти

- Масштабування

- сценарії

- scripts

- Sdk

- плавно

- seconds

- розділ

- побачити

- старший

- Послідовність

- служити

- обслуговування

- Послуги

- виступаючої

- комплект

- налаштування

- установка

- кілька

- зсув

- Повинен

- Показувати

- продемонстрований

- показаний

- Шоу

- сторона

- істотно

- Кремній

- аналогічний

- простий

- один

- SIX

- Розмір

- розміри

- So

- Софтвер

- розробка програмного забезпечення

- рішення

- Рішення

- Простір

- спеціаліст

- спеціалізований

- мова

- Розпізнавання мови

- стабільний

- стек

- Стеки

- старт

- почалася

- починається

- Стартапи

- зберігання

- історії

- зберігання

- обтічний

- стиль

- Успішно

- такі

- підтримка

- Підтриманий

- Опори

- система

- Systems

- взяття

- Навчання

- команда

- методи

- Технологія

- тензорний потік

- Тести

- ніж

- Що

- Команда

- Площа

- їх

- Їх

- Там.

- Ці

- це

- три

- через

- пропускна здатність

- час

- times

- до

- занадто

- інструменти

- Простеження

- навчений

- Навчання

- Трансформатори

- ПЕРЕГЛЯД

- два

- тип

- типовий

- завантажено

- us

- використання

- використовуваний

- використання

- зазвичай

- використовувати

- використовує

- значення

- різноманітність

- різний

- величезний

- дуже

- через

- Відео

- Віргінія

- бачення

- чекати

- покрокове керівництво

- шлях..

- we

- Web

- веб-сервіси

- вага

- Що

- коли

- який

- волі

- з

- в

- без

- спостереження

- слово

- Work

- працював

- робочий

- працює

- світ

- запис

- лист

- йорк

- Ти

- вашу

- зефірнет