Агенти великої мовної моделі (LLM) — це програми, які розширюють можливості автономних LLM за допомогою 1) доступу до зовнішніх інструментів (API, функцій, веб-перехоплювачів, плагінів тощо) і 2) здатності планувати та виконувати завдання самостійно -режисована мода. Часто LLM потрібно взаємодіяти з іншим програмним забезпеченням, базами даних або API для виконання складних завдань. Наприклад, адміністративний чат-бот, який планує зустрічі, потребує доступу до календарів та електронної пошти співробітників. Завдяки доступу до інструментів агенти LLM можуть стати потужнішими — ціною додаткової складності.

У цій публікації ми представляємо агентів LLM і демонструємо, як створити та розгорнути агент LLM електронної комерції за допомогою Amazon SageMaker JumpStart та AWS Лямбда. Агент використовуватиме інструменти для надання нових можливостей, таких як відповіді на запитання про повернення («Чи є моє повернення rtn001 оброблено?») і надання оновлень про замовлення («Чи могли б ви сказати мені, якщо замовлення 123456 відправлено?»). Ці нові можливості вимагають, щоб LLM отримували дані з кількох джерел даних (orders, returns) і виконати розширену генерацію пошуку (RAG).

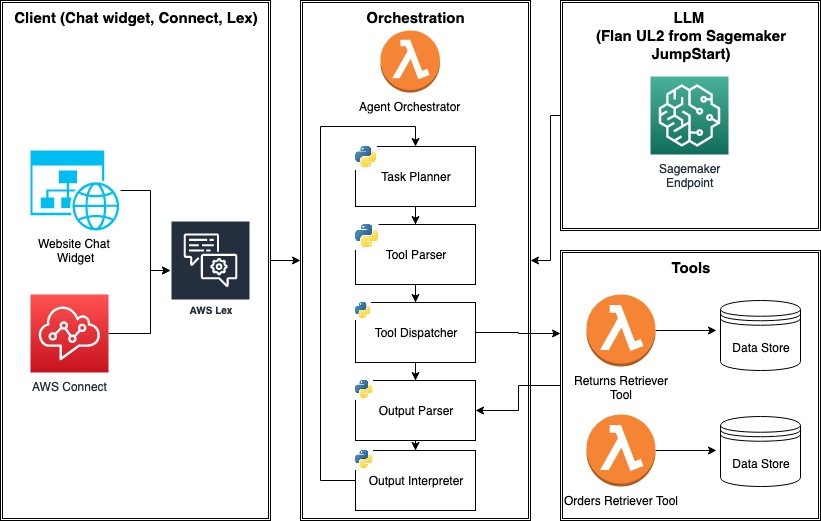

Для живлення агента LLM ми використовуємо a Flan-UL2 модель, розгорнута як a Кінцева точка SageMaker і використовувати інструменти пошуку даних, створені за допомогою AWS Lambda. Згодом агент може бути інтегрований Амазон Лекс і використовується як чат-бот на веб-сайтах або AWS Connect. Ми завершуємо публікацію пунктами, які слід розглянути перед розгортанням агентів LLM у виробництві. Для повністю керованого досвіду створення агентів LLM AWS також надає агенти для функції Amazon Bedrock (у попередній версії).

Короткий огляд архітектур агентів LLM

Агенти LLM – це програми, які використовують LLM для вирішення, коли та як використовувати необхідні інструменти для виконання складних завдань. Завдяки інструментам і можливостям планування завдань агенти LLM можуть взаємодіяти із зовнішніми системами та долати традиційні обмеження LLM, такі як обмеження знань, галюцинації та неточні обчислення. Інструменти можуть приймати різноманітні форми, наприклад виклики API, функції Python або плагіни на основі веб-хуків. Наприклад, LLM може використовувати «додаток пошуку» для отримання відповідного контексту та виконання RAG.

Отже, що означає для LLM обирати інструменти та планувати завдання? Існує багато підходів (наприклад ReAct, MRKL, Формувальник інструментів, ОбіймиGPT та Агент-трансформерs) до використання LLM з інструментами, і прогрес відбувається швидко. Але один простий спосіб полягає в тому, щоб підказати LLM список інструментів і попросити його визначити 1) чи потрібен інструмент для задоволення запиту користувача, і якщо так, 2) вибрати відповідний інструмент. Така підказка зазвичай виглядає як наведений нижче приклад і може включати кілька прикладів для підвищення надійності LLM у виборі правильного інструменту.

Більш складні підходи включають використання спеціалізованого LLM, який може безпосередньо декодувати «виклики API» або «використання інструментів», наприклад GorillaLLM. Такі налаштовані LLM навчаються на наборах даних специфікації API, щоб розпізнавати та передбачати виклики API на основі інструкцій. Часто ці LLM вимагають деяких метаданих про доступні інструменти (опис, yaml або JSON-схема для своїх вхідних параметрів), щоб виводити виклики інструментів. Цей підхід прийнято агенти Amazon Bedrock та Виклики функцій OpenAI. Зауважте, що LLM зазвичай мають бути достатньо великими та складними, щоб демонструвати здатність вибору інструментів.

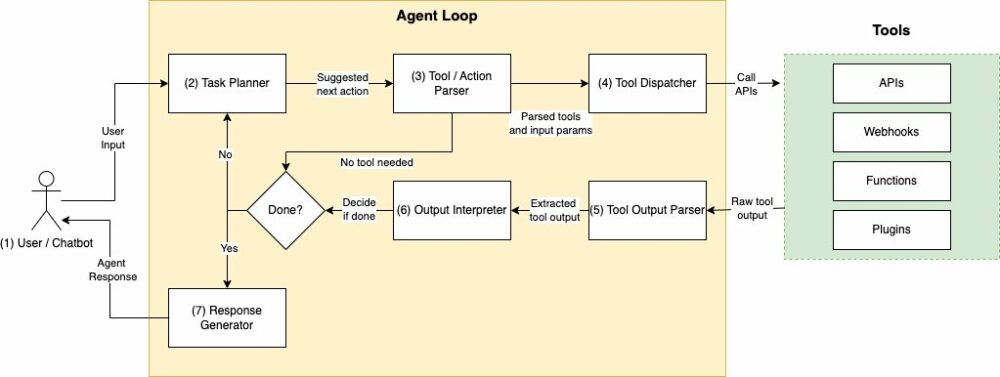

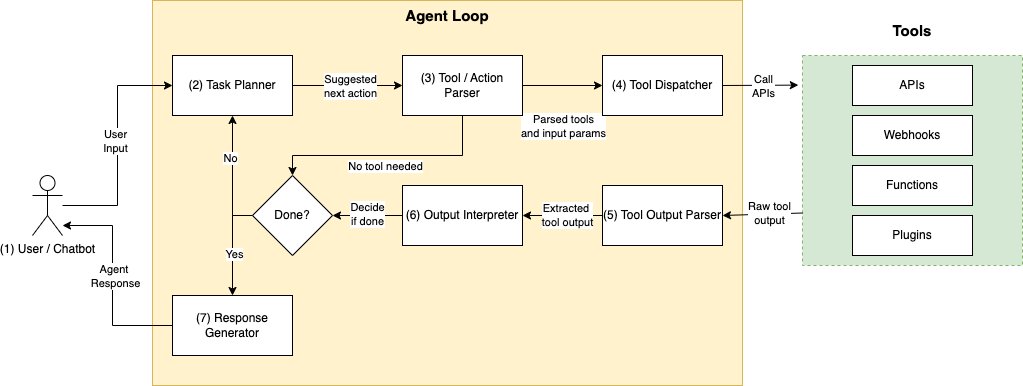

Якщо вибрано механізми планування завдань і вибору інструментів, типова програма агента LLM працює в такій послідовності:

- Запит користувача – Програма приймає дані користувача, такі як «Де моє замовлення

123456?» з якогось клієнтського додатку. - Сплануйте наступні дії та виберіть інструменти для використання – Далі програма використовує підказку, щоб LLM згенерував наступну дію, наприклад, «Пошук таблиці замовлень за допомогою

OrdersAPI.” LLM пропонується запропонувати назву інструменту, наприкладOrdersAPIіз попередньо визначеного списку доступних інструментів та їх описів. Як альтернатива, LLM можна доручити безпосередньо генерувати виклик API із вхідними параметрами, такими якOrdersAPI(12345).- Зауважте, що наступна дія може включати або не включати використання інструменту чи API. Якщо ні, LLM відповідатиме на введення користувача без включення додаткового контексту з інструментів або просто повертатиме готову відповідь, наприклад, «Я не можу відповісти на це запитання».

- Запит інструменту аналізу – Далі нам потрібно проаналізувати та перевірити інструмент/прогноз дії, запропонований LLM. Перевірка необхідна, щоб гарантувати, що назви інструментів, API та параметри запиту не є галюцинаціями та що інструменти належним чином викликаються відповідно до специфікації. Для цього розбору може знадобитися окремий виклик LLM.

- Інструмент виклику – Після забезпечення правильного імені інструменту та параметра ми запускаємо інструмент. Це може бути HTTP-запит, виклик функції тощо.

- Розібрати вихід – Відповідь інструменту може потребувати додаткової обробки. Наприклад, виклик API може призвести до довгої відповіді JSON, де лише підмножина полів цікавить LLM. Отримання інформації в чистому, стандартизованому форматі може допомогти LLM інтерпретувати результат більш надійно.

- Інтерпретувати вихідні дані – Враховуючи вихідні дані інструменту, LLM знову отримує запит, щоб зрозуміти це та вирішити, чи може він згенерувати остаточну відповідь користувачеві, чи потрібні додаткові дії.

- Припиніть або перейдіть до кроку 2 – Повернути остаточну відповідь або відповідь за замовчуванням у разі помилок або тайм-аутів.

Різні фреймворки агентів виконують попередній потік програми по-різному. Наприклад, ReAct об’єднує вибір інструментів і генерацію остаточної відповіді в одну підказку, на відміну від використання окремих підказок для вибору інструменту та генерації відповіді. Крім того, цю логіку можна запустити за один прохід або за допомогою оператора while («цикл агента»), який завершується, коли генерується остаточна відповідь, виникає виняткова ситуація або виникає тайм-аут. Що залишається постійним, так це те, що агенти використовують LLM як центральний елемент для оркестрування планування та викликів інструментів до завершення завдання. Далі ми покажемо, як реалізувати простий агентський цикл за допомогою сервісів AWS.

Огляд рішення

Для цієї публікації в блозі ми впроваджуємо агент LLM для підтримки електронної комерції, який надає дві функції за допомогою інструментів:

- Інструмент для отримання статусу повернення – Дайте відповіді на запитання про статус повернення, наприклад: «Що відбувається з моїм поверненням».

rtn001? " - Інструмент пошуку статусу замовлення – Відстежуйте статус замовлень, наприклад «Який статус мого замовлення

123456? "

Агент ефективно використовує LLM як маршрутизатор запитів. За запитом («Який статус замовлення 123456?”), виберіть відповідний інструмент пошуку для запиту в кількох джерелах даних (тобто повернення та замовлення). Ми виконуємо маршрутизацію запитів, маючи LLM вибір серед кількох інструментів пошуку, які відповідають за взаємодію з джерелом даних і отримання контексту. Це розширює простий шаблон RAG, який передбачає єдине джерело даних.

Обидва інструменти пошуку є лямбда-функціями, які приймають ідентифікатор (orderId or returnId) як вхідні дані отримує об’єкт JSON із джерела даних і перетворює JSON на зрозумілий рядок представлення, який підходить для використання LLM. Джерелом даних у реальному сценарії може бути високомасштабована база даних NoSQL, наприклад DynamoDB, але це рішення використовує простий Python Dict із зразками даних для демонстраційних цілей.

До агента можна додати додаткові функції, додавши Інструменти пошуку та відповідно змінивши підказки. Цей агент можна протестувати як автономну службу, яка інтегрується з будь-яким інтерфейсом користувача через HTTP, що можна легко зробити за допомогою Амазон Лекс.

Ось деякі додаткові відомості про ключові компоненти:

- Кінцева точка висновку LLM – Ядром агентської програми є LLM. Ми використовуватимемо хаб базової моделі SageMaker JumpStart для легкого розгортання

Flan-UL2модель. SageMaker JumpStart спрощує розгортання кінцевих точок висновку LLM на виділених SageMaker екземпляри. - Агент-організатор – Керівник агента керує взаємодією між LLM, інструментами та клієнтською програмою. У нашому рішенні ми використовуємо функцію AWS Lambda для керування цим потоком і використовуємо наступні як допоміжні функції.

- Планувальник завдань (інструментів) – Планувальник завдань використовує LLM, щоб запропонувати один із варіантів: 1) запит на повернення, 2) запит на замовлення або 3) відсутність інструменту. Ми використовуємо тільки оперативну техніку і

Flan-UL2модель як є без тонкого налаштування. - Парсер інструментів – Синтаксичний аналізатор інструменту гарантує, що пропозиція інструменту від планувальника завдань дійсна. Примітно, ми гарантуємо, що один

orderIdorreturnIdможна проаналізувати. В іншому випадку ми відповідаємо повідомленням за умовчанням. - Диспетчер інструментів – Диспетчер інструментів викликає інструменти (лямбда-функції), використовуючи дійсні параметри.

- Парсер виводу – Синтаксичний аналізатор виведення очищає та витягує відповідні елементи з JSON у зрозумілий людині рядок. Це завдання виконується як кожним інструментом пошуку, так і в оркестраторі.

- Інтерпретатор виводу – Відповідальність інтерпретатора виводу полягає в тому, щоб 1) інтерпретувати вихідні дані від виклику інструменту та 2) визначити, чи запит користувача можна задовольнити чи потрібні додаткові кроки. Якщо останнє, остаточна відповідь генерується окремо та повертається користувачеві.

- Планувальник завдань (інструментів) – Планувальник завдань використовує LLM, щоб запропонувати один із варіантів: 1) запит на повернення, 2) запит на замовлення або 3) відсутність інструменту. Ми використовуємо тільки оперативну техніку і

Тепер давайте трохи глибше заглибимося в ключові компоненти: координатор агентів, планувальник завдань і диспетчер інструментів.

Агент-оркестрант

Нижче наведено скорочену версію циклу агента всередині лямбда-функції оркестратора агента. Цикл використовує допоміжні функції, такі як task_planner or tool_parser, модульувати завдання. Цикл тут призначений для запуску щонайбільше два рази, щоб запобігти застряганню LLM у надмірно довгому циклі.

Планувальник завдань (інструмент прогнозування)

Агент оркестратор використовує task planner передбачити інструмент пошуку на основі введення користувача. Для нашого LLM-агента ми просто використаємо оперативне проектування та декілька підказок, щоб навчити LLM цьому завданню в контексті. Більш досвідчені агенти можуть використовувати тонко налаштований LLM для прогнозування інструментів, що виходить за рамки цієї публікації. Підказка така:

Диспетчер інструменту

Механізм відправки інструменту працює через if/else логіка для виклику відповідних лямбда-функцій залежно від назви інструменту. Наступне tool_dispatch реалізація допоміжної функції. Використовується всередині agent цикл і повертає необроблену відповідь від функції Lambda інструменту, яка потім очищається an output_parser функції.

Розгорніть рішення

Важливі передумови – Щоб розпочати розгортання, потрібно виконати наступні передумови:

- Доступ до Консоль управління AWS через користувача, який може запускати Стеки AWS CloudFormation

- Знайомство з навігацією AWS Lambda та Амазон Лекс консолі

Flan-UL2вимагає єдиногоml.g5.12xlargeдля розгортання, що може вимагати збільшення обмежень ресурсів через a квиток підтримки. У нашому прикладі ми використовуємоus-east-1як Регіон, тому, будь ласка, переконайтеся, що збільшили квоту обслуговування (за потреби) уus-east-1.

Розгорнути за допомогою CloudFormation – Ви можете розгорнути рішення на us-east-1 натиснувши кнопку нижче:![]()

Розгортання рішення займе приблизно 20 хвилин і створить a LLMAgentStack стек, який:

- розгортає кінцеву точку SageMaker за допомогою

Flan-UL2модель від SageMaker JumpStart; - розгортає три функції лямбда:

LLMAgentOrchestrator,LLMAgentReturnsTool,LLMAgentOrdersToolІ - розгортає ан AWS Лекс бот, який можна використовувати для тестування агента:

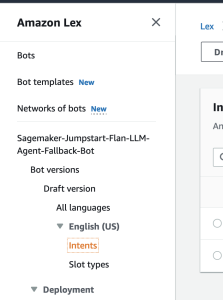

Sagemaker-Jumpstart-Flan-LLM-Agent-Fallback-Bot.

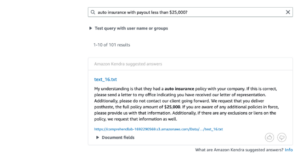

Перевірте розчин

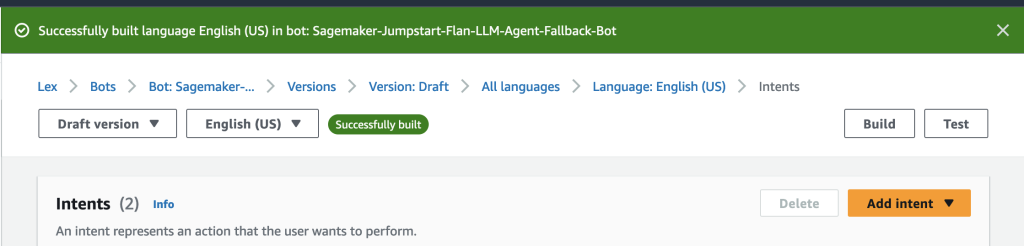

Стек розгортає бота Amazon Lex із назвою Sagemaker-Jumpstart-Flan-LLM-Agent-Fallback-Bot. Бот можна використовувати для наскрізного тестування агента. Ось додатковий вичерпний посібник для тестування ботів AWS Amazon Lex з інтеграцією Lambda та того, як інтеграція працює на високому рівні. Коротше кажучи, бот Amazon Lex — це ресурс, який забезпечує швидкий інтерфейс користувача для спілкування з агентом LLM, що працює всередині створеної нами функції Lambda (LLMAgentOrchestrator).

Зразки тестових випадків для розгляду такі:

- Дійсний запит на замовлення (наприклад, «Який товар було замовлено

123456? ")- Замовлення «123456» є дійсним замовленням, тому ми повинні очікувати обґрунтованої відповіді (наприклад, «Трав'яне мило для рук»)

- Дійсний запит на повернення для повернення (наприклад, «Коли я повернуся

rtn003оброблено?»)- Слід очікувати обґрунтованої відповіді щодо статусу повернення.

- Не має значення ні для повернення, ні для замовлень (наприклад, «Яка зараз погода в Шотландії?»)

- Питання, яке не має відношення до повернень або замовлень, тому має бути повернуто відповідь за замовчуванням («На жаль, я не можу відповісти на це запитання»).

- Недійсний запит на замовлення (наприклад, «Який товар було замовлено

383833? ")- Ідентифікатор 383832 не існує в наборі даних замовлень, тому ми повинні помилитися (наприклад, «Замовлення не знайдено. Будь ласка, перевірте свій ідентифікатор замовлення»).

- Недійсний запит на повернення (наприклад, «Коли я повернуся

rtn123оброблено?»)- Так само id

rtn123не існує в наборі даних повернення, і, отже, має завершитися помилкою.

- Так само id

- Нерелевантний запит на повернення (наприклад, «Який вплив повернення

rtn001про мир у всьому світі?»)- Хоча це питання, здається, стосується чинного порядку, не має значення. LLM використовується для фільтрації запитань із нерелевантним контекстом.

Щоб виконати ці тести самостійно, ось інструкції.

- На консолі Amazon Lex (Консоль AWS > Amazon Lex), перейдіть до бота під назвою

Sagemaker-Jumpstart-Flan-LLM-Agent-Fallback-Bot. Цей бот уже налаштований для викликуLLMAgentOrchestratorЛямбда функція кожного разу, колиFallbackIntentспрацьовує. - На панелі навігації виберіть Наміри.

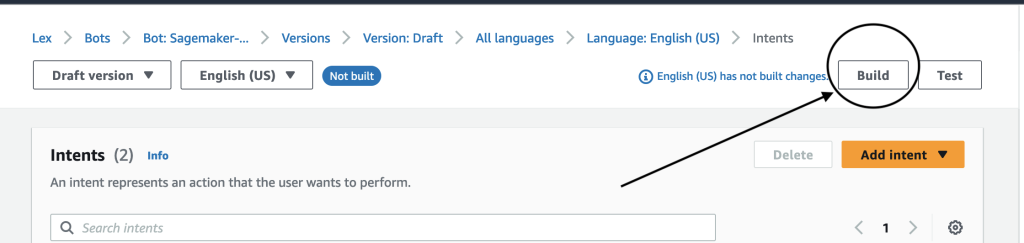

- Вибирати Будувати у верхньому правому куті

- 4. Дочекайтеся завершення процесу збирання. Коли це буде зроблено, ви отримаєте повідомлення про успіх, як показано на наступному знімку екрана.

- Протестуйте бота, ввівши тестові випадки.

Прибирати

Щоб уникнути додаткових витрат, видаліть ресурси, створені нашим рішенням, виконавши такі дії:

- на AWS CloudFormation консолі, виберіть стек під назвою

LLMAgentStack(або власне ім’я, яке ви вибрали). - Вибирати видаляти

- Переконайтеся, що стек видалено з консолі CloudFormation.

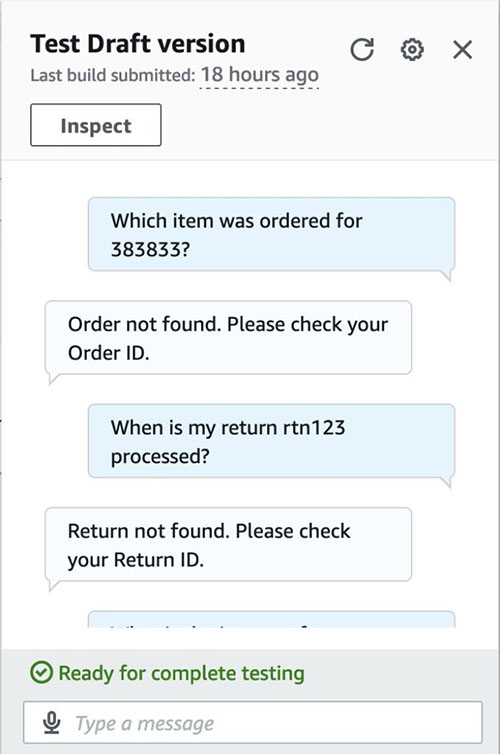

Важливо: ще раз перевірте, чи стек успішно видалено, переконавшись, що Flan-UL2 кінцева точка висновку видаляється.

- Щоб перевірити, перейдіть до Консоль AWS > Sagemaker > Кінцеві точки > Висновок стр.

- На сторінці мають бути перераховані всі активні кінцеві точки.

- Переконатися

sm-jumpstart-flan-bot-endpointне існує, як на скріншоті нижче.

Міркування щодо виробництва

Розгортання агентів LLM у виробництві вимагає вжиття додаткових заходів для забезпечення надійності, продуктивності та зручності обслуговування. Ось деякі міркування перед розгортанням агентів у виробництві:

- Вибір моделі LLM для живлення агентського циклу: Для рішення, яке обговорюється в цій публікації, ми використали a

Flan-UL2модель без тонкого налаштування для виконання планування завдань або вибору інструментів. На практиці використання LLM, налаштованого на пряме виведення інструментів або запитів API, може підвищити надійність і продуктивність, а також спростити розробку. Ми могли б точно налаштувати LLM на завдання вибору інструментів або використати модель, яка безпосередньо декодує маркери інструментів, наприклад Toolformer.- Використання точно налаштованих моделей також може спростити додавання, видалення та оновлення інструментів, доступних для агента. За допомогою підходів, які базуються лише на підказках, для оновлення інструментів потрібно змінювати кожну підказку в оркестраторі агента, наприклад для планування завдань, аналізу інструментів і відправлення інструментів. Це може бути громіздким, і продуктивність може погіршитися, якщо занадто багато інструментів надається в контексті LLM.

- Надійність і продуктивність: Агенти LLM можуть бути ненадійними, особливо для складних завдань, які неможливо виконати за кілька циклів. Додавання перевірок виводу, повторних спроб, структурування виходів з LLM у JSON або yaml, а також застосування тайм-аутів для надання аварійних люків для LLM, що застрягли в циклах, може підвищити надійність.

Висновок

У цій публікації ми досліджували, як створити LLM-агента, який може використовувати кілька інструментів з нуля, використовуючи низькорівневу підказку, функції AWS Lambda та SageMaker JumpStart як будівельні блоки. Ми детально обговорили архітектуру агентів LLM і агентський цикл. Концепції та архітектура рішення, представлені в цій публікації блогу, можуть підійти для агентів, які використовують невелику кількість попередньо визначеного набору інструментів. Ми також обговорили кілька стратегій використання агентів у виробництві. Агенти для Bedrock, який знаходиться в попередній версії, також забезпечує керований досвід для створення агентів із вбудованою підтримкою викликів агентських інструментів.

Про автора

Джон Хван є архітектором генеративного штучного інтелекту в AWS, який спеціалізується на додатках Large Language Model (LLM), векторних базах даних і стратегії генеративного штучного інтелекту. Він захоплено допомагає компаніям у розробці продуктів штучного інтелекту та машинного навчання та майбутнього агентів LLM і других пілотів. До того, як приєднатися до AWS, він був менеджером із продукції в Alexa, де допомагав запровадити розмовний штучний інтелект на мобільних пристроях, а також трейдером деривативів у Morgan Stanley. Він отримав ступінь бакалавра інформатики в Стенфордському університеті.

Джон Хван є архітектором генеративного штучного інтелекту в AWS, який спеціалізується на додатках Large Language Model (LLM), векторних базах даних і стратегії генеративного штучного інтелекту. Він захоплено допомагає компаніям у розробці продуктів штучного інтелекту та машинного навчання та майбутнього агентів LLM і других пілотів. До того, як приєднатися до AWS, він був менеджером із продукції в Alexa, де допомагав запровадити розмовний штучний інтелект на мобільних пристроях, а також трейдером деривативів у Morgan Stanley. Він отримав ступінь бакалавра інформатики в Стенфордському університеті.

- Розповсюдження контенту та PR на основі SEO. Отримайте посилення сьогодні.

- PlatoData.Network Vertical Generative Ai. Додайте собі сили. Доступ тут.

- PlatoAiStream. Web3 Intelligence. Розширення знань. Доступ тут.

- ПлатонЕСГ. Автомобільні / електромобілі, вуглець, CleanTech, Енергія, Навколишнє середовище, Сонячна, Поводження з відходами. Доступ тут.

- PlatoHealth. Розвідка про біотехнології та клінічні випробування. Доступ тут.

- ChartPrime. Розвивайте свою торгову гру за допомогою ChartPrime. Доступ тут.

- BlockOffsets. Модернізація екологічної компенсаційної власності. Доступ тут.

- джерело: https://aws.amazon.com/blogs/machine-learning/learn-how-to-build-and-deploy-tool-using-llm-agents-using-aws-sagemaker-jumpstart-foundation-models/

- : має

- :є

- : ні

- :де

- $UP

- 1

- 100

- 15%

- 19

- 20

- 200

- 24

- 27

- 500

- 7

- 9

- a

- здібності

- здатність

- МЕНЮ

- доступ

- виконувати

- За

- відповідно

- через

- дію

- дії

- активний

- доданий

- додати

- Додатковий

- адміністративний

- досягнення

- після

- знову

- Агент

- агенти

- AI

- AI / ML

- Alexa

- ВСІ

- вже

- Також

- Amazon

- Амазон Лекс

- Amazon Web Services

- серед

- кількість

- an

- та

- відповідь

- будь-який

- API

- Інтерфейси

- додаток

- додаток

- застосування

- підхід

- підходи

- відповідний

- архітектура

- ЕСТЬ

- AS

- запитати

- передбачає

- At

- збільшено

- доступний

- уникнути

- AWS

- AWS Lambda

- назад

- заснований

- BE

- ставати

- було

- перед тим

- буття

- нижче

- Берклі

- За

- Біт

- блоки

- Блог

- тіло

- Бот

- обидва

- боти

- приносити

- будувати

- Створюємо

- побудований

- бізнес

- але

- button

- by

- розрахунки

- календарі

- call

- Виклики

- CAN

- не може

- можливості

- випадок

- випадків

- вантажі

- Chatbot

- перевірка

- Вибирати

- вибраний

- клієнт

- комбінати

- Компанії

- повний

- Зроблено

- комплекс

- складність

- Компоненти

- всеосяжний

- комп'ютер

- Інформатика

- поняття

- укладає

- налаштувати

- Вважати

- міркування

- Консоль

- постійна

- контекст

- продовжувати

- діалоговий

- розмовний ШІ

- Core

- Коштувати

- може

- створювати

- створений

- громіздкий

- виготовлений на замовлення

- дані

- Database

- базами даних

- набори даних

- Днів

- вирішувати

- присвячених

- глибше

- дефолт

- Визначення

- демонстрація

- демонструвати

- Залежно

- розгортання

- розгорнути

- розгортання

- розгортання

- розгортає

- Похідні

- призначений

- деталь

- деталі

- Визначати

- розробка

- прилади

- безпосередньо

- обговорювалися

- занурення

- do

- робить

- зроблений

- управляти

- e

- e-commerce

- кожен

- легко

- легко

- фактично

- або

- ще

- працює

- кінець в кінець

- Кінцева точка

- виконання

- Машинобудування

- підвищувати

- забезпечувати

- забезпечується

- гарантує

- забезпечення

- вхід

- Озаглавлений

- помилка

- помилки

- бігти

- особливо

- і т.д.

- Event

- Кожен

- приклад

- Приклади

- Крім

- виняток

- виконувати

- існувати

- очікувати

- досвід

- Розвіданий

- продовжити

- продовжується

- зовнішній

- додатково

- Виписки

- FAIL

- false

- мода

- особливість

- кілька

- Поля

- фільтрувати

- остаточний

- потік

- Сфокусувати

- після

- слідує

- для

- формат

- форми

- знайдений

- фонд

- каркаси

- дружній

- від

- Виконати

- повністю

- функція

- функціональні можливості

- Функції

- майбутнє

- в цілому

- породжувати

- генерується

- покоління

- генеративний

- Генеративний ШІ

- отримати

- даний

- Go

- Земля

- керівництво

- Відбувається

- люки

- Мати

- має

- he

- допомога

- допоміг

- допомогу

- отже

- тут

- hi

- Високий

- дуже

- тримає

- ГОДИННИК

- Як

- How To

- HTML

- HTTP

- HTTPS

- Концентратор

- людина

- читається людиною

- i

- ID

- if

- Impact

- здійснювати

- реалізація

- імпорт

- удосконалювати

- in

- включати

- включення

- Augmenter

- зростаючий

- інформація

- вхід

- запит

- всередині

- інструкції

- інтегрований

- Інтеграція

- інтеграція

- намір

- взаємодіяти

- взаємодіючих

- Взаємодії

- інтерес

- в

- вводити

- введені

- викликали

- викликає

- залучати

- IT

- пунктів

- ітерації

- приєднання

- JPG

- json

- ключ

- знання

- мова

- великий

- запуск

- УЧИТЬСЯ

- рівень

- як

- недоліки

- рамки

- список

- LLM

- логіка

- Довго

- ВИГЛЯДИ

- зробити

- РОБОТИ

- вдалося

- управління

- менеджер

- багато

- Може..

- me

- значити

- механізм

- механізми

- зустрічі

- повідомлення

- метадані

- хвилин

- Mobile

- мобільні пристрої

- модель

- Моделі

- більше

- Morgan

- Morgan Stanley

- найбільш

- множинний

- my

- ім'я

- Названий

- Імена

- рідний

- Переміщення

- навігація

- навігація

- необхідно

- Необхідність

- необхідний

- Нові

- наступний

- немає

- ніхто

- особливо

- зараз

- номер

- численний

- об'єкт

- of

- часто

- on

- один раз

- ONE

- тільки

- протистояли

- or

- порядок

- замовлень

- Інше

- інакше

- наші

- з

- вихід

- поза

- над

- Подолати

- огляд

- сторінка

- pane

- параметри

- проходити

- пристрасний

- Викрійки

- світ

- в очікуванні

- Виконувати

- продуктивність

- вибирати

- підібраний

- план

- планування

- plato

- Інформація про дані Платона

- PlatoData

- будь ласка

- plugins

- політика

- пошта

- влада

- Харчування

- практика

- передбачати

- прогноз

- передумови

- запобігати

- попередній перегляд

- попередній

- попередній

- процес

- Оброблено

- обробка

- Product

- розробка продукту

- менеджер по продукції

- Production

- програма

- програми

- правильно

- забезпечувати

- за умови

- забезпечує

- забезпечення

- цілей

- Python

- питання

- питань

- Швидко

- підвищення

- швидко

- Сировина

- Реальний світ

- розумний

- визнавати

- повернення

- регіон

- доречний

- надійність

- залишається

- Вилучено

- видалення

- подання

- запросити

- запитів

- вимагати

- вимагається

- Вимагається

- ресурс

- ресурси

- Реагувати

- відповідь

- відповідальність

- відповідальний

- результат

- повертати

- повернення

- Умови повернення

- право

- маршрутизатор

- Маршрутизація

- прогін

- біг

- s

- мудрець

- Незадоволений

- масштабовані

- сценарій

- наука

- сфера

- Пошук

- Здається,

- обраний

- вибір

- самонаправлений

- сенс

- окремий

- Послідовність

- обслуговування

- Послуги

- комплект

- кілька

- занурено

- Доставка

- Короткий

- постріл

- Повинен

- Показувати

- показаний

- простий

- спростити

- просто

- один

- невеликий

- So

- Софтвер

- рішення

- деякі

- складний

- Source

- Джерела

- спеціальний

- спеціалізований

- конкретний

- специфікація

- стек

- автономні

- Станфорд

- Стенфордський університет

- Стенлі

- старт

- почалася

- Заява

- Статус

- Крок

- заходи

- Стоп

- зберігати

- стратегії

- Стратегія

- рядок

- структурування

- Згодом

- успіх

- Успішно

- такі

- пропонувати

- підходящий

- підтримка

- Переконайтеся

- Systems

- таблиця

- Приймати

- прийняті

- приймає

- взяття

- Завдання

- завдання

- сказати

- тест

- перевірений

- Тестування

- Тести

- Що

- Команда

- Майбутнє

- їх

- потім

- Там.

- Ці

- це

- ті

- три

- Таким чином

- times

- до

- Жетони

- занадто

- інструмент

- інструменти

- топ

- Усього:

- трек

- trader

- традиційний

- навчений

- спрацьовує

- намагатися

- два

- типовий

- типово

- ui

- університет

- необов'язково

- до

- Updates

- оновлення

- використання

- використовуваний

- користувач

- використовує

- використання

- використовувати

- ПЕРЕВІР

- перевірка достовірності

- різноманітність

- версія

- через

- чекати

- було

- шлях..

- we

- погода

- Web

- веб-сервіси

- веб-сайти

- ДОБРЕ

- Що

- Що таке

- коли

- коли б ні

- Чи

- який

- в той час як

- ВООЗ

- волі

- з

- в

- без

- працює

- світ

- б

- ямл

- Ти

- вашу

- себе

- зефірнет