Юрист, який спеціалізується на конфіденційності даних, вивчає ризики ШІ.

Карколомний розвиток штучного інтелекту призводить до великої плутанини у світі бізнесу. Але плутанина – це не обов’язково погано. Якщо зустріти це зі щирою цікавістю та бажанням зрозуміти, це може перетворитися на мудрість.

Кріс Харт, партнер бостонської юридичної фірми Foley Hoag, це добре розуміє. Як співголова групи захисту конфіденційних даних компанії, Харт консультує бізнес-клієнтів щодо дотримання нормативних вимог, допомагаючи їм визначити ризики та прийняти політику, щоб уникнути юридичних проблем.

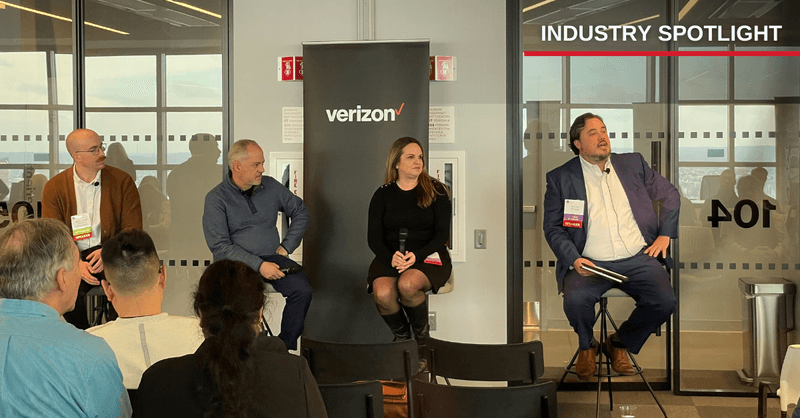

Нещодавно Харт виступав разом із двома членами Інституту досвідченого штучного інтелекту (Метью Семплем, спеціалістом з етики штучного інтелекту, та Кансу Канка, директором Відповідальна практика ШІ) на заході, організованому Рада керівництва масовими технологіями. Подія, яка залучила різноманітну групу учасників, була розроблена, щоб допомогти компаніям зрозуміти, як оптимізувати свої операції за допомогою ШІ.

Юридична небезпека

Поширеною помилкою є те, що штучний інтелект нерегульований. Хоча існує не так багато законів, що стосуються штучного інтелекту, є багато законів, які застосовуються до технологій ШІ. Частиною роботи Харта є консультування клієнтів щодо ризиків, пов’язаних із законами, з якими клієнти можуть бути не знайомі. Перший крок, пояснює він, полягає в тому, щоб провести різницю: ми говоримо про системи штучного інтелекту, які зараз знаходяться в розробці, чи сторонні системи, які використовують компанії?

«Одна з речей, яка стала зрозумілою з великими мовними моделями, які зараз досить повсюдно використовуються для робочих цілей, полягає в тому, що якою б не була їхня корисність, можуть виникнути проблеми щодо конфіденційності їхніх вхідних даних», — каже Харт. «Будьте дуже обережні, щоб не розміщувати конфіденційну інформацію для юридичних фірм, не розміщувати привілейовану інформацію, не розміщувати конфіденційну інформацію, яка потім може бути використана як навчальна інформація та ненавмисно розкрита».

Існують також проблеми з інтелектуальною власністю, особливо у випадку генеративного штучного інтелекту, що призвело до низки судових позовів щодо авторських прав проти компаній штучного інтелекту. Найпомітніше, The New York Times подав позов проти OpenAI; Getty Images подав до суду стабільна дифузія; і група авторів, включаючи Джона Грішема, Джоді Піколт і Джорджа Р. Р. Мартіна подав до суду OpenAI для «систематичної масової крадіжки».

Наскільки триватимуть ці судові позови, ще належить побачити, але навряд чи можна недооцінювати шкоду залученим компаніям, і урок очевидний: компаніям, які використовують штучний інтелект, особливо тим, які розробляють нові інструменти, потрібно бути легковажними.

«Якою мірою цей інструмент прийматиме несприятливі рішення для організацій?» — запитує Харт. «Чи є упередженість, чи вона може бути? Як захиститися від цього на етапі розробки? Як перевірити весь процес після того, як ви його зібрали, щоб переконатися, що ви можете повернутися назад і виправити проблеми?»

Нові перспективи

Це складні запитання, відповіді на які залежать від конкретних випадків використання. Вони також говорять про важливість створення структури відповідального штучного інтелекту (RAI) на кожному етапі розробки та розгортання. Здається, що успіх ШІ все частіше визначається ступенем, до якого компанії можуть шанувати мультидисциплінарний підхід.

Ось чому Інститут досвідченого ШІ серед своїх рядів є інженери, а також філософи, юристи, економісти тощо. Саме тому і Інститут, і Foley Hoag є членами Ради керівництва масовими технологіями (MTLC), технологічної асоціації, яка об’єднує лідерів із «різними поглядами» для вирішення актуальних юридичних та економічних проблем.

«Потрібно мати людей, які розуміються на технології», — каже Харт. «Ви повинні залучити інженерів, але ви також повинні залучити юристів. Ви повинні мати людей, які дивляться на це з різних точок зору, готові критично подумати про те, для чого призначена технологія та чи може вона створити відомі чи ненавмисні несприятливі результати».

Терпіння - це чеснота

Серед усього галасу про штучний інтелект легко забути про важливість терпіння. Справи розвиваються швидко, тому, зрозуміло, компанії бояться, що якщо вони не «рухатимуться швидко і не зламають речі», то втратять свою конкурентну перевагу. Харт виступає за більш обережний підхід.

«Деякі компанії були змушені вийти на ринок раніше, ніж вони, можливо, планували, оскільки ChatGPT підірвав усе», — пояснює Харт. «Організації повинні ретельно розглянути, наскільки зрілими є їхні постачальники ШІ, особливо тому, що вони повинні розуміти, що відбувається з їхніми даними».

З одного боку, експерти кажуть, що ШІ обіцяє революцію. Від генеративного штучного інтелекту до медичної діагностики, широту його потенціалу непросто звести до одного кроку. З іншого боку, така груба прогностична сила вимагає не лише терпіння, але й перспективи. Небагато компаній здатні самостійно орієнтуватися в цьому новому ландшафті.

Щоб навчитися Інститут досвідченого ШІ— зі своїми списками інженерів, науковців і практиків зі штучного інтелекту може допомогти вашому бізнесу орієнтуватися в цих важких водах, натисніть тут.

- Розповсюдження контенту та PR на основі SEO. Отримайте посилення сьогодні.

- PlatoData.Network Vertical Generative Ai. Додайте собі сили. Доступ тут.

- PlatoAiStream. Web3 Intelligence. Розширення знань. Доступ тут.

- ПлатонЕСГ. вуглець, CleanTech, Енергія, Навколишнє середовище, Сонячна, Поводження з відходами. Доступ тут.

- PlatoHealth. Розвідка про біотехнології та клінічні випробування. Доступ тут.

- джерело: https://www.mtlc.co/ai-the-law-a-lawyer-explains-the-risks-for-companies/

- :є

- : ні

- $UP

- a

- МЕНЮ

- вчені

- прийняти

- просування

- несприятливий

- радити

- прихильники

- проти

- AI

- Системи ШІ

- ВСІ

- пліч-о-пліч

- Також

- серед

- an

- та

- Відповіді

- Застосовувати

- підхід

- ЕСТЬ

- навколо

- AS

- Асоціація

- At

- учасники

- приваблюваний

- аудит

- authors

- уникнути

- назад

- поганий

- BE

- оскільки

- ставати

- було

- буття

- зміщення

- має

- обидва

- широта

- Перерва

- бізнес

- підприємства

- але

- by

- CAN

- обережний

- обережно

- випадок

- випадків

- проблеми

- ChatGPT

- ясно

- клієнтів

- співголова

- Приходити

- загальний

- Компанії

- конкурентоспроможний

- дотримання

- Турбота

- конфіденційний

- замішання

- Вважати

- скликає

- авторське право

- виправити

- може

- Рада

- створювати

- цікавість

- В даний час

- дані

- конфіденційність даних

- безпеку даних

- рішення

- певний

- Ступінь

- залежати

- розгортання

- призначений

- бажання

- розвивається

- розробка

- діагностика

- різний

- важкий

- радіомовлення

- Директор

- відмінність

- Різне

- do

- робить

- Не знаю

- вниз

- малювати

- кожен

- Раніше

- легко

- легко

- Економічний

- економісти

- край

- або

- Машинобудування

- Інженери

- Весь

- обладнаний

- особливо

- Event

- все

- досвідний

- experts

- Пояснює

- ступінь

- ШВИДКО

- страх

- кілька

- Фірма

- фірми

- Перший

- Фолі Хог

- для

- примусовий

- Рамки

- від

- генеративний

- Генеративний ШІ

- справжній

- Джордж

- буде

- Group

- рука

- Відбувається

- Мати

- he

- допомога

- допомогу

- тримати

- тримає

- честь

- відбувся

- Як

- How To

- HTTPS

- обман

- ідентифікувати

- if

- значення

- in

- ненавмисно

- У тому числі

- все більше і більше

- інформація

- витрати

- Інститут

- інтелектуальний

- інтелектуальна власність

- призначених

- в

- залучений

- питання

- IT

- ЙОГО

- робота

- Джон

- відомий

- ландшафт

- мова

- великий

- закон

- юридична фірма

- юридичні фірми

- Законодавство

- судові процеси

- юрист

- адвокати

- Лідери

- Керівництво

- провідний

- УЧИТЬСЯ

- Led

- легальний

- Правові питання

- урок

- злегка

- шукати

- втрачати

- серія

- зробити

- багато

- ринок

- Маса

- Матвій

- зрілий

- медичний

- члени

- зустрів

- може бути

- Моделі

- більше

- найбільш

- переміщення

- мультидисциплінарний

- Переміщення

- обов'язково

- Необхідність

- Нові

- Нью-Йорк

- зараз

- номер

- of

- on

- один раз

- ONE

- тільки

- OpenAI

- операції

- Оптимізувати

- or

- організації

- Інше

- Результати

- власний

- частина

- партнер

- Терпіння

- Люди

- перспектива

- перспективи

- фаза

- Крок

- plato

- Інформація про дані Платона

- PlatoData

- Plenty

- Політика

- потенціал

- влада

- пресування

- досить

- недоторканність приватного життя

- привілейовані

- проблеми

- процес

- обіцянку

- власність

- захист

- цілей

- put

- Поклавши

- питань

- швидко

- R

- ряди

- висип

- Сировина

- насправді

- регуляторні

- Відповідність нормативам

- залишається

- відповідальний

- революційний

- Risk

- ризики

- зразок

- приказка

- говорить

- шкала

- безпеку

- Здається,

- бачив

- чутливий

- Повинен

- з

- один

- So

- ВИРІШИТИ

- говорити

- спеціалізується

- конкретний

- стабільний

- Стажування

- Крок

- успіх

- такі

- Переконайтеся

- Systems

- говорити

- технології

- Технології

- Технологія

- ніж

- Що

- Команда

- закон

- крадіжка

- їх

- Їх

- потім

- Там.

- Ці

- вони

- річ

- речі

- думати

- третя сторона

- це

- ті

- через

- по всьому

- до

- разом

- інструмент

- Навчання

- Перетворення

- наступати

- два

- розуміти

- Зрозуміло

- розумієш

- використання

- використовуваний

- використання

- утиліта

- постачальники

- прогулянки

- хотіти

- Ордери

- було

- Води

- we

- ДОБРЕ

- Що

- будь

- Чи

- який

- в той час як

- ВООЗ

- чий

- чому

- готовий

- мудрість

- з

- Work

- світ

- йорк

- Ти

- вашу

- зефірнет