Зараз шахрайство в Інтернеті може стати набагато небезпечнішим, оскільки шахраї мають безперешкодний доступ до ChatGPT, Techradar звіти.

Широко популярний чат-бот ChatGPT на основі ШІ постійно потрапляє в заголовки газет. Завдяки своїй здатності писати все, починаючи від налагодження коду iframe і закінчуючи складним кодом комп’ютерного програмування, ChatGPT затвердив штучний інтелект як технічний модний термін року.

Незважаючи на величезну популярність і залучення, ChatGPT викликає занепокоєння щодо етики та регулювання.

Читайте також: Користувачі ChatGPT «втечуть з в’язниці» ШІ, звільнить Дена Альтер Его

Недавній звітом опублікований дослідниками кібербезпеки з Norton Labs, виклав три ключові способи, якими зловмисники можуть зловживати ChatGPT. У звіті зазначено, що ChatGPT може бути використаний для більш ефективного інтернет-шахрайства: шляхом генерації глибоко підробленого вмісту, створення фішингу та створення шкідливого програмного забезпечення.

«Лабораторії Norton очікують, що шахраї також розглядають можливості великих мовних моделей і тестують способи вдосконалення своїх кіберзлочинів, щоб зробити їх більш реалістичними та правдоподібними», — йдеться у звіті.

Здатність інструменту виробляти «високоякісну дезінформацію або дезінформацію у великих масштабах» може допомогти ботофермам ефективніше посилювати розбрат. За словами Нортона, це може дозволити зловмисникам без зусиль «вселяти сумніви та маніпулювати наративами кількома мовами».

Дуже переконлива «дезінформація»

Написання переконливих бізнес-планів, стратегій і описів компаній – це дитяча гра для ChatGPT. Однак цей потенціал також підвищує ризики дезінформації, яка може перетворитися на шахрайство.

«Мало того, що контент, створений ChatGPT, іноді ненавмисно є неправильним, але й зловмисники також можуть використовувати ці інструменти для навмисного створення контенту, який використовується, щоб певним чином завдати шкоди людям», — йдеться у звіті.

Його здатність генерувати «високоякісну дезінформацію або дезінформацію в масштабах може призвести до недовіри та сформувати наративи різними мовами».

Писати відгуки про продукти стало дедалі простіше з ChatGPT, який неможливо відстежити, оскільки він щоразу генерує індивідуальні відповіді з тією самою інформацією. Незважаючи на свої можливості, він ставить перед собою завдання «виявляти фальшиві відгуки та неякісні продукти».

Викликає занепокоєння те, що інструмент також може використовуватися для залякування.

«Використання цих інструментів у кампаніях переслідування в соціальних мережах, щоб змусити людей замовкнути або знущатися, також є можливим результатом, який матиме жахливий вплив на мову», — зазначається у звіті.

ChatGPT у фішингових кампаніях

ChatGPT особливо добре справляється зі створенням людського звучання тексту різними мовами, причому читачам не залишається байдужим щодо того, створений текст штучним інтелектом чи людиною. Навіть OpenAI, розробник ChatGPT, не може визначити, чи був текст написаний ШІ, заявляючи, що «неможливо надійно виявити весь текст, написаний ШІ».

Перспектива використання ChatGPT у фішингових кампаніях є реальною.

«Зловмисники можуть використовувати ChatGPT для створення фішингових електронних листів або публікацій у соціальних мережах, які нібито походять із законних джерел, що ускладнює виявлення та захист від таких загроз», — йдеться у звіті.

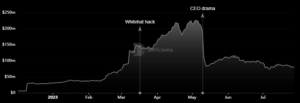

Зі зростанням його популярності ймовірним наслідком є збільшення кількості «фішингових кампаній та їх складності».

У звіті йдеться про те, що «зловмисники можуть надавати ChatGPT реальні приклади нешкідливих повідомлень від компаній, яких вони хочуть видати за себе, і наказувати ШІ створювати нові на основі того самого стилю зі зловмисними намірами».

Такі кампанії можуть виявитися дуже успішними в обмані осіб з метою розкриття особистої інформації або надсилання грошей злочинним організаціям. Norton Labs радить споживачам бути обережними, «натискаючи посилання або надаючи особисту інформацію».

ChatGPT може створювати шкідливі програми

Створення коду та адаптація різних мов програмування є невід’ємною частиною послуг ChatGPT. Тож не дивно, що шахраї використовують його для створення шкідливого програмного забезпечення.

«За допомогою правильної підказки початківці автори зловмисного програмного забезпечення можуть описати, що вони хочуть зробити, і отримати робочі фрагменти коду», - йдеться у звіті. Це створює серйозну загрозу атак зловмисного програмного забезпечення, достатньо розвинутих, щоб спричинити хаос.

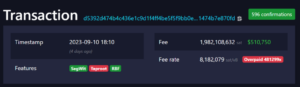

«Одним із прикладів є генерація коду для виявлення того, коли адреса біткойн-гаманця копіюється в буфер обміну, щоб її можна було замінити шкідливою адресою, контрольованою автором шкідливого програмного забезпечення», — пояснюється у звіті.

У результаті наявність такого чат-бота спричинить зростання складності шкідливого програмного забезпечення.

- Розповсюдження контенту та PR на основі SEO. Отримайте посилення сьогодні.

- Платоблокчейн. Web3 Metaverse Intelligence. Розширені знання. Доступ тут.

- джерело: https://metanews.com/chatgpt-is-being-used-to-make-quality-scams/

- :є

- 7

- 8

- a

- здатність

- Здатний

- МЕНЮ

- зловживання

- доступ

- За

- актори

- адреса

- просунутий

- проти

- AI

- Можливість

- Aid

- ВСІ

- та

- очікування

- з'являтися

- ЕСТЬ

- AS

- At

- нападки

- автор

- authors

- наявність

- поганий

- заснований

- BE

- оскільки

- ставати

- буття

- Біткойн

- Bitcoin Гаманець

- Бот

- знущання

- бізнес

- by

- Кампанії

- CAN

- не може

- можливості

- потужність

- Викликати

- обережний

- виклик

- Chatbot

- ChatGPT

- код

- Компанії

- компанія

- комплекс

- комп'ютер

- Турбота

- Споживачі

- зміст

- Генерація контенту

- постійно

- контроль

- може

- виробити

- створювати

- створення

- Кримінальну

- Кібербезпека

- Небезпечний

- описувати

- Розробник

- різний

- важкий

- Розкриття

- розбрат

- дезінформація

- сумніваюся

- кожен

- ефект

- Ефективний

- фактично

- повідомлення електронної пошти

- включіть

- зачеплення

- юридичні особи

- встановлений

- етика

- Навіть

- все

- приклад

- Приклади

- пояснені

- підроблений

- ферми

- для

- шахраї

- від

- породжувати

- генерується

- генерує

- породжує

- покоління

- отримати

- добре

- Мати

- має

- Headlines

- дуже

- Однак

- HTTPS

- величезний

- людина

- ідентифікувати

- неможливе

- in

- Augmenter

- Збільшує

- все більше і більше

- зазначений

- індивідуальний

- осіб

- інформація

- намір

- навмисно

- інтернет

- IT

- ЙОГО

- ключ

- Labs

- мова

- мови

- великий

- вести

- життя

- зв'язку

- трохи

- серія

- зробити

- Робить

- шкідливих програм

- макс-ширина

- Медіа

- повідомлення

- може бути

- Дезінформація

- недовіра

- Моделі

- гроші

- більше

- множинний

- розповіді

- Нові

- примітки

- novice

- номер

- of

- on

- ONE

- OpenAI

- порядок

- Результат

- частина

- особливо

- Люди

- персонал

- phishing

- плани

- plato

- Інформація про дані Платона

- PlatoData

- Play

- Грати для

- популярний

- популярність

- позах

- це можливо

- Пости

- потенціал

- виробляти

- Вироблений

- Продукти

- Програмування

- мови програмування

- перспектива

- Доведіть

- за умови

- забезпечення

- опублікований

- Читати

- читачі

- реальний

- справжнє життя

- реалістичний

- останній

- Регулювання

- замінити

- звітом

- Дослідники

- результат

- Відгуки

- ризики

- то ж

- шкала

- Шахрайство

- Шахраї

- шахрайство

- відправка

- серйозний

- Послуги

- Форма

- Мовчання

- просто

- So

- соціальна

- соціальні медіа

- Повідомлення в соціальних мережах

- деякі

- Джерела

- мова

- Навпроти

- заявив,

- стратегії

- стиль

- успішний

- такі

- технології

- Тестування

- Дякую

- Що

- Команда

- їх

- Їх

- Ці

- загроза

- актори загроз

- загрози

- три

- через

- час

- до

- інструмент

- інструменти

- ПЕРЕГЛЯД

- Типи

- розв'язати

- використання

- користувачі

- Wallet

- шлях..

- способи

- Що

- Чи

- який

- широко

- волі

- з

- робочий

- б

- запис

- письмовий

- зефірнет