Створення масштабованих і ефективних конвеєрів машинного навчання (ML) має вирішальне значення для оптимізації розробки, розгортання та керування моделями ML. У цій публікації ми представляємо структуру для автоматизації створення спрямованого ациклічного графа (DAG) для Трубопроводи Amazon SageMaker на основі простих конфігураційних файлів. The рамковий код і приклади представлені тут охоплюють лише конвеєри навчання моделей, але їх можна також легко розширити до конвеєрів пакетного виведення.

Цей динамічний фреймворк використовує файли конфігурації для організації етапів попередньої обробки, навчання, оцінки та реєстрації як для одномодельних, так і для багатомодельних випадків використання на основі визначених користувачем сценаріїв Python, потреб інфраструктури (включаючи Віртуальна приватна хмара Amazon (Amazon VPC) підмережі та групи безпеки, Управління ідентифікацією та доступом AWS (IAM) ролі, Служба управління ключами AWS (AWS KMS) ключі, реєстр контейнерів і типи екземплярів), введення та виведення Служба простого зберігання Amazon (Amazon S3) шляхи та теги ресурсів. Файли конфігурації (YAML і JSON) дозволяють фахівцям ML вказувати недиференційований код для оркестрування навчальних конвеєрів за допомогою декларативного синтаксису. Це дає змогу дослідникам обробки даних швидко створювати й повторювати моделі ML, а інженерам ML — швидше запускати конвеєри ML безперервної інтеграції та безперервної доставки (CI/CD), скорочуючи час виробництва моделей.

Огляд рішення

Пропонований код фреймворку починається зі зчитування файлів конфігурації. Потім він динамічно створює SageMaker Pipelines DAG на основі кроків, оголошених у файлах конфігурації, а також взаємодій і залежностей між кроками. Цей фреймворк оркестровки обслуговує випадки використання як однієї, так і кількох моделей і забезпечує плавний потік даних і процесів. Основні переваги цього рішення:

- Автоматизація – Весь робочий процес ML, від попередньої обробки даних до реєстру моделі, організований без ручного втручання. Це скорочує час і зусилля, необхідні для експериментування та введення в дію моделі.

- Відтворюваність – За допомогою попередньо визначеного файлу конфігурації спеціалісти з обробки даних та інженери ML можуть відтворювати весь робочий процес, досягаючи узгоджених результатів у кількох циклах і середовищах.

- масштабованість - Amazon SageMaker використовується в усьому конвеєрі, що дозволяє фахівцям ML обробляти великі набори даних і навчати складні моделі без проблем з інфраструктурою.

- Гнучкість – Фреймворк є гнучким і може включати широкий спектр випадків використання ML, фреймворків ML (таких як XGBoost і TensorFlow), багатомодельне навчання та багатокрокове навчання. Кожен крок навчання DAG можна налаштувати за допомогою файлу конфігурації.

- Модель управління - The Реєстр моделей Amazon SageMaker інтеграція дозволяє відстежувати версії моделей і, отже, впевнено просувати їх у виробництво.

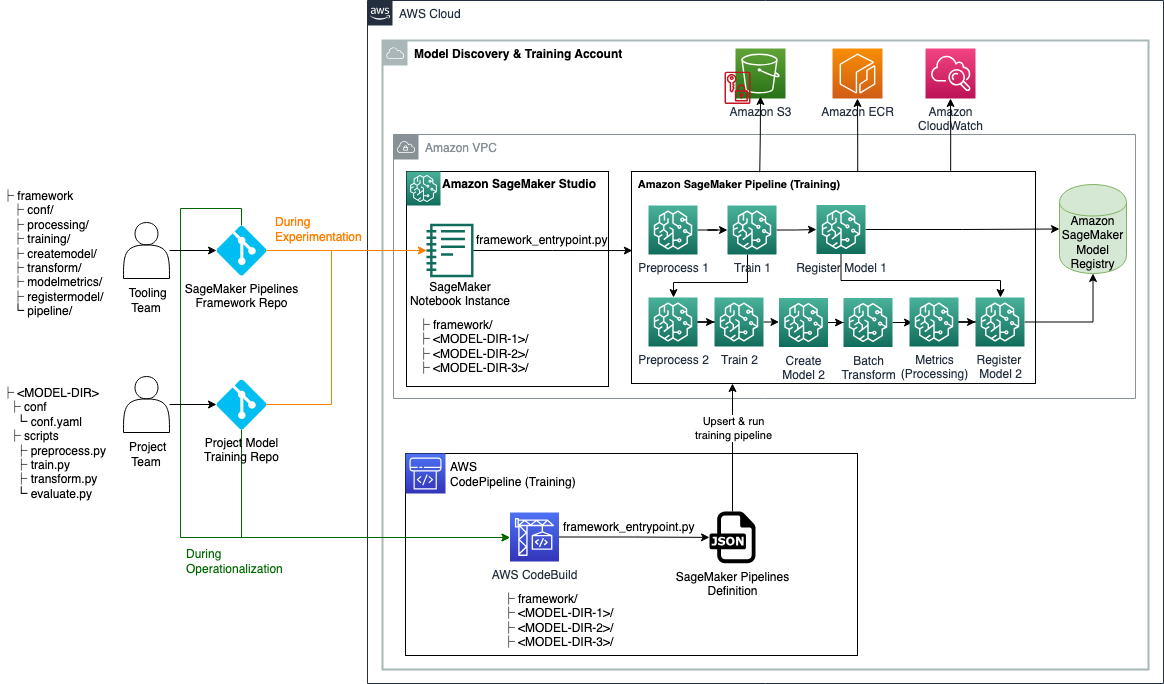

На наведеній нижче діаграмі архітектури показано, як ви можете використовувати запропоновану структуру як під час експериментування, так і введення в дію моделей ML. Під час експериментів ви можете клонувати репозиторій коду фреймворку, наданий у цій публікації, і репозиторії вихідного коду для вашого проекту в Студія Amazon SageMakerі налаштуйте своє віртуальне середовище (докладніше в цій публікації). Потім ви можете повторювати сценарії попередньої обробки, навчання та оцінки, а також вибирати конфігурацію. Щоб створити та запустити навчальну DAG SageMaker Pipelines, ви можете викликати точку входу фреймворку, яка прочитає всі конфігураційні файли, створить необхідні кроки та організує їх на основі вказаного порядку кроків і залежностей.

Під час введення в дію конвеєр CI клонує репозиторій коду рамки та навчальні репозиторії для конкретного проекту в AWS CodeBuild завдання, де скрипт точки входу фреймворку викликається для створення або оновлення навчальної DAG SageMaker Pipelines, а потім запускає його.

Структура репозитарію

Команда GitHub сховище містить наступні каталоги та файли:

- /framework/conf/ – Цей каталог містить файл конфігурації, який використовується для встановлення загальних змінних для всіх модулів моделювання, таких як підмережі, групи безпеки та роль IAM під час виконання. Блок моделювання — це послідовність із шести кроків для навчання моделі ML.

- /framework/createmodel/ – Цей каталог містить сценарій Python, який створює a Модель SageMaker об’єкт на основі модельних артефактів з a Етап навчання SageMaker Pipelines. Об’єкт моделі пізніше використовується в a Пакетне перетворення SageMaker завдання для оцінки продуктивності моделі на тестовому наборі.

- /framework/modelmetrics/ – Цей каталог містить сценарій Python, який створює Обробка Amazon SageMaker завдання для створення звіту JSON про показники моделі для навченої моделі на основі результатів завдання пакетного перетворення SageMaker, виконаного на тестових даних.

- /framework/pipeline/ – Цей каталог містить сценарії Python, які використовують класи Python, визначені в інших каталогах фреймворку, для створення або оновлення SageMaker Pipelines DAG на основі вказаних конфігурацій. Сценарій model_unit.py використовується pipeline_service.py для створення одного або кількох модулів моделювання. Кожен блок моделювання — це послідовність із шести кроків для навчання моделі ML: обробка, навчання, створення моделі, перетворення, метрика та реєстрація моделі. Конфігурації для кожного блоку моделювання слід вказати у відповідному репозиторії моделі. pipeline_service.py також встановлює залежності між кроками SageMaker Pipelines (як кроки всередині та між одиницями моделювання послідовні або зв’язані) на основі розділу sagemakerPipeline, який має бути визначений у файлі конфігурації одного зі сховищ моделі (модель прив’язки). Це дозволяє перевизначити залежності за замовчуванням, визначені SageMaker Pipelines. Ми обговоримо структуру файлу конфігурації далі в цій публікації.

- /framework/processing/ – Цей каталог містить сценарій Python, який створює завдання обробки SageMaker на основі вказаного зображення Docker і сценарію точки входу.

- /framework/registermodel/ – Цей каталог містить сценарій Python для реєстрації навченої моделі разом із її обчисленими показниками в реєстрі моделей SageMaker.

- /framework/навчання/ – Цей каталог містить сценарій Python, який створює навчальне завдання SageMaker.

- /framework/transform/ – Цей каталог містить сценарій Python, який створює завдання пакетного перетворення SageMaker. У контексті навчання моделі це використовується для обчислення метрики продуктивності навченої моделі на основі тестових даних.

- /framework/utilities/ – Цей каталог містить службові сценарії для читання та об’єднання конфігураційних файлів, а також журналювання.

- /framework_entrypoint.py – Цей файл є точкою входу коду рамки. Він викликає функцію, визначену в каталозі /framework/pipeline/, щоб створити або оновити SageMaker Pipelines DAG і запустити її.

- /приклади/ – Цей каталог містить кілька прикладів того, як ви можете використовувати цю структуру автоматизації для створення простих і складних навчальних DAG.

- /env.env – Цей файл дозволяє встановлювати загальні змінні, такі як підмережі, групи безпеки та роль IAM, як змінні середовища.

- /requirements.txt – Цей файл визначає бібліотеки Python, необхідні для коду фреймворку.

Передумови

Перед розгортанням цього рішення ви повинні мати такі передумови:

- Обліковий запис AWS

- Студія SageMaker

- Роль SageMaker із дозволами Amazon S3 на читання/запис і AWS KMS на шифрування/дешифрування

- Відро S3 для зберігання даних, сценаріїв і артефактів моделі

- За бажанням, Інтерфейс командного рядка AWS (AWS CLI)

- Python3 (Python 3.7 або новішої версії) і наступні пакети Python:

- boto3

- мудрець

- PyYAML

- Додаткові пакети Python, які використовуються у ваших власних сценаріях

Розгорніть рішення

Щоб розгорнути рішення, виконайте наведені нижче дії.

- Організуйте своє сховище навчальних моделей відповідно до такої структури:

- Клонуйте код фреймворку та вихідний код вашої моделі зі сховищ Git:

-

- Клон

dynamic-sagemaker-pipelines-frameworkrepo в навчальний каталог. У наступному коді ми припускаємо, що викликається навчальний каталогaws-train: - Клонуйте вихідний код моделі в тому ж каталозі. Для навчання з кількома моделями повторіть цей крок для стільки моделей, скільки потрібно для навчання.

- Клон

Для навчання з однією моделлю ваш каталог має виглядати так:

Для багатомодельного навчання ваш каталог має виглядати так:

- Налаштуйте наступні змінні середовища. Зірочками позначено необхідні змінні середовища; решта необов'язкові.

| Змінна середовища | Опис |

SMP_ACCOUNTID* |

Обліковий запис AWS, де запускається конвеєр SageMaker |

SMP_REGION* |

Регіон AWS, де запускається конвеєр SageMaker |

SMP_S3BUCKETNAME* |

Назва відра S3 |

SMP_ROLE* |

Роль SageMaker |

SMP_MODEL_CONFIGPATH* |

Відносний шлях файлів конфігурації однієї або кількох моделей |

SMP_SUBNETS |

Ідентифікатори підмережі для конфігурації мережі SageMaker |

SMP_SECURITYGROUPS |

Ідентифікатори груп безпеки для конфігурації мережі SageMaker |

Для випадків використання однієї моделі, SMP_MODEL_CONFIGPATH буде <MODEL-DIR>/conf/conf.yaml. Для випадків використання кількох моделей, SMP_MODEL_CONFIGPATH буде */conf/conf.yaml, що дозволяє знайти все conf.yaml файли за допомогою модуля glob Python і об’єднайте їх, щоб сформувати файл глобальної конфігурації. Під час експериментування (локального тестування) ви можете вказати змінні середовища у файлі env.env, а потім експортувати їх, виконавши таку команду у своєму терміналі:

Зверніть увагу, що значення змінних середовища в env.env повинні бути взяті в лапки (наприклад, SMP_REGION="us-east-1"). Під час введення в дію ці змінні середовища повинні бути встановлені конвеєром CI.

- Створіть і активуйте віртуальне середовище, виконавши такі команди:

- Встановіть необхідні пакети Python, виконавши таку команду:

- Відредагуйте модель навчання

conf.yamlфайли. Ми обговоримо структуру файлу конфігурації в наступному розділі. - З терміналу викличте точку входу фреймворку, щоб створити або оновити та запустити навчальну DAG SageMaker Pipeline:

- Перегляд і налагодження конвеєрів SageMaker, запущених на Трубопроводи вкладка інтерфейсу SageMaker Studio.

Структура файлу конфігурації

У запропонованому рішенні є два типи файлів конфігурації: конфігурація фреймворку та конфігурація моделі. У цьому розділі ми докладно опишемо кожен.

Конфігурація каркаса

Команда /framework/conf/conf.yaml файл встановлює змінні, які є спільними для всіх модулів моделювання. Це включає SMP_S3BUCKETNAME, SMP_ROLE, SMP_MODEL_CONFIGPATH, SMP_SUBNETS, SMP_SECURITYGROUPS та SMP_MODELNAME. Зверніться до кроку 3 інструкцій із розгортання, щоб отримати описи цих змінних і способи їх встановлення за допомогою змінних середовища.

Конфігурація моделі

Для кожної моделі в проекті нам потрібно вказати наступне в <MODEL-DIR>/conf/conf.yaml файл (зірочки позначають обов'язкові розділи; решта необов'язкові):

- /conf/models* – У цьому розділі ви можете налаштувати один або кілька модулів моделювання. Під час запуску коду фреймворку він автоматично читатиме всі файли конфігурації під час виконання та додаватиме їх до дерева конфігурації. Теоретично ви можете вказати всі модулі моделювання в одному

conf.yamlфайл, але рекомендується вказувати кожну конфігурацію модуля моделювання у відповідному каталозі чи сховищі Git, щоб мінімізувати помилки. Одиниці наступні:- {model-name}* – Назва моделі.

- вихідний_каталог* – Поширений

source_dirшлях для використання для всіх кроків у модулі моделювання. - попередній процес – У цьому розділі вказуються параметри попередньої обробки.

- поїзд* – У цьому розділі вказуються параметри навчальної роботи.

- трансформувати* – У цьому розділі вказуються параметри завдання SageMaker Transform для створення прогнозів на основі тестових даних.

- оцінювати – У цьому розділі вказуються параметри завдання SageMaker Processing для створення звіту JSON про показники моделі для навченої моделі.

- реєстр* – У цьому розділі вказуються параметри для реєстрації навченої моделі в реєстрі моделей SageMaker.

- /conf/sagemakerPipeline* – Цей розділ визначає потік SageMaker Pipelines, включаючи залежності між кроками. Для випадків використання однієї моделі цей розділ визначається в кінці файлу конфігурації. Для випадків використання кількох моделей

sagemakerPipelineрозділ потрібно лише визначити у файлі конфігурації однієї з моделей (будь-якої з моделей). Ми називаємо цю модель якірна модель. Параметри такі:- pipelineName* – Назва конвеєра SageMaker.

- Моделі* – Вкладений список модулів моделювання:

- {model-name}* – Ідентифікатор моделі, який має відповідати ідентифікатору {model-name} у розділі /conf/models.

- кроки* -

- step_name* – Ім’я кроку, яке відображатиметься в SageMaker Pipelines DAG.

- step_class* – (Union[Processing, Training, CreateModel, Transform, Metrics, RegisterModel])

- step_type* – Цей параметр потрібний лише для етапів попередньої обробки, для яких його слід налаштувати на попередню обробку. Це необхідно, щоб розрізнити етапи попередньої обробки та оцінки, обидва з яких мають a

step_classобробки. - enable_cache – ([Об’єднання[Правда, Неправда]]). Це вказує, чи потрібно вмикати Кешування конвеєрів SageMaker для цього кроку.

- ланцюжок_введення_джерело_крок – ([список[назва_кроку]]). Ви можете використовувати це, щоб встановити виходи каналів іншого кроку як вхідні дані для цього кроку.

- ланцюговий_вхід_додатковий_префікс – Це дозволено лише для кроків трансформації

step_classі може використовуватися разом ізchain_input_source_stepпараметр, щоб точно визначити файл, який слід використовувати як вхідні дані для кроку перетворення.

- кроки* -

- {model-name}* – Ідентифікатор моделі, який має відповідати ідентифікатору {model-name} у розділі /conf/models.

- залежно – У цьому розділі вказується послідовність, у якій слід виконувати кроки SageMaker Pipelines. Ми адаптували нотацію Apache Airflow для цього розділу (наприклад,

{step_name} >> {step_name}). Якщо цей розділ залишити порожнім, явні залежності, указані вchain_input_source_stepпараметр або неявні залежності визначають потік SageMaker Pipelines DAG.

Зауважте, що ми рекомендуємо мати один навчальний крок на кожен блок моделювання. Якщо для одиниці моделювання визначено декілька кроків навчання, наступні кроки неявно беруть останній крок навчання для створення об’єкта моделі, обчислення показників і реєстрації моделі. Якщо вам потрібно навчити кілька моделей, рекомендується створити кілька модулів моделювання.

прикладів

У цьому розділі ми демонструємо три приклади DAG для навчання моделі ML, створених за допомогою представленої структури.

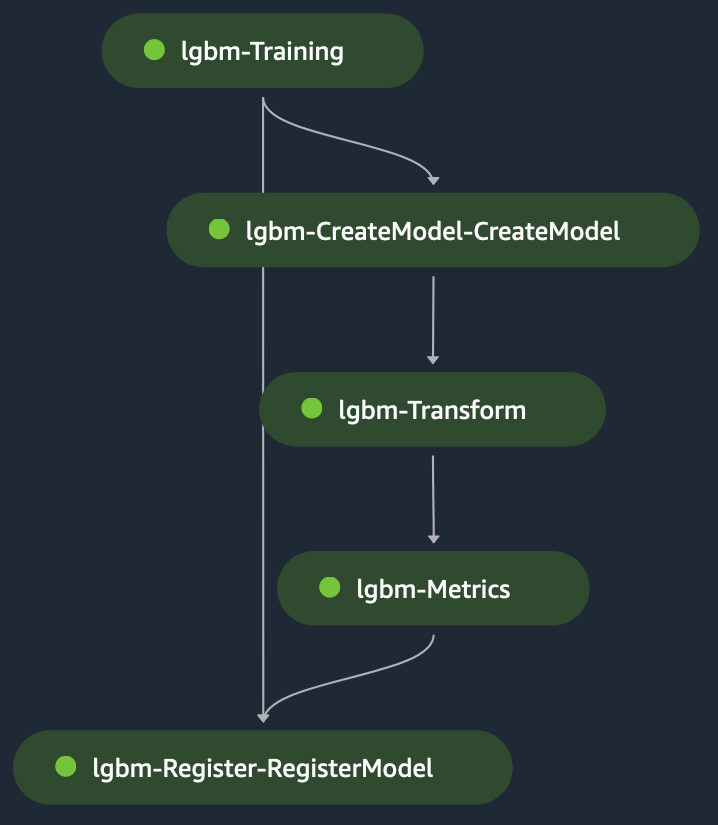

Одномодельне навчання: LightGBM

Це приклад однієї моделі для випадку використання класифікації, де ми використовуємо LightGBM у режимі сценарію на SageMaker, набору даних складається з категоріальних і числових змінних для прогнозування двійкової мітки Дохід (щоб передбачити, чи зробить суб’єкт покупку чи ні). The сценарій попередньої обробки використовується для моделювання даних для навчання та тестування, а потім помістіть його у відро S3. Потім шляхи S3 надаються до навчальний крок у файлі конфігурації.

Під час виконання кроку навчання SageMaker завантажує файл у контейнер за адресою /opt/ml/input/data/{channelName}/, доступний через змінну середовища SM_CHANNEL_{channelName} на контейнері (channelName= 'train' або 'test') сценарій навчання робить наступне:

- Завантажуйте файли локально зі шляхів локального контейнера за допомогою Навантаження NumPy модуль

- Задати гіперпараметри для алгоритму навчання.

- Збережіть навчену модель у локальному контейнерному шляху

/opt/ml/model/.

SageMaker бере вміст із /opt/ml/model/ для створення архіву, який використовується для розгортання моделі в SageMaker для розміщення.

Крок перетворення в якості вхідних даних приймає етап тестовий файл як вхідні дані і навчена модель, щоб робити прогнози на навченій моделі. Результатом кроку перетворення є прикутий до кроку показників, щоб оцінити модель порівняно з основна правда, який явно надається на етапі метрики. Нарешті, вихідні дані кроку метрик неявно пов’язані з кроком реєстру для реєстрації моделі в реєстрі моделей SageMaker з інформацією про продуктивність моделі, створеної на кроці метрик. На наступному малюнку показано візуальне представлення навчальної DAG. Ви можете звернутися до сценаріїв і файлу конфігурації для цього прикладу в GitHub репо.

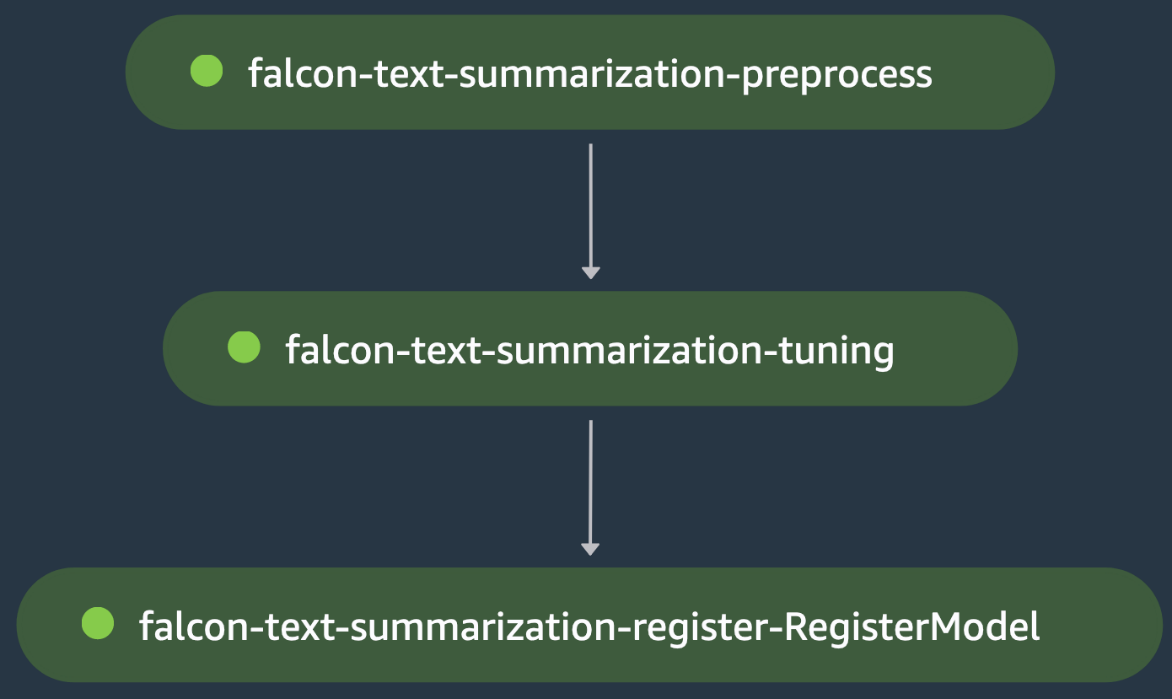

Одномодельне навчання: тонке налаштування LLM

Це ще один приклад навчання з однією моделлю, де ми організовуємо тонке налаштування великої мовної моделі (LLM) Falcon-40B від Hugging Face Hub для прикладу використання узагальнення тексту. The сценарій попередньої обробки завантажує samsum набір даних із Hugging Face, завантажує токенізер для моделі та обробляє розділення даних тренування/тесту для точного налаштування моделі на даних цього домену на етапі попередньої обробки falcon-text-summarization-process.

Вихідний результат прикутий до кроку налаштування falcon-text-summarization-tuning, де сценарій навчання завантажує Falcon-40B LLM із Hugging Face Hub і починає прискорене тонке налаштування за допомогою Лора на поїзді розділити. Модель оцінюється на тому ж етапі після тонкого налаштування, який воротарі втрата оцінки не виконує крок налаштування falcon-text-summarization-tuning, що спричиняє зупинку конвеєра SageMaker до того, як він зможе зареєструвати налаштовану модель. В іншому випадку крок налаштування falcon-text-summarization-tuning виконується успішно, і модель реєструється в реєстрі моделей SageMaker. На наступному малюнку показано візуальне представлення DAG для точного налаштування LLM. Сценарії та файл конфігурації для цього прикладу доступні в GitHub репо.

Багатомодельне навчання

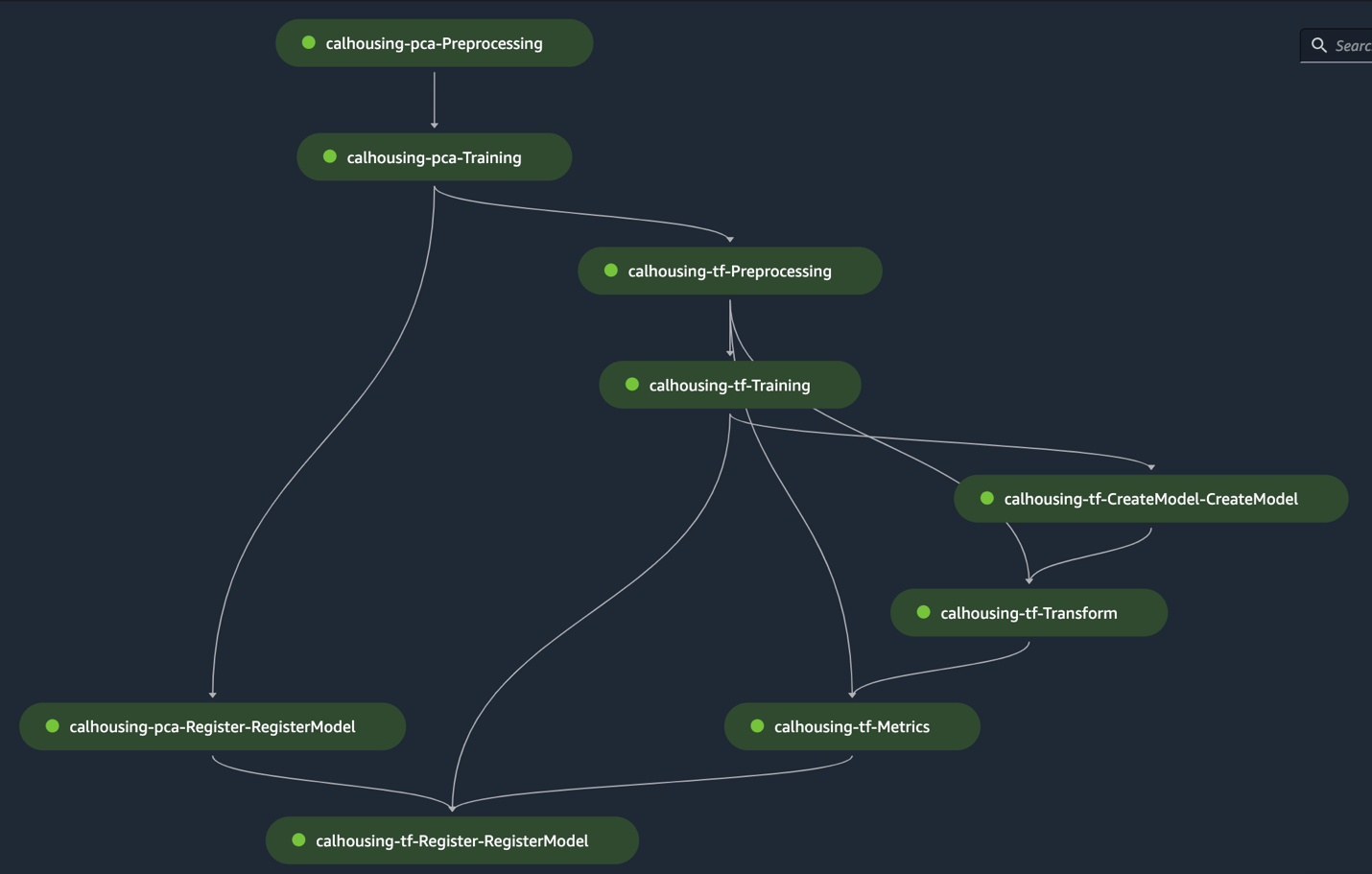

Це багатомодельний приклад навчання, де модель аналізу головних компонентів (PCA) навчається для зменшення розмірності, а модель TensorFlow Multilayer Perceptron навчається для Прогноз цін на житло в Каліфорнії. На етапі попередньої обробки моделі TensorFlow використовується навчена модель PCA, щоб зменшити розмірність своїх навчальних даних. Ми додаємо залежність у конфігурацію, щоб забезпечити реєстрацію моделі TensorFlow після реєстрації моделі PCA. На наступному малюнку показано візуальне представлення прикладу багатомодельного навчання DAG. Сценарії та конфігураційні файли для цього прикладу доступні в GitHub репо.

Прибирати

Виконайте наступні кроки, щоб очистити свої ресурси:

- Використовуйте AWS CLI, щоб список та видаляти будь-які інші конвеєри, створені сценаріями Python.

- За бажанням видаліть інші ресурси AWS, як-от сегмент S3 або роль IAM, створені за межами SageMaker Pipelines.

Висновок

У цій публікації ми представили структуру для автоматизації створення SageMaker Pipelines DAG на основі файлів конфігурації. Запропонований фреймворк пропонує перспективне рішення проблеми оркестрування складних робочих навантажень ML. Використовуючи файл конфігурації, SageMaker Pipelines забезпечує гнучкість створення оркестровки за допомогою мінімального коду, тож ви можете оптимізувати процес створення та керування конвеєрами як однієї, так і кількох моделей. Такий підхід не тільки економить час і ресурси, але й сприяє просуванню найкращих практик MLOps, сприяючи загальному успіху ініціатив ML. Щоб отримати додаткові відомості про деталі реалізації, перегляньте GitHub репо.

Про авторів

Луїс Феліпе Єпес Барріос, є інженером машинного навчання в AWS Professional Services, зосередженим на масштабованих розподілених системах і інструментах автоматизації для прискорення наукових інновацій у сфері машинного навчання (ML). Крім того, він допомагає корпоративним клієнтам оптимізувати їхні рішення машинного навчання за допомогою сервісів AWS.

Луїс Феліпе Єпес Барріос, є інженером машинного навчання в AWS Professional Services, зосередженим на масштабованих розподілених системах і інструментах автоматизації для прискорення наукових інновацій у сфері машинного навчання (ML). Крім того, він допомагає корпоративним клієнтам оптимізувати їхні рішення машинного навчання за допомогою сервісів AWS.

Цзіньчжао Фен, є інженером машинного навчання в AWS Professional Services. Він зосереджується на розробці та впровадженні широкомасштабних рішень Generative AI і класичних конвеєрних рішень ML. Він спеціалізується на FMOps, LLMOps та розподіленому навчанні.

Цзіньчжао Фен, є інженером машинного навчання в AWS Professional Services. Він зосереджується на розробці та впровадженні широкомасштабних рішень Generative AI і класичних конвеєрних рішень ML. Він спеціалізується на FMOps, LLMOps та розподіленому навчанні.

Суворий Аснані, інженер машинного навчання в AWS. Його досвід — прикладна наука про дані, зосереджена на масштабній реалізації робочих навантажень машинного навчання в хмарі.

Суворий Аснані, інженер машинного навчання в AWS. Його досвід — прикладна наука про дані, зосереджена на масштабній реалізації робочих навантажень машинного навчання в хмарі.

Хасан Шоджаї, є старшим спеціалістом із обробки даних у AWS Professional Services, де він допомагає клієнтам із різних галузей вирішувати їхні бізнес-завдання за допомогою великих даних, машинного навчання та хмарних технологій. До цієї посади Хасан керував кількома ініціативами з розробки нових методів моделювання на основі фізики та даних для провідних енергетичних компаній. Поза роботою Хасан захоплюється книгами, походами, фотографією та історією.

Хасан Шоджаї, є старшим спеціалістом із обробки даних у AWS Professional Services, де він допомагає клієнтам із різних галузей вирішувати їхні бізнес-завдання за допомогою великих даних, машинного навчання та хмарних технологій. До цієї посади Хасан керував кількома ініціативами з розробки нових методів моделювання на основі фізики та даних для провідних енергетичних компаній. Поза роботою Хасан захоплюється книгами, походами, фотографією та історією.

Алек Дженаб, є інженером машинного навчання, який спеціалізується на розробці та впровадженні рішень машинного навчання в масштабі для корпоративних клієнтів. Алек захоплено виводить на ринок інноваційні рішення, особливо в тих сферах, де машинне навчання може істотно покращити досвід кінцевих користувачів. Поза роботою він любить грати в баскетбол, кататися на сноуборді та відкривати приховані перлини Сан-Франциско.

Алек Дженаб, є інженером машинного навчання, який спеціалізується на розробці та впровадженні рішень машинного навчання в масштабі для корпоративних клієнтів. Алек захоплено виводить на ринок інноваційні рішення, особливо в тих сферах, де машинне навчання може істотно покращити досвід кінцевих користувачів. Поза роботою він любить грати в баскетбол, кататися на сноуборді та відкривати приховані перлини Сан-Франциско.

- Розповсюдження контенту та PR на основі SEO. Отримайте посилення сьогодні.

- PlatoData.Network Vertical Generative Ai. Додайте собі сили. Доступ тут.

- PlatoAiStream. Web3 Intelligence. Розширення знань. Доступ тут.

- ПлатонЕСГ. вуглець, CleanTech, Енергія, Навколишнє середовище, Сонячна, Поводження з відходами. Доступ тут.

- PlatoHealth. Розвідка про біотехнології та клінічні випробування. Доступ тут.

- джерело: https://aws.amazon.com/blogs/machine-learning/automate-amazon-sagemaker-pipelines-dag-creation/

- :є

- : ні

- :де

- $UP

- 120

- 160

- 7

- 8

- 9

- a

- Здатний

- МЕНЮ

- прискорений

- доступ

- доступною

- розмістити

- За

- рахунки

- досягнення

- через

- активоване

- ациклічні

- додавати

- після

- проти

- AI

- алгоритм

- ВСІ

- дозволяти

- дозволено

- дозволяє

- по

- Також

- Amazon

- Amazon SageMaker

- Трубопроводи Amazon SageMaker

- Amazon Web Services

- серед

- an

- аналіз

- Якір

- та

- Інший

- будь-який

- Apache

- прикладної

- підхід

- архітектура

- ЕСТЬ

- області

- AS

- допомагає

- припустити

- At

- автоматизувати

- автоматично

- автоматизація

- Автоматизація

- доступний

- AWS

- Професійні послуги AWS

- фон

- заснований

- баскетбол

- BE

- перед тим

- Переваги

- КРАЩЕ

- передового досвіду

- Великий

- Великий даних

- книги

- обидва

- Приведення

- будувати

- бізнес

- але

- by

- обчислювати

- розрахований

- call

- званий

- Виклики

- CAN

- випадок

- випадків

- обслуговує

- Причини

- прикутий

- виклик

- проблеми

- Канал

- вибір

- класів

- класифікація

- очистити

- cli

- клієнтів

- хмара

- код

- об'єднувати

- загальний

- Компанії

- комплекс

- компонент

- Турбота

- довіра

- конфігурація

- зв'язок

- послідовний

- складається

- Контейнер

- Контейнери

- містить

- зміст

- контекст

- безперервний

- внесок

- обкладинка

- створювати

- створений

- створює

- створення

- створення

- вирішальне значення

- виготовлений на замовлення

- Клієнти

- налаштувати

- DAG

- дані

- наука про дані

- вчений даних

- керовані даними

- набори даних

- оголошений

- дефолт

- визначати

- певний

- Визначає

- доставка

- демонструвати

- залежно

- Залежність

- розгортання

- розгортання

- розгортання

- описувати

- деталь

- докладно

- деталі

- розвивати

- розвивається

- розробка

- схема

- різний

- спрямований

- каталоги

- каталог

- відкриття

- обговорювати

- displayed

- розрізняти

- розподілений

- розподілені системи

- розподілене навчання

- Docker

- робить

- домен

- під час

- динамічний

- динамічно

- кожен

- ефективний

- зусилля

- повноваження

- включіть

- дозволяє

- дозволяє

- кінець

- енергія

- інженер

- Інженери

- забезпечувати

- підприємство

- Весь

- запис

- Навколишнє середовище

- середовищах

- помилки

- особливо

- оцінювати

- оцінюється

- оцінки

- оцінка

- Кожен

- приклад

- Приклади

- прискорити

- досвід

- явно

- експорт

- розширений

- Face

- FAIL

- false

- швидше

- поле

- Рисунок

- філе

- Файли

- в кінці кінців

- знайти

- Гнучкість

- гнучкий

- потік

- Сфокусувати

- увагу

- фокусується

- після

- слідує

- для

- форма

- перспективний

- Рамки

- каркаси

- Франциско

- від

- функція

- Крім того

- породжує

- генеративний

- Генеративний ШІ

- Git

- Глобальний

- управління

- графік

- великий

- Group

- Групи

- Мати

- має

- he

- допомагає

- тут

- прихований

- його

- історія

- хостинг

- житло

- Як

- How To

- HTML

- HTTP

- HTTPS

- Концентратор

- ідентифікатор

- Особистість

- ідентифікатори

- if

- зображення

- реалізація

- реалізації

- удосконалювати

- in

- В інших

- includes

- У тому числі

- вказувати

- вказує

- промисловості

- зробити висновок

- інформація

- Інфраструктура

- ініціативи

- інновація

- інноваційний

- вхід

- всередині

- встановлювати

- екземпляр

- інструкції

- інтеграція

- Взаємодії

- втручання

- в

- IT

- ЙОГО

- робота

- приєднання

- JPG

- json

- ключ

- ключі

- етикетка

- мова

- великий

- останній

- пізніше

- вивчення

- Led

- залишити

- libraries

- як

- Лінія

- список

- LLM

- загрузка

- вантажі

- місцевий

- локально

- каротаж

- подивитися

- виглядає як

- від

- машина

- навчання за допомогою машини

- зробити

- РОБОТИ

- Робить

- управління

- управління

- керівництво

- багато

- ринок

- матч

- метрика

- Метрика

- мінімальний

- мінімізувати

- ML

- MLOps

- режим

- модель

- моделювання

- Моделі

- Модулі

- більше

- множинний

- ім'я

- необхідно

- Необхідність

- необхідний

- потреби

- мережа

- наступний

- немає

- роман

- об'єкт

- of

- Пропозиції

- on

- ONE

- тільки

- оптимізуючий

- or

- організував

- оркестровка

- оркестровка

- Інше

- інакше

- вихід

- виходи

- поза

- загальний

- перевизначення

- пакети

- параметр

- параметри

- пристрасний

- шлях

- стежки

- для

- продуктивність

- виконується

- малюнок

- трубопровід

- plato

- Інформація про дані Платона

- PlatoData

- ігри

- точка

- пошта

- практики

- заздалегідь визначений

- передбачати

- Прогнози

- передумови

- представити

- представлений

- price

- Головний

- попередній

- приватний

- процес

- процеси

- обробка

- Вироблений

- Production

- професійний

- проект

- сприяє

- сприяння

- запропонований

- за умови

- забезпечує

- покупка

- Python

- швидко

- діапазон

- Читати

- легко

- читання

- рекомендувати

- рекомендований

- зменшити

- знижує

- скорочення

- послатися

- регіон

- реєструвати

- зареєстрований

- реєструючий

- Реєстрація

- реєстру

- решті

- повторювати

- звітом

- Сховище

- подання

- вимагається

- Вимога

- ресурс

- ресурси

- ті

- REST

- результати

- revenue

- огляд

- Роль

- ролі

- прогін

- біг

- пробіжки

- час виконання

- мудрець

- Трубопроводи SageMaker

- то ж

- Сан -

- Сан Франциско

- масштабовані

- шкала

- наука

- науковий

- вчений

- Вчені

- сценарій

- scripts

- розділ

- розділам

- безпеку

- Послідовність

- Послуги

- комплект

- набори

- кілька

- Повинен

- Шоу

- простий

- SIX

- згладити

- So

- рішення

- Рішення

- ВИРІШИТИ

- Source

- вихідні

- спеціалізований

- спеціалізується

- зазначений

- розкол

- Розколи

- починається

- Крок

- заходи

- Стоп

- зберігання

- зберігання

- раціоналізувати

- упорядкування

- структура

- студія

- тема

- підмережі

- наступні

- успіх

- Успішно

- такі

- поставляється

- синтаксис

- Systems

- Приймати

- приймає

- методи

- Технології

- тензорний потік

- термінал

- тест

- Тестування

- текст

- Що

- Команда

- Реєстр

- їх

- Їх

- потім

- отже

- Ці

- це

- три

- через

- по всьому

- час

- до

- топ

- Відстеження

- поїзд

- навчений

- Навчання

- Перетворення

- дерево

- правда

- два

- Типи

- ui

- при

- блок

- одиниць

- Оновити

- використання

- використання випадку

- використовуваний

- користувач

- User Experience

- використовує

- використання

- утиліта

- Цінності

- змінна

- версії

- через

- Віртуальний

- візуальний

- we

- Web

- веб-сервіси

- ДОБРЕ

- коли

- Чи

- який

- ВООЗ

- широкий

- Широкий діапазон

- волі

- з

- в

- без

- Work

- робочий

- XGBoost

- ямл

- Ти

- вашу

- зефірнет