В основі LangChain це інноваційний фреймворк, призначений для створення програм, які використовують можливості мовних моделей. Це набір інструментів, розроблений для розробників для створення програм, які залежать від контексту та здатні до складних міркувань.

Це означає, що додатки LangChain можуть розуміти контекст, наприклад швидкі інструкції чи відповіді, що ґрунтуються на вмісті, і використовувати мовні моделі для складних завдань міркування, як-от рішення про те, як відповісти або які дії виконати. LangChain представляє уніфікований підхід до розробки інтелектуальних програм, спрощуючи шлях від концепції до виконання за допомогою різноманітних компонентів.

Розуміння LangChain

LangChain — це набагато більше, ніж просто фреймворк; це повноцінна екосистема, що складається з кількох невід’ємних частин.

- По-перше, є бібліотеки LangChain, доступні як на Python, так і на JavaScript. Ці бібліотеки є основою LangChain, пропонуючи інтерфейси та інтеграцію для різних компонентів. Вони забезпечують базове середовище виконання для об’єднання цих компонентів у зв’язані ланцюжки та агенти разом із готовими реалізаціями для негайного використання.

- Далі у нас є шаблони LangChain. Це набір еталонних архітектур, що розгортаються, розроблених для широкого спектру завдань. Незалежно від того, створюєте ви чат-бота чи складний аналітичний інструмент, ці шаблони пропонують надійну відправну точку.

- LangServe виступає як універсальна бібліотека для розгортання ланцюжків LangChain як REST API. Цей інструмент необхідний для перетворення ваших проектів LangChain на доступні та масштабовані веб-сервіси.

- Нарешті, LangSmith служить платформою для розробників. Він призначений для налагодження, тестування, оцінки та моніторингу ланцюжків, побудованих на будь-якому фреймворку LLM. Повна інтеграція з LangChain робить його незамінним інструментом для розробників, які прагнуть удосконалити та вдосконалити свої програми.

Разом ці компоненти дають змогу з легкістю розробляти, створювати та розгортати програми. З LangChain ви починаєте з написання програм за допомогою бібліотек, посилаючись на шаблони для вказівок. Потім LangSmith допоможе вам перевіряти, тестувати та контролювати ваші ланцюги, гарантуючи, що ваші програми постійно вдосконалюються та готові до розгортання. Нарешті, за допомогою LangServe ви можете легко перетворити будь-який ланцюжок на API, що полегшить розгортання.

У наступних розділах ми глибше розглянемо, як налаштувати LangChain і розпочнемо вашу подорож у створенні інтелектуальних додатків на основі мовної моделі.

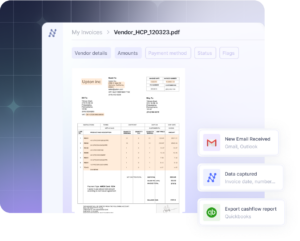

Автоматизуйте ручні завдання та робочі процеси за допомогою нашого конструктора робочих процесів на основі ШІ, розробленого Nanonets для вас і ваших команд.

Встановлення та налаштування

Ви готові поринути у світ LangChain? Налаштувати це просто, і цей посібник крок за кроком проведе вас через процес.

Першим кроком у вашій подорожі LangChain є його встановлення. Ви можете легко зробити це за допомогою pip або conda. Виконайте таку команду у вашому терміналі:

pip install langchain

Для тих, хто віддає перевагу найновішим функціям і готовий отримати більше пригод, ви можете встановити LangChain безпосередньо з початкового коду. Клонуйте репозиторій і перейдіть до langchain/libs/langchain каталог. Потім запустіть:

pip install -e .

Розгляньте можливість встановлення експериментальних функцій langchain-experimental. Це пакет, який містить передовий код і призначений для дослідницьких і експериментальних цілей. Встановіть його за допомогою:

pip install langchain-experimental

LangChain CLI — це зручний інструмент для роботи з шаблонами LangChain і проектами LangServe. Щоб установити LangChain CLI, використовуйте:

pip install langchain-cli

LangServe необхідний для розгортання ваших ланцюжків LangChain як REST API. Його встановлюють разом із LangChain CLI.

LangChain часто вимагає інтеграції з постачальниками моделей, сховищами даних, API тощо. Для цього прикладу ми використаємо API моделі OpenAI. Встановіть пакет OpenAI Python за допомогою:

pip install openai

Щоб отримати доступ до API, установіть ключ OpenAI API як змінну середовища:

export OPENAI_API_KEY="your_api_key"

Крім того, передайте ключ безпосередньо у своєму середовищі python:

import os

os.environ['OPENAI_API_KEY'] = 'your_api_key'

LangChain дозволяє створювати програми мовної моделі за допомогою модулів. Ці модулі можуть стояти окремо або складатися для складних випадків використання. Ці модулі –

- Модель I/O: полегшує взаємодію з різними мовними моделями, ефективно обробляючи їхні вхідні та вихідні дані.

- Пошук: Забезпечує доступ до даних конкретної програми та взаємодію з ними, що має вирішальне значення для динамічного використання даних.

- Агенти: Дозвольте програмам вибирати відповідні інструменти на основі директив високого рівня, покращуючи можливості прийняття рішень.

- Ланцюги: Пропонує попередньо визначені багаторазові композиції, які служать будівельними блоками для розробки програм.

- пам'ять: підтримує стан програми під час кількох ланцюжків виконання, необхідне для контекстно-залежної взаємодії.

Кожен модуль націлений на конкретні потреби розробки, що робить LangChain комплексним набором інструментів для створення розширених програм мовної моделі.

Поряд з вищевказаними компонентами, ми також маємо Мова експресії LangChain (LCEL), що є декларативним способом легкого складання модулів разом, і це дозволяє об’єднувати компоненти за допомогою універсального інтерфейсу Runnable.

LCEL виглядає приблизно так –

from langchain.chat_models import ChatOpenAI

from langchain.prompts import ChatPromptTemplate

from langchain.schema import BaseOutputParser # Example chain

chain = ChatPromptTemplate() | ChatOpenAI() | CustomOutputParser()

Тепер, коли ми розглянули основи, ми продовжимо:

- Розгляньте докладніше кожен модуль Langchain.

- Дізнайтеся, як використовувати мову виразів LangChain.

- Досліджуйте загальні випадки використання та впроваджуйте їх.

- Розгорніть наскрізну програму за допомогою LangServe.

- Перегляньте LangSmith для налагодження, тестування та моніторингу.

Давайте розпочнемо!

Модуль I: Модель введення/виведення

У LangChain основний елемент будь-якої програми обертається навколо мовної моделі. Цей модуль надає основні будівельні блоки для ефективного інтерфейсу з будь-якою мовною моделлю, забезпечуючи бездоганну інтеграцію та спілкування.

Ключові компоненти моделі I/O

- LLM і моделі чату (взаємозамінні):

- LLM:

- Визначення: Моделі завершення чистого тексту.

- Введення-виведення: приймати текстовий рядок як вхідні дані та повертати текстовий рядок як вихідні дані.

- Моделі чату

- LLM:

- Визначення: моделі, які використовують мовну модель як основу, але відрізняються форматами введення та виведення.

- Введення-виведення: прийняти список повідомлень чату як вхідні дані та повернути повідомлення чату.

- Підказки: створення шаблонів, динамічний вибір і керування входами моделі. Дозволяє створювати гнучкі контекстно-залежні підказки, які керують відповідями мовної моделі.

- Парсери виводу: вилучення та форматування інформації з вихідних даних моделі. Корисно для перетворення вихідних даних мовних моделей у структуровані дані або спеціальні формати, необхідні програмі.

LLM

Інтеграція LangChain із великими мовними моделями (LLM), такими як OpenAI, Cohere та Hugging Face, є фундаментальним аспектом його функціональності. Сам LangChain не розміщує LLM, але пропонує єдиний інтерфейс для взаємодії з різними LLM.

У цьому розділі наведено огляд використання оболонки OpenAI LLM у LangChain, яка також застосовується до інших типів LLM. Ми вже встановили це в розділі «Початок роботи». Давайте ініціалізуємо LLM.

from langchain.llms import OpenAI

llm = OpenAI()

- LLM реалізують Запуск інтерфейсу, основний будівельний блок Мова експресії LangChain (LCEL). Це означає, що вони підтримують

invoke,ainvoke,stream,astream,batch,abatch,astream_logдзвінки - LLM приймають струни як вхідні дані або об’єкти, які можуть бути примусово створені для рядкових підказок, у тому числі

List[BaseMessage]таPromptValue. (докладніше про це пізніше)

Давайте розглянемо кілька прикладів.

response = llm.invoke("List the seven wonders of the world.")

print(response)

Ви також можете викликати метод потоку для потокової передачі текстової відповіді.

for chunk in llm.stream("Where were the 2012 Olympics held?"): print(chunk, end="", flush=True)

Моделі чату

Інтеграція LangChain із моделями чату, спеціалізованим варіантом мовних моделей, є важливою для створення інтерактивних додатків для чату. Хоча вони використовують внутрішньо мовні моделі, моделі чату представляють окремий інтерфейс, зосереджений навколо повідомлень чату як вхідних і вихідних даних. Цей розділ містить детальний огляд використання моделі чату OpenAI у LangChain.

from langchain.chat_models import ChatOpenAI

chat = ChatOpenAI()

Моделі чату в LangChain працюють з різними типами повідомлень, наприклад AIMessage, HumanMessage, SystemMessage, FunctionMessage та ChatMessage (з довільним параметром ролі). загалом, HumanMessage, AIMessage та SystemMessage є найбільш часто використовуваними.

Моделі чату переважно приймають List[BaseMessage] як входи. Рядки можна конвертувати в HumanMessage та PromptValue також підтримується.

from langchain.schema.messages import HumanMessage, SystemMessage

messages = [ SystemMessage(content="You are Micheal Jordan."), HumanMessage(content="Which shoe manufacturer are you associated with?"),

]

response = chat.invoke(messages)

print(response.content)

Підказки

Підказки мають важливе значення для скерування мовних моделей для створення відповідних і узгоджених результатів. Вони можуть варіюватися від простих інструкцій до складних невеликих прикладів. У LangChain обробка підказок може бути дуже спрощеним процесом завдяки кільком спеціальним класам і функціям.

LangChain PromptTemplate class — це універсальний інструмент для створення рядкових підказок. Він використовує Python str.format синтаксис, що дозволяє генерувати динамічні підказки. Ви можете визначити шаблон із заповнювачами та заповнити їх певними значеннями за потреби.

from langchain.prompts import PromptTemplate # Simple prompt with placeholders

prompt_template = PromptTemplate.from_template( "Tell me a {adjective} joke about {content}."

) # Filling placeholders to create a prompt

filled_prompt = prompt_template.format(adjective="funny", content="robots")

print(filled_prompt)Для моделей чату підказки більш структуровані, містять повідомлення з певними ролями. Пропозиції LangChain ChatPromptTemplate Для цієї мети.

from langchain.prompts import ChatPromptTemplate # Defining a chat prompt with various roles

chat_template = ChatPromptTemplate.from_messages( [ ("system", "You are a helpful AI bot. Your name is {name}."), ("human", "Hello, how are you doing?"), ("ai", "I'm doing well, thanks!"), ("human", "{user_input}"), ]

) # Formatting the chat prompt

formatted_messages = chat_template.format_messages(name="Bob", user_input="What is your name?")

for message in formatted_messages: print(message)

Цей підхід дозволяє створювати інтерактивні, захоплюючі чат-боти з динамічними відповідями.

обидві PromptTemplate та ChatPromptTemplate бездоганно інтегруються з мовою виразів LangChain (LCEL), що дозволяє їм бути частиною більших складних робочих процесів. Ми обговоримо це пізніше.

Спеціальні шаблони підказок іноді необхідні для завдань, які вимагають унікального форматування або спеціальних інструкцій. Створення спеціального шаблону підказки передбачає визначення вхідних змінних і спеціального методу форматування. Ця гнучкість дозволяє LangChain задовольняти широкий спектр вимог до конкретних програм. Подробиці читайте тут.

LangChain також підтримує кілька підказок, дозволяючи моделі навчатися на прикладах. Ця функція життєво необхідна для завдань, які потребують розуміння контексту або певних шаблонів. Шаблони підказок із кількома випадками можна створювати з набору прикладів або за допомогою об’єкта вибору прикладу. Подробиці читайте тут.

Парсери виводу

Синтаксичні аналізатори виводу відіграють вирішальну роль у Langchain, дозволяючи користувачам структурувати відповіді, створені мовними моделями. У цьому розділі ми розглянемо концепцію аналізаторів виводу та надамо приклади коду з використанням PydanticOutputParser, SimpleJsonOutputParser, CommaSeparatedListOutputParser, DatetimeOutputParser і XMLOutputParser Langchain.

PydanticOutputParser

Langchain надає PydanticOutputParser для аналізу відповідей у структурах даних Pydantic. Нижче наведено покроковий приклад його використання.

from typing import List

from langchain.llms import OpenAI

from langchain.output_parsers import PydanticOutputParser

from langchain.prompts import PromptTemplate

from langchain.pydantic_v1 import BaseModel, Field, validator # Initialize the language model

model = OpenAI(model_name="text-davinci-003", temperature=0.0) # Define your desired data structure using Pydantic

class Joke(BaseModel): setup: str = Field(description="question to set up a joke") punchline: str = Field(description="answer to resolve the joke") @validator("setup") def question_ends_with_question_mark(cls, field): if field[-1] != "?": raise ValueError("Badly formed question!") return field # Set up a PydanticOutputParser

parser = PydanticOutputParser(pydantic_object=Joke) # Create a prompt with format instructions

prompt = PromptTemplate( template="Answer the user query.n{format_instructions}n{query}n", input_variables=["query"], partial_variables={"format_instructions": parser.get_format_instructions()},

) # Define a query to prompt the language model

query = "Tell me a joke." # Combine prompt, model, and parser to get structured output

prompt_and_model = prompt | model

output = prompt_and_model.invoke({"query": query}) # Parse the output using the parser

parsed_result = parser.invoke(output) # The result is a structured object

print(parsed_result)

Вихідний сигнал буде:

SimpleJsonOutputParser

SimpleJsonOutputParser від Langchain використовується, коли ви хочете проаналізувати JSON-подібні виходи. Ось приклад:

from langchain.output_parsers.json import SimpleJsonOutputParser # Create a JSON prompt

json_prompt = PromptTemplate.from_template( "Return a JSON object with `birthdate` and `birthplace` key that answers the following question: {question}"

) # Initialize the JSON parser

json_parser = SimpleJsonOutputParser() # Create a chain with the prompt, model, and parser

json_chain = json_prompt | model | json_parser # Stream through the results

result_list = list(json_chain.stream({"question": "When and where was Elon Musk born?"})) # The result is a list of JSON-like dictionaries

print(result_list)

CommaSeparatedListOutputParser

CommaSeparatedListOutputParser зручний, якщо ви хочете отримати списки, розділені комами, із відповідей моделі. Ось приклад:

from langchain.output_parsers import CommaSeparatedListOutputParser

from langchain.prompts import PromptTemplate

from langchain.llms import OpenAI # Initialize the parser

output_parser = CommaSeparatedListOutputParser() # Create format instructions

format_instructions = output_parser.get_format_instructions() # Create a prompt to request a list

prompt = PromptTemplate( template="List five {subject}.n{format_instructions}", input_variables=["subject"], partial_variables={"format_instructions": format_instructions}

) # Define a query to prompt the model

query = "English Premier League Teams" # Generate the output

output = model(prompt.format(subject=query)) # Parse the output using the parser

parsed_result = output_parser.parse(output) # The result is a list of items

print(parsed_result)

DatetimeOutputParser

Langchain DatetimeOutputParser призначений для аналізу інформації про дату та час. Ось як ним користуватися:

from langchain.prompts import PromptTemplate

from langchain.output_parsers import DatetimeOutputParser

from langchain.chains import LLMChain

from langchain.llms import OpenAI # Initialize the DatetimeOutputParser

output_parser = DatetimeOutputParser() # Create a prompt with format instructions

template = """

Answer the user's question:

{question}

{format_instructions} """ prompt = PromptTemplate.from_template( template, partial_variables={"format_instructions": output_parser.get_format_instructions()},

) # Create a chain with the prompt and language model

chain = LLMChain(prompt=prompt, llm=OpenAI()) # Define a query to prompt the model

query = "when did Neil Armstrong land on the moon in terms of GMT?" # Run the chain

output = chain.run(query) # Parse the output using the datetime parser

parsed_result = output_parser.parse(output) # The result is a datetime object

print(parsed_result)

Ці приклади демонструють, як парсери вихідних даних Langchain можна використовувати для структурування різних типів відповідей моделі, що робить їх придатними для різних програм і форматів. Синтаксичні аналізатори вихідних даних є цінним інструментом для підвищення зручності використання та інтерпретації виходів мовної моделі в Langchain.

Автоматизуйте ручні завдання та робочі процеси за допомогою нашого конструктора робочих процесів на основі ШІ, розробленого Nanonets для вас і ваших команд.

Модуль II: Пошук

Отримання в LangChain відіграє вирішальну роль у програмах, які вимагають специфічних для користувача даних, які не входять до навчального набору моделі. Цей процес, відомий як Retrieval Augmented Generation (RAG), передбачає отримання зовнішніх даних та їх інтеграцію в процес генерації мовної моделі. LangChain надає повний набір інструментів і функціональних можливостей для полегшення цього процесу, обслуговуючи як прості, так і складні програми.

LangChain забезпечує пошук за допомогою серії компонентів, які ми обговоримо один за іншим.

Завантажувачі документів

Завантажувачі документів у LangChain дозволяють отримувати дані з різних джерел. Маючи понад 100 доступних завантажувачів, вони підтримують низку типів документів, програм і джерел (приватні сегменти s3, загальнодоступні веб-сайти, бази даних).

Ви можете вибрати завантажувач документів на основі ваших вимог тут.

Усі ці завантажувачі завантажують дані Документ класи. Пізніше ми дізнаємося, як використовувати дані, отримані в класах Document.

Завантажувач текстових файлів: Завантажити простий .txt файл у документ.

from langchain.document_loaders import TextLoader loader = TextLoader("./sample.txt")

document = loader.load()

Завантажувач CSV: Завантажте файл CSV у документ.

from langchain.document_loaders.csv_loader import CSVLoader loader = CSVLoader(file_path='./example_data/sample.csv')

documents = loader.load()

Ми можемо налаштувати розбір, вказавши назви полів –

loader = CSVLoader(file_path='./example_data/mlb_teams_2012.csv', csv_args={ 'delimiter': ',', 'quotechar': '"', 'fieldnames': ['MLB Team', 'Payroll in millions', 'Wins']

})

documents = loader.load()

Завантажувачі PDF: Завантажувачі PDF у LangChain пропонують різні методи аналізу та вилучення вмісту з файлів PDF. Кожен завантажувач задовольняє різні вимоги та використовує різні базові бібліотеки. Нижче наведено докладні приклади для кожного завантажувача.

PyPDFLoader використовується для базового аналізу PDF.

from langchain.document_loaders import PyPDFLoader loader = PyPDFLoader("example_data/layout-parser-paper.pdf")

pages = loader.load_and_split()

MathPixLoader ідеально підходить для отримання математичного вмісту та діаграм.

from langchain.document_loaders import MathpixPDFLoader loader = MathpixPDFLoader("example_data/math-content.pdf")

data = loader.load()

PyMuPDFLoader є швидким і включає детальне вилучення метаданих.

from langchain.document_loaders import PyMuPDFLoader loader = PyMuPDFLoader("example_data/layout-parser-paper.pdf")

data = loader.load() # Optionally pass additional arguments for PyMuPDF's get_text() call

data = loader.load(option="text")

PDFMiner Loader використовується для більш детального контролю над вилученням тексту.

from langchain.document_loaders import PDFMinerLoader loader = PDFMinerLoader("example_data/layout-parser-paper.pdf")

data = loader.load()

AmazonTextractPDFParser використовує AWS Texttract для OCR та інші розширені функції аналізу PDF.

from langchain.document_loaders import AmazonTextractPDFLoader # Requires AWS account and configuration

loader = AmazonTextractPDFLoader("example_data/complex-layout.pdf")

documents = loader.load()

PDFMinerPDFasHTMLLoader генерує HTML із PDF для семантичного аналізу.

from langchain.document_loaders import PDFMinerPDFasHTMLLoader loader = PDFMinerPDFasHTMLLoader("example_data/layout-parser-paper.pdf")

data = loader.load()

PDFPlumberLoader надає детальні метадані та підтримує один документ на сторінку.

from langchain.document_loaders import PDFPlumberLoader loader = PDFPlumberLoader("example_data/layout-parser-paper.pdf")

data = loader.load()

Інтегровані завантажувачі: LangChain пропонує широкий вибір користувальницьких завантажувачів для безпосереднього завантаження даних із ваших додатків (таких як Slack, Sigma, Notion, Confluence, Google Drive та багатьох інших) і баз даних і використання їх у програмах LLM.

Повний список такий тут.

Нижче наведено пару прикладів, щоб проілюструвати це –

Приклад I – Slack

Slack, широко поширену платформу обміну миттєвими повідомленнями, можна інтегрувати в робочі процеси та програми LLM.

- Перейдіть на сторінку керування робочим простором Slack.

- перейдіть до

{your_slack_domain}.slack.com/services/export. - Виберіть потрібний діапазон дат і запустіть експорт.

- Slack сповіщає електронною поштою та DM, коли експорт готовий.

- Результатом експорту є a

.zipфайл, який знаходиться у вашій папці завантажень або в указаному вами шляху завантаження. - Призначте шлях до завантаженого

.zipфайл вLOCAL_ZIPFILE. - Використовувати

SlackDirectoryLoaderвідlangchain.document_loadersпакет.

from langchain.document_loaders import SlackDirectoryLoader SLACK_WORKSPACE_URL = "https://xxx.slack.com" # Replace with your Slack URL

LOCAL_ZIPFILE = "" # Path to the Slack zip file loader = SlackDirectoryLoader(LOCAL_ZIPFILE, SLACK_WORKSPACE_URL)

docs = loader.load()

print(docs)

Приклад II – Figma

Figma, популярний інструмент для розробки інтерфейсів, пропонує REST API для інтеграції даних.

- Отримайте ключ файлу Figma з формату URL:

https://www.figma.com/file/{filekey}/sampleFilename. - Ідентифікатори вузлів можна знайти в параметрі URL

?node-id={node_id}. - Згенеруйте маркер доступу, дотримуючись інструкцій на сторінці Довідковий центр Figma.

- Команда

FigmaFileLoaderклас відlangchain.document_loaders.figmaвикористовується для завантаження даних Figma. - Різні модулі LangChain, наприклад

CharacterTextSplitter,ChatOpenAI, тощо, використовуються для обробки.

import os

from langchain.document_loaders.figma import FigmaFileLoader

from langchain.text_splitter import CharacterTextSplitter

from langchain.chat_models import ChatOpenAI

from langchain.indexes import VectorstoreIndexCreator

from langchain.chains import ConversationChain, LLMChain

from langchain.memory import ConversationBufferWindowMemory

from langchain.prompts.chat import ChatPromptTemplate, SystemMessagePromptTemplate, AIMessagePromptTemplate, HumanMessagePromptTemplate figma_loader = FigmaFileLoader( os.environ.get("ACCESS_TOKEN"), os.environ.get("NODE_IDS"), os.environ.get("FILE_KEY"),

) index = VectorstoreIndexCreator().from_loaders([figma_loader])

figma_doc_retriever = index.vectorstore.as_retriever()

- Команда

generate_codeфункція використовує дані Figma для створення коду HTML/CSS. - Він використовує шаблонну розмову з моделлю на основі GPT.

def generate_code(human_input): # Template for system and human prompts system_prompt_template = "Your coding instructions..." human_prompt_template = "Code the {text}. Ensure it's mobile responsive" # Creating prompt templates system_message_prompt = SystemMessagePromptTemplate.from_template(system_prompt_template) human_message_prompt = HumanMessagePromptTemplate.from_template(human_prompt_template) # Setting up the AI model gpt_4 = ChatOpenAI(temperature=0.02, model_name="gpt-4") # Retrieving relevant documents relevant_nodes = figma_doc_retriever.get_relevant_documents(human_input) # Generating and formatting the prompt conversation = [system_message_prompt, human_message_prompt] chat_prompt = ChatPromptTemplate.from_messages(conversation) response = gpt_4(chat_prompt.format_prompt(context=relevant_nodes, text=human_input).to_messages()) return response # Example usage

response = generate_code("page top header")

print(response.content)

- Команда

generate_codeФункція під час виконання повертає код HTML/CSS на основі вхідних даних дизайну Figma.

Давайте тепер використаємо наші знання для створення кількох наборів документів.

Спочатку ми завантажуємо PDF, щорічний звіт про сталий розвиток BCG.

Для цього ми використовуємо PyPDFLoader.

from langchain.document_loaders import PyPDFLoader loader = PyPDFLoader("bcg-2022-annual-sustainability-report-apr-2023.pdf")

pdfpages = loader.load_and_split()

Зараз ми завантажимо дані з Airtable. У нас є Airtable, що містить інформацію про різні моделі оптичного розпізнавання та вилучення даних –

Скористаємося для цього AirtableLoader, який можна знайти у списку інтегрованих завантажувачів.

from langchain.document_loaders import AirtableLoader api_key = "XXXXX"

base_id = "XXXXX"

table_id = "XXXXX" loader = AirtableLoader(api_key, table_id, base_id)

airtabledocs = loader.load()

Давайте тепер продовжимо і навчимося використовувати ці класи документів.

Трансформери документів

Перетворювачі документів у LangChain є основними інструментами, призначеними для роботи з документами, які ми створили в попередньому підрозділі.

Вони використовуються для таких завдань, як розбиття довгих документів на менші частини, об’єднання та фільтрація, які мають вирішальне значення для адаптації документів до контекстного вікна моделі або задоволення конкретних потреб програми.

Одним із таких інструментів є RecursiveCharacterTextSplitter, універсальний роздільник тексту, який використовує список символів для розділення. Він дозволяє такі параметри, як розмір блоку, перекриття та початковий індекс. Ось приклад того, як це використовується в Python:

from langchain.text_splitter import RecursiveCharacterTextSplitter state_of_the_union = "Your long text here..." text_splitter = RecursiveCharacterTextSplitter( chunk_size=100, chunk_overlap=20, length_function=len, add_start_index=True,

) texts = text_splitter.create_documents([state_of_the_union])

print(texts[0])

print(texts[1])

Іншим інструментом є CharacterTextSplitter, який розділяє текст на основі заданого символу та містить елементи керування розміром фрагмента та накладенням:

from langchain.text_splitter import CharacterTextSplitter text_splitter = CharacterTextSplitter( separator="nn", chunk_size=1000, chunk_overlap=200, length_function=len, is_separator_regex=False,

) texts = text_splitter.create_documents([state_of_the_union])

print(texts[0])

HTMLHeaderTextSplitter призначений для розділення вмісту HTML на основі тегів заголовків, зберігаючи семантичну структуру:

from langchain.text_splitter import HTMLHeaderTextSplitter html_string = "Your HTML content here..."

headers_to_split_on = [("h1", "Header 1"), ("h2", "Header 2")] html_splitter = HTMLHeaderTextSplitter(headers_to_split_on=headers_to_split_on)

html_header_splits = html_splitter.split_text(html_string)

print(html_header_splits[0])

Більш складну маніпуляцію можна досягти, об’єднавши HTMLHeaderTextSplitter з іншим роздільником, наприклад Pipelined Splitter:

from langchain.text_splitter import HTMLHeaderTextSplitter, RecursiveCharacterTextSplitter url = "https://example.com"

headers_to_split_on = [("h1", "Header 1"), ("h2", "Header 2")]

html_splitter = HTMLHeaderTextSplitter(headers_to_split_on=headers_to_split_on)

html_header_splits = html_splitter.split_text_from_url(url) chunk_size = 500

text_splitter = RecursiveCharacterTextSplitter(chunk_size=chunk_size)

splits = text_splitter.split_documents(html_header_splits)

print(splits[0])

LangChain також пропонує спеціальні роздільники для різних мов програмування, як-от Python Code Splitter і JavaScript Code Splitter:

from langchain.text_splitter import RecursiveCharacterTextSplitter, Language python_code = """

def hello_world(): print("Hello, World!")

hello_world() """ python_splitter = RecursiveCharacterTextSplitter.from_language( language=Language.PYTHON, chunk_size=50

)

python_docs = python_splitter.create_documents([python_code])

print(python_docs[0]) js_code = """

function helloWorld() { console.log("Hello, World!");

}

helloWorld(); """ js_splitter = RecursiveCharacterTextSplitter.from_language( language=Language.JS, chunk_size=60

)

js_docs = js_splitter.create_documents([js_code])

print(js_docs[0])

Для розділення тексту на основі кількості токенів, що корисно для мовних моделей з обмеженнями токенів, використовується TokenTextSplitter:

from langchain.text_splitter import TokenTextSplitter text_splitter = TokenTextSplitter(chunk_size=10)

texts = text_splitter.split_text(state_of_the_union)

print(texts[0])

Нарешті, LongContextReorder змінює порядок документів, щоб запобігти зниженню продуктивності в моделях через довгі контексти:

from langchain.document_transformers import LongContextReorder reordering = LongContextReorder()

reordered_docs = reordering.transform_documents(docs)

print(reordered_docs[0])

Ці інструменти демонструють різні способи трансформації документів у LangChain, від простого поділу тексту до складного перевпорядкування та поділу для певної мови. Щоб отримати докладніші та конкретні випадки використання, ознайомтеся з розділом документації та інтеграції LangChain.

У наших прикладах завантажувачі вже створили для нас фрагментовані документи, і ця частина вже оброблена.

Моделі вбудовування тексту

Моделі вбудовування тексту в LangChain забезпечують стандартизований інтерфейс для різних постачальників моделей вбудовування, таких як OpenAI, Cohere та Hugging Face. Ці моделі перетворюють текст у векторне представлення, уможливлюючи такі операції, як семантичний пошук через подібність тексту у векторному просторі.

Щоб розпочати роботу з моделями вбудовування тексту, зазвичай потрібно інсталювати певні пакети та налаштувати ключі API. Ми вже зробили це для OpenAI

У LangChain, embed_documents метод використовується для вбудовування кількох текстів, надаючи список векторних зображень. Наприклад:

from langchain.embeddings import OpenAIEmbeddings # Initialize the model

embeddings_model = OpenAIEmbeddings() # Embed a list of texts

embeddings = embeddings_model.embed_documents( ["Hi there!", "Oh, hello!", "What's your name?", "My friends call me World", "Hello World!"]

)

print("Number of documents embedded:", len(embeddings))

print("Dimension of each embedding:", len(embeddings[0]))

Для вбудовування окремого тексту, наприклад пошукового запиту, embed_query використовується метод. Це корисно для порівняння запиту з набором вбудованих документів. Наприклад:

from langchain.embeddings import OpenAIEmbeddings # Initialize the model

embeddings_model = OpenAIEmbeddings() # Embed a single query

embedded_query = embeddings_model.embed_query("What was the name mentioned in the conversation?")

print("First five dimensions of the embedded query:", embedded_query[:5])

Розуміння цих вкладень має вирішальне значення. Кожен фрагмент тексту перетворюється на вектор, розмірність якого залежить від використовуваної моделі. Наприклад, моделі OpenAI зазвичай створюють 1536-вимірні вектори. Потім ці вбудовування використовуються для отримання відповідної інформації.

Функціональність вбудовування LangChain не обмежується OpenAI, але розроблена для роботи з різними постачальниками. Налаштування та використання можуть дещо відрізнятися залежно від постачальника, але основна концепція вбудовування текстів у векторний простір залишається незмінною. Для детального використання, включаючи розширені конфігурації та інтеграцію з різними постачальниками моделі вбудовування, документація LangChain у розділі «Інтеграції» є цінним ресурсом.

Векторні магазини

Векторні магазини в LangChain підтримують ефективне зберігання та пошук вбудованих текстів. LangChain інтегрується з понад 50 векторними магазинами, забезпечуючи стандартизований інтерфейс для зручності використання.

Приклад: Зберігання та пошук вбудованих елементів

Після вбудовування текстів ми можемо зберігати їх у векторному сховищі, наприклад Chroma і виконати пошук подібності:

from langchain.vectorstores import Chroma db = Chroma.from_texts(embedded_texts)

similar_texts = db.similarity_search("search query")

Скористаємось векторним сховищем FAISS для створення індексів для наших документів.

from langchain.embeddings import OpenAIEmbeddings

from langchain.vectorstores import FAISS pdfstore = FAISS.from_documents(pdfpages, embedding=OpenAIEmbeddings()) airtablestore = FAISS.from_documents(airtabledocs, embedding=OpenAIEmbeddings())

ретривери

Ретривери в LangChain — це інтерфейси, які повертають документи у відповідь на неструктурований запит. Вони більш загальні, ніж векторні сховища, зосереджені на пошуку, а не на зберіганні. Хоча векторні магазини можна використовувати як основу ретривера, існують також інші типи ретриверів.

Щоб налаштувати Chroma Retriever, спочатку встановіть його за допомогою pip install chromadb. Потім ви завантажуєте, розділяєте, вставляєте та отримуєте документи за допомогою ряду команд Python. Ось приклад коду для налаштування Chroma Retriever:

from langchain.embeddings import OpenAIEmbeddings

from langchain.text_splitter import CharacterTextSplitter

from langchain.vectorstores import Chroma full_text = open("state_of_the_union.txt", "r").read()

text_splitter = CharacterTextSplitter(chunk_size=1000, chunk_overlap=100)

texts = text_splitter.split_text(full_text) embeddings = OpenAIEmbeddings()

db = Chroma.from_texts(texts, embeddings)

retriever = db.as_retriever() retrieved_docs = retriever.invoke("What did the president say about Ketanji Brown Jackson?")

print(retrieved_docs[0].page_content)

MultiQueryRetriever автоматизує швидку настройку, генеруючи кілька запитів для запиту, введеного користувачем, і об’єднує результати. Ось приклад його простого використання:

from langchain.chat_models import ChatOpenAI

from langchain.retrievers.multi_query import MultiQueryRetriever question = "What are the approaches to Task Decomposition?"

llm = ChatOpenAI(temperature=0)

retriever_from_llm = MultiQueryRetriever.from_llm( retriever=db.as_retriever(), llm=llm

) unique_docs = retriever_from_llm.get_relevant_documents(query=question)

print("Number of unique documents:", len(unique_docs))

Контекстне стиснення в LangChain стискає отримані документи з використанням контексту запиту, забезпечуючи повернення лише релевантної інформації. Це передбачає зменшення вмісту та фільтрування менш релевантних документів. У наступному прикладі коду показано, як використовувати Contextual Compression Retriever:

from langchain.llms import OpenAI

from langchain.retrievers import ContextualCompressionRetriever

from langchain.retrievers.document_compressors import LLMChainExtractor llm = OpenAI(temperature=0)

compressor = LLMChainExtractor.from_llm(llm)

compression_retriever = ContextualCompressionRetriever(base_compressor=compressor, base_retriever=retriever) compressed_docs = compression_retriever.get_relevant_documents("What did the president say about Ketanji Jackson Brown")

print(compressed_docs[0].page_content)

EnsembleRetriever поєднує різні алгоритми пошуку для досягнення кращої продуктивності. Приклад поєднання BM25 і FAISS Retrievers показано в наступному коді:

from langchain.retrievers import BM25Retriever, EnsembleRetriever

from langchain.vectorstores import FAISS bm25_retriever = BM25Retriever.from_texts(doc_list).set_k(2)

faiss_vectorstore = FAISS.from_texts(doc_list, OpenAIEmbeddings())

faiss_retriever = faiss_vectorstore.as_retriever(search_kwargs={"k": 2}) ensemble_retriever = EnsembleRetriever( retrievers=[bm25_retriever, faiss_retriever], weights=[0.5, 0.5]

) docs = ensemble_retriever.get_relevant_documents("apples")

print(docs[0].page_content)

MultiVector Retriever у LangChain дозволяє запитувати документи з кількома векторами на документ, що корисно для захоплення різних семантичних аспектів у документі. Методи створення кількох векторів включають поділ на менші фрагменти, узагальнення або генерування гіпотетичних запитань. Для поділу документів на менші частини можна використовувати наступний код Python:

python

from langchain.retrievers.multi_vector import MultiVectorRetriever

from langchain.vectorstores import Chroma

from langchain.embeddings import OpenAIEmbeddings

from langchain.text_splitter import RecursiveCharacterTextSplitter

from langchain.storage import InMemoryStore

from langchain.document_loaders from TextLoader

import uuid loaders = [TextLoader("file1.txt"), TextLoader("file2.txt")]

docs = [doc for loader in loaders for doc in loader.load()]

text_splitter = RecursiveCharacterTextSplitter(chunk_size=10000)

docs = text_splitter.split_documents(docs) vectorstore = Chroma(collection_name="full_documents", embedding_function=OpenAIEmbeddings())

store = InMemoryStore()

id_key = "doc_id"

retriever = MultiVectorRetriever(vectorstore=vectorstore, docstore=store, id_key=id_key) doc_ids = [str(uuid.uuid4()) for _ in docs]

child_text_splitter = RecursiveCharacterTextSplitter(chunk_size=400)

sub_docs = [sub_doc for doc in docs for sub_doc in child_text_splitter.split_documents([doc])]

for sub_doc in sub_docs: sub_doc.metadata[id_key] = doc_ids[sub_docs.index(sub_doc)] retriever.vectorstore.add_documents(sub_docs)

retriever.docstore.mset(list(zip(doc_ids, docs)))

Іншим методом є створення підсумків для кращого пошуку завдяки більш сфокусованому представленню вмісту. Ось приклад створення підсумків:

from langchain.chat_models import ChatOpenAI

from langchain.prompts import ChatPromptTemplate

from langchain.schema.output_parser import StrOutputParser

from langchain.schema.document import Document chain = (lambda x: x.page_content) | ChatPromptTemplate.from_template("Summarize the following document:nn{doc}") | ChatOpenAI(max_retries=0) | StrOutputParser()

summaries = chain.batch(docs, {"max_concurrency": 5}) summary_docs = [Document(page_content=s, metadata={id_key: doc_ids[i]}) for i, s in enumerate(summaries)]

retriever.vectorstore.add_documents(summary_docs)

retriever.docstore.mset(list(zip(doc_ids, docs)))

Іншим підходом є створення гіпотетичних запитань, що стосуються кожного документа за допомогою LLM. Це можна зробити за допомогою такого коду:

functions = [{"name": "hypothetical_questions", "parameters": {"questions": {"type": "array", "items": {"type": "string"}}}}]

from langchain.output_parsers.openai_functions import JsonKeyOutputFunctionsParser chain = (lambda x: x.page_content) | ChatPromptTemplate.from_template("Generate 3 hypothetical questions:nn{doc}") | ChatOpenAI(max_retries=0).bind(functions=functions, function_call={"name": "hypothetical_questions"}) | JsonKeyOutputFunctionsParser(key_name="questions")

hypothetical_questions = chain.batch(docs, {"max_concurrency": 5}) question_docs = [Document(page_content=q, metadata={id_key: doc_ids[i]}) for i, questions in enumerate(hypothetical_questions) for q in questions]

retriever.vectorstore.add_documents(question_docs)

retriever.docstore.mset(list(zip(doc_ids, docs)))

Parent Document Retriever — це ще один засіб відновлення, який досягає балансу між точністю вбудовування та збереженням контексту, зберігаючи невеликі фрагменти та витягаючи їх більші батьківські документи. Його реалізація полягає в наступному:

from langchain.retrievers import ParentDocumentRetriever loaders = [TextLoader("file1.txt"), TextLoader("file2.txt")]

docs = [doc for loader in loaders for doc in loader.load()] child_splitter = RecursiveCharacterTextSplitter(chunk_size=400)

vectorstore = Chroma(collection_name="full_documents", embedding_function=OpenAIEmbeddings())

store = InMemoryStore()

retriever = ParentDocumentRetriever(vectorstore=vectorstore, docstore=store, child_splitter=child_splitter) retriever.add_documents(docs, ids=None) retrieved_docs = retriever.get_relevant_documents("query")

Самозапитувальний ретривер створює структуровані запити з вхідних даних природною мовою та застосовує їх до основного VectorStore. Його реалізацію показано в наступному коді:

from langchain.chat_models from ChatOpenAI

from langchain.chains.query_constructor.base from AttributeInfo

from langchain.retrievers.self_query.base from SelfQueryRetriever metadata_field_info = [AttributeInfo(name="genre", description="...", type="string"), ...]

document_content_description = "Brief summary of a movie"

llm = ChatOpenAI(temperature=0) retriever = SelfQueryRetriever.from_llm(llm, vectorstore, document_content_description, metadata_field_info) retrieved_docs = retriever.invoke("query")

WebResearchRetriever виконує веб-дослідження на основі заданого запиту –

from langchain.retrievers.web_research import WebResearchRetriever # Initialize components

llm = ChatOpenAI(temperature=0)

search = GoogleSearchAPIWrapper()

vectorstore = Chroma(embedding_function=OpenAIEmbeddings()) # Instantiate WebResearchRetriever

web_research_retriever = WebResearchRetriever.from_llm(vectorstore=vectorstore, llm=llm, search=search) # Retrieve documents

docs = web_research_retriever.get_relevant_documents("query")

Для наших прикладів ми також можемо використати стандартний ретривер, уже реалізований як частина нашого об’єкта векторної сховища, як показано нижче –

Тепер ми можемо запитати ретриверів. Результатом нашого запиту будуть об’єкти документа, що відповідають запиту. Зрештою вони будуть використані для створення відповідних відповідей у наступних розділах.

Автоматизуйте ручні завдання та робочі процеси за допомогою нашого конструктора робочих процесів на основі ШІ, розробленого Nanonets для вас і ваших команд.

Модуль III: Агенти

LangChain представляє потужну концепцію під назвою «Агенти», яка виводить ідею ланцюгів на абсолютно новий рівень. Агенти використовують мовні моделі для динамічного визначення послідовності дій для виконання, що робить їх неймовірно універсальними та адаптивними. На відміну від традиційних ланцюжків, де дії жорстко закодовані в коді, агенти використовують мовні моделі як механізми міркування, щоб вирішити, які дії виконувати та в якому порядку.

Агент є основним компонентом, відповідальним за прийняття рішень. Він використовує силу мовної моделі та підказку для визначення наступних кроків для досягнення конкретної мети. Вхідні дані для агента зазвичай включають:

- Інструменти: Опис доступних інструментів (про це пізніше).

- Введення користувача: Мета високого рівня або запит від користувача.

- Проміжні кроки: Історія пар (дій, вихід інструменту), виконаних для досягнення поточного введення користувача.

Вихід агента може бути наступним дію вжити заходів (AgentActions) або фінал відповідь надіслати користувачеві (AgentFinish). Ан дію вказує a інструмент і вхід для цього інструменту.

Tools

Інструменти — це інтерфейси, які агент може використовувати для взаємодії зі світом. Вони дозволяють агентам виконувати різні завдання, такі як пошук в Інтернеті, виконання команд оболонки або доступ до зовнішніх API. У LangChain інструменти необхідні для розширення можливостей агентів і надання їм можливості виконувати різноманітні завдання.

Щоб використовувати інструменти в LangChain, ви можете завантажити їх за допомогою такого фрагмента:

from langchain.agents import load_tools tool_names = [...]

tools = load_tools(tool_names)

Для ініціалізації деяких інструментів може знадобитися базова мовна модель (LLM). У таких випадках ви також можете пройти LLM:

from langchain.agents import load_tools tool_names = [...]

llm = ...

tools = load_tools(tool_names, llm=llm)

Це налаштування дозволяє отримати доступ до різноманітних інструментів та інтегрувати їх у робочі процеси вашого агента. Повний список інструментів із документацією щодо використання є тут.

Давайте розглянемо кілька прикладів інструментів.

DuckDuckGo

Інструмент DuckDuckGo дає змогу здійснювати веб-пошук за допомогою його пошукової системи. Ось як ним користуватися:

from langchain.tools import DuckDuckGoSearchRun

search = DuckDuckGoSearchRun()

search.run("manchester united vs luton town match summary")

DataForSeo

Набір інструментів DataForSeo дозволяє отримувати результати пошукової системи за допомогою DataForSeo API. Щоб використовувати цей інструментарій, вам потрібно налаштувати свої облікові дані API. Ось як налаштувати облікові дані:

import os os.environ["DATAFORSEO_LOGIN"] = "<your_api_access_username>"

os.environ["DATAFORSEO_PASSWORD"] = "<your_api_access_password>"

Після встановлення облікових даних ви можете створити a DataForSeoAPIWrapper інструмент для доступу до API:

from langchain.utilities.dataforseo_api_search import DataForSeoAPIWrapper wrapper = DataForSeoAPIWrapper() result = wrapper.run("Weather in Los Angeles")

Команда DataForSeoAPIWrapper інструмент отримує результати пошукової системи з різних джерел.

Ви можете налаштувати тип результатів і полів, що повертаються у відповіді JSON. Наприклад, ви можете вказати типи результатів, поля та встановити максимальну кількість для повернення найпопулярніших результатів:

json_wrapper = DataForSeoAPIWrapper( json_result_types=["organic", "knowledge_graph", "answer_box"], json_result_fields=["type", "title", "description", "text"], top_count=3,

) json_result = json_wrapper.results("Bill Gates")

У цьому прикладі налаштовується відповідь JSON, вказуючи типи результатів, поля та обмежуючи кількість результатів.

Ви також можете вказати розташування та мову для результатів пошуку, передавши додаткові параметри в оболонку API:

customized_wrapper = DataForSeoAPIWrapper( top_count=10, json_result_types=["organic", "local_pack"], json_result_fields=["title", "description", "type"], params={"location_name": "Germany", "language_code": "en"},

) customized_result = customized_wrapper.results("coffee near me")

Надавши параметри розташування та мови, ви можете адаптувати результати пошуку до певних регіонів і мов.

У вас є можливість вибрати пошукову систему, яку ви хочете використовувати. Просто вкажіть потрібну пошукову систему:

customized_wrapper = DataForSeoAPIWrapper( top_count=10, json_result_types=["organic", "local_pack"], json_result_fields=["title", "description", "type"], params={"location_name": "Germany", "language_code": "en", "se_name": "bing"},

) customized_result = customized_wrapper.results("coffee near me")

У цьому прикладі пошук налаштовано для використання Bing як пошукової системи.

Обгортка API також дозволяє вказати тип пошуку, який ви хочете виконати. Наприклад, ви можете виконати пошук на картах:

maps_search = DataForSeoAPIWrapper( top_count=10, json_result_fields=["title", "value", "address", "rating", "type"], params={ "location_coordinate": "52.512,13.36,12z", "language_code": "en", "se_type": "maps", },

) maps_search_result = maps_search.results("coffee near me")

Це налаштовує пошук для отримання інформації, пов’язаної з картами.

Shell (баш)

Набір інструментів Shell надає агентам доступ до середовища оболонки, дозволяючи їм виконувати команди оболонки. Ця функція потужна, але її слід використовувати з обережністю, особливо в пісочниці. Ось як ви можете використовувати інструмент Shell:

from langchain.tools import ShellTool shell_tool = ShellTool() result = shell_tool.run({"commands": ["echo 'Hello World!'", "time"]})

У цьому прикладі інструмент Shell виконує дві команди оболонки: повторюючи «Hello World!» і відображення поточного часу.

Ви можете надати агенту інструмент Shell для виконання більш складних завдань. Ось приклад агента, який отримує посилання з веб-сторінки за допомогою інструмента Shell:

from langchain.agents import AgentType, initialize_agent

from langchain.chat_models import ChatOpenAI llm = ChatOpenAI(temperature=0.1) shell_tool.description = shell_tool.description + f"args {shell_tool.args}".replace( "{", "{{"

).replace("}", "}}")

self_ask_with_search = initialize_agent( [shell_tool], llm, agent=AgentType.CHAT_ZERO_SHOT_REACT_DESCRIPTION, verbose=True

)

self_ask_with_search.run( "Download the langchain.com webpage and grep for all urls. Return only a sorted list of them. Be sure to use double quotes."

)

У цьому сценарії агент використовує інструмент Shell для виконання послідовності команд для отримання, фільтрування та сортування URL-адрес із веб-сторінки.

Наведені приклади демонструють деякі інструменти, доступні в LangChain. Ці інструменти зрештою розширюють можливості агентів (досліджено в наступному підрозділі) і дають їм змогу ефективно виконувати різні завдання. Залежно від ваших вимог ви можете вибрати інструменти та набори інструментів, які найкраще відповідають потребам вашого проекту, і інтегрувати їх у робочі процеси вашого агента.

Повернутися до Агентів

Тепер перейдемо до агентів.

AgentExecutor — це середовище виконання для агента. Він відповідає за виклик агента, виконання вибраних ним дій, передачу результатів дії назад агенту та повторення процесу, доки агент не завершить роботу. У псевдокоді AgentExecutor може виглядати приблизно так:

next_action = agent.get_action(...)

while next_action != AgentFinish: observation = run(next_action) next_action = agent.get_action(..., next_action, observation)

return next_action

AgentExecutor справляється з різними складнощами, такими як робота з випадками, коли агент вибирає неіснуючий інструмент, обробка помилок інструменту, керування створеними агентом виходами та забезпечення журналювання та спостереження на всіх рівнях.

Хоча клас AgentExecutor є основним середовищем виконання агента в LangChain, підтримуються інші, більш експериментальні середовища виконання, зокрема:

- Плануй і виконуй агент

- Baby AGI

- Авто GPT

Щоб краще зрозуміти структуру агента, давайте створимо базовий агент з нуля, а потім перейдемо до вивчення готових агентів.

Перш ніж ми заглибимося в створення агента, важливо переглянути деякі ключові термінології та схеми:

- AgentAction: Це клас даних, що представляє дію, яку повинен виконати агент. Він складається з a

toolвластивість (назва інструменту для виклику) і atool_inputвластивість (вхід для цього інструменту). - AgentFinish: Цей клас даних вказує на те, що агент виконав своє завдання і повинен повернути відповідь користувачеві. Зазвичай він включає словник значень, що повертаються, часто з ключовим «виводом», що містить текст відповіді.

- Проміжні кроки: Це записи попередніх дій агента та відповідних виходів. Вони мають вирішальне значення для передачі контексту майбутнім ітераціям агента.

У нашому прикладі ми використаємо виклик функцій OpenAI для створення нашого агента. Цей підхід надійний для створення агента. Ми почнемо зі створення простого інструменту, який обчислює довжину слова. Цей інструмент корисний, оскільки мовні моделі іноді можуть допускати помилки через токенізацію під час підрахунку довжини слів.

По-перше, давайте завантажимо мовну модель, яку будемо використовувати для керування агентом:

from langchain.chat_models import ChatOpenAI llm = ChatOpenAI(model="gpt-3.5-turbo", temperature=0)

Перевіримо модель за допомогою обчислення довжини слова:

llm.invoke("how many letters in the word educa?")

У відповіді має бути вказано кількість літер у слові «educa».

Далі ми визначимо просту функцію Python для обчислення довжини слова:

from langchain.agents import tool @tool

def get_word_length(word: str) -> int: """Returns the length of a word.""" return len(word)

Ми створили інструмент під назвою get_word_length який приймає слово як вхідні дані та повертає його довжину.

Тепер давайте створимо підказку для агента. Підказка вказує агенту, як міркувати та форматувати вихідні дані. У нашому випадку ми використовуємо OpenAI Function Calling, який вимагає мінімум інструкцій. Ми визначимо запит із заповнювачами для введення користувача та блокнота агента:

from langchain.prompts import ChatPromptTemplate, MessagesPlaceholder prompt = ChatPromptTemplate.from_messages( [ ( "system", "You are a very powerful assistant but not great at calculating word lengths.", ), ("user", "{input}"), MessagesPlaceholder(variable_name="agent_scratchpad"), ]

)

Тепер, як агент дізнається, які інструменти він може використовувати? Ми покладаємося на мовні моделі виклику функцій OpenAI, які потребують окремої передачі функцій. Щоб надати наші інструменти агенту, ми відформатуємо їх як виклики функцій OpenAI:

from langchain.tools.render import format_tool_to_openai_function llm_with_tools = llm.bind(functions=[format_tool_to_openai_function(t) for t in tools])

Тепер ми можемо створити агента, визначивши відображення вхідних даних і підключивши компоненти:

Це мова LCEL. Ми обговоримо це пізніше детально.

from langchain.agents.format_scratchpad import format_to_openai_function_messages

from langchain.agents.output_parsers import OpenAIFunctionsAgentOutputParser agent = ( { "input": lambda x: x["input"], "agent_scratchpad": lambda x: format_to_openai _function_messages( x["intermediate_steps"] ), } | prompt | llm_with_tools | OpenAIFunctionsAgentOutputParser()

)

Ми створили нашого агента, який розуміє дані користувача, використовує доступні інструменти та форматує вихідні дані. Тепер давайте взаємодіяти з ним:

agent.invoke({"input": "how many letters in the word educa?", "intermediate_steps": []})

Агент має відповісти AgentAction, що вказує на наступну дію.

Ми створили агента, але тепер нам потрібно написати для нього середовище виконання. Найпростішим середовищем виконання є те, що безперервно викликає агента, виконує дії та повторює, доки агент не завершить роботу. Ось приклад:

from langchain.schema.agent import AgentFinish user_input = "how many letters in the word educa?"

intermediate_steps = [] while True: output = agent.invoke( { "input": user_input, "intermediate_steps": intermediate_steps, } ) if isinstance(output, AgentFinish): final_result = output.return_values["output"] break else: print(f"TOOL NAME: {output.tool}") print(f"TOOL INPUT: {output.tool_input}") tool = {"get_word_length": get_word_length}[output.tool] observation = tool.run(output.tool_input) intermediate_steps.append((output, observation)) print(final_result)

У цьому циклі ми неодноразово викликаємо агента, виконуємо дії та оновлюємо проміжні кроки, доки агент не завершить роботу. Ми також керуємо взаємодією інструментів у циклі.

Щоб спростити цей процес, LangChain надає клас AgentExecutor, який інкапсулює виконання агента та пропонує обробку помилок, ранню зупинку, трасування та інші вдосконалення. Давайте використаємо AgentExecutor для взаємодії з агентом:

from langchain.agents import AgentExecutor agent_executor = AgentExecutor(agent=agent, tools=tools, verbose=True) agent_executor.invoke({"input": "how many letters in the word educa?"})

AgentExecutor спрощує процес виконання та забезпечує зручний спосіб взаємодії з агентом.

Пам'ять також детально обговорюється пізніше.

Агент, який ми наразі створили, не має статусу, тобто він не пам’ятає попередні взаємодії. Щоб увімкнути додаткові запитання та розмови, нам потрібно додати пам’ять для агента. Це включає два кроки:

- Додайте змінну пам’яті в запит, щоб зберігати історію чату.

- Відстежуйте історію чату під час взаємодії.

Почнемо з додавання заповнювача пам’яті в підказку:

from langchain.prompts import MessagesPlaceholder MEMORY_KEY = "chat_history"

prompt = ChatPromptTemplate.from_messages( [ ( "system", "You are a very powerful assistant but not great at calculating word lengths.", ), MessagesPlaceholder(variable_name=MEMORY_KEY), ("user", "{input}"), MessagesPlaceholder(variable_name="agent_scratchpad"), ]

)

Тепер створіть список для відстеження історії чату:

from langchain.schema.messages import HumanMessage, AIMessage chat_history = []

На етапі створення агента ми також включимо пам’ять:

agent = ( { "input": lambda x: x["input"], "agent_scratchpad": lambda x: format_to_openai_function_messages( x["intermediate_steps"] ), "chat_history": lambda x: x["chat_history"], } | prompt | llm_with_tools | OpenAIFunctionsAgentOutputParser()

)

Тепер, коли запускаєте агент, не забудьте оновити історію чату:

input1 = "how many letters in the word educa?"

result = agent_executor.invoke({"input": input1, "chat_history": chat_history})

chat_history.extend([ HumanMessage(content=input1), AIMessage(content=result["output"]),

])

agent_executor.invoke({"input": "is that a real word?", "chat_history": chat_history})

Це дає змогу агенту зберігати історію розмов і відповідати на додаткові запитання на основі попередніх взаємодій.

Щиро вітаю! Ви успішно створили та запустили свій перший наскрізний агент у LangChain. Щоб глибше ознайомитись із можливостями LangChain, ви можете дослідити:

- Підтримуються різні типи агентів.

- Попередньо створені агенти

- Як працювати з інструментами та інтеграціями інструментів.

Типи агентів

LangChain пропонує різні типи агентів, кожен з яких підходить для конкретних випадків використання. Ось деякі з доступних агентів:

- Zero-shot ReAct: Цей агент використовує фреймворк ReAct для вибору інструментів виключно на основі їхніх описів. Він вимагає описів для кожного інструменту та є надзвичайно універсальним.

- Структурований вхід ReAct: Цей агент працює з інструментами багаторазового введення та підходить для таких складних завдань, як навігація веб-переглядачем. Він використовує схему аргументів інструментів для структурованого введення.

- Функції OpenAI: Спеціально розроблений для моделей, налаштованих на виклик функцій, цей агент сумісний із такими моделями, як gpt-3.5-turbo-0613 і gpt-4-0613. Ми використали це для створення нашого першого агента вище.

- Розмова: Розроблений для розмовних налаштувань, цей агент використовує ReAct для вибору інструментів і використовує пам’ять для запам’ятовування попередніх взаємодій.

- Самозапитуйте з пошуком: Цей агент покладається на єдиний інструмент «Проміжна відповідь», який шукає фактичні відповіді на запитання. Це еквівалент оригінального самозапитання з пошуковим папером.

- Сховище документів ReAct: Цей агент взаємодіє зі сховищем документів за допомогою фреймворку ReAct. Він вимагає інструментів «Пошук» і «Пошук» і схожий на оригінальний приклад статті ReAct у Вікіпедії.

Вивчіть ці типи агентів, щоб знайти той, який найкраще відповідає вашим потребам у LangChain. Ці агенти дозволяють прив’язувати набір інструментів у них для обробки дій і генерування відповідей. Дізнайтеся більше на як створити власного агента за допомогою інструментів тут.

Готові агенти

Давайте продовжимо наше дослідження агентів, зосередившись на готових агентах, доступних у LangChain.

Gmail

LangChain пропонує набір інструментів Gmail, який дозволяє підключити вашу електронну пошту LangChain до API Gmail. Щоб розпочати, вам потрібно буде налаштувати свої облікові дані, які пояснюються в документації Gmail API. Після завантаження файлу credentials.json файл, ви можете продовжити використання Gmail API. Крім того, вам потрібно буде інсталювати деякі необхідні бібліотеки за допомогою таких команд:

pip install --upgrade google-api-python-client > /dev/null

pip install --upgrade google-auth-oauthlib > /dev/null

pip install --upgrade google-auth-httplib2 > /dev/null

pip install beautifulsoup4 > /dev/null # Optional for parsing HTML messages

Ви можете створити набір інструментів Gmail таким чином:

from langchain.agents.agent_toolkits import GmailToolkit toolkit = GmailToolkit()

Ви також можете налаштувати автентифікацію відповідно до своїх потреб. За лаштунками ресурс googleapi створюється за допомогою таких методів:

from langchain.tools.gmail.utils import build_resource_service, get_gmail_credentials credentials = get_gmail_credentials( token_file="token.json", scopes=["https://mail.google.com/"], client_secrets_file="credentials.json",

)

api_resource = build_resource_service(credentials=credentials)

toolkit = GmailToolkit(api_resource=api_resource)

Набір інструментів пропонує різні інструменти, які можна використовувати в агенті, зокрема:

GmailCreateDraft: створити чернетку електронного листа з указаними полями повідомлення.GmailSendMessage: надсилання електронних листів.GmailSearch: пошук повідомлень електронної пошти або ланцюжків.GmailGetMessage: отримати електронний лист за ідентифікатором повідомлення.GmailGetThread: пошук повідомлень електронної пошти.

Щоб використовувати ці інструменти в агенті, ви можете ініціалізувати агента таким чином:

from langchain.llms import OpenAI

from langchain.agents import initialize_agent, AgentType llm = OpenAI(temperature=0)

agent = initialize_agent( tools=toolkit.get_tools(), llm=llm, agent=AgentType.STRUCTURED_CHAT_ZERO_SHOT_REACT_DESCRIPTION,

)

Ось кілька прикладів того, як можна використовувати ці інструменти:

- Створіть чернетку Gmail для редагування:

agent.run( "Create a gmail draft for me to edit of a letter from the perspective of a sentient parrot " "who is looking to collaborate on some research with her estranged friend, a cat. " "Under no circumstances may you send the message, however."

)

- Знайдіть останній електронний лист у чернетках:

agent.run("Could you search in my drafts for the latest email?")

Ці приклади демонструють можливості набору інструментів Gmail від LangChain в агенті, що дозволяє вам взаємодіяти з Gmail програмно.

Агент бази даних SQL

У цьому розділі наведено огляд агента, призначеного для взаємодії з базами даних SQL, зокрема базою даних Chinook. Цей агент може відповідати на загальні запитання про базу даних і відновлювати помилки. Зверніть увагу, що він все ще знаходиться в активній розробці, і не всі відповіді можуть бути правильними. Будьте обережні, запускаючи його з конфіденційними даними, оскільки він може виконувати оператори DML у вашій базі даних.

Щоб використовувати цей агент, ви можете ініціалізувати його таким чином:

from langchain.agents import create_sql_agent

from langchain.agents.agent_toolkits import SQLDatabaseToolkit

from langchain.sql_database import SQLDatabase

from langchain.llms.openai import OpenAI

from langchain.agents import AgentExecutor

from langchain.agents.agent_types import AgentType

from langchain.chat_models import ChatOpenAI db = SQLDatabase.from_uri("sqlite:///../../../../../notebooks/Chinook.db")

toolkit = SQLDatabaseToolkit(db=db, llm=OpenAI(temperature=0)) agent_executor = create_sql_agent( llm=OpenAI(temperature=0), toolkit=toolkit, verbose=True, agent_type=AgentType.ZERO_SHOT_REACT_DESCRIPTION,

)

Цей агент можна ініціалізувати за допомогою ZERO_SHOT_REACT_DESCRIPTION тип агента. Він призначений для відповідей на запитання та надання описів. Крім того, ви можете ініціалізувати агента за допомогою OPENAI_FUNCTIONS тип агента з моделлю OpenAI GPT-3.5-turbo, яку ми використовували в нашому попередньому клієнті.

відмова

- Ланцюжок запитів може генерувати запити на вставку/оновлення/видалення. Будьте обережні та скористайтеся спеціальним запитом або створіть користувача SQL без прав на запис, якщо це необхідно.

- Майте на увазі, що виконання певних запитів, як-от «запустити максимально великий запит», може перевантажити вашу базу даних SQL, особливо якщо вона містить мільйони рядків.

- Бази даних, орієнтовані на сховище даних, часто підтримують квоти на рівні користувача, щоб обмежити використання ресурсів.

Ви можете попросити агента описати таблицю, наприклад таблицю «playlisttrack». Ось приклад того, як це зробити:

agent_executor.run("Describe the playlisttrack table")

Агент надасть інформацію про схему таблиці та зразки рядків.

Якщо ви помилково запитаєте про таблицю, яка не існує, агент може відновити та надати інформацію про найближчу відповідну таблицю. Наприклад:

agent_executor.run("Describe the playlistsong table")

Агент знайде найближчий відповідний стіл і надасть інформацію про нього.

Ви також можете попросити агента виконати запити до бази даних. Наприклад:

agent_executor.run("List the total sales per country. Which country's customers spent the most?")

Агент виконає запит і надасть результат, наприклад країну з найбільшим загальним обсягом продажів.

Щоб отримати загальну кількість треків у кожному списку відтворення, ви можете скористатися таким запитом:

agent_executor.run("Show the total number of tracks in each playlist. The Playlist name should be included in the result.")

Агент поверне назви списків відтворення разом із відповідною загальною кількістю треків.

У випадках, коли агент стикається з помилками, він може відновити та надати точні відповіді. Наприклад:

agent_executor.run("Who are the top 3 best selling artists?")

Навіть зіткнувшись з початковою помилкою, агент скорегує та надасть правильну відповідь, яка в даному випадку є ТОП-3 найбільш продаваних виконавців.

Агент Pandas DataFrame

У цьому розділі представлено агент, призначений для взаємодії з Pandas DataFrames для отримання відповідей на запитання. Зверніть увагу, що цей агент використовує агент Python під капотом для виконання коду Python, згенерованого мовною моделлю (LLM). Будьте обережні, використовуючи цей агент, щоб запобігти потенційній шкоді від шкідливого коду Python, створеного LLM.

Ви можете ініціалізувати агент Pandas DataFrame наступним чином:

from langchain_experimental.agents.agent_toolkits import create_pandas_dataframe_agent

from langchain.chat_models import ChatOpenAI

from langchain.agents.agent_types import AgentType from langchain.llms import OpenAI

import pandas as pd df = pd.read_csv("titanic.csv") # Using ZERO_SHOT_REACT_DESCRIPTION agent type

agent = create_pandas_dataframe_agent(OpenAI(temperature=0), df, verbose=True) # Alternatively, using OPENAI_FUNCTIONS agent type

# agent = create_pandas_dataframe_agent(

# ChatOpenAI(temperature=0, model="gpt-3.5-turbo-0613"),

# df,

# verbose=True,

# agent_type=AgentType.OPENAI_FUNCTIONS,

# )

Ви можете попросити агента підрахувати кількість рядків у DataFrame:

agent.run("how many rows are there?")

Агент виконає код df.shape[0] і надайте відповідь, наприклад «У кадрі даних 891 рядок».

Ви також можете попросити агента відфільтрувати рядки на основі конкретних критеріїв, наприклад знайти кількість людей, які мають більше ніж 3 братів і сестер:

agent.run("how many people have more than 3 siblings")

Агент виконає код df[df['SibSp'] > 3].shape[0] і дайте відповідь, наприклад «30 людей мають більше ніж 3 братів і сестер».

Якщо ви хочете обчислити квадратний корінь із середнього віку, ви можете запитати агента:

agent.run("whats the square root of the average age?")

Агент розрахує середній вік за допомогою df['Age'].mean() а потім обчисліть квадратний корінь за допомогою math.sqrt(). Він дасть відповідь, наприклад «Квадратний корінь із середнього віку дорівнює 5.449689683556195».

Давайте створимо копію DataFrame, а відсутні значення віку заповнимо середнім віком:

df1 = df.copy()

df1["Age"] = df1["Age"].fillna(df1["Age"].mean())

Потім ви можете ініціалізувати агент обома DataFrames і поставити йому запитання:

agent = create_pandas_dataframe_agent(OpenAI(temperature=0), [df, df1], verbose=True)

agent.run("how many rows in the age column are different?")

Агент порівнює вікові стовпці в обох DataFrames і надасть відповідь, наприклад «177 рядків у віковому стовпці різні».

Jira Toolkit

У цьому розділі пояснюється, як використовувати набір інструментів Jira, який дозволяє агентам взаємодіяти з примірником Jira. Ви можете виконувати різні дії, наприклад шукати проблеми та створювати проблеми за допомогою цього набору інструментів. Він використовує бібліотеку atlassian-python-api. Щоб використовувати цей набір інструментів, вам потрібно встановити змінні середовища для вашого екземпляра Jira, зокрема JIRA_API_TOKEN, JIRA_USERNAME та JIRA_INSTANCE_URL. Крім того, вам може знадобитися встановити ключ OpenAI API як змінну середовища.

Для початку встановіть бібліотеку atlassian-python-api і встановіть необхідні змінні середовища:

%pip install atlassian-python-api import os

from langchain.agents import AgentType

from langchain.agents import initialize_agent

from langchain.agents.agent_toolkits.jira.toolkit import JiraToolkit

from langchain.llms import OpenAI

from langchain.utilities.jira import JiraAPIWrapper os.environ["JIRA_API_TOKEN"] = "abc"

os.environ["JIRA_USERNAME"] = "123"

os.environ["JIRA_INSTANCE_URL"] = "https://jira.atlassian.com"

os.environ["OPENAI_API_KEY"] = "xyz" llm = OpenAI(temperature=0)

jira = JiraAPIWrapper()

toolkit = JiraToolkit.from_jira_api_wrapper(jira)

agent = initialize_agent( toolkit.get_tools(), llm, agent=AgentType.ZERO_SHOT_REACT_DESCRIPTION, verbose=True

)

Ви можете доручити агенту створити нову проблему в конкретному проекті зі зведенням і описом:

agent.run("make a new issue in project PW to remind me to make more fried rice")

Агент виконає необхідні дії для створення проблеми та надасть відповідь, як-от «У проекті PW створено нову проблему зі зведенням «Зробіть більше смаженого рису» та описом «Нагадування про необхідність зробити більше смаженого рису».

Це дозволяє вам взаємодіяти з примірником Jira за допомогою інструкцій природною мовою та набору інструментів Jira.

Автоматизуйте ручні завдання та робочі процеси за допомогою нашого конструктора робочих процесів на основі ШІ, розробленого Nanonets для вас і ваших команд.

Модуль IV: Ланцюги

LangChain — це інструмент, призначений для використання великих мовних моделей (LLM) у складних програмах. Він надає рамки для створення ланцюжків компонентів, включаючи LLM та інші типи компонентів. Дві основні рамки

- Мова виразів LangChain (LCEL)

- Застарілий інтерфейс Chain

Мова виразів LangChain (LCEL) — це синтаксис, який дозволяє інтуїтивно зрозуміло створювати ланцюжки. Він підтримує розширені функції, як-от потокове передавання, асинхронні виклики, пакетування, розпаралелювання, повторні спроби, резервні варіанти та трасування. Наприклад, ви можете створити підказку, модель і аналізатор виводу в LCEL, як показано в наступному коді:

from langchain.prompts import ChatPromptTemplate

from langchain.schema import StrOutputParser model = ChatOpenAI(model="gpt-3.5-turbo", temperature=0)

prompt = ChatPromptTemplate.from_messages([ ("system", "You're a very knowledgeable historian who provides accurate and eloquent answers to historical questions."), ("human", "{question}")

])

runnable = prompt | model | StrOutputParser() for chunk in runnable.stream({"question": "What are the seven wonders of the world"}): print(chunk, end="", flush=True)

Крім того, LLMChain є опцією, подібною до LCEL для створення компонентів. Приклад LLMChain такий:

from langchain.chains import LLMChain chain = LLMChain(llm=model, prompt=prompt, output_parser=StrOutputParser())

chain.run(question="What are the seven wonders of the world")

Ланцюжки в LangChain також можуть мати стан шляхом включення об’єкта Memory. Це дозволяє зберігати дані між викликами, як показано в цьому прикладі:

from langchain.chains import ConversationChain

from langchain.memory import ConversationBufferMemory conversation = ConversationChain(llm=chat, memory=ConversationBufferMemory())

conversation.run("Answer briefly. What are the first 3 colors of a rainbow?")

conversation.run("And the next 4?")

LangChain також підтримує інтеграцію з API виклику функцій OpenAI, що корисно для отримання структурованих виходів і виконання функцій у ланцюжку. Щоб отримати структуровані результати, ви можете вказати їх за допомогою класів Pydantic або JsonSchema, як показано нижче:

from langchain.pydantic_v1 import BaseModel, Field

from langchain.chains.openai_functions import create_structured_output_runnable

from langchain.chat_models import ChatOpenAI

from langchain.prompts import ChatPromptTemplate class Person(BaseModel): name: str = Field(..., description="The person's name") age: int = Field(..., description="The person's age") fav_food: Optional[str] = Field(None, description="The person's favorite food") llm = ChatOpenAI(model="gpt-4", temperature=0)

prompt = ChatPromptTemplate.from_messages([ # Prompt messages here

]) runnable = create_structured_output_runnable(Person, llm, prompt)

runnable.invoke({"input": "Sally is 13"})

Для структурованих виходів також доступний застарілий підхід із використанням LLMChain:

from langchain.chains.openai_functions import create_structured_output_chain class Person(BaseModel): name: str = Field(..., description="The person's name") age: int = Field(..., description="The person's age") chain = create_structured_output_chain(Person, llm, prompt, verbose=True)

chain.run("Sally is 13")

LangChain використовує функції OpenAI для створення різних конкретних ланцюжків для різних цілей. До них належать ланцюжки для вилучення, тегування, OpenAPI та QA з цитуваннями.

У контексті вилучення процес подібний до структурованого ланцюга виведення, але зосереджений на вилученні інформації або сутності. Для додавання тегів ідея полягає в тому, щоб позначити документ такими класами, як настрої, мова, стиль, охоплені теми або політичні тенденції.

Приклад того, як працює тегування в LangChain, можна продемонструвати за допомогою коду Python. Процес починається з встановлення необхідних пакетів і налаштування середовища:

pip install langchain openai

# Set env var OPENAI_API_KEY or load from a .env file:

# import dotenv

# dotenv.load_dotenv() from langchain.chat_models import ChatOpenAI

from langchain.prompts import ChatPromptTemplate

from langchain.chains import create_tagging_chain, create_tagging_chain_pydantic

Визначається схема для тегування, вказуючи властивості та їх очікувані типи:

schema = { "properties": { "sentiment": {"type": "string"}, "aggressiveness": {"type": "integer"}, "language": {"type": "string"}, }

} llm = ChatOpenAI(temperature=0, model="gpt-3.5-turbo-0613")

chain = create_tagging_chain(schema, llm)

Приклади запуску ланцюжка тегів з різними вхідними даними показують здатність моделі інтерпретувати почуття, мови та агресивність:

inp = "Estoy increiblemente contento de haberte conocido! Creo que seremos muy buenos amigos!"

chain.run(inp)

# {'sentiment': 'positive', 'language': 'Spanish'} inp = "Estoy muy enojado con vos! Te voy a dar tu merecido!"

chain.run(inp)

# {'sentiment': 'enojado', 'aggressiveness': 1, 'language': 'es'}

Для більш точного контролю схему можна визначити більш конкретно, включаючи можливі значення, описи та необхідні властивості. Приклад цього розширеного контролю показано нижче:

schema = { "properties": { # Schema definitions here }, "required": ["language", "sentiment", "aggressiveness"],

} chain = create_tagging_chain(schema, llm)

Схеми Pydantic також можна використовувати для визначення критеріїв тегів, забезпечуючи Pythonic спосіб визначення необхідних властивостей і типів:

from enum import Enum

from pydantic import BaseModel, Field class Tags(BaseModel): # Class fields here chain = create_tagging_chain_pydantic(Tags, llm)

Крім того, засіб трансформації тегів метаданих LangChain можна використовувати для вилучення метаданих із документів LangChain, пропонуючи подібні функції до ланцюжка тегів, але застосовуючи їх до документа LangChain.

Посилання на джерела пошуку є ще однією функцією LangChain, яка використовує функції OpenAI для отримання цитат із тексту. Це показано в наступному коді:

from langchain.chains import create_citation_fuzzy_match_chain

from langchain.chat_models import ChatOpenAI llm = ChatOpenAI(temperature=0, model="gpt-3.5-turbo-0613")

chain = create_citation_fuzzy_match_chain(llm)

# Further code for running the chain and displaying results

У LangChain ланцюжок у програмах великої мовної моделі (LLM) зазвичай передбачає поєднання шаблону підказки з LLM і необов’язково синтаксичним аналізатором виводу. Рекомендований спосіб зробити це за допомогою мови виразів LangChain (LCEL), хоча також підтримується застарілий підхід LLMChain.

Використовуючи LCEL, BasePromptTemplate, BaseLanguageModel і BaseOutputParser реалізують інтерфейс Runnable і можуть легко передаватись один в одного. Ось приклад, який демонструє це:

from langchain.prompts import PromptTemplate

from langchain.chat_models import ChatOpenAI