Розгортання потужних систем штучного інтелекту збагатило наше розуміння безпеки та неправомірного використання набагато більше, ніж це було б можливо за допомогою лише дослідження. Особливо:

- Неправильне використання мовної моделі на основі API часто має різні форми, ніж ми найбільше боялися.

- Ми виявили обмеження в оцінках існуючих мовних моделей, які ми вирішуємо за допомогою нових контрольних показників і класифікаторів.

- Базові дослідження безпеки пропонують значні переваги для комерційної корисності систем ШІ.

Тут ми описуємо наші останні думки в надії допомогти іншим розробникам AI вирішити питання безпеки та неправильного використання розгорнутих моделей.

Oпротягом останніх двох років, ми багато дізналися про те, як можна використовувати й зловживати мовними моделями — ідеї, які ми не змогли б отримати без досвіду розгортання в реальному світі. У червні 2020 року ми почали надавати розробникам і дослідникам доступ до API OpenAI, інтерфейс для доступу та створення додатків на основі нових моделей AI, розроблених OpenAI. Розгортання GPT-3, Codex та інших моделей таким чином, щоб зменшити ризики шкоди, створило різні технічні та політичні проблеми.

Огляд нашого підходу до розгортання моделі

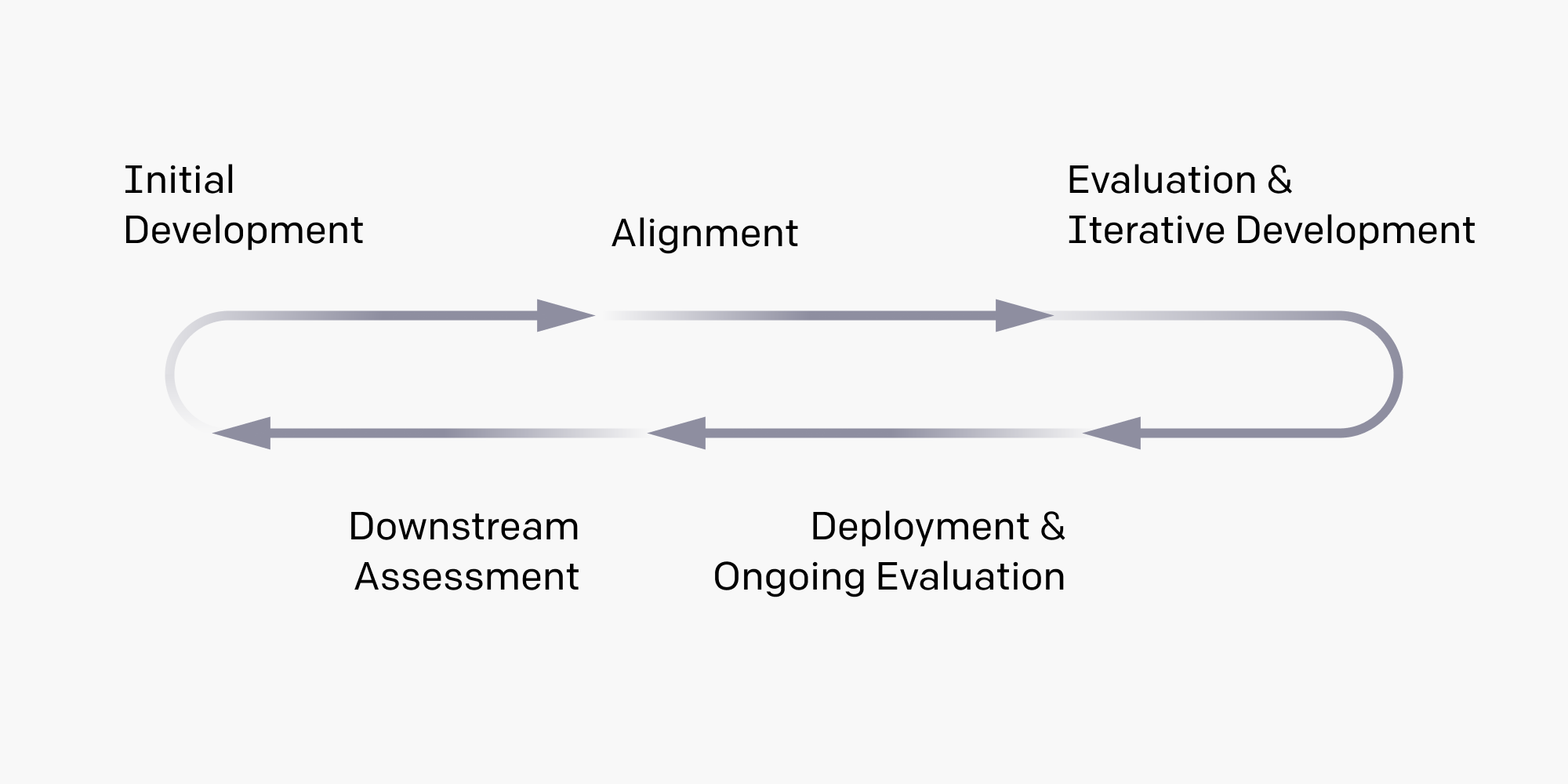

Великі мовні моделі тепер здатні виконувати а дуже широкий спектр завдань, часто з коробки. Їх профілі ризиків, потенційні можливості застосування та ширший вплив на суспільство залишатися погано зрозуміла. Як результат, наш підхід до розгортання робить акцент на безперервній ітерації та використовує такі стратегії, спрямовані на максимізацію переваг розгортання при зменшенні пов’язаних ризиків:

- Аналіз ризиків перед розгортанням, використання зростаючого набору оцінок безпеки та інструментів червоної команди (наприклад, ми перевірили наш InstructGPT на наявність будь-яких погіршень безпеки за допомогою оцінок обговорюється нижче)

- Починаючи з невеликої бази користувачів (наприклад, GPT-3 і наш Інструктувати GPT серія починалася як приватні бета-версії)

- Вивчення результатів пілотних експериментів нових випадків використання (наприклад, вивчення умов, за яких ми могли б безпечно увімкнути створення довгого контенту, працюючи з невеликою кількістю клієнтів)

- Впровадження процесів, які допомагають контролювати використання (наприклад, перегляд випадків використання, квот маркерів та обмежень швидкості)

- Проведення детальних ретроспективних оглядів (наприклад, інцидентів у сфері безпеки та великих розгортань)

Зауважте, що ця діаграма призначена для того, щоб візуально передати потребу в петлях зворотного зв’язку в безперервному процесі розробки та розгортання моделі, а також той факт, що безпека повинна бути інтегрована на кожному етапі. Він не має на меті передати повну чи ідеальну картину процесу нашої чи будь-якої іншої організації.

Немає срібної кули для відповідального розгортання, тому ми намагаємося дізнатися про обмеження наших моделей та потенційні шляхи неправомірного використання та вирішити їх на кожному етапі розробки та розгортання. Такий підхід дозволяє нам якомога більше дізнатися про проблеми безпеки та політики в невеликих масштабах і включити ці ідеї перед запуском більш масштабних розгортань.

Хоча це не є вичерпним, деякі сфери, у які ми інвестували досі, включають[1]:

- Попередня підготовка дані курація та фільтрація

- Тонка настройка моделі краще дотримуйтесь інструкцій

- Аналіз ризиків потенційних розгортань

- Надання детального користувача документація

- Створюємо інструменти для перевірки шкідливих вихідних даних моделі

- Перегляд випадків використання проти наших Політика

- Моніторинг на наявність ознак зловживання

- Вивчення вплив наших моделей

Оскільки кожен етап втручання має обмеження, необхідний цілісний підхід.

Є сфери, де ми могли б зробити більше, і де ще є куди вдосконалюватися. Наприклад, коли ми вперше працювали над GPT-3, ми розглядали його як внутрішній дослідницький артефакт, а не виробничу систему, і не були настільки агресивними у відфільтруванні токсичних навчальних даних, як могли б бути інакше. Ми інвестували більше у дослідження та видалення такого матеріалу для наступних моделей. Нам знадобилося більше часу, щоб вирішувати деякі випадки зловживання в тих випадках, коли у нас не було чітких політик з цього приводу, і ми вдосконалилися в повторенні цих правил. І ми продовжуємо рухатися до пакету вимог безпеки, який максимально ефективний у подоланні ризиків, а також чітко повідомляється розробникам та мінімізує надмірне тертя.

Тим не менш, ми вважаємо, що наш підхід дозволив нам виміряти та зменшити різні типи шкоди від використання мовної моделі в порівнянні з підходом, що має більш вільні руки, водночас даючи можливість широкого кола наукових, художніх та комерційних застосувань нашої моделі.[2]

Багато форм і розмірів зловживання мовною моделлю

OpenAI активно досліджує ризики неправомірного використання ШІ з початку нашої роботи над зловмисне використання ШІ В 2018 і на GPT-2 у 2019 році, і ми приділили особливу увагу системам штучного інтелекту, які надають можливість впливу на операції. Ми маємо працював з зовнішніх експертів для розробки докази концепції і просуваний обережний аналіз таких ризиків з боку третіх сторін. Ми продовжуємо боротися з ризиками, пов’язаними з операціями впливу за допомогою мовної моделі, і нещодавно спільно організували семінар на цю тему.[3]

Проте ми виявили та зупинили сотні акторів, які намагалися зловживати GPT-3 для набагато ширших цілей, ніж створення дезінформації для операцій впливу, у тому числі способами, які ми або не передбачали, або які ми передбачали, але не очікували, що будуть настільки поширений.[4] наш рекомендації щодо використання, рекомендації щодо вмісту, а внутрішня інфраструктура виявлення та реагування спочатку була орієнтована на ризики, які ми передбачали на основі внутрішніх і зовнішніх досліджень, наприклад створення оманливого політичного вмісту за допомогою GPT-3 або створення шкідливого програмного забезпечення за допомогою Codex. Наші зусилля з виявлення та реагування з часом розвивалися у відповідь на реальні випадки неправомірного використання, які зустрічалися «в дикій природі», які не були настільки помітними, як вплив на операції в наших початкових оцінках ризику. Приклади включають спам-рекламу сумнівних медичних товарів та рольові ігри расистських фантазій.

Щоб підтримати дослідження зловживання мовною моделлю та пом’якшення цього, ми активно досліджуємо можливості поділитися статистикою інцидентів у сфері безпеки цього року, щоб конкретизувати обговорення зловживання мовною моделлю.

Складність вимірювання ризику та впливу

Багато аспектів ризиків і впливу мовних моделей все ще важко виміряти, а тому їх важко відстежувати, мінімізувати та розкривати підзвітним способом. Ми активно використовували існуючі академічні контрольні показники для оцінки мовної моделі та прагнемо продовжувати надбудову на зовнішній роботі, але ми також виявили, що існуючі контрольні набори даних часто не відображають ризики безпеки та неправильного використання, які ми спостерігаємо на практиці.[5]

Такі обмеження відображають той факт, що академічні набори даних рідко створюються з явною метою інформування про виробниче використання мовних моделей і не користуються досвідом, отриманим від масштабного розгортання таких моделей. У результаті ми розробляємо нові набори оціночних даних і рамки для вимірювання безпеки наших моделей, які ми плануємо випустити незабаром. Зокрема, ми розробили нові показники оцінки для вимірювання токсичності в результатах моделі, а також розробили власні класифікатори для виявлення вмісту, який порушує наші політика щодо вмісту, як-от еротичний вміст, ворожі висловлювання, насильство, переслідування та самопошкодження. Обидва вони, у свою чергу, також були використані для покращення даних перед тренуванням[6]— зокрема, за допомогою класифікаторів для фільтрації вмісту та показників оцінки для вимірювання ефектів втручань у наборі даних.

Надійно класифікувати результати окремих моделей за різними вимірами важко, а виміряти їх соціальний вплив у масштабі API OpenAI ще важче. Ми провели кілька внутрішніх досліджень, щоб створити інституційну мускулатуру для такого вимірювання, але вони часто викликають більше запитань, ніж відповідей.

Ми особливо зацікавлені в кращому розумінні економічного впливу наших моделей і розподілу цього впливу. У нас є вагомі підстави вважати, що вплив на ринок праці від розгортання поточних моделей вже може бути значним в абсолютному вираженні, і що він буде зростати в міру зростання можливостей і охоплення наших моделей. На сьогоднішній день ми дізналися про різноманітні локальні ефекти, включаючи значне підвищення продуктивності для існуючих завдань, виконуваних окремими особами, як-от копірайтинг та підведення підсумків (іноді сприяючи зміщенню та створенню робочих місць), а також випадки, коли API відкривав нові програми, які раніше були неможливими. , як от синтез великомасштабного якісного зворотного зв'язку. Але нам бракує хорошого розуміння чистих ефектів.

Ми вважаємо, що для тих, хто розробляє та впроваджує потужні технології штучного інтелекту, важливо усунути як позитивні, так і негативні наслідки своєї роботи. Ми обговоримо деякі кроки в цьому напрямку в заключному розділі цієї публікації.

Зв'язок між безпекою та корисністю систем ШІ

У нашій Статут, опублікованому в 2018 році, ми говоримо, що «стурбовані тим, що останній етап розвитку AGI стане конкурентною гонкою без часу для адекватних заходів безпеки». Ми тоді опублікований детальний аналіз розвитку конкурентного ШІ, за яким ми уважно стежили наступні дослідження. У той же час розгортання систем штучного інтелекту через OpenAI API також поглибило наше розуміння синергії між безпекою та корисністю.

Наприклад, розробники переважно віддають перевагу нашим моделям InstructGPT, які точно налаштовані відповідно до намірів користувачів[7]—понад базові моделі GPT-3. Примітно, однак, що моделі InstructGPT спочатку не були мотивовані комерційними міркуваннями, а були спрямовані на досягнення прогресу в довгостроковій перспективі. проблеми з вирівнюванням. У практичному плані це означає, що клієнти, можливо, не дивно, віддають перевагу моделям, які залишаються при виконанні завдань і розуміють наміри користувача, а також моделям, які з меншою ймовірністю створять шкідливі або неправильні результати.[8] Інші фундаментальні дослідження, такі як наша робота над використання інформації отриманий з Інтернету, щоб відповісти на запитання більш правдиво, також має потенціал для покращення комерційної корисності систем ШІ.[9]

Ці синергії не завжди будуть мати місце. Наприклад, більш потужні системи часто потребують більше часу для ефективної оцінки та узгодження, уникаючи негайних можливостей для отримання прибутку. І корисність користувача та суспільства може бути не узгоджена через негативні зовнішні ефекти — розглянемо повністю автоматизований копірайтинг, який може бути корисним для творців контенту, але шкідливим для інформаційної екосистеми в цілому.

Це обнадійливо бачити випадки сильної синергії між безпекою та корисністю, але ми прагнемо інвестувати в дослідження безпеки та політики, навіть якщо вони йдуть на компроміс із комерційною корисністю.

Способи залучення

Кожен із наведених вище уроків викликає нові питання. Які інциденти безпеки ми все ще не можемо виявити та передбачити? Як ми можемо краще вимірювати ризики та вплив? Як ми можемо продовжувати покращувати як безпеку, так і корисність наших моделей, а також знаходити компроміси між цими двома, коли вони виникнуть?

Ми активно обговорюємо багато з цих питань з іншими компаніями, які впроваджують мовні моделі. Але ми також знаємо, що жодна організація чи набір організацій не має відповідей на всі відповіді, і ми хотіли б виділити кілька способів, за допомогою яких читачі можуть більше залучитися до розуміння та формування нашого розгортання найсучасніших систем штучного інтелекту.

По-перше, отримання безпосереднього досвіду взаємодії з найсучаснішими системами штучного інтелекту є неоціненним для розуміння їх можливостей і наслідків. Нещодавно ми припинили список очікування API після того, як зміцнили впевненість у своїй здатності ефективно виявляти та реагувати на зловживання. Особи в підтримуваних країн і територій можна швидко отримати доступ до OpenAI API, зареєструвавшись тут.

По-друге, дослідники, які працюють над темами, які нас особливо цікавлять, як-от упередженість та неправильне використання, і які отримають користь від фінансової підтримки, можуть подати заявку на отримання субсидованих кредитів API, використовуючи ця форма. Зовнішні дослідження є життєво важливими для інформування як нашого розуміння цих багатогранних систем, так і ширшого розуміння громадськості.

Нарешті, сьогодні ми публікуємо а програми досліджень вивчення впливу на ринок праці, пов’язаного з нашим сімейством моделей Codex, і заклик до зовнішніх співробітників для проведення цього дослідження. Ми раді співпрацювати з незалежними дослідниками для вивчення ефектів наших технологій, щоб інформувати про відповідні заходи політики та врешті-решт розширити наше мислення від генерації коду до інших методів.

Якщо ви зацікавлені в роботі над відповідальним розгортанням передових технологій AI, застосовувати працювати в OpenAI!

- 2019

- 2020

- 7

- 9

- МЕНЮ

- абсолют

- доступ

- активний

- адреса

- адресація

- Переваги

- AI

- ВСІ

- вже

- посилюється

- аналіз

- API

- застосовно

- додаток

- застосування

- підхід

- Art

- Автоматизований

- буття

- еталонний тест

- Переваги

- Берклі

- Box

- будувати

- Створюємо

- call

- Кембридж

- Може отримати

- можливості

- проведення

- випадків

- виклик

- проблеми

- код

- комерційний

- Компанії

- порівняний

- компонент

- довіра

- Контейнер

- зміст

- продовжувати

- контроль

- витрати

- може

- країни

- Творці

- кредити

- Поточний

- Клієнти

- передовий

- дані

- розгортання

- розгортання

- розгортання

- виявлено

- Виявлення

- розвивати

- розвиненою

- Розробник

- розробників

- розвивається

- розробка

- DID

- відрізняються

- різний

- Розмір

- обговорювати

- розподіл

- Рано

- Економічний

- Економічний вплив

- екосистема

- ефект

- Ефективний

- ефекти

- уповноважують

- дозволяє

- заохочення

- зачеплення

- Збагачений

- приклад

- Розширювати

- очікувати

- витрати

- досвід

- experts

- Провал

- сім'я

- особливість

- зворотний зв'язок

- фінансовий

- Перший

- Сфокусувати

- увагу

- стежити

- після

- форма

- форми

- знайдений

- Повний

- Стать

- дає

- добре

- Рости

- Зростання

- здоров'я

- допомога

- корисний

- Виділіть

- Як

- How To

- HTTPS

- Сотні

- Impact

- важливо

- удосконалювати

- включати

- включені

- У тому числі

- індивідуальний

- вплив

- інформація

- Інфраструктура

- розуміння

- Інституційна

- інтегрований

- намір

- інтерес

- інтерфейс

- інтернет

- інвестування

- залучений

- питання

- IT

- робота

- маркування

- праця

- мова

- останній

- запуск

- УЧИТЬСЯ

- вчений

- Уроки, витягнуті

- трохи

- місцевий

- Довго

- основний

- Робить

- шкідливих програм

- вручну

- ринок

- масивний

- вимір

- медичний

- Психічне здоров'я

- Метрика

- модель

- Моделі

- найбільш

- мережу

- Пропозиції

- відкрити

- з відкритим вихідним кодом

- операції

- Можливості

- порядок

- організація

- організації

- Інше

- інакше

- оплачувану

- Люди

- може бути

- перспектива

- картина

- пілот

- Політика

- політика

- політичний

- це можливо

- потужний

- приватний

- процес

- процеси

- виробляти

- Production

- продуктивність

- Продукти

- Профілі

- Прибуток

- громадськість

- Видавничий

- мета

- цілей

- швидко

- Гонки

- піднімається

- діапазон

- RE

- читачі

- зменшити

- зниження

- відображати

- відносини

- звільнити

- Вимога

- дослідження

- відповідь

- відповідальний

- Обмеження

- результати

- огляд

- Відгуки

- Risk

- ризики

- Безпека

- економія

- шкала

- Екран

- пошук

- Серія

- комплект

- форми

- Поділитись

- значний

- Ознаки

- срібло

- невеликий

- So

- соціальна

- суспільство

- Простір

- спам

- конкретно

- Стажування

- стан

- статистика

- залишатися

- стратегії

- сильний

- Дослідження

- Вивчення

- стиль

- підтримка

- система

- Systems

- завдання

- технічний

- Технології

- Мислення

- треті сторони

- через

- час

- сьогодні

- знак

- інструменти

- топ

- теми

- торгувати

- Навчання

- Перетворення

- розуміти

- us

- використання

- користувачі

- утиліта

- Що

- ВООЗ

- без

- Work

- працював

- робочий

- лист

- рік