Бум генеративного ШІ пов’язаний з обчисленнями. Він має унікальну властивість: додавання більшої кількості обчислювальних ресурсів безпосередньо призводить до кращого продукту. Зазвичай інвестиції в НДДКР безпосередньо пов’язані з тим, наскільки цінним був продукт, і цей зв’язок помітно сублінійний. Але наразі це не так зі штучним інтелектом, і, як наслідок, переважаючим фактором, що рухає індустрією сьогодні, є просто вартість навчання та висновків.

Хоча ми не знаємо справжніх цифр, ми чули з авторитетних джерел, що пропозиція обчислювальної техніки настільки обмежена, що попит перевищує її в 10 разів (!). Тому ми вважаємо справедливим сказати, що прямо зараз, доступ до обчислювальних ресурсів — за найнижчої загальної вартості — став визначальним чинником успіху компаній зі штучним інтелектом.

Насправді ми бачили, як багато компаній витрачають більше 80% свого загального капіталу на обчислювальні ресурси!

У цьому дописі ми намагаємося розбити фактори витрат для компанії ШІ. Абсолютні цифри, звичайно, змінюватимуться з часом, але ми не бачимо негайного полегшення від того, що компанії зі штучним інтелектом обмежені доступом до обчислювальних ресурсів. Тож, сподіваюся, це корисна основа для осмислення ландшафту.

Чому моделі штучного інтелекту такі дорогі з точки зору обчислень?

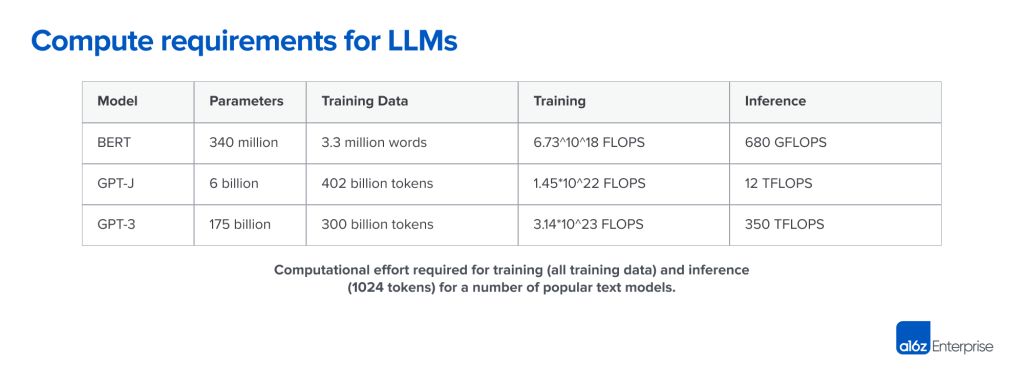

Існує велика різноманітність генеративних моделей штучного інтелекту, а вартість висновків і навчання залежить від розміру та типу моделі. На щастя, найпопулярнішими моделями сьогодні є переважно трансформаторні архітектури, які включають популярні моделі великих мов (LLM), такі як GPT-3, GPT-J або BERT. Тоді як точна кількість операцій для виведення та навчання трансформаторів залежить від моделі (див цей папір), існує досить точне емпіричне правило, яке залежить лише від кількості параметрів (тобто вагових коефіцієнтів нейронних мереж) моделі та кількості вхідних і вихідних маркерів.

Токени – це, по суті, короткі послідовності з кількох символів. Вони відповідають словам або частинам слів. Найкращий спосіб отримати інтуїтивне уявлення про токени — спробувати токенізацію за допомогою загальнодоступних онлайн-токенізерів (наприклад, OpenAI). Для GPT-3 середня довжина токена складається з 4 символів.

Основне правило для трансформаторів полягає в тому, що прямий перехід (тобто висновок) для моделі з p параметри для вхідної та вихідної послідовності довжини n лексеми кожен, займає приблизно 2*н*п операції з плаваючою комою (ФЛОПС)¹. Навчання на цю ж модель займає приблизно 6*стор FLOPS на токен (тобто додатковий зворотний прохід вимагає ще чотирьох операцій²).). Ви можете приблизно визначити загальну вартість навчання, помноживши її на кількість жетонів у даних навчання.

Вимоги до пам'яті для трансформаторів також залежать від розміру моделі. Для висновку нам знадобиться p параметри моделі для розміщення в пам’яті. Для навчання (тобто зворотного поширення) нам потрібно зберігати додаткові проміжні значення кожного параметра між прямим і зворотним проходом. Якщо припустити, що ми використовуємо 32-розрядні числа з плаваючою комою, це додаткові 8 байтів на параметр. Для навчання моделі зі 175 мільярдами параметрів нам знадобиться зберігати понад терабайт даних у пам’яті — це перевищує будь-який існуючий сьогодні графічний процесор і вимагає від нас розділити модель між картами. Вимоги до пам’яті для логічного висновку та навчання можна оптимізувати за допомогою значень з плаваючою комою меншої довжини, причому 16-бітний стане звичайним, а 8-бітний очікується в найближчому майбутньому.

У таблиці вище наведено розміри та обчислену вартість для кількох популярних моделей. GPT-3 має приблизно 175 мільярдів параметрів, що для введення та виведення 1,024 токенів призводить до обчислювальної вартості приблизно 350 трильйонів операцій з плаваючою комою (тобто терафлопс або TFLOPS). Навчання такої моделі, як GPT-3, вимагає приблизно 3.14*10^23 операцій із плаваючою комою. Інші моделі, такі як LLaMA від Meta, мають ще вище вимоги до обчислень. Навчання такої моделі є одним із найбільш інтенсивних обчислювальних завдань, які досі виконувало людство.

Підводячи підсумок: інфраструктура штучного інтелекту є дорогою, оскільки базові алгоритмічні проблеми надзвичайно складні з точки зору обчислень. Алгоритмічна складність сортування таблиці бази даних із мільйоном записів незначна порівняно зі складністю генерації одного слова за допомогою GPT-3. Це означає, що ви хочете вибрати найменшу модель, яка відповідає вашому варіанту використання.

Хороша новина полягає в тому, що для трансформаторів ми можемо легко оцінити, скільки обчислень і пам’яті споживатиме модель певного розміру. Отже, вибір правильного обладнання стає наступним питанням.

Час і вартість аргументів для GPU

Як обчислювальна складність перетворюється на час? Ядро процесора зазвичай може виконувати 1-2 інструкції за цикл, а тактова частота процесора була стабільною близько 3 ГГц протягом останніх 15 років через кінець Деннард Масштабування. Виконання однієї операції висновку GPT-3 без використання будь-якої паралельної архітектури займе близько 350 TFLOPS/(3 ГГц*1 FLOP) або 116,000 32 секунд, або XNUMX години. Це надзвичайно непрактично; замість цього нам потрібні спеціальні мікросхеми, які прискорюють це завдання.

На практиці всі моделі ШІ сьогодні працюють на картах, які використовують дуже велику кількість спеціалізованих ядер. Наприклад, графічний процесор NVIDIA A100 має 512 «тензорних ядер», які можуть виконувати множення матриці 4×4 (що еквівалентно 64 множенням і додаванням, або 128 FLOPS) за один цикл. Карти прискорювачів штучного інтелекту часто називають GPU (графічними процесорами), оскільки архітектура спочатку була розроблена для настільних ігор. У майбутньому ми очікуємо, що штучний інтелект стане окремим сімейством продуктів.

A100 має номінальну продуктивність 312 TFLOPS що теоретично скоротило б висновок для GPT-3 приблизно до 1 секунди. Однак це надто спрощений розрахунок з кількох причин. По-перше, для більшості випадків використання вузьким місцем є не обчислювальна потужність графічного процесора, а здатність отримувати дані зі спеціалізованої графічної пам’яті до тензорних ядер. По-друге, 175 мільярдів ваг займуть 700 ГБ і не помістяться в графічну пам’ять будь-якого GPU. Необхідно використовувати такі методи, як розділення та розподіл ваги. І, по-третє, існує ряд оптимізацій (наприклад, використання коротших представлень із плаваючою комою, таких як FP16, FP8 або розріджених матриць), які використовуються для прискорення обчислень. Але в цілому наведена вище математика дає нам інтуїтивне уявлення про загальну вартість обчислень сучасних LLM.

Навчання трансформаторної моделі займає приблизно втричі більше часу на один токен, ніж виконання висновків. Однак, враховуючи, що навчальний набір даних приблизно в 300 мільйонів разів більший, ніж запит на висновок, навчання займає більше часу в 1 мільярд. На одному GPU навчання займе десятиліття; на практиці це робиться на великих обчислювальних кластерах у виділених центрах обробки даних або, ймовірніше, у хмарі. Навчання також важче розпаралелювати, ніж висновок, оскільки оновлені ваги повинні обмінюватися між вузлами. Пам'ять і пропускна здатність між графічними процесорами часто стають набагато важливішим фактором, причому звичайними є високошвидкісні з'єднання та виділені мережі. Для навчання дуже великих моделей основним завданням може бути створення відповідної мережі. Дивлячись у майбутнє, прискорювачі штучного інтелекту матимуть мережеві можливості на карті чи навіть на чіпі.

Як ця обчислювальна складність перетворюється на вартість? Висновок GPT-3, який, як ми бачили вище, займає приблизно 1 секунду на A100, матиме вартість необробленого обчислення від $0.0002 до $0.0014 за 1,000 токенів (це можна порівняти з ціною OpenAI $0.002/1000 токенів). Користувач, який генерує 100 запитів на висновки на день, коштуватиме приблизно доларів на рік. Це дуже низька ціна, що робить більшість випадків використання текстового ШІ людьми фінансово життєздатними.

Навчання GPT-3, навпаки, набагато дорожчий. Знову ж таки обчислення лише вартості обчислень для 3.14*10^23 FLOPS за наведених вище ставок дає нам оцінку в 560,000 100 доларів США на картах AXNUMX для одиничний тренувальний пробіг. На практиці для навчання ми не отримаємо близько 100% ефективності GPU; однак ми також можемо використовувати оптимізацію, щоб скоротити час навчання. Інші оцінки вартості навчання GPT-3 варіюються від $500,000 до $ 4.6 мільйон залежно від апаратних припущень. Зауважте, що це вартість одного запуску, а не загальна вартість. Ймовірно, знадобиться кілька запусків, і хмарні провайдери захочуть мати довгострокові зобов’язання (докладніше про це нижче). Навчання топ-моделей залишається дорогим, але доступним для добре фінансованого стартапу.

Підводячи підсумок, сьогодні генеративний ШІ вимагає величезних інвестицій в інфраструктуру ШІ. Немає підстав вважати, що це зміниться найближчим часом. Навчання такої моделі, як GPT-3, є одним із найбільш інтенсивних обчислювальних завдань, які коли-небудь виконувало людство. І хоча графічні процесори стають швидшими, і ми знаходимо способи оптимізувати навчання, швидке розширення ШІ зводить нанівець обидва ці ефекти.

Міркування щодо інфраструктури ШІ

До цього моменту ми намагалися дати вам деяке уявлення про масштаб, потрібний для навчання та виведення моделей штучного інтелекту, а також про основні параметри, які ними керують. У цьому контексті ми хочемо надати деякі практичні вказівки щодо того, як вирішити, яку інфраструктуру ШІ використовувати.

Зовнішня проти внутрішньої інфраструктури

Давайте подивимося правді в очі: графічні процесори — це круто. Багато інженерів і засновників, які займаються інженерним мисленням, схильні створювати власне апаратне забезпечення штучного інтелекту не лише тому, що воно дає точний контроль над навчанням моделей, а й тому, що є щось цікаве у використанні великої кількості обчислювальної потужності (експонат А).

Однак реальність така багатьом стартапам — особливо компаніям, що займаються додатками — не потрібно створювати власну інфраструктуру ШІ у день 1. Натомість розміщені сервіси моделей, такі як OpenAI або Hugging Face (для мови) і Replicate (для генерації зображень), дозволяють засновникам швидко шукати продукт, який відповідає ринку, без необхідності керувати основною інфраструктурою чи моделями.

Ці послуги стали настільки хорошими, що багато компаній ніколи не закінчують їх. Розробники можуть досягти суттєвого контролю над продуктивністю моделі за допомогою оперативного проектування та абстракцій тонкого налаштування вищого порядку (тобто тонкого налаштування через виклики API). Ціни на ці послуги залежать від споживання, тому це також часто дешевше, ніж використання окремої інфраструктури. Ми бачили, як компанії, які займаються розробкою додатків, генерують понад 50 мільйонів доларів США ARR і вартістю понад 1 мільярд доларів, які надають послуги розміщеної моделі під капотом.

З іншого боку, деякі стартапи — особливо ті, хто навчає нові базові моделі або створюють вертикально інтегровані додатки ШІ, не можуть уникнути безпосереднього запуску власних моделей на графічних процесорах. Або тому, що модель фактично є продуктом, і команда шукає «відповідність моделі ринку», або тому, що для досягнення певних можливостей або зменшення граничних витрат у великому масштабі потрібен точний контроль над навчанням та/або висновками. У будь-якому випадку управління інфраструктурою може стати джерелом конкурентної переваги.

Побудова хмари проти центру обробки даних

У більшості випадків хмара є правильним місцем для вашої інфраструктури ШІ. Менші початкові витрати, можливість збільшення та зменшення масштабу, регіональна доступність і менше відволікання від створення власного центру обробки даних є переконливими для більшості стартапів і великих компаній.

Але з цього правила є кілька винятків:

- Якщо ви працюєте в дуже великому масштабі, може стати економічніше запустити власний центр обробки даних. Точна ціна залежить від географічного розташування та налаштувань, але зазвичай вимагає витрат на інфраструктуру понад 50 мільйонів доларів на рік.

- Вам потрібне дуже специфічне обладнання, яке ви не можете придбати у хмарного постачальника. Наприклад, типи GPU, які не є широко доступними, а також незвичайні вимоги до пам’яті, пам’яті чи мережі.

- Ви не можете знайти хмару, прийнятну з геополітичних міркувань.

Якщо ви все-таки хочете побудувати власний центр обробки даних, для ваших власних налаштувань було проведено комплексний аналіз ціни та продуктивності графічних процесорів (наприклад, Аналіз Тіма Деттмера). Окрім вартості та продуктивності самої карти, вибір апаратного забезпечення також залежить від потужності, простору та охолодження. Наприклад, дві карти RTX 3080 Ti разом мають таку саму необроблену обчислювальну потужність, як і A100, але відповідне енергоспоживання становить 700 Вт проти 300 Вт. Різниця в потужності в 3,500 кВт-год за ринковою ставкою 0.10 дол./кВт-год протягом трирічного життєвого циклу збільшує вартість RTX3080 Ti майже вдвічі (приблизно 2 дол. США).

З огляду на це, ми очікуємо, що переважна більшість стартапів використовуватиме хмарні обчислення.

Порівняння постачальників хмарних послуг

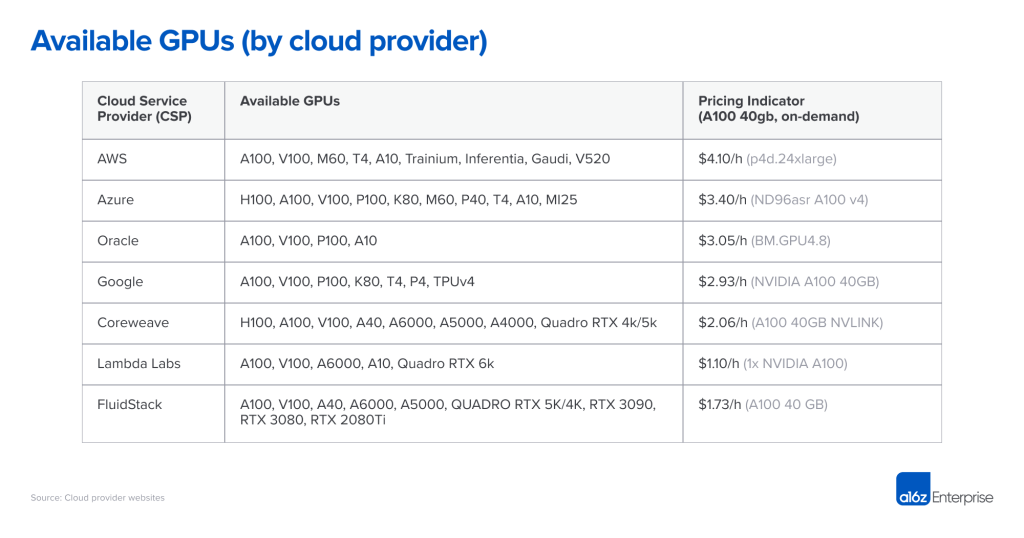

Веб-сервіси Amazon (AWS), Microsoft Azure та Google Cloud Platform (GCP) пропонують екземпляри GPU, але нові постачальники також, здається, зосереджуються саме на робочих навантаженнях ШІ. Ось структура, яку ми бачили, як багато засновників використовують для вибору хмарного постачальника:

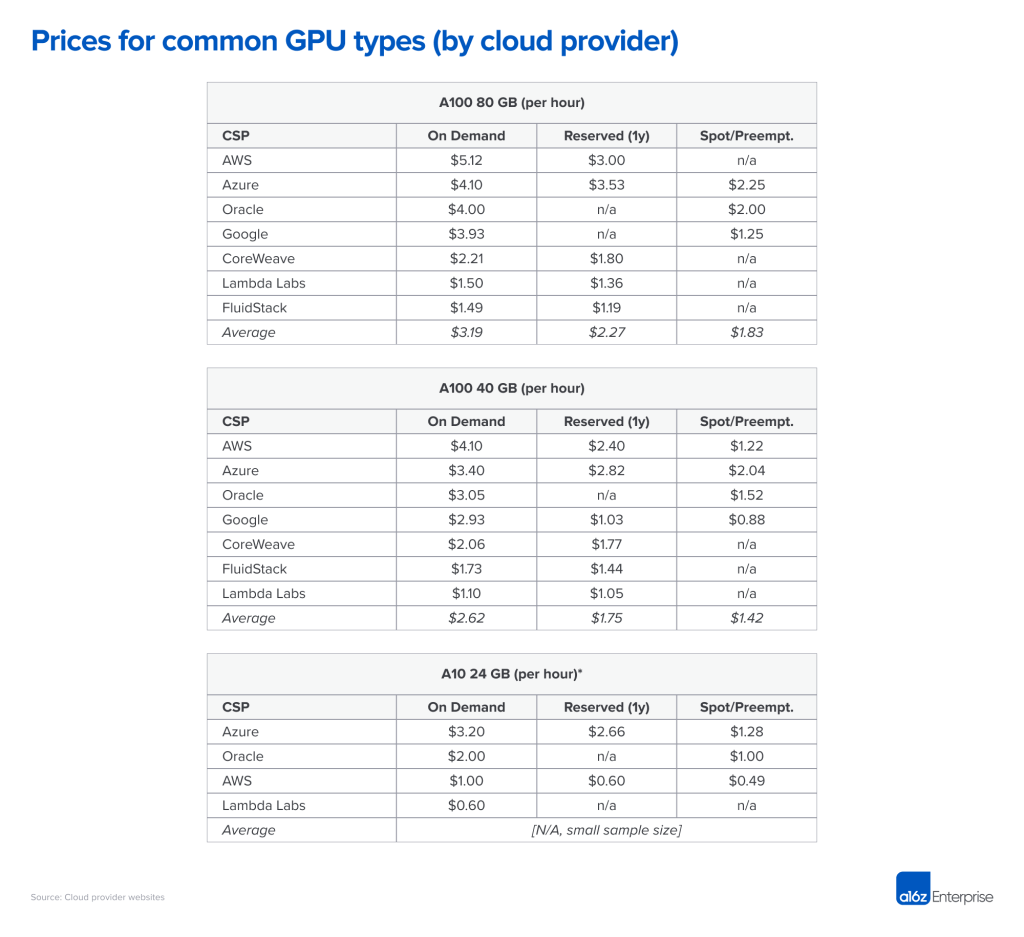

Ціна: У таблиці нижче наведено ціни на низку основних і менших спеціальних хмар станом на 7 квітня 2023 року. Ці дані є лише орієнтовними, оскільки екземпляри суттєво різняться з точки зору пропускної здатності мережі, витрат на вихід даних, додаткових витрат від ЦП і мережі, доступних знижки та інші фактори.

Обчислювальна потужність на певному обладнанні є товаром. Наївно ми очікували б досить однакових цін, але це не так. І хоча існують суттєві відмінності у функціях між хмарами, їх недостатньо, щоб пояснити, що ціни на NVIDIA A100 на вимогу різняться між постачальниками майже в 4 рази.

У верхній частині шкали цін великі публічні хмари стягують премію на основі репутації бренду, перевіреної надійності та необхідності керувати широким діапазоном робочих навантажень. Менші спеціалізовані постачальники штучного інтелекту пропонують нижчі ціни, або за допомогою спеціально створених центрів обробки даних (наприклад, Coreweave), або за допомогою арбітражу інших хмар (наприклад, Lambda Labs).

Практично кажучи, більшість великих покупців домовляються про ціни безпосередньо з постачальниками хмарних технологій, часто зобов’язуючись дотримуватися певних мінімальних витрат, а також мінімальних часових зобов’язань (ми бачили 1-3 роки). Різниця в ціні між хмарами дещо зменшується після переговорів, але ми бачимо, що рейтинг у таблиці вище залишається відносно стабільним. Важливо також відзначити, що невеликі компанії можуть отримати агресивні ціни від спеціальних хмар без великих витрат.

наявність: Найпотужніші графічні процесори (наприклад, Nvidia A100) постійно були дефіцитом протягом останніх 12 з гаком місяців.

Було б логічно вважати, що три найкращі хмарні провайдери мають найкращу доступність, враховуючи їх високу купівельну спроможність і об’єднання ресурсів. Але, як не дивно, багато стартапів не виявили, що це правда. Великі хмари мають багато апаратного забезпечення, але також мають задовольнити значні потреби клієнтів (наприклад, Azure є основним хостом для ChatGPT) і постійно додають/здають в оренду потужності для задоволення попиту. Тим часом Nvidia взяла на себе зобов’язання зробити апаратне забезпечення широко доступним у всій галузі, включаючи виділення для нових спеціалізованих постачальників. (Вони роблять це як для чесності, так і для того, щоб зменшити свою залежність від кількох великих клієнтів, які також конкурують з ними.)

У результаті багато стартапів знаходять більше доступних чіпів, у тому числі передову Nvidia H100, у менших хмарних постачальників. Якщо ви бажаєте співпрацювати з новішою інфраструктурною компанією, можливо, ви зможете скоротити час очікування на обладнання та, можливо, заощадити гроші в процесі.

Модель доставки обчислень: Великі хмари сьогодні пропонують лише екземпляри з виділеними графічними процесорами, тому причина в тому, що віртуалізація GPU досі залишається невирішеною проблемою. Спеціалізовані хмари штучного інтелекту пропонують інші моделі, такі як контейнери або пакетні завдання, які можуть виконувати окремі завдання без витрат на запуск і демонтаж екземпляра. Якщо вам подобається ця модель, це може істотно знизити вартість.

Мережеві з'єднання: Для навчання, зокрема, пропускна здатність мережі є основним фактором у виборі провайдера. Для навчання певних великих моделей потрібні кластери з виділеними структурами між вузлами, наприклад NVLink. Для створення зображень плата за вихідний трафік також може бути основним фактором витрат.

Підтримка клієнтів: Великі хмарні постачальники обслуговують величезну кількість клієнтів із тисячами артикулів продуктів. Може бути важко привернути увагу служби підтримки або вирішити проблему, якщо ви не великий клієнт. З іншого боку, багато спеціалізованих хмар ШІ пропонують швидку та оперативну підтримку навіть для невеликих клієнтів. Частково це пояснюється тим, що вони працюють у меншому масштабі, а також тому, що їхні робочі навантаження більш однорідні, тому вони більше стимулюються зосереджуватися на функціях і помилках, характерних для ШІ.

Порівняння GPU

За інших рівних умов топові графічні процесори працюватимуть найкраще майже на всіх робочих навантаженнях. Однак, як ви можете бачити в таблиці нижче, найкраще обладнання також є значно дорожчим. Вибір правильного типу графічного процесора для вашої конкретної програми може істотно знизити витрати та може змінити життєздатну та нежиттєздатну бізнес-модель.

Рішення про те, як далеко опуститися у списку, тобто визначення найбільш економічно ефективного вибору графічного процесора для вашої програми, є переважно технічним рішенням, яке виходить за рамки цієї статті. Але нижче ми поділимося деякими критеріями відбору, які ми бачили як найважливіші:

Навчання проти висновку: Як ми бачили в першому розділі вище, навчання моделі Transformer вимагає від нас зберігати 8 байт даних для навчання на додаток до ваг моделі. Це означає, що типовий споживчий графічний процесор високого класу з 12 ГБ пам’яті навряд чи можна використовувати для навчання моделі з 4 мільярдами параметрів. На практиці навчання великих моделей виконується на кластерах машин із переважно багатьма графічними процесорами на сервер, великою кількістю відеопам’яті та з’єднаннями з високою пропускною здатністю між серверами (тобто кластери, побудовані з використанням графічних процесорів топового центру обробки даних).

Зокрема, багато моделей будуть найбільш рентабельними на NVIDIA H100, але на сьогоднішній день її важко знайти, і зазвичай потрібно довгострокове зобов’язання більше ніж на рік. NVIDIA A100 виконує більшість моделей навчання сьогодні; його легше знайти, але для великих кластерів також може знадобитися довгострокове зобов’язання.

Вимоги до пам'яті: Великі LLM мають надто високу кількість параметрів, щоб поміститися в будь-яку картку. Їх потрібно розділити на кілька карток і вимагають налаштування, подібного до навчання. Іншими словами, вам, ймовірно, знадобляться H100 або A100 навіть для висновків LLM. Але менші моделі (наприклад, Stable Diffusion) потребують набагато менше VRAM. Хоча A100 все ще популярний, ми бачили, як стартапи використовують карти A10, A40, A4000, A5000 і A6000 або навіть RTX.

Підтримка обладнання: Хоча переважна більшість робочих навантажень у компаніях, з якими ми говорили, працюють на NVIDIA, деякі почали експериментувати з іншими постачальниками. Найпоширенішим є Google TPU, але Gaudi 2 від Intel, схоже, також набуває популярності. Проблема з цими постачальниками полягає в тому, що продуктивність вашої моделі часто сильно залежить від наявності програмної оптимізації для цих мікросхем. Ймовірно, вам доведеться зробити PoC, щоб зрозуміти продуктивність.

Вимоги до затримки: Загалом робочі навантаження з меншою затримкою (наприклад, пакетна обробка даних або програми, які не вимагають інтерактивних відповідей інтерфейсу користувача) можуть використовувати менш потужні графічні процесори. Це може зменшити витрати на обчислення в 3-4 рази (наприклад, порівняння A100s з A10s на AWS). З іншого боку, додаткам, орієнтованим на користувачів, часто потрібні картки найвищого класу, щоб забезпечити привабливу взаємодію з користувачем у режимі реального часу. Оптимізація моделей часто необхідна, щоб привести витрати до керованого діапазону.

колючий: Компанії, які займаються створенням штучного інтелекту, часто спостерігають різке зростання попиту, оскільки ця технологія є такою новою та захоплюючою. Незвичайним є те, що обсяги запитів збільшуються в 10 разів на день, залежно від випуску нового продукту, або постійно зростають на 50% на тиждень. Упоратися з цими стрибками часто легше на графічних процесорах нижчого класу, оскільки на вимогу, швидше за все, доступно більше обчислювальних вузлів. Також часто має сенс обслуговувати цей тип трафіку за допомогою дешевших ресурсів — за рахунок продуктивності — якщо він надходить від менш залучених або менш утримуючих користувачів.

Моделі оптимізації та планування

Оптимізація програмного забезпечення може значно вплинути на час роботи моделей — і 10-кратний приріст не є рідкістю. Однак вам потрібно буде визначити, які методи будуть найбільш ефективними для вашої конкретної моделі та системи.

Деякі техніки працюють із досить широким діапазоном моделей. Використання коротших представлень із плаваючою комою (наприклад, FP16 або FP8 порівняно з оригінальним FP32) або квантування (INT8, INT4, INT2) досягає прискорення, яке часто є лінійним із зменшенням бітів. Іноді це вимагає модифікації моделі, але все більше доступних технологій автоматизують роботу зі змішаною або меншою точністю. Відсікання нейронних мереж зменшує кількість ваг, ігноруючи ваги з низькими значеннями. Разом із ефективним множенням розріджених матриць це може досягти значного прискорення сучасних графічних процесорів. Інший набір методів оптимізації вирішує вузьке місце пропускної здатності пам’яті (наприклад, вагові коефіцієнти потокової моделі).

Інші оптимізації дуже залежать від моделі. Наприклад, Stable Diffusion досяг значного прогресу в обсязі VRAM, необхідному для висновків. Ще один клас оптимізацій залежить від апаратного забезпечення. TensorML від NVIDIA містить низку оптимізацій, але працюватиме лише на апаратному забезпеченні NVIDIA. І останнє, але не менш важливе: планування завдань штучного інтелекту може створити значні обмеження продуктивності або покращення. Розподіл моделей між графічним процесором таким чином, щоб мінімізувати зміну ваг, вибір найкращого графічного процесора для завдання, якщо доступно кілька, і мінімізація часу простою шляхом попереднього пакетування робочих навантажень є поширеними методами.

Зрештою, оптимізація моделі все ще є чорною магією, і більшість стартапів, з якими ми спілкуємося, співпрацюють із третіми сторонами, щоб допомогти з деякими з цих аспектів програмного забезпечення. Часто це не традиційні постачальники MLops, а компанії, які спеціалізуються на оптимізації для конкретних генеративних моделей (наприклад, OctoML або SegMind).

Як змінюватиметься вартість інфраструктури ШІ?

Протягом останніх кількох років ми спостерігали експоненціальне зростання обох параметри моделі та Обчислювальна потужність GPU. Незрозуміло, чи збережеться ця тенденція.

Сьогодні широко визнано, що існує залежність між оптимальною кількістю параметрів і розміром набору навчальних даних (див. Deepmind шиншила працювати над цим більше). Найкращі магістратури сьогодні навчаються на Загальне сканування (набір із 4.5 мільярдів веб-сторінок, або близько 10% усіх існуючих веб-сторінок). Навчальний корпус також включає Вікіпедію та колекцію книг, хоча обидві набагато менші (загальна кількість існуючих книг оцінюється в лише близько 100 млн). Були запропоновані й інші ідеї, як-от транскрибування відео чи аудіовмісту, але жодна з них не наближається за розміром. Незрозуміло, чи зможемо ми отримати несинтетичний навчальний набір даних, який у 10 разів перевищує той, який уже використовувався.

Продуктивність GPU продовжуватиме зростати, але також повільніше. Закон Мура залишається недоторканим, що дозволяє використовувати більше транзисторів і ядер, але потужність і введення/виведення стають обмежуючими факторами. Крім того, було зібрано багато низькорослих плодів для оптимізації.

Однак це не означає, що ми не очікуємо зростання попиту на обчислювальну потужність. Навіть якщо зростання моделі та навчального набору сповільниться, зростання індустрії штучного інтелекту та збільшення кількості розробників штучного інтелекту сприятимуть попиту на більше та швидші графічні процесори. Велика частина потужності графічного процесора використовується розробниками для тестування на етапі розробки моделі, і цей попит лінійно масштабується залежно від кількості персоналу. Немає жодних ознак того, що дефіцит GPU, який ми маємо сьогодні, зменшиться найближчим часом.

Чи створить незмінна висока вартість інфраструктури штучного інтелекту рів, який унеможливить новим учасникам наздогнати добре фінансованих лідерів? Ми ще не знаємо відповіді на це питання. Вартість навчання LLM сьогодні може виглядати як рів, але моделі з відкритим кодом, такі як Alpaca або Stable Diffusion, показали, що ці ринки ще на ранніх етапах і можуть швидко змінитися. З часом структура витрат на новий стек програмного забезпечення ШІ (див. наш попередній пост) може почати виглядати більше як традиційна індустрія програмного забезпечення.

Зрештою, це було б добре: історія показала, що це призводить до живих екосистем із швидкими інноваціями та багатьма можливостями для засновників підприємців.

Дякую Мойн Надім і Шангда Сю за їхній внесок і керівництво під час написання.

¹ Інтуїція полягає в тому, що для будь-якого параметра (тобто ваги) у нейронній мережі операція виведення (тобто передача вперед) повинна виконувати дві операції з плаваючою комою для кожного параметра. По-перше, він множить значення вхідного вузла нейронної мережі на параметр. По-друге, він додає результат підсумовування до вихідного вузла нейронної мережі. Параметри в кодувальнику використовуються один раз на вхідний маркер, а параметри в декодері використовуються один раз на вихідний маркер. Якщо ми припустимо, що модель має p параметри, вхід і вихід мають довжину n лексеми, загальна кількість операцій з плаваючою комою n * p. Існує багато інших операцій (наприклад, нормалізація, кодування/декодування вбудовування), які відбуваються в моделі, але час, потрібний для їх виконання, порівняно малий.

² Спочатку для навчання потрібен прохід вперед через трансформатор, як описано вище, після чого слід прохід назад, який вимагає чотирьох додаткових операцій для кожного параметра для обчислення градієнта та регулювання ваги. Зауважте, що обчислення градієнта вимагає збереження обчислених значень вузла з прямого проходу. Для GPT-3, Мовні моделі - це малозабезпечені учні обговорює вартість навчання.

* * *

Погляди, висловлені тут, є поглядами окремих співробітників AH Capital Management, LLC («a16z»), які цитуються, і не є поглядами a16z або його філій. Певна інформація, що міститься тут, була отримана зі сторонніх джерел, зокрема від портфельних компаній фондів, якими керує a16z. Хоча отримано з джерел, які вважаються надійними, a16z не перевіряв таку інформацію незалежно та не робить жодних заяв щодо тривалої точності інформації чи її відповідності певній ситуації. Крім того, цей вміст може містити рекламу третіх сторін; a16z не переглядав такі оголошення та не схвалює будь-який рекламний вміст, що міститься в них.

Цей вміст надається лише в інформаційних цілях, і на нього не можна покладатися як на юридичну, ділову, інвестиційну чи податкову консультацію. Ви повинні проконсультуватися з власними радниками щодо цих питань. Посилання на будь-які цінні папери чи цифрові активи наведено лише з метою ілюстрації та не є інвестиційною рекомендацією чи пропозицією надати інвестиційні консультаційні послуги. Крім того, цей вміст не призначений для будь-яких інвесторів чи потенційних інвесторів і не призначений для використання ними, і за жодних обставин на нього не можна покладатися при прийнятті рішення інвестувати в будь-який фонд, яким керує a16z. (Пропозиція інвестувати у фонд a16z буде зроблена лише на підставі меморандуму про приватне розміщення, угоди про підписку та іншої відповідної документації будь-якого такого фонду, і її слід читати повністю.) Будь-які інвестиційні чи портфельні компанії, згадані, згадані або описані не є репрезентативними для всіх інвестицій у транспортні засоби, якими керує a16z, і не може бути гарантії, що інвестиції будуть прибутковими або що інші інвестиції, здійснені в майбутньому, матимуть подібні характеристики чи результати. Список інвестицій, здійснених фондами під управлінням Andreessen Horowitz (за винятком інвестицій, щодо яких емітент не надав дозволу a16z на оприлюднення, а також неоголошених інвестицій у публічні цифрові активи) доступний за адресою https://a16z.com/investments /.

Наведені в ньому діаграми та графіки призначені виключно для інформаційних цілей, і на них не слід покладатися під час прийняття інвестиційних рішень. Минулі результати не вказують на майбутні результати. Зміст відповідає лише вказаній даті. Будь-які прогнози, оцінки, прогнози, цілі, перспективи та/або думки, висловлені в цих матеріалах, можуть бути змінені без попередження та можуть відрізнятися або суперечити думкам, висловленим іншими. Додаткову важливу інформацію можна знайти на сторінці https://a16z.com/disclosures.

- Розповсюдження контенту та PR на основі SEO. Отримайте посилення сьогодні.

- PlatoAiStream. Web3 Data Intelligence. Розширення знань. Доступ тут.

- Карбування майбутнього з Адріенн Ешлі. Доступ тут.

- джерело: https://a16z.com/2023/04/27/navigating-the-high-cost-of-ai-compute/

- : має

- :є

- : ні

- 1 млрд доларів

- $UP

- 000

- 1

- 100

- 116

- 15 роки

- 2023

- 500

- 7

- 8

- a

- a16z

- здатність

- Здатний

- МЕНЮ

- вище

- абсолют

- прискорювати

- прискорювач

- прискорювачі

- прийнятний

- прийнятий

- доступ

- точність

- точний

- Achieve

- через

- додати

- доповнення

- Додатковий

- Додатково

- доповнення

- адреси

- Додає

- просування

- аванси

- Перевага

- реклама

- рада

- консультативний

- консультативні послуги

- впливати

- Філії

- після

- знову

- агресивний

- Угода

- AI

- алгоритмічний

- ВСІ

- асигнувань

- Дозволити

- вже

- Також

- хоча

- серед

- кількість

- суми

- an

- аналіз

- та

- Андрієссен

- Андреессен Горовиц

- Інший

- відповідь

- Очікуваний

- будь-який

- API

- додаток

- з'являються

- з'являється

- додаток

- застосування

- приблизно

- додатка

- квітня

- архітектура

- ЕСТЬ

- аргумент

- навколо

- Art

- стаття

- штучний

- штучний інтелект

- AS

- аспекти

- Активи

- гарантія

- At

- увагу

- аудіо

- автоматизувати

- наявність

- доступний

- середній

- уникнути

- AWS

- Лазурний

- ширина смуги

- заснований

- BE

- оскільки

- ставати

- стає

- становлення

- було

- буття

- Вірити

- вважається,

- нижче

- КРАЩЕ

- Краще

- між

- За

- зміщення

- Великий

- Мільярд

- Біт

- Black

- книги

- бум

- обидва

- Кордон

- марка

- Перерва

- приносити

- широкий

- широко

- помилки

- будувати

- Створюємо

- побудований

- бізнес

- бізнес-модель

- але

- покупців

- by

- обчислювати

- розрахований

- розрахунок

- Виклики

- CAN

- Може отримати

- не може

- можливості

- потужність

- капітал

- карта

- Cards

- випадок

- випадків

- Залучайте

- Центр

- Центри

- певний

- виклик

- зміна

- характеристика

- символи

- заряд

- ChatGPT

- більш дешевий

- чіп

- Чіпси

- вибір

- Вибирати

- обставин

- клас

- ясно

- годинник

- близько

- хмара

- хмарних обчислень

- Хмарна платформа

- збір

- Приходити

- приходить

- зручний

- зобов'язання

- вчинено

- здійснення

- товар

- загальний

- Компанії

- компанія

- порівняний

- порівняння

- порівняння

- переконливий

- конкурувати

- конкурентоспроможний

- складність

- всеосяжний

- обчислення

- обчислення

- обчислення

- обчислювальна потужність

- Зв'язки

- розгляду

- міркування

- постійно

- складати

- споживати

- споживач

- споживання

- Контейнери

- зміст

- контекст

- продовжувати

- триває

- навпаки

- контроль

- Прохолодно

- Core

- Коштувати

- рентабельним

- витрати

- може

- Курс

- створювати

- створення

- Критерії

- В даний час

- клієнт

- підтримка клієнтів

- Клієнти

- передовий

- цикл

- дані

- Центр обробки даних

- центрів обробки даних

- обробка даних

- набір даних

- Database

- Дата

- день

- десятиліття

- вирішувати

- рішення

- присвячених

- Deepmind

- доставляти

- доставка

- Попит

- залежність

- залежний

- Залежно

- залежить

- описаний

- робочий стіл

- Визначати

- визначення

- розвиненою

- розробників

- розробка

- відрізняються

- різниця

- Відмінності

- радіомовлення

- цифровий

- Цифрові активи

- безпосередньо

- Розкрити

- знижки

- чіткий

- do

- документація

- робить

- справи

- доларів

- зроблений

- Не знаю

- вниз

- час простою

- драматично

- управляти

- водій

- водіння

- два

- під час

- e

- Рано

- легше

- легко

- екосистеми

- Ефективний

- фактично

- ефекти

- ефективність

- ефективний

- або

- вбудовування

- з'являються

- кінець

- схвалювати

- витривалий

- зайнятий

- залучення

- Машинобудування

- Інженери

- цілісність

- що входить

- підприємницький

- Еквівалент

- особливо

- по суті

- оцінити

- оцінка

- Оцінки

- Навіть

- НІКОЛИ

- еволюціонувати

- приклад

- перевищує

- захоплюючий

- виключення

- виконувати

- виконання

- існувати

- розширення

- очікувати

- дорогий

- досвід

- Пояснювати

- експонентний

- експоненціальне зростання

- виражений

- надзвичайно

- тканину

- Face

- фактори

- ярмарок

- достатньо

- сім'я

- ШВИДКО

- швидше

- особливість

- риси

- Інформація про оплату

- кілька

- фінансово

- знайти

- кінець

- Перший

- відповідати

- фіксованою

- Flip

- плаваючий

- Сфокусувати

- потім

- для

- Прогнози

- На щастя

- Вперед

- знайдений

- фонд

- засновники

- чотири

- фракція

- Рамки

- від

- Паливо

- веселощі

- фонд

- засоби

- Крім того

- майбутнє

- прибуток

- азартні ігри

- Загальне

- породжує

- покоління

- генеративний

- Генеративний ШІ

- географічний

- геополітичний

- отримати

- отримання

- Давати

- даний

- дає

- Go

- добре

- Google Cloud

- Google Cloud Platform

- GPU

- Графічні процесори

- випускник

- графіка

- графіки

- Рости

- Зростання

- керівництво

- рука

- обробляти

- Обробка

- траплятися

- Жорсткий

- апаратні засоби

- Запрягання

- Мати

- чисельність персоналу

- почутий

- допомога

- корисний

- тут

- Високий

- Висококласний

- дуже

- історія

- капот

- З надією

- Горовіц

- господар

- відбувся

- ГОДИННИК

- Як

- How To

- Однак

- HTML

- HTTPS

- величезний

- Величезно

- Людей

- i

- ідеї

- if

- зображення

- Негайний

- важливо

- неможливе

- поліпшення

- in

- В інших

- заохочений

- включати

- includes

- У тому числі

- Augmenter

- Збільшує

- все більше і більше

- самостійно

- зазначений

- індивідуальний

- промисловість

- інформація

- Інформаційний

- Інфраструктура

- інновація

- вхід

- екземпляр

- замість

- інструкції

- інтегрований

- Інтелект

- інтерактивний

- в

- Invest

- інвестиції

- інвестиційні консультації

- інвестиції

- Інвестори

- Емітент

- IT

- ЙОГО

- сам

- Джобс

- просто

- тримати

- Дитина

- Знати

- Labs

- ландшафт

- мова

- великий

- в значній мірі

- більше

- останній

- Затримка

- закон

- Веде за собою

- вивчення

- легальний

- довжина

- життя

- як

- Ймовірно

- список

- Лама

- LLM

- розташування

- логічний

- Довго

- довгостроковий

- довше

- подивитися

- виглядає як

- шукати

- серія

- низький

- знизити

- найнижчий

- Машинки для перманенту

- made

- основний

- Більшість

- зробити

- РОБОТИ

- Робить

- управляти

- вдалося

- управління

- управління

- людство

- багато

- ринок

- ринки

- масивний

- Матеріали

- математики

- Матриця

- Питання

- макс-ширина

- Може..

- значущим

- засоби

- Між тим

- Зустрічатися

- Меморандум

- пам'ять

- згаданий

- методика

- Microsoft

- Microsoft Azure

- мільйона

- мінімізація

- мінімальний

- змішаний

- MLOps

- модель

- Моделі

- сучасний

- гроші

- місяців

- більше

- найбільш

- Найбільш популярний

- багато

- множинний

- множення

- навігація

- Близько

- майже

- необхідно

- Необхідність

- необхідний

- потреби

- мережу

- мережа

- мереж

- нейронної мережі

- нейронні мережі

- Нові

- новий продукт

- новини

- наступний

- немає

- вузол

- вузли

- Зверніть увагу..

- зараз

- номер

- номера

- Nvidia

- отримувати

- отриманий

- of

- пропонувати

- пропонує

- часто

- on

- On-Demand

- один раз

- ONE

- онлайн

- тільки

- відкрити

- з відкритим вихідним кодом

- OpenAI

- операційний

- операція

- операції

- Думки

- Можливості

- оптимальний

- оптимізація

- Оптимізувати

- оптимізований

- оптимізуючий

- or

- порядок

- оригінал

- спочатку

- Інше

- інші

- наші

- з

- вихід

- випереджає

- над

- загальний

- власний

- Паралельні

- параметр

- параметри

- приватність

- Сторони

- частини

- проходити

- Минуле

- Виконувати

- продуктивність

- дозвіл

- Персонал

- фаза

- вибирати

- підібраний

- місце

- платформа

- plato

- Інформація про дані Платона

- PlatoData

- будь ласка

- PoC

- точка

- басейн

- популярний

- портфель

- можливо

- пошта

- влада

- потужний

- Практичний

- практика

- Точність

- Premium

- попередній

- price

- ціни

- ціни без прихованих комісій

- первинний

- приватний

- ймовірно

- Проблема

- проблеми

- процес

- обробка

- процесор

- Product

- прибутковий

- Прогнози

- власність

- передбачуваний

- перспективи

- доведений

- забезпечувати

- за умови

- Постачальник

- провайдери

- громадськість

- публічно

- покупка

- цілей

- питання

- швидко

- R & D

- піднятий

- діапазон

- Ранжування

- швидко

- швидко

- ставка

- ставки

- Сировина

- досягати

- Читати

- реального часу

- Реальність

- причина

- Причини

- Рекомендація

- зменшити

- знижує

- посилання

- називають

- регіональний

- відносини

- щодо

- звільнити

- доречний

- надійність

- надійний

- допомога

- залишатися

- залишається

- представник

- шановний

- репутація

- запросити

- запитів

- вимагати

- вимагається

- вимога

- Вимога

- Вимагається

- ресурси

- ті

- реагувати

- результат

- результати

- відгуки

- RTX

- RTX 3080

- RTX 3080 Ti

- Правило

- прогін

- біг

- Зазначений

- то ж

- зберегти

- шкала

- ваги

- планування

- сфера

- Пошук

- Грати короля карти - безкоштовно Nijumi логічна гра гри

- другий

- seconds

- розділ

- Securities

- побачити

- бачив

- вибір

- сенс

- чутливий

- окремий

- Послідовність

- служити

- Сервери

- обслуговування

- Послуги

- комплект

- установка

- кілька

- Поділитись

- Короткий

- нестача

- Повинен

- показаний

- Шоу

- сторона

- підпис

- аналогічний

- просто

- з

- один

- ситуація

- Розмір

- розміри

- сповільнюється

- невеликий

- менше

- So

- так далеко

- Софтвер

- Вирішує

- деякі

- що в сім'ї щось

- кілька

- Source

- Джерела

- Простір

- розмова

- Говорить

- спеціалізуватися

- спеціалізований

- Спеціальність

- конкретний

- конкретно

- витрачати

- Витрати

- шипи

- розкол

- стабільний

- стек

- старт

- Пуск в експлуатацію

- почалася

- Стартапи

- Як і раніше

- зберігання

- зберігати

- потоковий

- структура

- тема

- передплата

- істотний

- успіх

- такі

- підходящий

- підсумовувати

- поставка

- підтримка

- система

- таблиця

- Приймати

- приймає

- балаканина

- цілі

- Завдання

- завдання

- податок

- команда

- технічний

- методи

- Технології

- Технологія

- terms

- Тестування

- ніж

- Що

- Команда

- Майбутнє

- інформація

- Пейзаж

- їх

- Їх

- Там.

- в ньому

- Ці

- вони

- річ

- думати

- Мислення

- третій

- треті сторони

- третя сторона

- це

- ті

- тисячі

- три

- через

- Зв'язаний

- час

- times

- до

- сьогодні

- сьогоднішній

- разом

- знак

- Токенізація

- Жетони

- занадто

- топ

- Усього:

- до

- тяги

- торгував

- традиційний

- трафік

- поїзд

- навчений

- Навчання

- Трансформатори

- переводити

- Trend

- намагався

- трильйон

- правда

- два

- тип

- Типи

- типовий

- типово

- ui

- Uncommon

- при

- що лежить в основі

- розуміти

- створеного

- одиниць

- оновлений

- на

- us

- використання

- використання випадку

- використовуваний

- користувач

- User Experience

- користувачі

- використання

- зазвичай

- Цінний

- значення

- цінний

- Цінності

- різноманітність

- величезний

- Транспортні засоби

- постачальники

- перевірено

- вертикально

- дуже

- viable

- вібруючий

- Відео

- думки

- Обсяги

- vs

- чекати

- хотіти

- було

- шлях..

- способи

- we

- Web

- веб-сервіси

- week

- вага

- ДОБРЕ

- Що

- коли

- який

- в той час як

- ВООЗ

- широкий

- Широкий діапазон

- широко

- Вікіпедія

- волі

- готовий

- з

- в

- без

- слово

- слова

- Work

- робочий

- б

- лист

- рік

- років

- ще

- Ти

- вашу

- зефірнет