Створення платформи операцій машинного навчання (MLOps) у середовищі штучного інтелекту (AI) і машинного навчання (ML) для організацій, що швидко розвивається, має важливе значення для плавного подолання розриву між науковими експериментами з даними та розгортанням, одночасно відповідаючи вимогам щодо продуктивності моделі, безпеки та відповідності.

Для того, щоб виконати нормативні вимоги та вимоги відповідності, ключовими вимогами при проектуванні такої платформи є:

- Адресний дрейф даних

- Відстежуйте продуктивність моделі

- Сприяти автоматичному перенавчанню моделі

- Надайте процес затвердження моделі

- Зберігайте моделі в безпечному середовищі

У цій публікації ми покажемо, як створити фреймворк MLOps для задоволення цих потреб, використовуючи комбінацію служб AWS і наборів інструментів сторонніх розробників. Рішення передбачає встановлення кількох середовищ із автоматизованим перенавчанням моделі, пакетним висновком і моніторингом за допомогою Монітор моделі Amazon SageMaker, версії моделі с Реєстр моделей SageMaker, а також конвеєр CI/CD для сприяння просуванню коду ML і конвеєрів у різних середовищах за допомогою Amazon SageMaker, Amazon EventBridge, Служба простих сповіщень Amazon (Amazon S3), HashiCorp Terraform, GitHub та Дженкінс CI/CD. Ми будуємо модель для прогнозування тяжкості (доброякісної чи злоякісної) мамографічного масового ураження, навченого за допомогою Алгоритм XGBoost за допомогою загальнодоступних UCI Мамографія Мас набір даних і розгорнути його за допомогою інфраструктури MLOps. Повні інструкції з кодом доступні в GitHub сховище.

Огляд рішення

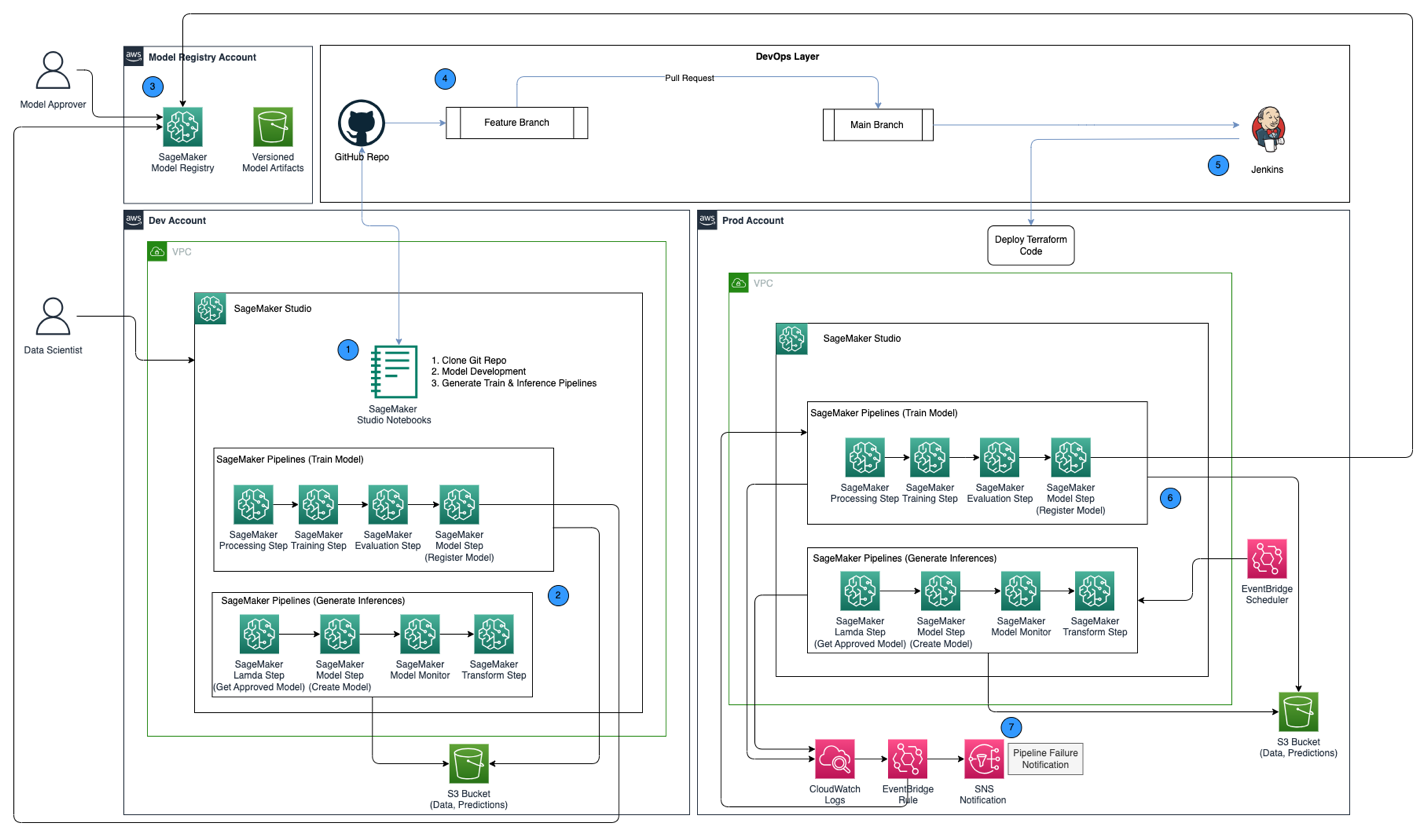

На наступній діаграмі архітектури показано огляд структури MLOps із такими ключовими компонентами:

- Стратегія кількох акаунтів – Два різних середовища (dev і prod) налаштовано в двох різних облікових записах AWS відповідно до найкращих практик AWS Well-Architected, а третій обліковий запис налаштовано в центральному реєстрі моделі:

- Середовище для розробників – Де ан Домен Amazon SageMaker Studio налаштовано, щоб дозволити розробку моделі, навчання моделі та тестування конвеєрів ML (навчання та висновок), перш ніж модель буде готова до просування у вищих середовищах.

- Продуктове середовище – Де конвеєри машинного навчання від розробника просуваються як перший крок, плануються та контролюються з часом.

- Центральний модельний реєстр - Реєстр моделей Amazon SageMaker налаштовано в окремому обліковому записі AWS для відстеження версій моделей, згенерованих у середовищах розробки та виробництва.

- CI/CD і керування джерелом – Розгортання конвеєрів ML у різних середовищах здійснюється за допомогою CI/CD, налаштованого за допомогою Jenkins, а також керування версіями через GitHub. Зміни коду, об’єднані з відповідною гілкою git середовища, запускають робочий процес CI/CD для внесення відповідних змін у задане цільове середовище.

- Пакетні прогнози з моніторингом моделі – Конвеєр виведення, побудований за допомогою Трубопроводи Amazon SageMaker виконується за розкладом для створення прогнозів разом із моніторингом моделі за допомогою SageMaker Model Monitor для виявлення дрейфу даних.

- Автоматизований механізм перенавчання – Навчальний конвеєр, створений за допомогою SageMaker Pipelines, запускається щоразу, коли в конвеєрі виведення виявляється дрейф даних. Після навчання модель реєструється в центральному реєстрі моделей для затвердження особою, яка затверджує модель. Після схвалення оновлена версія моделі використовується для створення прогнозів через конвеєр висновків.

- Інфраструктура як код – Інфраструктура як код (IaC), створена за допомогою HashiCorp Terraform, підтримує планування конвеєра виведення за допомогою EventBridge, запуск конвеєра поїзда на основі Правило EventBridge і надсилання сповіщень за допомогою Служба простих сповіщень Amazon (Amazon SNS) Теми.

Робочий процес MLOps включає такі кроки:

- Отримайте доступ до домену SageMaker Studio в обліковому записі розробки, клонуйте репозиторій GitHub, пройдіть процес розробки моделі за допомогою наданої моделі зразка та згенеруйте конвеєри навчання та висновків.

- Запустіть конвеєр підготовки в обліковому записі розробки, який генерує артефакти моделі для навченої версії моделі та реєструє модель у реєстрі моделей SageMaker в обліковому записі центрального реєстру моделей.

- Підтвердьте модель у реєстрі моделей SageMaker в обліковому записі центрального реєстру моделей.

- Надішліть код (конвеєри тренувань і висновків, а також код Terraform IaC для створення розкладу EventBridge, правила EventBridge і теми SNS) у гілку функцій репозиторію GitHub. Створіть запит на отримання, щоб об’єднати код у основну гілку репозиторію GitHub.

- Запустіть конвеєр Jenkins CI/CD, який налаштовано за допомогою репозиторію GitHub. Конвеєр CI/CD розгортає код в обліковому записі prod для створення конвеєрів навчання та висновків разом із кодом Terraform для надання розкладу EventBridge, правила EventBridge і теми SNS.

- Конвеєр виведення заплановано на щоденну роботу, тоді як конвеєр потягу налаштовано на запуск щоразу, коли виявляється дрейф даних з конвеєра виведення.

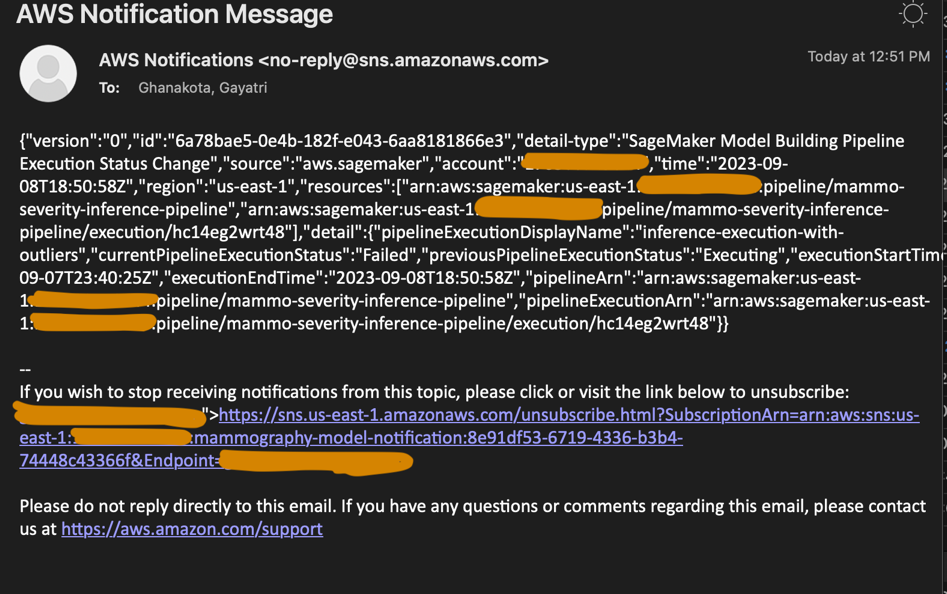

- Повідомлення надсилаються через тему SNS щоразу, коли виникає збій у потягу або конвеєрі висновку.

Передумови

Для цього рішення у вас повинні бути такі передумови:

- Три облікові записи AWS (облікові записи реєстру dev, prod і central model)

- Домен SageMaker Studio, налаштований у кожному з трьох облікових записів AWS (див Підключення до Amazon SageMaker Studio або подивіться відео Швидко перейдіть до Amazon SageMaker Studio для інструкцій з налаштування)

- Jenkins (ми використовуємо Jenkins 2.401.1) з правами адміністратора, встановленими на AWS

- Terraform версії 1.5.5 або новішої, встановленої на сервері Jenkins

Для цієї посади ми працюємо в us-east-1 Регіон для розгортання рішення.

Надання ключів KMS в облікових записах dev і prod

Наш перший крок – створити Служба управління ключами AWS (AWS KMS) ключі в облікових записах dev і prod.

Створіть ключ KMS в обліковому записі розробника та надайте доступ до облікового запису prod

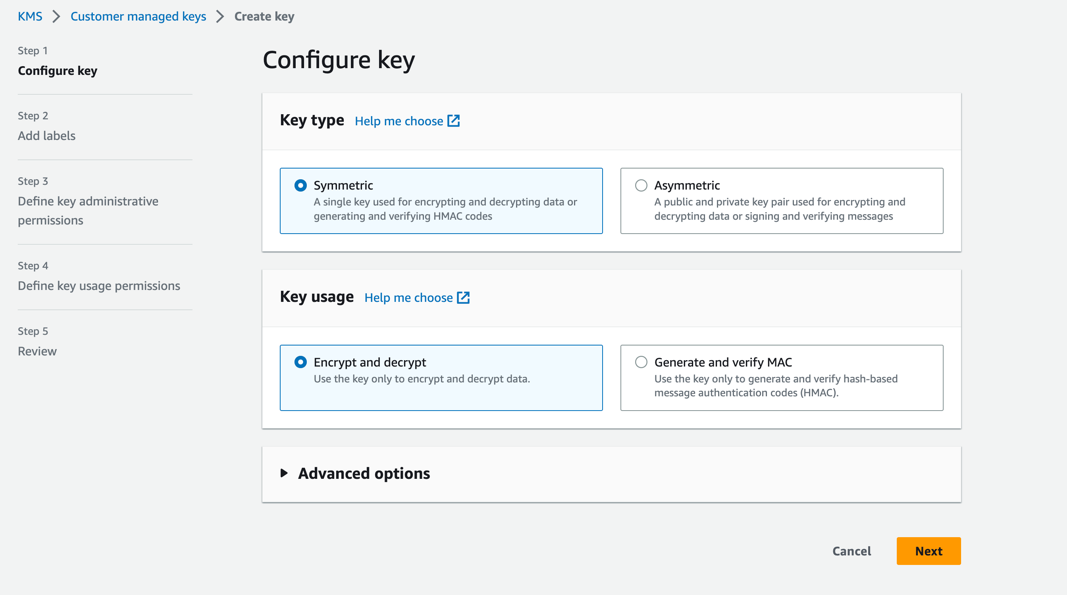

Щоб створити ключ KMS в обліковому записі розробника, виконайте такі дії:

- На консолі AWS KMS виберіть Ключі, керовані клієнтом у навігаційній панелі.

- Вибирати Створити ключ.

- для Тип ключавиберіть Симетричний.

- для Використання ключавиберіть Шифрувати і розшифровувати.

- Вибирати МАЙБУТНІ.

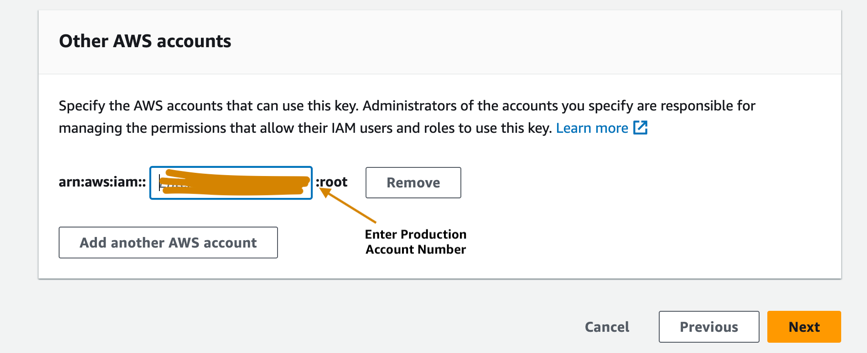

- Введіть номер робочого облікового запису, щоб надати робочому обліковому запису доступ до ключа KMS, наданого в обліковому записі розробника. Це обов’язковий крок, оскільки під час першого навчання моделі в обліковому записі розробника артефакти моделі шифруються за допомогою ключа KMS перед записом у сегмент S3 в обліковому записі центрального реєстру моделі. Робочому обліковому запису потрібен доступ до ключа KMS, щоб розшифрувати артефакти моделі та запустити конвеєр висновку.

- Вибирати МАЙБУТНІ і закінчіть створення ключа.

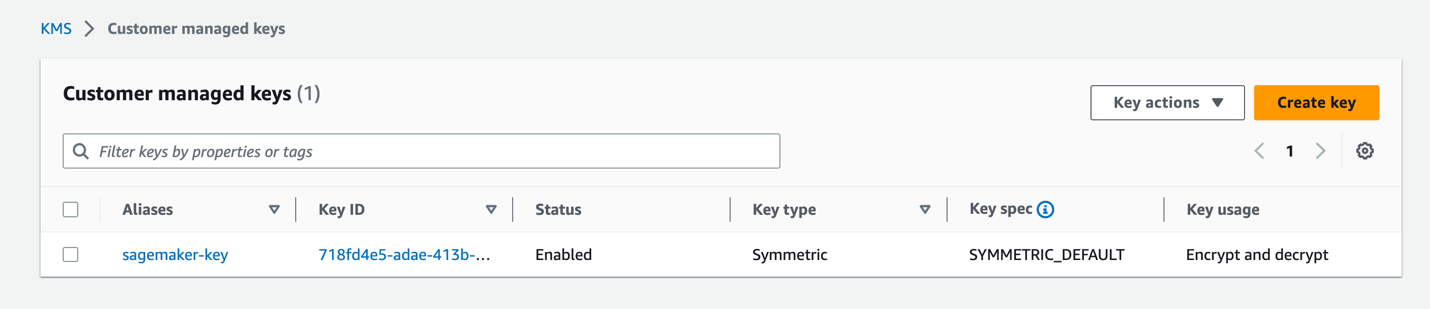

Після надання ключа він має бути видимим на консолі AWS KMS.

Створіть ключ KMS в обліковому записі prod

Виконайте ті самі кроки, що й у попередньому розділі, щоб створити керований клієнтом ключ KMS в обліковому записі prod. Ви можете пропустити крок, щоб надати доступ до ключа KMS іншому обліковому запису.

Налаштуйте відро артефактів моделі S3 в обліковому записі центрального реєстру моделей

Створіть відро S3 за вашим вибором за допомогою рядка sagemaker у домовленості про іменування як частину назви сегмента в обліковому записі реєстру центральної моделі та оновіть політику сегмента на сегменті S3, щоб надати дозволи обліковим записам dev і prod на читання та записування артефактів моделі в контейнер S3.

Наступний код — це політика сегментів, яку потрібно оновити на сегменті S3:

Налаштуйте ролі IAM у своїх облікових записах AWS

Наступний крок – налаштування Управління ідентифікацією та доступом AWS (IAM) у ваших облікових записах AWS із дозволами для AWS Lambda, SageMaker і Jenkins.

Роль виконання Lambda

Створювати Ролі виконання Lambda в облікових записах dev і prod, які використовуватимуться функцією Lambda, запущеною як частина SageMaker Pipelines Lambda step. Цей крок виконуватиметься з конвеєра висновків, щоб отримати останню затверджену модель, за допомогою якої створено висновки. Створіть ролі IAM в облікових записах dev і prod відповідно до умов іменування arn:aws:iam::<account-id>:role/lambda-sagemaker-role і додайте такі політики IAM:

- Політика 1 – Створіть вбудовану політику під назвою

cross-account-model-registry-access, який надає доступ до пакета моделі, налаштованого в реєстрі моделі в центральному обліковому записі: - Політика 2 – Приєднати AmazonSageMakerFullAccess, що є ан Керована політика AWS який надає повний доступ до SageMaker. Він також надає вибірковий доступ до пов’язаних служб, наприклад Автоматичне масштабування програми AWS, Amazon S3, Реєстр контейнерів Amazon Elastic (Amazon ECR), і Журнали Amazon CloudWatch.

- Політика 3 – Приєднати AWSLambda_FullAccess, яка є керованою політикою AWS, яка надає повний доступ до Lambda, функцій консолі Lambda та інших пов’язаних служб AWS.

- Політика 4 – Використовуйте таку політику довіри IAM для ролі IAM:

Роль виконання SageMaker

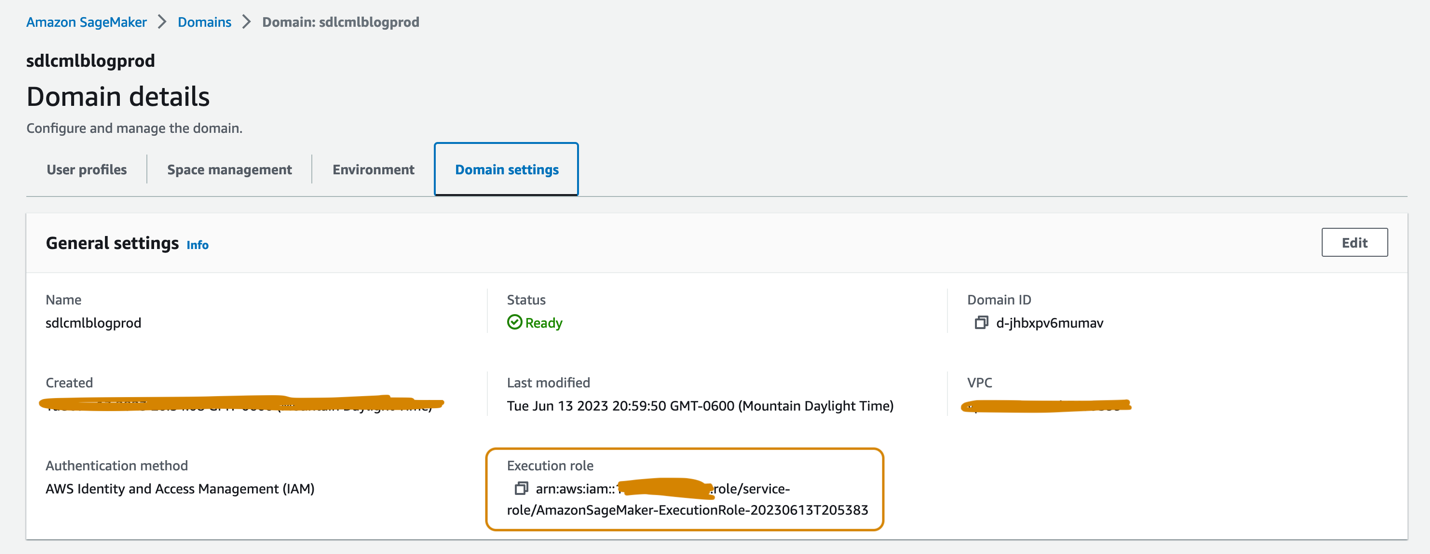

Домени SageMaker Studio, налаштовані в облікових записах dev і prod, повинні мати пов’язану роль виконання, яку можна знайти на настройки домену на сторінці відомостей про домен, як показано на наступному знімку екрана. Ця роль використовується для виконання завдань навчання, завдань обробки тощо в домені SageMaker Studio.

Додайте такі політики до ролі виконання SageMaker в обох облікових записах:

- Політика 1 – Створіть вбудовану політику під назвою

cross-account-model-artifacts-s3-bucket-access, який надає доступ до відра S3 в обліковому записі центрального реєстру моделі, де зберігаються артефакти моделі: - Політика 2 – Створіть вбудовану політику під назвою

cross-account-model-registry-access, який надає доступ до пакета моделі в реєстрі моделей в обліковому записі центрального реєстру моделей: - Політика 3 – Створіть вбудовану політику під назвою

kms-key-access-policy, який надає доступ до ключа KMS, створеного на попередньому кроці. Укажіть ідентифікатор облікового запису, у якому створюється політика, і ідентифікатор ключа KMS, створений у цьому обліковому записі. - Політика 4 – Приєднати AmazonSageMakerFullAccess, що є ан Керована політика AWS який надає повний доступ до SageMaker і вибірковий доступ до пов’язаних служб.

- Політика 5 – Приєднати AWSLambda_FullAccess, яка є керованою політикою AWS, яка надає повний доступ до Lambda, функцій консолі Lambda та інших пов’язаних служб AWS.

- Політика 6 – Приєднати CloudWatchEventsFullAccess, що є керованою політикою AWS, яка надає повний доступ до подій CloudWatch.

- Політика 7 – Додайте таку політику довіри IAM для ролі IAM виконання SageMaker:

- Політика 8 (специфічна для ролі виконання SageMaker в обліковому записі prod) – Створіть вбудовану політику під назвою

cross-account-kms-key-access-policy, який надає доступ до ключа KMS, створеного в обліковому записі розробника. Це потрібно для того, щоб конвеєр висновків читав артефакти моделі, що зберігаються в обліковому записі центрального реєстру моделі, де артефакти моделі зашифровано за допомогою ключа KMS з облікового запису розробника, коли перша версія моделі створюється з облікового запису розробника.

Роль Дженкінса між обліковими записами

Налаштуйте роль IAM під назвою cross-account-jenkins-role в обліковому записі prod, який Дженкінс припускає для розгортання конвеєрів машинного навчання та відповідної інфраструктури в обліковому записі prod.

Додайте такі керовані політики IAM до ролі:

CloudWatchFullAccessAmazonS3FullAccessAmazonSNSFullAccessAmazonSageMakerFullAccessAmazonEventBridgeFullAccessAWSLambda_FullAccess

Оновіть довірчі відносини для ролі, щоб надати дозволи обліковому запису AWS, на якому розміщено сервер Jenkins:

Оновіть дозволи для ролі IAM, пов’язаної з сервером Jenkins

Якщо припустити, що Jenkins налаштовано на AWS, оновіть роль IAM, пов’язану з Jenkins, щоб додати такі політики, які нададуть Jenkins доступ для розгортання ресурсів в обліковому записі prod:

- Політика 1 – Створіть таку вбудовану політику під назвою

assume-production-role-policy: - Політика 2 – Прикріпити

CloudWatchFullAccessкерована політика IAM.

Налаштуйте групу пакетів моделей в обліковому записі центрального реєстру моделей

У домені SageMaker Studio в обліковому записі центрального реєстру моделей створіть групу пакетів моделі під назвою mammo-severity-model-package за допомогою наступного фрагмента коду (який можна запустити за допомогою блокнота Jupyter):

Налаштуйте доступ до пакета моделі для ролей IAM в облікових записах dev і prod

Надання доступу до ролей виконання SageMaker, створених в облікових записах dev і prod, щоб ви могли реєструвати версії моделі в пакеті моделі mammo-severity-model-package в центральному реєстрі моделей з обох облікових записів. З домену SageMaker Studio в обліковому записі реєстру центральної моделі запустіть такий код у блокноті Jupyter:

Налаштуйте Jenkins

У цьому розділі ми налаштовуємо Jenkins для створення конвеєрів ML і відповідної інфраструктури Terraform в обліковому записі prod через конвеєр Jenkins CI/CD.

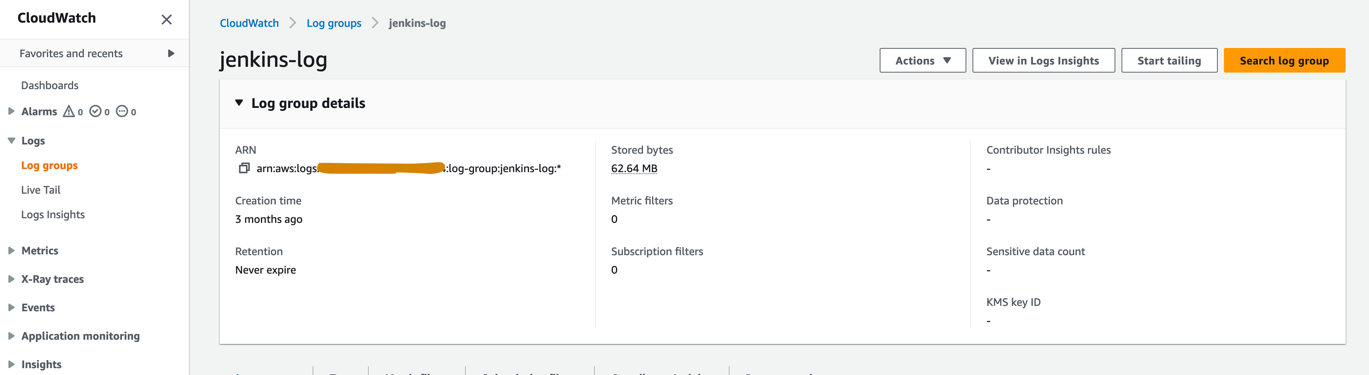

- На консолі CloudWatch створіть групу журналів під назвою

jenkins-logв обліковому записі prod, до якого Дженкінс надсилатиме журнали з конвеєра CI/CD. Групу журналу слід створити в тому самому регіоні, де налаштовано сервер Jenkins.

- Встановіть наступні плагіни на вашому сервері Jenkins:

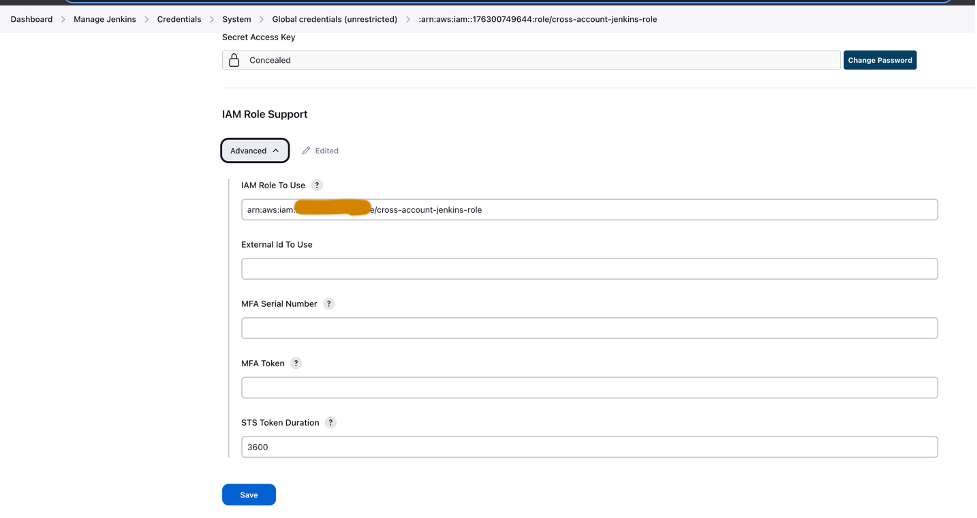

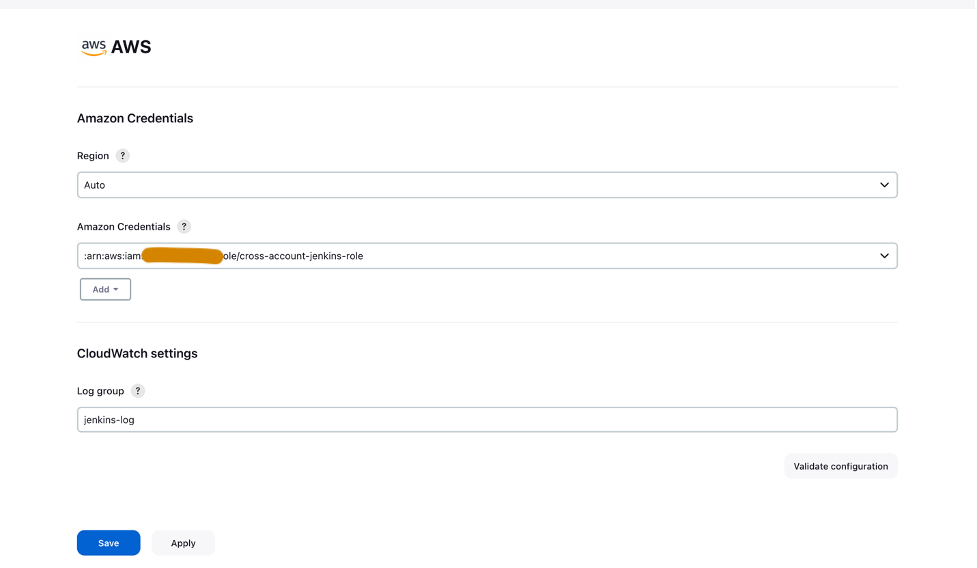

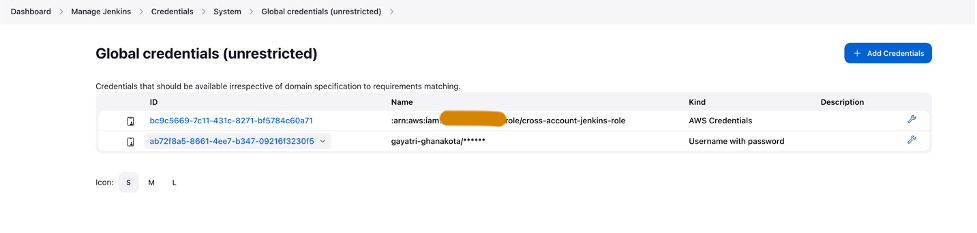

- Налаштуйте облікові дані AWS у Jenkins за допомогою ролі IAM для кількох облікових записів (

cross-account-jenkins-role), надані в обліковому записі продукту.

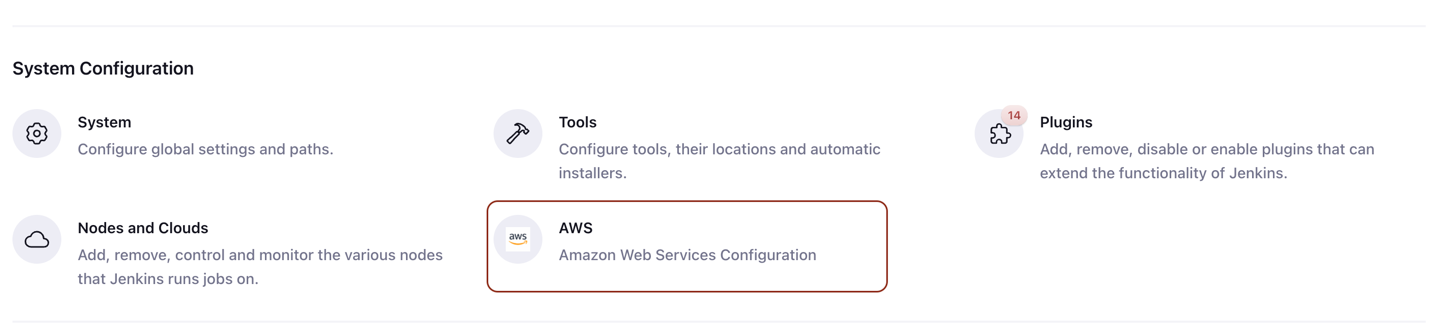

- для Конфігурація системивиберіть AWS.

- Надайте облікові дані та групу журналу CloudWatch, яку ви створили раніше.

- Налаштуйте облікові дані GitHub у Jenkins.

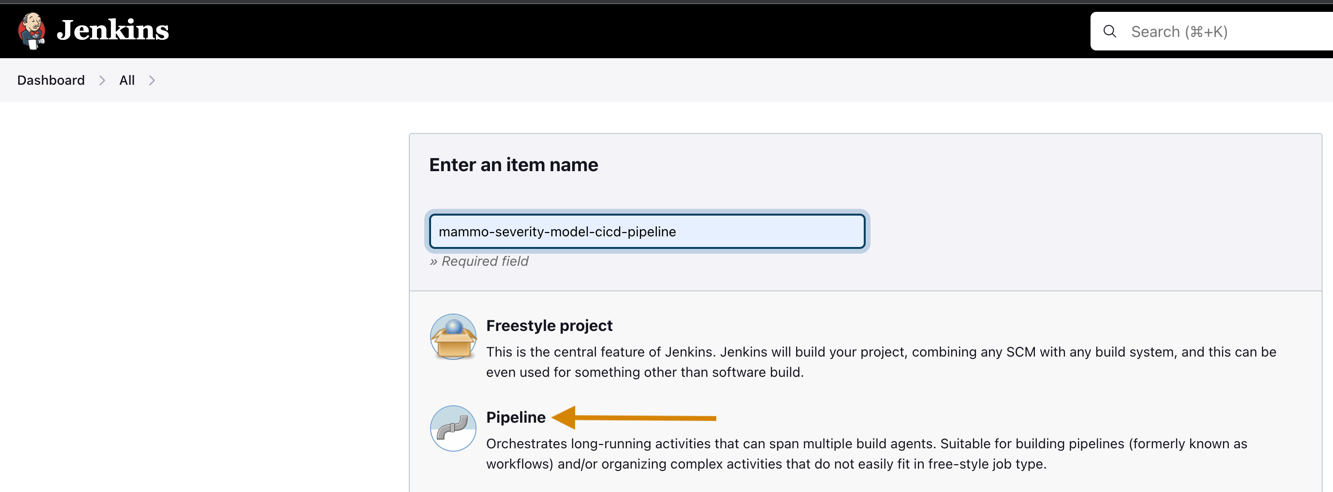

- Створіть новий проект у Jenkins.

- Введіть назву проекту та виберіть Трубопровід.

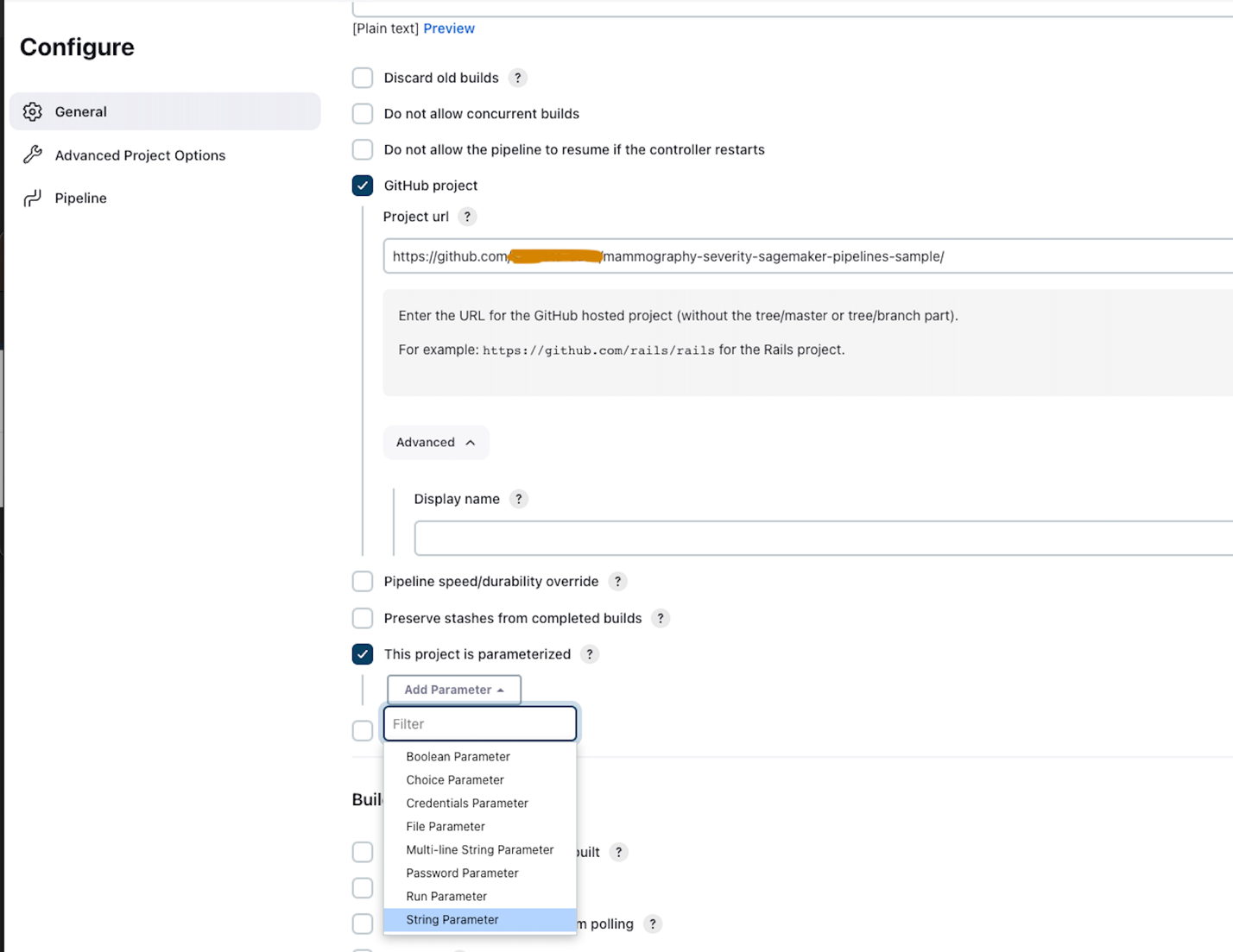

- на Загальне вкладка, виберіть Проект GitHub і введіть роздвоєний GitHub сховище URL-адреса.

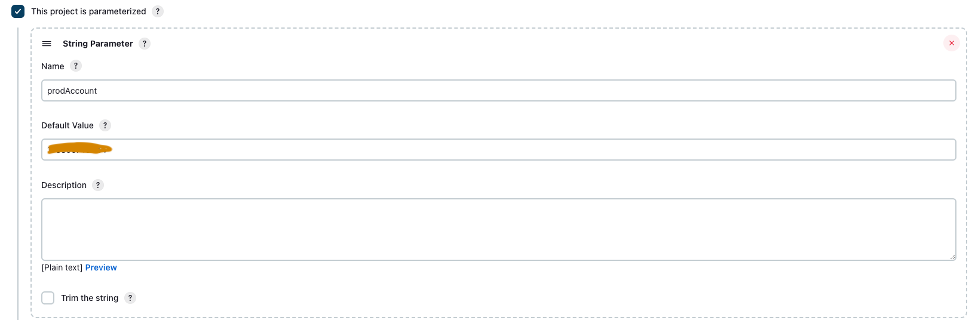

- Select Цей проект є параметризованим.

- на Додати параметр меню, виберіть Рядковий параметр.

- для ІМ'Я, введіть

prodAccount. - для Значення за замовчуванням, введіть ідентифікатор облікового запису prod.

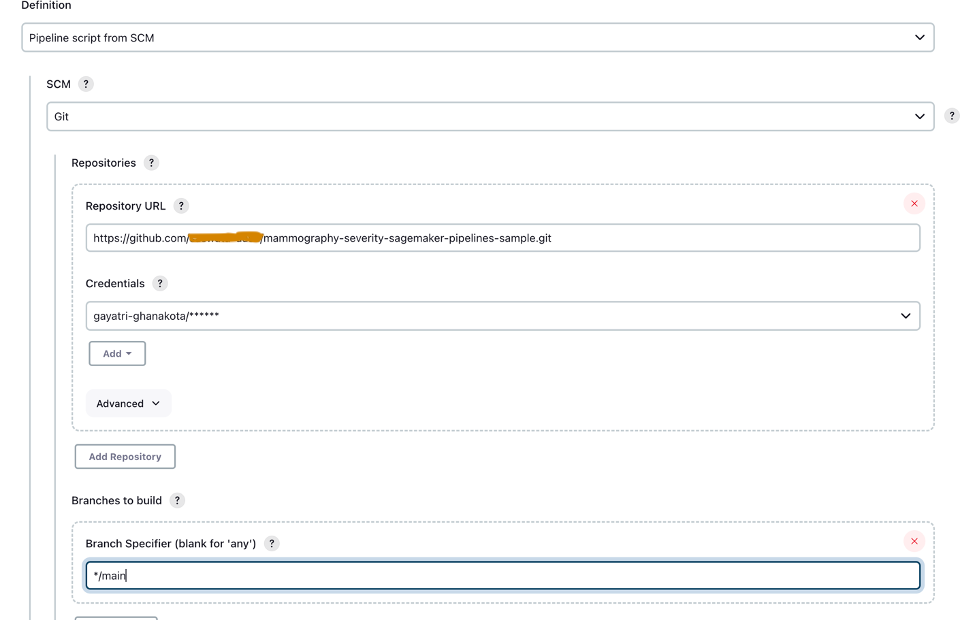

- під Розширені параметри проекту, Для Визначеннявиберіть Конвеєрний скрипт від SCM.

- для SCMвиберіть Git.

- для URL-адреса сховища, введіть роздвоєний GitHub сховище URL-адреса.

- для Повноваження, введіть облікові дані GitHub, збережені в Jenkins.

-

Що натомість? Створіть віртуальну версію себе у

mainв Гілки будувати розділ, на основі якого буде запущено конвеєр CI/CD.

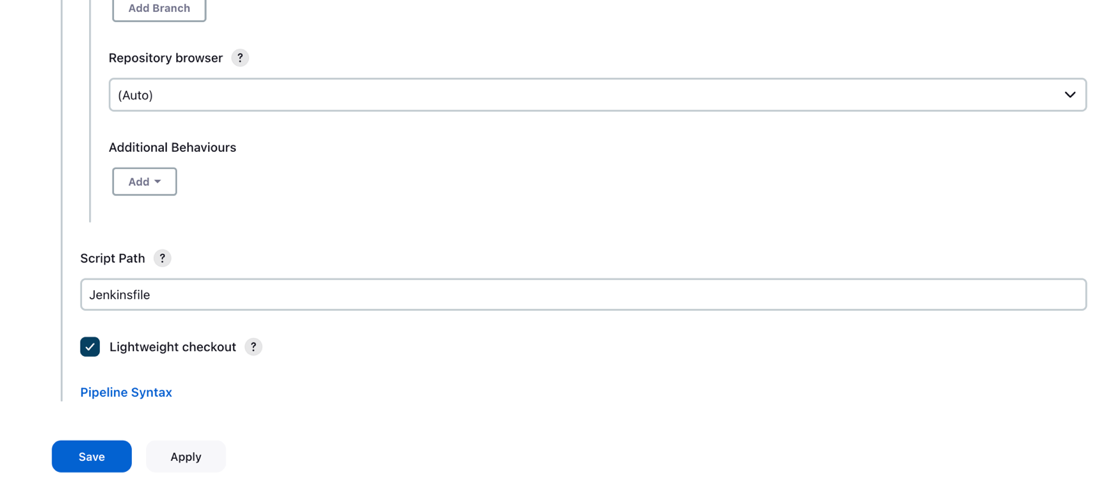

- для Шлях сценарію, введіть

Jenkinsfile. - Вибирати зберегти.

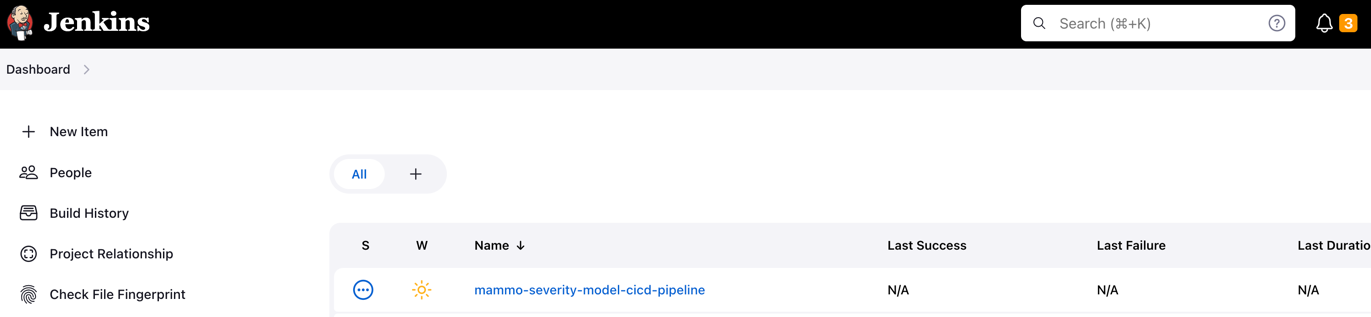

Конвеєр Jenkins має бути створений і видимий на панелі інструментів.

Надання сегментів S3, збір і підготовка даних

Виконайте такі дії, щоб налаштувати сегменти та дані S3:

- Створіть відро S3 за вашим вибором за допомогою рядка

sagemakerу домовленості про найменування як частину назви сегмента в облікових записах dev і prod для зберігання наборів даних і артефактів моделі. - Налаштуйте відро S3 для підтримки стану Terraform в обліковому записі prod.

- Завантажте та збережіть загальнодоступні UCI Мамографія Мас набір даних у сегмент S3, який ви створили раніше в обліковому записі розробника.

- Форк і клон GitHub сховище у домені SageMaker Studio в обліковому записі розробника. Репо має таку структуру папок:

- /environments – сценарій конфігурації для середовища prod

- /mlops-infra – Код для розгортання сервісів AWS за допомогою коду Terraform

- /трубопроводи – Код для компонентів конвеєра SageMaker

- Jenkinsfile – Сценарій для розгортання через конвеєр Jenkins CI/CD

- setup.py – Необхідно для встановлення необхідних модулів Python і створення команди run-pipeline

- mammography-severity-modeling.ipynb – Дозволяє створювати та запускати робочий процес ML

- Створіть папку під назвою data в папці клонованого сховища GitHub і збережіть копію загальнодоступної UCI Мамографія Мас набір даних.

- Дотримуйтесь зошита Юпітера

mammography-severity-modeling.ipynb. - Запустіть наведений нижче код у блокноті, щоб попередньо обробити набір даних і завантажити його в сегмент S3 в обліковому записі розробника:

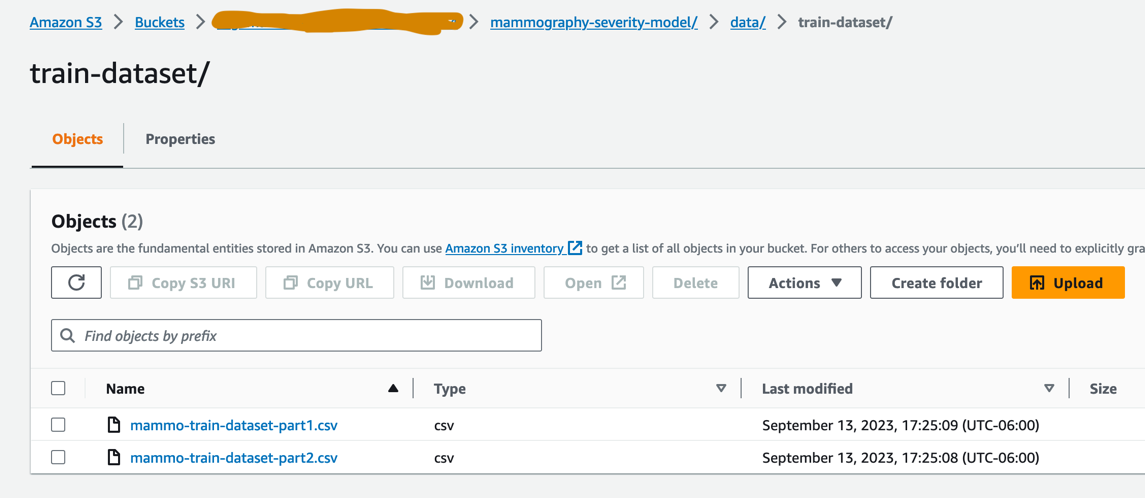

Код створить такі набори даних:

-

- дані/ mammo-train-dataset-part1.csv – Використовуватиметься для навчання першої версії моделі.

- дані/ mammo-train-dataset-part2.csv – Використовуватиметься для навчання другої версії моделі разом із набором даних mammo-train-dataset-part1.csv.

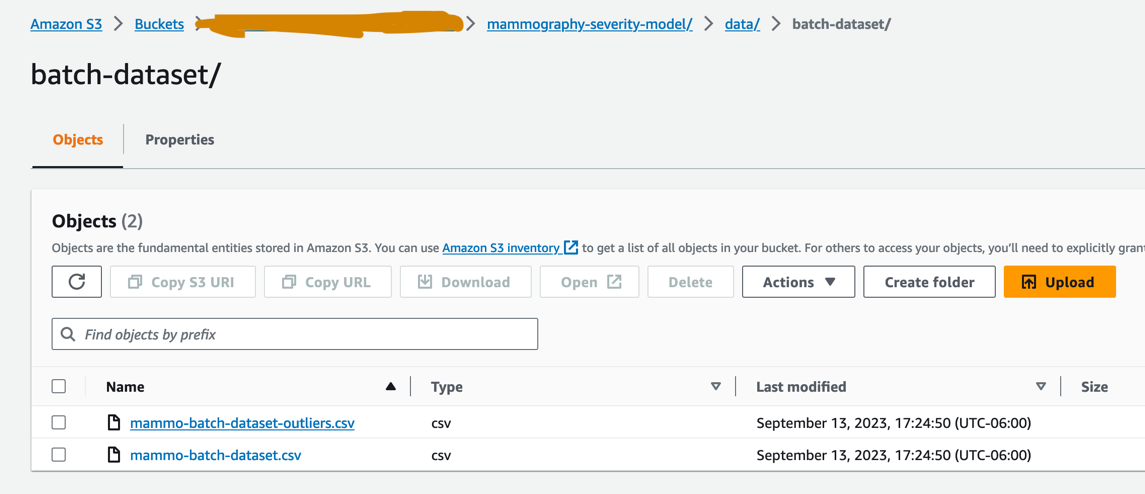

- data/mammo-batch-dataset.csv – Використовуватиметься для створення висновків.

- data/mammo-batch-dataset-outliers.csv – Буде вводити викиди в набір даних, щоб порушити конвеєр висновку. Це дозволить нам протестувати шаблон, щоб запустити автоматичне перенавчання моделі.

- Завантажте набір даних

mammo-train-dataset-part1.csvпід префіксомmammography-severity-model/train-datasetі завантажте набори данихmammo-batch-dataset.csvтаmammo-batch-dataset-outliers.csvдо префіксаmammography-severity-model/batch-datasetвідра S3, створеного в обліковому записі розробника: - Завантажте набори даних

mammo-train-dataset-part1.csvтаmammo-train-dataset-part2.csvпід префіксомmammography-severity-model/train-datasetу відро S3, створене в обліковому записі prod через консоль Amazon S3.

- Завантажте набори даних

mammo-batch-dataset.csvтаmammo-batch-dataset-outliers.csvдо префіксаmammography-severity-model/batch-datasetвідра S3 в обліковому записі прод.

Проведіть залізничний трубопровід

під <project-name>/pipelines/train, ви можете побачити такі сценарії Python:

- scripts/raw_preprocess.py – Інтегрується з SageMaker Processing для розробки функцій

- scripts/evaluate_model.py – У цьому випадку дозволяє розрахувати метрики моделі

auc_score - train_pipeline.py – Містить код конвеєра навчання моделі

Виконайте такі дії:

- Завантажте сценарії в Amazon S3:

- Отримайте екземпляр train pipeline:

- Надішліть конвеєр поїзда та запустіть його:

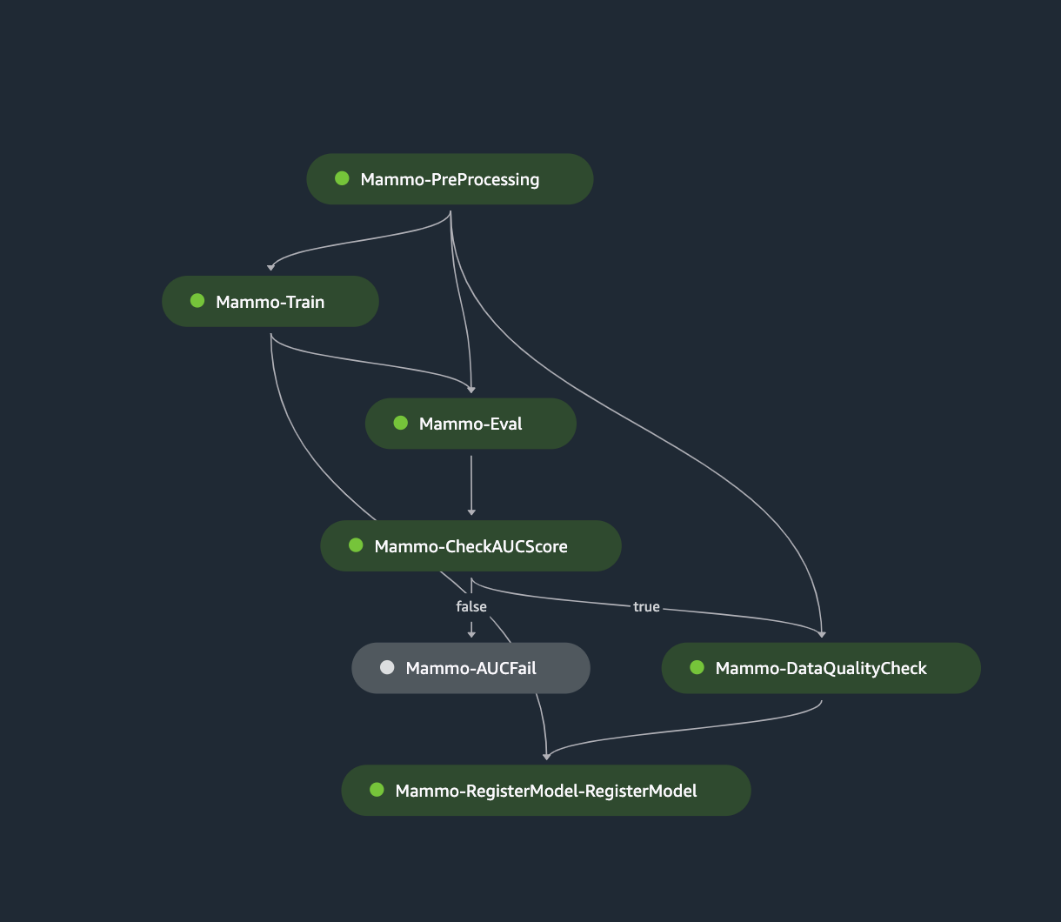

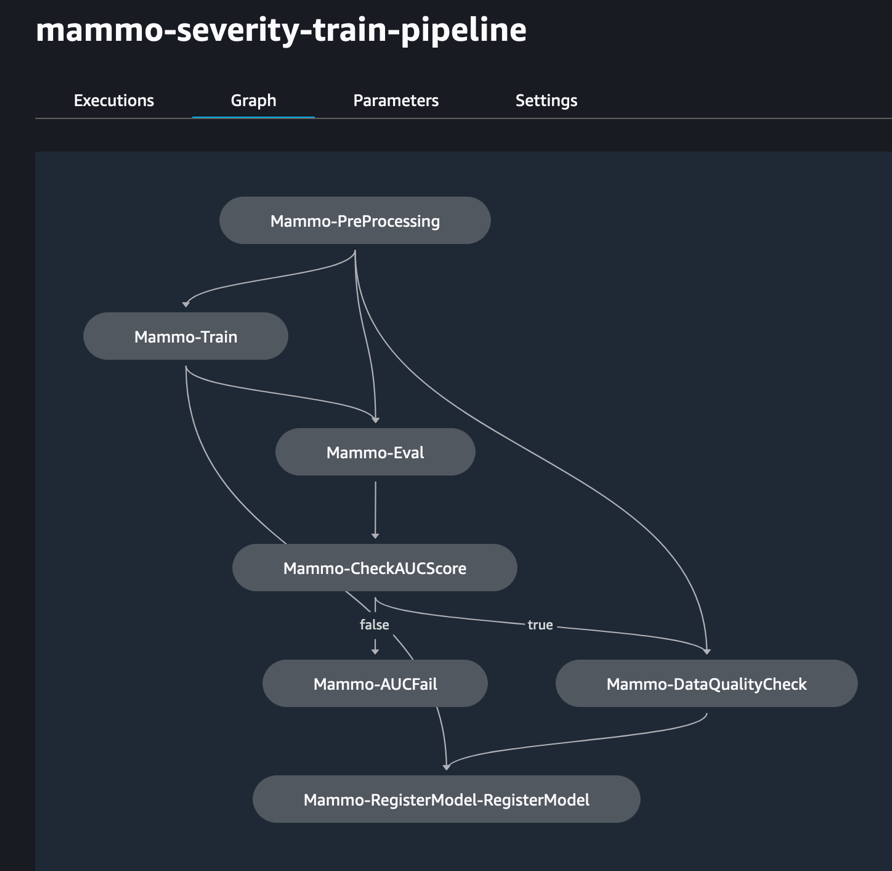

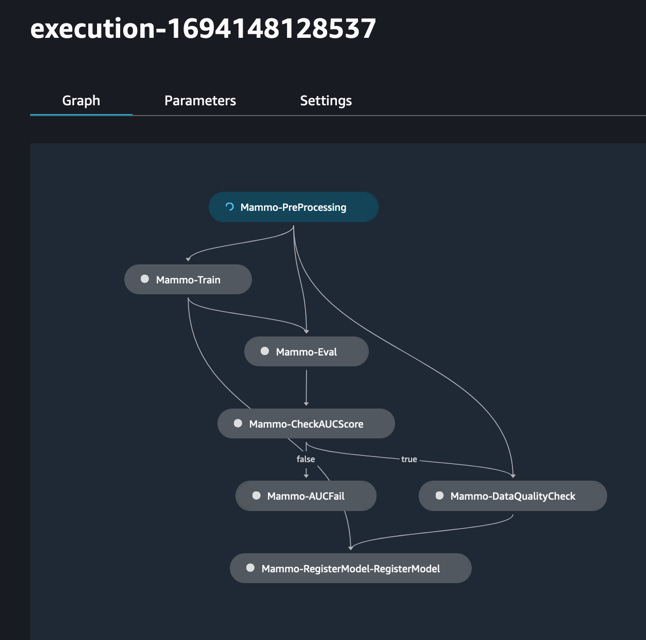

На наступному малюнку показано успішний запуск навчального конвеєра. На останньому етапі конвеєра модель реєструється в обліковому записі центрального реєстру моделей.

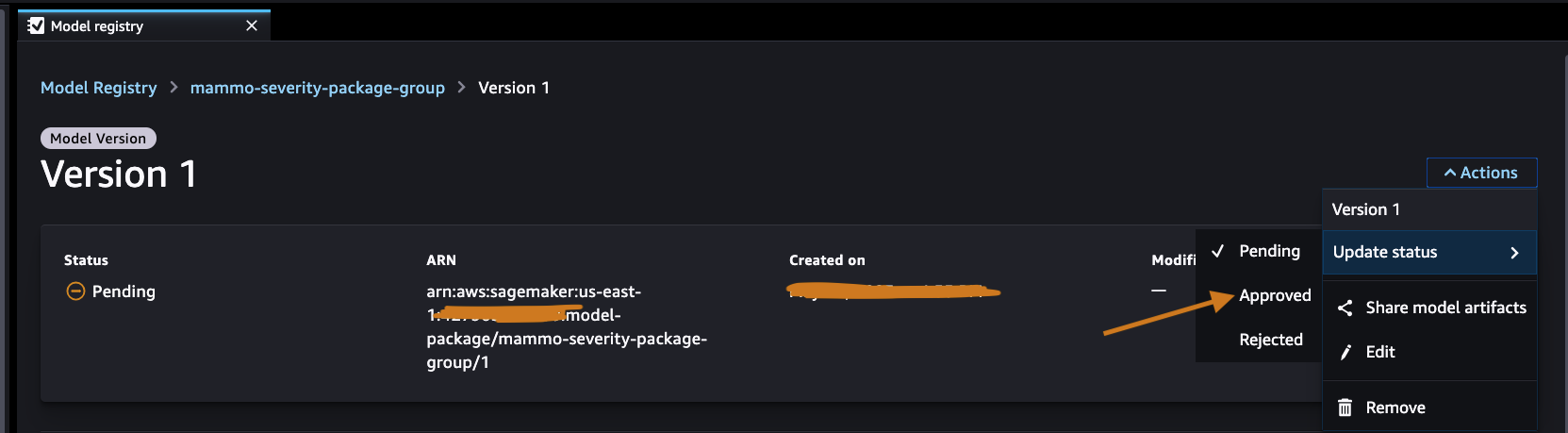

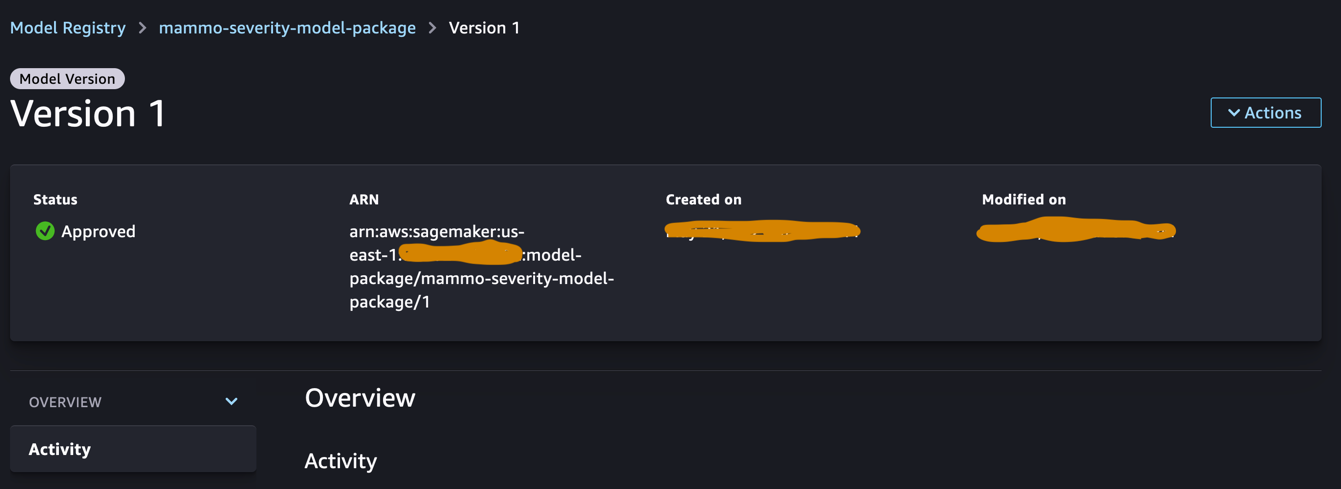

Затвердити модель у центральному реєстрі моделей

Увійдіть до облікового запису центрального реєстру моделей і отримайте доступ до реєстру моделей SageMaker у домені SageMaker Studio. Змініть статус версії моделі на Approved.

Після затвердження статус версії моделі слід змінити.

Запустіть конвеєр висновку (необов’язково)

Цей крок не є обов’язковим, але ви все одно можете запустити конвеєр висновків для створення прогнозів в обліковому записі розробника.

під <project-name>/pipelines/inference, ви можете побачити такі сценарії Python:

- scripts/lambda_helper.py – Отримує останню затверджену версію моделі з облікового запису центрального реєстру моделей за допомогою лямбда-етапу SageMaker Pipelines

- inference_pipeline.py – Містить код конвеєра виведення моделі

Виконайте такі дії:

- Завантажте сценарій у сегмент S3:

- Отримайте екземпляр конвеєра висновку за допомогою звичайного пакетного набору даних:

- Надішліть конвеєр висновку та запустіть його:

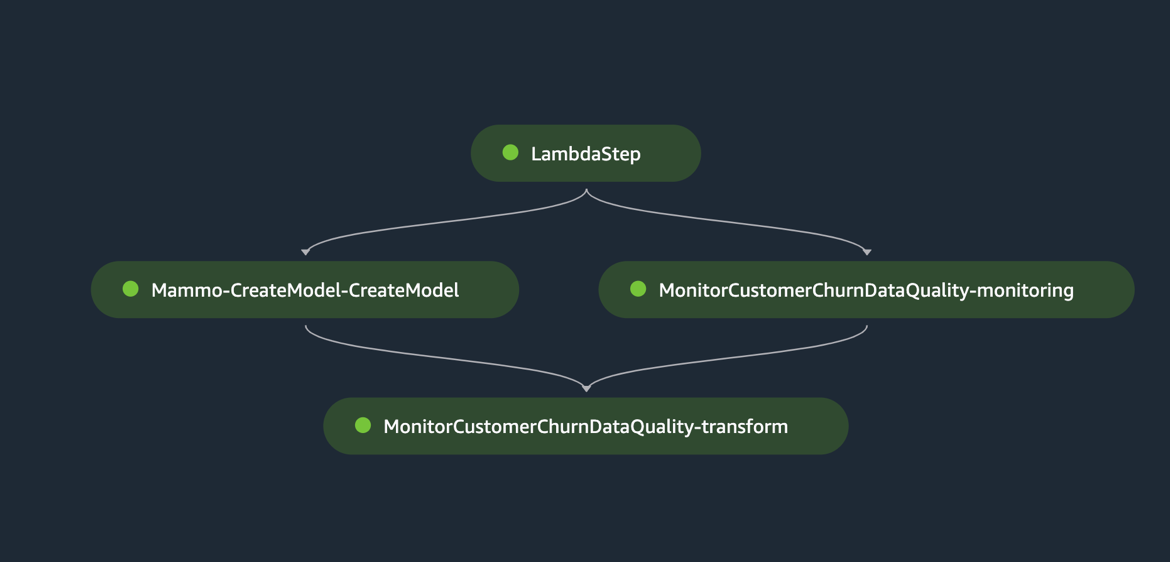

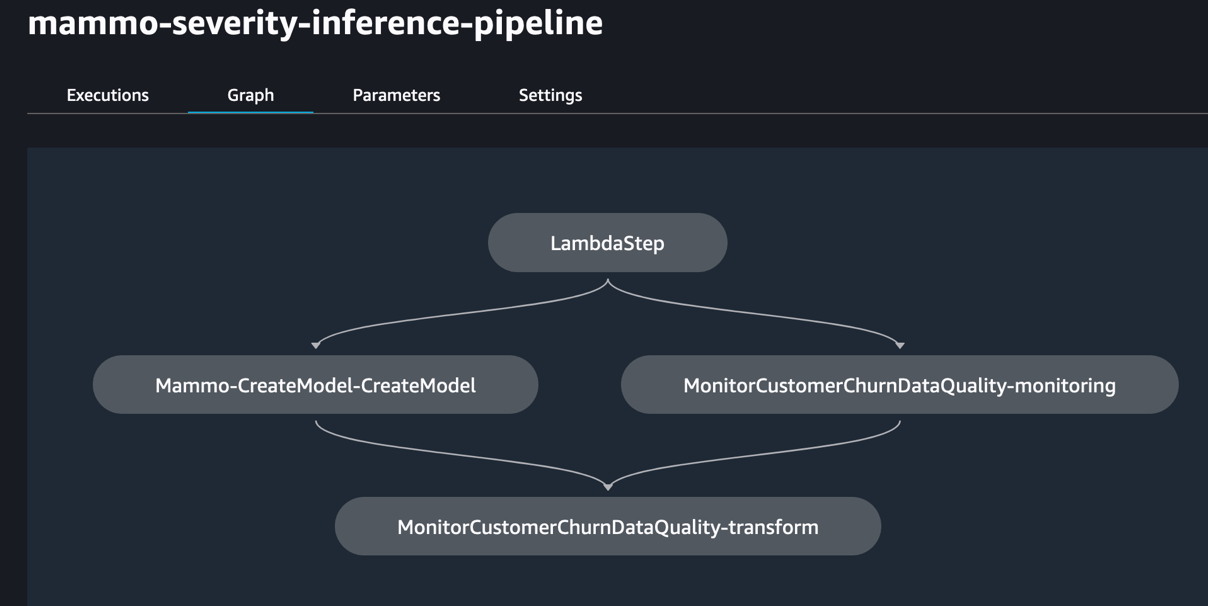

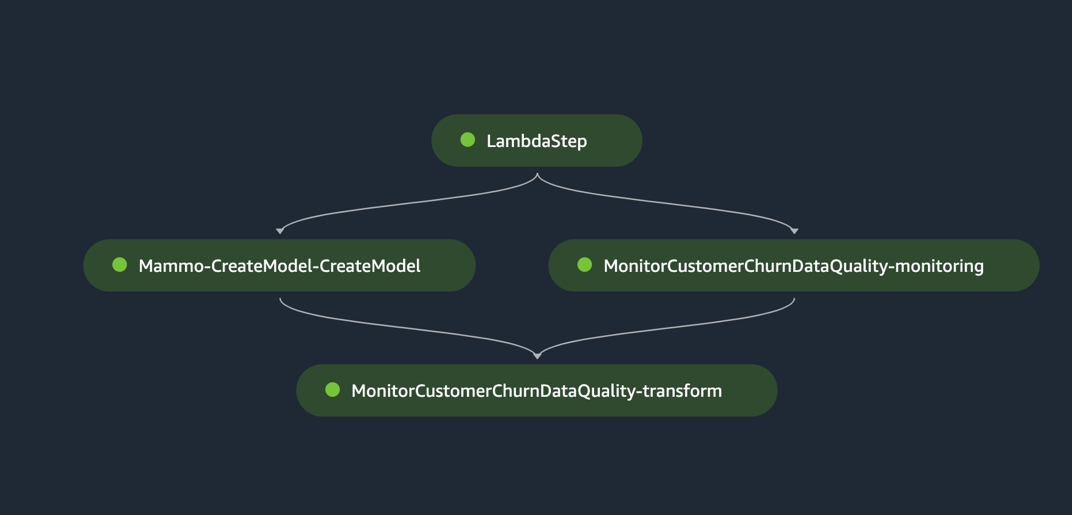

На наступному малюнку показано успішний запуск конвеєра виведення. Останній крок у конвеєрі генерує прогнози та зберігає їх у сегменті S3. Ми використовуємо MonitorBatchTransformStep для моніторингу вхідних даних у завдання пакетного перетворення. Якщо є будь-які викиди, конвеєр виведення переходить у несправний стан.

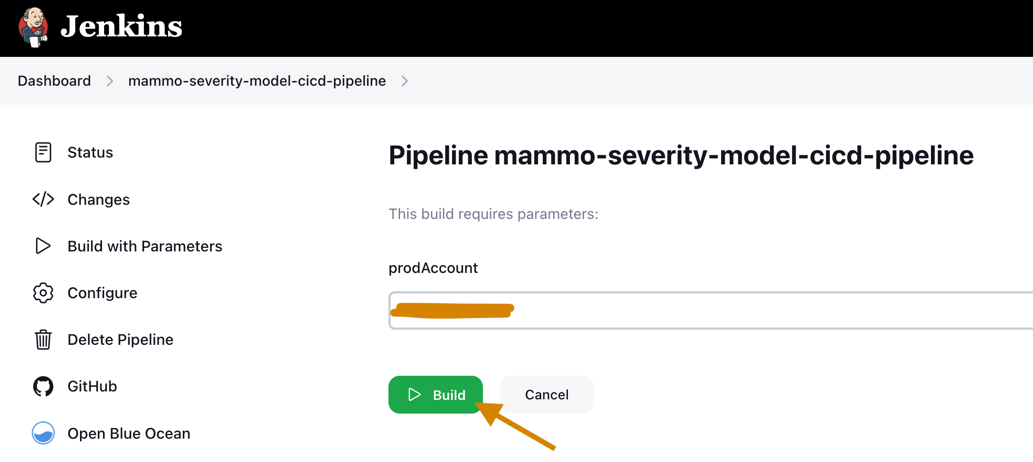

Запустіть конвеєр Дженкінса

Команда environment/ папка в репозиторії GitHub містить сценарій налаштування для облікового запису prod. Щоб запустити конвеєр Jenkins, виконайте такі дії:

- Оновіть сценарій конфігурації

prod.tfvars.jsonна основі ресурсів, створених на попередніх кроках: - Після оновлення надішліть код у розгалужене сховище GitHub і об’єднайте код у основну гілку.

- Перейдіть до інтерфейсу користувача Jenkins, виберіть Збірка з параметрамиі запустіть конвеєр CI/CD, створений у попередніх кроках.

Коли збірка буде завершена й успішна, ви зможете увійти в обліковий запис prod і переглянути конвеєри навчання та висновків у домені SageMaker Studio.

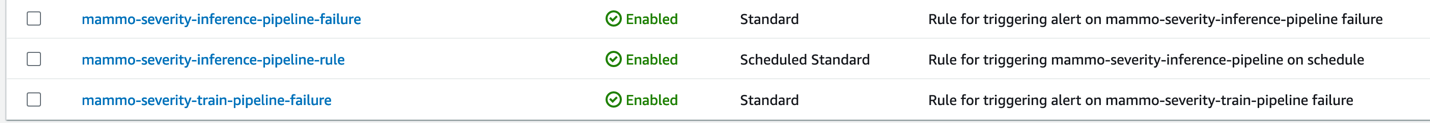

Крім того, ви побачите три правила EventBridge на консолі EventBridge в обліковому записі prod:

- Заплануйте конвеєр виведення

- Надіслати сповіщення про збій у конвеєрі поїзда

- Якщо конвеєр виведення не може запустити конвеєр поїзда, надішліть сповіщення

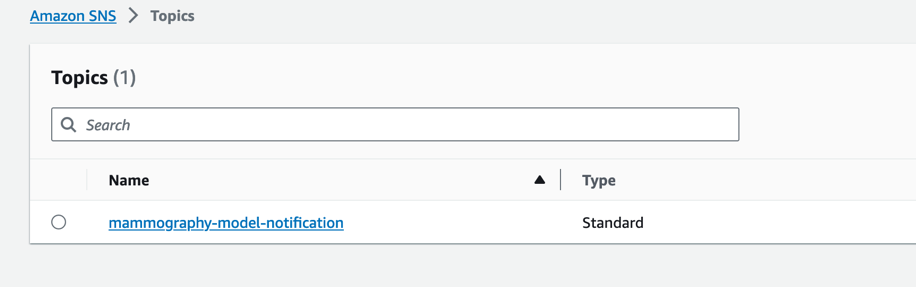

Нарешті, ви побачите тему сповіщень SNS на консолі Amazon SNS, яка надсилає сповіщення електронною поштою. Ви отримаєте електронний лист із проханням підтвердити прийняття цих сповіщень.

Перевірте конвеєр висновку за допомогою пакетного набору даних без викидів

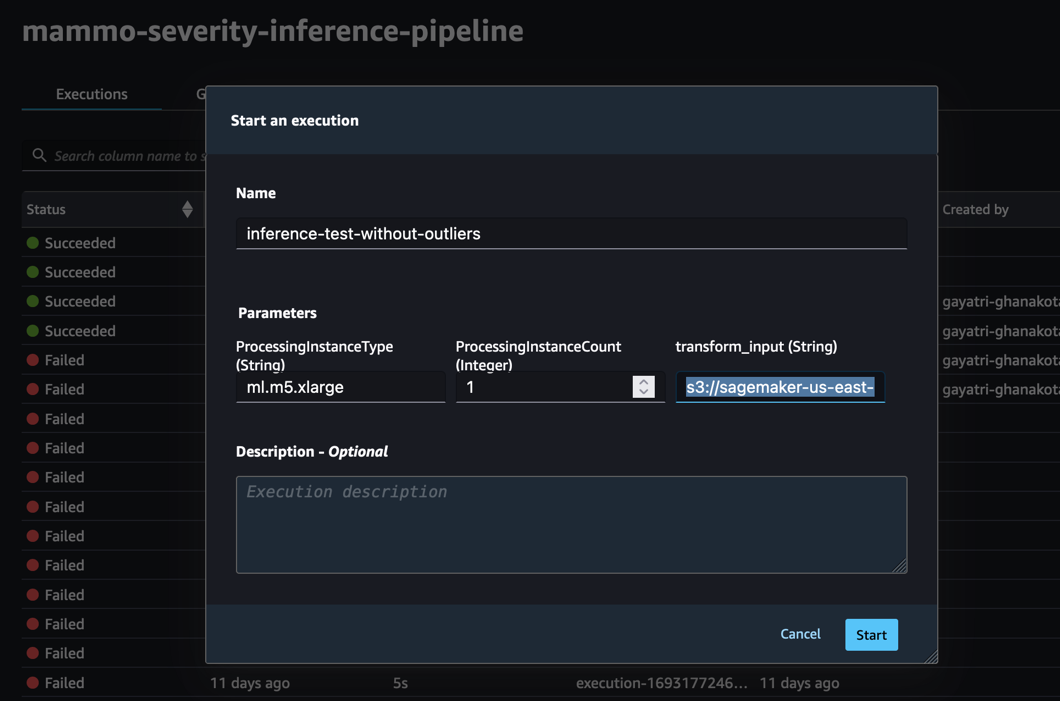

Щоб перевірити, чи конвеєр виведення працює належним чином в обліковому записі prod, ми можемо ввійти в обліковий запис prod і запустити конвеєр виведення, використовуючи пакетний набір даних без викидів.

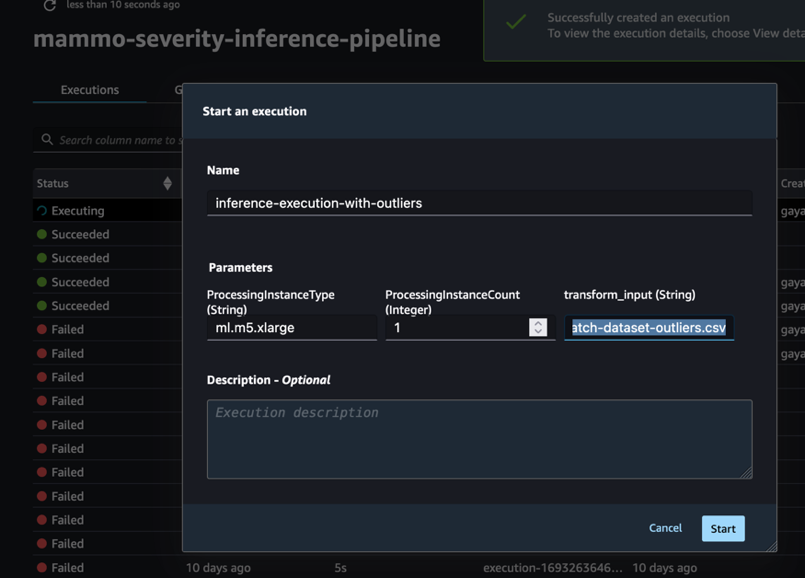

Запустіть конвеєр через консоль SageMaker Pipelines у домені SageMaker Studio облікового запису prod, де transform_input буде S3 URI набору даних без викидів (s3://<s3-bucket-in-prod-account>/mammography-severity-model/data/mammo-batch-dataset.csv).

Конвеєр виведення завершується успішно та записує прогнози назад у сегмент S3.

Перевірте конвеєр висновку за допомогою пакетного набору даних із викидами

Ви можете запустити конвеєр висновків, використовуючи пакетний набір даних із викидами, щоб перевірити, чи механізм автоматичного повторного навчання працює належним чином.

Запустіть конвеєр через консоль SageMaker Pipelines у домені SageMaker Studio облікового запису prod, де transform_input буде S3 URI набору даних із викидами (s3://<s3-bucket-in-prod-account>/mammography-severity-model/data/mammo-batch-dataset-outliers.csv).

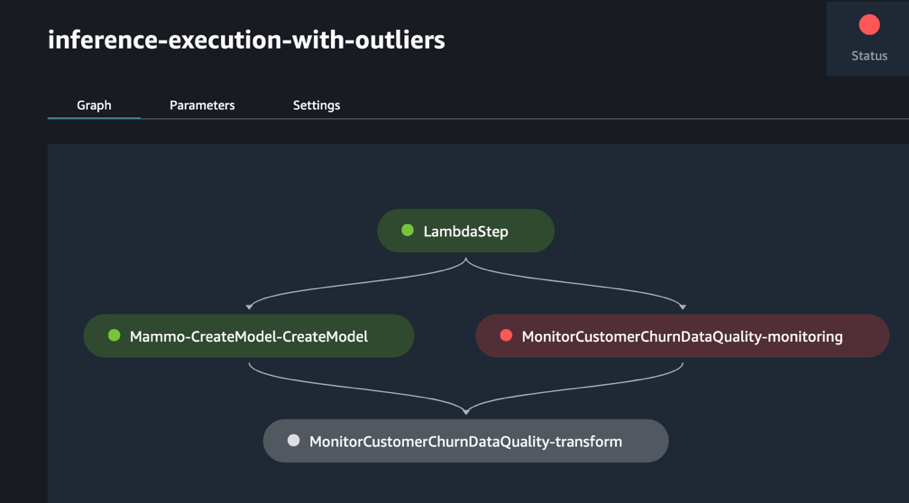

Конвеєр виведення не вдається, як очікувалося, що запускає правило EventBridge, яке, у свою чергу, запускає конвеєр поїзда.

Через кілька секунд ви побачите новий запуск конвеєра поїзда на консолі SageMaker Pipelines, який збирає два різні набори даних поїзда (mammo-train-dataset-part1.csv та mammo-train-dataset-part2.csv), завантажений у сегмент S3, щоб перенавчити модель.

Ви також побачите сповіщення, надіслане на електронну адресу, підписану на тему SNS.

Щоб використовувати оновлену версію моделі, увійдіть до облікового запису центрального реєстру моделей і схваліть версію моделі, яка буде підібрана під час наступного запуску конвеєра висновку, викликаного запланованим правилом EventBridge.

Незважаючи на те, що конвеєри підготовки та виведення використовують URL-адресу статичного набору даних, ви можете передати URL-адресу набору даних до конвеєрів потягу та виводу як динамічні змінні, щоб використовувати оновлені набори даних для повторного навчання моделі та створення прогнозів у реальному сценарії.

Прибирати

Щоб уникнути стягнення плати в майбутньому, виконайте наведені нижче дії.

- Видаліть домен SageMaker Studio з усіх облікових записів AWS.

- Видаліть усі ресурси, створені за межами SageMaker, включаючи сегменти S3, ролі IAM, правила EventBridge і тему SNS, налаштовану через Terraform в обліковому записі prod.

- Видаліть конвеєри SageMaker, створені в облікових записах за допомогою Інтерфейс командного рядка AWS (AWS CLI).

Висновок

Організаціям часто потрібно узгодити набори інструментів для всього підприємства, щоб забезпечити співпрацю між різними функціональними сферами та командами. Ця співпраця гарантує адаптацію вашої платформи MLOps до нових потреб бізнесу та прискорює впровадження ML серед команд. У цьому дописі пояснюється, як створити фреймворк MLOps у налаштуванні з кількома середовищами, щоб увімкнути автоматичне перенавчання моделі, пакетний висновок і моніторинг за допомогою Amazon SageMaker Model Monitor, керування версіями моделі за допомогою SageMaker Model Registry та просування коду ML і конвеєрів у середовищах за допомогою Конвеєр CI/CD. Ми продемонстрували це рішення, використовуючи комбінацію служб AWS і наборів інструментів сторонніх розробників. Інструкції щодо впровадження цього рішення див GitHub сховище. Ви також можете розширити це рішення, залучивши власні джерела даних і моделі моделювання.

Про авторів

Гаятрі Ганакота є старшим інженером машинного навчання в AWS Professional Services. Вона захоплена розробкою, розгортанням і поясненням рішень AI/ML у різних областях. До цієї посади вона керувала кількома ініціативами в якості спеціаліста з обробки даних та інженера з ML у провідних світових компаніях у сфері фінансів і роздрібної торгівлі. Вона має ступінь магістра комп’ютерних наук, спеціалізуючись на Data Science, в Університеті Колорадо, Боулдер.

Гаятрі Ганакота є старшим інженером машинного навчання в AWS Professional Services. Вона захоплена розробкою, розгортанням і поясненням рішень AI/ML у різних областях. До цієї посади вона керувала кількома ініціативами в якості спеціаліста з обробки даних та інженера з ML у провідних світових компаніях у сфері фінансів і роздрібної торгівлі. Вона має ступінь магістра комп’ютерних наук, спеціалізуючись на Data Science, в Університеті Колорадо, Боулдер.

Суніта Коппар є старшим архітектором Data Lake у AWS Professional Services. Вона захоплена вирішенням проблемних моментів клієнтів, обробкою великих даних і наданням довгострокових масштабованих рішень. До цієї посади вона розробляла продукти для Інтернету, телекомунікацій та автомобільної галузі, а також була клієнтом AWS. Вона має ступінь магістра з Data Science в Каліфорнійському університеті, Ріверсайд.

Суніта Коппар є старшим архітектором Data Lake у AWS Professional Services. Вона захоплена вирішенням проблемних моментів клієнтів, обробкою великих даних і наданням довгострокових масштабованих рішень. До цієї посади вона розробляла продукти для Інтернету, телекомунікацій та автомобільної галузі, а також була клієнтом AWS. Вона має ступінь магістра з Data Science в Каліфорнійському університеті, Ріверсайд.

Сасвата Деш є DevOps-консультантом AWS Professional Services. Вона працювала з клієнтами в галузі охорони здоров’я та біологічних наук, авіації та виробництва. Вона захоплена всім, що стосується автоматизації, і має великий досвід у розробці та створенні корпоративних рішень для клієнтів в AWS. Поза роботою вона займається своєю пристрастю фотографією та ловленням світанку.

Сасвата Деш є DevOps-консультантом AWS Professional Services. Вона працювала з клієнтами в галузі охорони здоров’я та біологічних наук, авіації та виробництва. Вона захоплена всім, що стосується автоматизації, і має великий досвід у розробці та створенні корпоративних рішень для клієнтів в AWS. Поза роботою вона займається своєю пристрастю фотографією та ловленням світанку.

- Розповсюдження контенту та PR на основі SEO. Отримайте посилення сьогодні.

- PlatoData.Network Vertical Generative Ai. Додайте собі сили. Доступ тут.

- PlatoAiStream. Web3 Intelligence. Розширення знань. Доступ тут.

- ПлатонЕСГ. вуглець, CleanTech, Енергія, Навколишнє середовище, Сонячна, Поводження з відходами. Доступ тут.

- PlatoHealth. Розвідка про біотехнології та клінічні випробування. Доступ тут.

- джерело: https://aws.amazon.com/blogs/machine-learning/promote-pipelines-in-a-multi-environment-setup-using-amazon-sagemaker-model-registry-hashicorp-terraform-github-and-jenkins-ci-cd/

- : має

- :є

- : ні

- :де

- $UP

- 1

- 10

- 100

- 12

- 13

- 14

- 16

- 17

- 19

- 23

- 27

- 31

- 320

- 7

- 8

- 9

- a

- МЕНЮ

- прискорюється

- прийняття

- доступ

- рахунки

- Рахунки

- через

- дію

- пристосовувати

- додавати

- адреса

- адміністративний

- Прийняття

- після

- вік

- AI

- вирівнювати

- ВСІ

- дозволяти

- дозволяє

- по

- Також

- Amazon

- Amazon SageMaker

- Amazon Web Services

- an

- та

- Інший

- будь-який

- додаток

- відповідний

- схвалювати

- затверджений

- архітектура

- ЕСТЬ

- області

- навколо

- штучний

- штучний інтелект

- Штучний інтелект (AI)

- AS

- запитувач

- асоційований

- припустити

- приєднувати

- автоматичний

- Автоматизований

- автоматичний

- Автоматизація

- автомобільний

- доступний

- авіація

- уникнути

- AWS

- Клієнт AWS

- Професійні послуги AWS

- назад

- заснований

- основа

- BE

- оскільки

- було

- перед тим

- буття

- КРАЩЕ

- передового досвіду

- між

- Великий

- Великий даних

- обидва

- Філія

- мостинг

- Приведення

- будувати

- Створюємо

- побудований

- бізнес

- але

- by

- розрахунок

- Каліфорнія

- званий

- CAN

- випадок

- центральний

- зміна

- змінилися

- Зміни

- вантажі

- перевірка

- вибір

- Вибирати

- код

- співробітництво

- збирати

- Колорадо

- Колонка

- Колони

- COM

- поєднання

- повний

- дотримання

- Компоненти

- всеосяжний

- комп'ютер

- Інформатика

- стан

- конфігурація

- підтвердити

- Консоль

- консультант

- Контейнер

- містить

- контроль

- Конвенція

- конвертувати

- Відповідний

- створювати

- створений

- створення

- Повноваження

- Перетинати

- клієнт

- Рішення для клієнтів

- Клієнти

- щодня

- приладова панель

- дані

- Озеро даних

- наука про дані

- вчений даних

- набори даних

- Розшифрувати

- дефолт

- Ступінь

- розгортання

- розгортання

- розгортання

- розгортає

- проектування

- деталі

- виявляти

- виявлено

- DEV

- розвиненою

- розвивається

- розробка

- DICT

- різний

- домен

- домени

- під час

- динамічний

- кожен

- Раніше

- ефект

- або

- повідомлення електронної пошти

- включіть

- зашифрованих

- інженер

- гарантує

- Що натомість? Створіть віртуальну версію себе у

- Навколишнє середовище

- середовищах

- істотний

- Події

- еволюціонує

- виконання

- очікуваний

- досвід

- пояснені

- пояснюючи

- продовжити

- фасилітувати

- FAIL

- не вдалося

- зазнає невдачі

- Провал

- особливість

- риси

- кілька

- Рисунок

- філе

- остаточний

- фінансовий

- закінчення

- фірми

- Перший

- перший раз

- після

- для

- знайдений

- Рамки

- каркаси

- від

- Виконати

- Повний

- функція

- функціональний

- майбутнє

- розрив

- породжувати

- генерується

- генерує

- отримати

- Git

- GitHub

- Давати

- даний

- дає

- Глобальний

- Go

- йде

- гранти

- Group

- Мати

- охорона здоров'я

- її

- вище

- тримає

- хостинг

- Як

- How To

- HTML

- HTTP

- HTTPS

- ID

- Особистість

- if

- реалізації

- імпорт

- in

- includes

- У тому числі

- індекс

- Інфраструктура

- спочатку

- ініціативи

- витрати

- встановлювати

- встановлений

- екземпляр

- інструкції

- Інтеграція

- Інтелект

- інтернет

- в

- вводити

- IT

- робота

- Джобс

- JPG

- json

- ключ

- ключі

- етикетка

- озеро

- ландшафт

- пізніше

- останній

- вивчення

- Led

- левередж

- життя

- Life Sciences

- Лінія

- журнал

- довгостроковий

- машина

- навчання за допомогою машини

- головний

- підтримувати

- зробити

- вдалося

- управління

- виробництво

- Маржа

- Маса

- магістра

- механізм

- засідання

- Меню

- Злиття

- Метрика

- відсутній

- ML

- MLOps

- модель

- моделювання

- Моделі

- змінювати

- Модулі

- Моменти

- монітор

- контрольований

- моніторинг

- більше

- множинний

- ім'я

- Названий

- іменування

- навігація

- Необхідність

- необхідний

- потреби

- Нові

- наступний

- нормальний

- ноутбук

- сповіщення

- Повідомлення

- номер

- нумпі

- of

- часто

- on

- ONE

- операції

- or

- порядок

- організації

- Інше

- з

- поза

- над

- огляд

- власний

- пакет

- сторінка

- Біль

- панди

- pane

- частина

- частини

- Пройшов

- пристрасть

- пристрасний

- Викрійки

- продуктивність

- Дозволи

- малюнок

- підібраний

- Вибори

- трубопровід

- платформа

- plato

- Інформація про дані Платона

- PlatoData

- точок

- Політика

- політика

- пошта

- практики

- передбачати

- Прогнози

- Готувати

- передумови

- попередній

- Головний

- попередній

- привілеї

- процес

- обробка

- Production

- Продукти

- професійний

- проект

- сприяти

- Підвищено

- просування

- забезпечувати

- за умови

- забезпечує

- забезпечення

- забезпечення

- публічно

- Тягне

- Переслідування

- Штовхати

- Python

- швидко

- швидко

- Сировина

- Читати

- готовий

- Реальний світ

- регіон

- реєструвати

- зареєстрований

- регістри

- реєстру

- регуляторні

- пов'язаний

- відносини

- видаляти

- Сховище

- запросити

- вимагається

- Вимога

- ресурс

- ресурси

- відповідь

- роздрібна торгівля

- повертати

- прибережна смуга

- Роль

- ролі

- корінь

- Правило

- Правила

- прогін

- пробіжки

- мудрець

- Трубопроводи SageMaker

- то ж

- зберегти

- зберігаються

- масштабовані

- сценарій

- розклад

- плановий

- планування

- наука

- НАУКИ

- вчений

- сценарій

- scripts

- плавно

- другий

- розділ

- безпечний

- безпеку

- побачити

- послати

- відправка

- посилає

- посланий

- окремий

- сервер

- обслуговування

- Послуги

- комплект

- налаштування

- установка

- Форма

- Поділитись

- вона

- Повинен

- Показувати

- продемонстрований

- показаний

- Шоу

- простий

- уривок

- So

- рішення

- Рішення

- Розв’язування

- Source

- Джерела

- Простір

- спеціалізований

- конкретний

- розкол

- стан

- Заява

- статичний

- Статус

- Крок

- заходи

- Як і раніше

- зберігати

- зберігати

- магазинів

- рядок

- структура

- студія

- успішний

- такі

- Опори

- Мета

- команди

- телеком

- Terraform

- тест

- Тестування

- Що

- Команда

- Їх

- потім

- Там.

- Ці

- речі

- третій

- третя сторона

- це

- три

- через

- час

- до

- набори інструментів

- топ

- тема

- трек

- поїзд

- навчений

- Навчання

- Перетворення

- викликати

- спрацьовує

- спрацьовування

- правда

- Довіряйте

- ПЕРЕГЛЯД

- два

- ui

- при

- університет

- Університет Каліфорнії

- Оновити

- оновлений

- завантажено

- URL

- us

- використання

- використовуваний

- використання

- утиліта

- Цінності

- різний

- версія

- версії

- через

- Відео

- видимий

- годинник

- we

- Web

- веб-сервіси

- коли

- коли б ні

- в той час як

- який

- в той час як

- волі

- з

- в

- без

- Work

- працював

- робочий

- робочий

- працює

- запис

- письмовий

- Ти

- вашу

- YouTube

- зефірнет