ZOO Digital надає наскрізну локалізацію та медіа-сервіси для адаптації оригінального теле- та кіноконтенту до різних мов, регіонів і культур. Це полегшує глобалізацію для найкращих у світі творців контенту. Компанії ZOO Digital, якій довіряють найбільші імена в галузі розваг, надається високоякісна локалізація та масштабні медіа-сервіси, включаючи дубляж, субтитри, сценарії та відповідність вимогам.

Типові робочі процеси локалізації вимагають ручної діаризації мовця, коли аудіопотік сегментується на основі ідентичності мовця. Цей трудомісткий процес має бути завершено, перш ніж вміст можна буде дублювати іншою мовою. За допомогою ручних методів локалізація 30-хвилинного епізоду може зайняти від 1 до 3 годин. За допомогою автоматизації ZOO Digital прагне досягти локалізації менш ніж за 30 хвилин.

У цій публікації ми обговорюємо розгортання моделей масштабованого машинного навчання (ML) для щоденника використання медіаконтенту Amazon SageMaker, з акцентом на WhisperX модель.

фон

Бачення ZOO Digital полягає в тому, щоб забезпечити швидший оборот локалізованого вмісту. Досягнення цієї мети перешкоджає інтенсивному ручному характеру вправ, що ускладнюється невеликою робочою силою кваліфікованих людей, які можуть локалізувати вміст вручну. ZOO Digital працює з понад 11,000 600 фрілансерів і лише у 2022 році локалізував понад XNUMX мільйонів слів. Проте пропозиція кваліфікованих людей випереджає зростаючий попит на контент, що вимагає автоматизації для допомоги в робочих процесах локалізації.

З метою прискорення локалізації робочих процесів контенту за допомогою машинного навчання ZOO Digital залучив AWS Prototyping, інвестиційну програму AWS для спільного створення робочих навантажень із клієнтами. Залучення було зосереджено на розробці функціонального рішення для процесу локалізації, а також наданні практичного навчання розробникам ZOO Digital на SageMaker, Амазонська розшифровка та Amazon Translate.

Виклик клієнта

Після транскрибування назви (фільму чи епізоду телевізійного серіалу) динаміки повинні бути призначені для кожного сегменту мови, щоб їх можна було правильно призначити виконавцям озвучення, які виконують роль персонажів. Цей процес називається діаризацією мовця. ZOO Digital стикається з проблемою створення щоденника в масштабі, будучи економічно життєздатним.

Огляд рішення

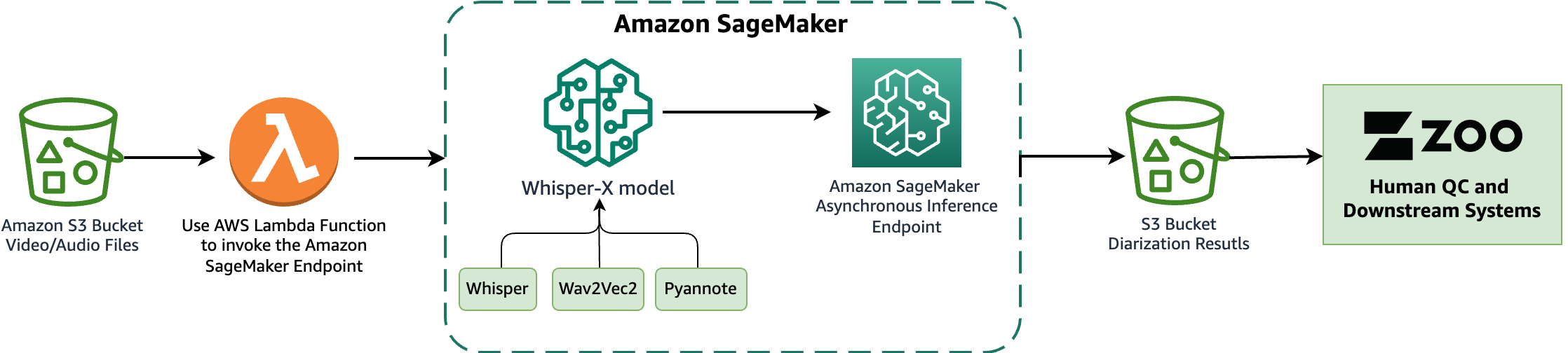

У цьому прототипі ми зберігали оригінальні мультимедійні файли у вказаному Служба простого зберігання Amazon (Amazon S3) відро. Це відро S3 було налаштовано на випромінювання події, коли в ньому виявлено нові файли, ініціюючи подію AWS Lambda функція. Щоб отримати вказівки щодо налаштування цього тригера, зверніться до посібника Використання тригера Amazon S3 для виклику функції Lambda. Згодом функція Lambda викликала кінцеву точку SageMaker для висновку за допомогою Boto3 SageMaker Runtime клієнт.

Команда WhisperX модель, на основі Шепіт OpenAI, виконує транскрипцію та щоденник медіа-активів. Він побудований на Швидше Шепіт повторна реалізація, пропонуючи до чотирьох разів швидшу транскрипцію з покращеним вирівнюванням часових позначок на рівні слова порівняно з Whisper. Крім того, він представляє діаріалізацію динаміків, якої немає в оригінальній моделі Whisper. WhisperX використовує модель Whisper для транскрипції Wav2Vec2 модель для покращення вирівнювання міток часу (забезпечення синхронізації транскрибованого тексту з мітками часу аудіо), і піаннота модель для діаризації. FFmpeg використовується для завантаження аудіо з вихідного носія, підтримуючи різні медіаформати. Прозора і модульна архітектура моделі забезпечує гнучкість, оскільки кожен компонент моделі можна замінити за потреби в майбутньому. Однак важливо зазначити, що WhisperX не має повних функцій керування та не є продуктом корпоративного рівня. Без обслуговування та підтримки він може бути непридатним для розгортання у виробництві.

У рамках цієї співпраці ми розгорнули та оцінили WhisperX на SageMaker, використовуючи кінцева точка асинхронного висновку для розміщення моделі. Асинхронні кінцеві точки SageMaker підтримують розміри завантажень до 1 ГБ і включають функції автоматичного масштабування, які ефективно пом’якшують стрибки трафіку та заощаджують витрати в період непікової навантаження. Асинхронні кінцеві точки особливо добре підходять для обробки великих файлів, таких як фільми та серіали в нашому випадку використання.

Наступна діаграма ілюструє основні елементи експериментів, які ми проводили в рамках цієї співпраці.

У наступних розділах ми детально розглянемо розгортання моделі WhisperX на SageMaker і оцінимо ефективність діаризації.

Завантажте модель та її компоненти

WhisperX — це система, яка включає кілька моделей для транскрипції, примусового вирівнювання та діаризації. Для безперебійної роботи SageMaker без необхідності отримувати артефакти моделі під час висновку важливо попередньо завантажити всі артефакти моделі. Потім ці артефакти завантажуються в обслуговуючий контейнер SageMaker під час ініціації. Оскільки ці моделі недоступні безпосередньо, ми пропонуємо описи та зразки коду з джерела WhisperX, надаючи інструкції щодо завантаження моделі та її компонентів.

WhisperX використовує шість моделей:

Більшість із цих моделей можна придбати у Обіймати обличчя за допомогою бібліотеки huggingface_hub. Ми використовуємо наступне download_hf_model() функцію для отримання цих артефактів моделі. Потрібен маркер доступу від Hugging Face, згенерований після прийняття угод користувача для наступних моделей піаннот:

import huggingface_hub

import yaml

import torchaudio

import urllib.request

import os CONTAINER_MODEL_DIR = "/opt/ml/model"

WHISPERX_MODEL = "guillaumekln/faster-whisper-large-v2"

VAD_MODEL_URL = "https://whisperx.s3.eu-west-2.amazonaws.com/model_weights/segmentation/0b5b3216d60a2d32fc086b47ea8c67589aaeb26b7e07fcbe620d6d0b83e209ea/pytorch_model.bin"

WAV2VEC2_MODEL = "WAV2VEC2_ASR_BASE_960H"

DIARIZATION_MODEL = "pyannote/speaker-diarization" def download_hf_model(model_name: str, hf_token: str, local_model_dir: str) -> str: """ Fetches the provided model from HuggingFace and returns the subdirectory it is downloaded to :param model_name: HuggingFace model name (and an optional version, appended with @[version]) :param hf_token: HuggingFace access token authorized to access the requested model :param local_model_dir: The local directory to download the model to :return: The subdirectory within local_modeL_dir that the model is downloaded to """ model_subdir = model_name.split('@')[0] huggingface_hub.snapshot_download(model_subdir, token=hf_token, local_dir=f"{local_model_dir}/{model_subdir}", local_dir_use_symlinks=False) return model_subdir

Модель VAD отримується з Amazon S3, а модель Wav2Vec2 – із модуля torchaudio.pipelines. На основі наступного коду ми можемо отримати всі артефакти моделей, включно з артефактами Hugging Face, і зберегти їх у вказаному локальному каталозі моделі:

def fetch_models(hf_token: str, local_model_dir="./models"): """ Fetches all required models to run WhisperX locally without downloading models every time :param hf_token: A huggingface access token to download the models :param local_model_dir: The directory to download the models to """ # Fetch Faster Whisper's Large V2 model from HuggingFace download_hf_model(model_name=WHISPERX_MODEL, hf_token=hf_token, local_model_dir=local_model_dir) # Fetch WhisperX's VAD Segmentation model from S3 vad_model_dir = "whisperx/vad" if not os.path.exists(f"{local_model_dir}/{vad_model_dir}"): os.makedirs(f"{local_model_dir}/{vad_model_dir}") urllib.request.urlretrieve(VAD_MODEL_URL, f"{local_model_dir}/{vad_model_dir}/pytorch_model.bin") # Fetch the Wav2Vec2 alignment model torchaudio.pipelines.__dict__[WAV2VEC2_MODEL].get_model(dl_kwargs={"model_dir": f"{local_model_dir}/wav2vec2/"}) # Fetch pyannote's Speaker Diarization model from HuggingFace download_hf_model(model_name=DIARIZATION_MODEL, hf_token=hf_token, local_model_dir=local_model_dir) # Read in the Speaker Diarization model config to fetch models and update with their local paths with open(f"{local_model_dir}/{DIARIZATION_MODEL}/config.yaml", 'r') as file: diarization_config = yaml.safe_load(file) embedding_model = diarization_config['pipeline']['params']['embedding'] embedding_model_dir = download_hf_model(model_name=embedding_model, hf_token=hf_token, local_model_dir=local_model_dir) diarization_config['pipeline']['params']['embedding'] = f"{CONTAINER_MODEL_DIR}/{embedding_model_dir}" segmentation_model = diarization_config['pipeline']['params']['segmentation'] segmentation_model_dir = download_hf_model(model_name=segmentation_model, hf_token=hf_token, local_model_dir=local_model_dir) diarization_config['pipeline']['params']['segmentation'] = f"{CONTAINER_MODEL_DIR}/{segmentation_model_dir}/pytorch_model.bin" with open(f"{local_model_dir}/{DIARIZATION_MODEL}/config.yaml", 'w') as file: yaml.safe_dump(diarization_config, file) # Read in the Speaker Embedding model config to update it with its local path speechbrain_hyperparams_path = f"{local_model_dir}/{embedding_model_dir}/hyperparams.yaml" with open(speechbrain_hyperparams_path, 'r') as file: speechbrain_hyperparams = file.read() speechbrain_hyperparams = speechbrain_hyperparams.replace(embedding_model_dir, f"{CONTAINER_MODEL_DIR}/{embedding_model_dir}") with open(speechbrain_hyperparams_path, 'w') as file: file.write(speechbrain_hyperparams)

Виберіть відповідний контейнер AWS Deep Learning Container для обслуговування моделі

Після збереження артефактів моделі за допомогою попереднього прикладу коду ви можете вибрати попередньо зібраний Контейнери глибокого навчання AWS (DLC) з наступного GitHub репо. Вибираючи образ Docker, враховуйте такі параметри: фреймворк (Hugging Face), завдання (висновок), версія Python і апаратне забезпечення (наприклад, GPU). Рекомендуємо використовувати наступне зображення: 763104351884.dkr.ecr.[REGION].amazonaws.com/huggingface-pytorch-inference:2.0.0-transformers4.28.1-gpu-py310-cu118-ubuntu20.04 У цьому образі попередньо встановлено всі необхідні системні пакети, наприклад ffmpeg. Не забудьте замінити [REGION] на регіон AWS, який ви використовуєте.

Для інших необхідних пакетів Python створіть a requirements.txt файл зі списком пакунків та їх версій. Ці пакети буде встановлено, коли буде створено AWS DLC. Нижче наведено додаткові пакети, необхідні для розміщення моделі WhisperX на SageMaker:

Створіть сценарій логічного висновку, щоб завантажити моделі та запустити логічний висновок

Далі ми створюємо кастом inference.py сценарій, щоб окреслити, як модель WhisperX та її компоненти завантажуються в контейнер і як повинен запускатися процес висновку. Сценарій містить дві функції: model_fn та transform_fn, model_fn функція викликається для завантаження моделей із відповідних місць. Згодом ці моделі переходять до transform_fn функція під час висновку, де виконуються процеси транскрипції, вирівнювання та діаризації. Нижче наведено приклад коду для inference.py:

import io

import json

import logging

import tempfile

import time import torch

import whisperx DEVICE = 'cuda' if torch.cuda.is_available() else 'cpu' def model_fn(model_dir: str) -> dict: """ Deserialize and return the models """ logging.info("Loading WhisperX model") model = whisperx.load_model(whisper_arch=f"{model_dir}/guillaumekln/faster-whisper-large-v2", device=DEVICE, language="en", compute_type="float16", vad_options={'model_fp': f"{model_dir}/whisperx/vad/pytorch_model.bin"}) logging.info("Loading alignment model") align_model, metadata = whisperx.load_align_model(language_code="en", device=DEVICE, model_name="WAV2VEC2_ASR_BASE_960H", model_dir=f"{model_dir}/wav2vec2") logging.info("Loading diarization model") diarization_model = whisperx.DiarizationPipeline(model_name=f"{model_dir}/pyannote/speaker-diarization/config.yaml", device=DEVICE) return { 'model': model, 'align_model': align_model, 'metadata': metadata, 'diarization_model': diarization_model } def transform_fn(model: dict, request_body: bytes, request_content_type: str, response_content_type="application/json") -> (str, str): """ Load in audio from the request, transcribe and diarize, and return JSON output """ # Start a timer so that we can log how long inference takes start_time = time.time() # Unpack the models whisperx_model = model['model'] align_model = model['align_model'] metadata = model['metadata'] diarization_model = model['diarization_model'] # Load the media file (the request_body as bytes) into a temporary file, then use WhisperX to load the audio from it logging.info("Loading audio") with io.BytesIO(request_body) as file: tfile = tempfile.NamedTemporaryFile(delete=False) tfile.write(file.read()) audio = whisperx.load_audio(tfile.name) # Run transcription logging.info("Transcribing audio") result = whisperx_model.transcribe(audio, batch_size=16) # Align the outputs for better timings logging.info("Aligning outputs") result = whisperx.align(result["segments"], align_model, metadata, audio, DEVICE, return_char_alignments=False) # Run diarization logging.info("Running diarization") diarize_segments = diarization_model(audio) result = whisperx.assign_word_speakers(diarize_segments, result) # Calculate the time it took to perform the transcription and diarization end_time = time.time() elapsed_time = end_time - start_time logging.info(f"Transcription and Diarization took {int(elapsed_time)} seconds") # Return the results to be stored in S3 return json.dumps(result), response_content_type

У каталозі моделі поряд із requirements.txt файл, переконатися в наявності inference.py у підкаталозі code. The models каталог має виглядати так:

Створіть архів моделей

Після створення моделей і каталогів коду ви можете використовувати наведені нижче командні рядки, щоб стиснути модель у архів (файл .tar.gz) і завантажити його в Amazon S3. На момент написання, використовуючи модель більш швидкого шепоту Large V2, результуючий архів, що представляє модель SageMaker, має розмір 3 ГБ. Для отримання додаткової інформації див Шаблони розміщення моделей в Amazon SageMaker, частина 2: Початок роботи з розгортанням моделей реального часу на SageMaker.

Створіть модель SageMaker і розгорніть кінцеву точку з асинхронним предиктором

Тепер ви можете створити модель SageMaker, конфігурацію кінцевої точки та асинхронну кінцеву точку за допомогою AsyncPredictor за допомогою архіву моделі, створеного на попередньому кроці. Інструкції див Створіть кінцеву точку асинхронного висновку.

Оцініть ефективність діаризації

Щоб оцінити ефективність щоденника моделі WhisperX у різних сценаріях, ми вибрали по три епізоди з двох англійських назв: одна драма складається з 30-хвилинних епізодів, а одна документальна назва складається з 45-хвилинних епізодів. Ми використали набір метричних інструментів pyannote, піаннота.метрика, щоб розрахувати частота помилок діаризації (DER). Під час оцінки основною правдою слугували переписані вручну та записані в щоденнику стенограми, надані ZOO.

Ми визначили ПЕД наступним чином:

Усього: це довжина відео правди. FA (Помилкова тривога) – це довжина сегментів, які вважаються мовленням у передбаченнях, але не в основному істинним. Сумувати це довжина сегментів, які розглядаються як мова в основній істині, але не в передбаченні. помилка, Називаний також Плутанина, це довжина сегментів, які призначаються різним динамікам у передбаченні та базовій правдивості. Усі одиниці вимірюються в секундах. Типові значення ПЕД можуть змінюватися залежно від конкретної програми, набору даних і якості системи діаризації. Зауважте, що DER може бути більшим за 1.0. Нижча ПЕД краще.

Щоб мати можливість обчислити DER для медіафайлу, необхідна базова істина, а також транскрибовані та щоденникові результати WhisperX. Їх потрібно проаналізувати та отримати списки кортежів, що містять мітку мовця, час початку сегмента мовлення та час завершення сегмента мовлення для кожного сегмента мовлення в медіа. Мітки динаміків не повинні збігатися між WhisperX і наземними щоденниками. Результати базуються переважно на часі сегментів. pyannote.metrics приймає ці кортежі базових істинних діаризацій і вихідних діаризацій (у документації pyannote.metrics згадується як посилання та гіпотеза) для розрахунку ПЕД. У наступній таблиці підсумовуються наші результати.

| Тип відео | DER | Правильно | Сумувати | помилка | Помилкова тривога |

| Драма | 0.738 | 44.80% | 21.80% | 33.30% | 18.70% |

| Документальний фільм | 1.29 | 94.50% | 5.30% | 0.20% | 123.40% |

| середній | 0.901 | 71.40% | 13.50% | 15.10% | 61.50% |

Ці результати виявляють значну різницю в продуктивності між драматичними та документальними назвами, причому модель досягла значно кращих результатів (використовуючи DER як сукупний показник) для драматичних епізодів порівняно з документальною назвою. Ретельніший аналіз назв дає змогу зрозуміти потенційні фактори, що сприяють цьому розриву продуктивності. Одним із ключових факторів може бути часта присутність у назві документального фільму фонової музики, яка накладається на мову. Незважаючи на те, що попередня обробка носіїв для підвищення точності диаризації, наприклад видалення фонового шуму для ізоляції мовлення, вийшла за межі цього прототипу, вона відкриває шляхи для майбутньої роботи, яка потенційно може підвищити продуктивність WhisperX.

Висновок

У цій публікації ми досліджували спільне партнерство між AWS і ZOO Digital, використовуючи методи машинного навчання за допомогою SageMaker і моделі WhisperX для покращення робочого процесу діаризації. Команда AWS відіграла ключову роль у допомозі ZOO у створенні прототипів, оцінці та розумінні ефективного розгортання користувацьких моделей ML, спеціально розроблених для діаризації. Це включало включення автоматичного масштабування для масштабованості за допомогою SageMaker.

Використання штучного інтелекту для створення щоденника призведе до значної економії коштів і часу під час створення локалізованого вмісту для ZOO. Допомагаючи транскрибувальникам швидко й точно створювати та ідентифікувати мовців, ця технологія справляється з традиційно трудомістким і схильним до помилок характером завдання. Звичайний процес часто передбачає кілька проходів через відео та додаткові етапи контролю якості, щоб мінімізувати помилки. Застосування штучного інтелекту для діаризації дає змогу застосовувати більш цілеспрямований та ефективний підхід, тим самим підвищуючи продуктивність за коротший проміжок часу.

Ми окреслили основні кроки для розгортання моделі WhisperX на асинхронній кінцевій точці SageMaker і заохочуємо вас спробувати це самостійно, використовуючи наданий код. Щоб дізнатися більше про послуги та технології ZOO Digital, відвідайте Офіційний сайт ZOO Digital. Докладніше про розгортання моделі OpenAI Whisper на SageMaker і про різні варіанти висновків див Розмістіть модель Whisper на Amazon SageMaker: досліджуйте варіанти висновків. Не соромтеся ділитися своїми думками в коментарях.

Про авторів

Ін Хоу, доктор філософії, є архітектором прототипування машинного навчання в AWS. Основні сфери її інтересів охоплюють глибоке навчання з акцентом на GenAI, комп’ютерне зір, НЛП та прогнозування даних часових рядів. У вільний час вона із задоволенням проводить якісні моменти зі своєю сім’єю, занурюється в романи та здійснює походи в національні парки Великобританії.

Ін Хоу, доктор філософії, є архітектором прототипування машинного навчання в AWS. Основні сфери її інтересів охоплюють глибоке навчання з акцентом на GenAI, комп’ютерне зір, НЛП та прогнозування даних часових рядів. У вільний час вона із задоволенням проводить якісні моменти зі своєю сім’єю, занурюється в романи та здійснює походи в національні парки Великобританії.

Ітан Камберленд є інженером-дослідником штучного інтелекту в ZOO Digital, де він працює над використанням штучного інтелекту та машинного навчання як допоміжних технологій для покращення робочих процесів у сфері мовлення, мови та локалізації. Він має досвід розробки програмного забезпечення та досліджень у сфері безпеки та контролю, зосереджуючись на отриманні структурованої інформації з Інтернету та використанні моделей ML з відкритим кодом для аналізу та збагачення зібраних даних.

Ітан Камберленд є інженером-дослідником штучного інтелекту в ZOO Digital, де він працює над використанням штучного інтелекту та машинного навчання як допоміжних технологій для покращення робочих процесів у сфері мовлення, мови та локалізації. Він має досвід розробки програмного забезпечення та досліджень у сфері безпеки та контролю, зосереджуючись на отриманні структурованої інформації з Інтернету та використанні моделей ML з відкритим кодом для аналізу та збагачення зібраних даних.

Гаурав Кайла очолює команду створення прототипів AWS для Великобританії та Ірландії. Його команда працює з клієнтами в різних галузях, щоб створити ідею та спільну розробку критично важливих для бізнесу робочих навантажень із завданням прискорити впровадження послуг AWS.

Гаурав Кайла очолює команду створення прототипів AWS для Великобританії та Ірландії. Його команда працює з клієнтами в різних галузях, щоб створити ідею та спільну розробку критично важливих для бізнесу робочих навантажень із завданням прискорити впровадження послуг AWS.

- Розповсюдження контенту та PR на основі SEO. Отримайте посилення сьогодні.

- PlatoData.Network Vertical Generative Ai. Додайте собі сили. Доступ тут.

- PlatoAiStream. Web3 Intelligence. Розширення знань. Доступ тут.

- ПлатонЕСГ. вуглець, CleanTech, Енергія, Навколишнє середовище, Сонячна, Поводження з відходами. Доступ тут.

- PlatoHealth. Розвідка про біотехнології та клінічні випробування. Доступ тут.

- джерело: https://aws.amazon.com/blogs/machine-learning/streamline-diarization-using-ai-as-an-assistive-technology-zoo-digitals-story/

- : має

- :є

- : ні

- :де

- $UP

- 000

- 1

- 10

- 100

- 11

- 140

- 2022

- 220

- 28

- 30

- 350

- 600

- 7

- 8

- a

- Здатний

- прискорювати

- приймає

- доступ

- доступною

- точність

- Achieve

- досягнення

- через

- пристосовувати

- Додатковий

- Додатково

- адреси

- Прийняття

- після

- сукупність

- угоди

- AI

- ai дослідження

- мета

- Цілі

- тривога

- вирівнювати

- вирівнювання

- вирівнювання

- ВСІ

- дозволяє

- тільки

- пліч-о-пліч

- Також

- хоча

- Amazon

- Amazon SageMaker

- Amazon Web Services

- an

- Аналізуючи

- аналіз

- та

- Інший

- додаток

- підхід

- відповідний

- архітектура

- ЕСТЬ

- області

- Художники

- AS

- оцінити

- Активи

- призначений

- допомогу

- допомагати

- At

- аудіо

- уповноважений

- автоматичний

- Автоматизація

- проспекти

- AWS

- фон

- заснований

- BE

- оскільки

- було

- перед тим

- буття

- КРАЩЕ

- Краще

- між

- За

- найбільший

- BIN

- обидва

- побудований

- бізнес

- але

- by

- обчислювати

- званий

- CAN

- випадок

- виклик

- символи

- Вибирати

- ближче

- код

- співробітництво

- спільний

- коментарі

- порівняний

- Зроблено

- дотримання

- компонент

- Компоненти

- складений

- комп'ютер

- Комп'ютерне бачення

- проводиться

- налаштувати

- конфігурування

- Вважати

- вважається

- Складається

- Контейнер

- містить

- зміст

- творці контенту

- внесок

- контроль

- звичайний

- Core

- правильно

- Коштувати

- витрати

- може

- створювати

- створений

- створення

- Творці

- критичний

- культур

- виготовлений на замовлення

- Клієнти

- дані

- глибокий

- глибоке навчання

- певний

- надання

- постачає

- заглиблюватися

- Попит

- Залежно

- розгортання

- розгорнути

- розгортання

- розгортання

- призначений

- деталі

- виявлено

- розробників

- пристрій

- схема

- DICT

- різниця

- різний

- цифровий

- Цифри

- безпосередньо

- каталоги

- каталог

- обговорювати

- Різне

- Docker

- документальний фільм

- документація

- домен

- Не знаю

- скачати

- Завантаження

- Драма

- охрестили

- під час

- кожен

- легше

- Ефективний

- ефективний

- продуктивно

- елементи

- ще

- вбудовування

- наймаючи

- дозволяє

- охоплювати

- заохочувати

- кінець

- кінець в кінець

- Кінцева точка

- зайнятий

- зачеплення

- інженер

- Машинобудування

- англійська

- підвищувати

- збагачення

- забезпечувати

- забезпечення

- рівень підприємства

- розваги

- епізод

- помилка

- помилки

- істотний

- оцінювати

- оцінюється

- оцінки

- оцінка

- Event

- Кожен

- приклад

- Здійснювати

- Експерименти

- Розвіданий

- Дослідження

- Face

- особи

- фактор

- фактори

- false

- сім'я

- швидше

- риси

- почувати

- Отримано

- філе

- Файли

- Гнучкість

- Сфокусувати

- увагу

- фокусування

- після

- слідує

- для

- примусовий

- чотири

- Рамки

- Безкоштовна

- частий

- від

- Повний

- функція

- функціональний

- Функції

- далі

- майбутнє

- розрив

- genai

- генерується

- породжує

- отримання

- GitHub

- глобалізація

- мета

- GPU

- Земля

- практичний

- апаратні засоби

- he

- її

- високоякісний

- його

- господар

- хостинг

- ГОДИННИК

- Як

- Однак

- HTML

- HTTP

- HTTPS

- HuggingFace

- ідентифікує

- Особистість

- if

- ілюструє

- зображення

- імпорт

- удосконалювати

- поліпшений

- in

- включені

- includes

- У тому числі

- включати

- включення

- зростаючий

- промисловості

- інформація

- ініціювання

- розуміння

- встановлений

- інструкції

- інтерес

- в

- Вводить

- інвестиції

- викликали

- включає в себе

- Ірландія

- IT

- ЙОГО

- JPG

- json

- ключ

- ключовий фактор

- етикетка

- етикетки

- мова

- мови

- великий

- більше

- вести

- Веде за собою

- вивчення

- довжина

- використання

- бібліотека

- ліній

- список

- списки

- загрузка

- погрузка

- місцевий

- Локалізація

- локально

- місць

- журнал

- каротаж

- Довго

- знизити

- машина

- навчання за допомогою машини

- обслуговування

- РОБОТИ

- управління

- Мандат

- керівництво

- вручну

- матч

- Може..

- Медіа

- метадані

- методика

- метрика

- Метрика

- мільйона

- мінімізувати

- хвилин

- Пом'якшити

- ML

- модель

- Моделі

- модульний

- Модулі

- Моменти

- більше

- в основному

- фільм

- кіно

- множинний

- музика

- повинен

- ім'я

- Імена

- National

- природа

- необхідно

- Необхідність

- необхідний

- Нові

- nlp

- шум

- особливо

- увагу

- отриманий

- of

- пропонувати

- пропонує

- офіційний

- часто

- on

- ONE

- з відкритим вихідним кодом

- OpenAI

- Відкриється

- операція

- Опції

- or

- оригінал

- OS

- Інше

- наші

- з

- план

- викладені

- вихід

- виходи

- над

- пакети

- частина

- особливо

- Партнерство

- Пройшов

- проходить

- шлях

- стежки

- моделі

- Люди

- Виконувати

- продуктивність

- виконується

- виступає

- частина

- трубопровід

- основний

- plato

- Інформація про дані Платона

- PlatoData

- Play

- грав

- поліція

- пошта

- потенціал

- потенційно

- попередній

- точно

- прогноз

- Прогнози

- наявність

- представити

- попередній

- первинний

- процес

- процеси

- обробка

- Product

- Production

- продуктивність

- програма

- прототип

- макетування

- забезпечувати

- за умови

- забезпечує

- забезпечення

- Python

- якість

- R

- ставка

- Читати

- реальний

- реального часу

- рекомендувати

- послатися

- називають

- регіон

- райони

- запам'ятати

- видалення

- замінювати

- представляє

- запросити

- вимагати

- вимагається

- Вимога

- дослідження

- ті

- результат

- в результаті

- результати

- повертати

- Умови повернення

- показувати

- Роль

- прогін

- біг

- час виконання

- s

- мудрець

- зразок

- зберегти

- зберігаються

- Економія

- масштабованість

- масштабовані

- шкала

- Масштабування

- сценарії

- сфера

- сценарій

- seconds

- розділам

- безпеку

- сегмент

- сегментація

- сегменти

- обраний

- вибирає

- Серія

- служив

- Послуги

- виступаючої

- налаштування

- Поділитись

- вона

- Повинен

- значний

- простий

- SIX

- Розмір

- розміри

- кваліфікований

- невеликий

- згладити

- So

- Софтвер

- розробка програмного забезпечення

- рішення

- Source

- Гучномовець

- динаміки

- конкретний

- конкретно

- зазначений

- мова

- Витрати

- шипи

- старт

- почалася

- Крок

- заходи

- зберігання

- зберігати

- Історія

- потік

- раціоналізувати

- структурований

- Згодом

- істотний

- такі

- підходящий

- поставка

- підтримка

- Підтримуючий

- обмінявся

- швидко

- синхронізація

- система

- таблиця

- Приймати

- приймає

- цільове

- Завдання

- команда

- методи

- Технології

- Технологія

- тимчасовий

- текст

- ніж

- Що

- Команда

- Майбутнє

- Великобританія

- їх

- Їх

- потім

- тим самим

- Ці

- вони

- це

- ті

- три

- через

- час

- Часовий ряд

- трудомісткий

- терміни

- times

- відмітка часу

- терміни

- назва

- назви

- до

- знак

- прийняли

- Інструментарій

- факел

- традиційно

- трафік

- Навчання

- прозорий

- викликати

- спрацьовування

- Довірений

- Правда

- намагатися

- підручник

- tv

- два

- типовий

- Uk

- при

- в 30

- розуміння

- одиниць

- Оновити

- на

- використання

- використання випадку

- використовуваний

- користувач

- використовує

- використання

- використовувати

- використовує

- Цінності

- різний

- змінюватися

- версія

- версії

- viable

- Відео

- бачення

- візит

- Голос

- W

- було

- we

- Web

- веб-сервіси

- ДОБРЕ

- коли

- в той час як

- Шепіт

- волі

- з

- в

- без

- слова

- Work

- робочий

- Робочі процеси

- Трудові ресурси

- працює

- світі

- лист

- ямл

- Ти

- вашу

- себе

- зефірнет

- ZOO