زبان کے ماڈل اعداد و شمار کے طریقے ہیں جو قدرتی متن کا استعمال کرتے ہوئے ترتیب میں ٹوکن کی جانشینی کی پیش گوئی کرتے ہیں۔ بڑے لینگویج ماڈلز (LLMs) نیورل نیٹ ورک پر مبنی لینگویج ماڈلز ہیں جن میں سیکڑوں ملین (برٹ) ٹریلین سے زیادہ پیرامیٹرز تک (ایم آئی سی ایس)، اور جس کا سائز سنگل GPU ٹریننگ کو ناقابل عمل بناتا ہے۔ LLMs کی تخلیقی صلاحیتیں انہیں متن کی ترکیب، خلاصہ، مشینی ترجمہ اور بہت کچھ کے لیے مقبول بناتی ہیں۔

ایل ایل ایم کا سائز اور اس کا تربیتی ڈیٹا ایک دو دھاری تلوار ہے: یہ ماڈلنگ کوالٹی لاتا ہے، لیکن بنیادی ڈھانچے کے چیلنجز کا سامنا کرتا ہے۔ ماڈل خود اکثر اتنا بڑا ہوتا ہے کہ کسی ایک GPU ڈیوائس کی یادداشت میں یا ملٹی GPU مثال کے متعدد آلات پر فٹ ہو سکے۔ ان عوامل کو تیز مشین لرننگ (ML) مثالوں کے بڑے کلسٹرز پر LLM کی تربیت کی ضرورت ہوتی ہے۔ پچھلے کچھ سالوں میں، متعدد صارفین LLM کی تربیت کے لیے AWS Cloud استعمال کر رہے ہیں۔

اس پوسٹ میں، ہم کامیاب LLM ٹریننگ کے لیے تجاویز اور بہترین طریقوں پر غور کرتے ہیں۔ ایمیزون سیج میکر ٹریننگ. سیج میکر ٹریننگ ایک منظم بیچ ایم ایل کمپیوٹ سروس ہے جو انفراسٹرکچر کو منظم کرنے کی ضرورت کے بغیر پیمانے پر ماڈلز کو ٹریننگ اور ٹیون کرنے میں وقت اور لاگت کو کم کرتی ہے۔ ایک لانچ کمانڈ کے اندر، ایمیزون سیج میکر آپ کی پسند کے کام کو چلانے والے مکمل طور پر فعال، عارضی کمپیوٹ کلسٹر شروع کرتا ہے، اور بہتر ایم ایل خصوصیات جیسے میٹاسٹور، منظم I/O، اور تقسیم کے ساتھ۔ یہ پوسٹ LLM ٹریننگ کے کام کے بوجھ کے تمام مراحل کا احاطہ کرتی ہے اور اس سے منسلک بنیادی ڈھانچے کی خصوصیات اور بہترین طریقوں کو بیان کرتی ہے۔ اس پوسٹ میں کچھ بہترین طرز عمل خاص طور پر ml.p4d.24xlarge مثالوں کا حوالہ دیتے ہیں، لیکن زیادہ تر کسی بھی مثال کی قسم پر لاگو ہوتے ہیں۔ یہ بہترین طرز عمل آپ کو SageMaker پر درجنوں سے سینکڑوں ملین پیرامیٹرز کے پیمانے پر LLMs کو تربیت دینے کی اجازت دیتا ہے۔

اس پوسٹ کے دائرہ کار کے بارے میں، درج ذیل کو نوٹ کریں:

- ہم نیورل نیٹ ورک کے سائنسی ڈیزائن اور اس سے وابستہ اصلاح کا احاطہ نہیں کرتے ہیں۔ Amazon.Science متعدد سائنسی اشاعتیں پیش کرتی ہیں، بشمول اور ان تک محدود نہیں۔ ایل ایل ایمز.

- اگرچہ یہ پوسٹ LLMs پر فوکس کرتی ہے، لیکن اس کے زیادہ تر بہترین طریقے کسی بھی قسم کی بڑے ماڈل ٹریننگ کے لیے متعلقہ ہیں، بشمول کمپیوٹر ویژن اور ملٹی موڈل ماڈلز، جیسے کہ اسٹیبل ڈفیوژن۔

بہترین طریقوں

ہم اس پوسٹ میں درج ذیل بہترین طریقوں پر بات کرتے ہیں:

- کمپیوٹنگ - سیج میکر ٹریننگ CPU ڈیٹاسیٹ کی تیاری کی نوکریوں اور ہزار پیمانے پر GPU جابز شروع کرنے کے لیے ایک بہترین API ہے۔

- ذخیرہ - ہم مہارت اور ترجیحات کے لحاظ سے ڈیٹا لوڈنگ اور چیک پوائنٹنگ کو دو طریقوں سے کرتے دیکھتے ہیں: ایمیزون ایف ایس ایکس لسٹر فائل سسٹم، یا ایمیزون سادہ اسٹوریج سروس (ایمیزون S3) صرف۔

- متوازی پن - آپ کی تقسیم شدہ تربیتی لائبریری کا انتخاب GPUs کے مناسب استعمال کے لیے اہم ہے۔ ہم کلاؤڈ آپٹمائزڈ لائبریری استعمال کرنے کی تجویز کرتے ہیں، جیسے کہ SageMaker sharded data parallelism، لیکن خود نظم شدہ اور اوپن سورس لائبریریاں بھی کام کر سکتی ہیں۔

- نیٹ ورکنگ - اس بات کو یقینی بنائیں کہ EFA اور NVIDIA GPUDirectRDMA فعال ہیں، تیز رفتار انٹر-مشین مواصلات کے لیے۔

- لچک - پیمانے پر، ہارڈ ویئر کی ناکامی ہو سکتی ہے۔ ہم باقاعدگی سے چیک پوائنٹ کرنے کی تجویز کرتے ہیں۔ ہر چند گھنٹے عام ہے۔

علاقے کا انتخاب

مثال کی قسم اور مطلوبہ صلاحیت خطے کے انتخاب کے لیے ایک فیصلہ کن عنصر ہے۔ سیج میکر اور کے ذریعہ تعاون یافتہ خطوں کے لئے ایمیزون لچکدار کمپیوٹ کلاؤڈ (ایمیزون EC2) مثال کی اقسام جو ہر علاقے میں دستیاب ہیں، دیکھیں ایمیزون سیج میکر قیمتوں کا تعین. اس پوسٹ میں، ہم فرض کرتے ہیں کہ تربیتی مثال کی قسم SageMaker کے زیر انتظام ml.p4d.24xlarge ہے۔

ہم آپ کی AWS اکاؤنٹ ٹیم کے ساتھ کام کرنے یا رابطہ کرنے کی تجویز کرتے ہیں۔ AWS سیلز اپنے LLM کام کے بوجھ کے لیے مناسب علاقے کا تعین کرنے کے لیے۔

ڈیٹا کی تیاری

LLM ڈویلپر اپنے ماڈلز کو قدرتی طور پر پائے جانے والے متن کے بڑے ڈیٹا سیٹس پر تربیت دیتے ہیں۔ اس طرح کے ڈیٹا ذرائع کی مقبول مثالیں شامل ہیں۔ عام کرال اور ڈھیر۔. قدرتی طور پر پائے جانے والے متن میں تعصبات، غلطیاں، گرامر کی غلطیاں، اور نحوی تغیرات شامل ہو سکتے ہیں۔ LLM کا حتمی معیار نمایاں طور پر تربیتی ڈیٹا کے انتخاب اور کیوریشن پر منحصر ہوتا ہے۔ ایل ایل ایم ٹریننگ ڈیٹا کی تیاری ایل ایل ایم انڈسٹری میں تحقیق اور اختراع کا ایک فعال شعبہ ہے۔ قدرتی لینگویج پروسیسنگ (NLP) ڈیٹاسیٹ کی تیاری میں اشتراک کے متوازی مواقع موجود ہیں۔ دوسرے الفاظ میں، ایسے اقدامات ہیں جو کام کی اکائیوں پر لاگو کیے جا سکتے ہیں — سورس فائلز، پیراگراف، جملے، الفاظ — بغیر ورکر سنکرونائزیشن کی ضرورت کے۔

اس قسم کے کاموں کے لیے SageMaker نوکریاں APIs، یعنی SageMaker ٹریننگ اور SageMaker پروسیسنگ۔ وہ ڈویلپرز کو ایک سے زیادہ مشینوں کے بیڑے پر صوابدیدی ڈوکر کنٹینر چلانے کے قابل بناتے ہیں۔ SageMaker Training API کے معاملے میں، کمپیوٹنگ بیڑا ہو سکتا ہے۔ تجاویز. سیج میکر پر متعدد تقسیم شدہ کمپیوٹنگ فریم ورک استعمال کیے گئے ہیں، بشمول ڈسک, رے، اور بھی پی اسپارک، جس میں ایک وقف ہے۔ AWS کے زیر انتظام کنٹینر اور SDK سیج میکر پروسیسنگ میں۔

جب آپ ایک سے زیادہ مشینوں کے ساتھ کوئی کام شروع کرتے ہیں، تو سیج میکر ٹریننگ اور پروسیسنگ آپ کے کوڈ کو فی مشین ایک بار چلاتی ہے۔ تقسیم شدہ ایپلیکیشن لکھنے کے لیے آپ کو کسی خاص ڈسٹری بیوٹڈ کمپیوٹنگ فریم ورک کو استعمال کرنے کی ضرورت نہیں ہے: آپ اپنی پسند کا کوڈ لکھ سکتے ہیں، جو فی مشین ایک بار چلے گا، تاکہ شیئر کچھ بھی متوازی نہ ہو۔ آپ اپنی پسند کی انٹر نوڈ کمیونیکیشن منطق بھی لکھ سکتے ہیں یا انسٹال کر سکتے ہیں۔

ڈیٹا لوڈ ہو رہا ہے

تربیتی ڈیٹا کو ذخیرہ کرنے اور اسے اس کے ذخیرہ سے تیز رفتار کمپیوٹ نوڈس میں منتقل کرنے کے متعدد طریقے ہیں۔ اس سیکشن میں، ہم ڈیٹا لوڈ کرنے کے اختیارات اور بہترین طریقوں پر تبادلہ خیال کرتے ہیں۔

سیج میکر اسٹوریج اور لوڈنگ کے اختیارات

ایک عام LLM ڈیٹاسیٹ کا سائز کروڑوں ٹیکسٹ ٹوکنز میں ہوتا ہے، جو چند سو گیگا بائٹس کی نمائندگی کرتا ہے۔ ml.p4d.24xlarge مثالوں کے SageMaker کے زیر انتظام کلسٹرز ڈیٹاسیٹ اسٹوریج اور لوڈنگ کے لیے کئی اختیارات تجویز کرتے ہیں:

- آن نوڈ NVMe SSD - ml.P4d.24x بڑی مثالیں 8TB NVMe سے لیس ہیں، اس کے تحت دستیاب ہیں۔

/opt/ml/input/data/<channel>اگر آپ استعمال کرتے ہیں سیج میکر فائل موڈ، اور میں/tmp. اگر آپ مقامی پڑھنے کی سادگی اور کارکردگی کے خواہاں ہیں، تو آپ اپنے ڈیٹا کو NVMe SSD میں کاپی کر سکتے ہیں۔ کاپی یا تو سیج میکر فائل موڈ کے ذریعہ کی جاسکتی ہے، یا آپ کے اپنے کوڈ کے ذریعہ، مثال کے طور پر ملٹی پروسیسڈ کا استعمال کرتے ہوئے بوٹو 3 or S5cmd. - FSx لسٹر - آن نوڈ NVMe SSDs سائز میں محدود ہیں، اور ہر کام یا گرم کلسٹر تخلیق پر Amazon S3 سے ادخال کی ضرورت ہوتی ہے۔ اگر آپ کم لیٹنسی بے ترتیب رسائی کو برقرار رکھتے ہوئے بڑے ڈیٹا سیٹس پر اسکیل کرنا چاہتے ہیں، تو آپ Lustre کے لیے FSx استعمال کر سکتے ہیں۔ Amazon FSx ایک اوپن سورس متوازی فائل سسٹم ہے، جو ہائی پرفارمنس کمپیوٹنگ (HPC) میں مقبول ہے۔ FSx لسٹر استعمال کرتا ہے۔ تقسیم شدہ فائل اسٹوریج (اسٹریپنگ) اور فزیکل طور پر فائل میٹا ڈیٹا کو فائل کے مواد سے الگ کرتا ہے تاکہ اعلی کارکردگی پڑھنے/لکھنے کو حاصل کیا جا سکے۔

- سیج میکر فاسٹ فائل موڈ - فاسٹ فائل موڈ (ایف ایف ایم) صرف سیج میکر کی خصوصیت ہے جو POSIX-مطابق انٹرفیس کے تحت SageMaker کے زیر انتظام کمپیوٹ مثالوں میں ریموٹ S3 اشیاء کو پیش کرتی ہے، اور FUSE کا استعمال کرتے ہوئے انہیں صرف پڑھنے پر ہی اسٹریم کرتی ہے۔ FFM S3 کالوں میں نتائج پڑھتا ہے جو ریموٹ فائلوں کو بلاک کے ذریعے بلاک کرتی ہے۔ Amazon S3 ٹریفک سے متعلق غلطیوں سے بچنے کے لیے ایک بہترین عمل کے طور پر، FFM ڈویلپرز کو S3 کالز کی بنیادی تعداد کو معقول رکھنا چاہیے، مثال کے طور پر فائلوں کو ترتیب وار پڑھ کر اور متوازی مقدار کے ساتھ۔

- خود سے منظم ڈیٹا لوڈنگ - یقیناً، آپ ملکیتی یا اوپن سورس کوڈ کا استعمال کرتے ہوئے اپنی، مکمل طور پر حسب ضرورت ڈیٹا لوڈنگ منطق کو نافذ کرنے کا فیصلہ بھی کر سکتے ہیں۔ سیلف مینیجڈ ڈیٹا لوڈنگ کو استعمال کرنے کی کچھ وجوہات یہ ہیں کہ پہلے سے تیار شدہ کوڈ کو دوبارہ استعمال کرکے ہجرت کی سہولت فراہم کرنا، اپنی مرضی کے مطابق ایرر ہینڈلنگ منطق کو لاگو کرنا، یا بنیادی کارکردگی اور شارڈنگ پر زیادہ کنٹرول حاصل کرنا۔ لائبریریوں کی مثالیں جنہیں آپ خود سے منظم ڈیٹا لوڈ کرنے کے لیے استعمال کر سکتے ہیں۔ torchdata.datapipes (پہلے AWS PyTorch S3 پلگ ان) اور ویب ڈیٹا سیٹ. AWS Python SDK بوٹو 3 کے ساتھ بھی ملایا جا سکتا ہے۔ ٹارچ ڈیٹاسیٹ اپنی مرضی کے مطابق ڈیٹا لوڈنگ کوڈ بنانے کے لیے کلاسز۔ حسب ضرورت ڈیٹا لوڈ کرنے والی کلاسیں سیج میکر ٹریننگ کے متضاد کلسٹرز کے تخلیقی استعمال کو بھی قابل بناتی ہیں، تاکہ سی پی یو اور جی پی یو بیلنس کو دیے گئے کام کے بوجھ کے مطابق بنایا جا سکے۔

ان اختیارات کے بارے میں مزید معلومات کے لیے اور ان کا انتخاب کرنے کے طریقے سے رجوع کریں۔ اپنے Amazon SageMaker ٹریننگ جاب کے لیے بہترین ڈیٹا سورس کا انتخاب کریں۔.

Amazon S3 کے ساتھ بڑے پیمانے پر تعامل کے لیے بہترین طریقے

ایمیزون S3 ڈیٹا ریڈنگ اور چیک پوائنٹنگ دونوں کے لیے LLM ورک بوجھ کو سنبھالنے کے قابل ہے۔ یہ حمایت کرتا ہے a درخواست کی شرح ایک بالٹی میں 3,500 PUT/COPY/POST/DELETE یا 5,500 GET/HEAD درخواستیں فی سیکنڈ فی پریفکس۔ تاہم، ضروری نہیں کہ یہ شرح ڈیفالٹ کے طور پر دستیاب ہو۔ اس کے بجائے، جیسے جیسے کسی سابقہ کے لیے درخواست کی شرح بڑھتی ہے، Amazon S3 بڑھی ہوئی شرح کو سنبھالنے کے لیے خود بخود اسکیل کرتا ہے۔ مزید معلومات کے لیے رجوع کریں۔ مجھے Amazon S503 سے 3 Slow Down کی غلطیاں کیوں مل رہی ہیں جب درخواستیں حمایت یافتہ درخواست کی شرح فی پریفکس کے اندر ہوں.

اگر آپ اعلی تعدد Amazon S3 تعامل کی توقع کرتے ہیں، تو ہم درج ذیل بہترین طریقوں کی تجویز کرتے ہیں:

- متعدد S3 بالٹیوں سے پڑھنے اور لکھنے کی کوشش کریں۔ پیش نظارہ. مثال کے طور پر، آپ ٹریننگ ڈیٹا اور چیک پوائنٹس کو مختلف سابقوں میں تقسیم کر سکتے ہیں۔

- ایمیزون S3 میٹرکس کو چیک کریں۔ ایمیزون کلاؤڈ واچ درخواست کی شرح کو ٹریک کرنے کے لیے۔

- بیک وقت PUT/GET کی مقدار کو کم سے کم کرنے کی کوشش کریں:

- ایک ہی وقت میں Amazon S3 کا استعمال کرتے ہوئے کم عمل کریں۔ مثال کے طور پر، اگر آٹھ پروسیس فی نوڈس کو Amazon S3 پر چیک پوائنٹ کرنے کی ضرورت ہے، تو آپ درجہ بندی کے مطابق چیک پوائنٹ کرکے PUT ٹریفک کو 8 کے فیکٹر سے کم کر سکتے ہیں: پہلے اندر نوڈ، پھر نوڈ سے Amazon S3 تک۔

- ہر تربیتی ریکارڈ کے لیے S3 GET استعمال کرنے کے بجائے ایک فائل یا S3 GET سے متعدد ٹریننگ ریکارڈ پڑھیں۔

- اگر آپ SageMaker FFM کے ذریعے Amazon S3 استعمال کرتے ہیں، SageMaker FFM فائلوں کو ٹکڑے ٹکڑے کرکے لانے کے لیے S3 کال کرتا ہے۔ FFM کے ذریعے پیدا کردہ Amazon S3 ٹریفک کو محدود کرنے کے لیے، ہم آپ کو فائلوں کو ترتیب وار پڑھنے اور متوازی طور پر کھولی گئی فائلوں کی تعداد کو محدود کرنے کی ترغیب دیتے ہیں۔

آپ کو ایک ہے تو ڈویلپر، کاروبار، یا انٹرپرائز سپورٹ پلان، آپ S3 503 Slow Down کی خرابیوں کے بارے میں تکنیکی معاونت کا کیس کھول سکتے ہیں۔ لیکن پہلے یہ یقینی بنائیں کہ آپ نے بہترین طریقوں پر عمل کیا ہے، اور درخواست کی شناخت حاصل کریں۔ ناکام درخواستوں کے لیے۔

متوازی تربیت

LLMs میں عام طور پر درجنوں سے سیکڑوں اربوں پیرامیٹرز ہوتے ہیں، جس کی وجہ سے وہ ایک NVIDIA GPU کارڈ میں فٹ ہونے کے لیے اتنے بڑے ہوتے ہیں۔ LLM پریکٹیشنرز نے کئی اوپن سورس لائبریریاں تیار کی ہیں جو LLM ٹریننگ کی تقسیم شدہ کمپیوٹیشن کی سہولت فراہم کرتی ہیں، بشمول ایف ایس ڈی پی, ڈیپ اسپیڈ اور Megatron کی. آپ ان لائبریریوں کو SageMaker Training میں چلا سکتے ہیں، لیکن آپ SageMaker کی تقسیم شدہ تربیتی لائبریریوں کو بھی استعمال کر سکتے ہیں، جو AWS Cloud کے لیے بہتر بنائی گئی ہیں اور ایک آسان ڈویلپر تجربہ فراہم کرتی ہیں۔ ڈیولپرز کے پاس سیج میکر پر اپنے LLM کی تقسیم شدہ تربیت کے لیے دو انتخاب ہیں: تقسیم شدہ لائبریریاں یا خود نظم۔

سیج میکر نے لائبریریاں تقسیم کیں۔

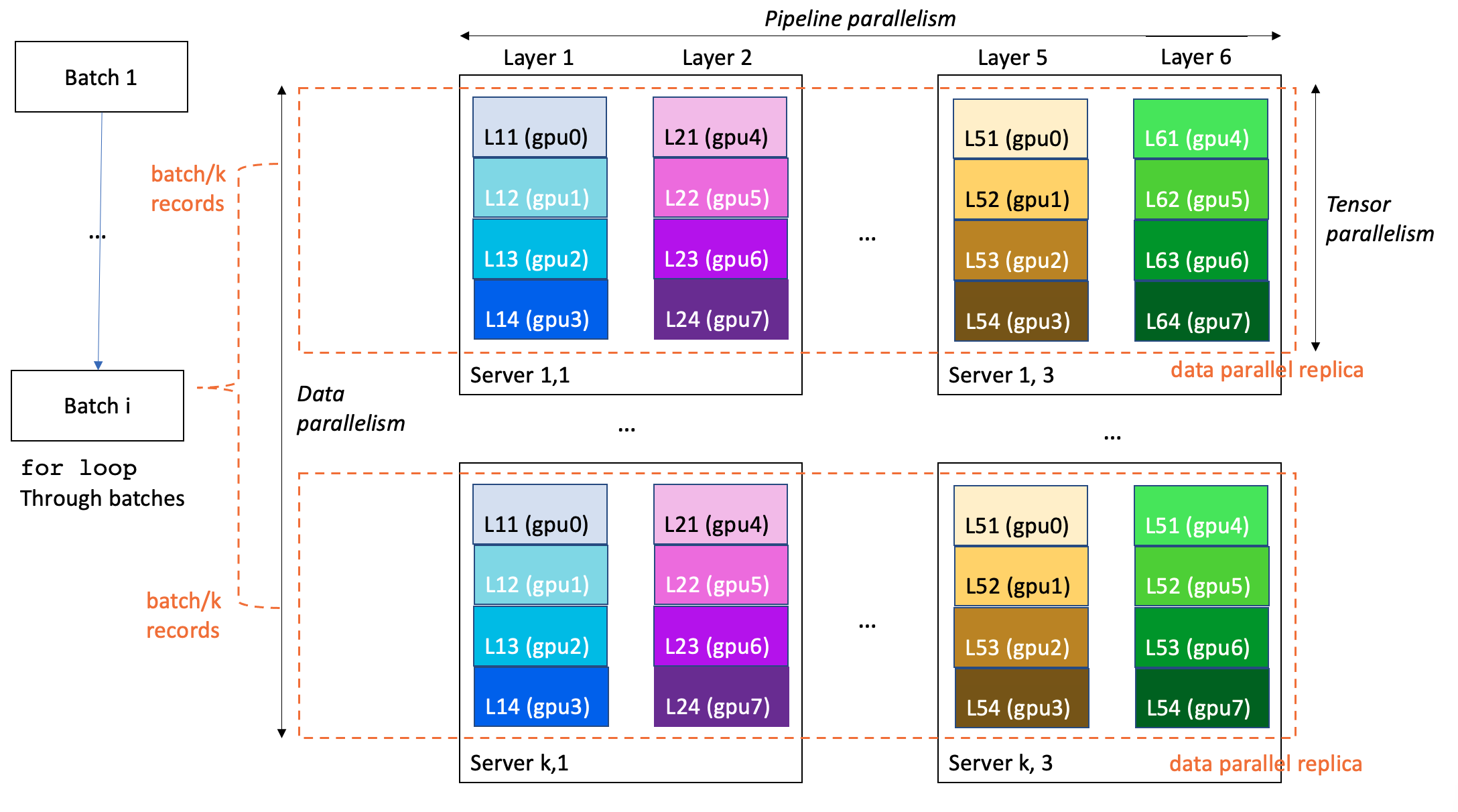

آپ کو بہتر تقسیم شدہ تربیتی کارکردگی اور قابل استعمال فراہم کرنے کے لیے، SageMaker Training TensorFlow اور PyTorch ٹریننگ کوڈ کو اسکیل کرنے کے لیے متعدد ملکیتی توسیعات کی تجویز پیش کرتی ہے۔ ایل ایل ایم کی تربیت اکثر 3D متوازی انداز میں کی جاتی ہے:

- ڈیٹا متوازی پروسیسنگ کی رفتار کو بڑھانے کے لیے ٹریننگ منی بیچز کو ماڈل کی متعدد ایک جیسی نقلوں میں تقسیم اور فیڈ کرتا ہے۔

- پائپ لائن متوازی ماڈل کی مختلف پرتوں کو مختلف GPUs یا یہاں تک کہ مثالوں سے منسوب کرتا ہے، تاکہ ماڈل کے سائز کو ایک GPU اور ایک سرور سے آگے بڑھایا جا سکے۔

- ٹینسر متوازی ایک واحد پرت کو ایک سے زیادہ GPUs میں تقسیم کرتا ہے، عام طور پر ایک ہی سرور کے اندر، انفرادی تہوں کو ایک GPU سے زیادہ سائز تک پیمانہ کرنے کے لیے

مندرجہ ذیل مثال میں، 6 لیئر ماڈل کو k*3 سرورز کے کلسٹر پر 8*k*3 GPUs (8 GPUs فی سرور) کے ساتھ تربیت دی جاتی ہے۔ ڈیٹا متوازی ڈگری k، پائپ لائن متوازی 6، اور ٹینسر متوازی 4 ہے۔ کلسٹر میں ہر GPU ماڈل کی ایک چوتھائی پرت پر مشتمل ہے، اور ایک مکمل ماڈل تین سرورز (مجموعی طور پر 24 GPUs) پر تقسیم کیا گیا ہے۔

ایل ایل ایم کے لیے درج ذیل خاص طور پر متعلقہ ہیں:

- SageMaker نے ماڈل متوازی تقسیم کیا۔ - یہ لائبریری گراف پارٹیشننگ کا استعمال کرتی ہے تاکہ رفتار یا میموری کے لیے بہتر بنائے گئے ذہین ماڈل پارٹیشننگ تیار کی جا سکے۔ SageMaker تقسیم شدہ ماڈل متوازی تازہ ترین اور سب سے بڑے ماڈل کی تربیت کی اصلاح کو ظاہر کرتا ہے، بشمول ڈیٹا متوازی، پائپ لائن متوازی، ٹینسر متوازی، آپٹیمائزر اسٹیٹ شارڈنگ، ایکٹیویشن چیک پوائنٹنگ، اور آف لوڈنگ۔ SageMaker کی تقسیم شدہ ماڈل متوازی لائبریری کے ساتھ، ہم نے 175 NVIDIA A920 GPUs پر 100-بلین پیرامیٹر ماڈل ٹریننگ کو دستاویزی شکل دی۔ مزید معلومات کے لیے رجوع کریں۔ Amazon SageMaker پر ماڈل کے متوازی اضافے اور Hugging Face کے ساتھ 175+ بلین پیرامیٹر NLP ماڈلز کو ٹرین کریں.

- سیج میکر نے ڈیٹا کو متوازی شارڈ کیا۔ میں ایم آئی سی ایس: پبلک کلاؤڈ پر دیو ہیکل ماڈل کی تربیت کے لیے قریبی لکیری اسکیلنگ, Zhang et al. ایک کم کمیونیکیشن ماڈل متوازی حکمت عملی متعارف کروائیں جو ماڈلز کو پورے کلسٹر کے بجائے صرف ڈیٹا کے متوازی گروپ پر تقسیم کرتی ہے۔ MiCS کے ساتھ، AWS سائنسدان EC176 P56.4de مثالوں پر 210-پرت 1.06-ٹریلین-پیرامیٹر ماڈل کی تربیت کے لیے 2 ٹیرا فلاپ فی GPU (نظریاتی چوٹی کا 4%) حاصل کرنے میں کامیاب ہوئے۔ MiCS اب سیج میکر ٹریننگ صارفین کے لیے بطور دستیاب ہے۔ سیج میکر نے ڈیٹا کو متوازی شارڈ کیا۔.

سیج میکر کی تقسیم شدہ تربیتی لائبریریاں اعلیٰ کارکردگی اور ایک آسان ڈویلپر کا تجربہ فراہم کرتی ہیں۔ خاص طور پر، ڈویلپرز کو حسب ضرورت متوازی عمل لانچر لکھنے اور برقرار رکھنے یا فریم ورک کے لیے مخصوص لانچ ٹول استعمال کرنے کی ضرورت نہیں ہے، کیونکہ متوازی لانچر جاب لانچ SDK میں بنایا گیا ہے۔

خود انتظام

سیج میکر ٹریننگ کے ساتھ، آپ کو اپنی پسند کا فریم ورک اور سائنسی نمونہ استعمال کرنے کی آزادی ہے۔ خاص طور پر، اگر آپ تقسیم شدہ تربیت کا خود انتظام کرنا چاہتے ہیں، تو آپ کے پاس اپنا حسب ضرورت کوڈ لکھنے کے لیے دو اختیارات ہیں:

- AWS ڈیپ لرننگ کنٹینر (DLC) استعمال کریں - AWS تیار اور برقرار رکھتا ہے۔ ڈی ایل سی، اعلی اوپن سورس ML فریم ورک کے لیے AWS سے بہتر ڈوکر پر مبنی ماحول فراہم کرنا۔ سیج میکر ٹریننگ میں ایک منفرد انضمام ہے جس کی مدد سے آپ AWS DLCs کو خارجی، صارف کی طرف سے طے شدہ انٹری پوائنٹ کے ساتھ کھینچ کر چلا سکتے ہیں۔ خاص طور پر LLM کی تربیت کے لیے، TensorFlow، PyTorch، Hugging Face، اور MXNet کے لیے AWS DLCs خاص طور پر متعلقہ ہیں۔ ایک فریم ورک DLC کا استعمال آپ کو اپنی Docker امیجز کو تیار کرنے اور ان کا نظم کیے بغیر، آپ کو فریم ورک کے مقامی متوازی، جیسے PyTorch Distributed کو استعمال کرنے کی اجازت دیتا ہے۔ مزید برآں، ہمارے DLCs میں ایک خصوصیت ہے۔ MPI انضمام، جو آپ کو آسانی سے متوازی کوڈ لانچ کرنے کی اجازت دیتا ہے۔

- اپنی مرضی کے مطابق سیج میکر کے موافق ڈاکر امیج لکھیں۔ - آپ اپنی (BYO) تصویر لا سکتے ہیں (دیکھیں۔ اپنی خود کی تربیتی الگورتھم استعمال کریں۔ اور ایمیزون سیج میکر کسٹم ٹریننگ کنٹینرز)، یا تو شروع سے شروع کرنا یا موجودہ DLC امیج کو بڑھانا۔ SageMaker پر LLM ٹریننگ کے لیے حسب ضرورت امیج استعمال کرتے وقت، درج ذیل کی تصدیق کرنا خاص طور پر اہم ہے:

- آپ کی تصویر مناسب ترتیبات کے ساتھ EFA پر مشتمل ہے (اس پوسٹ میں بعد میں مزید بحث کی جائے گی)

- آپ کی تصویر میں NVIDIA NCCL کمیونیکیشن لائبریری ہے، جو GPUDirectRDMA کے ساتھ فعال ہے

صارفین ڈیپ اسپیڈ سمیت متعدد خود انتظام شدہ تقسیم شدہ تربیتی لائبریریوں کو استعمال کرنے کے قابل ہو گئے ہیں۔

کموینیکیشن

LLM تربیتی ملازمت کی تقسیم شدہ نوعیت کے پیش نظر، کام کے بوجھ کی فزیبلٹی، کارکردگی اور اخراجات کے لیے انٹر مشین کمیونیکیشن بہت اہم ہے۔ اس سیکشن میں، ہم انٹر مشین کمیونیکیشن کے لیے کلیدی خصوصیات پیش کرتے ہیں اور انسٹالیشن اور ٹیوننگ کی تجاویز کے ساتھ اختتام کرتے ہیں۔

لچکدار فیبرک اڈاپٹر

ML ایپلی کیشنز کو تیز کرنے کے لیے، اور کلاؤڈ کے ذریعے فراہم کردہ لچک، توسیع پذیری، اور لچک کو حاصل کرکے کارکردگی کو بہتر بنانے کے لیے، آپ اس سے فائدہ اٹھا سکتے ہیں۔ لچکدار فیبرک اڈاپٹر (EFA) SageMaker کے ساتھ۔ ہمارے تجربے میں، تسلی بخش ملٹی نوڈ LLM تربیتی کارکردگی حاصل کرنے کے لیے EFA کا استعمال ضروری ہے۔

EFA ڈیوائس ایک نیٹ ورک انٹرفیس ہے جو EC2 مثالوں سے منسلک ہوتا ہے جس کا انتظام سیج میکر کے ذریعے تربیتی ملازمتوں کے دوران کیا جاتا ہے۔ EFA مثالوں کے مخصوص خاندانوں پر دستیاب ہے، بشمول P4d۔ EFA نیٹ ورک سینکڑوں Gbps تھرو پٹ حاصل کرنے کے قابل ہیں۔

EFA سے وابستہ، AWS نے متعارف کرایا ہے۔ قابل توسیع قابل اعتماد ڈیٹاگرام (SRD)، ایک ایتھرنیٹ پر مبنی نقل و حمل سے متاثر ہے۔ انفینی بینڈ قابل اعتماد ڈیٹاگرام، آرام دہ پیکٹ آرڈرنگ رکاوٹ کے ساتھ تیار ہوا۔ EFA اور SRD کے بارے میں مزید معلومات کے لیے رجوع کریں۔ کارکردگی کی تلاش میں، نیٹ ورک بنانے کے ایک سے زیادہ طریقے ہیں۔، ویڈیو EFA کیسے کام کرتا ہے اور ہم بادل میں infiniband کا استعمال کیوں نہیں کرتے ہیں۔، اور تحقیقی مقالہ لچکدار اور توسیع پذیر HPC کے لیے کلاؤڈ سے بہتر ٹرانسپورٹ پروٹوکول Shalev et al سے

آپ SageMaker کے موجودہ Docker کنٹینرز، یا SageMaker جابز کا استعمال کرتے ہوئے ML ماڈلز کی تربیت کے لیے استعمال کیے جانے والے حسب ضرورت کنٹینرز میں مطابقت پذیر مثالوں پر EFA انضمام شامل کر سکتے ہیں۔ مزید معلومات کے لیے رجوع کریں۔ EFA کے ساتھ ٹریننگ چلائیں۔. EFA اوپن سورس کے ذریعے سامنے آیا ہے۔ Libfabric مواصلاتی پیکج. تاہم، LLM ڈویلپرز شاذ و نادر ہی اسے براہ راست Libfabric کے ساتھ پروگرام کرتے ہیں، اور عام طور پر اس کے بجائے NVIDIA Collective Communications Library (NCCL) پر انحصار کرتے ہیں۔

AWS-OFI-NCCL پلگ ان

تقسیم شدہ ML میں، EFA اکثر NVIDIA Collective Communications Library (NCCL) کے ساتھ استعمال ہوتا ہے۔ NCCL ایک NVIDIA کی تیار کردہ اوپن سورس لائبریری ہے جو انٹر-GPU کمیونیکیشن الگورتھم کو نافذ کرتی ہے۔ انٹر-GPU کمیونیکیشن LLM ٹریننگ کا ایک سنگ بنیاد ہے جو اسکیل ایبلٹی اور کارکردگی کو متحرک کرتا ہے۔ ڈی ایل ٹریننگ کے لیے یہ اتنا اہم ہے کہ این سی سی ایل کو اکثر ڈیپ لرننگ ٹریننگ لائبریریوں میں کمیونیکیشن بیک اینڈ کے طور پر براہ راست مربوط کیا جاتا ہے، تاکہ LLM ڈویلپرز اسے اپنے ترجیحی Python DL ڈویلپمنٹ فریم ورک سے—بعض اوقات دیکھے بغیر—استعمال کریں۔ NCCL کو EFA پر استعمال کرنے کے لیے، LLM ڈویلپر AWS تیار کردہ استعمال کرتے ہیں۔ AWS OFI NCCL پلگ ان، جو EFA کے زیر استعمال Libfabric انٹرفیس پر NCCL کالز کا نقشہ بناتا ہے۔ ہم تجویز کرتے ہیں کہ حالیہ بہتریوں سے فائدہ اٹھانے کے لیے AWS OFI NCCL کا تازہ ترین ورژن استعمال کریں۔

اس بات کی تصدیق کرنے کے لیے کہ NCCL EFA استعمال کرتا ہے، آپ کو ماحولیاتی متغیر سیٹ کرنا چاہیے۔ NCCL_DEBUG کرنے کے لئے INFO، اور لاگ ان چیک کریں کہ EFA کو NCCL نے لوڈ کیا ہے:

NCCL اور EFA کنفیگریشن کے بارے میں مزید معلومات کے لیے رجوع کریں۔ اپنی EFA اور NCCL کنفیگریشن کی جانچ کریں۔. آپ این سی سی ایل کو کئی کے ساتھ مزید اپنی مرضی کے مطابق بنا سکتے ہیں۔ ماحولیاتی تغیرات. نوٹ کریں کہ NCCL 2.12 اور اس سے اوپر میں موثر، AWS نے EFA نیٹ ورکس (NCCL_ALGO سیٹ کیے بغیر چھوڑا جا سکتا ہے)۔

EFA پر NVIDIA GPUDirect RDMA

P4d مثال کی قسم کے ساتھ، ہم متعارف GPUDirect RDMA (GDR) EFA فیبرک پر۔ یہ نیٹ ورک انٹرفیس کارڈز (NICs) کو براہ راست GPU میموری تک رسائی کے قابل بناتا ہے، جس سے NVIDIA GPU پر مبنی EC2 مثالوں میں ریموٹ GPU سے GPU مواصلت تیز تر ہوتی ہے، CPUs اور صارف کی ایپلی کیشنز پر آرکیسٹریشن اوور ہیڈ کو کم کرتا ہے۔ جی ڈی آر کو NCCL کی طرف سے ہڈ کے نیچے استعمال کیا جاتا ہے، جب ممکن ہو۔

GDR کا استعمال انٹر-GPU کمیونیکیشن میں ظاہر ہوتا ہے جب لاگ لیول کو INFO پر سیٹ کیا جاتا ہے، جیسا کہ درج ذیل کوڈ میں ہے:

AWS ڈیپ لرننگ کنٹینرز میں EFA کا استعمال

AWS ڈیپ لرننگ کنٹینرز (DLCs) کو برقرار رکھتا ہے، جن میں سے بہت سے AWS کے زیر انتظام ڈاکر فائلز کے ساتھ آتے ہیں اور EFA، AWS OFI NCCL، اور NCCL پر مشتمل ہوتے ہیں۔ مندرجہ ذیل GitHub repos اس کے ساتھ مثالیں پیش کرتے ہیں۔ پی ٹورچ اور TensorFlow. آپ کو خود ان لائبریریوں کو انسٹال کرنے کی ضرورت نہیں ہے۔

اپنے سیج میکر ٹریننگ کنٹینر میں ای ایف اے کا استعمال

اگر آپ اپنا SageMaker ٹریننگ کنٹینر بناتے ہیں اور تیز رفتار انٹر نوڈ کمیونیکیشن کے لیے NCCL کو EFA پر استعمال کرنا چاہتے ہیں، تو آپ کو EFA، NCCL، اور AWS OFI NCCL انسٹال کرنے کی ضرورت ہے۔ مزید معلومات کے لیے رجوع کریں۔ EFA کے ساتھ ٹریننگ چلائیں۔ مزید برآں، آپ کو اپنے کنٹینر میں یا اپنے انٹری پوائنٹ کوڈ میں درج ذیل ماحولیاتی متغیرات کو سیٹ کرنا چاہیے:

FI_PROVIDER="efa"فیبرک انٹرفیس فراہم کنندہ کی وضاحت کرتا ہے۔NCCL_PROTO=simpleNCCL کو مواصلات کے لیے ایک سادہ پروٹوکول استعمال کرنے کی ہدایت کرتا ہے (فی الحال، EFA فراہم کنندہ LL پروٹوکول کی حمایت نہیں کرتا؛ ان کو فعال کرنے سے ڈیٹا بدعنوانی کا باعث بن سکتا ہے)FI_EFA_USE_DEVICE_RDMA=1آلہ کی RDMA فعالیت کو یک طرفہ اور دو طرفہ منتقلی کے لیے استعمال کرتا ہے۔NCCL_LAUNCH_MODE="PARALLEL"NCCL_NET_SHARED_COMMS="0"

آرکیسٹریشن

درجنوں سے سیکڑوں کمپیوٹ مثالوں کے لائف سائیکل اور کام کے بوجھ کو منظم کرنے کے لیے آرکیسٹریشن سافٹ ویئر کی ضرورت ہوتی ہے۔ اس سیکشن میں، ہم LLM آرکیسٹریشن کے لیے بہترین طریقے پیش کرتے ہیں۔

اندرونِ ملازمت آرکیسٹریشن

ڈویلپرز کو زیادہ تر تقسیم شدہ فریم ورک میں سرور سائیڈ ٹریننگ کوڈ اور کلائنٹ سائڈ لانچر کوڈ دونوں لکھنا چاہیے۔ ٹریننگ کوڈ ٹریننگ مشینوں پر چلتا ہے، جبکہ کلائنٹ سائیڈ لانچر کوڈ کلائنٹ مشین سے تقسیم شدہ کام کا بوجھ شروع کرتا ہے۔ آج بہت کم معیاری کاری ہے، مثال کے طور پر:

- PyTorch میں، ڈویلپرز کا استعمال کرتے ہوئے ملٹی مشین ٹاسک شروع کر سکتے ہیں۔

torchrun,torchx,torch.distributed.launch(فرسودگی کا راستہ)، یاtorch.multiprocessing.spawn - ڈیپ اسپیڈ اپنا ڈیپ اسپیڈ CLI لانچر تجویز کرتا ہے اور MPI لانچ کو بھی سپورٹ کرتا ہے۔

- MPI ایک مقبول متوازی کمپیوٹنگ فریم ورک ہے جس کا فائدہ ML-agnostic اور معقول مدت کا ہے، اور اس لیے مستحکم اور دستاویزی ہے، اور تقسیم شدہ ML ورک بوجھ میں تیزی سے دیکھا جاتا ہے۔

سیج میکر ٹریننگ کلسٹر میں، ٹریننگ کنٹینر ہر مشین پر ایک بار لانچ کیا جاتا ہے۔ اس کے نتیجے میں، آپ کے پاس تین اختیارات ہیں:

- مقامی لانچر – آپ کسی خاص DL فریم ورک کے مقامی لانچر کو بطور انٹری پوائنٹ استعمال کر سکتے ہیں، مثال کے طور پر a

torchrunکال، جو خود ایک سے زیادہ مقامی عمل کو جنم دے گا اور تمام مثالوں میں مواصلات قائم کرے گا۔ - سیج میکر MPI انضمام - آپ SageMaker MPI انضمام کا استعمال کر سکتے ہیں، جو ہمارے AWS DLC میں دستیاب ہے، یا بذریعہ خود انسٹال کیا جا سکتا ہے۔ سیج میکر ٹریننگ ٹول کٹ، براہ راست اپنے انٹری پوائنٹ کوڈ کو N بار فی مشین چلانے کے لیے۔ یہ آپ کے اپنے کوڈ میں بیچوان، فریم ورک کے لیے مخصوص لانچر اسکرپٹس کے استعمال سے بچنے کا فائدہ رکھتا ہے۔

- سیج میکر نے لائبریریاں تقسیم کیں۔ – اگر آپ سیج میکر کی تقسیم شدہ لائبریریوں کا استعمال کرتے ہیں، تو آپ ٹریننگ کوڈ پر توجہ مرکوز کر سکتے ہیں اور آپ کو لانچر کوڈ بالکل بھی لکھنے کی ضرورت نہیں ہے! SageMaker تقسیم شدہ لانچر کوڈ SageMaker SDK میں بنایا گیا ہے۔

انٹر جاب آرکیسٹریشن

ایل ایل ایم پروجیکٹس اکثر متعدد ملازمتوں پر مشتمل ہوتے ہیں: پیرامیٹر کی تلاش، اسکیلنگ کے تجربات، غلطیوں سے بازیافت، اور بہت کچھ۔ تربیتی کاموں کو شروع کرنے، روکنے اور متوازی بنانے کے لیے، جاب آرکیسٹریٹر کا استعمال کرنا ضروری ہے۔ سیج میکر ٹریننگ ایک سرور لیس ایم ایل جاب آرکیسٹریٹر ہے جو درخواست پر فوری طور پر عارضی کمپیوٹ مثالوں کا انتظام کرتا ہے۔ آپ صرف اس کی ادائیگی کرتے ہیں جو آپ استعمال کرتے ہیں، اور جیسے ہی آپ کا کوڈ ختم ہوتا ہے کلسٹرز ختم ہو جاتے ہیں۔ کے ساتھ سیج میکر ٹریننگ گرم تالاب، آپ کے پاس تربیتی کلسٹرز پر رہنے کے لیے وقت کی وضاحت کرنے کا اختیار ہے، تاکہ ملازمتوں میں اسی بنیادی ڈھانچے کو دوبارہ استعمال کیا جا سکے۔ اس سے تکرار کا وقت اور انٹر جاب پلیسمنٹ کی تبدیلی میں کمی آتی ہے۔ سیج میکر کی ملازمتیں مختلف پروگرامنگ زبانوں سے شروع کی جا سکتی ہیں، بشمول ازگر اور CLI.

SageMaker کے لیے مخصوص Python SDK ہے جسے کہا جاتا ہے۔ SageMaker Python SDK اور کے ذریعے نافذ کیا گیا۔ sagemaker Python لائبریری، لیکن اس کا استعمال اختیاری ہے۔

ایک بڑے اور طویل تربیتی کلسٹر کے ساتھ تربیتی ملازمتوں کے کوٹے میں اضافہ

SageMaker کے پاس وسائل پر پہلے سے طے شدہ کوٹے ہیں، جو غیر ارادی استعمال اور اخراجات کو روکنے کے لیے بنائے گئے ہیں۔ طویل عرصے تک چلنے والے اعلی درجے کی مثالوں کے ایک بڑے کلسٹر کا استعمال کرتے ہوئے ایل ایل ایم کو تربیت دینے کے لیے، آپ کو ممکنہ طور پر درج ذیل جدول میں کوٹہ بڑھانے کی ضرورت ہوگی۔

| کوٹہ کا نام | پہلے سے طے شدہ قیمت |

| تربیتی کام کے لیے سب سے طویل وقت | 432,000 سیکنڈ |

| تمام تربیتی ملازمتوں میں مثالوں کی تعداد | 4 |

| فی تربیتی کام مثالوں کی زیادہ سے زیادہ تعداد | 20 |

| تربیتی ملازمت کے استعمال کے لیے ml.p4d.24xlarge | 0 |

| گرم پول کے استعمال کی تربیت کے لیے ml.p4d.24xlarge | 0 |

ملاحظہ کریں AWS سروس کوٹہ اپنے کوٹہ کی قدروں کو کیسے دیکھیں اور کوٹہ بڑھانے کی درخواست کریں۔ آن ڈیمانڈ، اسپاٹ انسٹینس، اور ٹریننگ وارم پولز کوٹہ کو الگ الگ ٹریک اور تبدیل کیا جاتا ہے۔

اگر آپ سیج میکر پروفائلر کو فعال رکھنے کا فیصلہ کرتے ہیں، تو آگاہ رہیں کہ ہر تربیتی جاب سیج میکر پروسیسنگ جاب کا آغاز کرتا ہے، ہر ایک ml.m5.2x بڑی مثال استعمال کرتا ہے۔ تصدیق کریں کہ آپ کا SageMaker پروسیسنگ کوٹہ کافی زیادہ ہے تاکہ متوقع تربیتی ملازمت کی ہم آہنگی کو ایڈجسٹ کیا جا سکے۔ مثال کے طور پر، اگر آپ بیک وقت چلنے والی 50 پروفائلر کے ساتھ چلنے والی تربیتی نوکریاں شروع کرنا چاہتے ہیں، تو آپ کو ملازمت کے استعمال کی حد کو 5.2 تک پروسیس کرنے کے لیے ml.m50xlarge کو بڑھانا ہوگا۔

مزید برآں، طویل عرصے سے چلنے والی نوکری شروع کرنے کے لیے، آپ کو واضح طور پر سیٹ کرنا ہوگا۔ تخمینہ max_run سیکنڈوں میں ٹریننگ جاب کے لیے مطلوبہ زیادہ سے زیادہ دورانیے کا پیرامیٹر، ٹریننگ جاب کے لیے سب سے طویل رن ٹائم کے کوٹہ ویلیو تک۔

نگرانی اور لچک

ہارڈ ویئر کی ناکامی کسی ایک مثال کے پیمانے پر انتہائی نایاب ہے اور ایک ساتھ استعمال ہونے والے واقعات کی تعداد بڑھنے کے ساتھ ساتھ زیادہ سے زیادہ بار بار ہوتی جاتی ہے۔ عام LLM پیمانے پر—ہفتوں سے مہینوں تک 24/7 استعمال ہونے والے سیکڑوں سے ہزاروں GPUs—ہارڈ ویئر کی ناکامی کا ہونا یقینی ہے۔ لہذا، LLM کام کے بوجھ کو مناسب نگرانی اور لچک کے طریقہ کار کو نافذ کرنا چاہیے۔ سب سے پہلے، ناکامیوں کے اثرات کو محدود کرنے اور کمپیوٹ وسائل کے استعمال کو بہتر بنانے کے لیے، LLM انفراسٹرکچر کی قریب سے نگرانی کرنا ضروری ہے۔ سیج میکر ٹریننگ اس مقصد کے لیے کئی خصوصیات تجویز کرتی ہے:

- لاگز خود بخود CloudWatch لاگز کو بھیجے جاتے ہیں۔ لاگز میں آپ کی ٹریننگ اسکرپٹ شامل ہے۔

stdoutاورstderr. MPI کی بنیاد پر تقسیم شدہ تربیت میں، تمام MPI کارکنان لیڈر کے عمل کو اپنے لاگ بھیجتے ہیں۔ - سسٹم کے وسائل کے استعمال کے میٹرکس جیسے میموری، CPU کا استعمال، اور GPU استعمال، خودکار طور پر CloudWatch کو بھیج دیا جاتا ہے۔

- آپ کسٹم ٹریننگ میٹرکس کی وضاحت کریں۔ جو CloudWatch کو بھیج دیا جائے گا۔ میٹرکس آپ کے سیٹ کردہ ریگولر ایکسپریشنز کی بنیاد پر لاگز سے حاصل کیے جاتے ہیں۔ تیسری پارٹی کے تجرباتی پیکجز جیسے AWS پارٹنر وزن اور تعصب کی پیشکش سیج میکر ٹریننگ کے ساتھ استعمال کی جا سکتی ہے (مثال کے طور پر، دیکھیں W&B اور SageMaker کے ساتھ CIFAR-10 ہائپر پیرامیٹرز کو بہتر بنانا).

- سیج میکر پروفائلر آپ کو بنیادی ڈھانچے کے استعمال کا معائنہ کرنے اور اصلاح کی سفارشات حاصل کرنے کی اجازت دیتا ہے۔

- ایمیزون ایونٹ برج اور او ڈبلیو ایس لامبڈا۔ آپ کو خودکار کلائنٹ لاجک تخلیق کرنے کی اجازت دیتا ہے جو کام کی ناکامی، کامیابیاں، S3 فائل اپ لوڈ، اور مزید واقعات پر ردعمل ظاہر کرتا ہے۔

- سیج میکر ایس ایس ایچ مددگار ایک کمیونٹی کے زیر انتظام اوپن سورس لائبریری ہے جو آپ کو SSH کے ذریعے تربیتی ملازمت کے میزبانوں سے منسلک ہونے کی اجازت دیتی ہے۔ مخصوص نوڈس پر چلنے والے کوڈ کا معائنہ کرنے اور ان کا ازالہ کرنے میں مددگار ثابت ہو سکتا ہے۔

نگرانی کے علاوہ، SageMaker ملازمت کی لچک کے لیے سامان بھی لاتا ہے:

- کلسٹر ہیلتھ چیکس - آپ کا کام شروع ہونے سے پہلے، SageMaker GPU کی صحت کی جانچ کرتا ہے اور GPU مثالوں پر NCCL کمیونیکیشن کی تصدیق کرتا ہے، اگر ضروری ہو تو کسی بھی ناقص مثال کو تبدیل کرتا ہے تاکہ یہ یقینی بنایا جا سکے کہ آپ کی ٹریننگ اسکرپٹ مثالوں کے ایک صحت مند کلسٹر پر چلنا شروع ہو جائے۔ صحت کی جانچ فی الحال P اور G GPU پر مبنی مثال کی اقسام کے لیے فعال ہے۔

- بلٹ ان دوبارہ کوششیں اور کلسٹر اپ ڈیٹ - آپ سیج میکر کو خود بخود ترتیب دے سکتے ہیں۔ دوبارہ کوشش تربیتی ملازمتیں جو SageMaker اندرونی سرور کی خرابی (ISE) کے ساتھ ناکام ہوجاتی ہیں۔ نوکری کی دوبارہ کوشش کرنے کے حصے کے طور پر، SageMaker کسی بھی ایسی مثال کو بدل دے گا جس میں ناقابل بازیافت GPU کی خرابیوں کا سامنا ہوا ہو، تازہ مثالوں کے ساتھ، تمام صحت مند مثالوں کو ریبوٹ کریں، اور دوبارہ کام شروع کریں۔ اس کے نتیجے میں تیزی سے دوبارہ شروع ہوتا ہے اور کام کا بوجھ مکمل ہوتا ہے۔ کلسٹر اپ ڈیٹ فی الحال P اور G GPU پر مبنی مثال کی اقسام کے لیے فعال ہے۔ آپ اپنی ذات میں شامل کر سکتے ہیں۔ دوبارہ کوشش کرنے کا طریقہ کار کلائنٹ کوڈ کے ارد گرد جو جاب جمع کرتا ہے، دوسری قسم کی لانچ کی خرابیوں کو سنبھالنے کے لیے، جیسے کہ آپ کے اکاؤنٹ کے کوٹہ سے تجاوز کرنا۔

- آٹومیٹڈ ایمیزون S3 پر چیک پوائنٹ - یہ آپ کی مدد کرتا ہے۔ چوکی اپنی ترقی اور نئی ملازمتوں پر ماضی کی حالت کو دوبارہ لوڈ کریں۔

نوڈ لیول کی تبدیلی سے فائدہ اٹھانے کے لیے، آپ کے کوڈ میں غلطی ہونی چاہیے۔ جب کوئی نوڈ ناکام ہو جاتا ہے تو اجتماعی غلطی کی بجائے لٹک سکتے ہیں۔ اس لیے، فوری تدارک کے لیے، اپنے اجتماعات پر صحیح طریقے سے ٹائم آؤٹ سیٹ کریں اور کوڈ تک پہنچنے پر غلطی کو پھینک دیں۔

کچھ گاہک جاب ہینگ یا ایپلیکیشن کنورجنسس رکنے کی صورت میں نگرانی اور عمل کرنے کے لیے ایک مانیٹرنگ کلائنٹ ترتیب دیتے ہیں، CloudWatch لاگز اور غیر معمولی نمونوں کے لیے میٹرکس کی نگرانی کر کے جیسے کہ کوئی لاگ نہیں لکھا ہوا یا 0% GPU استعمال ہینگ، کنورجنسی رکنے، اور آٹو کا اشارہ دینے کے لیے۔ کام کو روکیں/دوبارہ کوشش کریں۔

چیک پوائنٹ پر گہرا غوطہ لگانا

۔ سیج میکر چیک پوائنٹ فیچر ہر چیز کی کاپی کرتا ہے جس پر آپ لکھتے ہیں۔ /opt/ml/checkpoints ایمیزون S3 پر واپس جائیں جیسا کہ URI میں بیان کیا گیا ہے۔ checkpoint_s3_uri SDK پیرامیٹر۔ جب کوئی کام شروع ہوتا ہے یا دوبارہ شروع ہوتا ہے، اس URI پر لکھی ہوئی ہر چیز کو تمام مشینوں کو واپس بھیج دیا جاتا ہے۔ /opt/ml/checkpoints. یہ آسان ہے اگر آپ چاہتے ہیں کہ تمام نوڈس کو تمام چیک پوائنٹس تک رسائی حاصل ہو، لیکن پیمانے پر — جب آپ کے پاس بہت سی مشینیں یا بہت سے تاریخی چوکیاں ہوں، تو یہ Amazon S3 پر ڈاؤن لوڈ کے طویل وقت اور بہت زیادہ ٹریفک کا باعث بن سکتا ہے۔ مزید برآں، ٹینسر اور پائپ لائن کے متوازی میں، کارکنوں کو چیک پوائنٹ والے ماڈل کے صرف ایک حصے کی ضرورت ہوتی ہے، نہ کہ تمام۔ اگر آپ کو ان حدود کا سامنا ہے، تو ہم درج ذیل اختیارات کی تجویز کرتے ہیں:

- چمک کے لیے FSx کو چیک پوائنٹ کرنا - اعلی کارکردگی کے بے ترتیب I/O کی بدولت، آپ اپنی پسند کی شارڈنگ اور فائل انتساب اسکیم کی وضاحت کر سکتے ہیں۔

- خود منظم ایمیزون S3 چیک پوائنٹنگ - ازگر کے فنکشنز کی مثالوں کے لیے جنہیں بلاک نہ کرنے والے انداز میں چیک پوائنٹس کو محفوظ کرنے اور پڑھنے کے لیے استعمال کیا جا سکتا ہے، دیکھیں چوکیوں کو بچانا

ہم پرزور مشورہ دیتے ہیں کہ آپ کے ماڈل کو ہر چند گھنٹوں میں چیک کریں، مثال کے طور پر 1–3 گھنٹے، متعلقہ اوور ہیڈ اور اخراجات پر منحصر ہے۔

فرنٹ اینڈ اور یوزر مینجمنٹ

وراثت میں مشترکہ HPC انفراسٹرکچر کے مقابلے میں صارف کا انتظام SageMaker کی ایک اہم قابل استعمال طاقت ہے۔ سیج میکر ٹریننگ کی اجازتوں پر متعدد افراد کی حکمرانی ہے۔ AWS شناخت اور رسائی کا انتظام (IAM) تجرید:

- پرنسپلز — صارفین اور سسٹم — کو وسائل شروع کرنے کی اجازت دی جاتی ہے۔

- تربیتی ملازمتوں میں خود کردار ہوتے ہیں، جو انہیں اپنی اجازت حاصل کرنے کی اجازت دیتے ہیں، مثال کے طور پر ڈیٹا تک رسائی اور خدمت کی درخواست کے بارے میں

مزید برآں، 2022 میں ہم نے شامل کیا۔ سیج میکر رول مینیجر شخصیت پر مبنی اجازتوں کی تخلیق کو آسان بنانے کے لیے۔

نتیجہ

سیج میکر ٹریننگ کے ساتھ، آپ اخراجات کو کم کر سکتے ہیں اور اپنے بڑے ماڈل ٹریننگ ورک بوجھ پر تکرار کی رفتار بڑھا سکتے ہیں۔ ہم نے کامیابی کی کہانیوں کو متعدد پوسٹس اور کیس اسٹڈیز میں دستاویز کیا ہے، بشمول:

اگر آپ اپنے اخراجات کو کم کرتے ہوئے اپنے LLM ٹائم ٹو مارکیٹ کو بہتر بنانا چاہتے ہیں، تو SageMaker Training API پر ایک نظر ڈالیں اور ہمیں بتائیں کہ آپ کیا بناتے ہیں!

امر رگاب، رشیکا کھیریا، زمناکو آورہمان، ارون ناگراجن، گال اوشری کا ان کے مفید جائزوں اور تعلیمات کے لیے خصوصی شکریہ۔

مصنفین کے بارے میں

Anastasia Tzeveleka AWS میں مشین لرننگ اور AI سپیشلسٹ سولیوشن آرکیٹیکٹ ہے۔ وہ EMEA میں صارفین کے ساتھ کام کرتی ہے اور AWS سروسز کا استعمال کرتے ہوئے پیمانے پر مشین لرننگ سلوشنز کی تعمیر میں ان کی مدد کرتی ہے۔ اس نے مختلف ڈومینز میں پروجیکٹس پر کام کیا ہے جن میں نیچرل لینگویج پروسیسنگ (NLP)، MLOps اور Low Code No Code ٹولز شامل ہیں۔

Anastasia Tzeveleka AWS میں مشین لرننگ اور AI سپیشلسٹ سولیوشن آرکیٹیکٹ ہے۔ وہ EMEA میں صارفین کے ساتھ کام کرتی ہے اور AWS سروسز کا استعمال کرتے ہوئے پیمانے پر مشین لرننگ سلوشنز کی تعمیر میں ان کی مدد کرتی ہے۔ اس نے مختلف ڈومینز میں پروجیکٹس پر کام کیا ہے جن میں نیچرل لینگویج پروسیسنگ (NLP)، MLOps اور Low Code No Code ٹولز شامل ہیں۔

گلی ناچم ایک سینئر AI/ML ماہر حل آرکیٹیکٹ ہے جو EMEA Amazon مشین لرننگ ٹیم کے حصے کے طور پر کام کرتا ہے۔ Gili گہری سیکھنے کے ماڈلز کی تربیت کے چیلنجوں کے بارے میں پرجوش ہے، اور کس طرح مشین لرننگ دنیا کو بدل رہی ہے جیسا کہ ہم جانتے ہیں۔ اپنے فارغ وقت میں گیلی ٹیبل ٹینس کھیلنے سے لطف اندوز ہوتے ہیں۔

گلی ناچم ایک سینئر AI/ML ماہر حل آرکیٹیکٹ ہے جو EMEA Amazon مشین لرننگ ٹیم کے حصے کے طور پر کام کرتا ہے۔ Gili گہری سیکھنے کے ماڈلز کی تربیت کے چیلنجوں کے بارے میں پرجوش ہے، اور کس طرح مشین لرننگ دنیا کو بدل رہی ہے جیسا کہ ہم جانتے ہیں۔ اپنے فارغ وقت میں گیلی ٹیبل ٹینس کھیلنے سے لطف اندوز ہوتے ہیں۔

اولیور کروچنٹ فرانس میں مقیم AWS میں پرنسپل مشین لرننگ اسپیشلسٹ سولیوشن آرکیٹیکٹ ہیں۔ Olivier AWS صارفین کی مدد کرتا ہے – چھوٹے سٹارٹ اپ سے لے کر بڑے اداروں تک – پروڈکشن گریڈ مشین لرننگ ایپلی کیشنز کو تیار اور تعینات کرتا ہے۔ اپنے فارغ وقت میں، وہ تحقیقی مقالے پڑھنے اور دوستوں اور خاندان کے ساتھ بیابانوں کی سیر کرنے سے لطف اندوز ہوتے ہیں۔

اولیور کروچنٹ فرانس میں مقیم AWS میں پرنسپل مشین لرننگ اسپیشلسٹ سولیوشن آرکیٹیکٹ ہیں۔ Olivier AWS صارفین کی مدد کرتا ہے – چھوٹے سٹارٹ اپ سے لے کر بڑے اداروں تک – پروڈکشن گریڈ مشین لرننگ ایپلی کیشنز کو تیار اور تعینات کرتا ہے۔ اپنے فارغ وقت میں، وہ تحقیقی مقالے پڑھنے اور دوستوں اور خاندان کے ساتھ بیابانوں کی سیر کرنے سے لطف اندوز ہوتے ہیں۔

برونو پسٹن میلان میں مقیم AWS کے لیے ایک AI/ML ماہر حل آرکیٹیکٹ ہے۔ وہ کسی بھی سائز کے صارفین کے ساتھ ان کی تکنیکی ضروریات کو گہرائی سے سمجھنے اور AI اور مشین لرننگ سلوشنز کو ڈیزائن کرنے میں ان کی مدد کرنے پر کام کرتا ہے جو AWS Cloud اور Amazon Machine Learning Stack کا بہترین استعمال کرتے ہیں۔ ان کی مہارت کا شعبہ مشین لرننگ اینڈ ٹو اینڈ، مشین لرننگ انڈسٹریلائزیشن اور ایم ایل او پیز ہیں۔ وہ اپنے دوستوں کے ساتھ وقت گزارنے اور نئی جگہوں کی تلاش کے ساتھ ساتھ نئی منزلوں کا سفر کرنے میں بھی لطف اندوز ہوتا ہے۔

برونو پسٹن میلان میں مقیم AWS کے لیے ایک AI/ML ماہر حل آرکیٹیکٹ ہے۔ وہ کسی بھی سائز کے صارفین کے ساتھ ان کی تکنیکی ضروریات کو گہرائی سے سمجھنے اور AI اور مشین لرننگ سلوشنز کو ڈیزائن کرنے میں ان کی مدد کرنے پر کام کرتا ہے جو AWS Cloud اور Amazon Machine Learning Stack کا بہترین استعمال کرتے ہیں۔ ان کی مہارت کا شعبہ مشین لرننگ اینڈ ٹو اینڈ، مشین لرننگ انڈسٹریلائزیشن اور ایم ایل او پیز ہیں۔ وہ اپنے دوستوں کے ساتھ وقت گزارنے اور نئی جگہوں کی تلاش کے ساتھ ساتھ نئی منزلوں کا سفر کرنے میں بھی لطف اندوز ہوتا ہے۔

- SEO سے چلنے والا مواد اور PR کی تقسیم۔ آج ہی بڑھا دیں۔

- پلیٹو بلاک چین۔ Web3 Metaverse Intelligence. علم میں اضافہ۔ یہاں تک رسائی حاصل کریں۔

- ماخذ: https://aws.amazon.com/blogs/machine-learning/training-large-language-models-on-amazon-sagemaker-best-practices/

- : ہے

- ][p

- $UP

- 000

- 1

- 100

- 2022

- 7

- 8

- a

- صلاحیتوں

- قابلیت

- ہمارے بارے میں

- اوپر

- رفتار کو تیز تر

- تیز

- تک رسائی حاصل

- ایڈجسٹ کریں

- اکاؤنٹ

- حاصل

- حصول

- کے پار

- ایکٹ

- چالو کرنے کی

- فعال

- اپنانے

- شامل کیا

- اس کے علاوہ

- اس کے علاوہ

- اضافے

- فائدہ

- AI

- AI / ML

- AL

- یلگورتم

- یلگوردمز

- تمام

- اجازت دے رہا ہے

- کی اجازت دیتا ہے

- ایمیزون

- ایمیزون EC2

- ایمیزون ایف ایس ایکس

- ایمیزون مشین لرننگ

- ایمیزون سیج میکر

- رقم

- اور

- اے پی آئی

- APIs

- قابل اطلاق

- درخواست

- ایپلی کیشنز

- اطلاقی

- مناسب

- کیا

- رقبہ

- ارد گرد

- AS

- منسلک

- At

- اوصاف

- آٹو

- آٹومیٹڈ

- خود کار طریقے سے

- دستیاب

- گریز

- AWS

- واپس

- پسدید

- متوازن

- کی بنیاد پر

- BE

- کیونکہ

- ہو جاتا ہے

- اس سے پہلے

- کیا جا رہا ہے

- فائدہ

- BEST

- بہترین طریقوں

- سے پرے

- بگ

- ارب

- اربوں

- بلاک

- لانے

- لاتا ہے

- تعمیر

- تعمیر

- کاروبار

- by

- فون

- کہا جاتا ہے

- کالز

- کر سکتے ہیں

- صلاحیت رکھتا

- اہلیت

- کارڈ

- کارڈ

- لے جانے کے

- کیس

- کیس اسٹڈیز

- کیٹلیز

- چیلنجوں

- تبدیل کرنے

- چینل

- چیک کریں

- چیک

- انتخاب

- انتخاب

- میں سے انتخاب کریں

- کلاس

- کلائنٹ

- قریب سے

- بادل

- کلسٹر

- کوڈ

- اجتماعی

- مل کر

- کس طرح

- کامن

- عام طور پر

- مواصلات

- کموینیکیشن

- مقابلے میں

- ہم آہنگ

- تکمیل

- حساب

- کمپیوٹنگ

- کمپیوٹر

- کمپیوٹر ویژن

- کمپیوٹنگ

- نتیجہ اخذ

- منعقد

- ترتیب

- کی توثیق

- رابطہ قائم کریں

- اس کے نتیجے میں

- پر مشتمل ہے

- کنٹینر

- کنٹینر

- پر مشتمل ہے

- مواد

- حصہ ڈالا

- کنٹرول

- کنٹرول

- آسان

- کنورجنس

- فساد

- قیمت

- اخراجات

- سکتا ہے

- کورس

- احاطہ

- کا احاطہ کرتا ہے

- تخلیق

- مخلوق

- تخلیقی

- اہم

- اہم

- کیپشن

- اس وقت

- اپنی مرضی کے

- گاہکوں

- اپنی مرضی کے مطابق

- اعداد و شمار

- ڈیٹا تک رسائی

- ڈیٹا کی تیاری

- ڈیٹاسیٹس

- فیصلہ کرنا

- وقف

- گہری

- گہری سیکھنے

- پہلے سے طے شدہ

- ڈگری

- منحصر ہے

- انحصار کرتا ہے

- تعیناتی

- ڈیزائن

- ڈیزائن

- مطلوبہ

- منزلوں

- اس بات کا تعین

- کا تعین کرنے

- ترقی

- ترقی یافتہ

- ڈیولپر

- ڈویلپرز

- ترقی

- تیار ہے

- آلہ

- کے الات

- مختلف

- براڈ کاسٹننگ

- براہ راست

- بات چیت

- بات چیت

- تقسیم کئے

- تقسیم کمپیوٹنگ

- تقسیم کی تربیت

- تقسیم

- میں Docker

- نہیں کرتا

- ڈومینز

- نہیں

- نیچے

- ڈاؤن لوڈ، اتارنا

- درجنوں

- کے دوران

- ہر ایک

- آسانی سے

- موثر

- یا تو

- ای ایم ای اے

- کو چالو کرنے کے

- چالو حالت میں

- کے قابل بناتا ہے

- کو فعال کرنا

- کی حوصلہ افزائی

- ختم ہو جاتا ہے

- بہتر

- لطف اندوز

- کافی

- کو یقینی بنانے کے

- انٹرپرائز

- اداروں

- اندراج

- ماحولیات

- ماحول

- کا سامان

- لیس

- خرابی

- نقائص

- قائم کرو

- بھی

- واقعات

- حتمی

- ہر کوئی

- سب کچھ

- وضع

- مثال کے طور پر

- مثال کے طور پر

- ایکسل

- موجودہ

- توقع ہے

- توقع

- تجربہ

- تجربہ

- ایکسپلور

- ظاہر

- اظہار

- توسیع

- ملانے

- بیرونی

- انتہائی

- کپڑے

- چہرہ

- سہولت

- سہولت

- عوامل

- ناکام

- ناکام رہتا ہے

- ناکامی

- خاندانوں

- خاندان

- فیشن

- فاسٹ

- تیز تر

- غلط

- ممکن

- نمایاں کریں

- خصوصیات

- چند

- میدان

- فائل

- فائلوں

- پہلا

- فٹ

- فلیٹ

- لچک

- توجہ مرکوز

- توجہ مرکوز

- پیچھے پیچھے

- کے بعد

- کے لئے

- کسر

- فریم ورک

- فریم ورک

- فرانس

- آزادی

- بار بار اس

- تازہ

- دوست

- سے

- مکمل

- مکمل طور پر

- فنکشنل

- فعالیت

- افعال

- مزید

- GAL

- پیدا

- پیداواری

- حاصل

- حاصل کرنے

- GitHub کے

- دی

- GPU

- GPUs

- گراف

- عظیم

- سب سے بڑا

- گروپ

- بڑھتا ہے

- ہینڈل

- ہینڈلنگ

- ہینگ

- ہو

- ہارڈ ویئر

- ہے

- ہونے

- صحت

- صحت مند

- مدد گار

- مدد

- مدد کرتا ہے

- ہائی

- اعلی تعدد

- اعلی کارکردگی

- تاریخی

- ہڈ

- میزبان

- HOURS

- کس طرح

- کیسے

- تاہم

- ایچ پی سی

- HTML

- HTTP

- HTTPS

- سینکڑوں

- لاکھوں لاکھ

- i

- ایک جیسے

- شناختی

- تصویر

- تصاویر

- فوری طور پر

- اثر

- پر عملدرآمد

- عملدرآمد

- پر عمل درآمد

- اہم

- کو بہتر بنانے کے

- بہتر

- بہتری

- in

- دیگر میں

- شامل

- سمیت

- اضافہ

- اضافہ

- اضافہ

- دن بدن

- انفرادی

- صنعت

- معلومات

- معلومات

- انفراسٹرکچر

- جدت طرازی

- متاثر

- انسٹال

- مثال کے طور پر

- کے بجائے

- ضم

- انضمام

- انٹیلجنٹ

- بات چیت

- انٹرفیس

- بیچوان

- اندرونی

- متعارف کرانے

- متعارف

- IT

- تکرار

- میں

- خود

- ایوب

- نوکریاں

- فوٹو

- رکھیں

- کلیدی

- بچے

- جان

- زبان

- زبانیں

- بڑے

- بڑے پیمانے پر

- بڑے

- تازہ ترین

- شروع

- شروع

- آغاز

- پرت

- تہوں

- قیادت

- رہنما

- سیکھنے

- کی وراست

- سطح

- لائبریریوں

- لائبریری

- زندگی کا دورانیہ

- کی طرح

- امکان

- LIMIT

- حدود

- لمیٹڈ

- تھوڑا

- ایل ایل ایم

- لوڈ کر رہا ہے

- مقامی

- لانگ

- طویل وقت

- دیکھو

- تلاش

- لو

- مشین

- مشین لرننگ

- مشینیں

- برقرار رکھنے کے

- برقرار رکھنے

- برقرار رکھتا ہے

- بنا

- بناتا ہے

- بنانا

- انتظام

- میں کامیاب

- انتظام

- بہت سے

- نقشہ جات

- زیادہ سے زیادہ

- یاد داشت

- میٹا ڈیٹا

- طریقوں

- پیمائش کا معیار

- منتقلی

- ملن

- لاکھوں

- ML

- ایم ایل اوپس

- موڈ

- ماڈل

- ماڈل

- نظر ثانی کی

- کی نگرانی

- نگرانی

- زیادہ

- سب سے زیادہ

- منتقل

- ایک سے زیادہ

- یعنی

- مقامی

- قدرتی

- قدرتی زبان عملیات

- فطرت، قدرت

- ضروری ہے

- ضروری

- ضرورت ہے

- ضروریات

- نیٹ ورک

- نیٹ ورک پر مبنی

- نیٹ ورک

- عصبی نیٹ ورک

- نئی

- ویزا

- نوڈ

- نوڈس

- تعداد

- متعدد

- NVIDIA

- اشیاء

- of

- پیش کرتے ہیں

- کی پیشکش

- زیتون

- on

- ڈیمانڈ

- ایک

- کھول

- اوپن سورس

- اوپن سورس کوڈ

- کھول دیا

- مواقع

- اصلاح کے

- کی اصلاح کریں

- اصلاح

- اختیار

- آپشنز کے بھی

- آرکیسٹرا

- حکم

- دیگر

- خود

- پیکج

- پیکجوں کے

- کاغذ.

- کاغذات

- پیرا میٹر

- متوازی

- پیرامیٹر

- پیرامیٹرز

- حصہ

- خاص طور پر

- خاص طور پر

- جذباتی

- گزشتہ

- راستہ

- پیٹرن

- ادا

- چوٹی

- کارکردگی

- پرفارمنس

- اجازت

- اجازتیں

- جسمانی طورپر

- پائپ لائن

- مقامات

- پلاٹا

- افلاطون ڈیٹا انٹیلی جنس

- پلیٹو ڈیٹا

- کھیل

- پوائنٹ

- پول

- پول

- مقبول

- پوسٹ

- مراسلات

- پریکٹس

- طریقوں

- پیش گوئی

- ترجیحات

- کو ترجیح دی

- حال (-)

- تحفہ

- کی روک تھام

- پہلے

- پرنسپل

- عمل

- عمل

- پروسیسنگ

- پیدا

- پروگرام

- پروگرامنگ

- پروگرامنگ زبانوں

- پیش رفت

- منصوبوں

- مناسب طریقے سے

- تجویز کریں

- تجویز کرتا ہے

- ملکیت

- پروٹوکول

- پروٹوکول

- فراہم

- فراہم

- فراہم کنندہ

- فراہم کرنے

- عوامی

- مطبوعات

- مقصد

- ڈال

- ازگر

- pytorch

- معیار

- بلند

- بے ترتیب

- Rare

- شرح

- قیمتیں

- پہنچ گئی

- پڑھیں

- پڑھنا

- احساس

- مناسب

- وجوہات

- وصول

- حال ہی میں

- سفارش

- سفارشات

- ریکارڈ

- ریکارڈ

- وصولی

- کو کم

- کم

- کو کم کرنے

- کے بارے میں

- خطے

- خطوں

- باقاعدہ

- باقاعدگی سے

- متعلقہ

- متعلقہ

- قابل اعتماد

- ریموٹ

- کی جگہ

- نمائندگی

- درخواست

- درخواستوں

- کی ضرورت

- ضرورت

- کی ضرورت ہے

- تحقیق

- تحقیق اور بدعت

- وسائل

- وسائل

- نتائج کی نمائش

- جائزہ

- کردار

- کردار

- رن

- چل رہا ہے

- sagemaker

- اسی

- محفوظ کریں

- اسکیل ایبلٹی

- توسیع پذیر

- پیمانے

- ترازو

- سکیلنگ

- سکیم

- سائنسی

- سائنسدانوں

- گنجائش

- سکرپٹ

- sdk

- تلاش کریں

- دوسری

- سیکنڈ

- سیکشن

- کی تلاش

- منتخب

- انتخاب

- سینئر

- بے سرور

- سرورز

- سروس

- سروسز

- مقرر

- ترتیبات

- کئی

- تیز

- شارڈنگ

- مشترکہ

- ہونا چاہئے

- نمایاں طور پر

- سادہ

- سادگی

- بیک وقت

- ایک

- سائز

- سائز

- مہارت

- سست

- چھوٹے

- So

- سافٹ ویئر کی

- حل

- کچھ

- ماخذ

- ذرائع

- ماہر

- مخصوص

- خاص طور پر

- مخصوص

- تیزی

- خرچ کرنا۔

- الگ ہوجاتا ہے

- کمرشل

- مستحکم

- ڈھیر لگانا

- شروع کریں

- شروع

- شروع ہوتا ہے

- سترٹو

- حالت

- شماریات

- مراحل

- بند کرو

- روکنا

- ذخیرہ

- ذخیرہ

- خبریں

- حکمت عملی

- سٹریم

- اسٹریمز

- طاقت

- اتارنے

- سختی

- مطالعہ

- کامیابی

- کامیابی کی کہانیاں

- کامیاب

- اس طرح

- حمایت

- تائید

- کی حمایت کرتا ہے

- ہم آہنگی

- نحو

- کے نظام

- ٹیبل

- لے لو

- ٹاسک

- کاموں

- ٹیم

- ٹیکنیکل

- ٹیسسرور

- شکریہ

- کہ

- ۔

- دنیا

- ان

- ان

- خود

- نظریاتی

- لہذا

- یہ

- تیسری پارٹی

- ہزاروں

- تین

- کے ذریعے

- تھرو پٹ

- وقت

- اوقات

- تجاویز

- کرنے کے لئے

- آج

- ٹوکن

- بھی

- کے آلے

- اوزار

- سب سے اوپر

- کل

- ٹریک

- ٹریفک

- ٹرین

- تربیت یافتہ

- ٹریننگ

- ترجمہ

- نقل و حمل

- ٹریلین

- اقسام

- ٹھیٹھ

- کے تحت

- بنیادی

- سمجھ

- منفرد

- یونٹس

- اپ ڈیٹ کریں

- us

- استعمالی

- استعمال

- استعمال کی شرائط

- رکن کا

- عام طور پر

- قیمت

- اقدار

- مختلف اقسام کے

- مختلف

- اس بات کی تصدیق

- ورژن

- کی طرف سے

- ویڈیو

- لنک

- نقطہ نظر

- گرم

- راستہ..

- طریقوں

- مہینے

- اچھا ہے

- کیا

- جس

- جبکہ

- ڈبلیو

- پوری

- گے

- ساتھ

- کے اندر

- بغیر

- الفاظ

- کام

- کام کیا

- کارکنوں

- کام کر

- کام کرتا ہے

- دنیا

- لکھنا

- لکھا

- سال

- تم

- اور

- اپنے آپ کو

- یو ٹیوب پر

- زیفیرنیٹ