محققین نے AI ماڈلز کے ذریعے استعمال کیے جانے والے بنیادی ڈھانچے میں تقریباً ایک درجن اہم کمزوریوں کی نشاندہی کی ہے (علاوہ تین اعلی اور دو درمیانے درجے کے کیڑے)، جو کمپنیوں کو خطرے میں ڈال سکتی ہیں کیونکہ وہ AI سے فائدہ اٹھانے کی دوڑ میں لگ جاتی ہیں۔ ان میں سے کچھ بے نشان رہتے ہیں۔

متاثرہ پلیٹ فارمز بڑے لینگویج ماڈلز (LLM) اور دیگر ML پلیٹ فارمز اور AIs کی میزبانی، تعیناتی اور اشتراک کے لیے استعمال ہوتے ہیں۔ ان میں رے شامل ہے، جو مشین لرننگ ماڈلز کی تقسیم شدہ تربیت میں استعمال ہوتی ہے۔ ایم ایل فلو، ایک مشین لرننگ لائف سائیکل پلیٹ فارم؛ ماڈل ڈی بی, ایک مشین لرننگ مینجمنٹ پلیٹ فارم؛ اور H20 ورژن 3جاوا پر مبنی مشین لرننگ کے لیے ایک اوپن سورس پلیٹ فارم۔

Machine- لرننگ سیکیورٹی فرم Protect AI نے 16 نومبر کو اپنے AI مخصوص بگ باؤنٹی پروگرام، ہنٹر کے حصے کے طور پر نتائج کا انکشاف کیا۔ یہ نہیںسافٹ ویئر مینٹینرز اور وینڈرز کو کمزوریوں کے بارے میں مطلع کیا، انہیں مسائل کو حل کرنے کے لیے 45 دن کی مہلت دی گئی۔

ہر ایک ایشو کو ایک CVE شناخت کنندہ تفویض کیا گیا ہے، اور جب کہ بہت سے مسائل کو ٹھیک کر دیا گیا ہے، دیگر پر کوئی پیچ نہیں ہے، ایسی صورت میں Protect AI نے ایک حل کی سفارش کی ہے۔ اس کا مشورہ.

AI بگس تنظیموں کو زیادہ خطرہ پیش کرتے ہیں۔

پروٹیکٹ AI کے مطابق، AI سسٹمز میں کمزوریاں حملہ آوروں کو AI ماڈلز تک غیر مجاز رسائی فراہم کر سکتی ہیں، جس سے وہ اپنے مقاصد کے لیے ماڈلز کا انتخاب کر سکتے ہیں۔

پروٹیکٹ اے آئی کے چیف آرکیٹیکٹ شان مورگن کا کہنا ہے کہ، لیکن، وہ انہیں باقی نیٹ ورک کا دروازہ بھی دے سکتے ہیں۔ سرور سے سمجھوتہ اور کم کوڈ AI سروسز سے اسناد کی چوری ابتدائی رسائی کے لیے دو امکانات ہیں، مثال کے طور پر۔

"انفرنس سرورز کے پاس صارفین کے لیے ML ماڈلز [دور سے] استعمال کرنے کے قابل رسائی پوائنٹس ہوسکتے ہیں، لیکن کسی کے نیٹ ورک میں جانے کے بہت سے طریقے ہیں،" وہ کہتے ہیں۔ "یہ ایم ایل سسٹمز جنہیں ہم ہدف بنا رہے ہیں [بگ باؤنٹی پروگرام کے ساتھ] اکثر اعلیٰ مراعات رکھتے ہیں، اور اس لیے یہ بہت اہم ہے کہ اگر کوئی آپ کے نیٹ ورک میں داخل ہونے کے قابل ہے، کہ وہ فوری طور پر استحقاق کو ایک انتہائی حساس نظام میں نہیں بڑھا سکتا۔ "

مثال کے طور پر، رے ڈسٹری بیوٹڈ لرننگ پلیٹ فارم کے لیے API میں ایک اہم مقامی فائل شامل کرنے کا مسئلہ (اب پیچ شدہ) حملہ آور کو سسٹم پر موجود کسی بھی فائل کو پڑھنے کی اجازت دیتا ہے۔ H20 پلیٹ فارم میں ایک اور مسئلہ (بھی طے شدہ) کوڈ کو AI ماڈل کی درآمد کے ذریعے عمل میں لانے کی اجازت دیتا ہے۔

خطرہ نظریاتی نہیں ہے: بڑی کمپنیوں نے پہلے ہی مفید AI ماڈلز تلاش کرنے اور انہیں اپنی مارکیٹوں اور آپریشنز پر لاگو کرنے کے لیے جارحانہ مہمات شروع کر دی ہیں۔ بینک پہلے ہی مارگیج پروسیسنگ اور اینٹی منی لانڈرنگ کے لیے مشین لرننگ اور AI کا استعمال کرتے ہیں، مثال کے طور پر۔

تلاش کرتے وقت ان AI سسٹمز میں کمزوریاں پروٹیکٹ AI کے صدر اور شریک بانی، Daryan Dehghanpisheh کہتے ہیں کہ یہ بنیادی ڈھانچے کے ساتھ سمجھوتہ کا باعث بن سکتا ہے، دانشورانہ املاک کی چوری بھی ایک بڑا مقصد ہے۔

"صنعتی جاسوسی ایک بڑا جزو ہے، اور AI اور ML کی جنگ میں، ماڈل ایک بہت ہی قیمتی دانشورانہ املاک کا اثاثہ ہیں،" وہ کہتے ہیں۔ "اس بارے میں سوچیں کہ روزانہ کی بنیاد پر ایک ماڈل کی تربیت پر کتنی رقم خرچ ہوتی ہے، اور جب آپ ایک ارب پیرامیٹرز کے بارے میں بات کر رہے ہیں، اور اس سے زیادہ، تو بہت زیادہ سرمایہ کاری، صرف خالص سرمایہ جو آسانی سے سمجھوتہ یا چوری ہو جاتا ہے۔"

HackerOne کے سینئر حل آرکیٹیکٹ، ڈین شیرٹس کا کہنا ہے کہ ChatGPT جیسے AI سسٹمز کے ساتھ لوگوں کے درمیان قدرتی زبان کے تعاملات کو بنیادی ڈھانچے کے خلاف لڑنا اور بھی زیادہ اثر انداز ہوگا۔ اس کی وجہ یہ ہے کہ جب سائبر کرائمین اس قسم کی کمزوریوں کو متحرک کرنے کے قابل ہوتے ہیں، تو AI سسٹمز کی افادیت اس سے کہیں زیادہ اثر ڈالے گی۔

وہ کہتے ہیں کہ یہ حملے "سسٹم کو حساس یا خفیہ ڈیٹا کو تھوکنے کا سبب بن سکتے ہیں، یا بدنیتی پر مبنی اداکار کو سسٹم کے بیک اینڈ تک رسائی حاصل کرنے میں مدد کر سکتے ہیں"۔ "اے آئی کے خطرات جیسے تربیتی ڈیٹا پوائزننگ کا بھی ایک اہم لہر اثر ہو سکتا ہے، جس سے غلط یا بدنیتی پر مبنی نتائج کی وسیع پیمانے پر پھیلاؤ ہوتی ہے۔"

AI انفراسٹرکچر کے لیے سیکیورٹی: اکثر نظر انداز کیا جاتا ہے۔

ایک سال قبل ChatGPT کے متعارف ہونے کے بعد، AI پر مبنی ٹیکنالوجیز اور خدمات - خاص طور پر جنریٹو AI (GenAI) - نے کام شروع کر دیا ہے۔ اس کے تناظر میں، ایک مختلف قسم کے مخالفانہ حملے تیار کیا گیا ہے جو AI اور مشین لرننگ سسٹم اور ان کے کاموں کو نشانہ بنا سکتا ہے۔ 15 نومبر کو، مثال کے طور پر، AI سیکیورٹی فرم Adversa AI

GPT پر مبنی نظاموں پر کئی حملوں کا انکشاف کیا۔ بشمول پرامپٹ لیک کرنا اور ان APIs کی گنتی کرنا جن تک سسٹم کو رسائی حاصل ہے۔

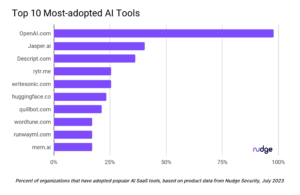

پھر بھی، پروٹیکٹ اے آئی کے بگ انکشافات اس حقیقت کی نشاندہی کرتے ہیں کہ مشین لرننگ کے عمل اور اے آئی آپریشنز کو سپورٹ کرنے والے ٹولز اور انفراسٹرکچر بھی ہدف بن سکتے ہیں۔ اور اکثر، کاروباری اداروں نے AI پر مبنی ٹولز اور ورک فلو کو اپنایا ہے۔ انفارمیشن سیکیورٹی گروپس سے اکثر مشورہ کیے بغیر.

"کسی بھی ہائی ٹیک ہائپ سائیکل کی طرح، لوگ سسٹمز کو تعینات کریں گے، وہ ایپلی کیشنز لگائیں گے، اور وہ کاروبار اور مارکیٹ کی ضروریات کو پورا کرنے کے لیے نئے تجربات تخلیق کریں گے، اور اکثر یا تو سیکیورٹی کو نظر انداز کر دیں گے اور وہ ان کو تخلیق کریں گے۔ 'شیڈو اسٹیک' کی قسم، یا وہ یہ فرض کریں گے کہ ان کے پاس موجود سیکیورٹی کی موجودہ صلاحیتیں انہیں محفوظ رکھ سکتی ہیں،" دہگھن پیشے کہتے ہیں۔ "لیکن وہ چیزیں جو ہم [سائبر سیکیورٹی پروفیشنلز] روایتی ڈیٹا سینٹرز کے لیے کر رہے ہیں، ضروری نہیں کہ آپ کو کلاؤڈ میں محفوظ رکھیں، اور اس کے برعکس۔"

Protect AI نے اپنے بگ باونٹی پلیٹ فارم کا استعمال کیا، جسے ہنٹر کا نام دیا گیا ہے، مختلف مشین لرننگ پلیٹ فارمز کے لیے ہزاروں محققین سے کمزوری کی درخواستیں طلب کرنے کے لیے، لیکن اب تک، اس شعبے میں بگ ہنٹنگ اپنے ابتدائی دور میں ہی ہے۔ یہ تبدیل کرنے کے بارے میں ہو سکتا ہے، اگرچہ.

مثال کے طور پر، ٹرینڈ مائیکرو کے زیرو ڈے انیشیٹو نے ابھی تک AI/ML ٹولز میں کیڑے تلاش کرنے کے لیے کوئی خاص مانگ نہیں دیکھی ہے، لیکن گروپ نے باقاعدگی سے تبدیلیاں دیکھی ہیں کہ انڈسٹری کس قسم کی کمزوریوں کو تلاش کرنا چاہتی ہے، اور ممکنہ طور پر AI فوکس آنے والا ہے۔ ٹرینڈ مائیکرو کے زیرو ڈے انیشی ایٹو میں خطرے سے آگاہی کے سربراہ، ڈسٹن چائلڈز کا کہنا ہے کہ جلد ہی۔

وہ کہتے ہیں "ہم AI میں وہی چیز دیکھ رہے ہیں جو ہم نے دوسری صنعتوں میں دیکھی جب وہ ترقی کرتے ہیں،" وہ کہتے ہیں۔ "سب سے پہلے، فعالیت کو شامل کرنے کے حق میں سیکیورٹی کو ترجیح نہیں دی گئی۔ اب جب کہ یہ قبولیت کی ایک خاص سطح پر پہنچ گیا ہے، لوگ حفاظتی مضمرات کے بارے میں پوچھنا شروع کر رہے ہیں۔

- SEO سے چلنے والا مواد اور PR کی تقسیم۔ آج ہی بڑھا دیں۔

- پلیٹو ڈیٹا ڈاٹ نیٹ ورک ورٹیکل جنریٹو اے آئی۔ اپنے آپ کو بااختیار بنائیں۔ یہاں تک رسائی حاصل کریں۔

- پلیٹوآئ اسٹریم۔ ویب 3 انٹیلی جنس۔ علم میں اضافہ۔ یہاں تک رسائی حاصل کریں۔

- پلیٹو ای ایس جی۔ کاربن، کلین ٹیک، توانائی ، ماحولیات، شمسی، ویسٹ مینجمنٹ یہاں تک رسائی حاصل کریں۔

- پلیٹو ہیلتھ۔ بائیوٹیک اینڈ کلینیکل ٹرائلز انٹیلی جنس۔ یہاں تک رسائی حاصل کریں۔

- ماخذ: https://www.darkreading.com/vulnerabilities-threats/unpatched-critical-vulnerabilities-ai-models-takeover

- : ہے

- : ہے

- : نہیں

- 15٪

- 16

- 7

- a

- قابلیت

- ہمارے بارے میں

- قبولیت

- تک رسائی حاصل

- قابل رسائی

- انہوں نے مزید کہا

- اپنایا

- فائدہ

- شکست

- متاثر

- کے خلاف

- جارحانہ

- پہلے

- AI

- اے آئی ماڈلز

- AI خدمات

- اے آئی سسٹمز

- AI / ML

- اجازت دے رہا ہے

- کی اجازت دیتا ہے

- پہلے ہی

- بھی

- an

- اور

- اور بنیادی ڈھانچہ

- ایک اور

- رقم کی غیرقانونی ترسیل کے مخالف

- کوئی بھی

- اے پی آئی

- APIs

- ایپلی کیشنز

- کا اطلاق کریں

- کیا

- AS

- پوچھنا

- اثاثے

- تفویض

- فرض کرو

- At

- حملے

- کے بارے میں شعور

- پسدید

- بینکوں

- کی بنیاد پر

- بنیاد

- جنگ

- BE

- کیونکہ

- بن

- رہا

- بگ

- ارب

- فضل

- بگ کی اطلاع دیں

- بگ فضل

- کیڑوں

- کاروبار

- کاروبار

- لیکن

- by

- مہمات

- کر سکتے ہیں

- صلاحیتوں

- دارالحکومت

- کیس

- کیونکہ

- مراکز

- کچھ

- تبدیل

- چیٹ جی پی ٹی

- چیف

- بادل

- شریک بانی

- کوڈ

- آنے والے

- جلد آ رہا ہے

- کمپنیاں

- جزو

- سمجھوتہ

- سمجھوتہ کیا

- مشاورت

- سکتا ہے

- تخلیق

- اسناد

- اہم

- سی ای وی

- cybercriminals

- سائبر سیکیورٹی

- سائیکل

- روزانہ

- اعداد و شمار

- ڈیٹا مراکز

- دن

- دن

- ڈیمانڈ

- تعیناتی

- تعینات

- ترقی یافتہ

- مختلف

- تقسیم کئے

- تقسیم کی تربیت

- کر

- ڈان

- درجن سے

- ڈوب

- آسانی سے

- اثر

- استعداد کار

- یا تو

- بلند

- شروع کیا

- بڑھ

- خاص طور پر

- جاسوسی

- بھی

- مثال کے طور پر

- پھانسی

- موجودہ

- تجربات

- استحصال

- حقیقت یہ ہے

- دور

- کی حمایت

- فائل

- مل

- تلاش

- فرم

- پہلا

- مقرر

- توجہ مرکوز

- کے لئے

- سے

- فعالیت

- حاصل کرنا

- پیداواری

- پیداواری AI۔

- حاصل

- دے دو

- مقصد

- اہداف

- زیادہ سے زیادہ

- گروپ

- ہے

- he

- سر

- مدد

- ہائی

- مارو

- ہوسٹنگ

- کس طرح

- HTML

- HTTPS

- شکار

- ہائپ

- کی نشاندہی

- شناخت

- if

- اثر

- اثر انداز کرنا

- اثرات

- درآمد

- اہم

- in

- دیگر میں

- شامل

- سمیت

- صنعتی

- صنعتوں

- صنعت

- معلومات

- انفارمیشن سیکورٹی

- انفراسٹرکچر

- ابتدائی

- انیشی ایٹو

- مثال کے طور پر

- دانشورانہ

- املاک دانش

- بات چیت

- میں

- تعارف

- سرمایہ کاری

- مسئلہ

- مسائل

- IT

- میں

- اعلی درجے کا Java

- فوٹو

- صرف

- رکھیں

- زبان

- بڑے

- لانڈرنگ

- قیادت

- معروف

- سیکھنے

- چھوڑ دو

- سطح

- زندگی کا دورانیہ

- کی طرح

- امکان

- ll

- ایل ایل ایم

- مقامی

- بہت

- مشین

- مشین لرننگ

- بنا

- انتظام

- بہت سے

- مارکیٹ

- Markets

- سے ملو

- مائکرو.

- ML

- ماڈل

- ماڈل

- قیمت

- زیادہ

- مورگن

- رہن

- بہت

- تقریبا

- ضروری ہے

- ضروریات

- نیٹ ورک

- نئی

- نومبر

- ناول

- اب

- تعداد

- of

- بند

- اکثر

- on

- کھول

- اوپن سورس

- آپریشنز

- or

- دیگر

- دیگر

- باہر

- نتائج

- خود

- پیرامیٹرز

- حصہ

- پیچ

- لوگ

- پلیٹ فارم

- پلیٹ فارم

- پلاٹا

- افلاطون ڈیٹا انٹیلی جنس

- پلیٹو ڈیٹا

- علاوہ

- امکانات

- حال (-)

- صدر

- استحقاق

- استحقاق

- عمل

- پروسیسنگ

- پیشہ ور ماہرین

- پروگرام

- جائیداد

- حفاظت

- ڈال

- جلدی سے

- ریس

- رے

- RE

- پڑھیں

- سفارش کی

- باقاعدہ

- رہے

- باقی

- دور

- محققین

- باقی

- نتائج کی نمائش

- ریپل

- رسک

- s

- محفوظ

- اسی

- دیکھا

- کا کہنا ہے کہ

- شان

- شعبے

- سیکورٹی

- دیکھ کر

- دیکھا

- سینئر

- حساس

- سرور

- سرورز

- سروسز

- شیڈو

- اشتراک

- شفٹوں

- اہم

- So

- اب تک

- سافٹ ویئر کی

- حل

- کچھ

- کسی

- جلد ہی

- ماخذ

- خرچ

- Stacks

- شروع

- چوری

- عرضیاں

- حمایت

- کے نظام

- سسٹمز

- لے لو

- لیا

- قبضے

- بات کر

- ہدف

- ھدف بندی

- اہداف

- ٹیکنالوجی

- کہ

- ۔

- چوری

- ان

- ان

- نظریاتی

- وہاں.

- یہ

- وہ

- بات

- چیزیں

- لگتا ہے کہ

- اس

- اگرچہ؟

- ہزاروں

- خطرہ

- تین

- کرنے کے لئے

- اوزار

- روایتی

- ٹریننگ

- رجحان

- ٹرگر

- دو

- اقسام

- غیر مجاز

- انڈرپننگ

- استعمال کی شرائط

- استعمال کیا جاتا ہے

- صارفین

- قیمتی

- دکانداروں

- ورژن

- بہت

- کی طرف سے

- وائس

- نقصان دہ

- خطرے کا سامنا

- جاگو

- چاہتا ہے

- تھا

- طریقوں

- we

- اچھا ہے

- کیا

- جب

- جس

- جبکہ

- وسیع پیمانے پر

- گے

- ساتھ

- کام کے بہاؤ

- سال

- ابھی

- تم

- اور

- زیفیرنیٹ

- صفر

- زیرو ڈے