بڑے پیمانے پر ویڈیو ڈیٹاسیٹس کے ساتھ کارروائی کی شناخت میں ڈرامائی طور پر بہتری آئی ہے۔ پھر بھی، ان ڈیٹا سیٹس کے ساتھ کیوریشن لاگت، رازداری، اخلاقیات، تعصب اور کاپی رائٹ سے متعلق مسائل ہیں۔ تو، ایم ائی ٹی سائنس دان مصنوعی ڈیٹاسیٹس کی طرف رجوع کر رہے ہیں۔

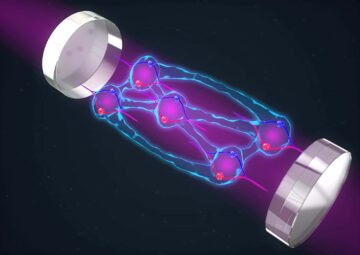

یہ ایک ایسے کمپیوٹر کے ذریعہ بنائے گئے ہیں جو منظروں، اشیاء اور انسانوں کے 3D ماڈلز کا استعمال کرتے ہوئے فوری طور پر مخصوص اعمال کے بہت سے مختلف کلپس تیار کرنے کے لیے استعمال کرتا ہے — کاپی رائٹ کے ممکنہ مسائل یا حقیقی ڈیٹا کے ساتھ آنے والے اخلاقی خدشات کے بغیر۔

کیا مصنوعی ڈیٹا اصلی ڈیٹا کی طرح اچھا ہے؟

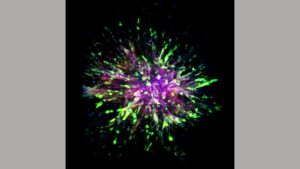

MIT، MIT-IBM واٹسن AI لیب، اور بوسٹن یونیورسٹی کے سائنسدانوں کی ایک ٹیم نے اس سوال کا جواب دینے کی کوشش کی۔ انہوں نے 150,000 ویڈیو کلپس کا ایک مصنوعی ڈیٹاسیٹ بنایا جس میں مختلف قسم کے انسانی اعمال کی نمائندگی کی گئی اور تربیت یافتہ مشین لرننگ اس ڈیٹاسیٹ کو استعمال کرنے والے ماڈلز۔ اس کے بعد انہوں نے حقیقی دنیا سے لے کر ان ماڈلز میں لی گئی فلموں کے چھ ڈیٹاسیٹ دکھائے تاکہ یہ جانچ سکیں کہ وہ ان ریکارڈنگز میں ہونے والی کارروائیوں کو کتنی اچھی طرح سے اٹھا سکتے ہیں۔

سائنسدانوں نے پایا کہ مصنوعی طور پر تربیت یافتہ ماڈلز نے ان ویڈیوز کے لیے حقیقی ڈیٹا پر تربیت یافتہ ماڈلز سے بھی بہتر کارکردگی کا مظاہرہ کیا جن میں پس منظر کی اشیاء کم ہیں۔

یہ دریافت سائنسدانوں کے مصنوعی ڈیٹا سیٹس کے استعمال میں مدد کر سکتی ہے تاکہ ماڈلز کو حقیقی کاموں پر زیادہ درست طریقے سے انجام دینے میں مدد مل سکے۔ اصل ڈیٹاسیٹس کے استعمال سے منسلک کچھ اخلاقی، رازداری اور کاپی رائٹ کے خدشات کو کم کرنے کے لیے، یہ محققین کو یہ تعین کرنے میں بھی مدد دے سکتا ہے کہ کون سی مشین لرننگ ایپلی کیشنز مصنوعی ڈیٹا کے ساتھ تربیت کے لیے سب سے زیادہ موزوں ہیں۔

ایم آئی ٹی-آئی بی ایم واٹسن اے آئی لیب کے پرنسپل سائنسدان اور مینیجر روجیریو فیرس نے کہا، "ہماری تحقیق کا حتمی مقصد اصلی ڈیٹا پری ٹریننگ کو مصنوعی ڈیٹا پری ٹریننگ سے بدلنا ہے۔ مصنوعی ڈیٹا میں ایکشن بنانے میں ایک لاگت آتی ہے، لیکن ایک بار ایسا کرنے کے بعد، آپ پوز، لائٹنگ وغیرہ کو تبدیل کر کے لامحدود تصاویر یا ویڈیوز بنا سکتے ہیں۔ یہی مصنوعی ڈیٹا کی خوبصورتی ہے۔"

سائنس دانوں نے ایک نیا مصنوعی ایکشن پری ٹریننگ اینڈ ٹرانسفر (SynAPT) مرتب کرکے، مصنوعی ویڈیو کلپس کے عوامی طور پر دستیاب تین ڈیٹا سیٹس کا استعمال کرتے ہوئے جس میں انسانی اعمال کو کیپچر کیا گیا۔ اس میں تقریباً 150 ایکشن کیٹیگریز ہیں، جن میں فی زمرہ 1,000 ویڈیو کلپس ہیں۔

تین مشین لرننگ ماڈلز کو پہلے سے تربیت دی گئی تھی کہ وہ ڈیٹاسیٹ کے بننے کے بعد استعمال کرتے ہوئے کارروائیوں کو پہچان سکیں۔ پری ٹریننگ ایک ماڈل کو دوسرے کام کو سکھانے سے پہلے اسے سکھانے کا عمل ہے۔ پہلے سے تربیت یافتہ ماڈل ان پیرامیٹرز کا استعمال کر سکتا ہے جو اس نے پہلے ہی سیکھے ہیں تاکہ اسے نئے ڈیٹا سیٹ کے ساتھ تیزی سے اور زیادہ مؤثر طریقے سے نیا کام سیکھنے میں مدد ملے۔ یہ اس کے بعد بنایا گیا ہے کہ لوگ کیسے سیکھتے ہیں، جو کہ ماضی کی معلومات کو دوبارہ استعمال کرنا ہے جب ہم کچھ نیا جانتے ہیں۔ پہلے سے تربیت یافتہ ماڈل کا تجربہ اصلی ویڈیو کلپس کے چھ ڈیٹا سیٹس کا استعمال کرتے ہوئے کیا گیا ہے، ہر ایک کیپچر کرنے والی کارروائیوں کی کلاسیں جو تربیتی ڈیٹا سے مختلف تھیں۔

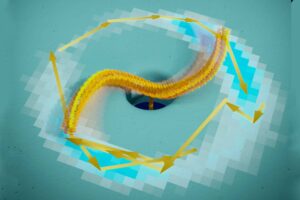

سائنسدانوں کے لیے یہ دیکھنا حیران کن تھا کہ تینوں مصنوعی ماڈلز نے چھ میں سے چار ڈیٹا سیٹس پر حقیقی ویڈیو کلپس کے ساتھ تربیت یافتہ ماڈلز کو پیچھے چھوڑ دیا۔ ان کی درستگی ڈیٹاسیٹس کے لیے سب سے زیادہ تھی جس میں "کم منظر-آبجیکٹ تعصب" والے ویڈیو کلپس تھے۔ اس کا مطلب ہے کہ ماڈل منظر میں پس منظر یا دیگر اشیاء کو دیکھ کر کارروائی کو نہیں پہچان سکتا ہے - اسے خود عمل پر توجہ مرکوز کرنی چاہیے۔

فیرس نے کہا، "کم سین آبجیکٹ کے تعصب والی ویڈیوز میں، اعمال کی وقتی حرکیات اشیاء کی ظاہری شکل یا پس منظر سے زیادہ اہم ہوتی ہے، اور ایسا لگتا ہے کہ مصنوعی ڈیٹا کے ساتھ اچھی طرح سے پکڑا گیا ہے۔"

"اعلی منظر آبجیکٹ تعصب ایک رکاوٹ کے طور پر کام کر سکتا ہے۔ ماڈل خود عمل کے بجائے کسی چیز کو دیکھ کر کسی عمل کو غلط درجہ بندی کر سکتا ہے۔ یہ ماڈل کو الجھا سکتا ہے۔"

شریک مصنف رامیشور پانڈا، MIT-IBM واٹسن AI لیب میں تحقیقی عملے کے رکن نے کہا، "ان نتائج کو تیار کرتے ہوئے، محققین مستقبل کے کام میں مزید ایکشن کلاسز اور اضافی مصنوعی ویڈیو پلیٹ فارمز کو شامل کرنا چاہتے ہیں، آخر کار ایسے ماڈلز کا ایک کیٹلاگ بنانا چاہتے ہیں جن کو مصنوعی ڈیٹا کا استعمال کرتے ہوئے پہلے سے تربیت دی گئی ہو۔"

"ہم ایسے ماڈل بنانا چاہتے ہیں جو ادب میں موجودہ ماڈلز سے بہت ملتے جلتے یا اس سے بھی بہتر کارکردگی کے حامل ہوں، لیکن ان میں سے کسی بھی تعصب یا حفاظتی خدشات کے پابند نہ ہوں۔"

سویونگ جن، ایک شریک مصنف اور CSAIL پوسٹ ڈاک نے کہا، "وہ اپنے کام کو تحقیق کے ساتھ جوڑنا بھی چاہتے ہیں جو زیادہ درست اور حقیقت پسندانہ مصنوعی ویڈیوز بنانا چاہتے ہیں، جو ماڈلز کی کارکردگی کو بڑھا سکتے ہیں۔"

"ہم رازداری کے مسائل یا سیاق و سباق یا سماجی تعصب کو روکنے کے لیے مصنوعی ڈیٹا سیٹس کا استعمال کرتے ہیں، لیکن ماڈل کیا سیکھتا ہے؟ کیا یہ کچھ سیکھتا ہے جو غیر جانبدار ہے؟"

شریک مصنف سمرتھ مشرا، بوسٹن یونیورسٹی (BU) میں گریجویٹ طالب علم، نے کہا, "اچھی طرح سے تشریح شدہ مصنوعی ڈیٹا حاصل کرنے کی لاگت کم ہونے کے باوجود، فی الحال، ہمارے پاس حقیقی ویڈیوز کے ساتھ سب سے بڑے تشریح شدہ ڈیٹاسیٹس کا مقابلہ کرنے کے پیمانے کے ساتھ ڈیٹا سیٹ نہیں ہے۔ حقیقی ویڈیوز کے ساتھ مختلف اخراجات اور خدشات پر بحث کرکے اور مصنوعی ڈیٹا کی افادیت کو ظاہر کرکے، ہم اس سمت میں کوششوں کی حوصلہ افزائی کرنے کی امید کرتے ہیں۔

جرنل حوالہ:

- Yo-what Kim et al. مصنوعی ڈیٹا کی بنیاد پر ویڈیو کی نمائندگی کتنی قابل منتقلی ہے؟ کاغذ.