As more organizations adopt generative AI technologies — to craft pitches, complete grant applications, and write بوائلر پلیٹ کوڈ - سیکیورٹی ٹیمیں ایک نئے سوال کو حل کرنے کی ضرورت کو محسوس کر رہی ہیں: آپ AI ٹولز کو کیسے محفوظ بناتے ہیں؟

گارٹنر کے ایک حالیہ سروے میں جواب دہندگان میں سے ایک تہائی نے یا تو رپورٹ کیا۔ AI پر مبنی ایپلیکیشن سیکیورٹی ٹولز کا استعمال یا ان پر عمل درآمد to address the risks posed by the use of generative AI in their organization.

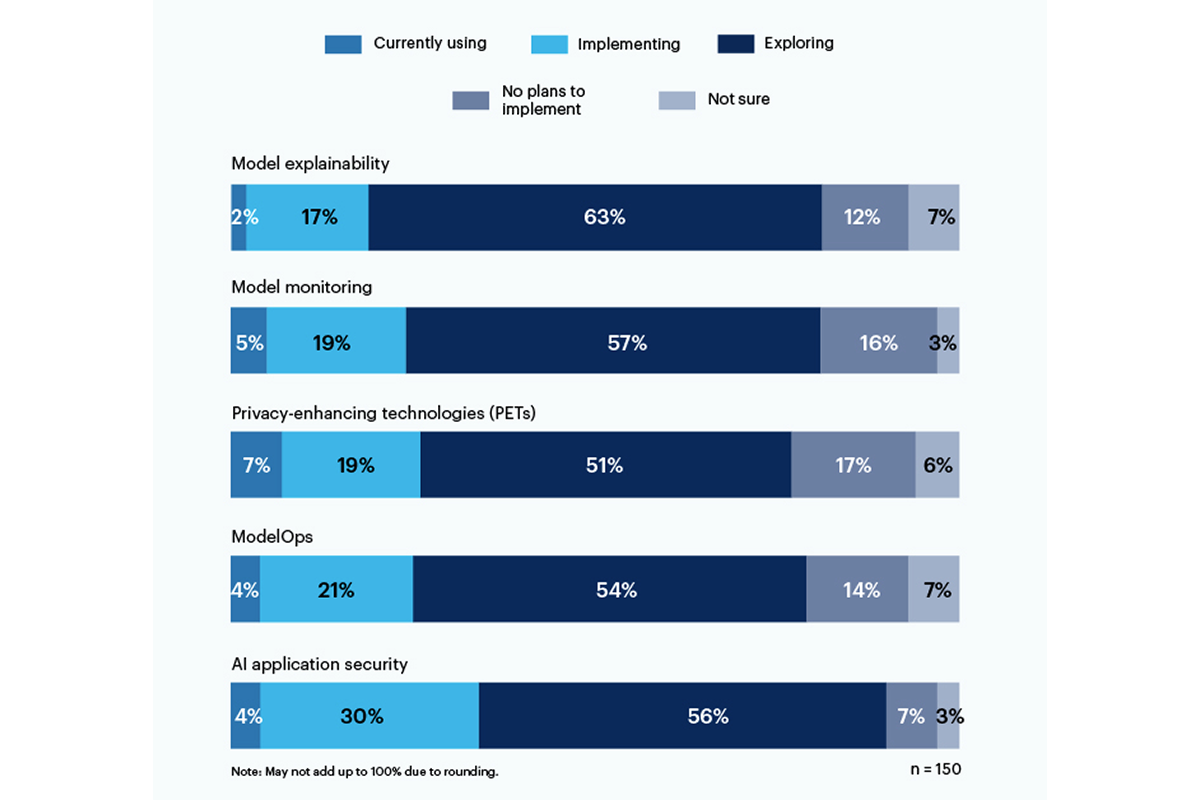

Privacy-enhancing technologies (PETs) showed the greatest current use, at 7% of respondents, with a solid 19% of companies implementing it; this category includes ways to protect personal data, such as ہومومورفک خفیہ کاری, AI سے تیار کردہ مصنوعی ڈیٹا, محفوظ کثیر جماعتی حساب, وفاقی تعلیم، اور امتیازی رازداری. However, a solid 17% have no plans to impelment PETs in their environment.

Only 19% are using or implementing tools for model explainability, but there is significant interest (56%) among the respondents in exploring and understanding these tools to address generative AI risk. Explainability, model monitoring, and AI application security tools can all be used on open source or proprietary models to achieve trustworthiness and reliability enterprise users need, according to Gartner.

The risks the respondents are most concerned about include incorrect or biased outputs (58%) and vulnerabilities or leaked secrets in AI-generated code (57%). Significantly, 43% cited potential copyright or licensing issues arising from AI-generated content as top risks to their organization.

“There is still no transparency about data models are training on, so the risk associated with bias, and privacy is very difficult to understand and estimate,” a C-suite executive wrote in response to the Gartner survey.

جون میں، نیشنل انسٹی ٹیوٹ آف اسٹینڈرڈز اینڈ ٹیکنالوجی (NIST) نے ایک عوامی ورکنگ گروپ کا آغاز کیا۔ to help address that question, based on its AI Risk Management Framework from January. As the Gartner data shows, کمپنیاں انتظار نہیں کر رہی ہیں NIST ہدایات کے لیے۔

- SEO سے چلنے والا مواد اور PR کی تقسیم۔ آج ہی بڑھا دیں۔

- پلیٹو ڈیٹا ڈاٹ نیٹ ورک ورٹیکل جنریٹو اے آئی۔ اپنے آپ کو بااختیار بنائیں۔ یہاں تک رسائی حاصل کریں۔

- پلیٹوآئ اسٹریم۔ ویب 3 انٹیلی جنس۔ علم میں اضافہ۔ یہاں تک رسائی حاصل کریں۔

- پلیٹو ای ایس جی۔ کاربن، کلین ٹیک، توانائی ، ماحولیات، شمسی، ویسٹ مینجمنٹ یہاں تک رسائی حاصل کریں۔

- پلیٹو ہیلتھ۔ بائیوٹیک اینڈ کلینیکل ٹرائلز انٹیلی جنس۔ یہاں تک رسائی حاصل کریں۔

- ماخذ: https://www.darkreading.com/tech-talks/companies-rely-multiple-methods-secure-generative-ai

- : ہے

- : نہیں

- 7

- a

- ہمارے بارے میں

- کے مطابق

- حاصل

- پتہ

- اپنانے

- AI

- تمام

- کے درمیان

- اور

- درخواست

- درخواست سیکورٹی

- ایپلی کیشنز

- کیا

- AS

- منسلک

- At

- کی بنیاد پر

- BE

- تعصب

- باصلاحیت

- لیکن

- by

- سی سوٹ۔

- کر سکتے ہیں

- قسم

- حوالہ دیا

- کوڈ

- کمپنیاں

- مکمل

- متعلقہ

- مواد

- کاپی رائٹ

- شلپ

- موجودہ

- اعداد و شمار

- مشکل

- ہدایات

- do

- یا تو

- انٹرپرائز

- ماحولیات

- تخمینہ

- ایگزیکٹو

- ایکسپلور

- کے لئے

- فریم ورک

- سے

- گارٹنر

- پیداواری

- پیداواری AI۔

- عطا

- سب سے بڑا

- ہے

- مدد

- کس طرح

- تاہم

- HTTPS

- پر عمل درآمد

- in

- شامل

- شامل ہیں

- انسٹی ٹیوٹ

- دلچسپی

- مسائل

- IT

- میں

- جنوری

- جون

- شروع

- لائسنسنگ

- انتظام

- طریقوں

- ماڈل

- ماڈل

- نگرانی

- زیادہ

- سب سے زیادہ

- ایک سے زیادہ

- قومی

- ضرورت ہے

- نئی

- نیسٹ

- نہیں

- of

- on

- کھول

- اوپن سورس

- or

- تنظیم

- تنظیمیں

- ذاتی

- ذاتی مواد

- پالتو جانور

- پچ

- کی منصوبہ بندی

- پلاٹا

- افلاطون ڈیٹا انٹیلی جنس

- پلیٹو ڈیٹا

- درپیش

- ممکنہ

- کی رازداری

- ملکیت

- حفاظت

- عوامی

- سوال

- احساس کرنا

- حال ہی میں

- وشوسنییتا

- انحصار کرو

- اطلاع دی

- جواب دہندگان

- جواب

- رسک

- رسک مینجمنٹ

- خطرات

- راز

- محفوظ بنانے

- سیکورٹی

- سے ظاہر ہوا

- شوز

- اہم

- نمایاں طور پر

- So

- ٹھوس

- ماخذ

- معیار

- ابھی تک

- اس طرح

- سروے

- مصنوعی

- ٹیموں

- ٹیکنالوجی

- ٹیکنالوجی

- کہ

- ۔

- ان

- وہاں.

- یہ

- اس

- کرنے کے لئے

- اوزار

- سب سے اوپر

- ٹریننگ

- شفافیت

- اعتماد

- سمجھ

- افہام و تفہیم

- استعمال کی شرائط

- استعمال کیا جاتا ہے

- صارفین

- کا استعمال کرتے ہوئے

- بہت

- نقصان دہ

- طریقوں

- ساتھ

- کام کر

- لکھنا

- لکھا ہے

- تم

- زیفیرنیٹ