مصنوعی ذہانت (AI) اور مشین لرننگ (ML) کی دنیا تخلیقی AI ماڈلز کے عروج کے ساتھ ایک مثالی تبدیلی کا مشاہدہ کر رہی ہے جو انسان جیسا متن، تصاویر، کوڈ اور آڈیو بنا سکتے ہیں۔ کلاسیکی ML ماڈلز کے مقابلے میں، جنریٹو AI ماڈل نمایاں طور پر بڑے اور زیادہ پیچیدہ ہیں۔ تاہم، ان کی بڑھتی ہوئی پیچیدگی کا اندازہ لگانے کے لیے زیادہ لاگت اور طاقتور کمپیوٹ وسائل کی بڑھتی ہوئی ضرورت کے ساتھ بھی آتا ہے۔ جنریٹیو AI ماڈلز کے لیے اعلیٰ تخمینہ لاگت محدود وسائل کے حامل کاروباری اداروں اور محققین کے داخلے میں رکاوٹ بن سکتی ہے، جس سے زیادہ موثر اور کفایت شعاری کے حل کی ضرورت ہوتی ہے۔ مزید برآں، جنریٹیو AI کے استعمال کے زیادہ تر معاملات میں انسانی تعامل یا حقیقی دنیا کے منظرنامے شامل ہوتے ہیں، ایسے ہارڈ ویئر کی ضرورت ہوتی ہے جو کم تاخیر کی کارکردگی پیش کر سکے۔ AWS طاقتور، موثر، اور لاگت سے موثر کمپیوٹ ہارڈویئر کی بڑھتی ہوئی ضرورت کو پورا کرنے کے لیے مقصد سے تیار کردہ چپس کے ساتھ اختراعات کر رہا ہے۔

آج، ہم اس کا اعلان کرتے ہوئے پرجوش ہیں۔ ایمیزون سیج میکر کی حمایت کرتا ہے AWS Inferentia2 (ml.inf2) اور AWS ٹرینیم (ml.trn1) پر مبنی SageMaker مثالیں جنریٹیو AI ماڈلز کی میزبانی کے لیے حقیقی وقت اور غیر مطابقت پذیر اندازے کے لیے۔ ml.inf2 مثالیں یو ایس ایسٹ (اوہائیو) میں سیج میکر اور یو ایس ایسٹ (این. ورجینیا) میں ml.trn1 مثالوں پر ماڈل کی تعیناتی کے لیے دستیاب ہیں۔

آپ سیج میکر پر ان مثالوں کو جنریٹو AI ماڈلز کے لیے کم قیمت پر اعلی کارکردگی حاصل کرنے کے لیے استعمال کر سکتے ہیں، بشمول بڑے لینگویج ماڈلز (LLMs)، اسٹیبل ڈفیوژن، اور وژن ٹرانسفارمرز۔ اس کے علاوہ، آپ استعمال کر سکتے ہیں Amazon SageMaker Inference Recommender لوڈ ٹیسٹ چلانے میں آپ کی مدد کرنے اور ان مثالوں پر اپنے ماڈل کو تعینات کرنے کے قیمت کی کارکردگی کے فوائد کا جائزہ لینے کے لیے۔

آپ ml.inf2 اور ml.trn1 مثالوں کو SageMaker پر ٹیکسٹ سمریائزیشن، کوڈ جنریشن، ویڈیو اور امیج جنریشن، اسپیچ ریکگنیشن، پرسنلائزیشن، فراڈ کا پتہ لگانے اور مزید کے لیے اپنی ML ایپلیکیشنز کو چلانے کے لیے استعمال کر سکتے ہیں۔ آپ اپنے SageMaker اینڈ پوائنٹ کو کنفیگر کرتے وقت ml.trn1 یا ml.inf2 مثالیں بتا کر آسانی سے شروعات کر سکتے ہیں۔ آپ آسانی سے شروع کرنے کے لیے ml.trn1 اور ml.inf2 ہم آہنگ AWS ڈیپ لرننگ کنٹینرز (DLCs) PyTorch، TensorFlow، Hugging Face، اور بڑے ماڈل کا اندازہ (LMI) کے لیے استعمال کر سکتے ہیں۔ ورژن کے ساتھ مکمل فہرست کے لیے، دیکھیں دستیاب ڈیپ لرننگ کنٹینرز امیجز.

اس پوسٹ میں، ہم LMI کنٹینر کا فائدہ اٹھاتے ہوئے، بغیر کسی اضافی کوڈنگ کی ضرورت کے، SageMaker کا استعمال کرتے ہوئے AWS Inferentia2 پر ایک بڑے لینگویج ماڈل کو تعینات کرنے کا عمل دکھاتے ہیں۔ ہم استعمال کرتے ہیں GPT4ALL-J، ایک ٹھیک ٹیونڈ GPT-J 7B ماڈل جو چیٹ بوٹ طرز کی بات چیت فراہم کرتا ہے۔

ml.trn1 اور ml.inf2 مثالوں کا جائزہ

ml.trn1 مثالیں ٹرینیم ایکسلریٹر سے چلتی ہیں، جس کا مقصد بنیادی طور پر LLMs سمیت جنریٹو AI ماڈلز کی اعلیٰ کارکردگی والی گہری سیکھنے کی تربیت کے لیے بنایا گیا ہے۔ تاہم، یہ مثالیں ان ماڈلز کے لیے انفرنس ورک بوجھ کو بھی سپورٹ کرتی ہیں جو Inf2 میں فٹ ہونے سے بھی بڑے ہوتے ہیں۔ سب سے بڑا مثال کا سائز، trn1.32x بڑا مثال، خصوصیات 16 ٹرینیم ایکسلریٹر FP512/BF3.4 کمپیوٹ پاور کے 16 petaflops تک فراہم کرنے والی ایک ہی مثال میں 16 GB ایکسلریٹر میموری کے ساتھ۔ 16 ٹرینیئم ایکسلریٹر ہموار اجتماعی مواصلات کے لیے انتہائی تیز رفتار نیورون لنک وی 2 کے ساتھ جڑے ہوئے ہیں۔

ml.Inf2 مثالوں کے ذریعہ تقویت یافتہ ہیں۔ AWS Inferentia2 ایکسلریٹر، اندازہ لگانے کے لیے ایک مقصد بنایا ہوا ایکسلریٹر۔ یہ پہلی نسل کے AWS Inferentia کے مقابلے میں تین گنا زیادہ کمپیوٹ کارکردگی، چار گنا زیادہ تھرو پٹ تک، اور 10 گنا تک کم تاخیر فراہم کرتا ہے۔ سب سے بڑا انسٹینس سائز، Inf2.48xlarge، BF12/FP2 کے لیے 384 petaflops کی مشترکہ کمپیوٹ پاور کے لیے ایک مثال میں 2.3 GB ایکسلریٹر میموری کے ساتھ 16 AWS Inferentia16 ایکسلریٹر رکھتا ہے۔ یہ آپ کو ایک ہی مثال میں 175-بلین پیرامیٹر ماڈل تک تعینات کرنے کے قابل بناتا ہے۔ Inf2 اس انٹر کنیکٹ کو پیش کرنے کے لیے واحد قیاس کے مطابق بہتر مثال ہے، یہ ایک خصوصیت ہے جو صرف زیادہ مہنگی تربیتی مثالوں میں دستیاب ہے۔ انتہائی بڑے ماڈلز کے لیے جو کسی ایک ایکسلریٹر میں فٹ نہیں ہوتے ہیں، ڈیٹا سی پی یو کو مکمل طور پر نظرانداز کرتے ہوئے، نیورون لنک کے ساتھ ایکسلریٹر کے درمیان براہ راست بہتا ہے۔ NeuronLink کے ساتھ، Inf2 تیزی سے تقسیم شدہ تخمینہ کی حمایت کرتا ہے اور تھرو پٹ اور تاخیر کو بہتر بناتا ہے۔

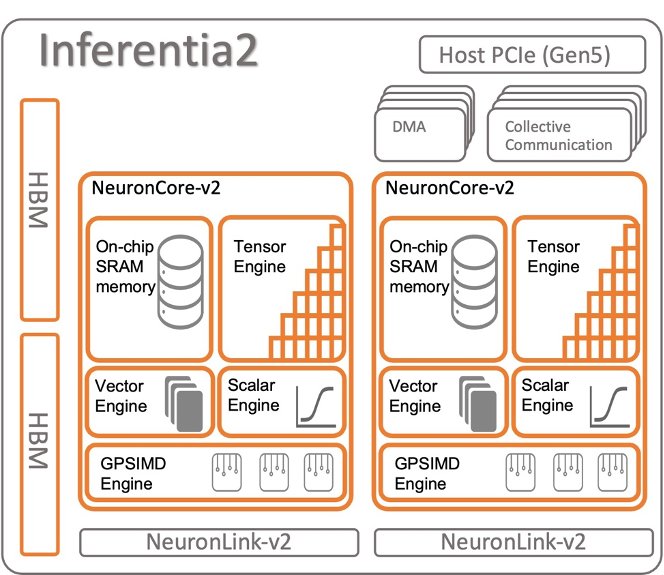

AWS Inferentia2 اور Trainium accelerators دونوں میں دو ہیں۔ NeuronCores-v2، 32 GB HBM میموری اسٹیک، اور وقف شدہ اجتماعی-کمپیوٹ انجن، جو ملٹی ایکسلریٹر انفرنس کرتے وقت کمپیوٹیشن اور کمیونیکیشن کو اوور لیپ کرکے رن ٹائم کو خود بخود بہتر بناتے ہیں۔ فن تعمیر کے بارے میں مزید تفصیلات کے لیے ملاحظہ کریں۔ ٹرینیم اور انفرنشیا ڈیوائسز.

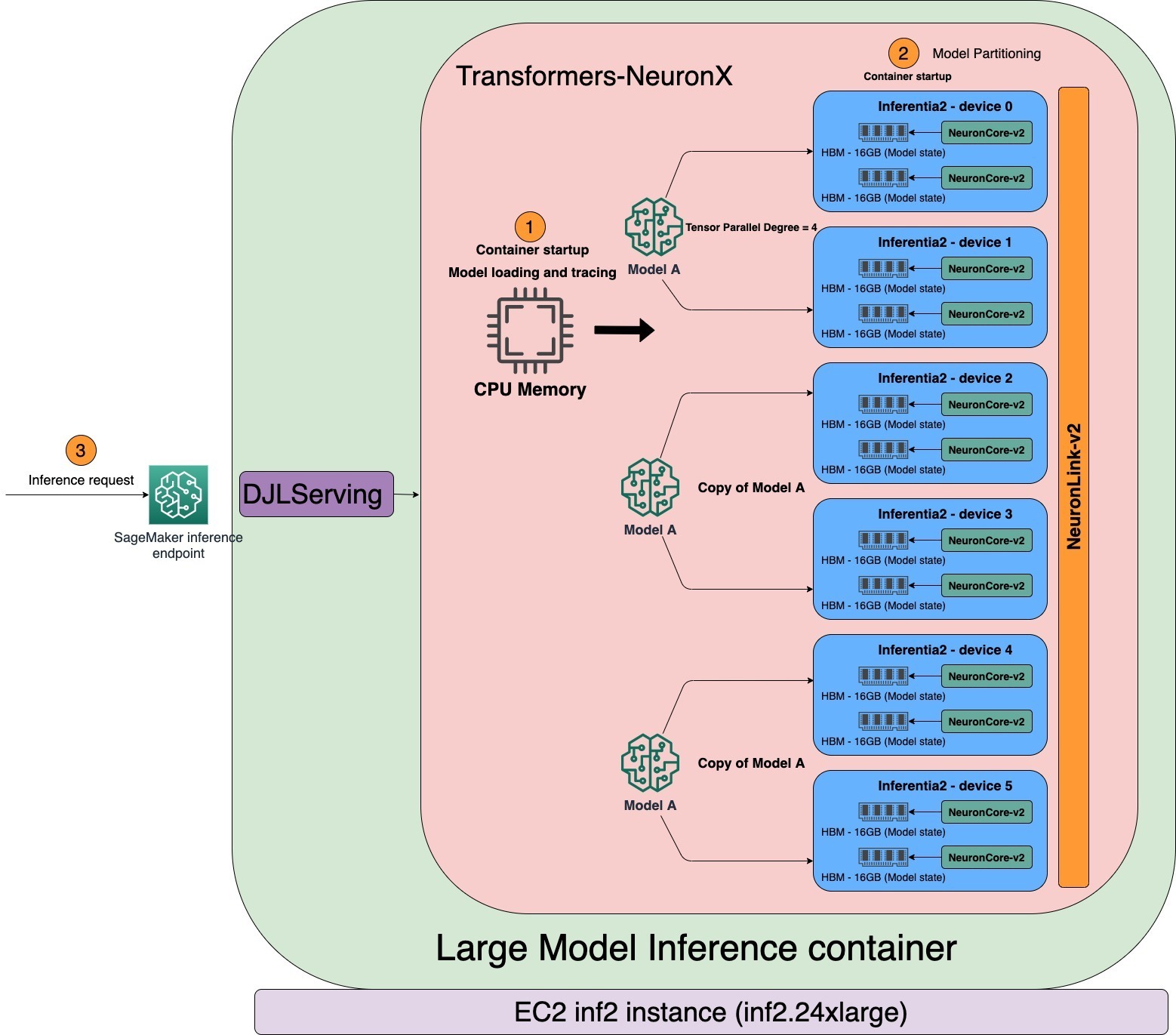

مندرجہ ذیل خاکہ AWS Inferentia2 کا استعمال کرتے ہوئے ایک مثال فن تعمیر کو دکھاتا ہے۔

AWS نیوران SDK

AWS نیوران SDK AWS Inferentia اور Trainium پر مبنی مثالوں پر گہری سیکھنے کے کام کے بوجھ کو چلانے کے لیے استعمال کیا جاتا ہے۔ AWS نیوران میں ایک گہری سیکھنے کا کمپائلر، رن ٹائم، اور ٹولز شامل ہیں جو مقامی طور پر TensorFlow اور PyTorch میں مربوط ہیں۔ نیوران کے ساتھ، آپ ml.trn1 اور ml.inf2 پر اعلی کارکردگی والے ML ورک بوجھ کو تیار، پروفائل، اور تعینات کر سکتے ہیں۔

۔ نیوران کمپائلر ML ماڈلز کو مختلف فارمیٹس میں قبول کرتا ہے (TensorFlow, PyTorch, XLA HLO) اور انہیں نیوران ڈیوائسز پر چلانے کے لیے بہتر بناتا ہے۔ نیوران کمپائلر کو ML فریم ورک کے اندر اندر طلب کیا جاتا ہے، جہاں ML ماڈلز کو کمپائلر کو نیوران فریم ورک پلگ ان کے ذریعے بھیجا جاتا ہے۔ نتیجے میں مرتب کرنے والے آرٹفیکٹ کو NEFF فائل (نیورون ایگزیکیوٹیبل فائل فارمیٹ) کہا جاتا ہے جو بدلے میں نیوران رن ٹائم کے ذریعے نیوران ڈیوائس پر لوڈ ہوتا ہے۔

۔ نیوران رن ٹائم کرنل ڈرائیور اور C/C++ لائبریریوں پر مشتمل ہے، جو AWS Inferentia اور Trainium Neuron ڈیوائسز تک رسائی کے لیے API فراہم کرتی ہے۔ TensorFlow اور PyTorch کے لیے نیورون ایم ایل فریم ورک پلگ ان نیورون کورز پر ماڈلز کو لوڈ اور چلانے کے لیے نیوران رن ٹائم کا استعمال کرتے ہیں۔ نیوران رن ٹائم لوڈز نے ڈیپ لرننگ ماڈلز (NEFF) کو نیوران ڈیوائسز پر مرتب کیا ہے اور اسے ہائی تھرو پٹ اور کم لیٹنسی کے لیے بہتر بنایا گیا ہے۔

SageMaker ml.inf2 مثالوں کا استعمال کرتے ہوئے NLP ماڈلز کی میزبانی کریں۔

اس سے پہلے کہ ہم LLMs کی خدمت میں گہرائی میں ڈوب جائیں۔ ٹرانسفارمرز - نیورونکس، جو کہ ایک اوپن سورس لائبریری ہے جو ماڈل کے بڑے وزن والے میٹرکس کو متعدد نیورون کورز پر جوڑتی ہے، آئیے مختصراً ایک ایسے ماڈل کے لیے مخصوص تعیناتی کے بہاؤ کو دیکھتے ہیں جو سنگل نیورون کور پر فٹ ہو سکتا ہے۔

چیک کریں معاون ماڈلز کی فہرست یہ یقینی بنانے کے لیے کہ ماڈل AWS Inferentia2 پر تعاون یافتہ ہے۔ اگلا، ماڈل کو نیوران کمپائلر کے ذریعہ پہلے سے مرتب کرنے کی ضرورت ہے۔ آپ سیج میکر نوٹ بک یا ایک استعمال کر سکتے ہیں۔ ایمیزون لچکدار کمپیوٹ کلاؤڈ (ایمیزون EC2) مثال کے طور پر ماڈل کو مرتب کرنا۔ آپ SageMaker Python SDK استعمال کر سکتے ہیں تاکہ مقبول ڈیپ لرننگ فریم ورک جیسے PyTorch کا استعمال کرتے ہوئے ماڈلز کو تعینات کیا جا سکے، جیسا کہ درج ذیل کوڈ میں دکھایا گیا ہے۔ آپ اپنے ماڈل کو SageMaker ہوسٹنگ سروسز میں تعینات کر سکتے ہیں اور ایک اختتامی نقطہ حاصل کر سکتے ہیں جسے اندازہ لگانے کے لیے استعمال کیا جا سکتا ہے۔ یہ اینڈ پوائنٹس مکمل طور پر منظم ہیں اور آٹو اسکیلنگ کو سپورٹ کرتے ہیں۔

کا حوالہ دیتے ہیں ڈویلپر فلو نمونہ اسکرپٹ کے ساتھ SageMaker پر Inf2 کے عام ترقیاتی بہاؤ کے بارے میں مزید تفصیلات کے لیے۔

SageMaker ml.inf2 مثالوں کا استعمال کرتے ہوئے LLMs کی میزبانی کریں۔

اربوں پیرامیٹرز والے بڑے لینگویج ماڈلز اکثر اتنے بڑے ہوتے ہیں کہ ایک ہی ایکسلریٹر پر فٹ نہیں ہو سکتے۔ یہ ایک سے زیادہ ایکسلریٹروں پر ایل ایل ایم کی میزبانی کے لیے ماڈل متوازی تکنیکوں کے استعمال کی ضرورت ہے۔ LLMs کی میزبانی کے لیے ایک اور اہم ضرورت اعلیٰ کارکردگی والے ماڈل پیش کرنے والے حل کا نفاذ ہے۔ اس حل کو مؤثر طریقے سے ماڈل کو لوڈ کرنا چاہیے، پارٹیشن کا انتظام کرنا چاہیے، اور بغیر کسی رکاوٹ کے HTTP اینڈ پوائنٹس کے ذریعے درخواستیں پیش کرنا چاہیے۔

SageMaker میں خصوصی ڈیپ لرننگ کنٹینرز (DLCs)، لائبریریاں، اور ماڈل کی ہم آہنگی کے لیے ٹولنگ اور بڑے ماڈل کا اندازہ شامل ہے۔ SageMaker پر LMI کے ساتھ شروع کرنے کے لیے وسائل کے لیے، رجوع کریں۔ ماڈل متوازی اور بڑے ماڈل کا اندازہ. SageMaker بڑے ماڈلز جیسے GPT، T5، OPT، BLOOM، اور AWS انفراسٹرکچر پر مستحکم ڈفیوژن کی میزبانی کے لیے مقبول اوپن سورس لائبریریوں کے ساتھ DLCs کو برقرار رکھتا ہے۔ ان خصوصی DLCs کو SageMaker LMI کنٹینرز کہا جاتا ہے۔

سیج میکر ایل ایم آئی کنٹینرز DJLServing کا استعمال کریں، ایک ماڈل سرور جو ٹرانسفارمرز-نیورونکس لائبریری کے ساتھ مربوط ہے تاکہ نیورون کورز میں ٹینسر کے ہم آہنگی کو سپورٹ کیا جا سکے۔ DJLServing کیسے کام کرتا ہے اس کے بارے میں مزید جاننے کے لیے، رجوع کریں۔ DJLServing اور DeepSpeed ماڈل کے متوازی اندازہ کا استعمال کرتے ہوئے Amazon SageMaker پر بڑے ماڈلز تعینات کریں۔. DJL ماڈل سرور اور ٹرانسفارمرز-نیورونکس لائبریری کنٹینر کے بنیادی اجزاء کے طور پر کام کرتے ہیں، جس میں نیوران SDK بھی شامل ہے۔ یہ سیٹ اپ ماڈلز کو AWS Inferentia2 ایکسلریٹرز پر لوڈ کرنے میں سہولت فراہم کرتا ہے، ماڈل کو متعدد نیورون کورز پر متوازی بناتا ہے، اور HTTP اینڈ پوائنٹس کے ذریعے سرونگ کو قابل بناتا ہے۔

LMI کنٹینر ایک سے لوڈنگ ماڈلز کو سپورٹ کرتا ہے۔ ایمیزون سادہ اسٹوریج سروس (Amazon S3) بالٹی یا Hugging Face Hub۔ پہلے سے طے شدہ ہینڈلر اسکرپٹ ماڈل کو لوڈ کرتا ہے، اسے مرتب کرتا ہے اور اسے نیوران کی اصلاح شدہ شکل میں تبدیل کرتا ہے، اور اسے لوڈ کرتا ہے۔ LLMs کی میزبانی کے لیے LMI کنٹینر استعمال کرنے کے لیے، ہمارے پاس دو اختیارات ہیں:

- بغیر کوڈ (ترجیحی) - یہ ایک LMI کنٹینر کا استعمال کرتے ہوئے LLM کو تعینات کرنے کا سب سے آسان طریقہ ہے۔ اس طریقہ میں، آپ فراہم کردہ استعمال کر سکتے ہیں پہلے سے طے شدہ ہینڈلر اور صرف ماڈل کا نام اور مطلوبہ پیرامیٹرز پاس کریں۔

serving.propertiesماڈل کو لوڈ اور ہوسٹ کرنے کے لیے فائل۔ ڈیفالٹ ہینڈلر استعمال کرنے کے لیے، ہم فراہم کرتے ہیں۔entryPointپیرامیٹر کے طور پرdjl_python.transformers-neuronx. - اپنا اپنا اسکرپٹ لائیں۔ – اس نقطہ نظر میں، آپ کے پاس اپنی model.py فائل بنانے کا اختیار ہے، جس میں ماڈل کو لوڈ کرنے اور پیش کرنے کے لیے ضروری کوڈ ہوتا ہے۔ یہ فائل کے درمیان ایک ثالث کے طور پر کام کرتا ہے

DJLServingAPIs اورtransformers-neuronxAPIs ماڈل لوڈنگ کے عمل کو اپنی مرضی کے مطابق کرنے کے لیے، آپ فراہم کر سکتے ہیں۔serving.propertiesقابل ترتیب پیرامیٹرز کے ساتھ۔ دستیاب قابل ترتیب پیرامیٹرز کی ایک جامع فہرست کے لیے، رجوع کریں۔ DJL کنفیگریشن کے تمام اختیارات. یہاں ایک مثال ہے۔ model.py فائل.

رن ٹائم فن تعمیر

۔ tensor_parallel_degree پراپرٹی ویلیو متعدد نیورون کورز میں ٹینسر کے متوازی ماڈیولز کی تقسیم کا تعین کرتی ہے۔ مثال کے طور پر، inf2.24xlarge میں چھ AWS Inferentia2 ایکسلریٹر ہیں۔ ہر AWS Inferentia2 ایکسلریٹر میں دو نیورون کور ہوتے ہیں۔ ہر نیورون کور میں 16 جی بی ذخیرہ کرنے والے ٹینسر کے متوازی ماڈیولز کی ایک سرشار ہائی بینڈوڈتھ میموری (HBM) ہوتی ہے۔ 4 کی ٹینسر متوازی ڈگری کے ساتھ، LMI ایک ہی ماڈل کی تین ماڈل کاپیاں مختص کرے گا، ہر ایک چار نیورون کور استعمال کرے گا۔ جیسا کہ درج ذیل خاکہ میں دکھایا گیا ہے، جب LMI کنٹینر شروع ہوتا ہے، ماڈل کو لوڈ کیا جائے گا اور پہلے CPU ایڈریس ایبل میموری میں ٹریس کیا جائے گا۔ جب ٹریسنگ مکمل ہو جاتی ہے، تو ماڈل کو ٹینسر کے متوازی ڈگری کی بنیاد پر نیورون کور پر تقسیم کر دیا جاتا ہے۔

LMI DJLServing کو اپنے ماڈل سرونگ اسٹیک کے طور پر استعمال کرتا ہے۔ SageMaker میں کنٹینر کی صحت کی جانچ کے گزر جانے کے بعد، کنٹینر تخمینہ کی درخواست کی خدمت کے لیے تیار ہے۔ DJLServing کے مساوی متعدد ازگر کے عمل کا آغاز کرتا ہے۔ TOTAL NUMBER OF NEURON CORES/TENSOR_PARALLEL_DEGREE. Python کے ہر عمل میں C++ کے مساوی تھریڈز ہوتے ہیں۔ TENSOR_PARALLEL_DEGREE. ہر C++ تھریڈز ایک نیورون کور پر ماڈل کا ایک شارڈ رکھتا ہے۔

بہت سے پریکٹیشنرز (ازگر کا عمل) تسلسل کے ساتھ تخمینہ چلاتے ہیں جب سرور کو متعدد آزاد درخواستوں کے ساتھ طلب کیا جاتا ہے۔ اگرچہ اسے ترتیب دینا آسان ہے، لیکن یہ عام طور پر ایکسلریٹر کی کمپیوٹ پاور کو استعمال کرنے کا بہترین عمل نہیں ہے۔ اس سے نمٹنے کے لیے، DJLServing متحرک بیچنگ کی بلٹ ان آپٹیمائزیشنز پیش کرتا ہے تاکہ سرور سائیڈ پر ان آزاد انفرنس کی درخواستوں کو یکجا کیا جا سکے تاکہ تھرو پٹ کو بڑھانے کے لیے متحرک طور پر ایک بڑا بیچ بنایا جا سکے۔ تمام درخواستیں اصل کام کی قطاروں میں داخل ہونے سے پہلے ڈائنامک بیچر تک پہنچ جاتی ہیں تاکہ اندازہ کا انتظار کیا جا سکے۔ آپ کا استعمال کرتے ہوئے متحرک بیچنگ کے لیے اپنے پسندیدہ بیچ سائز سیٹ کر سکتے ہیں۔ batch_size میں ترتیبات serving.properties. آپ بھی ترتیب دے سکتے ہیں۔ max_batch_delay آپ کی تاخیر کی ضروریات کی بنیاد پر بیچ میں شامل ہونے کے لیے دیگر درخواستوں کا انتظار کرنے کے لیے بیچر میں زیادہ سے زیادہ تاخیر کا وقت بتانے کے لیے۔ تھرو پٹ ماڈل کاپیوں کی تعداد اور کنٹینر میں شروع کیے گئے ازگر پروسیس گروپس پر بھی منحصر ہے۔ جیسا کہ مندرجہ ذیل خاکہ میں دکھایا گیا ہے، ٹینسر کی متوازی ڈگری 4 پر سیٹ کے ساتھ، LMI کنٹینر تین Python پروسیس گروپس کو لانچ کرتا ہے، ہر ایک کے پاس ماڈل کی مکمل کاپی ہوتی ہے۔ یہ آپ کو بیچ کا سائز بڑھانے اور اعلی تھرو پٹ حاصل کرنے کی اجازت دیتا ہے۔

LLMs کی تعیناتی کے لیے SageMaker نوٹ بک

اس سیکشن میں، ہم GPT4All-J، 6-بلین پیرامیٹر ماڈل جو FP24 میں 32 GB ہے، تعینات کرنے کا مرحلہ وار واک تھرو فراہم کرتے ہیں۔ GPT4All-J ایک مقبول چیٹ بوٹ ہے جس کو مختلف قسم کے تعامل کے مواد جیسے الفاظ کے مسائل، ڈائیلاگ، کوڈ، نظمیں، گانے، اور کہانیوں پر تربیت دی گئی ہے۔ GPT4all-J ایک عمدہ GPT-J ماڈل ہے جو انسانی تعاملات کی طرح ردعمل پیدا کرتا ہے۔

اس مثال کے لیے مکمل نوٹ بک فراہم کی گئی ہے۔ GitHub کے. ہم ماڈل کو Inf2 مثال میں تعینات کرنے کے لیے SageMaker Python SDK استعمال کر سکتے ہیں۔ ہم فراہم کردہ استعمال کرتے ہیں۔ پہلے سے طے شدہ ہینڈلر ماڈل لوڈ کرنے کے لیے۔ اس کے ساتھ، ہمیں صرف ایک فراہم کرنے کی ضرورت ہے servings.properties فائل اس فائل میں DJL ماڈل سرور کے لیے ماڈل کو ڈاؤن لوڈ اور ہوسٹ کرنے کے لیے مطلوبہ کنفیگریشنز ہیں۔ ہم استعمال کرتے ہوئے گلے لگانے والے چہرے کے ماڈل کا نام بتا سکتے ہیں۔ model_id ماڈل کو براہ راست Hugging Face repo سے ڈاؤن لوڈ کرنے کے لیے پیرامیٹر۔ متبادل طور پر، آپ ایمیزون S3 سے ماڈل کو فراہم کر کے ڈاؤن لوڈ کر سکتے ہیں۔ s3url پیرامیٹر entryPoint ماڈل کو لوڈ کرنے کے لیے لائبریری کی طرف اشارہ کرنے کے لیے پیرامیٹر ترتیب دیا گیا ہے۔ پر مزید تفصیلات کے لیے djl_python.fastertransformer، حوالہ دیتے ہیں گٹ ہب کوڈ.

۔ tensor_parallel_degree پراپرٹی ویلیو متعدد آلات میں ٹینسر کے متوازی ماڈیولز کی تقسیم کا تعین کرتی ہے۔ مثال کے طور پر، 12 نیورون کور اور 4 کی ٹینسر متوازی ڈگری کے ساتھ، LMI تین ماڈل کاپیاں مختص کرے گا، ہر ایک میں چار نیورون کور استعمال کیے جائیں گے۔ آپ پراپرٹی کا استعمال کرتے ہوئے صحت سے متعلق قسم کی بھی وضاحت کر سکتے ہیں۔ dtype. n_position پیرامیٹر ماڈل کے لیے زیادہ سے زیادہ ان پٹ اور آؤٹ پٹ تسلسل کی لمبائی کا مجموعہ بیان کرتا ہے۔ درج ذیل کوڈ دیکھیں:

کی تعمیر tarball استعمال serving.properties اور اسے S3 بالٹی میں اپ لوڈ کریں۔ اگرچہ اس مثال میں پہلے سے طے شدہ ہینڈلر استعمال کیا گیا ہے، آپ ایک تیار کر سکتے ہیں۔ model.py لوڈنگ اور سرونگ کے عمل کو حسب ضرورت بنانے کے لیے فائل۔ اگر کوئی پیکجز ہیں جن کو انسٹال کرنے کی ضرورت ہے، تو انہیں میں شامل کریں۔ requirements.txt فائل درج ذیل کوڈ دیکھیں:

DJL کنٹینر کی تصویر بازیافت کریں اور SageMaker ماڈل بنائیں:

اگلا، ہم پہلے بیان کردہ ماڈل کنفیگریشن کے ساتھ SageMaker اینڈ پوائنٹ بناتے ہیں۔ کنٹینر ماڈل کو میں ڈاؤن لوڈ کرتا ہے۔ /tmp جگہ کیونکہ سیج میکر نقشہ بناتا ہے۔ /tmp کرنے کے لئے ایمیزون لچکدار بلاک اسٹور (ایمیزون ای بی ایس)۔ ہمیں ایک شامل کرنے کی ضرورت ہے۔ volume_size پیرامیٹر کو یقینی بنانے کے لیے /tmp ڈائرکٹری میں ماڈل کو ڈاؤن لوڈ اور مرتب کرنے کے لیے کافی جگہ ہے۔ ہم نے طے کیا container_startup_health_check_timeout ماڈل کے تیار ہونے کے بعد صحت کی جانچ شروع ہونے کو یقینی بنانے کے لیے 3,600 سیکنڈ تک۔ ہم ml.inf2.8xlarge مثال استعمال کرتے ہیں۔ درج ذیل کوڈ دیکھیں:

سیج میکر اینڈ پوائنٹ بنانے کے بعد، ہم سیج میکر اینڈ پوائنٹس کے خلاف ریئل ٹائم پیشین گوئیاں کر سکتے ہیں Predictor اعتراض:

صاف کرو

اپنے ٹیسٹ مکمل کرنے کے بعد اخراجات بچانے کے لیے اختتامی پوائنٹس کو حذف کریں:

نتیجہ

اس پوسٹ میں، ہم نے SageMaker کی نئی شروع کی گئی صلاحیت کی نمائش کی، جو اب جنریٹو AI ماڈلز کی میزبانی کے لیے ml.inf2 اور ml.trn1 مثالوں کو سپورٹ کرتی ہے۔ ہم نے دکھایا کہ GPT4ALL-J، ایک جنریٹو AI ماڈل، کو AWS Inferentia2 پر SageMaker اور LMI کنٹینر کا استعمال کرتے ہوئے، بغیر کوئی کوڈ لکھے کیسے تعینات کیا جائے۔ ہم نے یہ بھی دکھایا کہ آپ DJLServing اور کس طرح استعمال کر سکتے ہیں۔ transformers-neuronx ماڈل لوڈ کرنے کے لیے، اسے تقسیم کرنا، اور سرو کرنا۔

Inf2 مثالیں AWS پر جنریٹو AI ماڈلز چلانے کا سب سے زیادہ سرمایہ کاری مؤثر طریقہ فراہم کرتی ہیں۔ کارکردگی کی تفصیلات کے لیے رجوع کریں۔ Inf2 کارکردگی.

دیکھو GitHub کے مثال کے طور پر نوٹ بک کے لئے ریپو۔ اسے آزمائیں اور اگر آپ کے کوئی سوالات ہیں تو ہمیں بتائیں!

مصنفین کے بارے میں

وویک گنگاسنی۔ ایمیزون ویب سروسز میں ایک سینئر مشین لرننگ سلوشنز آرکیٹیکٹ ہیں۔ وہ AWS پر AI/ML ایپلیکیشنز بنانے اور تعینات کرنے کے لیے مشین لرننگ اسٹارٹ اپ کے ساتھ کام کرتا ہے۔ وہ فی الحال MLOps، ML Inference اور Low-code ML کے حل فراہم کرنے پر توجہ مرکوز کر رہے ہیں۔ انہوں نے نیچرل لینگویج پروسیسنگ اور کمپیوٹر ویژن سمیت مختلف ڈومینز میں پروجیکٹس پر کام کیا ہے۔

وویک گنگاسنی۔ ایمیزون ویب سروسز میں ایک سینئر مشین لرننگ سلوشنز آرکیٹیکٹ ہیں۔ وہ AWS پر AI/ML ایپلیکیشنز بنانے اور تعینات کرنے کے لیے مشین لرننگ اسٹارٹ اپ کے ساتھ کام کرتا ہے۔ وہ فی الحال MLOps، ML Inference اور Low-code ML کے حل فراہم کرنے پر توجہ مرکوز کر رہے ہیں۔ انہوں نے نیچرل لینگویج پروسیسنگ اور کمپیوٹر ویژن سمیت مختلف ڈومینز میں پروجیکٹس پر کام کیا ہے۔

ہیروشی ٹوکیو AWS اناپورنا لیبز میں ایک حل آرکیٹیکٹ ہے۔ جاپان میں مقیم، اس نے AWS کے حصول سے پہلے ہی اناپورنا لیبز میں شمولیت اختیار کی اور اناپورنا لیبز ٹیکنالوجی کے ساتھ صارفین کی مسلسل مدد کی۔ اس کی حالیہ توجہ مشین لرننگ کے حل پر ہے جس کی بنیاد مقصد سے بنائے گئے سلکان، AWS Inferentia اور Trainium پر ہے۔

ہیروشی ٹوکیو AWS اناپورنا لیبز میں ایک حل آرکیٹیکٹ ہے۔ جاپان میں مقیم، اس نے AWS کے حصول سے پہلے ہی اناپورنا لیبز میں شمولیت اختیار کی اور اناپورنا لیبز ٹیکنالوجی کے ساتھ صارفین کی مسلسل مدد کی۔ اس کی حالیہ توجہ مشین لرننگ کے حل پر ہے جس کی بنیاد مقصد سے بنائے گئے سلکان، AWS Inferentia اور Trainium پر ہے۔

دھول پٹیل AWS میں پرنسپل مشین لرننگ آرکیٹیکٹ ہے۔ انہوں نے تقسیم شدہ کمپیوٹنگ اور مصنوعی ذہانت سے متعلق مسائل پر بڑے اداروں سے لے کر درمیانے درجے کے اسٹارٹ اپس تک کی تنظیموں کے ساتھ کام کیا ہے۔ وہ NLP اور کمپیوٹر ویژن ڈومینز سمیت گہری سیکھنے پر توجہ مرکوز کرتا ہے۔ وہ صارفین کو SageMaker پر اعلیٰ کارکردگی کے ماڈل کا اندازہ حاصل کرنے میں مدد کرتا ہے۔

دھول پٹیل AWS میں پرنسپل مشین لرننگ آرکیٹیکٹ ہے۔ انہوں نے تقسیم شدہ کمپیوٹنگ اور مصنوعی ذہانت سے متعلق مسائل پر بڑے اداروں سے لے کر درمیانے درجے کے اسٹارٹ اپس تک کی تنظیموں کے ساتھ کام کیا ہے۔ وہ NLP اور کمپیوٹر ویژن ڈومینز سمیت گہری سیکھنے پر توجہ مرکوز کرتا ہے۔ وہ صارفین کو SageMaker پر اعلیٰ کارکردگی کے ماڈل کا اندازہ حاصل کرنے میں مدد کرتا ہے۔

کنگ لین AWS میں سافٹ ویئر ڈویلپمنٹ انجینئر ہے۔ وہ Amazon میں کئی چیلنجنگ پروڈکٹس پر کام کر رہا ہے، بشمول ہائی پرفارمنس ایم ایل انفرنس سلوشنز اور ہائی پرفارمنس لاگنگ سسٹم۔ Qing کی ٹیم نے بہت کم تاخیر کے ساتھ Amazon Advertising میں پہلا بلین پیرامیٹر ماڈل کامیابی کے ساتھ لانچ کیا۔ کنگ کو بنیادی ڈھانچے کی اصلاح اور گہری سیکھنے کی سرعت کے بارے میں گہرائی سے علم ہے۔

کنگ لین AWS میں سافٹ ویئر ڈویلپمنٹ انجینئر ہے۔ وہ Amazon میں کئی چیلنجنگ پروڈکٹس پر کام کر رہا ہے، بشمول ہائی پرفارمنس ایم ایل انفرنس سلوشنز اور ہائی پرفارمنس لاگنگ سسٹم۔ Qing کی ٹیم نے بہت کم تاخیر کے ساتھ Amazon Advertising میں پہلا بلین پیرامیٹر ماڈل کامیابی کے ساتھ لانچ کیا۔ کنگ کو بنیادی ڈھانچے کی اصلاح اور گہری سیکھنے کی سرعت کے بارے میں گہرائی سے علم ہے۔

چنگ وی لی ایمیزون ویب سروسز میں مشین لرننگ کا ماہر ہے۔ انہوں نے پی ایچ ڈی کی ڈگری حاصل کی۔ آپریشنز ریسرچ میں جب اس نے اپنے مشیر کے ریسرچ گرانٹ اکاؤنٹ کو توڑا اور نوبل انعام دینے میں ناکام رہے جس کا اس نے وعدہ کیا تھا۔ فی الحال وہ مالیاتی خدمات اور انشورنس انڈسٹری میں صارفین کو AWS پر مشین لرننگ سلوشنز بنانے میں مدد کرتا ہے۔ اپنے فارغ وقت میں وہ پڑھنا اور پڑھانا پسند کرتے ہیں۔

چنگ وی لی ایمیزون ویب سروسز میں مشین لرننگ کا ماہر ہے۔ انہوں نے پی ایچ ڈی کی ڈگری حاصل کی۔ آپریشنز ریسرچ میں جب اس نے اپنے مشیر کے ریسرچ گرانٹ اکاؤنٹ کو توڑا اور نوبل انعام دینے میں ناکام رہے جس کا اس نے وعدہ کیا تھا۔ فی الحال وہ مالیاتی خدمات اور انشورنس انڈسٹری میں صارفین کو AWS پر مشین لرننگ سلوشنز بنانے میں مدد کرتا ہے۔ اپنے فارغ وقت میں وہ پڑھنا اور پڑھانا پسند کرتے ہیں۔

ایلن ٹین SageMaker کے ساتھ ایک سینئر پروڈکٹ مینیجر ہے جو بڑے ماڈل کے تخمینے پر سرکردہ کوششیں کر رہا ہے۔ وہ تجزیات کے شعبے میں مشین لرننگ کو لاگو کرنے کا پرجوش ہے۔ کام سے باہر، وہ باہر سے لطف اندوز ہوتا ہے۔

ایلن ٹین SageMaker کے ساتھ ایک سینئر پروڈکٹ مینیجر ہے جو بڑے ماڈل کے تخمینے پر سرکردہ کوششیں کر رہا ہے۔ وہ تجزیات کے شعبے میں مشین لرننگ کو لاگو کرنے کا پرجوش ہے۔ کام سے باہر، وہ باہر سے لطف اندوز ہوتا ہے۔

ورون سیال AWS Sagemaker کے ساتھ ایک سافٹ ویئر ڈویلپمنٹ انجینئر ہے جو ML Inference پلیٹ فارم کے لیے صارفین کے لیے اہم خصوصیات پر کام کر رہا ہے۔ وہ ڈسٹری بیوٹڈ سسٹمز اور اے آئی اسپیس میں کام کرنے کا شوقین ہے۔ اپنے فارغ وقت میں اسے پڑھنا اور باغبانی کرنا پسند ہے۔

ورون سیال AWS Sagemaker کے ساتھ ایک سافٹ ویئر ڈویلپمنٹ انجینئر ہے جو ML Inference پلیٹ فارم کے لیے صارفین کے لیے اہم خصوصیات پر کام کر رہا ہے۔ وہ ڈسٹری بیوٹڈ سسٹمز اور اے آئی اسپیس میں کام کرنے کا شوقین ہے۔ اپنے فارغ وقت میں اسے پڑھنا اور باغبانی کرنا پسند ہے۔

- SEO سے چلنے والا مواد اور PR کی تقسیم۔ آج ہی بڑھا دیں۔

- پلیٹوآئ اسٹریم۔ ویب 3 ڈیٹا انٹیلی جنس۔ علم میں اضافہ۔ یہاں تک رسائی حاصل کریں۔

- ایڈریین ایشلے کے ساتھ مستقبل کا نقشہ بنانا۔ یہاں تک رسائی حاصل کریں۔

- PREIPO® کے ساتھ PRE-IPO کمپنیوں میں حصص خریدیں اور بیچیں۔ یہاں تک رسائی حاصل کریں۔

- ماخذ: https://aws.amazon.com/blogs/machine-learning/achieve-high-performance-with-lowest-cost-for-generative-ai-inference-using-aws-inferentia2-and-aws-trainium-on-amazon-sagemaker/

- : ہے

- : ہے

- : نہیں

- :کہاں

- $UP

- 10

- 100

- 12

- 13

- 14

- 15٪

- 22

- 24

- 7

- 8

- 9

- a

- ہمارے بارے میں

- مسرع

- ایکسلریٹر

- قبول کرتا ہے

- تک رسائی حاصل

- اکاؤنٹ

- حاصل

- حصول

- کے پار

- کام کرتا ہے

- شامل کریں

- اس کے علاوہ

- پتہ

- قابل شناخت

- فائدہ

- اشتہار.

- کے بعد

- کے خلاف

- AI

- AI استعمال کے معاملات

- AI / ML

- تمام

- کی اجازت دیتا ہے

- بھی

- اگرچہ

- ایمیزون

- ایمیزون EC2

- ایمیزون سیج میکر

- ایمیزون ویب سروسز

- an

- تجزیاتی

- اور

- اعلان کریں

- ایک اور

- کوئی بھی

- APIs

- ایپلی کیشنز

- درخواست دینا

- نقطہ نظر

- فن تعمیر

- کیا

- رقبہ

- مصنوعی

- مصنوعی ذہانت

- مصنوعی انٹیلی جنس (AI)

- AS

- At

- آڈیو

- آٹو

- خود کار طریقے سے

- دستیاب

- AWS

- AWS Inferentia

- گیند

- بینڈوڈتھ

- رکاوٹ

- کی بنیاد پر

- BE

- کیونکہ

- رہا

- اس سے پہلے

- فوائد

- BEST

- کے درمیان

- بگ

- بڑا

- اربوں

- بلاک

- بلاگ

- بلوم

- مختصر

- توڑ دیا

- تعمیر

- تعمیر

- تعمیر میں

- کاروبار

- by

- C ++

- کہا جاتا ہے

- کر سکتے ہیں

- مقدمات

- چیلنج

- چیٹ بٹ

- چیک کریں

- چپس

- کوڈ

- کوڈنگ

- اجتماعی

- جمع

- مل کر

- آتا ہے

- مواصلات

- کموینیکیشن

- مقابلے میں

- ہم آہنگ

- مکمل

- مکمل طور پر

- پیچیدہ

- پیچیدگی

- اجزاء

- وسیع

- حساب

- کمپیوٹنگ

- کمپیوٹر

- کمپیوٹر ویژن

- کمپیوٹنگ

- ترتیب

- منسلک

- کنٹینر

- کنٹینر

- پر مشتمل ہے

- مواد

- کور

- قیمت

- سرمایہ کاری مؤثر

- اخراجات

- تخلیق

- بنائی

- اہم

- اہم

- اس وقت

- گاہک

- گاہکوں

- اپنی مرضی کے مطابق

- اعداد و شمار

- وقف

- گہری

- گہری سیکھنے

- پہلے سے طے شدہ

- کی وضاحت

- وضاحت کرتا ہے

- ڈگری

- تاخیر

- نجات

- ترسیل

- فراہم کرتا ہے

- demonstrated,en

- انحصار کرتا ہے

- تعیناتی

- تعینات

- تعیناتی

- تفصیلات

- کھوج

- یہ تعین

- ترقی

- ترقی

- آلہ

- کے الات

- مختلف

- براڈ کاسٹننگ

- براہ راست

- تقسیم کئے

- تقسیم کمپیوٹنگ

- تقسیم شدہ نظام

- تقسیم

- کر

- ڈومینز

- نہیں

- ڈاؤن لوڈ، اتارنا

- ڈاؤن لوڈز

- ڈرائیور

- متحرک

- متحرک طور پر

- ہر ایک

- اس سے قبل

- آسان

- سب سے آسان

- آسانی سے

- وسطی

- ہنر

- مؤثر طریقے سے

- کوششوں

- کے قابل بناتا ہے

- آخر

- اختتام پوائنٹ

- انجینئر

- انجن

- کافی

- کو یقینی بنانے کے

- اندر

- اداروں

- اندراج

- مساوی

- اندازہ

- بھی

- مثال کے طور پر

- بہت پرجوش

- مہنگی

- اضافی

- چہرہ

- سہولت

- سامنا کرنا پڑا

- ناکام

- تیز تر

- نمایاں کریں

- خصوصیات

- فائل

- مالی

- مالی خدمات

- ختم

- پہلا

- فٹ

- بہاؤ

- بہنا

- توجہ مرکوز

- توجہ مرکوز

- توجہ مرکوز

- کے بعد

- کے لئے

- فارم

- فارمیٹ

- چار

- فریم ورک

- فریم ورک

- دھوکہ دہی

- فراڈ کا پتہ لگانے

- سے

- مکمل

- مکمل طور پر

- مزید برآں

- پیدا ہوتا ہے

- نسل

- پیداواری

- پیداواری AI۔

- حاصل

- Go

- عطا

- گروپ کا

- بڑھتے ہوئے

- ہارڈ ویئر

- ہے

- he

- صحت

- مدد

- مدد

- مدد کرتا ہے

- یہاں

- ہائی

- اعلی کارکردگی

- اعلی

- ان

- انعقاد

- کی ڈگری حاصل کی

- میزبان

- ہوسٹنگ

- ہوسٹنگ خدمات

- ہاؤس

- کس طرح

- کیسے

- تاہم

- HTML

- HTTP

- HTTPS

- حب

- انسانی

- if

- تصویر

- تصاویر

- نفاذ

- درآمد

- in

- میں گہرائی

- شامل

- شامل ہیں

- سمیت

- اضافہ

- اضافہ

- آزاد

- صنعت

- انفراسٹرکچر

- بدعت

- ان پٹ

- آدانوں

- تنصیب

- مثال کے طور پر

- انشورنس

- ضم

- انٹیلی جنس

- بات چیت

- بات چیت

- بیچوان

- میں

- درخواست کی

- شامل

- IT

- میں

- جاپان

- ایوب

- میں شامل

- شامل ہو گئے

- فوٹو

- JSON

- صرف

- جان

- علم

- لیبز

- زبان

- بڑے

- بڑے کاروباری اداروں

- بڑے

- سب سے بڑا

- تاخیر

- شروع

- آغاز

- معروف

- جانیں

- سیکھنے

- لمبائی

- دو

- لائبریریوں

- لائبریری

- کی طرح

- پسند

- لمیٹڈ

- لسٹ

- ایل ایل ایم

- لوڈ

- لوڈ کر رہا ہے

- بوجھ

- لاگ ان

- لو

- کم

- سب سے کم

- مشین

- مشین لرننگ

- بنیادی طور پر

- برقرار رکھتا ہے

- اکثریت

- بنا

- انتظام

- میں کامیاب

- مینیجر

- نقشہ جات

- میکس

- زیادہ سے زیادہ

- یاد داشت

- طریقہ

- ML

- ایم ایل اوپس

- ماڈل

- ماڈل

- ماڈیولز

- زیادہ

- زیادہ موثر

- سب سے زیادہ

- ایک سے زیادہ

- نام

- قدرتی

- قدرتی زبان عملیات

- ضروری

- ضرورت ہے

- ضروریات

- نئی

- NY

- اگلے

- ویزا

- نوبل انعام

- نوٹ بک

- اب

- تعداد

- اعتراض

- of

- پیش کرتے ہیں

- تجویز

- اکثر

- اوہائیو

- on

- ایک

- صرف

- اوپن سورس

- آپریشنز

- اصلاح کے

- کی اصلاح کریں

- اصلاح

- اصلاح کرتا ہے

- اختیار

- آپشنز کے بھی

- or

- تنظیمیں

- دیگر

- ہمارے

- باہر

- باہر

- پیداوار

- باہر

- خود

- پیکجوں کے

- پیرا میٹر

- متوازی

- پیرامیٹر

- پیرامیٹرز

- منظور

- گزرتا ہے

- جذباتی

- کارکردگی

- شخصی

- پلیٹ فارم

- پلاٹا

- افلاطون ڈیٹا انٹیلی جنس

- پلیٹو ڈیٹا

- رابطہ بحال کرو

- پلگ ان

- پوائنٹ

- مقبول

- پوسٹ

- طاقت

- طاقت

- طاقتور

- پریکٹس

- صحت سے متعلق

- پیشن گوئی

- پیش گو

- کو ترجیح دی

- پرنسپل

- انعام

- مسائل

- عمل

- عمل

- پروسیسنگ

- مصنوعات

- پروڈکٹ مینیجر

- حاصل

- پروفائل

- منصوبوں

- وعدہ

- خصوصیات

- جائیداد

- فراہم

- فراہم

- فراہم کرتا ہے

- فراہم کرنے

- مقصد

- ازگر

- pytorch

- لے کر

- تک پہنچنے

- پڑھنا

- تیار

- حقیقی دنیا

- اصل وقت

- موصول

- حال ہی میں

- تسلیم

- کہا جاتا ہے

- متعلقہ

- درخواست

- درخواستوں

- ضرورت

- ضرورت

- ضروریات

- تحقیق

- محققین

- وسائل

- جوابات

- نتیجے

- اضافہ

- رن

- sagemaker

- سیج میکر کا اندازہ

- اسی

- محفوظ کریں

- سکیلنگ

- منظرنامے

- سکرپٹ

- sdk

- بغیر کسی رکاوٹ کے

- سیکنڈ

- سیکشن

- دیکھنا

- سینئر

- تسلسل

- خدمت

- سروس

- سروسز

- خدمت

- مقرر

- ترتیبات

- سیٹ اپ

- کئی

- منتقل

- ہونا چاہئے

- دکھائیں

- ظاہر ہوا

- دکھایا گیا

- شوز

- کی طرف

- نمایاں طور پر

- سلیکن

- اسی طرح

- سادہ

- ایک

- چھ

- سائز

- سائز

- So

- سافٹ ویئر کی

- سوفٹ ویئر کی نشوونما

- حل

- حل

- خلا

- ماہر

- خصوصی

- تقریر

- تقریر کی شناخت

- مستحکم

- ڈھیر لگانا

- Stacks

- شروع کریں

- شروع

- شروع ہوتا ہے

- سترٹو

- ذخیرہ

- خبریں

- ذخیرہ کرنے

- سویوستیت

- سٹائل

- کامیابی کے ساتھ

- اس طرح

- حمایت

- تائید

- کی حمایت کرتا ہے

- کے نظام

- سسٹمز

- لینے

- پڑھانا

- ٹیم

- تکنیک

- ٹیکنالوجی

- ٹیسسرور

- ٹیسٹ

- سے

- کہ

- ۔

- علاقہ

- ان

- ان

- وہاں.

- یہ

- اس

- تین

- کے ذریعے

- تھرو پٹ

- وقت

- اوقات

- کرنے کے لئے

- بھی

- اوزار

- سراغ لگانا

- تربیت یافتہ

- ٹریننگ

- ٹرانسفارمرز

- ٹرن

- دو

- قسم

- ٹھیٹھ

- اپ لوڈ کردہ

- us

- استعمال کی شرائط

- استعمال کیا جاتا ہے

- کا استعمال کرتے ہوئے

- عام طور پر

- استعمال

- استعمال کرنا۔

- قیمت

- مختلف اقسام کے

- مختلف

- وسیع

- بہت

- کی طرف سے

- ویڈیو

- ورجینیا

- نقطہ نظر

- انتظار

- واک تھرو

- راستہ..

- we

- ویب

- ویب خدمات

- وزن

- کیا

- جب

- جس

- گے

- ساتھ

- کے اندر

- بغیر

- گواہ

- لفظ

- کام

- کام کیا

- کام کر

- کام کرتا ہے

- دنیا

- لکھنا

- تحریری طور پر

- یارک

- تم

- اور

- زیفیرنیٹ