اس پوسٹ میں، ہم یہ ظاہر کرتے ہیں کہ پروٹین سب سیلولر لوکلائزیشن کا استعمال کرتے ہوئے پیشین گوئی کرنے کے لیے ایک جدید ترین پروٹین لینگویج ماڈل (pLM) کو موثر طریقے سے کیسے بنایا جائے۔ ایمیزون سیج میکر.

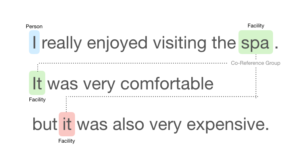

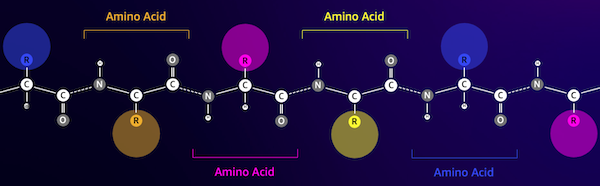

پروٹین جسم کی سالماتی مشینیں ہیں، جو آپ کے پٹھوں کو حرکت دینے سے لے کر انفیکشن کا جواب دینے تک ہر چیز کے لیے ذمہ دار ہیں۔ اس قسم کے باوجود، تمام پروٹین امائنو ایسڈ نامی مالیکیولز کی دہرائی جانے والی زنجیروں سے بنی ہیں۔ انسانی جینوم 20 معیاری امینو ایسڈز کو انکوڈ کرتا ہے، ہر ایک کی کیمیائی ساخت قدرے مختلف ہوتی ہے۔ ان کی نمائندگی حروف تہجی کے حروف سے کی جا سکتی ہے، جس کے بعد ہمیں متنی تار کے طور پر پروٹین کا تجزیہ اور دریافت کرنے کی اجازت ملتی ہے۔ پروٹین کی ترتیب اور ڈھانچے کی بہت زیادہ ممکنہ تعداد وہی ہے جو پروٹین کو ان کے وسیع اقسام کے استعمال فراہم کرتی ہے۔

پروٹین منشیات کی نشوونما میں بھی اہم کردار ادا کرتے ہیں، ممکنہ اہداف کے طور پر بلکہ علاج کے طور پر بھی۔ جیسا کہ مندرجہ ذیل جدول میں دکھایا گیا ہے، 2022 میں سب سے زیادہ فروخت ہونے والی دوائیں یا تو پروٹین (خاص طور پر اینٹی باڈیز) تھیں یا mRNA جیسے دیگر مالیکیولز کو جسم میں پروٹین میں تبدیل کیا گیا تھا۔ اس کی وجہ سے، بہت سے لائف سائنس کے محققین کو پروٹین کے بارے میں سوالات کا تیز، سستا اور زیادہ درست جواب دینے کی ضرورت ہے۔

| نام | ڈویلپر | 2022 عالمی فروخت ($ بلین امریکی ڈالر) | نوٹیفائر |

| Comirnaty | فائزر / بائیو ٹیک | $40.8 | کوویڈ ۔19 |

| سپائیک ویکس۔ | موڈرنا | $21.8 | کوویڈ ۔19 |

| ہمراہ | ابیوی | $21.6 | گٹھیا، کروہن کی بیماری، اور دیگر |

| Keytruda | مرک | $21.0 | مختلف کینسر |

ڈیٹا کا ذریعہ: Urquhart، L. 2022 میں فروخت کے لحاظ سے سرفہرست کمپنیاں اور ادویات. نیچر ریویو ڈرگ ڈسکوری 22، 260–260 (2023)۔

چونکہ ہم حروف کی ترتیب کے طور پر پروٹین کی نمائندگی کر سکتے ہیں، ہم ان تکنیکوں کا استعمال کرتے ہوئے تجزیہ کر سکتے ہیں جو اصل میں تحریری زبان کے لیے تیار کی گئی تھیں۔ اس میں بڑے لینگویج ماڈلز (LLMs) شامل ہیں جو بڑے ڈیٹا سیٹس پر پہلے سے تربیت یافتہ ہیں، جنہیں پھر مخصوص کاموں، جیسے کہ متن کا خلاصہ یا چیٹ بوٹس کے لیے ڈھال لیا جا سکتا ہے۔ اسی طرح، pLMs کو بغیر لیبل کے، خود زیر نگرانی سیکھنے کا استعمال کرتے ہوئے بڑے پروٹین سیکوینس ڈیٹا بیس پر پہلے سے تربیت دی جاتی ہے۔ ہم ان چیزوں کو پیشین گوئی کرنے کے لیے ڈھال سکتے ہیں جیسے کسی پروٹین کی 3D ساخت یا یہ دوسرے مالیکیولز کے ساتھ کیسے تعامل کر سکتا ہے۔ محققین نے یہاں تک کہ شروع سے ناول پروٹین ڈیزائن کرنے کے لیے pLM کا استعمال کیا ہے۔ یہ ٹولز انسانی سائنسی مہارت کی جگہ نہیں لیتے، لیکن ان میں پری کلینیکل ترقی اور آزمائشی ڈیزائن کو تیز کرنے کی صلاحیت ہے۔

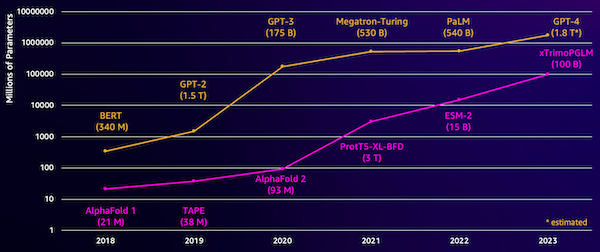

ان ماڈلز کے ساتھ ایک چیلنج ان کا سائز ہے۔ LLMs اور pLMs دونوں میں پچھلے کچھ سالوں میں بڑے پیمانے پر اضافہ ہوا ہے، جیسا کہ مندرجہ ذیل تصویر میں دکھایا گیا ہے۔ اس کا مطلب ہے کہ انہیں کافی درستگی کی تربیت دینے میں کافی وقت لگ سکتا ہے۔ اس کا مطلب یہ بھی ہے کہ آپ کو ماڈل کے پیرامیٹرز کو ذخیرہ کرنے کے لیے بڑی مقدار میں میموری کے ساتھ ہارڈ ویئر، خاص طور پر GPUs استعمال کرنے کی ضرورت ہے۔

طویل تربیت کا وقت، نیز بڑی مثالیں، زیادہ لاگت کے برابر ہوتی ہیں، جو اس کام کو بہت سے محققین کی پہنچ سے دور کر سکتا ہے۔ مثال کے طور پر، 2023 میں، a تحقیقی ٹیم 100 دنوں کے لیے 768 A100 GPUs پر 164 بلین پیرامیٹر pLM کی تربیت کی وضاحت کی! خوش قسمتی سے، بہت سے معاملات میں ہم موجودہ pLM کو اپنے مخصوص کام کے لیے ڈھال کر وقت اور وسائل بچا سکتے ہیں۔ اس تکنیک کو کہا جاتا ہے۔ ٹھیک ٹیوننگ، اور ہمیں لینگویج ماڈلنگ کی دیگر اقسام سے جدید ٹولز لینے کی بھی اجازت دیتا ہے۔

حل جائزہ

مخصوص مسئلہ جس کا ہم اس پوسٹ میں حل کرتے ہیں۔ سب سیلولر لوکلائزیشن: پروٹین کی ترتیب کو دیکھتے ہوئے، کیا ہم ایک ایسا ماڈل بنا سکتے ہیں جو یہ اندازہ لگا سکے کہ آیا یہ خلیے کے باہر (خلیہ کی جھلی) پر رہتا ہے یا اندر؟ یہ معلومات کا ایک اہم ٹکڑا ہے جو ہمیں اس کام کو سمجھنے میں مدد کر سکتا ہے اور آیا یہ منشیات کا ایک اچھا ہدف بنائے گا۔

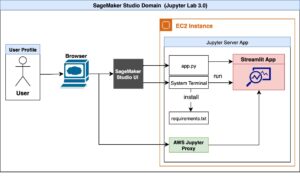

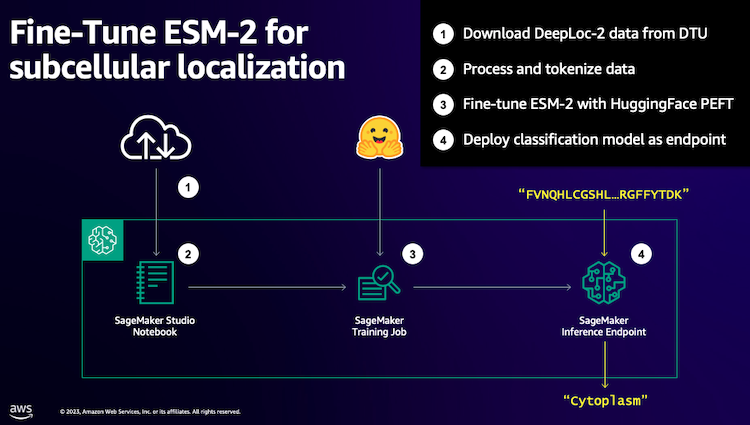

ہم استعمال کرتے ہوئے ایک عوامی ڈیٹاسیٹ ڈاؤن لوڈ کرکے شروع کرتے ہیں۔ ایمیزون سیج میکر اسٹوڈیو. پھر ہم سیج میکر کا استعمال کرتے ہوئے ESM-2 پروٹین لینگویج ماڈل کو ایک موثر تربیتی طریقہ استعمال کرتے ہوئے ٹھیک ٹیون کرتے ہیں۔ آخر میں، ہم ماڈل کو ریئل ٹائم انفرنس اینڈ پوائنٹ کے طور پر تعینات کرتے ہیں اور اسے کچھ معلوم پروٹینوں کی جانچ کے لیے استعمال کرتے ہیں۔ درج ذیل خاکہ اس ورک فلو کو واضح کرتا ہے۔

مندرجہ ذیل حصوں میں، ہم آپ کے ٹریننگ ڈیٹا کو تیار کرنے، ٹریننگ اسکرپٹ بنانے، اور SageMaker ٹریننگ جاب کو چلانے کے لیے مراحل سے گزرتے ہیں۔ اس پوسٹ میں نمایاں کردہ تمام کوڈ پر دستیاب ہے۔ GitHub کے.

تربیت کا ڈیٹا تیار کریں۔

ہم کا حصہ استعمال کرتے ہیں ڈیپ لوک -2 ڈیٹاسیٹ، جس میں تجرباتی طور پر طے شدہ مقامات کے ساتھ کئی ہزار سوئس پروٹ پروٹین شامل ہیں۔ ہم 100-512 امینو ایسڈ کے درمیان اعلیٰ معیار کی ترتیب کے لیے فلٹر کرتے ہیں:

df = pd.read_csv(

"https://services.healthtech.dtu.dk/services/DeepLoc-2.0/data/Swissprot_Train_Validation_dataset.csv"

).drop(["Unnamed: 0", "Partition"], axis=1)

df["Membrane"] = df["Membrane"].astype("int32")

# filter for sequences between 100 and 512 amino acides

df = df[df["Sequence"].apply(lambda x: len(x)).between(100, 512)]

# Remove unnecessary features

df = df[["Sequence", "Kingdom", "Membrane"]]

اگلا، ہم ترتیب کو ٹوکنائز کرتے ہیں اور انہیں تربیت اور تشخیصی سیٹوں میں تقسیم کرتے ہیں:

dataset = Dataset.from_pandas(df).train_test_split(test_size=0.2, shuffle=True)

tokenizer = AutoTokenizer.from_pretrained("facebook/esm2_t33_650M_UR50D")

def preprocess_data(examples, max_length=512):

text = examples["Sequence"]

encoding = tokenizer(text, truncation=True, max_length=max_length)

encoding["labels"] = examples["Membrane"]

return encoding

encoded_dataset = dataset.map(

preprocess_data,

batched=True,

num_proc=os.cpu_count(),

remove_columns=dataset["train"].column_names,

)

encoded_dataset.set_format("torch")

آخر میں، ہم پروسیس شدہ تربیت اور تشخیصی ڈیٹا کو اپ لوڈ کرتے ہیں۔ ایمیزون سادہ اسٹوریج سروس (ایمیزون S3):

train_s3_uri = S3_PATH + "/data/train"

test_s3_uri = S3_PATH + "/data/test"

encoded_dataset["train"].save_to_disk(train_s3_uri)

encoded_dataset["test"].save_to_disk(test_s3_uri)ایک تربیتی اسکرپٹ بنائیں

سیج میکر اسکرپٹ موڈ AWS کے زیر انتظام آپٹمائزڈ مشین لرننگ (ML) فریم ورک کنٹینرز میں آپ کو اپنا کسٹم ٹریننگ کوڈ چلانے کی اجازت دیتا ہے۔ اس مثال کے لیے، ہم ایک کو اپناتے ہیں۔ متن کی درجہ بندی کے لیے موجودہ اسکرپٹ گلے ملنے والے چہرے سے۔ یہ ہمیں اپنے تربیتی کام کی کارکردگی کو بہتر بنانے کے لیے کئی طریقے آزمانے کی اجازت دیتا ہے۔

طریقہ 1: وزنی تربیتی کلاس

بہت سے حیاتیاتی ڈیٹاسیٹس کی طرح، ڈیپ لوک ڈیٹا کو غیر مساوی طور پر تقسیم کیا جاتا ہے، یعنی وہاں مساوی تعداد میں جھلی اور غیر جھلی پروٹین نہیں ہیں۔ ہم اپنے ڈیٹا کو دوبارہ نمونہ بنا سکتے ہیں اور اکثریتی طبقے سے ریکارڈ کو ضائع کر سکتے ہیں۔ تاہم، یہ کل تربیتی ڈیٹا کو کم کرے گا اور ممکنہ طور پر ہماری درستگی کو نقصان پہنچائے گا۔ اس کے بجائے، ہم تربیتی کام کے دوران کلاس کے وزن کا حساب لگاتے ہیں اور نقصان کو ایڈجسٹ کرنے کے لیے ان کا استعمال کرتے ہیں۔

ہماری تربیتی اسکرپٹ میں، ہم ذیلی کلاس کرتے ہیں۔ Trainer سے کلاس transformers ایک WeightedTrainer کلاس جو کراس اینٹروپی نقصان کا حساب لگاتے وقت کلاس کے وزن کو مدنظر رکھتی ہے۔ یہ ہمارے ماڈل میں تعصب کو روکنے میں مدد کرتا ہے:

class WeightedTrainer(Trainer):

def __init__(self, class_weights, *args, **kwargs):

self.class_weights = class_weights

super().__init__(*args, **kwargs)

def compute_loss(self, model, inputs, return_outputs=False):

labels = inputs.pop("labels")

outputs = model(**inputs)

logits = outputs.get("logits")

loss_fct = torch.nn.CrossEntropyLoss(

weight=torch.tensor(self.class_weights, device=model.device)

)

loss = loss_fct(logits.view(-1, self.model.config.num_labels), labels.view(-1))

return (loss, outputs) if return_outputs else lossطریقہ 2: تدریجی جمع

گریڈینٹ جمع کرنا ایک تربیتی تکنیک ہے جو ماڈلز کو بڑے بیچ سائز پر تربیت کی نقل کرنے کی اجازت دیتی ہے۔ عام طور پر، بیچ کا سائز (ایک تربیتی مرحلے میں گریڈینٹ کا حساب لگانے کے لیے استعمال ہونے والے نمونوں کی تعداد) GPU میموری کی گنجائش سے محدود ہے۔ میلان جمع کرنے کے ساتھ، ماڈل پہلے چھوٹے بیچوں پر گریڈینٹ کا حساب لگاتا ہے۔ پھر، ماڈل کے وزن کو فوراً اپ ڈیٹ کرنے کے بجائے، میلان متعدد چھوٹے بیچوں پر جمع ہو جاتے ہیں۔ جب جمع شدہ گریڈینٹ ہدف کے بڑے بیچ سائز کے برابر ہوتے ہیں، تو ماڈل کو اپ ڈیٹ کرنے کے لیے اصلاح کا مرحلہ انجام دیا جاتا ہے۔ یہ ماڈلز کو GPU میموری کی حد سے تجاوز کیے بغیر مؤثر طریقے سے بڑے بیچوں کے ساتھ تربیت دینے دیتا ہے۔

تاہم، چھوٹے بیچ کے آگے اور پیچھے والے پاسوں کے لیے اضافی حساب کی ضرورت ہے۔ تدریجی جمع کے ذریعے بیچ کے سائز میں اضافہ ٹریننگ کو سست کر سکتا ہے، خاص طور پر اگر جمع کرنے کے بہت سارے اقدامات استعمال کیے جائیں۔ مقصد GPU کے استعمال کو زیادہ سے زیادہ کرنا ہے لیکن بہت سے اضافی تدریجی حساب کے مراحل سے ضرورت سے زیادہ سست روی سے بچنا ہے۔

طریقہ 3: گریڈینٹ چیک پوائنٹنگ

گریڈینٹ چیک پوائنٹنگ ایک تکنیک ہے جو کمپیوٹیشنل وقت کو مناسب رکھتے ہوئے تربیت کے دوران درکار میموری کو کم کرتی ہے۔ بڑے نیورل نیٹ ورک بہت زیادہ میموری لیتے ہیں کیونکہ انہیں بیک ورڈ پاس کے دوران گریڈینٹ کا حساب لگانے کے لیے فارورڈ پاس سے تمام انٹرمیڈیٹ ویلیوز کو اسٹور کرنا پڑتا ہے۔ یہ میموری کے مسائل کا سبب بن سکتا ہے۔ ایک حل یہ ہے کہ ان درمیانی قدروں کو ذخیرہ نہ کیا جائے، لیکن پھر انہیں پسماندہ پاس کے دوران دوبارہ گننا پڑتا ہے، جس میں کافی وقت لگتا ہے۔

گریڈینٹ چیک پوائنٹنگ ایک متوازن نقطہ نظر فراہم کرتا ہے۔ یہ صرف کچھ درمیانی اقدار کو بچاتا ہے، جسے کہا جاتا ہے۔ چیک پوائنٹس، اور ضرورت کے مطابق دوسروں کی دوبارہ گنتی کرتا ہے۔ لہذا، یہ ہر چیز کو ذخیرہ کرنے کے مقابلے میں کم میموری استعمال کرتا ہے، بلکہ ہر چیز کو دوبارہ گننے سے کم حساب کتاب بھی کرتا ہے۔ اسٹریٹجک طور پر یہ منتخب کرنے سے کہ کون سی ایکٹیویشن چیک پوائنٹ کی جائے، گریڈینٹ چیک پوائنٹنگ بڑے نیورل نیٹ ورکس کو قابل انتظام میموری کے استعمال اور حساب کے وقت کے ساتھ تربیت دینے کے قابل بناتی ہے۔ یہ اہم تکنیک بہت بڑے ماڈلز کو تربیت دینا ممکن بناتی ہے جو بصورت دیگر میموری کی حدود میں چلے جائیں گے۔

ہماری تربیتی اسکرپٹ میں، ہم ضروری پیرامیٹرز کو شامل کرکے گریڈینٹ ایکٹیویشن اور چیک پوائنٹنگ کو آن کرتے ہیں۔ TrainingArguments اعتراض:

from transformers import TrainingArguments

training_args = TrainingArguments(

gradient_accumulation_steps=4,

gradient_checkpointing=True

)طریقہ 4: LLMs کی کم درجہ کی موافقت

ESM-2 جیسے بڑے زبان کے ماڈلز میں اربوں پیرامیٹرز شامل ہو سکتے ہیں جن کی تربیت اور چلانے کے لیے مہنگے ہیں۔ محققین ان بڑے ماڈلز کو مزید موثر بنانے کے لیے ایک تربیتی طریقہ تیار کیا جسے Low-Rank Adaptation (LoRA) کہا جاتا ہے۔

LoRA کے پیچھے کلیدی خیال یہ ہے کہ جب کسی خاص کام کے لیے ماڈل کو ٹھیک کرتے ہیں، تو آپ کو تمام اصل پیرامیٹرز کو اپ ڈیٹ کرنے کی ضرورت نہیں ہوتی ہے۔ اس کے بجائے، LoRA ماڈل میں نئے چھوٹے میٹرکس کا اضافہ کرتا ہے جو ان پٹ اور آؤٹ پٹس کو تبدیل کرتے ہیں۔ فائن ٹیوننگ کے دوران صرف یہ چھوٹے میٹرکس کو اپ ڈیٹ کیا جاتا ہے، جو بہت تیز ہے اور کم میموری استعمال کرتا ہے۔ اصل ماڈل کے پیرامیٹرز منجمد رہتے ہیں۔

LoRA کے ساتھ ٹھیک ٹیوننگ کے بعد، آپ چھوٹے موافقت پذیر میٹرکس کو اصل ماڈل میں ضم کر سکتے ہیں۔ یا اگر آپ پچھلے کاموں کو بھولے بغیر دوسرے کاموں کے لیے ماڈل کو تیزی سے ٹھیک کرنا چاہتے ہیں تو آپ انہیں الگ رکھ سکتے ہیں۔ مجموعی طور پر، LoRA LLMs کو معمول کی قیمت کے ایک حصے پر نئے کاموں کے لیے مؤثر طریقے سے ڈھالنے کی اجازت دیتا ہے۔

ہماری تربیتی اسکرپٹ میں، ہم LoRA کو استعمال کرتے ہوئے تشکیل دیتے ہیں۔ PEFT گلے ملنے والے چہرے سے لائبریری:

from peft import get_peft_model, LoraConfig, TaskType

import torch

from transformers import EsmForSequenceClassification

model = EsmForSequenceClassification.from_pretrained(

“facebook/esm2_t33_650M_UR50D”,

Torch_dtype=torch.bfloat16,

Num_labels=2,

)

peft_config = LoraConfig(

task_type=TaskType.SEQ_CLS,

inference_mode=False,

bias="none",

r=8,

lora_alpha=16,

lora_dropout=0.05,

target_modules=[

"query",

"key",

"value",

"EsmSelfOutput.dense",

"EsmIntermediate.dense",

"EsmOutput.dense",

"EsmContactPredictionHead.regression",

"EsmClassificationHead.dense",

"EsmClassificationHead.out_proj",

]

)

model = get_peft_model(model, peft_config)سیج میکر ٹریننگ جاب جمع کروائیں۔

اپنی ٹریننگ اسکرپٹ کی وضاحت کرنے کے بعد، آپ سیج میکر ٹریننگ جاب کو کنفیگر اور جمع کر سکتے ہیں۔ سب سے پہلے، hyperparameters کی وضاحت کریں:

hyperparameters = {

"model_id": "facebook/esm2_t33_650M_UR50D",

"epochs": 1,

"per_device_train_batch_size": 8,

"gradient_accumulation_steps": 4,

"use_gradient_checkpointing": True,

"lora": True,

}اگلا، وضاحت کریں کہ ٹریننگ لاگز سے کون سے میٹرکس حاصل کیے جائیں:

metric_definitions = [

{"Name": "epoch", "Regex": "'epoch': ([0-9.]*)"},

{

"Name": "max_gpu_mem",

"Regex": "Max GPU memory use during training: ([0-9.e-]*) MB",

},

{"Name": "train_loss", "Regex": "'loss': ([0-9.e-]*)"},

{

"Name": "train_samples_per_second",

"Regex": "'train_samples_per_second': ([0-9.e-]*)",

},

{"Name": "eval_loss", "Regex": "'eval_loss': ([0-9.e-]*)"},

{"Name": "eval_accuracy", "Regex": "'eval_accuracy': ([0-9.e-]*)"},

]آخر میں، ایک گلے لگانے والے چہرے کا تخمینہ لگانے والے کی وضاحت کریں اور اسے ml.g5.2xlarge مثال کی قسم پر تربیت کے لیے جمع کروائیں۔ یہ ایک سرمایہ کاری مؤثر مثال کی قسم ہے جو بہت سے AWS علاقوں میں وسیع پیمانے پر دستیاب ہے:

from sagemaker.experiments.run import Run

from sagemaker.huggingface import HuggingFace

from sagemaker.inputs import TrainingInput

hf_estimator = HuggingFace(

base_job_name="esm-2-membrane-ft",

entry_point="lora-train.py",

source_dir="scripts",

instance_type="ml.g5.2xlarge",

instance_count=1,

transformers_version="4.28",

pytorch_version="2.0",

py_version="py310",

output_path=f"{S3_PATH}/output",

role=sagemaker_execution_role,

hyperparameters=hyperparameters,

metric_definitions=metric_definitions,

checkpoint_local_path="/opt/ml/checkpoints",

sagemaker_session=sagemaker_session,

keep_alive_period_in_seconds=3600,

tags=[{"Key": "project", "Value": "esm-fine-tuning"}],

)

with Run(

experiment_name=EXPERIMENT_NAME,

sagemaker_session=sagemaker_session,

) as run:

hf_estimator.fit(

{

"train": TrainingInput(s3_data=train_s3_uri),

"test": TrainingInput(s3_data=test_s3_uri),

}

)مندرجہ ذیل جدول ان مختلف تربیتی طریقوں کا موازنہ کرتا ہے جن پر ہم نے تبادلہ خیال کیا اور ہمارے کام کے رن ٹائم، درستگی، اور GPU میموری کی ضروریات پر ان کے اثرات۔

| ترتیب | بل کے قابل وقت (منٹ) | تشخیص کی درستگی | زیادہ سے زیادہ GPU میموری کا استعمال (GB) |

| بیس ماڈل | 28 | 0.91 | 22.6 |

| بیس + GA | 21 | 0.90 | 17.8 |

| بیس + جی سی | 29 | 0.91 | 10.2 |

| بیس + LoRA | 23 | 0.90 | 18.6 |

تمام طریقوں نے اعلی تشخیص کی درستگی کے ساتھ ماڈل تیار کیے ہیں۔ LoRA اور گریڈینٹ ایکٹیویشن کے استعمال سے رن ٹائم (اور لاگت) میں بالترتیب 18% اور 25% کمی واقع ہوئی۔ گریڈینٹ چیک پوائنٹنگ کے استعمال سے زیادہ سے زیادہ GPU میموری کے استعمال میں 55% کمی واقع ہوئی۔ آپ کی رکاوٹوں (لاگت، وقت، ہارڈ ویئر) پر منحصر ہے، ان طریقوں میں سے ایک دوسرے سے زیادہ معنی رکھتا ہے۔

ان طریقوں میں سے ہر ایک خود سے اچھی کارکردگی کا مظاہرہ کرتا ہے، لیکن کیا ہوتا ہے جب ہم انہیں مجموعہ میں استعمال کرتے ہیں؟ مندرجہ ذیل جدول نتائج کا خلاصہ کرتا ہے۔

| ترتیب | بل کے قابل وقت (منٹ) | تشخیص کی درستگی | زیادہ سے زیادہ GPU میموری کا استعمال (GB) |

| تمام طریقے | 12 | 0.80 | 3.3 |

اس صورت میں، ہم درستگی میں 12% کمی دیکھتے ہیں۔ تاہم، ہم نے رن ٹائم میں 57% اور GPU میموری کا استعمال 85% کم کر دیا ہے! یہ ایک بہت بڑی کمی ہے جو ہمیں لاگت سے موثر مثال کی اقسام کی وسیع رینج پر تربیت دینے کی اجازت دیتی ہے۔

صاف کرو

اگر آپ خود اپنے AWS اکاؤنٹ میں پیروی کر رہے ہیں تو، مزید چارجز سے بچنے کے لیے آپ نے جو بھی حقیقی وقتی انفرنس اینڈ پوائنٹ اور ڈیٹا بنایا ہے اسے حذف کریں۔

predictor.delete_endpoint()

bucket = boto_session.resource("s3").Bucket(S3_BUCKET)

bucket.objects.filter(Prefix=S3_PREFIX).delete()نتیجہ

اس پوسٹ میں، ہم نے سائنسی طور پر متعلقہ کام کے لیے ESM-2 جیسے پروٹین لینگویج ماڈلز کو مؤثر طریقے سے ٹھیک کرنے کا طریقہ دکھایا۔ pLMS کو تربیت دینے کے لیے ٹرانسفارمرز اور PEFT لائبریریوں کے استعمال کے بارے میں مزید معلومات کے لیے، پوسٹس کو دیکھیں پروٹین کے ساتھ گہری تعلیم اور ESMBind (ESMB): پروٹین بائنڈنگ سائٹ کی پیشن گوئی کے لیے ESM-2 کی کم درجہ بندی کی موافقت گلے ملنے والے چہرے کے بلاگ پر۔ آپ کو میں پروٹین کی خصوصیات کی پیشن گوئی کرنے کے لیے مشین لرننگ کے استعمال کی مزید مثالیں بھی مل سکتی ہیں۔ AWS پر شاندار پروٹین تجزیہ GitHub ذخیرہ۔

مصنف کے بارے میں

برائن وفادار Amazon Web Services میں گلوبل ہیلتھ کیئر اور لائف سائنسز ٹیم میں ایک سینئر AI/ML سلوشنز آرکیٹیکٹ ہیں۔ اس کے پاس بائیوٹیکنالوجی اور مشین لرننگ میں 17 سال سے زیادہ کا تجربہ ہے، اور وہ جینومک اور پروٹومک چیلنجز کو حل کرنے میں صارفین کی مدد کرنے کے لیے پرجوش ہیں۔ اپنے فارغ وقت میں، وہ اپنے دوستوں اور خاندان کے ساتھ کھانا پکانے اور کھانے سے لطف اندوز ہوتا ہے۔

برائن وفادار Amazon Web Services میں گلوبل ہیلتھ کیئر اور لائف سائنسز ٹیم میں ایک سینئر AI/ML سلوشنز آرکیٹیکٹ ہیں۔ اس کے پاس بائیوٹیکنالوجی اور مشین لرننگ میں 17 سال سے زیادہ کا تجربہ ہے، اور وہ جینومک اور پروٹومک چیلنجز کو حل کرنے میں صارفین کی مدد کرنے کے لیے پرجوش ہیں۔ اپنے فارغ وقت میں، وہ اپنے دوستوں اور خاندان کے ساتھ کھانا پکانے اور کھانے سے لطف اندوز ہوتا ہے۔

- SEO سے چلنے والا مواد اور PR کی تقسیم۔ آج ہی بڑھا دیں۔

- پلیٹو ڈیٹا ڈاٹ نیٹ ورک ورٹیکل جنریٹو اے آئی۔ اپنے آپ کو بااختیار بنائیں۔ یہاں تک رسائی حاصل کریں۔

- پلیٹوآئ اسٹریم۔ ویب 3 انٹیلی جنس۔ علم میں اضافہ۔ یہاں تک رسائی حاصل کریں۔

- پلیٹو ای ایس جی۔ کاربن، کلین ٹیک، توانائی ، ماحولیات، شمسی، ویسٹ مینجمنٹ یہاں تک رسائی حاصل کریں۔

- پلیٹو ہیلتھ۔ بائیوٹیک اینڈ کلینیکل ٹرائلز انٹیلی جنس۔ یہاں تک رسائی حاصل کریں۔

- ماخذ: https://aws.amazon.com/blogs/machine-learning/efficiently-fine-tune-the-esm-2-protein-language-model-with-amazon-sagemaker/

- : ہے

- : ہے

- : نہیں

- $UP

- 07

- 1

- 100

- 17

- 20

- 2022

- 2023

- 22

- 28

- 3d

- 425

- 600

- 7

- 750

- 8

- a

- ہمارے بارے میں

- اکاؤنٹ

- جمع ہے

- جمع کو

- درستگی

- درست طریقے سے

- چالو کرنے کی

- ایکٹیویشنز

- اپنانے

- موافقت

- اپنانے

- انہوں نے مزید کہا

- پتہ

- جوڑتا ہے

- اعلی درجے کی

- AI / ML

- مقصد

- تمام

- کی اجازت دیتا ہے

- ساتھ

- الفابیٹ

- بھی

- ایمیزون

- ایمیزون سیج میکر

- ایمیزون ویب سروسز

- مقدار

- an

- تجزیہ

- تجزیے

- اور

- ایک اور

- جواب

- کوئی بھی

- نقطہ نظر

- نقطہ نظر

- فن تعمیر

- کیا

- AS

- At

- دستیاب

- سے اجتناب

- دور

- AWS

- واپس

- متوازن

- BE

- کیونکہ

- پیچھے

- کے درمیان

- تعصب

- بڑا

- اربوں

- بائنڈنگ

- بایو ٹکنالوجی

- بلاگ

- جسم

- قرضے لے

- دونوں

- برائن

- تعمیر

- لیکن

- by

- حساب

- حساب کرتا ہے

- حساب

- کہا جاتا ہے

- کر سکتے ہیں

- اہلیت

- قبضہ

- کیس

- مقدمات

- کیونکہ

- سیل

- چین

- زنجیروں

- چیلنج

- چیلنجوں

- حروف

- بوجھ

- چیٹ بٹس

- سستی

- چیک کریں

- کیمیائی

- طبقے

- کوڈ

- مجموعہ

- کمپنیاں

- حساب

- کمپیوٹیشنل

- رکاوٹوں

- پر مشتمل ہے

- کنٹینر

- پر مشتمل ہے

- قیمت

- سرمایہ کاری مؤثر

- سکتا ہے

- تخلیق

- بنائی

- اپنی مرضی کے

- گاہکوں

- اعداد و شمار

- ڈیٹا بیس

- ڈیٹاسیٹس

- کمی

- کمی

- وضاحت

- کی وضاحت

- مظاہرہ

- demonstrated,en

- منحصر ہے

- تعیناتی

- بیان کیا

- ڈیزائن

- کے باوجود

- کا تعین

- ترقی یافتہ

- ترقی

- آلہ

- آریھ

- مختلف

- دریافت

- بات چیت

- بیماری

- تقسیم کئے

- نہیں

- نیچے

- ڈاؤن لوڈ کرنے

- منشیات کی

- منشیات

- کے دوران

- ہر ایک

- اثر

- مؤثر طریقے

- کارکردگی

- ہنر

- مؤثر طریقے سے

- یا تو

- اور

- کے قابل بناتا ہے

- انکوڈنگ

- اختتام پوائنٹ

- بہت بڑا

- عہد

- زمانے

- برابر

- برابر

- خاص طور پر

- تشخیص

- بھی

- سب کچھ

- مثال کے طور پر

- مثال کے طور پر

- متجاوز

- زیادہ

- موجودہ

- مہنگی

- تجربہ

- تجربات

- مہارت

- تلاش

- اضافی

- چہرہ

- خاندان

- تیز تر

- ممکن

- شامل

- خصوصیات

- چند

- اعداد و شمار

- فلٹر

- آخر

- مل

- آخر

- پہلا

- کے بعد

- کے لئے

- خوش قسمتی سے

- آگے

- کسر

- فریم ورک

- دوست

- سے

- منجمد

- تقریب

- مزید

- حاصل

- GitHub کے

- دی

- فراہم کرتا ہے

- گلوبل

- Go

- اچھا

- GPU

- GPUs

- میلان

- اضافہ ہوا

- ہوتا ہے

- ہارڈ ویئر

- ہے

- he

- صحت کی دیکھ بھال

- ہیلتھ ٹیک

- مدد

- مدد

- مدد کرتا ہے

- ہائی

- اعلی معیار کی

- ان

- کس طرح

- کیسے

- تاہم

- HTML

- HTTP

- HTTPS

- بھاری

- گلے لگانے والا چہرہ

- انسانی

- تکلیف

- خیال

- if

- وضاحت کرتا ہے

- درآمد

- اہم

- کو بہتر بنانے کے

- in

- شامل ہیں

- اضافہ

- انفیکشنز

- معلومات

- آدانوں

- کے اندر

- مثال کے طور پر

- کے بجائے

- بات چیت

- میں

- مسائل

- IT

- ایوب

- رکھیں

- رکھتے ہوئے

- کلیدی

- بادشاہت

- جانا جاتا ہے

- لیبل

- زبان

- بڑے

- بڑے

- سیکھنے

- کم

- آو ہم

- لائبریریوں

- لائبریری

- زندگی

- زندگی سائنس

- زندگی سائنس

- کی طرح

- LIMIT

- حدود

- لمیٹڈ

- زندگی

- لوکلائزیشن

- مقامات

- لانگ

- طویل وقت

- بند

- بہت

- لو

- وفاداری

- مشین

- مشین لرننگ

- مشینیں

- بنا

- اکثریت

- بنا

- بناتا ہے

- قابل انتظام

- میں کامیاب

- بہت سے

- بڑے پیمانے پر

- میکس

- زیادہ سے زیادہ

- زیادہ سے زیادہ

- مئی..

- مطلب

- کا مطلب ہے کہ

- یاد داشت

- ضم کریں

- طریقہ

- طریقوں

- پیمائش کا معیار

- منٹ

- ML

- ماڈل

- ماڈلنگ

- ماڈل

- آناخت

- زیادہ

- زیادہ موثر

- منتقل

- MRNA

- بہت

- ایک سے زیادہ

- نام

- فطرت، قدرت

- ضروری

- ضرورت ہے

- ضرورت

- نیٹ ورک

- عصبی

- نیند نیٹ ورک

- نئی

- کوئی بھی نہیں

- ناول

- تعداد

- اعتراض

- اشیاء

- of

- on

- ایک

- والوں

- صرف

- اصلاح کے

- اصلاح

- or

- حکم

- احکامات

- اصل

- اصل میں

- دیگر

- دیگر

- دوسری صورت میں

- ہمارے

- باہر

- نتائج

- باہر

- پر

- مجموعی طور پر

- خود

- پیرامیٹرز

- حصہ

- منظور

- گزرتا ہے

- جذباتی

- گزشتہ

- انجام دیں

- کارکردگی

- ٹکڑا

- پلاٹا

- افلاطون ڈیٹا انٹیلی جنس

- پلیٹو ڈیٹا

- کھیلیں

- علاوہ

- ممکن

- پوسٹ

- مراسلات

- ممکنہ

- ممکنہ طور پر

- پیشن گوئی

- تیار

- کی روک تھام

- پچھلا

- مسئلہ

- عملدرآمد

- تیار

- منصوبے

- خصوصیات

- پروٹین

- پروٹین

- فراہم کرتا ہے

- عوامی

- ڈال

- استفسار میں

- سوالات

- جلدی سے

- رینج

- درجہ بندی

- تک پہنچنے

- اصل وقت

- مناسب

- ریکارڈ

- کو کم

- کم

- کم

- کمی

- ریجیکس

- خطوں

- متعلقہ

- ہٹا

- کی جگہ

- ذخیرہ

- کی نمائندگی

- نمائندگی

- ضروریات

- محققین

- وسائل

- بالترتیب

- جواب دیں

- ذمہ دار

- نتائج کی نمائش

- واپسی

- جائزہ

- ٹھیک ہے

- کردار

- رن

- رن ٹائم

- sagemaker

- فروخت

- محفوظ کریں

- سائنس

- سائنس

- سائنسی

- فیرنا

- اسکرپٹ

- سکرپٹ

- سیکشنز

- دیکھنا

- منتخب

- SELF

- سینئر

- احساس

- علیحدہ

- تسلسل

- سروسز

- سیٹ

- کئی

- دکھایا گیا

- اسی طرح

- سادہ

- نقلی

- سائٹ

- سائز

- سائز

- تھوڑا سا مختلف

- سست

- سست روی

- چھوٹے

- چھوٹے

- حل

- حل

- حل

- کچھ

- ماخذ

- مخصوص

- تیزی

- تقسیم

- معیار

- شروع کریں

- ریاستی آرٹ

- رہنا

- مسلسل

- مرحلہ

- مراحل

- ذخیرہ

- ذخیرہ

- ذخیرہ کرنے

- حکمت عملی سے

- سلک

- ساخت

- ڈھانچوں

- جمع

- کافی

- ٹیبل

- لے لو

- لیتا ہے

- ہدف

- اہداف

- ٹاسک

- کاموں

- ٹیم

- تکنیک

- تکنیک

- ٹیسٹ

- متن

- سے

- کہ

- ۔

- ان

- ان

- خود

- تو

- علاج

- وہاں.

- لہذا

- یہ

- وہ

- چیزیں

- اس

- ہزار

- کے ذریعے

- وقت

- اوقات

- کرنے کے لئے

- ٹوکن دینا

- بھی

- اوزار

- مشعل

- کل

- ٹرین

- تربیت یافتہ

- ٹریننگ

- تبدیل

- ٹرانسفارمرز

- مقدمے کی سماعت

- سچ

- کوشش

- ٹیوننگ

- ٹرن

- قسم

- اقسام

- عام طور پر

- سمجھ

- UNNAMED

- غیر ضروری

- اپ ڈیٹ کریں

- اپ ڈیٹ

- اپ ڈیٹ

- us

- استعمال

- امریکی ڈالر

- استعمال کی شرائط

- استعمال کیا جاتا ہے

- استعمال

- کا استعمال کرتے ہوئے

- ہمیشہ کی طرح

- قیمت

- اقدار

- مختلف اقسام کے

- بہت

- کی طرف سے

- چاہتے ہیں

- we

- ویب

- ویب خدمات

- اچھا ہے

- تھے

- کیا

- جب

- چاہے

- جس

- جبکہ

- وسیع

- وسیع رینج

- بڑے پیمانے پر

- ساتھ

- بغیر

- کام

- مشقت

- کام کا بہاؤ

- گا

- لکھا

- X

- سال

- تم

- اور

- زیفیرنیٹ