آج دستیاب مقبول ترین ماڈلز میں سے ایک XGBoost ہے۔ درجہ بندی اور رجعت جیسے مختلف مسائل کو حل کرنے کی صلاحیت کے ساتھ، XGBoost ایک مقبول آپشن بن گیا ہے جو درخت پر مبنی ماڈلز کے زمرے میں بھی آتا ہے۔ اس پوسٹ میں، ہم یہ دیکھنے کے لیے گہرائی میں ڈوبتے ہیں کہ کیسے ایمیزون سیج میکر کا استعمال کرتے ہوئے ان ماڈلز کی خدمت کر سکتے ہیں NVIDIA ٹرائٹن انفرنس سرور. ریئل ٹائم انفرنس ورک بوجھ میں لیٹینسی اور تھرو پٹ کے لحاظ سے ضروریات کی مختلف سطحیں اور سروس لیول ایگریمنٹس (SLAs) ہو سکتے ہیں، اور SageMaker ریئل ٹائم اینڈ پوائنٹس کا استعمال کرتے ہوئے پورا کیا جا سکتا ہے۔

سیج میکر فراہم کرتا ہے۔ سنگل ماڈل اینڈ پوائنٹس، جو آپ کو ایک منطقی اختتامی نقطہ کے خلاف واحد مشین لرننگ (ML) ماڈل تعینات کرنے کی اجازت دیتا ہے۔ دیگر استعمال کے معاملات کے لیے، آپ اس کا استعمال کرتے ہوئے لاگت اور کارکردگی کا نظم کرنے کا انتخاب کر سکتے ہیں۔ ملٹی ماڈل اینڈ پوائنٹس، جو آپ کو ایک منطقی اختتامی نقطہ کے پیچھے میزبانی کے لیے متعدد ماڈلز کی وضاحت کرنے کی اجازت دیتا ہے۔ اس سے قطع نظر کہ آپ جو بھی آپشن منتخب کرتے ہیں، سیج میکر اینڈ پوائنٹس ایک قابل توسیع میکانزم کی اجازت دیتے ہیں حتیٰ کہ سب سے زیادہ مطالبہ کرنے والے انٹرپرائز صارفین کے لیے بھی بہت ساری خصوصیات میں قدر فراہم کرتے ہوئے، بشمول سائے کی مختلف حالتیں, آٹو اسکیلنگ، اور مقامی انضمام کے ساتھ ایمیزون کلاؤڈ واچ (مزید معلومات کے لیے رجوع کریں۔ ملٹی ماڈل اینڈ پوائنٹ کی تعیناتیوں کے لیے کلاؤڈ واچ میٹرکس).

ٹریٹن مختلف ML ماڈلز کو چلانے اور پیش کرنے میں مدد کرنے کے لیے انجن کے طور پر مختلف بیک اینڈس کو سپورٹ کرتا ہے۔ کسی بھی Triton کی تعیناتی کے لیے، یہ جاننا بہت ضروری ہے کہ بیک اینڈ کا رویہ آپ کے کام کے بوجھ کو کس طرح متاثر کرتا ہے اور کیا توقع کی جائے تاکہ آپ کامیاب ہو سکیں۔ اس پوسٹ میں، ہم آپ کو سمجھنے میں مدد کرتے ہیں۔ فاریسٹ انفرنس لائبریری (FIL) پسدید، جسے SageMaker پر Triton کے ذریعے سپورٹ کیا جاتا ہے، تاکہ آپ اپنے کام کے بوجھ کے لیے باخبر فیصلہ کر سکیں اور بہترین کارکردگی اور لاگت کی اصلاح ممکن حاصل کر سکیں۔

FIL پسدید میں گہرا غوطہ لگائیں۔

ٹریٹن کی حمایت کرتا ہے۔ FIL پسدید درختوں کے ماڈلز کی خدمت کرنا، جیسے XGBoost، لائٹ جی بی ایم، سائنٹ سیکھنا بے ترتیب جنگل, RAPIDS cuML رینڈم فاریسٹ، اور کسی دوسرے ماڈل کے ذریعہ تعاون یافتہ ٹریلائٹ. یہ ماڈل طویل عرصے سے درجہ بندی یا رجعت جیسے مسائل کو حل کرنے کے لیے استعمال ہوتے رہے ہیں۔ اگرچہ اس قسم کے ماڈلز روایتی طور پر CPUs پر چلتے ہیں، لیکن ان ماڈلز کی مقبولیت اور انفرنس ڈیمانڈز نے انفرنس کی کارکردگی کو بڑھانے کے لیے مختلف تکنیکوں کو جنم دیا ہے۔ FIL بیک اینڈ ان میں سے بہت سی تکنیکوں کو cuML کنسٹرکٹس کا استعمال کر کے استعمال کرتا ہے اور اسے C++ اور CUDA کور لائبریری پر بنایا گیا ہے تاکہ GPU ایکسلریٹر پر انفرنس پرفارمنس کو بہتر بنایا جا سکے۔

FIL بیک اینڈ سیکھنے کو تیز کرنے کے لیے CPU یا GPU کور استعمال کرنے کے لیے cuML کی لائبریریوں کا استعمال کرتا ہے۔ ان پروسیسرز کو استعمال کرنے کے لیے، ڈیٹا کا حوالہ میزبان میموری (مثال کے طور پر NumPy arrays) یا GPU arrays (uDF، Numba، cuPY، یا کسی بھی لائبریری سے لیا جاتا ہے جو __cuda_array_interface__) API۔ ڈیٹا کو میموری میں اسٹیج کرنے کے بعد، FIL بیک اینڈ تمام دستیاب CPU یا GPU کور پر پروسیسنگ چلا سکتا ہے۔

FIL بیک اینڈ تھریڈز میزبان کی مشترکہ میموری کو استعمال کیے بغیر ایک دوسرے کے ساتھ بات چیت کرسکتے ہیں، لیکن کام کے بوجھ میں میزبان میموری پر غور کیا جانا چاہیے۔ مندرجہ ذیل خاکہ ایک اینسبل شیڈیولر رن ٹائم آرکیٹیکچر دکھاتا ہے جہاں آپ کے پاس میموری کے علاقوں کو ٹھیک کرنے کی صلاحیت ہے، بشمول CPU ایڈریس ایبل مشترکہ میموری جو ٹرائیٹن (C++) اور ازگر کے عمل (Python بیک اینڈ) کے درمیان انٹر پروسیس کمیونیکیشن کے لیے استعمال ہوتی ہے۔ ٹینسر (ان پٹ/آؤٹ پٹ) FIL بیک اینڈ کے ساتھ۔

ٹریٹن انفرنس سرور ڈویلپرز کو اپنے کام کے بوجھ کو ٹیون کرنے اور ماڈل کی کارکردگی کو بہتر بنانے کے لیے قابل ترتیب اختیارات فراہم کرتا ہے۔ ترتیب dynamic_batching ٹرائٹن کو کلائنٹ سائڈ کی درخواستوں کو رکھنے اور انہیں سرور سائیڈ پر بیچ کرنے کی اجازت دیتا ہے تاکہ FIL کے متوازی کمپیوٹیشن کو مؤثر طریقے سے استعمال کر کے پورے بیچ کا ایک ساتھ اندازہ لگایا جا سکے۔ آپشن max_queue_delay_microseconds ایک ناکام محفوظ کنٹرول پیش کرتا ہے کہ ٹریٹن کتنی دیر تک بیچ بنانے کا انتظار کرتا ہے۔

متعدد دیگر FIL مخصوص ہیں۔ اختیارات دستیاب ہیں جو کارکردگی اور رویے کو متاثر کرتی ہے۔ ہم شروع کرنے کا مشورہ دیتے ہیں۔ storage_type. GPU پر بیک اینڈ چلاتے وقت، FIL ایک نیا میموری/ڈیٹا ڈھانچہ بناتا ہے جو درخت کی نمائندگی کرتا ہے جس کے لیے FIL کارکردگی اور نقش قدم کو متاثر کر سکتا ہے۔ یہ ماحولیاتی پیرامیٹر کے ذریعے قابل ترتیب ہے۔ storage_type، جس میں گھنے، ویرل اور آٹو کے اختیارات ہیں۔ گھنے آپشن کا انتخاب زیادہ GPU میموری استعمال کرے گا اور ہمیشہ بہتر کارکردگی کا نتیجہ نہیں ہوتا ہے، لہذا یہ چیک کرنا بہتر ہے۔ اس کے برعکس، اسپارس آپشن کم GPU میموری استعمال کرے گا اور ممکنہ طور پر بہتر یا گھنے سے بہتر کارکردگی دکھا سکتا ہے۔ آٹو کا انتخاب ماڈل کو ڈیفالٹ کرنے کا سبب بنے گا جب تک کہ ایسا کرنے سے اسپرس سے زیادہ GPU میموری استعمال نہ ہوجائے۔

جب ماڈل کی کارکردگی کی بات آتی ہے، تو آپ اس پر زور دینے پر غور کر سکتے ہیں۔ threads_per_tree اختیار ایک چیز جس کی آپ حقیقی دنیا کے منظرناموں میں نگرانی کر سکتے ہیں وہ ہے۔ threads_per_tree کسی بھی دوسرے پیرامیٹر کے مقابلے تھرو پٹ پر بڑا اثر ڈال سکتا ہے۔ اسے 2–1 سے 32 کی کسی بھی طاقت پر سیٹ کرنا جائز ہے۔ اس پیرامیٹر کے لیے زیادہ سے زیادہ قدر کا اندازہ لگانا مشکل ہے، لیکن جب سرور سے زیادہ بوجھ سے نمٹنے یا بڑے بیچ سائز پر کارروائی کرنے کی توقع کی جاتی ہے، تو یہ ایک وقت میں چند قطاروں پر کارروائی کرنے کے مقابلے میں بڑی قدر سے فائدہ اٹھاتا ہے۔

ایک اور پیرامیٹر جس سے آگاہ ہونا ضروری ہے۔ algoاگر آپ GPU پر چل رہے ہیں تو بھی دستیاب ہے۔ یہ پیرامیٹر الگورتھم کا تعین کرتا ہے جو تخمینہ کی درخواستوں پر کارروائی کرنے کے لیے استعمال ہوتا ہے۔ اس کے لیے سپورٹ کردہ آپشنز ہیں۔ ALGO_AUTO, NAIVE, TREE_REORG، اور BATCH_TREE_REORG. یہ اختیارات اس بات کا تعین کرتے ہیں کہ درخت کے اندر نوڈس کو کس طرح منظم کیا جاتا ہے اور اس کے نتیجے میں کارکردگی میں اضافہ بھی ہو سکتا ہے۔ دی ALGO_AUTO آپشن پہلے سے طے شدہ ہے۔ NAIVE ویرل اسٹوریج کے لئے اور BATCH_TREE_REORG گھنے اسٹوریج کے لئے.

آخر میں، FIL Shapley وضاحت کنندہ کے ساتھ آتا ہے، جسے استعمال کرکے چالو کیا جاسکتا ہے۔ treeshap_output پیرامیٹر تاہم، آپ کو یہ بات ذہن میں رکھنی چاہیے کہ Shapley آؤٹ پٹ اس کے آؤٹ پٹ سائز کی وجہ سے کارکردگی کو نقصان پہنچاتا ہے۔

ماڈل کی شکل

جنگل پر مبنی ماڈلز کو ذخیرہ کرنے کے لیے فی الحال کوئی معیاری فائل فارمیٹ نہیں ہے۔ ہر فریم ورک اپنے فارمیٹ کی وضاحت کرتا ہے۔ متعدد ان پٹ فائل فارمیٹس کو سپورٹ کرنے کے لیے، FIL اوپن سورس کا استعمال کرتے ہوئے ڈیٹا درآمد کرتا ہے۔ ٹریلائٹ کتب خانہ. یہ FIL کو مقبول فریم ورک میں تربیت یافتہ ماڈلز کو سپورٹ کرنے کے قابل بناتا ہے، جیسے XGBoost اور لائٹ جی بی ایم. نوٹ کریں کہ آپ جو ماڈل فراہم کر رہے ہیں اس کا فارمیٹ میں سیٹ ہونا چاہیے۔ model_type کنفیگریشن ویلیو میں بیان کیا گیا ہے۔ config.pbtxt فائل.

Config.pbtxt

ایک میں ہر ماڈل ماڈل ذخیرہ ماڈل کی ترتیب کو شامل کرنا چاہیے جو ماڈل کے بارے میں مطلوبہ اور اختیاری معلومات فراہم کرے۔ عام طور پر، یہ ترتیب a میں فراہم کی جاتی ہے۔ config.pbtxt فائل کے طور پر بیان کیا گیا ہے۔ ModelConfig protobuf. تشکیل کی ترتیبات کے بارے میں مزید جاننے کے لیے، سے رجوع کریں۔ ماڈل ترتیب. ماڈل کنفیگریشن کے کچھ پیرامیٹرز درج ذیل ہیں:

- max_batch_size - یہ زیادہ سے زیادہ بیچ سائز کا تعین کرتا ہے جو اس ماڈل کو دیا جا سکتا ہے۔ عام طور پر، FIL بیک اینڈ کو بھیجے گئے بیچوں کے سائز کی واحد حد وہ میموری ہے جس کے ساتھ ان پر کارروائی کی جائے۔ GPU چلانے کے لیے، دستیاب میموری کا تعین Triton کے CUDA میموری پول کے سائز سے کیا جاتا ہے، جسے سرور شروع کرتے وقت کمانڈ لائن آرگومنٹ کے ذریعے سیٹ کیا جا سکتا ہے۔

- ان پٹ – اس سیکشن میں موجود اختیارات ٹرائٹن کو بتاتے ہیں کہ ان خصوصیات کی تعداد جس کی توقع ہر ان پٹ نمونے کے لیے کی جائے۔

- پیداوار - اس سیکشن میں اختیارات ٹرائٹن کو بتاتے ہیں کہ ہر نمونے کے لیے کتنی آؤٹ پٹ ویلیوز ہوں گی۔ اگر

predict_probaآپشن کو درست پر سیٹ کیا گیا ہے، پھر ہر کلاس کے لیے ایک امکانی قدر واپس کی جائے گی۔ بصورت دیگر، ایک واحد قدر واپس کی جائے گی، جو دیے گئے نمونے کے لیے پیش گوئی کی گئی کلاس کی نشاندہی کرتی ہے۔ - مثال_گروپ - یہ طے کرتا ہے کہ اس ماڈل کی کتنی مثالیں بنائی جائیں گی اور آیا وہ GPU یا CPU استعمال کریں گے۔

- ماڈل_قسم - یہ تار بتاتا ہے کہ ماڈل کس فارمیٹ میں ہے (

xgboost_jsonاس مثال میں، لیکنxgboost,lightgbm، اورtl_checkpointدرست فارمیٹس بھی ہیں)۔ - predict_proba - اگر درست پر سیٹ کیا جاتا ہے تو، صرف کلاس کی پیشین گوئی کے بجائے ہر کلاس کے لیے امکانات کی قدریں واپس کی جائیں گی۔

- آؤٹ پٹ_کلاس - یہ درجہ بندی کے ماڈلز کے لیے درست اور ریگریشن ماڈلز کے لیے غلط پر سیٹ ہے۔

- حد - یہ درجہ بندی کا تعین کرنے کے لیے اسکور کی حد ہے۔ کب

output_classدرست پر سیٹ ہے، یہ فراہم کرنا ضروری ہے، حالانکہ یہ استعمال نہیں کیا جائے گا اگرpredict_probaیہ بھی درست ہے. - اسٹوریج_قسم - عام طور پر، اس ترتیب کے لیے AUTO کا استعمال زیادہ تر استعمال کے معاملات کو پورا کرنا چاہیے۔ اگر AUTO سٹوریج کا انتخاب کیا جاتا ہے، FIL ماڈل کے تخمینی سائز کی بنیاد پر یا تو ایک ویرل یا گھنے نمائندگی کا استعمال کرتے ہوئے ماڈل کو لوڈ کرے گا۔ کچھ صورتوں میں، آپ بڑے ماڈلز کی میموری فوٹ پرنٹ کو کم کرنے کے لیے اسے واضح طور پر SPARSE پر سیٹ کرنا چاہتے ہیں۔

سیج میکر پر ٹرائٹن انفرنس سرور

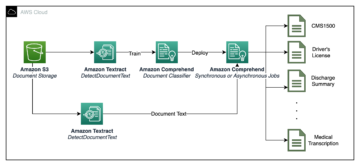

سیج میکر۔ کی اجازت دیتا ہے آپ NVIDIA Triton Inference Server کے ساتھ سنگل ماڈل اور ملٹی ماڈل اینڈ پوائنٹ دونوں کو تعینات کرنے کے لیے۔ مندرجہ ذیل اعداد و شمار ٹرائٹن انفرنس سرور اعلی سطحی فن تعمیر کو ظاہر کرتا ہے۔ دی ماڈل ذخیرہ ماڈلز کا فائل سسٹم پر مبنی ذخیرہ ہے جسے ٹریٹن انفرنسنگ کے لیے دستیاب کرائے گا۔ انفرنس کی درخواستیں سرور پر پہنچتی ہیں اور مناسب فی ماڈل شیڈیولر تک پہنچ جاتی ہیں۔ ٹریٹن لاگو کرتا ہے۔ متعدد شیڈولنگ اور بیچنگ الگورتھم جسے ماڈل بہ ماڈل کی بنیاد پر ترتیب دیا جا سکتا ہے۔ ہر ماڈل کا شیڈیولر اختیاری طور پر تخمینہ کی درخواستوں کی بیچنگ کرتا ہے اور پھر درخواستوں کو پاس کرتا ہے۔ پسدید ماڈل کی قسم کے مطابق۔ پسدید درخواست کردہ آؤٹ پٹس تیار کرنے کے لیے بیچ کی درخواستوں میں فراہم کردہ ان پٹس کا استعمال کرتے ہوئے انفرنسنگ کرتا ہے۔ اس کے بعد آؤٹ پٹ واپس کردیئے جاتے ہیں۔

SageMaker اینڈ پوائنٹس کے لیے اپنے آٹو اسکیلنگ گروپس کو ترتیب دیتے وقت، آپ غور کرنا چاہیں گے۔ SageMakerVariantInvocationsPerInstance آپ کے آٹو اسکیلنگ گروپ کی اسکیلنگ کی خصوصیات کا تعین کرنے کے بنیادی معیار کے طور پر۔ اس کے علاوہ، اس بات پر منحصر ہے کہ آیا آپ کے ماڈلز GPU یا CPU پر چل رہے ہیں، آپ CPUUtilization یا GPUUtilization کو اضافی معیار کے طور پر استعمال کرنے پر بھی غور کر سکتے ہیں۔ نوٹ کریں کہ سنگل ماڈل اینڈ پوائنٹس کے لیے، کیونکہ تعینات کیے گئے ماڈلز ایک جیسے ہیں، اپنے SLAs کو پورا کرنے کے لیے مناسب پالیسیاں ترتیب دینا کافی سیدھا ہے۔ ملٹی ماڈل اینڈ پوائنٹس کے لیے، ہم تجویز کرتے ہیں کہ اسی طرح کے ماڈلز کو دیے گئے اینڈ پوائنٹ کے پیچھے تعینات کریں تاکہ زیادہ مستحکم پیشین گوئی کی جا سکے۔ استعمال کے معاملات میں جہاں مختلف سائز اور تقاضوں کے ماڈلز استعمال کیے جاتے ہیں، آپ ان کام کے بوجھ کو متعدد ملٹی ماڈل اینڈ پوائنٹس پر الگ کرنا چاہتے ہیں یا بہترین قیمت اور کارکردگی کا توازن حاصل کرنے کے لیے اپنی آٹو اسکیلنگ گروپ پالیسی کو ٹھیک کرنے میں کچھ وقت گزار سکتے ہیں۔

NVIDIA ٹرائٹن ڈیپ لرننگ کنٹینرز (DLCs) کی فہرست کے لیے جو SageMaker inference سے تعاون یافتہ ہیں، دیکھیں دستیاب ڈیپ لرننگ کنٹینرز امیجز.

سیج میکر نوٹ بک واک تھرو

ایم ایل ایپلی کیشنز پیچیدہ ہیں اور اکثر ڈیٹا پری پروسیسنگ کی ضرورت پڑ سکتی ہے۔ اس نوٹ بک میں، ہم اس بات پر غور کرتے ہیں کہ سیج میکر ملٹی ماڈل اینڈ پوائنٹ پر ٹریٹن میں FIL بیک اینڈ کا استعمال کرتے ہوئے XGBoost جیسے درخت پر مبنی ML ماڈل کو کیسے تعینات کیا جائے۔ ہم اس بات کا بھی احاطہ کرتے ہیں کہ ٹریٹن میں اینسبل فیچر کا استعمال کرتے ہوئے آپ کے ماڈل کے لیے ازگر پر مبنی ڈیٹا پری پروسیسنگ انفرنس پائپ لائن کو کیسے نافذ کیا جائے۔ یہ ہمیں کلائنٹ کی طرف سے خام ڈیٹا بھیجنے کی اجازت دے گا اور بہترین تخمینہ کارکردگی کے لیے ٹرائٹن سیج میکر اینڈ پوائنٹ میں ڈیٹا پری پروسیسنگ اور ماڈل انفرنس دونوں ہی ہوں گے۔

ٹریٹن ماڈل کے جوڑ کی خصوصیت

ٹریٹن انفرنس سرور AI ماڈلز کی پیداوار میں پیمانے پر تعیناتی کو بہت آسان بناتا ہے۔ ٹرائٹن انفرنس سرور ایک آسان حل کے ساتھ آتا ہے جو پری پروسیسنگ اور پوسٹ پروسیسنگ پائپ لائنوں کی تعمیر کو آسان بناتا ہے۔ ٹرائٹن انفرنس سرور پلیٹ فارم اینسبل شیڈیولر فراہم کرتا ہے، جو کارکردگی کو یقینی بنانے اور تھرو پٹ کو بہتر بنانے کے دوران تخمینہ کے عمل میں حصہ لینے والے ماڈلز کی پائپ لائننگ کے لیے ذمہ دار ہے۔ ملبوس ماڈلز کا استعمال انٹرمیڈیٹ ٹینسر کی منتقلی کے اوور ہیڈ سے بچ سکتا ہے اور ٹرائٹن کو بھیجی جانے والی درخواستوں کی تعداد کو کم کر سکتا ہے۔

اس نوٹ بک میں، ہم دکھاتے ہیں کہ XGBoost ماڈل انفرنس کے ساتھ ڈیٹا پری پروسیسنگ کی پائپ لائن بنانے کے لیے جوڑ کی خصوصیت کا استعمال کیسے کیا جائے، اور آپ پائپ لائن میں حسب ضرورت پوسٹ پروسیسنگ کو شامل کرنے کے لیے اس سے ایکسٹراپولیٹ کر سکتے ہیں۔

ماحول قائم کریں

ہم مطلوبہ ماحول کو ترتیب دے کر شروع کرتے ہیں۔ ہم اپنی ماڈل پائپ لائن کو پیک کرنے کے لیے درکار انحصار کو انسٹال کرتے ہیں اور Triton Inference Server کا استعمال کرتے ہوئے انفرنسز چلاتے ہیں۔ ہم اس کی بھی تعریف کرتے ہیں۔ AWS شناخت اور رسائی کا انتظام (IAM) کا کردار جو SageMaker کو ماڈل نمونے اور NVIDIA Triton تک رسائی دے گا۔ ایمیزون لچکدار کنٹینر رجسٹری (ایمیزون ای سی آر) تصویر۔ درج ذیل کوڈ دیکھیں:

پری پروسیسنگ انحصار کے لیے کونڈا ماحول بنائیں

Triton میں Python پسدید ہمیں استعمال کرنے کی ضرورت ہے a کونسا کسی بھی اضافی انحصار کے لیے ماحول۔ اس صورت میں، ہم خام ڈیٹا کو XGBoost ماڈل میں فیڈ کرنے سے پہلے اسے پری پروسیس کرنے کے لیے Python بیک اینڈ کا استعمال کرتے ہیں جو FIL بیک اینڈ میں چل رہا ہے۔ اگرچہ ہم نے اصل میں ڈیٹا پری پروسیسنگ کرنے کے لیے RAPIDS cuDF اور cuML کا استعمال کیا تھا، یہاں ہم پانڈا اور scikit-learn کو تخمینہ کے دوران پری پروسیسنگ انحصار کے طور پر استعمال کرتے ہیں۔ ہم یہ تین وجوہات کی بنا پر کرتے ہیں:

- ہم یہ بتاتے ہیں کہ آپ کے انحصار کے لیے کونڈا ماحول کیسے بنایا جائے اور اسے میں کیسے پیک کیا جائے۔ فارمیٹ متوقع ہے۔ Triton's Python پسدید کی طرف سے.

- CPU پر Python بیک اینڈ میں چلنے والے پری پروسیسنگ ماڈل کو دکھا کر جب کہ XGBoost FIL بیک اینڈ میں GPU پر چلتا ہے، ہم یہ بتاتے ہیں کہ کس طرح ٹرائٹن کے ملبوس پائپ لائن میں ہر ماڈل ایک مختلف فریم ورک بیک اینڈ کے ساتھ ساتھ مختلف ہارڈویئر کنفیگریشنز پر چل سکتا ہے۔

- یہ اس بات پر روشنی ڈالتا ہے کہ کس طرح RAPIDS لائبریریاں (cuDF، cuML) اپنے CPU ہم منصبوں (Pandas, scit-learn) کے ساتھ مطابقت رکھتی ہیں۔ مثال کے طور پر، ہم دکھا سکتے ہیں کہ کیسے

LabelEncoderscuML میں بنائی گئی سکیٹ لرن میں استعمال کی جا سکتی ہے اور اس کے برعکس۔

ہم سے ہدایات پر عمل کریں ٹریٹن دستاویزات پیکیجنگ پری پروسیسنگ انحصار (سکیٹ سیکھنے اور پانڈاس) کو پائتھون بیک اینڈ میں کونڈا ماحول TAR فائل کے طور پر استعمال کرنے کے لیے۔ باش اسکرپٹ create_prep_env.sh کونڈا ماحول TAR فائل بناتا ہے، پھر ہم اسے پری پروسیسنگ ماڈل ڈائرکٹری میں منتقل کرتے ہیں۔ درج ذیل کوڈ دیکھیں:

جب ہم پچھلے اسکرپٹ کو چلاتے ہیں، تو یہ پیدا ہوتا ہے۔ preprocessing_env.tar.gz، جسے ہم پری پروسیسنگ ڈائرکٹری میں کاپی کرتے ہیں:

Triton Python پسدید کے ساتھ پری پروسیسنگ ترتیب دیں۔

پری پروسیسنگ کے لیے، ہم Triton's استعمال کرتے ہیں۔ ازگر پسدید سرور میں آنے والی خام ڈیٹا کی درخواستوں کے لئے تخمینہ کے دوران ٹیبلر ڈیٹا پری پروسیسنگ (قطعی انکوڈنگ) انجام دینے کے لئے۔ تربیت کے دوران کی جانے والی پری پروسیسنگ کے بارے میں مزید معلومات کے لیے دیکھیں تربیتی نوٹ بک.

Python بیک اینڈ پری پروسیسنگ، پوسٹ پروسیسنگ، اور کسی بھی دوسری حسب ضرورت منطق کو Python میں لاگو کرنے اور Triton کے ساتھ پیش کرنے کے قابل بناتا ہے۔ سیج میکر پر ٹرائٹن کا استعمال کرنے کے لیے ہم سے پہلے ایک ماڈل ریپوزٹری فولڈر قائم کرنے کی ضرورت ہوتی ہے جس میں ہم جن ماڈلز کو پیش کرنا چاہتے ہیں۔ ہم نے پہلے ہی Python ڈیٹا پری پروسیسنگ کے لیے ایک ماڈل ترتیب دیا ہے جسے preprocessing in کہا جاتا ہے۔ cpu_model_repository اور gpu_model_repository.

ٹریٹن کے پاس ماڈل ریپوزٹری لے آؤٹ کے لیے مخصوص تقاضے ہیں۔ ٹاپ لیول ماڈل ریپوزٹری ڈائرکٹری کے اندر، ہر ماڈل کی اپنی ذیلی ڈائرکٹری ہوتی ہے جس میں متعلقہ ماڈل کی معلومات ہوتی ہیں۔ ٹرائٹن میں ہر ماڈل ڈائرکٹری میں کم از کم ایک عددی ذیلی ڈائرکٹری ہونی چاہیے جو ماڈل کے ورژن کی نمائندگی کرتی ہو۔ قدر 1 ہمارے Python پری پروسیسنگ ماڈل کے ورژن 1 کی نمائندگی کرتی ہے۔ ہر ماڈل کو ایک مخصوص بیک اینڈ کے ذریعے چلایا جاتا ہے، لہذا ہر ورژن کی ذیلی ڈائرکٹری کے اندر اس بیک اینڈ کے لیے مطلوبہ ماڈل آرٹفیکٹ ہونا چاہیے۔ اس مثال کے لیے، ہم Python بیک اینڈ استعمال کرتے ہیں، جس کے لیے ضروری ہے کہ Python فائل جو آپ پیش کر رہے ہو اسے model.py کہا جائے، اور فائل کو لاگو کرنے کی ضرورت ہے۔ کچھ افعال. اگر ہم ایک PyTorch بیک اینڈ استعمال کر رہے تھے تو ایک model.pt فائل درکار ہوگی، وغیرہ۔ ماڈل فائلوں کے نام دینے کے کنونشنز کے بارے میں مزید تفصیلات کے لیے، رجوع کریں۔ ماڈل فائلیں۔.

۔ model.py Python فائل جو ہم یہاں استعمال کرتے ہیں وہ خام ڈیٹا کو ان خصوصیات میں تبدیل کرنے کے لیے تمام ٹیبلر ڈیٹا پری پروسیسنگ منطق کو لاگو کرتی ہے جو ہمارے XGBoost ماڈل میں فیڈ کیے جا سکتے ہیں۔

ہر ٹرائٹن ماڈل کو بھی فراہم کرنا ضروری ہے۔ config.pbtxt ماڈل کی ترتیب کو بیان کرنے والی فائل۔ تشکیل کی ترتیبات کے بارے میں مزید جاننے کے لیے، سے رجوع کریں۔ ماڈل ترتیب. ہمارے config.pbtxt فائل بیک اینڈ کو ازگر کے طور پر اور خام ڈیٹا کے لیے تمام ان پٹ کالمز کے ساتھ پری پروسیسڈ آؤٹ پٹ کے ساتھ متعین کرتی ہے، جو 15 خصوصیات پر مشتمل ہے۔ ہم یہ بھی بتاتے ہیں کہ ہم اس Python پری پروسیسنگ ماڈل کو CPU پر چلانا چاہتے ہیں۔ درج ذیل کوڈ دیکھیں:

FIL بیک اینڈ کے لیے درخت پر مبنی ML ماڈل ترتیب دیں۔

اگلا، ہم XGBoost جیسے درخت پر مبنی ML ماڈل کے لیے ماڈل ڈائرکٹری ترتیب دیتے ہیں، جو FIL بیک اینڈ استعمال کرے گی۔

کے لیے متوقع ترتیب cpu_memory_repository اور gpu_memory_repository جیسا کہ ہم نے پہلے دکھایا تھا۔

یہاں، FIL ماڈل کا نام ہے. ہم اسے ایک مختلف نام دے سکتے ہیں۔ xgboost اگر ہم چاہتے ہیں 1 ورژن ذیلی ڈائرکٹری ہے، جس میں ماڈل آرٹفیکٹ شامل ہے۔ اس صورت میں، یہ ہے xgboost.json ماڈل جسے ہم نے محفوظ کیا ہے۔ آئیے یہ متوقع ترتیب بنائیں:

ہمیں کنفیگریشن فائل کی ضرورت ہے۔ config.pbtxt ٹری بیسڈ ML ماڈل کے لیے ماڈل کنفیگریشن کو بیان کرنا، تاکہ ٹریٹن میں FIL بیک اینڈ سمجھ سکے کہ اسے کیسے پیش کیا جائے۔ مزید معلومات کے لیے، تازہ ترین عام سے رجوع کریں۔ ٹریٹن ترتیب کے اختیارات اور کنفیگریشن کے اختیارات کے لیے مخصوص FIL پسدید. ہم اس مثال میں صرف چند سب سے عام اور متعلقہ اختیارات پر توجہ مرکوز کرتے ہیں۔

تخلیق کریں config.pbtxt لیے model_cpu_repository:

اسی طرح، قائم config.pbtxt لیے model_gpu_repository (نوٹ کریں فرق یہ ہے۔ USE_GPU = True):

ensembles کا استعمال کرتے ہوئے Python بیک اینڈ اور FIL بیک اینڈ کو پری پروسیسنگ ڈیٹا کی ایک انفرنس پائپ لائن ترتیب دیں

اب ہم ڈیٹا پری پروسیسنگ اور ٹری بیسڈ ماڈل کا استعمال کرتے ہوئے انفرنس پائپ لائن ترتیب دینے کے لیے تیار ہیں۔ جوڑ ماڈل. ایک جوڑا ماڈل ایک یا زیادہ ماڈلز کی پائپ لائن اور ان ماڈلز کے درمیان ان پٹ اور آؤٹ پٹ ٹینسر کے کنکشن کی نمائندگی کرتا ہے۔ یہاں ہم Python بیک اینڈ میں ڈیٹا پری پروسیسنگ کی پائپ لائن بنانے کے لیے ensemble ماڈل کا استعمال کرتے ہیں جس کے بعد FIL بیک اینڈ میں XGBoost۔

کے لیے متوقع ترتیب ensemble ماڈل ڈائرکٹری اس سے ملتی جلتی ہے جو ہم نے پہلے دکھایا تھا:

ہم نے جوڑا ماڈل بنایا config.pbtxt میں رہنمائی کے بعد انسمبل ماڈلز. اہم بات یہ ہے کہ ہمیں جوڑا شیڈولر ترتیب دینے کی ضرورت ہے۔ config.pbtxt، جو جوڑ کے اندر ماڈلز کے درمیان ڈیٹا کے بہاؤ کی وضاحت کرتا ہے۔ اینسبل شیڈیولر ہر قدم میں آؤٹ پٹ ٹینسر جمع کرتا ہے، اور تصریح کے مطابق دوسرے مراحل کے لیے ان پٹ ٹینسر کے طور پر فراہم کرتا ہے۔

ماڈل ریپوزٹری کو پیک کریں اور Amazon S3 پر اپ لوڈ کریں۔

آخر میں، ہم مندرجہ ذیل ماڈل ریپوزٹری ڈائرکٹری ڈھانچے کے ساتھ ختم ہوتے ہیں، جس میں Python پری پروسیسنگ ماڈل اور اس کے انحصار کے ساتھ XGBoost FIL ماڈل اور ماڈل کا جوڑا شامل ہے۔

ہم ڈائریکٹری اور اس کے مواد کو بطور پیکج کرتے ہیں۔ model.tar.gz پر اپ لوڈ کرنے کے لیے ایمیزون سادہ اسٹوریج سروس (ایمیزون S3)۔ اس مثال میں ہمارے پاس دو اختیارات ہیں: CPU پر مبنی مثال یا GPU پر مبنی مثال کا استعمال۔ جب آپ کو اعلی پروسیسنگ پاور کی ضرورت ہو اور آپ CUDA کور استعمال کرنا چاہتے ہیں تو GPU پر مبنی مثال زیادہ موزوں ہے۔

مندرجہ ذیل کوڈ کے ساتھ CPU پر مبنی مثال (CPU کے لیے موزوں) کے لیے ماڈل پیکیج بنائیں اور اپ لوڈ کریں:

مندرجہ ذیل کوڈ کے ساتھ GPU پر مبنی مثال (GPU کے لیے موزوں) کے لیے ماڈل پیکج بنائیں اور اپ لوڈ کریں:

سیج میکر اینڈ پوائنٹ بنائیں

ہمارے پاس اب ماڈل کے نمونے S3 بالٹی میں محفوظ ہیں۔ اس مرحلے میں، ہم اضافی ماحولیاتی متغیر بھی فراہم کر سکتے ہیں۔ SAGEMAKER_TRITON_DEFAULT_MODEL_NAME، جو ٹرائٹن کے ذریعہ لوڈ کیے جانے والے ماڈل کے نام کی وضاحت کرتا ہے۔ اس کلید کی قدر Amazon S3 پر اپ لوڈ کردہ ماڈل پیکیج میں فولڈر کے نام سے مماثل ہونی چاہیے۔ یہ متغیر کسی ایک ماڈل کی صورت میں اختیاری ہے۔ ملبوس ماڈلز کے معاملے میں، اس کلید کو ٹریٹن کے لیے SageMaker میں شروع کرنے کے لیے بتانا ہوگا۔

اس کے علاوہ، آپ سیٹ کر سکتے ہیں SAGEMAKER_TRITON_BUFFER_MANAGER_THREAD_COUNT اور SAGEMAKER_TRITON_THREAD_COUNT دھاگے کی تعداد کو بہتر بنانے کے لیے۔

ہم پچھلے ماڈل کا استعمال ایک اینڈ پوائنٹ کنفیگریشن بنانے کے لیے کرتے ہیں جہاں ہم ان مثالوں کی قسم اور تعداد بتا سکتے ہیں جو ہم اینڈ پوائنٹ میں چاہتے ہیں۔

ہم اس اینڈ پوائنٹ کنفیگریشن کو سیج میکر اینڈ پوائنٹ بنانے کے لیے استعمال کرتے ہیں اور تعیناتی ختم ہونے کا انتظار کرتے ہیں۔ SageMaker MMEs کے ساتھ، ہمارے پاس یہ اختیار ہے کہ اس عمل کو دہراتے ہوئے متعدد ماڈلز کی میزبانی کریں، لیکن ہم اس مثال کے لیے ایک تعیناتی پر قائم رہتے ہیں:

حیثیت بدل جائے گی۔ InService جب تعیناتی کامیاب ہو جاتی ہے۔

SageMaker اینڈ پوائنٹ پر ہوسٹ کردہ اپنے ماڈل کو طلب کریں۔

اختتامی نقطہ چلنے کے بعد، ہم JSON کو پے لوڈ فارمیٹ کے طور پر استعمال کرتے ہوئے اندازہ لگانے کے لیے کچھ نمونہ خام ڈیٹا استعمال کر سکتے ہیں۔ تخمینہ کی درخواست کی شکل کے لئے، Triton استعمال کرتا ہے KFServing کمیونٹی کے معیار انفرنس پروٹوکولز. درج ذیل کوڈ دیکھیں:

بلاگ میں حوالہ دی گئی نوٹ بک میں مل سکتی ہے۔ GitHub ذخیرہ.

بہترین طریقوں

FIL بیک اینڈ کی سیٹنگز کو ٹھیک کرنے کے اختیارات کے علاوہ جس کا ہم نے پہلے ذکر کیا ہے، ڈیٹا سائنسدان یہ بھی یقینی بنا سکتے ہیں کہ بیک اینڈ کے ان پٹ ڈیٹا کو انجن کے ذریعے پروسیسنگ کے لیے بہتر بنایا گیا ہے۔ جب بھی ممکن ہو، ڈیٹا کو قطار کے بڑے فارمیٹ میں GPU صف میں داخل کریں۔ دیگر فارمیٹس کے لیے اندرونی تبدیلی کی ضرورت ہوگی اور اس سے کارکردگی میں کمی آئے گی۔

GPU میموری میں FIL ڈیٹا ڈھانچے کو برقرار رکھنے کے طریقے کی وجہ سے، درخت کی گہرائی کا خیال رکھیں۔ درخت کی گہرائی جتنی گہری ہوگی، آپ کی GPU میموری کا نشان اتنا ہی بڑا ہوگا۔

استعمال کریں instance_group_count کارکن کے عمل کو شامل کرنے اور FIL بیک اینڈ کے تھرو پٹ کو بڑھانے کے لیے پیرامیٹر، جس کے نتیجے میں CPU اور GPU میموری کا زیادہ استعمال ہوگا۔ اس کے علاوہ، SageMaker کے مخصوص متغیرات پر غور کریں جو تھرو پٹ بڑھانے کے لیے دستیاب ہیں، جیسے HTTP تھریڈز، HTTP بفر سائز، بیچ سائز، اور زیادہ سے زیادہ تاخیر۔

نتیجہ

اس پوسٹ میں، ہم نے FIL پسدید کی گہرائی تک رسائی حاصل کی جسے Triton Inference Server SageMaker پر سپورٹ کرتا ہے۔ یہ پسدید آپ کے درخت پر مبنی ماڈلز جیسے کہ مشہور XGBoost الگورتھم کے CPU اور GPU ایکسلریشن دونوں کے لیے فراہم کرتا ہے۔ اندازہ لگانے کے لیے بہترین کارکردگی حاصل کرنے کے لیے غور کرنے کے لیے بہت سے اختیارات ہیں، جیسے بیچ کے سائز، ڈیٹا ان پٹ فارمیٹس، اور دیگر عوامل جنہیں آپ کی ضروریات کو پورا کرنے کے لیے بنایا جا سکتا ہے۔ SageMaker آپ کو کارکردگی اور لاگت کی بچت کے توازن کے لیے اس صلاحیت کو سنگل اور ملٹی ماڈل اینڈ پوائنٹس کے ساتھ استعمال کرنے کی اجازت دیتا ہے۔

ہم آپ کو اس پوسٹ میں معلومات لینے کی ترغیب دیتے ہیں اور دیکھیں کہ کیا SageMaker آپ کی ہوسٹنگ کی ضروریات کو پورا کر سکتا ہے تاکہ درختوں پر مبنی ماڈل پیش کیے جا سکیں، لاگت میں کمی اور کام کے بوجھ کی کارکردگی کے لیے آپ کی ضروریات کو پورا کیا جا سکے۔

اس پوسٹ میں جس نوٹ بک کا حوالہ دیا گیا ہے وہ سیج میکر کی مثالوں میں پایا جا سکتا ہے۔ GitHub ذخیرہ. مزید برآں، آپ FIL بیک اینڈ پر تازہ ترین دستاویزات حاصل کر سکتے ہیں۔ GitHub کے.

مصنفین کے بارے میں

راگھو رمیشا۔ ایمیزون سیج میکر سروس ٹیم کے ساتھ ایک سینئر ایم ایل سلوشنز آرکیٹیکٹ ہے۔ وہ صارفین کی ایم ایل پروڈکشن ورک بوجھ کو SageMaker پر پیمانے پر بنانے، تعینات کرنے اور منتقل کرنے میں مدد کرنے پر توجہ مرکوز کرتا ہے۔ وہ مشین لرننگ، AI، اور کمپیوٹر ویژن ڈومینز میں مہارت رکھتا ہے، اور UT Dallas سے کمپیوٹر سائنس میں ماسٹر ڈگری رکھتا ہے۔ اپنے فارغ وقت میں وہ سفر اور فوٹو گرافی سے لطف اندوز ہوتے ہیں۔

راگھو رمیشا۔ ایمیزون سیج میکر سروس ٹیم کے ساتھ ایک سینئر ایم ایل سلوشنز آرکیٹیکٹ ہے۔ وہ صارفین کی ایم ایل پروڈکشن ورک بوجھ کو SageMaker پر پیمانے پر بنانے، تعینات کرنے اور منتقل کرنے میں مدد کرنے پر توجہ مرکوز کرتا ہے۔ وہ مشین لرننگ، AI، اور کمپیوٹر ویژن ڈومینز میں مہارت رکھتا ہے، اور UT Dallas سے کمپیوٹر سائنس میں ماسٹر ڈگری رکھتا ہے۔ اپنے فارغ وقت میں وہ سفر اور فوٹو گرافی سے لطف اندوز ہوتے ہیں۔

جیمز پارک ایمیزون ویب سروسز میں ایک حل آرکیٹیکٹ ہے۔ وہ Amazon.com کے ساتھ AWS پر ٹکنالوجی کے حل کو ڈیزائن کرنے، بنانے اور ان کی تعیناتی کے لیے کام کرتا ہے، اور اسے AI اور مشین لرننگ میں خاص دلچسپی ہے۔ اپنے فارغ وقت میں وہ نئی ثقافتوں، نئے تجربات، اور جدید ترین ٹیکنالوجی کے رجحانات کے ساتھ اپ ٹو ڈیٹ رہنے میں لطف اندوز ہوتے ہیں۔

جیمز پارک ایمیزون ویب سروسز میں ایک حل آرکیٹیکٹ ہے۔ وہ Amazon.com کے ساتھ AWS پر ٹکنالوجی کے حل کو ڈیزائن کرنے، بنانے اور ان کی تعیناتی کے لیے کام کرتا ہے، اور اسے AI اور مشین لرننگ میں خاص دلچسپی ہے۔ اپنے فارغ وقت میں وہ نئی ثقافتوں، نئے تجربات، اور جدید ترین ٹیکنالوجی کے رجحانات کے ساتھ اپ ٹو ڈیٹ رہنے میں لطف اندوز ہوتے ہیں۔

دھول پٹیل AWS میں پرنسپل مشین لرننگ آرکیٹیکٹ ہے۔ انہوں نے تقسیم شدہ کمپیوٹنگ اور مصنوعی ذہانت سے متعلق مسائل پر بڑے اداروں سے لے کر درمیانے درجے کے اسٹارٹ اپس تک کی تنظیموں کے ساتھ کام کیا ہے۔ وہ گہری سیکھنے پر توجہ مرکوز کرتا ہے، بشمول NLP اور کمپیوٹر ویژن ڈومینز۔ وہ صارفین کو Amazon SageMaker پر اعلیٰ کارکردگی کے ماڈل کا اندازہ حاصل کرنے میں مدد کرتا ہے۔

دھول پٹیل AWS میں پرنسپل مشین لرننگ آرکیٹیکٹ ہے۔ انہوں نے تقسیم شدہ کمپیوٹنگ اور مصنوعی ذہانت سے متعلق مسائل پر بڑے اداروں سے لے کر درمیانے درجے کے اسٹارٹ اپس تک کی تنظیموں کے ساتھ کام کیا ہے۔ وہ گہری سیکھنے پر توجہ مرکوز کرتا ہے، بشمول NLP اور کمپیوٹر ویژن ڈومینز۔ وہ صارفین کو Amazon SageMaker پر اعلیٰ کارکردگی کے ماڈل کا اندازہ حاصل کرنے میں مدد کرتا ہے۔

جیاہونگ لیو NVIDIA میں کلاؤڈ سروس پرووائیڈر ٹیم میں ایک حل آرکیٹیکٹ ہے۔ وہ مشین لرننگ اور AI سلوشنز کو اپنانے میں کلائنٹس کی مدد کرتا ہے جو NVIDIA ایکسلریٹڈ کمپیوٹنگ کو ان کی ٹریننگ اور انفرنس چیلنجز سے نمٹنے کے لیے فائدہ اٹھاتے ہیں۔ اپنے فارغ وقت میں، وہ اوریگامی، DIY پروجیکٹس، اور باسکٹ بال کھیلنا پسند کرتا ہے۔

جیاہونگ لیو NVIDIA میں کلاؤڈ سروس پرووائیڈر ٹیم میں ایک حل آرکیٹیکٹ ہے۔ وہ مشین لرننگ اور AI سلوشنز کو اپنانے میں کلائنٹس کی مدد کرتا ہے جو NVIDIA ایکسلریٹڈ کمپیوٹنگ کو ان کی ٹریننگ اور انفرنس چیلنجز سے نمٹنے کے لیے فائدہ اٹھاتے ہیں۔ اپنے فارغ وقت میں، وہ اوریگامی، DIY پروجیکٹس، اور باسکٹ بال کھیلنا پسند کرتا ہے۔

کشتیز گپتا NVIDIA میں ایک حل آرکیٹیکٹ ہے۔ وہ کلاؤڈ صارفین کو GPU AI ٹیکنالوجیز کے بارے میں تعلیم دینے سے لطف اندوز ہوتا ہے جو NVIDIA کو پیش کرنا ہے اور ان کی مشین لرننگ اور ڈیپ لرننگ ایپلی کیشنز کو تیز کرنے میں ان کی مدد کرنا ہے۔ کام سے باہر، وہ دوڑنا، پیدل سفر کرنے اور جنگلی حیات کو دیکھنے سے لطف اندوز ہوتا ہے۔

کشتیز گپتا NVIDIA میں ایک حل آرکیٹیکٹ ہے۔ وہ کلاؤڈ صارفین کو GPU AI ٹیکنالوجیز کے بارے میں تعلیم دینے سے لطف اندوز ہوتا ہے جو NVIDIA کو پیش کرنا ہے اور ان کی مشین لرننگ اور ڈیپ لرننگ ایپلی کیشنز کو تیز کرنے میں ان کی مدد کرنا ہے۔ کام سے باہر، وہ دوڑنا، پیدل سفر کرنے اور جنگلی حیات کو دیکھنے سے لطف اندوز ہوتا ہے۔

- SEO سے چلنے والا مواد اور PR کی تقسیم۔ آج ہی بڑھا دیں۔

- پلیٹوآئ اسٹریم۔ ویب 3 ڈیٹا انٹیلی جنس۔ علم میں اضافہ۔ یہاں تک رسائی حاصل کریں۔

- ایڈریین ایشلے کے ساتھ مستقبل کا نقشہ بنانا۔ یہاں تک رسائی حاصل کریں۔

- ماخذ: https://aws.amazon.com/blogs/machine-learning/hosting-ml-models-on-amazon-sagemaker-using-triton-xgboost-lightgbm-and-treelite-models/

- : ہے

- : ہے

- : نہیں

- :کہاں

- $UP

- 1

- 100

- 11

- 13

- 200

- 23

- 24

- 7

- 8

- 9

- a

- کی صلاحیت

- ہمارے بارے میں

- رفتار کو تیز تر

- تیز

- تیز

- ایکسلریٹر

- تک رسائی حاصل

- کے مطابق

- اس کے مطابق

- اکاؤنٹ

- حاصل

- کے پار

- شامل کریں

- اس کے علاوہ

- ایڈیشنل

- پتہ

- قابل شناخت

- اپنانے

- کے بعد

- کے خلاف

- معاہدے

- AI

- یلگورتم

- تمام

- تین ہلاک

- کی اجازت

- کی اجازت دیتا ہے

- ساتھ

- پہلے ہی

- بھی

- اگرچہ

- ہمیشہ

- ایمیزون

- ایمیزون سیج میکر

- ایمیزون ویب سروسز

- Amazon.com

- رقم

- an

- اور

- کوئی بھی

- اے پی آئی

- ایپلی کیشنز

- مناسب

- فن تعمیر

- کیا

- علاقوں

- دلیل

- لڑی

- مصنوعی

- مصنوعی ذہانت

- AS

- مدد

- At

- آٹو

- دستیاب

- سے اجتناب

- AWS

- پسدید

- متوازن

- کی بنیاد پر

- مار

- بنیاد

- باسکٹ بال

- BE

- کیونکہ

- بن

- رہا

- اس سے پہلے

- شروع کریں

- پیچھے

- نیچے

- فائدہ

- BEST

- بہتر

- کے درمیان

- بڑا

- بلاگ

- جسم

- دونوں

- بفر

- تعمیر

- عمارت

- تعمیر

- لیکن

- by

- C ++

- کہا جاتا ہے

- کر سکتے ہیں

- کارڈ

- کیس

- مقدمات

- قسم

- کیونکہ

- چیلنجوں

- تبدیل

- خصوصیات

- چیک کریں

- چپ

- میں سے انتخاب کریں

- منتخب کریں

- شہر

- طبقے

- درجہ بندی

- کلائنٹ

- کلائنٹس

- بادل

- کوڈ

- کالم

- COM

- آتا ہے

- آنے والے

- کامن

- ابلاغ

- مواصلات

- کمیونٹی

- ہم آہنگ

- پیچیدہ

- حساب

- کمپیوٹر

- کمپیوٹر سائنس

- کمپیوٹر ویژن

- کمپیوٹنگ

- ترتیب

- کنکشن

- غور کریں

- سمجھا

- بسم

- کھپت

- کنٹینر

- کنٹینر

- پر مشتمل ہے

- مندرجات

- اس کے برعکس

- کنٹرول

- آسان

- تبادلوں سے

- تبدیل

- کور

- اسی کے مطابق

- قیمت

- قیمت میں کمی

- لاگت کی بچت

- احاطہ

- تخلیق

- بنائی

- پیدا

- معیار

- اہم

- اس وقت

- اپنی مرضی کے

- گاہکوں

- سائیکل

- ڈلاس

- اعداد و شمار

- تاریخ

- دن

- نمٹنے کے

- فیصلہ

- گہری

- گہری سیکھنے

- گہرے

- پہلے سے طے شدہ

- غلطی

- ڈگری

- تاخیر

- مطالبہ

- مطالبات

- منحصر ہے

- تعیناتی

- تعینات

- تعینات

- تعیناتی

- گہرائی

- ڈیزائن

- تفصیلات

- اس بات کا تعین

- کا تعین

- یہ تعین

- کا تعین کرنے

- ڈویلپرز

- فرق

- مختلف

- تقسیم کئے

- تقسیم کمپیوٹنگ

- ڈی آئی

- do

- دستاویزات

- نہیں کرتا

- کر

- ڈومینز

- کیا

- کبوتر

- دو

- کے دوران

- ہر ایک

- اس سے قبل

- کی تعلیم

- کارکردگی

- مؤثر طریقے سے

- یا تو

- پر زور

- کے قابل بناتا ہے

- کی حوصلہ افزائی

- آخر

- اختتام پوائنٹ

- انجن

- انجن

- کو یقینی بنانے کے

- کو یقینی بنانے ہے

- انٹرپرائز

- اداروں

- پوری

- ماحولیات

- نقائص

- بھی

- ہر کوئی

- مثال کے طور پر

- مثال کے طور پر

- تبادلہ

- توقع ہے

- توقع

- تجربات

- برآمد

- عوامل

- کافی

- آبشار

- جھوٹی

- نمایاں کریں

- خصوصیات

- فیڈ

- کھانا کھلانا

- چند

- اعداد و شمار

- فائل

- فائلوں

- مل

- ختم

- پہلا

- بہاؤ

- توجہ مرکوز

- توجہ مرکوز

- پر عمل کریں

- پیچھے پیچھے

- کے بعد

- فوٹ پرنٹ

- کے لئے

- فارم

- فارمیٹ

- ملا

- فریم ورک

- فریم ورک

- دھوکہ دہی

- مفت

- سے

- مزید برآں

- فوائد

- جنرل

- پیدا ہوتا ہے

- حاصل

- دے دو

- دی

- GPU

- بہت

- گروپ

- گروپ کا

- رہنمائی

- ہو

- ہارڈ

- ہارڈ ویئر

- ہے

- he

- مدد

- مدد

- مدد کرتا ہے

- یہاں

- اعلی سطحی

- اعلی کارکردگی

- اعلی

- پر روشنی ڈالی گئی

- ان

- پکڑو

- کی ڈگری حاصل کی

- میزبان

- میزبانی کی

- ہوسٹنگ

- کس طرح

- کیسے

- تاہم

- HTML

- HTTP

- HTTPS

- تکلیف

- شناختی

- شناخت

- IDX

- if

- تصویر

- اثر

- اثرات

- پر عملدرآمد

- عملدرآمد

- عمل

- درآمدات

- in

- شامل

- سمیت

- اضافہ

- اشارہ کرتا ہے

- معلومات

- مطلع

- ان پٹ

- انسٹال

- مثال کے طور پر

- ہدایات

- انضمام

- انٹیلی جنس

- دلچسپی

- اندرونی

- میں

- IT

- میں

- فوٹو

- JSON

- صرف

- رکھیں

- کلیدی

- بچے

- جان

- بڑے

- بڑے کاروباری اداروں

- بڑے

- تاخیر

- تازہ ترین

- لے آؤٹ

- جانیں

- سیکھنے

- کم سے کم

- قیادت

- جائز

- کم

- سطح

- سطح

- لیوریج

- لائبریریوں

- لائبریری

- کی طرح

- LIMIT

- لائن

- لسٹ

- لوڈ

- منطق

- منطقی

- لانگ

- مشین

- مشین لرننگ

- بنا

- انتظام

- بہت سے

- ماسٹر کی

- میچ

- میکس

- زیادہ سے زیادہ

- مئی..

- میکانزم

- سے ملو

- اجلاس

- یاد داشت

- ذکر کیا

- مرچنٹ

- پیمائش کا معیار

- شاید

- منتقلی

- برا

- ML

- موڈ

- ماڈل

- ماڈل

- مہینہ

- زیادہ

- سب سے زیادہ

- سب سے زیادہ مقبول

- منتقل

- ملٹی ماڈل اینڈ پوائنٹ

- ایک سے زیادہ

- ضروری

- نام

- نام

- مقامی

- ضرورت ہے

- ضروریات

- نئی

- ویزا

- نہیں

- نوڈس

- نوٹ بک

- اب

- تعداد

- عجیب

- NVIDIA

- حاصل

- of

- پیش کرتے ہیں

- تجویز

- اکثر

- on

- ایک

- والوں

- صرف

- اوپن سورس

- زیادہ سے زیادہ

- اصلاح کے

- کی اصلاح کریں

- اصلاح

- اصلاح

- اختیار

- آپشنز کے بھی

- or

- حکم

- تنظیمیں

- منظم

- اصل میں

- OS

- دیگر

- دوسری صورت میں

- ہمارے

- باہر

- پیداوار

- باہر

- خود

- پیکج

- پیکیجنگ

- pandas

- متوازی

- پیرامیٹر

- پیرامیٹرز

- حصہ لینے

- خاص طور پر

- منظور

- گزرتا ہے

- راستہ

- انجام دیں

- کارکردگی

- کارکردگی کا مظاہرہ

- اجازت

- فوٹو گرافی

- پائپ لائن

- پلیٹ فارم

- پلاٹا

- افلاطون ڈیٹا انٹیلی جنس

- پلیٹو ڈیٹا

- کھیل

- مہربانی کرکے

- چمکتا

- پالیسیاں

- پالیسی

- پول

- مقبول

- مقبولیت

- ممکن

- ممکنہ طور پر

- پوسٹ

- طاقت

- پیشن گوئی

- پیش قیاسی

- پیش گوئی

- کی پیشن گوئی

- پیشن گوئی

- پہلے

- پرائمری

- پرنسپل

- مسائل

- عمل

- عمل

- پروسیسنگ

- پاور پروسیسنگ

- پروسیسرز

- پیدا

- پیداوار

- منصوبوں

- مناسب

- Proto کی

- فراہم

- فراہم

- فراہم کنندہ

- فراہم کرتا ہے

- فراہم کرنے

- ازگر

- pytorch

- بے ترتیب

- لے کر

- بلکہ

- خام

- تیار

- حقیقی دنیا

- اصل وقت

- وجوہات

- سفارش

- کو کم

- کہا جاتا ہے

- بے شک

- خطے

- متعلقہ

- متعلقہ

- کی جگہ

- ذخیرہ

- نمائندگی

- نمائندگی

- کی نمائندگی کرتا ہے

- درخواست

- درخواستوں

- کی ضرورت

- ضرورت

- ضروریات

- کی ضرورت ہے

- جواب

- ذمہ دار

- نتیجہ

- نتائج کی نمائش

- کردار

- رن

- چل رہا ہے

- s

- sagemaker

- سیج میکر کا اندازہ

- اسی

- بچت

- توسیع پذیر

- پیمانے

- سکیلنگ

- منظرنامے

- شیڈولنگ

- سائنس

- سائنسدانوں

- سائنٹ سیکھنا

- سکور

- سیکشن

- دیکھنا

- کی تلاش

- منتخب

- بھیجنے

- سینئر

- علیحدہ

- خدمت

- سروس

- سروس فراہم کرنے والے

- سروسز

- خدمت

- مقرر

- قائم کرنے

- ترتیبات

- شکل

- مشترکہ

- ہونا چاہئے

- دکھائیں

- شوز

- کی طرف

- نمایاں طور پر

- اسی طرح

- سادہ

- ایک

- سائز

- سائز

- So

- حل

- حل

- حل

- حل کرنا۔

- کچھ

- ماخذ

- مہارت دیتا ہے

- مخصوص

- تصریح

- مخصوص

- خرچ

- معیار

- شروع کریں

- شروع

- سترٹو

- حالت

- درجہ

- مستحکم

- مرحلہ

- مراحل

- ذخیرہ

- ذخیرہ

- ذخیرہ

- براہ راست

- سلک

- ساخت

- کامیاب

- اس طرح

- مشورہ

- موزوں

- حمایت

- تائید

- کی حمایت کرتا ہے

- لے لو

- ٹیم

- تکنیک

- ٹیکنالوجی

- ٹیکنالوجی

- بتا

- شرائط

- سے

- کہ

- ۔

- کے بارے میں معلومات

- ان

- ان

- تو

- وہاں.

- یہ

- وہ

- بات

- اس

- ان

- اگرچہ؟

- تین

- حد

- تھرو پٹ

- وقت

- کرنے کے لئے

- آج

- مل کر

- اوپر کی سطح

- روایتی طور پر

- تربیت یافتہ

- ٹریننگ

- منتقلی

- سفر

- درخت

- رجحانات

- رخ

- سچ

- دو

- قسم

- اقسام

- عام طور پر

- سمجھ

- اپ لوڈ کردہ

- اپ لوڈ کرنا

- us

- استعمال کی شرائط

- استعمال کیا جاتا ہے

- رکن کا

- کا استعمال کرتے ہوئے

- استعمال کرتا ہے

- استعمال کرنا۔

- قیمت

- اقدار

- مختلف

- ورژن

- کی طرف سے

- نقطہ نظر

- W

- انتظار

- چاہتے ہیں

- تھا

- دیکھ

- راستہ..

- we

- ویب

- ویب خدمات

- اچھا ہے

- تھے

- کیا

- جب

- جب بھی

- چاہے

- جس

- جبکہ

- گے

- ساتھ

- کے اندر

- بغیر

- کام

- کام کیا

- کارکن

- کام کرتا ہے

- گا

- XGBoost

- سال

- تم

- اور

- زیفیرنیٹ

- زپ