یہ پوسٹ Q4 Inc سے Stanislav Yeshchenko کے ساتھ مل کر لکھی گئی ہے۔

انٹرپرائزز Retrieval Augmented Generation (RAG) کو سوال و جواب کے چیٹ بوٹس بنانے کے لیے مرکزی دھارے کے نقطہ نظر کے طور پر رجوع کرتے ہیں۔ ہم ابھرتے ہوئے چیلنجوں کو دیکھتے رہتے ہیں جو دستیاب ڈیٹاسیٹس کی درجہ بندی کی نوعیت سے پیدا ہوتے ہیں۔ یہ ڈیٹا سیٹس اکثر عددی اور متنی ڈیٹا کا مرکب ہوتے ہیں، بعض اوقات ساختہ، غیر ساختہ، یا نیم ساختہ۔

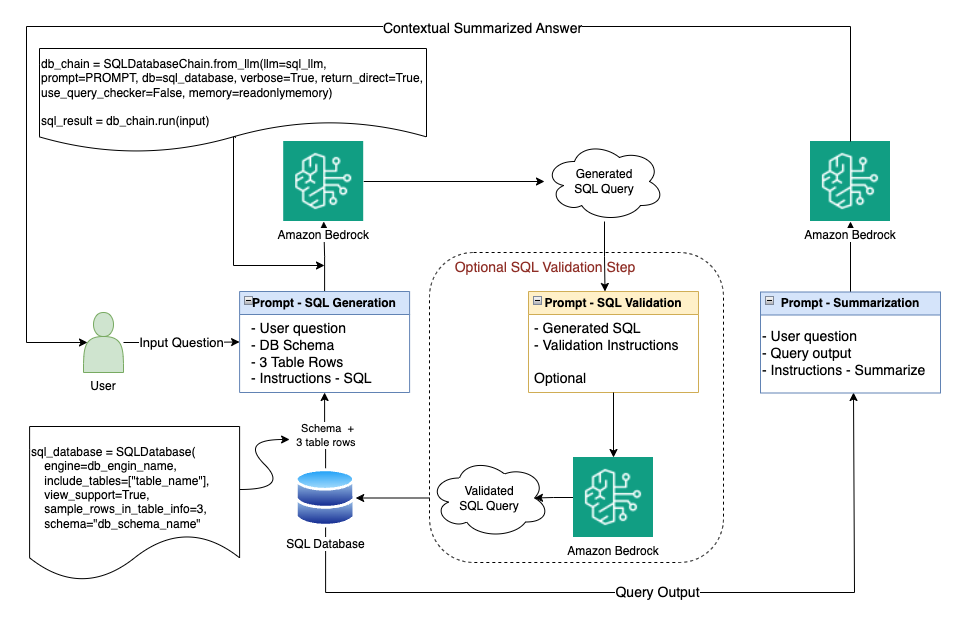

Q4 Inc. AWS پر بنائے گئے ان کے بہت سے AI استعمال کے معاملات میں سے ایک میں ان میں سے کچھ چیلنجوں کو حل کرنے کی ضرورت ہے۔ اس پوسٹ میں، ہم سوال و جواب کے بوٹ کے استعمال کے معاملے پر تبادلہ خیال کرتے ہیں جسے Q4 نے لاگو کیا ہے، وہ چیلنجز جو عددی اور ساختی ڈیٹاسیٹس نے پیش کیے ہیں، اور Q4 نے کس طرح یہ نتیجہ اخذ کیا کہ SQL کا استعمال ایک قابل عمل حل ہو سکتا ہے۔ آخر میں، ہم اس پر گہری نظر ڈالتے ہیں کہ Q4 ٹیم نے کس طرح استعمال کیا۔ ایمیزون بیڈرک اور SQLDatabaseChain SQL جنریشن کے ساتھ RAG پر مبنی حل کو نافذ کرنے کے لیے۔

کیس کا جائزہ استعمال کریں۔

Q4 Inc.، جس کا صدر دفتر ٹورنٹو میں ہے، نیویارک اور لندن میں دفاتر کے ساتھ، ایک سرکردہ کیپٹل مارکیٹس تک رسائی کا پلیٹ فارم ہے جو اس بات کو تبدیل کر رہا ہے کہ کس طرح جاری کنندگان، سرمایہ کار، اور فروخت کنندگان ایک دوسرے کے ساتھ مؤثر طریقے سے جڑتے، بات چیت کرتے اور مشغول رہتے ہیں۔ Q4 پلیٹ فارم IR ویب سائٹ پراڈکٹس، ورچوئل ایونٹس سلوشنز، انگیجمنٹ اینالیٹکس، سرمایہ کار تعلقات کسٹمر ریلیشن شپ مینجمنٹ (CRM)، شیئر ہولڈر اور مارکیٹ کے تجزیہ، نگرانی، اور ESG ٹولز کے ذریعے کیپٹل مارکیٹوں میں بات چیت کی سہولت فراہم کرتا ہے۔

آج کے تیز رفتار اور ڈیٹا سے چلنے والے مالیاتی منظر نامے میں، انوسٹر ریلیشن آفیسرز (IROs) کمپنی اور اس کے شیئر ہولڈرز، تجزیہ کاروں اور سرمایہ کاروں کے درمیان رابطے کو فروغ دینے میں اہم کردار ادا کرتے ہیں۔ اپنے روزمرہ کے فرائض کے حصے کے طور پر، IROs متنوع ڈیٹاسیٹس کا تجزیہ کرتے ہیں، بشمول CRM، ملکیت کے ریکارڈ، اور اسٹاک مارکیٹ کا ڈیٹا۔ اس ڈیٹا کا مجموعی استعمال مالیاتی رپورٹیں بنانے، سرمایہ کاروں کے تعلقات کے اہداف مقرر کرنے، اور موجودہ اور ممکنہ سرمایہ کاروں کے ساتھ مواصلت کا انتظام کرنے کے لیے کیا جاتا ہے۔

موثر اور متحرک ڈیٹا کی بازیافت کی بڑھتی ہوئی مانگ کو پورا کرنے کے لیے، Q4 کا مقصد ایک چیٹ بوٹ سوال و جواب کا ٹول بنانا ہے جو IROs کو صارف دوست فارمیٹ میں درکار ضروری معلومات تک رسائی کے لیے ایک بدیہی اور سیدھا طریقہ فراہم کرے گا۔

آخری مقصد ایک ایسا چیٹ بوٹ بنانا تھا جو بغیر کسی رکاوٹ کے عوامی طور پر دستیاب ڈیٹا کو، ملکیتی کسٹمر کے مخصوص Q4 ڈیٹا کے ساتھ، سیکیورٹی اور ڈیٹا کی رازداری کی اعلیٰ ترین سطح کو برقرار رکھتے ہوئے مربوط کرے گا۔ جہاں تک کارکردگی کا تعلق ہے، مقصد یہ تھا کہ سیکنڈوں کے سوال کے جواب کا وقت برقرار رکھا جائے تاکہ اختتامی صارفین کے لیے مثبت تجربہ کو یقینی بنایا جا سکے۔

مالیاتی منڈیاں ایک ریگولیٹڈ انڈسٹری ہے جس میں اعلی حصص شامل ہیں۔ غلط یا پرانی معلومات فراہم کرنا دیگر ممکنہ ڈیٹا پرائیویسی خطرات کے علاوہ سرمایہ کاروں اور حصص یافتگان کے اعتماد کو متاثر کر سکتا ہے۔ صنعت اور تقاضوں کو سمجھتے ہوئے، Q4 ڈیٹا کی رازداری اور جواب کی درستگی کو اپنے رہنما اصولوں کے طور پر کسی بھی حل کو مارکیٹ میں لے جانے سے پہلے اس کا اندازہ لگاتا ہے۔

تصور کے ثبوت کے لیے، Q4 نے مالی ملکیت کا ڈیٹاسیٹ استعمال کرنے کا فیصلہ کیا۔ ڈیٹا سیٹ ٹائم سیریز کے ڈیٹا پوائنٹس پر مشتمل ہوتا ہے جو ملکیت کے اثاثوں کی تعداد کی نمائندگی کرتا ہے۔ سرمایہ کاری کے اداروں، افراد اور عوامی کمپنیوں کے درمیان لین دین کی تاریخ؛ اور بہت سے عناصر۔

چونکہ Q4 اس بات کو یقینی بنانا چاہتا تھا کہ یہ تمام فعال اور غیر فعال ضروریات کو پورا کر سکے جن پر ہم نے تبادلہ خیال کیا ہے، اس لیے پروجیکٹ کو تجارتی طور پر قابل عمل رہنے کی بھی ضرورت ہے۔ نقطہ نظر، فن تعمیر، ٹیکنالوجی کے انتخاب، اور حل کے لیے مخصوص عناصر کے بارے میں فیصلہ کرنے کے پورے عمل میں اس کا احترام کیا گیا۔

تجربہ اور چیلنجز

یہ شروع سے ہی واضح تھا کہ انسانی زبان کے سوال کو سمجھنے اور درست جوابات پیدا کرنے کے لیے، Q4 کو بڑے لینگویج ماڈلز (LLMs) استعمال کرنے کی ضرورت ہوگی۔

درج ذیل کچھ تجربات ہیں جو ٹیم کی طرف سے کیے گئے، اس کے ساتھ ان چیلنجوں کی نشاندہی کی گئی اور سیکھے گئے سبق:

- پری ٹریننگ - Q4 اس پیچیدگی اور چیلنجوں کو سمجھتا ہے جو ایل ایل ایم کو اس کے اپنے ڈیٹاسیٹ کا استعمال کرتے ہوئے پری ٹریننگ کے ساتھ آتے ہیں۔ یہ تیزی سے واضح ہو گیا کہ یہ نقطہ نظر بہت سے غیر معمولی اقدامات جیسے کہ ڈیٹا پری پروسیسنگ، تربیت، اور تشخیص کے ساتھ وسائل پر مبنی ہے۔ ملوث کوششوں کے علاوہ، اس کی لاگت ممنوع ہوگی۔ ٹائم سیریز ڈیٹاسیٹ کی نوعیت پر غور کرتے ہوئے، Q4 نے یہ بھی محسوس کیا کہ نئے ڈیٹا کے آنے کے ساتھ ہی اسے مسلسل اضافی پری ٹریننگ کرنا پڑے گی۔ اس کے لیے ڈیٹا سائنس، مشین لرننگ، اور ڈومین میں مہارت کے ساتھ ایک سرشار کراس ڈسپلنری ٹیم کی ضرورت ہوگی۔ علم

- عمدہ ٹیوننگ - پہلے سے تربیت یافتہ فاؤنڈیشن ماڈل (FM) کو ٹھیک کرنا جس میں کئی لیبل والی مثالیں شامل ہیں۔ اس نقطہ نظر نے کچھ ابتدائی کامیابی ظاہر کی، لیکن بہت سے معاملات میں، ماڈل ہیلوسینیشن ایک چیلنج تھا۔ ماڈل نے اہم سیاق و سباق کے اشارے کو سمجھنے کے لئے جدوجہد کی اور غلط نتائج لوٹائے۔

- سیمنٹک تلاش کے ساتھ RAG - ایس کیو ایل جنریشن میں جانے سے پہلے سیمنٹک سرچ کے ساتھ روایتی RAG آخری مرحلہ تھا۔ ٹیم نے سیاق و سباق کو نکالنے کے لیے تلاش، معنوی تلاش، اور سرایت کرنے کا تجربہ کیا۔ ایمبیڈنگز کے تجربے کے دوران، ڈیٹاسیٹ کو ایمبیڈنگز میں تبدیل کیا گیا، ایک ویکٹر ڈیٹا بیس میں اسٹور کیا گیا، اور پھر سیاق و سباق کو نکالنے کے لیے سوال کے ایمبیڈنگز کے ساتھ ملایا گیا۔ تینوں تجربات میں سے کسی میں بھی بازیافت شدہ سیاق و سباق کو پھر اصل پرامپٹ کو LLM کے ان پٹ کے طور پر بڑھانے کے لیے استعمال کیا گیا۔ اس نقطہ نظر نے متن پر مبنی مواد کے لیے اچھا کام کیا، جہاں ڈیٹا الفاظ، جملوں اور پیراگراف کے ساتھ قدرتی زبان پر مشتمل ہوتا ہے۔ Q4 کے ڈیٹاسیٹ کی نوعیت کو مدنظر رکھتے ہوئے، جو کہ زیادہ تر مالیاتی ڈیٹا ہے جس میں نمبرز، مالیاتی لین دین، اسٹاک کوٹس، اور تاریخیں شامل ہیں، تینوں صورتوں میں نتائج سب سے بہتر تھے۔ یہاں تک کہ ایمبیڈنگز کا استعمال کرتے ہوئے بھی، نمبروں سے پیدا ہونے والی ایمبیڈنگز مماثلت کی درجہ بندی کے ساتھ جدوجہد کرتی ہیں، اور بہت سے معاملات میں غلط معلومات کی بازیافت کا باعث بنتی ہیں۔

Q4 کا نتیجہ: ایس کیو ایل تیار کرنا آگے کا راستہ ہے۔

روایتی RAG طریقہ کار کو استعمال کرتے ہوئے درپیش چیلنجوں پر غور کرتے ہوئے، ٹیم نے SQL جنریشن پر غور کرنا شروع کیا۔ خیال یہ تھا کہ LLM کا استعمال سب سے پہلے صارف کے سوال سے ایک SQL بیان تیار کرنے کے لیے کیا جائے، جو LLM کو قدرتی زبان میں پیش کیا جائے۔ اس کے بعد متعلقہ سیاق و سباق کو حاصل کرنے کے لیے تیار کردہ استفسار کو ڈیٹا بیس کے خلاف چلایا جاتا ہے۔ سیاق و سباق کو آخر میں خلاصہ قدم کے لیے ان پٹ پرامپٹ کو بڑھانے کے لیے استعمال کیا جاتا ہے۔

Q4 کا مفروضہ یہ تھا کہ بازیافت کے مرحلے کے لیے زیادہ یاد حاصل کرنے کے لیے، خاص طور پر عددی ڈیٹاسیٹ کے لیے، انہیں پہلے صارف کے سوال سے SQL پیدا کرنے کی ضرورت تھی۔ یہ خیال کیا جاتا تھا کہ اس سے نہ صرف درستگی میں اضافہ ہوتا ہے، بلکہ سیاق و سباق کو ایک دیئے گئے سوال کے لیے کاروباری ڈومین میں بھی رکھا جاتا ہے۔ استفسار کے لیے، اور درست SQL پیدا کرنے کے لیے، Q4 کو LLM کو ان کے ڈیٹاسیٹ کے ڈھانچے سے مکمل طور پر سیاق و سباق سے آگاہ کرنے کی ضرورت ہے۔ اس کا مطلب یہ تھا کہ ڈیٹا بیس اسکیما، چند نمونہ ڈیٹا کی قطاریں، اور ان فیلڈز کے لیے جن کو سمجھنا آسان نہیں ہے، انسانی پڑھنے کے قابل فیلڈ وضاحتیں شامل کرنے کے لیے درکار پرامپٹ۔

ابتدائی ٹیسٹوں کی بنیاد پر، اس طریقہ نے بہت اچھے نتائج دکھائے۔ تمام ضروری معلومات سے لیس ایل ایل ایم درست ایس کیو ایل تیار کرنے میں کامیاب تھا، جسے پھر درست سیاق و سباق کی بازیافت کے لیے ڈیٹا بیس کے خلاف چلایا گیا۔ خیال کے ساتھ تجربہ کرنے کے بعد، Q4 نے فیصلہ کیا کہ SQL جنریشن ان کے اپنے مخصوص ڈیٹاسیٹ کے لیے سیاق و سباق نکالنے کے چیلنجوں سے نمٹنے کا راستہ ہے۔

آئیے مجموعی حل کے نقطہ نظر کو بیان کرنے کے ساتھ شروع کریں، اسے اس کے اجزاء میں توڑ دیں، اور پھر ٹکڑوں کو ایک ساتھ رکھیں۔

حل جائزہ

LLMs اربوں پیرامیٹرز کے ساتھ بڑے ماڈل ہیں جو مختلف ذرائع سے بہت بڑی مقدار میں ڈیٹا کا استعمال کرتے ہوئے پہلے سے تربیت یافتہ ہیں۔ تربیتی ڈیٹاسیٹس کی وسعت کی وجہ سے، LLMs سے توقع کی جاتی ہے کہ وہ مختلف ڈومینز میں عمومی معلومات رکھتے ہیں۔ LLMs کو ان کی استدلال کی صلاحیتوں کے لیے بھی جانا جاتا ہے، جو ایک ماڈل سے دوسرے میں مختلف ہوتی ہیں۔ اس عمومی رویے کو کسی مخصوص ڈومین یا صنعت کے لیے اضافی ڈومین کے لیے مخصوص پری ٹریننگ ڈیٹا کا استعمال کرتے ہوئے فاؤنڈیشن ماڈل کو مزید بہتر بنا کر یا لیبل والے ڈیٹا کا استعمال کرتے ہوئے فائن ٹیوننگ کے ذریعے بہتر بنایا جا سکتا ہے۔ صحیح سیاق و سباق، میٹا ڈیٹا اور ہدایات کے پیش نظر، ایک اچھی طرح سے منتخب کردہ عمومی مقصد LLM اچھے معیار کا SQL پیدا کر سکتا ہے جب تک کہ اسے صحیح ڈومین کے مخصوص سیاق و سباق تک رسائی حاصل ہو۔

Q4 کے استعمال کے معاملے میں، ہم کسٹمر کے سوال کو SQL میں ترجمہ کرنے کے ساتھ شروع کرتے ہیں۔ ہم صارف کے سوال، ڈیٹا بیس اسکیما، کچھ نمونے ڈیٹا بیس کی قطاروں، اور SQL کو پیدا کرنے کے لیے LLM کے پرامپٹ کے طور پر تفصیلی ہدایات کو یکجا کرکے ایسا کرتے ہیں۔ ہمارے پاس ایس کیو ایل ہونے کے بعد، اگر ضروری سمجھا جائے تو ہم توثیق کا مرحلہ چلا سکتے ہیں۔ جب ہم SQL کے معیار سے خوش ہوتے ہیں، تو ہم متعلقہ سیاق و سباق کو بازیافت کرنے کے لیے ڈیٹا بیس کے خلاف استفسار چلاتے ہیں جس کی ہمیں درج ذیل مرحلے کے لیے ضرورت ہے۔ اب جب کہ ہمارے پاس متعلقہ سیاق و سباق موجود ہے، ہم صارف کے اصل سوال، سیاق و سباق کی بازیافت، اور حتمی خلاصہ جواب پیش کرنے کے لیے ہدایات کا ایک سیٹ واپس LLM کو بھیج سکتے ہیں۔ آخری مرحلے کا مقصد یہ ہے کہ LLM نتائج کا خلاصہ کرے اور ایک سیاق و سباق اور درست جواب فراہم کرے جو اس کے بعد صارف کو دیا جا سکے۔

عمل کے ہر مرحلے پر استعمال ہونے والے LLM کا انتخاب درستگی، لاگت اور کارکردگی پر بہت زیادہ اثر انداز ہوتا ہے۔ ایک پلیٹ فارم یا ٹیکنالوجی کا انتخاب کرنا جو آپ کو ایک ہی استعمال کیس (مختلف کاموں کے لیے ایک سے زیادہ LLM ٹرپس) کے اندر، یا مختلف استعمال کے معاملات میں LLMs کے درمیان سوئچ کرنے کی لچک دے سکے، آؤٹ پٹ کے معیار، تاخیر اور لاگت کو بہتر بنانے میں فائدہ مند ہو سکتا ہے۔ . ہم بعد میں اس پوسٹ میں ایل ایل ایم کے انتخاب پر توجہ دیں گے۔

حل کی تعمیر کے بلاکس

اب جب کہ ہم نے اعلیٰ سطح پر نقطہ نظر کو اجاگر کیا ہے، آئیے حل کی تعمیر کے بلاکس سے شروع کرتے ہوئے تفصیلات میں غوطہ لگائیں۔

ایمیزون بیڈرک

Amazon Bedrock ایک مکمل طور پر منظم سروس ہے جو AI21 Labs، Anthropic، Cohere، Meta، Stability AI، اور Amazon سمیت معروف کمپنیوں سے اعلی کارکردگی کا مظاہرہ کرنے والے FMs کا انتخاب پیش کرتی ہے۔ Amazon Bedrock ٹولز کا ایک وسیع سیٹ بھی پیش کرتا ہے جو تخلیقی AI ایپلی کیشنز بنانے، ترقی کے عمل کو آسان بنانے، اور رازداری اور سلامتی کو برقرار رکھنے کے لیے درکار ہیں۔ اس کے علاوہ، Amazon Bedrock کے ساتھ آپ مختلف FM آپشنز میں سے انتخاب کر سکتے ہیں، اور آپ ماڈلز کے جوابات کو اپنے استعمال کے کیس کی ضروریات کے مطابق ترتیب دینے کے لیے ذاتی طور پر اپنے ڈیٹا کا استعمال کرتے ہوئے ماڈلز کو مزید ٹھیک کر سکتے ہیں۔ ایمیزون بیڈرک ایک ہی API کے ذریعے دستیاب ماڈلز تک رسائی کو بڑھانے کا انتظام کرنے کے لیے بغیر کسی بنیادی ڈھانچے کے مکمل طور پر سرور لیس ہے۔ آخر میں، Amazon Bedrock کئی سیکورٹی اور رازداری کے تقاضوں کی حمایت کرتا ہے، بشمول HIPAA اہلیت اور GDPR کی تعمیل۔

Q4 کے حل میں، ہم Amazon Bedrock کو سرور لیس، API پر مبنی، ملٹی فاؤنڈیشن ماڈل بلڈنگ بلاک کے طور پر استعمال کرتے ہیں۔ چونکہ ہم ایک ہی استعمال کے کیس کے اندر LLM کے متعدد دورے کرنے کا ارادہ رکھتے ہیں، ٹاسک کی قسم کی بنیاد پر، ہم اس ماڈل کا انتخاب کر سکتے ہیں جو کسی خاص کام کے لیے سب سے زیادہ موزوں ہو، چاہے وہ SQL جنریشن ہو، توثیق ہو یا خلاصہ ہو۔

لینگ چین

لینگ چین ایک اوپن سورس انٹیگریشن اور آرکیسٹریشن فریم ورک ہے جس میں پہلے سے تیار کردہ ماڈیولز (I/O، بازیافت، زنجیریں، اور ایجنٹس) کا ایک سیٹ ہے جسے آپ FMs، ڈیٹا کے ذرائع، اور ٹولز کے درمیان کاموں کو مربوط اور آرکیسٹریٹ کرنے کے لیے استعمال کر سکتے ہیں۔ فریم ورک جنریٹیو AI ایپلی کیشنز کی تعمیر میں سہولت فراہم کرتا ہے جس کے لیے مطلوبہ آؤٹ پٹ پیدا کرنے کے لیے متعدد مراحل کی آرکیسٹریٹنگ کی ضرورت ہوتی ہے، بغیر شروع سے کوڈ لکھے۔ LangChain ایمیزون بیڈرک کو ملٹی فاؤنڈیشن ماڈل API کے طور پر سپورٹ کرتا ہے۔

Q4 کے استعمال کے معاملے کے لیے مخصوص، ہم اپنے ورک فلو میں کاموں کو مربوط کرنے اور ترتیب دینے کے لیے LangChain کا استعمال کرتے ہیں، بشمول ڈیٹا کے ذرائع اور LLMs سے منسلک ہونا۔ اس نقطہ نظر نے ہمارے کوڈ کو آسان بنا دیا ہے کیونکہ ہم موجودہ LangChain ماڈیولز استعمال کر سکتے ہیں۔

ایس کیو ایل ڈیٹا بیس چین

ایس کیو ایل ڈیٹا بیس چین ایک LangChain سلسلہ ہے جسے langchain_experimental سے درآمد کیا جا سکتا ہے۔ SLDatabaseChain اپنے موثر ٹیکسٹ ٹو ایس کیو ایل تبادلوں اور نفاذ کا استعمال کرتے ہوئے ایس کیو ایل سوالات کو تخلیق، لاگو اور چلانا آسان بناتا ہے۔

ہمارے استعمال کے معاملے میں، ہم SQL جنریشن میں SQLDatabaseChain استعمال کرتے ہیں، ڈیٹا بیس اور LLM کے درمیان تعاملات کو آسان اور ترتیب دیتے ہیں۔

ڈیٹاسیٹ

ہمارا سٹرکچرڈ ڈیٹا سیٹ SQL ڈیٹا بیس، ڈیٹا لیک، یا ڈیٹا گودام میں رہ سکتا ہے جب تک کہ ہمارے پاس SQL کے لیے سپورٹ موجود ہو۔ ہمارے حل میں، ہم SQL سپورٹ کے ساتھ کسی بھی ڈیٹا سیٹ کی قسم کا استعمال کر سکتے ہیں۔ اسے حل سے الگ کیا جانا چاہئے اور کسی بھی طرح سے حل کو تبدیل نہیں کرنا چاہئے۔

نفاذ کی تفصیلات

اب جب کہ ہم نے حل کے نقطہ نظر، حل کے اجزاء، ٹیکنالوجی کا انتخاب، اور اوزار تلاش کر لیے ہیں، ہم ان ٹکڑوں کو ایک ساتھ رکھ سکتے ہیں۔ درج ذیل خاکہ آخر سے آخر تک حل کو نمایاں کرتا ہے۔

آئیے نفاذ کی تفصیلات اور عمل کے بہاؤ کے ذریعے چلتے ہیں۔

ایس کیو ایل استفسار بنائیں

کوڈنگ کو آسان بنانے کے لیے، ہم موجودہ فریم ورک استعمال کرتے ہیں۔ ہم LangChain کو آرکیسٹریشن فریم ورک کے طور پر استعمال کرتے ہیں۔ ہم ان پٹ مرحلے سے شروع کرتے ہیں، جہاں ہمیں صارف کا سوال قدرتی زبان میں موصول ہوتا ہے۔

اس پہلے مرحلے میں، ہم یہ ان پٹ لیتے ہیں اور ایک مساوی SQL تیار کرتے ہیں جسے ہم ڈیٹا بیس کے خلاف سیاق و سباق نکالنے کے لیے چلا سکتے ہیں۔ ایس کیو ایل بنانے کے لیے، ہم SQLDatabaseChain استعمال کرتے ہیں، جو ہمارے مطلوبہ LLM تک رسائی کے لیے Amazon Bedrock پر انحصار کرتا ہے۔ Amazon Bedrock کے ساتھ، ایک ہی API کا استعمال کرتے ہوئے، ہمیں متعدد بنیادی LLMs تک رسائی حاصل ہوتی ہے اور ہم اپنے ہر LLM سفر کے لیے صحیح انتخاب کر سکتے ہیں۔ ہم سب سے پہلے ڈیٹا بیس سے ایک کنکشن قائم کرتے ہیں اور مطلوبہ ٹیبل اسکیما کو بازیافت کرتے ہیں اور ساتھ ہی ان میزوں سے کچھ نمونے کی قطاریں جو ہم استعمال کرنا چاہتے ہیں۔

ہماری جانچ میں، ہم نے ٹیبل ڈیٹا کی 2-5 قطاریں بہت زیادہ غیر ضروری اوور ہیڈ شامل کیے بغیر ماڈل کو کافی معلومات دینے کے لیے کافی پائی ہیں۔ تین قطاریں سیاق و سباق فراہم کرنے کے لیے کافی تھیں، ماڈل کو بہت زیادہ ان پٹ کے ساتھ مغلوب کیے بغیر۔ ہمارے استعمال کے معاملے میں، ہم نے Anthropic سے آغاز کیا۔ کلاڈ V2. ماڈل اپنی جدید استدلال کے لیے جانا جاتا ہے اور صحیح سیاق و سباق اور ہدایات کے ساتھ فراہم کردہ سیاق و سباق کے جوابات کو واضح کرتا ہے۔ ہدایات کے حصے کے طور پر، ہم LLM میں مزید واضح کرنے والی تفصیلات شامل کر سکتے ہیں۔ مثال کے طور پر ہم اس کالم کو بیان کر سکتے ہیں۔ Comp_NAME کمپنی کے نام کا مطلب ہے۔ اب ہم صارف کے سوال کو ملا کر پرامپٹ بنا سکتے ہیں جیسا کہ ہے، ڈیٹا بیس اسکیما، ٹیبل سے تین نمونے کی قطاریں جنہیں ہم استعمال کرنا چاہتے ہیں، اور مطلوبہ SQL کو بغیر تبصروں یا اضافے کے کلین SQL فارمیٹ میں تیار کرنے کے لیے ہدایات کا ایک سیٹ۔

تمام ان پٹ عناصر کو ملا کر ماڈل ان پٹ پرامپٹ سمجھا جاتا ہے۔ ایک اچھی طرح سے انجنیئرڈ ان پٹ پرامپٹ جو ماڈل کے ترجیحی نحو کے مطابق بنایا گیا ہے، آؤٹ پٹ کے معیار اور کارکردگی دونوں پر بہت زیادہ اثر ڈالتا ہے۔ کسی مخصوص کام کے لیے استعمال کرنے کے لیے ماڈل کا انتخاب بھی اہم ہے، نہ صرف اس لیے کہ یہ آؤٹ پٹ کوالٹی کو متاثر کرتا ہے، بلکہ اس لیے بھی کہ اس کی لاگت اور کارکردگی کے مضمرات ہیں۔

ہم بعد میں اس پوسٹ میں ماڈل کے انتخاب اور فوری انجینئرنگ اور اصلاح پر تبادلہ خیال کرتے ہیں، لیکن یہ بات قابل غور ہے کہ استفسار کے مرحلے کے لیے، ہم نے دیکھا کہ Claude Instant موازنہ کے نتائج پیدا کرنے کے قابل تھا، خاص طور پر جب صارف کا سوال اچھی طرح سے بیان کیا گیا ہو اور اتنا نفیس نہیں۔ تاہم، Claude V2 نے زیادہ پیچیدہ اور بالواسطہ صارف ان پٹ کے ساتھ بھی بہتر نتائج پیدا کیے۔ ہم نے سیکھا ہے کہ اگرچہ کچھ معاملات میں کلاڈ انسٹنٹ ایک بہتر تاخیر اور قیمت کے نقطہ پر کافی درستگی فراہم کر سکتا ہے، ہمارے استفسار کی تیاری کا معاملہ Claude V2 کے لیے بہتر تھا۔

SQL استفسار کی تصدیق کریں۔

ہمارا اگلا مرحلہ اس بات کی تصدیق کرنا ہے کہ LLM نے صحیح استفسار کا نحو تیار کیا ہے اور یہ کہ ڈیٹا بیس اسکیموں اور فراہم کردہ مثال کی قطاروں پر غور کرتے ہوئے استفسار سیاق و سباق کو سمجھتا ہے۔ تصدیق کے اس مرحلے کے لیے، ہم SQLDatabaseChain کے اندر مقامی استفسار کی توثیق پر واپس جا سکتے ہیں، یا ہم LLM کا دوسرا سفر چلا سکتے ہیں جس میں توثیق کی ہدایات کے ساتھ پیدا کردہ استفسار بھی شامل ہے۔

اگر ہم توثیق کے مرحلے کے لیے LLM استعمال کرتے ہیں، تو ہم پہلے جیسا LLM استعمال کر سکتے ہیں (Claude V2) یا ایک چھوٹا، زیادہ پرفارمنس والا LLM کسی آسان کام کے لیے، جیسے Claude Instant۔ چونکہ ہم Amazon Bedrock استعمال کر رہے ہیں، یہ ایک بہت ہی آسان ایڈجسٹمنٹ ہونی چاہیے۔ اسی API کا استعمال کرتے ہوئے، ہم اپنی API کال میں ماڈل کا نام تبدیل کر سکتے ہیں، جو تبدیلی کا خیال رکھتا ہے۔ یہ نوٹ کرنا ضروری ہے کہ زیادہ تر معاملات میں، ایک چھوٹا LLM لاگت اور تاخیر دونوں میں بہتر کارکردگی فراہم کر سکتا ہے اور اس پر غور کیا جانا چاہیے- جب تک کہ آپ کو مطلوبہ درستگی مل رہی ہو۔ ہمارے معاملے میں، جانچ نے ثابت کیا کہ پیدا کردہ استفسار مستقل طور پر درست اور صحیح نحو کے ساتھ ہے۔ یہ جانتے ہوئے، ہم توثیق کے اس مرحلے کو چھوڑنے اور تاخیر اور لاگت کو بچانے کے قابل تھے۔

ایس کیو ایل استفسار چلائیں۔

اب جب کہ ہمارے پاس تصدیق شدہ SQL استفسار ہے، ہم ڈیٹا بیس کے خلاف SQL استفسار چلا سکتے ہیں اور متعلقہ سیاق و سباق کو بازیافت کر سکتے ہیں۔ یہ ایک سیدھا سا قدم ہونا چاہیے۔

ہم تیار کردہ سیاق و سباق لیتے ہیں، اسے صارف کے ابتدائی سوال اور کچھ ہدایات کے ساتھ اپنی پسند کے LLM کو فراہم کرتے ہیں، اور ماڈل سے سیاق و سباق اور واضح خلاصہ تیار کرنے کو کہتے ہیں۔ اس کے بعد ہم صارف کے سامنے ابتدائی سوال کے جواب کے طور پر تیار کردہ خلاصہ پیش کرتے ہیں، یہ سب ہمارے ڈیٹاسیٹ سے نکالے گئے سیاق و سباق کے ساتھ منسلک ہیں۔

خلاصہ کے مرحلے میں شامل LLM کے لیے، ہم یا تو Titan Text Express یا Claude Instant استعمال کر سکتے ہیں۔ وہ دونوں خلاصہ کے کام کے لیے اچھے اختیارات پیش کریں گے۔

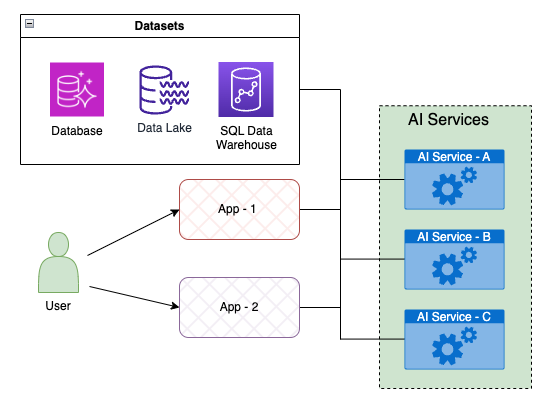

ایپلیکیشن انضمام

Q&A چیٹ بوٹ کی اہلیت Q4 کی AI خدمات میں سے ایک ہے۔ ماڈیولریٹی اور اسکیل ایبلٹی کو یقینی بنانے کے لیے، Q4 AI سروسز کو مائیکرو سروسز بناتا ہے جو APIs کے ذریعے Q4 ایپلی کیشنز تک قابل رسائی ہیں۔ یہ API پر مبنی نقطہ نظر Q4 پلیٹ فارم ماحولیاتی نظام کے ساتھ ہموار انضمام کو قابل بناتا ہے اور AI خدمات کی صلاحیتوں کو پلیٹ فارم ایپلی کیشنز کے مکمل سوٹ کے سامنے لانے میں سہولت فراہم کرتا ہے۔

AI خدمات کا بنیادی مقصد قدرتی زبان کو بطور ان پٹ استعمال کرتے ہوئے کسی بھی عوامی یا ملکیتی ڈیٹا سورس سے ڈیٹا کی بازیافت کے لیے سیدھی سیدھی صلاحیتیں فراہم کرنا ہے۔ اس کے علاوہ، AI سروسز تجرید کی اضافی تہیں فراہم کرتی ہیں تاکہ یہ یقینی بنایا جا سکے کہ فنکشنل اور غیر فنکشنل تقاضے، جیسے ڈیٹا پرائیویسی اور سیکیورٹی کو پورا کیا جاتا ہے۔ درج ذیل خاکہ انضمام کے تصور کو ظاہر کرتا ہے۔

نفاذ کے چیلنجز

ساختی، عددی ڈیٹاسیٹ کی نوعیت کی طرف سے پیش کردہ چیلنجوں کے علاوہ جن پر ہم نے پہلے بات کی تھی، Q4 کو نفاذ کے کئی دوسرے چیلنجوں کا سامنا تھا جن کو حل کرنے کی ضرورت تھی۔

ایل ایل ایم کا انتخاب اور کارکردگی

کام کے لیے صحیح LLM کا انتخاب بہت اہم ہے کیونکہ یہ براہ راست آؤٹ پٹ کے معیار کے ساتھ ساتھ کارکردگی (راؤنڈ ٹرپ لیٹنسی) کو متاثر کرتا ہے۔ یہاں کچھ عوامل ہیں جو ایل ایل ایم کے انتخاب کے عمل میں کردار ادا کرتے ہیں:

- ایل ایل ایم کی قسم - جس طرح سے FMs کی تعمیر کی جاتی ہے اور ابتدائی ڈیٹا جس پر ماڈل کو پہلے سے تربیت دی گئی ہے اس سے یہ طے ہوتا ہے کہ LLM کس قسم کے کاموں میں اچھے ہوں گے اور یہ کتنے اچھے ہوں گے۔ مثال کے طور پر، ٹیکسٹ ایل ایل ایم ٹیکسٹ جنریشن اور سمریائزیشن میں اچھا ہوگا، جبکہ ٹیکسٹ ٹو امیج یا امیج ٹو ٹیکسٹ ماڈل امیج اینالیٹکس اور جنریشن کے کاموں کے لیے زیادہ تیار ہوگا۔

- ایل ایل ایم سائز - FM سائز کی پیمائش کسی خاص ماڈل کے ماڈل پیرامیٹرز کی تعداد سے کی جاتی ہے، عام طور پر جدید LLMs کے لیے اربوں میں۔ عام طور پر، ماڈل جتنا بڑا ہوگا، ابتدائی طور پر تربیت یا بعد میں ٹھیک ٹیون کرنا اتنا ہی مہنگا ہوگا۔ دوسری طرف، عام طور پر، ایک ہی ماڈل کے فن تعمیر کے لیے، ماڈل جتنا بڑا ہوتا ہے، ہم اس سے اس قسم کے کام کو انجام دینے میں زیادہ ہوشیار ہونے کی توقع رکھتے ہیں جس کی طرف اسے تیار کیا گیا ہے۔

- ایل ایل ایم کی کارکردگی - عام طور پر، ماڈل جتنا بڑا ہوگا، آؤٹ پٹ پیدا کرنے میں اتنا ہی زیادہ وقت لگتا ہے، یہ فرض کرتے ہوئے کہ آپ ایک ہی کمپیوٹ اور I/O پیرامیٹرز (پرامپٹ اور آؤٹ پٹ سائز) استعمال کر رہے ہیں۔ اس کے علاوہ، اسی ماڈل کے سائز کے لیے، کارکردگی آپ کے پرامپٹ کے کس حد تک بہتر ہے، I/O ٹوکنز کا سائز، اور پرامپٹ کی وضاحت اور نحو سے بہت زیادہ متاثر ہوتی ہے۔ ایک اچھی طرح سے انجینئرڈ پرامپٹ، ایک بہتر I/O ٹوکن سائز کے ساتھ، ماڈل کے جوابی وقت کو بہتر بنا سکتا ہے۔

لہذا، اپنے کام کو بہتر بناتے وقت، درج ذیل بہترین طریقوں پر غور کریں:

- ایک ایسا ماڈل منتخب کریں جو ہاتھ میں کام کے لیے موزوں ہو۔

- سب سے چھوٹا ماڈل کا سائز منتخب کریں جو آپ کی تلاش میں درستگی پیدا کر سکے۔

- اپنے فوری ڈھانچے کو بہتر بنائیں اور ہدایات کے ساتھ ہر ممکن حد تک مخصوص رہیں جس طرح ماڈل کو سمجھنا آسان ہو۔

- سب سے چھوٹا ان پٹ پرامپٹ استعمال کریں جو آپ جس درستگی کی سطح کو تلاش کر رہے ہیں اسے پیدا کرنے کے لیے کافی ہدایات اور سیاق و سباق فراہم کر سکے۔

- آؤٹ پٹ سائز کو سب سے چھوٹے سائز تک محدود کریں جو آپ کے لیے معنی خیز ہو اور آپ کے آؤٹ پٹ کی ضروریات کو پورا کر سکے۔

ماڈل کے انتخاب اور کارکردگی کو بہتر بنانے کے عوامل کو مدنظر رکھتے ہوئے، ہم اپنے SQL جنریشن کے استعمال کے معاملے کو بہتر بنانے کے لیے کام کرنے لگے۔ کچھ جانچ کے بعد، ہم نے دیکھا کہ، بشرطیکہ ہمارے پاس صحیح سیاق و سباق اور ہدایات ہوں، اسی پرامپٹ ڈیٹا کے ساتھ، Claude Instant، بہت بہتر کارکردگی اور قیمت کے نقطہ پر Claude V2 کی طرح SQL کا موازنہ معیار پیدا کرے گا۔ یہ اس وقت درست ثابت ہوتا ہے جب صارف کا ان پٹ فطرت میں زیادہ سیدھا اور آسان ہوتا ہے۔ مزید نفیس ان پٹ کے لیے، Claude V2 مطلوبہ درستگی پیدا کرنے کے لیے ضروری تھا۔

خلاصہ کے کام پر اسی منطق کو لاگو کرنے سے ہم اس نتیجے پر پہنچے کہ Claude Instant یا Titan Text Express کا استعمال اس سے کہیں بہتر کارکردگی کے مقام پر درکار درستگی پیدا کرے گا اگر ہم Claude V2 جیسے بڑے ماڈل کا استعمال کریں۔ Titan Text Expressed نے بھی قیمت کی بہتر کارکردگی کی پیشکش کی، جیسا کہ ہم نے پہلے بات کی تھی۔

آرکیسٹریشن چیلنج

ہم نے محسوس کیا کہ اس سے پہلے کہ ہم صارف کے سوال کے لیے بامعنی آؤٹ پٹ جواب حاصل کر سکیں آرکیسٹریٹ کرنے کے لیے بہت کچھ ہے۔ جیسا کہ حل کے جائزہ میں دکھایا گیا ہے، اس عمل میں متعدد ڈیٹا بیس ٹرپس اور متعدد LLM ٹرپس شامل ہیں جو آپس میں جڑے ہوئے ہیں۔ اگر ہم شروع سے تعمیر کرتے، تو ہمیں بنیادی کوڈ تیار کرنے کے لیے غیر متفاوت ہیوی لفٹنگ میں ایک اہم سرمایہ کاری کرنی پڑتی۔ ہم نے فوری طور پر LangChain کو ایک آرکیسٹریشن فریم ورک کے طور پر استعمال کرنے، اوپن سورس کمیونٹی کی طاقت کا فائدہ اٹھاتے ہوئے، اور پہیے کو دوبارہ ایجاد کیے بغیر موجودہ ماڈیولز کو دوبارہ استعمال کرنے پر زور دیا۔

ایس کیو ایل چیلنج

ہم نے یہ بھی محسوس کیا کہ ایس کیو ایل بنانا اتنا آسان نہیں ہے جتنا سیمینٹک تلاش یا ایمبیڈنگز کا استعمال کرتے ہوئے سیاق و سباق نکالنے کے طریقہ کار۔ ہمیں پہلے ڈیٹا بیس اسکیما اور کچھ نمونے کی قطاریں حاصل کرنے کی ضرورت ہے تاکہ LLM کے اپنے پرامپٹ میں شامل کیا جا سکے۔ ایس کیو ایل کی توثیق کا مرحلہ بھی ہے، جہاں ہمیں ڈیٹا بیس اور ایل ایل ایم دونوں کے ساتھ بات چیت کرنے کی ضرورت ہے۔ SQLDatabaseChain ٹول کا واضح انتخاب تھا۔ چونکہ یہ LangChain کا حصہ ہے، اس کو اپنانا سیدھا سیدھا تھا، اور اب ہم سلسلہ کی مدد سے SQL جنریشن اور تصدیق کا انتظام کر سکتے ہیں، جس سے ہمیں کام کی مقدار کو کم سے کم کرنے کی ضرورت ہے۔

کارکردگی کے چیلنجز

Claude V2 کے استعمال کے ساتھ، اور مناسب فوری انجینئرنگ کے بعد (جس پر ہم اگلے حصے میں بحث کریں گے)، ہم اعلیٰ معیار کا SQL تیار کرنے کے قابل ہو گئے۔ ایس کیو ایل کے تیار کردہ معیار پر غور کرتے ہوئے، ہم نے یہ دیکھنا شروع کیا کہ توثیق کا مرحلہ درحقیقت کتنی قدر میں اضافہ کر رہا ہے۔ نتائج کا مزید تجزیہ کرنے کے بعد، یہ واضح ہو گیا کہ ایس کیو ایل کا معیار اس طرح سے مستقل طور پر درست تھا جس نے ایس کیو ایل کی توثیق کے مرحلے کو شامل کرنے کی لاگت/فائدہ کو ناگوار بنا دیا۔ ہم نے اپنے آؤٹ پٹ کے معیار پر منفی اثر ڈالے بغیر ایس کیو ایل کی توثیق کے مرحلے کو ختم کر دیا اور ایس کیو ایل کی توثیق کے راؤنڈ ٹرپ ٹائم کو ختم کر دیا۔

خلاصہ کے مرحلے کے لیے زیادہ لاگت اور کارکردگی کے لحاظ سے موثر LLM کو بہتر بنانے کے علاوہ، ہم بہتر کارکردگی اور لاگت کی کارکردگی حاصل کرنے کے لیے Titan Text Express کا استعمال کرنے کے قابل تھے۔

مزید کارکردگی کی اصلاح میں موثر پرامپٹ انجینئرنگ تکنیکوں کا استعمال کرتے ہوئے استفسار پیدا کرنے کے عمل کو ٹھیک کرنا شامل ہے۔ ٹوکن کی کثرت فراہم کرنے کے بجائے، توجہ ان پٹ ٹوکن کی کم سے کم مقدار فراہم کرنے پر تھی، صحیح نحو میں جسے سمجھنے کے لیے ماڈل کو تربیت دی گئی ہے، اور ہدایات کے کم سے کم لیکن بہترین سیٹ کے ساتھ۔ ہم اگلے حصے میں اس پر مزید بحث کریں گے—یہ ایک اہم موضوع ہے جو نہ صرف یہاں پر لاگو ہوتا ہے بلکہ استعمال کے دیگر معاملات میں بھی۔

فوری انجینئرنگ اور اصلاح

آپ Amazon Bedrock پر کلاڈ کو مختلف کاروباری استعمال کے معاملات کے لیے ایڈجسٹ کر سکتے ہیں اگر صحیح فوری انجینئرنگ تکنیکوں کو استعمال کیا جائے۔ Claude بنیادی طور پر بات چیت کے معاون کے طور پر کام کرتا ہے جو انسانی/اسسٹنٹ فارمیٹ کو استعمال کرتا ہے۔ کلاڈ کو معاون کردار کے لیے متن بھرنے کی تربیت دی جاتی ہے۔ مطلوبہ ہدایات اور فوری تکمیل کو دیکھتے ہوئے، ہم کئی تکنیکوں کا استعمال کرتے ہوئے کلاڈ کے لیے اپنے اشارے کو بہتر بنا سکتے ہیں۔

ہم ایک مناسب فارمیٹ شدہ پرامپٹ ٹیمپلیٹ کے ساتھ شروع کرتے ہیں جو ایک درست تکمیل فراہم کرتا ہے، پھر ہم ان پٹس کے مختلف سیٹوں کے ساتھ استعمال کرتے ہوئے جوابات کو مزید بہتر بنا سکتے ہیں جو حقیقی دنیا کے ڈیٹا کے نمائندہ ہیں۔ پرامپٹ ٹیمپلیٹ تیار کرتے وقت بہت سے ان پٹ حاصل کرنے کی سفارش کی جاتی ہے۔ آپ پرامپٹ ڈویلپمنٹ ڈیٹا اور ٹیسٹ ڈیٹا کے علیحدہ سیٹ بھی استعمال کر سکتے ہیں۔

Claude کے جواب کو بہتر بنانے کا ایک اور طریقہ یہ ہے کہ قواعد، ہدایات، اور شامل کرکے تجربہ اور اعادہ کریں۔ مفید اصلاحات. ان اصلاحوں سے، آپ مختلف قسم کی تکمیلات دیکھ سکتے ہیں، مثال کے طور پر، کلاؤڈ کو فریب کو روکنے کے لیے "مجھے نہیں معلوم" کا ذکر کرنا، قدم بہ قدم سوچنا، فوری سلسلہ بندی کا استعمال کرنا، "سوچنے" کے لیے جگہ دینا کیونکہ یہ ردعمل پیدا کرتا ہے۔ ، اور فہم اور درستگی کے لیے ڈبل چیکنگ۔

آئیے اپنا استفسار پیدا کرنے کے کام کو استعمال کریں اور کچھ تکنیکوں پر تبادلہ خیال کریں جو ہم نے اپنے پرامپٹ کو بہتر بنانے کے لیے استعمال کیے تھے۔ کچھ بنیادی عناصر تھے جنہوں نے ہماری استفسار کی کوششوں کو فائدہ پہنچایا:

- مناسب انسانی/اسسٹنٹ نحو کا استعمال

- XML ٹیگز کا استعمال (کلاڈ XML ٹیگز کا احترام اور سمجھتا ہے)

- فریب کو روکنے کے لیے ماڈل کے لیے واضح ہدایات شامل کرنا

درج ذیل عام مثال سے پتہ چلتا ہے کہ ہم نے کس طرح انسانی/اسسٹنٹ نحو کا استعمال کیا، XML ٹیگز کا اطلاق کیا، اور آؤٹ پٹ کو SQL تک محدود کرنے کے لیے ہدایات شامل کیں اور ماڈل کو "معذرت، میں مدد کرنے سے قاصر ہوں" کہنے کی ہدایت کی اگر یہ متعلقہ SQL پیدا نہیں کر سکتا۔ . XML ٹیگز کو ہدایات، اضافی اشارے، ڈیٹا بیس اسکیما، اضافی ٹیبل کی وضاحت، اور مثال کی قطاروں کو فریم کرنے کے لیے استعمال کیا گیا تھا۔

حتمی کام کرنے کا حل

تصور کے ثبوت کے دوران شناخت کیے گئے تمام چیلنجوں سے نمٹنے کے بعد، ہم نے حل کے تمام تقاضے پورے کر لیے تھے۔ Q4 LLM کے ذریعہ تیار کردہ SQL کے معیار سے مطمئن تھا۔ یہ ان سادہ کاموں کے لیے درست ہے جن کے لیے ڈیٹا کو فلٹر کرنے کے لیے صرف ایک WHERE شق کی ضرورت ہوتی ہے، اور مزید پیچیدہ کاموں کے لیے جن کے لیے GROUP BY اور ریاضیاتی افعال کے ساتھ سیاق و سباق پر مبنی جمع کی ضرورت ہوتی ہے۔ مجموعی حل کی آخر سے آخر میں تاخیر اس کے اندر آئی جسے استعمال کے معاملے کے لیے قابل قبول قرار دیا گیا تھا—سنگل ہندسوں کے سیکنڈ۔ یہ سب کچھ ہر مرحلے پر ایک بہترین LLM کے انتخاب، مناسب فوری انجینئرنگ، SQL تصدیقی مرحلے کو ختم کرنے، اور خلاصہ کے مرحلے (Titan Text Express یا Claude Instant) کے لیے ایک موثر LLM استعمال کرنے کی بدولت تھا۔

یہ بات قابل غور ہے کہ Amazon Bedrock کو ایک مکمل طور پر منظم سروس کے طور پر استعمال کرنا اور اسی API کے ذریعے LLMs کے سوٹ تک رسائی حاصل کرنے کی صلاحیت کو تجربہ کرنے اور LLMs کے درمیان API کال میں ماڈل کا نام تبدیل کرکے ہموار سوئچنگ کی اجازت ہے۔ لچک کی اس سطح کے ساتھ، Q4 کام کی نوعیت کی بنیاد پر ہر LLM کال کے لیے سب سے زیادہ کارکردگی کا مظاہرہ کرنے والے LLM کا انتخاب کرنے میں کامیاب رہا، چاہے وہ استفسار ہو، تصدیق ہو یا خلاصہ ہو۔

نتیجہ

ایسا کوئی حل نہیں ہے جو استعمال کے تمام معاملات میں فٹ بیٹھتا ہو۔ RAG اپروچ میں، آؤٹ پٹ کے معیار کا زیادہ تر انحصار صحیح سیاق و سباق فراہم کرنے پر ہوتا ہے۔ صحیح سیاق و سباق کو نکالنا کلید ہے، اور ہر ڈیٹاسیٹ اپنی منفرد خصوصیات کے ساتھ مختلف ہے۔

اس پوسٹ میں، ہم نے یہ ظاہر کیا کہ عددی اور ساختی ڈیٹاسیٹس کے لیے، ایس کیو ایل کو بڑھانے کے لیے استعمال ہونے والے سیاق و سباق کو نکالنے کے لیے استعمال کرنے سے زیادہ سازگار نتائج حاصل ہو سکتے ہیں۔ ہم نے یہ بھی ظاہر کیا کہ LangChain جیسے فریم ورک کوڈنگ کی کوشش کو کم سے کم کر سکتے ہیں۔ مزید برآں، ہم نے زیادہ سے زیادہ درستگی، کارکردگی، اور لاگت حاصل کرنے کے لیے ایک ہی استعمال کے معاملے میں LLMs کے درمیان سوئچ کرنے کے قابل ہونے کی ضرورت پر تبادلہ خیال کیا۔ آخر میں، ہم نے اس بات پر روشنی ڈالی کہ کس طرح Amazon Bedrock، سرور کے بغیر اور مختلف قسم کے LLMs کے ساتھ، کم سے کم بھاری لفٹنگ کے ساتھ محفوظ، پرفارمنٹ، اور لاگت کے لحاظ سے بہتر ایپلی کیشنز بنانے کے لیے درکار لچک فراہم کرتا ہے۔

اپنے کاروبار کے لیے قابل قدر استعمال کے معاملے کی نشاندہی کر کے تخلیقی AI سے چلنے والی ایپلی کیشنز کی تعمیر کی طرف اپنا سفر شروع کریں۔ SQL جنریشن، جیسا کہ Q4 ٹیم نے سیکھا، سمارٹ ایپلی کیشنز بنانے میں گیم چینجر ثابت ہو سکتا ہے جو آپ کے ڈیٹا اسٹورز کے ساتھ مربوط ہو کر آمدنی کی صلاحیت کو غیر مقفل کرتی ہے۔

مصنفین کے بارے میں

تیمر سلیمان AWS میں ایک سینئر سولیوشن آرکیٹیکٹ ہے۔ وہ آزاد سافٹ ویئر وینڈر (ISV) کے صارفین کو AWS پر اختراعات، تعمیر اور پیمانے میں مدد کرتا ہے۔ انہیں مشاورت، تربیت اور پیشہ ورانہ خدمات میں صنعت کا دو دہائیوں سے زیادہ کا تجربہ ہے۔ وہ ایک ملٹی پیٹنٹ موجد ہے جس کے پاس تین پیٹنٹ ہیں اور ان کا تجربہ ٹیلی کام، نیٹ ورکنگ، ایپلیکیشن انٹیگریشن، AI/ML، اور کلاؤڈ تعیناتیوں سمیت متعدد ٹیکنالوجی ڈومینز پر محیط ہے۔ وہ AWS نیٹ ورکنگ میں مہارت رکھتا ہے اور مشین جھکاؤ، AI، اور جنریٹو AI کے لیے گہرا جنون رکھتا ہے۔

تیمر سلیمان AWS میں ایک سینئر سولیوشن آرکیٹیکٹ ہے۔ وہ آزاد سافٹ ویئر وینڈر (ISV) کے صارفین کو AWS پر اختراعات، تعمیر اور پیمانے میں مدد کرتا ہے۔ انہیں مشاورت، تربیت اور پیشہ ورانہ خدمات میں صنعت کا دو دہائیوں سے زیادہ کا تجربہ ہے۔ وہ ایک ملٹی پیٹنٹ موجد ہے جس کے پاس تین پیٹنٹ ہیں اور ان کا تجربہ ٹیلی کام، نیٹ ورکنگ، ایپلیکیشن انٹیگریشن، AI/ML، اور کلاؤڈ تعیناتیوں سمیت متعدد ٹیکنالوجی ڈومینز پر محیط ہے۔ وہ AWS نیٹ ورکنگ میں مہارت رکھتا ہے اور مشین جھکاؤ، AI، اور جنریٹو AI کے لیے گہرا جنون رکھتا ہے۔

مانی خانوجا ایک ٹیک لیڈ - جنریٹو AI ماہرین، کتاب کی مصنفہ - AWS پر اپلائیڈ مشین لرننگ اور ہائی پرفارمنس کمپیوٹنگ، اور مینوفیکچرنگ ایجوکیشن فاؤنڈیشن بورڈ میں خواتین کے لیے بورڈ آف ڈائریکٹرز کی رکن ہیں۔ وہ مختلف ڈومینز جیسے کمپیوٹر ویژن، نیچرل لینگویج پروسیسنگ اور جنریٹیو AI میں مشین لرننگ (ML) پروجیکٹس کی رہنمائی کرتی ہیں۔ وہ بڑے پیمانے پر مشین لرننگ ماڈل بنانے، تربیت دینے اور تعینات کرنے میں صارفین کی مدد کرتی ہے۔ وہ اندرونی اور بیرونی کانفرنسوں میں بولتی ہیں جیسے کہ: ایجاد، ویمن ان مینوفیکچرنگ ویسٹ، یوٹیوب ویبینرز اور جی ایچ سی 23۔ اپنے فارغ وقت میں، وہ ساحل سمندر پر لمبی دوڑنا پسند کرتی ہے۔

مانی خانوجا ایک ٹیک لیڈ - جنریٹو AI ماہرین، کتاب کی مصنفہ - AWS پر اپلائیڈ مشین لرننگ اور ہائی پرفارمنس کمپیوٹنگ، اور مینوفیکچرنگ ایجوکیشن فاؤنڈیشن بورڈ میں خواتین کے لیے بورڈ آف ڈائریکٹرز کی رکن ہیں۔ وہ مختلف ڈومینز جیسے کمپیوٹر ویژن، نیچرل لینگویج پروسیسنگ اور جنریٹیو AI میں مشین لرننگ (ML) پروجیکٹس کی رہنمائی کرتی ہیں۔ وہ بڑے پیمانے پر مشین لرننگ ماڈل بنانے، تربیت دینے اور تعینات کرنے میں صارفین کی مدد کرتی ہے۔ وہ اندرونی اور بیرونی کانفرنسوں میں بولتی ہیں جیسے کہ: ایجاد، ویمن ان مینوفیکچرنگ ویسٹ، یوٹیوب ویبینرز اور جی ایچ سی 23۔ اپنے فارغ وقت میں، وہ ساحل سمندر پر لمبی دوڑنا پسند کرتی ہے۔

اسٹینسلاو یشچینکو Q4 Inc. میں ایک سافٹ ویئر آرکیٹیکٹ ہے۔ اسے سافٹ ویئر ڈویلپمنٹ اور سسٹم آرکیٹیکچر میں صنعت کا ایک دہائی سے زیادہ کا تجربہ ہے۔ ٹیکنیکل لیڈ اور سینئر فل اسٹیک ڈیولپر جیسے اس کے متنوع پس منظر پر پھیلے ہوئے کردار، Q4 پلیٹ فارم کی جدت کو آگے بڑھانے میں ان کے تعاون کو طاقت دیتے ہیں۔ Stanislav تکنیکی جدت کو چلانے اور میدان میں اسٹریٹجک حل کی تشکیل کے لیے وقف ہے۔

اسٹینسلاو یشچینکو Q4 Inc. میں ایک سافٹ ویئر آرکیٹیکٹ ہے۔ اسے سافٹ ویئر ڈویلپمنٹ اور سسٹم آرکیٹیکچر میں صنعت کا ایک دہائی سے زیادہ کا تجربہ ہے۔ ٹیکنیکل لیڈ اور سینئر فل اسٹیک ڈیولپر جیسے اس کے متنوع پس منظر پر پھیلے ہوئے کردار، Q4 پلیٹ فارم کی جدت کو آگے بڑھانے میں ان کے تعاون کو طاقت دیتے ہیں۔ Stanislav تکنیکی جدت کو چلانے اور میدان میں اسٹریٹجک حل کی تشکیل کے لیے وقف ہے۔

- SEO سے چلنے والا مواد اور PR کی تقسیم۔ آج ہی بڑھا دیں۔

- پلیٹو ڈیٹا ڈاٹ نیٹ ورک ورٹیکل جنریٹو اے آئی۔ اپنے آپ کو بااختیار بنائیں۔ یہاں تک رسائی حاصل کریں۔

- پلیٹوآئ اسٹریم۔ ویب 3 انٹیلی جنس۔ علم میں اضافہ۔ یہاں تک رسائی حاصل کریں۔

- پلیٹو ای ایس جی۔ کاربن، کلین ٹیک، توانائی ، ماحولیات، شمسی، ویسٹ مینجمنٹ یہاں تک رسائی حاصل کریں۔

- پلیٹو ہیلتھ۔ بائیوٹیک اینڈ کلینیکل ٹرائلز انٹیلی جنس۔ یہاں تک رسائی حاصل کریں۔

- ماخذ: https://aws.amazon.com/blogs/machine-learning/how-q4-inc-used-amazon-bedrock-rag-and-sqldatabasechain-to-address-numerical-and-structured-dataset-challenges-building-their-qa-chatbot/

- : ہے

- : ہے

- : نہیں

- :کہاں

- $UP

- 100

- 118

- 125

- 15٪

- 23

- 7

- a

- صلاحیتوں

- کی صلاحیت

- قابلیت

- تجری

- کثرت

- قابل قبول

- تک رسائی حاصل

- قابل رسائی

- اکاؤنٹ

- درستگی

- درست

- حاصل

- کے پار

- کام کرتا ہے

- اصل میں

- اپنانے

- شامل کیا

- انہوں نے مزید کہا

- اس کے علاوہ

- ایڈیشنل

- اس کے علاوہ

- اضافے

- پتہ

- خطاب کیا

- ایڈجسٹمنٹ

- اعلی درجے کی

- پیش قدمی کرنا

- فائدہ

- کے بعد

- کے خلاف

- ایجنٹ

- مجموعی

- AI

- AI خدمات

- AI استعمال کے معاملات

- AI / ML

- مقصد

- سیدھ کریں

- منسلک

- تمام

- کی اجازت

- کی اجازت

- ساتھ

- بھی

- اگرچہ

- am

- ایمیزون

- ایمیزون ویب سروسز

- رقم

- مقدار

- an

- تجزیہ

- تجزیہ کار کہتے ہیں

- تجزیاتی

- تجزیے

- تجزیہ

- اور

- ایک اور

- جواب

- جواب

- بشری

- کوئی بھی

- کچھ

- اے پی آئی

- APIs

- قابل اطلاق

- درخواست

- ایپلی کیشنز

- اطلاقی

- نقطہ نظر

- فن تعمیر

- کیا

- AS

- پوچھنا

- اثاثے

- اسسٹنٹ

- مدد

- درجہ بندی

- At

- اضافہ

- اضافہ

- مصنف

- دستیاب

- آگاہ

- AWS

- واپس

- پس منظر

- کی بنیاد پر

- بنیادی

- BE

- بیچ

- بن گیا

- کیونکہ

- رہا

- اس سے پہلے

- شروع

- رویے

- کیا جا رہا ہے

- خیال کیا

- فائدہ مند

- BEST

- بہترین طریقوں

- بہتر

- کے درمیان

- اربوں

- بلاک

- بلاکس

- بورڈ

- بورڈ آف ڈائریکٹرز

- کتاب

- بوٹ

- دونوں

- چوڑائی

- توڑ

- وسیع

- تعمیر

- عمارت

- بناتا ہے

- تعمیر

- کاروبار

- لیکن

- by

- فون

- آیا

- کر سکتے ہیں

- حاصل کر سکتے ہیں

- صلاحیتوں

- صلاحیت

- دارالحکومت

- کیپٹل مارکیٹس

- پرواہ

- کیس

- مقدمات

- چین

- زنجیروں

- چیلنج

- چیلنجوں

- عمارت کو چیلنج کرتا ہے۔

- تبدیل

- مبدل

- تبدیل کرنے

- خصوصیات

- چیٹ بٹ

- چیٹ بٹس

- انتخاب

- میں سے انتخاب کریں

- منتخب کریں

- وضاحت

- صاف

- واضح

- قریب

- بادل

- کوڈ

- کوڈنگ

- کالم

- مل کر

- امتزاج

- کس طرح

- تبصروں

- تجارتی طور پر

- ابلاغ

- مواصلات

- کمیونٹی

- کمپنیاں

- کمپنی کے

- موازنہ

- تکمیل

- پیچیدہ

- پیچیدگی

- تعمیل

- اجزاء

- سمجھو

- کمپیوٹنگ

- کمپیوٹر

- کمپیوٹر ویژن

- کمپیوٹنگ

- تصور

- نتیجہ اخذ

- یہ نتیجہ اخذ کیا

- اختتام

- منعقد

- کانفرنسوں

- رابطہ قائم کریں

- مربوط

- کنکشن

- غور کریں

- سمجھا

- پر غور

- مسلسل

- پر مشتمل ہے

- مشتمل

- تعمیر

- مشاورت

- مواد

- سیاق و سباق

- متعلقہ

- جاری

- مسلسل

- شراکت دار

- روایتی

- سنوادی

- تبادلوں

- تبدیل

- ہم آہنگی

- کور

- درست

- قیمت

- سکتا ہے

- تخلیق

- اہم

- CRM

- اہم

- گاہک

- گاہکوں

- روزانہ

- اعداد و شمار

- ڈیٹا لیک

- ڈیٹا پوائنٹس

- ڈیٹا کی رازداری

- ڈیٹا پرائیویسی اور سیکیورٹی

- ڈیٹا سائنس

- اعداد و شمار پر مبنی ہے

- ڈیٹا بیس

- ڈیٹاسیٹس

- تواریخ

- دہائی

- دہائیوں

- فیصلہ کیا

- فیصلہ کرنا

- وقف

- سمجھا

- کی وضاحت

- ڈیمانڈ

- demonstrated,en

- ثبوت

- انحصار کرتا ہے

- تعیناتی

- تعینات

- بیان

- بیان

- مطلوبہ

- تفصیلی

- تفصیلات

- یہ تعین

- ڈیولپر

- ترقی

- ترقی

- مختلف

- براہ راست

- براہ راست

- ڈائریکٹرز

- بات چیت

- بات چیت

- ڈوبکی

- متنوع

- do

- ڈومین

- ڈومینز

- نہیں

- ڈبل چیکنگ

- نیچے

- ڈرائیونگ

- دو

- کے دوران

- متحرک

- ہر ایک

- اس سے قبل

- آسان

- ماحول

- تعلیم

- موثر

- کارکردگی

- ہنر

- مؤثر طریقے سے

- کوشش

- کوششوں

- یا تو

- عناصر

- اہلیت

- ختم کرنا

- کرنڈ

- ملازم

- کے قابل بناتا ہے

- آخر

- آخر سے آخر تک

- ختم

- مشغول

- مصروفیت

- انجنیئرنگ

- کافی

- کو یقینی بنانے کے

- لیس

- مساوی

- ای ایس جی۔

- خاص طور پر

- قائم کرو

- کا جائزہ لینے

- تشخیص

- بھی

- واقعات

- ہر کوئی

- مثال کے طور پر

- مثال کے طور پر

- موجودہ

- توقع ہے

- توقع

- مہنگی

- تجربہ

- تجربہ

- تجربات

- ماہر

- مہارت

- وضاحت کی

- ایکسپریس

- اظہار

- توسیع

- بیرونی

- نکالنے

- نکالنے

- سامنا

- سہولت

- عوامل

- تیز رفتار

- سازگار

- ممکن

- چند

- میدان

- قطعات

- بھرنے

- فلٹر

- فائنل

- آخر

- مالی

- مالیاتی ڈیٹا

- پہلا

- لچک

- بہاؤ

- توجہ مرکوز

- پر عمل کریں

- کے بعد

- کے لئے

- فارمیٹ

- آگے

- فروغ

- ملا

- فاؤنڈیشن

- فریم

- فریم ورک

- فریم ورک

- مفت

- سے

- مکمل

- مکمل اسٹیک

- مکمل طور پر

- فنکشنل

- افعال

- مزید

- کھیل ہی کھیل میں

- کھیل مبدل

- GDPR

- جی ڈی پی آر تعمیل

- تیار

- جنرل

- پیدا

- پیدا

- پیدا ہوتا ہے

- پیدا کرنے والے

- نسل

- پیداواری

- پیداواری AI۔

- حاصل

- حاصل کرنے

- دے دو

- دی

- فراہم کرتا ہے

- دے

- Go

- مقصد

- اہداف

- اچھا

- عطا کی

- عظیم

- گروپ

- بڑھتے ہوئے

- تھا

- ہاتھ

- خوش

- ہے

- ہونے

- he

- ہیڈکوارٹر

- بھاری

- بھاری وزن اٹھانا

- مدد

- مدد کرتا ہے

- اس کی

- یہاں

- ہائی

- اعلی کارکردگی

- اعلی معیار کی

- اعلی

- سب سے زیادہ

- روشنی ڈالی گئی

- پر روشنی ڈالی گئی

- انتہائی

- اشارے

- ان

- تاریخ

- ہڈ

- کس طرح

- تاہم

- HTTPS

- انسانی

- انسانی پڑھنے کے قابل

- i

- خیال

- کی نشاندہی

- کی نشاندہی

- if

- تصویر

- اثر

- متاثر

- اثر انداز کرنا

- اثرات

- پر عملدرآمد

- نفاذ

- عمل درآمد

- عملدرآمد

- اثرات

- اہم

- کو بہتر بنانے کے

- in

- دیگر میں

- انکارپوریٹڈ

- شامل

- سمیت

- اضافہ

- اضافہ

- آزاد

- افراد

- صنعت

- معلومات

- انفراسٹرکچر

- ابتدائی

- ابتدائی طور پر

- اختراعات

- جدت طرازی

- ان پٹ

- آدانوں

- فوری

- اداروں

- ہدایات

- ضم

- انضمام

- ارادہ

- بات چیت

- بات چیت

- اندرونی

- آپس میں مبتلا

- میں

- بدیہی

- سرمایہ کاری

- سرمایہ کار

- سرمایہ

- ملوث

- جاری کرنے والے

- isv

- IT

- میں

- سفر

- فوٹو

- صرف

- رکھیں

- کلیدی

- جاننا

- علم

- جانا جاتا ہے

- لیبز

- جھیل

- زمین کی تزئین کی

- زبان

- بڑے

- بڑے

- آخری

- آخر میں

- تاخیر

- بعد

- تہوں

- قیادت

- معروف

- لیڈز

- سیکھا ہے

- سیکھنے

- کم سے کم

- قیادت

- اسباق

- سبق سیکھا

- سطح

- اٹھانے

- کی طرح

- پسند

- ایل ایل ایم

- منطق

- لندن

- لانگ

- دیکھو

- تلاش

- بہت

- مشین

- مشین لرننگ

- بنا

- مین

- بنیادی طور پر

- مین سٹریم میں

- برقرار رکھنے کے

- برقرار رکھنے

- بنا

- بناتا ہے

- انتظام

- میں کامیاب

- انتظام

- مینوفیکچرنگ

- بہت سے

- مارکیٹ

- مارکیٹ تجزیہ

- مارکیٹ ڈیٹا

- Markets

- ملا

- ریاضیاتی

- مئی..

- بامعنی

- مراد

- نظام

- سے ملو

- رکن

- کے ساتھ

- میٹا

- میٹا ڈیٹا

- طریقہ

- طریقہ کار

- مائکروسافٹ

- کم سے کم

- کم سے کم

- اختلاط

- ML

- ماڈل

- ماڈل

- جدید

- ماڈیولز

- زیادہ

- سب سے زیادہ

- زیادہ تر

- منتقل

- بہت

- کثیر

- ایک سے زیادہ

- نام

- مقامی

- قدرتی

- قدرتی زبان عملیات

- فطرت، قدرت

- ضروری

- ضرورت ہے

- ضرورت

- منفی طور پر

- نیٹ ورکنگ

- نئی

- NY

- اگلے

- نہیں

- براہ مہربانی نوٹ کریں

- اشارہ

- اب

- تعداد

- تعداد

- مقصد

- واضح

- of

- بند

- کی پیشکش کی

- تجویز

- افسران

- دفاتر

- اکثر

- on

- ایک

- صرف

- کھول

- اوپن سورس

- زیادہ سے زیادہ

- اصلاح کے

- کی اصلاح کریں

- اصلاح

- اصلاح

- آپشنز کے بھی

- or

- آرکیسٹریٹنگ

- آرکیسٹرا

- حکم

- اصل

- دیگر

- ہمارے

- پیداوار

- پر

- مجموعی طور پر

- مجموعی جائزہ

- زبردست

- خود

- ملکیت

- ملکیت

- پیرامیٹرز

- حصہ

- خاص طور پر

- منظور

- جذبہ

- پیٹنٹ

- پیٹنٹ

- راستہ

- انجام دیں

- کارکردگی

- کارکردگی کا مظاہرہ

- لینے

- ٹکڑے ٹکڑے

- پلیٹ فارم

- پلاٹا

- افلاطون ڈیٹا انٹیلی جنس

- پلیٹو ڈیٹا

- کھیلیں

- پوائنٹ

- پوائنٹس

- مثبت

- ممکن

- پوسٹ

- ممکنہ

- طاقت

- اختیارات

- طریقوں

- کو ترجیح دی

- حال (-)

- پیش

- کی روک تھام

- قیمت

- اصولوں پر

- کی رازداری

- پرائیویسی اور سیکورٹی

- عمل

- پروسیسنگ

- پیدا

- تیار

- حاصل

- پیشہ ورانہ

- گہرا

- منصوبے

- منصوبوں

- اشارہ کرتا ہے

- ثبوت

- تصور کا ثبوت

- مناسب

- ملکیت

- ثابت ہوا

- فراہم

- فراہم

- فراہم کرتا ہے

- فراہم کرنے

- عوامی

- عوامی کمپنیوں

- عوامی طور پر

- مقصد

- ڈال

- سوال و جواب

- معیار

- سوالات

- سوال

- جلدی سے

- واوین

- رینکنگ

- بلکہ

- RE

- تیار

- حقیقی دنیا

- احساس ہوا

- وصول

- سفارش کی

- ریکارڈ

- حوالہ دینا۔

- باضابطہ

- تعلقات

- تعلقات

- متعلقہ

- رپورٹیں

- نمائندے

- نمائندگی

- کی نمائندگی کرتا ہے

- کی ضرورت

- ضرورت

- ضروریات

- وسائل

- قابل احترام

- احترام

- جواب

- جوابات

- محدود

- نتائج کی نمائش

- آمدنی

- واپس

- جائزہ لیں

- ٹھیک ہے

- خطرات

- کردار

- کردار

- کمرہ

- منہاج القرآن

- قوانین

- رن

- چلتا ہے

- اسی

- مطمئن

- سے مطمئن ہونا

- محفوظ کریں

- کا کہنا ہے کہ

- اسکیل ایبلٹی

- پیمانے

- سائنس

- فیرنا

- ہموار

- بغیر کسی رکاوٹ کے

- تلاش کریں

- دوسری

- سیکنڈ

- سیکشن

- محفوظ بنانے

- سیکورٹی

- دیکھنا

- انتخاب

- بیچنے والے

- بھیجنے

- سینئر

- احساس

- علیحدہ

- سیریز

- بے سرور

- سروس

- سروسز

- مقرر

- سیٹ

- کئی

- تشکیل دینا۔

- شیئر ہولڈر

- شیئردارکوں

- وہ

- ہونا چاہئے

- سے ظاہر ہوا

- دکھایا گیا

- شوز

- اہم

- سادہ

- سادہ

- آسان

- آسان بنانے

- آسان بنانا

- ایک

- سائز

- سائز

- چھوٹے

- ہوشیار

- ہوشیار

- سافٹ ویئر کی

- سوفٹ ویئر کی نشوونما

- حل

- حل

- کچھ

- بہتر

- ماخذ

- ذرائع

- تناؤ

- پھیلا ہوا ہے

- بولی

- ماہرین

- مہارت دیتا ہے

- مخصوص

- خاص طور پر

- استحکام

- ڈھیر لگانا

- اسٹیج

- دائو

- کھڑے ہیں

- کھڑا ہے

- شروع کریں

- شروع

- شروع

- بیان

- رہنا

- مرحلہ

- مراحل

- اسٹاک

- اسٹاک مارکیٹ

- ذخیرہ

- پردہ

- براہ راست

- حکمت عملی

- ساخت

- منظم

- بعد میں

- کامیابی

- کامیابی کے ساتھ

- اس طرح

- کافی

- موزوں

- سویٹ

- مختصر

- خلاصہ

- حمایت

- کی حمایت کرتا ہے

- نگرانی

- سوئچ کریں

- نحو

- کے نظام

- ٹیبل

- موزوں

- لے لو

- لیا

- لیتا ہے

- لینے

- ٹاسک

- کاموں

- ٹیم

- ٹیک

- ٹیکنیکل

- تکنیک

- ٹیکنالوجی

- ٹیلی کام

- کہہ

- سانچے

- ٹیسٹ

- ٹیسٹنگ

- ٹیسٹ

- متن

- سے

- شکریہ

- کہ

- ۔

- دارالحکومت

- ان

- تو

- وہاں.

- یہ

- وہ

- سوچنا

- اس

- تین

- کے ذریعے

- بھر میں

- وقت

- وقت کا سلسلہ

- اوقات

- ٹائٹین

- کرنے کے لئے

- آج کا

- مل کر

- ٹوکن

- ٹوکن

- بھی

- کے آلے

- اوزار

- موضوع

- ٹورنٹو

- کی طرف

- ٹرین

- تربیت یافتہ

- ٹریننگ

- ٹرانزیکشن

- معاملات

- تبدیل

- سفر

- سچ

- بھروسہ رکھو

- ٹرن

- دو

- قسم

- اقسام

- عام طور پر

- قابل نہیں

- کے تحت

- بنیادی

- سمجھ

- افہام و تفہیم

- سمجھتا ہے۔

- سمجھا

- منفرد

- غیر مقفل

- غیر ضروری

- us

- استعمال کی شرائط

- استعمال کیس

- استعمال کیا جاتا ہے

- رکن کا

- صارف دوست

- کا استعمال کرتے ہوئے

- استعمال کرتا ہے

- درست

- توثیق

- قیمت

- مختلف اقسام کے

- مختلف

- وینڈر

- توثیق

- تصدیق

- اس بات کی تصدیق

- بہت

- قابل عمل

- لنک

- مجازی

- نقطہ نظر

- چلنا

- چاہتے تھے

- تھا

- راستہ..

- we

- ویب

- ویب خدمات

- Webinars

- ویب سائٹ

- اچھا ہے

- چلا گیا

- تھے

- مغربی

- کیا

- وہیل

- جب

- جبکہ

- جس

- جبکہ

- گے

- ساتھ

- کے اندر

- بغیر

- خواتین

- الفاظ

- کام

- کام کیا

- کام کا بہاؤ

- کام کر

- قابل

- گا

- لکھنا

- کوڈ لکھیں

- XML

- ابھی

- یارک

- تم

- اور

- یو ٹیوب پر

- زیفیرنیٹ